使用 Red Hat OpenStack Platform 部署和管理 OpenShift Data Foundation

在 Red Hat OpenStack Platform 上部署和管理 OpenShift Data Foundation 的说明

摘要

使开源包含更多

红帽致力于替换我们的代码、文档和 Web 属性中存在问题的语言。我们从这四个术语开始:master、slave、黑名单和白名单。由于此项工作十分艰巨,这些更改将在即将推出的几个发行版本中逐步实施。详情请查看 CTO Chris Wright 的信息。

对红帽文档提供反馈

我们感谢您对文档提供反馈信息。请告诉我们如何让它更好。

要提供反馈,请创建一个 Bugzilla ticket:

- 进入 Bugzilla 网站。

- 在 Component 部分中,选择 文档。

- 在 Description 中输入您要提供的信息。包括文档相关部分的链接。

- 点 Submit Bug。

前言

Red Hat OpenShift Data Foundation 4.8 支持使用 Red Hat OpenStack Platform 集群在现有 Red Hat OpenShift Container Platform (RHOCP) 上部署。

Red Hat OpenStack Platform 支持内部和外部 OpenShift Data Foundation 集群。如需有关部署要求的更多信息,请参阅规划部署。

要部署 OpenShift Data Foundation,请从准备部署 OpenShift Data Foundation 章节的要求开始,并根据您的要求遵循适当的部署流程:

第 1 章 准备部署 OpenShift 数据基础

使用动态存储设备在 OpenShift Container Platform 上部署 OpenShift Data Foundation 为您提供创建内部集群资源的选项。这将会在内部置备基础服务,这有助于为应用提供额外的存储类。

在开始部署 Red Hat OpenShift Data Foundation 前,请按照以下步骤执行:

可选:如果要使用外部密钥管理系统 (KMS) HashiCorp Vault 启用集群范围加密,请按照以下步骤执行:

- 确定您有有效的 Red Hat OpenShift Data Foundation Advanced 订阅。要了解 OpenShift Data Foundation 订阅如何工作,请参阅与 OpenShift Data Foundation 订阅相关的知识库文章。

- 当为加密选择 Token 验证方法时,请参考使用 KMS 通过 Token 身份验证启用集群范围的加密。

- 当为加密选择了 Kubernetes 验证方法时,请参考使用 KMS 使用 Kubernetes 身份验证启用集群范围的加密。

- 确保您在 Vault 服务器上使用签名的证书。

可选: 如果要使用外部密钥管理系统 (KMS) Thales CipherTrust Manager 启用集群范围的加密,您必须首先启用密钥管理互操作性协议 (KMIP),并在服务器上使用签名证书。按照以下步骤操作:

如果 KMIP 客户端不存在,请创建一个。在用户界面中,选择 KMIP → Client Profile → Add Profile。

-

在创建配置集的过程中,将

CipherTrust用户名添加到 Common Name 字段中。

-

在创建配置集的过程中,将

- 通过进入到 KMIP → Registration Token → New Registration Token 来创建令牌。为下一步复制令牌。

- 要注册客户端,请进入到 KMIP → Registered Clients → Add Client。指定名称。粘贴上一步中的注册令牌,然后点保存。

- 点 Save Private Key 和 Save Certificate 下载私钥和客户端证书。

要创建新的 KMIP 接口,请进入到 Admin Settings → Interfaces → Add Interface。

- 选择 KMIP Key Management Interoperability Protocol 并点 Next。

- 选择一个空闲端口。

- 为 Network Interface 选择 all。

- 为 Interface Mode 选择 TLS, verify client cert, user name taken from client cert, auth request is optional。

- (可选)您可以在密钥被删除时启用硬删除以删除元数据和材料。它默认是禁用的。

- 选择要使用的 CA,然后点 Save。

- 要获取服务器 CA 证书,请点新创建的界面右侧的 Action 菜单(⋮),然后点 Download Certificate。

可选: 如果要在部署过程中启用 StorageClass 加密,请创建一个密钥来充当密钥加密密钥 (KEK):

- 进入到 Keys → Add Key。

- 输入 Key Name。

- 分别将 Algorithm 和 Size 设置为 AES 和 256。

- 启用 Create a key in Pre-Active state,并设置激活的日期和时间。

- 确保在 Key Usage 下启用了 Encrypt 和 Decrypt。

- 复制新创建的密钥的 ID,以在部署过程中用作唯一标识符。

启动节点最低要求

当不符合标准部署资源要求时,将使用最低配置部署 OpenShift Data Foundation 集群。请参阅规划指南中的资源要求部分。

实现灾难恢复的要求 [技术预览]

Red Hat OpenShift Data Foundation 支持的灾难恢复功能需要满足以下所有先决条件,才能成功实施灾难恢复解决方案:

- 有效的 Red Hat OpenShift Data Foundation 高级订阅

有效的 Red Hat Advanced Cluster Management for Kubernetes 订阅

要了解 OpenShift Data Foundation 订阅如何工作,请参阅与 OpenShift Data Foundation 订阅相关的知识库文章。

如需更多信息,请参阅 Configuring OpenShift Data Foundation Disaster Recovery for OpenShift Workloads 指南,以及 Red Hat Advanced Cluster Management for Kubernetes 文档中的安装指南中的 Requirements and recommendations 部分。

第 2 章 以内部模式在 Red Hat OpenStack Platform 上部署 OpenShift Data Foundation

使用 Red Hat OpenStack Platform 安装程序置备的基础架构 (IPI) 提供的动态存储设备在 OpenShift Container Platform 上部署 OpenShift Data Foundation 可让您创建内部集群资源。这会导致在内部置备基础服务,这有助于为应用提供额外的存储类。

确保已满足 准备部署 OpenShift Data Foundation 章节的要求,然后按照以下步骤使用动态存储设备进行部署:

2.1. 安装 Red Hat OpenShift Data Foundation Operator

您可以使用 Red Hat OpenShift Container Platform Operator Hub 安装 Red Hat OpenShift Data Foundation Operator。

先决条件

-

使用具有

cluster-admin和 operator 安装权限的账户访问 OpenShift Container Platform 集群。 - 您必须在 Red Hat OpenShift Container Platform 集群中至少有三个 worker 节点。每个节点都应该包含一个磁盘,需要 3 个磁盘(PV)。但是,一个 PV 最终会默认未使用。这是预期的行为。

- 有关其他资源要求,请参阅规划您的部署指南。

当您需要覆盖 OpenShift Data Foundation 的集群范围默认节点选择器时,您可以使用以下命令为

openshift-storage命名空间指定空白节点选择器(在这种情况下创建openshift-storage命名空间):$ oc annotate namespace openshift-storage openshift.io/node-selector=

-

将节点作为

infra污点,以确保只在该节点上调度 Red Hat OpenShift Data Foundation 资源。这有助于您节省订阅成本。如需更多信息,请参阅管理和分配存储资源指南中的如何将专用 worker 节点用于 Red Hat OpenShift Data Foundation 部分。

流程

- 登录 OpenShift Web 控制台。

- 点 Operators → OperatorHub。

-

在 Filter by keyword 框中滚动或键入

OpenShift Data Foundation,以查找 OpenShift Data Foundation Operator。 - 点 Install。

在 Install Operator 页面中设置以下选项:

- 更新频道为 stable-4.12。

- 安装模式是 A specific namespace on the cluster。

-

Installed Namespace 为 Operator recommended namespace openshift-storage。如果命名空间

openshift-storage不存在,它会在 Operator 安装过程中创建。 将 Approval Strategy 选为 Automatic 或 Manual。

如果选择 Automatic 更新,Operator Lifecycle Manager(OLM)将自动升级 Operator 的运行实例,而无需任何干预。

如果选择 手动 更新,则 OLM 会创建一个更新请求。作为集群管理员,您必须手动批准该更新请求,才能将 Operator 更新至更新的版本。

- 确保为 Console 插件 选择了 Enable 选项。

- 点 Install。

验证步骤

-

成功安装 Operator 后,用户界面中会显示一个带有

Web console update is available信息的弹出窗口。点这个弹出窗口中的 Refresh web console 来反映控制台的更改。 在 Web 控制台中:

- 进入到 Installed Operators,再验证 OpenShift Data Foundation Operator 是否显示绿色勾号,指示安装成功。

- 进入到 Storage,再验证 Data Foundation 仪表板是否可用。

2.2. 使用 Token 验证方法通过 KMS 启用集群范围的加密

您可以在密码库中启用用于令牌身份验证的键值后端路径和策略。

先决条件

- 管理员对 vault 的访问权限。

- 有效的 Red Hat OpenShift Data Foundation 高级订阅。如需更多信息,请参阅 OpenShift Data Foundation 订阅中的知识库文章。

-

仔细选择唯一路径名称作为遵循命名惯例的后端

路径,因为它无法在以后更改。

流程

在密码库中启用 Key/Value(KV)后端路径。

对于 vault KV 机密引擎 API,版本 1:

$ vault secrets enable -path=odf kv

对于 vault KV 机密引擎 API,版本 2:

$ vault secrets enable -path=odf kv-v2

创建策略来限制用户在 secret 上执行写入或删除操作:

echo ' path "odf/*" { capabilities = ["create", "read", "update", "delete", "list"] } path "sys/mounts" { capabilities = ["read"] }'| vault policy write odf -创建与上述策略匹配的令牌:

$ vault token create -policy=odf -format json

2.3. 使用 Kubernetes 身份验证方法通过 KMS 启用集群范围的加密

您可以使用密钥管理系统(KMS)为集群范围的加密启用 Kubernetes 验证方法。

先决条件

- 管理员对 Vault 的访问权限。

- 有效的 Red Hat OpenShift Data Foundation 高级订阅。如需更多信息,请参阅 OpenShift Data Foundation 订阅中的知识库文章。

- OpenShift Data Foundation 操作器必须从 Operator Hub 安装。

-

仔细选择唯一路径名称作为后端

路径,请仔细选择命名规则。您不能在以后更改此路径名称。

流程

创建服务帐户:

$ oc -n openshift-storage create serviceaccount <serviceaccount_name>

其中,

<serviceaccount_name>指定服务帐户的名称。例如:

$ oc -n openshift-storage create serviceaccount odf-vault-auth

创建

clusterrolebindings和clusterroles:$ oc -n openshift-storage create clusterrolebinding vault-tokenreview-binding --clusterrole=system:auth-delegator --serviceaccount=openshift-storage:_<serviceaccount_name>_

例如:

$ oc -n openshift-storage create clusterrolebinding vault-tokenreview-binding --clusterrole=system:auth-delegator --serviceaccount=openshift-storage:odf-vault-auth

为

serviceaccount令牌和 CA 证书创建 secret。$ cat <<EOF | oc create -f - apiVersion: v1 kind: Secret metadata: name: odf-vault-auth-token namespace: openshift-storage annotations: kubernetes.io/service-account.name: <serviceaccount_name> type: kubernetes.io/service-account-token data: {} EOF其中,

<serviceaccount_name>是上一步中创建的服务帐户。从 secret 获取令牌和 CA 证书。

$ SA_JWT_TOKEN=$(oc -n openshift-storage get secret odf-vault-auth-token -o jsonpath="{.data['token']}" | base64 --decode; echo) $ SA_CA_CRT=$(oc -n openshift-storage get secret odf-vault-auth-token -o jsonpath="{.data['ca\.crt']}" | base64 --decode; echo)检索 OCP 集群端点。

$ OCP_HOST=$(oc config view --minify --flatten -o jsonpath="{.clusters[0].cluster.server}")获取服务帐户签发者:

$ oc proxy & $ proxy_pid=$! $ issuer="$( curl --silent http://127.0.0.1:8001/.well-known/openid-configuration | jq -r .issuer)" $ kill $proxy_pid

使用上一步中收集的信息在 Vault 中设置 Kubernetes 身份验证方法:

$ vault auth enable kubernetes

$ vault write auth/kubernetes/config \ token_reviewer_jwt="$SA_JWT_TOKEN" \ kubernetes_host="$OCP_HOST" \ kubernetes_ca_cert="$SA_CA_CRT" \ issuer="$issuer"重要当签发者为空时,在 Vault 中配置 Kubernetes 验证方法:

$ vault write auth/kubernetes/config \ token_reviewer_jwt="$SA_JWT_TOKEN" \ kubernetes_host="$OCP_HOST" \ kubernetes_ca_cert="$SA_CA_CRT"在 Vault 中启用 Key/Value(KV)后端路径。

对于 Vault KV secret 引擎 API,版本 1:

$ vault secrets enable -path=odf kv

对于 Vault KV secret 引擎 API,版本 2:

$ vault secrets enable -path=odf kv-v2

创建策略来限制用户在 secret 上执行

写入或删除操作:echo ' path "odf/*" { capabilities = ["create", "read", "update", "delete", "list"] } path "sys/mounts" { capabilities = ["read"] }'| vault policy write odf -生成角色:

$ vault write auth/kubernetes/role/odf-rook-ceph-op \ bound_service_account_names=rook-ceph-system,rook-ceph-osd,noobaa \ bound_service_account_namespaces=openshift-storage \ policies=odf \ ttl=1440h在创建存储系统期间配置 KMS 连接详情时,会稍后使用角色

odf-rook-ceph-op。$ vault write auth/kubernetes/role/odf-rook-ceph-osd \ bound_service_account_names=rook-ceph-osd \ bound_service_account_namespaces=openshift-storage \ policies=odf \ ttl=1440h

2.4. 创建 OpenShift Data Foundation 集群

安装 OpenShift Data Foundation 操作器(operator)后,创建 OpenShift Data Foundation。

先决条件

- OpenShift Data Foundation 操作器必须从 Operator Hub 安装。如需更多信息,请参阅使用 Operator Hub 安装 OpenShift Data Foundation Operator。

流程

在 OpenShift Web 控制台中,点 Operators → Installed Operators 查看所有已安装的 Operator。

确保所选 项目 为

openshift-storage。- 点 OpenShift Data Foundation 操作器,然后单击 Create StorageSystem。

在 Backing storage 页面中,选择以下内容:

- 为 Deployment 类型选项选择 Full Deployment。

- 选择 Use a existing StorageClass 选项。

选择 Storage Class。

默认情况下,设置为

standard。- 点 Next。

在 Capacity and nodes 页面中,提供必要的信息:

从下拉列表中选择 Requested Capacity 的值。默认设置为

2 TiB。注意选择初始存储容量后,集群扩展将使用所选的可用容量(原始存储的三倍)执行。

- 在 Select Nodes 部分中,选择至少三个可用节点。

可选:选中 Taint nodes 复选框,以将所选节点专用于 OpenShift Data Foundation。

对于具有多个可用区的云平台,请确保节点分布在不同的位置/可用性区域。

如果选择的节点与聚合的 30 个 CPU 和 72 GiB RAM 的 OpenShift Data Foundation 集群要求不匹配,则会部署最小的集群。如需最低起始节点要求,请参阅 规划指南中的资源要求部分。

- 点 Next。

可选:在 Security and network 页面中,根据您的要求进行配置:

- 若要启用加密,可选择为块存储和文件存储启用数据加密。

选择其中一个加密级别或两个都选:

集群范围的加密

加密整个集群(块和文件)。

StorageClass 加密

使用启用加密的存储类创建加密的持久性卷(仅块)。

可选:选择 Connect to an external key management service 复选框。这是集群范围加密的可选选项。

- 从 Key Management Service Provider 下拉列表中,选择 Vault 或 Thales CipherTrust Manager (using KMIP)。如果选择了 Vault,请进入下一步。如果您选择了 Thales CipherTrust Manager (using KMIP),请转到步骤 iii。

选择身份验证方法。

- 使用令牌验证方法

- 输入唯一的连接名称 , Vault 服务器的主机地址('https://<hostname 或 ip>'),端口号和令牌。

展开 Advanced Settings,以根据您的

Vault配置输入其他设置和证书详情:- 在 后端路径中输入为 OpenShift Data Foundation 专用且唯一的 Key Value secret 路径。

- (可选)输入 TLS 服务器名称和 Vault Enterprise 命名空间。

- 上传对应的 PEM 编码证书文件,以提供 CA 证书、客户端证书和客户端私钥。

- 点 Save 并跳过步骤 iv。

- 使用 Kubernetes 验证方法

- 输入唯一的 Vault Connection Name, Vault 服务器的主机地址('https://<hostname 或 ip>')、端口号和角色名称。

展开 Advanced Settings,以根据您的

Vault配置输入其他设置和证书详情:- 在 后端路径中输入为 OpenShift Data Foundation 专用且唯一的 Key Value secret 路径。

- 可选:输入 TLS Server Name 和 Authentication Path (如果适用)。

- 上传对应的 PEM 编码证书文件,以提供 CA 证书、客户端证书和客户端私钥。

- 点 Save 并跳过步骤 iv。

要使用 Thales CipherTrust Manager (using KMIP) 作为 KMS 供应商,请按照以下步骤执行:

- 在项目中输入密钥管理服务的唯一连接名称。

在 Address 和 Port 部分中,输入 Thales CipherTrust Manager 的 IP 以及在其中启用了 KMIP 接口的端口。例如:

- 地址: 123.34.3.2

- 端口 :5696

- 上传 客户端证书、CA 证书和 客户端私钥。

- 如果启用了 StorageClass 加密,请输入用于加密和解密的唯一标识符。

-

TLS Server 字段是可选的,并在没有 KMIP 端点的 DNS 条目时使用。例如,

kmip_all_<port>.ciphertrustmanager.local。

- 选择 网络。

- 点 Next。

在 Review and create 页面中,检查配置详情。

若要修改任何配置设置,请单击 Back。

- 单击 Create StorageSystem。

验证步骤

验证已安装存储集群的最终状态:

- 在 OpenShift Web 控制台中,导航到 Installed Operators → OpenShift Data Foundation → Storage System → ocs-storagecluster-storagesystem → Resources。

-

验证

StorageCluster的Status是否为Ready,并且旁边有一个绿色勾号标记。

- 要验证 OpenShift Data Foundation 是否已成功安装,请参阅验证您的 OpenShift Data Foundation 部署。

其他资源

要启用 Overprovision Control 警报,请参阅 Monitoring 中的 Alerts 指南。

2.5. 验证 OpenShift Data Foundation

使用本节验证 OpenShift Data Foundation 是否已正确部署。

2.5.1. 验证 pod 的状态

流程

- 从 OpenShift Web 控制台点 Workloads → Pods。

从 Project 下拉列表中选择

openshift-storage。注意如果禁用 Show default projects 选项,请使用切换按钮列出所有默认项目。

有关每个组件预期的 pod 数量及其变化取决于节点数量的更多信息,请参阅 表 2.1 “对应 OpenShift Data Foundation 集群的 Pod”。

为 Running 和 Completed pod 设置过滤器,以验证以下 pod 是否处于

Running和Completed状态:表 2.1. 对应 OpenShift Data Foundation 集群的 Pod

组件 对应的 pod OpenShift Data Foundation Operator

-

ocs-operator114(任何存储节点上 1 个 pod) -

ocs-metrics-exporter(任何存储节点上 1 个 pod) -

odf-operator-controller-manager-*(任何存储节点上 1 个 pod) -

odf-console-*任何存储节点上 1 个 pod) -

csi-addons-controller-manager-*(任何存储节点上 1 个 pod)

Rook-ceph Operator

rook-ceph-operator-*(任何存储节点上的 1 个 pod)

多云对象网关

-

noobaa-operator-*(任何存储节点上 1 个 pod) -

noobaa-core-*(任何存储节点上 1 个 pod) -

noobaa-db-pg-*(任何存储节点上 1 个 pod) -

noobaa-endpoint-*(任何存储节点上 1 个 pod)

MON

rook-ceph-mon-*(在存储节点间分布 3 个 pod)

MGR

rook-ceph-mgr-*(任何存储节点上的 1 个 pod)

MDS

rook-ceph-mds-ocs-storagecluster-cephfilesystem-*(2 个 pod 在存储节点间分布)

CSI

cephfs-

csi-cephfsplugin-*(每个存储节点上 1 个 pod) -

csi-cephfsplugin-provisioner-*(2 个 pod 在存储节点间分布)

-

rbd-

csi-rbdplugin-*(每个存储节点上 1 个 pod) -

csi-rbdplugin-provisioner-*(2 个 pod 在存储节点间分布)

-

rook-ceph-crashcollector

rook-ceph-crashcollector-*(每个存储节点上 1 个 pod)

OSD

-

rook-ceph-osd-*(每个设备 1 个 pod) -

rook-ceph-osd-prepare-ocs-deviceset-*(每个设备 1 个 pod)

-

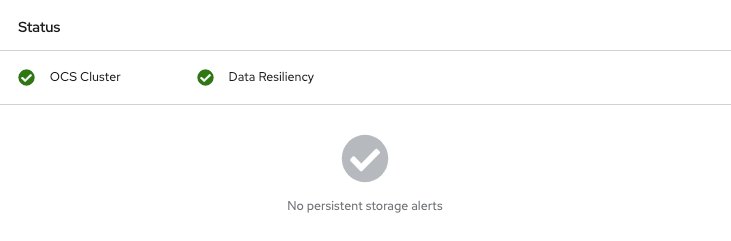

2.5.2. 验证 OpenShift Data Foundation 集群是否健康

流程

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

- 在 Overview 选项卡的 Status 卡中,点 Storage System,然后点弹出框中的存储系统链接。

- 在 Block and File 选项卡的 Status 卡中,验证 Storage Cluster 是否具有绿色勾号。

- 在 Details 卡中,验证是否显示集群信息。

如需有关使用 Block and File 仪表板的 OpenShift Data Foundation 集群健康的更多信息,请参阅 监控 OpenShift Data Foundation。

2.5.3. 验证 Multicloud 对象网关是否健康

流程

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

在 Overview 选项卡的 Status 卡中,点 Storage System,然后点弹出框中的存储系统链接。

- 在 Object 选项卡的 Status 卡 中,验证 Object Service 和数据弹性 都具有绿色勾号。

- 在 Details 卡中,验证是否显示了 MCG 信息。

如需有关使用对象服务仪表板的 OpenShift Data Foundation 集群健康的更多信息,请参阅监控 OpenShift Data Foundation。

2.5.4. 验证特定的存储类是否存在

流程

- 从 OpenShift Web 控制台左侧窗格中,点击 Storage → Storage Classes。

验证是否在创建 OpenShift Data Foundation 集群时创建了以下存储类:

-

ocs-storagecluster-ceph-rbd -

ocs-storagecluster-cephfs -

openshift-storage.noobaa.io

-

2.6. 卸载 OpenShift Data Foundation

2.6.1. 以内部模式卸载 OpenShift Data Foundation

要以内部模式卸载 OpenShift Data Foundation,请参阅 有关卸载 OpenShift Data Foundation 的知识库文章。

第 3 章 以外部模式在 Red Hat OpenStack Platform 上部署 OpenShift Data Foundation

Red Hat OpenShift Data Foundation 可以使用外部托管的 Red Hat Ceph Storage (RHCS) 集群作为 Red Hat OpenStack Platform 上的存储供应商。如需更多信息,请参阅规划部署。

有关如何安装 RHCS 集群的说明,请参阅安装指南。

按照以下步骤,以外部模式部署 OpenShift Data Foundation:

3.1. 安装 Red Hat OpenShift Data Foundation Operator

您可以使用 Red Hat OpenShift Container Platform Operator Hub 安装 Red Hat OpenShift Data Foundation Operator。

先决条件

-

使用具有

cluster-admin和 operator 安装权限的账户访问 OpenShift Container Platform 集群。 - 您必须在 Red Hat OpenShift Container Platform 集群中至少有三个 worker 节点。每个节点都应该包含一个磁盘,需要 3 个磁盘(PV)。但是,一个 PV 最终会默认未使用。这是预期的行为。

- 有关其他资源要求,请参阅规划您的部署指南。

当您需要覆盖 OpenShift Data Foundation 的集群范围默认节点选择器时,您可以使用以下命令为

openshift-storage命名空间指定空白节点选择器(在这种情况下创建openshift-storage命名空间):$ oc annotate namespace openshift-storage openshift.io/node-selector=

-

将节点作为

infra污点,以确保只在该节点上调度 Red Hat OpenShift Data Foundation 资源。这有助于您节省订阅成本。如需更多信息,请参阅管理和分配存储资源指南中的如何将专用 worker 节点用于 Red Hat OpenShift Data Foundation 部分。

流程

- 登录 OpenShift Web 控制台。

- 点 Operators → OperatorHub。

-

在 Filter by keyword 框中滚动或键入

OpenShift Data Foundation,以查找 OpenShift Data Foundation Operator。 - 点 Install。

在 Install Operator 页面中设置以下选项:

- 更新频道为 stable-4.12。

- 安装模式是 A specific namespace on the cluster。

-

Installed Namespace 为 Operator recommended namespace openshift-storage。如果命名空间

openshift-storage不存在,它会在 Operator 安装过程中创建。 将 Approval Strategy 选为 Automatic 或 Manual。

如果选择 Automatic 更新,Operator Lifecycle Manager(OLM)将自动升级 Operator 的运行实例,而无需任何干预。

如果选择 手动 更新,则 OLM 会创建一个更新请求。作为集群管理员,您必须手动批准该更新请求,才能将 Operator 更新至更新的版本。

- 确保为 Console 插件 选择了 Enable 选项。

- 点 Install。

验证步骤

-

成功安装 Operator 后,用户界面中会显示一个带有

Web console update is available信息的弹出窗口。点这个弹出窗口中的 Refresh web console 来反映控制台的更改。 在 Web 控制台中:

- 进入到 Installed Operators,再验证 OpenShift Data Foundation Operator 是否显示绿色勾号,指示安装成功。

- 进入到 Storage,再验证 Data Foundation 仪表板是否可用。

3.2. 为外部模式创建 OpenShift Data Foundation 集群

在 Red Hat OpenStack 平台上部署的 OpenShift Container Platform 上安装 OpenShift Data Foundation operator 后,需要创建新的 OpenShift Data Foundation 集群。

先决条件

- 在部署 OpenShift Data Foundation 4.12 之前,请确保 OpenShift Container Platform 版本为 4.12 或更高版本。

- 必须安装 OpenShift Data Foundation 操作器。如需更多信息,请参阅使用 Operator Hub 安装 OpenShift Data Foundation Operator。

要以外部模式检查 Red Hat Ceph Storage (RHCS) 与 Red Hat OpenShift Data Foundation 的支持性和互操作性,请转至 lab Red Hat OpenShift Data Foundation 支持性和互操作性检查器。

-

选择 Service Type 为

ODF as Self-Managed Service。 - 从下拉菜单中选择适当的 Version。

- 在 Versions 选项卡中,点 支持的 RHCS 兼容性选项卡。

-

选择 Service Type 为

如果您已将红帽 Ceph 存储集群从低于 4.1.1 的版本更新为最新版本,且不是全新部署的集群,您必须在红帽 Ceph 存储集群中手动设置 CephFS 池的应用类型,以外部模式启用 CephFS PVC 创建。

如需了解更多详细信息,请参阅在外部模式中对 CephFS PVC 创建进行故障排除。

- Red Hat Ceph Storage 必须安装并配置 Ceph 控制面板。如需更多信息,请参阅 Ceph 控制面板安装和访问。

- 红帽建议外部 Red Hat Ceph Storage 集群启用 PG Autoscaler。如需更多信息,请参阅 Red Hat Ceph Storage 文档中的放置组自动扩展部分。

- 外部 Ceph 集群应当预配置有一个现有的 RBD 池,供使用。如果不存在,请在进行 OpenShift Data Foundation 部署前,联系您的 Red Hat Ceph Storage 管理员创建一个。红帽建议为每个 OpenShift Data Foundation 集群使用单独的池。

流程

点 Operators → Installed Operators 查看所有已安装的 Operator。

确保所选 项目 为

openshift-storage。- 点 OpenShift Data Foundation → Create Instance of Storage Cluster 链接。

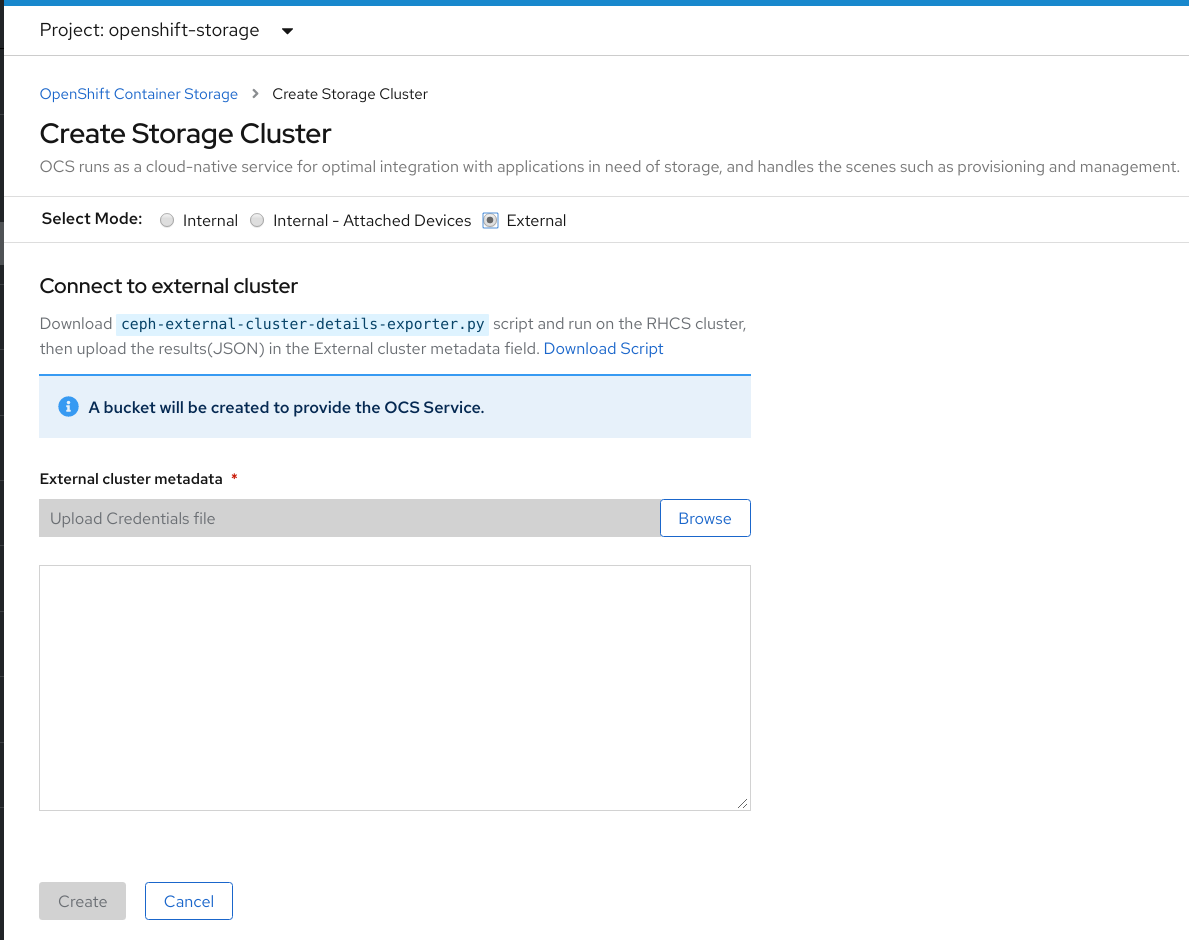

将 Mode 选择为 External。默认情况下,Internal 被选为部署模式。

图 3.1. 连接到创建存储集群表单上的外部集群部分

- 在 Connect to external cluster 部分中,单击 Download Script 链接,以下载用于提取 Ceph 集群详细信息的 python 脚本。

要提取 Red Hat Ceph Storage (RHCS) 集群详情,请联系 RHCS 管理员,以在带有

admin 密钥的 Red Hat Ceph Storage 节点上运行下载的 python 脚本。在 RHCS 节点上运行以下命令,以查看可用参数的列表:

# python3 ceph-external-cluster-details-exporter.py --help

重要如果在 Red Hat Enterprise Linux 7.x (RHEL 7.x) 集群中部署了 Red Hat Ceph Storage 4.x 集群,则使用

python而不是python3。注意您也可以从 MON 容器(容器化部署)或 MON 节点(rpm 部署)运行 脚本。

要从 RHCS 集群检索外部集群详情,请运行以下命令

# python3 ceph-external-cluster-details-exporter.py \ --rbd-data-pool-name <rbd block pool name> [optional arguments]

例如:

# python3 ceph-external-cluster-details-exporter.py --rbd-data-pool-name ceph-rbd --monitoring-endpoint xxx.xxx.xxx.xxx --monitoring-endpoint-port xxxx --rgw-endpoint xxx.xxx.xxx.xxx:xxxx --run-as-user client.ocs

在上面的示例中,

-

--RBD-data-pool-name是用于在 OpenShift Data Foundation 中提供块存储的强制参数。 -

--rgw-endpoint是可选的。如果要通过 Ceph Rados 网关为 OpenShift Data Foundation 置备对象存储,请提供此参数。使用以下格式提供端点:<ip_address>:<port> -

--monitoring-endpoint是可选的。它是可从 OpenShift 容器平台集群访问的活动ceph-mgr的 IP 地址。如果没有提供,则会自动填充该值。 -

--monitoring-endpoint-port是可选的。它是与--monitoring-endpoint指定的ceph-mgrPrometheus exporter 关联的端口。如果没有提供,则会自动填充该值。 -- run-as-user是一个可选参数,用于为 Ceph 用户提供由 脚本创建的名称。如果没有指定此参数,则会创建一个默认的用户名client.healthchecker。新用户的权限被设置为:- caps: [mgr] allow command config

- caps: [mon] allow r, allow command quorum_status, allow command version

caps: [osd] allow rwx pool=

RGW_POOL_PREFIX.rgw.meta, allow r pool=.rgw.root, allow rw pool=RGW_POOL_PREFIX.rgw.control, allow rx pool=RGW_POOL_PREFIX.rgw.log, allow x pool=RGW_POOL_PREFIX.rgw.buckets.index使用 python 脚本生成的 JSON 输出示例:

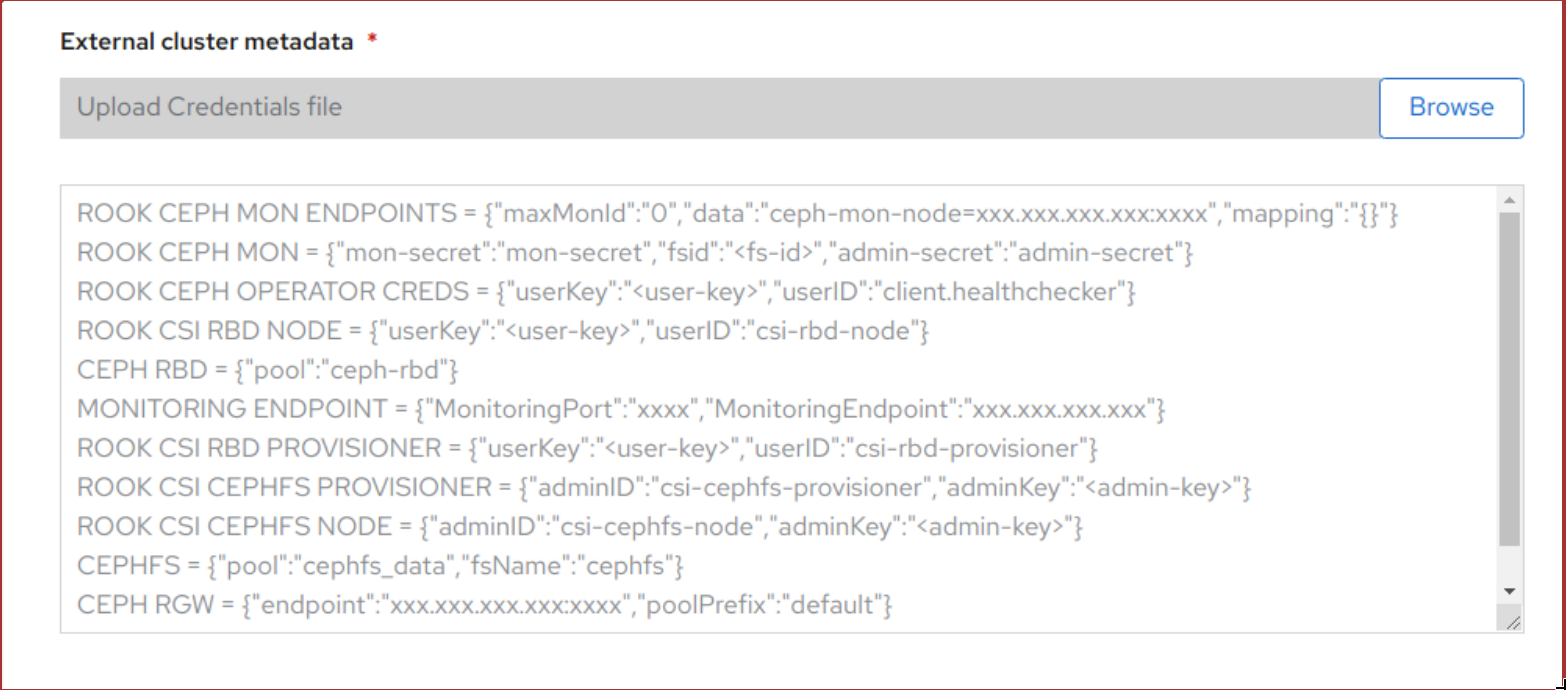

[{"name": "rook-ceph-mon-endpoints", "kind": "ConfigMap", "data": {"data": "xxx.xxx.xxx.xxx:xxxx", "maxMonId": "0", "mapping": "{}"}}, {"name": "rook-ceph-mon", "kind": "Secret", "data": {"admin-secret": "admin-secret", "fsid": "<fs-id>", "mon-secret": "mon-secret"}}, {"name": "rook-ceph-operator-creds", "kind": "Secret", "data": {"userID": "client.healthchecker", "userKey": "<user-key>"}}, {"name": "rook-csi-rbd-node", "kind": "Secret", "data": {"userID": "csi-rbd-node", "userKey": "<user-key>"}}, {"name": "ceph-rbd", "kind": "StorageClass", "data": {"pool": "ceph-rbd"}}, {"name": "monitoring-endpoint", "kind": "CephCluster", "data": {"MonitoringEndpoint": "xxx.xxx.xxx.xxx", "MonitoringPort": "xxxx"}}, {"name": "rook-csi-rbd-provisioner", "kind": "Secret", "data": {"userID": "csi-rbd-provisioner", "userKey": "<user-key>"}}, {"name": "rook-csi-cephfs-provisioner", "kind": "Secret", "data": {"adminID": "csi-cephfs-provisioner", "adminKey": "<admin-key>"}}, {"name": "rook-csi-cephfs-node", "kind": "Secret", "data": {"adminID": "csi-cephfs-node", "adminKey": "<admin-key>"}}, {"name": "cephfs", "kind": "StorageClass", "data": {"fsName": "cephfs", "pool": "cephfs_data"}}, {"name": "ceph-rgw", "kind": "StorageClass", "data": {"endpoint": "xxx.xxx.xxx.xxx:xxxx", "poolPrefix": "default"}}]

-

将 JSON 输出保存到带有

.json扩展名的文件注意要使 OpenShift Data Foundation 无缝工作,请确保使用 JSON 文件上传的参数(RGW 端点、CephFS 详细信息和 RBD 池等)在创建存储集群后在 RHCS 外部集群上保持不变。

点 External cluster metadata → Browse 来选择并上传 JSON 文件。

JSON 文件的内容填充并在文本框中显示。

图 3.2. JSON 文件内容

点 Create。

Create 按钮只有在上传

.json文件后才会启用。

验证步骤

验证已安装存储集群的最后一个 Status 显示为

Phase: Ready,并带有绿色勾号标记。- 点 Operators → Installed Operators → Storage Cluster 链接来查看存储集群安装状态。

- 另外,当使用 Operator Details 选项卡时,您可以点击 Storage Cluster 选项卡查看状态。

- 要验证 OpenShift Data Foundation、Pod 和 StorageClass 是否已成功安装,请参阅验证外部模式 OpenShift Data Foundation 安装。

3.3. 验证您的 OpenShift Data Foundation 安装的外部模式

使用本节验证 OpenShift Data Foundation 是否已正确部署。

3.3.1. 验证 pod 的状态

- 从 OpenShift Web 控制台左侧窗格中,点击 Workloads → Pods。

从 Project 下拉列表中选择

openshift-storage。注意如果禁用 Show default projects 选项,请使用切换按钮列出所有默认项目。

有关每个组件预期的 pod 数量及其变化取决于节点数量的更多信息,请参阅 表 3.1 “对应 OpenShift Data Foundation 组件的 Pod”

验证以下 pod 是否处于运行状态:

表 3.1. 对应 OpenShift Data Foundation 组件的 Pod

组件 对应的 pod OpenShift Data Foundation Operator

-

OCS-operator-*(在任何 worker 节点上有 1 个 pod) -

ocS-metrics-exporter-*(任何 worker 节点上 1 个 pod) -

odF-operator-controller-manager-*(任何 worker 节点上 1 个 pod) -

odf-console-*(任何 worker 节点上 1 个 pod) -

csi-addons-controller-manager-*(任何 worker 节点上 1 个 pod)

Rook-ceph Operator

rook-ceph-operator-*(任何 worker 节点上有 1 个 pod)

多云对象网关

-

noobaa-operator-*(任何 worker 节点上 1 个 pod) -

noobaa-core-*(任何 worker 节点上有 1 个 pod) -

noobaa-db-pg-*(任何 worker 节点上有 1 个 pod) -

noobaa-endpoint-*(任何 worker 节点上有 1 个 pod)

CSI

cephfs-

csi-cephfsplugin-*(每个 worker 节点上 1 个 pod) -

csi-cephfsplugin-provisioner-*(2 个 pod 在不同的 worker 节点上分布)

-

注意如果没有在外部集群中部署 MDS,则不会创建 csi-cephfs 插件 pod。

rbd-

csi-rbdplugin-*(每个 worker 节点上 1 个 pod) -

csi-rbdplugin-provisioner-*(2 个 pod 在不同的 worker 节点上分步)

-

-

3.3.2. 验证 OpenShift Data Foundation 集群是否健康

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

- 在 Overview 选项卡的 Status 卡中,点 Storage System,然后点弹出框中的存储系统链接。

- 在 Block and File 选项卡的 Status 卡中,验证 Storage Cluster 和 Data Resiliency 是否都具有绿色勾号。

在 Details 卡中,验证集群信息是否显示如下。

+ Service Name:: OpenShift Data Foundation Cluster Name:: ocs-external-storagecluster Provider:: OpenStack Mode:: External Version:: ocs-operator-4.12.0

有关使用 Block and File 仪表板的 OpenShift Data Foundation 健康状况的更多信息,请参阅监控 OpenShift Data Foundation。

3.3.3. 验证 Multicloud 对象网关是否健康

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

在 Overview 选项卡的 Status 卡中,点 Storage System,然后点弹出框中的存储系统链接。

- 在 Object 选项卡的 Status 卡中,验证 Object Service 和数据弹性都具有绿色勾号。

- 在 Details 卡中,验证 Multicloud Object Gateway(MCG)信息是否已显示。

RADOS 对象网关仅列出在以外部模式部署 OpenShift Data Foundation 时包含 RADOS 对象网关端点详细信息的情况。

有关使用对象仪表板的 OpenShift Data Foundation 健康状况的更多信息,请参阅监控 OpenShift Data Foundation。

3.3.4. 验证存储类是否已创建并列出

- 从 OpenShift Web 控制台左侧窗格中,点击 Storage → Storage Classes。

验证是否在创建 OpenShift Data Foundation 集群时创建了以下存储类:

-

ocs-external-storagecluster-ceph-rbd -

ocs-external-storagecluster-ceph-rgw -

ocs-external-storagecluster-cephfs -

openshift-storage.noobaa.io

-

-

如果没有在外部集群中部署 MDS,则不会创建

ocs-external-storagecluster-cephfs存储类。 -

如果没有在外部集群中部署 RGW,则不会创建

ocs-external-storagecluster-ceph-rgw存储类。

如需有关 MDS 和 RGW 的更多信息,请参阅 Red Hat Ceph Storage 文档

3.3.5. 验证 Ceph 集群是否已连接

运行以下命令,以验证 OpenShift Data Foundation 集群是否已连接到外部 Red Hat Ceph Storage 集群。

$ oc get cephcluster -n openshift-storage

NAME DATADIRHOSTPATH MONCOUNT AGE PHASE MESSAGE HEALTH ocs-external-storagecluster-cephcluster 31m15s Connected Cluster connected successfully HEALTH_OK

3.3.6. 验证存储集群是否已就绪

运行以下命令,以验证存储集群是否已就绪,并且 External 选项设为 true。

$ oc get storagecluster -n openshift-storage

NAME AGE PHASE EXTERNAL CREATED AT VERSION ocs-external-storagecluster 31m15s Ready true 2021-02-29T20:43:04Z 4.8.0

3.4. 卸载 OpenShift Data Foundation

3.4.1. 从外部存储系统卸载 OpenShift Data Foundation

使用本节中的步骤卸载 OpenShift Data Foundation。卸载 OpenShift Data Foundation 不会从外部集群中删除 RBD 池,或卸载外部 Red Hat Ceph Storage 集群。

卸载注解

Storage Cluster 上的注解用于更改卸载过程的行为。要定义卸载行为,在存储集群中引入了以下两个注解:

-

uninstall.ocs.openshift.io/cleanup-policy: delete -

uninstall.ocs.openshift.io/mode: graceful

uninstall.ocs.openshift.io/cleanup-policy 不适用于外部模式。

下表提供了有关可用于这些注解的不同值的信息:

表 3.2. uninstall.ocs.openshift.io 卸载注解描述

| 注解 | 值 | 默认值 | 行为 |

|---|---|---|---|

| cleanup-policy | delete | 是 |

Rook 清理物理驱动器和 |

| cleanup-policy | retain | 否 |

Rook 不会清理物理驱动器和 |

| 模式 | graceful | 是 | Rook 和 NooBaa 暂停卸载过程,直到管理员/用户移除 PVC 和 OBC |

| 模式 | forced | 否 | rook 和 NooBaa 会在卸载过程中继续进行,即使 PVC/OBCs 使用 Rook 和 NooBaa 置备 |

您可以通过使用以下命令编辑注解值来更改卸载模式:

$ oc annotate storagecluster ocs-external-storagecluster -n openshift-storage uninstall.ocs.openshift.io/mode="forced" --overwrite storagecluster.ocs.openshift.io/ocs-external-storagecluster annotated

先决条件

- 确保 OpenShift Data Foundation 集群处于健康状态。当因为资源或节点不足而导致部分 pod 无法成功终止时,卸载过程可能会失败。如果集群处于不健康状态,请在卸载 OpenShift Data Foundation 前联系红帽客户支持。

- 使用 OpenShift Data Foundation 提供的存储类,确保应用程序不使用持久性卷声明 (PVC) 或对象存储桶声明 (OBC)。

流程

删除使用 OpenShift Data Foundation 的卷快照。

列出所有命名空间中的卷快照

$ oc get volumesnapshot --all-namespaces

从上一命令的输出中,识别和删除使用 OpenShift Data Foundation 的卷快照。

$ oc delete volumesnapshot <VOLUME-SNAPSHOT-NAME> -n <NAMESPACE>

删除使用 OpenShift Data Foundation 的 PVC 和 OBC。

在默认的卸载模式 (graceful) 中,卸载程序会等待所有使用 OpenShift Data Foundation 的 PVC 和 OBC 被删除。

如果要事先删除 PVC 来删除存储集群,您可以将卸载模式注解设置为"强制"并跳过此步骤。这样做会导致系统中出现孤立 PVC 和 OBC。

使用 OpenShift Data Foundation 删除 OpenShift Container Platform 监控堆栈 PVC。

使用 OpenShift Data Foundation 删除 OpenShift Container Platform Registry PVC。

从 OpenShift Data Foundation 中删除 OpenShift Container Platform registry

使用 OpenShift Data Foundation 删除 OpenShift Container Platform 日志 PVC。

删除使用 OpenShift Data Foundation 置备的其他 PVC 和 OBC。

下面是一个示例脚本,用于标识使用 OpenShift Data Foundation 置备的 PVC 和 OBC。该脚本将忽略 OpenShift Data Foundation 内部使用的 PVC 和 OBC。

#!/bin/bash RBD_PROVISIONER="openshift-storage.rbd.csi.ceph.com" CEPHFS_PROVISIONER="openshift-storage.cephfs.csi.ceph.com" NOOBAA_PROVISIONER="openshift-storage.noobaa.io/obc" RGW_PROVISIONER="openshift-storage.ceph.rook.io/bucket" NOOBAA_DB_PVC="noobaa-db" NOOBAA_BACKINGSTORE_PVC="noobaa-default-backing-store-noobaa-pvc" # Find all the OCS StorageClasses OCS_STORAGECLASSES=$(oc get storageclasses | grep -e "$RBD_PROVISIONER" -e "$CEPHFS_PROVISIONER" -e "$NOOBAA_PROVISIONER" -e "$RGW_PROVISIONER" | awk '{print $1}') # List PVCs in each of the StorageClasses for SC in $OCS_STORAGECLASSES do echo "======================================================================" echo "$SC StorageClass PVCs and OBCs" echo "======================================================================" oc get pvc --all-namespaces --no-headers 2>/dev/null | grep $SC | grep -v -e "$NOOBAA_DB_PVC" -e "$NOOBAA_BACKINGSTORE_PVC" oc get obc --all-namespaces --no-headers 2>/dev/null | grep $SC echo done删除 OBC。

$ oc delete obc <obc name> -n <project name>

删除 PVC。

$ oc delete pvc <pvc name> -n <project-name>

确保您已删除了集群中创建的自定义后备存储、存储桶类等。

删除 Storage Cluster 对象并等待相关资源被删除。

$ oc delete -n openshift-storage storagesystem --all --wait=true

删除命名空间并等待删除完成。如果

openshift-storage是活跃的项目,则需要切换到另一个项目。例如:

$ oc project default $ oc delete project openshift-storage --wait=true --timeout=5m

如果以下命令返回

NotFound错误,则项目被删除。$ oc get project openshift-storage

注意卸载 OpenShift Data Foundation 时,如果没有完全删除命名空间并处于

Terminating状态,请执行 故障排除和删除 Uninstall 过程中剩余的资源 的步骤,以识别阻塞命名空间的对象。确认已删除使用 OpenShift Data Foundation 置备的所有 PV。如果有任何 PV 处于

Released状态,请将其删除。$ oc get pv $ oc delete pv <pv name>

删除

CustomResourceDefinitions。$ oc delete crd backingstores.noobaa.io bucketclasses.noobaa.io cephblockpools.ceph.rook.io cephclusters.ceph.rook.io cephfilesystems.ceph.rook.io cephnfses.ceph.rook.io cephobjectstores.ceph.rook.io cephobjectstoreusers.ceph.rook.io noobaas.noobaa.io ocsinitializations.ocs.openshift.io storageclusters.ocs.openshift.io cephclients.ceph.rook.io cephobjectrealms.ceph.rook.io cephobjectzonegroups.ceph.rook.io cephobjectzones.ceph.rook.io cephrbdmirrors.ceph.rook.io storagesystems.odf.openshift.io --wait=true --timeout=5m

确保完全卸载 OpenShift Data Foundation:

- 在 OpenShift Container Platform Web 控制台中点 Storage。

- 验证 OpenShift Data Foundation 是否不再出现在 Storage 下。

3.4.2. 从 OpenShift Data Foundation 中删除监控堆栈

使用本节清理 OpenShift Data Foundation 的监控堆栈。

在配置监控堆栈时创建的 PVC 位于 openshift-monitoring 命名空间中。

先决条件

PVC 被配置为使用 OpenShift Container Platform 监控堆栈。

如需更多信息,请参阅配置监控堆栈。

流程

列出当前在

openshift-monitoring命名空间中运行的 pod 和 PVC。$ oc get pod,pvc -n openshift-monitoring NAME READY STATUS RESTARTS AGE pod/alertmanager-main-0 3/3 Running 0 8d pod/alertmanager-main-1 3/3 Running 0 8d pod/alertmanager-main-2 3/3 Running 0 8d pod/cluster-monitoring- operator-84457656d-pkrxm 1/1 Running 0 8d pod/grafana-79ccf6689f-2ll28 2/2 Running 0 8d pod/kube-state-metrics- 7d86fb966-rvd9w 3/3 Running 0 8d pod/node-exporter-25894 2/2 Running 0 8d pod/node-exporter-4dsd7 2/2 Running 0 8d pod/node-exporter-6p4zc 2/2 Running 0 8d pod/node-exporter-jbjvg 2/2 Running 0 8d pod/node-exporter-jj4t5 2/2 Running 0 6d18h pod/node-exporter-k856s 2/2 Running 0 6d18h pod/node-exporter-rf8gn 2/2 Running 0 8d pod/node-exporter-rmb5m 2/2 Running 0 6d18h pod/node-exporter-zj7kx 2/2 Running 0 8d pod/openshift-state-metrics- 59dbd4f654-4clng 3/3 Running 0 8d pod/prometheus-adapter- 5df5865596-k8dzn 1/1 Running 0 7d23h pod/prometheus-adapter- 5df5865596-n2gj9 1/1 Running 0 7d23h pod/prometheus-k8s-0 6/6 Running 1 8d pod/prometheus-k8s-1 6/6 Running 1 8d pod/prometheus-operator- 55cfb858c9-c4zd9 1/1 Running 0 6d21h pod/telemeter-client- 78fc8fc97d-2rgfp 3/3 Running 0 8d NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE persistentvolumeclaim/my-alertmanager-claim-alertmanager-main-0 Bound pvc-0d519c4f-15a5-11ea-baa0-026d231574aa 40Gi RWO ocs-external-storagecluster-ceph-rbd 8d persistentvolumeclaim/my-alertmanager-claim-alertmanager-main-1 Bound pvc-0d5a9825-15a5-11ea-baa0-026d231574aa 40Gi RWO ocs-external-storagecluster-ceph-rbd 8d persistentvolumeclaim/my-alertmanager-claim-alertmanager-main-2 Bound pvc-0d6413dc-15a5-11ea-baa0-026d231574aa 40Gi RWO ocs-external-storagecluster-ceph-rbd 8d persistentvolumeclaim/my-prometheus-claim-prometheus-k8s-0 Bound pvc-0b7c19b0-15a5-11ea-baa0-026d231574aa 40Gi RWO ocs-external-storagecluster-ceph-rbd 8d persistentvolumeclaim/my-prometheus-claim-prometheus-k8s-1 Bound pvc-0b8aed3f-15a5-11ea-baa0-026d231574aa 40Gi RWO ocs-external-storagecluster-ceph-rbd 8d

编辑监控

configmap。$ oc -n openshift-monitoring edit configmap cluster-monitoring-config

删除引用 OpenShift Data Foundation 存储类的所有

config部分,如下例所示并保存。Before editing

. . . apiVersion: v1 data: config.yaml: | alertmanagerMain: volumeClaimTemplate: metadata: name: my-alertmanager-claim spec: resources: requests: storage: 40Gi storageClassName: ocs-external-storagecluster-ceph-rbd prometheusK8s: volumeClaimTemplate: metadata: name: my-prometheus-claim spec: resources: requests: storage: 40Gi storageClassName: ocs-external-storagecluster-ceph-rbd kind: ConfigMap metadata: creationTimestamp: "2019-12-02T07:47:29Z" name: cluster-monitoring-config namespace: openshift-monitoring resourceVersion: "22110" selfLink: /api/v1/namespaces/openshift-monitoring/configmaps/cluster-monitoring-config uid: fd6d988b-14d7-11ea-84ff-066035b9efa8 . . .After editing

. . . apiVersion: v1 data: config.yaml: | kind: ConfigMap metadata: creationTimestamp: "2019-11-21T13:07:05Z" name: cluster-monitoring-config namespace: openshift-monitoring resourceVersion: "404352" selfLink: /api/v1/namespaces/openshift-monitoring/configmaps/cluster-monitoring-config uid: d12c796a-0c5f-11ea-9832-063cd735b81c . . .

在本例中,

alertmanagerMain和prometheusK8s监控组件使用 OpenShift Data Foundation PVC。列出使用 PVC 的 pod。

在本例中,消耗 PVC 的

alertmanagerMain和prometheusK8spod 处于Terminating状态。这些 pod 不再使用 OpenShift Data Foundation PVC后,您可以删除 PVC。$ oc get pod,pvc -n openshift-monitoring NAME READY STATUS RESTARTS AGE pod/alertmanager-main-0 3/3 Terminating 0 10h pod/alertmanager-main-1 3/3 Terminating 0 10h pod/alertmanager-main-2 3/3 Terminating 0 10h pod/cluster-monitoring-operator-84cd9df668-zhjfn 1/1 Running 0 18h pod/grafana-5db6fd97f8-pmtbf 2/2 Running 0 10h pod/kube-state-metrics-895899678-z2r9q 3/3 Running 0 10h pod/node-exporter-4njxv 2/2 Running 0 18h pod/node-exporter-b8ckz 2/2 Running 0 11h pod/node-exporter-c2vp5 2/2 Running 0 18h pod/node-exporter-cq65n 2/2 Running 0 18h pod/node-exporter-f5sm7 2/2 Running 0 11h pod/node-exporter-f852c 2/2 Running 0 18h pod/node-exporter-l9zn7 2/2 Running 0 11h pod/node-exporter-ngbs8 2/2 Running 0 18h pod/node-exporter-rv4v9 2/2 Running 0 18h pod/openshift-state-metrics-77d5f699d8-69q5x 3/3 Running 0 10h pod/prometheus-adapter-765465b56-4tbxx 1/1 Running 0 10h pod/prometheus-adapter-765465b56-s2qg2 1/1 Running 0 10h pod/prometheus-k8s-0 6/6 Terminating 1 9m47s pod/prometheus-k8s-1 6/6 Terminating 1 9m47s pod/prometheus-operator-cbfd89f9-ldnwc 1/1 Running 0 43m pod/telemeter-client-7b5ddb4489-2xfpz 3/3 Running 0 10h NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE persistentvolumeclaim/ocs-alertmanager-claim-alertmanager-main-0 Bound pvc-2eb79797-1fed-11ea-93e1-0a88476a6a64 40Gi RWO ocs-external-storagecluster-ceph-rbd 19h persistentvolumeclaim/ocs-alertmanager-claim-alertmanager-main-1 Bound pvc-2ebeee54-1fed-11ea-93e1-0a88476a6a64 40Gi RWO ocs-external-storagecluster-ceph-rbd 19h persistentvolumeclaim/ocs-alertmanager-claim-alertmanager-main-2 Bound pvc-2ec6a9cf-1fed-11ea-93e1-0a88476a6a64 40Gi RWO ocs-external-storagecluster-ceph-rbd 19h persistentvolumeclaim/ocs-prometheus-claim-prometheus-k8s-0 Bound pvc-3162a80c-1fed-11ea-93e1-0a88476a6a64 40Gi RWO ocs-external-storagecluster-ceph-rbd 19h persistentvolumeclaim/ocs-prometheus-claim-prometheus-k8s-1 Bound pvc-316e99e2-1fed-11ea-93e1-0a88476a6a64 40Gi RWO ocs-external-storagecluster-ceph-rbd 19h

删除相关的 PVC。请确定删除所有消耗存储类的 PVC。

$ oc delete -n openshift-monitoring pvc <pvc-name> --wait=true --timeout=5m

3.4.3. 从 OpenShift Data Foundation 中删除 OpenShift Container Platform registry

使用这个部分从 OpenShift Data Foundation 清理 OpenShift Container Platform registry。如果要配置其他存储,请参阅 镜像 registry

作为配置 OpenShift Container Platform registry 的一部分创建的 PVC 位于 openshift-image-registry 命名空间中。

先决条件

- 镜像 registry 应配置为使用 OpenShift Data Foundation PVC。

流程

编辑

configs.imageregistry.operator.openshift.io对象,并删除 storage 部分中的内容。$ oc edit configs.imageregistry.operator.openshift.io

编辑前

. . . storage: pvc: claim: registry-cephfs-rwx-pvc . . .编辑后

. . . storage: emptyDir: {} . . .在本例中,PVC 称为

registry-cephfs-rwx-pvc,现在可以安全地删除。删除 PVC。

$ oc delete pvc <pvc-name> -n openshift-image-registry --wait=true --timeout=5m

3.4.4. 从 OpenShift Data Foundation 中删除集群日志记录操作器

使用本节从 OpenShift Data Foundation 清理集群日志记录 Operator。

在配置集群日志记录 Operator 时创建的 PVC 位于 openshift-logging 命名空间中。

先决条件

- 集群日志记录实例应该已配置为使用 OpenShift Data Foundation PVC。

流程

删除命名空间中的

ClusterLogging实例。$ oc delete clusterlogging instance -n openshift-logging --wait=true --timeout=5m

openshift-logging命名空间中的 PVC 现在可以安全地删除。删除 PVC。

$ oc delete pvc <pvc-name> -n openshift-logging --wait=true --timeout=5m<pvc-name>- 是 PVC 的名称

第 4 章 以内部模式部署独立多云对象网关

仅通过 OpenShift Data Foundation 部署多云对象网关组件可为部署提供灵活性,并有助于减少资源消耗。使用这个部分只以内部模式部署独立 Multicloud 对象网关组件,这涉及以下步骤:

- 安装 Red Hat OpenShift Data Foundation Operator

- 创建独立多云对象网关

在外部模式部署中不支持部署独立多云对象网关组件。

4.1. 安装 Red Hat OpenShift Data Foundation Operator

您可以使用 Red Hat OpenShift Container Platform Operator Hub 安装 Red Hat OpenShift Data Foundation Operator。

先决条件

-

使用具有

cluster-admin和 operator 安装权限的账户访问 OpenShift Container Platform 集群。 - 您必须在 Red Hat OpenShift Container Platform 集群中至少有三个 worker 节点。每个节点都应该包含一个磁盘,需要 3 个磁盘(PV)。但是,一个 PV 最终会默认未使用。这是预期的行为。

- 有关其他资源要求,请参阅规划您的部署指南。

当您需要覆盖 OpenShift Data Foundation 的集群范围默认节点选择器时,您可以使用以下命令为

openshift-storage命名空间指定空白节点选择器(在这种情况下创建openshift-storage命名空间):$ oc annotate namespace openshift-storage openshift.io/node-selector=

-

将节点作为

infra污点,以确保只在该节点上调度 Red Hat OpenShift Data Foundation 资源。这有助于您节省订阅成本。如需更多信息,请参阅管理和分配存储资源指南中的如何将专用 worker 节点用于 Red Hat OpenShift Data Foundation 部分。

流程

- 登录 OpenShift Web 控制台。

- 点 Operators → OperatorHub。

-

在 Filter by keyword 框中滚动或键入

OpenShift Data Foundation,以查找 OpenShift Data Foundation Operator。 - 点 Install。

在 Install Operator 页面中设置以下选项:

- 更新频道为 stable-4.12。

- 安装模式是 A specific namespace on the cluster。

-

Installed Namespace 为 Operator recommended namespace openshift-storage。如果命名空间

openshift-storage不存在,它会在 Operator 安装过程中创建。 将 Approval Strategy 选为 Automatic 或 Manual。

如果选择 Automatic 更新,Operator Lifecycle Manager(OLM)将自动升级 Operator 的运行实例,而无需任何干预。

如果选择 手动 更新,则 OLM 会创建一个更新请求。作为集群管理员,您必须手动批准该更新请求,才能将 Operator 更新至更新的版本。

- 确保为 Console 插件 选择了 Enable 选项。

- 点 Install。

验证步骤

-

成功安装 Operator 后,用户界面中会显示一个带有

Web console update is available信息的弹出窗口。点这个弹出窗口中的 Refresh web console 来反映控制台的更改。 在 Web 控制台中:

- 进入到 Installed Operators,再验证 OpenShift Data Foundation Operator 是否显示绿色勾号,指示安装成功。

- 进入到 Storage,再验证 Data Foundation 仪表板是否可用。

4.2. 创建独立多云对象网关

在部署 OpenShift Data Foundation 时,您只能创建独立多云对象网关组件。

先决条件

- 确保已安装 OpenShift Data Foundation Operator。

流程

在 OpenShift Web 控制台中,点 Operators → Installed Operators 查看所有已安装的 Operator。

确保所选 项目 为

openshift-storage。- 单击 OpenShift Data Foundation operator,然后单击 Create StorageSystem。

在 Backing storage 页面中,选择以下内容:

- 为 Deployment 类型选择 Multicloud Object Gateway。

- 选择 Use a existing StorageClass 选项。

- 点 Next。

可选:选择 Connect to an external key management service 复选框。这是集群范围加密的可选选项。

- 从 Key Management Service Provider 下拉列表中,选择 Vault 或 Thales CipherTrust Manager (using KMIP)。如果选择了 Vault,请进入下一步。如果您选择了 Thales CipherTrust Manager (using KMIP),请转到步骤 iii。

选择身份验证方法。

- 使用令牌验证方法

- 输入唯一的连接名称 , Vault 服务器的主机地址('https://<hostname 或 ip>'),端口号和令牌。

展开 Advanced Settings,以根据您的

Vault配置输入其他设置和证书详情:- 在 后端路径中输入为 OpenShift Data Foundation 专用且唯一的 Key Value secret 路径。

- (可选)输入 TLS 服务器名称和 Vault Enterprise 命名空间。

- 上传对应的 PEM 编码证书文件,以提供 CA 证书、客户端证书和客户端私钥。

- 点 Save 并跳过步骤 iv。

- 使用 Kubernetes 验证方法

- 输入唯一的 Vault Connection Name, Vault 服务器的主机地址('https://<hostname 或 ip>')、端口号和角色名称。

展开 Advanced Settings,以根据您的

Vault配置输入其他设置和证书详情:- 在 后端路径中输入为 OpenShift Data Foundation 专用且唯一的 Key Value secret 路径。

- 可选:输入 TLS Server Name 和 Authentication Path (如果适用)。

- 上传对应的 PEM 编码证书文件,以提供 CA 证书、客户端证书和客户端私钥。

- 点 Save 并跳过步骤 iv。

要使用 Thales CipherTrust Manager (using KMIP) 作为 KMS 供应商,请按照以下步骤执行:

- 在项目中输入密钥管理服务的唯一连接名称。

在 Address 和 Port 部分中,输入 Thales CipherTrust Manager 的 IP 以及在其中启用了 KMIP 接口的端口。例如:

- 地址: 123.34.3.2

- 端口 :5696

- 上传 客户端证书、CA 证书和 客户端私钥。

- 如果启用了 StorageClass 加密,请输入用于加密和解密的唯一标识符。

-

TLS Server 字段是可选的,并在没有 KMIP 端点的 DNS 条目时使用。例如,

kmip_all_<port>.ciphertrustmanager.local。

- 选择 网络。

- 点 Next。

在 Review and create 页面中,查看配置详情:

若要修改任何配置设置,请单击 Back。

- 单击 Create StorageSystem。

验证步骤

- 验证 OpenShift Data Foundation 集群是否健康

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

在 Overview 选项卡的 Status 卡中,点 Storage System,然后点弹出框中的存储系统链接。

- 在 Object 选项卡的 Status 卡 中,验证 Object Service 和数据弹性 都具有绿色勾号。

- 在 Details 卡中,验证是否显示了 MCG 信息。

- 验证 pod 的状态

- 从 OpenShift Web 控制台点 Workloads → Pods。

从 Project 下拉列表中选择

openshift-storage,再验证以下 pod 处于Running状态。注意如果禁用 Show default projects 选项,请使用切换按钮列出所有默认项目。

组件 对应的 pod OpenShift Data Foundation Operator

-

ocs-operator114(任何存储节点上 1 个 pod) -

ocs-metrics-exporter(任何存储节点上 1 个 pod) -

odf-operator-controller-manager-*(任何存储节点上 1 个 pod) -

odf-console-*任何存储节点上 1 个 pod) -

csi-addons-controller-manager-*(任何存储节点上 1 个 pod)

Rook-ceph Operator

rook-ceph-operator-*(任何存储节点上的 1 个 pod)

多云对象网关

-

noobaa-operator-*(任何存储节点上 1 个 pod) -

noobaa-core-*(任何存储节点上 1 个 pod) -

noobaa-db-pg-*(任何存储节点上 1 个 pod) -

noobaa-endpoint-*(任何存储节点上 1 个 pod)

-

第 5 章 存储类和存储池

OpenShift Data Foundation Operator 根据使用的平台安装默认存储类。这个默认存储类由 Operator 所有和控制,且无法删除或修改。但是,如果您希望存储类具有不同的行为,可以创建自定义存储类。

您可以创建多个存储池,映射到提供以下功能的存储类:

- 使具有自身高可用性的应用能够使用具有两个副本的持久卷,从而可能提高应用性能。

- 使用启用了压缩的存储类为持久性卷声明节省空间。

外部模式 OpenShift Data Foundation 集群不支持多个存储类和多个池。

使用单个设备集的最小集群,只能创建两个新的存储类。每个存储集群扩展都允许两个新的附加存储类。

5.1. 创建存储类和池

您可以使用现有池创建存储类,也可以在创建存储类时为存储类创建新池。

先决条件

-

确保您已登录到 OpenShift Container Platform Web 控制台,并且 OpenShift Data Foundation 集群处于

Ready状态。

流程

- 点 Storage → StorageClasses。

- 点 Create Storage Class。

- 输入存储类 Name 和 Description。

Reclaim Policy 设置为

Delete作为默认选项。使用这个设置。如果您在存储类中将重新声明策略改为

Retain,则持久性卷(PV)会处于Released状态,即使在删除持久性卷声明(PVC)后也是如此。卷绑定模式设置为

WaitForConsumer作为默认选项。如果您选择

Immediate选项,则创建 PVC 时会立即创建 PV。- 选择 RBD Provisioner,这是用于置备持久性卷的插件。

从列表中选择现有存储池,或创建新池。

注意默认的池不支持使用双向复制数据保护策略。但是,如果您创建了额外的池,则可以使用双向复制。

- 创建新池

- 单击 Create New Pool。

- 输入 池名称。

- 选择 2-way-Replication 或 3-way-Replication作为数据保护策略。

如果需要压缩数据,选择启用压缩。

启用压缩可能会影响应用程序的性能,在已压缩或加密的数据时可能会证明无效。在启用压缩之前写入的数据不会压缩。

- 单击 Create 以创建新存储池。

- 创建池后,单击 Finish。

- 可选:选择启用加密复选框。

- 点 Create 创建存储类。

5.2. 为持久性卷加密创建存储类

先决条件

根据您的用例,您必须确保为以下之一配置对 KMS 的访问:

-

使用

vaulttokens:确保配置了访问权限,如使用 vaulttoken 配置对 KMS 的访问所述 -

使用

vaulttenantsa(技术预览):确保配置访问权限,如使用vaulttenantsa配置对 KMS 的访问所述 - 使用 Thales CipherTrust Manager (使用 KMIP):确保配置访问权限,如使用 Thales CipherTrust Manager 配置对 KMS 的访问所述

流程

- 在 OpenShift Web 控制台中,进入 Storage → StorageClasses。

- 点 Create Storage Class。

- 输入存储类 Name 和 Description。

- 为 Reclaim Policy 选择 Delete 或 Retain。默认情况下,选择 Delete。

- 选择 Immediate 或 WaitForFirstConsumer 作为卷绑定模式。WaitForConsumer 设置为默认选项。

-

选择 RBD Provisioner

openshift-storage.rbd.csi.ceph.com,这是用于调配持久卷的插件。 - 选择 存储池,其中卷数据将存储到列表中或创建新池。

选中 Enable encryption 复选框。有两个选项可用来设置 KMS 连接详情:

Select existing KMS connection: 从下拉列表中选择现有 KMS 连接。该列表填充自

csi-kms-connection-detailsConfigMap 中的连接详情。- 从下拉菜单中选择 Provider。

- 从列表中选择给定供应商的 Key service。

创建新的 KMS 连接 :这仅适用于

vaulttoken和Thales CipherTrust Manager (using KMIP)。- 选择 Key Management Service Provider。

如果将

Vault选为 Key Management Service Provider,请按照以下步骤执行:- 输入唯一的连接名称 , Vault 服务器的主机地址('https://<hostname 或 ip>'),端口号和令牌。

展开 Advanced Settings,以根据您的

Vault配置输入其他设置和证书详情:- 在 后端路径中输入为 OpenShift Data Foundation 专用且唯一的 Key Value secret 路径。

- (可选)输入 TLS 服务器名称和 Vault Enterprise 命名空间。

- 上传对应的 PEM 编码证书文件,以提供 CA 证书、客户端证书和客户端私钥。

- 点 Save。

如果选择了

Thales CipherTrust Manager (using KMIP)作为 Key Management Service Provider,请按照以下步骤执行:- 输入唯一 连接名称。

- 在 Address 和 Port 部分中,输入 Thales CipherTrust Manager 的 IP 以及在其中启用了 KMIP 接口的端口。例如,Address: 123.34.3.2, Port: 5696.

- 上传 客户端证书、CA 证书和 客户端私钥。

- 输入在上面生成的用于加密和解密的密钥的唯一标识符。

-

TLS Server 字段是可选的,并在没有 KMIP 端点的 DNS 条目时使用。例如,

kmip_all_<port>.ciphertrustmanager.local。

- 点 Save。

- 点 Create。

如果 HashiCorp Vault 设置不允许自动检测后端路径使用的 Key/Value(KV)secret 引擎 API 版本,编辑 ConfigMap 以添加

vaultBackend参数。注意vaultBackend是一个可选参数,添加到 configmap 中,以指定与后端路径关联的 KV secret 引擎 API 版本。确保值与为后端路径设置的 KV secret 引擎 API 版本匹配,否则可能会导致持久性卷声明(PVC)创建过程中失败。识别新创建的存储类使用的 encryptionKMSID。

- 在 OpenShift Web 控制台中,导航到 Storage → Storage Classes。

- 点 Storage class name → YAML 标签页。

捕获存储类使用的 encryptionKMSID。

Example:

encryptionKMSID: 1-vault

- 在 OpenShift Web 控制台中,导航到 Workloads → ConfigMaps。

- 要查看 KMS 连接详情,请单击点击 csi-kms-connection-details。

编辑 ConfigMap。

- 点击 Action 菜单 (⋮) → Edit ConfigMap。

根据之前标识的

encryptionKMSID配置的后端,添加vaultBackend参数。您可以为 KV secret engine API 版本 1 分配

kv,为 KV secret engine API 版本 2 分配kv-v2。Example:

kind: ConfigMap apiVersion: v1 metadata: name: csi-kms-connection-details [...] data: 1-vault: |- { "encryptionKMSType": "vaulttokens", "kmsServiceName": "1-vault", [...] "vaultBackend": "kv-v2" } 2-vault: |- { "encryptionKMSType": "vaulttenantsa", [...] "vaultBackend": "kv" }- 点 Save

第 6 章 为 OpenShift Container Platform 服务配置存储

您可以使用 OpenShift Data Foundation 为 OpenShift Container Platform 服务(如镜像 registry、监控和日志记录)提供存储。

为这些服务配置存储的过程取决于 OpenShift Data Foundation 部署中使用的基础架构。

始终确保您具有适用于这些服务的大量存储容量。如果这些关键服务的存储空间不足,集群就会变得不可用,且很难恢复。

红帽建议为这些服务配置较短的策展和保留间隔。详情请参阅 OpenShift Container Platform 文档中的配置持久性存储的配置 Curator 调度和修改 Prometheus 指标数据的保留时间部分。

如果您确实耗尽这些服务的存储空间,请联系红帽客户支持。

6.1. 将镜像 registry 配置为使用 OpenShift Data Foundation

OpenShift Container Platform 提供了一个内建的容器镜像 Registry,它作为一个标准的工作负载在集群中运行。registry 通常用作集群中构建的镜像的发布目标,以及在集群中运行的工作负载的镜像源。

此过程不会将数据从现有镜像 registry 迁移到新镜像 registry。如果您在现有 registry 中已有容器镜像,请在完成此过程前备份 registry,并在这个过程完成后重新注册您的镜像。

先决条件

- 具有 OpenShift Web 控制台的管理访问权限。

-

OpenShift Data Foundation Operator 在

openshift-storage命名空间上安装并运行。在 OpenShift Web 控制台中,点 Operators → Installed Operators 查看已安装的 Operator。 -

Image Registry Operator 在

openshift-image-registry命名空间中安装并运行。在 OpenShift Web 控制台中,点 Administration → Cluster Settings → Cluster Operators 查看集群操作器。 -

带有 provisioner

openshift-storage.cephfs.csi.ceph.com的存储类可用。在 OpenShift Web 控制台中,点 Storage → StorageClasses 查看可用的存储类。

流程

为镜像 Registry 创建一个持久性卷声明。

- 在 OpenShift Web 控制台中,点击 Storage → Persistent Volume Claims。

-

将 Project 设置为

openshift-image-registry。 单击 Create Persistent Volume Claim。

-

在上方检索的可用存储类列表中,使用置备程序

openshift-storage.cephfs.csi.ceph.com指定存储类。 -

指定持久性卷声明 名称,如

ocs4registry。 -

指定

Shared Access (RWX)访问模式。 - 将 Size 指定为最少 100 GB。

点 Create。

等待新持久卷声明的状态变为

Bound。

-

在上方检索的可用存储类列表中,使用置备程序

将集群的 Image Registry 配置为使用新的持久卷声明。

- 点 Administration → Custom Resource Definitions。

-

点与

imageregistry.operator.openshift.io组关联的Config自定义资源定义。 - 点 实例 选项卡。

- 在集群实例外,点 Action Menu(⋮) → Edit Config。

添加新的持久性卷声明作为镜像 Registry 的持久性存储。

在

spec:下添加以下内容,并替换现有的storage:部分(如有必要)。storage: pvc: claim: <new-pvc-name>例如:

storage: pvc: claim: ocs4registry- 点 Save。

验证新配置是否正在使用。

- 点击 Workloads → Pods。

-

将 Project 设置为

openshift-image-registry。 -

验证新的

image-registry-*pod 的状态是否为Running,并且以前的image-registry-*pod 已终止。 -

点击新

image-registry-*Pod 查看 pod 详情。 -

向下滚动到 Volumes,再验证

registry-storage卷是否具有与您的新持久性卷声明匹配的 Type,如ocs4registry。

6.2. 配置监控以使用 OpenShift 数据基础

OpenShift 数据基础提供由 Prometheus 和 Alert Manager 组成的监控堆栈。

按照本节中的说明,将 OpenShift 数据基础配置为监控堆栈的存储。

如果存储空间不足,则监控将无法正常工作。始终确保您拥有大量用于监控的存储容量。

红帽建议为此服务配置简短的保留间隔。详情请参阅 OpenShift Container Platform 文档中的 Prometheus 指标指南的修改保留时间。

先决条件

- 具有 OpenShift Web 控制台的管理访问权限。

-

OpenShift Data Foundation Operator 在

openshift-storage命名空间上安装并运行。在 OpenShift Web 控制台中,点 Operators → Installed Operators 查看已安装的 Operator。 -

监控 Operator 在

openshift-monitoring命名空间内安装并运行。在 OpenShift Web 控制台中,点 Administration → Cluster Settings → Cluster Operators 查看集群操作器。 -

带有 provisioner

openshift-storage.rbd.csi.ceph.com的存储类可用。在 OpenShift Web 控制台中,点 Storage → StorageClasses 查看可用的存储类。

流程

- 在 OpenShift Web 控制台中,前往 Workloads → Config Maps。

-

将 Project 下拉菜单设置为

openshift-monitoring。 - 单击 Create Config Map。

使用以下命令定义一个新的

cluster-monitoring-configConfig Map。将尖括号 (

<,>) 中的内容替换为您自己的值,如retention: 24h或storage: 40Gi。将 storageClassName 替换为使用 provisioner

openshift-storage.rbd.csi.ceph.com的storageclass。在下例中,storageclass 的名称为ocs-storagecluster-ceph-rbd。cluster-monitoring-configConfig Map 示例apiVersion: v1 kind: ConfigMap metadata: name: cluster-monitoring-config namespace: openshift-monitoring data: config.yaml: | prometheusK8s: retention: <time to retain monitoring files, e.g. 24h> volumeClaimTemplate: metadata: name: ocs-prometheus-claim spec: storageClassName: ocs-storagecluster-ceph-rbd resources: requests: storage: <size of claim, e.g. 40Gi> alertmanagerMain: volumeClaimTemplate: metadata: name: ocs-alertmanager-claim spec: storageClassName: ocs-storagecluster-ceph-rbd resources: requests: storage: <size of claim, e.g. 40Gi>- 单击 Create 以保存并创建 Config Map。

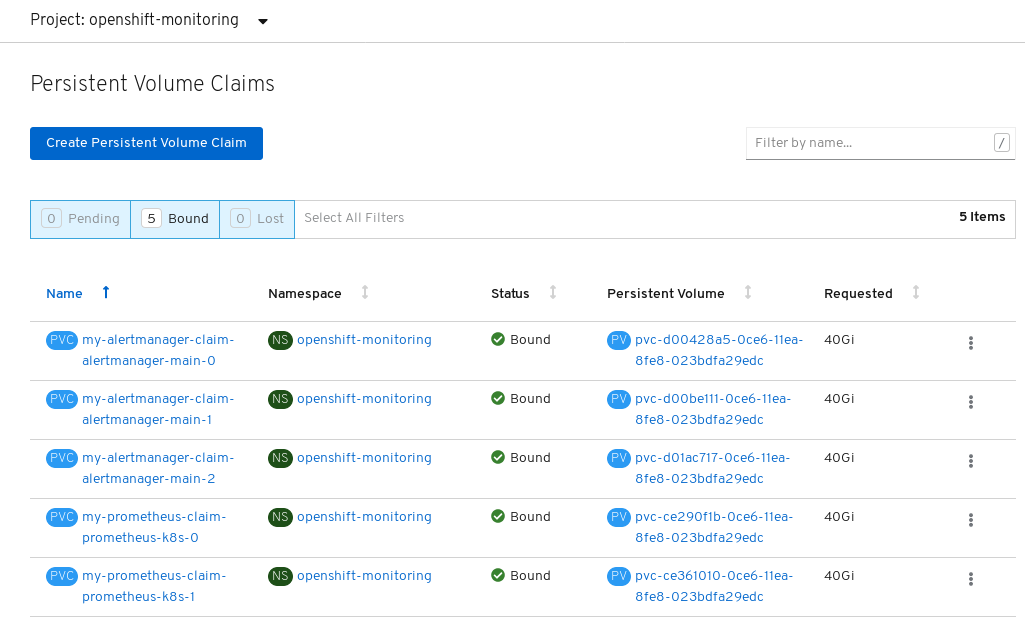

验证步骤

验证持久卷声明是否已绑定到 pod。

- 进入 Storage → Persistent Volume Claims。

-

将 Project 下拉菜单设置为

openshift-monitoring。 验证 5 持久性卷声明是否可见,状态为

Bound,附加到三个alertmanager-main-*pod,以及两个prometheus-k8s-*pod。图 6.1. 监控创建和绑定的存储

验证新

alertmanager-main-*pod 的状态是否显示为Running。- 进入 Workloads → Pods。

-

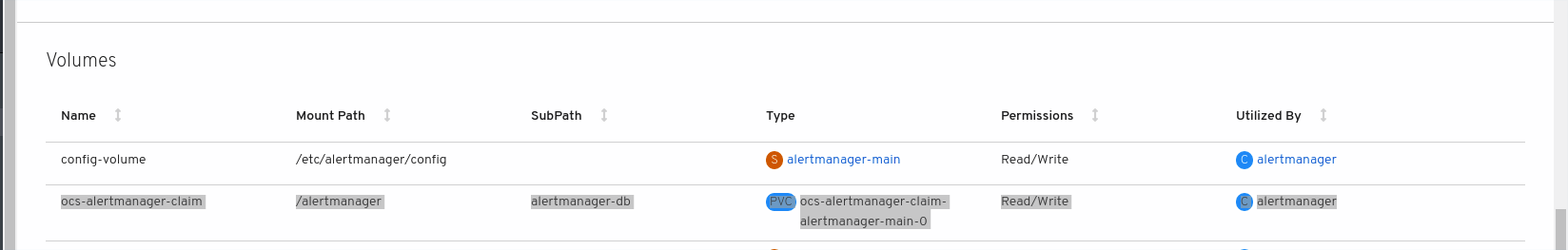

点击新

alertmanager-main-*pod 查看 pod 详情。 向下滚动到 Volumes,再验证卷是否具有 Type (

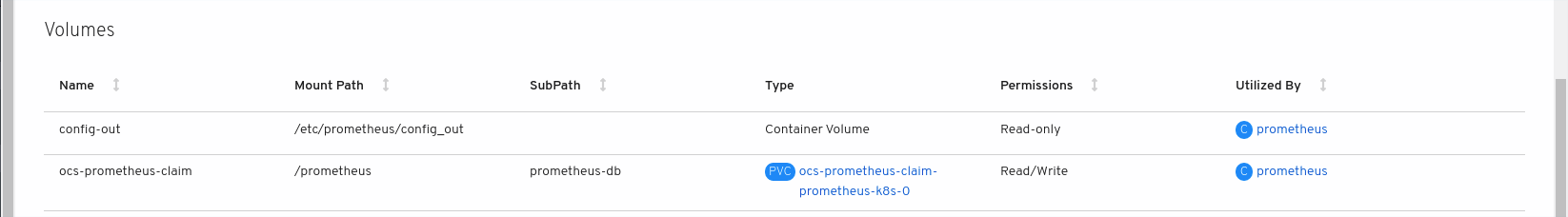

ocs-alertmanager-claim),它与您的新持久性卷声明匹配,如ocs-alertmanager-claim-alertmanager-main-0。图 6.2. 附加到

alertmanager-main-*pod 的持久性卷声明

验证新的

prometheus-k8s-*pod 的状态是否为Running。-

点新的

prometheus-k8s-*Pod 查看 pod 详情。 向下滚动到 Volumes,再验证卷是否具有 Type (

ocs-prometheus-claim),它与您的新持久性卷声明匹配,如ocs-prometheus-claim-prometheus-k8s-0。图 6.3. 附加到

prometheus-k8s-*pod 的持久性卷声明

-

点新的

6.3. OpenShift 数据基础的集群日志记录

您可以部署集群日志记录来聚合一系列 OpenShift Container Platform 服务的日志。有关如何部署集群日志记录的详情,请参考部署集群日志记录。

在初始 OpenShift Container Platform 部署时,默认情况下不配置 OpenShift Data Foundation,OpenShift Container Platform 集群将依赖于节点提供的默认存储。您可以编辑 OpenShift 日志记录(ElasticSearch)的默认配置,使其由 OpenShift Data Foundation 支持,使 OpenShift Data Foundation 支持日志(Elasticsearch)。

始终确保您具有适用于这些服务的大量存储容量。如果您对这些关键服务的存储空间不足,日志记录应用将变得不可用,很难恢复。

红帽建议为这些服务配置较短的策展和保留间隔。详情请参阅 OpenShift Container Platform 文档中的 集群日志记录 Curator。

如果您缺少这些服务的存储空间,请联系红帽客户支持。

6.3.1. 配置持久性存储

您可以使用存储类名称和大小参数为 Elasticsearch 集群配置持久性存储类和大小。Cluster Logging Operator 根据这些参数为 Elasticsearch 集群中的每个数据节点创建一个持久性卷声明。例如:

spec:

logStore:

type: "elasticsearch"

elasticsearch:

nodeCount: 3

storage:

storageClassName: "ocs-storagecluster-ceph-rbd”

size: "200G"

本例指定,集群中的每个数据节点将绑定到请求 200GiB 的 ocs-storagecluster-ceph-rbd 存储的持久性卷声明。每个主分片将由单个副本支持。分片的副本会在所有节点之间复制,并且始终可用;如果因为单一冗余策略至少存在两个节点,则可以恢复副本。有关 Elasticsearch 复制策略的详情,请参考为日志存储配置复制策略。

缺少存储块将导致默认存储支持部署。例如:

spec:

logStore:

type: "elasticsearch"

elasticsearch:

nodeCount: 3

storage: {}如需更多信息,请参阅为日志存储配置持久性存储以及为 emptyDir 存储配置日志存储。

6.3.2. 配置集群日志记录以使用 OpenShift Data Foundation

按照本节中的说明,将 OpenShift Data Foundation 配置为 OpenShift 集群日志记录的存储。

当您首次在 OpenShift 数据基础中配置日志记录时,您可以获取所有日志。但是,在卸载和重新安装日志记录后,会删除旧日志并只处理新日志。

先决条件

- 具有 OpenShift Web 控制台的管理访问权限。

-

OpenShift Data Foundation Operator 在

openshift-storage命名空间上安装并运行。 -

Cluster logging Operator 已安装并在

openshift-logging命名空间中运行。

流程

- 从 OpenShift Web 控制台左侧窗格中,点击 Administration → Custom Resource Definitions。

- 在 Custom Resource Definitions 页面中点 ClusterLogging。

- 在 Custom Resource Definition Overview 页面上,从 Actions 菜单中选择 View Instances,或者点击 Instances 选项卡。

在 Cluster Logging 页面上,点击 Create Cluster Logging。

您可能需要刷新页面来加载数据。

在 YAML 中,将 storageClassName 替换为使用 provisioner

openshift-storage.rbd.csi.ceph.com的storageclass。在下例中,storageclass 的名称为ocs-storagecluster-ceph-rbd:apiVersion: "logging.openshift.io/v1" kind: "ClusterLogging" metadata: name: "instance" namespace: "openshift-logging" spec: managementState: "Managed" logStore: type: "elasticsearch" elasticsearch: nodeCount: 3 storage: storageClassName: ocs-storagecluster-ceph-rbd size: 200G # Change as per your requirement redundancyPolicy: "SingleRedundancy" visualization: type: "kibana" kibana: replicas: 1 curation: type: "curator" curator: schedule: "30 3 * * *" collection: logs: type: "fluentd" fluentd: {}如果 OpenShift Data Foundation 节点带有污点,您必须添加容限,以启用为日志调度 daemonset pod。

spec: [...] collection: logs: fluentd: tolerations: - effect: NoSchedule key: node.ocs.openshift.io/storage value: 'true' type: fluentd- 点 Save。

验证步骤

验证持久卷声明是否已绑定到

elasticsearchPod。- 进入 Storage → Persistent Volume Claims。

-

将 Project 下拉菜单设置为

openshift-logging。 验证持久卷声明是否可见,状态为

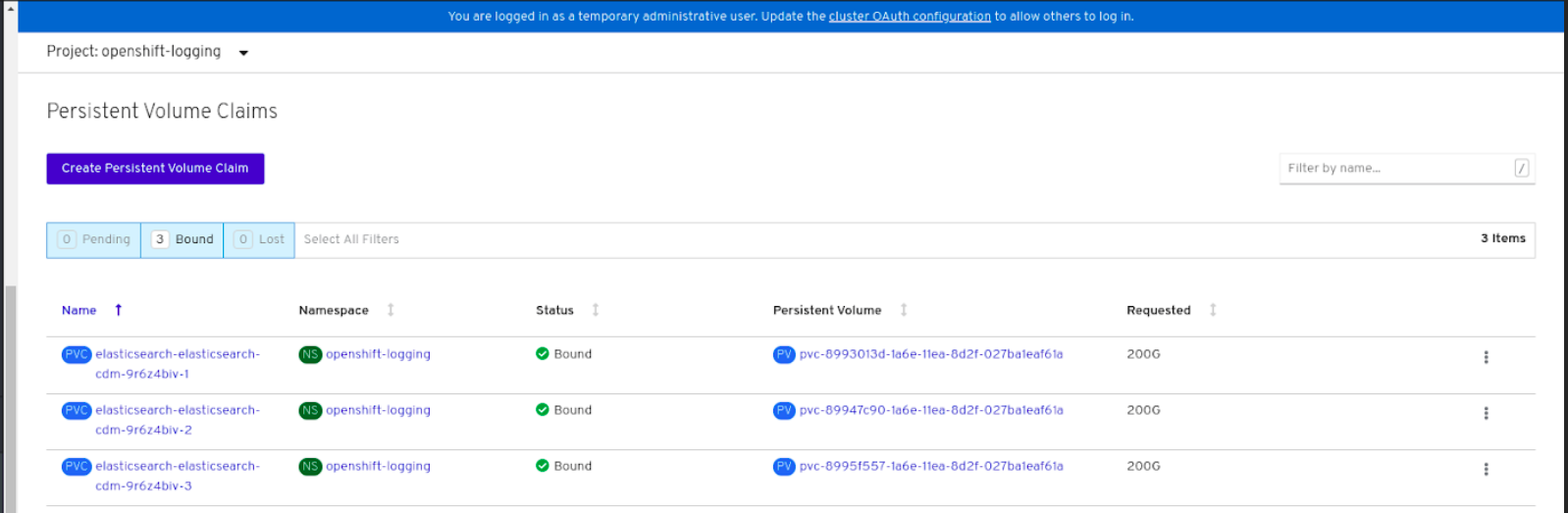

Bound,附加到elasticsearch-* pod。图 6.4. 创建并绑定集群日志记录

验证是否在使用新集群日志记录。

- 点 Workload → Pods。

-

将项目设置为

openshift-logging。 -

验证新的

elasticsearch-* Pod 的状态是否为Running。 -

点新的

elasticsearch-* Pod 查看 pod 详情。 -

向下滚动到 Volumes,再验证 elasticsearch 卷是否具有与新持久性卷声明匹配的 Type,如

elasticsearch-elasticsearch-cdm-9r624biv-3。 - 点 Persistent Volume Claim 名称,然后在 PersistentVolumeClaim Overview 页面中验证存储类名称。

确保使用较短的 Curator 时间,以避免在附加到 Elasticsearch Pod 的 PV 上 PV 完整场景。

您可以配置 Curator,以根据保留设置删除 Elasticsearch 数据。建议您将以下默认索引数据保留 5 天设为默认值。

config.yaml: |

openshift-storage:

delete:

days: 5如需了解更多详细信息,请参阅配置日志保留时间。

要卸载由持久性卷声明支持的集群日志记录,请使用相应部署指南的卸载章节中从 OpenShift Data Foundation 中删除集群日志记录 Operator 的步骤。

第 7 章 使用 OpenShift Data Foundation 支持 OpenShift Container Platform 应用程序

您无法在 OpenShift Container Platform 安装过程中直接安装 OpenShift Data Foundation。但是,您可以使用 Operator Hub 在现有 OpenShift Container Platform 上安装 OpenShift Data Foundation,然后将 OpenShift Container Platform 应用程序配置为由 OpenShift Data Foundation 支持。

先决条件

- 已安装 OpenShift Container Platform,您还可管理 OpenShift Web 控制台。

-

OpenShift Data Foundation 在

openshift-storage命名空间上安装并运行。

流程

在 OpenShift Web 控制台中执行以下任一操作:

点 Workloads → Deployments。

在 Deployments 页面中,您可以执行以下操作之一:

- 从 Action 菜单中选择任何现有部署并点击 Add Storage 选项。

创建新部署,然后添加存储。

- 单击 Create Deployment 以创建新部署。

-

根据您的要求编辑

YAML以创建部署。 - 点 Create。

- 从页面右上角的 Actions 下拉菜单中选择 Add Storage。

点 Workloads → Deployment Configs。

在 Deployment Configs 页面中,您可以执行以下操作之一:

- 从 Action 菜单中选择任何现有部署并点击 Add Storage 选项。

创建新部署,然后添加存储。

- 单击 Create Deployment Config 以创建新部署。

-

根据您的要求编辑

YAML以创建部署。 - 点 Create。

- 从页面右上角的 Actions 下拉菜单中选择 Add Storage。

在 Add Storage 页面中,您可以选择以下选项之一:

- 点击 Use existing claim 选项,然后从下拉菜单中选择适合的 PVC。

单击 Create new claim 选项。

-

从 Storage Class 下拉列表中,选择适当的

CephFS或RBD存储类。 - 为持久性卷声明提供名称。

选择 ReadWriteOnce (RWO) 或 ReadWriteMany (RWX) 访问模式。

注意ReadOnlyMany (ROX) 已被取消激活,因为它不受支持。

选择所需存储容量的大小。

注意您可以扩展块 PV,但无法在创建持久性卷声明后减少存储容量。

-

从 Storage Class 下拉列表中,选择适当的

- 指定容器内挂载路径卷的挂载路径和子路径(如果需要)。

- 点 Save。

验证步骤

根据您的配置,执行以下任一操作:

- 点 Workloads → Deployments。

- 点 Workloads → Deployment Configs。

- 根据需要设置项目。

- 单击您添加存储的部署,以显示部署详情。

- 向下滚动到 Volumes,再验证您的部署带有一个与您分配的持久性卷声明相匹配的类型。

- 点 Persistent Volume Claim 名称,然后在 Persistent Volume Claim Overview 页面中验证存储类名称。

第 8 章 如何在 Red Hat OpenShift Data Foundation 中使用专用 worker 节点

任何 Red Hat OpenShift Container Platform 订阅都需要一个 OpenShift Data Foundation 订阅。但是,如果您使用基础架构节点调度 OpenShift 数据基础资源,您可以在 OpenShift Container Platform 订阅上保存。

务必要在不同环境中维持 Machine API 支持的一致性。因此,强烈建议在所有情形中都有特殊类别的节点标记为 worker 或 infra,或者同时具有这两个角色。如需更多信息,请参阅 第 8.3 节 “手动创建基础架构节点” 部分。

8.1. 基础架构节点分析

用于 OpenShift Data Foundation 的基础架构节点有几个属性。需要 infra node-role 标签,以确保节点不使用 RHOCP 权利。infra node-role 标签负责确保运行 OpenShift Data Foundation 的节点仅需要 OpenShift Data Foundation 权利。

-

标记了

node-role.kubernetes.io/infra

还需要添加具有 NoSchedule effect 的 OpenShift Data Foundation 污点,以便 infra 节点只调度 OpenShift Data Foundation 资源。

-

使用

node.ocs.openshift.io/storage="true"污点

该标签将 RHOCP 节点识别为 infra 节点,以便不应用 RHOCP 订阅成本。该污点可防止将非 OpenShift Data Foundation 资源调度到污点节点上。

在节点上添加存储污点可能需要对其他 daemonset pod(如 openshift-dns daemonset )进行容限处理。有关如何管理容限的详情,请参考知识库文章 https://access.redhat.com/solutions/6592171。

用于运行 OpenShift Data Foundation 服务的基础架构节点上的污点和标签示例:

spec:

taints:

- effect: NoSchedule

key: node.ocs.openshift.io/storage

value: "true"

metadata:

creationTimestamp: null

labels:

node-role.kubernetes.io/worker: ""

node-role.kubernetes.io/infra: ""

cluster.ocs.openshift.io/openshift-storage: ""8.2. 用于创建基础架构节点的机器集

如果环境中支持 Machine API,则应将标签添加到要调配基础架构节点的 Machine Sets 的模板中。避免将标签手动添加到机器 API 创建的节点的反模式。这样做类似于向部署创建的 pod 添加标签。在这两种情况下,pod/节点失败时,替代的 pod/节点都将没有适当的标签。

在 EC2 环境中,您将需要三个计算机集,各自配置为在不同的可用区(如 us-east-2a, us-east-2b, us-east-2c)中调配基础架构节点。目前,OpenShift Data Foundation 不支持在超过三个可用区部署。

以下 Machine Set 模板示例创建具有基础架构节点所需的适当污点和标签的节点。这将用于运行 OpenShift Data Foundation 服务。

template:

metadata:

creationTimestamp: null

labels:

machine.openshift.io/cluster-api-cluster: kb-s25vf

machine.openshift.io/cluster-api-machine-role: worker

machine.openshift.io/cluster-api-machine-type: worker

machine.openshift.io/cluster-api-machineset: kb-s25vf-infra-us-west-2a

spec:

taints:

- effect: NoSchedule

key: node.ocs.openshift.io/storage

value: "true"

metadata:

creationTimestamp: null

labels:

node-role.kubernetes.io/infra: ""

cluster.ocs.openshift.io/openshift-storage: ""如果向基础架构节点添加污点,您还需要为其他工作负载的污点添加容限,如 fluentd pod。如需更多信息,请参阅 OpenShift 4 中的基础架构节点红帽知识库解决方案。

8.3. 手动创建基础架构节点

只有环境中不支持 Machine API 时,标签才应直接应用到节点。手动创建要求至少可使用 3 个 RHOCP worker 节点来调度 OpenShift Data Foundation 服务,并且这些节点有足够的 CPU 和内存资源。要避免 RHOCP 订阅成本,需要以下内容:

oc label node <node> node-role.kubernetes.io/infra="" oc label node <node> cluster.ocs.openshift.io/openshift-storage=""

还需要添加一个 NoSchedule OpenShift Data Foundation 污点,以便 infra 节点只调度 OpenShift Data Foundation 资源并代表任何其他非 OpenShift Data Foundation 工作负载。

oc adm taint node <node> node.ocs.openshift.io/storage="true":NoSchedule

不要删除 node-role node-role.kubernetes.io/worker=""

除非对 OpenShift 调度程序和 MachineConfig 资源进行了更改,否则删除 node-role.kubernetes.io/worker="" 可能会导致问题。

如果已删除,则应将其重新添加到每个 infra 节点。添加 node-role node-role.kubernetes.io/infra="" 和 OpenShift Data Foundation 污点足以满足权利的要求。

8.4. 从用户界面污点一个节点

本节解释了在 OpenShift Data Foundation 部署后污点节点的步骤。

流程

- 在 OpenShift Web 控制台中,点击 Compute → Nodes,然后选择必须污点的节点。

- 在 Details 页面中,点 Edit taint。

- 在 Key <node.ocs.openshift.io/storage>, Value <true> 和 Effect<Noschedule> 字段中输入值。

- 点 Save。

验证步骤

按照以下步骤验证节点是否已成功污点:

- 进入 Compute → Nodes。

- 选择节点以验证其状态,然后单击 YAML 选项卡。

在 specs 部分中检查以下参数值:

Taints: Key: node.ocs.openshift.io/storage Value: true Effect: Noschedule

其他资源

如需更多信息,请参阅在 VMware vSphere 上创建 OpenShift Data Foundation 集群。

第 9 章 扩展存储节点

要扩展 OpenShift 数据基础的存储容量,您可以执行以下操作之一:

- 扩展存储节点 - 为现有 OpenShift Data Foundation 节点添加存储容量

- 扩展存储节点 - 添加包含存储容量的新 worker 节点

9.1. 扩展存储节点的要求

在继续扩展存储节点前,请参考以下部分以了解特定 Red Hat OpenShift Data Foundation 实例的节点要求:

始终确保您有大量的存储容量。

如果存储完全填满,则无法添加容量、删除内容或从存储中迁移内容来释放空间。当存储被完全占用时将很难恢复。

当集群存储容量达到总容量的 75%(接近满)和 85%(满)时,会发出容量警报。始终及时处理容量警告的信息,并定期检查您的存储以确保您不会耗尽存储空间。

如果您完全耗尽存储空间,请联系红帽客户支持。

9.2. 通过在 Red Hat OpenStack Platform 基础架构上为 OpenShift Data Foundation 节点添加容量来扩展存储

要在用户置备的基础架构上增加动态创建的存储集群中的存储容量,您可以为配置的 Red Hat OpenShift Data Foundation worker 节点添加存储容量和性能。

先决条件

- 具有 OpenShift Container Platform 控制台的管理权限。

- 您有一个正在运行的 OpenShift Data Foundation Storage Cluster。

- 该磁盘的大小应该与初始部署过程中使用的大小相同。

流程

- 登录 OpenShift Web 控制台。

- 点 Operators → Installed Operators。

- 点 OpenShift Data Foundation Operator。

单击 Storage Systems 选项卡。

- 点击存储系统名称最右侧的 Action Menu(⋮) 来扩展选项菜单。

- 从选项菜单中选择 Add Capacity。

- 选择 Storage Class。选择您要用来置备新存储设备的存储类。

如果您使用部署期间生成的默认存储类,存储类应设置为 standard。如果您已创建了其他存储类,请选择适当的选项。

+ Raw Capacity 字段显示在存储类创建过程中设置的大小。所消耗的存储总量是这个大小的三倍,因为 OpenShift Data Foundation 使用的副本数为 3。

点 Add。

-

要检查状态,请进入 Storage → Data Foundation,并验证 Status 卡中的

Storage System有一个绿色勾号。

-

要检查状态,请进入 Storage → Data Foundation,并验证 Status 卡中的

验证步骤

验证 Raw Capacity 卡。

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

- 在 Overview 选项卡的 Status 卡中,点 Storage System,然后点弹出框中的存储系统链接。

在 Block and File 选项卡中,检查 Raw Capacity 卡。

请注意,容量会根据您的选择而增加。

注意原始容量不考虑复制并显示完整容量。

验证新 OSD 及其对应的新持久卷声明(PVC)已创建。

查看新创建的 OSD 的状态:

- 从 OpenShift Web 控制台点 Workloads → Pods。

从 Project 下拉列表中选择

openshift-storage。注意如果禁用 Show default projects 选项,请使用切换按钮列出所有默认项目。

查看 PVC 的状态:

- 从 OpenShift Web 控制台点 Storage → Persistent Volume Claims。

从 Project 下拉列表中选择

openshift-storage。注意如果禁用 Show default projects 选项,请使用切换按钮列出所有默认项目。

可选:如果在集群中启用了集群范围的加密,请验证新 OSD 设备是否已加密。

识别运行新 OSD pod 的节点。

$ oc get -n openshift-storage -o=custom-columns=NODE:.spec.nodeName pod/<OSD-pod-name><OSD-pod-name>是 OSD pod 的名称。

例如:

$ oc get -n openshift-storage -o=custom-columns=NODE:.spec.nodeName pod/rook-ceph-osd-0-544db49d7f-qrgqm

输出示例:

NODE compute-1

对于上一步中确定的每个节点,请执行以下操作:

创建调试 pod,并为所选主机打开 chroot 环境。

$ oc debug node/<node-name><node-name>是节点的名称。

$ chroot /host

检查

ocs-deviceset名称旁边的crypt关键字。$ lsblk

只有在红帽支持团队帮助下,才支持集群缩减。

9.3. 通过添加新节点来横向扩展存储容量

要扩展存储容量,您需要执行以下操作:

- 添加新节点,以在现有工作程序节点已以其最大支持 OSD 运行时增加存储容量,即初始配置期间所选容量的 3 个 OSD 递增。

- 验证新节点是否已成功添加

- 添加节点后扩展存储容量

9.3.1. 在安装程序置备的基础架构中添加节点

先决条件

- 具有 OpenShift Container Platform 控制台的管理权限。

- 您有一个正在运行的 OpenShift Data Foundation Storage Cluster。

流程

- 导航到 Compute → Machine Sets。

在您要添加节点的机器集中,选择 Edit Machine Count。

- 添加节点数量,然后点 Save。

- 点 Compute → Nodes 并确认新节点是否处于 Ready 状态。

将 OpenShift 数据基础标签应用到新节点。

- 对于新节点,点击 Action 菜单(⋮) → Edit Labels。

- 添加 cluster.ocs.openshift.io/openshift-storage,然后点 Save。

建议您添加 3 个节点,每个节点都位于不同的区中。您必须添加 3 个节点,并对所有节点执行此步骤。

验证步骤

执行以下命令终端,并验证输出中是否存在新节点:

$ oc get nodes --show-labels | grep cluster.ocs.openshift.io/openshift-storage= |cut -d' ' -f1

在 OpenShift Web 控制台中,点 Workloads → Pods,确认在新节点上至少有以下 pod 处于 Running 状态:

-

csi-cephfsplugin-* -

csi-rbdplugin-*

-

9.3.2. 扩展存储容量

将新节点添加到 OpenShift Data Foundation 后,您必须扩展存储容量,如通过添加容量扩展存储中所述。

第 10 章 多云对象网关

10.1. 关于 Multicloud 对象网关

Multicloud 对象网关 (MCG) 是 OpenShift 的轻量级对象存储服务,允许用户启动小规模,然后根据需要在多个集群中、多个集群中和云原生存储中进行扩展。

10.2. 使用应用程序访问多云对象网关

您可以使用任何以 AWS S3 或使用 AWS S3 软件开发套件 (SDK) 的代码为目标的应用程序访问对象服务。应用程序需要指定多云对象网关(MCG)端点、访问密钥和 secret 访问密钥。您可以使用您的终端或 MCG CLI 来检索此信息。

先决条件

- 正在运行的 OpenShift Data Foundation 平台。

下载 MCG 命令行界面以简化管理。

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-x86_64-rpms # yum install mcg

注意指定使用订阅管理器启用存储库的适当架构。

- 对于 IBM Power,使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-ppc64le-rpms

- 对于 IBM Z 基础架构,使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-s390x-rpms

或者,您也可以从 下载红帽 OpenShift Data Foundation 页面上的 OpenShift Data Foundation RPM 安装 MCG 软件包。

注意根据您的架构选择正确的产品变体。

您可以通过两种方式访问相关的端点、访问密钥和 secret 访问密钥:

例如:

- 使用虚拟主机风格访问 MCG 存储桶

- 如果客户端应用程序尝试访问 https://<bucket-name>.s3-openshift-storage.apps.mycluster-cluster.qe.rh-ocs.com

<bucket-name>是 MCG 存储桶的名称

例如:https://mcg-test-bucket.s3-openshift-storage.apps.mycluster-cluster.qe.rh-ocs.com

DNS 条目需要

mcg-test-bucket.s3-openshift-storage.apps.mycluster-cluster.qe.rh-ocs.com来指向 S3 服务。

确保您有一个 DNS 条目,以便使用虚拟主机样式将客户端应用程序指向 MCG 存储桶。

10.2.1. 从终端访问 Multicloud 对象网关

流程

运行 describe 命令,以查看有关多云对象网关(MCG)端点的信息,包括其访问密钥(AWS_ACCESS_KEY_ID 值)和 secret 访问密钥(AWS_SECRET_ACCESS_KEY 值)。

# oc describe noobaa -n openshift-storage

输出结果类似如下:

Name: noobaa

Namespace: openshift-storage

Labels: <none>

Annotations: <none>

API Version: noobaa.io/v1alpha1

Kind: NooBaa

Metadata:

Creation Timestamp: 2019-07-29T16:22:06Z

Generation: 1

Resource Version: 6718822

Self Link: /apis/noobaa.io/v1alpha1/namespaces/openshift-storage/noobaas/noobaa

UID: 019cfb4a-b21d-11e9-9a02-06c8de012f9e

Spec:

Status:

Accounts:

Admin:

Secret Ref:

Name: noobaa-admin

Namespace: openshift-storage

Actual Image: noobaa/noobaa-core:4.0

Observed Generation: 1

Phase: Ready

Readme:

Welcome to NooBaa!

-----------------

Welcome to NooBaa!

-----------------

NooBaa Core Version:

NooBaa Operator Version:

Lets get started:

1. Connect to Management console:

Read your mgmt console login information (email & password) from secret: "noobaa-admin".

kubectl get secret noobaa-admin -n openshift-storage -o json | jq '.data|map_values(@base64d)'

Open the management console service - take External IP/DNS or Node Port or use port forwarding:

kubectl port-forward -n openshift-storage service/noobaa-mgmt 11443:443 &

open https://localhost:11443

2. Test S3 client:

kubectl port-forward -n openshift-storage service/s3 10443:443 &

1

NOOBAA_ACCESS_KEY=$(kubectl get secret noobaa-admin -n openshift-storage -o json | jq -r '.data.AWS_ACCESS_KEY_ID|@base64d')

2

NOOBAA_SECRET_KEY=$(kubectl get secret noobaa-admin -n openshift-storage -o json | jq -r '.data.AWS_SECRET_ACCESS_KEY|@base64d')

alias s3='AWS_ACCESS_KEY_ID=$NOOBAA_ACCESS_KEY AWS_SECRET_ACCESS_KEY=$NOOBAA_SECRET_KEY aws --endpoint https://localhost:10443 --no-verify-ssl s3'

s3 ls

Services:

Service Mgmt:

External DNS:

https://noobaa-mgmt-openshift-storage.apps.mycluster-cluster.qe.rh-ocs.com

https://a3406079515be11eaa3b70683061451e-1194613580.us-east-2.elb.amazonaws.com:443

Internal DNS:

https://noobaa-mgmt.openshift-storage.svc:443

Internal IP:

https://172.30.235.12:443

Node Ports:

https://10.0.142.103:31385

Pod Ports:

https://10.131.0.19:8443

serviceS3:

External DNS: 3

https://s3-openshift-storage.apps.mycluster-cluster.qe.rh-ocs.com

https://a340f4e1315be11eaa3b70683061451e-943168195.us-east-2.elb.amazonaws.com:443

Internal DNS:

https://s3.openshift-storage.svc:443

Internal IP:

https://172.30.86.41:443

Node Ports:

https://10.0.142.103:31011

Pod Ports:

https://10.131.0.19:6443

oc describe nooba 命令的输出列出了可用的内部和外部 DNS 名称。使用内部 DNS 时,流量是空闲的。外部 DNS 使用 Load Balancing 来处理流量,因此会有一个每小时的成本。

10.2.2. 使用 MCG 命令行界面访问 Multicloud 对象网关

先决条件

下载 MCG 命令行界面。

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-x86_64-rpms # yum install mcg

注意指定使用订阅管理器启用存储库的适当架构。

- 对于 IBM Power,使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-ppc64le-rpms

- 对于 IBM Z 基础架构,使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-s390x-rpms

流程

运行 status 命令访问端点、访问密钥和 secret 访问密钥:

noobaa status -n openshift-storage

输出结果类似如下:

INFO[0000] Namespace: openshift-storage INFO[0000] INFO[0000] CRD Status: INFO[0003] ✅ Exists: CustomResourceDefinition "noobaas.noobaa.io" INFO[0003] ✅ Exists: CustomResourceDefinition "backingstores.noobaa.io" INFO[0003] ✅ Exists: CustomResourceDefinition "bucketclasses.noobaa.io" INFO[0004] ✅ Exists: CustomResourceDefinition "objectbucketclaims.objectbucket.io" INFO[0004] ✅ Exists: CustomResourceDefinition "objectbuckets.objectbucket.io" INFO[0004] INFO[0004] Operator Status: INFO[0004] ✅ Exists: Namespace "openshift-storage" INFO[0004] ✅ Exists: ServiceAccount "noobaa" INFO[0005] ✅ Exists: Role "ocs-operator.v0.0.271-6g45f" INFO[0005] ✅ Exists: RoleBinding "ocs-operator.v0.0.271-6g45f-noobaa-f9vpj" INFO[0006] ✅ Exists: ClusterRole "ocs-operator.v0.0.271-fjhgh" INFO[0006] ✅ Exists: ClusterRoleBinding "ocs-operator.v0.0.271-fjhgh-noobaa-pdxn5" INFO[0006] ✅ Exists: Deployment "noobaa-operator" INFO[0006] INFO[0006] System Status: INFO[0007] ✅ Exists: NooBaa "noobaa" INFO[0007] ✅ Exists: StatefulSet "noobaa-core" INFO[0007] ✅ Exists: Service "noobaa-mgmt" INFO[0008] ✅ Exists: Service "s3" INFO[0008] ✅ Exists: Secret "noobaa-server" INFO[0008] ✅ Exists: Secret "noobaa-operator" INFO[0008] ✅ Exists: Secret "noobaa-admin" INFO[0009] ✅ Exists: StorageClass "openshift-storage.noobaa.io" INFO[0009] ✅ Exists: BucketClass "noobaa-default-bucket-class" INFO[0009] ✅ (Optional) Exists: BackingStore "noobaa-default-backing-store" INFO[0010] ✅ (Optional) Exists: CredentialsRequest "noobaa-cloud-creds" INFO[0010] ✅ (Optional) Exists: PrometheusRule "noobaa-prometheus-rules" INFO[0010] ✅ (Optional) Exists: ServiceMonitor "noobaa-service-monitor" INFO[0011] ✅ (Optional) Exists: Route "noobaa-mgmt" INFO[0011] ✅ (Optional) Exists: Route "s3" INFO[0011] ✅ Exists: PersistentVolumeClaim "db-noobaa-core-0" INFO[0011] ✅ System Phase is "Ready" INFO[0011] ✅ Exists: "noobaa-admin" #------------------# #- Mgmt Addresses -# #------------------# ExternalDNS : [https://noobaa-mgmt-openshift-storage.apps.mycluster-cluster.qe.rh-ocs.com https://a3406079515be11eaa3b70683061451e-1194613580.us-east-2.elb.amazonaws.com:443] ExternalIP : [] NodePorts : [https://10.0.142.103:31385] InternalDNS : [https://noobaa-mgmt.openshift-storage.svc:443] InternalIP : [https://172.30.235.12:443] PodPorts : [https://10.131.0.19:8443] #--------------------# #- Mgmt Credentials -# #--------------------# email : admin@noobaa.io password : HKLbH1rSuVU0I/souIkSiA== #----------------# #- S3 Addresses -# #----------------# 1 ExternalDNS : [https://s3-openshift-storage.apps.mycluster-cluster.qe.rh-ocs.com https://a340f4e1315be11eaa3b70683061451e-943168195.us-east-2.elb.amazonaws.com:443] ExternalIP : [] NodePorts : [https://10.0.142.103:31011] InternalDNS : [https://s3.openshift-storage.svc:443] InternalIP : [https://172.30.86.41:443] PodPorts : [https://10.131.0.19:6443] #------------------# #- S3 Credentials -# #------------------# 2 AWS_ACCESS_KEY_ID : jVmAsu9FsvRHYmfjTiHV 3 AWS_SECRET_ACCESS_KEY : E//420VNedJfATvVSmDz6FMtsSAzuBv6z180PT5c #------------------# #- Backing Stores -# #------------------# NAME TYPE TARGET-BUCKET PHASE AGE noobaa-default-backing-store aws-s3 noobaa-backing-store-15dc896d-7fe0-4bed-9349-5942211b93c9 Ready 141h35m32s #------------------# #- Bucket Classes -# #------------------# NAME PLACEMENT PHASE AGE noobaa-default-bucket-class {Tiers:[{Placement: BackingStores:[noobaa-default-backing-store]}]} Ready 141h35m33s #-----------------# #- Bucket Claims -# #-----------------# No OBC's found.

现在,您有相关的端点、访问密钥和 secret 访问密钥来连接到您的应用。

例如:

如果 AWS S3 CLI 是应用程序,以下命令将列出 OpenShift Data Foundation 中的存储桶:

AWS_ACCESS_KEY_ID=<AWS_ACCESS_KEY_ID> AWS_SECRET_ACCESS_KEY=<AWS_SECRET_ACCESS_KEY> aws --endpoint <ENDPOINT> --no-verify-ssl s3 ls

10.3. 为混合或多云添加存储资源

10.3.1. 创建新的后备存储

在 OpenShift Data Foundation 中使用此流程创建新的后备存储。

先决条件

- OpenShift Data Foundation 的管理员访问权限。

流程

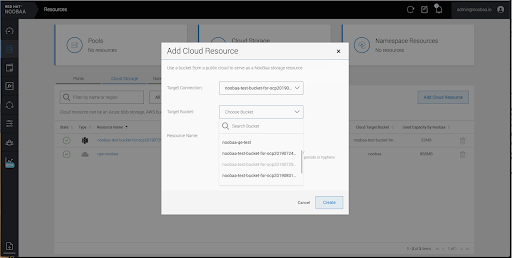

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

- 单击 Backing Store 选项卡。

- 单击 Create Backing Store。

在 Create New Backing Store 页面中执行以下操作:

- 输入后端存储名称。

- 选择 Provider。

- 选择 Region。

- 输入 端点.这是可选的。

从下拉列表中选择一个 Secret,或者创建自己的 secret。另外,您也可以切换到 Credentials 视图来填写所需的 secret。

有关创建 OCP secret 的更多信息,请参阅 Openshift Container Platform 文档中的 创建 secret 部分。

每个后备存储都需要不同的机密。有关为特定后备存储创建 secret 的更多信息,请参阅 第 10.3.2 节 “使用 MCG 命令行界面为混合或多云添加存储资源” 并按照使用 YAML 添加存储资源的步骤进行操作。

注意此菜单与 Google Cloud 和本地 PVC 以外的所有供应商相关。

- 输入 Target bucket。目标 bucket 是托管在远程云服务的容器存储。它允许您创建一个连接,告诉 MCG 它可以将此存储桶用于系统。

- 单击 Create Backing Store。

验证步骤

- 在 OpenShift Web 控制台中,点 Storage → Data Foundation。

- 单击 Backing Store 选项卡,以查看所有后备存储。

10.3.2. 使用 MCG 命令行界面为混合或多云添加存储资源

多云对象网关 (MCG) 简化了跨云供应商和集群的数据生成过程。

您必须添加 MCG 可以使用的后备存储。

根据部署类型,您可以选择以下步骤之一来创建后备存储:

- 有关创建 AWS 支持的后备存储,请参阅 第 10.3.2.1 节 “创建 AWS 支持的后备存储”

- 有关创建 IBM COS 支持的后备存储,请参阅 第 10.3.2.2 节 “创建 IBM COS 支持的后备存储”

- 有关创建 Azure 支持的后备存储,请参阅 第 10.3.2.3 节 “创建 Azure 支持的后备存储”

- 有关创建由 GCP 支持的后备存储,请参阅 第 10.3.2.4 节 “创建由 GCP 支持的后备存储”

- 有关创建本地持久性卷支持的后备存储,请参阅 第 10.3.2.5 节 “创建由本地持久性卷支持的后备存储”

对于 VMware 部署,请跳至 第 10.3.3 节 “创建兼容 s3 的多云对象网关后备存储” 以获得进一步说明。

10.3.2.1. 创建 AWS 支持的后备存储

先决条件

下载多云对象网关(MCG)命令行界面。

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-x86_64-rpms # yum install mcg

注意指定使用订阅管理器启用存储库的适当架构。例如,如果是 IBM Z 基础架构,请使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-s390x-rpms

或者,您也可以从 下载红帽 OpenShift Data Foundation 页面上的 OpenShift Data Foundation RPM 安装 MCG 软件包。

注意根据您的架构选择正确的产品变体。

流程

使用 MCG 命令行界面

在 MCG 命令行界面中运行以下命令:

noobaa backingstore create aws-s3 <backingstore_name> --access-key=<AWS ACCESS KEY> --secret-key=<AWS SECRET ACCESS KEY> --target-bucket <bucket-name> -n openshift-storage

<backingstore_name>- 后备储存的名称。

<AWS ACCESS KEY>和<AWS SECRET ACCESS KEY>- 您创建的 AWS 访问密钥 ID 和 secret 访问密钥。

<bucket-name>现有 AWS 存储桶名称。此参数告知 MCG 将哪一个存储桶用作其后备存储的目标存储桶,以及随后数据存储和管理。

输出结果类似如下:

INFO[0001] ✅ Exists: NooBaa "noobaa" INFO[0002] ✅ Created: BackingStore "aws-resource" INFO[0002] ✅ Created: Secret "backing-store-secret-aws-resource"

使用 YAML 添加存储资源

使用凭证创建 secret:

apiVersion: v1 kind: Secret metadata: name: <backingstore-secret-name> namespace: openshift-storage type: Opaque data: AWS_ACCESS_KEY_ID: <AWS ACCESS KEY ID ENCODED IN BASE64> AWS_SECRET_ACCESS_KEY: <AWS SECRET ACCESS KEY ENCODED IN BASE64>

<AWS ACCESS KEY>和<AWS SECRET ACCESS KEY>-

使用 Base64 提供并编码您自己的 AWS 访问密钥 ID 和 secret 访问密钥,并使用结果代替

<AWS ACCESS KEY ID ENCODED IN BASE64>和<AWS SECRET ACCESS KEY ENCODED IN BASE64>。 <backingstore-secret-name>- 上一步中创建的后备存储 secret 的名称。

为特定的后备存储应用以下 YAML:

apiVersion: noobaa.io/v1alpha1 kind: BackingStore metadata: finalizers: - noobaa.io/finalizer labels: app: noobaa name: bs namespace: openshift-storage spec: awsS3: secret: name: <backingstore-secret-name> namespace: openshift-storage targetBucket: <bucket-name> type: aws-s3<bucket-name>- 现有 AWS 存储桶名称。

<backingstore-secret-name>- 上一步中创建的后备存储 secret 的名称。

10.3.2.2. 创建 IBM COS 支持的后备存储

先决条件

下载多云对象网关(MCG)命令行界面。

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-x86_64-rpms # yum install mcg

注意指定使用订阅管理器启用存储库的适当架构。例如,

- 对于 IBM Power,使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-ppc64le-rpms

- 对于 IBM Z 基础架构,使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-s390x-rpms

或者,您也可以从 下载红帽 OpenShift Data Foundation 页面上的 OpenShift Data Foundation RPM 安装 MCG 软件包。

注意根据您的架构选择正确的产品变体。

流程

使用命令行界面

在 MCG 命令行界面中运行以下命令:

noobaa backingstore create ibm-cos <backingstore_name> --access-key=<IBM ACCESS KEY> --secret-key=<IBM SECRET ACCESS KEY> --endpoint=<IBM COS ENDPOINT> --target-bucket <bucket-name> -n openshift-storage

<backingstore_name>- 后备储存的名称。

<IBM ACCESS KEY>,<IBM SECRET ACCESS KEY>, 和<IBM COS ENDPOINT>IBM 访问密钥 ID、secret 访问密钥和适当的区域端点,对应于现有 IBM 存储桶的位置。

要在 IBM 云中生成上述密钥,您必须在为您的目标存储桶创建服务凭证时包含 HMAC 凭证。

<bucket-name>现有 IBM 存储桶名称。此参数告知 MCG 将哪一个存储桶用作其后备存储的目标存储桶,以及随后数据存储和管理。

输出结果类似如下:

INFO[0001] ✅ Exists: NooBaa "noobaa" INFO[0002] ✅ Created: BackingStore "ibm-resource" INFO[0002] ✅ Created: Secret "backing-store-secret-ibm-resource"

使用 YAML 添加存储资源

使用凭证创建 secret:

apiVersion: v1 kind: Secret metadata: name: <backingstore-secret-name> namespace: openshift-storage type: Opaque data: IBM_COS_ACCESS_KEY_ID: <IBM COS ACCESS KEY ID ENCODED IN BASE64> IBM_COS_SECRET_ACCESS_KEY: <IBM COS SECRET ACCESS KEY ENCODED IN BASE64>

<IBM COS ACCESS KEY ID ENCODED IN BASE64>和<IBM COS SECRET ACCESS KEY ENCODED IN BASE64>- 使用 Base64 提供并编码您自己的 IBM COS 访问密钥 ID 和 secret 访问密钥,并使用这些属性的结果来代替这些属性。

<backingstore-secret-name>- 后备存储 secret 的名称。

为特定的后备存储应用以下 YAML:

apiVersion: noobaa.io/v1alpha1 kind: BackingStore metadata: finalizers: - noobaa.io/finalizer labels: app: noobaa name: bs namespace: openshift-storage spec: ibmCos: endpoint: <endpoint> secret: name: <backingstore-secret-name> namespace: openshift-storage targetBucket: <bucket-name> type: ibm-cos<bucket-name>- 现有的 IBM COS 存储桶名称。此参数告知 MCG 将哪一个存储桶用作其后备存储的目标存储桶,以及随后数据存储和管理。

<endpoint>- 与现有 IBM 存储桶名称的位置对应的区域端点。此参数指示 MCG 关于用于其后备存储的端点,然后是数据存储和管理。

<backingstore-secret-name>- 上一步中创建的 secret 的名称。

10.3.2.3. 创建 Azure 支持的后备存储

先决条件

下载多云对象网关(MCG)命令行界面。

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-x86_64-rpms # yum install mcg

注意指定使用订阅管理器启用存储库的适当架构。例如,如果是 IBM Z 基础架构,请使用以下命令:

# subscription-manager repos --enable=rh-odf-4-for-rhel-8-s390x-rpms