명령줄을 사용하여 Red Hat Virtualization을 자체 호스팅 엔진으로 설치

명령행을 사용하여 Red Hat Virtualization Manager를 관리하는 동일한 호스트에서 실행되는 가상 시스템으로 설치합니다.

초록

접두부

셀프 호스트 엔진 설치는 Ansible을 사용하여 자동화됩니다. 설치 스크립트(hosted-engine --deploy)는 초기 배포 호스트에서 실행되며 Red Hat Virtualization Manager(또는 "engine")는 배포 호스트에 생성된 가상 시스템에 설치 및 구성됩니다. Manager 및 데이터 웨어하우스 데이터베이스는 Manager 가상 시스템에 설치되어 있지만 필요한 경우 별도의 서버 사후 설치로 마이그레이션할 수 있습니다.

Manager 가상 시스템을 실행할 수 있는 호스트는 자체 호스팅 엔진 노드라고 합니다. 고가용성 기능을 지원하려면 두 개 이상의 자체 호스팅 엔진 노드가 필요합니다.

Manager 가상 시스템 전용 스토리지 도메인을 셀프 호스트 엔진 스토리지 도메인이라고 합니다. 이 스토리지 도메인은 설치 스크립트를 통해 생성되므로 설치를 시작하기 전에 기본 스토리지를 준비해야 합니다.

환경 옵션 및 권장 구성에 대한 정보는 계획 및 사전 요구 사항 가이드 를 참조하십시오. 자체 호스팅 엔진 환경과 관련된 구성은 셀프 호스트 엔진 권장 사항을 참조하십시오.

Red Hat Virtualization 주요 구성 요소

| 구성 요소 이름 | 설명 |

|---|---|

| Red Hat Virtualization Manager | 환경에서 리소스를 관리하는 그래픽 사용자 인터페이스와 REST API를 제공하는 서비스입니다. Manager는 Red Hat Enterprise Linux를 실행하는 실제 또는 가상 시스템에 설치됩니다. |

| 호스트 | Red Hat Enterprise Linux 호스트(RHEL 호스트)와 Red Hat Virtualization Host(이미지 기반 하이퍼바이저)는 지원되는 두 가지 유형의 호스트입니다. 호스트는 KVM(커널 기반 가상 시스템) 기술을 사용하고 가상 시스템 실행에 사용되는 리소스를 제공합니다. |

| 공유 스토리지 | 스토리지 서비스는 가상 시스템과 연결된 데이터를 저장하는 데 사용됩니다. |

| 데이터 웨어하우스 | Manager에서 구성 정보 및 통계 데이터를 수집하는 서비스입니다. |

셀프 호스트 엔진 아키텍처

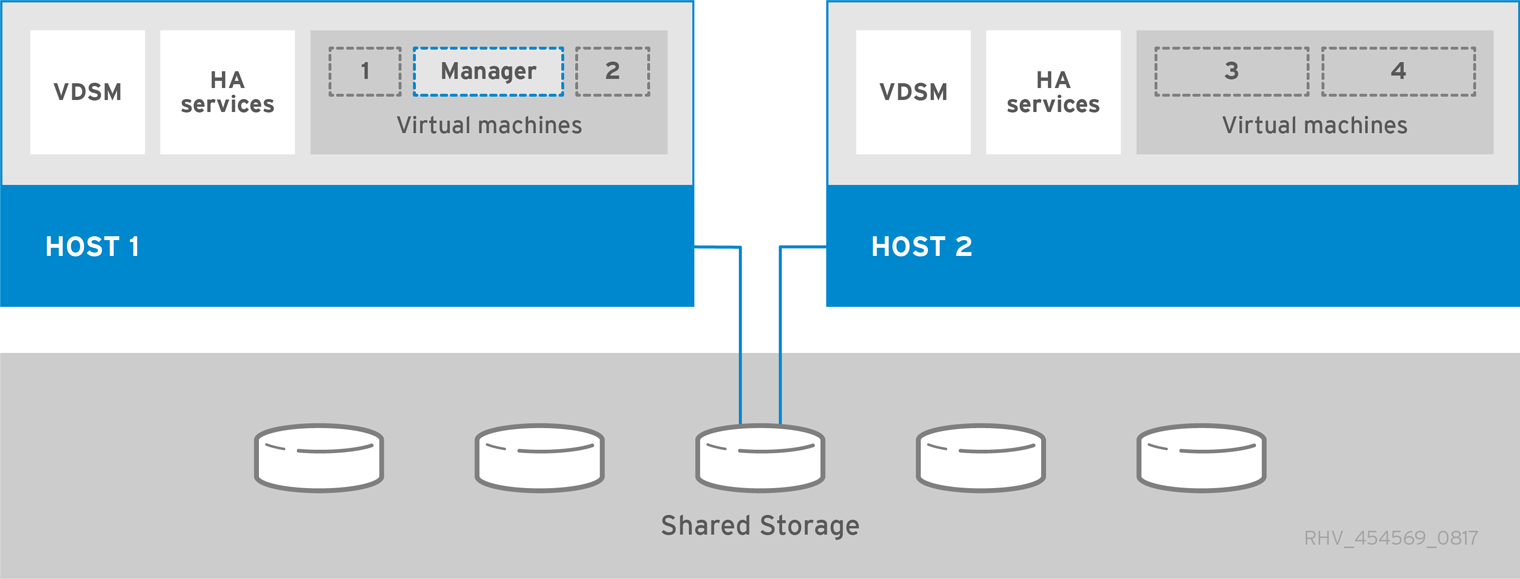

Red Hat Virtualization Manager는 관리하는 동일한 환경에서 자체 호스팅 엔진 노드(특별 호스트)에서 가상 시스템으로 실행됩니다. 셀프 호스트 엔진 환경에는 하나의 물리적 서버가 필요하지만 배포 및 관리를 위해 추가 관리 오버헤드가 필요합니다. 관리자는 외부 HA 관리 없이 가용성이 높습니다.

셀프 호스트 엔진 환경의 최소 설정에는 다음이 포함됩니다.

- 자체 호스팅 엔진 노드에서 호스팅되는 Red Hat Virtualization Manager 가상 시스템 1대. RHV-M Appliance는 Red Hat Enterprise Linux 8 가상 시스템의 설치를 자동화하는 데 사용하고 해당 가상 시스템에서 Manager를 사용합니다.

- 가상 시스템의 고가용성을 위해 최소 2개의 셀프 호스팅 엔진 노드. Red Hat Enterprise Linux 호스트 또는 RHVH(Red Hat Virtualization Host)를 사용할 수 있습니다. VDSM(호스트 에이전트)은 Red Hat Virtualization Manager와의 원활한 통신을 위해 모든 호스트에서 실행됩니다. HA 서비스는 Manager 가상 시스템의 고가용성을 관리하기 위해 모든 셀프 호스트 엔진 노드에서 실행됩니다.

- 사용하는 스토리지 유형에 따라 로컬 또는 원격 서버에서 호스팅할 수 있는 스토리지 서비스 1개. 모든 호스트에서 스토리지 서비스에 액세스할 수 있어야 합니다.

그림 1. 셀프 호스트 엔진 Red Hat Virtualization 아키텍처

1장. 설치 개요

자체 호스팅 엔진 설치에서는 Ansible 및 RHV-M Appliance( 사전 구성된 관리자 가상 시스템 이미지)를 사용하여 다음 작업을 자동화합니다.

- 첫 번째 셀프 호스트 엔진 노드 구성

- 해당 노드에 Red Hat Enterprise Linux 가상 머신 설치

- 해당 가상 머신에 Red Hat Virtualization Manager 설치 및 구성

- 셀프 호스트 엔진 스토리지 도메인 구성

RHV-M Appliance는 설치 중에만 사용됩니다. 관리자를 업그레이드하는 데 사용되지 않습니다.

셀프 호스트 엔진 환경 설치에는 다음 단계가 포함됩니다.

셀프 호스트 엔진 스토리지 도메인 및 표준 스토리지 도메인에 사용할 스토리지를 준비합니다. 다음 스토리지 유형 중 하나를 사용할 수 있습니다.

배포 호스트를 설치하여 에서 설치를 실행합니다. 이 호스트는 첫 번째 셀프 호스트 엔진 노드가 됩니다. 호스트 유형을 사용할 수 있습니다.

관리자에 더 많은 셀프 호스트 엔진 노드와 표준 호스트를 추가합니다. 셀프 호스트 엔진 노드는 Manager 가상 시스템 및 기타 가상 시스템을 실행할 수 있습니다. 표준 호스트는 Manager 가상 시스템은 실행할 수 없지만 다른 모든 가상 시스템을 실행할 수 있습니다.

- 스토리지 도메인을 Manager에 추가합니다. 셀프 호스트 엔진 스토리지 도메인은 Manager 가상 시스템 이외의 다른 용도로 사용하지 않는 것이 좋습니다.

- Manager와 별도로 서버에서 데이터베이스 또는 서비스를 호스팅하려는 경우 설치가 완료된 후 마이그레이션할 수 있습니다.

환경을 최신 상태로 유지합니다. 자세한 내용은 How do I update my Red Hat Virtualization system? 에서 참조하십시오. 알려진 문제에 대한 버그 수정이 자주 릴리스되므로 예약된 작업을 사용하여 호스트와 관리자를 업데이트합니다.

2장. 요구 사항

2.1. Red Hat Virtualization Manager 요구 사항

2.1.1. 하드웨어 요구 사항

여기에 설명된 최소 및 권장 하드웨어 요구 사항은 일반 중소 규모 설치를 기반으로 합니다. 정확한 요구 사항은 크기 및 부하에 따라 배포마다 다릅니다.

Red Hat Virtualization에 대한 하드웨어 인증은 Red Hat Enterprise Linux에 대한 하드웨어 인증의 적용을 받습니다. 자세한 내용은 Does Red Hat Virtualization also have hardware certification? 를 참조하십시오. Red Hat Enterprise Linux에서 사용할 수 있도록 특정 하드웨어 항목이 인증되었는지 확인하려면 Red Hat 인증 하드웨어 를 참조하십시오.

표 2.1. Red Hat Virtualization Manager 하드웨어 요구 사항

| 리소스 | 최소 | 권장 |

|---|---|---|

| CPU | 듀얼 코어 x86_64 CPU. | 쿼드 코어 x86_64 CPU 또는 여러 듀얼 코어 x86_64 CPU. |

| 메모리 | 데이터 웨어하우스가 설치되어 있지 않고 기존 프로세스에서 메모리를 사용하지 않는 경우 4GB의 사용 가능한 시스템 RAM. | 시스템 RAM 16GB. |

| 하드 디스크 | 로컬에서 액세스할 수 있고 쓰기 가능한 25GB의 디스크 공간. | 로컬에서 액세스할 수 있고 쓰기 가능한 50GB의 디스크 공간. RHV Manager 기록 데이터베이스 크기 계산기 를 사용하여 관리자 기록 데이터베이스 크기에 적합한 디스크 공간을 계산할 수 있습니다. |

| 네트워크 인터페이스 | 최소 1Gbps 대역폭의 NIC(네트워크 인터페이스 카드) 1개. | 최소 1Gbps 대역폭의 NIC(네트워크 인터페이스 카드) 1개. |

2.1.2. 브라우저 요구 사항

다음 브라우저 버전 및 운영 체제를 사용하여 관리 포털과 VM 포털에 액세스할 수 있습니다.

브라우저 지원은 계층으로 나뉩니다.

- 계층 1: 완전히 테스트되어 완벽하게 지원되는 브라우저와 운영 체제 조합. Red Hat 엔지니어링은 이 계층의 브라우저 문제를 해결하기 위해 최선을 다하고 있습니다.

- 계층 2: 부분적으로 테스트되었으며 작동할 가능성이 높은 브라우저와 운영 체제 조합. 이 계층에 대해 제한된 지원이 제공됩니다. Red Hat Engineering에서는 이 계층의 브라우저 문제를 수정하려고 시도합니다.

- 계층 3: 테스트되지 않았지만 작동할 수 있는 브라우저와 운영 체제 조합. 이 계층에는 최소한의 지원이 제공됩니다. Red Hat Engineering에서는 이 계층에 있는 브라우저의 사소한 문제만 수정하려고 시도합니다.

표 2.2. 브라우저 요구 사항

| 지원 계층 | 운영 체제 제품군 | 브라우저 |

|---|---|---|

| 계층 1 | Red Hat Enterprise Linux | Mozilla Firefox ESR(Extended Support Release) 버전 |

| Any | 최신 버전의 Google Chrome, Mozilla Firefox 또는 Microsoft Edge | |

| 계층 2 | ||

| 계층 3 | Any | 이전 버전의 Google Chrome 또는 Mozilla Firefox |

| Any | 기타 브라우저 |

2.1.3. 클라이언트 요구 사항

가상 시스템 콘솔은 Red Hat Enterprise Linux 및 Windows에서 지원되는 Remote Viewer(virt-viewer) 클라이언트를 통해서만 액세스할 수 있습니다. virt-viewer 를 설치하려면 가상 머신 관리 가이드의 클라이언트 시스템에 지원 구성 요소 설치를 참조하십시오. virt-viewer 를 설치하려면 관리자 권한이 필요합니다.

SPICE, VNC 또는 RDP(Windows 전용) 프로토콜을 사용하여 가상 머신 콘솔에 액세스할 수 있습니다. 게스트 운영 체제에 QXLDOD 그래픽 드라이버를 설치하여 SPICE의 기능을 개선할 수 있습니다. SPICE는 현재 2560x1600픽셀의 최대 해상도를 지원합니다.

클라이언트 운영 체제 SPICE 지원

지원되는 QXLDOD 드라이버는 Red Hat Enterprise Linux 7.2 이상 및 Windows 10에서 사용할 수 있습니다.

SPICE는 QXLDOD 드라이버를 사용하여 Windows 8 또는 8.1에서 작동할 수 있지만 인증되거나 테스트되지 않았습니다.

2.1.4. 운영 체제 요구 사항

Red Hat Virtualization Manager는 Red Hat Enterprise Linux 8.6의 기본 설치에 설치되어 있어야 합니다.

기본 설치 후 추가 패키지를 설치하지 마십시오. 이는 Manager에 필요한 패키지를 설치하려고 할 때 종속성 문제가 발생할 수 있기 때문입니다.

Manager 설치에 필요한 리포지토리 이외의 추가 리포지토리를 활성화하지 마십시오.

2.2. 호스트 요구 사항

Red Hat Virtualization에 대한 하드웨어 인증은 Red Hat Enterprise Linux에 대한 하드웨어 인증의 적용을 받습니다. 자세한 내용은 Does Red Hat Virtualization also have hardware certification? 를 참조하십시오. Red Hat Enterprise Linux에서 사용할 수 있도록 특정 하드웨어 항목이 인증되었는지 확인하려면 인증 솔루션 찾기를 참조하십시오.

게스트에 적용되는 요구 사항 및 제한 사항에 대한 자세한 내용은 Red Hat Enterprise Linux 기술 기능 및 제한 및 Red Hat Virtualization에 대한 지원 제한을 참조하십시오.

2.2.1. CPU 요구 사항

모든 CPU는 Intel® 64 또는 AMD64 CPU 확장 기능을 지원해야 하며 AMD-V™ 또는 Intel VT® 하드웨어 가상화 확장 기능이 활성화되어 있어야 합니다. No eXecute 플래그(NX)도 지원이 필요합니다.

지원되는 CPU 모델은 다음과 같습니다.

AMD

- Opteron G4

- Opteron G5

- EPYC

Intel

- Nehalem

- 웨스트메르

- SandyBridge

- IvyBridge

- Haswell

- Broadwell

- Skylake Client

- Skylake Server

- Cascadelake 서버

보안 업데이트가 포함된 각 CPU 모델에 대해 CPU 유형은 기본 유형 과 보안 유형을 나열합니다. 예를 들면 다음과 같습니다.

- Intel Cascadelake Server Family

- 보안 Intel Cascadelake Server Family

보안 CPU 유형에는 최신 업데이트가 포함되어 있습니다. 자세한 내용은 BZ#1731395를 참조하십시오.

2.2.1.1. 프로세서가 필요한 플래그를 지원하는지 확인

BIOS에서 가상화를 활성화해야 합니다. 이 변경 후 호스트의 전원을 끄고 재부팅하여 변경 사항이 적용되는지 확인합니다.

절차

- Red Hat Enterprise Linux 또는 Red Hat Virtualization Host 부팅 화면에서 임의의 키를 누르고 목록에서 Boot or Boot with serial console 항목을 선택합니다.

-

Tab을 눌러 선택한 옵션의 커널 매개 변수를 편집합니다. -

마지막 커널 매개 변수 뒤에 공백이 있는지 확인하고 매개 변수

rescue를 추가합니다. -

Enter를 눌러 복구 모드로 부팅합니다. 프롬프트에서 프로세서에 필요한 확장 기능이 있으며 다음 명령을 실행하여 활성화되어 있는지 확인합니다.

# grep -E 'svm|vmx' /proc/cpuinfo | grep nx

출력이 표시되면 프로세서는 하드웨어 가상화를 지원합니다. 출력이 표시되지 않으면 프로세서는 여전히 하드웨어 가상화를 지원할 수 있습니다. 일부 환경에서는 제조 업체가 BIOS에서 가상화 확장 기능을 사용하지 않도록 설정할 수도 있습니다. 이 경우 시스템의 BIOS 및 제조업체에서 제공하는 마더보드 설명서를 참조하십시오.

2.2.2. 메모리 요구 사항

필요한 최소 RAM은 2GB입니다. 클러스터 수준 4.2에서 4.5까지의 경우 Red Hat Virtualization Host에서 VM당 지원되는 최대 RAM은 6TB입니다. 클러스터 수준 4.6 ~ 4.7의 경우 Red Hat Virtualization Host에서 VM당 지원되는 최대 RAM은 16TB입니다.

그러나 필요한 RAM 크기는 게스트 운영 체제 요구 사항, 게스트 애플리케이션 요구 사항, 게스트 메모리 활동 및 사용량에 따라 다릅니다. 또한 KVM은 가상화된 게스트의 물리적 RAM을 과다 할당하여 게스트가 최대 부하에서 동시에 작동하지 않는다는 가정하에 물리적인 요구 사항보다 큰 RAM 요구 사항을 가진 게스트를 프로비저닝할 수 있습니다. KVM은 필요에 따라 게스트에 RAM을 할당하고 활용도가 낮은 게스트를 스왑으로 전환하여 이 작업을 수행합니다.

2.2.3. 스토리지 요구 사항

호스트에는 구성, 로그, 커널 덤프를 저장하고 스왑 공간으로 사용하기 위한 스토리지가 필요합니다. 스토리지는 로컬 또는 네트워크 기반일 수 있습니다. RHVH(Red Hat Virtualization Host)는 네트워크 스토리지에서 하나, 일부 또는 모든 기본 할당을 사용하여 부팅할 수 있습니다. 네트워크 스토리지에서 부팅하면 네트워크 연결이 끊어질 수 있습니다. 드롭인 다중 경로 구성 파일을 추가하면 네트워크 연결 손실 문제를 해결할 수 있습니다. RHVH가 SAN 스토리지에서 부팅되고 연결이 끊어지면 네트워크 연결이 복원될 때까지 파일을 읽기 전용으로 전환합니다. 네트워크 스토리지를 사용하면 성능이 저하될 수 있습니다.

RHVH의 최소 스토리지 요구 사항은 이 섹션에 설명되어 있습니다. Red Hat Enterprise Linux 호스트의 스토리지 요구 사항은 기존 구성에서 사용하는 디스크 공간 크기에 따라 다르지만 RHVH보다 클 것으로 예상됩니다.

호스트 설치의 최소 스토리지 요구 사항은 다음과 같습니다. 그러나 더 많은 스토리지 공간을 사용하는 기본 할당을 사용합니다.

- / (root) - 6 GB

- /home - 1GB

- /tmp - 1GB

- /boot - 1GB

- /var - 5GB

- /var/crash - 10GB

- /var/log - 8GB

- /var/log/audit - 2GB

- /var/tmp - 10GB

- 스왑 - 1GB. 자세한 내용은 Red Hat 플랫폼에 권장되는 스왑 크기? 를 참조하십시오.

- Anaconda는 향후 메타데이터 확장을 위해 볼륨 그룹 내에 씬 풀 크기의 20%를 예약합니다. 이렇게 하면 기본으로 제공되는 구성이 정상적인 사용 조건에서 공간이 부족해지는 것을 방지할 수 있습니다. 설치 중에 씬 풀의 오버 프로비저닝도 지원되지 않습니다.

- 최소 합계 - 64GiB

자체 호스팅 엔진 설치를 위해 RHV-M appliance를 설치하는 경우에도 /var/tmp 는 10GB 이상이어야 합니다.

메모리 과다 할당을 사용하려면 모든 가상 머신에 가상 메모리를 제공하기에 충분한 스왑 공간을 추가합니다. Memory Optimization(메모리 최적화 )을 참조하십시오.

2.2.4. PCI 장치 요구 사항

호스트에는 최소 대역폭이 1Gbps인 네트워크 인터페이스가 하나 이상 있어야 합니다. 각 호스트에는 두 개의 네트워크 인터페이스가 있어야 하며, 이 인터페이스는 가상 시스템 마이그레이션과 같은 네트워크 집약적인 활동을 지원하기 위한 전용으로 사용됩니다. 이러한 작업의 성능은 사용 가능한 대역폭에 따라 제한됩니다.

Intel Q35 기반 가상 시스템에서 PCI Express 및 기존 PCI 장치를 사용하는 방법에 대한 자세한 내용은 Q35 가상 시스템에서 PCI Express 및 규칙 PCI 장치 사용을 참조하십시오.

2.2.5. 장치 할당 요구 사항

가상 머신에서 호스트의 특정 PCIe 장치를 사용할 수 있도록 장치 할당 및 PCI 통과를 구현하려는 경우 다음 요구 사항이 충족되는지 확인하십시오.

- CPU는 IOMMU(예: VT-d 또는 AMD-Vi)를 지원해야 합니다. IBM POWER8에서는 기본적으로 IOMMU를 지원합니다.

- 펌웨어가 IOMMU를 지원해야 합니다.

- 사용된 CPU 루트 포트는 ACS 또는 ACS와 동등한 기능을 지원해야 합니다.

- PCIe 장치는 ACS 또는 ACS 동등한 기능을 지원해야 합니다.

- PCIe 장치와 루트 포트 간의 모든 PCIe 스위치와 브리지는 ACS를 지원해야 합니다. 예를 들어 스위치가 ACS를 지원하지 않는 경우 해당 스위치의 모든 장치는 동일한 IOMMU 그룹을 공유하며 동일한 가상 시스템에만 할당할 수 있습니다.

- GPU 지원의 경우 Red Hat Enterprise Linux 8은 PCIe 기반 NVIDIA K-Series Quadro(2000 시리즈 이상), GRID, 비VGA 그래픽 장치로의 PCI 장치 할당을 지원합니다. 현재 최대 두 개의 GPU를 표준 에뮬레이트된 VGA 인터페이스 외에 가상 머신에 연결할 수 있습니다. 에뮬레이트된 VGA는 사전 부팅 및 설치에 사용되며 NVIDIA GPU는 NVIDIA 그래픽 드라이버가 로드될 때 사용합니다. NVIDIA Quadro 2000은 지원되지 않으며 Quadro K420 카드도 지원되지 않습니다.

벤더 사양 및 데이터시트를 확인하여 하드웨어가 이러한 요구 사항을 충족하는지 확인하십시오. lspci -v 명령을 사용하여 시스템에 이미 설치된 PCI 장치 정보를 출력할 수 있습니다.

2.2.6. vGPU 요구 사항

호스트가 해당 호스트의 가상 머신에서 vGPU를 사용하려면 다음 요구 사항을 충족해야 합니다.

- vGPU-compatible GPU

- GPU 사용 호스트 커널

- 올바른 드라이버가 있는 설치된 GPU

- 가상 시스템의 관리 포털 호스트 장치 탭에서 Manage vGPU 대화 상자를 사용하여 vGPU 유형 및 이 가상 머신에서 사용할 인스턴스 수를 선택합니다.

- 클러스터의 각 호스트에 설치된 vGPU 가능 드라이버

- vGPU 드라이버가 설치된 vGPU 지원 가상 머신 운영 체제

2.3. 네트워킹 요구사항

2.3.1. 일반 요구 사항

Red Hat Virtualization에서는 Manager를 실행하는 실제 또는 가상 시스템에서 IPv6를 활성화해야 합니다. 시스템에서 사용하지 않는 경우에도 Manager 시스템에서 IPv6를 비활성화하지 마십시오.

2.3.2. 셀프 호스트 엔진 배포를 위한 네트워크 범위

셀프 호스트 엔진 배포 프로세스에서는 192.168. 아래의 /24 네트워크 주소를 일시적으로 사용합니다. 기본값은 192.168.222.0/24 이고 이 주소가 사용 중인 경우 사용되지 않는 주소를 찾을 때까지 192.168 에서 다른 /24 주소를 시도합니다. 이 범위에서 사용되지 않는 네트워크 주소를 찾지 못하면 배포에 실패합니다.

명령줄을 사용하여 자체 호스팅 엔진을 설치하는 경우 --ansible-extra-vars=he_ipv4_subnet_prefix=PREFIX 옵션을 사용하여 대체 /24 네트워크 범위를 사용하도록 배포 스크립트를 설정할 수 있습니다. 여기서 PREFIX 는 기본 범위의 접두사입니다. 예를 들면 다음과 같습니다.

# hosted-engine --deploy --ansible-extra-vars=he_ipv4_subnet_prefix=192.168.222

명령줄을 사용하여 Red Hat Virtualization을 자체 호스팅 엔진으로 설치하여 다른 범위만 설정할 수 있습니다.

2.3.3. DNS, NTP 및 IPMI 펜싱에 대한 방화벽 요구 사항

다음 모든 항목에 대한 방화벽 요구 사항은 개별적으로 고려해야 하는 특수한 사례입니다.

DNS 및 NTP

Red Hat Virtualization에서는 DNS 또는 NTP 서버를 생성하지 않으므로 방화벽에 들어오는 트래픽에 대해 열려 있는 포트가 필요하지 않습니다.

기본적으로 Red Hat Enterprise Linux는 모든 대상 주소의 DNS 및 NTP로의 아웃바운드 트래픽을 허용합니다. 나가는 트래픽을 비활성화하는 경우 DNS 및 NTP 서버로 전송되는 요청에 대한 예외를 정의합니다.

- Red Hat Virtualization Manager 및 모든 호스트(Red Hat Virtualization Host 및 Red Hat Enterprise Linux 호스트)는 정규화된 도메인 이름과 완벽하게 정렬된 정방향 및 역방향 이름 확인을 갖추고 있어야 합니다.

- Red Hat Virtualization 환경에서 DNS 서비스를 가상 시스템으로 실행하는 것은 지원되지 않습니다. Red Hat Virtualization 환경에서 사용하는 모든 DNS 서비스는 환경 외부에서 호스팅되어야 합니다.

-

이름 확인을 위해

/etc/hosts파일 대신 DNS를 사용합니다. hosts 파일을 사용하려면 일반적으로 더 많은 작업이 필요하며 오류가 발생할 가능성이 높아집니다.

IPMI 및 기타 펜싱 메커니즘 (선택 사항)

IPMI(Intelligent Platform Management Interface) 및 기타 펜싱 메커니즘의 경우 방화벽에 들어오는 트래픽에 대한 열려 있는 포트가 필요하지 않습니다.

기본적으로 Red Hat Enterprise Linux는 모든 대상 주소의 포트에 아웃바운드 IPMI 트래픽을 허용합니다. 나가는 트래픽을 비활성화하는 경우 IPMI 또는 펜싱 서버로 전송되는 요청의 경우 예외를 수행합니다.

클러스터의 각 Red Hat Virtualization Host 및 Red Hat Enterprise Linux 호스트는 클러스터에 있는 다른 모든 호스트의 펜싱 장치에 연결할 수 있어야 합니다. 클러스터 호스트에 오류가 발생하면 (네트워크 오류, 스토리지 오류...)) 호스트 역할을 수행할 수 없으며 데이터 센터의 다른 호스트에 연결할 수 있어야 합니다.

특정 포트 번호는 사용 중인 펜스 에이전트 유형 및 구성 방법에 따라 다릅니다.

다음 섹션의 방화벽 요구 사항 표는 이 옵션을 나타내지 않습니다.

2.3.4. Red Hat Virtualization Manager 방화벽 요구 사항

Red Hat Virtualization Manager에서는 시스템의 방화벽을 통해 네트워크 트래픽을 허용하도록 여러 포트를 열어야 합니다.

engine-setup 스크립트는 방화벽을 자동으로 구성할 수 있습니다.

여기에 설명된 방화벽 구성은 기본 구성이 있다고 가정합니다.

이러한 방화벽 요구 사항에 대한 다이어그램은 https://access.redhat.com/articles/3932211 에서 확인할 수 있습니다. 테이블의 ID를 사용하여 다이어그램에서 연결을 조회할 수 있습니다.

표 2.3. Red Hat Virtualization Manager 방화벽 요구 사항

| ID | 포트 | 프로토콜 | 소스 | 대상 | 목적 | 기본적으로 암호화됨 |

|---|---|---|---|---|---|---|

| M1 | - | ICMP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Red Hat Virtualization Manager | 선택 사항: 진단에 도움이 될 수 있습니다. | 없음 |

| M2 | 22 | TCP | 백엔드 구성 및 소프트웨어 업그레이드를 포함하여 관리자 유지 관리에 사용되는 시스템. | Red Hat Virtualization Manager | SSH(Secure Shell) 액세스. 선택 사항: | 있음 |

| M3 | 2222 | TCP | 가상 시스템 직렬 콘솔에 액세스하는 클라이언트. | Red Hat Virtualization Manager | SSH(Secure Shell) 액세스로 가상 시스템 직렬 콘솔에 연결할 수 있습니다. | 있음 |

| M4 | 80, 443 | TCP | 관리 포털 클라이언트 VM 포털 클라이언트 Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 REST API 클라이언트 | Red Hat Virtualization Manager | 관리자에 HTTP(포트 80, 암호화되지 않음) 및 HTTPS(포트 443, 암호화된) 액세스를 제공합니다. HTTP는 연결을 HTTPS로 리디렉션합니다. | 있음 |

| M5 | 6100 | TCP | 관리 포털 클라이언트 VM 포털 클라이언트 | Red Hat Virtualization Manager |

Manager에서 websocket 프록시가 실행 중일 때 웹 기반 콘솔 클라이언트 | 없음 |

| M6 | 7410 | UDP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Red Hat Virtualization Manager |

호스트에서 Kdump가 활성화된 경우 Manager의 fence_kdump 리스너에 대해 이 포트를 엽니다. fence_kdump Advanced Configuration 을 참조하십시오. | 없음 |

| M7 | 54323 | TCP | 관리 포털 클라이언트 |

Red Hat Virtualization Manager( |

| 있음 |

| M8 | 6642 | TCP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | OVN(Open Virtual Network) southbound 데이터베이스 | OVN(Open Virtual Network) 데이터베이스에 연결 | 있음 |

| M9 | 9696 | TCP | OVN의 외부 네트워크 공급자 클라이언트 | OVN의 외부 네트워크 공급자 | OpenStack Networking API | 예, engine-setup에 의해 생성된 구성으로. |

| M10 | 35357 | TCP | OVN의 외부 네트워크 공급자 클라이언트 | OVN의 외부 네트워크 공급자 | OpenStack Identity API | 예, engine-setup에 의해 생성된 구성으로. |

| M11 | 53 | TCP, UDP | Red Hat Virtualization Manager | DNS Server | 1023 이상의 포트에서 포트 53으로의 DNS 조회 요청 및 응답. 기본적으로 를 엽니다. | 없음 |

| M12 | 123 | UDP | Red Hat Virtualization Manager | NTP 서버 | 1023 이상의 포트에서 123 포트로의 NTP 요청 및 응답. 기본적으로 를 엽니다. | 없음 |

-

기본 구성에서 OVN northbound 데이터베이스(6641)의 유일한 클라이언트는

ovirt-provider-ovn이므로 OVN northbound 데이터베이스(6641)의 포트는 나열되지 않습니다. 둘 다 동일한 호스트에서 실행되므로 해당 통신은 네트워크에 표시되지 않습니다. - 기본적으로 Red Hat Enterprise Linux는 모든 대상 주소의 DNS 및 NTP로의 아웃바운드 트래픽을 허용합니다. 나가는 트래픽을 비활성화하는 경우 Manager가 DNS 및 NTP 서버로 요청을 보내는 경우 예외를 수행합니다. 다른 노드에는 DNS 및 NTP가 필요할 수도 있습니다. 이 경우 해당 노드의 요구 사항을 참조하고 그에 따라 방화벽을 구성합니다.

2.3.5. 호스트 방화벽 요구 사항

Red Hat Enterprise Linux 호스트와 RHVH(Red Hat Virtualization Host)에서는 시스템 방화벽을 통해 네트워크 트래픽을 허용하도록 여러 포트를 열어야 합니다. 방화벽 규칙은 Manager에 새 호스트를 추가할 때 기본적으로 자동으로 구성되며 기존 방화벽 구성을 덮어씁니다.

새 호스트를 추가할 때 자동 방화벽 구성을 비활성화하려면 Advanced Parameters (고급 매개 변수 )에서 Automatically configure host firewall (호스트 방화벽 자동 구성) 확인란을 지웁니다.

호스트 방화벽 규칙을 사용자 지정하려면 RHV를 참조하십시오. 호스트의 방화벽 규칙을 사용자 지정하는 방법?.

이러한 방화벽 요구 사항의 다이어그램은 Red Hat Virtualization에서 확인할 수 있습니다. 방화벽 요구 사항 다이어그램. 테이블의 ID를 사용하여 다이어그램에서 연결을 조회할 수 있습니다.

표 2.4. 가상화 호스트 방화벽 요구 사항

| ID | 포트 | 프로토콜 | 소스 | 대상 | 목적 | 기본적으로 암호화됨 |

|---|---|---|---|---|---|---|

| H1 | 22 | TCP | Red Hat Virtualization Manager | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | SSH(Secure Shell) 액세스. 선택 사항: | 있음 |

| H2 | 2223 | TCP | Red Hat Virtualization Manager | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | SSH(Secure Shell) 액세스로 가상 시스템 직렬 콘솔에 연결할 수 있습니다. | 있음 |

| H3 | 161 | UDP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Red Hat Virtualization Manager | SNMP(Simple Network Management Protocol). 호스트에서 하나 이상의 외부 SNMP 관리자에게 보내는 간단한 네트워크 관리 프로토콜 트랩을 원하는 경우에만 필요합니다. 선택 사항: | 없음 |

| H4 | 111 | TCP | NFS 스토리지 서버 | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | NFS 연결. 선택 사항: | 없음 |

| H5 | 5900 - 6923 | TCP | 관리 포털 클라이언트 VM 포털 클라이언트 | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | VNC 및 SPICE를 통한 원격 게스트 콘솔 액세스. 가상 시스템에 대한 클라이언트 액세스를 용이하게 하려면 이러한 포트가 열려 있어야 합니다. | 예(선택 사항) |

| H6 | 5989 | TCP, UDP | CIFSMOM (Common Information Model Object Manager) | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | CIFSMOM(Common Information Model Object Manager)에서 호스트에서 실행되는 가상 시스템을 모니터링하는 데 사용됩니다. CIMOM을 사용하여 가상화 환경의 가상 시스템을 모니터링하려는 경우에만 필요합니다. 선택 사항: | 없음 |

| H7 | 9090 | TCP | Red Hat Virtualization Manager 클라이언트 시스템 | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | 설치된 경우 Cockpit 웹 인터페이스에 액세스하는 데 필요합니다. | 있음 |

| H8 | 16514 | TCP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | libvirt 를 사용하는 가상 시스템 마이그레이션. | 있음 |

| H9 | 49152 - 49215 | TCP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | VDSM을 사용한 가상 시스템 마이그레이션 및 펜싱. 이러한 포트는 가상 시스템의 자동화 및 수동 마이그레이션을 모두 원활하게 수행할 수 있도록 열려 있어야 합니다. | 네, 필요합니다. 펜싱 에이전트에 따라 libvirt를 통해 마이그레이션이 수행됩니다. |

| H10 | 54321 | TCP | Red Hat Virtualization Manager Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Manager 및 기타 가상화 호스트와의 VDSM 통신. | 있음 |

| H11 | 54322 | TCP |

Red Hat Virtualization Manager | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 |

| 있음 |

| H12 | 6081 | UDP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | OVN이 호스트 간에 터널을 생성할 수 있도록 OVN이 네트워크 공급자로 사용되는 경우 필수입니다. | 없음 |

| H13 | 53 | TCP, UDP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | DNS Server | 1023 이상의 포트에서 포트 53으로의 DNS 조회 요청 및 응답. 이 포트는 필수이며 기본적으로 열려 있습니다. | 없음 |

| H14 | 123 | UDP | Red Hat Virtualization Host Red Hat Enterprise Linux 호스트 | NTP 서버 | 1023 이상의 포트에서 123 포트로의 NTP 요청 및 응답. 이 포트는 필수이며 기본적으로 열려 있습니다. | |

| H15 | 4500 | TCP, UDP | Red Hat Virtualization Host | Red Hat Virtualization Host | 인터넷 보안 프로토콜 (IPSec) | 있음 |

| H16 | 500 | UDP | Red Hat Virtualization Host | Red Hat Virtualization Host | 인터넷 보안 프로토콜 (IPSec) | 있음 |

| H17 | - | AH, ESP | Red Hat Virtualization Host | Red Hat Virtualization Host | 인터넷 보안 프로토콜 (IPSec) | 있음 |

기본적으로 Red Hat Enterprise Linux는 모든 대상 주소의 DNS 및 NTP로의 아웃바운드 트래픽을 허용합니다. 나가는 트래픽을 비활성화하는 경우 Red Hat Virtualization Host에 대한 예외를 만드십시오.

DNS 및 NTP 서버로 요청을 보낼 Red Hat Enterprise Linux 호스트. 다른 노드에는 DNS 및 NTP가 필요할 수도 있습니다. 이 경우 해당 노드의 요구 사항을 참조하고 그에 따라 방화벽을 구성합니다.

2.3.6. 데이터베이스 서버 방화벽 요구 사항

Red Hat Virtualization에서는 Manager 데이터베이스(엔진) 및 데이터 웨어하우스 데이터베이스(ovirt-engine-history)에 원격 데이터베이스 서버를 사용할 수 있습니다. 원격 데이터베이스 서버를 사용하려면 관리자 및 데이터 웨어하우스 서비스(관리자와 분리 가능)의 연결을 허용해야 합니다.

마찬가지로 외부 시스템에서 로컬 또는 원격 데이터 웨어하우스 데이터베이스에 액세스하려는 경우 데이터베이스에서 해당 시스템의 연결을 허용해야 합니다.

외부 시스템에서 Manager 데이터베이스에 액세스하는 것은 지원되지 않습니다.

이러한 방화벽 요구 사항에 대한 다이어그램은 https://access.redhat.com/articles/3932211 에서 확인할 수 있습니다. 테이블의 ID를 사용하여 다이어그램에서 연결을 조회할 수 있습니다.

표 2.5. 데이터베이스 서버 방화벽 요구 사항

| ID | 포트 | 프로토콜 | 소스 | 대상 | 목적 | 기본적으로 암호화됨 |

|---|---|---|---|---|---|---|

| D1 | 5432 | TCP, UDP | Red Hat Virtualization Manager 데이터 웨어하우스 서비스 |

관리자 (

데이터 웨어하우스( | PostgreSQL 데이터베이스 연결에 대한 기본 포트입니다. | |

| D2 | 5432 | TCP, UDP | 외부 시스템 |

데이터 웨어하우스( | PostgreSQL 데이터베이스 연결에 대한 기본 포트입니다. | 기본적으로 비활성되어 있습니다. 아니요,하지만 활성화할 수 있습니다. |

2.3.7. 최대 전송 단위 요구 사항

배포 중에 호스트에 대해 권장되는 최대 전송 단위(MTU) 설정은 1500입니다. 환경이 다른 MTU로 설정된 후 이 설정을 업데이트할 수 있습니다. MTU 설정을 변경하는 방법에 대한 자세한 내용은 호스팅 엔진 VM 네트워크 MTU를 변경하는 방법을 참조하십시오.

3장. Red Hat Virtualization용 스토리지 준비

새 환경의 스토리지 도메인에 사용할 스토리지를 준비해야 합니다. Red Hat Virtualization 환경에는 데이터 스토리지 도메인이 하나 이상 있어야 하지만 추가하는 것이 좋습니다.

호스트의 운영 체제를 설치하거나 다시 설치하는 경우 먼저 호스트에 연결된 기존 비OS 스토리지를 분리하여 이러한 디스크가 실수로 초기화되는 것을 방지하고 잠재적인 데이터가 손실되도록 하는 것이 좋습니다.

데이터 도메인에는 데이터 센터에 있는 모든 가상 시스템과 템플릿의 가상 하드 디스크와 OVF 파일이 있으며 활성 상태에서는 데이터 센터 간에 공유할 수 없습니다(데이터 센터 간에 마이그레이션할 수 있음). 여러 스토리지 유형의 데이터 도메인을 동일한 데이터 센터에 추가할 수 있으며, 모두 로컬 도메인이 아니라 공유됩니다.

다음 스토리지 유형 중 하나를 사용할 수 있습니다.

사전 요구 사항

셀프 호스트 엔진에는 Manager 가상 시스템 전용이 74GiB 이상인 추가 데이터 도메인이 있어야 합니다. 셀프 호스트 엔진 설치 프로그램은 이 도메인을 생성합니다. 설치하기 전에 이 도메인의 스토리지를 준비합니다.

주의셀프 호스트 엔진의 배포 후 셀프 호스트 엔진 스토리지 도메인을 확장하거나 변경할 수 없습니다. 이러한 변경으로 인해 셀프 호스트 엔진이 부팅되지 않을 수 있습니다.

- FCP 또는 iSCSI 중 하나의 블록 스토리지 도메인을 사용하는 경우 단일 대상 LUN은 자체 호스팅 엔진에 대해 지원되는 유일한 설정입니다.

- iSCSI 스토리지를 사용하는 경우 셀프 호스트 엔진 스토리지 도메인에서 전용 iSCSI 대상을 사용해야 합니다. 추가 스토리지 도메인은 다른 iSCSI 대상을 사용해야 합니다.

- 셀프 호스트 엔진 스토리지 도메인과 동일한 데이터 센터에 추가 데이터 스토리지 도메인을 생성하는 것이 좋습니다. 활성 데이터 스토리지 도메인이 하나뿐인 데이터 센터에 셀프 호스트 엔진을 배포하고 해당 스토리지 도메인이 손상된 경우 새 스토리지 도메인을 추가하거나 손상된 스토리지 도메인을 제거할 수 없습니다. 셀프 호스트 엔진을 재배포해야 합니다.

3.1. NFS 스토리지 준비

Red Hat Enterprise Virtualization Host 시스템에서 스토리지 도메인 역할을 할 파일 스토리지 또는 원격 서버에서 NFS 공유를 설정합니다. 원격 스토리지의 공유를 내보내고 Red Hat Virtualization Manager에서 구성한 후 Red Hat Virtualization 호스트에서 공유를 자동으로 가져옵니다.

NFS 설정, 구성, 마운트 및 내보내기에 대한 자세한 내용은 Red Hat Enterprise Linux 8의 파일 시스템 관리를 참조하십시오.

Red Hat Virtualization에는 특정 시스템 사용자 계정과 시스템 사용자 그룹이 필요하므로 Manager가 내보낸 디렉토리로 표시되는 스토리지 도메인에 데이터를 저장할 수 있습니다. 다음 절차에서는 한 디렉토리에 대한 권한을 설정합니다. Red Hat Virtualization에서 스토리지 도메인으로 사용하려는 모든 디렉토리에 대해 chown 및 chmod 단계를 반복해야 합니다.

사전 요구 사항

NFS

utils패키지를 설치합니다.# dnf install nfs-utils -y

활성화된 버전을 확인하려면 다음을 수행하십시오.

# cat /proc/fs/nfsd/versions

다음 서비스를 활성화합니다.

# systemctl enable nfs-server # systemctl enable rpcbind

절차

kvm그룹을 생성합니다.# groupadd kvm -g 36

kvm그룹에vdsm사용자를 생성합니다.# useradd vdsm -u 36 -g kvm

스토리지디렉터리를 생성하고 액세스 권한을 수정합니다.# mkdir /storage # chmod 0755 /storage # chown 36:36 /storage/

관련 권한을 사용하여

스토리지디렉토리를/etc/exports에 추가합니다.# vi /etc/exports # cat /etc/exports /storage *(rw)

다음 서비스를 다시 시작하십시오.

# systemctl restart rpcbind # systemctl restart nfs-server

특정 IP 주소에 사용할 수 있는 내보내기를 확인하려면 다음을 수행하십시오.

# exportfs /nfs_server/srv 10.46.11.3/24 /nfs_server <world>

서비스를 시작한 후 /etc/exports 에서 변경한 경우 exportfs -ra 명령을 사용하여 변경 사항을 다시 로드할 수 있습니다. 위의 단계를 모두 수행한 후에는 내보내기 디렉터리를 준비하고 다른 호스트에서 테스트하여 사용할 수 있는지 확인할 수 있습니다.

3.2. iSCSI 스토리지 준비

Red Hat Virtualization은 LUN으로 구성된 볼륨 그룹에서 생성된 스토리지 도메인인 iSCSI 스토리지를 지원합니다. 볼륨 그룹과 LUN은 한 번에 두 개 이상의 스토리지 도메인에 연결할 수 없습니다.

iSCSI 스토리지 설정 및 구성에 대한 자세한 내용은 Red Hat Enterprise Linux 8의 스토리지 장치 관리에서 iSCSI 대상 구성을 참조하십시오.

블록 스토리지를 사용하고 있으며 원시 장치 또는 직접 LUN에 가상 머신을 배포하고 LVM(Logical Volume Manager)으로 관리하려는 경우 게스트 논리 볼륨을 숨길 필터를 생성해야 합니다. 그러면 호스트가 부팅될 때 게스트 논리 볼륨이 활성화되지 않으므로 오래된 논리 볼륨으로 인해 데이터가 손상될 수 있습니다. vdsm-tool config-lvm-filter 명령을 사용하여 LVM에 대한 필터를 생성합니다. LVM 필터 생성참조

Red Hat Virtualization은 현재 블록 크기가 4K인 블록 스토리지를 지원하지 않습니다. 레거시(512b 블록) 모드에서 블록 스토리지를 구성해야 합니다.

호스트가 SAN 스토리지에서 부팅되고 스토리지 연결이 끊어지면 스토리지 파일 시스템이 읽기 전용으로 되어 연결이 복원된 후 이 상태로 유지됩니다.

이러한 상황을 방지하려면 연결 시 대기 중인지 확인하려면 부팅 LUN에 대해 SAN의 루트 파일 시스템에 드롭인 다중 경로 구성 파일을 추가합니다.

# cat /etc/multipath/conf.d/host.conf

multipaths {

multipath {

wwid boot_LUN_wwid

no_path_retry queue

}3.3. FCP 스토리지 준비

Red Hat Virtualization은 기존 LUN으로 구성된 볼륨 그룹에서 스토리지 도메인을 생성하여 SAN 스토리지를 지원합니다. 한 번에 두 개 이상의 스토리지 도메인에 볼륨 그룹과 LUN을 연결할 수 없습니다.

Red Hat Virtualization 시스템 관리자에게는 SAN(Storage Area Networks) 개념에 대한 실무 지식이 필요합니다. SAN은 일반적으로 호스트와 공유 외부 스토리지 간의 트래픽에 FCP(Fibre Channel Protocol)를 사용합니다. 이러한 이유로 SAN은 때때로 FCP 스토리지라고 할 수 있습니다.

Red Hat Enterprise Linux에서 FCP 또는 다중 경로 설정 및 구성에 대한 자세한 내용은 스토리지 관리 가이드 및 DM Multipath 가이드 를 참조하십시오.

블록 스토리지를 사용하고 있으며 원시 장치 또는 직접 LUN에 가상 머신을 배포하고 LVM(Logical Volume Manager)으로 관리하려는 경우 게스트 논리 볼륨을 숨길 필터를 생성해야 합니다. 그러면 호스트가 부팅될 때 게스트 논리 볼륨이 활성화되지 않으므로 오래된 논리 볼륨으로 인해 데이터가 손상될 수 있습니다. vdsm-tool config-lvm-filter 명령을 사용하여 LVM에 대한 필터를 생성합니다. LVM 필터 생성참조

Red Hat Virtualization은 현재 블록 크기가 4K인 블록 스토리지를 지원하지 않습니다. 레거시(512b 블록) 모드에서 블록 스토리지를 구성해야 합니다.

호스트가 SAN 스토리지에서 부팅되고 스토리지 연결이 끊어지면 스토리지 파일 시스템이 읽기 전용으로 되어 연결이 복원된 후 이 상태로 유지됩니다.

이러한 상황을 방지하려면 연결 시 대기 중인지 확인하려면 부팅 LUN에 대해 SAN의 루트 파일 시스템에 드롭인 다중 경로 구성 파일을 추가합니다.

# cat /etc/multipath/conf.d/host.conf

multipaths {

multipath {

wwid boot_LUN_wwid

no_path_retry queue

}

}3.4. Red Hat Gluster Storage 준비

Red Hat Gluster Storage 설정 및 구성에 대한 자세한 내용은 Red Hat Gluster Storage 설치 가이드를 참조하십시오.

Red Hat Virtualization에서 지원되는 Red Hat Gluster Storage 버전은 Red Hat Gluster Storage 버전 호환성 및 지원을 참조하십시오.

3.5. SAN 벤더에 대한 다중 경로 구성 사용자 정의

RHV 환경이 SAN과 다중 경로 연결을 사용하도록 구성된 경우 스토리지 벤더에서 지정한 요구 사항에 맞게 다중 경로 구성 설정을 사용자 지정할 수 있습니다. 이러한 사용자 지정은 /etc/multipath.conf 에 지정된 기본 설정과 설정을 모두 재정의할 수 있습니다.

다중 경로 설정을 재정의하려면 /etc/multipath.conf 를 사용자 정의하지 마십시오. VDSM이 /etc/multipath.conf 를 소유하고 있기 때문에 VDSM 또는 Red Hat Virtualization을 설치하거나 업그레이드하면 포함된 사용자 지정을 포함하여 이 파일을 덮어쓸 수 있습니다. 이 덮어쓰기로 인해 심각한 스토리지 오류가 발생할 수 있습니다.

대신 사용자 지정 또는 재정의하려는 설정이 포함된 /etc/multipath/conf.d 디렉터리에 파일을 생성합니다.

VDSM은 /etc/multipath/conf.d 에서 파일을 알파벳순으로 실행합니다. 따라서 실행 순서를 제어하려면 마지막에 오는 숫자로 파일 이름을 시작합니다. 예를 들면 /etc/multipath/conf.d/90-myfile.conf 입니다.

심각한 스토리지 오류를 방지하려면 다음 지침을 따르십시오.

-

/etc/multipath.conf를 수정하지 마십시오. 파일에 사용자 수정이 포함되어 있고 파일을 덮어쓰면 예기치 않은 스토리지 문제가 발생할 수 있습니다. -

user_friendly_names 및설정을 재정의하지 마십시오. 자세한 내용은 Multipath.conf의 권장 설정을 참조하십시오.find_multipaths -

스토리지 벤더에서 특별히 필요한 경우가 아니면

no_설정을 재정의하지 마십시오. 자세한 내용은 Multipath.conf의 권장 설정을 참조하십시오.path_retry및 poll_interval

이러한 지침을 따르지 않으면 치명적인 스토리지 오류가 발생할 수 있습니다.

사전 요구 사항

VDSM은 multipath 모듈을 사용하도록 구성되어 있습니다. 이를 확인하려면 다음을 입력합니다.

# vdsm-tool is-configured --module multipath

절차

-

/etc/multipath/conf.d디렉터리에 새 구성 파일을 생성합니다. -

/etc/multipath.conf에서 재정의하려는 개별 설정을

/etc/multipath/conf.d/<my_device>.conf의 새 구성 파일로 복사합니다. 주석 표시를 제거하고 설정 값을 편집하고 변경 사항을 저장합니다. 다음을 입력하여 새 구성 설정을 적용합니다.

# systemctl reload multipathd

참고multipathd 서비스를 재시작하지 마십시오. 이렇게 하면 VDSM 로그에 오류가 발생합니다.

검증 단계

- 다양한 오류 시나리오의 프로덕션이 아닌 클러스터에서 새 구성이 예상대로 작동하는지 테스트합니다. 예를 들어 모든 스토리지 연결을 비활성화합니다.

- 한 번에 하나의 연결을 활성화하고 스토리지 도메인에 연결할 수 있는지 확인합니다.

3.6. Multipath.conf에 권장되는 설정

다음 설정을 재정의하지 마십시오.

- user_friendly_names no

장치 이름은 모든 하이퍼바이저에서 일관성이 있어야 합니다. 예를 들면

/dev/mapper/{WWID}입니다. 이 설정의 기본값은no로 다양한 하이퍼바이저에서/dev/mapper/mpath{N}과 같은 임의의 장치 이름을 할당할 수 없으므로 시스템 동작을 예측할 수 없습니다.주의이 설정을

user_friendly_names yes로 변경하지 마십시오. 사용자 친화적인 이름을 사용하면 예기치 않은 시스템 동작이나 오류가 발생할 수 있으며 지원되지 않습니다.find_multipaths no이 설정은 RHVH가 둘 이상의 경로를 사용할 수 있는 경우에만 다중 경로를 통해 장치에 액세스를 시도하는지 제어합니다. 현재 값인

no를 사용하면 RHV에서 하나의 경로만 사용 가능한 경우에도 다중 경로를 통해 장치에 액세스할 수 있습니다.주의이 설정을 재정의하지 마십시오.

스토리지 시스템 공급업체에 필요하지 않은 경우 다음 설정을 재정의하지 마십시오.

no_path_retry 4-

이 설정은 경로를 사용할 수 없는 경우 재시도하려는 폴링 시도 수를 제어합니다. RHV 버전 4.2 이전에는 경로를 사용할 수 없는

경우QEMU에 I/O 대기열에 문제가 있기 때문에no_path_retry값이 실패했습니다.실패 값으로 인해가상 머신을 신속하게 일시 중지했습니다. RHV 버전 4.2는 이 값을4로 변경하여 multipathd가 마지막 경로가 실패했음을 감지하면 모든 경로를 4번 더 확인합니다. 기본 5초 폴링 간격을 가정하면 경로를 확인하는 데 20초가 걸립니다. 경로가 작동되지 않으면 multipathd는 커널이 대기열을 중지하고 경로가 복원될 때까지 미해결 및 향후 I/O에 모두 실패하도록 지시합니다. 경로가 복원되면 다음에 모든 경로가 실패할 때 20초 지연이 재설정됩니다. 자세한 내용은 이 설정을 변경한 커밋을 참조하십시오. polling_interval 5- 이 설정은 경로가 열려 있는지 또는 실패했는지 감지하기 위한 폴링 시도 사이의 시간(초)을 결정합니다. 벤더가 값을 늘리는 명확한 이유를 제공하지 않는 한 VDSM 생성의 기본값을 유지하여 시스템이 경로 실패에 더 빨리 응답하도록 합니다.

4장. 셀프 호스트 엔진 배포 호스트 설치

셀프 호스트 엔진은 Red Hat Virtualization Host 또는 Red Hat Enterprise Linux 호스트에서 배포할 수 있습니다.

고가용성 또는 VLAN에 본딩된 인터페이스를 사용하여 다른 유형의 트래픽(예: 스토리지 또는 관리 연결)을 분리하려는 경우 셀프 호스트 엔진 배포를 시작하기 전에 호스트에서 해당 인터페이스를 구성해야 합니다. 계획 및 사전 요구 사항 가이드의 네트워킹 권장 사항을 참조하십시오.

4.1. Red Hat Virtualization Host 설치

RHVH(Red Hat Virtualization Host)는 Red Hat Virtualization 환경에서 하이퍼바이저 역할을 할 물리적 시스템을 설정하는 간단한 방법을 제공하기 위해 설계된 Red Hat Enterprise Linux 기반의 최소 운영 체제입니다. 최소한의 운영 체제에는 시스템이 하이퍼바이저 역할을 하는 데 필요한 패키지만 포함되어 있으며, 호스트를 모니터링하고 관리 작업을 수행하는 데 필요한 Cockpit 웹 인터페이스가 있습니다. 최소 브라우저 요구 사항은 Cockpit 실행을 참조하십시오.

RHVH에서는 보안을 강화하기 위해 NIST 800-53 파티셔닝 요구 사항을 지원합니다. RHVH에서는 기본적으로 NIST 800-53 파티션 레이아웃을 사용합니다.

호스트는 최소 호스트 요구 사항을 충족해야 합니다.

호스트의 운영 체제를 설치하거나 다시 설치하는 경우 먼저 호스트에 연결된 기존 비OS 스토리지를 분리하여 이러한 디스크가 실수로 초기화되는 것을 방지하고 잠재적인 데이터가 손실되도록 하는 것이 좋습니다.

절차

- Red Hat 고객 포털에서 Red Hat Virtualization 시작하기로 이동한 후 로그인하십시오.

- Download Latest(최신 다운로드)를 클릭하여 제품 다운로드 페이지에 액세스합니다.

- 목록에서 RHV에 대한 적절한 하이퍼바이저 이미지를 선택하고 Download Now(지금 다운로드 )를 클릭합니다.

- RHVH를 설치할 시스템을 시작하고 준비된 설치 미디어에서 부팅합니다.

부팅 메뉴에서 Install RHVH 4.4 를 선택하고

Enter를 누릅니다.참고Tab키를 눌러 커널 매개 변수를 편집할 수도 있습니다. 커널 매개변수는 공백으로 구분되어야 하며Enter키를 눌러 지정된 커널 매개 변수를 사용하여 시스템을 부팅할 수 있습니다.Esc키를 눌러 커널 매개 변수의 변경 사항을 지우고 부팅 메뉴로 돌아갑니다.- 언어를 선택하고 Continue(계속 )를 클릭합니다.

- Keyboard Layout (키보드 레이아웃) 화면에서 키보드 레이아웃을 선택하고 Done(완료)을 클릭합니다.

Installation Destination (설치 대상) 화면에서 RHVH를 설치할 장치를 선택합니다. 선택적으로 암호화를 활성화합니다. Done(완료)을 클릭합니다.

중요Automatically configure partitioning (파티션 자동 구성) 옵션을 사용합니다.

- Time & Date (시간 및 날짜) 화면에서 시간대를 선택하고 Done(완료 )을 클릭합니다.

Network & Host Name(네트워크 및 호스트 이름) 화면에서 네트워크를 선택하고 구성...'을 클릭합니다. 연결 세부 정보를 구성하려면 다음을 수행합니다.

참고시스템을 부팅할 때마다 연결을 사용하려면 Connect automatically with priority(우선 순위와 함께 자동으로 연결 ) 확인란을 선택합니다. 자세한 내용은 Red Hat Enterprise Linux 8 설치 가이드의 네트워크 및 호스트 이름 옵션 구성 을 참조하십시오.

Host Name (호스트 이름) 필드에 호스트 이름을 입력하고 Done(완료)을 클릭합니다.

- 선택 사항: 보안 정책 및 Kdump 구성. 설치 요약 화면의 각 섹션에 대한 자세한 내용은 Red Hat Enterprise Linux 8의 표준 RHEL 설치를 수행하는 과정에서 GUI를 사용하여 RHEL 설치 사용자 정의를 참조하십시오.

- Begin Installation (설치 시작)을 클릭합니다.

루트 암호를 설정하고 RHVH를 설치하는 동안 선택적으로 추가 사용자를 생성합니다.

주의RHVH에서 신뢰할 수 없는 사용자를 생성하지 마십시오. 이로 인해 로컬 보안 취약점이 악용될 수 있습니다.

Reboot(재부팅 )를 클릭하여 설치를 완료합니다.

참고RHVH를 다시 시작하면

nodectl 검사에서 호스트에서 상태 점검을수행하고 명령줄에 로그인할 때 결과를 표시합니다. 메시지노드 상태: OK또는node 상태: DEGRADED은 상태를 나타냅니다.nodectl check를 실행하여 자세한 내용을 확인합니다.참고필요한 경우 커널 모듈이 자동으로 로드되지 않도록 할 수 있습니다.

4.1.1. Red Hat Virtualization Host Repository 활성화

시스템을 등록하여 업데이트를 수신합니다. Red Hat Virtualization Host에는 리포지토리가 한 개만 필요합니다. 이 섹션에서는 Content Delivery Network 또는 Red Hat Satellite 6 에 RHVH를 등록하는 방법을 설명합니다.

콘텐츠 전달 네트워크에 RHVH 등록

메시지가 표시되면 시스템을 Content Delivery Network에 등록하고 고객 포털 사용자 이름 및 암호를 입력합니다.

# subscription-manager register

Red Hat Virtualization Host에 대한 이후 업데이트를 허용하도록 Red Hat Virtualization Host 8리포지토리를 활성화합니다.# subscription-manager repos --enable=rhvh-4-for-rhel-8-x86_64-rpms

Red Hat Satellite 6에 RHVH 등록

-

https://HostFQDNorIP:9090에서 Cockpit 웹 인터페이스에 로그인합니다. - 터미널을 클릭합니다.

Red Hat Satellite 6에 RHVH를 등록합니다.

# rpm -Uvh http://satellite.example.com/pub/katello-ca-consumer-latest.noarch.rpm # subscription-manager register --org="org_id" # subscription-manager list --available # subscription-manager attach --pool=pool_id # subscription-manager repos \ --disable='*' \ --enable=rhvh-4-for-rhel-8-x86_64-rpms

virt-who를 사용하여 Red Hat Satellite에서 가상 머신 서브스크립션을 구성할 수도 있습니다. virt-who를 사용하여 호스트 기반 서브스크립션 관리를 참조하십시오.

4.2. Red Hat Enterprise Linux 호스트 설치

Red Hat Enterprise Linux 호스트는 Red Hat Enterprise Linux Server 및 Red Hat 8의 표준 기본 설치를 기반으로 합니다.

Virtualization 서브스크립션이 연결된 Red Hat Enterprise Linux

자세한 설치 지침은 표준 RHEL 설치 수행을 참조하십시오.

호스트는 최소 호스트 요구 사항을 충족해야 합니다.

호스트의 운영 체제를 설치하거나 다시 설치하는 경우 먼저 호스트에 연결된 기존 비OS 스토리지를 분리하여 이러한 디스크가 실수로 초기화되는 것을 방지하고 잠재적인 데이터가 손실되도록 하는 것이 좋습니다.

호스트의 BIOS 설정에서 가상화를 활성화해야 합니다. 호스트의 BIOS 설정을 변경하는 방법에 대한 자세한 내용은 호스트의 하드웨어 문서를 참조하십시오.

Red Hat Enterprise Linux 호스트에 타사 워치독을 설치하지 마십시오. VDSM에서 제공하는 워치독 데몬을 방해할 수 있습니다.

4.2.1. Red Hat Enterprise Linux 호스트 리포지토리 활성화

Red Hat Enterprise Linux 시스템을 호스트로 사용하려면 시스템을 Content Delivery Network에 등록하고, Red Hat Enterprise Linux Server 및 서브스크립션을 연결하며, 호스트 리포지토리를 활성화해야 합니다.

Red Hat Virtualization

절차

메시지가 표시되면 시스템을 Content Delivery Network에 등록하고 고객 포털 사용자 이름 및 암호를 입력합니다.

# subscription-manager register

Red Hat Enterprise Linux Server및Red Hat Virtualization서브스크립션 풀을 찾아 풀 ID를 기록합니다.# subscription-manager list --available

풀 ID를 사용하여 시스템에 서브스크립션을 연결합니다.

# subscription-manager attach --pool=poolid참고현재 첨부된 서브스크립션을 보려면 다음을 수행합니다.

# subscription-manager list --consumed

활성화된 리포지토리를 모두 나열하려면 다음을 수행합니다.

# dnf repolist

리포지토리를 구성합니다.

# subscription-manager repos \ --disable='*' \ --enable=rhel-8-for-x86_64-baseos-eus-rpms \ --enable=rhel-8-for-x86_64-appstream-eus-rpms \ --enable=rhv-4-mgmt-agent-for-rhel-8-x86_64-rpms \ --enable=fast-datapath-for-rhel-8-x86_64-rpms \ --enable=advanced-virt-for-rhel-8-x86_64-rpms \ --enable=openstack-16.2-cinderlib-for-rhel-8-x86_64-rpms \ --enable=rhceph-4-tools-for-rhel-8-x86_64-rpms \ --enable=rhel-8-for-x86_64-appstream-tus-rpms \ --enable=rhel-8-for-x86_64-baseos-tus-rpmsRHEL 버전을 8.6으로 설정합니다.

# subscription-manager release --set=8.6

virt모듈을 재설정합니다.# dnf module reset virt

참고Advanced Virtualization 스트림에서 이 모듈이 이미 활성화되어 있는 경우 이 단계는 필요하지 않지만 부정적인 영향을 미치지 않습니다.

다음을 입력하여 스트림의 값을 확인할 수 있습니다.

# dnf module list virt

-

다음 명령을 사용하여 Advanced Virtualization 스트림에서

virt모듈을 활성화합니다.

RHV 4.4.2:의 경우

# dnf module enable virt:8.2

RHV 4.4.3에서 4.4.5의 경우:

# dnf module enable virt:8.3

RHV 4.4.6에서 4.4.10으로의 경우:

# dnf module enable virt:av

RHV 4.4 이상의 경우:

# dnf module enable virt:rhel

참고RHEL 8.6부터 고급 가상화 패키지는 표준

virt:rhel모듈을 사용합니다. RHEL 8.4 및 8.5의 경우 하나의 고급 가상화 스트림만 사용됩니다.rhel:av.현재 설치된 모든 패키지가 최신 상태인지 확인합니다.

# dnf upgrade --nobest

시스템을 재부팅합니다.

참고필요한 경우 커널 모듈이 자동으로 로드되지 않도록 할 수 있습니다.

5장. Red Hat Virtualization Manager 설치

5.1. 수동으로 RHV-M Appliance 설치

셀프 호스트 엔진을 배포할 때 다음과 같은 일련의 이벤트가 수행됩니다.

- 설치 프로그램에서 RHV-M Appliance를 배포 호스트에 설치합니다.

- 어플라이언스에서 Manager 가상 시스템을 설치합니다.

- 어플라이언스에서 Manager 가상 시스템에 Manager를 설치합니다.

그러나 필요한 경우 배포 호스트에 수동으로 어플라이언스를 설치할 수 있습니다. 어플라이언스가 크고 네트워크 연결 문제로 인해 어플라이언스 설치에 시간이 오래 걸리거나 실패할 수 있습니다.

절차

Red Hat Enterprise Linux 호스트에서 다음을 수행합니다.

virt모듈을 재설정합니다.# dnf module reset virt

참고Advanced Virtualization 스트림에서 이 모듈이 이미 활성화되어 있는 경우 이 단계는 필요하지 않지만 부정적인 영향을 미치지 않습니다.

다음을 입력하여 스트림의 값을 확인할 수 있습니다.

# dnf module list virt

-

다음 명령을 사용하여 Advanced Virtualization 스트림에서

virt모듈을 활성화합니다.

RHV 4.4.2:의 경우

# dnf module enable virt:8.2

RHV 4.4.3에서 4.4.5의 경우:

# dnf module enable virt:8.3

RHV 4.4.6에서 4.4.10으로의 경우:

# dnf module enable virt:av

RHV 4.4 이상의 경우:

# dnf module enable virt:rhel

참고RHEL 8.6부터 고급 가상화 패키지는 표준

virt:rhel모듈을 사용합니다. RHEL 8.4 및 8.5의 경우 하나의 고급 가상화 스트림만 사용됩니다.rhel:av.설치된 패키지를 동기화하여 사용 가능한 최신 버전으로 업데이트합니다.

# dnf distro-sync --nobest

RHV-M Appliance를 호스트에 수동으로 설치합니다.

# dnf install rhvm-appliance

이제 자체 호스팅 엔진을 배포할 때 설치 프로그램에서 어플라이언스가 이미 설치되어 있음을 탐지합니다.

5.2. 방화벽 활성화 및 구성

자체 호스팅 배포 스크립트를 실행하기 전에 firewalld 를 설치하고 실행해야 합니다. 인터페이스가 구성된 활성 영역도 있어야 합니다.

사전 요구 사항

-

firewalld가 설치되어 있습니다.hosted-engine-setup에는firewalld패키지가 필요하므로 추가 단계를 수행할 필요가 없습니다.

절차

firewalld시작 :# systemctl unmask firewalld # systemctl start firewalld

시스템 시작 시 firewalld가 자동으로 시작되도록 하려면 root로 다음 명령을 입력합니다.

# systemctl enable firewalld

firewalld가 실행 중인지 확인합니다.

# systemctl status firewalld

관리 인터페이스가 방화벽 영역에 있는지 확인하십시오.

# firewall-cmd --get-active-zones

이제 셀프 호스트 엔진을 배포할 준비가 되었습니다.

5.3. 명령줄을 사용하여 셀프 호스트 엔진 배포

명령줄에서 셀프 호스트 엔진을 배포할 수 있습니다. 설정 패키지를 설치한 후 hosted-engine --deploy 명령을 실행하고 스크립트는 환경의 세부 정보를 수집하여 호스트 및 관리자를 구성하는 데 사용합니다.

배포를 일시 중지하거나 자동화를 사용하여 배포 중에 수동으로 Manager 가상 시스템을 사용자 지정할 수 있습니다.

-

변수

he_pause_host를true로 설정하면 Manager를 설치하고 배포 호스트를 Manager에 추가한 후 배포를 일시 중지합니다. 변수

he_pause_before_engine_setup을true로 설정하면 Manager를 설치하기 전에 배포가 일시 중지되고 Manager를 복원하기 전에he_restore_from_file을 사용합니다.참고he_pause_host또는he_pause_before_engine_setup변수가 true로 설정된 경우 배포 호스트에서 접미사_he_setup_lock을 사용하여/tmp에 잠금 파일이 생성됩니다. 그러면 필요에 따라 가상 시스템을 수동으로 사용자 지정할 수 있습니다. 잠금 파일을 삭제한 후에도 배포가 계속되거나 24시간이 지난 후에도 배포됩니다.배포 호스트의 다음 디렉터리에 Ansible 플레이북을 추가하면 플레이북이 자동으로 실행됩니다.

/usr/share/ansible/collections/ansible_collections/ansible_collections/redhat/rhv/roles/hosted_engine_setup/hooks/의 다음 디렉토리 중 하나에 플레이북을 추가합니다.-

enginevm_before_engine_setup -

enginevm_after_engine_setup -

after_add_host -

after_setup

-

사전 요구 사항

engine-setup을 수행하기 전에 어플라이언스 콘텐츠를 최신 제품 버전으로 업그레이드하십시오.-

이 작업을 수동으로 수행하려면

he_pause_before_engine_setup을 사용하여 배포를 일시 중지하고dnf 업데이트를수행합니다. -

이 작업을 자동으로 수행하려면

enginevm_before_engine_setup후크를 적용합니다.

-

이 작업을 수동으로 수행하려면

- 관리자 및 호스트에 준비된 FQDN. 정방향 및 역방향 조회 레코드는 모두 DNS에서 설정해야 합니다.

- FCP 또는 iSCSI 중 하나의 블록 스토리지 도메인을 사용하는 경우 단일 대상 LUN은 자체 호스팅 엔진에 대해 지원되는 유일한 설정입니다.

- 선택 사항: 자동화를 사용하여 배포하는 동안 Manager 가상 시스템을 사용자 지정하려면 Ansible 플레이북을 추가해야 합니다. 배포 중 자동화를 사용하여 엔진 가상 시스템 사용자 정의를 참조하십시오.

셀프 호스트 엔진 설정 스크립트에는 엔진 가상 시스템에서 베어 메탈 호스트의 루트 계정에 대해 2048비트 RSA 키를 사용하여 ssh 공개 키 액세스가 필요합니다.

/etc/ssh/sshd_config에서 이러한 값은 다음과 같이 설정해야 합니다.PubkeyAcceptedKeyTypes는 2048비트 RSA 키를 허용해야 합니다.기본적으로 이 설정은 시스템 전체 암호화 정책을 사용합니다. 자세한 내용은 설명서 페이지

crypto-policies(7)을 참조하십시오.참고4.4.5.5 이전 버전에서 Manager에 등록된 RHVH 호스트는 모든 키가 마이그레이션될 때까지 이전 버전과의 호환성을 위해 RSA 2048이 필요합니다.

4.4.5.5 이상에 등록된 RHVH 호스트는 Manager와 RHVH에서 둘 다 지원하는 강력한 알고리즘을 사용합니다.

PubkeyAcceptedKeyTypes설정은 사용되는 알고리즘을 결정하는 데 도움이 됩니다.-

PermitRootLogin은암호 없이또는yes로 설정됩니다. -

PubkeyAuthentication이yes로 설정됨

절차

배포 도구를 설치합니다.

# dnf install ovirt-hosted-engine-setup

네트워크 또는 터미널 중단 시 세션이 손실되지 않도록

tmux창 관리자를 사용하여 스크립트를 실행합니다.tmux설치 및 실행 :# dnf -y install tmux # tmux

배포 스크립트를 시작합니다.

# hosted-engine --deploy

또는 배포 호스트를 Manager에 추가한 후 배포를 일시 중지하려면

--ansible-extra-vars=he_pause_host=true:# hosted-engine --deploy --ansible-extra-vars=he_pause_host=true

참고언제든지 스크립트를 이스케이프하려면 Ctrl+D 키보드 조합을 사용하여 배포를 중단합니다. 세션 시간 제한 또는 연결 중단이 발생하는 경우

tmux attach를 실행하여 배포 세션을 복구합니다.메시지가 표시되면 Yes 를 입력하여 배포를 시작합니다.

Continuing will configure this host for serving as hypervisor and will create a local VM with a running engine. The locally running engine will be used to configure a new storage domain and create a VM there. At the end the disk of the local VM will be moved to the shared storage. Are you sure you want to continue? (Yes, No)[Yes]:

네트워크를 구성합니다. 표시된 게이트웨이가 올바른지 확인하고 Enter 를 누릅니다. 스크립트가 호스트의 연결을 확인할 수 있도록 동일한 서브넷에 ping 가능 주소를 입력합니다.

Please indicate a pingable gateway IP address [X.X.X.X]:

이 스크립트는 환경의 관리 브릿지로 사용할 수 있는 NIC를 탐지합니다. 해당 항목 중 하나를 입력하거나 Enter 를 눌러 기본값을 적용합니다.

Please indicate a nic to set ovirtmgmt bridge on: (ens1, ens0) [ens1]:

네트워크 연결을 확인하는 방법을 지정합니다. 기본값은

dns입니다.Please specify which way the network connectivity should be checked (ping, dns, tcp, none) [dns]:

ping- 게이트웨이를 ping합니다.

DNS- DNS 서버와의 연결을 확인합니다.

tcp- 호스트 및 포트 조합에 대한 TCP 연결을 생성합니다. 대상 IP 주소와 포트를 지정해야 합니다. 연결이 성공적으로 생성되면 네트워크가 활성인 것으로 간주됩니다. 지정된 호스트가 지정된 포트에서 들어오는 TCP 연결을 수락할 수 있는지 확인합니다.

none- 네트워크는 항상 연결된 것으로 간주됩니다.

셀프 호스트 엔진의 호스트를 배포할 데이터 센터의 이름을 입력합니다. 기본 이름은 Default 입니다.

Please enter the name of the data center where you want to deploy this hosted-engine host. Data center [Default]:

셀프 호스트 엔진의 호스트를 배포할 클러스터의 이름을 입력합니다. 기본 이름은 Default 입니다.

Please enter the name of the cluster where you want to deploy this hosted-engine host. Cluster [Default]:

- 가상 시스템 설치에 사용자 지정 어플라이언스를 사용하려면 OVA 아카이브 경로를 입력합니다. 또는 RHV-M Appliance를 사용하려면 이 필드를 비워 둡니다.

사용자 지정 RHV-M Appliance 어플라이언스 이미지로 배포하려면 OVA 아카이브의 경로를 지정합니다. 또는 RHV-M Appliance를 사용하려면 이 필드를 비워 둡니다.

If you want to deploy with a custom engine appliance image, please specify the path to the OVA archive you would like to use. Entering no value will use the image from the rhvm-appliance rpm, installing it if needed. Appliance image path []:

Manager 가상 머신의 CPU 및 메모리 구성을 입력합니다.

Please specify the number of virtual CPUs for the VM. The default is the appliance OVF value [4]: Please specify the memory size of the VM in MB. The default is the maximum available [6824]:

manager.example.com과 같은 Manager 가상 머신의 FQDN을 지정합니다.Please provide the FQDN you would like to use for the engine. Note: This will be the FQDN of the engine VM you are now going to launch, it should not point to the base host or to any other existing machine. Engine VM FQDN []:

Manager 가상 머신의 도메인을 지정합니다. 예를 들어 FQDN이

manager.example.com인 경우example.com을 입력합니다.Please provide the domain name you would like to use for the engine appliance. Engine VM domain: [example.com]

Manager의 루트 암호를 생성하고 다시 입력하여 확인합니다.

Enter root password that will be used for the engine appliance: Confirm appliance root password:

선택 사항: 암호를 입력하지 않고 Manager 가상 머신에 root 사용자로 로그인할 수 있도록 SSH 공개 키를 입력하고 root 사용자에 대해 SSH 액세스를 활성화할지 여부를 지정합니다.

You may provide an SSH public key, that will be added by the deployment script to the authorized_keys file of the root user in the engine appliance. This should allow you passwordless login to the engine machine after deployment. If you provide no key, authorized_keys will not be touched. SSH public key []: Do you want to enable ssh access for the root user (yes, no, without-password) [yes]:

선택 사항: Manager 가상 머신에서 DISA STIG 보안 프로파일을 적용할 수 있습니다. DISA STIG 프로파일이 기본 OpenSCAP 프로파일입니다.

Do you want to apply a default OpenSCAP security profile? (Yes, No) [No]:

Manager 가상 시스템의 MAC 주소를 입력하거나 무작위로 생성된 가상 시스템의 MAC 주소를 수락합니다. DHCP를 통해 Manager 가상 머신에 IP 주소를 제공하려면 이 MAC 주소에 유효한 DHCP 예약이 있는지 확인하십시오. 배포 스크립트는 DHCP 서버를 구성하지 않습니다.

You may specify a unicast MAC address for the VM or accept a randomly generated default [00:16:3e:3d:34:47]:

Manager 가상 머신의 네트워킹 세부 정보를 입력합니다.

How should the engine VM network be configured (DHCP, Static)[DHCP]?

Static 을 지정하면 Manager 가상 머신의 IP 주소를 입력합니다.

중요- 정적 IP 주소는 호스트와 동일한 서브넷에 속해야 합니다. 예를 들어 호스트가 10.1.1.0/24에 있는 경우 Manager 가상 머신의 IP는 동일한 서브넷 범위(10.1.1.1-254/24)에 있어야 합니다.

- IPv6의 경우 Red Hat Virtualization은 정적 주소 지정만 지원합니다.

Please enter the IP address to be used for the engine VM [x.x.x.x]: Please provide a comma-separated list (max 3) of IP addresses of domain name servers for the engine VM Engine VM DNS (leave it empty to skip):

Manager 가상 머신 및 기본 호스트 항목을 가상 머신의

/etc/hosts파일에 추가할지 여부를 지정합니다. 호스트 이름을 확인할 수 있는지 확인해야 합니다.Add lines for the appliance itself and for this host to /etc/hosts on the engine VM? Note: ensuring that this host could resolve the engine VM hostname is still up to you. Add lines to /etc/hosts? (Yes, No)[Yes]:

SMTP 서버의 이름 및 TCP 포트 번호, 이메일 알림을 보내는 데 사용되는 이메일 주소 및 이러한 알림을 받기 위한 쉼표로 구분된 이메일 주소 목록을 제공합니다. 또는 Enter 를 눌러 기본값을 수락합니다.

Please provide the name of the SMTP server through which we will send notifications [localhost]: Please provide the TCP port number of the SMTP server [25]: Please provide the email address from which notifications will be sent [root@localhost]: Please provide a comma-separated list of email addresses which will get notifications [root@localhost]:

admin@internal사용자의 암호를 생성하여 관리 포털에 액세스하여 다시 입력하여 확인합니다.Enter engine admin password: Confirm engine admin password:

배포 호스트의 호스트 이름을 지정합니다.

Please provide the hostname of this host on the management network [hostname.example.com]:

이 스크립트는 가상 시스템을 생성합니다. 기본적으로 스크립트는 먼저 RHV-M Appliance를 다운로드하여 설치 시간을 단축합니다.

선택 사항:

he_pause_host: true변수를 설정하면 배포 호스트를 Manager에 추가한 후 배포가 일시 중지됩니다. 이제 배포 호스트에서 Manager 가상 시스템에 로그인하여 사용자 지정할 수 있습니다. FQDN 또는 Manager의 IP 주소로 로그인할 수 있습니다. 예를 들어 관리자의 FQDN이manager.example.com인 경우 :$ ssh root@manager.example.com

작은 정보설치 로그에서 IP 주소는

local_vm_ip에 있습니다. 설치 로그는/var/log/ovirt-hosted-engine-setup/ovirt-hosted-engine-setup-ansible-bootstrap_local_vm*의 최신 인스턴스입니다.- 필요에 따라 Manager 가상 시스템을 사용자 지정합니다.

- 마쳤으면 Manager FQDN이 있는 브라우저를 사용하여 관리 포털에 로그인하고 호스트의 상태가 Up 인지 확인합니다.

- 잠금 파일을 삭제하고 배포 스크립트가 자동으로 계속되어 Manager 가상 시스템을 구성합니다.

사용할 스토리지 유형을 선택합니다.

Please specify the storage you would like to use (glusterfs, iscsi, fc, nfs)[nfs]:

NFS의 경우 버전, 스토리지의 전체 주소 및 경로 및 모든 마운트 옵션을 입력합니다.

Please specify the nfs version you would like to use (auto, v3, v4, v4_1)[auto]: Please specify the full shared storage connection path to use (example: host:/path): storage.example.com:/hosted_engine/nfs If needed, specify additional mount options for the connection to the hosted-engine storage domain []:iSCSI의 경우 포털 세부 정보를 입력하고 자동 감지 목록에서 대상과 LUN을 선택합니다. 배포 중에 하나의 iSCSI 대상만 선택할 수 있지만 다중 경로는 동일한 포털 그룹의 모든 포털을 연결하는 데 지원됩니다.

참고iSCSI 대상을 두 개 이상 지정하려면 셀프 호스트 엔진을 배포하기 전에 다중 경로를 활성화해야 합니다. 자세한 내용은 Red Hat Enterprise Linux DM Multipath 를 참조하십시오. 다른 옵션으로 다중 경로를 설치하고 구성하는 스크립트를 생성하는 다중 경로 도우미 도구도 있습니다.

Please specify the iSCSI portal IP address: Please specify the iSCSI portal port [3260]: Please specify the iSCSI discover user: Please specify the iSCSI discover password: Please specify the iSCSI portal login user: Please specify the iSCSI portal login password: The following targets have been found: [1] iqn.2017-10.com.redhat.example:he TPGT: 1, portals: 192.168.1.xxx:3260 192.168.2.xxx:3260 192.168.3.xxx:3260 Please select a target (1) [1]: 1 The following luns have been found on the requested target: [1] 360003ff44dc75adcb5046390a16b4beb 199GiB MSFT Virtual HD status: free, paths: 1 active Please select the destination LUN (1) [1]:Gluster 스토리지의 경우 스토리지의 전체 주소 및 경로와 모든 마운트 옵션을 입력합니다.

중요복제본 1 및 복제본 3 Gluster 스토리지만 지원됩니다. 다음과 같이 볼륨을 구성해야 합니다.

gluster volume set VOLUME_NAME group virt gluster volume set VOLUME_NAME performance.strict-o-direct on gluster volume set VOLUME_NAME network.remote-dio off gluster volume set VOLUME_NAME storage.owner-uid 36 gluster volume set VOLUME_NAME storage.owner-gid 36 gluster volume set VOLUME_NAME network.ping-timeout 30

Please specify the full shared storage connection path to use (example: host:/path): storage.example.com:/hosted_engine/gluster_volume If needed, specify additional mount options for the connection to the hosted-engine storage domain []:파이버 채널의 경우 자동 감지 목록에서 LUN을 선택합니다. 호스트 버스 어댑터는 구성 및 연결되어야 하며 LUN은 기존 데이터를 포함하지 않아야 합니다. 기존 LUN을 재사용하려면 관리 가이드의 LUN 재사용 을 참조하십시오.

The following luns have been found on the requested target: [1] 3514f0c5447600351 30GiB XtremIO XtremApp status: used, paths: 2 active [2] 3514f0c5447600352 30GiB XtremIO XtremApp status: used, paths: 2 active Please select the destination LUN (1, 2) [1]:

Manager 가상 머신의 디스크 크기를 입력합니다.

Please specify the size of the VM disk in GB: [50]:

배포가 완료되면 데이터 센터 1개, 클러스터, 호스트, 스토리지 도메인 및 Manager 가상 시스템이 이미 실행 중입니다. 관리 포털에 로그인하여 다른 리소스를 추가할 수 있습니다.

- 선택 사항: 환경에 사용자를 추가할 수 있도록 Red Hat Single Sign On을 설치하고 구성하십시오. 자세한 내용은 관리 가이드의 Red Hat Single Sign-On 설치 및 구성을 참조하십시오.

- 선택 사항: RHV 환경에서 보고서를 모니터링하고 표시할 수 있도록 Grafana를 배포합니다. 자세한 내용은 관리 가이드의 Grafana 구성 을 참조하십시오.

Manager 가상 시스템, 호스트 실행 중인 호스트 및 셀프 호스트 엔진 스토리지 도메인은 관리 포털에서 골드 왕관으로 플래그가 지정됩니다.

Manager의 I/O 스케줄러와 Manager의 주문 I/O 요청을 호스팅하는 하이퍼바이저 모두. 이중 재주문으로 인해 스토리지 계층에 대한 I/O 요청이 지연되어 성능에 영향을 미칠 수 있습니다.

데이터 센터에 따라 I/O 스케줄러를 none 으로 변경하여 성능을 향상시킬 수 있습니다. 자세한 내용은 RHEL 의 시스템 상태 및 성능 모니터링 및 관리에서 사용 가능한 디스크 스케줄러 를 참조하십시오.

다음 단계는 Red Hat Virtualization Manager 리포지토리를 활성화하는 것입니다.

5.4. Red Hat Virtualization Manager 리포지토리 활성화

Red Hat Subscription Manager에 Manager 머신을 로그인하여 등록하고, Red Hat Virtualization Manager 서브스크립션을 연결하며, Manager 리포지토리를 활성화해야 합니다.

절차

메시지가 표시되면 시스템을 Content Delivery Network에 등록하고 고객 포털 사용자 이름 및 암호를 입력합니다.

# subscription-manager register

참고IPv6 네트워크를 사용하는 경우 IPv6 전환 메커니즘을 사용하여 콘텐츠 전달 네트워크 및 서브스크립션 관리자에게 액세스합니다.

Red Hat Virtualization Manager서브스크립션 풀을 찾아 풀 ID를 기록합니다.# subscription-manager list --available

풀 ID를 사용하여 서브스크립션을 시스템에 연결합니다.

# subscription-manager attach --pool=pool_id참고현재 첨부된 서브스크립션을 보려면 다음을 수행합니다.

# subscription-manager list --consumed

활성화된 리포지토리를 모두 나열하려면 다음을 수행합니다.

# dnf repolist

리포지토리를 구성합니다.

# subscription-manager repos \ --disable='*' \ --enable=rhel-8-for-x86_64-baseos-eus-rpms \ --enable=rhel-8-for-x86_64-appstream-eus-rpms \ --enable=rhv-4.4-manager-for-rhel-8-x86_64-rpms \ --enable=fast-datapath-for-rhel-8-x86_64-rpms \ --enable=jb-eap-7.4-for-rhel-8-x86_64-rpms \ --enable=openstack-16.2-cinderlib-for-rhel-8-x86_64-rpms \ --enable=rhceph-4-tools-for-rhel-8-x86_64-rpms \ --enable=rhel-8-for-x86_64-appstream-tus-rpms \ --enable=rhel-8-for-x86_64-baseos-tus-rpmsRHEL 버전을 8.6으로 설정합니다.

# subscription-manager release --set=8.6

pki-deps모듈을 활성화합니다.# dnf module -y enable pki-deps

postgresql모듈 버전 12를 활성화합니다.# dnf module -y enable postgresql:12

nodejs모듈의 버전 14를 활성화합니다.# dnf module -y enable nodejs:14

- 업그레이드 가이드 의 자체 호스트 엔진 업데이트 절차를 사용하여 셀프 호스트 엔진을 업데이트합니다.

추가 리소스

모듈 및 모듈 스트림에 대한 자세한 내용은 사용자 공간 구성 요소 설치, 관리 및 제거의 다음 섹션을 참조하십시오.

호스트 및 스토리지를 환경에 추가할 수 있는 관리 포털에 로그인합니다.

5.5. 관리 포털에 연결

웹 브라우저를 사용하여 관리 포털에 액세스합니다.

웹 브라우저에서

https://manager-fqdn /ovirt-engine으로 이동하여 설치 중에 제공한 FQDN으로 manager-fqdn 을 바꿉니다.참고대체 호스트 이름 또는 IP 주소를 사용하여 관리 포털에 액세스할 수 있습니다. 이렇게 하려면 /etc/ovirt-engine/engine.conf.d/ 에 구성 파일을 추가해야 합니다. 예를 들면 다음과 같습니다.

# vi /etc/ovirt-engine/engine.conf.d/99-custom-sso-setup.conf SSO_ALTERNATE_ENGINE_FQDNS="alias1.example.com alias2.example.com"대체 호스트 이름 목록은 공백으로 구분해야 합니다. Manager의 IP 주소를 목록에 추가할 수도 있지만 DNS 확인 가능 호스트 이름 대신 IP 주소를 사용하는 것은 권장되지 않습니다.

- 관리 포털 을 클릭합니다. SSO 로그인 페이지가 표시됩니다. SSO 로그인을 사용하면 관리 및 VM 포털에 동시에 로그인할 수 있습니다.

- User Name (사용자 이름) 및 Password (암호)를 입력합니다. 처음 로그인하는 경우 사용자 이름 admin 과 설치 중에 지정한 암호를 사용합니다.

- 인증할 도메인 을 선택합니다. 내부 관리자 이름을 사용하여 로그인하는 경우 internal 도메인을 선택합니다.

- Log In (로그인)을 클릭합니다.

- 관리 포털은 여러 언어로 볼 수 있습니다. 기본 선택은 웹 브라우저의 로케일 설정에 따라 선택됩니다. 기본이 아닌 언어로 관리 포털을 보려면 시작 페이지의 드롭다운 목록에서 선호하는 언어를 선택합니다.

Red Hat Virtualization 관리 포털에서 로그아웃하려면 헤더 표시줄에서 사용자 이름을 클릭하고 Sign Out (로그아웃)을 클릭합니다. 모든 포털에서 로그아웃되고 Manager 시작 화면이 표시됩니다.

6장. Red Hat Virtualization용 호스트 설치

Red Hat Virtualization은 다음 두 가지 유형의 호스트를 지원합니다. RHVH(Red Hat Virtualization Host) 및 Red Hat Enterprise Linux 호스트. 환경에 따라 한 유형만 사용하거나 둘 다 사용할 수 있습니다. 마이그레이션 및 고가용성과 같은 기능에는 최소 두 개의 호스트가 필요합니다.

네트워킹 정보에 대한 호스트 네트워크 구성은 권장 사례를 참조하십시오.

SELinux는 설치 시 강제 모드입니다. 확인하려면 getenforce 를 실행합니다. Red Hat Virtualization 환경을 지원하려면 SELinux가 모든 호스트와 관리자에서 강제 모드에 있어야 합니다.

표 6.1. 호스트 유형

| 호스트 유형 | 기타 이름 | 설명 |

|---|---|---|

| Red Hat Virtualization Host | RHVH, 씬 호스트 | 이는 Red Hat Enterprise Linux 기반의 최소 운영 체제입니다. 고객 포털에서 ISO 파일로 배포되며, 시스템 역할을 하는 데 필요한 패키지만 포함합니다. |

| Red Hat Enterprise Linux host | RHEL 호스트, 씩 호스트 | 적절한 서브스크립션이 첨부된 Red Hat Enterprise Linux 시스템은 호스트로 사용할 수 있습니다. |

호스트 호환성

새 데이터 센터를 생성할 때 호환성 버전을 설정할 수 있습니다. 데이터 센터의 모든 호스트에 맞는 호환성 버전을 선택합니다. 설정한 후에는 버전 회귀가 허용되지 않습니다. 새로운 Red Hat Virtualization 설치의 경우 최신 호환성 버전이 기본 데이터 센터 및 기본 클러스터에 설정되어 있습니다. 이전 버전과 호환성 버전을 사용하려면 추가 데이터 센터 및 클러스터를 생성해야 합니다. 호환성 버전에 대한 자세한 내용은 Red Hat Virtualization 라이프 사이클의 Red Hat Virtualization Manager 호환성을 참조하십시오.

6.1. Red Hat Virtualization Host

6.1.1. Red Hat Virtualization Host 설치

RHVH(Red Hat Virtualization Host)는 Red Hat Virtualization 환경에서 하이퍼바이저 역할을 할 물리적 시스템을 설정하는 간단한 방법을 제공하기 위해 설계된 Red Hat Enterprise Linux 기반의 최소 운영 체제입니다. 최소한의 운영 체제에는 시스템이 하이퍼바이저 역할을 하는 데 필요한 패키지만 포함되어 있으며, 호스트를 모니터링하고 관리 작업을 수행하는 데 필요한 Cockpit 웹 인터페이스가 있습니다. 최소 브라우저 요구 사항은 Cockpit 실행을 참조하십시오.

RHVH에서는 보안을 강화하기 위해 NIST 800-53 파티셔닝 요구 사항을 지원합니다. RHVH에서는 기본적으로 NIST 800-53 파티션 레이아웃을 사용합니다.

호스트는 최소 호스트 요구 사항을 충족해야 합니다.

호스트의 운영 체제를 설치하거나 다시 설치하는 경우 먼저 호스트에 연결된 기존 비OS 스토리지를 분리하여 이러한 디스크가 실수로 초기화되는 것을 방지하고 잠재적인 데이터가 손실되도록 하는 것이 좋습니다.

절차

- Red Hat 고객 포털에서 Red Hat Virtualization 시작하기로 이동한 후 로그인하십시오.

- Download Latest(최신 다운로드)를 클릭하여 제품 다운로드 페이지에 액세스합니다.

- 목록에서 RHV에 대한 적절한 하이퍼바이저 이미지를 선택하고 Download Now(지금 다운로드 )를 클릭합니다.

- RHVH를 설치할 시스템을 시작하고 준비된 설치 미디어에서 부팅합니다.

부팅 메뉴에서 Install RHVH 4.4 를 선택하고

Enter를 누릅니다.참고Tab키를 눌러 커널 매개 변수를 편집할 수도 있습니다. 커널 매개변수는 공백으로 구분되어야 하며Enter키를 눌러 지정된 커널 매개 변수를 사용하여 시스템을 부팅할 수 있습니다.Esc키를 눌러 커널 매개 변수의 변경 사항을 지우고 부팅 메뉴로 돌아갑니다.- 언어를 선택하고 Continue(계속 )를 클릭합니다.

- Keyboard Layout (키보드 레이아웃) 화면에서 키보드 레이아웃을 선택하고 Done(완료)을 클릭합니다.

Installation Destination (설치 대상) 화면에서 RHVH를 설치할 장치를 선택합니다. 선택적으로 암호화를 활성화합니다. Done(완료)을 클릭합니다.

중요Automatically configure partitioning (파티션 자동 구성) 옵션을 사용합니다.

- Time & Date (시간 및 날짜) 화면에서 시간대를 선택하고 Done(완료 )을 클릭합니다.

Network & Host Name(네트워크 및 호스트 이름) 화면에서 네트워크를 선택하고 구성...'을 클릭합니다. 연결 세부 정보를 구성하려면 다음을 수행합니다.

참고시스템을 부팅할 때마다 연결을 사용하려면 Connect automatically with priority(우선 순위와 함께 자동으로 연결 ) 확인란을 선택합니다. 자세한 내용은 Red Hat Enterprise Linux 8 설치 가이드의 네트워크 및 호스트 이름 옵션 구성 을 참조하십시오.

Host Name (호스트 이름) 필드에 호스트 이름을 입력하고 Done(완료)을 클릭합니다.

- 선택 사항: 보안 정책 및 Kdump 구성. 설치 요약 화면의 각 섹션에 대한 자세한 내용은 Red Hat Enterprise Linux 8의 표준 RHEL 설치를 수행하는 과정에서 GUI를 사용하여 RHEL 설치 사용자 정의를 참조하십시오.

- Begin Installation (설치 시작)을 클릭합니다.

루트 암호를 설정하고 RHVH를 설치하는 동안 선택적으로 추가 사용자를 생성합니다.

주의RHVH에서 신뢰할 수 없는 사용자를 생성하지 마십시오. 이로 인해 로컬 보안 취약점이 악용될 수 있습니다.

Reboot(재부팅 )를 클릭하여 설치를 완료합니다.

참고RHVH를 다시 시작하면

nodectl 검사에서 호스트에서 상태 점검을수행하고 명령줄에 로그인할 때 결과를 표시합니다. 메시지노드 상태: OK또는node 상태: DEGRADED은 상태를 나타냅니다.nodectl check를 실행하여 자세한 내용을 확인합니다.참고필요한 경우 커널 모듈이 자동으로 로드되지 않도록 할 수 있습니다.

6.1.2. Red Hat Virtualization Host Repository 활성화

시스템을 등록하여 업데이트를 수신합니다. Red Hat Virtualization Host에는 리포지토리가 한 개만 필요합니다. 이 섹션에서는 Content Delivery Network 또는 Red Hat Satellite 6 에 RHVH를 등록하는 방법을 설명합니다.

콘텐츠 전달 네트워크에 RHVH 등록

메시지가 표시되면 시스템을 Content Delivery Network에 등록하고 고객 포털 사용자 이름 및 암호를 입력합니다.

# subscription-manager register

Red Hat Virtualization Host에 대한 이후 업데이트를 허용하도록 Red Hat Virtualization Host 8리포지토리를 활성화합니다.# subscription-manager repos --enable=rhvh-4-for-rhel-8-x86_64-rpms

Red Hat Satellite 6에 RHVH 등록

-

https://HostFQDNorIP:9090에서 Cockpit 웹 인터페이스에 로그인합니다. - 터미널을 클릭합니다.

Red Hat Satellite 6에 RHVH를 등록합니다.

# rpm -Uvh http://satellite.example.com/pub/katello-ca-consumer-latest.noarch.rpm # subscription-manager register --org="org_id" # subscription-manager list --available # subscription-manager attach --pool=pool_id # subscription-manager repos \ --disable='*' \ --enable=rhvh-4-for-rhel-8-x86_64-rpms

virt-who를 사용하여 Red Hat Satellite에서 가상 머신 서브스크립션을 구성할 수도 있습니다. virt-who를 사용하여 호스트 기반 서브스크립션 관리를 참조하십시오.

6.1.3. 고급 설치

6.1.3.1. 사용자 정의 파티셔닝

RHVH(Red Hat Virtualization Host)의 사용자 지정 파티션은 권장되지 않습니다. Installation Destination (설치 대상) 창에서 Automatically configure partitioning (파티션 자동 구성) 옵션을 사용합니다.

설치에 사용자 지정 파티셔닝이 필요한 경우 설치 중에 I will configure partitioning(파티션 옵션)을 선택하고 다음 제한 사항이 적용됩니다.

- Manual Partitioning (수동 파티션) 창에서 기본 LVM 씬 프로비저닝 옵션이 선택되었는지 확인합니다.

다음 디렉터리가 필요하며 씬 프로비저닝된 논리 볼륨에 있어야 합니다.

-

root (

/) -

/home -

/tmp -

/var -

/var/crash -

/var/log /var/log/audit중요/usr에 대해 별도의 파티션을 만들지 마십시오. 이렇게 하면 설치에 실패합니다./usr은 RHVH와 함께 버전을 변경할 수 있는 논리 볼륨에 있어야 하므로 루트(/)에 남아 있어야 합니다.각 파티션의 필수 스토리지 크기에 대한 자세한 내용은 스토리지 요구 사항을 참조하십시오.

-

root (

-

/boot디렉토리는 표준 파티션으로 정의해야 합니다. -

/var디렉터리는 별도의 볼륨이나 디스크에 있어야 합니다. - XFS 또는 Ext4 파일 시스템만 지원됩니다.

Kickstart 파일에서 수동 파티셔닝 구성

다음 예제에서는 Kickstart 파일에서 수동 파티셔닝을 구성하는 방법을 보여줍니다.

clearpart --all part /boot --fstype xfs --size=1000 --ondisk=sda part pv.01 --size=42000 --grow volgroup HostVG pv.01 --reserved-percent=20 logvol swap --vgname=HostVG --name=swap --fstype=swap --recommended logvol none --vgname=HostVG --name=HostPool --thinpool --size=40000 --grow logvol / --vgname=HostVG --name=root --thin --fstype=ext4 --poolname=HostPool --fsoptions="defaults,discard" --size=6000 --grow logvol /var --vgname=HostVG --name=var --thin --fstype=ext4 --poolname=HostPool --fsoptions="defaults,discard" --size=15000 logvol /var/crash --vgname=HostVG --name=var_crash --thin --fstype=ext4 --poolname=HostPool --fsoptions="defaults,discard" --size=10000 logvol /var/log --vgname=HostVG --name=var_log --thin --fstype=ext4 --poolname=HostPool --fsoptions="defaults,discard" --size=8000 logvol /var/log/audit --vgname=HostVG --name=var_audit --thin --fstype=ext4 --poolname=HostPool --fsoptions="defaults,discard" --size=2000 logvol /home --vgname=HostVG --name=home --thin --fstype=ext4 --poolname=HostPool --fsoptions="defaults,discard" --size=1000 logvol /tmp --vgname=HostVG --name=tmp --thin --fstype=ext4 --poolname=HostPool --fsoptions="defaults,discard" --size=1000

logvol --thinpool --grow 를 사용하는 경우 volgroup --reserved-space 또는 volgroup --reserved-percent 를 포함하여 씬 풀을 확장하기 위해 볼륨 그룹의 공간을 예약해야 합니다.

6.1.3.2. 설치 프로그램 지원 없이 호스트에 DUD 드라이버 설치

RHVH(Red Hat Virtualization Host)에서 기본 구성에서 지원하지 않는 하드웨어 RAID 장치를 사용하는 경우와 같이 RHVH(Red Hat Virtualization Host)를 설치하려면 DUD( Driver Update Disk)가 필요한 경우가 있습니다. Red Hat Enterprise Linux 호스트와는 달리 RHVH는 DUD를 완전히 지원하지 않습니다. 이후 RAID가 표시되지 않으므로 설치 후 호스트가 정상적으로 부팅되지 않습니다. 대신 긴급 모드로 부팅됩니다.

출력 예:

Warning: /dev/test/rhvh-4.4-20210202.0+1 does not exist Warning: /dev/test/swap does not exist Entering emergency mode. Exit the shell to continue.

이러한 경우 설치를 완료하기 전에 드라이버를 수동으로 추가할 수 있습니다.

사전 요구 사항

- RHVH를 설치하는 시스템입니다.

- 더디.

- DUD 및 RHVH에 USB 드라이브를 사용하는 경우 사용 가능한 USB 포트가 두 개 이상 있어야 합니다.

절차

- 호스트 시스템에서 DUD를 로드합니다.

RHVH를 설치합니다. 명령줄 을 사용하여 Red Hat Virtualization 설치에서 자체 호스팅 엔진으로 Red Hat Virtualization 호스트 설치를 참조하십시오.

중요설치가 완료되면 시스템을 재부팅하지 마십시오.

작은 정보SSH를 사용하여 DUD에 액세스하려면 다음을 수행합니다.

커널 명령줄에

inst.sshd문자열을 추가합니다.<kernel_command_line> inst.sshd- 설치 중에 네트워킹을 활성화합니다.

- Ctrl + Alt + F3을 눌러 콘솔 모드를 시작합니다. 또는 SSH를 사용하여 연결할 수 있습니다.

DUD 마운트:

# mkdir /mnt/dud # mount -r /dev/<dud_device> /mnt/dudDUD에 있는 RPM 파일을 대상 시스템의 디스크에 복사합니다.

# cp /mnt/dud/rpms/<path>/<rpm_file>.rpm /mnt/sysroot/root/

예를 들면 다음과 같습니다.

# cp /mnt/dud/rpms/x86_64/kmod-3w-9xxx-2.26.02.014-5.el8_3.elrepo.x86_64.rpm /mnt/sysroot/root/

루트 디렉토리를

/mnt/sysroot로 변경하십시오.# chroot /mnt/sysroot

현재 initrd 이미지를 백업합니다. 예를 들면 다음과 같습니다.

# cp -p /boot/initramfs-4.18.0-240.15.1.el8_3.x86_64.img /boot/initramfs-4.18.0-240.15.1.el8_3.x86_64.img.bck1 # cp -p /boot/rhvh-4.4.5.1-0.20210323.0+1/initramfs-4.18.0-240.15.1.el8_3.x86_64.img /boot/rhvh-4.4.5.1-0.20210323.0+1/initramfs-4.18.0-240.15.1.el8_3.x86_64.img.bck1

이전에 복사한 사본에서 드라이버에 대한 RPM 파일을 설치합니다.

예를 들면 다음과 같습니다.

# dnf install /root/kmod-3w-9xxx-2.26.02.014-5.el8_3.elrepo.x86_64.rpm

참고이 패키지는 설치된 환경에 재부팅한 후 시스템에 표시되지 않으므로, 필요한 경우

initramfs를 다시 빌드하려면 해당 패키지를 다시 설치해야 합니다. 그런 후에 패키지가 남아 있습니다.dnf를 사용하여 호스트를 업데이트하는 경우 드라이버 업데이트가 지속되므로 이 프로세스를 반복할 필요가 없습니다.작은 정보인터넷에 연결되어 있지 않은 경우

dnf대신rpm명령을 사용하십시오.# rpm -ivh /root/kmod-3w-9xxx-2.26.02.014-5.el8_3.elrepo.x86_64.rpm

새 이미지를 생성하여 드라이버를 강제로 추가합니다.

# dracut --force --add-drivers <module_name> --kver <kernel_version>

예를 들면 다음과 같습니다.

# dracut --force --add-drivers 3w-9xxx --kver 4.18.0-240.15.1.el8_3.x86_64

결과를 확인하십시오. 새 이미지는 더 커야 하며 드라이버를 포함해야 합니다. 예를 들어 원본 백업 이미지 파일과 새 이미지 파일의 크기를 비교합니다.

이 예에서 새 이미지 파일은 88739013 바이트로, 원래 88717417바이트보다 큽니다.

# ls -ltr /boot/initramfs-4.18.0-240.15.1.el8_3.x86_64.img* -rw-------. 1 root root 88717417 Jun 2 14:29 /boot/initramfs-4.18.0-240.15.1.el8_3.x86_64.img.bck1 -rw-------. 1 root root 88739013 Jun 2 17:47 /boot/initramfs-4.18.0-240.15.1.el8_3.x86_64.img

새 드라이버는 이미지 파일의 일부여야 합니다. 예를 들어 3w-9xxx 모듈을 포함해야 합니다.

# lsinitrd /boot/initramfs-4.18.0-240.15.1.el8_3.x86_64.img | grep 3w-9xxx drwxr-xr-x 2 root root 0 Feb 22 15:57 usr/lib/modules/4.18.0-240.15.1.el8_3.x86_64/weak-updates/3w-9xxx lrwxrwxrwx 1 root root 55 Feb 22 15:57 usr/lib/modules/4.18.0-240.15.1.el8_3.x86_64/weak-updates/3w-9xxx/3w-9xxx.ko-../../../4.18.0-240.el8.x86_64/extra/3w-9xxx/3w-9xxx.ko drwxr-xr-x 2 root root 0 Feb 22 15:57 usr/lib/modules/4.18.0-240.el8.x86_64/extra/3w-9xxx -rw-r--r-- 1 root root 80121 Nov 10 2020 usr/lib/modules/4.18.0-240.el8.x86_64/extra/3w-9xxx/3w-9xxx.ko

설치 중인 계층에 사용할 커널이 포함된

/boot의 디렉터리에 이미지를 복사합니다. 예를 들면 다음과 같습니다.# cp -p /boot/initramfs-4.18.0-240.15.1.el8_3.x86_64.img /boot/rhvh-4.4.5.1-0.20210323.0+1/initramfs-4.18.0-240.15.1.el8_3.x86_64.img

- chroot를 종료합니다.

- 쉘을 종료합니다.

- Ctrl + Alt + F3 를 사용하여 가상 터미널에 액세스한 경우 Ctrl + Alt + F_<n>_, 일반적으로 F 1 또는 F 5를 눌러 설치 관리자로 돌아갑니다.

- 설치 프로그램 화면에서 재부팅합니다.

검증

시스템이 성공적으로 재부팅되어야 합니다.

6.1.3.3. Red Hat Virtualization Host 배포 자동화

설치 질문에 대한 답변이 포함된 Kickstart 파일과 함께 네트워크를 통해 PXE 서버에서 부팅하여 물리적 미디어 장치 없이 RHVH(Red Hat Virtualization Host)를 설치할 수 있습니다.

호스트의 운영 체제를 설치하거나 다시 설치하는 경우 먼저 호스트에 연결된 기존 비OS 스토리지를 분리하여 이러한 디스크가 실수로 초기화되는 것을 방지하고 잠재적인 데이터가 손실되도록 하는 것이 좋습니다.

Kickstart 파일을 사용하여 PXE 서버에서 설치하는 일반적인 지침은 Red Hat Enterprise Linux와 거의 동일한 방식으로 설치되므로 Red Hat Enterprise Linux 설치 가이드에서 확인할 수 있습니다. Red Hat Satellite를 사용하여 RHVH를 배포하기 위한 예제가 포함된 RHVH별 지침은 다음과 같습니다.

자동화된 RHVH 배포에는 다음 3단계가 있습니다.

6.1.3.3.1. 설치 환경 준비

- Red Hat 고객 포털에서 Red Hat Virtualization 시작하기로 이동한 후 로그인하십시오.

- Download Latest(최신 다운로드)를 클릭하여 제품 다운로드 페이지에 액세스합니다.

- 목록에서 RHV에 대한 적절한 하이퍼바이저 이미지를 선택하고 Download Now(지금 다운로드 )를 클릭합니다.

- 네트워크에서 RHVH ISO 이미지를 사용할 수 있도록 합니다. Red Hat Enterprise Linux 설치 가이드에서 네트워크에 설치 소스를 참조하십시오.

RHVH ISO에서 squashfs.img 하이퍼바이저 이미지 파일을 추출합니다.

# mount -o loop /path/to/RHVH-ISO /mnt/rhvh # cp /mnt/rhvh/Packages/redhat-virtualization-host-image-update* /tmp # cd /tmp # rpm2cpio redhat-virtualization-host-image-update* | cpio -idmv참고/tmp/usr/share/redhat-virtualization-host/image/디렉터리에 있는 이 squashfs.img 파일은 redhat-virtualization-host-version_number_version.squashfs.img 라고 합니다. 물리적 시스템에 설치할 하이퍼바이저 이미지를 포함합니다. Anacondainst.stage2옵션에서 사용하는 /LiveOS/squashfs.img 파일과 혼동해서는 안 됩니다.

6.1.3.3.2. PXE 서버 및 부트 로더 구성

- PXE 서버를 구성합니다. Red Hat Enterprise Linux 설치 가이드에서 네트워크 설치 준비를 참조하십시오.

RHVH 부트 이미지를

/tftpboot디렉터리에 복사합니다.# cp mnt/rhvh/images/pxeboot/{vmlinuz,initrd.img} /var/lib/tftpboot/pxelinux/부트 로더 구성에서 RHVH 부트 이미지를 지정하는

rhvh라벨을 생성합니다.LABEL rhvh MENU LABEL Install Red Hat Virtualization Host KERNEL /var/lib/tftpboot/pxelinux/vmlinuz APPEND initrd=/var/lib/tftpboot/pxelinux/initrd.img inst.stage2=URL/to/RHVH-ISORed Hat Satellite용 RHVH 부트 로더 구성 예

Red Hat Satellite의 정보를 사용하여 호스트를 프로비저닝하는 경우

rhvh_image라는 글로벌 또는 호스트 그룹 수준 매개변수를 생성하고 ISO가 마운트되거나 추출된 디렉터리 URL로 채워야 합니다.<%# kind: PXELinux name: RHVH PXELinux %> # Created for booting new hosts # DEFAULT rhvh LABEL rhvh KERNEL <%= @kernel %> APPEND initrd=<%= @initrd %> inst.ks=<%= foreman_url("provision") %> inst.stage2=<%= @host.params["rhvh_image"] %> intel_iommu=on console=tty0 console=ttyS1,115200n8 ssh_pwauth=1 local_boot_trigger=<%= foreman_url("built") %> IPAPPEND 2RHVH ISO의 콘텐츠를 로컬에서 사용할 수 있도록 설정하고, HTTPD 서버를 사용하여 네트워크로 내보냅니다.

# cp -a /mnt/rhvh/ /var/www/html/rhvh-install # curl URL/to/RHVH-ISO/rhvh-install

6.1.3.3.3. Kickstart 파일 생성 및 실행

- Kickstart 파일을 만들고 네트워크를 통해 사용할 수 있도록 합니다. Red Hat Enterprise Linux 설치 가이드에서 Kickstart 설치 단원을 참조하십시오.

Kickstart 파일이 다음 RHV 특정 요구 사항을 충족하는지 확인합니다.

RHVH에는

%packages섹션이 필요하지 않습니다. 대신,liveimg옵션을 사용하고 RHVH ISO 이미지에서 redhat-virtualization-host-버전_number_version.squashfs.img 파일을 지정합니다.liveimg --url=example.com/tmp/usr/share/redhat-virtualization-host/image/redhat-virtualization-host-version_number_version.squashfs.img

자동 분할은 권장되지만 주의할 점은 로컬 디스크를 먼저 감지하고,

ignoredisk명령을 포함하고, 무시할 로컬 디스크를 지정합니다(예: assda). 특정 드라이브가 사용되도록 하려면ignoredisk --only-use=/dev/disk/<path>또는ignoredisk --only-use=/dev/disk/<ID>를 사용하는 것이 좋습니다.autopart --type=thinp ignoredisk --only-use=sda ignoredisk --only-use=/dev/disk/<path> ignoredisk --only-use=/dev/disk/<ID>

참고자동 분할을 수행하려면 씬 프로비저닝이 필요합니다.

/옵션이 작동하지 않습니다.home은 필수 디렉터리이므로 RHVH에서는 --no-home설치에 수동으로 파티셔닝이 필요한 경우 파티션에 적용되는 제한 사항 목록 및 Kickstart 파일의 수동 파티셔닝 예제를 보려면 사용자 지정 파티셔닝을 참조하십시오.

nodectl init명령을 호출하는%post섹션이 필요합니다.%post nodectl init %end

참고nodectl init명령이%post섹션의 맨 끝에 있지만 재부팅 코드 전에 있는지 확인합니다.RHVH를 자체 배포하는 Kickstart 예

이 Kickstart 예제에서는 RHVH를 배포하는 방법을 보여줍니다. 필요에 따라 추가 명령과 옵션을 포함할 수 있습니다.

주의이 예제에서는 모든 디스크가 비어 있고 초기화할 수 있다고 가정합니다. 데이터가 있는 디스크를 연결한 경우 제거하거나

ignoredisks속성에 추가합니다.liveimg --url=http://FQDN/tmp/usr/share/redhat-virtualization-host/image/redhat-virtualization-host-version_number_version.squashfs.img clearpart --all autopart --type=thinp rootpw --plaintext ovirt timezone --utc America/Phoenix zerombr text reboot %post --erroronfail nodectl init %end

Satellite에서 등록 및 네트워크 구성을 사용하여 RHVH를 배포하는 Kickstart 예

이 Kickstart 예제에서는 Red Hat Satellite의 정보를 사용하여 호스트 네트워크를 구성하고 호스트를 Satellite 서버에 등록합니다.

rhvh_image라는 글로벌 또는 호스트 그룹 수준 매개 변수를 만들고 디렉터리 URL로 채워야 합니다 .ntp_server1은 글로벌 또는 호스트 그룹 수준 변수이기도 합니다.주의이 예제에서는 모든 디스크가 비어 있고 초기화할 수 있다고 가정합니다. 데이터가 있는 디스크를 연결한 경우 제거하거나

ignoredisks속성에 추가합니다.<%# kind: provision name: RHVH Kickstart default oses: - RHVH %> install liveimg --url=<%= @host.params['rhvh_image'] %>squashfs.img network --bootproto static --ip=<%= @host.ip %> --netmask=<%= @host.subnet.mask %> --gateway=<%= @host.subnet.gateway %> --nameserver=<%= @host.subnet.dns_primary %> --hostname <%= @host.name %> zerombr clearpart --all autopart --type=thinp rootpw --iscrypted <%= root_pass %> # installation answers lang en_US.UTF-8 timezone <%= @host.params['time-zone'] || 'UTC' %> keyboard us firewall --service=ssh services --enabled=sshd text reboot %post --log=/root/ks.post.log --erroronfail nodectl init <%= snippet 'subscription_manager_registration' %> <%= snippet 'kickstart_networking_setup' %> /usr/sbin/ntpdate -sub <%= @host.params['ntp_server1'] || '0.fedora.pool.ntp.org' %> /usr/sbin/hwclock --systohc /usr/bin/curl <%= foreman_url('built') %> sync systemctl reboot %end

Kickstart 파일 위치를 PXE 서버의 부트 로더 구성 파일에 추가합니다.

APPEND initrd=/var/tftpboot/pxelinux/initrd.img inst.stage2=URL/to/RHVH-ISO inst.ks=URL/to/RHVH-ks.cfg

- Red Hat Enterprise Linux 설치 가이드에서 PXE를 사용하여 네트워크에서 부팅하는 지침에 따라 RHVH를 설치합니다.

6.2. Red Hat Enterprise Linux 호스트

6.2.1. Red Hat Enterprise Linux 호스트 설치

Red Hat Enterprise Linux 호스트는 Red Hat Enterprise Linux Server 및 Red Hat 8의 표준 기본 설치를 기반으로 합니다.

Virtualization 서브스크립션이 연결된 Red Hat Enterprise Linux

자세한 설치 지침은 표준 RHEL 설치 수행을 참조하십시오.

호스트는 최소 호스트 요구 사항을 충족해야 합니다.

호스트의 운영 체제를 설치하거나 다시 설치하는 경우 먼저 호스트에 연결된 기존 비OS 스토리지를 분리하여 이러한 디스크가 실수로 초기화되는 것을 방지하고 잠재적인 데이터가 손실되도록 하는 것이 좋습니다.

호스트의 BIOS 설정에서 가상화를 활성화해야 합니다. 호스트의 BIOS 설정을 변경하는 방법에 대한 자세한 내용은 호스트의 하드웨어 문서를 참조하십시오.

Red Hat Enterprise Linux 호스트에 타사 워치독을 설치하지 마십시오. VDSM에서 제공하는 워치독 데몬을 방해할 수 있습니다.

6.2.2. Red Hat Enterprise Linux 호스트 리포지토리 활성화

Red Hat Enterprise Linux 시스템을 호스트로 사용하려면 시스템을 Content Delivery Network에 등록하고, Red Hat Enterprise Linux Server 및 서브스크립션을 연결하며, 호스트 리포지토리를 활성화해야 합니다.

Red Hat Virtualization

절차

메시지가 표시되면 시스템을 Content Delivery Network에 등록하고 고객 포털 사용자 이름 및 암호를 입력합니다.

# subscription-manager register

Red Hat Enterprise Linux Server및Red Hat Virtualization서브스크립션 풀을 찾아 풀 ID를 기록합니다.# subscription-manager list --available

풀 ID를 사용하여 시스템에 서브스크립션을 연결합니다.

# subscription-manager attach --pool=poolid참고현재 첨부된 서브스크립션을 보려면 다음을 수행합니다.

# subscription-manager list --consumed

활성화된 리포지토리를 모두 나열하려면 다음을 수행합니다.

# dnf repolist

리포지토리를 구성합니다.

# subscription-manager repos \ --disable='*' \ --enable=rhel-8-for-x86_64-baseos-eus-rpms \ --enable=rhel-8-for-x86_64-appstream-eus-rpms \ --enable=rhv-4-mgmt-agent-for-rhel-8-x86_64-rpms \ --enable=fast-datapath-for-rhel-8-x86_64-rpms \ --enable=advanced-virt-for-rhel-8-x86_64-rpms \ --enable=openstack-16.2-cinderlib-for-rhel-8-x86_64-rpms \ --enable=rhceph-4-tools-for-rhel-8-x86_64-rpms \ --enable=rhel-8-for-x86_64-appstream-tus-rpms \ --enable=rhel-8-for-x86_64-baseos-tus-rpmsRHEL 버전을 8.6으로 설정합니다.

# subscription-manager release --set=8.6

현재 설치된 모든 패키지가 최신 상태인지 확인합니다.

# dnf upgrade --nobest

시스템을 재부팅합니다.

참고필요한 경우 커널 모듈이 자동으로 로드되지 않도록 할 수 있습니다.

6.2.3. Red Hat Enterprise Linux 호스트에 Cockpit 설치

Cockpit을 설치하여 호스트의 리소스를 모니터링하고 관리 작업을 수행할 수 있습니다.

절차

대시보드 패키지를 설치합니다.

# dnf install cockpit-ovirt-dashboard

cockpit.socket 서비스를 활성화하고 시작합니다.# systemctl enable cockpit.socket # systemctl start cockpit.socket

Cockpit이 방화벽에서 활성 서비스인지 확인합니다.

# firewall-cmd --list-services

cockpit이 나열되어야 합니다. 그렇지 않은 경우 root 권한을 사용하여 다음을 입력하여cockpit를 서비스로 방화벽에 추가합니다.# firewall-cmd --permanent --add-service=cockpit

재부팅 후

--permanent옵션은cockpit서비스를 활성 상태로 유지합니다.

https://HostFQDNorIP:9090 에서 Cockpit 웹 인터페이스에 로그인할 수 있습니다.

6.3. 호스트 네트워크 구성에 권장되는 사례

항상 RHV Manager를 사용하여 클러스터에 있는 호스트의 네트워크 구성을 수정합니다. 그렇지 않으면 지원되지 않는 구성을 만들 수 있습니다. 자세한 내용은 Network Manager Stateful Configuration (nmstate) 을 참조하십시오.

네트워크 환경이 복잡한 경우 Red Hat Virtualization Manager에 호스트를 추가하기 전에 수동으로 호스트 네트워크를 구성해야 할 수 있습니다.

호스트 네트워크 구성에 대한 다음 사례를 고려합니다.

-

Cockpit을 사용하여 네트워크를 구성합니다. 또는

nmtui또는nmcli를 사용할 수 있습니다. - 셀프 호스트 엔진 배포 또는 호스트를 관리자에게 추가하는 데 네트워크가 필요하지 않은 경우 관리자에게 호스트를 추가한 후 관리 포털에서 네트워크를 구성합니다. 데이터 센터 또는 클러스터에서 새 논리적 네트워크 생성을 참조하십시오.

다음 명명 규칙을 사용합니다.

-

VLAN 장치:

VLAN_NAME_TYPE_RAW_PLUS_VID_NO_PAD -

VLAN 인터페이스:

physical_device.VLAN_ID(예:eth0.23,eth1.128,enp3s0.50) -

본딩 인터페이스:

본딩번호(예:bond0,bond1) -

본딩 인터페이스의 VLAN:

본딩번호.VLAN_ID(예:bond0.50,bond1.128)

-

VLAN 장치:

- 네트워크 본딩 사용. Red Hat Virtualization에서는 네트워크 티밍이 지원되지 않으며, 호스트가 자체 호스팅 엔진을 배포하거나 관리자에 추가된 경우 오류가 발생합니다.

권장 본딩 모드를 사용합니다.

-

가상 시스템에서

ovirtmgmt네트워크를 사용하지 않는 경우 네트워크에서 지원되는 본딩 모드를 사용할 수 있습니다. -

가상 시스템에서

ovirtmgmt네트워크를 사용하는 경우 가상 시스템 게스트 또는 컨테이너가 연결하는 브리지와 함께 사용할 때 어떤 본딩 모드가 작동하는지를 참조하십시오. -

Red Hat Virtualization의 기본 본딩 모드는

(Mode 4) 동적 링크 집계입니다. 스위치가 LACP(링크 집계 제어 프로토콜)를 지원하지 않는 경우(Mode 1) Active-Backup을 사용합니다. 자세한 내용은 Bonding Modes 를 참조하십시오.

-

가상 시스템에서

물리적 NIC에서 VLAN을 다음 예와 같이 구성합니다(

nmcli를 사용하더라도 모든 툴을 사용할 수 있음):# nmcli connection add type vlan con-name vlan50 ifname eth0.50 dev eth0 id 50 # nmcli con mod vlan50 +ipv4.dns 8.8.8.8 +ipv4.addresses 123.123.0.1/24 +ipv4.gateway 123.123.0.254

다음 예와 같이 본딩에서 VLAN을 구성합니다(cli가

사용되지만모든 툴을 사용할 수 있음).# nmcli connection add type bond con-name bond0 ifname bond0 bond.options "mode=active-backup,miimon=100" ipv4.method disabled ipv6.method ignore # nmcli connection add type ethernet con-name eth0 ifname eth0 master bond0 slave-type bond # nmcli connection add type ethernet con-name eth1 ifname eth1 master bond0 slave-type bond # nmcli connection add type vlan con-name vlan50 ifname bond0.50 dev bond0 id 50 # nmcli con mod vlan50 +ipv4.dns 8.8.8.8 +ipv4.addresses 123.123.0.1/24 +ipv4.gateway 123.123.0.254

-

firewalld를 비활성화하지 마십시오. - Manager에 호스트를 추가한 후 관리 포털에서 방화벽 규칙을 사용자 지정합니다. 호스트 방화벽 규칙 구성을 참조하십시오.

6.4. Red Hat Virtualization Manager에 셀프 호스트 엔진 노드 추가

셀프 호스트 엔진 노드를 표준 호스트와 같은 방식으로 추가하여 호스트를 셀프 호스트 엔진 노드로 배포합니다. 공유 스토리지 도메인이 자동으로 감지되고 노드가 장애 조치 호스트로 사용하여 필요한 경우 Manager 가상 시스템을 호스팅할 수 있습니다. 또한 표준 호스트를 셀프 호스트 엔진 환경에 연결할 수 있지만 Manager 가상 시스템을 호스팅할 수 없습니다. Manager 가상 시스템이 고가용성인지 확인하기 위해 두 개 이상의 자체 호스팅 엔진 노드가 있습니다. REST API를 사용하여 추가 호스트를 추가할 수도 있습니다. REST API 가이드의 호스트 를 참조하십시오.

사전 요구 사항

- 모든 셀프 호스트 엔진 노드는 같은 클러스터에 있어야 합니다.

- 셀프 호스트 엔진 노드를 재사용하는 경우 기존 셀프 호스트 엔진 구성을 제거합니다. 셀프 호스트 엔진 환경에서 호스트 제거를 참조하십시오.

절차

- 관리 포털에서 Compute(컴퓨팅 → Hosts (호스트) 를 클릭합니다.

New (새로 만들기)를 클릭합니다.

추가 호스트 설정에 대한 자세한 내용은 관리 가이드 의 새 호스트 및 호스트 Windows 편집 을 참조하십시오.

- 드롭다운 목록을 사용하여 새 호스트에 대해 Data Center (데이터 센터) 및 Host Cluster(호스트 클러스터 )를 선택합니다.

- 새 호스트의 Name (이름) 및 Address (주소)를 입력합니다. 표준 SSH 포트인 22는 SSH 포트 필드에 자동으로 채워집니다.

Manager(관리자)에 사용할 인증 방법을 선택하여 호스트에 액세스합니다.

- 암호 인증을 사용하려면 root 사용자 암호를 입력합니다.

- 또는 SSH PublicKey 필드에 표시된 키를 공개 키 인증을 사용하도록 호스트의 /root/.ssh/authorized_keys 로 복사합니다.

- 선택적으로 호스트에 지원되는 전원 관리 카드가 있는 전원 관리를 구성합니다. 전원 관리 구성에 대한 자세한 내용은 관리 가이드에 설명된 호스트 전원 관리 설정을 참조하십시오.

- Hosted Engine(호스팅 엔진 ) 탭을 클릭합니다.

- 배포를 선택합니다.

- OK(확인)를 클릭합니다.

6.5. Red Hat Virtualization Manager에 표준 호스트 추가

항상 RHV Manager를 사용하여 클러스터에 있는 호스트의 네트워크 구성을 수정합니다. 그렇지 않으면 지원되지 않는 구성을 만들 수 있습니다. 자세한 내용은 Network Manager Stateful Configuration (nmstate) 을 참조하십시오.

다음 단계는 플랫폼에서 완료되므로 Red Hat Virtualization 환경에 호스트를 추가하는 데 다소 시간이 걸릴 수 있습니다(가상화 검사, 패키지 설치, 브리지 생성 등).

절차

- 관리 포털에서 Compute(컴퓨팅 → Hosts (호스트) 를 클릭합니다.

- New (새로 만들기)를 클릭합니다.

- 드롭다운 목록을 사용하여 새 호스트에 대해 Data Center (데이터 센터) 및 Host Cluster(호스트 클러스터 )를 선택합니다.

- 새 호스트의 Name (이름) 및 Address (주소)를 입력합니다. 표준 SSH 포트인 22는 SSH 포트 필드에 자동으로 채워집니다.

Manager(관리자)에 사용할 인증 방법을 선택하여 호스트에 액세스합니다.

- 암호 인증을 사용하려면 root 사용자 암호를 입력합니다.

- 또는 SSH PublicKey 필드에 표시된 키를 공개 키 인증을 사용하도록 호스트의 /root/.ssh/authorized_keys 로 복사합니다.

선택적으로 Advanced Parameters(고급 매개 변수 ) 버튼을 클릭하여 다음과 같은 고급 호스트 설정을 변경합니다.

- 자동 방화벽 구성을 비활성화합니다.

- 호스트 SSH 지문을 추가하여 보안을 강화합니다. 수동으로 추가하거나 자동으로 가져올 수 있습니다.

- 선택적으로 호스트에 지원되는 전원 관리 카드가 있는 전원 관리를 구성합니다. 전원 관리 구성에 대한 자세한 내용은 관리 가이드에 설명된 호스트 전원 관리 설정을 참조하십시오.

- OK(확인)를 클릭합니다.

새 호스트는 설치 상태가 있는 호스트 목록에 표시되며 Notification Drawer (

![]() )의 Events 섹션에서 설치 진행 상황을 볼 수 있습니다. 잠시 후 호스트 상태가

)의 Events 섹션에서 설치 진행 상황을 볼 수 있습니다. 잠시 후 호스트 상태가 Up 으로 변경됩니다.

7장. Red Hat Virtualization용 스토리지 추가

새 환경에서 스토리지를 데이터 도메인으로 추가합니다. Red Hat Virtualization 환경에는 데이터 도메인이 하나 이상 있어야 하지만 추가하는 것이 좋습니다.

이전에 준비한 스토리지를 추가합니다.

iSCSI 스토리지를 사용하는 경우 새 데이터 도메인은 셀프 호스트 엔진 스토리지 도메인과 동일한 iSCSI 대상을 사용하지 않아야 합니다.

셀프 호스트 엔진 스토리지 도메인과 동일한 데이터 센터에 추가 데이터 도메인을 생성하는 것이 좋습니다. 활성 데이터 스토리지 도메인이 하나뿐인 데이터 센터에 셀프 호스트 엔진을 배포하고 해당 스토리지 도메인이 손상된 경우 새 스토리지 도메인을 추가하거나 손상된 스토리지 도메인을 제거할 수 없습니다. 자체 호스팅 엔진을 재배포해야 합니다.

7.1. NFS 스토리지 추가

다음 절차에서는 기존 NFS 스토리지를 Red Hat Virtualization 환경에 데이터 도메인으로 연결하는 방법을 설명합니다.

ISO 또는 내보내기 도메인이 필요한 경우 다음 절차를 사용하지만 Domain Function (도메인 기능) 목록에서 ISO 또는 Export (내보내기)를 선택합니다.

절차

- 관리 포털에서 Storage → Domains (도메인)를 클릭합니다.

- New Domain (새 도메인)을 클릭합니다.

- 스토리지 도메인 의 이름을 입력합니다.

- Data Center (데이터 센터),Domain Function(도메인 기능 ),Storage Type(스토리지 유형 ),Format (형식 ) 및 Host(호스트) 목록에 대한 기본값을 수락합니다.

- 스토리지 도메인에 사용할 Export Path (내보내기 경로)를 입력합니다. 내보내기 경로는 123.123.0.10:/data 형식이어야 합니다(IPv4), [2001:0:0:0:0:0:0:5db1]:/data (IPv6) 또는 domain.example.com:/data 형식이어야 합니다.

선택적으로 고급 매개변수를 구성할 수 있습니다.

- Advanced Parameters (고급 매개 변수)를 클릭합니다.

- Warning Low Space Indicator 필드에 백분율 값을 입력합니다. 스토리지 도메인에서 사용 가능한 사용 가능한 공간이 이 백분율 미만이면 사용자에게 경고 메시지가 표시되고 기록됩니다.

- Critical Space Action Blocker( Critical Space Action Blocker) 필드에 GB 값을 입력합니다. 스토리지 도메인에서 사용 가능한 사용 가능한 공간이 이 값보다 낮으면 오류 메시지가 사용자에게 표시되고, 공간을 사용하는 새 작업이 일시적으로 차단됩니다.

- Wipe after Delete(삭제 후 삭제 후) 확인란을 선택하여 wipe after delete(삭제 후 삭제) 옵션을 활성화합니다. 이 옵션은 도메인을 만든 후에 편집할 수 있지만, 이렇게 하면 이미 존재하는 디스크의 wipe after delete 속성은 변경되지 않습니다.

- OK(확인)를 클릭합니다.

새 NFS 데이터 도메인의 상태는 디스크가 준비될 때까지 Locked(잠김) 입니다. 그러면 데이터 도메인이 데이터 센터에 자동으로 연결됩니다.

7.2. iSCSI 스토리지 추가

다음 절차에서는 기존 iSCSI 스토리지를 Red Hat Virtualization 환경에 데이터 도메인으로 연결하는 방법을 설명합니다.

절차

- Storage → Domains (스토리지 도메인)를 클릭합니다.

- New Domain (새 도메인)을 클릭합니다.

- 새 스토리지 도메인의 Name (이름)을 입력합니다.

- 드롭다운 목록에서 데이터 센터를 선택합니다.

- Domain Function (도메인 기능)로 Data 를 선택하고 Storage Type (스토리지 유형)으로 iSCSI 를 선택합니다.

활성 호스트를 호스트로 선택합니다.

중요스토리지 도메인과의 통신은 Manager가 아닌 선택한 호스트에서 수행됩니다. 따라서 스토리지 도메인을 구성하려면 모든 호스트가 스토리지 장치에 액세스할 수 있어야 합니다.

관리자는 iSCSI 대상을 LUN 또는 LUN에 iSCSI 대상에 매핑할 수 있습니다. iSCSI 스토리지 유형을 선택하면 New Domain (새 도메인) 창에 사용되지 않는 LUN이 있는 알려진 대상이 자동으로 표시됩니다. 스토리지를 추가하는 데 사용하는 대상이 나타나지 않으면 대상 검색을 사용하여 찾을 수 있습니다. 그렇지 않으면 다음 단계를 진행합니다.

Discover Targets (대상 검색)를 클릭하여 대상 검색 옵션을 활성화합니다. 대상이 발견되어 에 로그인되면 New Domain(새 도메인 ) 창에 환경에서 사용하지 않는 LUN이 포함된 대상이 자동으로 표시됩니다.

참고환경에서 외부적으로 사용되는 LUN도 표시됩니다.

Discover Targets(대상 검색) 옵션을 사용하여 여러 대상 또는 여러 경로에 LUN을 동일한 LUN에 추가할 수 있습니다.

중요REST API 메서드

discoveriscsi을 사용하여 iscsi 대상을 검색할 경우 FQDN 또는 IP 주소를 사용할 수 있지만 검색된 대상의 iscsi 세부 정보를 사용하여 REST API 메서드iscsilogin을 사용하여 로그인해야 합니다. 자세한 내용은 REST API 가이드 의 discoveriscsi 을 참조하십시오.- Address (주소) 필드에 iSCSI 호스트의 FQDN 또는 IP 주소를 입력합니다.

-

Port (포트) 필드에서 대상을 검색할 때 호스트에 연결할 포트를 입력합니다. 기본값은

3260입니다. CHAP를 사용하여 스토리지를 보호하는 경우 User Authentication (사용자 인증) 확인란을 선택합니다. CHAP 사용자 이름과 CHAP 암호를 입력합니다.

참고REST API를 사용하여 특정 호스트의 iSCSI 대상에 대한 자격 증명을 정의할 수 있습니다. 자세한 내용은 StorageServerConnectionExtensions: Add in the REST API Guide 를 참조하십시오.

- Discover(검색 )를 클릭합니다.

검색 결과에서 하나 이상의 대상을 선택하고 하나의 대상 또는 여러 대상의 경우 Login ( 로그인 )을 클릭합니다.

중요둘 이상의 경로 액세스가 필요한 경우 필요한 모든 경로를 통해 타겟을 검색하고 로그인해야 합니다. 추가 경로를 추가하도록 스토리지 도메인을 수정하는 것은 현재 지원되지 않습니다.

중요REST API

iscsilogin메서드를 사용하여 로그인하는 경우 검색된 대상의 iscsi 세부 정보를 사용해야 합니다. 그러면discoveriscsi메서드가 생성됩니다. 자세한 내용은 REST API 가이드 의 iscsilogin 을 참조하십시오.

- 원하는 대상 옆에 있는 + 버튼을 클릭합니다. 그러면 항목이 확장되고 대상에 연결된 사용되지 않는 모든 LUN이 표시됩니다.

- 스토리지 도메인을 생성하는 데 사용하는 각 LUN의 확인란을 선택합니다.

선택적으로 고급 매개변수를 구성할 수 있습니다.

- Advanced Parameters (고급 매개 변수)를 클릭합니다.

- Warning Low Space Indicator 필드에 백분율 값을 입력합니다. 스토리지 도메인에서 사용 가능한 사용 가능한 공간이 이 백분율 미만이면 사용자에게 경고 메시지가 표시되고 기록됩니다.

- Critical Space Action Blocker( Critical Space Action Blocker) 필드에 GB 값을 입력합니다. 스토리지 도메인에서 사용 가능한 사용 가능한 공간이 이 값보다 낮으면 오류 메시지가 사용자에게 표시되고, 공간을 사용하는 새 작업이 일시적으로 차단됩니다.

- Wipe after Delete(삭제 후 삭제 후) 확인란을 선택하여 wipe after delete(삭제 후 삭제) 옵션을 활성화합니다. 이 옵션은 도메인을 만든 후에 편집할 수 있지만, 이렇게 하면 이미 존재하는 디스크의 wipe after delete 속성은 변경되지 않습니다.

- Discard after Delete(삭제 후 삭제 취소) 확인란을 선택하여 삭제 후 삭제 옵션을 활성화합니다. 이 옵션은 도메인을 생성한 후 편집할 수 있습니다. 이 옵션은 블록 스토리지 도메인에서만 사용할 수 있습니다.

- OK(확인)를 클릭합니다.

동일한 대상에 여러 스토리지 연결 경로를 구성한 경우 iSCSI 다중 경로 구성 절차에 따라 iSCSI 본딩을 완료합니다.

현재 스토리지 네트워크를 iSCSI 본딩으로 마이그레이션하려면 Migrating a Logical Network to an iSCSI Bond 를 참조하십시오.

7.3. FCP 스토리지 추가

다음 절차에서는 기존 FCP 스토리지를 Red Hat Virtualization 환경에 데이터 도메인으로 연결하는 방법을 설명합니다.

절차

- Storage → Domains (스토리지 도메인)를 클릭합니다.

- New Domain (새 도메인)을 클릭합니다.

- 스토리지 도메인의 Name (이름)을 입력합니다.

드롭다운 목록에서 FCP 데이터 센터를 선택합니다.

적절한 FCP 데이터 센터가 아직 없는 경우

(없음)을 선택합니다.- 드롭다운 목록에서 Domain Function (도메인 기능) 및 Storage Type (스토리지 유형)을 선택합니다. 선택한 데이터 센터와 호환되지 않는 스토리지 도메인 유형을 사용할 수 없습니다.

Host(호스트 ) 필드에서 활성 호스트를 선택합니다. 데이터 센터의 첫 번째 데이터 도메인이 아닌 경우 데이터 센터의 SPM 호스트를 선택해야 합니다.