Red Hat Training

A Red Hat training course is available for Red Hat OpenStack Platform

director 的安装和使用

使用 Red Hat OpenStack Platform director 创建 OpenStack 云环境

OpenStack 文档 团队

rhos-docs@redhat.com摘要

第 1 章 简介

Red Hat OpenStack Platform director 是一个安装和管理完整的 OpenStack 环境的工具组,它主要基于 OpenStack 项目 - TripleO("OpenStack-On-OpenStack" 的缩写)。这个项目利用 OpenStack 组件来安装一个可以完全工作的 OpenStack 环境。它包括了新的 OpenStack 组件来部署并控制裸机系统作为 OpenStack 的节点,这为安装一个完整、简洁、稳定的 Red Hat OpenStack Platform 环境提供了一个简便的方法。

Red Hat OpenStack Platform director 使用两个主要概念:undercloud 和 overcloud。undercloud 可以安装并配置 overcloud。下面几节概述了这两个概念。

1.1. undercloud

undercloud 是包含 OpenStack 平台 director 工具组的主要管理节点,它是由单一系统组成的 OpenStack 安装,并包括了置备和管理 OpenStack 环境 (overcloud) 所需的组件。undercloud 的组件具有多个功能:

- 环境规划

- undercloud 为用户提供了创建并分配节点角色的规划功能。undercloud 包括了一组默认节点,如 Compute、Controller 和不同存储角色。另外,它还提供了使用自定义节点的功能。此外,您可以选择在每个节点角色上包括哪些 OpenStack Platform 服务,这提供了一个模式化新节点类型,或把特定组件隔离在它们自己的主机上的方法。

- 裸机系统控制

- undercloud 使用每个节点的带外管理接口(通常是智能平台管理接口,即 Intelligent Platform Management Interface,简称 IPMI)来进行电源管理控制,并使用一个基于 PXE 的服务来发现硬件属性并在每个节点上安装 OpenStack。通过这个功能,可以把裸机系统部署为 OpenStack 节点。如需获得完整的电源管理驱动程序列表,请参阅 附录 B, 电源管理驱动。

- 编配

- undercloud 提供了一组 YAML 模板作为环境的一组计划。undercloud 导入这些计划,并根据其中的指示创建所需的 OpenStack 环境。在这些计划中还包括了一些 hook,您可以使用它们在创建环境的某些特定阶段对环境进行定制。

- 命令行工具和 Web UI

- Red Hat OpenStack Platform director 通过基于终端的命令行接口或基于 web 的用户接口来使用 undercloud 功能。

- undercloud 组件

undercloud 使用 OpenStack 组件作为它的基本工具组。每个组件在 undercloud 上的单独容器内运行。这包括以下组件:

- OpenStack Identity (keystone) - 提供 director 组件的验证和授权功能。

- OpenStack Bare Metal (ironic) 和 OpenStack Compute (nova) - 管理裸机节点。

- OpenStack Networking (neutron) 和 Open vSwitch - 控制裸机节点的网络。

- OpenStack Image Server (glance) - 存储写到裸机上的镜像。

- OpenStack Orchestration (heat) 和 Puppet - 提供对节点的编配功能,并在 director 把 overcloud 镜像写入到磁盘后配置节点。

OpenStack Telemetry(ceilometer) - 监控并采集数据。这还包括:

- OpenStack Telemetry Metrics(gnocchi) - 为 metrics 提供一个时间序列数据库。

- OpenStack Telemetry Alarming(aodh) - 为监控提供一个警告组件。

- OpenStack Telemetry Event Storage(panko)- 为监控提供事件存储。

- OpenStack Workflow Service(mistral) - 为特定 director 操作(如导入和部署计划)提供一组工作流程。

- OpenStack Messaging Service(zaqar) - 为 OpenStack Workflow Service 提供一个消息服务。

OpenStack Object Storage(swift) - 为不同的 OpenStack 平台组件提供对象存储,包括:

- 为 OpenStack Image Service 提供镜像存储

- 为 OpenStack Bare Metal 提供内省数据

- 为 OpenStack Workflow Service 提供部署计划

1.2. overcloud

overcloud 是一个通过 undercloud 创建的 Red Hat OpenStack Platform环境,它包括了一组基于所要创建的 OpenStack 平台环境的不同节点角色。undercloud 包括了一组默认的 overcloud 节点角色:

- Controller

为 OpenStack 环境提供管理、网络和高可用性服务的节点。在一个理想的 OpenStack 环境中,推荐在一个高可用性集群中使用 3 个 Controller 节点。

一个默认 Controller(控制器)节点包括以下组件:

- OpenStack Dashboard (horizon)

- OpenStack Identity (keystone)

- OpenStack Compute (nova) API

- OpenStack Networking (neutron)

- OpenStack Image Service (glance)

- OpenStack Block Storage (cinder)

- OpenStack Object Storage (swift)

- OpenStack Orchestration (heat)

- OpenStack Telemetry (ceilometer)

- OpenStack Telemetry Metrics (gnocchi)

- OpenStack Telemetry Alarming (aodh)

- OpenStack Telemetry Event Storage (panko)

- OpenStack Clustering (sahara)

- OpenStack Shared File Systems(manila)

- OpenStack Bare Metal(ironic)

- MariaDB

- Open vSwitch

- 高可用性服务的 Pacemaker 和 Galera。

- Compute

为 OpenStack 环境提供计算资源的节点。随着时间的推移,可以通过添加更多节点来扩展您的环境。一个默认 Compute (计算)节点包括以下组件:

- OpenStack Compute (nova)

- KVM/QEMU

- OpenStack Telemetry (ceilometer) 代理

- Open vSwitch

- Storage

为 OpenStack 环境提供存储的节点。这包括:

- Ceph Storage 节点 - 用来组成存储集群,每个节点包括一个 Ceph Object Storage Daemon(OSD)。另外,director 会在实施 Ceph Storage 节点的 Controller 节点上安装 Ceph Monitor。

Block storage(cinder)- 作为 HA Controller 节点的外部块存储。这类节点包括以下组件:

- OpenStack Block Storage (cinder) 卷

- OpenStack Telemetry (ceilometer) 代理

- Open vSwitch.

Object Storage (swift) - 这些节点为 OpenStack Swift 提供了一个外部存储层。Controller 节点通过 Swift 代理访问这些节点。这个节点包括以下组件:

- OpenStack Object Storage (swift) 存储

- OpenStack Telemetry (ceilometer) 代理

- Open vSwitch.

1.3. 高可用性

Red Hat OpenStack Platform director 使用一个 Controller 节点集群来为 OpenStack 平台环境提供高可用性功能。director 在每个 Controller 节点上安装一组重复的组件,这种集群配置在单一 Controller 节点出现问题时,提供了一个故障转移的功能,从而在一定程度上为 OpenStack 用户提供了不间断的服务。

OpenStack Platform director 使用以下软件来管理 Controller 节点上的组件:

- Pacemaker - Pacemaker 是集群资源的管理者,它会管理并监控一个集群中所有节点上的 OpenStack 组件的可用性。

- HA Proxy(HA 代理) - 为集群提供负载平衡和代理服务。

- Galera - 在集群中复制 Red Hat OpenStack Platform 数据库。

- Memcached - 提供数据库缓存服务。

- Red Hat OpenStack Platform director 会在 Controller 节点上自动配置大批高可用性设置。但是,仍然需要手工配置节点来启用电源管理控制。相关说明参见本指南。

- 自版本 13 起,您可以使用 director 部署计算实例的高可用性 (Instance HA)。借助 Instance HA,您可以在 Compute 节点失败时从该节点自动撤离实例。

1.4. 容器化

undercloud 和 overcloud 上的各个 OpenStack Platform 服务在对应节点的单独 Linux 容器内运行。这不仅提供一种隔离服务的方法,也提供了维护和升级 OpenStack Platform 的简便途径。红帽支持多种方法来获取 overcloud 的容器镜像,包括:

- 直接从Red Hat Container Catalog(红帽容器目录)拉取

- 托管在 undercloud 上

- 托管在 Satellite 6 服务器上

本指南提供了关于如何配置注册表详情和执行基本容器操作的信息。

1.5. Ceph 存储

大型的机构通常需要使用 OpenStack 来为成千上万的客户端系统提供服务,而每个 OpenStack 客户端系统都会有自己对块存储资源的要求。在一个单一的节点上安装 glance (images)、cinder (volumes) 和/或 nova (compute) 来管理一个大型系统中的成千上万的客户系统将变得非常不现实。这个问题可以通过外部扩展 OpenStack 加以解决。

但是,在实际的环境中,仍然需要一个存储层的虚拟化解决方案来扩展 Red Hat OpenStack Platform 的存储层,使它可以支持 terabyte、petabyte 甚至 exabyte 数量级的存储要求。Red Hat Ceph Storage 提供了这样一个存储虚拟化层,它具有高可用性和高效性。虽然虚拟化可能会在牺牲系统性能的情况下实现,但是 Ceph 会把集群中的块设备镜像作为对象来处理,这意味着大型的 Ceph Block 设备镜像有比独立磁盘更好的性能。另外,Cept Block 设备还支持缓存、copy-on-write cloning 和 copy-on-read cloning 功能来提高性能。

如需了解更多与 Red Hat Ceph Storage 相关的信息,请参阅 Red Hat Ceph Storage。

对于多架构云,仅支持预安装的或外部的 Ceph。请参阅 Integrating an Overcloud with an Existing Red Hat Ceph Cluster and 附录 G, Red Hat OpenStack Platform for POWER 来了解更多详细信息。

部分 I. director 的安装和配置

第 2 章 规划您的 undercloud

2.1. 容器化 undercloud

undercloud 是控制最终 OpenStack 平台环境(称为 overcloud)的配置、安装和管理的节点。undercloud 本身以容器的形式使用 OpenStack 平台组件来创建红帽称作 OpenStack Platform director 的工具组。这意味着,undercloud 从注册表来源拉取一组镜像容器,生成容器的配置,然后以容器的形式运行各项 OpenStack Platform 服务。因此,undercloud 提供一组容器化的服务集合,作为用于创建和管理 overcloud 的工具组。

undercloud 和 overcloud 都使用容器,它们使用相同的架构来拉取、配置和运行容器。这种架构依赖 OpenStack Orchestration 服务(称为 Heat)来置备和配置节点,通过 Ansible 来配置服务和容器。建议您对 Heat 和 Ansible 有一定的了解,这将有助于对问题进行故障排除。

2.2. 准备 undercloud 网络

undercloud 需要访问两个主要网络:

- Provisioning 或 Control Plane 网络:director 使用此网络来置备节点并(在执行 Ansible 配置时)通过 SSH 访问节点。此网络也为您提供从 undercloud 到 overcloud 节点的 SSH 访问途径。undercloud 提供 DHCP 服务,用于内省和置备此网络上的其他节点;这意味着此网络上不应存在其他 DHCP 服务。director 为此网络配置接口。

- External 网络:此网络供 undercloud 用于访问 OpenStack 平台软件仓库、容器镜像源或其他服务器,如 DNS 服务器或 NTP 服务器。您也可通过网络从工作站访问 undercloud。这意味着,您必须手动配置 undercloud 上的接口来访问外部网络。

也就是说,undercloud 需要最少两张 1 Gbps 网卡。不过,建议为 Provisioning 网络流量使用 10 Gbps 接口,特别是在 overcloud 环境中置备大量节点时。

请注意:

- 确保 Provisioning / Control Plane 网络的 NIC 和用于从您的工作站访问 director 计算机的 NIC 不同。director 安装会使用 Provisioning NIC 创建一个网桥,它会忽略所有远程连接。使用 External NIC 来远程连接 director 系统。

Provisioning 网络需要一个与您的环境大小相匹配的 IP 范围。使用以下原则来决定包括在这个范围内的 IP 地址数量:

- 最少为内省期间每个连接到 Provisioning 网络的节点包括一个临时 IP。

- 最少为部署期间每个连接到 Provisioning 网络的节点包括一个永久 IP 地址。

- 包括一个额外的 IP 地址,用于 Provisioning 网络上 overcloud 高可用性集群的虚拟 IP。

- 包括一个此范围内的额外 IP 地址,以用于扩展环境。

2.3. 确定环境规模

在安装 undercloud 之前,有必要先确定环境的规模。要规划的因素包括:

- 您的 overcloud 中有多少个节点?undercloud 管理 overcloud 中的每个节点。置备 overcloud 节点会消耗 undercloud 上的资源。这意味着,您必须为 undercloud 提供适当的资源,它们要足以部署和控制 overcloud 节点。

- 您希望 undercloud 同步执行多少个操作?undercloud 上的大部分 OpenStack 服务会使用一组 worker。每个 worker 执行特定于该服务的一个操作。多个 worker 提供同步操作。undercloud 上的默认 worker 数量等于 undercloud 上 CPU 线程总数的一半。[1]例如,如果 undercloud 具有一个 16 线程的 CPU,那么默认情况下,director 服务将生成 8 个 worker。请注意,director 在默认情况下也会使用一组上限和下限值。

| 服务 | 最小值 | 最大值 |

|---|---|---|

|

OpenStack Orchestration (heat) |

4 |

24 |

|

所有其他服务 |

2 |

12 |

undercloud 的 CPU和内存最低要求:

- 支持 Intel 64 或 AMD64 CPU 扩展的 8 线程 64 位 x86 处理器。这可为每个 undercloud 服务提供 4 个 worker。

- 最少 24 GB RAM。

如果希望使用更大数量的 worker,您的 undercloud 将需要更多的 vCPU 和内存。请遵循以下建议:

- 最小值:每个线程使用 1.5 GB 内存。例如,一台有 48 个线程的计算机应当具有 72 GB RAM。这可以为 24 个 Heat worker 和 12 个用于其他服务的 worker 提供最小的覆盖范围。

- 建议值:每个线程使用 3 GB 内存。例如,一台有 48 个线程的计算机应当具有 144 GB RAM。这可以为 24 个 Heat worker 和 12 个用于其他服务的 worker 提供建议的覆盖范围。

2.4. undercloud 磁盘大小调整

对于 undercloud,建议的下限为根磁盘上提供有 100 GB 的可用磁盘空间。这包括:

- 20 GB 用于容器镜像

- 10 GB 在节点部署过程中用于 QCOW2 镜像转换和缓存

- 70 GB 或更大空间供常规使用、保存日志和指标以及满足增长需要

2.5. undercloud 软件仓库

安装和配置 undercloud 需要下列软件仓库。

表 2.1. 核心软件仓库

| 名称 | 软件仓库 | 描述 |

|---|---|---|

|

Red Hat Enterprise Linux 7 Server (RPMs) |

|

x86_64 系统的基本操作系统仓库。 |

|

Red Hat Enterprise Linux 7 Server - Extras (RPMs) |

|

包括 Red Hat OpenStack Platform 的依赖软件包。 |

|

Red Hat Enterprise Linux 7 Server - RH Common (RPMs) |

|

包括部署和配置 Red Hat OpenStack Platform 的工具程序。 |

|

Red Hat Satellite Tools for RHEL 7 Server RPMs x86_64 |

|

管理使用 Red Hat Satellite 6 的主机的工具。 |

|

Red Hat Enterprise Linux High Availability (for RHEL 7 Server) (RPMs) |

|

Red Hat Enterprise Linux 的高可用性工具。用于 Controller 节点的高可用性功能。 |

|

Red Hat OpenStack Platform 14 for RHEL 7 (RPMs) |

|

Red Hat OpenStack Platform 核心软件仓库,包含 Red Hat OpenStack Platform director 的软件包。 |

表 2.2. Ceph 软件仓库

| 名称 | 软件仓库 | 描述 |

|---|---|---|

|

Red Hat Ceph Storage Tools 3 for Red Hat Enterprise Linux 7 Server (RPMs) |

|

为节点提供与 Ceph Storage 集群通信的工具。如果计划在 overcloud 中使用 Ceph Storage,undercloud 需要此软件仓库中的 |

IBM POWER 软件仓库

这些软件仓库供 POWER PC 架构上的 Openstack Platform 使用。使用这些软件仓库来替代核心软件仓库中的同等库。

| 名称 | 软件仓库 | 描述 |

|---|---|---|

|

Red Hat Enterprise Linux for IBM Power, little endian |

|

ppc64le 系统的基本操作系统软件仓库。 |

|

Red Hat OpenStack Platform 14 for RHEL 7 (RPMs) |

|

用于 ppc64le 系统的 Red Hat OpenStack Platform 核心软件仓库。 |

第 3 章 director 安装准备

3.1. 准备 undercloud

安装 director 需要准备好以下几项:

- 一个用来执行命令的非 root 用户。

- 用于组织镜像和模板的目录。

- 一个可解析的主机名

- 一个红帽订阅

- 用于准备镜像和安装 director 的命令行工具

步骤

-

以

root用户身份登录 undercloud。 创建

stack用户:[root@director ~]# useradd stack

为该用户设置密码:

[root@director ~]# passwd stack

进行以下操作,以使用户在使用

sudo时无需输入密码:[root@director ~]# echo "stack ALL=(root) NOPASSWD:ALL" | tee -a /etc/sudoers.d/stack [root@director ~]# chmod 0440 /etc/sudoers.d/stack

切换到新的

stack用户:[root@director ~]# su - stack [stack@director ~]$

director 使用系统镜像和 Heat 模板来创建 overcloud 环境。要让这些文件保持井然有序,建议您创建一些目录来存放镜像和模板:

[stack@director ~]$ mkdir ~/images [stack@director ~]$ mkdir ~/templates

检查 undercloud 的基础和完整主机名:

[stack@director ~]$ hostname [stack@director ~]$ hostname -f

如果上面的任何一个命令报错或没有输出正确的主机名,则请使用

hostnamectl设置主机名:[stack@director ~]$ sudo hostnamectl set-hostname manager.example.com [stack@director ~]$ sudo hostnamectl set-hostname --transient manager.example.com

另外,director 还需要在

/etc/hosts中包括一个带有系统主机名和基础名称的条目。/etc/hosts中的 IP 地址必须与您计划用于 undercloud 公共 API 的地址匹配。例如,如果系统名是manager.example.com,其使用的 IP 地址是10.0.0.1,/etc/hosts则需要包括一个与以下内容类似的条目:10.0.0.1 manager.example.com manager

在红帽 Content Delivery Network 或 Red Hat Satellite 注册您的系统。例如,在出现提示时,使用您的客户门户网站用户名和密码来注册 Content Delivery Network:

[stack@director ~]$ sudo subscription-manager register

查找 Red Hat OpenStack Platform director 的权利池 ID。例如:

[stack@director ~]$ sudo subscription-manager list --available --all --matches="Red Hat OpenStack" Subscription Name: Name of SKU Provides: Red Hat Single Sign-On Red Hat Enterprise Linux Workstation Red Hat CloudForms Red Hat OpenStack Red Hat Software Collections (for RHEL Workstation) Red Hat Virtualization SKU: SKU-Number Contract: Contract-Number Pool ID: Valid-Pool-Number-123456 Provides Management: Yes Available: 1 Suggested: 1 Service Level: Support-level Service Type: Service-Type Subscription Type: Sub-type Ends: End-date System Type: Physical查找

Pool ID的值并附加 Red Hat OpenStack Platform 14 的权利:[stack@director ~]$ sudo subscription-manager attach --pool=Valid-Pool-Number-123456

禁用所有默认的仓库,然后启用 Red Hat Enterprise Linux 仓库:

[stack@director ~]$ sudo subscription-manager repos --disable=* [stack@director ~]$ sudo subscription-manager repos --enable=rhel-7-server-rpms --enable=rhel-7-server-extras-rpms --enable=rhel-7-server-rh-common-rpms --enable=rhel-ha-for-rhel-7-server-rpms --enable=rhel-7-server-openstack-14-rpms

这些仓库包括了安装 director 所需的软件包。

对系统上的软件进行一个更新来确保使用了最新的基本系统软件包:

[stack@director ~]$ sudo yum update -y [stack@director ~]$ sudo reboot

安装用于安装和配置 director 的命令行工具:

[stack@director ~]$ sudo yum install -y python-tripleoclient

如果要创建包含 Ceph Storage 节点的 overcloud,需要额外安装

ceph-ansible软件包:[stack@director ~]$ sudo yum install -y ceph-ansible

3.2. 准备容器镜像

undercloud 配置需要一些初始注册表配置来确定从何处获取镜像以及如何存储它们。以下过程演示了如何生成并定制准备容器镜像所需的环境文件。

步骤

- 以 stack 用户身份登录 undercloud。

生成默认的容器镜像准备文件:

$ openstack tripleo container image prepare default \ --local-push-destination \ --output-env-file containers-prepare-parameter.yaml

这个命令使用以下额外选项:

-

--local-push-destination,设置 undercloud 上的注册表作为存储容器镜像的位置。这意味着,director 将从红帽 Container Catalog 拉取所需的镜像,并将它们推送到 undercloud 上的注册表。在安装 undercloud 时,director 会使用这个注册表作为镜像来源。如果直接从红帽 Container Catalog 目录拉取镜像,请忽略这个选项。 --output-env-file是环境文件名称。此文件的内容包括用于为 undercloud 准备容器镜像的参数。在本例中,文件的名称是containers-prepare-parameter.yaml。注意也可以使用

containers-prepare-parameter.yaml文件来定义部署 overcloud 时的容器镜像来源。

-

-

编辑

containers-prepare-parameter.yaml,然后根据自己的需要进行修改。

3.3. 容器镜像准备参数

这个用于准备容器的默认文件 (containers-prepare-parameter.yaml) 中含有 ContainerImagePrepare Heat 参数。此参数定义一个用于准备一系列镜像的策略列表:

parameter_defaults: ContainerImagePrepare: - (strategy one) - (strategy two) - (strategy three) ...

每一策略接受一组子参数,它们定义要使用哪些镜像以及如何对待它们。下表中列出了用于各项 ContainerImagePrepare 策略的子参数:

| 参数 | 描述 |

|---|---|

|

|

要附加到目标镜像标签的字符串。 |

|

|

用于排除过滤器的镜像名称子字符串列表 |

|

|

镜像名称字符串列表。必须至少匹配其中一项。如果指定了 includes,则所有 excludes 会被忽略。 |

|

|

ansible 角色名称字符串,在上传过程中、推送到目的地之前运行。 |

|

|

要传递到 |

|

|

用于过滤要修改的镜像的镜像标签字典。如果镜像与定义的标签匹配,则 director 将该镜像包括在修改过程中。 |

|

|

用于在上传过程中推送镜像的注册表的命名空间。如果您指定这个参数的命名空间,则所有镜像参数也会使用此命名空间。如果设为 |

|

|

要从中拉取原始镜像容器的源注册表。 |

|

|

用于定义从何处获取初始镜像的 |

|

|

定义要标记生成的镜像的标签模式。通常设为 |

set 参数接受一组 key: value 定义。下表列出了这些键:

| 键 | 描述 |

|---|---|

|

|

Ceph Storage 容器镜像的名称。 |

|

|

Ceph Storage 容器镜像的命名空间。 |

|

|

Ceph Storage 容器镜像的标签。 |

|

|

各个 OpenStack 服务镜像的前缀。 |

|

|

各个 OpenStack 服务镜像的后缀。 |

|

|

各个 OpenStack 服务镜像的命名空间。 |

|

|

用于确定要使用的 OpenStack Networking (neutron) 容器的驱动程序。null 值代表使用标准的 |

|

|

用于标识要拉取的镜像的标签。 |

set 部分中可以包含多个以 openshift_ 开头的参数,它们用于各种涉及 OpenShift-on-OpenStack 的场景。

3.4. 分层镜像准备条目

ContainerImagePrepare 的值是一个 YAML 列表。这意味着您可以指定多个条目。下例中包括了两个条目;在这个示例中,director 使用所有镜像的最新版本,但 nova-api 镜像除外,它使用标记为 14.0-44 的版本:

ContainerImagePrepare:

- tag_from_label: "{version}-{release}"

push_destination: true

excludes:

- nova-api

set:

namespace: registry.access.redhat.com/rhosp14

name_prefix: openstack-

name_suffix: ''

tag: latest

- push_destination: true

includes:

- nova-api

set:

namespace: registry.access.redhat.com/rhosp14

tag: 14.0-44

includes 和 excludes 条目控制如何过滤各个条目的镜像。匹配 includes 策略的镜像的优先级高于 excludes 匹配项。镜像名称中必须包含相应的值,才能被视为匹配项。

3.5. 准备期间修改镜像

执行 prepare 期间,可以修改镜像来进行必要的更改,然后立即使用这些更改进行部署。修改镜像的用例包括:

- 作为连续集成管道的一个部分,在部署之前使用要测试的更改修改镜像。

- 作为开发工作流的一个部分,需要部署本地更改以进行测试和开发。

- 当更改需要部署但不能通过镜像构建管道(专用附加项、应急修补程序)提供时。

通过对各个需要修改的镜像调用 Ansible 角色来完成修改。角色会提取源镜像,进行请求的更改,然后标记结果。然后,prepare 命令会推送镜像,并设置指示已修改镜像的 heat 参数。

Ansible 角色 tripleo-modify-image 遵守必要的角色接口,为 modify 用例提供所需的行为。通过 ContainerImagePrepare 参数中的 modify 相关键来控制修改:

-

modify_role指定为各个要修改的镜像调用哪一个 ansible 角色。 -

modify_append_tag用于附加到源镜像标签的末尾。这可以标明生成的镜像已被修改过。在 push_destination 注册表已包含指定镜像时,也可用它来跳过修改。因此,任何时候必须修改镜像时,都建议您更改 modify_append_tag。 -

modify_vars是要传递给角色的 ansible 变量的字典。

由 tripleo-modify-image 角色处理的不同用例通过将 tasks_from 变量设置为角色中所需的文件来选定。

在开发和测试用于修改镜像的 ContainerImagePrepare 条目时,建议您单独运行 prepare 以确认它的修改是否与预期相符:

sudo openstack tripleo container image prepare \ -e ~/containers-prepare-parameter.yaml

3.6. 更新容器镜像的现有软件包

以下条目将生成要在镜像中更新的所有软件包,但使用 undercloud 主机的 yum 软件仓库配置:

ContainerImagePrepare:

- push_destination: true

...

modify_role: tripleo-modify-image

modify_append_tag: "-updated"

modify_vars:

tasks_from: yum_update.yml

compare_host_packages: true

yum_repos_dir_path: /etc/yum.repos.d

...3.7. 将额外的 RPM 文件安装到容器镜像中

可以安装一系列的 RPM 文件,这些文件可用于安装热修复补丁、本地软件包构建,或无法通过软件包仓库提供的软件包。例如,以下代码仅在 centos-binary-nova-compute 镜像中安装一些热修复补丁软件包:

ContainerImagePrepare:

- push_destination: true

...

includes:

- nova-compute

modify_role: tripleo-modify-image

modify_append_tag: "-hotfix"

modify_vars:

tasks_from: rpm_install.yml

rpms_path: /home/stack/nova-hotfix-pkgs

...3.8. 通过自定义 Dockerfile 修改容器镜像

为获得最大的灵活性,可以指定一个含有 Dockerfile 的目录来进行所需的修改。当角色被调用时,会生成 Dockerfile.modified,它将更改 FROM 指令并添加额外的 LABEL 指令。以下示例对 centos-binary-nova-compute 镜像运行自定义 Dockerfile:

ContainerImagePrepare:

- push_destination: true

...

includes:

- nova-compute

modify_role: tripleo-modify-image

modify_append_tag: "-hotfix"

modify_vars:

tasks_from: modify_image.yml

modify_dir_path: /home/stack/nova-custom

...后面提供了示例 /home/stack/nova-custom/Dockerfile。请注意,运行了任何 USER root 指令后,需要重新切换到原先镜像默认用户:

FROM docker.io/tripleomaster/centos-binary-nova-compute:latest USER root COPY customize.sh /tmp/ RUN /tmp/customize.sh USER "nova"

3.9. 为容器镜像准备 Satellite 服务器

Red Hat Satellite 6 提供了注册表同步功能。通过该功能可将多个镜像提取到 Satellite 服务器中,作为应用程序生命周期的一部分加以管理。Satellite 也可以作为注册表供其他启用容器功能的系统使用。如需了解更多有关管理容器镜像的详细信息,请参阅 Red Hat Satellite 6 Content Management Guide 中的 "Managing Container Images"。

以下操作过程示例中使用了 Red Hat Satellite 6 的 hammer 命令行工具和一个名为 ACME 的示例组织。请将该组织替换为您自己 Satellite 6 中的组织。

步骤

创建可供默认 overcloud 和 undercloud 使用的所有容器镜像的列表:

$ openstack overcloud container image prepare \ -r /usr/share/openstack-tripleo-heat-templates/roles_data.yaml \ --output-images-file /home/stack/satellite_images_overcloud $ openstack overcloud container image prepare \ -r /usr/share/openstack-tripleo-heat-templates/roles_data_undercloud.yaml \ --output-images-file /home/stack/satellite_images_undercloud

- 这将创建两个包含您的容器镜像信息的文件。您将使用这些文件将容器镜像同步到 Satellite 6 服务器。

从文件中删除与 YAML 相关的信息,然后将它们合并到一个仅含唯一镜像列表的平面文件。下列命令可实现这一目的:

$ awk -F ':' '{if (NR!=1) {gsub("[[:space:]]", ""); print $2}}' ~/satellite_images_overcloud | sed "s/registry.access.redhat.com\///g" > ~/satellite_images_overcloud_names $ awk -F ':' '{if (NR!=1) {gsub("[[:space:]]", ""); print $2}}' ~/satellite_images_undercloud | sed "s/registry.access.redhat.com\///g" > ~/satellite_images_undercloud_names $ cat ~/satellite_images_overcloud_names ~/satellite_images_undercloud_names | sort | uniq > ~/satellite_images_names这样就得到了要提取到 Satellite 服务器中的镜像列表。

-

将

satellite_images_names文件复制到包含 Satellite 6hammer工具的系统中。或者按照 Hammer CLI Guide 中的说明将hammer工具安装到 undercloud。 运行以下

hammer命令,为您的 Satellite 组织创建新产品 (OSP14 Containers):$ hammer product create \ --organization "ACME" \ --name "OSP14 Containers"

该定制产品将会包含我们的镜像。

为产品添加基本容器镜像:

$ hammer repository create \ --organization "ACME" \ --product "OSP14 Containers" \ --content-type docker \ --url https://registry.access.redhat.com \ --docker-upstream-name rhosp14/openstack-base \ --name base

添加

satellite_images文件中的 overcloud 容器镜像。$ while read IMAGE; do \ IMAGENAME=$(echo $IMAGE | cut -d"/" -f2 | sed "s/openstack-//g" | sed "s/:.*//g") ; \ hammer repository create \ --organization "ACME" \ --product "OSP14 Containers" \ --content-type docker \ --url https://registry.access.redhat.com \ --docker-upstream-name $IMAGE \ --name $IMAGENAME ; done < satellite_images_names

同步容器镜像:

$ hammer product synchronize \ --organization "ACME" \ --name "OSP14 Containers"

等待 Satellite 服务器完成同步。

注意根据具体配置情况,

hammer可能会询问您的 Satellite 服务器用户名和密码。您可以使用配置文件将hammer配置为自动登录。请参阅 Hammer CLI Guide 中的“Authentication”部分。-

如果您的 Satellite 6 服务器使用内容视图,请创建一个用于纳入镜像的新内容视图版本,并在应用生命周期的不同环境之间推进这个视图。这很大程度上取决于您的应用生命周期构造方式。例如,如果在生命周期中使用称为

production的环境,并且您希望容器镜像可在这个环境中使用,那么请创建一个包含这些容器镜像的内容视图,并将该内容视图推进到production环境。如需更多信息,请参阅 "Managing Container Images with Content Views"。 检查

base镜像中的标签:$ hammer docker tag list --repository "base" \ --organization "ACME" \ --environment "production" \ --content-view "myosp14" \ --product "OSP14 Containers"

这会在特定环境的内容视图中显示 OpenStack 平台容器镜像的标签。

返回到 undercloud,并生成默认的环境文件(将您的 Satellite 服务器用作源来准备镜像)。以下是用于生成环境文件的命令示例:

(undercloud) $ openstack tripleo container image prepare default \ --output-env-file containers-prepare-parameter.yaml

-

--output-env-file是环境文件名称。此文件的内容包括用于为 undercloud 准备容器镜像的参数。在本例中,文件的名称是containers-prepare-parameter.yaml。

-

编辑

containers-prepare-parameter.yaml文件,然后修改以下内容:-

namespace- Satellite 服务器上注册表的 URL 和端口。Red Hat Satellite 上的默认注册表端口是 5000。 name_prefix- 该前缀基于 Satellite 6 规范。它的值根据您是否使用了内容视图而不同:-

如果您使用了内容视图,则前缀的结构为

[组织]-[环境]-[内容视图]-[产品]-。例如:acme-production-myosp14-osp14_containers-。 -

如果不使用内容视图,则前缀的结构为

[组织]-[产品]-。例如:acme-osp14_containers-。

-

如果您使用了内容视图,则前缀的结构为

-

ceph_namespace、ceph_image、ceph_tag- 如果正在使用 Ceph Storage,请额外纳入这些参数以定义 Ceph Storage 容器镜像的位置。请注意,ceph_image现包含特定于 Satellite 的前缀。这个前缀与name_prefix选项的值相同。

-

以下是含有特定于 Satellite 的参数的示例环境文件:

parameter_defaults:

ContainerImagePrepare:

- push_destination: true

set:

ceph_image: acme-production-myosp14-osp14_containers-rhceph-3-rhel7

ceph_namespace: satellite.example.com:5000

ceph_tag: latest

name_prefix: acme-production-myosp14-osp14_containers-

name_suffix: ''

namespace: satellite.example.com:5000

neutron_driver: null

tag: latest

...

tag_from_label: '{version}-{release}'在创建 undercloud 和 overcloud 时使用此环境文件。

第 4 章 安装 director

4.1. 配置 director

在安装 director 时,需要使用特定的设置来决定您的网络配置。这些设置存储在 stack 用户的主目录内的一个模板中,即 undercloud.conf。以下操作过程展示了如何基于这个默认模板来进行配置。

步骤

红帽会提供一个基本的模板来帮助您设置安装所需的配置。把这个模板复制到

stack用户的家目录中:[stack@director ~]$ cp \ /usr/share/python-tripleoclient/undercloud.conf.sample \ ~/undercloud.conf

-

编辑

undercloud.conf文件。这个文件包含用于配置 undercloud 的设置。如果忽略或注释掉某个参数,undercloud 安装将使用默认值。

4.2. Director 配置参数

下方列出了可用于配置 undercloud.conf 文件的各种参数。

默认值

以下参数会在 undercloud.conf 文件的 [DEFAULT] 部分中进行定义:

- additional_architectures

overcloud 将支持的额外 (kernel) 架构的列表。目前,这仅限于

ppc64le注意如果启用了 ppc64le,您也必须将

ipxe_enabled设为False- certificate_generation_ca

-

为所请求证书签名的 CA 的

certmonger别名。只有设置了generate_service_certificate参数时才应使用此参数。如果选择localCA,certmonger 会把本地 CA 证书提取至/etc/pki/ca-trust/source/anchors/cm-local-ca.pem,并将它添加到信任链中。 - clean_nodes

- 确定是否在部署之间和内省之后擦除硬盘。

- cleanup

-

清理临时文件。如果将这设为

False,则部署期间使用的临时文件将在命令运行后保留在原位。这可用于调试生成的文件或者确定是否发生了错误。 - container_images_file

含有容器镜像信息的 Heat 环境文件。这可以是:

- 所有需要的容器镜像的参数

-

或

ContainerImagePrepare参数(用于推动必要的容器准备)。通常,含有此参数的文件被命名为containers-prepare-parameter.yaml。

- custom_env_files

- 要添加到 undercloud 安装中的其他环境文件。

- deployment_user

-

安装 undercloud 的用户。如果此参数保留为不设置,则使用当前的默认用户 (

stack)。 - discovery_default_driver

-

为自动注册的节点设置默认驱动器。需要启用

enable_node_discovery,且必须在enabled_drivers列表中包含驱动器。 - docker_insecure_registries

-

供

docker使用的不安全注册表的列表。如果从私有容器注册表等其他来源拉取镜像,通常需要此参数。在大多数情形中,如果已注册 undercloud,docker 将具有相关的证书,可从红帽 Container Catalog 或您的 Satellite 服务器拉取容器镜像。 - docker_registry_mirror

-

在

/etc/docker/daemon.json中配置的可选registry-mirror - enable_ironic、enable_ironic_inspector、enable_mistral、enable_tempest、enable_validations、enable_zaqar

-

定义要为 director 启用的核心服务。保留设为

true。 - enable_ui

-

定义是否安装 director 的 Web UI。安装后您可以通过图形 Web 界面来执行 overcloud 规划和部署。请注意,只有通过

undercloud_service_certificate或generate_service_certificate启用了 SSL/TLS,才能使用此 UI。 - enable_node_discovery

-

自动注册通过 PXE 引导内省虚拟内存盘(ramdisk)的所有未知节点。 新节点使用

fake_pxe作为默认驱动器,但您可以设置discovery_default_driver进行覆盖。您也可以使用内省规则为新注册的节点指定驱动器信息。 - enable_novajoin

-

定义是否在 undercloud 中安装

novajoin元数据服务。 - enable_routed_networks

- 启用对路由控制平面网络的支持。

- enable_swift_encryption

- 是否启用静态 Swift 加密。

- enable_telemetry

-

定义是否在 undercloud 中安装 OpenStack Telemetry 服务(ceilometer、aodh、panko、gnocchi)。在Red Hat OpenStack Platform 中,遥测的指标后端由 gnocchi 提供。如果将

enable_telemetry参数设置为true,则会自动安装和设置遥测服务。默认值为false,即在 undercloud 中禁用遥测。如果使用要利用指标数据的其他产品,如 Red Hat CloudForms,则需要这个参数。 - enabled_hardware_types

- 要为 undercloud 启用的硬件类型的列表。

- generate_service_certificate

-

定义 undercloud 安装期间是否生成 SSL/TLS 证书,此证书用于

undercloud_service_certificate参数。undercloud 安装会保存生成的证书/etc/pki/tls/certs/undercloud-[undercloud_public_vip].pem。certificate_generation_ca参数中定义的 CA 将为此证书签名。 - heat_container_image

- 要使用的 heat 容器镜像的 URL。请保留不设置。

- heat_native

-

使用原生 heat 模板。请保留为

true。 - hieradata_override

-

hieradata覆盖文件的路径。如果设置此参数,undercloud 安装会将此文件复制到/etc/puppet/hieradata下,并将它设置为层次结构中的第一个文件。此参数可用于在undercloud.conf参数以外提供服务自定义配置。 - inspection_extras

-

指定在内省的过程中是否启用额外的硬件集合。在内省镜像中需要

python-hardware或python-hardware-detect软件包。 - inspection_interface

-

director 用来进行节点内省的网桥。这是 director 配置创建的一个自定义网桥。

LOCAL_INTERFACE会附加到这个网桥。请保留使用默认的值(br-ctlplane)。 - inspection_runbench

-

在节点内省过程中运行一组基准测试。把它设置为

true来启用这个功能。如果您需要在检查注册节点的硬件时执行基准数据分析操作,则需要使用这个参数。 - ipa_otp

-

定义在 IPA 服务器注册 undercloud 节点使用的一次性密码。启用

enable_novajoin之后需要提供此密码。 - ipxe_enabled

-

定义使用 iPXE 还是标准的 PXE。默认值是

true,这会使用 iPXE;设置为false则使用标准的 PXE。 - local_interface

指定 director 的 Provisioning NIC 的接口。它同时还是 director 用来作为它的 DHCP 和 PXE 引导服务的设备。把这个项的值改为您需要使用的值。使用

ip addr命令可以查看连接了哪些设备。以下是一个ip addr命令的结果输出示例:2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 52:54:00:75:24:09 brd ff:ff:ff:ff:ff:ff inet 192.168.122.178/24 brd 192.168.122.255 scope global dynamic eth0 valid_lft 3462sec preferred_lft 3462sec inet6 fe80::5054:ff:fe75:2409/64 scope link valid_lft forever preferred_lft forever 3: eth1: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noop state DOWN link/ether 42:0b:c2:a5:c1:26 brd ff:ff:ff:ff:ff:ff在这个例子中,External NIC 使用

eth0,Provisioning NIC 使用eth1(当前没有被配置)。在这种情况下,把local_interface设置为eth1。配置脚本会把这个接口附加到一个自定义的网桥(由inspection_interface参数定义)上。- local_ip

-

director 的 Provisioning NIC 的 IP 地址。它同时还是 director 用来作为它的 DHCP 和 PXE 引导服务的 IP 地址。除非您需要为 Provisioning 网络使用不同的子网(例如,默认值与环境中存在的 IP 地址或子网有冲突),否则请保留默认值

192.168.24.1/24。 - local_mtu

-

用于

local_interface的 MTU。 - local_subnet

-

适用于 PXE 引导和 DHCP 接口的本地子网。

local_ip地址应该属于这个子网。 默认值为ctlplane-subnet。 - net_config_override

-

网络配置覆盖模板的路径。如果设置此参数,undercloud 将使用 JSON 格式的模板来利用

os-net-config参数配置网络。这将忽略undercloud.conf中设置的网络参数。如需示例,请参阅/usr/share/python-tripleoclient/undercloud.conf.sample。 - output_dir

- 用于输出状态、已处理的 heat 模板和 ansible 部署文件的目录。

- overcloud_domain_name

要在部署 overcloud 时使用的 DNS 域名。

注意必须将 overcloud 参数

CloudDomain设置为匹配的值。- roles_file

- 在 undercloud 安装时要覆盖的角色文件。强烈建议您保留为不设置,以便 director 安装使用默认的角色文件。

- scheduler_max_attempts

- 调度程序尝试部署实例的次数上限。请将此值设为大于等于您要立即部署的裸机节点数量,从而在调度时避免可能出现的争用情形。

- service_principal

- 使用该证书的服务的 Kerberos 主体。只有您的 CA 要求 Kerberos 主体时才应使用此参数,例如在 FreeIPA 中。

- subnets

-

用于置备和内省的路由网络子网的列表。请参阅子网,以了解更多信息。默认值仅包含

ctlplane-subnet子网。 - templates

- 要覆盖的 heat 模板文件。

- undercloud_admin_host

-

使用 SSL/TLS 时 director 的 Admin API 的 IP 地址。该 IP 地址用于通过 SSL/TLS 访问管理端点。director 的配置会把这个 IP 地址附加到它的软件网桥上作为一个路由的 IP 地址(使用

/32网络掩码)。 - undercloud_debug

-

把 undercloud 服务的日志级别设置为

DEBUG。把值设为true来启用它。 - undercloud_enable_selinux

-

在部署期间启用或禁用 SELinux。强烈建议您保留设为

true,除非要调试问题。 - undercloud_hostname

- 定义 undercloud 的完全限定主机名。如果设置,undercloud 安装将配置所有系统主机名设置。如果保留未设置,undercloud 将使用当前的主机名,但用户必须相应地配置所有主机名设置。

- undercloud_log_file

-

用于存储 undercloud 安装/升级日志的日志文件的路径。默认情况下,日志文件是主目录中的

install-undercloud.log。例如,/home/stack/install-undercloud.log。 - undercloud_nameservers

- 用于 undercloud 主机名解析的 DNS 名称服务器列表。

- undercloud_ntp_servers

- 用于帮助同步 undercloud 的日期和时间的网络时间协议服务器列表。

- undercloud_public_host

-

使用 SSL/TLS 时 director 的 Public API 的 IP 地址。该 IP 地址用于通过 SSL/TLS 从外部访问 director 端点。director 的配置会把这个 IP 地址附加到它的软件网桥上作为一个路由的 IP 地址(使用

/32网络掩码)。 - undercloud_service_certificate

- 用于 OpenStack SSL/TLS 通信的证书的位置和文件名。理想的情况是从一个信任的证书认证机构获得这个证书。或者,您也可以生成一个自签名的证书。另外,这些指导也包括为您的证书(无论是自签名证书还是从证书认证机构获得的证书)设置 SELinux 上下文的信息。

- undercloud_update_packages

- 定义是否在安装 undercloud 期间更新软件包。

子网

每个置备子网在 undercloud.conf 文件中都有一个对应的同名部分。例如,以下内容可创建一个名为 ctlplane-subnet 的子网:

[ctlplane-subnet] cidr = 192.168.24.0/24 dhcp_start = 192.168.24.5 dhcp_end = 192.168.24.24 inspection_iprange = 192.168.24.100,192.168.24.120 gateway = 192.168.24.1 masquerade = true

您可以根据自身环境所需来指定相应数量的置备网络。

- gateway

-

overcloud 实例的网关。它是 undercloud 主机,会把网络流量转发到外部网络。除非您的 director 使用不同的 IP 地址,或直接使用外部网关,否则请保留默认值

192.168.24.1。

director 的配置也可以使用相关的 sysctl 内核参数自动启用 IP 转发。

- cidr

-

director 用来管理 overcloud 实例的网络,这是由 undercloud 的

neutron服务管理的 Provisioning 网络。除非您的 Provisioning 网络使用了不同的子网,否则请保留默认值192.168.24.0/24。 - masquerade

-

定义是否伪装

cidr中定义的用于外部访问的网络。这为 Provisioning 网络提供了一定程度的网络地址转换(network address translation,简称 NAT)功能,从而可以通过 director 实现外部访问。 - dhcp_start; dhcp_end

- overcloud 节点 DHCP 分配范围的开始值和终止值。请确保此范围可以为节点提供足够的 IP 地址。

请根据您的配置所需来修改上述参数的值。完成后,请保存文件。

4.3. 安装 director

以下操作过程旨在安装 director 并执行一些基本的安装后任务。

步骤

运行以下命令,以在 undercloud 上安装 director:

[stack@director ~]$ openstack undercloud install

这会启动 director 的配置脚本。director 会安装额外的软件包,并把它的服务配置为和

undercloud.conf中的设置相符合的情况。这个脚本会需要一些时间来完成。完成后,此脚本会生成两个文件:

-

undercloud-passwords.conf- director 服务的所有密码列表。 -

stackrc- 用来访问 director 命令行工具的一组初始变量。

-

此脚本还会自动启动所有的 OpenStack 平台服务容器。使用以下命令来检查已启用的容器:

[stack@director ~]$ sudo docker ps

此脚本会将

stack用户添加到docker组中,以使stack用户有权访问容器管理命令。请使用以下命令刷新stack用户的权限:[stack@director ~]$ exec su -l stack

这个命令会提示您重新登录。请输入 stack 用户的密码。

运行以下命令初始化

stack用户来使用命令行工具:[stack@director ~]$ source ~/stackrc

提示信息现在指示,OpenStack 命令在对 undercloud 验证身份并执行命令;

(undercloud) [stack@director ~]$

director 的安装已完成。您现在可以使用 director 的命令行工具了。

4.4. 为 overcloud 节点获取镜像

director 需要以下几个磁盘镜像来部署 overcloud 节点:

- 一个内省内核和 ramdisk - 用于通过 PXE 引导进行裸机系统内省。

- 一个实施内核和 ramdisk - 用于系统部署和实施。

- overcloud 内核、ramdisk 和完整镜像 - 写到节点硬盘中的基本 overcloud 系统。

以下操作过程旨在展示如何获取并安装这些镜像。

4.4.1. 单一架构 overcloud

这些镜像和规程是部署和 overcloud 所需要的。

步骤

查找

stackrc文件,以启用 director 的命令行工具:[stack@director ~]$ source ~/stackrc

安装

rhosp-director-images和rhosp-director-images-ipa软件包:(undercloud) [stack@director ~]$ sudo yum install rhosp-director-images rhosp-director-images-ipa

将镜像解包到

stack用户的主目录下的images目录 (/home/stack/images):(undercloud) [stack@director ~]$ cd ~/images (undercloud) [stack@director images]$ for i in /usr/share/rhosp-director-images/overcloud-full-latest-14.0.tar /usr/share/rhosp-director-images/ironic-python-agent-latest-14.0.tar; do tar -xvf $i; done

把这些镜像导入到 director:

(undercloud) [stack@director images]$ openstack overcloud image upload --image-path /home/stack/images/

这会将下列镜像上传到 director:

-

bm-deploy-kernel -

bm-deploy-ramdisk -

overcloud-full -

overcloud-full-initrd -

overcloud-full-vmlinuz

另外,此脚本还会在 director 的 PXE 服务器上安装内省镜像。

-

检查这些镜像是否已成功上传:

(undercloud) [stack@director images]$ openstack image list +--------------------------------------+------------------------+ | ID | Name | +--------------------------------------+------------------------+ | 765a46af-4417-4592-91e5-a300ead3faf6 | bm-deploy-ramdisk | | 09b40e3d-0382-4925-a356-3a4b4f36b514 | bm-deploy-kernel | | ef793cd0-e65c-456a-a675-63cd57610bd5 | overcloud-full | | 9a51a6cb-4670-40de-b64b-b70f4dd44152 | overcloud-full-initrd | | 4f7e33f4-d617-47c1-b36f-cbe90f132e5d | overcloud-full-vmlinuz | +--------------------------------------+------------------------+

这个列表没有显示内省 PXE 镜像。director 会把这些文件复制到

/httpboot。(undercloud) [stack@director images]$ ls -l /httpboot total 341460 -rwxr-xr-x. 1 root root 5153184 Mar 31 06:58 agent.kernel -rw-r--r--. 1 root root 344491465 Mar 31 06:59 agent.ramdisk -rw-r--r--. 1 ironic-inspector ironic-inspector 337 Mar 31 06:23 inspector.ipxe

4.4.2. 多架构 overcloud

这些是部署操作和 overcloud 所需要的镜像和规程。

步骤

查找

stackrc文件,以启用 director 的命令行工具:[stack@director ~]$ source ~/stackrc

安装

rhosp-director-images-all软件包:(undercloud) [stack@director ~]$ sudo yum install rhosp-director-images-all

将存档解包到特定于架构的目录中,该目录位于

stack用户的主目录下的images目录 (/home/stack/images) 中:(undercloud) [stack@director ~]$ cd ~/images (undercloud) [stack@director images]$ for arch in x86_64 ppc64le ; do mkdir $arch ; done (undercloud) [stack@director images]$ for arch in x86_64 ppc64le ; do for i in /usr/share/rhosp-director-images/overcloud-full-latest-14.0-${arch}.tar /usr/share/rhosp-director-images/ironic-python-agent-latest-14.0-${arch}.tar ; do tar -C $arch -xf $i ; done ; done把这些镜像导入到 director:

(undercloud) [stack@director ~]$ cd ~/images (undercloud) [stack@director images]$ openstack overcloud image upload --image-path ~/images/ppc64le --architecture ppc64le --whole-disk --http-boot /tftpboot/ppc64le (undercloud) [stack@director images]$ openstack overcloud image upload --image-path ~/images/x86_64/ --http-boot /tftpboot

这会将下列镜像上传到 director:

-

bm-deploy-kernel -

bm-deploy-ramdisk -

overcloud-full -

overcloud-full-initrd -

overcloud-full-vmlinuz -

ppc64le-bm-deploy-kernel -

ppc64le-bm-deploy-ramdisk ppc64le-overcloud-full另外,此脚本还会在 director 的 PXE 服务器上安装内省镜像。

-

检查这些镜像是否已成功上传:

(undercloud) [stack@director images]$ openstack image list +--------------------------------------+---------------------------+--------+ | ID | Name | Status | +--------------------------------------+---------------------------+--------+ | 6d1005ba-ec82-473b-8e33-88aadb5b6792 | bm-deploy-kernel | active | | fb723b33-9f11-45f5-b25b-c008bf509290 | bm-deploy-ramdisk | active | | 6a6096ba-8f79-4343-b77c-4349f7b94960 | overcloud-full | active | | de2a1bde-9351-40d2-bbd7-7ce9d6eb50d8 | overcloud-full-initrd | active | | 67073533-dd2a-4a95-8e8b-0f108f031092 | overcloud-full-vmlinuz | active | | 69a9ffe5-06dc-4d81-a122-e5d56ed46c98 | ppc64le-bm-deploy-kernel | active | | 464dd809-f130-4055-9a39-cf6b63c1944e | ppc64le-bm-deploy-ramdisk | active | | f0fedcd0-3f28-4b44-9c88-619419007a03 | ppc64le-overcloud-full | active | +--------------------------------------+---------------------------+--------+

这个列表没有显示内省 PXE 镜像。director 会把这些文件复制到

/tftpboot。(undercloud) [stack@director images]$ ls -l /tftpboot /tftpboot/ppc64le/ /tftpboot: total 422624 -rwxr-xr-x. 1 root root 6385968 Aug 8 19:35 agent.kernel -rw-r--r--. 1 root root 425530268 Aug 8 19:35 agent.ramdisk -rwxr--r--. 1 ironic ironic 20832 Aug 8 02:08 chain.c32 -rwxr--r--. 1 ironic ironic 715584 Aug 8 02:06 ipxe.efi -rw-r--r--. 1 root root 22 Aug 8 02:06 map-file drwxr-xr-x. 2 ironic ironic 62 Aug 8 19:34 ppc64le -rwxr--r--. 1 ironic ironic 26826 Aug 8 02:08 pxelinux.0 drwxr-xr-x. 2 ironic ironic 21 Aug 8 02:06 pxelinux.cfg -rwxr--r--. 1 ironic ironic 69631 Aug 8 02:06 undionly.kpxe /tftpboot/ppc64le/: total 457204 -rwxr-xr-x. 1 root root 19858896 Aug 8 19:34 agent.kernel -rw-r--r--. 1 root root 448311235 Aug 8 19:34 agent.ramdisk -rw-r--r--. 1 ironic-inspector ironic-inspector 336 Aug 8 02:06 default

默认的 overcloud-full.qcow2 镜像是一种平面分区镜像。但是,您仍可以导入和使用完整的磁盘镜像。请参阅 附录 C, 完整的磁盘镜像 了解更多信息。

4.5. 为 Control Plane 设置名称服务器

如果您希望 overcloud 解析外部主机名,如 cdn.redhat.com,建议您在 overcloud 节点上设置名称服务器。对于没有进行网络隔离的标准 overcloud,名称服务器会使用 undercloud 的控制平面子网来定义。请按照以下过程操作,以定义环境的名称服务器。

步骤

查找

stackrc文件,以启用 director 的命令行工具:[stack@director ~]$ source ~/stackrc

为

ctlplane-subnet子网设置名称服务器:(undercloud) [stack@director images]$ openstack subnet set --dns-nameserver [nameserver1-ip] --dns-nameserver [nameserver2-ip] ctlplane-subnet

请为每一个名称服务器使用

--dns-nameserver选项。查看子网来验证名称解析服务器:

(undercloud) [stack@director images]$ openstack subnet show ctlplane-subnet +-------------------+-----------------------------------------------+ | Field | Value | +-------------------+-----------------------------------------------+ | ... | | | dns_nameservers | 8.8.8.8 | | ... | | +-------------------+-----------------------------------------------+

如果要将服务流量隔离到单独的网络,overcloud 节点将使用网络环境配置文件中的 DnsServer 参数。

4.6. 后续步骤

undercloud 的配置到此结束。下一章将介绍基本的 overcloud 配置,包括注册节点和检查节点,并把它们标记为不同的节点角色。

部分 II. 基本的 Overcloud 部署

第 5 章 规划您的 overcloud

以下一节提供了与规划您的 Red Hat OpenStack Platform 环境中的各个环境相关的信息。这包括定义节点角色、规划您的网络拓扑结构和存储。

5.1. 节点角色

director 为构建 overcloud 提供了多个默认的节点类型。这些节点类型是:

- Controller

提供用于控制环境的关键服务。它包括仪表板服务 (horizon)、认证服务 (keystone)、镜像存储服务 (glance)、联网服务 (neutron)、编配服务 (heat) 以及高可用性服务。一个 Red Hat OpenStack Platform 环境中需要三个 Controller 节点,才能成为高可用性环境。

注意由一个节点组成的环境可用于测试。不支持由两个节点或由三个以上节点组成的环境。

- Compute

- 一个作为虚拟机监控程序(hypervisor)的物理服务器,它为环境中运行的虚拟机提供处理能力。一个基本的 Red Hat OpenStack Platform 环境中需要最少一个 Compute 节点。

- Ceph 存储

- 提供 Red Hat Ceph Storage 的一个主机。额外的 Ceph Storage 主机可以在一个集群中扩展。这个实施角色是可选的。

- Swift Storage

- 为 OpenStack 的 Swift 服务提供外部对象存储的主机。这个部署角色是可选的。

下表提供了几个不同的 overcloud 示例,以及每种情况中的节点数量。

表 5.1. 节点部署

|

Controller |

Compute |

Ceph 存储 |

Swift Storage |

总计 | |

|

小型 overcloud |

3 |

1 |

- |

- |

4 |

|

中型 overcloud |

3 |

3 |

- |

- |

6 |

|

带有额外对象存储的中型 overcloud |

3 |

3 |

- |

3 |

9 |

|

带有 Ceph Storage 集群的中型 overcloud |

3 |

3 |

3 |

- |

9 |

此外,还需思考是否要将各个服务划分成不同的自定义角色。有关可组合角色架构的更多信息,请参阅 Advanced Overcloud Customization 指南中的"Composable Services and Custom Roles"。

5.2. Overcloud 网络

规划环境中的网络拓扑结构和子网非常重要,这样您可以把角色和服务进行正确的映射,从而使它们可以互相进行正确的通信。Red Hat OpenStack Platform 使用 Openstack Networking (neutron) 服务,此服务可自主运行,并可管理基于软件的网络、静态和浮动 IP 地址以及 DHCP。

默认情况下,director 将节点配置为使用 Provisioning / Control Plane 进行连接。不过,可以将网络流量隔离到一系列的可组合网络,供您自定义和分配服务。

在典型的 Red Hat OpenStack Platform 安装中,网络类型的数量通常会超过物理网络链路的数量。为了可以把所有网络都连接到正确的主机,overcloud 使用 VLAN 标记(VLAN tagging)来为每个接口提供多个网络。大多数的网络都是相互隔离的子网,但部分网络需要第 3 层网关来提供路由功能以便接入互联网或连接基础架构网络。如果使用 VLAN 来隔离网络流量类型,请使用支持 802.1Q 标准的交换机来提供 tagged VLAN。

我们推荐,即使在部署时使用了禁用隧道功能的 neutron VLAN,您最好仍然部署一个项目网络(利用 GRE 或 VXLAN 进行隧道连接)。这只需要在部署时进行一些微小的自定义,便可为以后使用网络隧道功能实现工具网络或虚拟化网络留下选择余地。您仍然需要使用 VLAN 创建租户网络,但同时也可为特殊用途网络创建 VXLAN 隧道,而不需要消耗租户 VLAN。VXLAN 功能可以添加到带有租户 VLAN 的部署中,而租户 VLAN 却无法在不对系统运行造成干扰的情况下添加到现有的 overcloud 中。

director 也提供一系列模板,来配置具有隔离的可组合网络的 NIC。默认的配置为:

- 单 NIC 配置 - 一个 NIC 在原生 VLAN 中用于 Provisioning 网络,并用于 tagged VLAN(使用子网处理不同的 overcloud 网络类型)。

- 绑定 NIC 配置 - 一个 NIC 在原生 VLAN 中用于 Provisioning 网络,tagged VLAN 绑定中的两个 NIC 用于不同的 overcloud 网络类型。

- 多 NIC 配置 - 每个 NIC 都使用一个子网来分别处理 overcloud 中不同的网络类型。

您也可以创建自己的模板来映射特定的 NIC 配置。

在思考您的网络配置时,以下细微细节也很重要:

- 在 overcloud 创建过程中,在所有 overcloud 机器间使用同一个名称来代表 NIC。理想情况下,您应该在每个 overcloud 节点上对每个相关的网络都使用相同的 NIC 来避免混淆。例如,Provisioning 网络使用主(primary)NIC,OpenStack 服务使用从(secondary)NIC。

- 把所有 overcloud 系统设置为使用 Provisioning NIC 进行 PXE 引导,并在 External NIC 以及系统的所有其他 NIC 上禁用 PXE 引导。另外,还需要确保 Provisioning NIC 在 PXE 引导设置中位于引导顺序的最上面(在硬盘和 CD/DVD 驱动器之前)。

- 所有 overcloud 裸机系统都需要一个受支持的电源管理接口,如智能平台管理接口(IPMI)。这将使得 director 能够控制每个节点的电源管理。

- 请记录下每个 overcloud 系统的以下信息:Provisioning NIC 的 MAC 地址、IPMI NIC 的 IP 地址、IPMI 用户名和 IPMI 密码。稍后设置 overcloud 节点时需要用到这些信息。

- 如果一个实例需要可以被外部互联网访问,则需要从公共网络中分配一个浮动 IP 地址,并把它和这个实例相关联。这个实例仍然会保留它的私人 IP,但网络数据可以通过 NAT 到达浮动 IP 地址。请注意,一个浮动 IP 地址只能分配给一个接口,而不能分配给多个私人 IP 地址。但是,浮动 IP 地址只会为一个租户预留以供使用,租户可以根据需要关联或取消关联一个特定的实例。这个配置会使您的环境暴露于外部网络,您需要确保使用了适当的安全保护措施。

- 为了减少 Open vSwitch 中出现网络环路的风险,只能有一个接口或一个绑定作为给定网桥的成员。如果需要多个绑定或接口,可以配置多个网桥。

- 建议使用 DNS 主机名解析,以便您的 overcloud 节点可以连接外部服务,如 Red Hat Content Delivery Network 和网络时间服务器。

5.3. Overcloud 存储

如果在使用任何驱动程序或后端类型的后端 cinder-volume 的客户机实例上使用 LVM,会出现与性能、卷可见性和卷可用性有关的问题。这些问题可利用 LVM 过滤器来解决。如需更多信息,请参考 Storage Guide 中的section 2.1 Back Ends,以及 KCS 文章 3213311 "Using LVM on a cinder volume exposes the data to the compute host."

director 为 overcloud 环境提供不同的存储选项,它们包括:

- Ceph Storage 节点

director 使用 Red Hat Ceph Storage 创建一组可扩展存储节点。overcloud 将这些节点用于:

- 镜像 - Glance 管理虚拟机的镜像。镜像是不可变的,OpenStack 把镜像看做为二进制数据块,并根据它们的实际情况进行下载。您可以使用 glance 在一个 Ceph 块设备中存储镜像。

- 卷 - Cinder 卷是块设备。OpenStack 使用卷来引导虚拟机,或把卷附加到运行的虚拟机上。OpenStack 使用 Cinder 服务管理卷。您可以使用 Cinder,通过镜像的写时复制(copy-on-write,简称 COW)克隆引导虚拟机。

- 文件系统 - Manila 共享由文件系统来支持。OpenStack 用户使用 manila 服务来管理共享。您可以使用 manila 来管理由 CephFS 文件系统(数据保存在 Ceph Storage 节点上)支持的共享。

客户机磁盘 - 客户机磁盘就是客户机操作系统磁盘。在默认情况下,当使用 nova 引导虚拟机时,它的磁盘会以一个文件的形式出现在虚拟机监控程序 (hypervisor)上,通常位于

/var/lib/nova/instances/<uuid>/。Ceph 中的每个虚拟机可以在不使用 Cinder 的情况下直接引导,这可以使您在实时迁移时更容易地执行维护操作。此外,如果您的虚拟机监控程序出现问题,它还可以方便地触发nova evacuate,并在其他位置运行虚拟机。重要如需关于支持的镜像格式的信息,请参阅 Instances and Images Guide 中的 Image Service 章节。

如需了解更详细的信息,请参阅 Red Hat Ceph Storage Architecture Guide。

- Swift 存储节点

- director 会创建外部对象存储节点。当您需要扩展或替换 overcloud 环境中的控制器节点,同时需要在一个高可用性集群外保留对象存储时,这将非常有用。

5.4. Overcloud 安全性

OpenStack 平台环境的安全性在一定程度上取决于网络的安全性。在您的网络环境中使用适当的安全性措施来确保可以正确地控制网络访问。例如:

- 使用网络分段(network segmentation)技术来控制网络数据并隔离敏感数据。扁平化网络(flat network)通常不是非常安全。

- 限制对服务和端口的访问。

- 使用适当的防火墙设置以及密码。

- 启用 SELinux。

如需了解更多与系统安全相关的信息,请参阅:

5.5. Overcloud 高可用性

要部署高度可用的 overcloud,director 将配置多个 Controller、Compute 和 Storage 节点,并以单一集群的形式协同工作。出现节点故障时,根据故障的节点来触发自动隔离和重新生成流程。有关 overcloud 高可用性架构和服务的信息,请参阅 Understanding Red Hat OpenStack Platform High Availability。

您也可以通过 director 为 Compute 实例配置高可用性 (Instance HA)。这种机制可以在节点故障时在 Compute 节点上自动清空和重新生成实例。Instance HA 的要求与一般的 overcloud 要求相同,但您必须通过执行额外的步骤来准备部署环境。有关 Instance HA 工作方式和安装说明的信息,请参阅 High Availability for Compute Instances 指南。

5.6. Controller 节点要求

Controller 节点用来托管 RHEL OpenStack 平台环境中的核心服务,如 Horizon 仪表板、后端数据库服务器、Keystone 认证和 High Availability 服务。

- 处理器

- 支持 Intel 64 或 AMD64 CPU 扩展的 64 位 x86 处理器。

- 内存

至少 32 GB 的内存。不过,建议根据 vCPU 数量(CPU 内核数乘以超线程值)来决定内存大小。请参考以下计算方式:

控制器 RAM 最小值计算:

- 每个 vCPU 使用 1.5 GB 内存。例如,拥有 48 个 vCPU 的计算机应当具有 72 GB RAM。

控制器 RAM 建议值计算:

- 每个 vCPU 使用 3 GB 内存。例如,拥有 48 个 vCPU 的计算机应当具有 144 GB RAM。

有关测量内存要求的更多信息,请参阅红帽客户门户上的“Red Hat OpenStack Platform 高可用控制器硬件要求”。

- 磁盘存储和布局

至少需要 40 GB 存储。但是,Telemetry (

gnocchi) 和 Object Storage (swift) 服务都安装在 Controller 上,都配置为使用根磁盘。这些默认布局适合在商用硬件上部署小型 overcloud,这样的环境通常用于概念验证以及测试。基于这些默认布局,只需最少的规划即可部署 overcloud,但只能提供很低的工作负载容量和性能。然而在企业环境中,这可能造成很大的瓶颈。这是因为 Telemetry 会不断地访问存储资源,导致磁盘 I/O 使用率很高,从而严重影响所有其他 Controller 服务的性能。在这类环境中,需要细致规划 overcloud 并相应地进行配置。

红帽为 Telemetry 和 Object Storage 提供了一些配置建议方案。如需了解详细信息,请参阅 Deployment Recommendations for Specific Red Hat OpenStack Platform Services。

- 网络接口卡

- 最少两个 1 Gbps 网络接口卡。额外的网卡可以组成绑定接口,或处理标记的 VLAN 网络(tagged VLAN)流量。

- 电源管理

- 每个 Controller 节点都需要在服务器的主板上有一个被支持的电源管理接口(如 IPMI)。

5.7. Compute 节点要求

Compute 节点负责运行虚拟机实例。它们必须支持硬件虚拟化,并需要有足够的内存和磁盘空间来支持它们所运行的虚拟机。

- 处理器

- 支持带有 Intel 64 或 AMD64 CPU 扩展并启用了 Intel VT 硬件虚拟扩展的 64 位 x86 处理器。我们推荐所使用的处理器最少有 4 个内核。

- IBM POWER 8 处理器。

- 内存

- 最少 6 GB RAM,然后加上准备提供给虚拟机实例使用的内存。

- 磁盘空间

- 最少具有 40GB 可用磁盘空间。

- 网络接口卡

- 最少一个 1 Gbps 网络接口卡。但在生产环境中,推荐最少使用两个网卡。额外的网卡可以组成绑定接口,或处理标记的 VLAN 网络(tagged VLAN)流量。

- 电源管理

- 每个 Compute 节点在服务器的主板上都要有一个受支持的电源管理接口(如智能平台管理接口 (IPMI) 功能)。

5.8. Ceph Storage 节点要求

Ceph Storage 节点负责在 Red Hat OpenStack Platform 环境中提供对象存储。

- 处理器

- 支持 Intel 64 或 AMD64 CPU 扩展的 64 位 x86 处理器。

- 内存

- 红帽通常建议每个 OSD 主机最少 16GB RAM,每个 OSD 守护进程增加 2 GB RAM。

- 磁盘配置

大小取决于您的存储需求。推荐的 Red Hat Ceph Storage 节点配置需要至少三个或更多磁盘,采用与下方类似的布局:

-

/dev/sda- 根磁盘。director 把主 overcloud 镜像复制到这个磁盘。这应当具有最少 40 GB 的可用磁盘空间。 -

/dev/sdb- journal 磁盘。这个磁盘被分为不同的分区来保存 Ceph OSD 的日志信息。例如,/dev/sdb1、/dev/sdb2、/dev/sdb3等。 journal 磁盘通常需要是一个固态磁盘(SSD)来保证系统的性能。 /dev/sdc和后续 - OSD 磁盘。可以根据您的存储需要使用多个磁盘。注意Red Hat OpenStack Platform director 使用

ceph-ansible,不支持在 Ceph Storage 节点的根磁盘上安装 OSD。这意味着所支持的每个 Ceph Storage 节点需要至少两个或更多磁盘。

-

- 网络接口卡

- 最少一个 1 Gbps 网络接口卡。但在生产环境中,推荐最少使用两个网卡。额外的网卡可以组成绑定接口,或处理标记的 VLAN 网络(tagged VLAN)流量。推荐为存储节点使用10 Gbps 接口,特别是所创建的 OpenStack 平台环境需要处理大量网络数据时。

- 电源管理

- 每个 Controller 节点都需要在服务器的主板上有一个被支持的电源管理接口(如 IPMI)。

如需了解更多有关安装使用 Ceph Storage 集群的 overcloud 的信息,请参阅 Deploying an Overcloud with Containerized Red Hat Ceph 指南。

5.9. Object Storage 节点要求

Object Storage 节点提供 overcloud 的对象存储层。Object Storage 代理安装在控制器节点上。存储层要求每一个裸机节点装有多个磁盘。

- 处理器

- 支持 Intel 64 或 AMD64 CPU 扩展的 64 位 x86 处理器。

- 内存

- 内存要求取决于存储空间大小。理想状态下,每 1TB 硬盘空间需要至少 1GB 内存。为获得最佳性能,建议每 1TB 硬盘空间使用 2GB 内存,尤其是小文件(100GB 以下)工作负载。

- 磁盘空间

存储要求取决于工作负载需要的容量。建议使用 SSD 驱动器来存储帐户和容器数据。帐户和容器数据大约占对象数据的 1%。例如,对于每 100TB 硬盘容量,请提供 1TB 容量来存储帐户和容器数据。

不过,这还取决于所存储数据的类型。如果存储的大部分是小对象,则需要提供较多的 SSD 空间。而对于大对象(视频和备份等),可提供较少的 SSD 空间。

- 磁盘配置

所推荐的节点配置需要类似于如下的磁盘布局:

-

/dev/sda- 根磁盘。director 把主 overcloud 镜像复制到该磁盘。 -

/dev/sdb- 用于帐户数据。 -

/dev/sdc- 用于容器数据。 -

/dev/sdd及后续 - 对象服务器磁盘。可以根据您的存储需要使用多个磁盘。

-

- 网络接口卡

- 最少两个 1 Gbps 网络接口卡。额外的网卡可以组成绑定接口,或处理标记的 VLAN 网络(tagged VLAN)流量。

- 电源管理

- 每个 Controller 节点都需要在服务器的主板上有一个被支持的电源管理接口(如 IPMI)。

5.10. overcloud 软件仓库

安装和配置 undercloud 需要下列软件仓库。

表 5.2. 核心软件仓库

| 名称 | 软件仓库 | 描述 |

|---|---|---|

|

Red Hat Enterprise Linux 7 Server (RPMs) |

|

x86_64 系统的基本操作系统仓库。 |

|

Red Hat Enterprise Linux 7 Server - Extras (RPMs) |

|

包括 Red Hat OpenStack Platform 的依赖软件包。 |

|

Red Hat Enterprise Linux 7 Server - RH Common (RPMs) |

|

包括部署和配置 Red Hat OpenStack Platform 的工具程序。 |

|

Red Hat Satellite Tools for RHEL 7 Server RPMs x86_64 |

|

管理使用 Red Hat Satellite 6 的主机的工具。 |

|

Red Hat Enterprise Linux High Availability (for RHEL 7 Server) (RPMs) |

|

Red Hat Enterprise Linux 的高可用性工具。用于 Controller 节点的高可用性功能。 |

|

Red Hat OpenStack Platform 14 for RHEL 7 (RPMs) |

|

Red Hat OpenStack Platform 核心软件仓库。 |

表 5.3. Ceph 软件仓库

| 名称 | 软件仓库 | 描述 |

|---|---|---|

|

Red Hat Ceph Storage OSD 3 for Red Hat Enterprise Linux 7 Server (RPMs) |

|

(Ceph Storage 节点)Ceph Storage Object Storage 守护进程的软件仓库。在 Ceph Storage 节点上安装。 |

|

Red Hat Ceph Storage MON 3 for Red Hat Enterprise Linux 7 Server (RPMs) |

|

(Ceph Storage 节点)Ceph Storage Monitor 守护进程的软件仓库。在使用 Ceph Storage 节点的 OpenStack 环境的 Controller 节点上安装。 |

|

Red Hat Ceph Storage Tools 3 for Red Hat Enterprise Linux 7 Server (RPMs) |

|

提供节点与 Ceph Storage 集群进行通信的工具。部署配备 Ceph Storage 集群的 overcloud 时,应该为所有节点启用此软件仓库。 |

表 5.4. NFV 软件仓库

| 名称 | 软件仓库 | 描述 |

|---|---|---|

|

Enterprise Linux for Real Time for NFV (RHEL 7 Server) (RPMs) |

|

适用于 NFV 的实时 KVM (RT-KVM) 的软件仓库。包含用于启用实时内核的软件包。应该为 RT-KVM 的所有目标 Compute 节点启用这个软件仓库。注:您需要另行订阅 |

IBM POWER 软件仓库

这些软件仓库供 POWER PC 架构上的 Openstack Platform 使用。使用这些软件仓库来替代核心软件仓库中的同等库。

| 名称 | 软件仓库 | 描述 |

|---|---|---|

|

Red Hat Enterprise Linux for IBM Power, little endian |

|

ppc64le 系统的基本操作系统软件仓库。 |

|

Red Hat OpenStack Platform 14 for RHEL 7 (RPMs) |

|

用于 ppc64le 系统的 Red Hat OpenStack Platform 核心软件仓库。 |

第 6 章 使用 CLI 工具配置基本的 overcloud

本章介绍了使用 CLI 工具配置 OpenStack 平台环境的基本步骤。overcloud 基本配置中不含任何自定义功能。但是,您可以按照 Advanced Overcloud Customization 指南中的说明,向这类基本 overcloud 添加高级配置选项,并按照您的具体规格进行自定义。

6.1. 为 overcloud 注册节点

director 需要一个节点定义模板,这个模板由您手动创建。此文件采用 JSON 或 YAML 格式,其中包含节点的详细硬件和电源管理信息。

步骤

创建一个模板来列出您的节点。例如,采用 JSON 格式的模板可能如下方所示:

{ "nodes":[ { "mac":[ "bb:bb:bb:bb:bb:bb" ], "name":"node01", "cpu":"4", "memory":"6144", "disk":"40", "arch":"x86_64", "pm_type":"ipmi", "pm_user":"admin", "pm_password":"p@55w0rd!", "pm_addr":"192.168.24.205" }, { "mac":[ "cc:cc:cc:cc:cc:cc" ], "name":"node02", "cpu":"4", "memory":"6144", "disk":"40", "arch":"x86_64", "pm_type":"ipmi", "pm_user":"admin", "pm_password":"p@55w0rd!", "pm_addr":"192.168.24.206" } ] }或者,YAML 格式的类似节点模板可能如下方所示:

nodes: - mac: - "bb:bb:bb:bb:bb:bb" name: "node01" cpu: 4 memory: 6144 disk: 40 arch: "x86_64" pm_type: "ipmi" pm_user: "admin" pm_password: "p@55w0rd!" pm_addr: "192.168.24.205" - mac: - cc:cc:cc:cc:cc:cc name: "node02" cpu: 4 memory: 6144 disk: 40 arch: "x86_64" pm_type: "ipmi" pm_user: "admin" pm_password: "p@55w0rd!" pm_addr: "192.168.24.206"这个模板使用以下属性:

- name

- 节点的逻辑名称。

- pm_type

要使用的电源管理驱动程序。本例中使用 IPMI 驱动程序 (

ipmi),这是首选的电源管理驱动程序。注意IPMI 是首选的受支持电源管理驱动程序。如需更多受支持的电源管理类型及其选项,请参阅 附录 B, 电源管理驱动。如果这些电源管理驱动程序不能正常工作,请将 IPMI 用于电源管理。

- pm_user; pm_password

- IPMI 的用户名和密码。

- pm_addr

- IPMI 设备的 IP 地址。

- mac

- (可选)节点上网络接口的 MAC 地址列表。对于每个系统的 Provisioning NIC,只使用 MAC 地址。

- cpu

- 节点上的 CPU 数量。(可选)

- memory

- 以 MB 为单位的内存大小。(可选)

- disk

- 以 GB 为单位的硬盘的大小。(可选)

- arch

系统架构。(可选)

重要在构建多架构云时,

arch键是必需的,用于区分使用x86_64和ppc64le架构的节点。

创建完模板后,将这个文件保存到

stack用户的主目录 (/home/stack/nodes.json),然后使用以下命令将其导入到 director:$ source ~/stackrc (undercloud) $ openstack overcloud node import ~/nodes.json

这会导入模板,并把模板中的每个节点注册到 director。

完成节点注册和配置之后,在 CLI 中查看这些节点的列表:

(undercloud) $ openstack baremetal node list

6.2. 检查节点的硬件

director 可以在每个节点上运行内省进程。这个进程会使每个节点通过 PXE 引导一个内省代理。这个代理从节点上收集硬件数据,并把信息发送回 director,director 把这些信息保存在运行于 director 上的 OpenStack Object Storage (swift) 服务中。director 使用硬件信息用于不同目的,如进行 profile tagging、benchmarking、手工引导磁盘分配等。

步骤

运行以下命令检查每个节点的属性:

(undercloud) $ openstack overcloud node introspect --all-manageable --provide

-

--all-manageable选项仅内省处于受管理状态的节点。本例中为所有节点。 -

--provide选项会在内省后将所有节点重置为available状态。

-

在一个单独的终端窗口中运行以下命令来监测内省的进程:

(undercloud) $ sudo journalctl -l -u openstack-ironic-inspector -u openstack-ironic-inspector-dnsmasq -u openstack-ironic-conductor -f

重要确保这个过程成功完成。它可能需要 15 分钟来检查这些裸机节点。

-

内省完成后,所有节点都会变为

available状态。

6.3. 为节点添加标签以加入到配置集

在注册并检查完每个节点的硬件后,需要为它们添加标签,加入特定的配置集。这些配置集标签会把节点和类型(flavor)相匹配,从而使类型分配到部署角色。下方的示例显示了 Controller 节点的角色、类型、配置集和节点之间的关系:

| 类型 | 描述 |

|---|---|

|

角色 |

|

|

类型 |

|

|

配置集 |

|

|

节点 |

您也可以对单个节点应用 |

默认的配置文件类型 compute、control、swift-storage、ceph-storage 和 block-storage 会在 undercloud 的安装过程中创建,多数环境中可不经修改直接使用。

步骤

为了通过添加标签把节点标记为特定的配置集,把

profile选项添加到每个节点的properties/capabilities参数中。例如,把环境中的两个节点分别标记为使用 controller 配置集和 compute 配置集,使用以下命令:(undercloud) $ openstack baremetal node set --property capabilities='profile:compute,boot_option:local' 58c3d07e-24f2-48a7-bbb6-6843f0e8ee13 (undercloud) $ openstack baremetal node set --property capabilities='profile:control,boot_option:local' 1a4e30da-b6dc-499d-ba87-0bd8a3819bc0

其中的

profile:compute和profile:control选项会把节点标记为相关的配置集。这些命令还设置

boot_option:local参数,该参数用于定义每个节点的引导方式。在标记完节点后,检查分配的配置集或可能的配置集:

(undercloud) $ openstack overcloud profiles list

6.4. 设置 UEFI 引导模式

默认引导模式是传统 BIOS 模式。新式系统可能要求使用 UEFI 引导模式,而非传统 BIOS 模式。下列步骤可用来更改为 UEFI 模式。

步骤

在

undercloud.conf文件中设置下列参数:ipxe_enabled = True inspection_enable_uefi = True

保存此文件并执行 undercloud 安装:

$ openstack undercloud install

等待安装脚本完成。

将每个注册节点的引导模式设置为

uefi。例如,要在capabilities属性中添加或替换现有的boot_mode参数,可运行以下命令:$ NODE=<NODE NAME OR ID> ; openstack baremetal node set --property capabilities="boot_mode:uefi,$(openstack baremetal node show $NODE -f json -c properties | jq -r .properties.capabilities | sed "s/boot_mode:[^,]*,//g")" $NODE

注意检查是否保留了

profile和boot_option功能。+

$ openstack baremetal node show r530-12 -f json -c properties | jq -r .properties.capabilities

将各个类型的引导模式设为

uefi:$ openstack flavor set --property capabilities:boot_mode='uefi' control

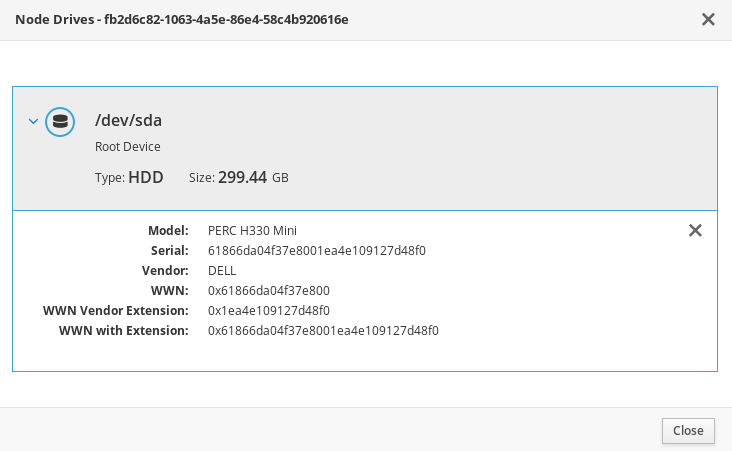

6.5. 为节点定义根磁盘

一些节点可能会使用多个磁盘。这意味着 director 需要识别在置备过程中作为根磁盘的磁盘。在置备过程中,director 将 QCOW2 overcloud-full 镜像写入到根磁盘。

以下几个属性可帮助 director 识别根磁盘:

-

model(字符串):设备 ID。 -

vendor(字符串):设备厂商。 -

serial(字符串):磁盘序列号。 -

hctl(字符串):SCSI 的 Host:Channel:Target:Lun。 -

size(整数):设备的大小(以 GB 为单位)。 -

wwn(字符串):唯一的存储 ID。 -

wwn_with_extension(字符串):唯一存储 ID 附加厂商扩展名。 -

wwn_vendor_extension(字符串):唯一厂商存储标识符。 -

rotational(布尔值):旋转磁盘设备为 true (HDD),否则为 false (SSD)。 -

name(字符串):设备名称,例如:/dev/sdb1。

只对有固定名称的设备才使用 name。不要使用 name 来设置其他设备的根磁盘,因为此值在节点引导时可能会改变。

本例演示了如何使用序列号指定根设备。

步骤

通过对每个节点的硬盘执行内省,检查磁盘信息。以下命令显示了一个节点的磁盘信息:

(undercloud) $ openstack baremetal introspection data save 1a4e30da-b6dc-499d-ba87-0bd8a3819bc0 | jq ".inventory.disks"

例如,一个节点的数据可能会显示 3 个磁盘:

[ { "size": 299439751168, "rotational": true, "vendor": "DELL", "name": "/dev/sda", "wwn_vendor_extension": "0x1ea4dcc412a9632b", "wwn_with_extension": "0x61866da04f3807001ea4dcc412a9632b", "model": "PERC H330 Mini", "wwn": "0x61866da04f380700", "serial": "61866da04f3807001ea4dcc412a9632b" } { "size": 299439751168, "rotational": true, "vendor": "DELL", "name": "/dev/sdb", "wwn_vendor_extension": "0x1ea4e13c12e36ad6", "wwn_with_extension": "0x61866da04f380d001ea4e13c12e36ad6", "model": "PERC H330 Mini", "wwn": "0x61866da04f380d00", "serial": "61866da04f380d001ea4e13c12e36ad6" } { "size": 299439751168, "rotational": true, "vendor": "DELL", "name": "/dev/sdc", "wwn_vendor_extension": "0x1ea4e31e121cfb45", "wwn_with_extension": "0x61866da04f37fc001ea4e31e121cfb45", "model": "PERC H330 Mini", "wwn": "0x61866da04f37fc00", "serial": "61866da04f37fc001ea4e31e121cfb45" } ]本例演示了如何将根设备设置为磁盘 2,该磁盘的序列号为

61866da04f380d001ea4e13c12e36ad6。这需要更改节点定义的root_device参数:(undercloud) $ openstack baremetal node set --property root_device='{"serial": "61866da04f380d001ea4e13c12e36ad6"}' 1a4e30da-b6dc-499d-ba87-0bd8a3819bc0注意把每个节点的 BIOS 配置为包括从所选 root 磁盘引导。推荐的引导顺序是:网络引导,然后是 root 磁盘引导。

6.6. 创建特定于架构的角色

在构建多云架构时,需要将特定于架构的角色添加到 roles_data.yaml 中。以下是一个同时包含 ComputePPC64LE 角色和默认角色的示例。如需与角色相关的信息,可参阅 Creating a Custom Role File 小节。

openstack overcloud roles generate \

--roles-path /usr/share/openstack-tripleo-heat-templates/roles -o ~/templates/roles_data.yaml \

Controller Compute ComputePPC64LE BlockStorage ObjectStorage CephStorage6.7. 环境文件

undercloud 带有一组 Heat 模板,作为创建 overcloud 的方案。您可以使用环境文件来自定义 overcloud 的各个方面,这些文件是 YAML 格式的文件,其内容可覆盖核心 Heat 模板集合中的参数和资源。您可以根据需要纳入多个环境文件。但是,环境文件的顺序非常重要,因为后续环境文件中定义的参数和资源更为优先。以下列表是环境文件顺序的示例:

- 每个角色及其类型的节点数量。包含此信息对于创建 overcloud 至关重要。

- 容器化 OpenStack 服务的容器镜像位置。

-

任何网络隔离文件,首先是 heat 模板集合中的初始化文件 (

environments/network-isolation.yaml),然后是您自定义的 NIC 配置文件,最后是任何额外的网络配置。 - 任何外部的负载平衡环境文件。

- 任何存储环境文件,如 Ceph Storage、NFS、iSCSI 等。

- 任何用于红帽 CDN 或 Satellite 注册的环境文件。

- 任何其它自定义环境文件。

建议将自定义环境文件放在一个单独目录中,比如 templates 目录。

您可以按照 Advanced Overcloud Customization 指南来自定义 overcloud 的高级功能。

一个基本的 overcloud 会使用本地 LVM 存储作为块存储,这种配置不受支持。建议您使用外部存储解决方案(如 Red Hat Ceph Storage)来实现块存储。

下面几节演示如何为您的 overcloud 创建所需环境。

6.8. 创建定义节点数目和类型的环境文件

默认情况下,director 部署具有 1 个 Controller 节点和 1 个 Compute 节点的 overcloud,节点的类型是 baremetal。不过,这仅适用于概念验证部署。您可以通过指定不同的节点数目和类型来覆盖默认配置。对于小型生产环境,您可能要考虑至少 3 个 Controller 节点和 3 个 Compute 节点,并且分配特定的类型来确保使用适当的资源规格来创建节点。以下过程演示了如何创建名为 node-info.yaml 的环境文件,该文件用于存储节点数目和类型分配情况。

步骤

创建一个

node-info.yaml文件,保存在/home/stack/templates/目录下:(undercloud) $ touch /home/stack/templates/node-info.yaml

编辑这个文件,使其包含您需要的节点数目和类型。本例部署 3 个 Controller 节点、3 个 Compute 节点和 3 个Ceph Storage 节点。

parameter_defaults: OvercloudControllerFlavor: control OvercloudComputeFlavor: compute ControllerCount: 3 ComputeCount: 3

6.9. 创建 undercloud CA 信任的环境文件

如果您的 undercloud 使用 TLS 且其 CA 不是公共信任的,您需要遵照此过程操作。undercloud 运行自己的证书颁发机构 (CA) 来进行 SSL 端点加密。要让 undercloud 端点可被部署中的其余部分访问,请将 overcloud 配置为信任 undercloud CA。

为了让这种方法凑效,您的 overcloud 节点需要指向 undercloud 的公开端点的网络路径。依赖于脊叶型网络的部署可能需要应用这种配置。

undercloud 中可以使用两种类型的自定义证书:

-

用户提供的证书 - 当您自行提供证书时,会应用此定义。证书可能来自于您自己的 CA,也可能是自签名的。这通过使用

undercloud_service_certificate选项来传递。在这种情形中,您需要信任自签名证书或者信任其 CA(取决于您的部署)。 -

自动生成的证书 - 当您通过

certmonger生成使用自己的本地 CA 的证书时,会应用此定义。这通过generate_service_certificate选项来启用。在这种情形中,会存在一个 CA 证书 (/etc/pki/ca-trust/source/anchors/cm-local-ca.pem),以及供 undercloud 的 HAProxy 实例使用的服务器证书。要向 OpenStack 出示证书,您需要将 CA 添加到inject-trust-anchor-hiera.yaml文件中。

步骤

本例中使用了位于 /home/stack/ca.crt.pem 的一个自签名证书。如果您使用自动生成的证书,请改为使用 /etc/pki/ca-trust/source/anchors/cm-local-ca.pem。

打开证书文件,仅复制证书部分。不要包括其密钥:

$ vi /home/stack/ca.crt.pem

您需要的证书部分与下方简写的示例类似:

-----BEGIN CERTIFICATE----- MIIDlTCCAn2gAwIBAgIJAOnPtx2hHEhrMA0GCSqGSIb3DQEBCwUAMGExCzAJBgNV BAYTAlVTMQswCQYDVQQIDAJOQzEQMA4GA1UEBwwHUmFsZWlnaDEQMA4GA1UECgwH UmVkIEhhdDELMAkGA1UECwwCUUUxFDASBgNVBAMMCzE5Mi4xNjguMC4yMB4XDTE3 -----END CERTIFICATE-----

创建一个名为

/home/stack/inject-trust-anchor-hiera.yaml的 YAML 文件,其包含下列内容以及您从 PEM 文件复制而来的证书:parameter_defaults: CAMap: ... undercloud-ca: content: | -----BEGIN CERTIFICATE----- MIIDlTCCAn2gAwIBAgIJAOnPtx2hHEhrMA0GCSqGSIb3DQEBCwUAMGExCzAJBgNV BAYTAlVTMQswCQYDVQQIDAJOQzEQMA4GA1UEBwwHUmFsZWlnaDEQMA4GA1UECgwH UmVkIEhhdDELMAkGA1UECwwCUUUxFDASBgNVBAMMCzE5Mi4xNjguMC4yMB4XDTE3 -----END CERTIFICATE-----注意证书字符串必须采用 PEM 格式。

在 overcloud 部署期间,CA 证书会复制到各个 overcloud 节点,使它信任 undercloud 的 SSL 端点提供的加密。如需关于如何包含环境文件的更多信息,请参阅 第 6.12 节 “在 overcloud 部署中包括环境文件”。

6.10. 部署命令

创建 OpenStack 环境的最后一个环节是运行 openstack overcloud deploy 命令进行创建。在运行此命令前,您应当已经熟悉关键的选项,以及如何纳入自定义的环境文件。

不要以后台进程的形式运行 openstack overcloud deploy,因为这可能会造成在 overcloud 的创建过程中出现进程无法继续的问题。

6.11. 部署命令选项

下表列出了 openstack overcloud deploy 命令的额外参数。

表 6.1. 部署命令选项

| 参数 | 描述 |

|---|---|

|

|

包括在部署过程中使用的 Heat 模板的目录。如果为空,命令会使用位于 |

|

|

创建或更新的栈的名称 |

|

|

部署超时时间(分钟) |

|

|

hypervisor 使用的虚拟类型 |

|

|

网络时间协议 (NTP) 服务器用于同步时间。您也可以在逗号分隔列表中指定多个 NTP 服务器,例如: |

|

|

为环境变量 no_proxy 指定自定义值。这个环境变量被用来在代理通讯中排除特定的主机名。 |

|

|

定义访问 overcloud 节点的 SSH 用户。SSH 访问通常使用 |

|

|

传递给 overcloud 部署的额外环境文件。此参数可以指定多次。请注意,传递到 |

|

|

需要在部署中包括的环境文件所在的目录。这个命令会使用数字顺序而不是字母顺序处理这些环境文件。 |

|

|

overcloud 在创建过程中会执行一组部署前检查。如果部署前检查出现任何非严重错误,则此选项会退出创建。我们推荐使用此选项,因为任何错误都有可能造成部署失败。 |

|

|

overcloud 在创建过程中会执行一组部署前检查。如果部署前检查出现任何非关键警告,则此选项会退出创建。 |

|

|

对 overcloud 进行验证检查,但不实际创建 overcloud。 |

|

|

跳过 overcloud 部署后配置。 |

|

|

强制进行 overcloud 部署后配置。 |

|

|

跳过生成 |

|

|

到带有选项和参数的 YAML 文件的路径。 |

|

|

把 overcloud 节点注册到客户门户或 Satellite 6。 |

|

|

overcloud 节点的注册方法。 |

|

|

用于注册的组织。 |

|

|

强制注册系统(即使已经注册过)。 |

|

|

注册 overcloud 节点的 Satellite 服务器的基本 URL。此参数需要使用 Satellite 的 HTTP URL 而不是 HTTPS URL。例如,http://satellite.example.com,而不是 https://satellite.example.com。overcloud 的创建过程会使用此 URL 来确定服务器是 Red Hat Satellite 5 还是 Red Hat Satellite 6 服务器。如果是 Red Hat Satellite 6 服务器,overcloud 会获取 |

|

|

用于注册的激活码。 |

运行以下命令获得选项的完整列表:

(undercloud) $ openstack help overcloud deploy

某些命令行参数已过时或已弃用,它们的功能可以通过环境文件的 parameter_defaults 部分中所包含的 Heat 模板参数实现。下表将已弃用的参数与 Heat 模板中的等效参数对应了起来。

表 6.2. 将被弃用的 CLI 参数映射到 Heat 模板参数

| 参数 | 描述 | Heat 模板参数 |

|---|---|---|

|

|

扩展的 Controller 节点数量 |

|

|

|

扩展的 Compute 节点数量 |

|

|

|

扩展的 Ceph 节点数量 |

|

|

|

扩展的 Cinder 节点数量 |

|

|

|

扩展的 Swift 节点数量 |

|

|

|

Controller 节点使用的 flavor |

|

|

|

Compute 节点使用的 flavor |

|

|

|

Ceph 节点使用的 flavor |

|

|

|

Cinder 节点使用的 flavor |

|

|

|

Swift 存储节点使用的 flavor |

|

|

|

定义在 neutron 插件中配置的平面网络。默认是 "datacentre",允许外部网络创建 |

|

|

|

在每个虚拟机管理器上创建的 Open vSwitch 网桥。默认值是 "br-ex",一般情况下不需要修改它 |

|

|

|

要使用的逻辑网络到物理网桥的映射。默认情况是把主机上的外部网桥(br-ex)映射到一个物理名(datacentre)。您可以使用它作为默认的浮动网络 |

|

|

|

定义网络节点的 br-ex 中的网桥接口 |

|

|

|

neutron 的租户网络类型 |

|

|

|

Neutron 租户网络的隧道类型。使用逗号分隔的字符串可以指定多个值 |

|

|

|

可以用来进行租户网络分配的 GRE 隧道 ID 的范围 |

|

|

|

可以用来进行租户网络分配的 VXLAN VNI ID 范围 |

|

|

|

支持的 Neutron ML2 和 Open vSwitch VLAN 映射范围。默认是在 datacentre 物理网络中允许任何 VLAN |

|

|

|

neutron 租户网络的机制驱动。默认值是 "openvswitch"。使用逗号分隔的字符串可以指定多个值 |

|

|

|

禁用隧道功能以在 Neutron 中使用 VLAN 分段网络或平面网络 |

无参数映射。 |

|

|

overcloud 在创建过程中会执行一组部署前检查。在使用这个选项时,如果部署前检查出现任何严重错误,则会退出创建。我们推荐使用此选项,因为任何错误都有可能造成部署失败。 |

未进行参数映射 |

这些参数计划从未来的 Red Hat OpenStack Platform 版本中移除。

6.12. 在 overcloud 部署中包括环境文件

使用 -e 来包含用于自定义 overcloud 的环境文件。您可以根据需要包含多个环境文件。但是,环境文件的顺序非常重要,后续环境文件中定义的参数和资源会覆盖前面环境文件中定义的相同参数和资源。下表是环境文件顺序的一个示例:

- 每个角色及其类型的节点数量。包含此信息对于创建 overcloud 至关重要。

- 容器化 OpenStack 服务的容器镜像位置。

-

任何网络隔离文件,首先是 heat 模板集合中的初始化文件 (

environments/network-isolation.yaml),然后是您自定义的 NIC 配置文件,最后是任何额外的网络配置。 - 任何外部的负载平衡环境文件。

- 任何存储环境文件,如 Ceph Storage、NFS、iSCSI 等。

- 任何用于红帽 CDN 或 Satellite 注册的环境文件。

- 任何其它自定义环境文件。

使用 -e 选项添加的所有环境文件都会成为 overcloud 栈定义的一部分。

下例中的命令演示如何使用此场景中早前定义的环境文件来启动 overcloud 创建过程:

(undercloud) $ openstack overcloud deploy --templates \ -e /home/stack/templates/node-info.yaml\ -e /home/stack/templates/overcloud_images.yaml \ -e /home/stack/inject-trust-anchor-hiera.yaml -r /home/stack/templates/roles_data.yaml \

这个命令包括以下的额外选项:

- --templates

-

以

/usr/share/openstack-tripleo-heat-templates中的 Heat 模板集合为基础来创建 overcloud - -e /home/stack/templates/node-info.yaml

- 添加环境文件以定义每种角色有多少个节点以及使用哪些类型。

- -e /home/stack/templates/overcloud_images.yaml

- 添加包含容器镜像源的环境文件。

- -e /home/stack/inject-trust-anchor-hiera.yaml

- 添加用于在 undercloud 中安装自定义证书的环境文件。

- -r /home/stack/templates/roles_data.yaml

- (可选)如果使用自定义角色或启用多架构云,这是生成的角色数据。如需更多信息,请参阅 第 6.6 节 “创建特定于架构的角色”。

director 需要这些环境文件来进行重新部署并使用部署后的功能(请参阅 第 9 章 创建 overcloud 后执行的任务)。没有正确包含这些文件可能会破坏您的 overcloud。

如果计划在以后修改 overcloud 配置,您应该:

- 修改定制环境文件和 Heat 模板中的参数

-

使用相同的环境文件再次运行

openstack overcloud deploy命令

不要直接编辑 overcloud 的配置,因为在使用 director 对 overcloud 栈进行更新时,这种手动配置会被 director 的配置覆盖。

6.13. 在部署前验证 overcloud 配置

在执行 overcloud 部署操作前,先验证您的 Heat 模板和环境文件,确认是否存在任何错误。

步骤

overcloud 的 Heat 核心模板采用 Jinja2 格式。要验证您的模板,请使用以下命令呈现未采用 Jinja2 格式的版本:

$ cd /usr/share/openstack-tripleo-heat-templates $ ./tools/process-templates.py -o ~/overcloud-validation

使用下列命令来验证模板语法:

(undercloud) $ openstack orchestration template validate --show-nested \ --template ~/overcloud-validation/overcloud.yaml -e ~/overcloud-validation/overcloud-resource-registry-puppet.yaml \ -e [ENVIRONMENT FILE] \ -e [ENVIRONMENT FILE]

验证过程需要

overcloud-resource-registry-puppet.yaml环境文件包括针对于 overcloud 的资源。使用-e选项为这个命令添加其他额外的环境文件。此外,还需包含--show-nested选项,以解析来自嵌套模板的参数。- 此命令可以识别模板中的任何语法错误。如果模板语法验证成功,输出会显示生成的 overcloud 模板的预览。

6.14. Overcloud 部署输出

一旦 overcloud 创建完毕,director 会提供为配置 overcloud 而执行的 Ansible play 的总结:

PLAY RECAP ************************************************************* overcloud-compute-0 : ok=160 changed=67 unreachable=0 failed=0 overcloud-controller-0 : ok=210 changed=93 unreachable=0 failed=0 undercloud : ok=10 changed=7 unreachable=0 failed=0 Tuesday 15 October 2018 18:30:57 +1000 (0:00:00.107) 1:06:37.514 ****** ========================================================================

director 还会提供用于访问 overcloud 的详细信息。

Ansible passed. Overcloud configuration completed. Overcloud Endpoint: http://192.168.24.113:5000 Overcloud Horizon Dashboard URL: http://192.168.24.113:80/dashboard Overcloud rc file: /home/stack/overcloudrc Overcloud Deployed

6.15. 访问 overcloud

director 会生成脚本来配置和帮助认证 director 主机与 overcloud 的交互。director 将此文件保存为 stack 用户主目录的 overcloudrc 文件。运行以下命令来使用此文件:

(undercloud) $ source ~/overcloudrc

这会加载所需的环境变量,以便通过 director 主机的 CLI 与 overcloud 进行交互。命令提示符的变化会显示当前状态:

(overcloud) $

要返回与 director 主机进行交互的状态,运行以下命令:

(overcloud) $ source ~/stackrc (undercloud) $

overcloud 中的每个节点还会包括一个名为 heat-admin 的用户。stack 用户有到每个节点上的此用户的 SSH 访问权限。要通过 SSH 访问某一节点,可查找相关节点的 IP 地址:

(undercloud) $ openstack server list

使用 heat-admin 用户和节点的 IP 地址连接到节点:

(undercloud) $ ssh heat-admin@192.168.24.23

6.16. 后续步骤

使用命令行工具创建 overcloud 的步骤到此结束。有关创建后的功能,请参阅第 9 章 创建 overcloud 后执行的任务。

第 7 章 使用 Web UI 配置基本 overcloud

本章介绍了使用 Web UI 配置 OpenStack 平台环境的基本步骤。overcloud 基本配置中不含任何自定义功能。但是,您可以按照 Advanced Overcloud Customization 指南中的说明,向这类基本 overcloud 添加高级配置选项,并按照您的具体规格进行自定义。

在本章所用的示例中,所有节点都是使用 IPMI 来进行电源管理的裸机系统。如需了解其他的受支持电源管理类型和它们的选项,请参阅附录 B, 电源管理驱动。

流程

- 使用一个节点定义模板手动注册空节点。

- 检查所有节点的硬件。

- 把一个 overcloud 计划上传到 director。

- 将节点分配到角色。

要求

- 第 4 章 安装 director 中创建的并已启用 UI 的 director 节点

- 一组作为节点的裸机。所需的节点数量由您需要创建的 overcloud 类型所决定。这些计算机也必须满足每种节点类型对系统的要求。这些节点不需要操作系统,director 会把 Red Hat Enterprise Linux 7 镜像复制到每个节点。

- Provisioning 网络的一个网络连接,需配置为原生 VLAN。所有节点都必须连接此网络。

- 所有其他网络类型使用 Provisioning 网络来提供 OpenStack 服务。不过,您可以为其他网络流量类型创建额外的网络。

UI 工作流不支持多架构云。请参阅 第 6 章 使用 CLI 工具配置基本的 overcloud 中的说明

7.1. 访问 Web UI

用户可以使用 undercloud.conf 文件中的 undercloud_public_host 参数所指定的 IP 地址来通过 SSL 访问 director 的 web UI。例如, undercloud 的公共 IP 地址为 192.168.24.2,则可以通过 https://192.168.24.2 来访问 UI。

web UI 会首先显示带有以下字段的登录界面:

-

Username - director 的管理员用户。默认值为

admin。 -

Password - 管理员用户的密码。在 undercloud 主机终端中以

stack用户身份运行sudo hiera admin_password命令,可查找此密码。

登录 UI 后,UI 将访问 OpenStack Identity Public API 并获取其他 Public API 服务的端点。这些服务包括:

| 组件 | UI 用途 |

|---|---|

|

OpenStack Identity( |

用于进行 UI 认证和其他服务的端点发现。 |

|

OpenStack Orchestration( |

查看部署的状态。 |

|

OpenStack Bare Metal( |

用于控制节点。 |

|

OpenStack Object Storage( |

用于存储供 overcloud 创建使用的 Heat 模板集合或计划。 |

|

OpenStack Workflow( |

访问和执行 director 任务。 |

|

OpenStack Messaging( |

基于 Websocket 的服务,可用于查找特定任务的状态。 |

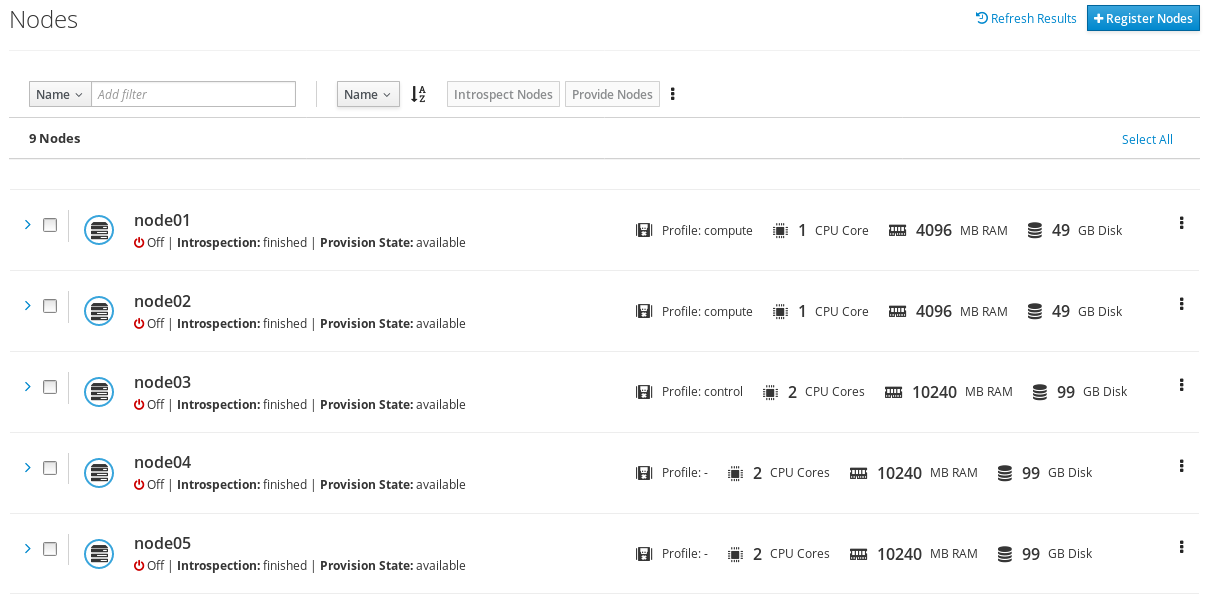

7.2. 浏览 Web UI

UI 包含三大区域:

- Plan

位于 UI 顶部的菜单项。此页面充当主 UI 区域,您可以在其中定义 overcloud 创建计划、分配至各个角色的节点和当前 overcloud 的状态。此区域也提供一个部署工作流,逐步引导您完成 overcloud 创建过程的每个步骤,如设置部署参数和分配节点到角色等。

- Nodes

位于 UI 顶部的菜单项。此页面充当节点配置区域,提供用于注册新节点和内省已注册节点的各种方式。此区域还显示电源状态、内省状态、置备状态和硬件信息等信息。

单击每个节点右侧的溢出菜单项(三个点)可显示所选节点的磁盘信息。

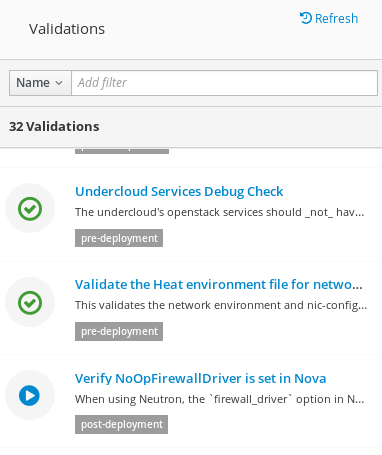

- Validations

单击 Validations 菜单项后,页面右侧会显示一个面板。

这个部分提供了一组适用于下列情况的系统检查:

- 部署前

- 部署后

- 内省前

- 升级前

- 升级后

这些验证任务在部署期间的特定时点上自动运行,但您也可以手动运行。若要运行某项验证任务,可单击对应的 Play 按钮。单击各项验证任务的标题可运行该任务,或单击验证标题查看更多相关信息。

7.3. 在 Web UI 中导入 overcloud 计划

director UI 需要先加载计划,才能配置 overcloud。此计划通常是一个 Heat 模板集合,比如 undercloud 上的 /usr/share/openstack-tripleo-heat-templates。此外,您也可以根据自己的硬件和环境要求自定义计划。有关自定义 overcloud 的更多信息,请参阅 Advanced Overcloud Customization 指南。

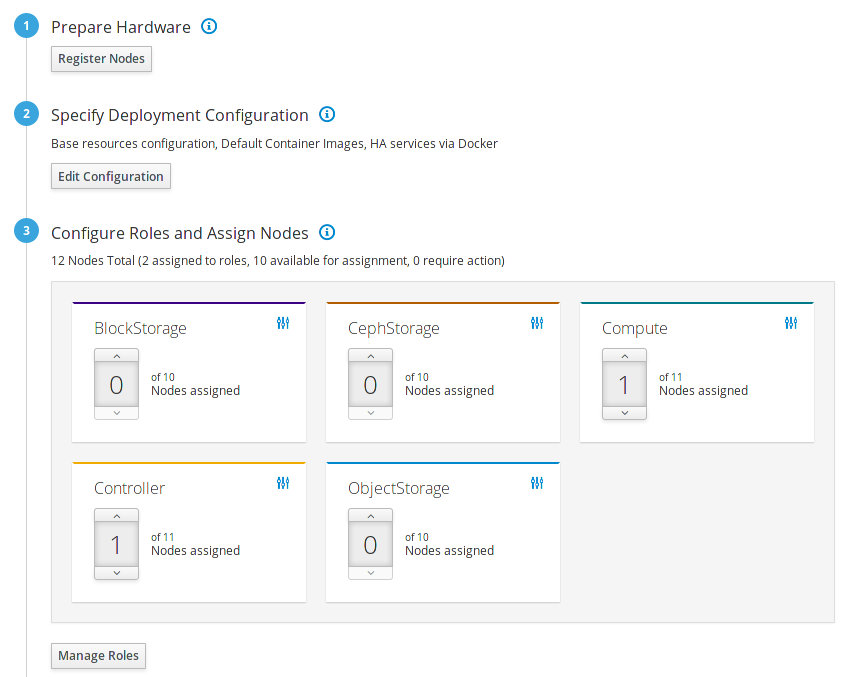

计划中包含配置 overcloud 的四个主要步骤:

- 准备硬件 - 节点注册和内省。

- 指定部署配置 - 配置 overcloud 参数,定义要包含的环境文件。

- 配置角色和分配节点 - 分配节点到角色,修改角色相关参数。

- 配置网络 - 查看 overcloud 的网络拓扑。

- 准备容器镜像 - 为 overcloud 准备及获取容器镜像编辑参数。

- 部署 - 启动 overcloud 创建过程。

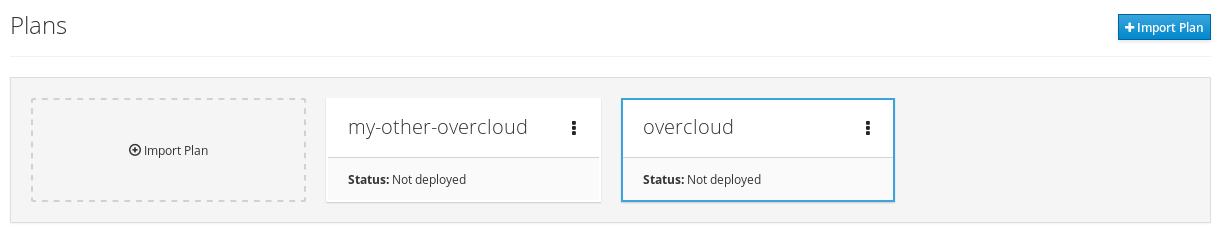

undercloud 安装和配置过程会自动上传计划。您也可以在 Web UI 中导入多个计划。单击 Plan 屏幕上的 All Plans 导航项。这将显示当前 Plans 列表。单击卡片可在多个计划之间切换。

单击 Import Plan 将出现窗口,要求提供以下信息:

-

Plan Name - 计划的纯文本名称。例如,

overcloud。 上传类型 - 选择使用什么方法上传模板:

- 使用默认模板 - 使用默认的 Heat 模板。

- Tar 归档 (tar.gz) - 使用包括模板的归档文件。

- 本地文件夹 (只适用于 Google Chrome) - 从您的客户端系统的一个本地文件夹中上传。

- Git 仓库 URL - 使用公共 Git 仓库的 URL。

- Plan Files - 单击浏览按钮来选择本地文件系统中的计划。

如果需要复制 director 的 Heat 模板集到客户端机器,可以存档文件并复制它们:

$ cd /usr/share/openstack-tripleo-heat-templates/ $ tar -cf ~/overcloud.tar * $ scp ~/overcloud.tar user@10.0.0.55:~/.

一旦 director UI 上传了计划,该计划就会显示在 Plans 列表中,此时您可以进行配置。只需单击您要选择的计划卡片即可。

7.4. 在 Web UI 中注册节点

配置 overcloud 节点的第一步是注册您的节点。您可以通过以下方式之一来开始注册节点:

- 单击 Plan 屏幕上 1 Prepare Hardware 下面的 Register Nodes。

- 单击 Nodes 屏幕上的 Register Nodes。

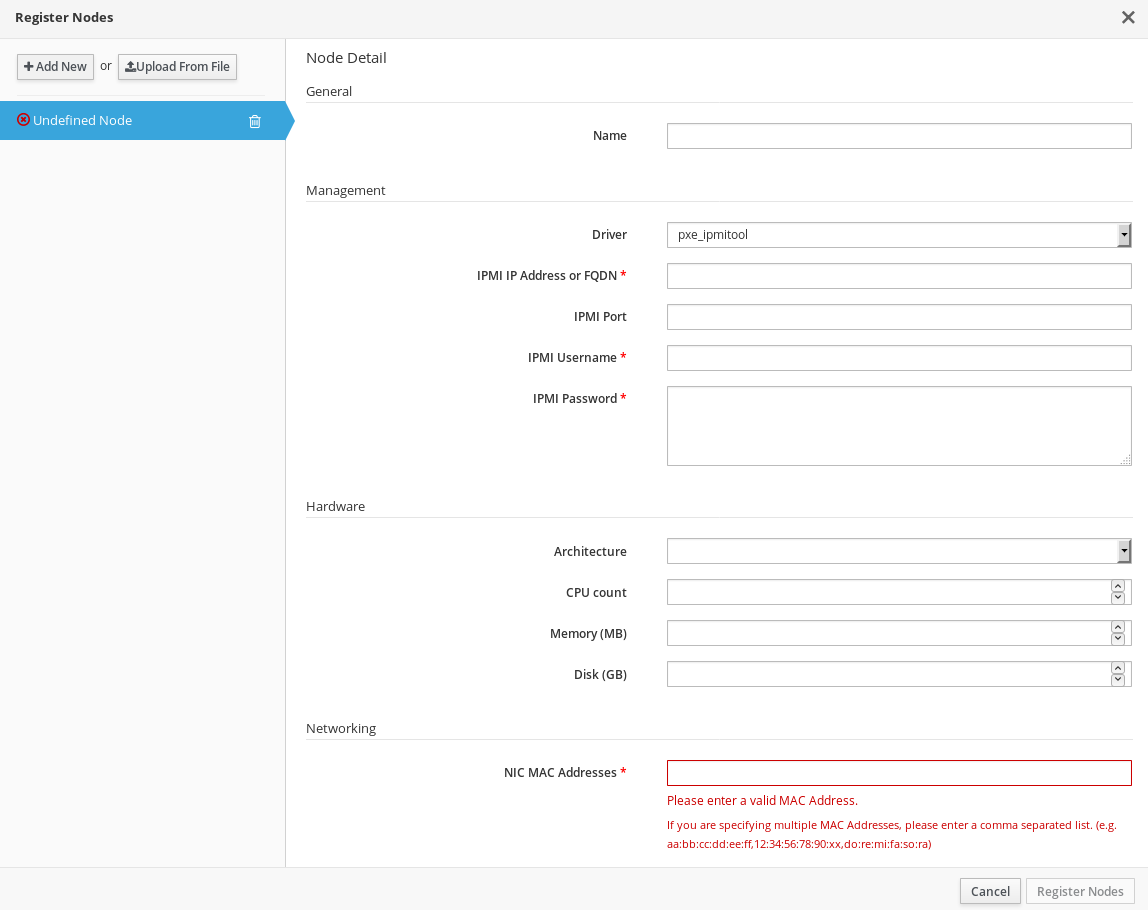

这将显示 Register Nodes 窗口。

Director 需要一份要注册的节点列表,您可以通过以下两种方式之一来提供:

- 上传节点定义模板 - 单击 Upload from File 按钮,然后选择一个文件。如需节点定义模板的语法,请参阅第 6.1 节 “为 overcloud 注册节点”。

- 手动注册各个节点 - 单击 Add New,然后提供节点的一系列详细信息。

如下为手动注册时要提供的详细信息:

- 名称

- 节点的纯文本名称。仅可使用 RFC3986 非保留字符。

- Driver

-

要使用的电源管理驱动程序。本例中使用 IPMI 驱动程序 (

ipmi),但也有其他驱动程序可用。如需可用的驱动程序,请参阅 附录 B, 电源管理驱动。 - IPMI IP 地址

- IPMI 设备的 IP 地址。

- IPMI Port

- 用于访问 IPMI 设备的端口。

- IPMI Username; IPMI Password

- IPMI 的用户名和密码。

- Architecture

- 系统架构。(可选)

- CPU count

- 节点上的 CPU 数量。(可选)

- Memory (MB)

- 以 MB 为单位的内存大小。(可选)

- Disk (GB)

- 以 GB 为单位的硬盘的大小。(可选)

- NIC MAC Addresses

- 节点上的网络接口的 MAC 地址列表。对于每个系统的 Provisioning NIC,只使用 MAC 地址。

UI 也允许注册使用 Dell Remote Access Controller (DRAC) 电源管理的节点。这些节点使用 pxe_drac 驱动。如需更多信息,请参阅 第 B.2 节 “Dell Remote Access Controller (DRAC)”。

在输入节点信息后,请单击窗口底部的 Register Nodes。

Director 将注册节点。完成时,您可以使用 UI 来执行节点内省。

7.5. 在 Web UI 中检查节点硬件

director 可以在每个节点上运行内省过程。此过程会使每个节点通过 PXE 引导一个内省代理。此代理从节点上收集硬件数据,并把信息发送回 director,director 把这些信息存储到运行于 director 上的 OpenStack Object Storage(swift)服务中。director 将这些硬件信息用于不同的目的,如进行配置文件标记、基准测试和手动分配根磁盘等。

您也可以通过创建策略文件,在内省后立即将节点标记到配置文件中。如需有关创建策略文件并将它们纳入到内省过程中的信息,请参阅附录 E, 自动配置集标记。另外,您还可以通过 UI 将节点标记到配置文件中。如需关于手动标记节点的详细信息,请参阅第 7.9 节 “在 Web UI 中将节点分配给角色”。

若要启动内省过程:

- 前往 Nodes 屏幕。

- 选择您想要内省的所有节点。

- 单击 Introspect Nodes。

确保这个过程成功完成。它可能需要 15 分钟来检查这些裸机节点。

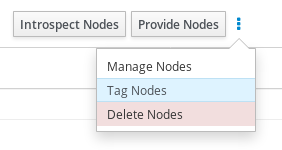

内省过程完成时,选择 Provision State 为 manageable 的所有节点,然后单击 Provide Nodes 按钮。等待 Provision State 更改为 available。

节点现在已做好标记和部署准备。

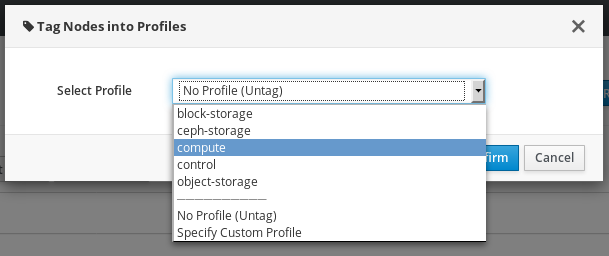

7.6. 在 Web UI 中将节点标记到配置文件

您可以为每个节点分配一组配置集。每个配置集分别对应相关的类型和角色(如需更多信息,请参阅 第 6.3 节 “为节点添加标签以加入到配置集”>)。

Nodes 屏幕包含其他菜单切换,可提供额外的节点管理操作,比如 Tag Nodes。

标记一组节点:

- 使用复选框选择要标记的节点。

- 单击菜单切换。

- 单击 Tag Nodes。

选择现有的配置文件。要创建新的配置文件,选择 Specify Custom Profile 并在 Custom Profile 中输入名称。

注意

注意如果要创建自定义配置集,还必须将该配置集标记分配为一种新类型。如需了解更多有关创建新类型的信息,请参阅 第 6.3 节 “为节点添加标签以加入到配置集”。

- 单击 Confirm 标记节点。

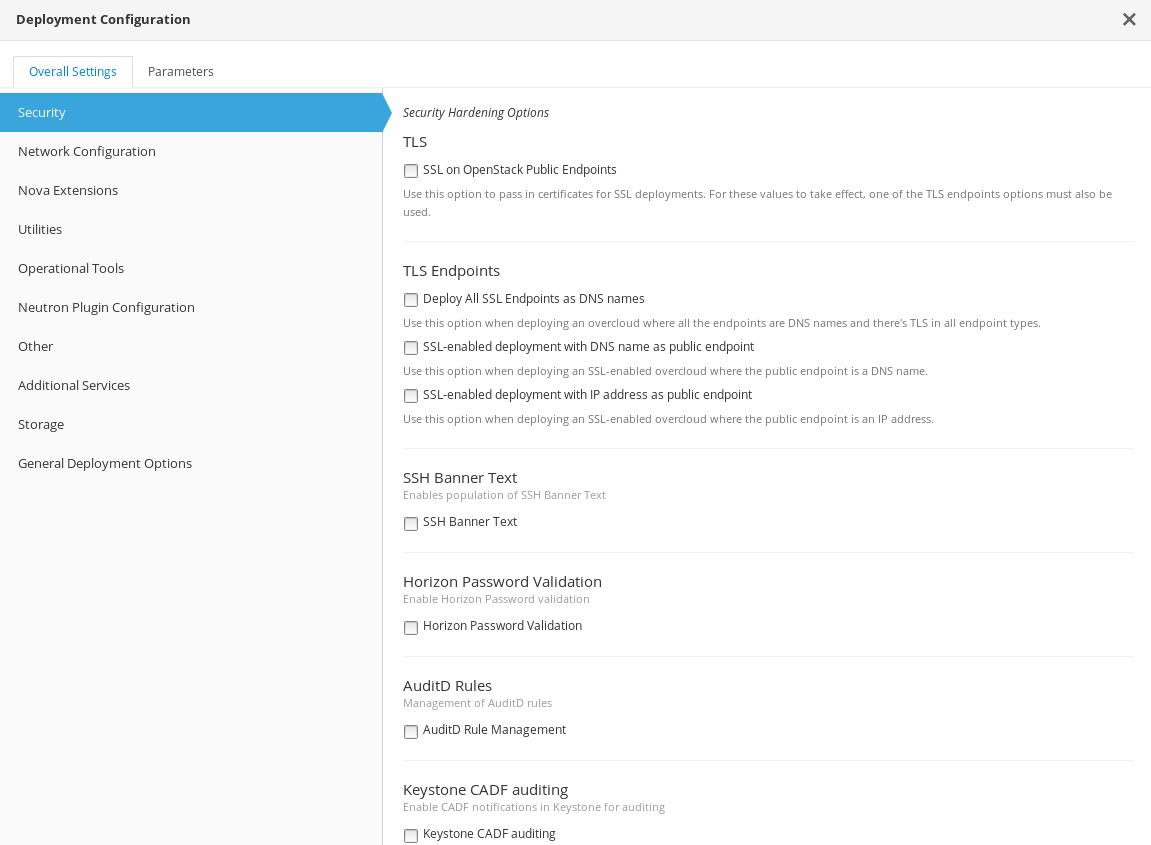

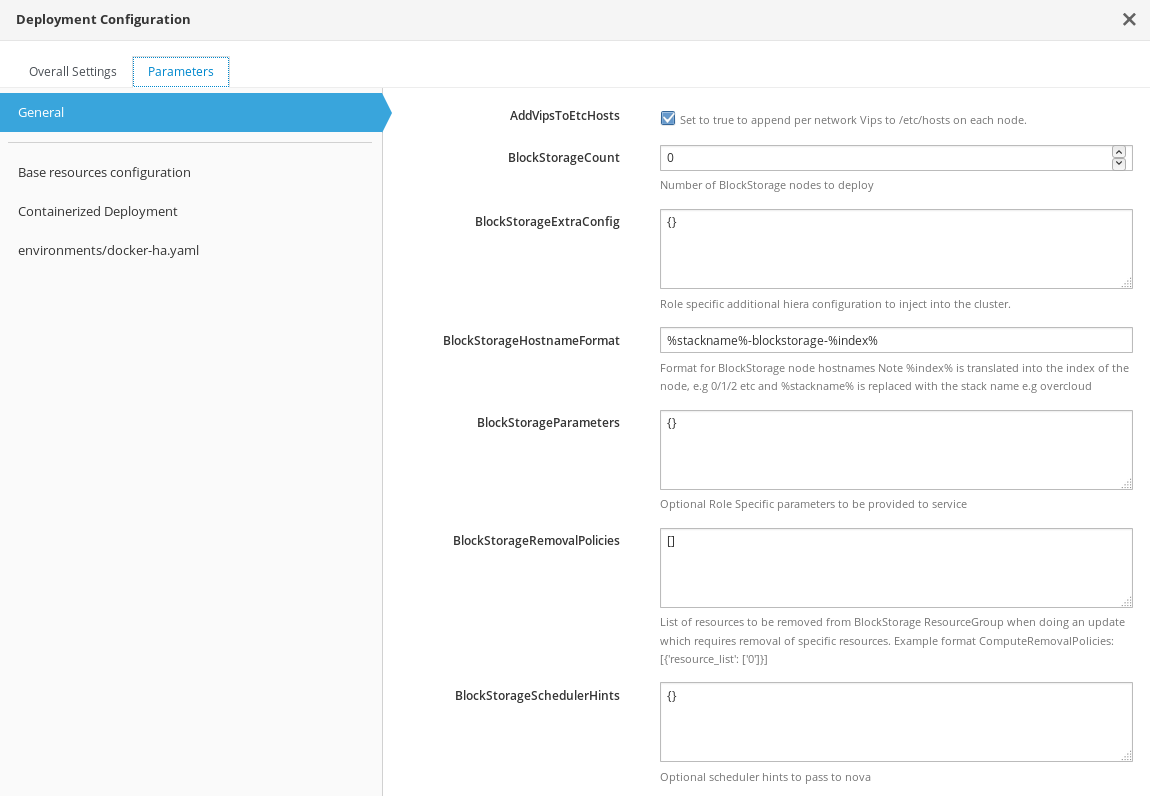

7.7. 在 Web UI 中编辑 overcloud 计划参数

Plan 屏幕中提供了一种方式,供您自定义上传的计划。在 2 Specify Deployment Configuration 下,单击 Edit Configuration 链接,修改您的基本 overcloud 配置。

这时将出现一个窗口,其包含两个主要选项卡:

- Overall Settings

此选项卡提供了纳入 overcloud 中不同功能的方式。这些功能在计划的

capabilities-map.yaml文件中定义,每项功能各自使用一个不同的环境文件。例如,在 Storage 下,您可以选择 Storage Environment,其计划映射到environments/storage-environment.yaml文件,允许您配置 overcloud 的 NFS、iSCSI 或 Ceph 设置。Other 选项卡包含在计划中检测到但未在capabilities-map.yaml中列出的环境文件,对于添加计划中包含的自定义环境文件,这非常有用。一旦选定要纳入的功能,请单击 Save。

- Parameters

这包括 overcloud 的各种基本参数和环境文件参数。参数修改完毕后,请单击 Save。

7.8. 在 Web UI 中添加角色

3 Configure Roles and Assign Nodes 部分的右下角是 Manage Roles 图标。

单击该图标后,会显示一组卡片,它们分别代表着可添加到环境中的各种角色。要添加某个角色,请选中该角色右上角的复选框。

选好角色后,请单击 Save Changes。

7.9. 在 Web UI 中将节点分配给角色

注册并检查了每个节点的硬件之后,将它们分配给计划中的角色。

要将节点分配到角色,请滚动到 Plan 屏幕上的 3 Configure Roles and Assign Nodes 区域。每个角色都使用旋转器小工具将一定数量的节点分配给该角色。各角色可用的节点取决于在 第 7.6 节 “在 Web UI 中将节点标记到配置文件” 中标记过的节点。

这会改变每个角色的 *Count 参数。例如,如果将 Controller 角色的节点数量更改为 3,会将 ControllerCount 参数设置为 3。您也可以在部署配置的 Parameters 选项卡中查看并编辑这些计数值。如需更多信息,请参阅 第 7.7 节 “在 Web UI 中编辑 overcloud 计划参数”。

7.10. 在 Web UI 中编辑角色参数

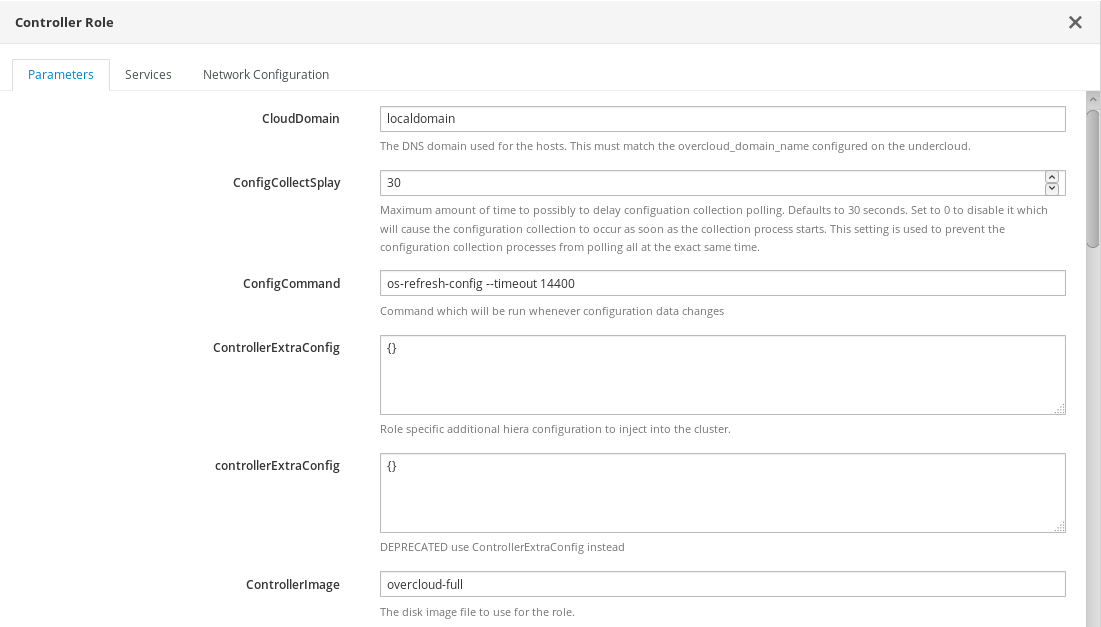

每个节点角色都会提供配置角色相关参数的方法。请滚动到 Plan 屏幕上的 3 Configure Roles and Assign Nodes 角色。单击角色名称旁边的 Edit Role Parameters 图标。

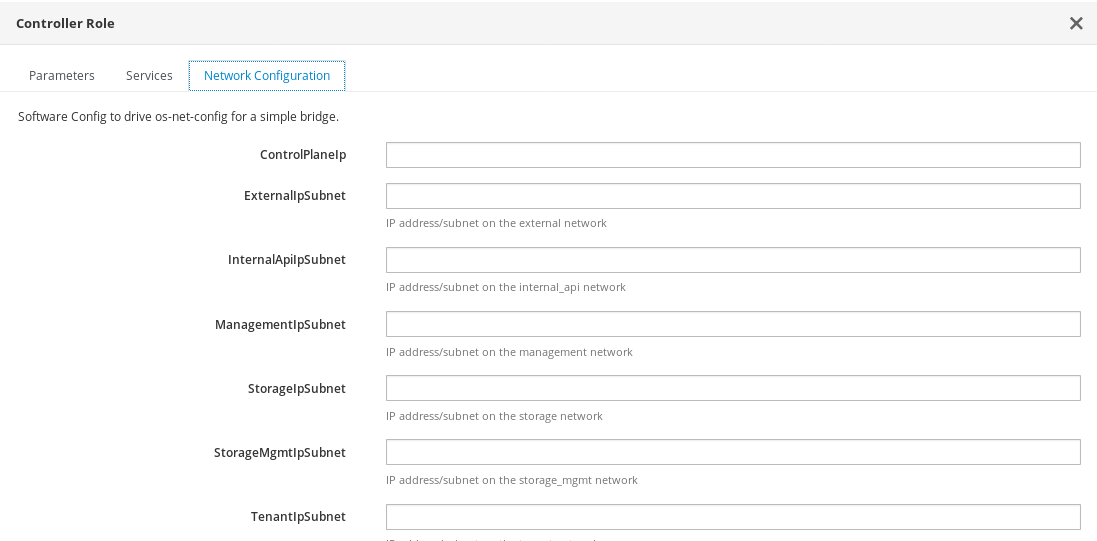

![]()

此时将出现一个窗口,其中显示了两个主要选项卡:

- Parameters

此选项卡中含有各种角色相关的参数。例如,如果您在编辑控制器节点,可以使用

overcloudControlFlavor参数更改角色的默认类型。修改了角色相关参数后,请单击 Save Changes。

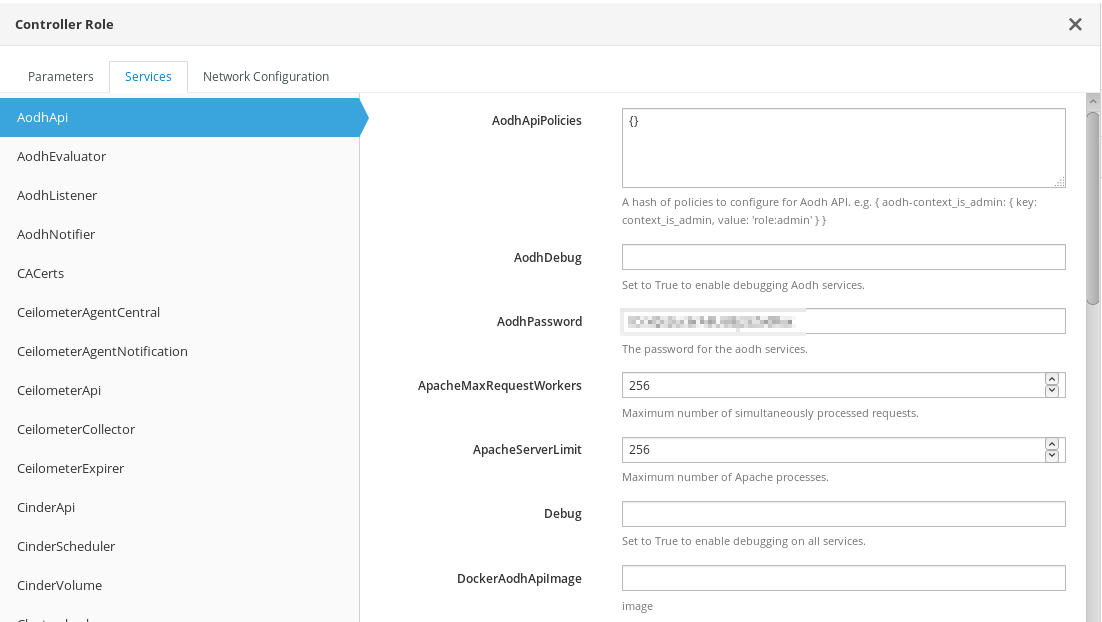

- Services

此选项卡可定义所选角色的服务相关参数。左侧面板中显示您可选择并修改的服务列表。例如,若要更改时区,可单击

OS::TripleO:Services:Timezone服务,然后根据您想要的时区更改TimeZone参数。修改了服务相关参数后,请单击 Save Changes。

- Network Configuration

此选项卡可用于定义 overcloud 中各种网络的 IP 地址或子网范围。

尽管角色的服务参数显示在 UI 中,但一部分服务可能默认为禁用状态。您可以按照第 7.7 节 “在 Web UI 中编辑 overcloud 计划参数”中的说明启用这些服务。也可参阅 Advanced Overcloud Customization 指南的 Composable Roles 部分,以了解有关启用这些服务的信息。

7.11. 在 Web UI 中查看网络拓扑

先决条件

确保您在部署配置的第二步中启用了 Network Isolation。

步骤

在部署前确认网络配置:

- 在 Plan 页面中,滚动到 4 Configure Network。

- 单击 Edit Role。这会显示网络拓扑,您可以确认其配置。

7.12. 在 web UI 中准备容器镜像

使用以下步骤为 overcloud 准备容器镜像。

步骤

- 在 Plan 页面中,滚动到 5 Prepare Container Image。

- 点 Edit Configuration。这会显示一个带有容器镜像详情的窗口。

编辑容器镜像详情:

- Registry Namespace - 每个 OpenStack 服务镜像的命名空间。

- Name Prefix - 每个 OpenStack 服务镜像的前缀。

- Name Suffix - 每个 OpenStack 服务镜像的后缀。

-

Tag - director 用来识别从源注册表中拉取镜像的标签(tag)。这个项通常会被设置为

latest。 - Push Destination - 在上传过程中把镜像推送到的注册表的命名空间。当为这个参数指定了一个命名空间后,所有镜像参数也会使用这个命名空间。这可以是 undercloud 注册表,也可以是一个自定义的外部注册表。如果不需要上传而直接从 Red Hat Container Catalog 拉取镜像,则选择 Don’t push images 来直接拉取镜像。请注意,这样设置可能会在您的外部路由上造成阻塞,因为每个 overcloud 节点都需要从 Red Hat Container Catalog 拉取容器镜像。

-

Tag from Label - 定义要标记生成的镜像的标签特征。通常设为

\{version}-\{release}。

- 编辑完这些设置后,点 Next。

- 检查您的 overcloud 容器镜像设置并点 Save Changes。

7.13. 在 Web UI 中启动 overcloud 创建过程

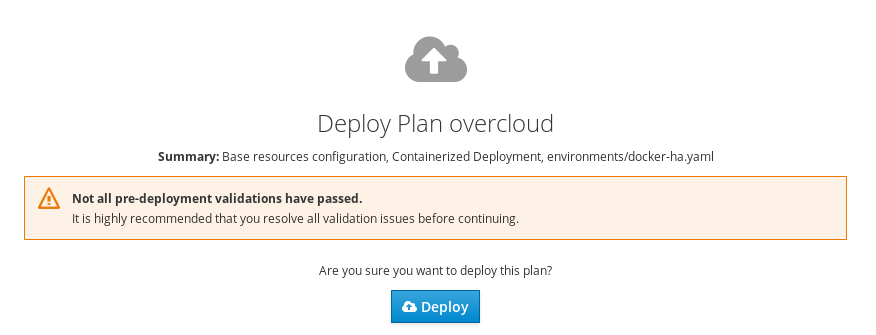

配置了 overcloud 计划后,您可以开始部署 overcloud。具体操作包括滚动到 6 Deploy 区域,并单击 Validate and Deploy。

如果没有运行 undercloud 验证或未通过验证,屏幕中会显示警告消息。请确保您的 undercloud 主机满足相关的要求,然后再进行部署。

准备好部署时,请单击 Deploy。

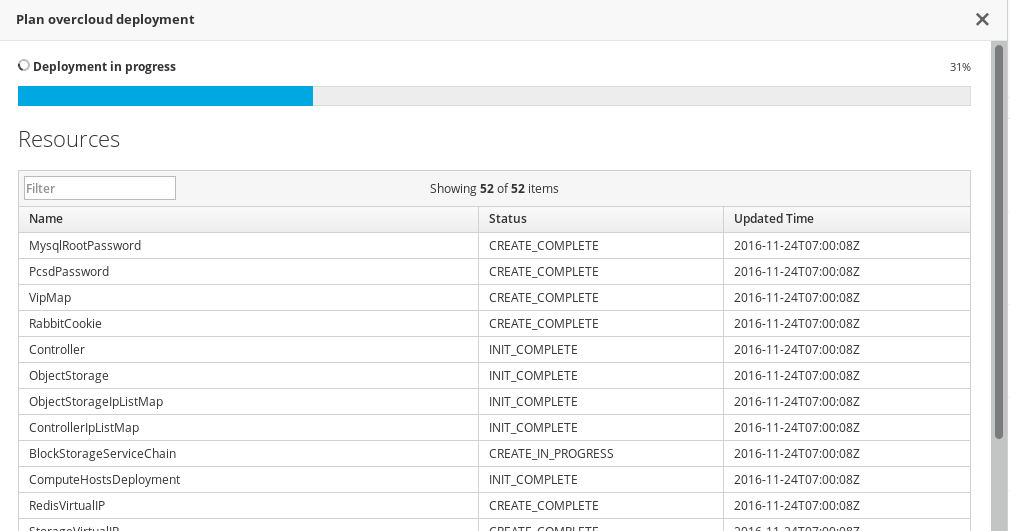

UI 会定期监控 overcloud 的创建进度,并通过进度条来指示当前的进度百分比。单击View detailed information 链接,可显示 overcloud 中当前 OpenStack Orchestration 栈的日志。

等待 overcloud 部署完成。

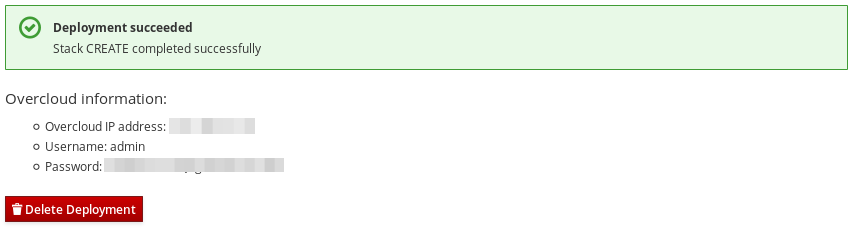

在 overcloud 创建过程完成后,4 Deploy 区域显示当前的 overcloud 状态和以下详细信息:

- IP address - 用于访问 overcloud 的 IP 地址。

-

Password - ondercloud 上 OpenStack

admin用户的密码。

使用以上信息来访问您的 overcloud。

7.14. 完成 overcloud 的创建

通过 director UI 创建 overcloud 的步骤到此结束。如需了解创建后功能,请参阅第 9 章 创建 overcloud 后执行的任务。

第 8 章 使用预置备节点配置基本 overcloud

本章介绍了使用预置备节点来配置 OpenStack 平台环境的基本步骤。这种配置情境与标准的 overcloud 创建场景之间存在多项差异:

- 您可以使用外部工具配置节点,让 director 仅控制 overcloud 的配置。

- 您无需依赖 director 的配置方法,可直接使用节点。在不实施电源管理控制的情况下创建 overcloud,或者使用具有 DHCP/PXE 引导限制的网络时,这一点非常有用。

- director 不使用 OpenStack Compute (nova)、OpenStack Bare Metal (ironic) 或者 OpenStack Image (glance) 来管理节点。

-

预置备的节点可以使用不依赖于 QCOW2

overcloud-full镜像的自定义置备布局。

本场景提供的是基本配置,不包含任何自定义功能。但是,您可以按照 Advanced Overcloud Customization 指南中的说明,向这类基本 overcloud 添加高级配置选项,并按照您的具体规格进行自定义。

不支持在 overcloud 中混用预置备节点和 director 配置节点。

要求

- 第 4 章 安装 director中创建的 director 节点。

- 一组作为节点的裸机。所需的节点数量由您需要创建的 overcloud 类型所决定。这些计算机还需要满足每种节点类型的相应要求。这些节点需要安装 Red Hat Enterprise Linux 7.5 或更新的版本,作为其主机操作系统。红帽建议使用最新的可用版本。

- 用于管理预置备节点的一个网络连接。本情境需要具备对节点的不间断 SSH 访问权限以进行编配代理配置。

Control Plane 网络的一个网络连接。这种网络具备两种主要情境:

将 Provisioning 网络用作 Control Plane,这种是默认情境。这种网络通常是预置备节点至 director 的 3 层 (L3) 可路由网络连接。本情境示例使用以下 IP 地址分配:

表 8.1. Provisioning 网络 IP 分配信息

节点名 IP 地址 Director

192.168.24.1

Controller

192.168.24.2

Compute

192.168.24.3

- 使用单独的网络。当 director 的 Provisioning 网络是一种专用的不可路由的网络时,您可以从任何子网定义节点的 IP 地址,通过公共 API 端点与 director 通讯。本情境有一些需要注意的地方,详情请参阅第 8.5 节 “使用单独的 overcloud 节点网络”章节。

- 本示例中的所有其他网络类型使用 Control Plane 网络来提供 OpenStack 服务。不过,您可以为其他网络流量类型创建额外的网络。

8.1. 创建配置节点的用户

在本流程稍后的阶段,director 需要具备以 stack 用户的身份访问 overcloud 节点的 SSH 权限。

在每个 overcloud 节点上,创建名为

stack的用户,并为每个节点设置密码。例如,在 Controller 节点上运行以下命令:[root@controller ~]# useradd stack [root@controller ~]# passwd stack # specify a password

进行以下操作以使这个用户使用

sudo时不需要输入密码:[root@controller ~]# echo "stack ALL=(root) NOPASSWD:ALL" | tee -a /etc/sudoers.d/stack [root@controller ~]# chmod 0440 /etc/sudoers.d/stack

在所有预置备节点上创建和配置

stack用户之后,将stack用户的公共 SSH 密钥从 director 节点复制到每个 overcloud 节点。例如,将 director 的公共 SSH 密钥复制到 Controller 节点:[stack@director ~]$ ssh-copy-id stack@192.168.24.2

8.2. 为节点注册操作系统

每个节点需要具备访问红帽订阅的权限。以下步骤显示了如何将每个节点注册到红帽 Content Delivery Network。对每个节点执行以下操作:

运行注册命令,按照提示输入您的客户门户用户名和密码:

[root@controller ~]# sudo subscription-manager register

找到 Red Hat OpenStack Platform 14 所在的权利池:

[root@controller ~]# sudo subscription-manager list --available --all --matches="Red Hat OpenStack"

使用上一步中找到的池 ID 来添加 Red Hat OpenStack Platform 14 的权利:

[root@controller ~]# sudo subscription-manager attach --pool=pool_id

禁用所有默认软件仓库:

[root@controller ~]# sudo subscription-manager repos --disable=*

启用所需的红帽企业 Linux 软件仓库。

对于 x86_64 系统,请运行: