管理指南

Administering Red Hat OpenShift Dev Spaces 3.3

Robert Kratky

rkratky@redhat.comFabrice Flore-Thébault

ffloreth@redhat.comJana Vrbkova

jvrbkova@redhat.comMax Leonov

mleonov@redhat.comdevtools-docs@redhat.com

摘要

第 1 章 准备安装

要准备 OpenShift Dev Spaces 安装,了解 OpenShift Dev Spaces 生态系统和部署限制:

1.1. 支持的平台

OpenShift Dev Spaces 在以下 CPU 架构的 OpenShift 4.10 和 4.11 上运行:

-

AMD64 和 Intel 64 (

x86_64) -

IBM Power (

ppc64le)和 IBM Z (s390x)

其他资源

1.2. 架构

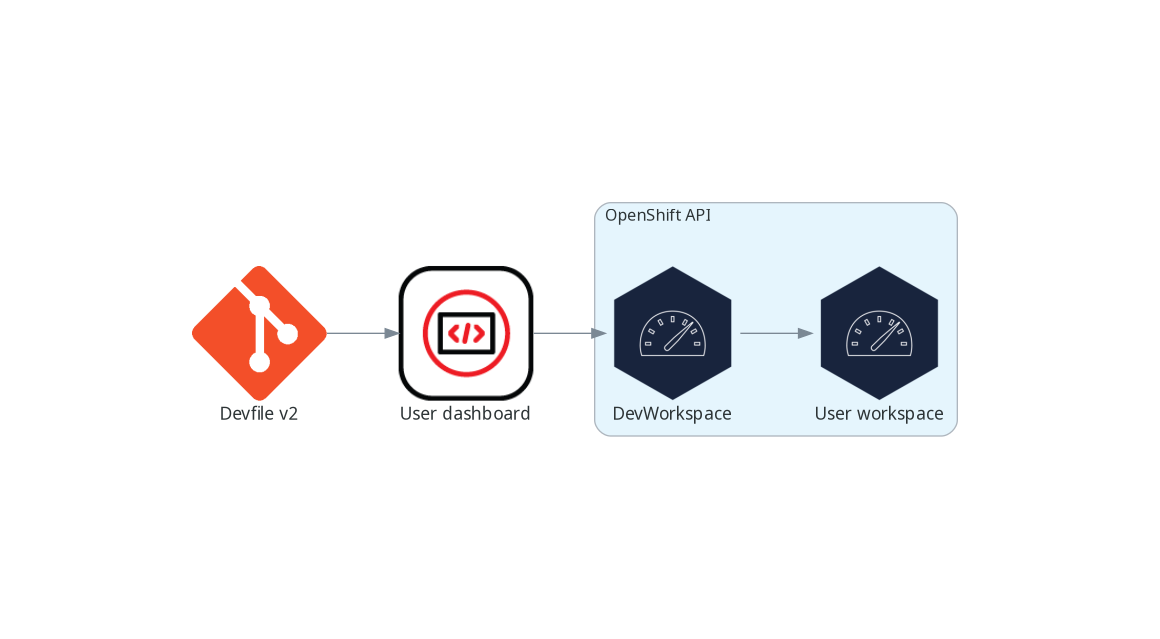

图 1.1. 带有 Dev Workspace operator 的高级别 OpenShift Dev Spaces 架构

OpenShift Dev Spaces 在三个组件组上运行:

- OpenShift Dev Spaces 服务器组件

- 管理用户项目和工作区。主组件是用户仪表板,用户从中控制其工作区。

- dev Workspace operator

-

创建并控制运行用户工作区所需的 OpenShift 对象。包括

Pod、Service和PeristentVolumes。 - 用户工作区

- 基于容器的开发环境,包括 IDE。

这些 OpenShift 功能的角色是中央化的:

- Dev Workspace 自定义资源

- 代表用户工作区以及由 OpenShift Dev Spaces 操作的有效 OpenShift 对象。它是三个组件组的通信通道。

- OpenShift 基于角色的访问控制(RBAC)

- 控制对所有资源的访问。

其他资源

1.2.1. 服务器组件

OpenShift Dev Spaces 服务器组件确保多租户和工作空间管理。

图 1.2. 与 Dev Workspace Operator 交互的 OpenShift Dev Spaces 服务器组件

其他资源

1.2.1.1. Dev Spaces operator

OpenShift Dev Spaces 运算符确保对 OpenShift Dev Spaces 服务器组件的完整生命周期管理。它引进了:

CheCluster自定义资源定义(CRD)-

定义

CheClusterOpenShift 对象。 - OpenShift Dev Spaces 控制器

- 创建和控制必要的 OpenShift 对象,以运行 OpenShift Dev Spaces 实例,如容器集、服务和持久卷。

CheCluster自定义资源(CR)在使用 OpenShift Dev Spaces operator 的集群中,可以创建

CheCluster自定义资源(CR)。OpenShift Dev Spaces operator 确保在这个 OpenShift Dev Spaces 实例中确保对 OpenShift Dev Spaces 服务器组件的完整生命周期管理:

1.2.1.2. dev Workspace operator

Dev Workspace operator 扩展 OpenShift 以提供 Dev Workspace 支持。它引进了:

- dev Workspace 自定义资源定义

- 从 Devfile v2 规范定义 Dev Workspace OpenShift 对象。

- dev Workspace 控制器

- 创建并控制必要的 OpenShift 对象来运行 Dev Workspace,如 pod、服务和持久卷。

- dev Workspace 自定义资源

- 在具有 Dev Workspace operator 的集群上,可以创建 Dev Workspace 自定义资源(CR)。Dev Workspace CR 是 Devfile 的 OpenShift 表示。它在 OpenShift 集群中定义用户工作区。

其他资源

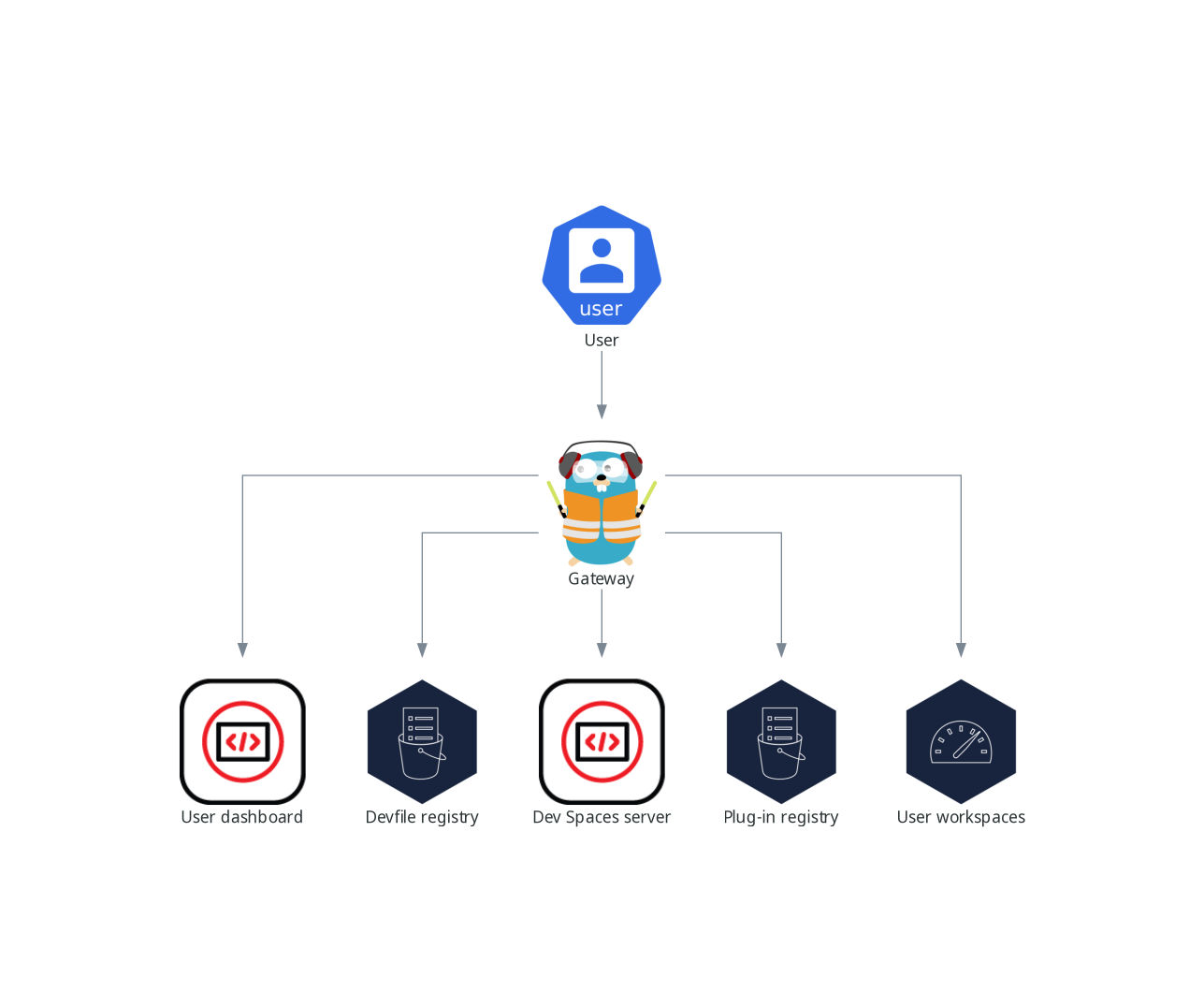

1.2.1.3. gateway

OpenShift Dev Spaces 网关具有以下角色:

- 路由请求.它使用 Traefik。

- 使用 OpenID Connect (OIDC)验证用户。它使用 OpenShift OAuth2 代理。

- 应用基于 OpenShift 基于角色的访问控制(RBAC)策略,以控制对任何 OpenShift Dev Spaces 资源的访问。它使用 'kube-rbac-proxy'。

OpenShift Dev Spaces 操作器将它作为 che-gateway Deployment 进行管理。

它控制对以下内容的访问:

图 1.3. OpenShift Dev Spaces 网关与其他组件交互

其他资源

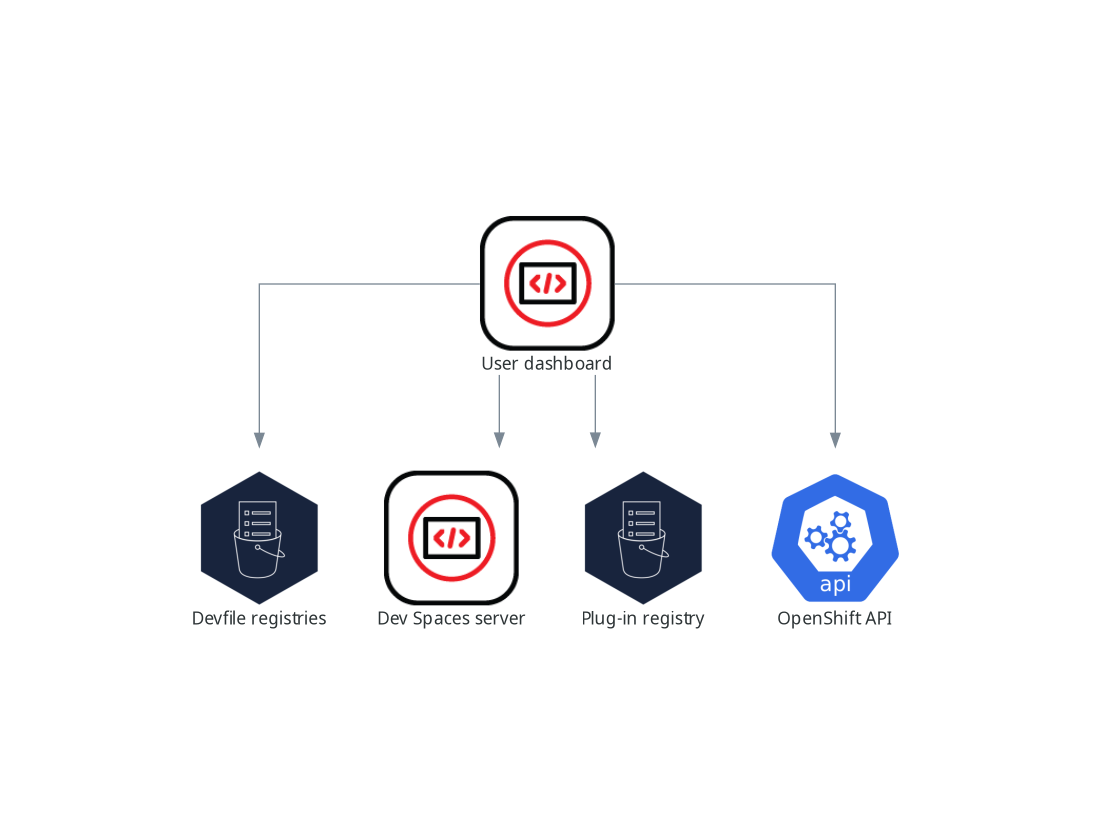

1.2.1.4. 用户仪表板

用户仪表板是 Red Hat OpenShift Dev Spaces 的登录页面。OpenShift Dev Spaces 用户浏览用户仪表板以访问和管理其工作区。它是 React 应用。OpenShift Dev Spaces 部署会在 devspaces-dashboard Deployment 中启动。

它需要访问:

图 1.4. 用户仪表板与其他组件交互

当用户请求用户仪表板以启动工作区时,用户仪表板执行这个操作序列:

- 当用户从代码示例创建工作区时,从 第 1.2.1.5 节 “devfile registry” 收集 devfile。

- 当用户从远程 devfile 创建工作区时,将存储库 URL 发送到 第 1.2.1.6 节 “dev Spaces 服务器” 并期望 devfile 返回。

- 阅读描述工作区的 devfile。

- 从 第 1.2.1.8 节 “插件 registry” 收集附加元数据。

- 将信息转换为 Dev Workspace 自定义资源。

- 使用 OpenShift API 在用户项目中创建 Dev Workspace 自定义资源。

- 监视 Dev Workspace 自定义资源状态。

- 将用户重定向到正在运行的工作区 IDE。

1.2.1.5. devfile registry

其他资源

OpenShift Dev Spaces devfile registry 提供了一个示例 devfiles 列表来创建 ready-to-to-use 工作区。第 1.2.1.4 节 “用户仪表板” 在 Dashboard → Create Workspace 页面中显示示例列表。每个示例都包括一个 Devfile v2。OpenShift Dev Spaces 部署在 devfile-registry 部署中启动一个 devfile registry 实例。

图 1.5. devfile registry 与其他组件交互

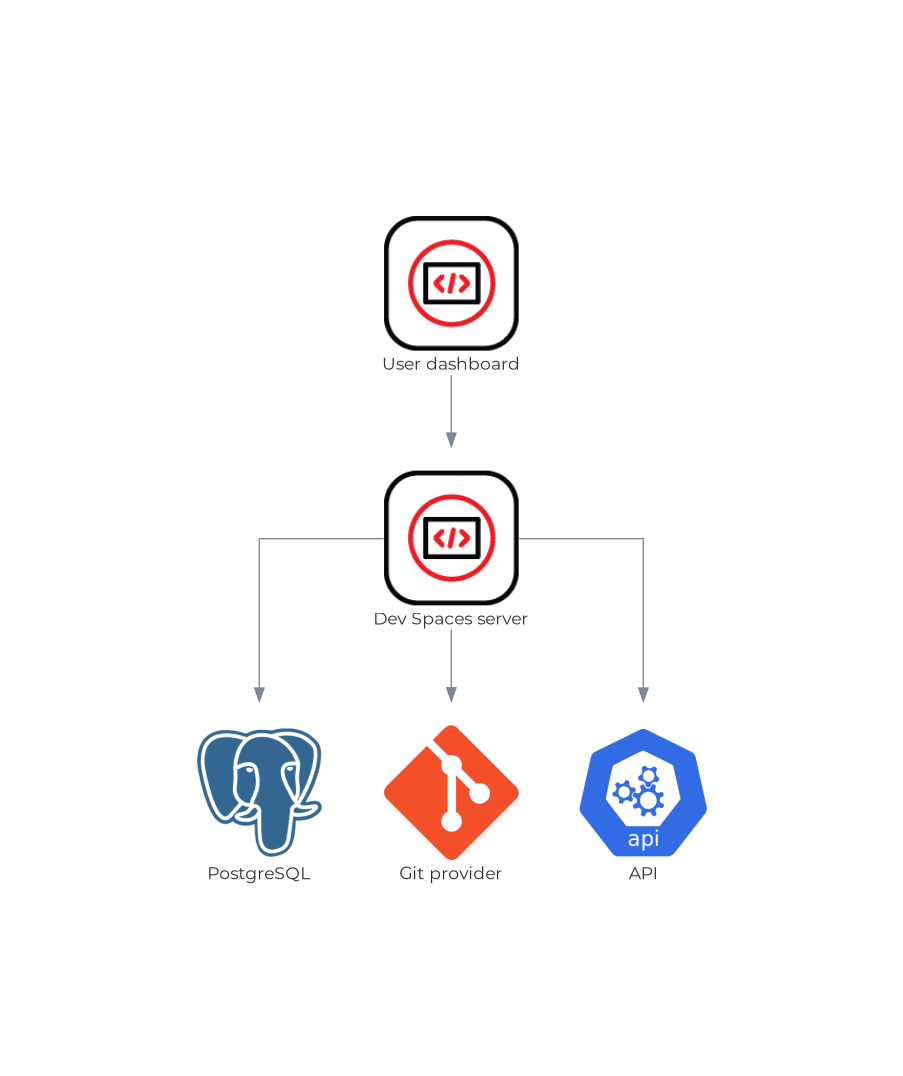

1.2.1.6. dev Spaces 服务器

OpenShift Dev Spaces 服务器主要功能有:

- 创建用户命名空间。

- 使用所需的 secret 和配置映射置备用户命名空间。

- 与 Git 服务供应商集成,获取并验证 devfile 和身份验证。

OpenShift Dev Spaces 服务器是一个 Java Web 服务,它公开 HTTP REST API,需要访问:

- 第 1.2.1.7 节 “PostgreSQL”

- Git 服务供应商

- OpenShift API

图 1.6. OpenShift Dev Spaces 服务器与其他组件交互

1.2.1.7. PostgreSQL

OpenShift Dev Spaces 服务器使用 PostgreSQL 数据库来持久保留用户配置,如工作空间元数据。

OpenShift Dev Spaces 部署在 postgres 部署中启动一个专用的 PostgreSQL 实例。您可以使用外部数据库。

图 1.7. PostgreSQL 与其他组件交互

1.2.1.8. 插件 registry

每个 OpenShift Dev Spaces 工作区都以特定的编辑器和一组关联的扩展开始。OpenShift Dev Spaces 插件注册表提供可用编辑器和编辑器扩展的列表。Devfile v2 描述了每个编辑器或扩展名。

第 1.2.1.4 节 “用户仪表板” 正在读取 registry 的内容。

图 1.8. 插件 registry 与其他组件交互

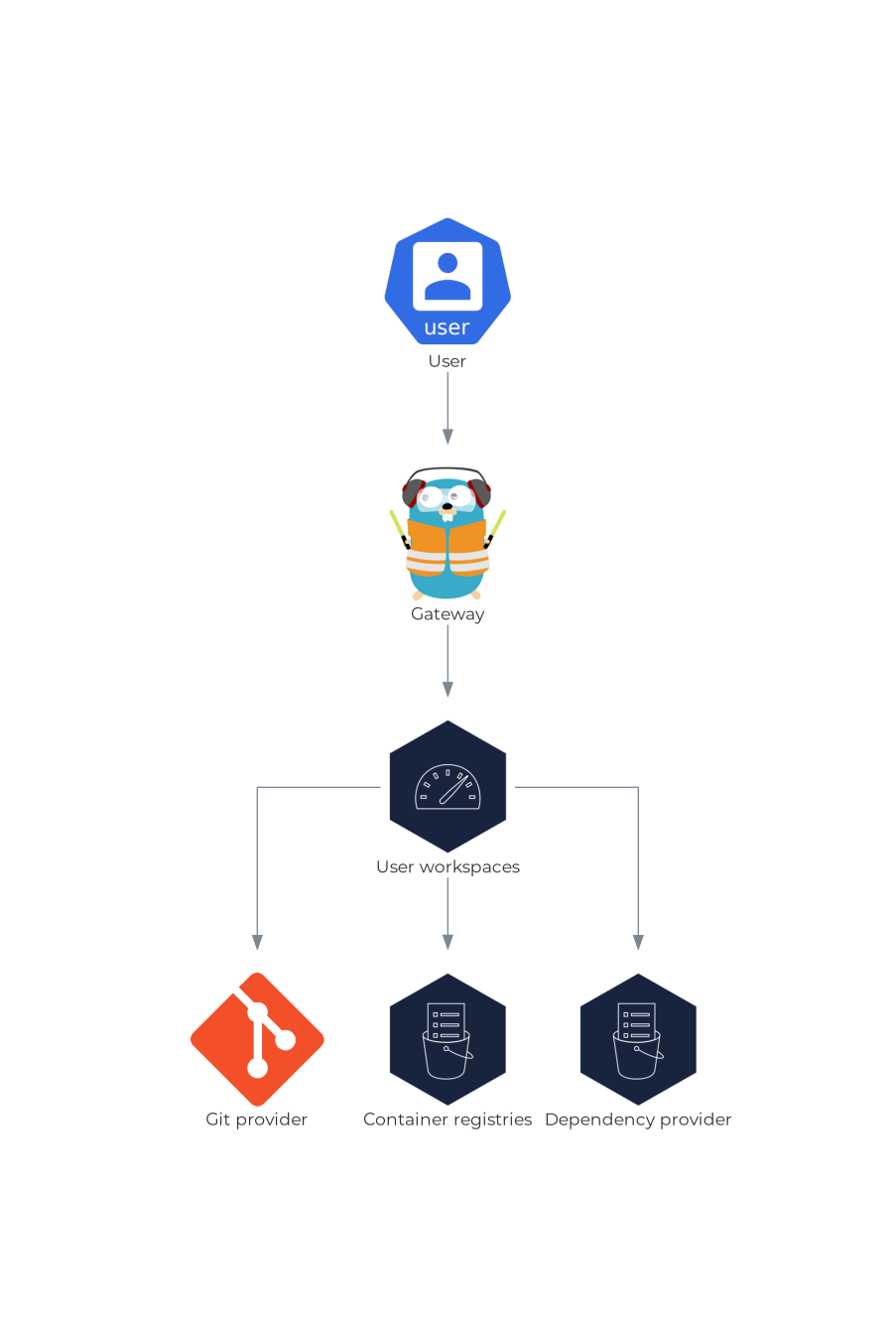

1.2.2. 用户工作区

图 1.9. 用户工作区与其他组件交互

用户工作区是在容器中运行的 Web IDE。

用户工作区是一个 Web 应用。它包含在容器中运行的微服务,它们提供了在浏览器中运行的现代 IDE 服务:

- Editor

- 语言自动完成

- 语言服务器

- 调试工具

- 插件

- 应用程序运行时

工作区是一个 OpenShift Deployment,其中包含工作空间容器并启用插件,以及相关的 OpenShift 组件:

- 容器

- ConfigMaps

- 服务

- Endpoints

- 入口或路由

- Secrets

- 持久性卷(PV)

OpenShift Dev Spaces 工作区包含项目的源代码,保留在 OpenShift Persistent Volume (PV)中。微服务对此共享目录具有读写访问权限。

使用 devfile v2 格式指定 OpenShift Dev Spaces 工作区的工具和运行时应用程序。

下图显示了运行一个 OpenShift Dev Spaces 工作区及其组件。

图 1.10. OpenShift Dev Spaces 工作区组件

在图中,有一个正在运行的工作区。

1.3. 计算 Dev Spaces 资源要求

OpenShift Dev Spaces Operator、Dev Workspace Controller 和用户工作区由一组 pod 组成。pod 有助于 CPU 和内存限值和请求中的资源消耗。了解如何计算运行 Red Hat OpenShift Dev Spaces 所需的资源,如内存和 CPU。

流程

识别 devfile 的

components部分中明确指定的工作区组件。当此部分为空时,OpenShift Dev Spaces 只加载隐式组件。表 1.1. devfile 指定工作区组件内存要求

用途 Pod 容器名称 内存限制 内存请求 CPU 限制 CPU 请求 您的开发人员工具

Workspace总计

识别 OpenShift Dev Spaces 负载的隐式工作区组件:开发人员工具、编辑器和 OpenShift Dev Spaces 网关。

表 1.2. 隐式工作区组件默认要求

用途 Pod 容器名称 内存限制 内存请求 CPU 限制 CPU 请求 开发人员工具

Workspaceuniversal-developer-image1 GiB

256 MiB

500 M

30 M

Editor

Workspaceche-code128 MiB

32 MiB

500 M

30 M

OpenShift Dev Spaces 网关

Workspaceche-gateway256 Mi

64 Mi

500 M

50 M

总计

2.4 GiB

480 MiB

1.5

110 m

- 总结每个工作区所需的资源,并通过正在运行的工作区计数来多处。

服务器组件要求总和。

表 1.3. OpenShift Dev Spaces 服务器组件默认要求

用途 Pod 名称 容器名称 内存限制 内存请求 CPU 限制 CPU 请求 OpenShift Dev Spaces operator

devspaces-operatordevspaces-operator256 MiB

64 MiB

500 M

100 M

OpenShift Dev Spaces Server

devspacesdevspaces-server1 Gi

512 MiB

1

1 m

OpenShift Dev Spaces Dashboard

devspaces-dashboard-

devspaces-dashboard

256 MiB

32 MiB

500 M

100 M

OpenShift Dev Spaces Gateway

devspaces-gatewaytraefik4 GiB

128 MiB

1

100 M

OpenShift Dev Spaces Gateway

devspaces-gatewayconfigbump256 MiB

64 MiB

500 M

50 M

OpenShift Dev Spaces Gateway

devspaces-gatewayoauth-proxy512 MiB

64 MiB

500 M

100 M

OpenShift Dev Spaces Gateway

devspaces-gatewaykube-rbac-proxy512 MiB

64 MiB

500 M

100 M

devfile registry

devfile-registrydevfile-registry256 Mi

32 Mi

500 M

100 M

插件 registry

plugin-registryplugin-registry256 Mi

32 Mi

500 M

100 M

PostgreSQL 数据库

postgrespostgres1 Gi

512 Mi

500 M

100 M

dev Workspace Controller Manager

devworkspace-controller-managerdevworkspace-controller1 GiB

100 MiB

1

250 m

dev Workspace Controller Manager

devworkspace-controller-managerkube-rbac-proxyN/A

N/A

N/A

N/A

dev Workspace webhook 服务器

devworkspace-webhook-serverwebhook-server300 MiB

29 MiB

200 M

100 M

dev Workspace Operator Catalog

registry-serverN/A

50 MiB

N/A

10 M

dev Workspace Webhook Server

devworkspace-webhook-serverwebhook-server300 MiB

20 MiB

200 M

100 M

dev Workspace Webhook Server

devworkspace-webhook-serverkube-rbac-proxyN/A

N/A

N/A

N/A

总计

9.5 GiB

1.6 GiB

7.4

2.31

-

第 2 章 安装 Dev Spaces

本节介绍安装 Red Hat OpenShift Dev Spaces 的说明。

每个集群只能部署一个 OpenShift Dev Spaces 实例。

2.1. 安装 dsc 管理工具

您可以在 Microsoft Windows、Apple MacOS 和 Linux 上安装 dsc、Red Hat OpenShift Dev Spaces 命令行工具。使用 dsc 时,可以执行 OpenShift Dev Spaces 服务器的操作,如启动、停止、更新和删除服务器。

先决条件

Linux 或 macOS。

注意

流程

-

将存档从 https://developers.redhat.com/products/openshift-dev-spaces/download 下载到一个目录,如

$HOME。 -

对存档运行

tar xvzf,以提取/dsc目录。 -

将提取的

/dsc/bin子目录添加到$PATH。

验证

运行

dsc来查看它的信息。$ dsc

其他资源

- "DSC 参考文档"

2.2. 使用 CLI 在 OpenShift 上安装 Dev Spaces

您可以在 OpenShift 上安装 OpenShift Dev Spaces。

先决条件

- OpenShift Container Platform

-

具有 OpenShift 集群的管理权限的活跃

oc会话。请参阅 OpenShift CLI 入门。 -

DSC:请参阅: 第 2.1 节 “安装 dsc 管理工具”。

流程

可选: 如果您之前在这个 OpenShift 集群上部署了 OpenShift Dev Spaces,请确保删除了以前的 OpenShift Dev Spaces 实例:

$ dsc server:delete

创建 OpenShift Dev Spaces 实例:

$ dsc server:deploy --platform openshift

验证步骤

验证 OpenShift Dev Spaces 实例状态:

$ dsc server:status

进入 OpenShift Dev Spaces 集群实例:

$ dsc dashboard:open

2.3. 使用 Web 控制台在 OpenShift 上安装 Dev Spaces

本节论述了如何使用 OpenShift Web 控制台安装 OpenShift Dev Spaces。考虑 第 2.2 节 “使用 CLI 在 OpenShift 上安装 Dev Spaces”。

先决条件

- 集群管理员的 OpenShift Web 控制台会话。请参阅 访问 Web 控制台。

流程

可选: 如果您之前在这个 OpenShift 集群上部署了 OpenShift Dev Spaces,请确保删除了以前的 OpenShift Dev Spaces 实例:

$ dsc server:delete

- 安装 Red Hat OpenShift Dev Spaces Operator。请参阅使用 Web 控制台 从 OperatorHub 安装。

在 OpenShift 中创建

openshift-devspaces项目,如下所示:oc create namespace openshift-devspaces

- 在 OpenShift Web 控制台的 Administrator 视图中,前往 Operators → Installed Operators → Red Hat OpenShift Dev Spaces 实例 Specification → Create CheCluster → YAML view。

-

在 YAML 视图 中,将

namespace: openshift-operators替换为namespace: openshift-devspaces。 - 选择 Create。请参阅从已安装的 Operator 创建应用程序。

验证

- 要验证 OpenShift Dev Spaces 实例是否已正确安装,请导航至 Operator 详情页面的 Dev Spaces Cluster 选项卡。Red Hat OpenShift Dev Spaces 实例规格 页面显示 Red Hat OpenShift Dev Spaces 实例及其状态的列表。

-

点 devspaces

CheCluster并导航到 Details 选项卡。 请参见以下字段的内容:

-

Message 字段包含错误消息。预期内容为

无。 - Red Hat OpenShift Dev Spaces URL 字段包含 Red Hat OpenShift Dev Spaces 实例的 URL。部署成功完成时会出现 URL。

-

Message 字段包含错误消息。预期内容为

- 导航到 Resources 选项卡。查看分配给 OpenShift Dev Spaces 部署的资源列表,以及它们的状态。

2.4. 在受限环境中安装 Dev Spaces

在受限网络中的 OpenShift 集群中,公共资源不可用。

但是,部署 OpenShift Dev Spaces 和 running 工作区需要以下公共资源:

- Operator 目录

- 容器镜像

- 项目示例

要使这些资源可用,可将这些资源替换为其在 OpenShift 集群可访问的注册表中的副本。

先决条件

- OpenShift 集群至少有 64 GB 磁盘空间。

- OpenShift 集群已准备好在受限网络上运行,OpenShift control plane 则能够访问公共互联网。请参阅关于断开连接的安装镜像 以及使用 Operator Lifecycle Manager 在受限网络中。

-

具有 OpenShift 集群的管理权限的活跃

oc会话。请参阅 OpenShift CLI 入门。 -

一个活跃的

oc registry会话到registry.redhat.io红帽生态系统目录。请参阅: Red Hat Container Registry 身份验证。

-

opm。请参阅安装opmCLI。 -

jq.请参阅 下载jq。 -

Podman.请参阅安装 Podman。 -

具有对 < my_registry> registry 的管理访问权限的活跃

skopeo会话。请参阅为断开连接的安装 安装 Skopeo、授权至registry 的镜像。 -

用于OpenShift Dev Spaces 版本 3.3 的 DSC。请参阅 第 2.1 节 “安装 dsc 管理工具”。

流程

下载并执行镜像脚本,以安装自定义 Operator 目录并镜像相关的镜像: prepare-restricted-environment.sh。

$ bash prepare-restricted-environment.sh \ --ocp_ver "4.11" \ --devworkspace_operator_index "registry.redhat.io/redhat/redhat-operator-index:v4.10" \ --devworkspace_operator_version "v0.15.2" \ --prod_operator_index "registry.redhat.io/redhat/redhat-operator-index:v4.10" \ --prod_operator_package_name "devspaces-operator" \ --prod_operator_version "v3.3.0" \ --my_registry "<my_registry>" \ --my_catalog "<my_catalog>"

在上一步中,使用

che-operator-cr-patch.yaml中的配置设置安装 OpenShift Dev Spaces:$ dsc server:deploy --platform=openshift \ --che-operator-cr-patch-yaml=che-operator-cr-patch.yaml

- 允许从 OpenShift Dev Spaces 命名空间到用户项目中的所有 Pod 的传入流量。请参阅: 第 3.7.1 节 “配置网络策略”。

其他资源

第 3 章 配置 Dev Spaces

本节论述了 Red Hat OpenShift Dev Spaces 的配置方法和选项。

3.1. 了解 CheCluster 自定义资源

OpenShift Dev Spaces 的默认部署由 Red Hat OpenShift Dev Spaces Operator 包含一个 CheCluster 自定义资源参数。

CheCluster 自定义资源是一个 Kubernetes 对象。您可以通过编辑 CheCluster 自定义资源 YAML 文件来配置它。此文件包含配置各个组件的部分: devWorkspace、cheServer、pluginRegistry、devfileRegistry、数据库、仪表板 和镜像Puller。

Red Hat OpenShift Dev Spaces Operator 会将 CheCluster 自定义资源转换为 OpenShift Dev Spaces 安装的每个组件可用的配置映射。

OpenShift 平台将配置应用到每个组件,并创建必要的 Pod。当 OpenShift 检测到组件配置中的改变时,它会相应地重启 Pod。

例 3.1. 配置 OpenShift Dev Spaces 服务器组件的主要属性

-

在

cheServer组件部分,使用适当的修改来应用CheCluster自定义资源 YAML 文件。 -

Operator 生成

cheConfigMap。 -

OpenShift 会检测

ConfigMap中的更改,并触发 OpenShift Dev Spaces Pod 重启。

其他资源

3.1.1. 在安装过程中使用 dsc 配置 CheCluster 自定义资源

要使用适当的配置部署 OpenShift Dev Spaces,请在安装 OpenShift Dev Spaces 期间编辑 CheCluster 自定义资源 YAML 文件。否则,OpenShift Dev Spaces 部署使用 Operator 进行的默认配置参数。

先决条件

-

具有 OpenShift 集群的管理权限的活跃

oc会话。请参阅 CLI 入门。 -

DSC:请参阅: 第 2.1 节 “安装 dsc 管理工具”。

流程

创建一个

che-operator-cr-patch.yamlYAML 文件,其中包含要配置的CheCluster自定义资源的子集:spec: <component>: <property_to_configure>: <value>

部署 OpenShift Dev Spaces 并应用

che-operator-cr-patch.yaml文件中的更改:$ dsc server:deploy \ --che-operator-cr-patch-yaml=che-operator-cr-patch.yaml \ --platform <chosen_platform>

验证

验证配置的属性的值:

$ oc get configmap che -o jsonpath='{.data.<configured_property>}' \ -n openshift-devspaces

3.1.2. 使用 CLI 配置 CheCluster 自定义资源

要配置正在运行的 OpenShift Dev Spaces 实例,请编辑 CheCluster 自定义资源 YAML 文件。

先决条件

- OpenShift 上 OpenShift Dev Spaces 实例。

-

具有对目标 OpenShift 集群的管理权限的活跃

oc会话。请参阅 CLI 入门。

流程

编辑集群中的 CheCluster 自定义资源:

$ oc edit checluster/devspaces -n openshift-devspaces

- 保存并关闭该文件以应用更改。

验证

验证配置的属性的值:

$ oc get configmap che -o jsonpath='{.data.<configured_property>}' \ -n openshift-devspaces

3.1.3. CheCluster 自定义资源字段参考

本节介绍了可用于自定义 CheCluster 自定义资源的所有字段。

-

例 3.2 “最小

CheCluster自定义资源示例。” - 表 3.1 “开发环境配置选项。”

- 表 3.4 “OpenShift Dev Spaces 组件配置。”

- 表 3.5 “DevWorkspace operator 组件配置。”

- 表 3.6 “与 OpenShift Dev Spaces 服务器组件相关的常规配置设置。”

- 表 3.7 “与 OpenShift Dev Spaces 安装使用的插件 registry 组件相关的配置设置。”

- 表 3.8 “与 OpenShift Dev Spaces 安装使用的 Devfile registry 组件相关的配置设置。”

- 表 3.9 “与 OpenShift Dev Spaces 安装使用的数据库组件相关的配置设置。”

- 表 3.10 “与 OpenShift Dev Spaces 安装使用的 Dashboard 组件相关的配置设置。”

- 表 3.11 “Kubernetes 镜像提取组件配置。”

- 表 3.12 “OpenShift Dev Spaces 服务器指标组件配置。”

- 表 3.13 “网络、OpenShift Dev Spaces 身份验证和 TLS 配置.”

- 表 3.14 “存储 OpenShift Dev Spaces 镜像的替代注册表。”

-

表 3.15 “

CheCluster自定义资源状态定义 OpenShift Dev Spaces 安装的观察状态”

例 3.2. 最小 CheCluster 自定义资源示例。

apiVersion: org.eclipse.che/v2

kind: CheCluster

metadata:

name: devspaces

spec:

devEnvironments:

defaultNamespace:

template: '<username>-che'

storage:

pvcStrategy: 'common'

components:

database:

externalDb: false

metrics:

enable: true表 3.1. 开发环境配置选项。

| 属性 | Description |

|---|---|

| containerBuildConfiguration | 容器构建配置。 |

| defaultComponents | 应用到 DevWorkspaces 的默认组件。当 Devfile 不包含任何组件时,可以使用这些默认组件。 |

| defaultEditor |

要使用的工作区创建的默认编辑器。它可以是插件 ID 或一个 URI。插件 ID 必须具有 |

| defaultNamespace | 用户的默认命名空间。 |

| defaultPlugins | 应用到 DevWorkspaces 的默认插件。 |

| disableContainerBuildCapabilities | 禁用容器构建功能。 |

| nodeSelector | 节点选择器限制可以运行工作区 Pod 的节点。 |

| secondsOfInactivityBeforeIdling | 空闲的工作区超时(以秒为单位)。此超时为持续时间,如果没有活动,工作区将被闲置。要禁用因不活跃而造成的工作区闲置,请将此值设置为 -1。 |

| secondsOfRunBeforeIdling | 运行工作区(以秒为单位)的超时。此超时是工作区运行的最长持续时间。要禁用工作空间运行超时,将此值设置为 -1。 |

| storage | 工作区持久性存储。 |

| 容限(tolerations) | 工作空间 pod 的 pod 容限,用于限制工作区 pod 可以运行的位置。 |

| trustedCerts | 可信证书设置。 |

表 3.2. 开发环境 defaultNamespace 选项。

| 属性 | Description |

|---|---|

| autoProvision | 指明是否允许自动创建用户命名空间。如果设为 false,则集群管理员必须预先创建用户命名空间。 |

| 模板 |

如果您不提前创建用户命名空间,此字段定义启动第一个工作区时创建的 Kubernetes 命名空间。您可以使用 < |

表 3.3. 开发环境 存储选项。

| 属性 | Description |

|---|---|

| perUserStrategyPvcConfig |

使用每个用户 PVC 策略时 |

| perWorkspaceStrategyPvcConfig |

使用 |

| pvcStrategy |

OpenShift Dev Spaces 服务器的持久性卷声明策略。支持的策略包括: |

表 3.4. OpenShift Dev Spaces 组件配置。

| 属性 | Description |

|---|---|

| cheServer | 与 OpenShift Dev Spaces 服务器相关的常规配置设置。 |

| dashboard | 与 OpenShift Dev Spaces 安装使用的仪表板相关的配置设置。 |

| 数据库 | 与 OpenShift Dev Spaces 安装使用的数据库相关的配置设置。 |

| devWorkspace | DevWorkspace Operator 配置。 |

| devfileRegistry | 与 OpenShift Dev Spaces 安装使用的 devfile registry 相关的配置设置。 |

| imagePuller | Kubernetes 镜像提取器配置. |

| metrics | OpenShift Dev Spaces 服务器指标配置。 |

| pluginRegistry | 与 OpenShift Dev Spaces 安装使用的插件 registry 相关的配置设置。 |

表 3.5. DevWorkspace operator 组件配置。

| 属性 | Description |

|---|---|

| runningLimit | 每个用户运行的最大工作区数。 |

表 3.6. 与 OpenShift Dev Spaces 服务器组件相关的常规配置设置。

| 属性 | Description |

|---|---|

| clusterRoles |

分配给 OpenShift Dev Spaces ServiceAccount 的 ClusterRole。默认角色为: - < |

| debug | 为 OpenShift Dev Spaces 服务器启用调试模式。 |

| 部署 | 部署覆盖选项. |

| extraProperties |

除了从 |

| logLevel |

OpenShift Dev Spaces 服务器的日志级别: |

| proxy | Kubernetes 集群的代理服务器设置。OpenShift 集群不需要额外的配置。通过为 OpenShift 集群指定这些设置,您可以覆盖 OpenShift 代理配置。 |

表 3.7. 与 OpenShift Dev Spaces 安装使用的插件 registry 组件相关的配置设置。

| 属性 | Description |

|---|---|

| 部署 | 部署覆盖选项. |

| disableInternalRegistry | 禁用内部插件 registry。 |

| externalPluginRegistries | 外部插件注册表. |

| openVSXURL | 打开 VSX 注册表 URL。如果省略了嵌入的实例,则会使用它。 |

表 3.8. 与 OpenShift Dev Spaces 安装使用的 Devfile registry 组件相关的配置设置。

| 属性 | Description |

|---|---|

| 部署 | 部署覆盖选项. |

| disableInternalRegistry | 禁用内部 devfile registry。 |

| externalDevfileRegistries | 外部 devfile registry 提供示例可供使用 devfile。 |

表 3.9. 与 OpenShift Dev Spaces 安装使用的数据库组件相关的配置设置。

| 属性 | Description |

|---|---|

| credentialsSecretName |

包含 OpenShift Dev Spaces 服务器用来连接到数据库的 PostgreSQL |

| 部署 | 部署覆盖选项. |

| externalDb |

指示 Operator 部署专用数据库。默认情况下,一个专用的 PostgreSQL 数据库作为 OpenShift Dev Spaces 安装的一部分部署。当将 |

| postgresDb | OpenShift Dev Spaces 服务器用来连接到数据库的 PostgreSQL 数据库名称。 |

| postgresHostName |

OpenShift Dev Spaces 服务器连接到的 PostgreSQL 数据库主机名。仅在使用外部数据库时覆盖这个值。请参阅 |

| postgresPort |

OpenShift Dev Spaces 服务器连接到的 PostgreSQL 数据库端口。仅在使用外部数据库时覆盖这个值。请参阅 |

| pvc | PostgreSQL 数据库的 PVC 设置。 |

表 3.10. 与 OpenShift Dev Spaces 安装使用的 Dashboard 组件相关的配置设置。

| 属性 | Description |

|---|---|

| 部署 | 部署覆盖选项. |

| headerMessage | 仪表板标题消息. |

表 3.11. Kubernetes 镜像提取组件配置。

| 属性 | Description |

|---|---|

| enable |

安装和配置社区支持的 Kubernetes Image Puller Operator。在不提供任何 specs 的情况下将值设为 |

| spec | Kubernetes Image Puller spec,在 CheCluster 中配置镜像 puller。 |

表 3.12. OpenShift Dev Spaces 服务器指标组件配置。

| 属性 | Description |

|---|---|

| enable |

为 OpenShift Dev Spaces 服务器端点启用 |

表 3.13. 网络、OpenShift Dev Spaces 身份验证和 TLS 配置.

| 属性 | Description |

|---|---|

| annotations | 定义要为 Ingress 设置的注解(OpenShift 平台的路由)。kubernetes 平台的默认值为 kubernetes.io/ingress.class: \nginx\ nginx.ingress.kubernetes.io/proxy-read-timeout: \3600\, nginx.ingress.kubernetes.io/proxy-connect-timeout: \3600\, nginx.ingress.kubernetes.io/ssl-redirect: \true\ |

| auth | 身份验证设置。 |

| domain | 对于 OpenShift 集群,Operator 使用域为路由生成主机名。生成的主机名遵循此模式: che-<devspaces-namespace>.<domain>。<devspaces-namespace> 是创建 CheCluster CRD 的命名空间。与标签结合使用,它会创建一个由非默认 Ingress 控制器提供的路由。对于 Kubernetes 集群,它包含全局入口域。没有默认值: 您必须指定它们。 |

| hostname | 安装的 OpenShift Dev Spaces 服务器的公共主机名。 |

| labels | 定义要为 Ingress 设置的标签(OpenShift 平台的路由)。 |

| tlsSecretName |

用于设置 Ingress TLS 终止的 secret 名称。如果字段是一个空字符串,则使用默认集群证书。secret 必须具有 |

表 3.14. 存储 OpenShift Dev Spaces 镜像的替代注册表。

| 属性 | Description |

|---|---|

| hostname | 用于从中拉取镜像的替代容器 registry 的可选主机名或 URL。这个值会覆盖 OpenShift Dev Spaces 部署涉及的所有默认容器镜像中定义的容器 registry 主机名。这在受限环境中安装 OpenShift Dev Spaces 特别有用。 |

| 机构 | 从中拉取镜像的替代 registry 的可选存储库名称。这个值会覆盖 OpenShift Dev Spaces 部署涉及的所有默认容器镜像中定义的容器 registry。这在受限环境中安装 OpenShift Dev Spaces 特别有用。 |

表 3.15. CheCluster 自定义资源状态 定义 OpenShift Dev Spaces 安装的观察状态

| 属性 | Description |

|---|---|

| chePhase | 指定 OpenShift Dev Spaces 部署的当前阶段。 |

| cheURL | OpenShift Dev Spaces 服务器的公共 URL。 |

| cheVersion | 当前安装了 OpenShift Dev Spaces 版本。 |

| devfileRegistryURL | 内部 devfile registry 的公共 URL。 |

| gatewayPhase | 指定网关部署的当前阶段。 |

| message | 人类可读的消息,指示 OpenShift Dev Spaces 部署处于当前阶段的详细信息。 |

| pluginRegistryURL | 内部插件 registry 的公共 URL。 |

| postgresVersion | 使用的镜像的 PostgreSQL 版本。 |

| reason | 简短的 CamelCase 消息指示 OpenShift Dev Spaces 部署在当前阶段的详细信息。 |

| workspaceBaseDomain | 解析的工作区基域。这是 spec 中相同名称的显式定义属性的副本,或者如果在 spec 中未定义,我们将在 OpenShift 上运行,则自动解析路由的 basedomain。 |

3.2. 配置项目

对于每个用户,OpenShift Dev Spaces 会隔离项目中的工作区。OpenShift Dev Spaces 通过存在标签和注解来识别 user 项目。在启动工作区时,如果所需的项目不存在,OpenShift Dev Spaces 会使用模板名称创建项目。

您可以通过以下方法修改 OpenShift Dev Spaces 行为:

3.2.1. 配置项目名称

您可以配置 OpenShift Dev Spaces 在启动工作区时用来创建所需项目的项目名称模板。

有效的项目名称模板遵循以下惯例:

-

<

;username> 或<userid> 占位符是必须的。 -

用户名和 ID 不能包含无效字符。如果用户名或 ID 的格式与 OpenShift 对象的命名惯例不兼容,OpenShift Dev Spaces 将用户名或 ID 更改为有效的名称,将不兼容的字符替换为

-符号。 -

OpenShift Dev Spaces 评估了

<userid> 占位符到 14 个字符长字符串中,并添加随机的六个字符长后缀,以防止 ID 冲突。其结果存储在用户首选项中以供重复使用。 - Kubernetes 将项目名称的长度限制为 63 个字符。

- OpenShift 将长度限制为 49 个字符。

流程

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: components: devEnvironments: defaultNamespace: template: <workspace_namespace_template_>例 3.3. 用户工作区项目名称模板示例

用户工作区项目名称模板 生成的项目示例 <username>-devspaces(默认)user1-devspaces

<userid>-namespacecge1egvsb2nhba-namespace-ul1411<userid>-aka-<username>-namespacecgezegvsb2nhba-aka-user1-namespace-6m2w2b

3.2.2. 提前置备项目

您可以提前置备工作区项目,而不是依赖于自动配置。为每个用户重复上述步骤。

流程

使用以下标签和注解为 < username > 用户创建 <project_name > 项目:

kind: Namespace apiVersion: v1 metadata: name: <project_name> 1 labels: app.kubernetes.io/part-of: che.eclipse.org app.kubernetes.io/component: workspaces-namespace annotations: che.eclipse.org/username: <username>

- 1

- 使用您选择的项目名称。

3.3. 配置服务器组件

3.3.1. 将 Secret 或 ConfigMap 挂载为文件或环境变量到 Red Hat OpenShift Dev Spaces 容器中

机密是存储敏感数据的 OpenShift 对象,例如:

- 用户名

- 密码

- 身份验证令牌

的加密形式。

用户可以挂载包含敏感数据或 ConfigMap (在 OpenShift Dev Spaces 受管容器中包含配置)的 OpenShift Secret:

- 一个文件

- 环境变量

挂载过程使用标准的 OpenShift 挂载机制,但它需要额外的注释和标记。

3.3.1.1. 将 Secret 或 ConfigMap 作为一个文件挂载到 OpenShift Dev Spaces 容器中

先决条件

- 正在运行的红帽 OpenShift Dev Spaces 实例。

流程

在部署了 OpenShift Dev Spaces 的 OpenShift 项目中创建一个新的 OpenShift Secret 或 ConfigMap。要创建的对象标签必须与一组标签匹配:

-

app.kubernetes.io/part-of: che.eclipse.org -

app.kubernetes.io/component: <DEPLOYMENT_NAME>-<OBJECT_KIND> &

lt;DEPLOYMENT_NAME> 对应于以下部署:-

postgres -

Keycloak -

devfile-registry -

plugin-registry devspaces和

-

<OBJECT_KIND> 是:secret或者

-

configmap

-

例 3.4. 例如:

apiVersion: v1

kind: Secret

metadata:

name: custom-settings

labels:

app.kubernetes.io/part-of: che.eclipse.org

app.kubernetes.io/component: devspaces-secret

...或者

apiVersion: v1

kind: ConfigMap

metadata:

name: custom-settings

labels:

app.kubernetes.io/part-of: che.eclipse.org

app.kubernetes.io/component: devspaces-configmap

...注解必须指示给定对象被挂载为一个文件。

配置注解值:

-

Che.eclipse.org/mount-as: file- 要表示对象被挂载为一个文件。 -

Che.eclipse.org/mount-path: <TARGET_PATH> - 要提供所需的挂载路径。

-

例 3.5. 例如:

apiVersion: v1

kind: Secret

metadata:

name: custom-data

annotations:

che.eclipse.org/mount-as: file

che.eclipse.org/mount-path: /data

labels:

...或者

apiVersion: v1

kind: ConfigMap

metadata:

name: custom-data

annotations:

che.eclipse.org/mount-as: file

che.eclipse.org/mount-path: /data

labels:

...OpenShift 对象可以包含多个项目,其名称必须与挂载到容器中所需的文件名匹配。

例 3.6. 例如:

apiVersion: v1

kind: Secret

metadata:

name: custom-data

labels:

app.kubernetes.io/part-of: che.eclipse.org

app.kubernetes.io/component: devspaces-secret

annotations:

che.eclipse.org/mount-as: file

che.eclipse.org/mount-path: /data

data:

ca.crt: <base64 encoded data content here>或者

apiVersion: v1

kind: ConfigMap

metadata:

name: custom-data

labels:

app.kubernetes.io/part-of: che.eclipse.org

app.kubernetes.io/component: devspaces-configmap

annotations:

che.eclipse.org/mount-as: file

che.eclipse.org/mount-path: /data

data:

ca.crt: <data content here>

这会导致名为 ca.crt 的文件挂载到 OpenShift Dev Spaces 容器的 /data 路径上。

要在 OpenShift Dev Spaces 容器中进行更改,请完全重新创建对象。

3.3.1.2. 将 Secret 或 ConfigMap 作为环境变量挂载到 OpenShift Dev Spaces 容器中

先决条件

- 正在运行的红帽 OpenShift Dev Spaces 实例。

流程

在部署了 OpenShift Dev Spaces 的 OpenShift 项目中创建一个新的 OpenShift Secret 或 ConfigMap。要创建的对象标签必须与一组标签匹配:

-

app.kubernetes.io/part-of: che.eclipse.org -

app.kubernetes.io/component: <DEPLOYMENT_NAME>-<OBJECT_KIND> &

lt;DEPLOYMENT_NAME> 对应于以下部署:-

postgres -

Keycloak -

devfile-registry -

plugin-registry devspaces和

-

<OBJECT_KIND> 是:secret或者

-

configmap

-

例 3.7. 例如:

apiVersion: v1

kind: Secret

metadata:

name: custom-settings

labels:

app.kubernetes.io/part-of: che.eclipse.org

app.kubernetes.io/component: devspaces-secret

...或者

apiVersion: v1

kind: ConfigMap

metadata:

name: custom-settings

labels:

app.kubernetes.io/part-of: che.eclipse.org

app.kubernetes.io/component: devspaces-configmap

...注解必须指示给定对象被挂载为环境变量。

配置注解值:

-

Che.eclipse.org/mount-as: env- 表示对象被挂载为环境变量 -

Che.eclipse.org/env-name : <FOO_ENV> - 以提供环境变量名称,这是挂载对象密钥值所必需的

-

例 3.8. 例如:

apiVersion: v1

kind: Secret

metadata:

name: custom-settings

annotations:

che.eclipse.org/env-name: FOO_ENV

che.eclipse.org/mount-as: env

labels:

...

data:

mykey: myvalue或者

apiVersion: v1

kind: ConfigMap

metadata:

name: custom-settings

annotations:

che.eclipse.org/env-name: FOO_ENV

che.eclipse.org/mount-as: env

labels:

...

data:

mykey: myvalue这会生成两个环境变量:

-

FOO_ENV -

myvalue

集成到 OpenShift Dev Spaces 容器中。

如果对象提供多个数据项,则必须为每个数据键提供环境变量名称,如下所示:

例 3.9. 例如:

apiVersion: v1

kind: Secret

metadata:

name: custom-settings

annotations:

che.eclipse.org/mount-as: env

che.eclipse.org/mykey_env-name: FOO_ENV

che.eclipse.org/otherkey_env-name: OTHER_ENV

labels:

...

data:

mykey: __<base64 encoded data content here>__

otherkey: __<base64 encoded data content here>__或者

apiVersion: v1

kind: ConfigMap

metadata:

name: custom-settings

annotations:

che.eclipse.org/mount-as: env

che.eclipse.org/mykey_env-name: FOO_ENV

che.eclipse.org/otherkey_env-name: OTHER_ENV

labels:

...

data:

mykey: __<data content here>__

otherkey: __<data content here>__这会生成两个环境变量:

-

FOO_ENV -

OTHER_ENV

集成到 OpenShift Dev Spaces 容器中。

OpenShift 对象中注解名称的最大长度为 63 个字符,可为以 / 结尾的前缀保留 9 个字符。这作为可用于对象的密钥最大长度的限制。

要在 OpenShift Dev Spaces 容器中进行更改,请完全重新创建对象。

3.3.2. Dev Spaces 服务器的高级配置选项

以下部分介绍了 OpenShift Dev Spaces 服务器组件的高级部署和配置方法。

3.3.2.1. 了解 OpenShift Dev Spaces 服务器高级配置

下一节介绍 OpenShift Dev Spaces 服务器组件高级配置方法。

高级配置是必需的:

-

添加 Operator 不会自动从标准

CheCluster自定义资源字段生成的环境变量。 -

覆盖 Operator 从标准

CheCluster自定义资源字段自动生成的属性。

customCheProperties 字段是 CheCluster 自定义资源 服务器设置 的一部分,包含更多环境变量以应用到 OpenShift Dev Spaces 服务器组件。

例 3.10. 覆盖工作区的默认内存限值

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。apiVersion: org.eclipse.che/v2 kind: CheCluster spec: components: cheServer: extraProperties: CHE_LOGS_APPENDERS_IMPL: json

早期版本的 OpenShift Dev Spaces Operator 具有名为 custom 的 ConfigMap 来履行此角色。如果 OpenShift Dev Spaces Operator 找到了名为 custom 的 configMap,它会将其包含的数据添加到 customCheProperties 字段中,重新部署 OpenShift Dev Spaces,并删除 自定义 configMap。

3.4. 全局配置工作区

这部分论述了如何全局配置工作区。

3.4.1. 限制用户可以保留的工作区数量

默认情况下,用户可以在仪表板中保留无限个工作区,但您可以限制这个数量来减少对集群的需求。

此配置是 CheCluster 自定义资源的一部分:

spec:

components:

cheServer:

extraProperties:

CHE_LIMITS_USER_WORKSPACES_COUNT: "<kept_workspaces_limit>" 1- 1

- 设置每个用户的最大工作区数。默认值

-1允许用户保留无限数量的工作区。使用正整数来设置每个用户的最大工作区数。

流程

获取 OpenShift Dev Spaces 命名空间的名称。默认为

openshift-devspaces。$ oc get checluster --all-namespaces \ -o=jsonpath="{.items[*].metadata.namespace}"配置

CHE_LIMITS_USER_WORKSPACES_COUNT:$ oc patch checluster/devspaces -n openshift-devspaces \1 --type='merge' -p \ '{"spec":{"components":{"cheServer":{"extraProperties":{"CHE_LIMITS_USER_WORKSPACES_COUNT": "<kept_workspaces_limit>"}}}}}' 2

3.4.2. 允许用户同时运行多个工作区

默认情况下,用户一次只能运行一个工作区。您可以让用户同时运行多个工作区。

如果使用默认存储方法,如果用户在多节点集群中分布 pod 时,当同时运行工作区时,用户可能会出现问题。从每位用户的 通用存储策略 切换到 每个工作区存储策略,或 使用临时存储 类型可以避免或解决这些问题。

此配置是 CheCluster 自定义资源的一部分:

spec:

components:

devWorkspace:

runningLimit: "<running_workspaces_limit>" 1- 1

- 设置每个用户同时运行工作区的最大数量。默认值为:

1。

流程

获取 OpenShift Dev Spaces 命名空间的名称。默认为

openshift-devspaces。$ oc get checluster --all-namespaces \ -o=jsonpath="{.items[*].metadata.namespace}"配置

runningLimit:$ oc patch checluster/devspaces -n openshift-devspaces \1 --type='merge' -p \ '{"spec":{"components":{"devWorkspace":{"runningLimit": "<running_workspaces_limit>"}}}}' 2

3.4.3. 带有自签名证书的 Git

您可以配置 OpenShift Dev Spaces,以支持使用自签名证书的 Git 供应商上的操作。

先决条件

-

具有 OpenShift 集群的管理权限的活跃

oc会话。请参阅 OpenShift CLI 入门。 - Git 版本 2 或更高版本

流程

使用 Git 服务器详情创建新 ConfigMap:

$ oc create configmap che-git-self-signed-cert \ --from-file=ca.crt=<path_to_certificate> \ 1 --from-literal=githost=<host:port> -n openshift-devspaces 2

注意-

如果没有指定

githost,则给定证书适用于所有 HTTPS 存储库。 -

证书文件通常存储为 Base64 ASCII 文件,例如:

.pem、.crt、.ca-bundle.另外,它们可以编码为二进制数据,如.cer。所有包含证书文件的Secret都应该使用 Base64 ASCII 证书而不是二进制数据证书。

-

如果没有指定

在 ConfigMap 中添加所需的标签:

$ oc label configmap che-git-self-signed-cert \ app.kubernetes.io/part-of=che.eclipse.org -n openshift-devspaces

配置 OpenShift Dev Spaces 操作对象,以便为 Git 存储库使用自签名证书。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。

spec: devEnvironments: trustedCerts: gitTrustedCertsConfigMapName: che-git-self-signed-cert

验证步骤

创建并启动新工作区。工作区使用的每个容器都挂载一个带有自签名证书的文件的特殊卷。容器的

/etc/gitconfig文件包含有关 Git 服务器主机( URL)和http部分中的证书路径的信息(请参阅关于 git-config的 Git 文档)。例 3.11.

/etc/gitconfig文件的内容[http "https://10.33.177.118:3000"] sslCAInfo = /etc/config/che-git-tls-creds/certificate

3.4.4. 配置工作区 nodeSelector

本节论述了如何为 OpenShift Dev Spaces 工作区的 Pod 配置 nodeSelector。

流程

OpenShift Dev Spaces 使用 CHE_WORKSPACE_POD_NODE_SELECTOR 环境变量来配置 nodeSelector。此变量可以包含一组以逗号分隔的 key=value 对来组成 nodeSelector 规则,或 NULL 禁用它。

CHE_WORKSPACE_POD_NODE__SELECTOR=disktype=ssd,cpu=xlarge,[key=value]

nodeSelector 必须在 OpenShift Dev Spaces 安装过程中配置。这可防止现有工作区因为卷关联性冲突而运行失败,导致现有工作区 PVC 和 Pod 被调度到不同的区。

为了避免在大型多区集群上的不同区中调度 Pod 和 PVC,请创建一个额外的 StorageClass 对象(注意 允许的Topologies 字段),这将协调 PVC 创建过程。

通过 CHE_INFRA_KUBERNETES_PVC_STORAGE_CLASS_NAME 环境变量将这个新创建的 StorageClass 名称传递给 OpenShift Dev Spaces。这个变量的默认空值指示 OpenShift Dev Spaces 使用集群的默认 StorageClass。

3.4.5. 打开 VSX registry URL

为了搜索并安装扩展,Visis Studio Code 编辑器使用嵌入的 Open VSX 注册表实例。您还可以将 OpenShift Dev Spaces 配置为使用另一个 Open VSX registry 实例,而不是嵌入的实例。

流程

在 CheCluster Custom Resource

spec.components.pluginRegistry.openVSXURL字段中设置 Open VSX registry 实例的 URL。spec: components: # [...] pluginRegistry: openVSXRegistryURL: <your_open_vsx_registy> # [...]

3.5. 缓存镜像以便更快地开始工作区

要提高 OpenShift Dev Spaces 工作区的开始时间性能,请使用 Image Puller (一个 OpenShift Dev Spaces-agnostic)组件,可用于对 OpenShift 集群预拉取镜像。Image Puller 是一个额外的 OpenShift 部署,它会创建一个 DaemonSet,可以配置为在每个节点上预拉取相关的 OpenShift Dev Spaces 工作区镜像。当 OpenShift Dev Spaces 工作区启动时,这些镜像将已经可用,因此改进了工作空间开始时间。

Image Puller 为配置提供以下参数。

表 3.16. 镜像拉取器参数

| 参数 | 使用 | 默认 |

|---|---|---|

|

| DaemonSet 健康检查间隔(以小时为单位) |

|

|

| 拉取程序运行时每个缓存的镜像的内存请求。请参阅 第 3.5.2 节 “定义内存设置”。 |

|

|

| 拉取程序运行时每个缓存的镜像的内存限值。请参阅 第 3.5.2 节 “定义内存设置”。 |

|

|

| 拉取器运行时每个缓存的镜像的处理器请求 |

|

|

| 拉取器运行时每个缓存的镜像的处理器限制 |

|

|

| 要创建的 DaemonSet 的名称 |

|

|

| 要创建的 Deployment 的名称 |

|

|

| 要创建的 DaemonSet 的 OpenShift 项目 |

|

|

|

要拉取镜像的分号分隔列表,格式为 < | |

|

| 节点选择器应用到 DaemonSet 创建的 pod |

|

|

| 关联性应用到由 DaemonSet 创建的 pod |

|

|

|

镜像 pull secret 列表,格式为 |

|

其他资源

3.5.1. 定义镜像列表

Image Puller 可以预先拉取大多数镜像,包括全新镜像,如 che-machine-exec。但是,在 OpenShift 3.11 上预拉取(pull)时不支持挂载 Dockerfile 中的卷的镜像,如 traefik。

流程

-

通过导航到

"https://devspaces-<openshift_deployment_name>.<domain_name>"/plugin-registry/v3/external_images.txtURL 来拉取相关容器镜像的列表。 -

从列表中确定预拉取的镜像。为了加快工作空间启动时间,请考虑拉取与工作区相关的镜像,如

generic-developer-image、che-code' 和che-gateway。

3.5.2. 定义内存设置

定义内存请求和限值参数,以确保拉取的容器和平台有足够的内存来运行。

先决条件

流程

-

要定义

CACHING_MEMORY_REQUEST或CACHING_MEMORY_LIMIT的最小值,请考虑运行每个容器镜像所需的必要内存量。 要定义

CACHING_MEMORY_REQUEST或CACHING_MEMORY_LIMIT的 maximal 值,请考虑分配给集群中的 DaemonSet Pod 的总内存:(memory limit) * (number of images) * (number of nodes in the cluster)

在 20 节点上拉取 5 个镜像,容器内存限值为

20Mi需要2000Mi内存。

3.5.3. 使用 Web 控制台在 OpenShift 上安装镜像 puller

您可以使用 OpenShift Web 控制台在 OpenShift 上安装社区支持的 Kubernetes Image Puller Operator。

先决条件

- 第 3.5.1 节 “定义镜像列表”

- 第 3.5.2 节 “定义内存设置”.

- 集群管理员的 OpenShift Web 控制台会话。请参阅 访问 Web 控制台。

流程

- 安装社区支持的 Kubernetes Image Puller Operator。请参阅使用 Web 控制台 从 OperatorHub 安装。

-

从支持的

Kubernetes Image PullerOperator 创建 kubernetes-image-puller KubernetesImagePuller 操作对象。请参阅从已安装的 Operator 创建应用程序。

3.5.4. 使用 CLI 在 OpenShift 上安装镜像 puller

您可以使用 OpenShift oc 管理工具在 OpenShift 上安装 Kubernetes Image Puller。

先决条件

- 第 3.5.1 节 “定义镜像列表”.

- 第 3.5.2 节 “定义内存设置”.

-

具有 OpenShift 集群的管理权限的活跃

oc会话。请参阅 OpenShift CLI 入门。

流程

克隆 Image Puller 存储库,并获取包含 OpenShift 模板的目录:

$ git clone https://github.com/che-incubator/kubernetes-image-puller $ cd kubernetes-image-puller/deploy/openshift

使用以下参数配置

app.yaml、configmap.yaml和serviceaccount.yamlOpenShift 模板:表 3.17.

app.yaml中的镜像拉取(puller OpenShift 模板参数)值 使用 默认 DEPLOYMENT_NAMEConfigMap 中的

DEPLOYMENT_NAME的值kubernetes-image-pullerIMAGE用于

kubernetes-image-puller部署的镜像registry.redhat.io/devspaces/imagepuller-rhel8:3.3IMAGE_TAG要拉取的镜像标签

latestSERVICEACCOUNT_NAME部署创建和使用的 ServiceAccount 的名称

kubernetes-image-puller表 3.18.

configmap.yaml中的 image Puller OpenShift 模板参数值 使用 默认 CACHING_CPU_LIMITConfigMap 中的

CACHING_CPU_LIMIT值.2CACHING_CPU_REQUESTConfigMap 中的

CACHING_CPU_REQUEST值.05CACHING_INTERVAL_HOURSConfigMap 中的

CACHING_INTERVAL_HOURS的值"1"CACHING_MEMORY_LIMITConfigMap 中的

CACHING_MEMORY_LIMIT值"20Mi"CACHING_MEMORY_REQUESTConfigMap 中的

CACHING_MEMORY_REQUEST的值"10Mi"DAEMONSET_NAMEConfigMap 中的

DAEMONSET_NAME的值kubernetes-image-pullerDEPLOYMENT_NAMEConfigMap 中的

DEPLOYMENT_NAME的值kubernetes-image-puller镜像ConfigMap 中的

IMAGES值"undefined"NAMESPACEConfigMap 中

NAMESPACE的值k8s-image-pullerNODE_SELECTORConfigMap 中的

NODE_SELECTOR的值"{}"表 3.19.

serviceaccount.yaml中的 image Puller OpenShift 模板参数值 使用 默认 SERVICEACCOUNT_NAME部署创建和使用的 ServiceAccount 的名称

kubernetes-image-puller创建用于托管 Image Puller 的 OpenShift 项目:

$ oc new-project <k8s-image-puller>处理并应用模板来安装 puller:

$ oc process -f serviceaccount.yaml | oc apply -f - $ oc process -f configmap.yaml | oc apply -f - $ oc process -f app.yaml | oc apply -f -

验证步骤

验证是否存在 < kubernetes-image-puller> 部署和 < kubernetes-image-puller> DaemonSet。DaemonSet 需要具有集群中每个节点的 Pod:

$ oc get deployment,daemonset,pod --namespace <k8s-image-puller>验证 < kubernetes-image-puller >

ConfigMap的值。$ oc get configmap <kubernetes-image-puller> --output yaml

3.6. 配置可观察性

要配置 OpenShift Dev Spaces observability 功能,请参阅:

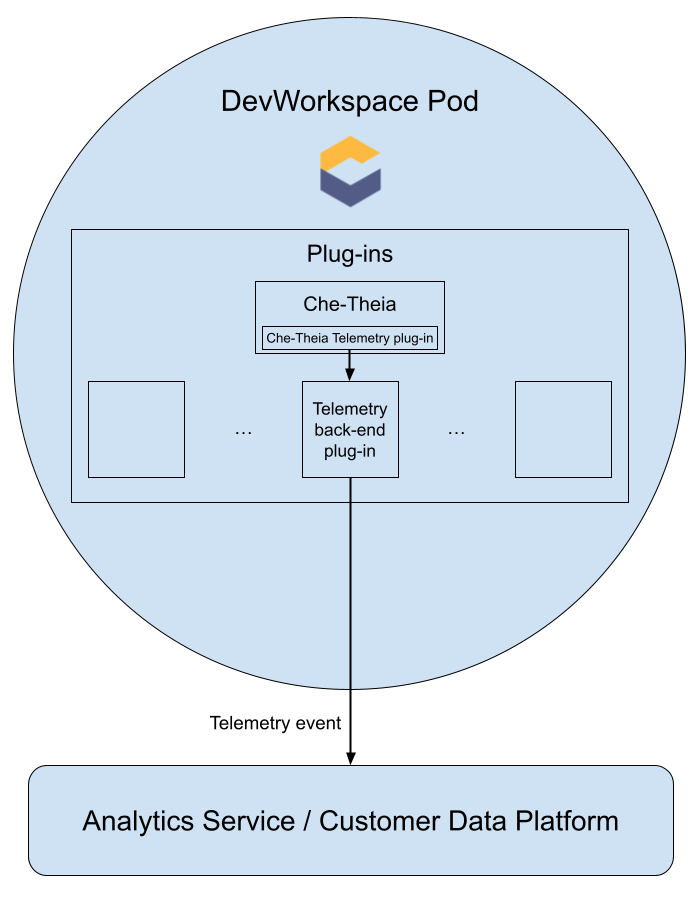

3.6.1. Che-Theia 工作区

3.6.1.1. Telemetry 概述

Telemetry 是操作数据的显式和 ethical 集合。默认情况下,Red Hat OpenShift Dev Spaces 不提供遥测(Telemetry),但在 Che- Theia 编辑器中提供了一个抽象 API,允许使用插件机制和 chectl 命令行工具使用数据来收集遥测。此方法用于"红帽托管的 Eclipse Che"服务"为每个 Che-Theia 工作区启用遥测(Telemetry)。

本文档包含介绍如何为 Red Hat OpenShift Dev Spaces 创建自己的遥测客户端,以及 Red Hat OpenShift Dev Spaces Woopra Telemetry 插件的概述信息。

3.6.1.2. 使用案例

Red Hat OpenShift Dev Spaces 遥测 API 允许跟踪:

- 工作区使用率的持续时间

- 用户驱动的操作,如文件编辑、提交和推送到远程存储库。

- 工作区中使用的编程语言和 devfile。

3.6.1.3. 如何使用

当 Dev Workspace 启动时,che-theia 容器会启动遥测插件,该插件负责将遥测事件发送到后端。如果在 Dev Workspace Pod 中设置了 $DEVWORKSPACE_TELEMETRY_BACKEND_PORT 环境变量,遥测插件会将事件发送到侦听该端口的后端。后端将接收的事件转换为特定于后端的事件,并将其发送到配置的分析后端(如 Segment 或 Woopra)。

3.6.1.4. Che-Theia telemetry 插件发送到后端的事件

| 事件 | Description |

|---|---|

| WORKSPACE_OPENED | 在 Che-Theia 启动时发送 |

| COMMIT_LOCALLY |

使用 |

| PUSH_TO_REMOTE |

使用 |

| EDITOR_USED | 在编辑器中更改文件时发送 |

在后端插件中可以检测到 WORKSPACE_INACTIVE 和 WORKSPACE_STOPPED 等其他事件。

3.6.1.5. Woopra 遥测插件

Woopra Telemetry 插件是一个插件,用于将遥测从 Red Hat OpenShift Dev Spaces 安装发送到 Segment 和 Woopra。此插件 由红帽托管的 Eclipse Che 使用,但任何 Red Hat OpenShift Dev Spaces 部署都可以利用这个插件。有效 Woopra 域和 Segment Write 密钥以外的依赖项没有依赖项。插件 plugin.yaml 的 devfile v2 具有四个环境变量,可传递给插件:

-

WOOPRA_DOMAIN- 将事件发送到的 Woopra 域。 -

SEGMENT_WRITE_KEY- 将事件发送到 Segment 和 Woopra 的写密钥。 -

WOOPRA_DOMAIN_ENDPOINT- 如果您更不希望直接传递 Woopra 域,则插件将从返回 Woopra Domain 的提供的 HTTP 端点中获取它。 -

SEGMENT_WRITE_KEY_ENDPOINT- 如果您更不希望直接传递写键,则插件将从返回的 Segment write 键的提供的 HTTP 端点中获取它。

要在 Red Hat OpenShift Dev Spaces 安装中启用 Woopra 插件:

流程

使用正确设置环境变量将

plugin.yamldevfile v2 文件部署到 HTTP 服务器。配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: devEnvironments: defaultPlugins: - editor: eclipse/che-theia/next 1 plugins: 2 - 'https://your-web-server/plugin.yaml'

3.6.1.6. 创建遥测插件

本节演示了如何创建扩展 AbstractAnalyticsManager 并实施以下方法的 AnalyticsManager 类:

-

isEnabled ()- 决定遥测后端是否正常运行。这可能意味着始终返回真,或者具有更复杂的检查,例如,当缺少连接属性时返回false。 -

destroy ()- 在关闭遥测后端前运行的清理方法。此方法发送WORKSPACE_STOPPED事件。 -

onActivity ()- 通知某些活动仍在为给定用户发生。这主要用于发送WORKSPACE_INACTIVE事件。 -

onEvent ()- 将遥测事件提交到遥测服务器,如WORKSPACE_USED或WORKSPACE_STARTED。 -

increaseDuration ()- 增加当前事件的持续时间,而不是以小时间内发送多个事件。

以下部分涵盖:

- 创建遥测服务器以将事件回显到标准输出.

- 扩展 OpenShift Dev Spaces 遥测客户端并实施用户的自定义后端。

-

创建一个

plugin.yaml文件,代表自定义后端的 Dev Workspace 插件。 -

通过从

CheCluster自定义资源设置workspacesDefaultPlugins属性,将自定义插件指定到 OpenShift Dev Spaces 的位置。

3.6.1.6.1. 开始使用

本文档描述了扩展 OpenShift Dev Spaces 遥测系统与自定义后端通信所需的步骤:

- 创建接收事件的服务器进程

- 扩展 OpenShift Dev Spaces 库以创建将事件发送到服务器的后端

- 将遥测后端打包到容器中,并将其部署到镜像 registry

- 为后端添加一个插件,并指示 OpenShift Dev Spaces 在 Dev Workspaces 中加载插件

如需完整的遥测后端示例,这里 提供了。

创建接收事件的服务器

出于演示目的,本例演示了如何创建从我们的遥测插件接收事件的服务器并将其写入标准输出。

对于生产环境,请考虑与第三方遥测系统(例如,Segment、Woopra)集成,而不是创建自己的遥测服务器。在这种情况下,使用供应商的 API 将事件从自定义后端发送到其系统。

以下 Go 代码在端口 8080 上启动一个服务器,并将事件写入标准输出:

例 3.12. main.go

package main

import (

"io/ioutil"

"net/http"

"go.uber.org/zap"

)

var logger *zap.SugaredLogger

func event(w http.ResponseWriter, req *http.Request) {

switch req.Method {

case "GET":

logger.Info("GET /event")

case "POST":

logger.Info("POST /event")

}

body, err := req.GetBody()

if err != nil {

logger.With("err", err).Info("error getting body")

return

}

responseBody, err := ioutil.ReadAll(body)

if err != nil {

logger.With("error", err).Info("error reading response body")

return

}

logger.With("body", string(responseBody)).Info("got event")

}

func activity(w http.ResponseWriter, req *http.Request) {

switch req.Method {

case "GET":

logger.Info("GET /activity, doing nothing")

case "POST":

logger.Info("POST /activity")

body, err := req.GetBody()

if err != nil {

logger.With("error", err).Info("error getting body")

return

}

responseBody, err := ioutil.ReadAll(body)

if err != nil {

logger.With("error", err).Info("error reading response body")

return

}

logger.With("body", string(responseBody)).Info("got activity")

}

}

func main() {

log, _ := zap.NewProduction()

logger = log.Sugar()

http.HandleFunc("/event", event)

http.HandleFunc("/activity", activity)

logger.Info("Added Handlers")

logger.Info("Starting to serve")

http.ListenAndServe(":8080", nil)

}

基于此代码创建容器镜像,并将它公开为 openshift-devspaces 项目中的 OpenShift 中的部署。示例遥测服务器的代码位于 telemetry-server-example。要部署遥测服务器,请克隆存储库并构建容器:

$ git clone https://github.com/che-incubator/telemetry-server-example $ cd telemetry-server-example $ podman build -t registry/organization/telemetry-server-example:latest . $ podman push registry/organization/telemetry-server-example:latest

manifest_with_ingress.yaml 和 manifest_with_route 包含 Deployment 和 Service 的定义。前者也定义了 Kubernetes Ingress,后者定义 OpenShift 路由。

在清单文件中,替换 image 和 host 字段,以匹配您推送的镜像和 OpenShift 集群的公共主机名。然后运行:

$ kubectl apply -f manifest_with_[ingress|route].yaml -n openshift-devspaces

3.6.1.6.2. 创建后端项目

为了在开发时进行快速反馈,建议在 Dev Workspace 内进行开发。这样,您可以在集群中运行应用程序并从前端遥测插件接收事件。

Maven Quarkus 项目构建:

mvn io.quarkus:quarkus-maven-plugin:2.7.1.Final:create \ -DprojectGroupId=mygroup -DprojectArtifactId=devworkspace-telemetry-example-plugin \ -DprojectVersion=1.0.0-SNAPSHOT-

删除

src/main/java/mygroup和src/test/java/mygroup下的文件。 -

参阅 GitHub 软件包 以获取最新版本的 Maven 与

backend-base协调。 在

pom.xml中添加以下依赖项:例 3.13.

pom.xml<!-- Required --> <dependency> <groupId>org.eclipse.che.incubator.workspace-telemetry</groupId> <artifactId>backend-base</artifactId> <version>LATEST VERSION FROM PREVIOUS STEP</version> </dependency> <!-- Used to make http requests to the telemetry server --> <dependency> <groupId>io.quarkus</groupId> <artifactId>quarkus-rest-client</artifactId> </dependency> <dependency> <groupId>io.quarkus</groupId> <artifactId>quarkus-rest-client-jackson</artifactId> </dependency>-

使用

read:packages权限创建个人访问令牌,以下载来自 GitHub 软件包的org.eclipse.che.incubator.workspace-telemetry:backend-base依赖项。 在

~/.m2/settings.xml文件中添加 GitHub 用户名、个人访问令牌和che-incubator存储库详情:例 3.14.

settings.xml<settings xmlns="http://maven.apache.org/SETTINGS/1.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance" xsi:schemaLocation="http://maven.apache.org/SETTINGS/1.0.0 http://maven.apache.org/xsd/settings-1.0.0.xsd"> <servers> <server> <id>che-incubator</id> <username>YOUR GITHUB USERNAME</username> <password>YOUR GITHUB TOKEN</password> </server> </servers> <profiles> <profile> <id>github</id> <activation> <activeByDefault>true</activeByDefault> </activation> <repositories> <repository> <id>central</id> <url>https://repo1.maven.org/maven2</url> <releases><enabled>true</enabled></releases> <snapshots><enabled>false</enabled></snapshots> </repository> <repository> <id>che-incubator</id> <url>https://maven.pkg.github.com/che-incubator/che-workspace-telemetry-client</url> </repository> </repositories> </profile> </profiles> </settings>

3.6.1.6.3. 创建分析管理器的强制实施并添加特殊逻辑

在 src/main/java/mygroup 下创建两个文件:

-

MainConfiguration.java- 包含提供给AnalyticsManager的配置。 -

AnalyticsManager.java- 包含特定于遥测系统的逻辑。

例 3.15. MainConfiguration.java

package org.my.group;

import java.util.Optional;

import javax.enterprise.context.Dependent;

import javax.enterprise.inject.Alternative;

import org.eclipse.che.incubator.workspace.telemetry.base.BaseConfiguration;

import org.eclipse.microprofile.config.inject.ConfigProperty;

@Dependent

@Alternative

public class MainConfiguration extends BaseConfiguration {

@ConfigProperty(name = "welcome.message") 1

Optional<String> welcomeMessage; 2

}- 1

- MicroProfile 配置注解用于注入

welcome.message配置。

有关如何设置特定于您的后端的配置属性的详情,请查看 Quarkus 配置参考指南。

例 3.16. AnalyticsManager.java

package org.my.group;

import java.util.HashMap;

import java.util.Map;

import javax.enterprise.context.Dependent;

import javax.enterprise.inject.Alternative;

import javax.inject.Inject;

import org.eclipse.che.incubator.workspace.telemetry.base.AbstractAnalyticsManager;

import org.eclipse.che.incubator.workspace.telemetry.base.AnalyticsEvent;

import org.eclipse.che.incubator.workspace.telemetry.finder.DevWorkspaceFinder;

import org.eclipse.che.incubator.workspace.telemetry.finder.UsernameFinder;

import org.eclipse.microprofile.rest.client.inject.RestClient;

import org.slf4j.Logger;

import static org.slf4j.LoggerFactory.getLogger;

@Dependent

@Alternative

public class AnalyticsManager extends AbstractAnalyticsManager {

private static final Logger LOG = getLogger(AbstractAnalyticsManager.class);

public AnalyticsManager(MainConfiguration mainConfiguration, DevWorkspaceFinder devworkspaceFinder, UsernameFinder usernameFinder) {

super(mainConfiguration, devworkspaceFinder, usernameFinder);

mainConfiguration.welcomeMessage.ifPresentOrElse( 1

(str) -> LOG.info("The welcome message is: {}", str),

() -> LOG.info("No welcome message provided")

);

}

@Override

public boolean isEnabled() {

return true;

}

@Override

public void destroy() {}

@Override

public void onEvent(AnalyticsEvent event, String ownerId, String ip, String userAgent, String resolution, Map<String, Object> properties) {

LOG.info("The received event is: {}", event); 2

}

@Override

public void increaseDuration(AnalyticsEvent event, Map<String, Object> properties) { }

@Override

public void onActivity() {}

}

由于 org.my.group.AnalyticsManager 和 org.my.group.MainConfiguration 是 alternative Bean,因此使用 src/main/resources/application.properties 中的 quarkus.arc.selected-alternatives 属性指定它们。

例 3.17. application.properties

quarkus.arc.selected-alternatives=MainConfiguration,AnalyticsManager

3.6.1.6.4. 在 Dev Workspace 中运行应用程序

在 Dev Workspace 中设置

DEVWORKSPACE_TELEMETRY_BACKEND_PORT环境变量。在这里,该值设置为4167。spec: template: attributes: workspaceEnv: - name: DEVWORKSPACE_TELEMETRY_BACKEND_PORT value: '4167'- 从 Red Hat OpenShift Dev Spaces 仪表板重启 Dev Workspace。

在 Dev Workspace 的终端窗口中运行以下命令启动应用程序。使用

--settings标志指定到包含 GitHub 访问令牌的settings.xml文件的位置的路径。$ mvn --settings=settings.xml quarkus:dev -Dquarkus.http.port=${DEVWORKSPACE_TELEMETRY_BACKEND_PORT}现在,应用程序通过前端插件的端口

4167接收遥测事件。

验证步骤

验证以下输出是否已记录:

INFO [org.ecl.che.inc.AnalyticsManager] (Quarkus Main Thread) No welcome message provided INFO [io.quarkus] (Quarkus Main Thread) devworkspace-telemetry-example-plugin 1.0.0-SNAPSHOT on JVM (powered by Quarkus 2.7.2.Final) started in 0.323s. Listening on: http://localhost:4167 INFO [io.quarkus] (Quarkus Main Thread) Profile dev activated. Live Coding activated. INFO [io.quarkus] (Quarkus Main Thread) Installed features: [cdi, kubernetes-client, rest-client, rest-client-jackson, resteasy, resteasy-jsonb, smallrye-context-propagation, smallrye-openapi, swagger-ui, vertx]

要验证

AnalyticsManager的onEvent ()方法是否从前端插件接收事件,请按 l 键来禁用 Quarkus 实时编码,并在 IDE 中编辑任何文件。应该记录以下输出:INFO [io.qua.dep.dev.RuntimeUpdatesProcessor] (Aesh InputStream Reader) Live reload disabled INFO [org.ecl.che.inc.AnalyticsManager] (executor-thread-2) The received event is: Edit Workspace File in Che

3.6.1.6.5. 实现 isEnabled ()

例如,每当方法被调用时,此方法总是返回 true。

例 3.18. AnalyticsManager.java

@Override

public boolean isEnabled() {

return true;

}

可以在 isEnabled () 中放入更复杂的逻辑。例如,托管的 OpenShift Dev Spaces Woopra 后端 会在确定是否启用了后端前检查配置属性是否存在。

3.6.1.6.6. 实施 onEvent ()

在Event ()上,将后端接收的事件发送到遥测系统。对于示例应用程序,它会将 HTTP POST 有效负载发送到遥测服务器的 /event 端点。

向示例遥测服务器发送 POST 请求

例如,遥测服务器应用通过以下 URL 部署到 OpenShift :http://little-telemetry-server-che.apps-crc.testing,其中 apps-crc.testing 是 OpenShift 集群的入口域名。

通过创建

TelemetryService.java来设置 RESTEasy REST 客户端例 3.19.

TelemetryService.javapackage org.my.group; import java.util.Map; import javax.ws.rs.Consumes; import javax.ws.rs.POST; import javax.ws.rs.Path; import javax.ws.rs.core.MediaType; import javax.ws.rs.core.Response; import org.eclipse.microprofile.rest.client.inject.RegisterRestClient; @RegisterRestClient public interface TelemetryService { @POST @Path("/event") 1 @Consumes(MediaType.APPLICATION_JSON) Response sendEvent(Map<String, Object> payload); }- 1

- 为

POST请求发出的端点。

在

src/main/resources/application.properties文件中指定TelemetryService的基本 URL:例 3.20.

application.propertiesorg.my.group.TelemetryService/mp-rest/url=http://little-telemetry-server-che.apps-crc.testing

将

TelemetryService注入AnalyticsManager并在Event ()中发送POST请求例 3.21.

AnalyticsManager.java@Dependent @Alternative public class AnalyticsManager extends AbstractAnalyticsManager { @Inject @RestClient TelemetryService telemetryService; ... @Override public void onEvent(AnalyticsEvent event, String ownerId, String ip, String userAgent, String resolution, Map<String, Object> properties) { Map<String, Object> payload = new HashMap<String, Object>(properties); payload.put("event", event); telemetryService.sendEvent(payload); }这会发送 HTTP 请求到遥测服务器,并在小时间内自动延迟相同的事件。默认持续时间为 1500 毫秒。

3.6.1.6.7. 实现 increaseDuration ()

许多遥测系统识别事件持续时间。AbstractAnalyticsManager 将同一时间段内出现的相同事件合并到一个事件中。这个 增强Duration () 的实现是 no-op。此方法使用用户遥测供应商的 API 更改事件或事件属性,以反映事件的增加持续时间。

例 3.22. AnalyticsManager.java

@Override

public void increaseDuration(AnalyticsEvent event, Map<String, Object> properties) {}3.6.1.6.8. 实施 onActivity ()

设置不活跃超时限制,并使用 onActivity () 发送 WORKSPACE_INACTIVE 事件(如果最后一次事件的时间超过超时时间)。

例 3.23. AnalyticsManager.java

public class AnalyticsManager extends AbstractAnalyticsManager {

...

private long inactiveTimeLimit = 60000 * 3;

...

@Override

public void onActivity() {

if (System.currentTimeMillis() - lastEventTime >= inactiveTimeLimit) {

onEvent(WORKSPACE_INACTIVE, lastOwnerId, lastIp, lastUserAgent, lastResolution, commonProperties);

}

}3.6.1.6.9. 实施 destroy ()

调用 destroy () 时,发送 WORKSPACE_STOPPED 事件并关闭任何资源,如连接池。

例 3.24. AnalyticsManager.java

@Override

public void destroy() {

onEvent(WORKSPACE_STOPPED, lastOwnerId, lastIp, lastUserAgent, lastResolution, commonProperties);

}

运行 mvn quarkus:dev,如 第 3.6.1.6.4 节 “在 Dev Workspace 中运行应用程序” 所述,并使用 Ctrl+C 终止应用程序,将 WORKSPACE_STOPPED 事件发送到服务器。

3.6.1.6.10. 打包 Quarkus 应用程序

有关在容器中打包应用程序的最佳说明,请参阅 Quarkus 文档。构建容器并将其推送到您选择的容器 registry。

用于构建使用 JVM 运行的 Quarkus 镜像的 Dockerfile 示例

例 3.25. Dockerfile.jvm

FROM registry.access.redhat.com/ubi8/openjdk-11:1.11

ENV LANG='en_US.UTF-8' LANGUAGE='en_US:en'

COPY --chown=185 target/quarkus-app/lib/ /deployments/lib/

COPY --chown=185 target/quarkus-app/*.jar /deployments/

COPY --chown=185 target/quarkus-app/app/ /deployments/app/

COPY --chown=185 target/quarkus-app/quarkus/ /deployments/quarkus/

EXPOSE 8080

USER 185

ENTRYPOINT ["java", "-Dquarkus.http.host=0.0.0.0", "-Djava.util.logging.manager=org.jboss.logmanager.LogManager", "-Dquarkus.http.port=${DEVWORKSPACE_TELEMETRY_BACKEND_PORT}", "-jar", "/deployments/quarkus-run.jar"]要构建镜像,请运行:

mvn package && \ podman build -f src/main/docker/Dockerfile.jvm -t image:tag .

构建 Quarkus 原生镜像的 Dockerfile 示例

例 3.26. Dockerfile.native

FROM registry.access.redhat.com/ubi8/ubi-minimal:8.5

WORKDIR /work/

RUN chown 1001 /work \

&& chmod "g+rwX" /work \

&& chown 1001:root /work

COPY --chown=1001:root target/*-runner /work/application

EXPOSE 8080

USER 1001

CMD ["./application", "-Dquarkus.http.host=0.0.0.0", "-Dquarkus.http.port=$DEVWORKSPACE_TELEMETRY_BACKEND_PORT}"]要构建镜像,请运行:

mvn package -Pnative -Dquarkus.native.container-build=true && \ podman build -f src/main/docker/Dockerfile.native -t image:tag .

3.6.1.6.11. 为您的插件创建 plugin.yaml

创建一个 plugin.yaml devfile v2 文件,该文件代表在 Dev Workspace Pod 中运行自定义后端的 Dev Workspace 插件。如需有关 devfile v2 的更多信息,请参阅 Devfile v2 文档

例 3.27. plugin.yaml

schemaVersion: 2.1.0

metadata:

name: devworkspace-telemetry-backend-plugin

version: 0.0.1

description: A Demo telemetry backend

displayName: Devworkspace Telemetry Backend

components:

- name: devworkspace-telemetry-backend-plugin

attributes:

workspaceEnv:

- name: DEVWORKSPACE_TELEMETRY_BACKEND_PORT

value: '4167'

container:

image: YOUR IMAGE 1

env:

- name: WELCOME_MESSAGE 2

value: 'hello world!'- 1

- 指定从 第 3.6.1.6.10 节 “打包 Quarkus 应用程序” 构建的容器镜像。

- 2

- 从 Example 4 设置

welcome.message可选配置属性的值。

通常,用户将此文件部署到公司 Web 服务器。本指南说明了如何在 OpenShift 中创建 Apache Web 服务器并托管该插件。

创建一个 ConfigMap 对象来引用新 plugin.yaml 文件。

$ oc create configmap --from-file=plugin.yaml -n openshift-devspaces telemetry-plugin-yaml

创建部署、服务和公开 Web 服务器的路由。部署引用此 ConfigMap 对象,并将其放置在 /var/www/html 目录中。

例 3.28. manifest.yaml

kind: Deployment

apiVersion: apps/v1

metadata:

name: apache

spec:

replicas: 1

selector:

matchLabels:

app: apache

template:

metadata:

labels:

app: apache

spec:

volumes:

- name: plugin-yaml

configMap:

name: telemetry-plugin-yaml

defaultMode: 420

containers:

- name: apache

image: 'registry.redhat.io/rhscl/httpd-24-rhel7:latest'

ports:

- containerPort: 8080

protocol: TCP

resources: {}

volumeMounts:

- name: plugin-yaml

mountPath: /var/www/html

strategy:

type: RollingUpdate

rollingUpdate:

maxUnavailable: 25%

maxSurge: 25%

revisionHistoryLimit: 10

progressDeadlineSeconds: 600

---

kind: Service

apiVersion: v1

metadata:

name: apache

spec:

ports:

- protocol: TCP

port: 8080

targetPort: 8080

selector:

app: apache

type: ClusterIP

---

kind: Route

apiVersion: route.openshift.io/v1

metadata:

name: apache

spec:

host: apache-che.apps-crc.testing

to:

kind: Service

name: apache

weight: 100

port:

targetPort: 8080

wildcardPolicy: None$ oc apply -f manifest.yaml

验证步骤

部署启动后,确认 web 服务器中存在

plugin.yaml:$ curl apache-che.apps-crc.testing/plugin.yaml

3.6.1.6.12. 在 Dev Workspace 中指定遥测插件

在现有 Dev Workspace 的

components字段中添加以下内容:components: ... - name: telemetry-plug-in plugin: uri: http://apache-che.apps-crc.testing/plugin.yaml- 从 OpenShift Dev Spaces 仪表板启动 Dev Workspace。

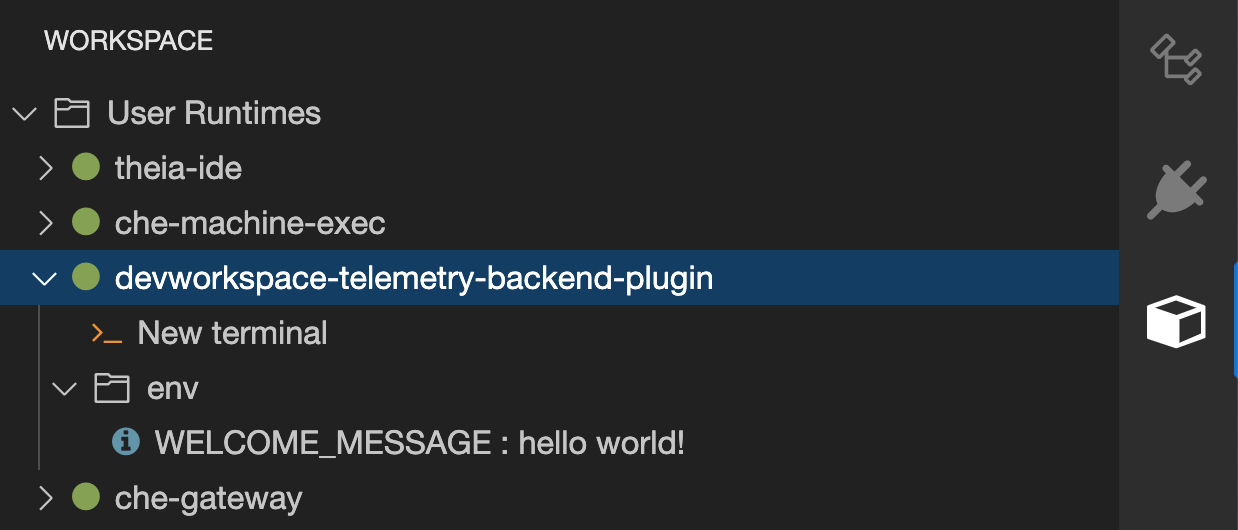

验证步骤

验证

telemetry-plug-in容器是否在 Dev Workspace pod 中运行。此处可以通过检查编辑器中的 Workspace 视图来验证这一点。

- 在编辑器中编辑文件,并在示例遥测服务器日志中观察其事件。

3.6.1.6.13. 为所有 Dev Workspaces 应用遥测插件

将遥测插件设置为默认插件。默认插件应用于新和现有的 Dev Workspaces 的 Dev Workspace 启动。

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: devEnvironments: defaultPlugins: - editor: eclipse/che-theia/next 1 plugins: 2 - 'http://apache-che.apps-crc.testing/plugin.yaml'

验证步骤

- 从 Red Hat OpenShift Dev Spaces 仪表板启动新的或现有的 Dev Workspace。

- 按照 第 3.6.1.6.12 节 “在 Dev Workspace 中指定遥测插件” 的验证步骤,验证遥测插件是否正常工作。

3.6.2. 配置服务器日志记录

可以微调 OpenShift Dev Spaces 服务器中可用的各个日志记录器的日志级别。

整个 OpenShift Dev Spaces 服务器的日志级别使用 Operator 的 cheLogLevel 配置属性全局配置。请参阅 第 3.1.3 节 “CheCluster 自定义资源字段参考”。要在不由 Operator 管理的安装中设置全局日志级别,请在 che ConfigMap 中指定 CHE_LOG_LEVEL 环境变量。

可以使用 CHE_LOGGER_CONFIG 环境变量在 OpenShift Dev Spaces 服务器中配置各个日志记录器的日志级别。

3.6.2.1. 配置日志级别

流程

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: components: cheServer: extraProperties: CHE_LOGGER_CONFIG: "<key1=value1,key2=value2>" 1- 1

- 以逗号分隔的键值对列表,其中键是日志记录器的名称,如 OpenShift Dev Spaces 服务器日志输出和值中所示。

例 3.29. 为

WorkspaceManager配置调试模式spec: components: cheServer: extraProperties: CHE_LOGGER_CONFIG: "org.eclipse.che.api.workspace.server.WorkspaceManager=DEBUG"

3.6.2.2. 日志记录器命名

日志记录器的名称遵循使用这些日志记录器的内部服务器类的类名称。

3.6.2.3. 日志记录 HTTP 流量

流程

要记录 OpenShift Dev Spaces 服务器和 Kubernetes 或 OpenShift 集群的 API 服务器之间的 HTTP 流量,请配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: components: cheServer: extraProperties: CHE_LOGGER_CONFIG: "che.infra.request-logging=TRACE"

3.6.3. 使用 dsc 收集日志

安装 Red Hat OpenShift Dev Spaces 包括几个在 OpenShift 集群中运行的容器。虽然可以从每个运行中的容器手动收集日志,但 dsc 提供了可自动化此过程的命令。

以下命令可使用 dsc 工具从 OpenShift 集群收集 Red Hat OpenShift Dev Spaces 日志:

dsc server:logs收集现有的 Red Hat OpenShift Dev Spaces 服务器日志,并将它们存储在本地计算机上的一个目录中。默认情况下,日志会下载到机器的临时目录中。但是,这可以通过指定

-d参数来覆盖。例如,要将 OpenShift Dev Spaces 日志下载到/home/user/che-logs/目录,请使用 命令dsc server:logs -d /home/user/che-logs/

运行时,

dsc server:logs会在控制台中指定存储日志文件的目录信息:Red Hat OpenShift Dev Spaces logs will be available in '/tmp/chectl-logs/1648575098344'

如果在非默认项目中安装了 Red Hat OpenShift Dev Spaces,则

dsc server:logs需要-n <NAMESPACE> paremeter,其中 <NAMESPACE> 是 Red Hat OpenShift Dev Spaces 的 OpenShift 项目。例如,若要从my-namespace项目中的 OpenShift Dev Spaces 获取日志,请使用 命令dsc server:logs -n my-namespace

dsc server:deploy-

使用

dsc安装时,会在 OpenShift Dev Spaces 安装过程中自动收集日志。与dsc server:logs一样,可以使用-d参数来指定目录日志存储在 中。

其他资源

- "DSC 参考文档"

3.6.4. 使用 Prometheus 和 Grafana 监控

您可以使用集群中运行的 Prometheus 和 Grafana 实例收集并查看 OpenShift Dev Spaces 指标。

3.6.4.1. 安装 Prometheus 和 Grafana

您可以通过应用 template.yaml 来安装 Prometheus 和 Grafana。本例中的 template.yaml 文件提供了基本配置、Deployment 和 Services 的监控堆栈,以便开始使用 Prometheus 和 Grafana。

另外,您可以使用 Prometheus Operator 和 Grafana Operator。

先决条件

- oc

流程

使用 template.yaml 安装 Prometheus 和 Grafana:

为 Prometheus 和 Grafana 创建一个新项目,

监控:$ oc new-project monitoring

在

monitoring项目中应用template.yaml:$ oc apply -f template.yaml -n monitoring

例 3.30. template.yaml

---

apiVersion: v1

kind: Service

metadata:

name: grafana

labels:

app: grafana

spec:

ports:

- name: 3000-tcp

port: 3000

protocol: TCP

targetPort: 3000

selector:

app: grafana

---

apiVersion: v1

kind: Service

metadata:

name: prometheus

labels:

app: prometheus

spec:

ports:

- name: 9090-tcp

port: 9090

protocol: TCP

targetPort: 9090

selector:

app: prometheus

---

apiVersion: apps/v1

kind: Deployment

metadata:

labels:

app: grafana

name: grafana

spec:

selector:

matchLabels:

app: grafana

template:

metadata:

labels:

app: grafana

spec:

containers:

- image: registry.redhat.io/rhel8/grafana:7

name: grafana

ports:

- containerPort: 3000

protocol: TCP

---

apiVersion: apps/v1

kind: Deployment

metadata:

labels:

app: prometheus

name: prometheus

spec:

selector:

matchLabels:

app: prometheus

template:

metadata:

labels:

app: prometheus

spec:

serviceAccountName: prometheus

containers:

- image: quay.io/prometheus/prometheus:v2.36.0

name: prometheus

ports:

- containerPort: 9090

protocol: TCP

volumeMounts:

- mountPath: /prometheus

name: volume-data

- mountPath: /etc/prometheus/prometheus.yml

name: volume-config

subPath: prometheus.yml

volumes:

- emptyDir: {}

name: volume-data

- configMap:

defaultMode: 420

name: prometheus-config

name: volume-config

---

apiVersion: v1

kind: ConfigMap

metadata:

name: prometheus-config

data:

prometheus.yml: ""

---

apiVersion: v1

kind: ServiceAccount

metadata:

name: prometheus

---3.6.4.2. 监控 Dev Workspace Operator

您可以配置一个监控堆栈示例,以处理 Dev Workspace Operator 公开的指标。

3.6.4.2.1. 使用 Prometheus 收集 Dev Workspace Operator 指标

使用 Prometheus 收集、存储和查询 Dev Workspace Operator 的指标:

先决条件

-

devworkspace-controller-metricsService 是在端口8443上公开指标。默认预配置。 -

devworkspace-webhookserver服务在端口9443上公开指标。默认预配置。 -

Prometheus 2.26.0 或更高版本正在运行。Prometheus 控制台在端口

9090上运行,并带有相应的服务。请参阅 Prometheus 的第一个步骤。

流程

创建一个 ClusterRoleBinding 将与 Prometheus 关联的 ServiceAccount 绑定到 devworkspace-controller-metrics-reader ClusterRole。对于 监控堆栈示例,要使用的 ServiceAccount 的名称是

prometheus。注意如果没有 ClusterRoleBinding,您无法访问 Dev Workspace 指标,因为访问使用基于角色的访问控制(RBAC)进行保护。

例 3.31. ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRoleBinding metadata: name: devworkspace-controller-metrics-binding subjects: - kind: ServiceAccount name: prometheus namespace: monitoring roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: devworkspace-controller-metrics-reader将 Prometheus 配置为从

devworkspace-controller-metricsService 公开的端口8443中提取指标,再从devworkspace-webhookserverService 公开的端口9443中提取指标。注意监控堆栈示例 已创建了带有空配置的

prometheus-configConfigMap。要提供 Prometheus 配置详情,请编辑 ConfigMap 的data字段。例 3.32. Prometheus 配置

apiVersion: v1 kind: ConfigMap metadata: name: prometheus-config namespace: monitoring data: prometheus.yml: |- global: scrape_interval: 5s 1 evaluation_interval: 5s 2 scrape_configs: 3 - job_name: 'DevWorkspace' scheme: https authorization: type: Bearer credentials_file: '/var/run/secrets/kubernetes.io/serviceaccount/token' tls_config: insecure_skip_verify: true static_configs: - targets: ['devworkspace-controller-metrics.<DWO_project>:8443'] 4 - job_name: 'DevWorkspace webhooks' scheme: https authorization: type: Bearer credentials_file: '/var/run/secrets/kubernetes.io/serviceaccount/token' tls_config: insecure_skip_verify: true static_configs: - targets: ['devworkspace-webhookserver.<DWO_project>:9443'] 5- 1

- 抓取目标的速率。

- 2

- 重新检查记录和警报规则的速率。

- 3

- Prometheus 监控的资源。在默认配置中,两个作业是

DevWorkspace和DevWorkspace Webhook,提取由devworkspace-controller-metrics和devworkspace-webhookserver服务公开的时间序列数据。 - 4

- 来自端口

8443的指标的修整目标。将<DWO_project> 替换为devworkspace-controller-metricsService所在的项目。 - 5

- 来自端口

9443的指标的修整目标。将<DWO_project> 替换为devworkspace-webhookserverService所在的项目。

缩减

PrometheusDeployment 并向上读取上一步中更新的 ConfigMap。$ oc scale --replicas=0 deployment/prometheus -n monitoring && oc scale --replicas=1 deployment/prometheus -n monitoring

验证

使用端口转发在本地访问

Prometheus服务:$ oc port-forward svc/prometheus 9090:9090 -n monitoring

-

通过查看

localhost:9090/targets上的目标端点来验证所有目标是否已启动。 使用 Prometheus 控制台查看和查询指标:

-

查看

localhost:9090/metrics上的指标。 从

localhost:9090/graph来查询指标。如需更多信息,请参阅使用表达式浏览器。

-

查看

3.6.4.2.2. dev Workspace 特定的指标

下表描述了 devworkspace-controller-metrics 服务公开的 Dev Workspace 特定指标。

表 3.20. 指标

| 名称 | 类型 | Description | 标签 |

|---|---|---|---|

|

| 计数 | Dev Workspace 启动事件的数量。 |

|

|

| 计数 |

Dev Workspaces 的数量成功进入 |

|

|

| 计数 | 失败的 Dev Workspaces 数量。 |

|

|

| Histogram | 启动 Dev Workspace 所需的时间(以秒为单位)。 |

|

表 3.21. 标签

| 名称 | Description | 值 |

|---|---|---|

|

|

Dev Workspace 的 |

|

|

|

Dev Workspace 的 |

|

|

| 工作区启动失败的原因。 |

|

表 3.22. 启动故障原因

| 名称 | Description |

|---|---|

|

| 由于用于创建 Dev Workspace 的 devfile 无效,启动失败。 |

|

|

由于以下错误导致启动失败: |

|

| 未知故障原因. |

3.6.4.2.3. 在 Grafana 仪表板中查看 Dev Workspace Operator 指标

使用示例仪表板查看 Grafana 上的 Dev Workspace Operator 指标:

先决条件

- Prometheus 收集指标。请参阅 第 3.6.4.2.1 节 “使用 Prometheus 收集 Dev Workspace Operator 指标”。

- Grafana 版本 7.5.3 或更高版本。

-

Grafana 在带有对应服务的端口

3000上运行。请参阅安装 Grafana。

流程

- 为 Prometheus 实例添加数据源。请参阅创建 Prometheus 数据源。

-

导入 示例

grafana-dashboard.json仪表板。

验证步骤

- 使用 Grafana 控制台查看 Dev Workspace Operator 指标仪表板。请参阅 第 3.6.4.2.4 节 “Dev Workspace Operator 的 Grafana 仪表板”。

其他资源

3.6.4.2.4. Dev Workspace Operator 的 Grafana 仪表板

基于 grafana-dashboard.json 的 Grafana 仪表板示例从 Dev Workspace Operator 中显示以下指标。

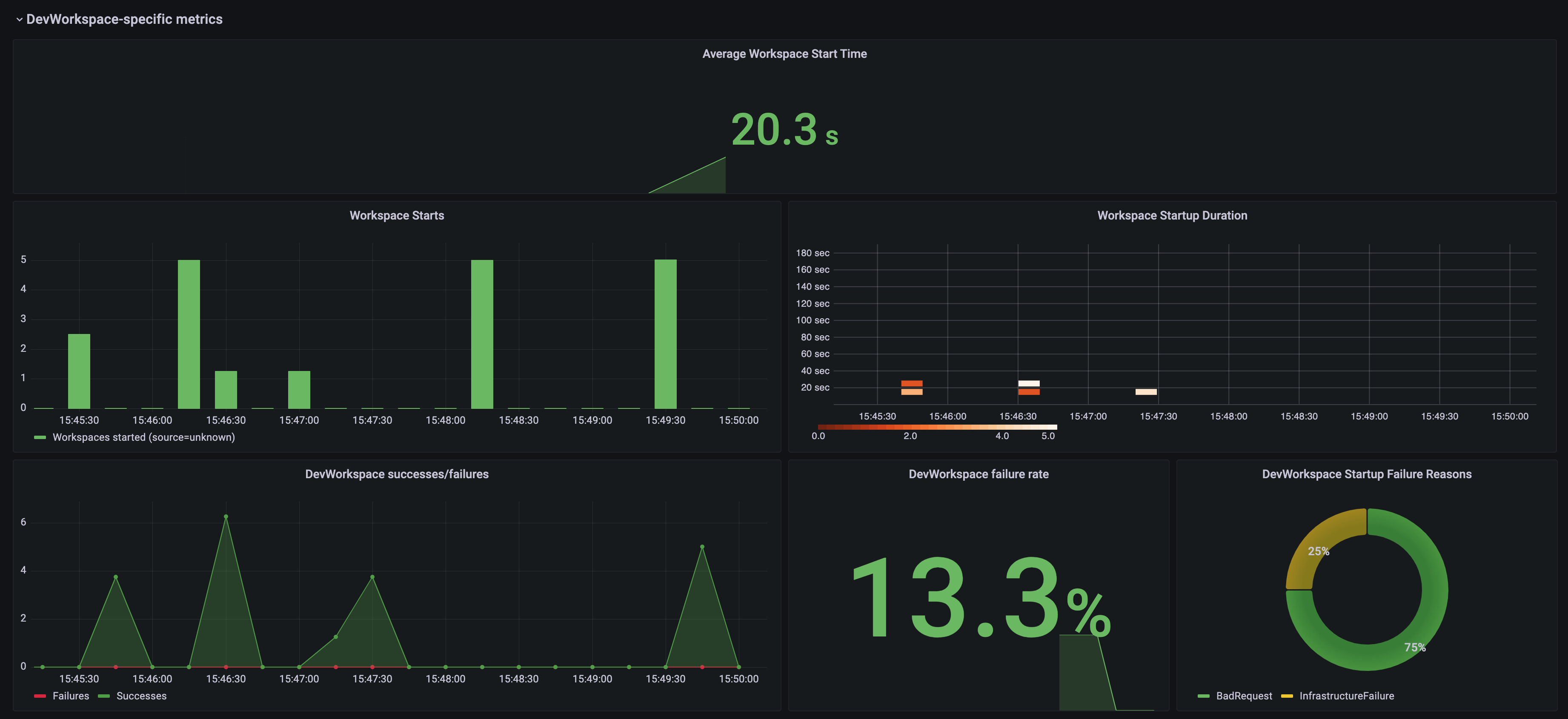

Dev Workspace 特定的指标 面板

图 3.1. Dev Workspace 特定的指标 面板

- 平均工作空间开始时间

- 平均工作空间启动持续时间。

- Workspace start

- 成功和失败的工作区启动数量。

- 工作区启动持续时间

- 显示工作空间启动持续时间的 heatmap。

- dev Workspace 成功/失败

- 成功和失败的 Dev Workspace 启动之间的比较。

- dev Workspace 失败率

- 失败的工作区启动数和总工作空间启动数量之间的比例。

- Dev Workspace 启动失败原因

显示工作空间启动失败分布的饼图:

-

BadRequest -

InfrastructureFailure -

Unknown

-

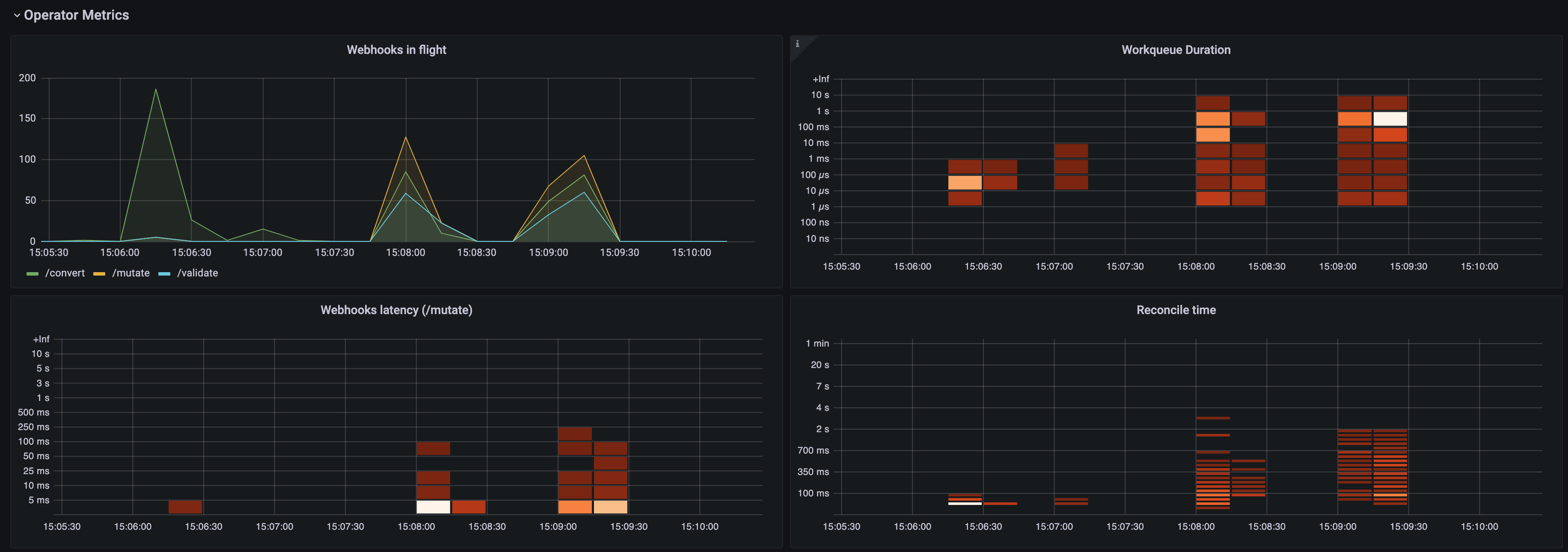

Operator 指标 面板(第 1 部分)

图 3.2. Operator 指标 面板(第 1 部分)

- flight 中的 Webhook

- 不同 webhook 请求的数量之间的比较。

- 工作队列持续时间

- heatmap 显示在处理前协调请求在工作队列中的时长。

- Webhook 延迟(/mutate)

-

显示

/mutateWebhook 延迟的 heatmap。 - 协调时间

- 显示协调持续时间的 heatmap。

Operator 指标 面板(第 2 部分)

图 3.3. Operator 指标 面板(第 2 部分)

- Webhook 延迟(/convert)

-

显示

/convertwebhook 延迟的 heatmap。 - 工作队列深度

- 工作队列中的协调请求数。

- 内存

- Dev Workspace 控制器和 Dev Workspace Webhook 服务器的内存用量。

- 协调计数(DWO)

- Dev Workspace 控制器的平均协调数。

3.6.4.3. 监控 Dev Spaces 服务器

您可以配置 OpenShift Dev Spaces 以公开 JVM 指标,如 JVM 内存和 OpenShift Dev Spaces 服务器的类加载。

3.6.4.3.1. 启用并公开 OpenShift Dev Spaces 服务器指标

OpenShift Dev Spaces 在 che-host 服务的端口 8087 上公开 JVM 指标。您可以配置这个行为。

流程

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: components: metrics: enable: <boolean> 1- 1

true可启用,false以禁用。

3.6.4.3.2. 使用 Prometheus 收集 OpenShift Dev Spaces 服务器指标

使用 Prometheus 为 OpenShift Dev Spaces 服务器收集、存储和查询 JVM 指标:

先决条件

-

OpenShift Dev Spaces 是在端口

8087上公开指标。请参阅启用和公开 OpenShift Dev Spaces 服务器 JVM 指标。 -

Prometheus 2.26.0 或更高版本正在运行。Prometheus 控制台在端口

9090上运行,并带有相应的服务。请参阅 Prometheus 的第一个步骤。

流程

将 Prometheus 配置为从端口

8087中提取指标。注意监控堆栈示例 已创建了带有空配置的

prometheus-configConfigMap。要提供 Prometheus 配置详情,请编辑 ConfigMap 的data字段。例 3.33. Prometheus 配置

apiVersion: v1 kind: ConfigMap metadata: name: prometheus-config data: prometheus.yml: |- global: scrape_interval: 5s 1 evaluation_interval: 5s 2 scrape_configs: 3 - job_name: 'OpenShift Dev Spaces Server' static_configs: - targets: ['che-host.<OpenShift Dev Spaces_project>:8087'] 4缩减

PrometheusDeployment 并向上读取上一步中更新的 ConfigMap。$ oc scale --replicas=0 deployment/prometheus -n monitoring && oc scale --replicas=1 deployment/prometheus -n monitoring

验证

使用端口转发在本地访问

Prometheus服务:$ oc port-forward svc/prometheus 9090:9090 -n monitoring

-

通过查看

localhost:9090/targets上的目标端点来验证所有目标是否已启动。 使用 Prometheus 控制台查看和查询指标:

-

查看

localhost:9090/metrics上的指标。 从

localhost:9090/graph来查询指标。如需更多信息,请参阅使用表达式浏览器。

-

查看

3.6.4.3.3. 在 Grafana 仪表板中查看 OpenShift Dev Spaces Server 指标

查看 Grafana 上的 OpenShift Dev Spaces 服务器指标:

先决条件

- Prometheus 收集 OpenShift Dev Spaces 集群上的指标。请参阅 第 3.6.4 节 “使用 Prometheus 和 Grafana 监控”。

-

Grafana 6.0 或更高版本使用对应的服务在端口

3000上运行。请参阅安装 Grafana。

流程

- 为 Prometheus 实例添加数据源。请参阅创建 Prometheus 数据源。

- 导入示例 仪表板。请参阅 导入仪表板。

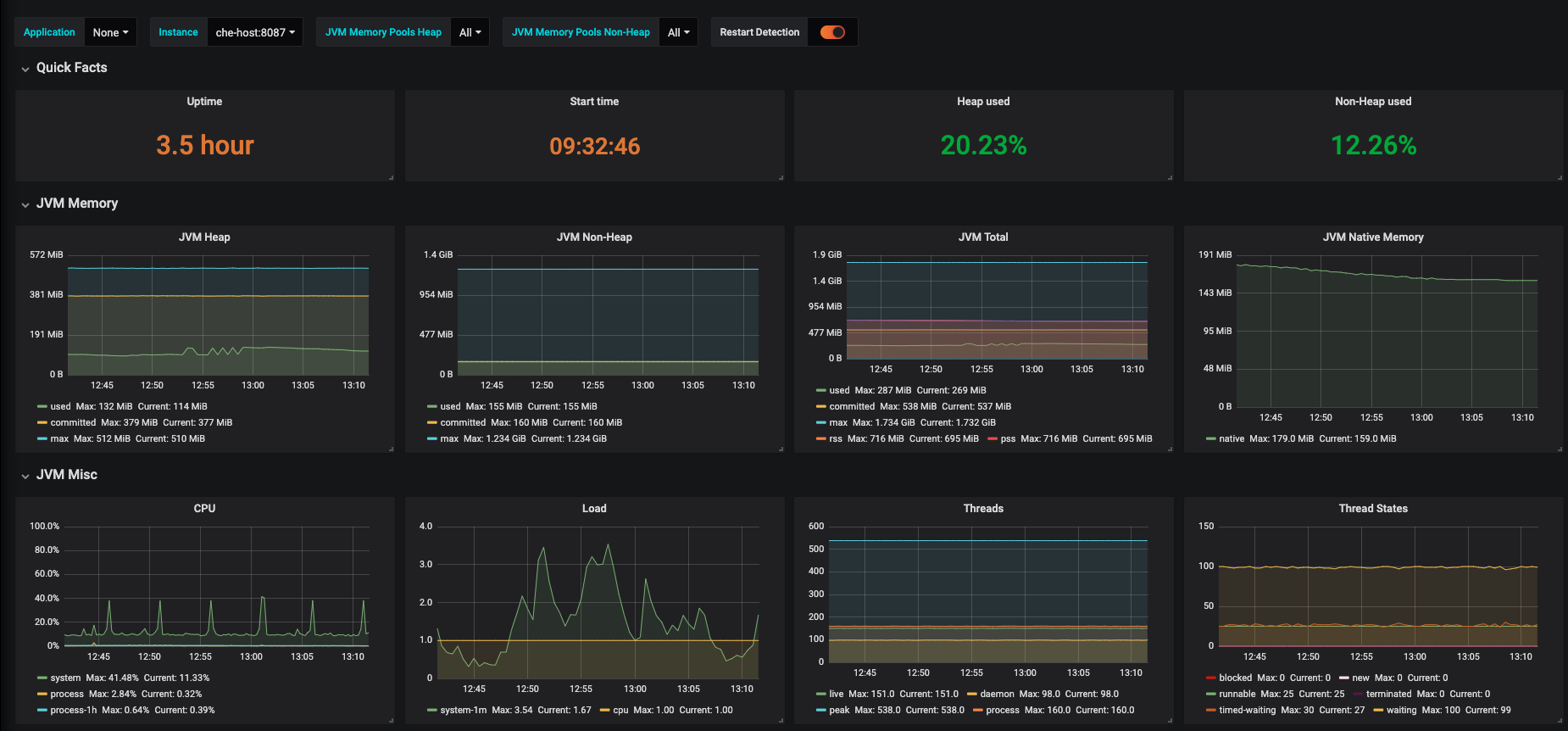

在 Grafana 控制台中查看 OpenShift Dev Spaces JVM 指标:

图 3.4. OpenShift Dev Spaces 服务器 JVM 仪表板

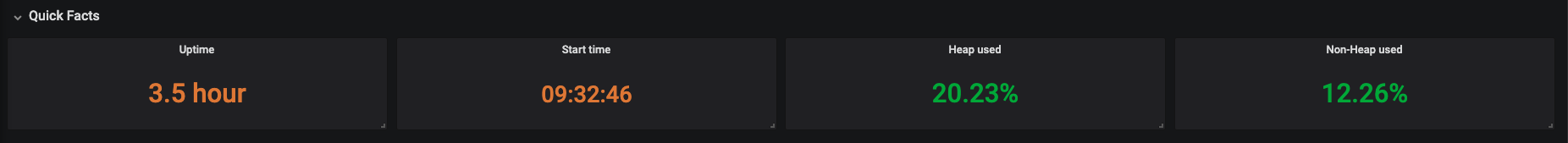

图 3.5. 快速事实

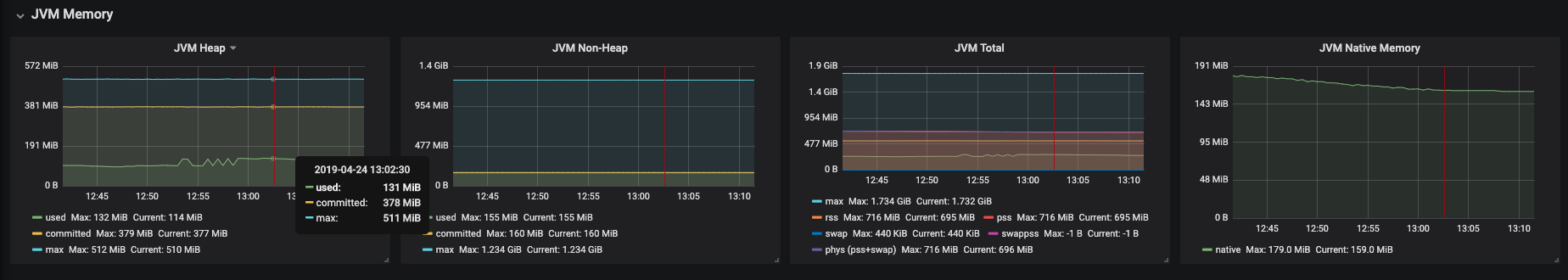

图 3.6. JVM 内存

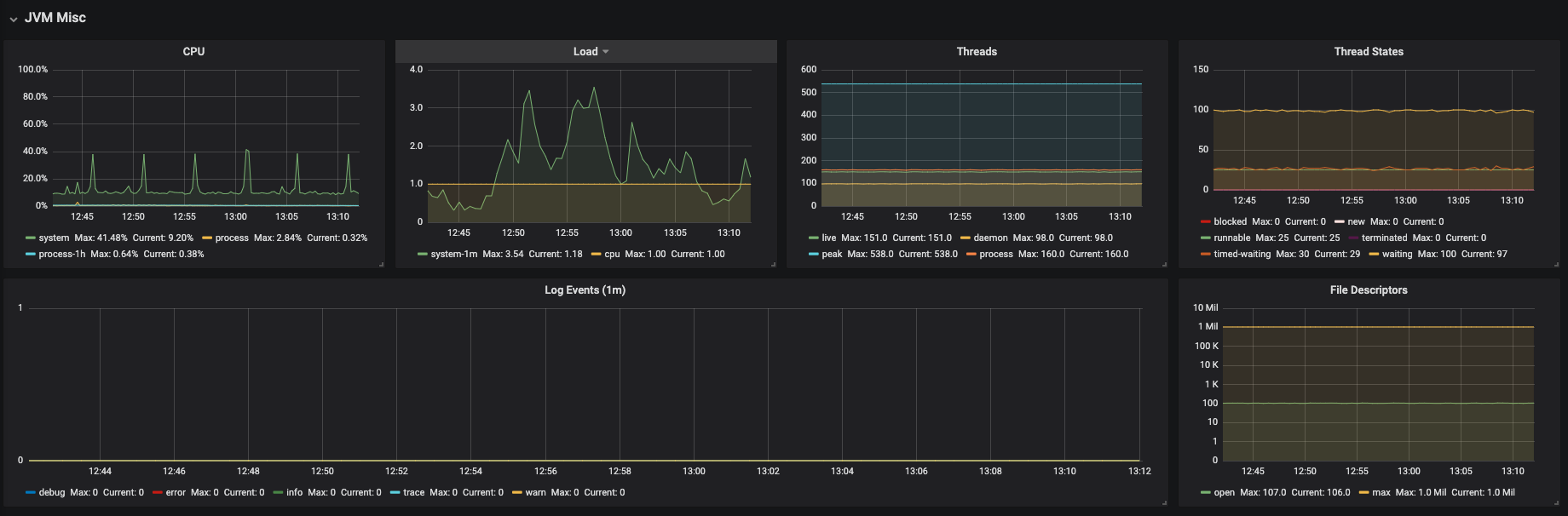

图 3.7. JVM Misc

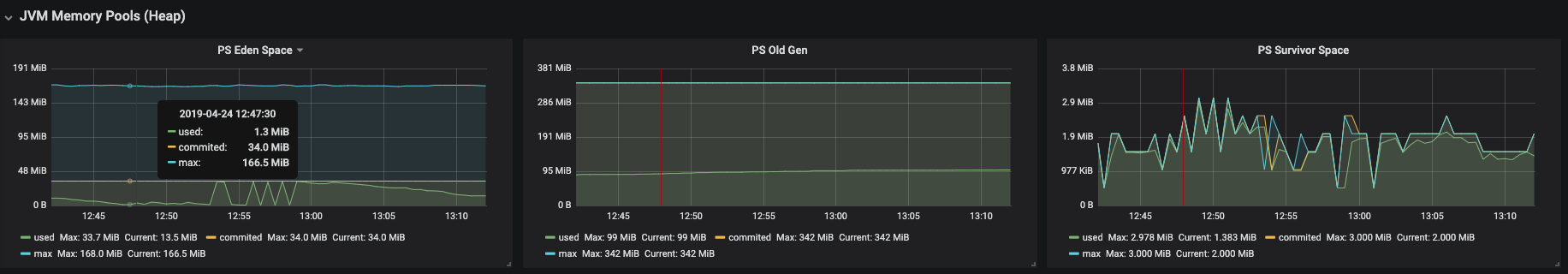

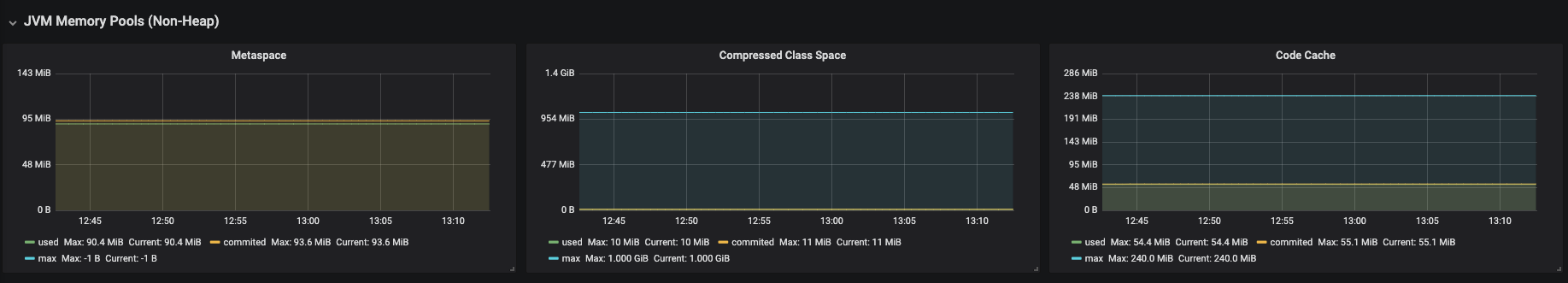

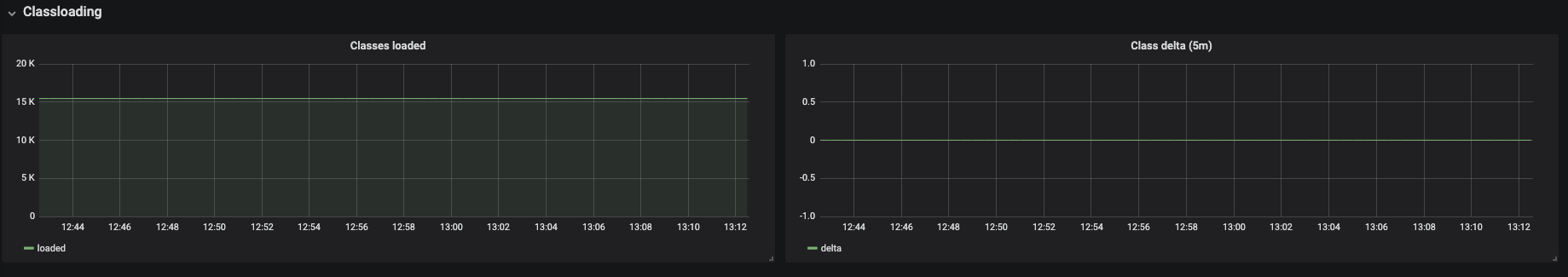

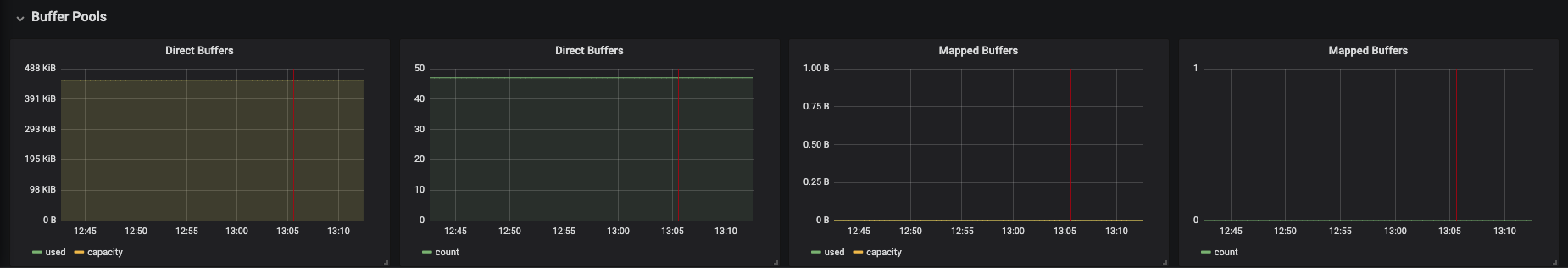

图 3.8. JVM 内存池(heap)

图 3.9. JVM 内存限值(Non-Heap)

图 3.10. 垃圾回收

图 3.11. 类载入

图 3.12. 缓冲池

3.7. 配置网络

3.7.1. 配置网络策略

默认情况下,OpenShift 集群中的所有 Pod 都可以相互通信,即使它们位于不同的命名空间中。在 OpenShift Dev Spaces 上下文中,这会导致一个用户项目中的工作空间 Pod 将流量发送到另一个用户项目中的另一个工作区 Pod。

为安全起见,可以使用 NetworkPolicy 对象配置多租户隔离来限制用户项目中的 Pod 的所有传入通信。但是,OpenShift Dev Spaces 项目中的 Pod 必须能够与用户项目中的 Pod 通信。

先决条件

- OpenShift 集群具有网络限制,如多租户隔离。

流程

将

allow-from-openshift-devspacesNetworkPolicy 应用到每个用户项目。allow-from-openshift-devspacesNetworkPolicy 允许从 OpenShift Dev Spaces 命名空间进入到用户项目中的所有 Pod 的流量。例 3.34.

allow-from-openshift-devspaces.yamlapiVersion: networking.k8s.io/v1 kind: NetworkPolicy metadata: name: allow-from-openshift-devspaces spec: ingress: - from: - namespaceSelector: matchLabels: kubernetes.io/metadata.name: openshift-devspaces 1 podSelector: {} 2 policyTypes: - Ingress

3.7.2. 配置 Dev Spaces 主机名

此流程描述了如何配置 OpenShift Dev Spaces 来使用自定义主机名。

先决条件

-

具有对目标 OpenShift 集群的管理权限的活跃

oc会话。请参阅 CLI 入门。 - 生成证书和私钥文件。

要生成私钥和证书的对,必须将相同的证书颁发机构(CA)用作其他 OpenShift Dev Spaces 主机。

要求 DNS 供应商将自定义主机名指向集群入口。

流程

为 OpenShift Dev Spaces 预先创建一个项目:

$ oc create project openshift-devspaces

创建 TLS secret:

$ oc create secret TLS <tls_secret_name> \ 1 --key <key_file> \ 2 --cert <cert_file> \ 3 -n openshift-devspaces

在 secret 中添加所需的标签:

$ oc label secret <tls_secret_name> \ 1 app.kubernetes.io/part-of=che.eclipse.org -n openshift-devspaces

- 1

- TLS secret 名称

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: networking: hostname: <hostname> 1 tlsSecretName: <secret> 2- 如果已经部署了 OpenShift Dev Spaces,请等待所有 OpenShift Dev Spaces 组件完成。

3.7.3. 将不受信任的 TLS 证书导入到 Dev Spaces

OpenShift Dev Spaces 组件与外部服务通信使用 TLS 加密。它们需要由可信证书颁发机构(CA)签名的 TLS 证书。因此,您必须导入到 OpenShift Dev Spaces 中由外部服务使用的所有不可信 CA 链,例如:

- 代理

- 身份提供程序(OIDC)

- 源代码存储库供应商(Git)

OpenShift Dev Spaces 在 OpenShift Dev Spaces 项目中使用标记的配置映射作为 TLS 证书的源。配置映射可以有一个任意数量的密钥,每个密钥都有随机的证书。

当 OpenShift 集群包含通过 cluster- wide-proxy 配置 添加的集群范围的可信 CA 证书时,OpenShift Dev Spaces Operator 会检测到它们,并使用 config.openshift.io/inject-trusted-cabundle="true" 标签自动注入配置映射。根据此注解,OpenShift 会自动在配置映射的 ca-bundle.crt 键内自动注入集群范围的可信 CA 证书。

先决条件

流程

将要导入的所有 CA 链 PEM 文件串联到

custom-ca-certificates.pem文件中,并删除与 Java 信任存储不兼容的返回字符。$ cat ca-cert-for-{prod-id-short}-*.pem | tr -d '\r' > custom-ca-certificates.pem使用所需 TLS 证书创建

custom-ca-certificates配置映射:$ oc create configmap custom-ca-certificates \ --from-file=custom-ca-certificates.pem \ --namespace=openshift-devspaces标记

custom-ca-certificates配置映射:$ oc label configmap custom-ca-certificates \ app.kubernetes.io/component=ca-bundle \ app.kubernetes.io/part-of=che.eclipse.org \ --namespace=openshift-devspaces- 如果 OpenShift Dev Spaces 之前尚未部署,则部署 OpenShift Dev Spaces。否则,请等待 OpenShift Dev Spaces 组件的推出完成。

- 重启正在运行的工作区以使更改生效。

验证步骤

验证配置映射是否包含自定义 CA 证书。这个命令以 PEM 格式返回您的自定义 CA 证书:

$ oc get configmap \ --namespace=openshift-devspaces \ --output='jsonpath={.items[0:].data.custom-ca-certificates\.pem}' \ --selector=app.kubernetes.io/component=ca-bundle,app.kubernetes.io/part-of=che.eclipse.org验证 OpenShift Dev Spaces pod 包含挂载

ca-certs-merged配置映射的卷:$ oc get pod \ --selector=app.kubernetes.io/component=devspaces \ --output='jsonpath={.items[0].spec.volumes[0:].configMap.name}' \ --namespace=openshift-devspaces \ | grep ca-certs-merged验证 OpenShift Dev Spaces 服务器容器是否有自定义 CA 证书。这个命令以 PEM 格式返回您的自定义 CA 证书:

$ oc exec -t deploy/devspaces \ --namespace=openshift-devspaces \ -- cat /public-certs/custom-ca-certificates.pem在 OpenShift Dev Spaces 服务器中验证导入的证书计数是否不为空:

$ oc logs deploy/devspaces --namespace=openshift-devspaces \ | grep custom-ca-certificates.pem列出证书的 SHA256 指纹:

$ for certificate in ca-cert*.pem ; do openssl x509 -in $certificate -digest -sha256 -fingerprint -noout | cut -d= -f2; done

验证 OpenShift Dev Spaces 服务器 Java 信任存储是否包含具有相同指纹的证书:

$ oc exec -t deploy/devspaces --namespace=openshift-devspaces -- \ keytool -list -keystore /home/user/cacerts \ | grep --after-context=1 custom-ca-certificates.pem- 启动工作区,获取其创建的项目名称:< workspace_namespace > 并等待工作区启动。

验证

che-trusted-ca-certs配置映射是否包含您的自定义 CA 证书。这个命令以 PEM 格式返回您的自定义 CA 证书:$ oc get configmap che-trusted-ca-certs \ --namespace=<workspace_namespace> \ --output='jsonpath={.data.custom-ca-certificates\.custom-ca-certificates\.pem}'验证工作区 pod 是否挂载

che-trusted-ca-certs配置映射:$ oc get pod \ --namespace=<workspace_namespace> \ --selector='controller.devfile.io/devworkspace_name=<workspace_name>' \ --output='jsonpath={.items[0:].spec.volumes[0:].configMap.name}' \ | grep che-trusted-ca-certs验证 generic

-developer-image容器(或工作区 devfile 中定义的容器)挂载che-trusted-ca-certs卷:$ oc get pod \ --namespace=<workspace_namespace> \ --selector='controller.devfile.io/devworkspace_name=<workspace_name>' \ --output='jsonpath={.items[0:].spec.containers[0:]}' \ | jq 'select (.volumeMounts[].name == "che-trusted-ca-certs") | .name'获取工作区 pod 名称 < ;workspace_pod_name> :

$ oc get pod \ --namespace=<workspace_namespace> \ --selector='controller.devfile.io/devworkspace_name=<workspace_name>' \ --output='jsonpath={.items[0:].metadata.name}' \验证工作区容器是否具有自定义 CA 证书。这个命令以 PEM 格式返回您的自定义 CA 证书:

$ oc exec <workspace_pod_name> \ --namespace=<workspace_namespace> \ -- cat /public-certs/custom-ca-certificates.custom-ca-certificates.pem

其他资源

3.7.4. 配置 OpenShift 路由

如果您的组织需要,您可以配置 OpenShift Route 标签和注解。

先决条件

-

具有对目标 OpenShift 集群的管理权限的活跃

oc会话。请参阅 CLI 入门。 - 在 OpenShift 中运行的一个 OpenShift Dev Spaces 实例。

流程

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: components: cheServer: extraProperties: CHE_INFRA_KUBERNETES_INGRESS_LABELS: <labels> 1 CHE_INFRA_KUBERNETES_INGRESS_ANNOTATIONS__JSON: "<annotations>" 2 networking: labels: <labels> 3 annotations: <annotations> 4

3.7.5. 配置 OpenShift 路由

您可以配置标签、注解和域,供 OpenShift Route 使用 路由器分片。

先决条件

-

具有 OpenShift 集群的管理权限的活跃

oc会话。请参阅 OpenShift CLI 入门。 -

DSC:请参阅: 第 2.1 节 “安装 dsc 管理工具”。

流程

配置

CheCluster自定义资源。请参阅 第 3.1.2 节 “使用 CLI 配置 CheCluster 自定义资源”。spec: components: cheServer: extraProperties: CHE_INFRA_OPENSHIFT_ROUTE_LABELS: <labels> 1 CHE_INFRA_OPENSHIFT_ROUTE_HOST_DOMAIN__SUFFIX: <domain> 2 networking: labels: <labels> 3 domain: <domain> 4 annotations: <annotations> 5

3.8. 配置存储

3.8.1. 使用存储类安装 Dev Spaces

要将 OpenShift Dev Spaces 配置为使用配置的基础架构存储,请使用存储类安装 OpenShift Dev Spaces。当用户想绑定非默认置备程序提供的持久性卷时,这特别有用。为此,用户将这一存储绑定用于保存 OpenShift Dev Spaces 数据,并设置该存储的参数。这些参数可以确定以下内容:

- 特殊主机路径

- 存储容量

- 卷 mod

- 挂载选项

- 文件系统

- 访问模式

- 存储类型

- 以及许多其他

OpenShift Dev Spaces 有两个组件需要持久性卷来存储数据:

- PostgreSQL 数据库。

-

OpenShift Dev Spaces 工作区。OpenShift Dev Spaces 工作区使用卷存储源代码,如

/projects卷。

OpenShift Dev Spaces 工作区源代码仅在工作区不是临时时存储在持久性卷中。

持久性卷声明事实:

- OpenShift Dev Spaces 不在基础架构中创建持久卷。

- OpenShift Dev Spaces 使用持久性卷声明(PVC)挂载持久性卷。

OpenShift Dev Spaces 服务器创建持久性卷声明。

用户在 OpenShift Dev Spaces 配置中定义一个存储类名称,以使用 OpenShift Dev Spaces PVC 中的存储类功能。使用存储类时,用户使用额外的存储参数以灵活的方式配置基础架构存储。也可以使用类名称将静态置备的持久性卷绑定到 OpenShift Dev Spaces PVC。

流程

使用 CheCluster 自定义资源定义定义存储类:

定义存储类名称:配置

CheCluster自定义资源,并安装 OpenShift Dev Spaces。请参阅 第 3.1.1 节 “在安装过程中使用 dsc 配置CheCluster自定义资源”。spec: components: database: pvc: # keep blank unless you need to use a non default storage class for PostgreSQL PVC storageClass: 'postgres-storage' devEnvironments: storage: pvc: # keep blank unless you need to use a non default storage class for workspace PVC(s) storageClass: 'workspace-storage'在

che-postgres-pv.yaml文件中定义 PostgreSQL 数据库的持久性卷:che-postgres-pv.yamlfileapiVersion: v1 kind: PersistentVolume metadata: name: postgres-pv-volume labels: type: local spec: storageClassName: postgres-storage capacity: storage: 1Gi accessModes: - ReadWriteOnce hostPath: path: "/data/che/postgres"在

che-postgres-pv.yaml文件中定义 OpenShift Dev Spaces 工作区的持久性卷:che-workspace-pv.yamlfileapiVersion: v1 kind: PersistentVolume metadata: name: workspace-pv-volume labels: type: local spec: storageClassName: workspace-storage capacity: storage: 10Gi accessModes: - ReadWriteOnce hostPath: path: "/data/che/workspace"绑定两个持久性卷:

$ kubectl apply -f che-workspace-pv.yaml -f che-postgres-pv.yaml

您必须为卷提供有效的文件权限。您可以使用存储类配置或者手动进行此操作。要手动定义权限,请定义 storageClass#mountOptions uid 和 gid。PostgreSQL 卷需要 uid=26 和 gid=26。

3.9. 管理身份和授权

本节介绍管理 Red Hat OpenShift Dev Spaces 的身份和授权的不同方面。

3.9.1. GitHub、GitLab 或 Bitbucket 的 OAuth

允许用户处理远程 Git 存储库:

3.9.1.1. 为 GitHub 配置 OAuth 2.0

允许用户处理 GitHub 上托管的远程 Git 存储库:

- 设置 GitHub OAuth App (OAuth 2.0)。

- 应用 GitHub OAuth App Secret。

3.9.1.1.1. 设置 GitHub OAuth 应用程序

使用 OAuth 2.0 设置 GitHub OAuth 应用程序。

先决条件

- 登录到 GitHub。

-

base64安装在您要使用的操作系统中。

流程

- 前往 https://github.com/settings/applications/new。

输入以下值:

-

应用程序名称 :

OpenShift Dev Spaces. -

主页 URL:

"https://devspaces-<openshift_deployment_name>.<domain_name>"/ -

授权回调 URL:

"https://devspaces-<openshift_deployment_name>.<domain_name>"/api/oauth/callback

-

应用程序名称 :

- 点击 Register application。

- 点 Generate new client secret。