开发 Hibernate 应用程序

面向希望开发和部署 Jakarta Persistence API(JPA)或 Hibernate 应用程序以用于红帽 JBoss 企业应用平台的开发人员和管理员的说明和信息。

摘要

第 1 章 简介

1.1. 关于 Hibernate 内核

Hibernate Core 是 Java 语言的对象关系映射框架。它提供了一个将面向对象的域模型映射到关系数据库的框架,允许应用避免直接与数据库交互。Hibernate 通过用高级别对象处理功能替代直接持久数据库访问,解决对象关系不匹配问题。

1.2. Hibernate EntityManager

Hibernate 实体管理器实施由 Jakarta Persistence 2.2 规范定义的编程接口和生命周期规则。此打包程序与 Hibernate 批注一起,在成熟的 Hibernate 核心基础上实施独立的 Jakarta Persistence 解决方案。您可以组合使用所有三个组件、不带 Jakarta Persistence 编程接口和生命周期的注释,甚至还可以根据项目的业务和技术需求使用纯原生 Hibernate 内核。您随时可以回退到 Hibernate 原生 API,或者在需要时甚至退回到原生 JDBC 和 SQL。它为 JBoss EAP 提供了完整的 Jakarta Persistence 解决方案。

JBoss EAP 的 7.3 发行版本符合 Jakarta Persistence 2.2 规范,其符合 Jakarta EE 8 中定义的规范。

Hibernate 还提供规范的其他功能。若要开始使用 Jakarta Persistence 和 JBoss EAP,请参阅 JBoss EAP 附带的 bean-validation、gleter 和 Kitchen sink 快速入门。

Jakarta Persistence 在容器中(如 Jakarta Enterprise Beans 3 或更现代化的 Jakarta Contexts 和 Dependency Injection)以及独立 Java SE 应用在特定容器外执行。两种环境中都提供以下编程接口和构件:

如果您计划将安全管理器与 Hibernate 一起使用,请注意,Hibernate 仅在 JBoss EAP 服务器引导 实体管理器Factory 时支持它。当应用程序引导 EntityManagerFactory 或 SessionFactory 时不支持它。

- EntityManagerFactory

- 实体管理器工厂提供实体管理器实例,所有实例都配置为连接到同一数据库,使用由特定实施定义的相同默认设置等。您可以准备多个实体管理器工厂来访问多个数据存储。此界面与原生 Hibernate 中的 SessionFactory 类似。

- EntityManager

- 实体管理器 API 用于访问特定工作单元中的数据库。它用于创建和删除持久实体实例,按主要密钥身份查找实体,以及对所有实体进行查询。此界面与 Hibernate 中的 Session 类似。

- 持久性上下文

- 持久上下文是一组实体实例,其中任何持久实体身份都有唯一的实体实例。在持久上下文中,实体实例及其生命周期由特定实体管理器管理。此上下文的范围可以是事务,也可以是扩展工作单元。

- persistence 单元

- 可由给定实体管理器管理的实体类型集合由持久性单元定义。持久性单元定义应用相关或分组的所有类的集合,它们在映射到单个数据存储时必须共存。

- 容器管理的实体管理器

- 生命周期由容器管理的实体管理器。

- 应用程序管理的实体管理器

- 生命周期由应用程序管理的实体管理器。

- Jakarta Transactions 实体经理

- 参与雅加达交易的实体经理.

- 资源本地实体管理器

- 使用资源交易(而不是 Jakarta 交易)的实体管理器。

第 2 章 Hibernate 配置

2.1. Hibernate 配置

应用服务器内和独立应用中实体管理器的配置都位于持久存档中。持久存档是一种 JAR 文件,必须定义驻留在 META-INF/ 文件夹中的 persistence.xml 文件。

您可以使用 persistence.xml 文件连接数据库。有两种方法可以做到这一点:

指定 JBoss EAP 的

datasources子系统中配置的数据源。jta-data-source指向此持久性单元映射到的数据源的 Java 命名和目录接口名称。java:jboss/datasources/ExampleDS此处指向 JBoss EAP 中嵌入的H2 DB。persistence.xml文件中的object-relational-mapping示例<persistence> <persistence-unit name="myapp"> <provider>org.hibernate.jpa.HibernatePersistenceProvider</provider> <jta-data-source>java:jboss/datasources/ExampleDS</jta-data-source> <properties> ... ... </properties> </persistence-unit> </persistence>通过指定连接属性,显式配置

persistence.xml文件。在

persistence.xml文件中指定连接属性示例<property name="javax.persistence.jdbc.driver" value="org.hsqldb.jdbcDriver"/> <property name="javax.persistence.jdbc.user" value="sa"/> <property name="javax.persistence.jdbc.password" value=""/> <property name="javax.persistence.jdbc.url" value="jdbc:hsqldb:."/>

有关连接属性的完整列表,请参阅

persistence.xml文件中可配置的连接属性。

有许多属性控制 Hibernate 在运行时的行为。所有都是可选的,且具有合理的默认值。这些 Hibernate 属性均在 persistence.xml 文件中使用。有关所有可配置 Hibernate 属性的完整列表,请参阅 Hibernate Properties。

2.2. 第二级缓存

2.2.1. 关于第二级缓存

第二级缓存是在应用会话外保留信息的本地数据存储。缓存由持久性提供商管理,通过将数据与应用分开来改进运行时。

JBoss EAP 支持用于以下目的的缓存:

- Web Session Clustering

- 有状态的 Session Bean Clustering

- SSO 集群

- Hibernate 第二级缓存

- Jakarta Persistence second-level Cache

每个缓存容器定义一个 repl 和一个 dist 缓存。用户应用不应直接使用这些缓存。

2.2.2. 为 Hibernate 配置二级缓存

可以通过两种方式进行 Infinispan 配置为 Hibernate 的二级缓存:

-

建议您使用

persistence.xml文件通过 Jakarta Persistence 应用 配置第二级缓存,如 JBoss EAP 开发指南中所述。 -

或者,您可以使用

hibernate.cfg.xml文件通过 Hibernate 原生应用程序配置二级缓存,如下所述。

使用 Hibernate 原生应用程序配置 Hibernate 的第二级缓存

-

在部署的类路径中创建

hibernate.cfg.xml文件。 将以下 XML 添加到

hibernate.cfg.xml文件中:XML 需要位于<session-factory>标签中:<property name="hibernate.cache.use_second_level_cache">true</property> <property name="hibernate.cache.use_query_cache">true</property> <property name="hibernate.cache.region.factory_class">org.jboss.as.jpa.hibernate5.infinispan.InfinispanRegionFactory</property>

要在应用程序中使用 Hibernate 原生 API,您必须在

MANIFEST.MF文件中添加以下依赖项:Dependencies: org.infinispan,org.hibernate

第 3 章 Hibernate 标注

3.1. Hibernate 标注

org.hibernate.annotations 软件包包含在标准 Jakarta Persistence 注释之上,由 Hibernate 提供的一些注释。

表 3.1. 常规注解

| 注解 | 描述 |

|---|---|

|

| 可以在类、属性或集合级别上定义的任意 SQL 检查限制。 |

|

| 将实体或集合标记为不可变。无注释表示该元素是可变的。 不可变实体可能不会由应用更新。不可变实体的更新将被忽略,但不会抛出异常。

集合上放置 |

表 3.2. 缓存实体

| 注解 | 描述 |

|---|---|

|

| 向 root 实体或集合添加缓存策略。 |

表 3.3. 集合相关注解

| 注解 | 描述 |

|---|---|

|

| 定义永久映射的密钥类型。 |

|

|

定义指向不同实体类型的 |

|

| 使用 SQL 排序(而非 HQL 排序)订购集合。 |

|

|

用于集合、数组和接合子类的策略。目前不支持次要表的 |

|

| 指定自定义持久化器。 |

|

| 集合排序(Java 级别排序)。 |

|

| 其中,要添加到集合的元素实体或目标实体的子句。子句使用 SQL 编写。 |

|

| 其中,要添加到集合连接表的子句。子句使用 SQL 编写。 |

表 3.4. CRUD Operations 的自定义 SQL

| 注解 | 描述 |

|---|---|

|

|

覆盖 Hibernate 默认 |

|

|

覆盖 Hibernate 默认 |

|

|

覆盖 Hibernate 默认 |

|

|

覆盖 Hibernate 默认 |

|

|

覆盖 Hibernate 默认 |

|

| 将不可变和只读实体映射到给定 SQL 子选择表达式。 |

|

|

确保自动清空正确,并且对派生实体的查询不会返回过时的数据。主要用于 |

表 3.5. 实体

| 注解 | 描述 |

|---|---|

|

| 对关联应用级联战略。 |

|

|

添加可能需要超过标准

|

|

| 用于定义多形 Hibernate 的类型适用于实体层次结构。 |

|

| 特定类的 lazy 和代理配置。 |

|

| 表的补充信息,可以是主要或次要信息。 |

|

| 表的复数注释. |

|

| 定义明确的目标,避免误会和通用解决方案。 |

|

| 为实体或组件定义导体。 |

|

| 为实体或组件定义一组教学程序。 |

表 3.6. 获取

| 注解 | 描述 |

|---|---|

|

| 用于 SQL 加载的批处理大小. |

|

| 定义获取策略配置文件。 |

|

|

|

|

|

指定应当获取实体属性以及属于同一组的所有其他属性。为了加载实体属性 lazily,需要进行字节代码增强。默认情况下,所有非收集属性都会加载到一个名为 |

表 3.7. 过滤器

| 注解 | 描述 |

|---|---|

|

| 向集合的实体或目标实体添加过滤器。 |

|

| 过滤定义. |

|

| 过滤器定义数组。 |

|

| 为连接表集合添加过滤器。 |

|

|

将多个 |

|

|

添加多个 |

|

| 参数定义。 |

表 3.8. 主密钥

| 注解 | 描述 |

|---|---|

|

| 此注释的属性由数据库生成。 |

|

| 以取消输入的方式描述任何类型的 Hibernate 生成器的生成器注释。 |

|

| 通用生成器定义的数组。 |

|

| 指定属性是实体的自然 ID 的一部分。 |

|

| 键/值模式. |

|

|

支持 Hibernate 的 |

表 3.9. 继承

| 注解 | 描述 |

|---|---|

|

| 将要放置在根实体上的磁盘公式。 |

|

| 用于表达 Hibernate 特定磁盘属性的可选注释。 |

|

| 将给定的分级值映射到对应的实体类型。 |

表 3.10. 映射 JP-QL/HQL Queries

| 注解 | 描述 |

|---|---|

|

|

扩展 |

|

|

使用 Hibernate 功能扩展 |

|

|

扩展 |

|

|

使用 Hibernate 功能扩展 |

表 3.11. 映射简单属性

| 注解 | 描述 |

|---|---|

|

| 属性访问类型. |

|

| 支持一组列.对于组件用户类型映射很有用。 |

|

| 用于从 中读取值并将值写入列的自定义 SQL 表达式。使用 直接加载/保存对象以及查询。写入表达式必须只包含一个值的 '?' 占位符。 |

|

|

|

表 3.12. 属性

| 注解 | 描述 |

|---|---|

|

|

在大多数地方用作 |

|

| 定义数据库索引。 |

|

|

可用于替换大多数位置的 |

|

| 将属性作为指针引用给所有者(通常是自有实体)。 |

|

| Hibernate 类型. |

|

| Hibernate 类型定义. |

|

| Hibernate 类型定义数组. |

表 3.13. 单个关联备注

| 注解 | 描述 |

|---|---|

|

| 定义指向多个实体类型的 ToOne 关联。与按实体类型匹配是通过元数据磁盘列实现的。此类映射应该只有很少的映射。 |

|

|

定义 |

|

|

定义 |

|

| 定义用于给定关联的 fetching 策略。 |

|

| 定义集合的延迟状态。 |

|

|

定义 ToOne 关联(即 |

|

| 关联上找不到某一元素时要执行的操作. |

表 3.14. 静止的锁定

| 注解 | 描述 |

|---|---|

|

| 注释的属性更改将触发实体版本递增。如果没有该注释,该属性将涉及开放式锁定策略(默认)。 |

|

| 用于定义应用于实体的开放式锁定方式。在层次结构中,仅在 root 实体上有效。 |

|

| 可选注解与 Version 和时间戳版本属性组合。注解值决定时间戳的生成位置。 |

第 4 章 Hibernate 查询语言

4.1. 关于 Hibernate 查询语言

Java Persistence 查询语言简介

Java Persistence 查询语言是一种独立于平台的对象导向查询语言,定义为 Java Persistence API 规范的一部分。Jakarta 等效于 Java Persistence 查询语言是 Jakarta Persistence 查询语言,它被定义为 Jakarta Persistence 规范的一部分。

Java Persistence 查询语言用于对存储在关系数据库中的实体进行查询。它受到 SQL 的极大启发,其查询语法类似于 SQL 查询,但针对 Java Persistence API 实体对象运行,而不是直接使用数据库表。

HQL 简介

Hibernate 查询语言(HQL)是一个功能强大的查询语言,类似于 SQL。但是,与 SQL 相比,HQL 完全面向对象,并且理解继承、多形性和关联等概念。

HQL 是 Java Persistence 查询语言的超集。HQL 查询并不总是是一个有效的 Java Persistence 查询语言查询,但 Java Persistence 查询语言查询始终是有效的 HQL 查询。

HQL 和 Java Persistence 查询语言都不是执行查询操作的非类型安全方法。标准查询提供了用于查询的类型安全方法。

4.2. 关于 HQL 语句

HQL 和 Java Persistence 查询语言都允许 SELECT、UPDATE 和 DELETE 语句。HQL 还允许 INSERT 语句,其格式类似于 SQL INSERT-SELECT。

下表显示了各种 HQL 语句的 Backus-Naur Form(BNF)表示法中的语法。

表 4.1. HQL 语句

| 声明 | 描述 |

|---|---|

|

|

HQL 中用于 select_statement :: =

[select_clause]

from_clause

[where_clause]

[groupby_clause]

[having_clause]

[orderby_clause]

|

|

|

HQL update_statement ::= update_clause [where_clause]

update_clause ::= UPDATE entity_name [[AS] identification_variable]

SET update_item {, update_item}*

update_item ::= [identification_variable.]{state_field | single_valued_object_field}

= new_value

new_value ::= scalar_expression |

simple_entity_expression |

NULL

|

|

|

HQL 中的 delete_statement ::= delete_clause [where_clause] delete_clause ::= DELETE FROM entity_name [[AS] identification_variable] |

|

|

HQL 中的 insert_statement ::= insert_clause select_statement insert_clause ::= INSERT INTO entity_name (attribute_list) attribute_list ::= state_field[, state_field ]* 没有与它对应的 Java Persistence 查询语言。 |

Hibernate 允许使用数据操作语言(DML)直接通过 Hibernate 查询语言(HQL)批量插入、更新和删除数据。

使用 DML 可能会违反对象/关系映射,并可能会影响对象状态。对象状态保留在内存中,使用 DML 时,内存中对象的状态不受影响,具体取决于对底层数据库执行的操作。如果使用 DML,则必须小心使用内存中数据。

关于 UPDATE 和 DELETE 语句

UPDATE 和 DELETE 语句的伪syntax 是:

(更新 | 从中删除 )EntityName(WHERE where_conditions)?。

FROM 关键字和 WHERE 术语是可选的。FROM 子句负责定义可供查询的其余部分使用的对象模型类型的范围。它还负责定义其余查询可用的所有标识变量。WHERE 子句允许您优化返回的实例列表。

执行 UPDATE 或 DELETE 语句的结果是实际受影响的行数(更新或删除)。

示例:批量更新语句

Session session = sessionFactory.openSession();

Transaction tx = session.beginTransaction();

String hqlUpdate = "update Company set name = :newName where name = :oldName";

int updatedEntities = s.createQuery( hqlUpdate )

.setString( "newName", newName )

.setString( "oldName", oldName )

.executeUpdate();

tx.commit();

session.close();

示例:批量删除语句

Session session = sessionFactory.openSession();

Transaction tx = session.beginTransaction();

String hqlDelete = "delete Company where name = :oldName";

int deletedEntities = s.createQuery( hqlDelete )

.setString( "oldName", oldName )

.executeUpdate();

tx.commit();

session.close();

Query.executeUpdate() 方法返回的 int 值指示受操作影响的数据库内实体数量。

在内部,数据库可能会使用多个 SQL 语句来执行响应 DML 更新 或删除 请求 的操作。这可能是因为表和需要更新或删除的连接表之间存在关系。

例如,如上例所示,发出删除声明可能实际上不仅对使用 oldName 命名的 公司的 Company 表执行删除,而且会对合并表执行删除。因此 , 由于 成功执行了上例,与 Employee 表的双向多对多关系也会从相应的加入表中丢弃行。

已删除的Entries 值包含操作影响的所有行的计数,包括 join 表中的行。

执行批量更新或删除操作时应小心,因为它们可能会导致数据库和活动持久化上下文中的实体不一致。通常,批量更新和删除操作应只在新持久性上下文中的事务内执行,或者在获取或访问状态可能受到此类操作影响的实体之前执行。

关于 INSERT 语句

HQL 添加了定义 INSERT 语句的功能。没有与它对应的 Java Persistence 查询语言。HQL INSERT 语句的 Backus-Naur Form(BNF)是:

insert_statement ::= insert_clause select_statement insert_clause ::= INSERT INTO entity_name (attribute_list) attribute_list ::= state_field[, state_field ]*

attribute_list 与 SQL INSERT 语句中的列规格类似。对于涉及映射继承的实体,在 properties _list 中只能使用直接在指定实体上定义的属性。不允许超级类属性,子类属性并不合理。换句话说,INSERT 语句本质上是非私有的。

select_statement 可以是任何有效的 HQL 选择查询,注意返回类型必须与插入预期的类型匹配。目前,这会在查询编译过程中检查,而不是让检查与数据库相连接。这可能会导致 Hibernate 类型与相等的问题 。例如,这可能会导致映射为 org.hibernate.type.DateType 的属性和定义为 org.hibernate.type.TimestampType 的属性之间不匹配问题,即使数据库可能无法区分或处理转换。

对于 id 属性,插入语句为您提供两个选项:您可以在 attribute_list 中明确指定 id 属性,在这种情况下,从对应的 select 表达式获取它的值,或者从 attribute_list 中省略它,在这种情况下使用生成的值。只有使用"在数据库中操作"的 id 生成器时才可使用后一种选项;尝试将此选项用于任何"内存中"类型生成器将导致解析过程中出现异常情况。

对于不确定的锁定属性,插入语句再次为您提供两个选项:您可以在 attribute_list 中指定 属性,在这种情况下,它的值取自对应的选择表达式,或者从 attribute_list 中省略它,在这种情况下,使用了对应的 org.hibernate.type.VersionType 定义的 seed 值。

示例:INSERT 查询语句

String hqlInsert = "insert into DelinquentAccount (id, name) select c.id, c.name from Customer c where ..."; int createdEntities = s.createQuery(hqlInsert).executeUpdate();

示例: Bulkert Statement

Session session = sessionFactory.openSession();

Transaction tx = session.beginTransaction();

String hqlInsert = "insert into Account (id, name) select c.id, c.name from Customer c where ...";

int createdEntities = s.createQuery( hqlInsert )

.executeUpdate();

tx.commit();

session.close();

如果不使用 SELECT 语句提供 id 属性的值,则会为您生成标识符,只要底层数据库支持自动生成的密钥。此批量插入操作的返回值是数据库中实际创建的条目数。

4.3. 关于 HQL 排序

查询的结果也可以排序。ORDER BY 子句用于指定用于排序结果的选定值。作为按顺序子句的一部分,表达式的类型被视为有效,包括:

- 状态字段

- 组件/嵌入式属性

- 星形表达式,如算术运算、函数等。

- 在 select 子句中为任一表达式类型声明的标识变量

HQL 不强制在 select 子句中命名排序句中引用的所有值,但它需要 Java Persistence 查询语言。代表数据库可移植性的应用程序应该意识到,并非所有数据库都支持在 select 子句中引用未引用的顺序子句中的值。

排序中的各个表达式可以通过 ASC (发送)或 DESC (降序)来指示所需的排序方向。

示例:订单人

// legal because p.name is implicitly part of p

select p

from Person p

order by p.name

select c.id, sum( o.total ) as t

from Order o

inner join o.customer c

group by c.id

order by t

4.4. 关于集合成员参考

引用集合值的关联实际上指的是该集合的值。

示例:集合参考

select c

from Customer c

join c.orders o

join o.lineItems l

join l.product p

where o.status = 'pending'

and p.status = 'backorder'

// alternate syntax

select c

from Customer c,

in(c.orders) o,

in(o.lineItems) l

join l.product p

where o.status = 'pending'

and p.status = 'backorder'

在这个示例中,标识变量 o 实际指的是对象模型类型顺序,这是客户#顺序关联元素的类型。

示例还显示了使用 IN 语法指定集合关联接合的替代语法。两种形式都是等同的。哪种应用程序选择使用就只是一个体验问题。

4.5. 关于限定路径表达式

之前已指出收集值的关联实际指的是该集合的值。根据集合的类型,也提供一组明确的资格表达式。

表 4.2. 路径表达式

| expression | 描述 |

|---|---|

|

| 指的是集合值。与未指定限定符相同。用于明确显示意图.对任何类型的 collection-valued 引用有效。 |

|

|

根据 HQL 规则,这对于指定 javax.persistence.OrderColumn 注解的 Map 和 Lists 都有效,以引用 Map 键或 List 位置(回答 OrderColumn 值)。但是,Java Persistence 查询语言保留在 List 案例中使用,并为 MAP 案例添加 |

|

| 仅对映射有效。指地图的密钥。如果密钥本身是一个实体,可以进一步导航。 |

|

|

仅对映射有效。引用 Map 的逻辑 java.util.Map.Entry tuple(其键和值的组合)。 |

示例:限定集合参考

// Product.images is a Map<String,String> : key = a name, value = file path

// select all the image file paths (the map value) for Product#123

select i

from Product p

join p.images i

where p.id = 123

// same as above

select value(i)

from Product p

join p.images i

where p.id = 123

// select all the image names (the map key) for Product#123

select key(i)

from Product p

join p.images i

where p.id = 123

// select all the image names and file paths (the 'Map.Entry') for Product#123

select entry(i)

from Product p

join p.images i

where p.id = 123

// total the value of the initial line items for all orders for a customer

select sum( li.amount )

from Customer c

join c.orders o

join o.lineItems li

where c.id = 123

and index(li) = 1

4.6. 关于 HQL 功能

HQL 定义一些可用的标准功能,无论使用的底层数据库是什么。HQL 也可以了解方形图和应用程序中定义的其他功能。

4.6.1. 关于 HQL 标准化功能

无论使用的底层数据库是什么,HQL 中都提供以下功能:

表 4.3. HQL 标准化功能

| 功能 | 描述 |

|---|---|

|

| 返回二进制数据的长度。 |

|

| 执行 SQL 广播.cast 目标应命名为要使用的 Hibernate 映射类型。 |

|

| 根据日期时间值执行 SQL 提取.提取将返回日期/时间值的一部分,如当年。请参见以下简写表格。 |

|

| 用于提取第二个的缩写提取表单。 |

|

| 用于提取分钟的缩写提取表单。 |

|

| 用于提取小时的缩写提取表单。 |

|

| 用于提取日期的缩写提取表单. |

|

| 用于提取月份的简短提取表单。 |

|

| 用于提取年度的简短提取表单. |

|

| 转换值作为字符数据的简写形式。 |

4.6.2. 关于 HQL 非标准化功能

Hibernate 拨号可以注册已知可用于该特定数据库产品的其他功能。它们只有在使用该数据库或拨号时才可用。以数据库可移植性为目标的应用应避免在此类别中使用函数。

应用程序开发人员还可以提供自己的一组功能。这通常代表自定义 SQL 函数或 SQL 片段的别名。此类功能声明通过使用 org.hibernate.cfg.Configuration 的 addSqlFunction 方法进行。

4.6.3. 关于连接操作

HQL 除了支持串联(CONCAT)功能外,还定义了串联运算符。这不是由 Java Persistence 查询语言定义的,因此便携式应用应避免使用它。连接运算符取自 SQL 串联运算符(||)。

示例:连接操作示例

select 'Mr. ' || c.name.first || ' ' || c.name.last from Customer c where c.gender = Gender.MALE

4.7. 关于动态注入

特定的表达式类型仅在 select 子句中有效。Hibernate 将此"动态实例化"称为"动态实例化"。Java Persistence 查询语言支持部分功能,并将其称为"结构表达式"。

示例:动态注入示例 - 结构

select new Family( mother, mate, offspr )

from DomesticCat as mother

join mother.mate as mate

left join mother.kittens as offspr

因此,我们不在这里处理 Object[],而是将值嵌套在 type-safe java 对象中,该对象将作为查询的结果返回。类引用必须完全限定,并且必须具有匹配的构造器。

此处的类不需要映射。如果确实代表某一实体,则生成的实例将返回为 NEW 状态(非 managed!)。

这也是 Java Persistence 查询语言支持的部分。HQL 支持其他"动态实例化"功能。首先,查询可以指定返回列表,而不是用于 scalar 结果的 Object[]:

示例:动态注入示例 - 列表

select new list(mother, offspr, mate.name)

from DomesticCat as mother

inner join mother.mate as mate

left outer join mother.kittens as offspr

这个查询的结果将是 List<List>,而不是 List<Object[]>。

HQL 还支持将井号结果换算成一个映射。

示例:动态注入示例 - 映射

select new map( mother as mother, offspr as offspr, mate as mate )

from DomesticCat as mother

inner join mother.mate as mate

left outer join mother.kittens as offspr

select new map( max(c.bodyWeight) as max, min(c.bodyWeight) as min, count(*) as n )

from Cat cxt

这个查询的结果将是 List<Map<String,Object>>,而不是 List<Object[]>。映射的键由提供给所选表达式的别名定义。

4.8. 关于 HQL predicates

predicates 形成 where 子句、包含 子句 和 搜索案例表达式的基础。它们是可解析为真实值的表达式,通常是 TRUE 或 FALSE,尽管涉及 NULL 值的布尔值比较通常解析为 UNKNOWN。

HQL 谓词

null Predicate

检查 null 值。可以应用到基本属性引用、实体引用和参数。HQL 还允许将它应用到组件/嵌入式类型。

示例:NULL Check

// select everyone with an associated address select p from Person p where p.address is not null // select everyone without an associated address select p from Person p where p.address is null

像 Predicate

执行类似于字符串值的比较。语法为:

like_expression ::= string_expression [NOT] LIKE pattern_value [ESCAPE escape_character]语义遵循 SQL 等表达式的语义。

pattern_value是在 string_expression 中尝试匹配的模式。正如 SQL 一样,mod_value可以使用_(下划线)和%(百分比)作为通配符。含义相同。_匹配任何单个字符。%匹配任意数量的字符。可选的s

cap_character用于指定用于转义pattern_value中_和%的特殊含义的转义字符。这在需要搜索模式(包括_ 或%)时非常有用。示例:LIKE Predicate

select p from Person p where p.name like '%Schmidt' select p from Person p where p.name not like 'Jingleheimmer%' // find any with name starting with "sp_" select sp from StoredProcedureMetadata sp where sp.name like 'sp|_%' escape '|'

Predicate 间

类似于 SQL

BETWEEN表达式。执行评估,说明值在 2 个其他值范围内。所有操作对象都应具有可比较类型。示例:BETWEEN Predicate

select p from Customer c join c.paymentHistory p where c.id = 123 and index(p) between 0 and 9 select c from Customer c where c.president.dateOfBirth between {d '1945-01-01'} and {d '1965-01-01'} select o from Order o where o.total between 500 and 5000 select p from Person p where p.name between 'A' and 'E'IN Predicate

INpredicate 执行检查特定值是否在值列表中。它的语法是:in_expression ::= single_valued_expression [NOT] IN single_valued_list single_valued_list ::= constructor_expression | (subquery) | collection_valued_input_parameter constructor_expression ::= (expression[, expression]*)single_valued_expression 的类型和 single_valued_list 中的单个值必须一致。Java Persistence 查询语言将此处的有效类型限制为字符串、数字、日期、时间、时间戳和枚举类型。在 Java Persistence 查询语言 中,single_valued_expression 只能指:- "状态字段",这是简单属性的术语。特别是,这不包括关联和组件/嵌入式属性。

实体类型表达式.

在 HQL 中,

single_valued_expression 可以指一组更广泛的表达式类型。允许单值关联。同样是组件/嵌入式属性,尽管该功能取决于底层数据库中对元或"行值构造器语法"的支持级别。此外,HQL 不会以任何方式限制值类型,但应用开发人员应该意识到,不同的类型可能会基于底层数据库供应商获得有限的支持。这主要是 Java Persistence 查询语言限制的原因。值列表可能来自多个不同来源。在

constructor_expression和collection_valued_input_parameter中,值列表不能为空;它必须至少包含一个值。示例:IN Predicate

select p from Payment p where type(p) in (CreditCardPayment, WireTransferPayment) select c from Customer c where c.hqAddress.state in ('TX', 'OK', 'LA', 'NM') select c from Customer c where c.hqAddress.state in ? select c from Customer c where c.hqAddress.state in ( select dm.state from DeliveryMetadata dm where dm.salesTax is not null ) // Not Java Persistence query language compliant! select c from Customer c where c.name in ( ('John','Doe'), ('Jane','Doe') ) // Not Java Persistence query language compliant! select c from Customer c where c.chiefExecutive in ( select p from Person p where ... )

4.9. 关于关系比较

比较涉及比较运算符之一 - =, >, >=, <, ›, <>。HQL 还定义了 != 作为与 <> 的比较运算符。操作对象应该是相同的类型。

示例:关系比较示例

// numeric comparison

select c

from Customer c

where c.chiefExecutive.age < 30

// string comparison

select c

from Customer c

where c.name = 'Acme'

// datetime comparison

select c

from Customer c

where c.inceptionDate < {d '2000-01-01'}

// enum comparison

select c

from Customer c

where c.chiefExecutive.gender = com.acme.Gender.MALE

// boolean comparison

select c

from Customer c

where c.sendEmail = true

// entity type comparison

select p

from Payment p

where type(p) = WireTransferPayment

// entity value comparison

select c

from Customer c

where c.chiefExecutive = c.chiefTechnologist

比较还可能涉及子队列限定符 - ALL、ANY、SOM E。SOME 和 ANY 是同义词。

如果对子队列结果中的所有值进行比较都为 true,则 ALL 限定符会解析为 true。如果子队列结果为空,它将解析为 false。

示例:所有 Subquery Comparison Qualifier 示例

// select all players that scored at least 3 points // in every game. select p from Player p where 3 > all ( select spg.points from StatsPerGame spg where spg.player = p )

如果对子 队列结果中至少一个值进行比较为 true,ANY /SOME 限定符会解析为 true。如果子队列结果为空,它将解析为 false。

4.10. 字节码增强

4.10.1. lazy Attribute Loading

lazy 属性加载是一种字节码增强,它允许您告知 Hibernate,从数据库获取时仅应加载实体的特定部分,以及应在何时加载其他剩余部分。这与基于代理加载的理念不同,后者是实体中心,即在需要时一次性加载实体的状态。通过字节码增强,根据需要加载各个属性或属性组。

可以将 lazy 属性指定为一起加载,这称为 lazy 组。默认情况下,所有单数属性都是单个组的一部分。访问一个 lazy singular 属性时,会加载所有 lazy 单数属性。与单片组不同,lazy 复数属性是各个离散的 lazy 组。此行为可通过 @org.hibernate.annotations.LazyGroup 注释显式控制。

@Entity

public class Customer {

@Id

private Integer id;

private String name;

@Basic( fetch = FetchType.LAZY )

private UUID accountsPayableXrefId;

@Lob

@Basic( fetch = FetchType.LAZY )

@LazyGroup( "lobs" )

private Blob image;

public Integer getId() {

return id;

}

public void setId(Integer id) {

this.id = id;

}

public String getName() {

return name;

}

public void setName(String name) {

this.name = name;

}

public UUID getAccountsPayableXrefId() {

return accountsPayableXrefId;

}

public void setAccountsPayableXrefId(UUID accountsPayableXrefId) {

this.accountsPayableXrefId = accountsPayableXrefId;

}

public Blob getImage() {

return image;

}

public void setImage(Blob image) {

this.image = image;

}

}

在上例中,有两个 lazy 属性:accounts PayableXrefId 和 image。这些属性各自属于不同的获取组。accountsPayableXrefId 属性是默认 fetch 组的一部分,这意味着访问 accountsPayableXrefId 不会强制加载 映像 属性,反之亦然。

第 5 章 Hibernate 服务

5.1. 关于 Hibernate 服务

服务是向 Hibernate 提供各种功能的可插拔实现的类。具体来说,它们是某些服务合同接口的实施。接口称为服务角色;实施类称为服务实施。般而言,用户可以插入所有标准服务角色(覆盖)的替代实施;他们还可以定义服务角色基础组之外的其他服务(扩展)。

5.2. 关于服务合同

服务的基本要求是实施标记接口 org.hibernate.service.Service。Hibernate 在内部将此用于某些基本类型安全。

服务也可以实施 org.hibernate.service.spi.Startable 和 org.hibernate.service.spi.Stoppable 接口来接收启动和停止的通知。另一个可选服务合同是 org.hibernate.service.spi.Manageable,在 Jakarta 管理中将服务标记为可管理,但 Jakarta 管理集成已启用。

5.3. 服务依赖项类型

允许服务使用以下方法之一声明对其他服务的依赖:

- @org.hibernate.service.spi.InjectService

服务实施类上接受单个参数并标有

@InjectService的任何方法都被视为请求注入其他服务。默认情况下,方法参数的类型应当是要注入的服务角色。如果参数类型与 service 角色不同,则应当使用

InjectService 的serviceRole属性来显式命名该角色。默认情况下,注入的服务被视为必需,如果缺少指定的依赖服务,则启动该服务将失败。如果要注入的服务是可选的,

InjectService 的required 属性应声明为false。默认值为true。- org.hibernate.service.spi.ServiceRegistryAwareService

第二种方法是拉取方法,其中服务实施可选的服务接口

org.hibernate.service.spi.ServiceRegistryAwareService,它声明了单一注入服务方法。在启动过程中,Hibernate 会将

org.hibernate.service.ServiceRegistry自身注入到实施此接口的服务中。然后,服务可以使用ServiceRegistry引用来查找所需的任何其他服务。

5.3.1. Service Registry

5.3.1.1. 关于 ServiceRegistry

除服务本身外,中央服务 API 是 org.hibernate.service.ServiceRegistry 接口。服务注册表的主要用途是保存、管理和提供对服务的访问。

服务注册表采用层次结构。个注册表中的服务可以依赖于并使用同一注册表中的服务以及任何父注册表。

使用 org.hibernate.service.ServiceRegistryBuilder 构建 org.hibernate.service.ServiceRegistry 实例。

使用 ServiceRegistryBuilder 创建 ServiceRegistry 的示例

ServiceRegistryBuilder registryBuilder =

new ServiceRegistryBuilder( bootstrapServiceRegistry );

ServiceRegistry serviceRegistry = registryBuilder.buildServiceRegistry();

5.3.2. 自定义服务

5.3.2.1. 关于自定义服务

旦创建了 org.hibernate.service.ServiceRegistry,则该服务本身可能会接受重新配置,但此处的不可变性意味着添加或替换服务。因此 org.hibernate.service.ServiceRegistryBuilder 提供的另一个角色是允许对从中生成的 org.hibernate.service.ServiceRegistry 中包含的服务进行调整。

有两种方法可以告知 org.hibernate.service.ServiceRegistryBuilder 相关信息。

-

实施

org.hibernate.service.spi.BasicServiceInitiator类,以控制服务类按需构建,并使用其addInitiator方法将它添加到org.hibernate.service.ServiceRegistryBuilder中。 -

只需实例化服务类,并使用其

addService 方法将它添加到中。org.hibernate.service.ServiceRegistryBuilder

这两种方法都可用于扩展注册表,例如添加新的服务角色和覆盖服务,如替换服务实施。

示例:使用 ServiceRegistryBuilder 将现有服务替换为自定义服务

ServiceRegistryBuilder registryBuilder =

new ServiceRegistryBuilder(bootstrapServiceRegistry);

registryBuilder.addService(JdbcServices.class, new MyCustomJdbcService());

ServiceRegistry serviceRegistry = registryBuilder.buildServiceRegistry();

public class MyCustomJdbcService implements JdbcServices{

@Override

public ConnectionProvider getConnectionProvider() {

return null;

}

@Override

public Dialect getDialect() {

return null;

}

@Override

public SqlStatementLogger getSqlStatementLogger() {

return null;

}

@Override

public SqlExceptionHelper getSqlExceptionHelper() {

return null;

}

@Override

public ExtractedDatabaseMetaData getExtractedMetaDataSupport() {

return null;

}

@Override

public LobCreator getLobCreator(LobCreationContext lobCreationContext) {

return null;

}

@Override

public ResultSetWrapper getResultSetWrapper() {

return null;

}

}

5.3.3. Boot-Strap Registry

5.3.3.1. 关于 Boot-strap Registry

boot-strap 注册表存放绝对必须可用的服务,大多数操作都必须可用。这里的主要服务是 ClassLoaderService,这是一个完美的例子。即使解析配置文件也需要访问类加载服务,如资源查找。这是通常使用的根注册表,而不是父注册表。

boot-strap 注册表的实例使用 org.hibernate.service.BootstrapServiceRegistryBuilder 类构建。

Using BootstrapServiceRegistryBuilder

示例:使用 BootstrapServiceRegistryBuilder

BootstrapServiceRegistry bootstrapServiceRegistry =

new BootstrapServiceRegistryBuilder()

// pass in org.hibernate.integrator.spi.Integrator instances which are not

// auto-discovered (for whatever reason) but which should be included

.with(anExplicitIntegrator)

// pass in a class loader that Hibernate should use to load application classes

.with(anExplicitClassLoaderForApplicationClasses)

// pass in a class loader that Hibernate should use to load resources

.with(anExplicitClassLoaderForResources)

// see BootstrapServiceRegistryBuilder for rest of available methods

...

// finally, build the bootstrap registry with all the above options

.build();

5.3.3.2. BootstrapRegistry 服务

org.hibernate.service.classloading.spi.ClassLoaderServiceHibernate 需要与类加载器交互。但是,Hibernate 或任何库与类加载器交互的方式因托管应用的运行时环境而异。应用程序服务器、OSGi 容器和其他模块化类加载系统带来了非常具体的类加载要求。此服务从这种环境复杂性中提供 Hibernate 抽象。更重要的是,它以单一兼容的方式做到这一点。

在与类加载器交互方面,Hibernate 需要以下功能:

- 定位应用程序类的功能

- 定位集成类的功能

- 查找资源(如属性文件和 XML 文件)的功能

加载

java.util.ServiceLoader 的功能注意目前,加载应用类的功能和加载集成类的功能组合到服务的单个负载类功能中。这可能在以后的版本中有所改变。

org.hibernate.integrator.spi.IntegratorService应用程序、附加组件和其他模块需要与 Hibernate 集成。以上方法需要一个组件(通常是应用)来协调各个模块的注册。此注册代表每个模块的集成商进行。

此服务侧重于发现方面。它利用

org.hibernate功能来发现.service.classloading.spi.ClassLoaderService 提供的标准 Java java.util.ServiceLoaderorg.hibernate.integrator.spi.Integrator合同的实施。集成器只需定义一个名为

/META-INF/services/org.hibernate.integrator.spi.Integrator的文件,并使其在类路径中可用。此文件由

java.util.ServiceLoader机制使用。它将列出实施org.hibernate.integrator.spi.Integrator接口的完全限定类名称,每行一个。

5.3.4. SessionFactory Registry

虽然最佳做法是将所有 registry 类型的实例视为针对给定 机构。SessionFactory,但该组中的服务实例明确属于单个 org.hibernate.SessionFactory。

差别在于需要发起它们的时间问题。通常他们需要访问 org.hibernate.SessionFactory 才能启动。这个特殊 registry 是 org.hibernate.service.spi.SessionFactoryServiceRegistry。

5.3.4.1. SessionFactory 服务

org.hibernate.event.service.spi.EventListenerRegistry

- 描述

- 用于管理事件侦听器的服务。

- initiator

-

org.hibernate.event.service.internal.EventListenerServiceInitiator - 实施

-

org.hibernate.event.service.internal.EventListenerRegistryImpl

5.3.5. 集成器

org.hibernate.integrator.spi.Integrator 旨在提供一种简单的途径,让开发人员能够将信息集中到构建可正常工作的 SessionFactory 的过程中。org.hibernate.integrator.spi.Integrator 接口定义了两种感兴趣的方法:

-

集成使我们能够在构建过程中 hook -

解除集成使我们可以固定在SessionFactory关机中。

org.hibernate.integrator.spi.Integrator 中定义了第三个方法,它是一个超载的集成形式,接受 org.hibernate.metamodel.source.MetadataImplementor 而不是 org.hibernate.cfg.Configuration。

除了 IntegratorService 提供的发现方法外,应用在构建 时可以手动注册 Integrator 实施。

BootstrapService Registry

5.3.5.1. 集成器用例

org.hibernate.integrator.spi.Integrator 注册事件监听程序和提供服务,请参阅 org.hibernate.integrator.spi.ServiceContributingIntegrator。

示例:注册事件列表

public class MyIntegrator implements org.hibernate.integrator.spi.Integrator {

public void integrate(

Configuration configuration,

SessionFactoryImplementor sessionFactory,

SessionFactoryServiceRegistry serviceRegistry) {

// As you might expect, an EventListenerRegistry is the thing with which event listeners are registered It is a

// service so we look it up using the service registry

final EventListenerRegistry eventListenerRegistry = serviceRegistry.getService(EventListenerRegistry.class);

// If you wish to have custom determination and handling of "duplicate" listeners, you would have to add an

// implementation of the org.hibernate.event.service.spi.DuplicationStrategy contract like this

eventListenerRegistry.addDuplicationStrategy(myDuplicationStrategy);

// EventListenerRegistry defines 3 ways to register listeners:

// 1) This form overrides any existing registrations with

eventListenerRegistry.setListeners(EventType.AUTO_FLUSH, myCompleteSetOfListeners);

// 2) This form adds the specified listener(s) to the beginning of the listener chain

eventListenerRegistry.prependListeners(EventType.AUTO_FLUSH, myListenersToBeCalledFirst);

// 3) This form adds the specified listener(s) to the end of the listener chain

eventListenerRegistry.appendListeners(EventType.AUTO_FLUSH, myListenersToBeCalledLast);

}

}

第 6 章 Hibernate Envers

6.1. 关于 Hibernate Envers

Hibernate Envers 是一种审计和版本化系统,为 JBoss EAP 提供了一种途径来跟踪永久类的历史变化。为标有 @Audited 的实体创建审计表,该实体存储对实体所做的更改历史记录。然后可以检索和查询数据。

Envers 允许开发人员:

- 审计根据 Jakarta Persistence 规范定义的所有映射

- 审核扩展 Jakarta Persistence 规范的所有 hibernate 映射

- 由或使用原生 Hibernate API 映射的审计实体

- 使用修订实体记录每个修订版本的数据

- 查询历史数据

6.2. 关于审计持久性类

持久类审计通过 Hibernate Envers 和 @Audited 注释在 JBoss EAP 中完成。当注解应用到类时,将创建一个表,用于存储实体的修订历史记录。

每次对类进行更改时,都会向 audit 表中添加一个条目。该条目包含对类的更改,并获得修订号。这意味着可以回滚更改,也可以查看以前的修订版本。

6.3. 审计策略

6.3.1. 关于审计策略

审计策略定义了审计信息的持久性、查询和存储方式。Hibernate Envers 目前有两种审计策略:

- 默认审计策略

- 此策略将审计数据与开始修订一起保留。对于在审计表中插入、更新或删除的每一行,在审计表中插入一行或多行,以及其有效期的开始修订。

- 插入后不会更新审计表中的行。对审计信息查询使用子查询来选择审计表中适用的行,这些行速度慢且难以索引。

- 有效期审计策略

- 此策略存储启动修订以及审计信息的结束修订。对于在审计表中插入、更新或删除的每一行,在审计表中插入一行或多行,以及其有效期的开始修订。

- 同时,上一审计行(如果可用)的结束修订字段被设置为这个修订版本。然后,对审计信息的查询可以在开始和结束修订版本之间使用,而不是子查询。这意味着保留审计信息的速度稍慢,因为增加了更新,但检索审计信息的速度要快得多。

- 这也可以通过添加额外的索引来改进。

如需有关审计的更多信息,请参阅关于审计持久类。要为应用设置审计策略,请参阅 设置审计策略。

6.3.2. 设置审计策略

JBoss EAP 支持两种审计策略:

- 默认审计策略

- 有效期审计策略

定义审计策略

在应用的 persistence 属性。如果在 .xml 文件中配置 org.hibernate.envers. audit_strategypersistence.xml 文件中未设置 属性,则使用默认的审计策略。

设置默认审计策略

<property name="org.hibernate.envers.audit_strategy" value="org.hibernate.envers.strategy.DefaultAuditStrategy"/>

设置Validity Audit 策略

<property name="org.hibernate.envers.audit_strategy" value="org.hibernate.envers.strategy.ValidityAuditStrategy"/>

6.3.3. 将审计支持添加到 Jakarta Persistence Entity

流程

JBoss EAP 通过 Hibernate Envers 使用实体审核来跟踪永久类的历史更改。本节介绍添加对 Jakarta Persistence 实体的审计支持。

将审计支持添加到 Jakarta Persistence Entity

- 配置可用的审计参数以适合部署。详情请参阅 配置 Envers 参数。

- 打开 Jakarta Persistence 实体进行审计。

-

导入

org.hibernate.envers.Audited接口。 将

@Audited注释应用到要审核的每个字段或属性,或将它应用到整个类。示例:审计两个字段

import org.hibernate.envers.Audited; import javax.persistence.Entity; import javax.persistence.Id; import javax.persistence.GeneratedValue; import javax.persistence.Column; @Entity public class Person { @Id @GeneratedValue private int id; @Audited private String name; private String surname; @ManyToOne @Audited private Address address; // add getters, setters, constructors, equals and hashCode here }示例:审计最终类

import org.hibernate.envers.Audited; import javax.persistence.Entity; import javax.persistence.Id; import javax.persistence.GeneratedValue; import javax.persistence.Column; @Entity @Audited public class Person { @Id @GeneratedValue private int id; private String name; private String surname; @ManyToOne private Address address; // add getters, setters, constructors, equals and hashCode here }

为审核配置了 Jakarta Persistence 实体时,将创建一个名为 _AUD 的表来存储历史更改。

6.4. Configuration

6.4.1. 配置端点参数

JBoss EAP 通过 Hibernate Envers 使用实体审计来跟踪永久类的历史更改。

配置可用的端点参数

-

打开

应用的 persistent.xml文件。 根据需要添加、删除或配置 Envers 属性。有关可用属性列表,请参阅 Envers Configuration Properties。

示例:结束参数

<persistence-unit name="mypc"> <description>Persistence Unit.</description> <jta-data-source>java:jboss/datasources/ExampleDS</jta-data-source> <shared-cache-mode>ENABLE_SELECTIVE</shared-cache-mode> <properties> <property name="hibernate.hbm2ddl.auto" value="create-drop" /> <property name="hibernate.show_sql" value="true" /> <property name="hibernate.cache.use_second_level_cache" value="true" /> <property name="hibernate.cache.use_query_cache" value="true" /> <property name="hibernate.generate_statistics" value="true" /> <property name="org.hibernate.envers.versionsTableSuffix" value="_V" /> <property name="org.hibernate.envers.revisionFieldName" value="ver_rev" /> </properties> </persistence-unit>

6.4.2. 在运行时启用或禁用审计

在运行时启用或禁用实体版本审核

-

子类

AuditEventListener类。 覆盖在 Hibernate 事件中调用的以下方法:

-

onPostInsert -

onPostUpdate -

onPostDelete -

onPreUpdateCollection -

onPreRemoveCollection -

onPostRecreateCollection

-

- 将子类指定为事件的监听程序。

- 确定是否应审计更改。

- 如果更改应该被审计,则将调用传递到超级类。

6.4.3. 配置条件审计

Hibernate Envers 使用一系列事件监听器以对各种 Hibernate 事件的响应保留审计数据。如果 Envers JAR 在类路径中,则这些监听程序会自动注册。

实施条件审计

-

在

persistenceHibernate 属性设置为 false。.xml 文件中将 hibernate.listeners.envers.autoRegister - 子类要覆盖的每个事件监听程序。将条件审计逻辑放在子类中,并在应当执行审计时调用超级方法。

-

创建

org.hibernate.integrator.spi.Integrator的自定义实施,类似于org.hibernate.envers.event.EnversIntegrator。使用在第 2 步中创建的事件监听器子类,而不是默认的类。 -

将

META-INF/services/org.hibernate.integrator.spi.Integrator文件添加到 JAR。此文件应当包含实施接口的类的完全限定名称。

6.4.4. Envers 配置属性

表 6.1. 实体数据版本配置参数

| 属性名称 | 默认值 | 描述 |

|---|---|---|

|

| 在被审计实体名称前加上字符串,以创建保存审计信息的实体的名称。 | |

|

| _AUD |

附加到已审计实体名称的字符串,以创建保存审计信息的实体的名称。例如,如果对表名称为 |

|

| REV | 包含修订号的审计实体中的字段名称。 |

|

| REVTYPE |

存放修订类型的审计实体中的字段名称。当前可能的修订类型有: |

|

| true |

此属性决定是否应生成修订项,如果关系字段未拥有的更改。这可以是一对多关系中的集合,也可以是使用一对一关系中的 mapping |

|

| true |

为 true 时,用于开放式锁定的属性(使用 |

|

| false | 此属性定义在删除实体时是否应将实体数据存储在修订中,所有其他属性均标记为 null(而非 ID)。这通常不需要,因为数据存在于最后一处的修订版本中。但有时候,在最后一个修订版本中访问它更为简单和高效。但是,这意味着在删除前包含的数据被存储两次。 |

|

| Null(与普通表相同) |

用于审计表的默认架构名称。可以使用 |

|

| Null(与普通表相同) |

应用于审计表的默认目录名称。可以使用 |

|

|

|

此属性定义在持久保留审计数据时应使用的审计策略。默认情况下,仅存储了实体修改的修订版本。另外, |

|

| REVEND | 在审计实体中保存最终修订版本的列名称。只有使用了有效期审计策略时,此属性才有效。 |

|

| false |

此属性定义除结束修订本身外,是否应将最终修订的时间戳(数据在最后有效的位置)存储下来。这对于使用表分区从关系数据库中清除旧的审计记录非常有用。分区需要表中存在的列。只有在使用了Validity |

|

| REVEND_TSTMP |

结束修订版本时间戳的列名称,即数据仍有效。只有在使用了Validity |

6.5. 查询审计信息

6.5.1. 通过队列检索审计信息

Hibernate Envers 提供通过查询检索审计信息的功能。

许多情况下,对审计数据的查询比 实时数据 的相应查询要慢得多,因为它们涉及关联的子选择。

通过给定修订版本查询类实体

此查询的入口点为:

AuditQuery query = getAuditReader()

.createQuery()

.forEntitiesAtRevision(MyEntity.class, revisionNumber);

然后,可以使用 AuditEntity 工厂类别指定限制。以下查询仅选择 name 属性等于 John 的实体:

query.add(AuditEntity.property("name").eq("John"));以下查询只选择与给定实体相关的实体:

query.add(AuditEntity.property("address").eq(relatedEntityInstance));

// or

query.add(AuditEntity.relatedId("address").eq(relatedEntityId));然后可以订购、限制结果,并且设置聚合和预测(分组除外)。以下示例是一个完整的查询。

List personsAtAddress = getAuditReader().createQuery()

.forEntitiesAtRevision(Person.class, 12)

.addOrder(AuditEntity.property("surname").desc())

.add(AuditEntity.relatedId("address").eq(addressId))

.setFirstResult(4)

.setMaxResults(2)

.getResultList();查询修订,其中给定类的实体更改

此查询的入口点为:

AuditQuery query = getAuditReader().createQuery()

.forRevisionsOfEntity(MyEntity.class, false, true);限制可以添加到此查询中,方式与上例相同。这个查询还有其它可能:

AuditEntity.revisionNumber()- 指定修改审计实体的修订版本号的限制、预测和顺序。

AuditEntity.revisionProperty(propertyName)- 指定修订实体属性的限制、预测和订单,对应于修改审计实体的修订版本。

AuditEntity.revisionType()- 提供对修订版本类型的访问(ADD、MOD、DEL)。

然后可以根据需要调整查询结果。以下查询选择 MyEntity 类的实体的最小修订号,其中的 entity Id ID 在修订号 42 后更改:

Number revision = (Number) getAuditReader().createQuery()

.forRevisionsOfEntity(MyEntity.class, false, true)

.setProjection(AuditEntity.revisionNumber().min())

.add(AuditEntity.id().eq(entityId))

.add(AuditEntity.revisionNumber().gt(42))

.getSingleResult();

对修订的查询也可以最小化/最大化属性。以下查询选择给定实体的 actualDate 值大于给定值的修订版本,但尽量小:

Number revision = (Number) getAuditReader().createQuery()

.forRevisionsOfEntity(MyEntity.class, false, true)

// We are only interested in the first revision

.setProjection(AuditEntity.revisionNumber().min())

.add(AuditEntity.property("actualDate").minimize()

.add(AuditEntity.property("actualDate").ge(givenDate))

.add(AuditEntity.id().eq(givenEntityId)))

.getSingleResult();

mini ()和 属性的实体必须满足此条件。

max()方法 返回一个条件,可以向其中添加约束,但具有最大/最小

创建查询时传递两个布尔值参数:

selectEntitiesOnly-

这个参数只有在未设置显式投射时才有效。

如果为true,则查询的结果将是满足指定限制修订版本时更改的实体列表。

若为 false,则结果将是三个元素数组的列表。第一个元素是更改后的实体实例。第二个是包含修订数据的实体。如果不使用自定义实体,这将是DefaultRevisionEntity实例。第三个元素数组将是修订的类型(ADD、MOD、DEL)。 selectDeletedEntities-

此参数指定是否必须将删除实体的修订包含在结果中。如果为 true,实体将具有修订类型

DEL,除 id 外的所有字段都将值为null。

查询修改后属性的实体的修订

以下查询将返回 MyEntity 及给定 ID 的所有修订,其中的 actualDate 属性已更改。

AuditQuery query = getAuditReader().createQuery()

.forRevisionsOfEntity(MyEntity.class, false, true)

.add(AuditEntity.id().eq(id));

.add(AuditEntity.property("actualDate").hasChanged())

hasChanged 条件可以和附加标准组合。以下查询将在生成 revisionNumber 时为 MyEntity 返回一个横向片段。它仅限于修改 prop1 但不修改 prop 2 的修订版本。

AuditQuery query = getAuditReader().createQuery()

.forEntitiesAtRevision(MyEntity.class, revisionNumber)

.add(AuditEntity.property("prop1").hasChanged())

.add(AuditEntity.property("prop2").hasNotChanged());

结果集还包含数字低于 revisionNumber 的修订版本。这意味着,这个查询无法读取为"通过 prop1 修改和 prop 2 不更改的 revisionNumber 中所有 MyEntities 更改"。

以下查询显示如何使用 forEntitiesModifiedAtRevision 查询返回这个结果:

AuditQuery query = getAuditReader().createQuery()

.forEntitiesModifiedAtRevision(MyEntity.class, revisionNumber)

.add(AuditEntity.property("prop1").hasChanged())

.add(AuditEntity.property("prop2").hasNotChanged());在给定修订版本中修改查询实体

以下示例显示了给定修订中修改的实体的基本查询。它允许检索指定修订中更改的实体名称和对应 Java 类:

Set<Pair<String, Class>> modifiedEntityTypes = getAuditReader()

.getCrossTypeRevisionChangesReader().findEntityTypes(revisionNumber);还可以从 org.hibernate.envers.CrossTypeRevisionChangesReader 访问许多其他查询:

list<Object> findEntities(Number)-

返回给定修订中更改(添加、更新和删除)的所有审计实体的快照。执行

n+1SQL 查询,其中n是指定修订版本中修改的多个不同实体类。 List<Object> findEntities(Number, RevisionType)-

返回给定修订版本中更改(添加、更新或删除)的所有审计实体的快照,并按照修改类型过滤。执行

n+1SQL 查询,其中n是指定修订版本中修改的多个不同实体类。Map<RevisionType, List<Object>> findEntitiesGroupByRevisionType(Number)-

返回包含由修改操作分组的实体快照列表的映射,如添加、更新或删除。执行

3n+1SQL 查询,其中n是指定修订版本中修改的多个不同实体类。

6.5.2. 使用参考实体属性的遍历实体协会

您可以使用引用实体的属性来遍历查询中的实体。这可让您查询一对一和多对一关联。

以下示例演示了您可以在查询中遍历实体的一些方式。

在修订号 1 中,查找所有者年龄为 20 岁或住在地址号 30 的车子,然后按照汽车制作排列结果。

List<Car> resultList = auditReader.createQuery() .forEntitiesAtRevision( Car.class, 1 ) .traverseRelation( "owner", JoinType.INNER, "p" ) .traverseRelation( "address", JoinType.INNER, "a" ) .up().up().add( AuditEntity.disjunction().add(AuditEntity.property( "p", "age" ) .eq( 20 ) ).add( AuditEntity.property( "a", "number" ).eq( 30 ) ) ) .addOrder( AuditEntity.property( "make" ).asc() ).getResultList();在修订号 1 中,查找所有者期限等于所有者地址号的车辆。

Car result = (Car) auditReader.createQuery() .forEntitiesAtRevision( Car.class, 1 ) .traverseRelation( "owner", JoinType.INNER, "p" ) .traverseRelation( "address", JoinType.INNER, "a" ) .up().up().add(AuditEntity.property( "p", "age" ) .eqProperty( "a", "number" ) ).getSingleResult();在修订号 1 中,查找所有者为 20 岁或没有所有者的所有车辆。

List<Car> resultList = auditReader.createQuery() .forEntitiesAtRevision( Car.class, 1 ) .traverseRelation( "owner", JoinType.LEFT, "p" ) .up().add( AuditEntity.or( AuditEntity.property( "p", "age").eq( 20 ), AuditEntity.relatedId( "owner" ).eq( null ) ) ) .addOrder( AuditEntity.property( "make" ).asc() ).getResultList();在修订号 1 中,找到 make 等于"car3"且所有者年龄为 30 或没有所有者的所有车辆。

List<Car> resultList = auditReader.createQuery() .forEntitiesAtRevision( Car.class, 1 ) .traverseRelation( "owner", JoinType.LEFT, "p" ) .up().add( AuditEntity.and( AuditEntity.property( "make" ).eq( "car3" ), AuditEntity.property( "p", "age" ).eq( 30 ) ) ) .getResultList();在修订号 1 中,查找 make 等于"car3"或所有者为 10 或没有所有者的所有车。

List<Car> resultList = auditReader.createQuery() .forEntitiesAtRevision( Car.class, 1 ) .traverseRelation( "owner", JoinType.LEFT, "p" ) .up().add( AuditEntity.or( AuditEntity.property( "make" ).eq( "car3" ), AuditEntity.property( "p", "age" ).eq( 10 ) ) ) .getResultList();

6.6. 性能调优

6.6.1. 备用批处理算法

Hibernate 允许您使用以下四种获取策略之一为关联加载数据: join、Select、subselect 和 batch。在这四种策略中,批处理加载允许最大的性能提升,因为它是选择获取的优化策略。在此策略中,Hibernate 通过指定主或外键列表,在单个 SELECT 语句中检索一组实体实例或集合。批处理获取是对 lazy 选择获取策略的优化。

有两种方法可以配置批处理获取:每个类级别或每收集级别。

按类级别

当 Hibernate 在每个类级别上加载数据时,它需要批量大小的关联,以便在查询时预加载。例如,请考虑在运行时您有 30 个加载到会话中的

car对象实例。每个car对象属于一个所有者对象。如果您要迭代所有汽车对象并请求其所有者,通过加载lazy,Hibernate 将发出 30 个选择声明 - 每个所有者一个。这是性能瓶颈。您可以在通过查询请求之前,告诉 Hibernate 预加载下一批所有者的数据。查询了

所有者对象后,Hibernate 将在同一个 SELECT 语句中查询更多这些对象。提前要查询

的所有者对象数量取决于配置时指定的batch-size参数:<class name="owner" batch-size="10"></class>

这会让 Hibernate 查询至少 10 个

所有者对象,预计在不久的将来会需要它们。当用户查询A 车的所有者时,汽车 B的所有者可能已经作为批处理加载的一部分加载。当用户实际需要car B的所有者,而不是前往数据库(并发出 SELECT 语句)时,可以从当前会话检索该值。除了

batch-size参数外,Hibernate 4.2.0 还引进了新的配置项,以提高批处理加载性能。配置项称为Batch Fetch Style配置,由hibernate.batch_fetch_style参数指定。支持三种不同的批处理获取方式:inrigacY、PADDED 和 DYNAMIC。要指定要使用的样式,请使用

org.hibernate.cfg.AvailableSettings#BATCH_FETCH_STYLE。强制要求:在旧式加载中,使用一组基于

ArrayHelper.getBatchSizes(int)预先构建的批处理大小。使用现有可批处理标识符数的下一个小型预构建批处理大小来加载批处理。继续前面的示例,

批处理大小设置为 30,预先构建的批处理大小为 [30、15、10、9、8、7、. 1]。尝试批量加载 29 个标识符将导致批处理 15、10 和 4。将会有 3 个对应的 SQL 查询,每个查询都从数据库中加载 15、10 和 4 所有者。PADDED - 添加类似于udACY 批处理加载样式。它仍然使用预先构建的批处理大小,但使用下一个bigger 批处理大小,并固定额外的标识符占位符。

与上例所示,如果初始化 30 个所有者对象,则仅对数据库执行一项查询。

但是,如果要初始化 29 个所有者对象,Hibernate 仍将仅执行一个批处理大小为 30 的 SQL 选择声明,使用带有重复标识符添加的额外空间 padded。

动态 - 虽然符合批处理大小限制,但这种批处理加载的方式使用要加载的实际对象数量动态构建其 SQL SELECT 语句。

例如,对于 30 所有者对象,最大批处理大小为 30,检索 30 所有者对象的调用将产生一个 SQL SELECT 语句。调用来检索 35 将产生两个分别批处理大小为 30 和 5 的 SQL 语句。Hibernate 将动态更改第二个 SQL 语句,使其保持为 5(所需数量),同时仍保持为批处理大小限制为 30。这与 PADDED 版本不同,因为第二个 SQL 不会获得 PADDED,与 criACY 样式不同,第二个 SQL 语句没有固定大小 - 第二个 SQL 是动态创建的。

对于少于 30 个标识符的查询,这种样式只会动态加载请求的标识符数。

按收集级别

Hibernate 还可以按照上述每个类部分中列出的批处理获取大小和样式进行批处理加载集合。

要反转上一节中使用的示例,请考虑您需要加载每个

所有者对象拥有的所有车对象。如果在当前会话迭代过程中加载 10 个所有者对象,则迭代所有所有者将生成 10 个 SELECT 语句,每个调用getCars()方法一个。如果在 Owner 映射中为行车集合启用批量获取,Hibernate 可以预先获取这些集合,如下所示:<class name="Owner"><set name="cars" batch-size="5"></set></class>

因此,由于批量大小为 5 个,并且使用传统的批处理样式来加载 10 个集合,Hibernate 将执行两个 SELECT 语句,各自检索五个集合。

6.6.2. 不可更改数据的第二级对象缓存

Hibernate 自动在内存中缓存数据以提高性能。这通过内存中缓存实现,该缓存可减少数据库查找的次数,特别是很少更改的数据。

Hibernate 维护两种类型的缓存:主缓存(也称为一级缓存)是必需的。此缓存与当前会话关联,并且所有请求都必须通过它。辅助缓存也称为第二级缓存,是可选的,仅在查询了主缓存后才会使用。

通过先将数据存储到一个状态数组中,数据存储在二级缓存中。这个数组会被深度复制,并将深度副本放入缓存中。相反,可以从缓存读取。这非常适合改变(可传递数据)的数据,但对不可变数据效率较低。

从内存使用情况和处理速度来看,深度复制数据是一项代价昂贵的操作。对于大型数据集,内存和处理速度成为了性能限制因素。Hibernate 允许您指定引用而非复制的不可变数据。Hibernate 现在可以将对数据的引用存储在缓存中,而不是复制整个数据集。

这可以通过将配置设置 hibernate.cache.use_reference_entries 的值更改为 true 来完成。默认情况下,hibernate.cache.use_reference_entries 设置为 false。

当 hibernate.cache.use_reference_entries 设置为 true 时,没有任何关联的不可变数据对象不会复制到二级缓存中,并且仅存储对其的引用。

当 hibernate.cache.use_reference_entries 设为 true 时,具有关联的不可变数据对象仍会深入复制到二级缓存中。

第 7 章 Hibernate Search

7.1. Hibernate Search 入门

7.1.1. 关于 Hibernate Search

Hibernate 搜索为 Hibernate 应用程序提供全文本搜索功能。尤其适合搜索基于 SQL 的解决方案不适合的应用程序,包括全文本、模糊搜索和地理位置搜索。Hibernate Search 使用 Apache Lucene 作为其全文本搜索引擎,但旨在最大限度地降低维护开销。配置后,索引、群集和数据同步将保持透明,让您专注于满足您的业务需求。

之前的 JBoss EAP 版本包括 Hibernate 4.2 和 Hibernate Search 4.6。JBoss EAP 7 包括 Hibernate 5 和 Hibernate Search 5.5。

Hibernate Search 5.5 与 Java 7 协同工作,现在基于 Lucene 5.3.x 构建。如果您使用任何原生 Lucene API,请确保与这个版本一致。

7.1.2. Hibernate 搜索概述

Hibernate 搜索由索引组件和索引搜索组件组成,它们都由 Apache Lucene 支持。每次从数据库插入、更新或删除实体时,Hibernate Search 都会通过 Hibernate 事件系统跟踪此事件并计划索引更新。所有这些更新都会被处理,而无需直接与 Apache Lucene API 交互。相反,与底层 Lucene 索引的交互是通过索引 管理器 来处理的。默认情况下,IndexManager 和 Lucene 索引之间有一个一对一的关系。IndexManager 会提取特定的索引配置,包括所选后端、readread 策略和 DirectoryProvider。

索引创建后,您可以搜索实体并返回受管实体列表,而不是处理底层 Lucene 基础架构。Hibernate 和 Hibernate 搜索之间共享相同的持久性上下文。FullTextSession 类构建在 Hibernate 会话 类之上,以便应用程序代码可以使用统一 org.hibernate.Query 或 javax.persistence.Query API,其方式与 HQL、Java Persistence 查询语言(JPQL)或原生查询相同。

建议在所有操作中使用事务性批处理模式,无论它们是基于 Java 命名和目录接口。

建议针对您的数据库和 Hibernate 搜索在事务中执行您的操作,无论是 Java 命名和目录界面还是 Jakarta Transactions。

Hibernate 搜索在 Hibernate 或实体管理器长对话模式中运行完美,称为原子对话。

7.1.3. 关于目录提供程序

Apache Lucene 是 Hibernate Search 基础架构的一部分,拥有用于存储索引的目录的概念。Hibernate Search 通过目录提供程序处理 Lucene Directory 实例的初始化和配置。

directory_provider 属性指定用于存储索引的目录提供程序。默认文件系统目录提供商是 filesystem,它使用本地文件系统来存储索引。

7.1.4. 关于工作程序

Lucene 索引的更新由 Hibernate Search Worker 处理,它接收所有实体更改,按照上下文对其进行队列,并在上下文结束时应用它们。最常见的上下文是事务,但可能取决于实体更改的数量或其他一些应用事件。

为提高效率,交互分批,一般在上下文结束时应用。在事务之外,索引更新操作会在实际数据库操作后执行。如果是持续事务,则为事务提交阶段调度索引更新操作,并在交易回滚时丢弃。工作程序可以配置特定的批处理大小限制,之后无论上下文如何进行索引。

这种处理索引更新的方法有两大好处:

- 性能:Lucene 索引在批量执行时效果更好。

- acidity:执行的工作范围与数据库事务所执行的范围相同,并且仅在提交事务时执行。这在严格意义上不是 ACID,但 ACID 行为对于完整文本搜索索引很少有用,因为它们可以随时从源重建。

两种批处理模式(无范围与事务)等同于 autocommit 与事务性行为。从性能角度看,建议使用事务模式。范围选择是透明的。Hibernate Search 可检测是否存在交易并调整范围范围。

7.1.5. 后端设置和操作

7.1.5.1. 后端

Hibernate Search 使用各种后端来处理批量工作。后端不限于配置选项 default.worker.backend。此属性指定 BackendQueueProcessor 接口的实施,该接口是后端配置的一部分。设置后端需要额外的设置,如 Jakarta Messaging 后端。

7.1.5.2. lucene

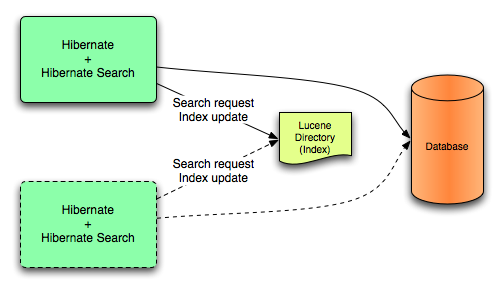

在 Lucene 模式中,节点的所有索引更新都由同一节点使用目录提供程序对 Lucene 目录执行。在非集群环境中或带有共享目录存储的集群环境中使用此模式。

图 7.1. Lucene 后端配置

Lucene 模式针对目录管理锁定策略的非集群或集群应用程序。Lucene 模式的主要优点是简单性和 Lucene 查询中更改的即时可见性。Near Real Time(NRT)后端是非集群和非共享索引配置的替代后端。

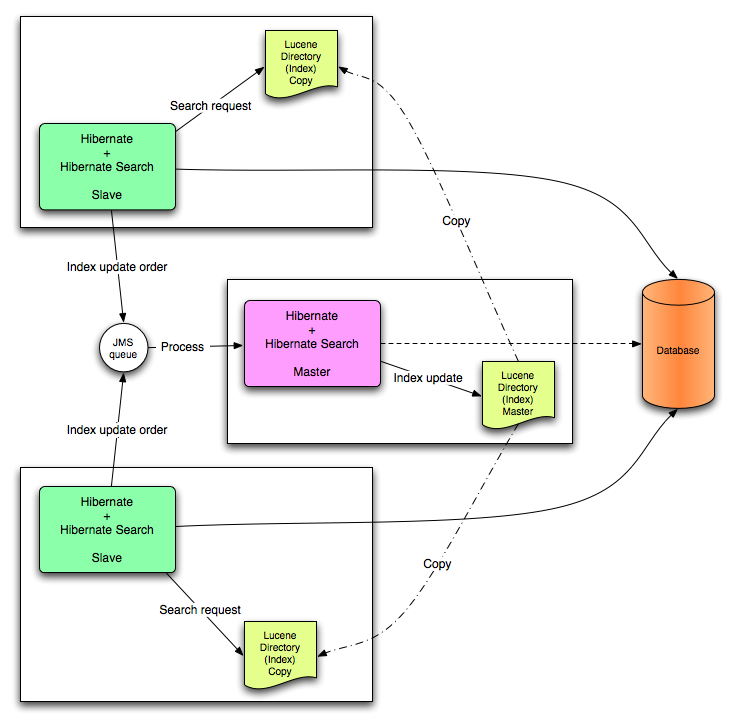

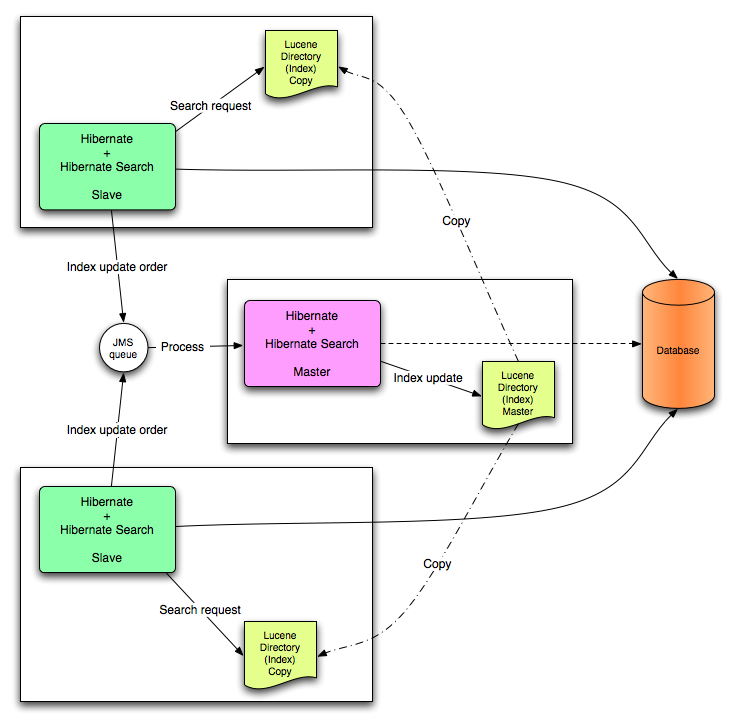

7.1.5.3. Jakarta Messaging

节点的索引更新发送到 Jakarta 消息传递队列。唯一的读取器处理队列并更新主索引。随后,主索引定期复制到从副本,从而建立主和从模式。主控机负责 Lucene 索引更新。slave 接受读写操作,但处理本地索引副本中的读取操作。主设备全权负责更新 Lucene 索引。仅 master 应用更新操作中的本地更改。

图 7.2. Jakarta 消息传递服务后端配置

此模式面向集群环境,其中吞吐量至关重要,并且可以节省索引更新延迟。Jakarta 消息传递供应商确保可靠性,并使用从设备更改本地索引副本。

7.1.6. 读取器策略

在执行查询时,Hibernate Search 使用 reader 策略与 Apache Lucene 索引交互。根据应用的配置集选择一个 reader 策略,如频繁更新、阅读主要异步索引更新。

7.1.6.1. 共享策略

使用 共享 策略,Hibernate Search 对给定的 Lucene 索引在多个查询和线程间共享相同的 IndexReader,但提供 IndexReader 保持更新。如果没有更新 IndexReader,则会打开并提供新的索引。每个 IndexReader 由多个 Segment Readers 组成。共享策略重新打开最后一次打开后修改或创建的片段,并共享上一实例中已加载的网段。这是默认的策略。

7.1.6.2. 未共享策略

使用 not-shared 策略时,Lucene IndexReader 每次执行查询时都会打开。打开并启动 index Reader 是一个代价昂贵的操作。因此,为每个查询执行打开 index Reader 不是有效的策略。

7.1.6.3. 自定义 Reader 策略

您可以使用 org.hibernate.search.reader.ReaderProvider 编写自定义 reader 策略。实施必须安全进行。

7.2. Configuration

7.2.1. 最低配置

Hibernate Search 旨在为其配置和操作提供灵活性,并且仔细选择默认值以适合大多数用例。至少必须配置目录提供程序及其属性。默认目录提供程序是 filesystem,它使用本地文件系统进行索引存储。有关可用目录提供程序及其配置的详细信息,请参阅 DirectoryProvider 配置。

如果您直接使用 Hibernate,必须在配置文件中设置 DirectoryProvider 等设置,可以是 hibernate.properties 或 hibernate.cfg.xml。如果您通过 Jakarta Persistence 使用 Hibernate,则配置文件为 persistence.xml。

其它资源

- 有关可用目录提供程序及其配置的详细信息,请参阅 DirectoryProvider 配置。

7.2.2. 配置 IndexManager

Hibernate Search 为这个接口提供几个实现:

-

基于目录:默认实施,它使用 LuceneDirectory抽象来管理索引文件。 -

近实时:避免在每次提交时清空到磁盘的写入。此索引管理器也基于目录,但使用 Lucene 的近乎实时 NRT 功能。

要指定默认以外的 IndexManager,请指定以下属性:

hibernate.search.[default|<indexname>].indexmanager = near-real-time

7.2.2.1. 基于目录

基于目录 的实施是默认的 IndexManager 实施。它高度可配置,允许为 reader 策略、后端和目录提供程序进行单独的配置。

7.2.2.2. 接近实时

NRTIndexManager 是默认 索引管理器 的扩展,它利用 Lucene NRT、Near Real Time(低延迟索引写入)功能。但是,它会忽略 lucene 以外的备用后端的配置设置,并在 目录 上获取专用写入锁定。

IndexWriter 不会刷新磁盘的每个更改来提供低延迟。查询可以从未清空的索引写入缓冲区读取更新的状态。但是,这意味着如果 IndexWriter 被终止或应用程序崩溃,可能会丢失更新,因此必须重建索引。

由于上述缺点,建议对数据有限的非集群网站采用 Near Real Time 配置,因为可以单独配置主节点以提高性能。

7.2.2.3. Custom

为自定义实现指定完全限定类名称,以设置自定义 IndexManager。为实施设置 no-gument 构造器,如下所示:

[default|<indexname>].indexmanager = my.corp.myapp.CustomIndexManager

自定义索引管理器实现不需要与默认实施相同的组件。例如,委派到不公开 目录 接口的远程索引服务。

7.2.3. DirectoryProvider 配置

DirectoryProvider 是围绕 Lucene Directory 的 Hibernate 搜索抽象,处理底层 Lucene 资源的配置和初始化。目录提供程序及其属性显示了 Hibernate Search 中提供的目录提供程序的列表,以及对应的选项。

每个索引化实体都与 Lucene 索引关联(多个实体共享同一索引的情况除外)。索引的名称由 @Indexed 注释的 index 属性提供。如果未指定 索引 属性,则索引的类的完全限定名称将用作名称(推荐)。

DirectoryProvider 及任何其他选项都可使用前缀 hibernate.search.<indexname> 进行配置。名称 default (hibernate.search.default)保留,可用于定义适用于所有索引的属性。配置目录提供程序 显示如何使用 hibernate.search.default.directory_provider 将默认目录提供程序设置为文件系统。Hibernate.search.default.indexBase 设置索引的默认基础目录。因此,在 /usr/lucene/indexes/org.hibernate.example.Status 中创建实体 状态 索引。

但是,规则 实体的索引正在使用内存中目录,因为此实体的默认目录提供商将被属性 hibernate.search.Rules.directory_provider 覆盖。

最后,Action 实体使用由 hibernate.search.Actions.directory_provider 指定的自定义目录供应商 CustomDirectoryProvider。

指定索引名称

package org.hibernate.example;

@Indexed

public class Status { ... }

@Indexed(index="Rules")

public class Rule { ... }

@Indexed(index="Actions")

public class Action { ... }

配置目录提供程序

hibernate.search.default.directory_provider = filesystem hibernate.search.default.indexBase=/usr/lucene/indexes hibernate.search.Rules.directory_provider = ram hibernate.search.Actions.directory_provider = com.acme.hibernate.CustomDirectoryProvider

使用上述配置方案,您可以轻松定义常见的规则,如目录提供程序和基础目录,并在以后按索引覆盖这些默认值。

目录提供程序及其属性

- ram

- 无

- Filesystem

基于文件系统的目录.使用的目录为 <indexBase>/< indexName >

- indexBase : base directory

- indexName :覆盖 @Indexed.index(对于分片索引非常有用)

- locking_strategy : 可选,请参阅 LockFactory 配置

-

filesystem_access_type :允许 确定此

DirectoryProvider使用的FSDirectory实施的确切类型。允许的值为auto(默认值,在非 Windows系统上选择 NIOFSDirectory,Windows 上的SimpleFSDirectory)、SimpleFSDirectory、nio(NIOFSDirectory)、mmap(MMapDirectory)。更改此设置之前,请参阅这些目录实施的 Java 文档。尽管NIOFSDirectory或MMapDirectory能够带来显著的性能提升,他们也有自己的问题。

filesystem-master基于文件系统的目录.比如

文件系统.它还定期将索引复制到源目录(aka copy 目录)。刷新周期的建议值是(至少) 50%,复制信息的时间要高于 3600 秒 - 60 分钟。

请注意,副本基于增量复制机制,减少了平均复制时间。

DirectoryProvider 通常用于 Jakarta Messaging 后端集群中的主节点。

buffer_size_on_copyBest 取决于您的操作系统和可用的 RAM;大多数用户使用 16 到 64MB 之间的值报告良好的结果。- indexBase: base directory

- indexName :覆盖 @Indexed.index(对于分片索引非常有用)

- sourceBase :源(复制)基础目录。

-

source :源目录后缀(默认为

@Indexed.index)。实际的源目录名称为<sourceBase>/<source> - 刷新 :刷新周期(每次刷新秒将发生一次复制 )。如果在以下刷新期满时副本仍在进行中,则将跳过第二个复制操作。

- buffer_size_on_copy :在单个低级复制指令中移动的 MegaBytes 数量;默认为 16MB。

- locking_strategy : 可选,请参阅 LockFactory 配置

-

filesystem_access_type :允许 确定此

DirectoryProvider使用的FSDirectory实施的确切类型。允许的值为auto(默认值,在非 Windows系统上选择 NIOFSDirectory,Windows 上的SimpleFSDirectory)、SimpleFSDirectory、nio(NIOFSDirectory)、mmap(MMapDirectory)。更改此设置之前,请参阅这些目录实施的 Java 文档。尽管NIOFSDirectory或MMapDirectory可以大幅提升性能,但您也需要意识到这些问题。

filesystem-slave基于文件系统的目录.与

文件系统类似,但会定期检索主版本(来源)。为避免锁定和不一致的搜索结果,保留 2 个本地副本。刷新周期的建议值是(至少) 50%,复制信息的时间要高于 3600 秒 - 60 分钟。

请注意,副本基于增量复制机制,减少了平均复制时间。如果刷新周期为限时副本仍在进行中,则将跳过第二个复制操作。

DirectoryProvider 通常用于使用 Jakarta 消息传递后端的从节点。

buffer_size_on_copyBest 取决于您的操作系统和可用的 RAM;大多数用户使用 16 到 64MB 之间的值报告良好的结果。- indexBase: Base directory

- indexName :覆盖 @Indexed.index(对于分片索引非常有用)

- SourceBase:源代码 (复制)基础目录。

-

Source: 源代码 目录后缀(默认为

@Indexed.index)。实际的源目录名称为<sourceBase>/<source> - refresh :刷新周期(复制将每刷新秒发生一次)。

- buffer_size_on_copy :在单个低级复制指令中移动的 MegaBytes 数量;默认为 16MB。

- locking_strategy : 可选,请参阅 LockFactory 配置

- retry_marker_lookup :可选,默认为 0。定义在失败前 Hibernate Search 检查源目录中标记文件的次数。在每次尝试之间等待 5 秒。

-

retry_initialize_period : 可选,以秒为单位设置整数值以启用重试初始化功能:如果从系统找不到主索引,它将再次尝试直到在后台找到它,而不阻止应用启动:在索引初始化前执行的完整Text 查询不会被阻断,而是返回空结果。如果不启用 选项或将其明确设置为零,它将失败,但有一个例外,而不是调度重试计时器。要防止应用程序在没有无效索引的情况下启动,但仍控制初始化超时,请参阅

retry_marker_lookup。 -

filesystem_access_type :允许 确定此

DirectoryProvider使用的FSDirectory实施的确切类型。允许的值为 auto(默认值,在非 Windows系统上选择 NIOFSDirectory,Windows 上的SimpleFSDirectory)、SimpleFSDirectory、nio(NIOFSDirectory)、mmap(MMapDirectory)。更改此设置之前,请参阅这些目录实施的 Java 文档。尽管NIOFSDirectory或MMapDirectory可以大幅提升性能,您也需要意识到这些问题。

如果内置目录提供商不适合您的需要,您可以通过实施 org.hibernate.store.DirectoryProvider 接口来编写自己的目录提供商。在这种情况下,将您的提供程序的完全限定类名称传递到 directory_provider 属性。您可以使用前缀 hibernate.search.<indexname> 传递任何其他属性。

7.2.4. Worker 配置

Hibernate Search 可通过 worker 配置与 Lucene 进行交互。有几个架构组件和可能的扩展点。让我们来详细了解一下.

使用 worker 配置优化 Infinispan Query 与 Lucene 交互的方式。此配置中有多种架构组件和可能的扩展点。

首先有一名 工作者。Worker 界面的实施负责接收所有实体更改,按照上下文排队,并在上下文结束时应用它们。最为直观的上下文(特别是在与 ORM 的连接时)就是事务。因此,Hibernate Search 默认使用 TransactionalWorker 来限制每次事务的所有更改。但是,可以想象一下上下文取决于实体数量或其它应用程序生命周期事件的情况。

表 7.1. 范围配置

| 属性 | 描述 |

|---|---|

|

|

要使用的 |

|

|

前缀为 |

|

|

定义每个上下文所批处理索引操作的最大数量。旦达到限制,即使上下文尚未结束,也会触发索引。只有 |

上下文结束后,应准备和应用索引更改。这可以在新线程内同步或异步完成。同步更新具有索引始终与数据库同步的优势。另一方面,异步更新可以帮助最小化用户响应时间。缺点是数据库和索引状态之间可能存在差异。

以下选项在每个索引上可能会有所不同;实际上,它们需要 indexName 前缀或使用 default 来为所有索引设置默认值。

表 7.2. 执行配置

| 属性 | 描述 |

|---|---|

|

|

|

|

| 后端可以使用线程池并行应用来自同一事务上下文(或批处理)的更新。默认值为 1。如果您每次事务都有多个操作,则可以使用更大的值进行试验。 |

|

| 定义线程池不足时的最大工作队列数。仅适用于异步执行.默认为无限.如果达到限制,则工作由主线程完成。 |

目前,所有工作都在同一个虚拟机(VM)中完成,无论哪种执行模式。单个虚拟机的工作总量还没有改变。幸运的是,有一个更好的方法,即委派。通过配置 hibernate.search.default.worker.backend,可以将索引工作发送到其他服务器。同样,这个选项可以针对每个索引配置不同。

表 7.3. 后端配置

| 属性 | 描述 |

|---|---|

|

|

您还可以指定实施 |

- Java 消息传递服务后端配置

| 属性 | 描述 |

|

| 定义 Java 命名和目录接口属性,以启动 InitialContext(如有必要)。Java 命名和目录接口仅供 Java 消息传递服务后端使用。 |

|

|

Java 消息传递服务后端必填.定义 Java 命名和目录接口名称,从中查找 Java 消息传递服务连接工厂(红帽 JBoss 企业应用平台中默认为 |

|

| Java 消息传递服务后端必填.定义 Java 命名和目录接口名称,从中查找 Java 消息传递服务队列。该队列将用于发布工作消息。 |

正如您可能注意到的,一些显示的属性是相关联的,这意味着并非所有属性值组合都有意义。实际上,您可以生成非功能配置。这在您自己提供部分显示接口的实现的情况下尤为正确。在编写自己的工作 程序或 后端队列程序实施 前,请务必研究现有的代码。

7.2.4.1. Jakarta Messaging Master/Slave Backd

这部分论述了如何配置主/从 Hibernate Search 架构。

图 7.3. Jakarta 消息传递后端配置

7.2.4.2. 从属节点

每个索引更新操作都会发送到 Jakarta 消息传递队列。索引查询操作在本地索引副本中执行。

Jakarta Messaging Slave 配置

### slave configuration ## DirectoryProvider # (remote) master location hibernate.search.default.sourceBase = /mnt/mastervolume/lucenedirs/mastercopy # local copy location hibernate.search.default.indexBase = /Users/prod/lucenedirs # refresh every half hour hibernate.search.default.refresh = 1800 # appropriate directory provider hibernate.search.default.directory_provider = filesystem-slave ## Back-end configuration hibernate.search.default.worker.backend = jms hibernate.search.default.worker.jms.connection_factory = /ConnectionFactory hibernate.search.default.worker.jms.queue = queue/hibernatesearch #optional jndi configuration (check your Jakarta Messaging provider for more information) ## Optional asynchronous execution strategy # hibernate.search.default.worker.execution = async # hibernate.search.default.worker.thread_pool.size = 2 # hibernate.search.default.worker.buffer_queue.max = 50

建议使用文件系统本地副本来加快搜索结果。

7.2.4.3. Master 节点

每个索引更新操作都从 Jakarta 消息传递队列执行并执行。主索引定期复制。

执行 Jakarta Messaging 队列中的索引更新操作,并定期复制主索引。

Jakarta 消息传递服务主配置

### master configuration ## DirectoryProvider # (remote) master location where information is copied to hibernate.search.default.sourceBase = /mnt/mastervolume/lucenedirs/mastercopy # local master location hibernate.search.default.indexBase = /Users/prod/lucenedirs # refresh every half hour hibernate.search.default.refresh = 1800 # appropriate directory provider hibernate.search.default.directory_provider = filesystem-master ## Back-end configuration #Back-end is the default for Lucene

除了 Hibernate Search 框架配置外,还必须编写和设置消息驱动型 Bean,以便通过 Jakarta Messaging 处理索引工作队列。

消息驱动的 Bean 处理索引队列

@MessageDriven(activationConfig = {

@ActivationConfigProperty(propertyName="destinationType",

propertyValue="javax.jms.Queue"),

@ActivationConfigProperty(propertyName="destination",

propertyValue="queue/hibernatesearch"),

@ActivationConfigProperty(propertyName="DLQMaxResent", propertyValue="1")

} )

public class MDBSearchController extends AbstractJMSHibernateSearchController

implements MessageListener {

@PersistenceContext EntityManager em;

//method retrieving the appropriate session

protected Session getSession() {

return (Session) em.getDelegate();

}

//potentially close the session opened in #getSession(), not needed here

protected void cleanSessionIfNeeded(Session session)

}

}

本例继承了 Hibernate Search 源代码中提供的抽象 Jakarta 消息传递控制器类,并实施 Jakarta EE MDB。此实施以示例形式提供,并可通过利用非 Jakarta EE 消息驱动型 Bean 而进行调整。

7.2.5. 调优 Lucene 索引

7.2.5.1. 调优 Lucene 索引性能

Hibernate Search 用于通过指定传递给底层 Lucene IndexWriter (如 mergeFactor、 maxMergeDocs 和 的一组参数来调整 Lucene 索引性能。指定这些参数作为为所有索引应用、基于索引甚至每个分片的默认值。

maxBufferedDocs )

有几个低级别 IndexWriter 设置可以针对不同的用例进行调整。这些参数按照 indexwriter 关键字分组:

hibernate.search.[default|<indexname>].indexwriter.<parameter_name>

如果没有在特定分片配置中为 索引写入器值 设置值,Hibernate Search 会检查 index 部分,然后在 default 部分。

下表中的配置将导致这些设置应用于 Animal 索引的第二个分片 :

-

max_merge_docs= 10 -

merge_factor= 20 -

ram_buffer_size= 64MB -

term_index_interval= Lucene default

所有其他值将使用 Lucene 中定义的默认值。

所有值的默认值都是保留为 Lucene 自己的默认值。索引性能和行为属性中列出的值取决于您使用的 Lucene 版本。显示的值相对于版本 2.4。

以前版本的 Hibernate Search 具有 批处理 和 事务 属性的概念。情况已不再如此,因为后端始终使用相同的设置执行工作。

表 7.4. 索引性能和行为属性

| 属性 | 描述 | 默认值 |

|---|---|---|

|

|

当其他进程不需要写入同一索引时,设置为 |

|

|

|

每个索引都有一个单独的"pipeline",其中包含要应用到索引的更新。当此队列满时,向队列添加更多操作将变为阻止操作。除非 |

|

|

| 确定应用和清空缓冲区内删除术语前所需的最小删除术语数量。如果当时内存中有被缓冲的文档,则它们会被合并并创建新的网段。 | 禁用(按 RAM 使用情况清空) |

|

| 控制索引期间内存中缓冲的文档数量。消耗的 RAM 量越大。 | 禁用(按 RAM 使用情况清空) |

|

| 定义片段中允许的最大文件数。较小的值在经常更改索引时表现更好,如果索引不经常改变,更大的值可以提供更好的搜索性能。 | 无限(Integer.MAX_VALUE) |

|

| 控制片段合并频率和大小。 确定插入时段索引的合并频率。使用较小的值时,索引和搜索未优化索引时会使用较少的 RAM,但索引速度较慢。当值较大时,索引期间会使用更多的 RAM,而搜索未优化索引时速度较慢,索引速度也更快。因此,较大的值(> 10)最适合创建批处理索引,更适合以互动方式维护的索引的更小的值(< 10)。该值不能低于 2。 | 10 |

|

|

控制片段合并频率和大小。在下一个片段合并操作中始终考虑小于这个大小的片段(以 MB 为单位)。设置这个太大可能会导致合并操作昂贵,即使它们的频率较低。See also | 0 MB(实际为 ~1K) |

|

| 控制片段合并频率和大小。 大于这个大小的片段(以 MB 为单位)永远不会合并到更大的网段。 这有助于降低内存要求并避免以最佳搜索速度为代价进行一些合并操作。在优化索引时,这个值将被忽略。

See also | 无限 |

|

| 控制片段合并频率和大小。

即使优化索引,大于这个大小的片段(以 MB 为单位)也不会合并(请参阅

Applied to | 无限 |

|

| 控制片段合并频率和大小。

设置为

应用到 |

|

|

| 控制专用于文档缓冲区的 RAM 量(以 MB 为单位)。在一起使用 max_buffered_docs 时,会首先进行刷新(以此类事件为准)。 通常,为了提高索引性能,最好使用 RAM 刷新,而不是按文档计数进行清除,并使用尽可能大的 RAM 缓冲区。 | 16 MB |

|

| 设置索引术语之间的间隔。 较大的值会导致 IndexReader 使用的内存减少,但随机访问速度较慢。Small 值会导致 IndexReader 使用更多内存,并加快对术语的随机访问。详情请查看 Lucene 文档。 | 128 |

|

|

使用复合文件格式的优点是使用较少的文件描述符。缺点是索引需要更长的时间和临时磁盘空间。您可以在改进索引时间时将此参数设置为

布尔值参数,使用 | true |

|

| 并非所有实体更改都需要 Lucene 索引更新。如果没有索引所有更新的实体属性(脏属性),Hibernate Search 将跳过重新索引的过程。

如果您使用需要在每次更新事件中调用的自定义

此优化不应用于使用

布尔值参数,使用 | true |

黑色后端 不应在生产环境中使用,而是仅作为识别索引瓶颈的工具。

7.2.5.2. Lucene IndexWriter

有几个低级别 IndexWriter 设置可以针对不同的用例进行调整。这些参数按照 indexwriter 关键字分组:

default.<indexname>.indexwriter.<parameter_name>

如果没有在分片配置中为 indexwriter 设置值,Hibernate Search 会查看 index 部分,然后查看 default 部分。

7.2.5.3. 性能选项配置

以下配置将导致这些设置应用到 Animal 索引的第二个分片中 :

性能选项配置示例

default.Animals.2.indexwriter.max_merge_docs = 10 default.Animals.2.indexwriter.merge_factor = 20 default.Animals.2.indexwriter.term_index_interval = default default.indexwriter.max_merge_docs = 100 default.indexwriter.ram_buffer_size = 64

-

max_merge_docs= 10 -

merge_factor= 20 -

ram_buffer_size= 64MB -

term_index_interval= Lucene default

所有其他值将使用 Lucene 中定义的默认值。

Lucene 默认值是 Hibernate Search 的默认设置。因此,下表中列出的值取决于所使用的 Lucene 版本。显示的值相对于版本 2.4。有关 Lucene 索引性能的更多信息,请参阅 Lucene 文档。

后端始终使用相同的设置执行工作。

表 7.5. 索引性能和行为属性

| 属性 | 描述 | 默认值 |

|---|---|---|

|

|

当其他进程不需要写入同一索引时,设置为 |

|

|

|

每个索引都有一个单独的"pipeline",其中包含要应用到索引的更新。当此队列满时,向队列添加更多操作将变为阻止操作。除非 |

|

|

| 确定应用和清空缓冲区内删除术语前所需的最小删除术语数量。如果当时内存中有被缓冲的文档,则它们会被合并并创建新的网段。 | 禁用(按 RAM 使用情况清空) |

|

| 控制索引期间内存中缓冲的文档数量。消耗的 RAM 量越大。 | 禁用(按 RAM 使用情况清空) |

|

| 定义片段中允许的最大文件数。较小的值在经常更改索引时表现更好,如果索引不经常改变,更大的值可以提供更好的搜索性能。 | 无限(Integer.MAX_VALUE) |

|

| 控制片段合并频率和大小。 确定插入时段索引的合并频率。使用较小的值时,索引和搜索未优化索引时会使用较少的 RAM,但索引速度较慢。当值较大时,索引期间会使用更多的 RAM,而搜索未优化索引时速度较慢,索引速度也更快。因此,较大的值(> 10)最适合创建批处理索引,更适合以互动方式维护的索引的更小的值(< 10)。该值不能低于 2。 | 10 |

|

| 控制片段合并频率和大小。 在下一个片段合并操作中始终考虑小于这个大小的片段(以 MB 为单位)。 设置这个太大可能会导致合并操作昂贵,即使它们的频率较低。

See also | 0 MB(实际为 ~1K) |

|

| 控制片段合并频率和大小。 大于这个大小的片段(以 MB 为单位)永远不会合并到更大的网段。 这有助于降低内存要求并避免以最佳搜索速度为代价进行一些合并操作。在优化索引时,这个值将被忽略。

See also | 无限 |

|

| 控制片段合并频率和大小。

即使优化索引,大于这个大小的片段(以 MB 为单位)也不会合并(请参阅

Applied to | 无限 |

|

| 控制片段合并频率和大小。

设置为

应用到 |

|

|

| 控制专用于文档缓冲区的 RAM 量(以 MB 为单位)。在一起使用 max_buffered_docs 时,会首先进行刷新(以此类事件为准)。 通常,为了提高索引性能,最好使用 RAM 刷新,而不是按文档计数进行清除,并使用尽可能大的 RAM 缓冲区。 | 16 MB |

|

| 设置索引术语之间的间隔。 较大的值会导致 IndexReader 使用的内存减少,但术语随机访问速度较慢。小的值可让 IndexReader 使用更多内存,并加快术语随机访问的速度。详情请查看 Lucene 文档。 | 128 |

|

|

使用复合文件格式的优点是使用较少的文件描述符。缺点是索引需要更长的时间和临时磁盘空间。您可以在改进索引时间时将此参数设置为

布尔值参数,使用 | true |

|

| 并非所有实体更改都需要 Lucene 索引更新。如果没有索引所有更新的实体属性(脏属性),Hibernate Search 将跳过重新索引的过程。

如果您使用需要在每次更新事件中调用的自定义

此优化不应用于使用

布尔值参数,使用 | true |

7.2.5.4. 调整索引速度

架构允许时,保留 default.exclusive_index_use=true,以提高索引写入效率。

在调优索引速度时,推荐的方法首先侧重于优化对象加载,然后使用您实现的计时来调整索引过程。将 黑色设置为 worker 后端,并启动索引例程。此后端不禁用 Hibernate 搜索。它将生成必要的更改集到索引,但丢弃它们而不是将它们清空到索引。与将 hibernate.search.indexing_strategy 设置为 manual 不同,使用 黑色可能会从数据库中加载更多数据,因为相关实体也会 重新索引。

hibernate.search.[default|<indexname>].worker.backend blackhole

黑色后端 不会在生产环境中使用,而是作为识别索引瓶颈的诊断工具。

7.2.5.5. 控制分段大小

以下选项配置所创建的片段的最大大小:

-

merge_max_size -

merge_max_optimize_size -

merge_calibrate_by_deletes

控制分段大小

//to be fairly confident no files grow above 15MB, use: hibernate.search.default.indexwriter.ram_buffer_size = 10 hibernate.search.default.indexwriter.merge_max_optimize_size = 7 hibernate.search.default.indexwriter.merge_max_size = 7

将合并操作的 max_size 设置为硬限制段大小小于一半,因为合并片段将两个片段合并为一个更大的片段。

新网段最初可能比预期大小更大,但创建网段永远不会显著大于 ram_buffer_size。将此阈值检查为估计值。

7.2.6. LockFactory 配置

Lucene Directory 可通过 LockingFactory(通过 Hibernate Search 管理的每个索引的 LockingFactory )进行配置。

有些锁定策略需要文件系统级别锁定,并可用于基于 RAM 的索引。在使用此策略时,必须指定 IndexBase 配置选项以指向存储锁定标记文件的文件系统位置。

要选择一个锁定工厂,将 hibernate.search.<index>.locking_strategy 选项设置为以下选项:

- simple

- native

- 单

- none

表 7.6. 可用 LockFactory 实施列表

| 名称 | class | 描述 |

|---|---|---|

|

LockFactory 配置 | org.apache.lucene.store.SimpleFSLockFactory | 基于 Java 文件 API 的安全实施,它通过创建标志文件来标记索引的使用。 如果出于某种原因您必须终止应用程序,则需要先删除此文件,然后才能将其重新启动。 |

|

| org.apache.lucene.store.NativeFSLockFactory |

就像 这种实施在 NFS 上存在已知问题,避免在网络共享中产生问题。

|

|

| org.apache.lucene.store.SingleInstanceLockFactory | 此 LockFactory 不使用文件标记,而是内存中保留的 Java 对象锁定;因此,只有在您确定索引不会由任何其他进程共享时,才可以使用它。

这是 |

|

| org.apache.lucene.store.NoLockFactory | 对此索引的更改不会通过锁定协调。 |

以下是锁定策略配置示例:

hibernate.search.default.locking_strategy = simple hibernate.search.Animals.locking_strategy = native hibernate.search.Books.locking_strategy = org.custom.components.MyLockingFactory

7.2.7. 索引格式兼容性

Hibernate Search 目前不提供向后兼容 API 或工具来协助将应用程序移植到较新版本。API 使用 Apache Lucene 编写和搜索索引。有时可能需要更新索引格式。在这种情况下,如果 Lucene 无法读取旧格式,则可能需要重新索引数据。

在尝试更新索引格式前备份索引。

Hibernate Search 公开 hibernate.search.lucene_version 配置属性。此属性指示 Analyzers 和其他 Lucene 类遵守旧版 Lucene 中定义的行为。另请参见 lu 。如果未指定 选项,Hibernate Search 会指示 Lucene 使用版本默认值。建议在配置中明确定义使用的版本,以防止在升级发生时自动更改。升级后,可以根据需要明确更新配置值。

cene-core.jar 中包含的 org.apache.lucene.util. Version

强制 Analyzers 与创建 Lucene 3.0 创建的索引兼容

hibernate.search.lucene_version = LUCENE_30

配置的 SearchFactory 是全局的,会影响包含相关参数的所有 Lucene API。如果使用 Lucene 并且 Hibernate Search 被绕过,请对其应用相同的值,以获得一致的结果。

7.3. 应用程序的 Hibernate 搜索

7.3.1. Hibernate Search 的第一步

要开始使用应用程序的 Hibernate 搜索,请按照以下主题操作:

7.3.2. 使用 Maven 启用 Hibernate Search

在 Maven 项目中使用以下配置添加 hibernate-search-orm 依赖项:

<dependencyManagement>

<dependencies>

<dependency>

<groupId>org.hibernate</groupId>

<artifactId>hibernate-search-orm</artifactId>

<version>5.5.1.Final-redhat-1</version>

</dependency>

</dependencies>

</dependencyManagement>

<dependencies>

<dependency>

<groupId>org.hibernate</groupId>

<artifactId>hibernate-search-orm</artifactId>

<scope>provided</scope>

</dependency>

</dependencies>7.3.3. 添加注解

对于本节,请考虑您拥有包含图书详细信息的数据库的示例。您的应用包含 Hibernate 管理的类 example.Book 和 example.Author,您想要为您的应用添加免费文本搜索功能以启用搜索图书。

示例:在添加 Hibernate 搜索特定注释前实体书和授权

package example;

...

@Entity

public class Book {

@Id

@GeneratedValue

private Integer id;

private String title;

private String subtitle;

@ManyToMany

private Set<Author> authors = new HashSet<Author>();

private Date publicationDate;

public Book() {}

// standard getters/setters follow here

...

}

package example;

...

@Entity

public class Author {

@Id

@GeneratedValue

private Integer id;

private String name;

public Author() {}

// standard getters/setters follow here

...

}

要达到此目的,您必须向 Book 和 Author 类添加一些注释。第一个注释 @Indexed 将 Book 标记为可索引。按照设计,Hibernate Search 在索引中存储一个未描述的 ID,以确保给定实体的索引不可变。@DocumentId 标记用于此目的的属性,并且在大多数情况下与数据库主密钥相同。如果存在 @Id 注释,则 注释是可选的。

@Document Id

接下来,您要使可搜索的字段必须标记为。在本例中,以标题 和副 标题 开头,并以@Field 标注。参数 index=Index.YES 将确保对文本进行索引,而 analyze=Analyze.YES 则确保将使用默认的 Lucene 分析器分析文本。通常,分析意味着将句子划分为单个单词,并可能排除诸如 "a"或. “”我们稍后将深入探讨分析器。我们在 @Field (storage=Store.NO )中指定的第三个参数确保实际数据不会存储在索引中。此数据存储在索引中是否与搜索它的能力无关。从 Lucene 的角度来看,在索引创建后不需要保留数据。存储它的好处是能够通过预测来检索。

如果不进行预测,Hibernate Search 默认为执行 Lucene 查询,以查找符合查询条件的实体的数据库标识符,并使用这些标识符从数据库中检索受管对象。对预测或预测的决定必须逐例做出。建议使用默认行为,因为它返回受管对象,而 仅返回对象数组。请注意,index=Index.YES,analyze=Analyze.YES 和 store=Store.NO 是这些参数的默认值,可以省略。

尚未讨论的另一个注释是 @DateBridge。此注释是 Hibernate Search 中的内置字段桥之一。Lucene 索引纯粹基于字符串。因此,Hibernate Search 必须将索引字段的数据类型转换为字符串,反之亦然。提供了一系列预定义的网桥,包括 DateBridge,它使用指定的解析将 java.util.Date 转换为字符串。如需了解更多详细信息,请参阅网桥。

这将为我们保留 @IndexedEmbedded。此注释用于为所属实体(@ManyToMany、@*ToOne、@Embedded 和 @ElementCollection)索引关联实体。这是必要的,因为 Lucene 索引文档是一个扁平数据结构,它不知道对象关系。为确保作者姓名可以搜索,您必须确保将姓名作为本书本身的一部分进行索引。在 @IndexedEmbedded 的顶部,您还必须标记您希望在 @Indexed 索引中包含的关联实体的所有字段。如需了解更多详细信息,请参阅嵌入式对象和关联对象。

这些设置现在应该已足够。有关实体映射的详情,请参阅映射实体。

示例:添加 Hibernate 搜索注解后的实体

package example;

...

@Entity

public class Book {

@Id

@GeneratedValue

private Integer id;

private String title;

private String subtitle;

@Field(index = Index.YES, analyze=Analyze.NO, store = Store.YES)

@DateBridge(resolution = Resolution.DAY)

private Date publicationDate;

@ManyToMany

private Set<Author> authors = new HashSet<Author>();

public Book() {

}

// standard getters/setters follow here

...

}

package example;

...

@Entity

public class Author {

@Id

@GeneratedValue

private Integer id;

private String name;

public Author() {

}

// standard getters/setters follow here

...

}7.3.4. 索引

Hibernate Search 将通过 Hibernate 核心以透明的方式索引每个实体保留、更新或删除。但是,您必须为数据库中已存在的数据创建初始 Lucene 索引。添加上述属性和注释后,应当触发工作簿中的初始批处理索引。您可以使用以下代码片段之一来实现此目的(请参阅 ):

示例:使用 Hibernate 会话索引数据

FullTextSession fullTextSession = org.hibernate.search.Search.getFullTextSession(session); fullTextSession.createIndexer().startAndWait();

示例:使用 Jakarta Persistence 来索引数据

EntityManager em = entityManagerFactory.createEntityManager(); FullTextEntityManager fullTextEntityManager = org.hibernate.search.jpa.Search.getFullTextEntityManager(em); fullTextEntityManager.createIndexer().startAndWait();

执行上述代码后,您应能够在 /var/lucene/indexes/example.Book 下看到 Lucene 索引。使用 Luke 检查此索引以帮助您了解 Hibernate 搜索的工作原理。

7.3.5. 搜索

要执行搜索,请使用 Lucene API 或 Hibernate Search query DSL 创建 Lucene 查询查询。将查询嵌套在 org.hibernate.Query 中,以从 Hibernate API 获取所需的功能。以下代码根据索引字段准备查询。执行代码将返回 Books 列表。

示例:使用 Hibernate 搜索会话创建和执行搜索

FullTextSession fullTextSession = Search.getFullTextSession(session);

Transaction tx = fullTextSession.beginTransaction();

// create native Lucene query using the query DSL

// alternatively you can write the Lucene query using the Lucene query parser

// or the Lucene programmatic API. The Hibernate Search DSL is recommended though

QueryBuilder qb = fullTextSession.getSearchFactory()

.buildQueryBuilder().forEntity( Book.class ).get();

org.apache.lucene.search.Query query = qb

.keyword()

.onFields("title", "subtitle", "authors.name", "publicationDate")

.matching("Java rocks!")

.createQuery();

// wrap Lucene query in a org.hibernate.Query

org.hibernate.Query hibQuery =

fullTextSession.createFullTextQuery(query, Book.class);

// execute search

List result = hibQuery.list();

tx.commit();

session.close();

示例:使用 Jakarta Persistence 创建和执行搜索

EntityManager em = entityManagerFactory.createEntityManager();

FullTextEntityManager fullTextEntityManager =

org.hibernate.search.jpa.Search.getFullTextEntityManager(em);

em.getTransaction().begin();

// create native Lucene query using the query DSL

// alternatively you can write the Lucene query using the Lucene query parser

// or the Lucene programmatic API. The Hibernate Search DSL is recommended though

QueryBuilder qb = fullTextEntityManager.getSearchFactory()

.buildQueryBuilder().forEntity( Book.class ).get();

org.apache.lucene.search.Query query = qb

.keyword()

.onFields("title", "subtitle", "authors.name", "publicationDate")

.matching("Java rocks!")

.createQuery();

// wrap Lucene query in a javax.persistence.Query

javax.persistence.Query persistenceQuery =

fullTextEntityManager.createFullTextQuery(query, Book.class);

// execute search

List result = persistenceQuery.getResultList();

em.getTransaction().commit();

em.close();

7.3.6. Analyzer

假设索引图书实体的标题 重构:改进现有代码的设计,并且 以下查询需要点击: 重构、重 构、 重构 和 重构。在 Lucene 中选择一个分析器类,该类在索引和搜索时应用单词强制。Hibernate Search 提供多种配置分析器的方法(请参阅默认分析器和按类分析器 ),了解更多信息:

-

在配置文件中设置

analyzer属性。指定类成为默认分析器。 -

在实体级别上设置

@Analyzer注释。 -

在字段级别上设置

@Analyzer注释。

指定要使用的完全限定类名称或分析器,或者查看由 @AnalyzerDef 注释定义的分析器,以及 @Analyzer 注释。使用 Solr 分析器框架及其工厂选择后一个选项。有关工厂类的更多信息,请参阅 Solr JavaDoc 或阅读 Solr Wiki 的对应章节。

在示例中,两个过滤器工厂使用 StandardTokenizerFactory:LowerCaseFilterFactory 和 SnowballPorterFilterFactory。令牌者在标点字符和连字符分割单词,但保持电子邮件地址和互联网主机名不变。标准令牌程序是这一操作和其他常规操作的理想选择。小写过滤器将令牌中的所有字母转换为小写,snowball 过滤器则应用特定于语言的逻辑。

如果使用 Solr 框架,请使用带任意数量的过滤器的令牌程序。

示例:使用 @AnalyzerDef 和 Solr Framework 来定义和使用分析器

@Indexed

@AnalyzerDef(

name = "customanalyzer",

tokenizer = @TokenizerDef(factory = StandardTokenizerFactory.class),

filters = {

@TokenFilterDef(factory = LowerCaseFilterFactory.class),

@TokenFilterDef(factory = SnowballPorterFilterFactory.class,

params = { @Parameter(name = "language", value = "English") })

})

public class Book implements Serializable {

@Field

@Analyzer(definition = "customanalyzer")

private String title;

@Field

@Analyzer(definition = "customanalyzer")

private String subtitle;

@IndexedEmbedded

private Set authors = new HashSet();

@Field(index = Index.YES, analyze = Analyze.NO, store = Store.YES)

@DateBridge(resolution = Resolution.DAY)

private Date publicationDate;

public Book() {

}

// standard getters/setters follow here

...

}

使用 @AnalyzerDef 定义分析器,然后使用 @Analyzer 将它应用到实体和属性。在该示例中,定义了 customanalyzer,但不应用于实体。分析器仅适用于 标题 属性。分析器定义是全局的。为实体定义分析器,并根据需要为实体重新利用定义。

和副标题

7.4. 将实体映射到索引结构

7.4.1. 映射实体

索引实体所需的所有元数据信息都通过注释进行描述,因此无需 XML 映射文件。您仍然可以将 Hibernate 映射文件用于基本 Hibernate 配置,但是必须通过注释来表示 Hibernate Search 特定配置。

7.4.1.1. 基本映射

让我们从最常用于映射实体的注释开始。

基于 Lucene 的查询 API 使用以下常见注解来映射实体:

- @Indexed

- @Field

- @NumericField

- @Id

7.4.1.2. @Indexed

最重要的是,我们必须将持久类声明为可索引。这可以通过使用 @Indexed 为类添加注解(索引流程将忽略未注释 @Indexed 的 所有实体):

@Entity

@Indexed

public class Essay {

...

}

您可以选择指定 @Indexed 注释的 index 属性,以更改索引的默认名称。

7.4.1.3. @Field

对于实体的每个属性(或属性),您可以描述如何对其进行索引。默认(不存在)表示索引过程中会忽略该属性。

在 Hibernate Search 5 之前,只有通过 @NumericField 明确请求时,才会选择数字字段编码。从 Hibernate Search 5 开始,系统将自动为数字类型选择此编码。为避免数字编码,您可以通过 @Field.bridge 或 明确指定非数字字段网桥。软件包 @Field Bridgeorg.hibernate.search.bridge.builtin 包含一组网桥,这些网桥编号编码为字符串,如 org.hibernate.search.bridge.builtin.IntegerBridge。

@field 确实将属性声明 为索引,并允许通过设置以下一个或多个属性来配置索引过程的多个方面:

-

Name :describe 在哪个名称下,该属性应存储在 Lucene 文档中。默认值为属性名称(遵循 JavaBeans 约定) -

存储:描述属性是否存储在 Lucene 索引中。您可以存储值Store.YES(在索引中消耗更多空间,但允许 投射,以压缩方式存储 Store.COMPRESS(这确实消耗更多 CPU),或者避免任何存储Store.NO(这是默认值)。存储属性时,您可以从 Lucene 文档检索其原始值。这与元素是否索引无关。 index:描述属性是否索引。不同的值是 index.NO,这表示它不会被索引,不能被查询和Index.YES找到,即元素会被索引并可以搜索。默认值为Index.YES。index. no在不需要可搜索属性但应该可用于投射的情形中,将非常有用。注意index.NO与 Analyze.YES或Norms.YES结合使用,因为分析和强制要求对该属性进行索引。分析:确定属性是否被分析(Analyze.YES)还是不分析(Analyze.NO)。默认值为 Analyze.YES。注意是否要分析属性取决于您是否希望按原样搜索元素,或按其包含的词语搜索。分析文本字段会有意义,但可能不是日期字段。

注意不得分析用于排序的字段。

-

强制:描述索引时间提升信息应存储(Norms.YES)还是不存储(Norms.NO)。不存储存储会节省大量内存,但没有任何索引时间提高可用信息。默认值为Norms.YES。 termVector:描述术语频率对的集合。这个属性允许在索引过程中将术语向量存储在文档中。默认值为TermVector.NO。此属性的不同值有:

值 定义 TermVector.YES

存储每个文档的术语向量。这会生成两个同步的数组,一个包含文档术语,另一个包含术语的频率。

TermVector.NO

不要存储术语向量。

TermVector.WITH_OFFSETS

存储术语向量和令牌偏移信息。这与 TermVector.YES 加上它包含术语的起始和结束偏移位置信息相同。

TermVector.WITH_POSITIONS

存储术语向量和令牌位置信息。这与 TermVector.YES 相同,还包含每一次在文档中出现某个术语的规范。

TermVector.WITH_POSITION_OFFSETS

存储术语向量、令牌位置和偏移信息。这是 YES、WITH_OFFSETS 和 WITH_POSITIONS 的组合。

indexNullAs: Per default null 值将被忽略且未索引。不过,您可以使用indexNullAs指定一个字符串,该字符串将被插入为null值的令牌。默认情况下,此值设置为Field。DO_NOT_INDEX_NULL表示不应索引null值。您可以将这个值设置为Field.DEFAULT_NULL_TOKEN,以指示应使用默认的空令牌。可以使用hibernate.search.default_null_token在配置中指定此默认空令牌。如果未设置此属性,并且指定了Field.DEFAULT_NULL_TOKEN,则字符串 "null" 将用作默认值。注意使用

indexNullAs参数时,务必要在搜索查询中使用相同的令牌来搜索null值。此外,建议仅在未分析的字段(分析.NO)中使用此功能。警告在实施自定义 FieldBridge 或 TwoWayFieldBridge 时,开发人员可以处理 null 值的索引(请参阅 JavaDocs LuceneOptions.indexNullAs())。

7.4.1.4. @NumericField

@Field 有一个相应的注释,名为 @NumericField,其范围与 @Field 或 @DocumentId 相同。它可用于 Integer、Long、Float 和 Double 属性。在索引时,将使用 Trie 结构对该值进行索引。当属性索引为数字字段时,它实现了有效的范围查询和排序,与对标准 @Field 属性执行相同的查询相比,它实现了高效的范围查询和排序。@NumericField 注释接受以下参数:

| 值 | 定义 |

|---|---|

| forField | (可选)指定将索引为数字的相关 @Field 的名称。只有 属性包含超过 @Field 声明时,才强制使用它 |

| precisionStep | (可选)更改 Trie 结构存储在索引中的方式。较小的精度Steps会导致更多磁盘空间使用量、更快的范围和排序查询。较大的值会导致使用空间减少,范围查询性能更接近普通 @Fields 中的范围查询。默认值为 4。 |

@NumericField 仅支持 Double、Long、Integer 和 Float。其他数字类型无法利用 Lucene 中的类似功能,因此其余类型应使用默认或自定义 TwoWayFieldBridge 进行字符串编码。

假设您可以在类型转换过程中处理近似值,可以使用自定义 NumericFieldBridge:

示例:定义自定义数字FieldBridge

public class BigDecimalNumericFieldBridge extends NumericFieldBridge {

private static final BigDecimal storeFactor = BigDecimal.valueOf(100);

@Override

public void set(String name, Object value, Document document, LuceneOptions luceneOptions) {

if ( value != null ) {

BigDecimal decimalValue = (BigDecimal) value;