在 OpenShift 中使用 AMQ Streams

用于 OpenShift Container Platform 上的 AMQ Streams 1.8

摘要

使开源包含更多

红帽承诺替换我们的代码、文档和网页属性中存在问题的语言。我们从这四个术语开始: master、slave、blacklist 和 whitelist。这些更改将在即将发行的几个发行本中逐渐实施。如需了解更多详细信息,请参阅 CTO Chris Wright 信息。

第 1 章 AMQ 流概述

AMQ Streams 简化了在 OpenShift 集群中运行 Apache Kafka 的过程。

本指南提供有关配置 Kafka 组件和使用 AMQ Streams Operator 的说明。步骤与您可能想要修改部署的方式相关,并引进其他功能,如 Cruise Control 或分布式追踪。

您可以使用 AMQ Streams 自定义资源 配置部署。自定义资源 API 引用 描述了您可以在配置中使用的属性。

您是否想要开始使用 AMQ Streams?有关逐步部署说明,请参阅 OpenShift 中的部署和升级 AMQ Streams 指南 。

1.1. Kafka 功能

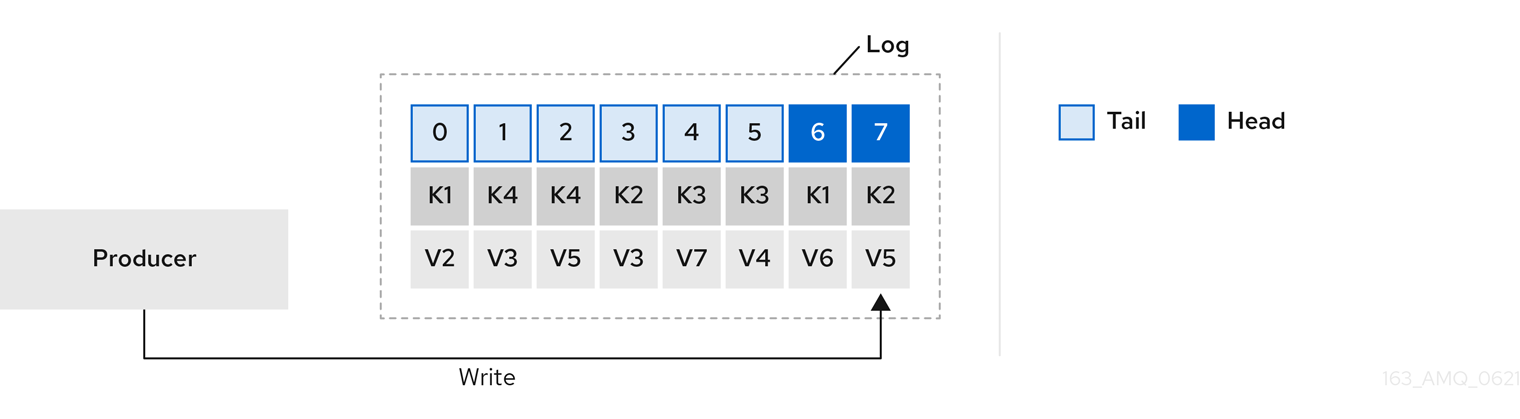

Kafka 的底层数据流处理功能和组件架构可以提供:

- 微服务和其他应用以极高的吞吐量和低延迟共享数据

- 消息排序保证

- 从数据存储中重获/重播消息以重建应用程序状态

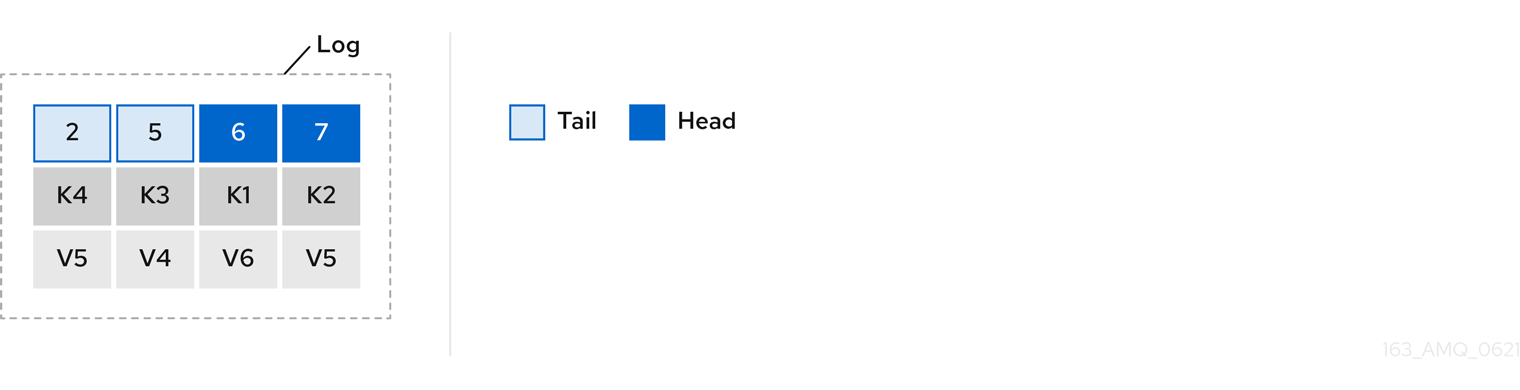

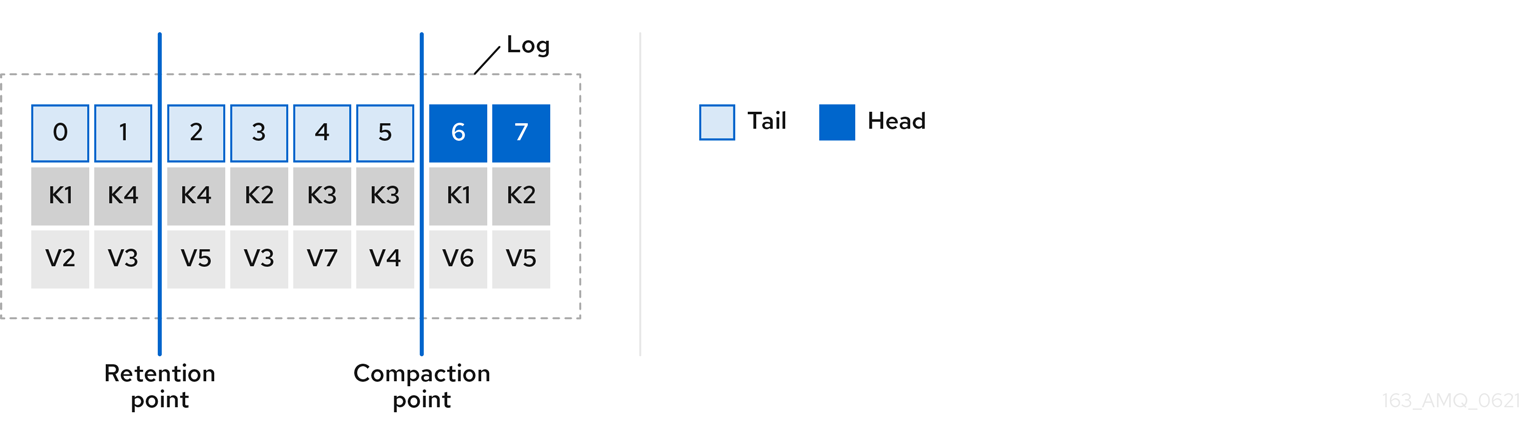

- 使用键值日志时删除旧记录的消息紧凑

- 集群配置中的水平可扩展性

- 数据复制来控制容错

- 保留大量数据以便立即访问

1.2. Kafka 用例

Kafka 的功能使其适合:

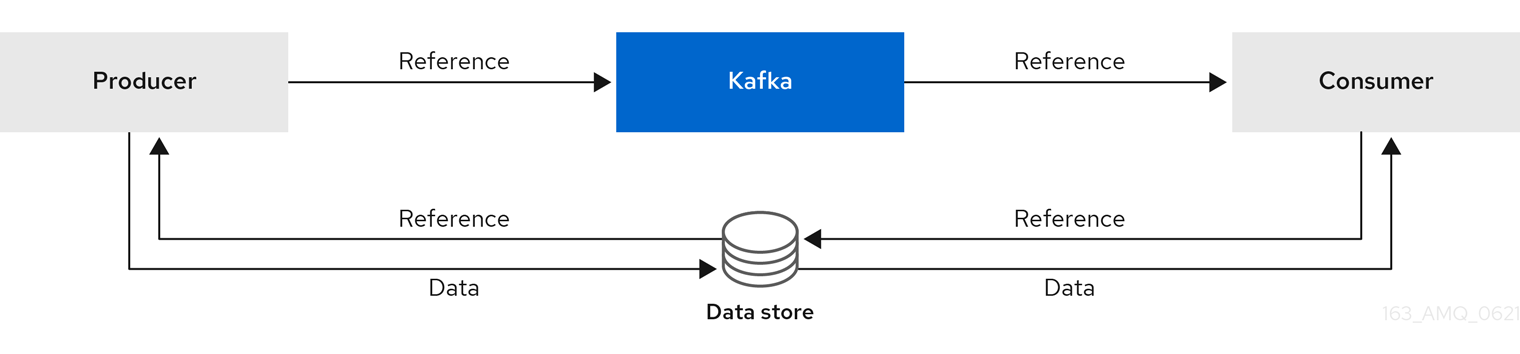

- 事件驱动的架构

- 事件源,以捕获对应用状态的更改作为事件日志

- 消息代理

- 网站活动跟踪

- 通过指标进行操作监控

- 日志收集和聚合

- 为分布式系统提交日志

- 流处理,以便应用程序能够实时响应数据

1.3. AMQ 流如何支持 Kafka

AMQ Streams 提供容器镜像和 Operator,以便在 OpenShift 上运行 Kafka。AMQ Streams Operator 是运行 AMQ Streams 的基础。AMQ Streams 提供的 Operator 是专门构建的,具有可有效管理 Kafka 的专业操作知识。

Operator 简化了以下流程:

- 部署和运行 Kafka 集群

- 部署和运行 Kafka 组件

- 配置对 Kafka 的访问

- 保护对 Kafka 的访问

- 升级 Kafka

- 管理代理

- 创建和管理主题

- 创建和管理用户

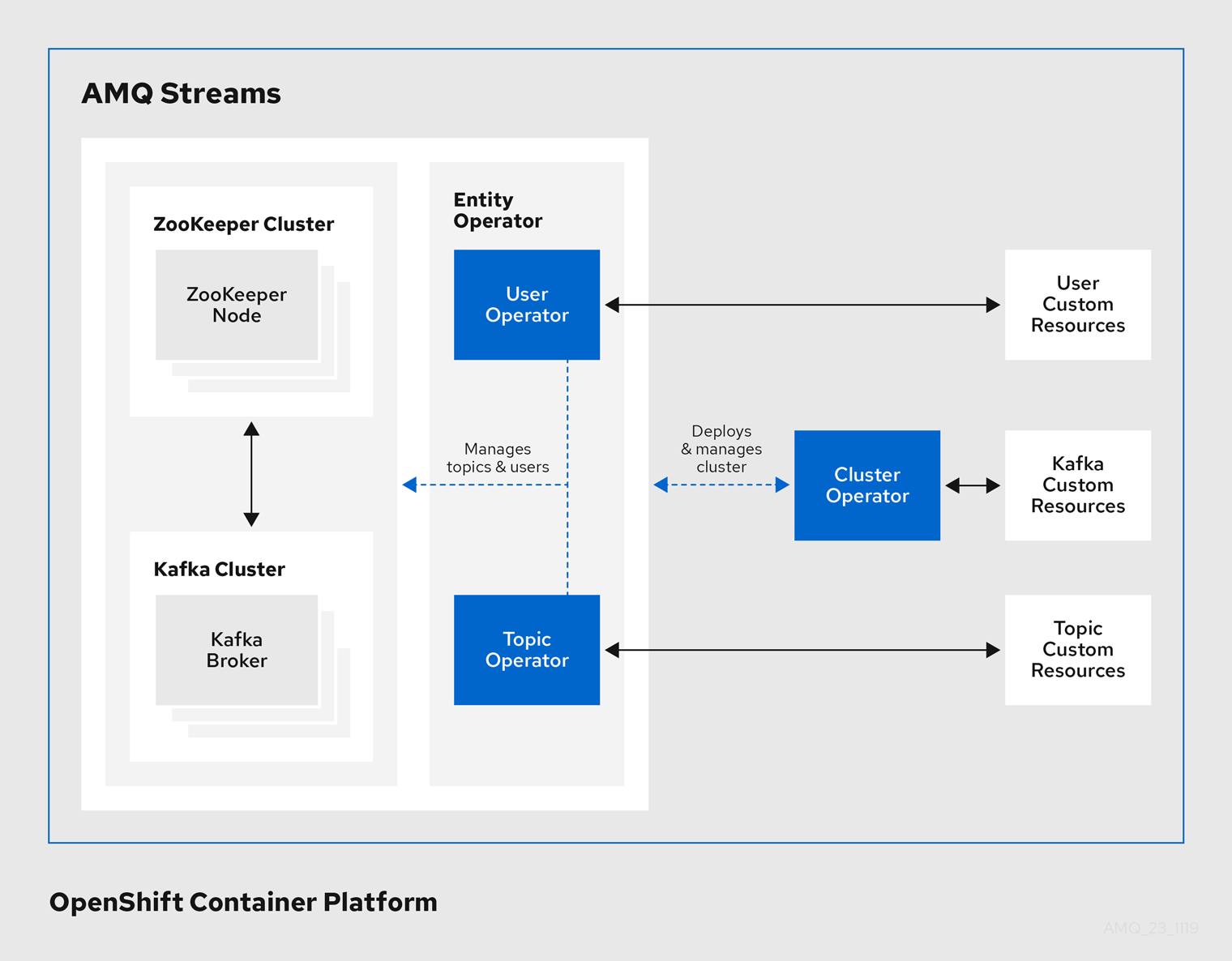

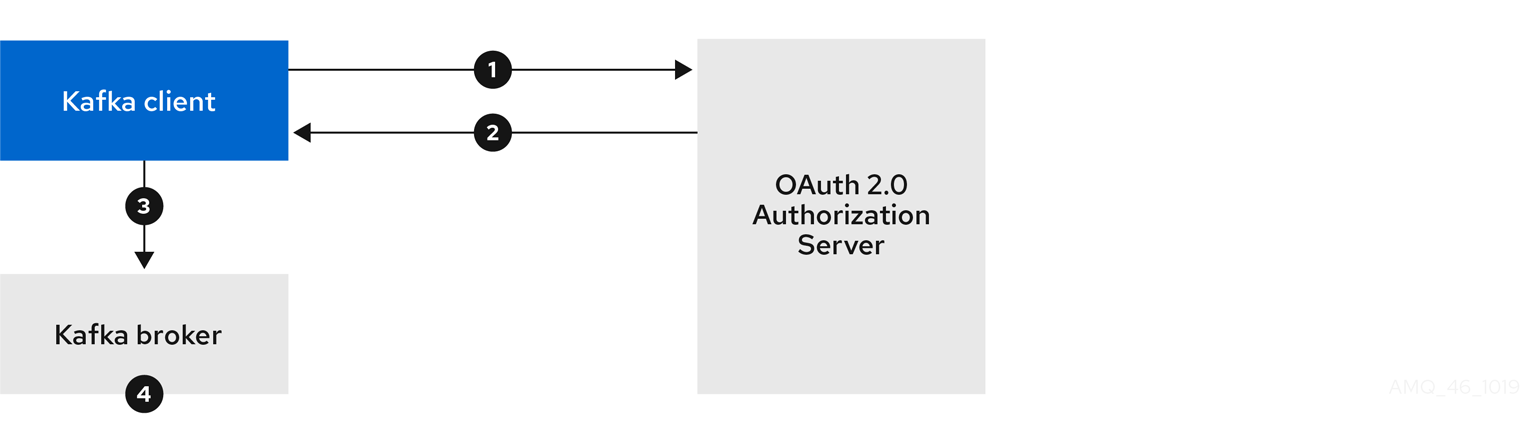

1.4. AMQ Streams Operator

AMQ Streams 支持使用 Operator 的 Kafka 来部署和管理 Kafka 到 OpenShift 的组件和依赖项。

Operator 是一种打包、部署和管理 OpenShift 应用的方法。AMQ Streams Operator 扩展 OpenShift 功能,自动执行与 Kafka 部署相关的常见复杂任务。通过在代码中了解 Kafka 操作,Kafka 管理任务可以简化,无需人工干预。

Operator

AMQ Streams 提供 Operator 来管理在 OpenShift 集群中运行的 Kafka 集群。

- Cluster Operator

- 部署和管理 Apache Kafka 集群、Kafka Connect、Kafka MirrorMaker、Kafka Bridge、Kafka Exporter 和 Entity Operator

- 实体 Operator

- 由主题 Operator 和 User Operator 组成

- 主题 Operator

- 管理 Kafka 主题

- User Operator

- 管理 Kafka 用户

Cluster Operator 可以与 Kafka 集群同时部署 Topic Operator 和 User Operator 作为 Entity Operator 配置的一部分。

AMQ Streams 架构中的 Operator

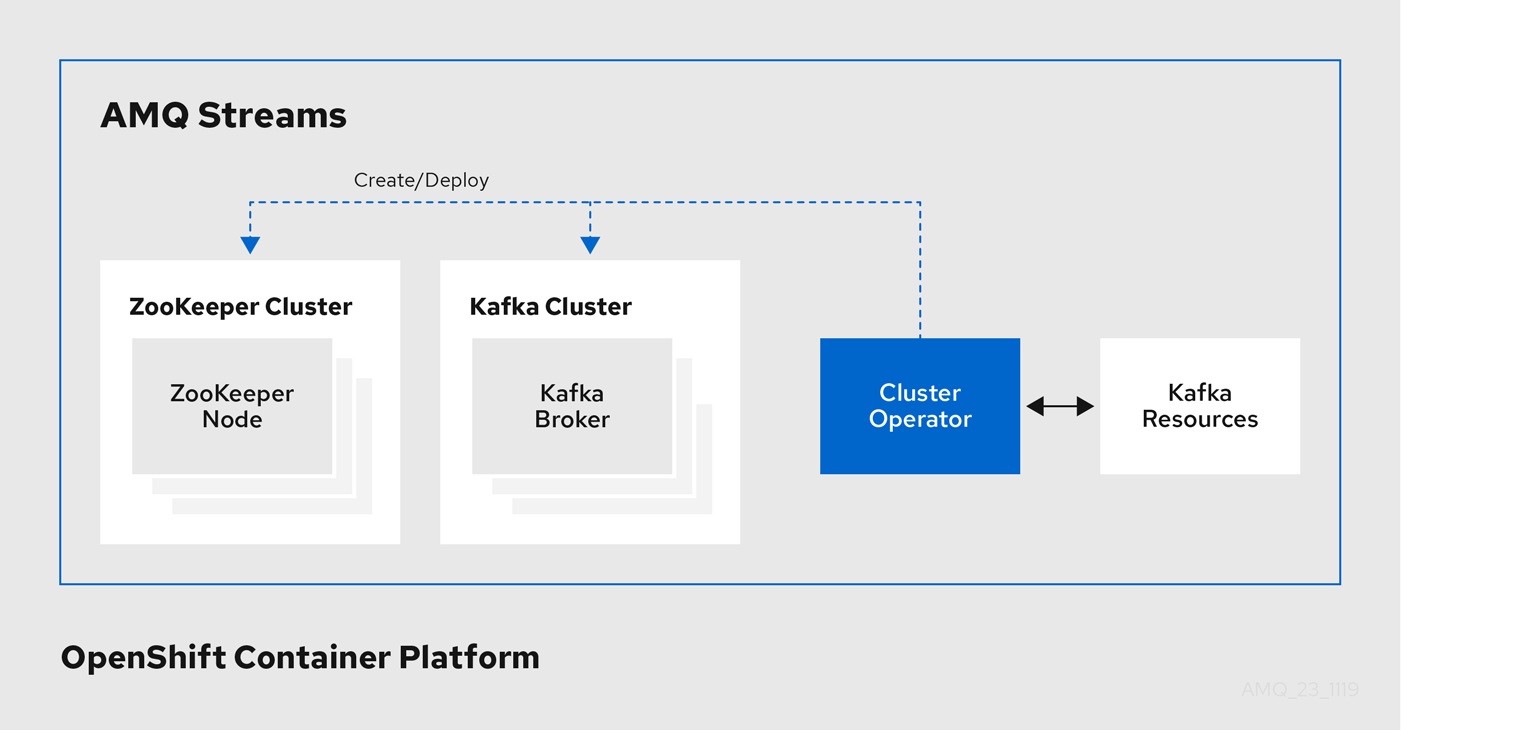

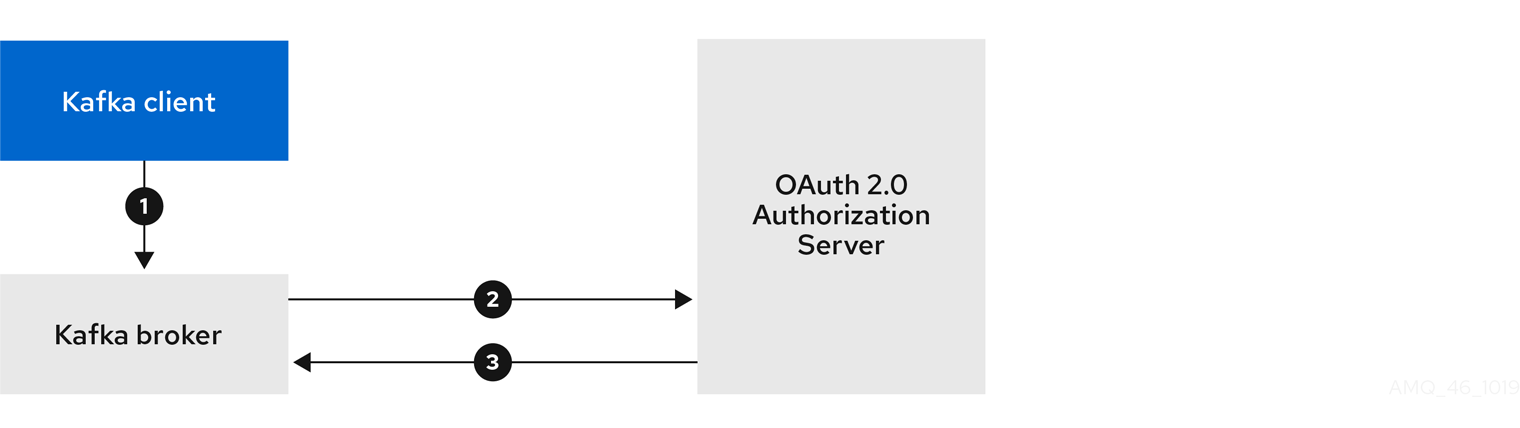

1.4.1. Cluster Operator

AMQ Streams 使用 Cluster Operator 来部署和管理集群:

- Kafka(包括 ZooKeeper、实体 Operator、Kafka Exporter 和 Cruise Control)

- Kafka Connect

- Kafka MirrorMaker

- Kafka Bridge

自定义资源用于部署集群。

例如,部署 Kafka 集群:

-

在

OpenShift 集群中创建了带有集群配置的 Kafka资源。 -

Cluster Operator 根据 Kafka 资源中声明的内容部署对应的

Kafka集群。

Cluster Operator 也可以部署(通过配置 Kafka 资源):

-

通过

KafkaTopic自定义资源提供 operator 风格主题管理的主题 Operator -

一个 User Operator,通过

KafkaUser自定义资源提供 operator 风格的用户管理

部署的 Entity Operator 中的 Topic Operator 和 User Operator 功能。

Cluster Operator 的架构示例

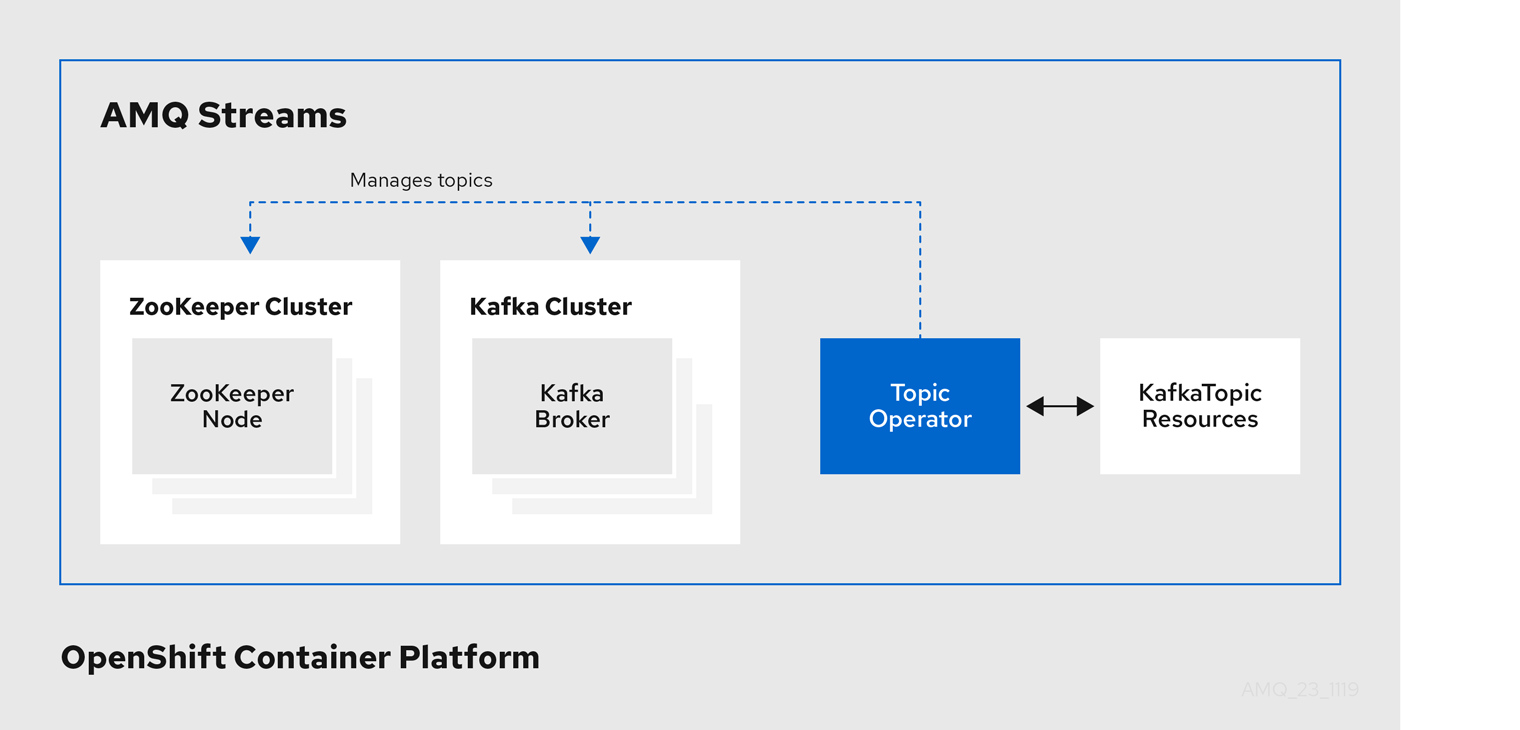

1.4.2. 主题 Operator

Topic Operator 提供了通过 OpenShift 资源管理 Kafka 集群中主题的方法。

Topic Operator 的架构示例

Topic Operator 的角色是保留一组 KafkaTopic OpenShift 资源,描述与对应的 Kafka 主题同步中的 Kafka 主题。

特别是,如果 KafkaTopic 是:

- 创建,主题 Operator 会创建该主题

- 删除的,主题 Operator 会删除该主题

- 更改,主题 Operator 更新该主题

在另一个方向上工作,如果一个主题是:

-

在 Kafka 集群中创建,Operator 会创建一个

KafkaTopic -

从 Kafka 集群中删除,Operator 会删除

KafkaTopic -

在 Kafka 集群中更改,Operator 会更新

KafkaTopic

这可让您声明 KafkaTopic 作为应用程序部署的一部分,Topic Operator 将为您创建该主题。您的应用程序只需要处理从所需主题中产生或使用的内容。

Topic Operator 在主题 存储中维护每个主题 的信息,它与来自 Kafka 主题或 OpenShift KafkaTopic 自定义资源的更新持续同步。应用到本地内存中主题存储的操作的更新会保留在磁盘上的备份主题存储中。如果某个主题被重新配置或重新分配给其他代理,KafkaTopic 将始终保持最新状态。

1.4.3. User Operator

User Operator 通过监视 Kafka 用户描述 Kafka 用户并确保在 Kafka 集群中正确配置了这些用户来管理 Kafka 集群的 Kafka 用户。

例如,如果 KafkaUser 是:

- 创建,User Operator 创建它描述的用户

- 删除时,User Operator 会删除它所描述的用户

- 更改后,User Operator 会更新它所描述的用户

与主题 Operator 不同,User Operator 不会将 Kafka 集群的任何更改与 OpenShift 资源同步。Kafka 主题可以直接由 Kafka 中的应用程序创建,但用户不必与 User Operator 并行直接在 Kafka 集群中管理。

User Operator 允许您将 KafkaUser 资源声明为应用程序部署的一部分。您可以为用户指定身份验证和授权机制。您还可以配置 用户配额 来控制对 Kafka 资源的使用,例如,确保用户不会专利对代理的访问。

创建用户时,会在 Secret 中创建用户凭据。您的应用需要使用用户 及其凭据进行身份验证,并生成或使用消息。

除了管理用于身份验证的凭证外,User Operator 还通过在 KafkaUser 声明中包含用户访问权限描述来管理授权规则。

1.4.4. AMQ Streams Operator 中的功能门

您可以使用功能 门来启用和禁用 Operator 的一些功能。

功能门在操作器配置中设置,具有三个成熟度阶段:alpha、beta 或 General Availability(GA)。

如需更多信息,请参阅 功能门。

1.5. AMQ Streams 自定义资源

使用 AMQ Streams 将 Kafka 组件部署到 OpenShift 集群可通过应用自定义资源进行高度配置。自定义资源作为自定义资源定义(CRD)添加的 API 实例创建,以扩展 OpenShift 资源。

CRD 用作描述 OpenShift 集群中自定义资源的配置说明,并为部署中使用的每个 Kafka 组件以及用户和主题提供 AMQ Streams。CRD 和自定义资源定义为 YAML 文件。AMQ Streams 发行版提供了示例 YAML 文件。

CRD 还允许 AMQ Streams 资源受益于原生 OpenShift 功能,如 CLI 访问和配置验证。

1.5.1. AMQ Streams 自定义资源示例

CRD 需要在集群中进行一次性安装,以定义用于实例化和管理 AMQ Streams 特定资源的 schema。

通过安装 CRD 在集群中添加新的自定义资源类型后,您可以根据具体规格创建资源实例。

根据集群设置,安装通常需要集群管理员特权。

管理自定义资源的访问权限仅限于 AMQ Streams 管理员。如需更多信息,请参阅 OpenShift 上部署和升级 AMQ 流指南中的指定 AMQ 流 管理员。

CRD 在 OpenShift 集群中定义 一种 新型资源,如 kind:Kafka。

Kubernetes API 服务器允许基于 kind 创建自定义资源,并且从 CRD 中了解如何在添加到 OpenShift 集群时验证和存储自定义资源。

当 CRD 被删除时,该类型的自定义资源也会被删除。另外,自定义资源创建的资源也会被删除,如 pod 和 statefulsets。

每个 AMQ Streams 特定自定义资源都符合 CRD 为资源类型定义的 schema 。AMQ Streams 组件的自定义资源具有常见的配置属性,这些属性在 spec 下定义。

要了解 CRD 和自定义资源之间的关系,让我们看一下 Kafka 主题的 CRD 示例。

Kafka 主题 CRD

apiVersion: kafka.strimzi.io/v1beta2 kind: CustomResourceDefinition metadata: 1 name: kafkatopics.kafka.strimzi.io labels: app: strimzi spec: 2 group: kafka.strimzi.io versions: v1beta2 scope: Namespaced names: # ... singular: kafkatopic plural: kafkatopics shortNames: - kt 3 additionalPrinterColumns: 4 # ... subresources: status: {} 5 validation: 6 openAPIV3Schema: properties: spec: type: object properties: partitions: type: integer minimum: 1 replicas: type: integer minimum: 1 maximum: 32767 # ...

- 1

- 主题 CRD 的元数据、名称和标识 CRD 的标签。

- 2

- 此 CRD 的规格,包括组(域)名称、复数名称和支持的 schema 版本,用于 URL 以访问该主题的 API。其他名称用于标识 CLI 中的实例资源。例如,oc

get kafkatopic my-topic或oc get kafkatopics。 - 3

- 可以在 CLI 命令中使用短名称。例如,

oc get kt可用作缩写而不是oc get kafkatopic。 - 4

- 在自定义资源上使用

get命令时显示的信息。 - 5

- CRD 的当前状态,如资源的 schema 引用 中所述。

- 6

- OpenAPIV3Schema 验证提供了用于创建主题自定义资源的验证。例如,一个主题至少需要一个分区和一个副本。

您可以识别 AMQ Streams 安装文件提供的 CRD YAML 文件,因为文件名包含索引号后跟 'Crd'。

以下是 KafkaTopic 自定义资源的对应示例。

Kafka 主题自定义资源

apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaTopic 1 metadata: name: my-topic labels: strimzi.io/cluster: my-cluster 2 spec: 3 partitions: 1 replicas: 1 config: retention.ms: 7200000 segment.bytes: 1073741824 status: conditions: 4 lastTransitionTime: "2019-08-20T11:37:00.706Z" status: "True" type: Ready observedGeneration: 1 / ...

自定义资源可以通过平台 CLI 应用到集群。创建自定义资源时,它将使用与 Kubernetes API 内置资源相同的验证。

创建 KafkaTopic 自定义资源后,Tpic Operator 将获得通知,并在 AMQ Streams 中创建对应的 Kafka 主题。

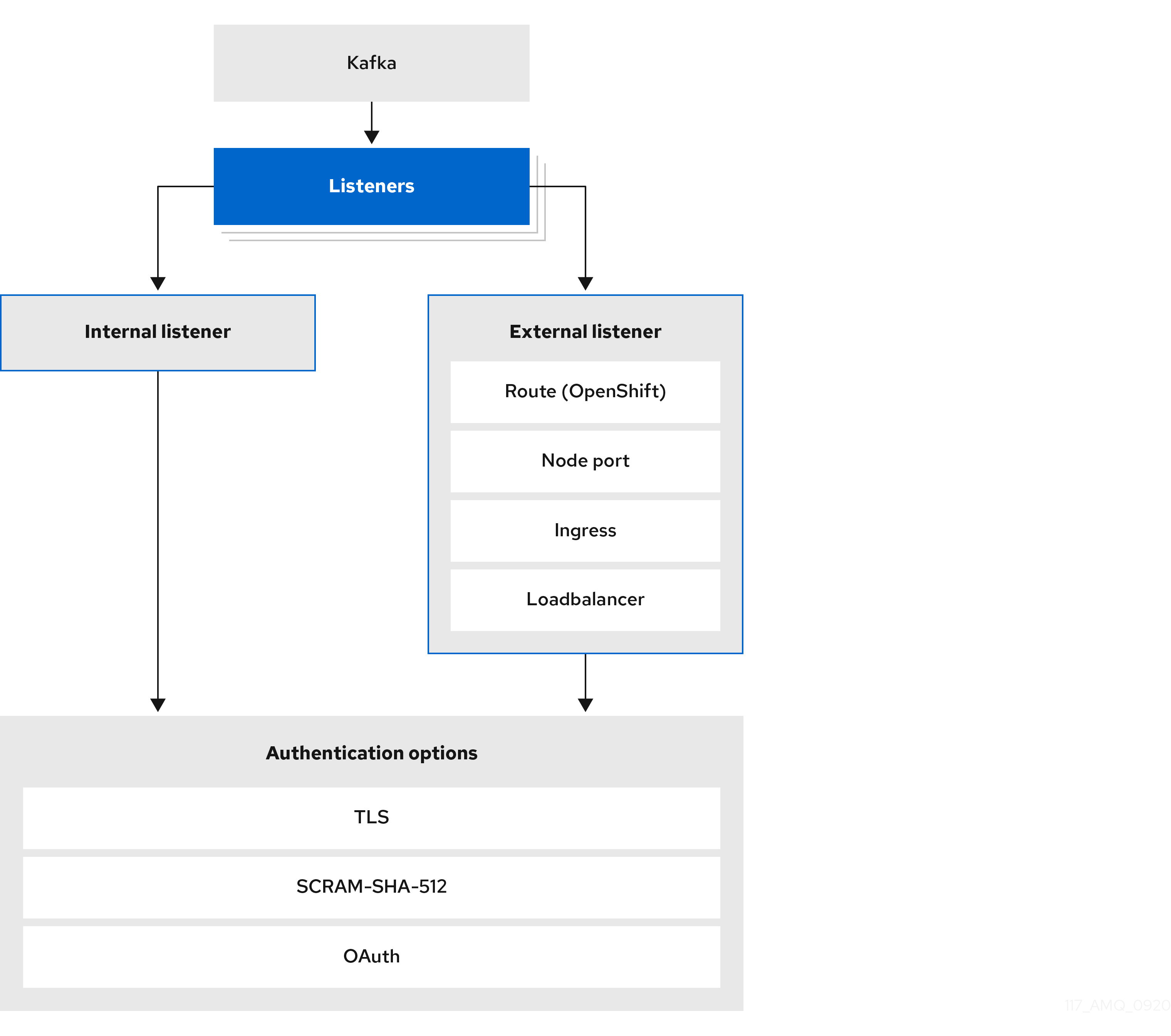

1.6. 监听程序配置

侦听器用于连接到 Kafka 代理。

AMQ Streams 提供了一个 generic GenericKafkaListener 模式,其中包含用于通过 Kafka 资源配置监听器的属性。

The GenericKafkaListener 提供了用于监听器配置的灵活方法。您可以指定属性来配置 内部 侦听器,以便在 OpenShift 集群内连接,或者指定 外部 侦听器以连接 OpenShift 集群外部。

每个监听程序都 定义为 Kafka 资源中的一个数组。您可以根据需要配置任意数量的侦听器,只要它们的名称和端口是唯一的。

您可能希望配置多个外部监听器,例如,以处理来自需要不同身份验证机制的网络的访问。或者,您可能需要将 OpenShift 网络加入外部网络。在这种情况下,您可以配置内部侦听器( 使用ServiceDnsDomain 属性),以便不使用 OpenShift 服务 DNS 域(通常为 .cluster.local)。

有关监听器可用的配置选项的更多信息,请参阅 GenericKafkaListener 模式参考。

配置监听程序来保护对 Kafka 代理的访问

您可以使用身份验证为安全连接配置监听程序。有关保护对 Kafka 代理的访问的更多信息,请参阅管理对 Kafka 的访问。

为 OpenShift 外部的客户端访问配置外部侦听器

您可以使用指定的连接机制(如 loadbalancer),为 OpenShift 环境外的客户端访问配置外部侦听器。有关连接外部客户端的配置选项的更多信息,请参阅配置外部监听程序。

监听程序证书

您可以为启用了 TLS 加密的 TLS 监听程序或者外部监听程序提供自己的服务器证书,称为 Kafka 侦听程序证书。如需更多信息,请参阅 Kafka 侦听程序证书。

1.7. 文档规范

Replaceables

在本文档中,可替换的文本采用 单空间 格式,使用斜体、大写和连字符。

例如,在以下代码中,您要将 MY-NAMESPACE 替换为命名空间的名称:

sed -i 's/namespace: .*/namespace: MY-NAMESPACE/' install/cluster-operator/*RoleBinding*.yaml第 2 章 部署配置

本章论述了如何使用自定义资源配置受支持的部署的不同方面:

- Kafka 集群

- Kafka Connect 集群

- 支持 Source2Image 的 Kafka Connect 集群

- Kafka MirrorMaker

- Kafka Bridge

- Sything Control

应用到自定义资源的标签也会应用到由 Kafka MirrorMaker 组成的 OpenShift 资源。这提供了一种便捷的机制,可使资源根据需要进行标记。

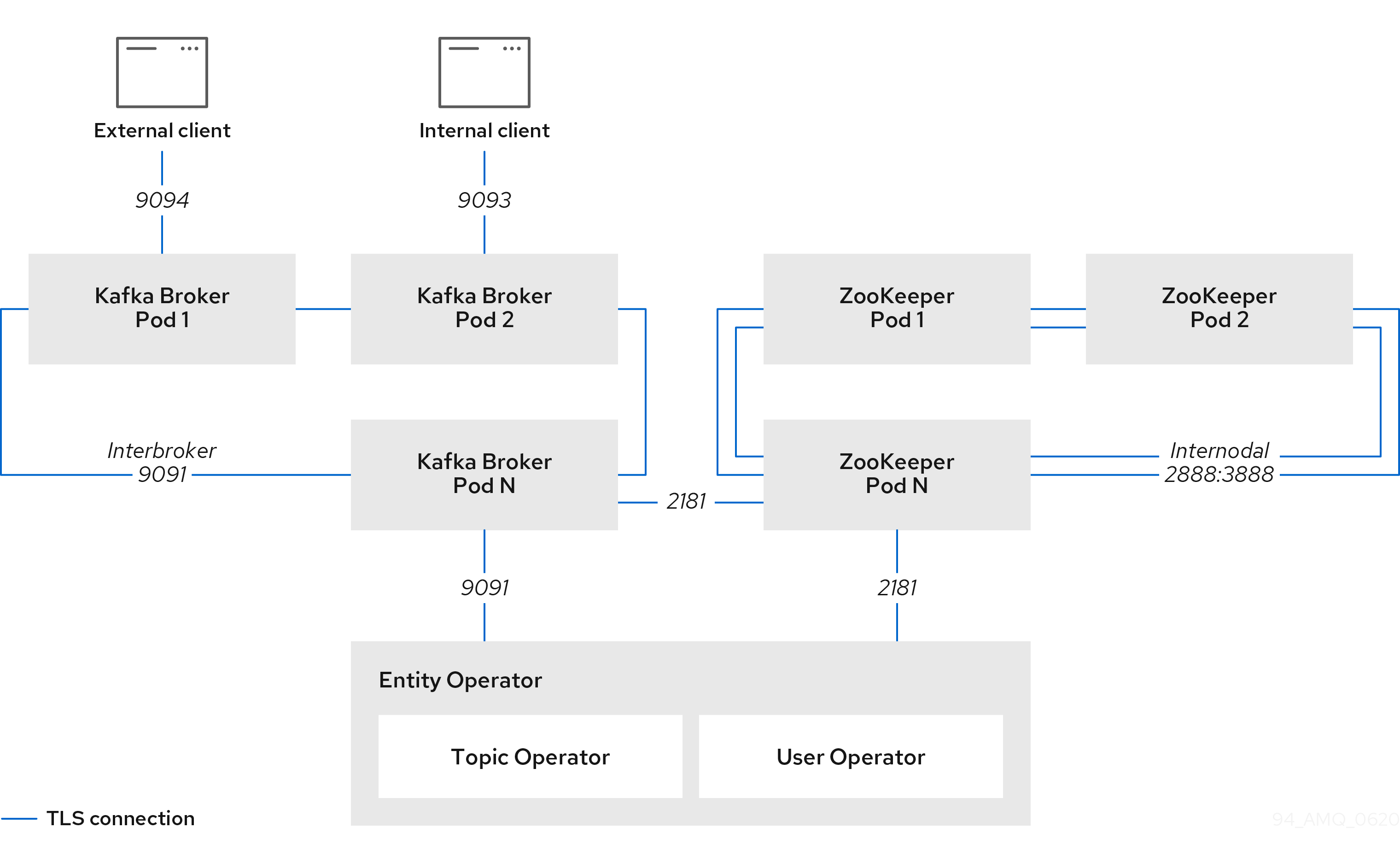

2.1. Kafka 集群配置

本节论述了如何在 AMQ Streams 集群中配置 Kafka 部署。Kafka 集群使用 ZooKeeper 集群部署。部署也可以包括管理 Kafka 主题和用户的 Topic Operator 和 User Operator。

您可以使用 Kafka 资源配置 Kafka。配置选项也可用于 Kafka 资源中的 ZooKeeper 和 Entity Operator。Entity Operator 由 Topic Operator 和 User Operator 组成。

Kafka 资源的完整 schema 信息包括在 第 13.2.1 节 “Kafka 模式参考” 中。

监听程序配置

您可以配置监听程序以将客户端连接到 Kafka 代理。有关为连接代理配置监听程序的更多信息,请参阅 Listener 配置。

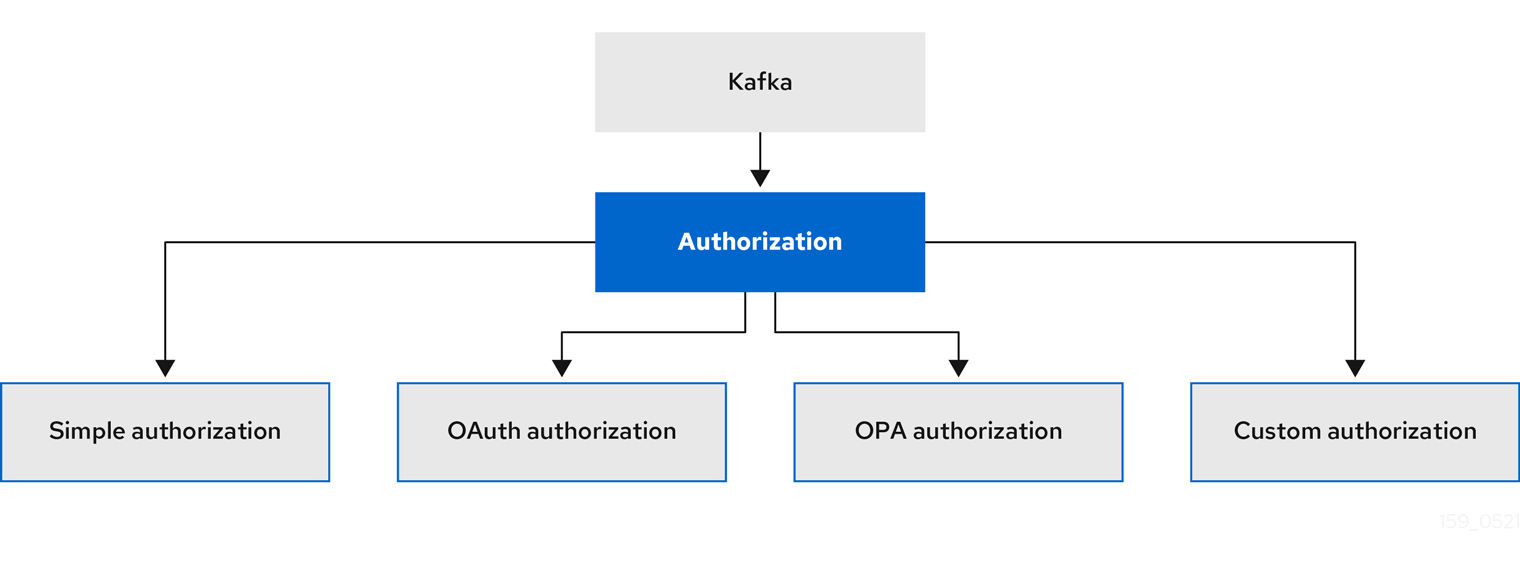

授权对 Kafka 的访问

您可以将 Kafka 集群配置为允许或拒绝用户执行的操作。有关保护对 Kafka 代理的访问的更多信息,请参阅管理对 Kafka 的访问。

管理 TLS 证书

在部署 Kafka 时,Cluster Operator 会自动设置并更新 TLS 证书,以在集群中启用加密和身份验证。如果需要,您可以在续订周期结束前手动续订集群和客户端 CA 证书。您还可以替换集群和客户端 CA 证书使用的密钥。如需更多信息,请参阅 手动重新更新 CA 证书和 替换私钥。

其它资源

- 有关 Apache Kafka 的详情,请查看 Apache Kafka 网站。

2.1.1. 配置 Kafka

使用 Kafka 资源的属性来配置 Kafka 部署。

除了配置 Kafka 外,您还可以为 ZooKeeper 和 AMQ Streams Operator 添加配置。常见的配置属性(如日志记录和健康检查)是为每个组件独立配置的。

此流程仅显示一些可能的配置选项,但尤为重要选项包括:

- 资源请求(CPU / Memory)

- 用于最大和最小内存分配的 JVM 选项

- 侦听器(和客户端身份验证)

- Authentication

- 存储

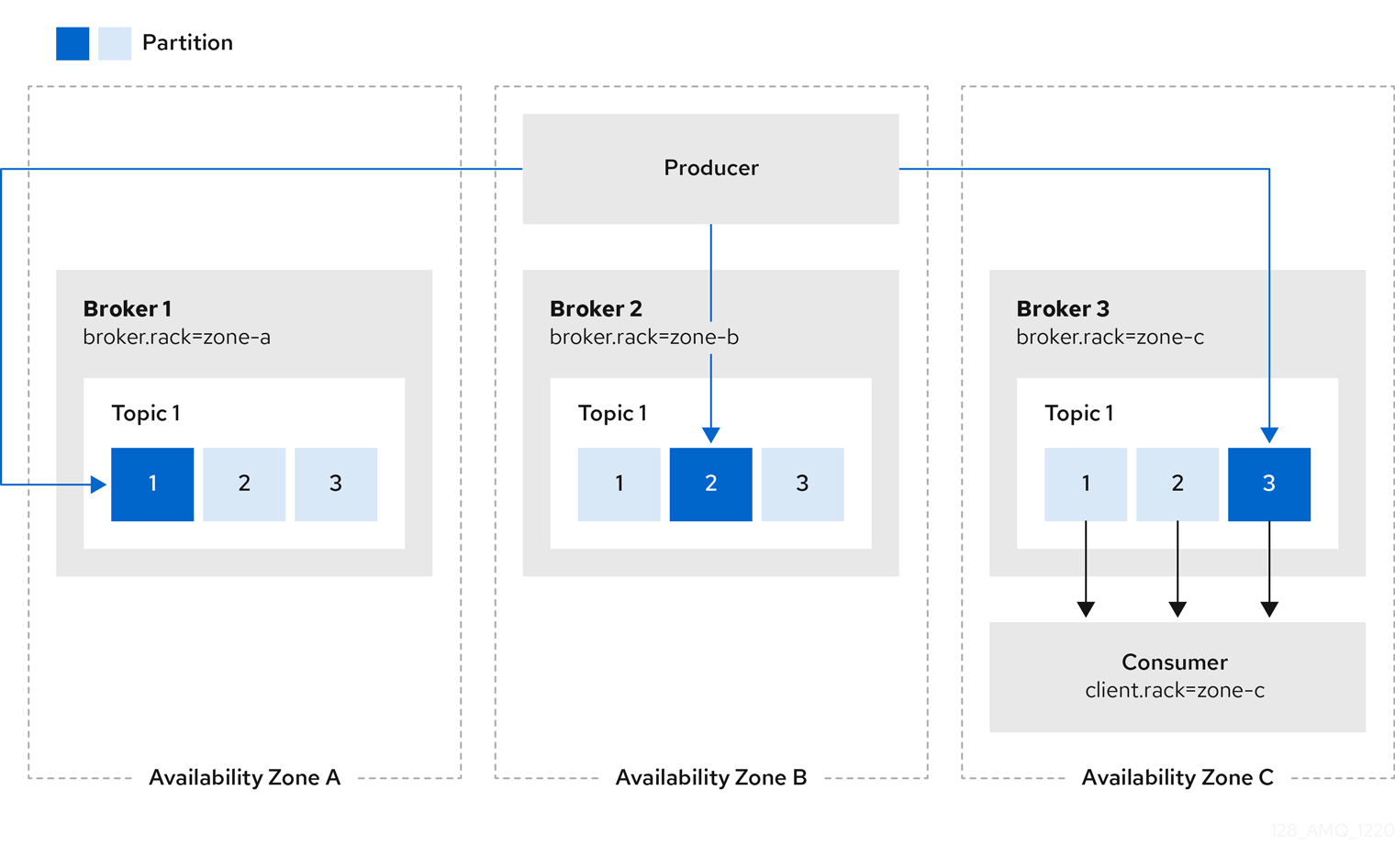

- 机架感知

- 指标

- 用于集群重新平衡的精简控制

Kafka 版本

Kafka 配置 的 log.message.format 属性必须是指定 Kafka 版本(.version 和 inter.broker.protocol.versionspec.kafka.version)支持的版本。属性表示附加到消息的日志格式版本,以及 Kafka 集群中使用的 Kafka 协议版本。在升级 Kafka 版本时,需要更新这些属性。如需更多信息,请参阅 OpenShift 上部署 和升级 AMQ Streams 中的升级 Kafka。

先决条件

- OpenShift 集群

- 一个正在运行的 Cluster Operator

有关 部署方法的说明,请参阅 OpenShift 指南中的部署和升级 AMQ Streams :

流程

编辑

Kafka资源的spec属性。您可以配置的属性显示在此示例配置中:

apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: replicas: 3 1 version: 2.8.0 2 logging: 3 type: inline loggers: kafka.root.logger.level: "INFO" resources: 4 requests: memory: 64Gi cpu: "8" limits: memory: 64Gi cpu: "12" readinessProbe: 5 initialDelaySeconds: 15 timeoutSeconds: 5 livenessProbe: initialDelaySeconds: 15 timeoutSeconds: 5 jvmOptions: 6 -Xms: 8192m -Xmx: 8192m image: my-org/my-image:latest 7 listeners: 8 - name: plain 9 port: 9092 10 type: internal 11 tls: false 12 configuration: useServiceDnsDomain: true 13 - name: tls port: 9093 type: internal tls: true authentication: 14 type: tls - name: external 15 port: 9094 type: route tls: true configuration: brokerCertChainAndKey: 16 secretName: my-secret certificate: my-certificate.crt key: my-key.key authorization: 17 type: simple config: 18 auto.create.topics.enable: "false" offsets.topic.replication.factor: 3 transaction.state.log.replication.factor: 3 transaction.state.log.min.isr: 2 log.message.format.version: 2.8 inter.broker.protocol.version: 2.8 ssl.cipher.suites: "TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384" 19 ssl.enabled.protocols: "TLSv1.2" ssl.protocol: "TLSv1.2" storage: 20 type: persistent-claim 21 size: 10000Gi 22 rack: 23 topologyKey: topology.kubernetes.io/zone metricsConfig: 24 type: jmxPrometheusExporter valueFrom: configMapKeyRef: 25 name: my-config-map key: my-key # ... zookeeper: 26 replicas: 3 27 logging: 28 type: inline loggers: zookeeper.root.logger: "INFO" resources: requests: memory: 8Gi cpu: "2" limits: memory: 8Gi cpu: "2" jvmOptions: -Xms: 4096m -Xmx: 4096m storage: type: persistent-claim size: 1000Gi metricsConfig: # ... entityOperator: 29 tlsSidecar: 30 resources: requests: cpu: 200m memory: 64Mi limits: cpu: 500m memory: 128Mi topicOperator: watchedNamespace: my-topic-namespace reconciliationIntervalSeconds: 60 logging: 31 type: inline loggers: rootLogger.level: "INFO" resources: requests: memory: 512Mi cpu: "1" limits: memory: 512Mi cpu: "1" userOperator: watchedNamespace: my-topic-namespace reconciliationIntervalSeconds: 60 logging: 32 type: inline loggers: rootLogger.level: INFO resources: requests: memory: 512Mi cpu: "1" limits: memory: 512Mi cpu: "1" kafkaExporter: 33 # ... cruiseControl: 34 # ... tlsSidecar: 35 # ...- 1

- 2

- Kafka 版本,可按照 升级过程将其改为受支持的 版本。

- 3

- 指定 Kafka 日志记录器和日志级别 直接(

内联)或通过ConfigMap 间接(外部)添加。自定义 ConfigMap 必须放在log4j.properties键下。对于 Kafkakafka.root.logger.levellogger,您可以将日志级别设置为 INFO、ERROR、WARN、TRACE、DEBUG、FATAL 或 OFF。 - 4

- 5

- 健康检查以了解 何时重新启动容器(存活度)以及容器何时可以接受流量(就绪度)。

- 6

- 用于优化运行 Kafka 的虚拟机(VM)性能的 JVM 配置选项。

- 7

- ADVANCED OPTION: 容器镜像配置,只在特殊情况下推荐这样做。

- 8

- 侦听器配置客户端如何通过 bootstrap 地址连接到 Kafka 集群。侦听器 配置为 内部或外部 侦听器,以便从 OpenShift 集群内部或外部进行连接。

- 9

- 用于标识侦听器的名称。在 Kafka 集群中必须是唯一的。

- 10

- Kafka 内侦听器使用的端口号。在给定 Kafka 集群中,端口号必须是唯一的。允许的端口号是 9092 及以上,但端口 9404 和 9999 除外,它们已用于 Prometheus 和 JMX。根据监听程序类型,端口号可能与连接 Kafka 客户端的端口号不同。

- 11

- 侦听器类型指定为

内部,或用于外部监听器,作为路由、负载均衡器、节点端口或入口。 - 12

- 为每个侦听器启用 TLS 加密。默认为

false。路由监听程序不需要 TLS 加密。 - 13

- 定义是否分配了包括集群服务后缀(通常.

cluster.local)在内的完全限定 DNS 名称。 - 14

- 15

- 16

- 由外部 证书颁发机构管理的 Kafka 侦听器 证书的可选配置。

brokerCertChainAndKey指定包含服务器证书和私钥的Secret。您可以在任何启用 TLS 加密的监听程序上配置 Kafka 侦听程序证书。 - 17

- 授权在 Kafka 代理上启用简单、OAUTH 2.0 或 OPA 授权。简单授权使用

AclAuthorizerKafka 插件。 - 18

config指定代理配置。标准 Apache Kafka 配置可能会提供,仅限于不是由 AMQ Streams 直接管理的属性。- 19

- 20

- 21

- 22

- 23

- 将机架感知 配置为在不同机架之间分布副本。

topologykey必须与集群节点标签匹配。 - 24

- 启用了 Prometheus 指标。在本例中,为 Prometheus JMX Exporter(默认指标导出器)配置了指标数据。

- 25

- 通过 Prometheus JMX Exporter 将指标导出到 Grafana 仪表板的 Prometheus 规则,这可以通过引用包含 Prometheus JMX 导出器配置的 ConfigMap 来启用。您可以使用对包含

metricsConfig.valueFrom.configMapKeyRef.key下的空文件的 ConfigMap 的引用来启用指标,而无需进一步配置。 - 26

- zookeeper 特定的配置,其中包含与 Kafka 配置类似的属性。

- 27

- ZooKeeper 节点的数量。zookeeper 集群或ensemble 通常使用奇数的节点(通常为三个、五个或 7 个)运行。大多数节点必须可用,才能保持有效的仲裁。如果 ZooKeeper 集群丢失其仲裁,它将停止响应客户端,Kafka 代理将停止工作。拥有稳定且高度可用的 ZooKeeper 集群对于 AMQ 流至关重要。

- 28

- 29

- 实体 Operator 配置,用于指定 Topic Operator 和 User Operator 的配置。

- 30

- 实体操作器 TLS sidecar 配置.实体 Operator 使用 TLS sidecar 与 ZooKeeper 进行安全通信。

- 31

- 指定 Topic Operator 日志记录器和日志级别。这个示例使用

内联日志记录。 - 32

- 33

- Kafka Exporter 配置.Kafka Exporter 是一个可选组件,用于从 Kafka 代理提取指标数据,特别是消费者滞后数据。

- 34

- Cruise Control 的可选配置,用于 重新平衡 Kafka 集群。

- 35

- 插入控制 TLS sidecar 配置.cruise Control 使用 TLS sidecar 与 ZooKeeper 进行安全通信。

创建或更新资源:

oc apply -f KAFKA-CONFIG-FILE

2.1.2. 配置实体 Operator

Entity Operator 负责管理正在运行的 Kafka 集群中与 Kafka 相关的实体。

Entity Operator 包括:

- 用于管理 Kafka 主题的主题 Operator

- 管理 Kafka 用户的用户 Operator

通过 Kafka 资源配置,Cluster Operator 可在部署 Kafka 集群时部署 Entity Operator,包括一个或多个操作器。

部署后,实体 Operator 根据部署配置包含操作器。

Operator 会自动配置为管理 Kafka 集群的主题和用户。

2.1.2.1. 实体 Operator 配置属性

使用 Kafka.spec 中的 principal Operator 属性来配置 Entity Operator。

entity Operator 属性支持以下几个子属性:

-

tlsSidecar -

topicOperator -

userOperator -

模板

tlsSidecar 属性包含 TLS sidecar 容器的配置,用于与 ZooKeeper 通信。

template 属性包含 Entity Operator pod 的配置,如标签、注解、关联性和容限。有关配置模板的详情请参考 第 2.6 节 “自定义 OpenShift 资源”。

topicOperator 属性包含 Topic Operator 的配置。当缺少这个选项时,Entity Operator 会在没有 Topic Operator 的情况下部署。

userOperator 属性包含 User Operator 的配置。当缺少这个选项时,Entity Operator 会在没有 User Operator 的情况下部署。

有关配置 Entity Operator 的属性的更多信息,请参阅 EntityUserOperatorSpec schema 参考。

启用两个运算符的基本配置示例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

zookeeper:

# ...

entityOperator:

topicOperator: {}

userOperator: {}

如果将空对象({})用于 topicOperator 和 ,则所有属性都使用其默认值。

userOperator

当缺少 topicOperator 和 userOperator 属性时,Entity Operator 不会被部署。

2.1.2.2. 主题 Operator 配置属性

可以使用 topicOperator 对象中的附加选项来配置主题 Operator 部署。支持以下属性:

watchedNamespace-

主题操作器监视

KafkaTopics的 OpenShift 命名空间。默认为部署 Kafka 集群的命名空间。 reconciliationIntervalSeconds-

定期协调之间的间隔(以秒为单位)。

默认值120. zookeeperSessionTimeoutSeconds-

ZooKeeper 会话超时,以秒为单位。默认值为

18。 topicMetadataMaxAttempts-

从 Kafka 获取主题元数据的尝试数量。每次尝试之间的时间都定义为指数回退。考虑在因为分区或副本数量而创建主题时增加这个值。

默认6. image-

image属性可用于配置要使用的容器镜像。有关配置自定义容器镜像的详情,请参考 第 13.1.6 节 “image”。 资源-

resources属性配置分配给 Topic Operator 的资源数量。有关资源请求和限制配置的详情,请参阅 第 13.1.5 节 “资源”。 logging-

logging属性配置 Topic Operator 的日志。如需了解更多详细信息,请参阅 第 13.2.45.1 节 “logging”。

Topic Operator 配置示例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

zookeeper:

# ...

entityOperator:

# ...

topicOperator:

watchedNamespace: my-topic-namespace

reconciliationIntervalSeconds: 60

# ...

2.1.2.3. 用户 Operator 配置属性

用户 Operator 部署可以使用 userOperator 对象中的附加选项进行配置。支持以下属性:

watchedNamespace-

用户操作员在其中监视

KafkaUsers的 OpenShift 命名空间。默认为部署 Kafka 集群的命名空间。 reconciliationIntervalSeconds-

定期协调之间的间隔(以秒为单位)。

默认值120. zookeeperSessionTimeoutSeconds-

ZooKeeper 会话超时,以秒为单位。默认值为

18。 image-

image属性可用于配置要使用的容器镜像。有关配置自定义容器镜像的详情,请参考 第 13.1.6 节 “image”。 资源-

resources属性配置分配给 User Operator 的资源数量。有关资源请求和限制配置的详情,请参阅 第 13.1.5 节 “资源”。 logging-

logging属性配置 User Operator 的日志记录。如需了解更多详细信息,请参阅 第 13.2.45.1 节 “logging”。 secretPrefix-

secretPrefix属性在从 KafkaUser 资源创建的所有 Secret 的名称中添加前缀。例如,STRIMZI_SECRET_PREFIX=kafka-将为所有 Secret 名称添加前缀kafka-。因此,名为my-user的 KafkaUser 将创建名为kafka-my-user的 Secret。

User Operator 配置示例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

zookeeper:

# ...

entityOperator:

# ...

userOperator:

watchedNamespace: my-user-namespace

reconciliationIntervalSeconds: 60

# ...

2.1.3. Kafka 和 ZooKeeper 存储类型

作为有状态应用程序,Kafka 和 ZooKeeper 需要将数据存储在磁盘上。AMQ Streams 支持用于此数据的三种存储类型:

- ephemeral

- persistent

- JBOD 存储

JBOD 存储只支持 Kafka,不适用于 ZooKeeper。

在配置 Kafka 资源时,您可以指定 Kafka 代理使用的存储类型及其对应的 ZooKeeper 节点。您可以使用以下资源中的 storage 属性配置存储类型:

-

Kafka.spec.kafka -

Kafka.spec.zookeeper

存储类型在 type 字段中配置。

部署 Kafka 集群后,无法更改存储类型。

其它资源

- 如需有关临时存储的更多信息,请参阅 临时存储模式参考。

- 有关持久性存储的更多信息,请参阅 持久性存储架构参考。

- 有关 JBOD 存储的更多信息,请参阅 JBOD 模式参考。

-

有关

Kafka模式的更多信息,请参阅Kafka模式参考。

2.1.3.1. 数据存储注意事项

高效的数据存储基础架构对于 AMQ 流的最佳性能至关重要。

块存储是必需的。文件存储(如 NFS)无法使用 Kafka。

从以下选项中为块存储选择:

- 基于云的块存储解决方案,如 Amazon Elastic Block Store(EBS)

- 本地持久性卷

- 通过 光纤通道 或 iSCSI等协议访问的存储区域网络(SAN)卷

AMQ Streams 不需要 OpenShift 原始块卷。

2.1.3.1.1. 文件系统

建议您将存储系统配置为使用 XFS 文件系统。AMQ Streams 还与 ext4 文件系统兼容,但为了获得最佳结果,可能需要额外的配置。

2.1.3.1.2. Apache Kafka 和 ZooKeeper 存储

Apache Kafka 和 ZooKeeper 使用单独的磁盘。

支持三种类型的数据存储:

- 临时(仅适用于开发的建议)

- persistent

- JBOD(只是一个磁盘绑定,仅适用于 Kafka)

如需更多信息,请参阅 Kafka 和 ZooKeeper 存储。

在异步发送和从多个主题接收数据的大型集群中,固态驱动器(SSD)(虽然不必要)可以提高 Kafka 的性能。SSD 在 ZooKeeper 中特别有效,它需要快速、低延迟的数据访问。

您不需要置备复制存储,因为 Kafka 和 ZooKeeper 都内置了数据复制。

2.1.3.2. 临时存储

临时存储使用 emptyDir 卷来存储数据。要使用临时存储,请将 type 字段设置为 ephemeral。

emptyDir 卷不是持久性的,存储在其中的数据会在 pod 重启时丢失。新 pod 启动后,它必须从集群的其他节点恢复所有数据。临时存储不适用于单节点 ZooKeeper 集群,或者适用于复制因数为 1 的 Kafka 主题。此配置将导致数据丢失。

临时存储示例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

storage:

type: ephemeral

# ...

zookeeper:

# ...

storage:

type: ephemeral

# ...

2.1.3.2.1. 日志目录

Kafka 代理使用临时卷作为挂载到以下路径的日志目录:

/var/lib/kafka/data/kafka-logIDX

其中 IDX 是 Kafka 代理 pod 索引。例如 /var/lib/kafka/data/kafka-log0。

2.1.3.3. 持久性存储

永久存储使用持久卷声明 来调配用于存储数据的持久卷。持久卷声明可用于调配许多不同类型的卷,具体取决于要调配卷的 存储类。可以与持久卷声明一起使用的数据类型包括许多类型的 SAN 存储 和本地持久卷。

若要使用持久存储,必须将 type 设置为 persistent-claim。持久性存储支持额外的配置选项:

id(可选)-

存储标识号.对于 JBOD 存储声明中定义的存储卷,此选项是必需的。默认值为

0。 大小(必需)- 定义持久卷声明的大小,如 "1000Gi"。

class(可选)- 用于动态卷置备的 OpenShift 存储类。

selector(可选)- 允许选择要使用的特定持久性卷。它包含键:值对,代表用于选择此类卷的标签。

deleteClaim(optional)-

指定在取消部署集群时是否需要删除持久卷声明的布尔值。默认为

false。

仅支持重新定义持久性卷大小的 OpenShift 版本支持在现有 AMQ Streams 集群中增加持久性卷的大小。要调整持久性卷的大小必须使用支持卷扩展的存储类。对于不支持卷扩展的其他 OpenShift 版本和存储类,您必须在部署集群前决定必要的存储大小。无法减少现有持久性卷的大小。

使用 1000Gi 大小的持久性存储配置片段示例

# ... storage: type: persistent-claim size: 1000Gi # ...

以下示例演示了存储类的使用。

使用特定存储类的持久性存储配置片段示例

# ... storage: type: persistent-claim size: 1Gi class: my-storage-class # ...

最后,可以利用 选择器 来选择特定的标记持久卷,以提供 SSD 等必要功能。

使用选择器的持久性存储配置片段示例

# ...

storage:

type: persistent-claim

size: 1Gi

selector:

hdd-type: ssd

deleteClaim: true

# ...

2.1.3.3.1. 存储类覆盖

您可以为一个或多个 Kafka 代理或 ZooKeeper 节点指定不同的存储类,而不是使用默认存储类。例如,当存储类仅限于不同的可用区或数据中心时,这很有用。您可以使用 overrides 字段来实现这一目的。

在本例中,默认存储类名为 my-storage-class :

使用存储类覆盖的 AMQ Streams 集群示例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

labels:

app: my-cluster

name: my-cluster

namespace: myproject

spec:

# ...

kafka:

replicas: 3

storage:

deleteClaim: true

size: 100Gi

type: persistent-claim

class: my-storage-class

overrides:

- broker: 0

class: my-storage-class-zone-1a

- broker: 1

class: my-storage-class-zone-1b

- broker: 2

class: my-storage-class-zone-1c

# ...

zookeeper:

replicas: 3

storage:

deleteClaim: true

size: 100Gi

type: persistent-claim

class: my-storage-class

overrides:

- broker: 0

class: my-storage-class-zone-1a

- broker: 1

class: my-storage-class-zone-1b

- broker: 2

class: my-storage-class-zone-1c

# ...

配置的 overrides 属性后,卷使用以下存储类:

-

ZooKeeper 节点 0 的持久卷将使用

my-storage-class-zone-1a。 -

ZooKeeper 节点 1 的持久卷将使用

my-storage-class-zone-1b。 -

ZooKeeepr 节点 2 的持久卷将使用

my-storage-class-zone-1c。 -

Kafka 代理 0 的持久性卷将使用

my-storage-class-zone-1a。 -

Kafka 代理 1 的持久性卷将使用

my-storage-class-zone-1b。 -

Kafka 代理 2 的持久性卷将使用

my-storage-class-zone-1c。

overrides 属性目前只用于覆盖存储类配置。目前不支持覆盖其他存储配置字段。目前不支持存储配置中的其他字段。

2.1.3.3.2. 持久性卷声明命名

使用持久性存储时,它会使用以下名称创建持久性卷声明:

data-cluster-name-kafka-idx-

用于存储 Kafka 代理 pod

IDx数据的卷的持久性卷声明。 data-cluster-name-zookeeper-idx-

用于为 ZooKeeper 节点 pod

idx存储数据的卷的持久性卷声明。

2.1.3.3.3. 日志目录

Kafka 代理使用持久性卷作为挂载到以下路径的日志目录:

/var/lib/kafka/data/kafka-logIDX

其中 IDX 是 Kafka 代理 pod 索引。例如 /var/lib/kafka/data/kafka-log0。

2.1.3.4. 重新定义持久性卷大小

您可以通过增大现有 AMQ Streams 集群使用的持久性卷的大小来置备存储容量。在使用一个持久性卷或在 JBOD 存储配置中使用多个持久性卷的集群中,支持重新定义持久性卷大小。

您可以增大但不能缩小持久性卷的大小。OpenShift 目前不支持缩小持久卷的大小。

先决条件

- 个 OpenShift 集群,其支持卷大小调整。

- Cluster Operator 正在运行。

- 使用使用支持卷扩展的存储类创建的持久性卷的 Kafka 集群。

流程

在

Kafka资源中,增大分配给 Kafka 集群和 ZooKeeper 集群的持久性卷的大小。-

要增大分配给 Kafka 集群的卷大小,编辑

spec.kafka.storage属性。 要增大分配给 ZooKeeper 集群的卷大小,请编辑

spec.zookeeper.storage属性。例如,将卷大小从

1000Gi增加到2000Gi:apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: persistent-claim size: 2000Gi class: my-storage-class # ... zookeeper: # ...

-

要增大分配给 Kafka 集群的卷大小,编辑

创建或更新资源:

oc apply -f KAFKA-CONFIG-FILEOpenShift 会响应来自 Cluster Operator 的请求,增加了所选持久性卷的容量。完成大小调整后,Cluster Operator 会重启所有使用调整大小持久性卷的 pod。这会自动发生。

其它资源

有关在 OpenShift 中调整持久性卷大小的更多信息,请参阅使用 Kubernetes 重新定义持久性卷 大小。

2.1.3.5. JBOD 存储概述

您可以将 AMQ Streams 配置为使用 JBOD,这是多个磁盘或卷的数据存储配置。JBOD 是为 Kafka 代理提供更多数据存储的一种方法。它还能提高性能。

一个或多个卷描述了 JBOD 配置,每个卷可以 临时 或永久 。JBOD 卷声明的规则和限制与临时和永久存储的规则和限制相同。例如,您不能在置备后缩小持久性存储卷的大小,或者 type=ephemeral 时您无法更改 sizeLimit 的值。

2.1.3.5.1. JBOD 配置

若要将 JBOD 与 AMQ Streams 搭配使用,存储 类型 必须设置为 jbod。借助 volumes 属性,您可以描述组成 JBOD 存储阵列或配置的磁盘。以下片段显示了 JBOD 配置示例:

# ...

storage:

type: jbod

volumes:

- id: 0

type: persistent-claim

size: 100Gi

deleteClaim: false

- id: 1

type: persistent-claim

size: 100Gi

deleteClaim: false

# ...创建 JBOD 卷后,无法更改 id。

用户可以从 JBOD 配置中添加或删除卷。

2.1.3.5.2. JBOD 和持久性卷声明

当使用持久性存储声明 JBOD 卷时,生成的持久性卷声明的命名方案如下:

data-id-cluster-name-kafka-idx-

其中

id是用于存储 Kafka 代理 podidx数据的卷 ID。

2.1.3.5.3. 日志目录

Kafka 代理将使用 JBOD 卷作为挂载到以下路径的日志目录:

/var/lib/kafka/data-id/kafka-log_idx_-

其中

id是用于存储 Kafka 代理 podidx数据的卷 ID。例如/var/lib/kafka/data-0/kafka-log0。

2.1.3.6. 将卷添加到 JBOD 存储

这个步骤描述了如何在配置为使用 JBOD 存储的 Kafka 集群中添加卷。它不能应用到配置为使用任何其他存储类型的 Kafka 集群。

在已经使用并被删除的 id 下添加新卷时,您必须确保之前使用的 PersistentVolumeClaims 已被删除。

先决条件

- OpenShift 集群

- 一个正在运行的 Cluster Operator

- 带有 JBOD 存储的 Kafka 集群

流程

编辑

Kafka资源中的spec.kafka.storage.volumes属性。将新卷添加到 volumes数组。例如,添加 ID 为2的新卷:apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: jbod volumes: - id: 0 type: persistent-claim size: 100Gi deleteClaim: false - id: 1 type: persistent-claim size: 100Gi deleteClaim: false - id: 2 type: persistent-claim size: 100Gi deleteClaim: false # ... zookeeper: # ...创建或更新资源:

oc apply -f KAFKA-CONFIG-FILE- 创建新主题或将现有分区重新分配至新磁盘.

其它资源

有关重新分配主题的详情请参考 第 2.1.4.2 节 “分区重新分配”。

2.1.3.7. 从 JBOD 存储中删除卷

这个步骤描述了如何从配置为使用 JBOD 存储的 Kafka 集群中删除卷。它不能应用到配置为使用任何其他存储类型的 Kafka 集群。JBOD 存储始终必须至少包含一个卷。

为避免数据丢失,您必须先移动所有分区,然后再删除卷。

先决条件

- OpenShift 集群

- 一个正在运行的 Cluster Operator

- 带有两个或多个卷的 JBOD 存储的 Kafka 集群

流程

- 从要删除的磁盘中重新分配所有分区。分区中仍然分配到将要删除的磁盘中的任何数据都可能会丢失。

编辑

Kafka资源中的spec.kafka.storage.volumes属性。从 volumes 阵列中删除一个或多个卷。例如,删除 ID 为1和2的卷:apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: jbod volumes: - id: 0 type: persistent-claim size: 100Gi deleteClaim: false # ... zookeeper: # ...创建或更新资源:

oc apply -f KAFKA-CONFIG-FILE

其它资源

有关重新分配主题的详情请参考 第 2.1.4.2 节 “分区重新分配”。

2.1.4. 扩展集群

2.1.4.1. 扩展 Kafka 集群

2.1.4.1.1. 在集群中添加代理

提高某个主题吞吐量的主要方法是增加该主题的分区数量。这是因为额外的分区允许在集群中的不同代理之间共享该主题的负载。但是,如果每个代理都受到使用更多分区的特定资源(通常是 I/O)限制,则不会增加吞吐量。相反,您需要在集群中添加代理。

当您在集群中添加额外的代理时,Kafka 不会自动为其分配任何分区。您必须决定从现有代理迁移到新代理的分区。

在所有代理之间重新分布分区后,应该减少每个代理的资源利用率。

2.1.4.1.2. 从集群中删除代理

因为 AMQ Streams 使用 StatefulSet 来管理代理 Pod,所以 您无法从集群中删除 任何 pod。您只能从集群中移除一个或多个数字最高的 pod。例如,在一个有 12 个代理的集群中,pod 被命名为 cluster-name-kafka-0 to cluster-name-kafka-11。如果您决定缩减一个代理,则会删除 cluster-name-kafka-11。

在从集群中删除代理前,请确保它没有被分配给任何分区。您还应决定剩余的代理中哪些将负责要停用代理中的每个分区。代理没有分配分区后,您可以安全地缩减集群。

2.1.4.2. 分区重新分配

Topic Operator 目前不支持将副本分配给不同的代理,因此需要直接连接到代理 Pod 以将副本分配到代理。

在代理 pod 中,kafka-reassign-partitions.sh 实用程序允许您将分区重新分配给不同的代理。

它有三种不同的模式:

--generate- 取一组主题和代理,并生成 重新分配 JSON 文件,该文件将导致这些主题的分区分配给这些代理。由于这适用于整个主题,因此当您只想重新分配某些主题的某些分区时,无法使用它。

--execute- 取 重新分配 JSON 文件 并将其应用到集群中的分区和代理。因此获得分区的代理会成为分区领导的追随者。对于给定分区,新代理一旦捕获并加入 ISR(同步副本)后,旧的代理将停止成为追随者,并删除其副本。

--verify-

使用与

--execute步骤相同的 重新分配 JSON 文件,--verify检查文件中的所有分区是否已移到其预期代理中。如果重新分配完成后,--verify 也会移除任何有效的 节流。除非被删除,否则节流将继续影响群集,即使重新分配完成后也是如此。

只能在任何给定时间在集群中运行一个重新分配,且无法取消正在运行的重新分配。如果您需要取消重新分配,请等待它完成,然后执行另一个重新分配以恢复第一次重新分配的影响。kafka-reassign-partitions.sh 将显示此重新版本的重新分配 JSON 作为其输出的一部分。在需要停止进行中的重新分配时,应将非常大的重新分配分成几个较小的重新分配。

2.1.4.2.1. 重新分配 JSON 文件

重新分配 JSON 文件 有一个特定的结构:

{

"version": 1,

"partitions": [

<PartitionObjects>

]

}其中 <PartitionObjects> 是一个用逗号分开的对象列表,例如:

{

"topic": <TopicName>,

"partition": <Partition>,

"replicas": [ <AssignedBrokerIds> ]

}

虽然 Kafka 也支持 "log_dirs" 属性,但这不应用于 AMQ Streams。

以下是重新分配 JSON 文件的示例,该文件将 主题 4 的分区 4 分配给代理 2、4 和 7,并将 主题 2 的分区 2 分配给 代理 1、5 和 7 :

{

"version": 1,

"partitions": [

{

"topic": "topic-a",

"partition": 4,

"replicas": [2,4,7]

},

{

"topic": "topic-b",

"partition": 2,

"replicas": [1,5,7]

}

]

}JSON 中没有包括的分区不会更改。

2.1.4.2.2. 在 JBOD 卷间重新分配分区

在 Kafka 集群中使用 JBOD 存储时,您可以选择在特定卷及其日志目录之间重新分配分区(每个卷都有一个日志目录)。要将分区重新分配给特定卷,请将 log_dirs 选项添加到重新分配 JSON 文件中的 <PartitionObjects> 中。

{

"topic": <TopicName>,

"partition": <Partition>,

"replicas": [ <AssignedBrokerIds> ],

"log_dirs": [ <AssignedLogDirs> ]

}

log_dirs 对象应包含与 replicas 对象中指定的副本数相同的日志目录 数量。该值应当是日志目录的绝对路径或 any 关键字。

例如:

{

"topic": "topic-a",

"partition": 4,

"replicas": [2,4,7].

"log_dirs": [ "/var/lib/kafka/data-0/kafka-log2", "/var/lib/kafka/data-0/kafka-log4", "/var/lib/kafka/data-0/kafka-log7" ]

}2.1.4.3. 生成重新分配 JSON 文件

此流程描述了如何生成重新分配 JSON 文件,该文件使用 kafka-reassign-partitions.sh 工具为给定主题集重新分配所有分区。

先决条件

- 一个正在运行的 Cluster Operator

-

Kafka资源 - 重新分配分区的一组主题

流程

准备名为 topic

.json的 JSON 文件,其中列出要移动的主题。它必须具有以下结构:{ "version": 1, "topics": [ <TopicObjects> ] }其中 <TopicObjects> 是一个以逗号分隔的对象列表,例如:

{ "topic": <TopicName> }例如,如果要重新分配

topic-a 和分区,则需要准备类似以下的 topictopic-b 的所有.json文件:{ "version": 1, "topics": [ { "topic": "topic-a"}, { "topic": "topic-b"} ] }将

topic.json文件复制到其中一个代理 pod 中:cat topics.json | oc exec -c kafka <BrokerPod> -i -- \ /bin/bash -c \ 'cat > /tmp/topics.json'

使用

kafka-reassign-partitions.sh命令生成重新分配 JSON。oc exec <BrokerPod> -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --topics-to-move-json-file /tmp/topics.json \ --broker-list <BrokerList> \ --generate

例如,将

topic-a 和的所有分区移动到 brokertopic-b4和7oc exec <BrokerPod> -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --topics-to-move-json-file /tmp/topics.json \ --broker-list 4,7 \ --generate

2.1.4.4. 手动创建重新分配 JSON 文件

如果要移动特定的分区,可以手动创建重新分配 JSON 文件。

2.1.4.5. 重新分配节流

分区重新分配可能是一个缓慢的过程,因为它涉及到在代理之间传输大量数据。为避免对客户端造成重大影响,您可以限制重新分配过程。这可能会导致重新分配需要更长的时间。

- 如果限流太低,新分配的代理将无法与正在发布的记录保持同步,并且重新分配永远不会完成。

- 如果限流太高,客户端就会受到影响。

例如,对于制作者而言,这可能会比等待确认的正常延迟更高。对于消费者而言,这可能会因为轮询之间延迟较高而导致吞吐量下降。

2.1.4.6. 扩展 Kafka 集群

这个步骤描述了如何在 Kafka 集群中增加代理数量。

先决条件

- 现有的 Kafka 集群。

-

名为 reassignment

.json的重新分配 JSON 文件 描述了如何在放大的集群中将分区重新分配给代理。

流程

-

通过增加

Kafka.spec.kafka.replicas配置选项,根据需要添加多个新代理。 - 验证新代理 Pod 是否已启动。

将

reassignment.json文件复制到您稍后要执行命令的代理 pod 中:cat reassignment.json | \ oc exec broker-pod -c kafka -i -- /bin/bash -c \ 'cat > /tmp/reassignment.json'

例如:

cat reassignment.json | \ oc exec my-cluster-kafka-0 -c kafka -i -- /bin/bash -c \ 'cat > /tmp/reassignment.json'使用同一代理 pod 的

kafka-reassign-partitions.sh命令行工具执行分区重新分配。oc exec broker-pod -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --execute如果您要节流复制,您也可以使用

--throttle选项,每秒使用节流率(以字节为单位)。例如:oc exec my-cluster-kafka-0 -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --throttle 5000000 \ --execute

此命令将显示两个重新分配 JSON 对象:第一个记录了正在移动的分区的当前分配。如果稍后需要恢复重新分配,您应该将其保存到本地文件(而不是 pod 中的文件)。第二个 JSON 对象是您在重新分配 JSON 文件中传递的目标重新分配。

如果您需要在重新分配期间更改节流,您可以使用具有不同节流率的同一命令行。例如:

oc exec my-cluster-kafka-0 -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --throttle 10000000 \ --execute

定期验证是否使用任何代理 Pod 的

kafka-reassign-partitions.sh命令行工具完成重新分配。这与上一步中的命令相同,但使用--verify选项而不是--execute选项。oc exec broker-pod -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --verify例如:

oc exec my-cluster-kafka-0 -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --verify

-

当

--verify命令报告每个分区成功完成时,重新分配已完成。最后的--verify还会导致移除任何重新分配节流。现在,如果您保存了 JSON,将分配还原到其原始代理中,您可以删除还原文件。

2.1.4.7. 缩减 Kafka 集群

这个步骤描述了如何减少 Kafka 集群中的代理数量。

先决条件

- 现有的 Kafka 集群。

-

名为 reassignment

.json的重新分配 JSON 文件 描述在删除了最高编号 Pod 中的代理后,应如何将分区重新分配给集群中的代理。

流程

将

reassignment.json文件复制到您稍后要执行命令的代理 pod 中:cat reassignment.json | \ oc exec broker-pod -c kafka -i -- /bin/bash -c \ 'cat > /tmp/reassignment.json'

例如:

cat reassignment.json | \ oc exec my-cluster-kafka-0 -c kafka -i -- /bin/bash -c \ 'cat > /tmp/reassignment.json'使用同一代理 pod 的

kafka-reassign-partitions.sh命令行工具执行分区重新分配。oc exec broker-pod -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --execute如果您要节流复制,您也可以使用

--throttle选项,每秒使用节流率(以字节为单位)。例如:oc exec my-cluster-kafka-0 -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --throttle 5000000 \ --execute

此命令将显示两个重新分配 JSON 对象:第一个记录了正在移动的分区的当前分配。如果稍后需要恢复重新分配,您应该将其保存到本地文件(而不是 pod 中的文件)。第二个 JSON 对象是您在重新分配 JSON 文件中传递的目标重新分配。

如果您需要在重新分配期间更改节流,您可以使用具有不同节流率的同一命令行。例如:

oc exec my-cluster-kafka-0 -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --throttle 10000000 \ --execute

定期验证是否使用任何代理 Pod 的

kafka-reassign-partitions.sh命令行工具完成重新分配。这与上一步中的命令相同,但使用--verify选项而不是--execute选项。oc exec broker-pod -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --verify例如:

oc exec my-cluster-kafka-0 -c kafka -it -- \ bin/kafka-reassign-partitions.sh --bootstrap-server localhost:9092 \ --reassignment-json-file /tmp/reassignment.json \ --verify

-

当

--verify命令报告每个分区成功完成时,重新分配已完成。最后的--verify还会导致移除任何重新分配节流。现在,如果您保存了 JSON,将分配还原到其原始代理中,您可以删除还原文件。 所有分区重新分配完成后,删除的代理不应对集群中的任何分区负责。您可以通过检查代理的数据日志目录是否包含任何实时分区日志来验证这一点。如果代理上的日志目录包含与扩展正则表达式

[a-zA-Z0-9.-]+\ 不匹配的目录。[a-z0-9]+-delete$仍然具有实时分区,不应停止。您可以执行以下命令检查:

oc exec my-cluster-kafka-0 -c kafka -it -- \ /bin/bash -c \ "ls -l /var/lib/kafka/kafka-log_<N>_ | grep -E '^d' | grep -vE '[a-zA-Z0-9.-]+\.[a-z0-9]+-delete$'"

其中 N

是要删除的 Pod数。如果上述命令显示任何输出,则代理仍然有实时分区。在这种情况下,重新分配没有完成,或者重新分配 JSON 文件不正确。

-

确认代理没有实时分区后,您可以编辑

Kafka.spec.kafka.replicas 资源的spec.kafka.replicas,这会缩减Kafka.StatefulSet,从而删除最高数字的代理 Pod。

2.1.5. 用于滚动更新的维护时间窗

通过维护时间窗,您可以计划对 Kafka 和 ZooKeeper 集群进行某些滚动更新,以便在方便的时间启动。

2.1.5.1. 维护时间窗概述

在大多数情况下,Cluster Operator 只更新 Kafka 或 ZooKeeper 集群,以响应对对应 Kafka 资源的更改。这可让您计划何时对 Kafka 资源应用更改,以最大程度降低对 Kafka 客户端应用程序的影响。

但是,在不对 Kafka 资源 进行任何相应的更改的情况下,可能会对 Kafka 和 ZooKeeper 集群进行一些更新。例如,如果 Cluster Operator 管理的 CA(证书授权机构)证书接近到期时间,则 Cluster Operator 将需要执行滚动重启。

虽然 pod 的滚动重启不应影响服务 的可用性 (假设正确的代理和主题配置),这可能会影响 Kafka 客户端应用程序 的性能。通过维护时间窗,您可以调度 Kafka 和 ZooKeeper 集群的自发滚动更新,以便在方便的时间开始。如果没有为群集配置维护时间窗,那么这种自发滚动更新可能会在不方便的时间(如在可预测的高负载期间)发生。

2.1.5.2. 维护时间窗定义

您可以通过在 Kafka.spec.maintenanceTimeWindows 属性中输入字符串数组来配置维护时间窗。每个字符串是一个 cron 表达式,解释为使用 UTC(协调世界时间,其实际用途与 Greenwich Mean Time 相同)。

以下示例配置了一个维护时间窗口,该时间窗口从午夜开始,到 01:59am(UTC)、周日、周一、星期二和周四结束:

# ... maintenanceTimeWindows: - "* * 0-1 ? * SUN,MON,TUE,WED,THU *" # ...

在实践中,维护窗口应当与 Kafka.spec.clusterCa.renewalDays 和 Kafka.spec.clientsCa.renewalDays 属性一同设置,以确保在 配置的维护时间窗口中完成必要的 CA 证书续订。

AMQ Streams 不完全根据给定的窗口调度维护操作。相反,对于每个协调,它会检查维护窗口当前是否"打开"。这意味着,给定时间窗内的维护操作启动可能会被 Cluster Operator 协调间隔延迟。因此维护时间窗必须至少是这个长。

其它资源

- 有关 Cluster Operator 配置的更多信息,请参阅 第 5.1.1 节 “Cluster Operator 配置”。

2.1.5.3. 配置维护时间窗

您可以配置维护时间窗,用于由支持的进程触发的滚动更新。

先决条件

- OpenShift 集群。

- Cluster Operator 正在运行。

流程

在

Kafka资源中添加或编辑maintenanceTimeWindows属性。例如,允许在 0800 到 1059 之间以及 1400 到 1559 之间的维护,您可以设置maintenanceTimeWindows,如下所示:apiVersion: kafka.strimzi.io/v1beta2 kind: Kafka metadata: name: my-cluster spec: kafka: # ... zookeeper: # ... maintenanceTimeWindows: - "* * 8-10 * * ?" - "* * 14-15 * * ?"创建或更新资源:

oc apply -f KAFKA-CONFIG-FILE

其它资源

执行滚动更新:

2.1.6. 从终端连接到 ZooKeeper

大多数 Kafka CLI 工具可以直接连接到 Kafka,因此在正常情况下,您不需要连接到 ZooKeeper。zookeeper 服务通过加密和身份验证进行保护,它们不应该由不属于 AMQ Streams 的外部应用程序使用。

但是,如果要使用需要连接到 ZooKeeper 的 Kafka CLI 工具,您可以使用 ZooKeeper 容器中的终端,并连接 localhost:12181 作为 ZooKeeper 地址。

先决条件

- OpenShift 集群可用。

- Kafka 集群正在运行。

- Cluster Operator 正在运行。

流程

使用 OpenShift 控制台打开终端,或者从 CLI 运行

exec命令。例如:

oc exec -ti my-cluster-zookeeper-0 -- bin/kafka-topics.sh --list --zookeeper localhost:12181务必使用

localhost:12181。现在,您可以向 ZooKeeper 运行 Kafka 命令。

2.1.7. 手动删除 Kafka 节点

此流程描述了如何使用 OpenShift 注解删除现有 Kafka 节点。删除 Kafka 节点包括删除运行 Kafka 代理的 Pod 和相关的 PersistentVolumeClaim (如果集群部署了持久性存储)。删除后,Pod 及其相关的 PersistentVolumeClaim 会被自动重新创建。

删除 PersistentVolumeClaim 可能会导致持久性数据丢失。只有在您遇到存储问题时才应执行以下步骤。

先决条件

有关运行 以下的说明,请参阅 OpenShift 指南中的部署和升级 AMQ Streams :

流程

查找您要删除的

Pod的名称。例如,如果集群命名为 cluster-name,pod 被命名为 cluster-name-kafka-index,其中 索引 以零开始,结尾是副本总数。

给 OpenShift

中的容器集资源标注:使用

oc annotate:oc annotate pod cluster-name-kafka-index strimzi.io/delete-pod-and-pvc=true

- 等待下一次协调,当带有底层持久性卷声明的注解的 pod 被删除后再重新创建。

2.1.8. 手动删除 ZooKeeper 节点

此流程描述了如何使用 OpenShift 注释删除现有的 ZooKeeper 节点。删除 ZooKeeper 节点包括删除运行 ZooKeeper 的 Pod 和相关的 PersistentVolumeClaim (如果集群部署了持久性存储)。删除后,Pod 及其相关的 PersistentVolumeClaim 会被自动重新创建。

删除 PersistentVolumeClaim 可能会导致持久性数据丢失。只有在您遇到存储问题时才应执行以下步骤。

先决条件

有关运行 以下的说明,请参阅 OpenShift 指南中的部署和升级 AMQ Streams :

流程

查找您要删除的

Pod的名称。例如,如果集群名为 cluster-name,pod 被命名为 cluster-name-zookeeper-index,其中 索引 从零开始,结尾是副本总数。

给 OpenShift

中的容器集资源标注:使用

oc annotate:oc annotate pod cluster-name-zookeeper-index strimzi.io/delete-pod-and-pvc=true

- 等待下一次协调,当带有底层持久性卷声明的注解的 pod 被删除后再重新创建。

2.1.9. Kafka 集群资源列表

以下资源由 OpenShift 集群中的 Cluster Operator 创建:

共享资源

cluster-name-cluster-ca- 使用用于加密集群通信的集群 CA 私钥的机密。

cluster-name-cluster-ca-cert- 使用 Cluster CA 公钥的 secret。这个密钥可以用来验证 Kafka 代理的身份。

cluster-name-clients-ca- 带有用于签署用户证书的 Clients CA 私钥的 secret

cluster-name-clients-ca-cert- 使用 Clients CA 公钥的机密。此密钥可用于验证 Kafka 用户的身份。

cluster-name-cluster-operator-certs- 使用集群操作器密钥与 Kafka 和 ZooKeeper 通信的机密。

zookeeper 节点

cluster-name-zookeeper- StatefulSet,它负责管理 ZooKeeper 节点 pod。

cluster-name-zookeeper-idx- 由 Zookeeper StatefulSet 创建的 Pod。

cluster-name-zookeeper-nodes- 无头服务需要直接解析 ZooKeeper pod IP 地址。

cluster-name-zookeeper-client- Kafka 代理用于连接 ZooKeeper 节点的服务作为客户端。

cluster-name-zookeeper-config- 包含 ZooKeeper 辅助配置的 ConfigMap,由 ZooKeeper 节点 pod 挂载为卷。

cluster-name-zookeeper-nodes- 使用 ZooKeeper 节点密钥的机密。

cluster-name-zookeeper- Zookeeper 节点使用的服务帐户。

cluster-name-zookeeper- 为 ZooKeeper 节点配置的 Pod Disruption Budget。

cluster-name-network-policy-zookeeper- 管理对 ZooKeeper 服务访问的网络策略.

data-cluster-name-zookeeper-idx-

用于为 ZooKeeper 节点 pod

idx存储数据的卷的持久性卷声明。只有在选择了持久存储来调配持久卷以存储数据时,才会创建此资源。

Kafka 代理

cluster-name-kafka- StatefulSet,它负责管理 Kafka 代理 pod。

cluster-name-kafka-idx- 由 Kafka StatefulSet 创建的 Pod。

cluster-name-kafka-brokers- 需要 DNS 直接解析 Kafka 代理 Pod IP 地址的服务。

cluster-name-kafka-bootstrap- 服务可用作从 OpenShift 集群内连接的 Kafka 客户端的 bootstrap 服务器。

cluster-name-kafka-external-bootstrap-

为从 OpenShift 集群外部连接的客户端引导服务。只有在启用了外部侦听器时才创建此资源。当监听器名称为

外部并且端口为9094时,旧服务名称将用于向后兼容。 cluster-name-kafka-pod-id-

用于将流量从 OpenShift 集群外部路由到单个容器集的服务。只有在启用了外部侦听器时才创建此资源。当监听器名称为

外部并且端口为9094时,旧服务名称将用于向后兼容。 cluster-name-kafka-external-bootstrap-

从 OpenShift 集群外部连接的客户端的引导路由。只有在启用了外部侦听器并设置为 type

route时才会创建此资源。当监听器名称为外部并且端口为9094时,旧路由名称将用于向后兼容。 cluster-name-kafka-pod-id-

从 OpenShift 集群外部的流量路由到单个容器集。只有在启用了外部侦听器并设置为 type

route时才会创建此资源。当监听器名称为外部并且端口为9094时,旧路由名称将用于向后兼容。 cluster-name-kafka-listener-name-bootstrap- 为从 OpenShift 集群外部连接的客户端引导服务。只有在启用了外部侦听器时才创建此资源。新服务名称将用于所有其他外部侦听器。

cluster-name-kafka-listener-name-pod-id- 用于将流量从 OpenShift 集群外部路由到单个容器集的服务。只有在启用了外部侦听器时才创建此资源。新服务名称将用于所有其他外部侦听器。

cluster-name-kafka-listener-name-bootstrap-

从 OpenShift 集群外部连接的客户端的引导路由。只有在启用了外部侦听器并设置为 type

route时才会创建此资源。新路由名称将用于所有其他外部侦听器。 cluster-name-kafka-listener-name-pod-id-

从 OpenShift 集群外部的流量路由到单个容器集。只有在启用了外部侦听器并设置为 type

route时才会创建此资源。新路由名称将用于所有其他外部侦听器。 cluster-name-kafka-config- 包含 Kafka 辅助配置且由 Kafka 代理 Pod 挂载为卷的 ConfigMap。

cluster-name-kafka-brokers- 使用 Kafka 代理密钥的 secret。

cluster-name-kafka- Kafka 代理使用的服务帐户。

cluster-name-kafka- 为 Kafka 代理配置的 Pod Disruption Budget。

cluster-name-network-policy-kafka- 管理对 Kafka 服务访问的网络策略。

strimzi-namespace-name-cluster-name-kafka-init- Kafka 代理使用的集群角色绑定。

cluster-name-jmx- 用来保护 Kafka 代理端口的 JMX 用户名和密码的 secret。只有在 Kafka 中启用了 JMX 时才会创建此资源。

data-cluster-name-kafka-idx-

用于存储 Kafka 代理 pod

IDx数据的卷的持久性卷声明。只有在选择了持久存储来调配持久卷以存储数据时才创建此资源。 data-id-cluster-name-kafka-idx-

用于存储 Kafka 代理 pod

ID的卷 ID 的持久性卷声明。只有在调配持久卷以存储数据时,才会为 JBOD 卷选择持久存储时创建此资源。

实体 Operator

只有在使用 Cluster Operator 部署 Entity Operator 时才会创建这些资源。

cluster-name-entity-operator- 使用主题和用户操作器进行部署.

cluster-name-entity-operator-random-string- 由 Entity Operator 部署创建的 Pod。

cluster-name-entity-topic-operator-config- 带有主题 Operator 辅助配置的 ConfigMap。

cluster-name-entity-user-operator-config- 带有用户 Operator 辅助配置的 ConfigMap.

cluster-name-entity-operator-certs- 使用 Entity Operator 密钥与 Kafka 和 ZooKeeper 通信的 secret。

cluster-name-entity-operator- Entity Operator 使用的服务帐户。

strimzi-cluster-name-entity-topic-operator- Entity Topic Operator 使用的角色绑定。

strimzi-cluster-name-entity-user-operator- Entity User Operator 使用的角色绑定。

Kafka Exporter

只有在使用 Cluster Operator 部署 Kafka Exporter 时才会创建这些资源。

cluster-name-kafka-exporter- 使用 Kafka 导出器部署.

cluster-name-kafka-exporter-random-string- 由 Kafka Exporter 部署创建的 Pod。

cluster-name-kafka-exporter- 用于收集消费者滞后指标的服务.

cluster-name-kafka-exporter- Kafka Exporter 使用的服务帐户。

Sything Control

只有在使用 Cluster Operator 部署 Cruise Control 时才会创建这些资源。

cluster-name-cruise-control- 通过 Cruise 控制进行部署.

cluster-name-cruise-control-random-string- 由 Cruise Control 部署创建的 Pod。

cluster-name-cruise-control-config- 包含 Cruise Control 辅助配置的 ConfigMap,并被 Cruise Control pod 作为一个卷挂载。

cluster-name-cruise-control-certs- 使用 Cruise Control 密钥与 Kafka 和 ZooKeeper 通信的机密。

cluster-name-cruise-control- 用于与 Cruise Control 通信的服务.

cluster-name-cruise-control- Cruise Control 使用的服务帐户.

cluster-name-network-policy-cruise-control- 管理对 Cruise 控制服务的访问的网络策略.

2.2. Kafka Connect/S2I 集群配置

本节论述了如何在 AMQ Streams 集群中配置 Kafka Connect 或 Kafka Connect with Source-to-Image(S2I)部署。

Kafka Connect 是一个集成工具包,用于使用连接器插件在 Kafka 代理和其他系统间流传输数据。Kafka Connect 提供了一个框架,用于将 Kafka 与外部数据源或目标(如数据库)集成,以使用连接器导入或导出数据。连接器是提供所需连接配置的插件。

如果使用 Kafka Connect,您可以配置 KafkaConnect 或 资源。如果您使用 Source-to-Image( KafkaConnect S2IS2I )框架来部署 Kafka Connect,请使用 KafkaConnectS2I 资源。

-

KafkaConnect资源的完整 schema 信息包括在 第 13.2.59 节 “KafkaConnect模式参考” 中。 -

KafkaConnectS2I资源的完整 schema 包括在 第 13.2.84 节 “KafkaConnectS2I模式参考” 中。

随着 KafkaConnect 资源引入 构建配置,AMQ Streams 现在可以使用数据连接所需的连接器插件自动构建容器镜像。因此,使用 Source-to-Image(S2I)进行 Kafka Connect 的支持已弃用,并将在 AMQ Streams 1.8 后被删除。要准备此更改,您可以将 Kafka Connect S2I 实例迁移到 Kafka Connect 实例。

其它资源

2.2.1. 配置 Kafka 连接

使用 Kafka Connect 设置到 Kafka 集群的外部数据连接。

使用 KafkaConnect 或 资源的属性来配置 Kafka Connect 部署。此流程中演示的示例适用于 KafkaConnect S2IKafkaConnect 资源,但 KafkaConnectS2I 资源的属性相同。

Kafka 连接器配置

KafkaConnector 资源允许您以 OpenShift 原生方式为 Kafka Connect 创建和管理连接器实例。

在 Kafka Connect 配置中,您可以通过添加 strimzi.io/use-connector-resources 注解为 Kafka Connect 集群启用 KafkaConnectors。您还可以添加 构建配置,以便 AMQ Streams 会自动构建带有数据连接所需的连接器插件的容器镜像。Kafka Connect 连接器的外部配置通过 externalConfiguration 属性指定。

要管理连接器,您可以使用 Kafka Connect REST API,或使用 KafkaConnector 自定义资源。KafkaConnector 资源必须部署到与其链接的 Kafka Connect 集群相同的命名空间中。有关使用这些方法创建、重新配置或删除连接器的更多信息,请参阅 OpenShift 上部署和升级 AMQ Streams 中的创建和管理连接器。

连接器配置作为 HTTP 请求的一部分传递给 Kafka Connect,并存储在 Kafka 本身中。ConfigMap 和机密是用于存储配置和机密数据的标准 OpenShift 资源。您可以使用 ConfigMap 和 Secret 配置连接器的某些元素。然后,您可以引用 HTTP REST 命令中的配置值,以便在需要时保持配置独立和安全。这个方法尤其适用于机密数据,如用户名、密码或证书。

先决条件

- OpenShift 集群

- 一个正在运行的 Cluster Operator

有关运行 以下的说明,请参阅 OpenShift 指南中的部署和升级 AMQ Streams :

流程

编辑

KafkaConnect 或资源的KafkaConnectS2Ispec属性。您可以配置的属性显示在此示例配置中:

apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaConnect 1 metadata: name: my-connect-cluster annotations: strimzi.io/use-connector-resources: "true" 2 spec: replicas: 3 3 authentication: 4 type: tls certificateAndKey: certificate: source.crt key: source.key secretName: my-user-source bootstrapServers: my-cluster-kafka-bootstrap:9092 5 tls: 6 trustedCertificates: - secretName: my-cluster-cluster-cert certificate: ca.crt - secretName: my-cluster-cluster-cert certificate: ca2.crt config: 7 group.id: my-connect-cluster offset.storage.topic: my-connect-cluster-offsets config.storage.topic: my-connect-cluster-configs status.storage.topic: my-connect-cluster-status key.converter: org.apache.kafka.connect.json.JsonConverter value.converter: org.apache.kafka.connect.json.JsonConverter key.converter.schemas.enable: true value.converter.schemas.enable: true config.storage.replication.factor: 3 offset.storage.replication.factor: 3 status.storage.replication.factor: 3 build: 8 output: 9 type: docker image: my-registry.io/my-org/my-connect-cluster:latest pushSecret: my-registry-credentials plugins: 10 - name: debezium-postgres-connector artifacts: - type: tgz url: https://repo1.maven.org/maven2/io/debezium/debezium-connector-postgres/1.3.1.Final/debezium-connector-postgres-1.3.1.Final-plugin.tar.gz sha512sum: 962a12151bdf9a5a30627eebac739955a4fd95a08d373b86bdcea2b4d0c27dd6e1edd5cb548045e115e33a9e69b1b2a352bee24df035a0447cb820077af00c03 - name: camel-telegram artifacts: - type: tgz url: https://repo.maven.apache.org/maven2/org/apache/camel/kafkaconnector/camel-telegram-kafka-connector/0.7.0/camel-telegram-kafka-connector-0.7.0-package.tar.gz sha512sum: a9b1ac63e3284bea7836d7d24d84208c49cdf5600070e6bd1535de654f6920b74ad950d51733e8020bf4187870699819f54ef5859c7846ee4081507f48873479 externalConfiguration: 11 env: - name: AWS_ACCESS_KEY_ID valueFrom: secretKeyRef: name: aws-creds key: awsAccessKey - name: AWS_SECRET_ACCESS_KEY valueFrom: secretKeyRef: name: aws-creds key: awsSecretAccessKey resources: 12 requests: cpu: "1" memory: 2Gi limits: cpu: "2" memory: 2Gi logging: 13 type: inline loggers: log4j.rootLogger: "INFO" readinessProbe: 14 initialDelaySeconds: 15 timeoutSeconds: 5 livenessProbe: initialDelaySeconds: 15 timeoutSeconds: 5 metricsConfig: 15 type: jmxPrometheusExporter valueFrom: configMapKeyRef: name: my-config-map key: my-key jvmOptions: 16 "-Xmx": "1g" "-Xms": "1g" image: my-org/my-image:latest 17 rack: topologyKey: topology.kubernetes.io/zone 18 template: 19 pod: affinity: podAntiAffinity: requiredDuringSchedulingIgnoredDuringExecution: - labelSelector: matchExpressions: - key: application operator: In values: - postgresql - mongodb topologyKey: "kubernetes.io/hostname" connectContainer: 20 env: - name: JAEGER_SERVICE_NAME value: my-jaeger-service - name: JAEGER_AGENT_HOST value: jaeger-agent-name - name: JAEGER_AGENT_PORT value: "6831"

- 1

- 根据需要,使用

KafkaConnect或 KafkaConnectS2I - 2

- 为 Kafka Connect 集群启用 KafkaConnectors。

- 3

- 4

- Kafka Connect 集群的身份验证,使用 TLS 机制 (如下所示)、使用 OAuth bearer 令牌 或基于 SASL 的 SCRAM-SHA-512 或 PLAIN 机制。默认情况下,Kafka Connect 使用纯文本连接连接到 Kafka 代理。

- 5

- 用于连接到 Kafka Connect 集群的 bootstrap 服务器。

- 6

- 使用密钥名称进行 TLS 加密,在其下,TLS 证书以 X.509 格式存储到集群的 X.509 格式。如果证书存储在同一个 secret 中,则可以多次列出证书。

- 7

- Kafka Connect worker ( 而不是连接器)配置。标准 Apache Kafka 配置可能会提供,仅限于不是由 AMQ Streams 直接管理的属性。

- 8

- 用于自动使用连接器插件构建容器镜像的 构建配置属性。

- 9

- (必需)配置推送新镜像的容器注册表。

- 10

- (必需)要添加到新容器镜像的连接器插件及其工件列表。每个插件必须至少配置一个

工件。 - 11

- 12

- 13

- 指定 Kafka 连接日志记录器和日志级别 直接(

内联)或通过ConfigMap 间接(外部)添加。自定义 ConfigMap 必须放在log4j.properties 或log4j2.properties键下。对于 Kafka Connectlog4j.rootLogger日志记录器,您可以将日志级别设置为 INFO、ERROR、WARN、TRACE、DEBUG、FATAL 或 OFF。 - 14

- 健康检查以了解 何时重新启动容器(存活度)以及容器何时可以接受流量(就绪度)。

- 15

- Prometheus metrics,通过引用包含本例中 Prometheus JMX 导出器配置的 ConfigMap 来启用它。您可以使用对包含

metricsConfig.valueFrom.configMapKeyRef.key下的空文件的 ConfigMap 的引用来启用指标,而无需进一步配置。 - 16

- 运行 Kafka Connect 的虚拟机(VM)性能优化 JVM 配置选项。

- 17

- ADVANCED OPTION: 容器镜像配置,只在特殊情况下推荐这样做。

- 18

- 将机架感知 配置为在不同机架之间分布副本。

topologykey必须与集群节点标签匹配。 - 19

- 模板自定义.在这里,pod 被调度为反关联性,因此 pod 不会调度到具有相同主机名的节点。

- 20

- 还 使用 Jaeger 为分布式追踪设置 环境变量。

创建或更新资源:

oc apply -f KAFKA-CONNECT-CONFIG-FILE- 如果为 Kafka Connect 启用了授权,请配置 Kafka Connect 用户以启用对 Kafka Connect consumer 组和主题的访问。

2.2.2. 多个实例的 Kafka Connect 配置

如果您正在运行多个 Kafka Connect 实例,您必须更改以下配置 属性 的默认配置:

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaConnect

metadata:

name: my-connect

spec:

# ...

config:

group.id: connect-cluster 1

offset.storage.topic: connect-cluster-offsets 2

config.storage.topic: connect-cluster-configs 3

status.storage.topic: connect-cluster-status 4

# ...

# ...

对于具有同一 group.id 的所有 Kafka Connect 实例,三个主题的值必须相同。

除非更改默认设置,否则每个连接到同一 Kafka 集群的 Kafka Connect 实例都使用相同的值部署。实际上,所有实例都合并在一起,在集群中运行并使用相同的主题。

如果多个 Kafka Connect 集群尝试使用相同的主题,Kafka Connect 将无法按预期工作并生成错误。

如果要运行多个 Kafka Connect 实例,请为每个实例更改这些属性的值。

2.2.3. 配置 Kafka Connect 用户授权

这个步骤描述了如何授权用户对 Kafka Connect 的访问。

当 Kafka 中使用任何类型的授权时,Kafka Connect 用户需要对消费者组的读/写访问权限以及 Kafka Connect 的内部主题。

用户组和内部主题的属性由 AMQ Streams 自动配置,或者可以在 KafkaConnect 或 资源的 KafkaConnect S2Ispec 中明确指定。

KafkaConnect 资源中的配置属性示例

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaConnect

metadata:

name: my-connect

spec:

# ...

config:

group.id: my-connect-cluster 1

offset.storage.topic: my-connect-cluster-offsets 2

config.storage.topic: my-connect-cluster-configs 3

status.storage.topic: my-connect-cluster-status 4

# ...

# ...

此流程演示了在使用 简单 授权时如何提供访问权限。

简单的授权使用由 Kafka AclAuthorizer 插件处理的 ACL 规则来提供正确的访问级别。有关将 KafkaUser 资源配置为使用简单授权的更多信息,请参阅 AclRule schema 引用。

运行多个实例时,使用者组和主题的默认值将有所不同。

先决条件

- OpenShift 集群

- 一个正在运行的 Cluster Operator

流程

编辑

KafkaUser资源中的授权属性,以便为用户提供访问权限。在以下示例中,使用

字面名称值为 Kafka Connect 主题和消费者组配置访问权限:属性 名称 offset.storage.topicconnect-cluster-offsetsstatus.storage.topicconnect-cluster-statusconfig.storage.topicconnect-cluster-configsgroupconnect-clusterapiVersion: kafka.strimzi.io/v1beta2 kind: KafkaUser metadata: name: my-user labels: strimzi.io/cluster: my-cluster spec: # ... authorization: type: simple acls: # access to offset.storage.topic - resource: type: topic name: connect-cluster-offsets patternType: literal operation: Write host: "*" - resource: type: topic name: connect-cluster-offsets patternType: literal operation: Create host: "*" - resource: type: topic name: connect-cluster-offsets patternType: literal operation: Describe host: "*" - resource: type: topic name: connect-cluster-offsets patternType: literal operation: Read host: "*" # access to status.storage.topic - resource: type: topic name: connect-cluster-status patternType: literal operation: Write host: "*" - resource: type: topic name: connect-cluster-status patternType: literal operation: Create host: "*" - resource: type: topic name: connect-cluster-status patternType: literal operation: Describe host: "*" - resource: type: topic name: connect-cluster-status patternType: literal operation: Read host: "*" # access to config.storage.topic - resource: type: topic name: connect-cluster-configs patternType: literal operation: Write host: "*" - resource: type: topic name: connect-cluster-configs patternType: literal operation: Create host: "*" - resource: type: topic name: connect-cluster-configs patternType: literal operation: Describe host: "*" - resource: type: topic name: connect-cluster-configs patternType: literal operation: Read host: "*" # consumer group - resource: type: group name: connect-cluster patternType: literal operation: Read host: "*"创建或更新资源。

oc apply -f KAFKA-USER-CONFIG-FILE

2.2.4. 执行 Kafka 连接器重启

此流程描述了如何使用 OpenShift 注解手动触发 Kafka 连接器重启。

先决条件

- Cluster Operator 正在运行。

流程

查找控制您要重启的

Kafka 连接器的 KafkaConnector自定义资源的名称:oc get KafkaConnector

要重启连接器,请注解

OpenShift 中的 KafkaConnector资源。例如,使用oc annotate:oc annotate KafkaConnector KAFKACONNECTOR-NAME strimzi.io/restart=true等待下一次协调发生(默认为每隔两分钟)。

Kafka 连接器重启,只要协调过程检测到注解。当 Kafka Connect 接受重启请求时,该注解会从

KafkaConnector自定义资源中删除。

其它资源

- 在部署和管理连接器 指南中 创建和管理连接器.

2.2.5. 执行 Kafka 连接器任务重启

此流程描述了如何使用 OpenShift 注解手动触发 Kafka 连接器任务重启。

先决条件

- Cluster Operator 正在运行。

流程

查找控制您要重启的

Kafka 连接器任务的 KafkaConnector自定义资源的名称:oc get KafkaConnector

从

KafkaConnector自定义资源中找到要重启的任务 ID。任务 ID 是非负整数,从 0 开始。oc describe KafkaConnector KAFKACONNECTOR-NAME要重启连接器任务,请注解

OpenShift 中的 KafkaConnector资源。例如,使用oc annotate重启任务 0:oc annotate KafkaConnector KAFKACONNECTOR-NAME strimzi.io/restart-task=0等待下一次协调发生(默认为每隔两分钟)。

Kafka 连接器任务重启,只要协调过程检测到注解。当 Kafka Connect 接受重启请求时,该注解会从

KafkaConnector自定义资源中删除。

其它资源

- 在部署和管理连接器 指南中 创建和管理连接器.

2.2.6. 从使用 S2I 的 Kafka Connect 迁移到 Kafka Connect

对 Kafka Connect with S2I 和 KafkaConnectS2I 资源的支持已弃用。这会在 KafkaConnect 资源引入 构建配置 属性,用于使用连接器插件来自动构建容器镜像。

这个步骤描述了如何使用 S2I 实例将 Kafka Connect 迁移到标准 Kafka Connect 实例。为此,您需要配置一个新的 KafkaConnect 自定义资源来替换 KafkaConnectS2I 资源,然后删除该资源。

迁移过程涉及从 KafkaConnectS2I 实例删除到新 KafkaConnect 实例部署成功时的停机时间。在此期间,连接器将不会运行和处理数据。但是,更改后,它们应从停止的时间点继续。

先决条件

-

使用 KafkaConnectS2I 配置部署带有 S

2I 的 KafkaConnect - 与 S2I 的 Kafka Connect 使用带有使用 S2I 构建添加的连接器的镜像

-

sink 和源连接器实例是使用

KafkaConnector资源或 Kafka Connect REST API 创建的

流程

-

使用与用于

Kafka自定义资源。connectS2I 资源的名称相同的名称创建新的 KafkaConnect -

将

KafkaConnectS2I资源属性复制到KafkaConnect资源。 如果指定,请确保使用相同的

spec.config属性:-

group.id -

offset.storage.topic -

config.storage.topic status.storage.topic如果未指定这些属性,则使用默认值。在这种情况下,也将其从

KafkaConnect资源配置中退出。

现在,将特定于

KafkaConnect资源的配置添加到新资源中。-

添加

构建配置,以配置您要添加到 Kafka Connect 部署中的所有连接器和其他库。注意或者,您也可以使用连接器手动构建新镜像,并使用

.spec.image属性指定它。删除旧的

KafkaConnectS2I资源:oc delete -f MY-KAFKA-CONNECT-S2I-CONFIG-FILE将 MY-KAFKA-CONNECT-S2I-CONFIG-FILE 替换为包含

KafkaConnectS2I资源配置的文件名。另外,您可以指定资源的名称:

oc delete kafkaconnects2i MY-KAFKA-CONNECT-S2I将 MY-KAFKA-CONNECT-S2I 替换为

KafkaConnectS2I资源的名称。等待 Kafka Connect with S2I 部署被删除,并且 pod 已被删除。

警告不得删除任何其他资源。

部署新的

KafkaConnect资源:oc apply -f MY-KAFKA-CONNECT-CONFIG-FILE将 MY-KAFKA-CONNECT-CONFIG-FILE 替换为包含新

KafkaConnect资源配置的文件名称。等待新镜像构建好,部署创建好,并且容器集已启动。

如果您使用

KafkaConnector资源来管理 Kafka Connect 连接器,请检查所有预期的连接器是否存在并正在运行:oc get kctr --selector strimzi.io/cluster=MY-KAFKA-CONNECT-CLUSTER -o name将 MY-KAFKA-CONNECT-CLUSTER 替换为 Kafka Connect 集群的名称。

通过 Kafka Connect 存储自动恢复连接器。即使您使用 Kafka Connect REST API 管理它们,您不应该手动重新创建它们。

2.2.7. Kafka Connect 集群资源列表

以下资源由 OpenShift 集群中的 Cluster Operator 创建:

- connect-cluster-name-connect

- 用于创建 Kafka Connect worker 节点 pod 的 Deployment。

- connect-cluster-name-connect-api

- 公开用于管理 Kafka Connect 集群的 REST 接口的服务。

- connect-cluster-name-config

- 包含 Kafka Connect 辅助配置且由 Kafka 代理 Pod 挂载为卷的 ConfigMap。

- connect-cluster-name-connect

- 为 Kafka Connect worker 节点配置的 Pod Disruption Budget。

2.2.8. Kafka Connect(S2I)集群资源列表

以下资源由 OpenShift 集群中的 Cluster Operator 创建:

- connect-cluster-name-connect-source

- 镜像流,用作新构建的 Docker 镜像的基础镜像。

- connect-cluster-name-connect

- BuildConfig,它负责构建新的 Kafka Connect Docker 镜像。

- connect-cluster-name-connect

- 将推送新构建 Docker 镜像的镜像流。

- connect-cluster-name-connect

- DeploymentConfig,它负责创建 Kafka Connect worker 节点 pod。

- connect-cluster-name-connect-api

- 公开用于管理 Kafka Connect 集群的 REST 接口的服务。

- connect-cluster-name-config

- 包含 Kafka Connect 辅助配置且由 Kafka 代理 Pod 挂载为卷的 ConfigMap。

- connect-cluster-name-connect

- 为 Kafka Connect worker 节点配置的 Pod Disruption Budget。

2.2.9. 与 Debezium 集成以捕获更改数据

红帽 Debezium 是一个分布式更改数据捕获平台。它捕获数据库中的行级更改,创建更改事件记录,并将记录流传输到 Kafka 主题。Debezium 基于 Apache Kafka 构建。您可以将 Debezium 与 AMQ Streams 部署和集成。部署 AMQ Streams 后,您可以通过 Kafka Connect 将 Debezium 部署为连接器配置。Debezium 将更改事件记录传递到 OpenShift 上的 AMQ Streams。应用程序可以读取 这些更改事件流,并按发生更改事件的顺序访问更改事件。

Debezium 具有多个用途,包括:

- 数据复制

- 更新缓存和搜索索引

- 简化单体式应用程序

- 数据集成

- 启用流查询

要捕获数据库更改,请使用 Debezium 数据库连接器部署 Kafka Connect。您可以配置 KafkaConnector 资源来定义连接器实例。

有关使用 AMQ Streams 部署 Debezium 的更多信息,请参阅 产品文档。Debezium 文档包括 Debezium 入门 指南,指导您完成设置服务和查看数据库更新事件记录所需的连接器所需的流程。

2.3. Kafka MirrorMaker 集群配置

本章论述了如何在 AMQ Streams 集群中配置 Kafka 镜像Maker 部署以在 Kafka 集群间复制数据。

您可以使用带有 MirrorMaker 或 MirrorMaker 2.0 的 AMQ Streams。MirrorMaker 2.0 是最新版本,为在 Kafka 集群间镜像数据提供了一种更有效的方法。

如果使用 MirrorMaker,您需要配置 KafkaMirrorMaker 资源。

以下流程演示了如何配置资源:

KafkaMirrorMaker 资源的完整 schema 信息包括在 KafkaMirrorMaker schema 引用 中。

2.3.1. Configuring Kafka MirrorMaker

使用 KafkaMirrorMaker 资源的属性来配置 Kafka MirrorMaker 部署。

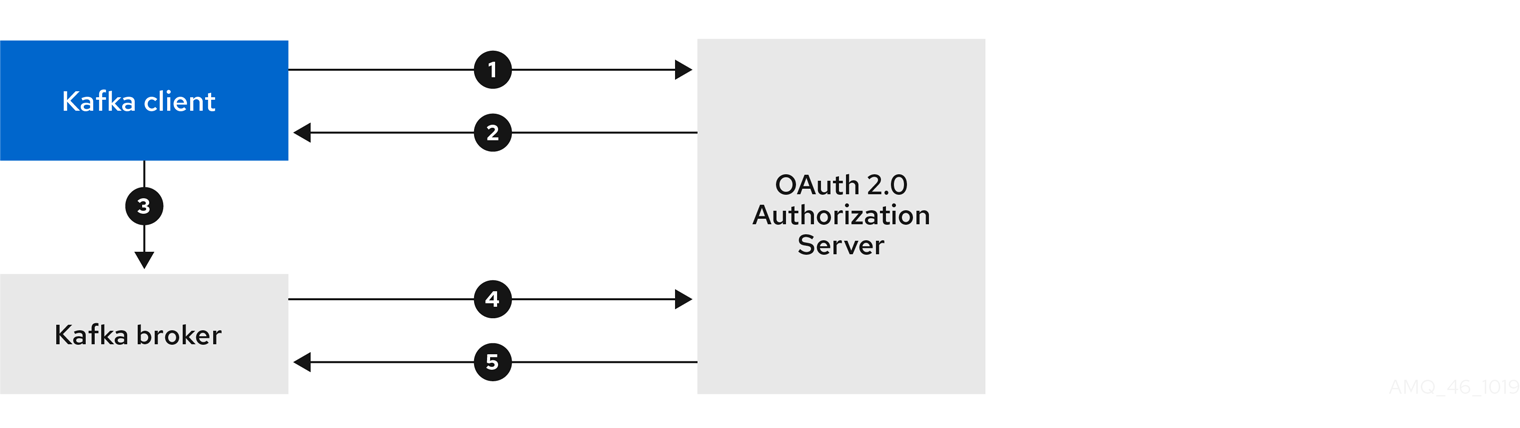

您可以使用 TLS 或 SASL 身份验证为生产者和使用者配置访问控制。此流程演示了在使用者和制作者侧使用 TLS 加密和身份验证的配置。

先决条件

有关运行 以下的说明,请参阅 OpenShift 指南中的部署和升级 AMQ Streams :

- 源和目标 Kafka 集群必须可用

流程

编辑

KafkaMirrorMaker资源的spec属性。您可以配置的属性显示在此示例配置中:

apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaMirrorMaker metadata: name: my-mirror-maker spec: replicas: 3 1 consumer: bootstrapServers: my-source-cluster-kafka-bootstrap:9092 2 groupId: "my-group" 3 numStreams: 2 4 offsetCommitInterval: 120000 5 tls: 6 trustedCertificates: - secretName: my-source-cluster-ca-cert certificate: ca.crt authentication: 7 type: tls certificateAndKey: secretName: my-source-secret certificate: public.crt key: private.key config: 8 max.poll.records: 100 receive.buffer.bytes: 32768 ssl.cipher.suites: "TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384" 9 ssl.enabled.protocols: "TLSv1.2" ssl.protocol: "TLSv1.2" ssl.endpoint.identification.algorithm: HTTPS 10 producer: bootstrapServers: my-target-cluster-kafka-bootstrap:9092 abortOnSendFailure: false 11 tls: trustedCertificates: - secretName: my-target-cluster-ca-cert certificate: ca.crt authentication: type: tls certificateAndKey: secretName: my-target-secret certificate: public.crt key: private.key config: compression.type: gzip batch.size: 8192 ssl.cipher.suites: "TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384" 12 ssl.enabled.protocols: "TLSv1.2" ssl.protocol: "TLSv1.2" ssl.endpoint.identification.algorithm: HTTPS 13 include: "my-topic|other-topic" 14 resources: 15 requests: cpu: "1" memory: 2Gi limits: cpu: "2" memory: 2Gi logging: 16 type: inline loggers: mirrormaker.root.logger: "INFO" readinessProbe: 17 initialDelaySeconds: 15 timeoutSeconds: 5 livenessProbe: initialDelaySeconds: 15 timeoutSeconds: 5 metricsConfig: 18 type: jmxPrometheusExporter valueFrom: configMapKeyRef: name: my-config-map key: my-key jvmOptions: 19 "-Xmx": "1g" "-Xms": "1g" image: my-org/my-image:latest 20 template: 21 pod: affinity: podAntiAffinity: requiredDuringSchedulingIgnoredDuringExecution: - labelSelector: matchExpressions: - key: application operator: In values: - postgresql - mongodb topologyKey: "kubernetes.io/hostname" connectContainer: 22 env: - name: JAEGER_SERVICE_NAME value: my-jaeger-service - name: JAEGER_AGENT_HOST value: jaeger-agent-name - name: JAEGER_AGENT_PORT value: "6831" tracing: 23 type: jaeger

- 1

- 2

- 为 使用者和生产者引导服务器.

- 3

- 4

- 5

- 6

- 使用密钥名称进行 TLS 加密,其中 TLS 证书存储在 X.509 格式供使用者或生产者使用。如果证书存储在同一个 secret 中,则可以多次列出证书。

- 7

- 8

- 9

- 使用特定 密码套件 为 TLS 版本运行外部侦听器的 SSL 属性。

- 10

- 通过将 设置为

HTTPS来 启用主机名验证。空字符串将禁用验证。 - 11

- 如果 abort

OnSendFailure属性 设为true,则 Kafka MirrorMaker 将退出,容器将在发送失败消息后重启。 - 12

- 使用特定 密码套件 为 TLS 版本运行外部侦听器的 SSL 属性。

- 13

- 通过将 设置为

HTTPS来 启用主机名验证。空字符串将禁用验证。 - 14

- 包括的主题 (从源镜像到目标 Kafka 集群)。

- 15

- 16

- 指定日志记录器和日志级别 通过 ConfigMap 直接(

内联)或间接(外部)添加。自定义 ConfigMap 必须放在log4j.properties 或log4j2.properties键下。MirrorMaker 有一个名为mirrormaker.root.logger的日志记录器。您可以将日志级别设置为 INFO、ERROR、WARN、TRACE、DEBUG、FATAL 或 OFF。 - 17

- 健康检查以了解 何时重新启动容器(存活度)以及容器何时可以接受流量(就绪度)。

- 18

- Prometheus metrics,通过引用包含本例中 Prometheus JMX 导出器配置的 ConfigMap 来启用它。您可以使用对包含

metricsConfig.valueFrom.configMapKeyRef.key下的空文件的 ConfigMap 的引用来启用指标,而无需进一步配置。 - 19

- 用于优化运行 Kafka MirrorMaker 的虚拟机(VM)性能的 JVM 配置选项。

- 20

- ADVANCED OPTION: 容器镜像配置,只在特殊情况下推荐这样做。

- 21

- 模板自定义.在这里,pod 被调度为反关联性,因此 pod 不会调度到具有相同主机名的节点。

- 22

- 还 使用 Jaeger 为分布式追踪设置 环境变量。

- 23

警告将 abort

OnSendFailure属性设置为false时,制作者会尝试发送主题中的下一个消息。原始消息可能会丢失,因为没有尝试重新发送失败的消息。创建或更新资源:

oc apply -f <your-file>

2.3.2. Kafka MirrorMaker 集群资源列表

以下资源由 OpenShift 集群中的 Cluster Operator 创建:

- <mirror-maker-name>-mirror-maker

- 负责创建 Kafka MirrorMaker pod 的部署。

- <mirror-maker-name>-config

- 包含 Kafka MirrorMaker 的辅助配置的 ConfigMap,并由 Kafka 代理 Pod 挂载为卷。

- <mirror-maker-name>-mirror-maker

- 为 Kafka MirrorMaker worker 节点配置的 Pod Disruption Budget。

2.4. Kafka MirrorMaker 2.0 集群配置

本节论述了如何在 AMQ Streams 集群中配置 Kafka MirrorMaker 2.0 部署。

MirrorMaker 2.0 用于在数据中心内或之间的两个或多个活跃 Kafka 集群之间复制数据。

集群间的数据复制支持以下条件:

- 发生系统故障时恢复数据

- 聚合数据以进行分析

- 对特定集群的数据访问的限制

- 在特定位置置备数据以缩短延迟

如果使用 MirrorMaker 2.0,您需要配置 KafkaMirrorMaker2 资源。

MirrorMaker 2.0 引入了一种全新的在集群间复制数据的方法。

因此,资源配置与以前的 MirrorMaker 版本不同。如果您选择使用 MirrorMaker 2.0,当前没有传统支持,因此任何资源都必须手动转换为新格式。

MirrorMaker 2.0 复制数据的方式如下:

以下流程演示了如何为 MirrorMaker 2.0 配置资源:

KafkaMirrorMaker2 资源的完整 schema 包括在 KafkaMirrorMaker2 架构引用 中。

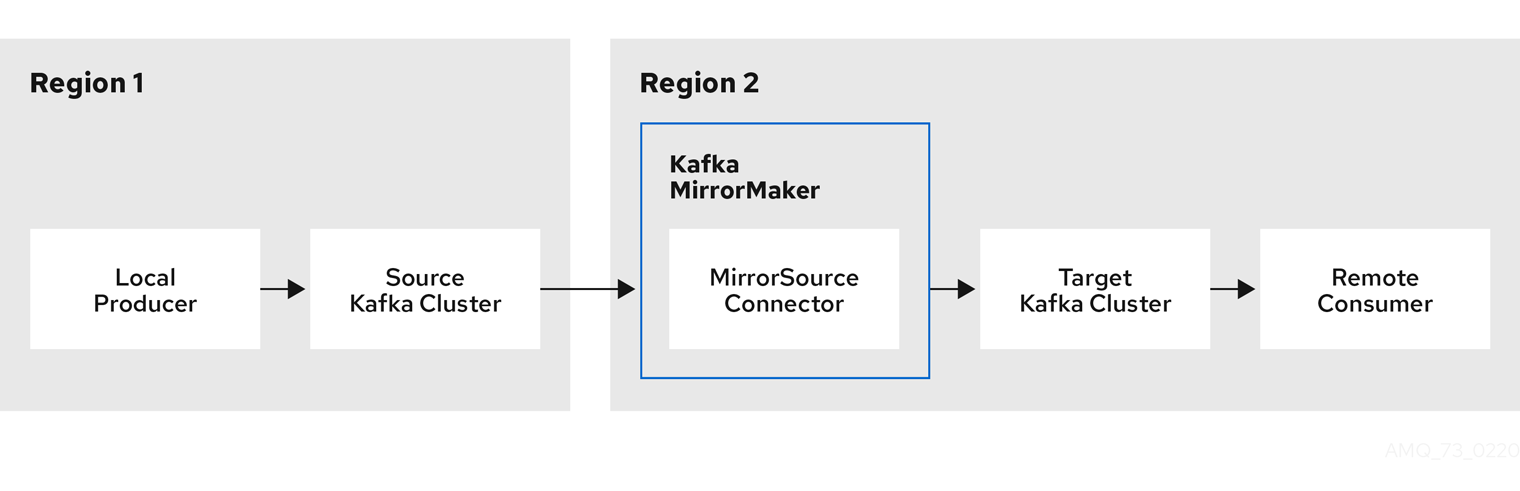

2.4.1. MirrorMaker 2.0 数据复制

MirrorMaker 2.0 使用源 Kafka 集群的信息,并将其写入目标 Kafka 集群。

MirrorMaker 2.0 使用:

- 源集群配置以使用源集群的数据

- 将数据输出到目标集群的目标集群配置

MirrorMaker 2.0 基于 Kafka Connect 框架,即管理集群间数据传输的 连接器。MirrorMaker 2.0 MirrorSourceConnector 将主题从源集群复制到目标集群。

将数据从一个集群 镜像 到另一个集群的过程是异步的。建议的模式是让信息与源 Kafka 集群一起生成,然后远程使用与目标 Kafka 集群类似的信息。

MirrorMaker 2.0 可以用于多个源集群。

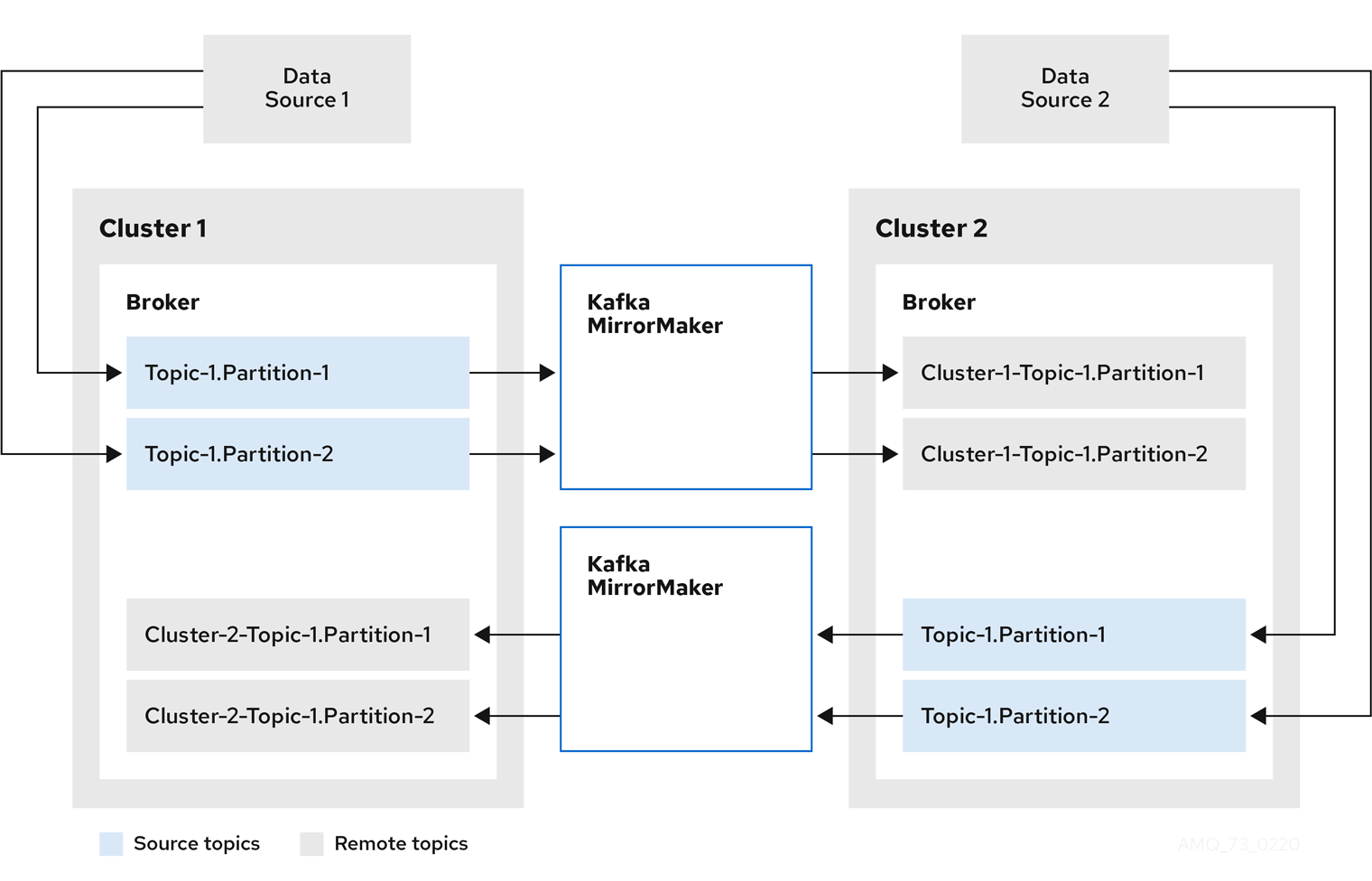

图 2.1. 在两个集群间复制

默认情况下,每 10 分钟检查源集群中的新主题。您可以通过在源连接器配置中添加 refresh.topics.interval.seconds 来更改频率。但是,增加操作的频率可能会影响整体性能。

2.4.2. 集群配置

您可以在 主动/ 被动或主动/主动 集群配置中使用 MirrorMaker 2.0。

- 在 主动/主动 配置中,两个集群都处于活动状态并同时提供相同的数据,如果您想在不同的地理位置在本地提供相同的数据,这很有用。

- 在 主动/被动 配置中,来自主动/被动群集的数据复制到被动群集中,该群集仍处于备用状态,例如,在发生系统故障时进行数据恢复。

预计生产者和消费者只能连接到活跃的集群。

每个目标目的地都需要一个 MirrorMaker 2.0 集群。

2.4.2.1. 双向复制(主动/主动)

MirrorMaker 2.0 架构支持 主动/主动 集群配置中的双向复制。

每个集群使用 源 和远程 主题的概念复制其他集群的数据。由于每个集群中存储了相同的主题,因此 MirrorMaker 2.0 会自动重命名远程主题来代表源集群。原始集群的名称前面是主题名称的前面。

图 2.2. 主题重命名

通过标记原始集群,主题不会复制到该集群中。

在配置需要数据聚合的架构时,通过 远程 主题复制的概念非常有用。消费者可以订阅同一群集内的源和远程主题,无需单独的聚合集群。

2.4.2.2. 单向复制(主动/被动)

MirrorMaker 2.0 架构支持 主动/被动 集群配置中的单向复制。

您可以使用 主动/被动 集群配置进行备份,或将数据迁移到另一个集群。在这种情况下,您可能不希望自动重命名远程主题。

您可以通过在源连接器配置中添加 IdentityReplicationPolicy 来覆盖自动重命名。应用此配置后,主题会保留其原始名称。

2.4.2.3. 主题配置同步

主题配置会在源集群和目标集群之间自动同步。通过同步配置属性,可以减少重新平衡的需求。

2.4.2.4. 数据完整性

MirrorMaker 2.0 监控源主题,并将配置更改传播到远程主题,检查并创建缺少的分区。只有 MirrorMaker 2.0 可以写入远程主题。

2.4.2.5. 偏移跟踪

MirrorMaker 2.0 使用 内部主题 跟踪消费者组的偏移量。

- 偏移同步 主题映射从记录元数据中复制主题分区的来源和目标偏移

- checkpoint 主题映射源和目标集群中为各个消费者组中复制主题分区的最后提交偏移

检查点 主题的偏移会通过配置预先确定的时间间隔进行跟踪。这两个主题都允许从故障转移上的正确偏移位置完全恢复复制。

MirrorMaker 2.0 使用其 MirrorCheckpointConnector 来发送 检查点 以进行偏移。

2.4.2.6. 同步消费者组偏移

__consumer_offsets 主题存储关于每个消费者组已提交的偏移的信息。偏移同步定期将源集群使用者组的使用者偏移量传输到目标集群的使用者偏移主题。

偏移同步在 主动/被动 配置中特别有用。如果活跃集群停机,使用者应用可以切换到被动(standby)集群,并从最近传输的偏移位置获取。

使用主题偏移同步:

-

通过将 sync.

group.offsets.enabled 添加到 checkpoint 连接器配置来启用同步,并将 属性设置为true。默认情况下禁用同步。 -

将

IdentityReplicationPolicy添加到源和检查点连接器配置中,以便目标集群中的主题保留其原始名称。

要进行主题偏移同步,目标集群中的消费者组无法使用与源集群中的组相同的 id。

如果启用,则定期与源集群进行偏移同步。您可以通过将 sync. group.offsets.interval.seconds 和 emit.checkpoints.interval.seconds 添加到 checkpoint 连接器配置来更改频率。属性指定消费者组偏移同步的频率(以秒为单位),以及发出用于偏移跟踪的检查点频率。两个属性的默认值都是 60 秒。您还可以使用 refresh. groups.interval.seconds 属性更改新使用者 组的检查频率,默认为每 10 分钟执行一次。

由于同步是基于时间的,因此使用者到被动群集的任何切换都可能会导致消息出现某种重复。

2.4.2.7. 连接检查

一个 心跳 的内部主题检查集群之间的连通性。

heartbeat 主题从源集群中复制。

目标集群使用该主题检查:

- 集群之间的连接器正在运行

- 源集群可用

MirrorMaker 2.0 使用其 MirrorHeartbeatConnector 发送执行这些检查 的心跳。

2.4.3. ACL 规则同步

如果没有 使用 User Operator,则可以获得对远程主题的 ACL 访问权限。

如果使用 AclAuthorizer( 没有 User Operator),则管理对代理访问权限的 ACL 规则也适用于远程主题。能够读取源主题的用户可以读取其远程等效内容。

OAuth 2.0 授权不支持以这种方式访问远程主题。

2.4.4. 使用 MirrorMaker 2.0 在 Kafka 集群间同步数据

使用 MirrorMaker 2.0 通过配置同步 Kafka 集群之间的数据。

配置必须指定:

- 每个 Kafka 集群

- 每个集群的连接信息,包括 TLS 身份验证

复制流和方向

- 集群到集群

- 主题

使用 KafkaMirrorMaker2 资源的属性来配置 Kafka MirrorMaker 2.0 部署。

以前版本的 MirrorMaker 继续受到支持。如果要使用为之前版本配置的资源,则必须将其更新为 MirrorMaker 2.0 所支持的格式。

MirrorMaker 2.0 为复制因素等属性提供默认配置值。最小配置(默认值保持不变)会类似如下:

apiVersion: kafka.strimzi.io/v1beta2

kind: KafkaMirrorMaker2

metadata:

name: my-mirror-maker2

spec:

version: 2.8.0

connectCluster: "my-cluster-target"

clusters:

- alias: "my-cluster-source"

bootstrapServers: my-cluster-source-kafka-bootstrap:9092

- alias: "my-cluster-target"

bootstrapServers: my-cluster-target-kafka-bootstrap:9092

mirrors:

- sourceCluster: "my-cluster-source"

targetCluster: "my-cluster-target"

sourceConnector: {}您可以使用 TLS 或 SASL 身份验证为源和目标集群配置访问控制。此流程显示为源和目标集群使用 TLS 加密和身份验证的配置。

先决条件

有关运行 以下的说明,请参阅 OpenShift 指南中的部署和升级 AMQ Streams :

- 源和目标 Kafka 集群必须可用

流程

编辑

KafkaMirrorMaker2资源的spec属性。您可以配置的属性显示在此示例配置中:

apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaMirrorMaker2 metadata: name: my-mirror-maker2 spec: version: 2.8.0 1 replicas: 3 2 connectCluster: "my-cluster-target" 3 clusters: 4 - alias: "my-cluster-source" 5 authentication: 6 certificateAndKey: certificate: source.crt key: source.key secretName: my-user-source type: tls bootstrapServers: my-cluster-source-kafka-bootstrap:9092 7 tls: 8 trustedCertificates: - certificate: ca.crt secretName: my-cluster-source-cluster-ca-cert - alias: "my-cluster-target" 9 authentication: 10 certificateAndKey: certificate: target.crt key: target.key secretName: my-user-target type: tls bootstrapServers: my-cluster-target-kafka-bootstrap:9092 11 config: 12 config.storage.replication.factor: 1 offset.storage.replication.factor: 1 status.storage.replication.factor: 1 ssl.cipher.suites: "TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384" 13 ssl.enabled.protocols: "TLSv1.2" ssl.protocol: "TLSv1.2" ssl.endpoint.identification.algorithm: HTTPS 14 tls: 15 trustedCertificates: - certificate: ca.crt secretName: my-cluster-target-cluster-ca-cert mirrors: 16 - sourceCluster: "my-cluster-source" 17 targetCluster: "my-cluster-target" 18 sourceConnector: 19 tasksMax: 10 20 config: replication.factor: 1 21 offset-syncs.topic.replication.factor: 1 22 sync.topic.acls.enabled: "false" 23 refresh.topics.interval.seconds: 60 24 replication.policy.separator: "" 25 replication.policy.class: "io.strimzi.kafka.connect.mirror.IdentityReplicationPolicy" 26 heartbeatConnector: 27 config: heartbeats.topic.replication.factor: 1 28 checkpointConnector: 29 config: checkpoints.topic.replication.factor: 1 30 refresh.groups.interval.seconds: 600 31 sync.group.offsets.enabled: true 32 sync.group.offsets.interval.seconds: 60 33 emit.checkpoints.interval.seconds: 60 34 replication.policy.class: "io.strimzi.kafka.connect.mirror.IdentityReplicationPolicy" topicsPattern: ".*" 35 groupsPattern: "group1|group2|group3" 36 resources: 37 requests: cpu: "1" memory: 2Gi limits: cpu: "2" memory: 2Gi logging: 38 type: inline loggers: connect.root.logger.level: "INFO" readinessProbe: 39 initialDelaySeconds: 15 timeoutSeconds: 5 livenessProbe: initialDelaySeconds: 15 timeoutSeconds: 5 jvmOptions: 40 "-Xmx": "1g" "-Xms": "1g" image: my-org/my-image:latest 41 template: 42 pod: affinity: podAntiAffinity: requiredDuringSchedulingIgnoredDuringExecution: - labelSelector: matchExpressions: - key: application operator: In values: - postgresql - mongodb topologyKey: "kubernetes.io/hostname" connectContainer: 43 env: - name: JAEGER_SERVICE_NAME value: my-jaeger-service - name: JAEGER_AGENT_HOST value: jaeger-agent-name - name: JAEGER_AGENT_PORT value: "6831" tracing: type: jaeger 44 externalConfiguration: 45 env: - name: AWS_ACCESS_KEY_ID valueFrom: secretKeyRef: name: aws-creds key: awsAccessKey - name: AWS_SECRET_ACCESS_KEY valueFrom: secretKeyRef: name: aws-creds key: awsSecretAccessKey

- 1

- Kafka Connect 和 Mirror Maker 2.0 版本,版本 将始终相同。

- 2

- 3

- Kafka Connect 的 Kafka 集群别名,它必须指定 目标 Kafka 集群。Kafka 集群由 Kafka Connect 用于其内部主题。

- 4

- 正在同步 的 Kafka 集群的规格。

- 5

- 源 Kafka 集群的集群 别名。

- 6

- 7

- 8

- 使用源 Kafka 集群的 TLS 证书以 X.509 格式存储的密钥名称进行 TLS 加密。如果证书存储在同一个 secret 中,则可以多次列出证书。

- 9

- 目标 Kafka 集群的集群 别名。

- 10

- 目标 Kafka 集群的身份验证的配置方式与源 Kafka 集群相同。

- 11

- 12

- Kafka Connect 配置.标准 Apache Kafka 配置可能会提供,仅限于不是由 AMQ Streams 直接管理的属性。

- 13

- 使用特定 密码套件 为 TLS 版本运行外部侦听器的 SSL 属性。

- 14

- 通过将 设置为

HTTPS来 启用主机名验证。空字符串将禁用验证。 - 15

- 目标 Kafka 集群的 TLS 加密配置方式与源 Kafka 集群相同。

- 16

- 17

- MirrorMaker 2.0 连接器使用的源集群的集群 别名。

- 18

- MirrorMaker 2.0 连接器使用的目标集群的集群 别名。

- 19

- 创建远程主题的

MirrorSourceConnector配置。配置会覆盖默认配置选项。 - 20

- 连接器可以创建的任务数量上限。任务处理数据复制,并并行运行。如果基础架构支持处理开销,增加这个值可以提高吞吐量。Kafka Connect 在集群成员之间分发任务。如果任务数量超过工作程序,则为工作程序分配多项任务。对于接收器连接器,旨在为每个主题分区使用一个任务。对于源连接器,可以并行运行的任务数量也可能取决于外部系统。如果无法实现并行性,连接器会创建少于任务的最大数量。

- 21

- 在目标集群中创建的已镜像主题的复制因素。

- 22

MirrorSourceConnectoroffset-syncs内部主题的复制因素,用于映射源和目标集群的偏移。- 23

- 启用 ACL 规则同步 时,将应用 ACL 来同步主题。默认值为

true。 - 24

- 可选设置,可更改新主题的检查频率。默认为每 10 分钟检查一次。

- 25

- 定义用于重命名远程主题的分隔符。

- 26

- 添加可覆盖远程主题自动重命名的策略。该主题不会用源集群的名称来附加名称,而是保留其原始名称。此可选设置对主动/被动备份和数据迁移很有用。要配置主题偏移同步,还必须为

checkpointConnector.config设置此属性。 - 27

- 执行连接检查

的 MirrorHeartbeatConnector配置。配置会覆盖默认配置选项。 - 28

- 在目标集群中创建的心跳主题的复制因素。

- 29

- 跟踪偏移的

MirrorCheckpointConnector配置。配置会覆盖默认配置选项。 - 30

- 在目标集群中创建的检查点主题的复制因素。

- 31

- 可选设置,以更改新使用者组的检查频率。默认为每 10 分钟检查一次。

- 32

- 可选设置来同步消费者组偏移,这对于主动/被动配置中的恢复非常有用。默认情况下不启用同步。

- 33

- 如果启用了消费者组偏移的同步,您可以调整同步的频率。

- 34

- 调整检查偏移跟踪的频率。如果更改了偏移同步的频率,您可能还需要调整这些检查的频率。

- 35

- 从 定义为正则表达式模式的 源集群进行主题复制。这里我们请求所有主题。

- 36

- 来自 定义为正则表达式模式的 源集群的使用者组复制。在这里,我们按名称请求三个消费者组。您可以使用逗号分隔的列表。

- 37

- 38

- 指定 Kafka 连接日志记录器和日志级别 直接(

内联)或通过ConfigMap 间接(外部)添加。自定义 ConfigMap 必须放在log4j.properties 或log4j2.properties键下。对于 Kafka Connectlog4j.rootLogger日志记录器,您可以将日志级别设置为 INFO、ERROR、WARN、TRACE、DEBUG、FATAL 或 OFF。 - 39

- 健康检查以了解 何时重新启动容器(存活度)以及容器何时可以接受流量(就绪度)。

- 40

- 用于优化运行 Kafka MirrorMaker 的虚拟机(VM)性能的 JVM 配置选项。

- 41

- ADVANCED OPTION: 容器镜像配置,只在特殊情况下推荐这样做。

- 42

- 模板自定义.在这里,pod 被调度为反关联性,因此 pod 不会调度到具有相同主机名的节点。

- 43

- 还 使用 Jaeger 为分布式追踪设置 环境变量。

- 44

- 45

创建或更新资源:

oc apply -f MIRRORMAKER-CONFIGURATION-FILE

2.4.5. 执行 Kafka MirrorMaker 2.0 连接器重启

此流程描述了如何使用 OpenShift 注解手动触发 Kafka MirrorMaker 2.0 连接器重启。

先决条件

- Cluster Operator 正在运行。

流程

查找控制您要重启的

Kafka MirrorMaker 2.0 连接器的 KafkaMirrorMaker2自定义资源的名称:oc get KafkaMirrorMaker2

从 Kafka

MirrorMaker2 自定义资源中找到要重启的 Kafka MirrorMaker2.0 连接器的名称。oc describe KafkaMirrorMaker2 KAFKAMIRRORMAKER-2-NAME要重启连接器,请注解

OpenShift 中的 KafkaMirrorMaker2资源。在本例中,oc annotate会重启名为my-source->my-target.MirrorSourceConnector的连接器:oc annotate KafkaMirrorMaker2 KAFKAMIRRORMAKER-2-NAME "strimzi.io/restart-connector=my-source->my-target.MirrorSourceConnector"等待下一次协调发生(默认为每隔两分钟)。

Kafka MirrorMaker 2.0 连接器重启,只要协调过程检测到注解。当重启请求被接受时,该注解会从

KafkaMirrorMaker2自定义资源中删除。

2.4.6. 执行 Kafka MirrorMaker 2.0 连接器任务重启

此流程描述了如何使用 OpenShift 注解手动触发 Kafka MirrorMaker 2.0 连接器任务的重启。

先决条件

- Cluster Operator 正在运行。

流程

查找控制您要重启的

Kafka MirrorMaker 2.0 连接器的 KafkaMirrorMaker2自定义资源的名称:oc get KafkaMirrorMaker2

查找 Kafka MirrorMaker 2.0 连接器的名称,以及从

KafkaMirrorMaker2自定义资源重启的任务 ID。任务 ID 是非负整数,从 0 开始。oc describe KafkaMirrorMaker2 KAFKAMIRRORMAKER-2-NAME要重启连接器任务,请注解

OpenShift 中的 KafkaMirrorMaker2资源。在本例中,oc annotate restartstask 0 of a connector ofmy-source->my-target.MirrorSourceConnector:oc annotate KafkaMirrorMaker2 KAFKAMIRRORMAKER-2-NAME "strimzi.io/restart-connector-task=my-source->my-target.MirrorSourceConnector:0"等待下一次协调发生(默认为每隔两分钟)。

Kafka MirrorMaker 2.0 连接器任务重启,只要协调过程检测到注解。当重启任务请求被接受时,注解会从

KafkaMirrorMaker2自定义资源中删除。

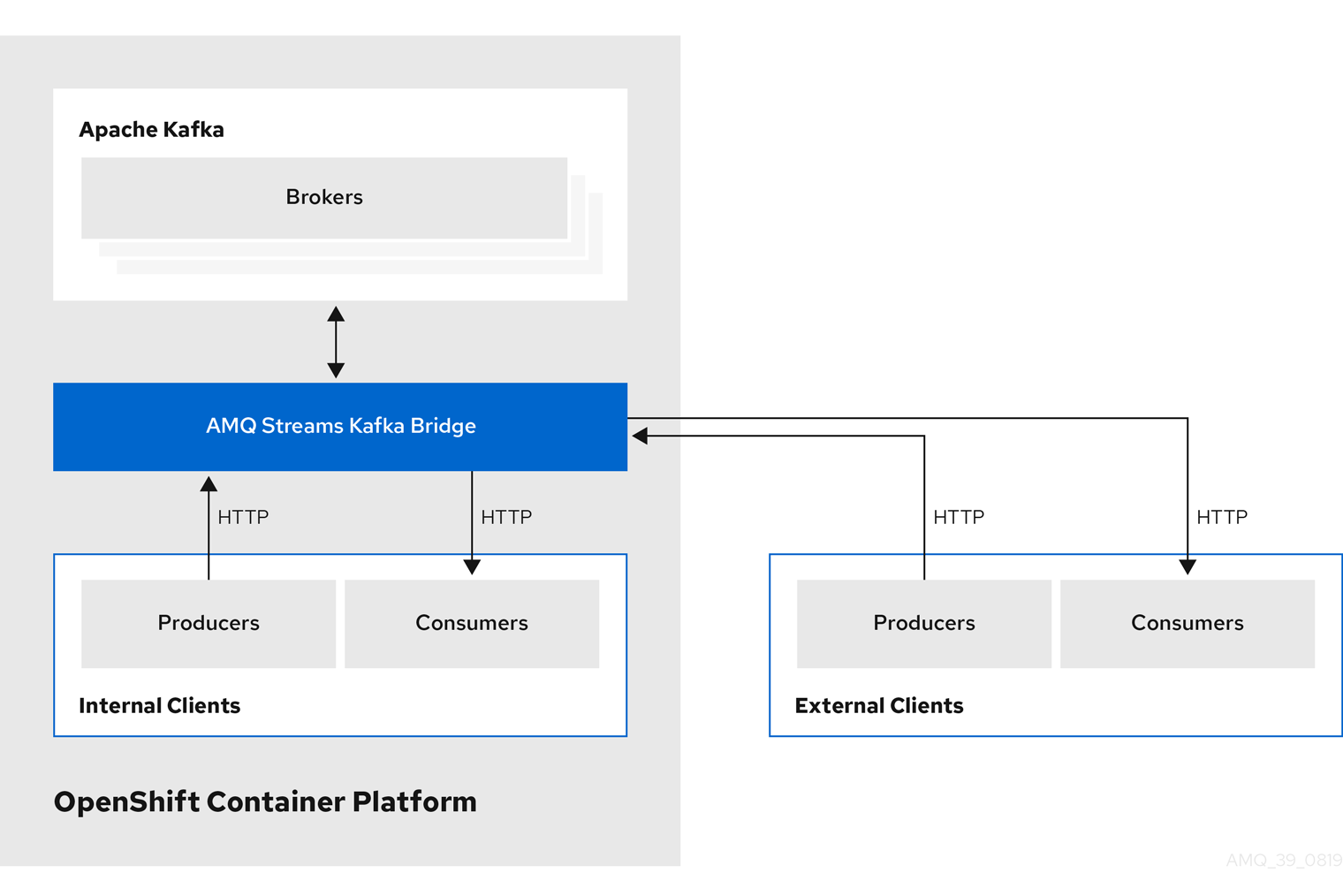

2.5. Kafka Bridge 集群配置

本节论述了如何在 AMQ Streams 集群中配置 Kafka Bridge 部署。

Kafka Bridge 为将基于 HTTP 的客户端与 Kafka 集群集成提供了一个 API。

如果使用 Kafka Bridge,您可以配置 KafkaBridge 资源。

KafkaBridge 资源的完整 schema 信息包括在 第 13.2.110 节 “KafkaBridge 模式参考” 中。

2.5.1. 配置 Kafka 网桥

使用 Kafka Bridge 向 Kafka 集群发出基于 HTTP 的请求。

使用 KafkaBridge 资源的属性来配置 Kafka Bridge 部署。

为了防止不同 Kafka 网桥实例处理客户端消费者请求时出现问题,必须使用基于地址的路由来确保请求路由到正确的 Kafka Bridge 实例。另外,每个独立的 Kafka Bridge 实例都必须有一个副本。Kafka Bridge 实例具有自己的状态,不与其他实例共享。

先决条件

- OpenShift 集群

- 一个正在运行的 Cluster Operator

有关运行 以下的说明,请参阅 OpenShift 指南中的部署和升级 AMQ Streams :

流程

编辑

KafkaBridge资源的spec属性。您可以配置的属性显示在此示例配置中:

apiVersion: kafka.strimzi.io/v1beta2 kind: KafkaBridge metadata: name: my-bridge spec: replicas: 3 1 bootstrapServers: my-cluster-kafka-bootstrap:9092 2 tls: 3 trustedCertificates: - secretName: my-cluster-cluster-cert certificate: ca.crt - secretName: my-cluster-cluster-cert certificate: ca2.crt authentication: 4 type: tls certificateAndKey: secretName: my-secret certificate: public.crt key: private.key http: 5 port: 8080 cors: 6 allowedOrigins: "https://strimzi.io" allowedMethods: "GET,POST,PUT,DELETE,OPTIONS,PATCH" consumer: 7 config: auto.offset.reset: earliest producer: 8 config: delivery.timeout.ms: 300000 resources: 9 requests: cpu: "1" memory: 2Gi limits: cpu: "2" memory: 2Gi logging: 10 type: inline loggers: logger.bridge.level: "INFO" # enabling DEBUG just for send operation logger.send.name: "http.openapi.operation.send" logger.send.level: "DEBUG" jvmOptions: 11 "-Xmx": "1g" "-Xms": "1g" readinessProbe: 12 initialDelaySeconds: 15 timeoutSeconds: 5 livenessProbe: initialDelaySeconds: 15 timeoutSeconds: 5 image: my-org/my-image:latest 13 template: 14 pod: affinity: podAntiAffinity: requiredDuringSchedulingIgnoredDuringExecution: - labelSelector: matchExpressions: - key: application operator: In values: - postgresql - mongodb topologyKey: "kubernetes.io/hostname" bridgeContainer: 15 env: - name: JAEGER_SERVICE_NAME value: my-jaeger-service - name: JAEGER_AGENT_HOST value: jaeger-agent-name - name: JAEGER_AGENT_PORT value: "6831"

- 1

- 2

- 3

- 使用源 Kafka 集群的 TLS 证书以 X.509 格式存储的密钥名称进行 TLS 加密。如果证书存储在同一个 secret 中,则可以多次列出证书。

- 4

- Kafka Bridge 集群的身份验证,使用 TLS 机制 (此处所示)、使用 OAuth bearer 令牌 或基于 SASL 的 SCRAM-SHA-512 或 PLAIN 机制。默认情况下,Kafka Bridge 在不进行身份验证的情况下连接到 Kafka 代理。

- 5

- 对 Kafka 代理的 HTTP 访问.

- 6

- CORS 访问 指定选定的资源和访问方法.请求中的附加 HTTP 标头描述了允许访问 Kafka 集群的原始数据。

- 7

- 8

- 9

- 10

- 指定 Kafka Bridge 日志记录器和日志级别 直接(

内联)或通过ConfigMap 间接(外部)添加。自定义 ConfigMap 必须放在log4j.properties 或log4j2.properties键下。对于 Kafka Bridge loggers,您可以将日志级别设置为 INFO、ERROR、WARN、TRACE、DEBUG、FATAL 或 OFF。 - 11

- 运行 Kafka 网桥的虚拟机(VM)的 JVM 配置选项 优化性能。

- 12

- 健康检查以了解 何时重新启动容器(存活度)以及容器何时可以接受流量(就绪度)。

- 13

- ADVANCED OPTION: 容器镜像配置,只在特殊情况下推荐这样做。

- 14

- 模板自定义.在这里,pod 被调度为反关联性,因此 pod 不会调度到具有相同主机名的节点。

- 15

- 还 使用 Jaeger 为分布式追踪设置 环境变量。

创建或更新资源:

oc apply -f KAFKA-BRIDGE-CONFIG-FILE

2.5.2. Kafka Bridge 集群资源列表

以下资源由 OpenShift 集群中的 Cluster Operator 创建:

- bridge-cluster-name-bridge

- 部署,用于创建 Kafka Bridge worker 节点 pod。

- bridge-cluster-name-bridge-service

- 公开 Kafka Bridge 集群的 REST 接口的服务。

- bridge-cluster-name-bridge-config

- 包含 Kafka Bridge 辅助配置且由 Kafka 代理 Pod 挂载为卷的 ConfigMap。

- bridge-cluster-name-bridge

- 为 Kafka Bridge worker 节点配置的 Pod Disruption Budget。

2.6. 自定义 OpenShift 资源

AMQ Streams 创建几个 OpenShift 资源,如 Deployment、StatefulSet、 Pod 和 Services,它们由 AMQ Streams 操作器管理。只有负责管理特定 OpenShift 资源的操作器才能更改该资源。如果您尝试手动更改由 operator 管理的 OpenShift 资源,Operator 会将您的更改还原。

但是,更改由 Operator 管理的 OpenShift 资源对于执行某些任务很有用,例如:

-

添加控制 Istio 或其他服务如何处理

Pod的自定义标签或注解 -

管理集群如何创建

Loadbalancer-type Services

您可以使用 AMQ Streams 自定义资源中的 template 属性进行此类更改。template 属性在以下资源中受到支持:API 引用提供了有关可自定义字段的更多详情。

Kafka.spec.kafka-

请查看 第 13.2.32 节 “

KafkaClusterTemplate模式参考” Kafka.spec.zookeeper-

请查看 第 13.2.43 节 “

ZookeeperClusterTemplateschema reference” Kafka.spec.entityOperator-

请查看 第 13.2.48 节 “

EntityOperatorTemplate模式参考” Kafka.spec.kafkaExporter-

请查看 第 13.2.54 节 “

KafkaExporterTemplate模式参考” Kafka.spec.cruiseControl-

请查看 第 13.2.51 节 “

CruiseControlTemplate模式参考” KafkaConnect.spec-

请查看 第 13.2.68 节 “

KafkaConnectTemplate模式参考” KafkaConnectS2I.spec-

请查看 第 13.2.68 节 “

KafkaConnectTemplate模式参考” KafkaMirrorMaker.spec-

请查看 第 13.2.108 节 “

KafkaMirrorMakerTemplate模式参考” KafkaMirrorMaker2.spec-

请查看 第 13.2.68 节 “

KafkaConnectTemplate模式参考” KafkaBridge.spec-

请查看 第 13.2.118 节 “

KafkaBridgeTemplate模式引用” KafkaUser.spec-

请查看 第 13.2.101 节 “

KafkaUserTemplate模式参考”

在以下示例中,使用 template 属性来修改 Kafka 代理的 StatefulSet 中的标签:

模板自定义示例

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: my-cluster

labels:

app: my-cluster

spec:

kafka:

# ...

template:

statefulset:

metadata:

labels:

mylabel: myvalue

# ...

2.6.1. 自定义镜像拉取策略

AMQ Streams 允许您自定义 Cluster Operator 部署的所有 pod 中容器的镜像拉取策略。镜像拉取策略使用 Cluster Operator 部署中的环境变量 STRIMZI_IMAGE_PULL_POLICY 进行配置。STRIMZI_IMAGE_PULL_POLICY 环境变量可设置为三个不同的值:

Always- 每次 pod 启动或重启时,都会从注册表调取容器镜像。