관리 가이드

Red Hat Virtualization의 관리 작업

초록

1장. Red Hat Virtualization 환경 관리 및 유지 관리

Red Hat Virtualization 환경에서는 관리자가 계속 실행되도록 해야 합니다. 관리자는 다음과 같은 작업을 수행합니다.

- 호스트 및 가상 시스템 등의 물리적 리소스와 가상 리소스 관리. 여기에는 호스트 업그레이드 및 추가, 도메인 가져오기, 외부 하이퍼바이저에서 생성된 가상 시스템 변환, 가상 시스템 풀 관리 등이 포함됩니다.

- 호스트 중 하나에서 극심한 부하, 메모리 또는 디스크 공간이 부족하고 필요한 작업을 수행하는 등의 잠재적 문제에 대해 전체 시스템 리소스를 모니터링합니다(예: 시스템을 종료하여 가상 시스템을 다른 호스트로 마이그레이션하여 부하를 줄이거나 리소스를 확보하는 등).

- 가상 시스템의 새로운 요구 사항에 대응(예: 운영 체제 업그레이드 또는 메모리 할당).

- 태그를 사용하여 사용자 지정된 오브젝트 속성 관리.

- 공개 북마크 로 저장된 검색 관리.

- 사용자 설정 및 권한 수준 설정 관리.

- 전체 시스템 기능을 위한 특정 사용자 또는 가상 시스템의 문제 해결.

- 일반 및 특정 보고서 생성.

1.1. 글로벌 설정

Administration(관리) Configure( 구성 ) 창을 클릭하여 액세스하면 사용자, 역할, 시스템 권한, 스케줄링 정책, 인스턴스 유형 및 MAC 주소 풀과 같은 Red Hat Virtualization 환경에 대한 여러 글로벌 리소스를 구성할 수 있습니다. 이 창을 사용하면 사용자가 환경의 리소스와 상호 작용하는 방법을 사용자 지정하고 여러 클러스터에 적용할 수 있는 옵션을 구성하는 중앙 위치를 제공합니다.

1.1.1. 역할

역할은 Red Hat Virtualization Manager에서 구성할 수 있는 사전 정의된 권한 세트입니다. 역할은 데이터 센터의 다양한 리소스 수준과 특정 실제 및 가상 리소스에 대한 액세스 및 관리 권한을 제공합니다.

다단계 관리를 사용하면 컨테이너 오브젝트에 적용되는 모든 권한이 해당 컨테이너 내의 모든 개별 오브젝트에도 적용됩니다. 예를 들어 호스트 관리자 역할이 특정 호스트의 사용자에게 할당되면 사용자는 할당된 호스트에서만 사용 가능한 호스트 작업을 수행할 수 있는 권한을 얻게 됩니다. 그러나 호스트 관리자 역할이 데이터 센터의 사용자에게 할당되면 사용자는 데이터 센터 클러스터에 있는 모든 호스트에서 호스트 작업을 수행할 수 있는 권한을 얻게 됩니다.

1.1.1.1. 새 역할 생성

Red Hat Virtualization의 기본 역할 목록에 필요한 역할이 없는 경우 새 역할을 생성하고 사용자의 목적에 맞게 사용자 지정할 수 있습니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다. 그러면 Configure(구성 ) 창이 열립니다. Roles(역할 ) 탭은 기본적으로 선택되어 기본 User 및 Administrator 역할 목록과 사용자 지정 역할을 표시합니다.

- New (새로 만들기)를 클릭합니다.

- 새 역할의 Name (이름) 및 Description (설명)을 입력합니다.

- Admin(관리) 또는 User (사용자)를 Account Type(계정 유형 )으로 선택합니다.

- Check Boxes(작업 허용 ) 목록에 나열된 오브젝트에 대한 권한 수를 보려면 Expand All (모두 확장) 또는 Collapse All (모든 축소) 버튼을 사용합니다. 각 오브젝트에 대한 옵션을 확장하거나 축소할 수도 있습니다.

- 각 오브젝트에 대해 설정 중인 역할에 대해 허용하거나 거부할 작업을 선택하거나 지웁니다.

- OK(확인 )를 클릭하여 변경 사항을 적용합니다. 새 역할은 역할 목록에 표시됩니다.

1.1.1.2. 역할 편집 또는 복사

생성한 역할의 설정을 변경할 수 있지만 기본 역할은 변경할 수 없습니다. 기본 역할을 변경하려면 요구 사항에 맞게 복제하고 수정합니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다. 그러면 기본 User 및 Administrator 역할 목록과 사용자 지정 역할을 표시하는 Configure (구성) 창이 열립니다.

- 변경할 역할을 선택합니다.

- Edit(편집 ) 또는 Copy (복사)를 클릭합니다. 그러면 Edit Role or Copy Role(역할 편집 또는 복사 역할 편집) 창이 열립니다.

- 필요한 경우 역할의 Name (이름) 및 Description (설명)을 편집합니다.

- 나열된 오브젝트에 대한 권한 중 하나 이하를 보려면 Expand All( 모두 확장) 또는 Collapse All (모든 축소) 버튼을 사용합니다. 각 오브젝트에 대한 옵션을 확장하거나 축소할 수도 있습니다.

- 각 오브젝트에 대해 편집 중인 역할에 대해 허용 또는 거부할 작업을 선택하거나 지웁니다.

- OK(확인 )를 클릭하여 변경한 내용을 적용합니다.

1.1.1.3. 사용자 역할 및 권한 부여 예

다음 예제에서는 이 장에 설명된 다양한 권한 부여 시스템의 다양한 기능을 사용하여 다양한 시나리오에 권한 부여 제어를 적용하는 방법을 보여줍니다.

예 1.1. 클러스터 권한

Sarah는 회사의 회계 부서의 시스템 관리자입니다. 부서의 모든 가상 리소스는 Accounts 라는 Red Hat Virtualization 클러스터에서 구성됩니다. 계정에 ClusterAdmin 역할이 할당됩니다. 그러면 가상 시스템이 클러스터의 하위 개체이므로 클러스터의 모든 가상 시스템을 관리할 수 있습니다. 가상 시스템 관리에는 디스크 등의 가상 리소스 편집, 추가 또는 제거 및 스냅샷이 포함됩니다. 이 클러스터 외부의 리소스를 관리할 수 없습니다. ClusterAdmin 은 관리자 역할이므로 관리 포털 또는 VM 포털을 사용하여 이러한 리소스를 관리할 수 있습니다.

예 1.2. VM PowerUser 권한

John은 계정 부서의 소프트웨어 개발자입니다. 그는 가상 시스템을 사용하여 소프트웨어를 빌드하고 테스트합니다. Sarah는 johndesktop 이라는 가상 데스크탑을 만들었습니다. John은 johndesktop 가상 시스템에서 UserVmManager 역할을 할당받습니다. 이렇게 하면 VM 포털을 사용하여 이 단일 가상 시스템에 액세스할 수 있습니다. UserVmManager 권한이 있으므로 가상 시스템을 수정할 수 있습니다. UserVmManager 는 사용자 역할이므로 관리 포털을 사용할 수 없습니다.

예 1.3. 데이터 센터 파워 사용자 역할 권한

Penelope는 사무실 관리자입니다. 자신이 맡은 책임 외에도 인터뷰 예약, 참조 점검 등 인사 작업을 수행하는 데 도움을 주기도 합니다. 기업 정책에 따라 Penelope는 특별한 작업에 특정 애플리케이션을 사용해야 합니다.

Penelope는 사무실 관리 작업을 수행할 수 있는 시스템을 보유하고 있지만, 이 시스템을 사용하여 애플리케이션을 실행할 별도의 가상 시스템을 만들려고 합니다. 새 가상 시스템이 상주할 데이터 센터에 대한 PowerUserRole 권한이 할당됩니다. 이는 새 가상 시스템을 생성하려면 스토리지 도메인에 가상 디스크 생성을 포함하여 데이터 센터 내의 여러 구성 요소를 변경해야 하기 때문입니다.

이는 Penelope에 DataCenterAdmin 권한을 할당하는 것과 같지 않습니다. 데이터 센터의 PowerUser로 Penelope는 VM 포털에 로그인하고 데이터 센터 내의 가상 시스템에서 가상 시스템 관련 작업을 수행할 수 있습니다. 호스트 또는 스토리지를 데이터 센터에 연결하는 등의 데이터 센터 수준 작업을 수행할 수 없습니다.

예 1.4. 네트워크 관리자 권한

Chris는 IT 부서의 네트워크 관리자로 근무하고 있습니다. 담당 부서의 Red Hat Virtualization 환경에서는 일상적인 네트워크 생성, 조작 및 제거가 포함됩니다. 역할을 위해 리소스와 각 리소스의 네트워크에 대한 관리 권한이 필요합니다. 예를 들어 Chris가 IT 부서의 데이터 센터에 대한 NetworkAdmin 권한이 있는 경우 데이터 센터에서 네트워크를 추가 및 제거하고 데이터 센터에 속하는 모든 가상 시스템의 네트워크를 연결 및 분리할 수 있습니다.

예 1.5. 사용자 정의 역할 권한

Rachel은 IT 부서에서 일하며 Red Hat Virtualization에서 사용자 계정을 관리합니다. 사용자 계정을 추가하고 적절한 역할 및 권한을 할당할 수 있는 권한이 필요합니다. 가상 시스템을 사용하지 않으며 호스트, 가상 시스템, 클러스터 또는 데이터 센터의 관리에 액세스할 수 없어야 합니다. 이 특정 권한 세트를 제공하는 기본 제공 역할은 없습니다. Rachel의 위치에 적합한 권한 집합을 정의하려면 사용자 지정 역할을 생성해야 합니다.

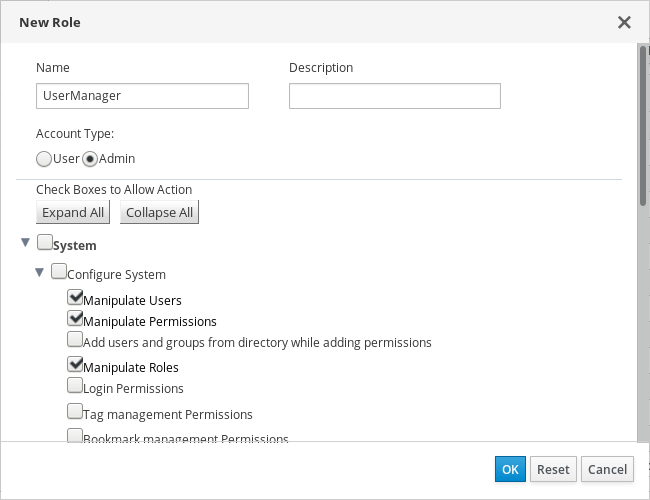

그림 1.1. UserManager 사용자 지정 역할

위에 표시된 UserManager 사용자 지정 역할을 사용하면 사용자, 권한 및 역할을 조작할 수 있습니다. 이러한 작업은 System (시스템) 아래에 구성됩니다. 오브젝트 계층 구조에 표시된 계층의 최상위 오브젝트 입니다. 즉, 시스템의 다른 모든 개체에 적용됩니다. 역할은 Account Type(계정 유형 )을 Admin 으로 설정합니다. 즉, Rachel은 이 역할을 할당하면 관리 포털과 VM 포털을 모두 사용할 수 있습니다.

1.1.2. 시스템 권한

권한을 사용하면 사용자가 오브젝트가 개별 오브젝트 또는 컨테이너 오브젝트인 오브젝트에 대한 작업을 수행할 수 있습니다. 컨테이너 오브젝트에 적용되는 권한은 해당 컨테이너의 모든 멤버에게도 적용됩니다.

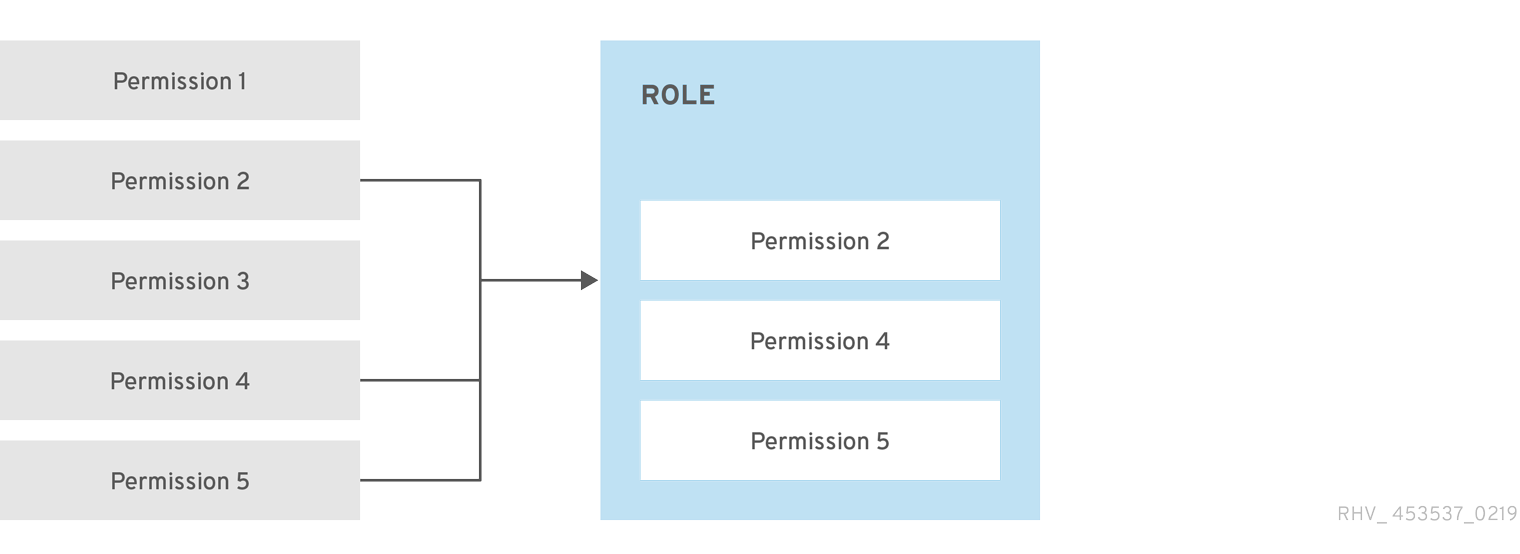

그림 1.2. 권한 및 역할

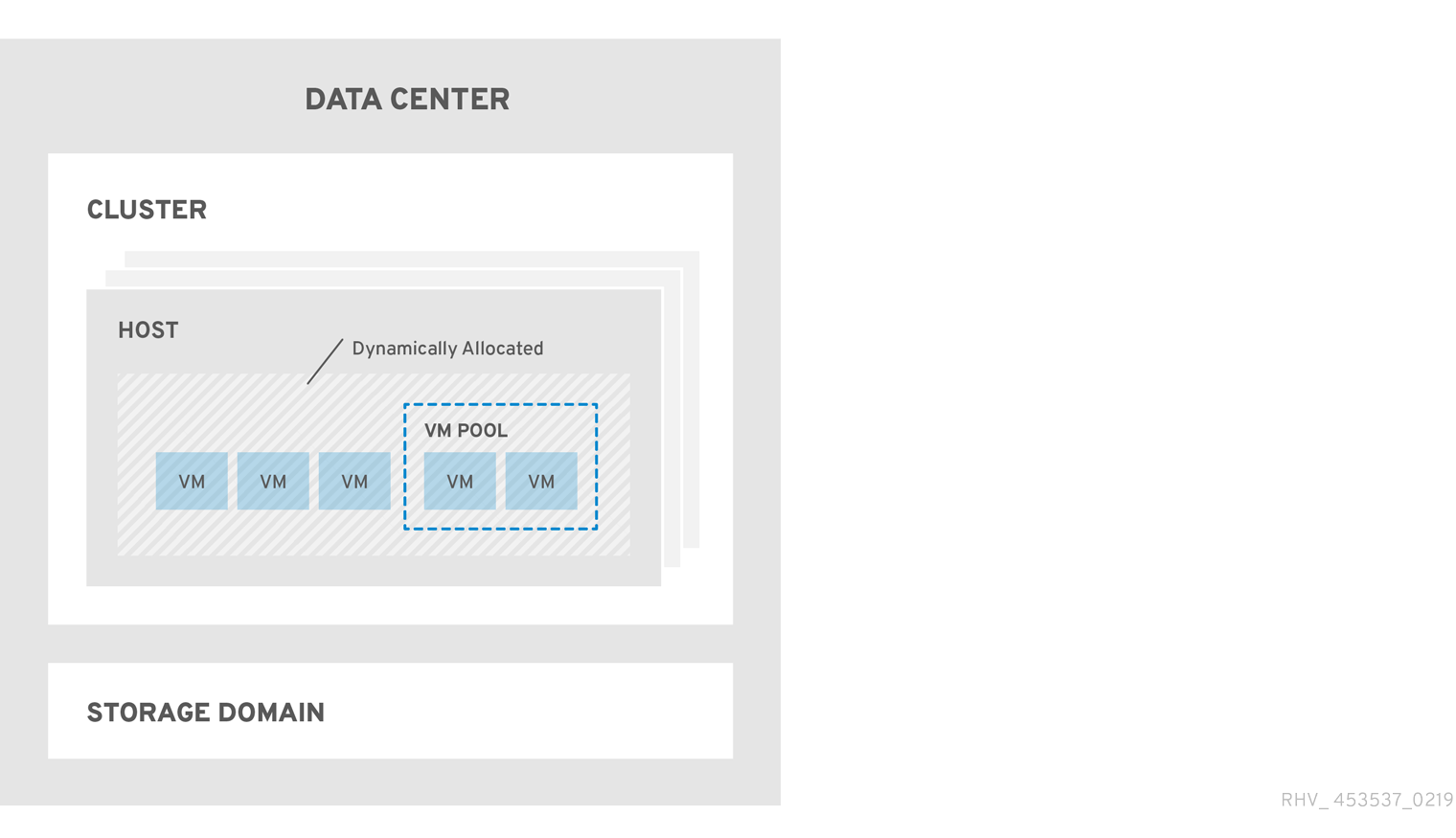

그림 1.3. Red Hat Virtualization 개체 계층 구조

1.1.2.1. 사용자 속성

역할 및 권한은 사용자의 속성입니다. 역할은 다양한 수준의 실제 및 가상 리소스에 대한 액세스를 허용하는 사전 정의된 권한 집합입니다. 다단계 관리는 세밀하게 조정된 권한 계층 구조를 제공합니다. 예를 들어 데이터 센터 관리자는 데이터 센터에 있는 모든 오브젝트를 관리할 수 있는 권한이 있는 반면 호스트 관리자에게 단일 물리적 호스트에 대한 시스템 관리자 권한이 있습니다. 사용자는 단일 가상 시스템을 사용할 수 있는 권한을 보유할 수 있지만 가상 시스템 구성을 변경하지 않고 다른 사용자에게 가상 시스템에 시스템 권한을 할당할 수 있습니다.

1.1.2.2. 사용자 및 관리자 역할

Red Hat Virtualization은 시스템 전체 권한이 있는 관리자부터 단일 가상 시스템에 액세스할 수 있는 최종 사용자에게 이르기까지 다양한 사전 구성된 역할을 제공합니다. 기본 역할을 변경하거나 제거할 수는 없지만, 요구 사항에 따라 역할을 복제 및 사용자 지정하거나 새 역할을 생성할 수 있습니다. 역할은 다음 두 가지 유형이 있습니다.

- 관리자 역할: 물리적 및 가상 리소스를 관리하기 위해 관리 포털에 액세스 가능. 관리자 역할은 VM 포털에서 수행할 작업에 대한 권한을 부여하지만 VM 포털에서 볼 수 있는 작업에 대한 권한을 제한하지 않습니다.

- 사용자 역할: VM 포털에 액세스하여 가상 시스템 및 템플릿 관리 및 액세스 가능. 사용자 역할은 VM 포털에서 사용자가 볼 수 있는 사항을 결정합니다. 관리자 역할이 있는 사용자에게 부여된 권한은 VM 포털에서 해당 사용자가 사용할 수 있는 작업에 반영됩니다.

1.1.2.3. 사용자 역할 설명

아래 표에서는 VM 포털에서 가상 시스템에 액세스하고 구성할 권한을 부여하는 기본 사용자 역할을 설명합니다.

표 1.1. Red Hat Virtualization 사용자 역할 - Basic

| Role | 권한 | 참고 |

|---|---|---|

| UserRole | 가상 시스템 및 풀에 액세스하고 사용할 수 있음. | VM 포털에 로그인할 수 있음, 할당된 가상 시스템 및 풀을 사용하며, 가상 시스템 상태 및 세부 정보를 확인합니다. |

| PowerUserRole | 가상 시스템과 템플릿을 생성하고 관리할 수 있습니다. | Configure (구성) 창이 있거나 특정 데이터 센터 또는 클러스터에 대해 전체 환경의 사용자에게 이 역할을 적용합니다. 예를 들어 PowerUserRole이 데이터 센터에 적용된 경우 PowerUser는 데이터 센터에서 가상 시스템과 템플릿을 생성할 수 있습니다. |

| UserVmManager | 가상 시스템의 시스템 관리자. | 가상 시스템을 관리하고 스냅샷을 만들고 사용할 수 있습니다. VM 포털에서 가상 시스템을 생성하는 사용자에게는 시스템의 UserVmManager 역할이 자동으로 할당됩니다. |

아래 표는 VM 포털의 리소스에 대한 권한을 보다 세부적으로 조정할 수 있는 고급 사용자 역할에 대해 설명합니다.

표 1.2. Red Hat Virtualization 사용자 역할 - 고급

| Role | 권한 | 참고 |

|---|---|---|

| UserTemplateBasedVm | 템플릿만 사용하는 제한된 권한. | 템플릿을 사용하여 가상 시스템을 생성할 수 있음. |

| DiskOperator | 가상 디스크 사용자. | 가상 디스크를 사용, 보기 및 편집할 수 있습니다. 가상 디스크가 연결된 가상 시스템을 사용하는 권한을 상속합니다. |

| VmCreator | VM 포털에서 가상 시스템을 생성할 수 있음. | 이 역할은 특정 가상 시스템에 적용되지 않습니다. Configure (구성) 창이 있는 전체 환경의 사용자에게 이 역할을 적용합니다. 또는 특정 데이터 센터 또는 클러스터에 이 역할을 적용합니다. 이 역할을 클러스터에 적용하는 경우 전체 데이터 센터 또는 특정 스토리지 도메인에 DiskCreator 역할을 적용해야 합니다. |

| TemplateCreator | 할당된 리소스 내에서 가상 시스템 템플릿을 생성, 편집, 관리 및 제거할 수 있습니다. | 이 역할은 특정 템플릿에 적용되지 않습니다. Configure (구성) 창이 있는 전체 환경의 사용자에게 이 역할을 적용합니다. 또는 특정 데이터 센터, 클러스터 또는 스토리지 도메인에 이 역할을 적용합니다. |

| DiskCreator | 할당된 클러스터 또는 데이터 센터 내에서 가상 디스크를 생성, 편집, 관리 및 제거할 수 있습니다. | 이 역할은 특정 가상 디스크에 적용되지 않습니다. Configure (구성) 창이 있는 전체 환경의 사용자에게 이 역할을 적용합니다. 또는 특정 데이터 센터 또는 스토리지 도메인에 이 역할을 적용합니다. |

| TemplateOwner | 템플릿을 편집하고 삭제하고, 템플릿에 대한 사용자 권한을 할당 및 관리할 수 있습니다. | 이 역할은 템플릿을 생성하는 사용자에게 자동으로 할당됩니다. 템플릿에 대한 TemplateOwner 권한이 없는 다른 사용자는 템플릿을 보거나 사용할 수 없습니다. |

| VnicProfileUser | 가상 시스템 및 템플릿용 논리적 네트워크 및 네트워크 인터페이스 사용자. | 특정 논리적 네트워크에서 네트워크 인터페이스를 연결하거나 연결 해제할 수 있습니다. |

1.1.2.4. 설명된 관리자 역할

아래 표는 관리 포털에서 리소스에 액세스하고 구성할 권한을 부여하는 기본 관리자 역할을 설명합니다.

표 1.3. Red Hat Virtualization 시스템 관리자 역할 - Basic

| Role | 권한 | 참고 |

|---|---|---|

| 수퍼유저 | Red Hat Virtualization 환경의 시스템 관리자. | 에는 모든 오브젝트와 수준에 대한 전체 권한이 있으며, 모든 데이터 센터에서 모든 오브젝트를 관리할 수 있습니다. |

| ClusterAdmin | 클러스터 관리자. | 특정 클러스터 아래의 모든 오브젝트에 대한 관리 권한이 있습니다. |

| DataCenterAdmin | 데이터 센터 관리자. | 특정 데이터 센터 아래의 모든 오브젝트에 대한 관리 권한을 보유합니다. 단, 스토리지는 제외입니다. |

디렉터리 서버에 대한 관리자를 Red Hat Virtualization 관리 사용자로 사용하지 마십시오. 특히 Red Hat Virtualization 관리 사용자로 사용하기 위해 디렉터리 서버에서 사용자를 생성합니다.

아래 표는 관리 포털의 리소스에 대한 권한을 보다 세부적으로 조정할 수 있는 고급 관리자 역할을 설명합니다.

표 1.4. Red Hat Virtualization 시스템 관리자 역할 - 고급

| Role | 권한 | 참고 |

|---|---|---|

| TemplateAdmin | 가상 머신 템플릿 관리자. | 템플릿의 스토리지 도메인과 네트워크 세부 정보를 생성, 삭제 및 구성하고 도메인 간에 템플릿을 이동할 수 있습니다. |

| StorageAdmin | 스토리지 관리자. | 할당된 스토리지 도메인을 생성, 삭제, 구성 및 관리할 수 있습니다. |

| HostAdmin | 호스트 관리자. | 특정 호스트를 연결, 제거, 구성 및 관리할 수 있습니다. |

| NetworkAdmin | 네트워크 관리자. | 특정 데이터 센터 또는 클러스터의 네트워크를 구성하고 관리할 수 있습니다. 데이터 센터 또는 클러스터의 네트워크 관리자는 클러스터 내의 가상 풀에 대한 네트워크 권한을 상속받습니다. |

| VmPoolAdmin | 가상 풀의 시스템 관리자. | 가상 풀을 생성, 삭제 및 구성하고, 가상 풀 사용자를 할당 및 제거하고, 풀의 가상 시스템에서 기본 작업을 수행할 수 있습니다. |

| GlusterAdmin | Gluster 스토리지 관리자. | Gluster 스토리지 볼륨을 생성, 삭제, 구성 및 관리할 수 있습니다. |

| VmImporterExporter | 가상 시스템의 관리자 가져오기 및 내보내기. | 가상 시스템을 가져오고 내보낼 수 있습니다. 다른 사용자가 내보낸 모든 가상 시스템과 템플릿을 볼 수 있습니다. |

1.1.2.5. 리소스에 관리자 또는 사용자 역할 할당

사용자가 해당 리소스에 액세스하거나 관리할 수 있도록 관리자 또는 사용자 역할을 리소스에 할당합니다.

절차

- 리소스 이름을 찾아 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- Permissions(권한 ) 탭을 클릭하여 할당된 사용자, 각 사용자의 역할 및 선택한 리소스에 대한 상속된 권한을 나열합니다.

- 추가를 클릭합니다.

- 기존 사용자의 이름 또는 사용자 이름을 Search (검색) 텍스트 상자에 입력하고 Go (이동)를 클릭합니다. 가능한 일치 항목 목록에서 사용자를 선택합니다.

- Role to Assign (할당할 역할) 드롭다운 목록에서 역할을 선택합니다.

- OK(확인)를 클릭합니다.

이제 사용자에게 해당 리소스에 대해 해당 역할의 상속된 권한이 활성화되었습니다.

권한이 시스템 계층 구조에서 낮은 리소스에서 자동으로 상속되므로 클러스터와 같은 리소스에서 일반 사용자에게 글로벌 권한을 할당하지 마십시오. 가상 시스템, 풀 또는 가상 시스템 풀, 특히 후자의 특정 리소스에 대한 UserRole 및 기타 모든 사용자 역할 권한을 설정합니다.

글로벌 권한을 할당하면 권한 상속으로 인해 두 가지 문제가 발생할 수 있습니다.

- 일반 사용자는 관리자가 할당 권한을 수행하지 않으려는 경우에도 가상 시스템 풀을 제어하는 권한을 자동으로 부여할 수 있습니다.

- 풀에서 가상 시스템 포털이 예기치 않게 작동할 수 있습니다.

따라서 다른 리소스가 권한을 상속받는 리소스가 아닌 특정 리소스에 대해서만 UserRole 및 기타 모든 사용자 역할 권한을 설정하는 것이 좋습니다.

1.1.2.6. 리소스에서 관리자 또는 사용자 역할 제거

리소스에서 관리자 또는 사용자 역할을 제거합니다. 사용자는 해당 리소스의 역할과 연결된 상속된 권한이 손실됩니다.

절차

- 리소스 이름을 찾아 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- Permissions(권한 ) 탭을 클릭하여 할당된 사용자, 사용자의 역할 및 선택한 리소스에 대한 상속된 권한을 나열합니다.

- 리소스에서 제거할 사용자를 선택합니다.

- Remove(제거)를 클릭합니다.

- OK(확인)를 클릭합니다.

1.1.2.7. 데이터 센터의 시스템 권한 관리

SuperUser 로서 시스템 관리자는 관리 포털의 모든 측면을 관리합니다. 특정 관리 역할을 다른 사용자에게 할당할 수 있습니다. 이러한 제한된 관리자 역할은 특정 리소스로 제한하는 사용자 관리 권한을 부여하는 데 유용합니다. 예를 들어 DataCenterAdmin 역할에는 해당 데이터 센터에 대한 스토리지를 제외하고 할당된 데이터 센터에 대해서만 관리자 권한이 있으며 ClusterAdmin 에는 할당된 클러스터에 대한 관리자 권한만 있습니다.

데이터 센터 관리자는 특정 데이터 센터에 대해서만 시스템 관리 역할입니다. 이 기능은 각 데이터 센터에 관리자가 필요한 여러 데이터 센터가 있는 가상화 환경에 유용합니다. DataCenterAdmin 역할은 계층적 모델입니다. 데이터 센터에 대한 데이터 센터 관리자 역할이 할당된 사용자는 해당 데이터 센터에 대한 스토리지를 제외하고 데이터 센터의 모든 오브젝트를 관리할 수 있습니다. 헤더 표시줄에서 Configure(구성 ) 버튼을 사용하여 환경의 모든 데이터 센터에 대한 데이터 센터 관리자를 할당합니다.

데이터 센터 관리자 역할은 다음 작업을 허용합니다.

- 데이터 센터와 연결된 클러스터 생성 및 제거.

- 데이터 센터와 연결된 호스트, 가상 시스템 및 풀을 추가 및 제거합니다.

- 데이터 센터와 연결된 가상 시스템에 대한 사용자 권한을 편집합니다.

기존 사용자에게만 역할과 권한을 할당할 수 있습니다.

기존 시스템 관리자를 제거하고 새 시스템 관리자를 추가하여 데이터 센터의 시스템 관리자를 변경할 수 있습니다.

1.1.2.8. 설명된 데이터 센터 관리자 역할

데이터 센터 권한 역할

아래 표에서는 데이터 센터 관리에 적용되는 관리자 역할 및 권한을 설명합니다.

표 1.5. Red Hat Virtualization 시스템 관리자 역할

| Role | 권한 | 참고 |

|---|---|---|

| DataCenterAdmin | 데이터 센터 관리자 | 클러스터, 호스트, 템플릿 및 가상 시스템을 포함한 스토리지를 제외하고 특정 데이터 센터 내의 모든 실제 및 가상 리소스를 사용, 생성, 삭제, 관리할 수 있습니다. |

| NetworkAdmin | 네트워크 관리자 | 특정 데이터 센터의 네트워크를 구성하고 관리할 수 있습니다. 데이터 센터의 네트워크 관리자는 데이터 센터 내의 가상 시스템에 대한 네트워크 권한을 상속받습니다. |

1.1.2.9. 클러스터의 시스템 권한 관리

SuperUser 로서 시스템 관리자는 관리 포털의 모든 측면을 관리합니다. 특정 관리 역할을 다른 사용자에게 할당할 수 있습니다. 이러한 제한된 관리자 역할은 특정 리소스로 제한하는 사용자 관리 권한을 부여하는 데 유용합니다. 예를 들어 DataCenterAdmin 역할에는 해당 데이터 센터에 대한 스토리지를 제외하고 할당된 데이터 센터에 대해서만 관리자 권한이 있으며 ClusterAdmin 에는 할당된 클러스터에 대한 관리자 권한만 있습니다.

클러스터 관리자는 특정 클러스터에 대해서만 시스템 관리 역할입니다. 이 기능은 각 클러스터에 시스템 관리자가 필요한 여러 클러스터가 있는 데이터 센터에서 유용합니다. ClusterAdmin 역할은 계층 구조 모델입니다. 클러스터에 대한 클러스터 관리자 역할이 할당된 사용자가 클러스터의 모든 개체를 관리할 수 있습니다. 헤더 표시줄에서 Configure(구성 ) 버튼을 사용하여 환경에 있는 모든 클러스터에 클러스터 관리자를 할당합니다.

클러스터 관리자 역할은 다음 작업을 허용합니다.

- 연결된 클러스터 생성 및 제거.

- 클러스터와 관련된 호스트, 가상 시스템 및 풀을 추가 및 제거합니다.

- 클러스터와 연결된 가상 시스템에 대한 사용자 권한을 편집합니다.

기존 사용자에게만 역할과 권한을 할당할 수 있습니다.

기존 시스템 관리자를 제거하고 새 시스템 관리자를 추가하여 클러스터의 시스템 관리자를 변경할 수도 있습니다.

1.1.2.10. 설명된 클러스터 관리자 역할

클러스터 권한 역할

아래 표에서는 클러스터 관리에 적용할 수 있는 관리자 역할 및 권한을 설명합니다.

표 1.6. Red Hat Virtualization 시스템 관리자 역할

| Role | 권한 | 참고 |

|---|---|---|

| ClusterAdmin | 클러스터 관리자 | 호스트, 템플릿 및 가상 시스템을 포함하여 특정 클러스터의 모든 실제 및 가상 리소스를 사용, 생성, 삭제, 관리할 수 있습니다. 는 표시 네트워크 지정과 같은 클러스터 내에서 네트워크 속성을 구성하거나 네트워크를 필수 또는 필요하지 않은 것으로 표시할 수 있습니다. 그러나 ClusterAdmin 에는 클러스터에서 네트워크를 연결하거나 분리할 권한이 없으므로 NetworkAdmin 권한이 필요합니다. |

| NetworkAdmin | 네트워크 관리자 | 특정 클러스터의 네트워크를 구성하고 관리할 수 있습니다. 클러스터의 네트워크 관리자는 클러스터 내의 가상 시스템에 대한 네트워크 권한을 상속받습니다. |

1.1.2.11. 네트워크의 시스템 권한 관리

SuperUser 로서 시스템 관리자는 관리 포털의 모든 측면을 관리합니다. 특정 관리 역할을 다른 사용자에게 할당할 수 있습니다. 이러한 제한된 관리자 역할은 특정 리소스로 제한하는 사용자 관리 권한을 부여하는 데 유용합니다. 예를 들어 DataCenterAdmin 역할에는 해당 데이터 센터에 대한 스토리지를 제외하고 할당된 데이터 센터에 대해서만 관리자 권한이 있으며 ClusterAdmin 에는 할당된 클러스터에 대한 관리자 권한만 있습니다.

네트워크 관리자는 특정 네트워크 또는 데이터 센터, 클러스터, 호스트, 가상 시스템 또는 템플릿의 모든 네트워크에 적용할 수 있는 시스템 관리 역할입니다. 네트워크 사용자는 특정 가상 시스템 또는 템플릿에서 네트워크 보기 및 연결과 같은 제한된 관리 역할을 수행할 수 있습니다. 헤더 표시줄에서 Configure(구성 ) 버튼을 사용하여 환경의 모든 네트워크에 대한 네트워크 관리자를 할당할 수 있습니다.

네트워크 관리자 역할은 다음 작업을 허용합니다.

- 네트워크 만들기, 편집 및 제거.

- 포트 미러링 구성을 포함하여 네트워크 설정을 편집합니다.

- 클러스터 및 가상 시스템을 포함한 리소스에서 네트워크를 연결 및 분리합니다.

네트워크를 생성하는 사용자에게는 생성된 네트워크에 대한 NetworkAdmin 권한이 자동으로 할당됩니다. 기존 관리자를 제거하고 새 관리자를 추가하여 네트워크 관리자를 변경할 수도 있습니다.

1.1.2.12. 설명된 네트워크 관리자 및 사용자 역할

네트워크 권한 역할

아래 표는 네트워크 관리에 적용할 수 있는 관리자 및 사용자 역할 및 권한을 설명합니다.

표 1.7. Red Hat Virtualization Network 관리자 및 사용자 역할

| Role | 권한 | 참고 |

|---|---|---|

| NetworkAdmin | 데이터 센터, 클러스터, 호스트, 가상 시스템 또는 템플릿의 네트워크 관리자. 네트워크를 생성하는 사용자에게는 생성된 네트워크에 대한 NetworkAdmin 권한이 자동으로 할당됩니다. | 특정 데이터 센터, 클러스터, 호스트, 가상 시스템 또는 템플릿의 네트워크를 구성하고 관리할 수 있습니다. 데이터 센터 또는 클러스터의 네트워크 관리자는 클러스터 내의 가상 풀에 대한 네트워크 권한을 상속받습니다. 가상 시스템 네트워크에서 포트 미러링을 구성하려면 네트워크에 NetworkAdmin 역할을 적용하고 가상 머신에서 UserVmManager 역할을 적용합니다. |

| VnicProfileUser | 가상 시스템 및 템플릿용 논리적 네트워크 및 네트워크 인터페이스 사용자. | 특정 논리적 네트워크에서 네트워크 인터페이스를 연결하거나 연결 해제할 수 있습니다. |

1.1.2.13. 호스트의 시스템 권한 관리

SuperUser 로서 시스템 관리자는 관리 포털의 모든 측면을 관리합니다. 특정 관리 역할을 다른 사용자에게 할당할 수 있습니다. 이러한 제한된 관리자 역할은 특정 리소스로 제한하는 사용자 관리 권한을 부여하는 데 유용합니다. 예를 들어 DataCenterAdmin 역할에는 해당 데이터 센터에 대한 스토리지를 제외하고 할당된 데이터 센터에 대해서만 관리자 권한이 있으며 ClusterAdmin 에는 할당된 클러스터에 대한 관리자 권한만 있습니다.

호스트 관리자는 특정 호스트에 대해서만 시스템 관리 역할입니다. 이 기능은 각 호스트에 시스템 관리자가 필요한 여러 호스트가 있는 클러스터에서 유용합니다. 헤더 표시줄에서 Configure(구성 ) 버튼을 사용하여 환경의 모든 호스트에 대한 호스트 관리자를 할당할 수 있습니다.

호스트 관리자 역할은 다음 작업을 허용합니다.

- 호스트의 구성을 편집합니다.

- 논리적 네트워크를 설정합니다.

- 호스트를 제거합니다.

기존 시스템 관리자를 제거하고 새 시스템 관리자를 추가하여 호스트의 시스템 관리자를 변경할 수도 있습니다.

1.1.2.14. 설명된 호스트 관리자 역할

호스트 권한 역할

아래 표에서는 호스트 관리에 적용할 수 있는 관리자 역할 및 권한을 설명합니다.

표 1.8. Red Hat Virtualization 시스템 관리자 역할

| Role | 권한 | 참고 |

|---|---|---|

| HostAdmin | 호스트 관리자 | 특정 호스트를 구성, 관리 및 제거할 수 있습니다. 또한 네트워크 관련 작업을 특정 호스트에서 수행할 수 있습니다. |

1.1.2.15. 스토리지 도메인의 시스템 권한 관리

SuperUser 로서 시스템 관리자는 관리 포털의 모든 측면을 관리합니다. 특정 관리 역할을 다른 사용자에게 할당할 수 있습니다. 이러한 제한된 관리자 역할은 특정 리소스로 제한하는 사용자 관리 권한을 부여하는 데 유용합니다. 예를 들어 DataCenterAdmin 역할에는 해당 데이터 센터에 대한 스토리지를 제외하고 할당된 데이터 센터에 대해서만 관리자 권한이 있으며 ClusterAdmin 에는 할당된 클러스터에 대한 관리자 권한만 있습니다.

스토리지 관리자는 특정 스토리지 도메인에 대해서만 시스템 관리 역할입니다. 이 기능은 스토리지 도메인마다 시스템 관리자가 필요한 여러 스토리지 도메인이 있는 데이터 센터에서 유용합니다. 헤더 표시줄에서 Configure(구성 ) 버튼을 사용하여 환경의 모든 스토리지 도메인에 대한 스토리지 관리자를 할당합니다.

스토리지 도메인 관리자 역할은 다음 작업을 허용합니다.

- 스토리지 도메인의 구성을 편집합니다.

- 스토리지 도메인을 유지 관리 모드로 이동합니다.

- 스토리지 도메인을 제거합니다.

기존 사용자에게만 역할과 권한을 할당할 수 있습니다.

기존 시스템 관리자를 제거하고 새 시스템 관리자를 추가하여 스토리지 도메인의 시스템 관리자를 변경할 수도 있습니다.

1.1.2.16. 설명된 스토리지 관리자 역할

스토리지 도메인 권한 역할

아래 표에서는 스토리지 도메인 관리에 적용할 수 있는 관리자 역할 및 권한을 설명합니다.

표 1.9. Red Hat Virtualization 시스템 관리자 역할

| Role | 권한 | 참고 |

|---|---|---|

| StorageAdmin | 스토리지 관리자 | 특정 스토리지 도메인을 생성, 삭제, 구성 및 관리할 수 있습니다. |

| GlusterAdmin | Gluster Storage 관리자 | Gluster 스토리지 볼륨을 생성, 삭제, 구성 및 관리할 수 있습니다. |

1.1.2.17. 가상 머신 풀의 시스템 권한 관리

SuperUser 로서 시스템 관리자는 관리 포털의 모든 측면을 관리합니다. 특정 관리 역할을 다른 사용자에게 할당할 수 있습니다. 이러한 제한된 관리자 역할은 특정 리소스로 제한하는 사용자 관리 권한을 부여하는 데 유용합니다. 예를 들어 DataCenterAdmin 역할에는 해당 데이터 센터에 대한 스토리지를 제외하고 할당된 데이터 센터에 대해서만 관리자 권한이 있으며 ClusterAdmin 에는 할당된 클러스터에 대한 관리자 권한만 있습니다.

가상 시스템 풀 관리자는 데이터 센터의 가상 시스템 풀에 대한 시스템 관리 역할입니다. 이 역할은 특정 가상 시스템 풀, 데이터 센터 또는 전체 가상화 환경에 적용할 수 있습니다. 이 역할은 다른 사용자가 특정 가상 시스템 풀 리소스를 관리할 수 있도록 하는 데 유용합니다.

가상 머신 풀 관리자 역할은 다음 작업을 허용합니다.

- 풀 생성, 편집 및 제거.

- 풀에서 가상 머신 추가 및 분리.

기존 사용자에게만 역할과 권한을 할당할 수 있습니다.

1.1.2.18. 가상 머신 풀 관리자 역할 설명

풀 권한 역할

아래 표는 풀 관리에 적용할 수 있는 관리자 역할 및 권한을 설명합니다.

표 1.10. Red Hat Virtualization 시스템 관리자 역할

| Role | 권한 | 참고 |

|---|---|---|

| VmPoolAdmin | 가상 풀의 시스템 관리자 역할. | 가상 풀을 생성, 삭제 및 구성하고, 가상 풀 사용자를 할당 및 제거하고, 가상 시스템에서 기본 작업을 수행할 수 있습니다. |

| ClusterAdmin | 클러스터 관리자 | 특정 클러스터의 모든 가상 시스템 풀을 사용, 생성, 삭제, 관리할 수 있습니다. |

1.1.2.19. 가상 디스크의 시스템 권한 관리

SuperUser 로서 시스템 관리자는 관리 포털의 모든 측면을 관리합니다. 특정 관리 역할을 다른 사용자에게 할당할 수 있습니다. 이러한 제한된 관리자 역할은 특정 리소스로 제한하는 사용자 관리 권한을 부여하는 데 유용합니다. 예를 들어 DataCenterAdmin 역할에는 해당 데이터 센터에 대한 스토리지를 제외하고 할당된 데이터 센터에 대해서만 관리자 권한이 있으며 ClusterAdmin 에는 할당된 클러스터에 대한 관리자 권한만 있습니다.

Red Hat Virtualization Manager는 두 개의 기본 가상 디스크 사용자 역할을 제공하지만 기본 가상 디스크 관리자 역할은 없습니다. 이러한 사용자 역할 중 하나인 DiskCreator 역할을 사용하면 VM 포털에서 가상 디스크를 관리할 수 있습니다. 이 역할은 특정 가상 시스템, 데이터 센터, 특정 스토리지 도메인 또는 전체 가상화 환경에 적용할 수 있습니다. 이 역할은 다른 사용자가 다른 가상 리소스를 관리할 수 있도록 하는 데 유용합니다.

가상 디스크 생성자 역할은 다음 작업을 허용합니다.

- 가상 시스템 또는 기타 리소스와 연결된 가상 디스크를 생성, 편집 및 제거합니다.

- 가상 디스크에 대한 사용자 권한을 편집합니다.

기존 사용자에게만 역할과 권한을 할당할 수 있습니다.

1.1.2.20. 가상 디스크 사용자 역할 설명

가상 디스크 사용자 권한 역할

아래 표는 VM 포털에서 가상 디스크를 사용하고 관리하는 데 적용할 수 있는 사용자 역할 및 권한을 설명합니다.

표 1.11. Red Hat Virtualization 시스템 관리자 역할

| Role | 권한 | 참고 |

|---|---|---|

| DiskOperator | 가상 디스크 사용자. | 가상 디스크를 사용, 보기 및 편집할 수 있습니다. 가상 디스크가 연결된 가상 시스템을 사용하는 권한을 상속합니다. |

| DiskCreator | 할당된 클러스터 또는 데이터 센터 내에서 가상 디스크를 생성, 편집, 관리 및 제거할 수 있습니다. | 이 역할은 특정 가상 디스크에 적용되지 않습니다. Configure (구성) 창이 있는 전체 환경의 사용자에게 이 역할을 적용합니다. 또는 특정 데이터 센터, 클러스터 또는 스토리지 도메인에 이 역할을 적용합니다. |

1.1.2.20.1. 레거시 SPICE 암호 설정

SPICE 콘솔은 기본적으로 암호화 문자열과 함께 FIPS 호환 암호화를 사용합니다. 기본 SPICE 암호화 문자열은 kECDHE+FIPS:kDHE+FIPS:kRSA+FIPS:!eNULL:!aNULL입니다.

일반적으로 이 문자열은 충분합니다. 그러나 이전 운영 체제 또는 SPICE 클라이언트가 있는 가상 머신이 하나나 하나라도 FIPS 호환 암호화를 지원하지 않는 경우 더 약한 암호 문자열을 사용해야 합니다. 그렇지 않으면 기존 클러스터에 새 클러스터 또는 새 호스트를 설치하고 해당 가상 시스템에 연결을 시도하면 연결 보안 오류가 발생할 수 있습니다.

Ansible 플레이북을 사용하여 암호 문자열을 변경할 수 있습니다.

암호화 문자열 변경

Manager 시스템의 디렉토리

/usr/share/ovirt-engine/playbooks에 파일을 만듭니다. 예를 들면 다음과 같습니다.# vim /usr/share/ovirt-engine/playbooks/change-spice-cipher.yml

파일에 다음을 입력하여 저장합니다.

name: oVirt - setup weaker SPICE encryption for old clients hosts: hostname vars: host_deploy_spice_cipher_string: 'DEFAULT:-RC4:-3DES:-DES' roles: - ovirt-host-deploy-spice-encryption방금 만든 파일을 실행합니다.

# ansible-playbook -l hostname /usr/share/ovirt-engine/playbooks/change-spice-cipher.yml

또는 host_ deploy_ 를 재구성할 수 있습니다.

spice_cipher_string 변수와 함께 -deploy로 호스트--extra-vars 옵션을 사용하여 Ansible 플레이북 ovirt- host

# ansible-playbook -l hostname \

--extra-vars host_deploy_spice_cipher_string=”DEFAULT:-RC4:-3DES:-DES” \

/usr/share/ovirt-engine/playbooks/ovirt-host-deploy.yml1.1.3. 예약 정책

스케줄링 정책은 스케줄링 정책이 적용되는 클러스터의 호스트 간에 가상 시스템이 배포되는 논리를 정의하는 규칙 집합입니다. 스케줄링 정책은 필터, 가중치 및 부하 분산 정책의 조합을 통해 이 논리를 결정합니다. filter 모듈은 하드 적용을 적용하고 해당 필터에서 지정한 조건을 충족하지 않는 호스트를 필터링합니다. weights 모듈은 소프트 적용을 적용하며, 가상 시스템을 실행할 수 있는 클러스터의 호스트를 결정할 때 고려하는 요인의 상대적 우선 순위를 제어하는 데 사용됩니다.

Red Hat Virtualization Manager는 5가지 기본 스케줄링 정책을 제공합니다. evenly_Distributed,Cluster_Maintenance,None,Power_Saving 및 VM_Evenly_Distributed. 가상 시스템 배포에 대한 세부적인 제어를 제공하는 새로운 스케줄링 정책을 정의할 수도 있습니다. 스케줄링 정책에 관계없이 과부하된 CPU가 있는 호스트에서 가상 시스템이 시작되지 않습니다. 기본적으로 5분 동안 80% 이상의 부하가 있는 경우 호스트의 CPU가 과부하로 간주되지만 스케줄링 정책을 사용하여 이러한 값을 변경할 수 있습니다. 각 스케줄링 정책 의 속성에 대한 자세한 내용은 관리 가이드 의 스케줄링 정책을 참조하십시오.

스케줄링 정책이 작동하는 방법에 대한 자세한 내용은 클러스터 스케줄링 정책의 작동 방식을 참조하십시오.

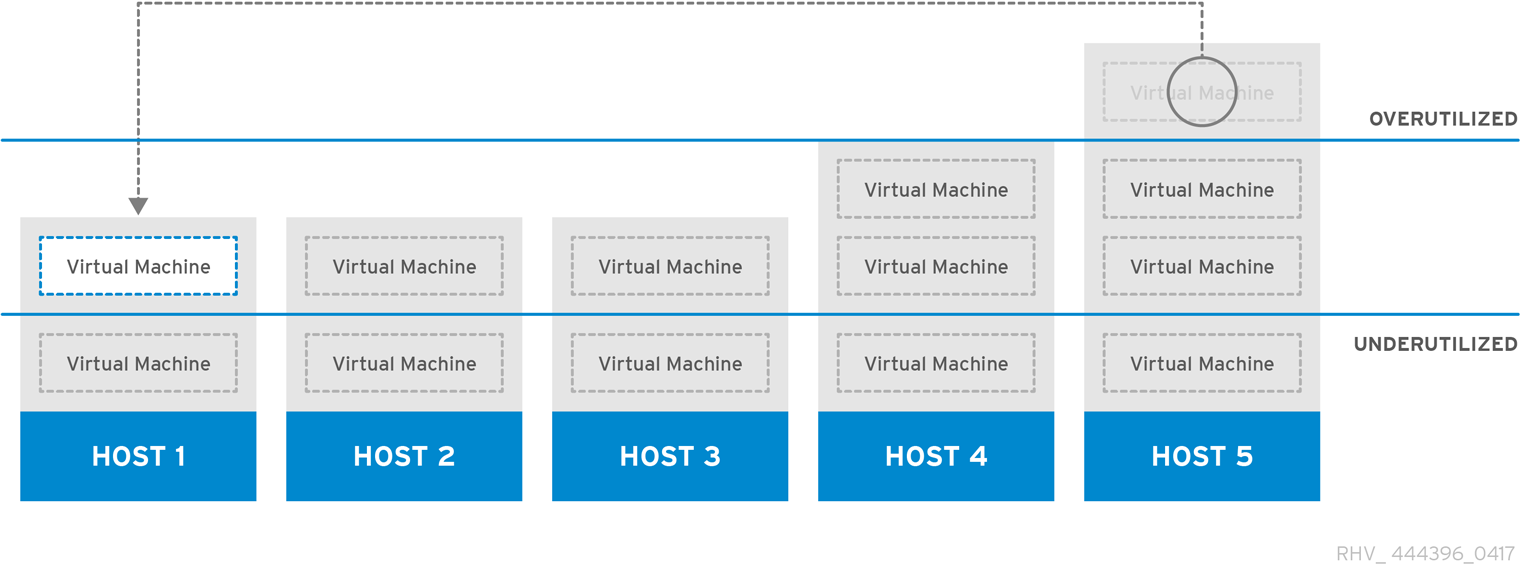

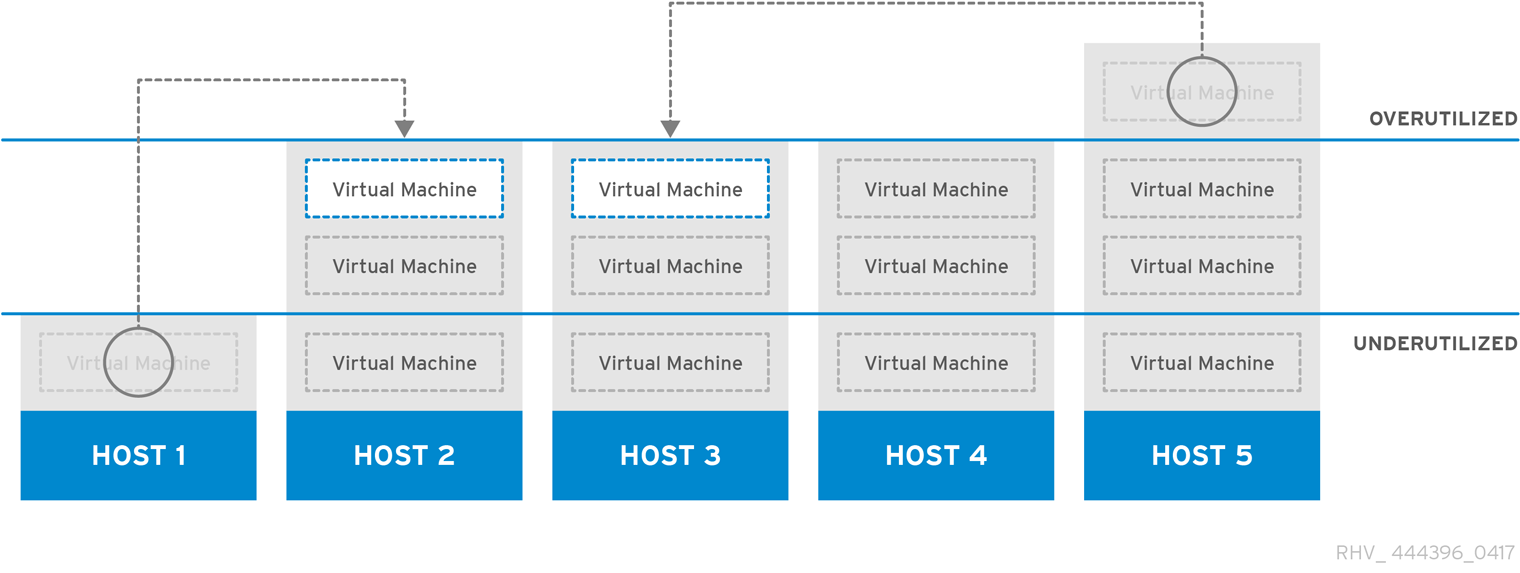

그림 1.4. 균일하게 분산 스케줄링 정책

evenly_Distributed 스케줄링 정책에서는 클러스터의 모든 호스트에서 메모리와 CPU 처리 부하를 균등하게 배포합니다. 호스트에 연결된 추가 가상 머신은 해당 호스트가 정의된 CpuOverCommitDurationMinutes,HighUtilization, highUtilization ,ECDHEpuToPhysicalCpuRatio, 또는 MaxFreeMemoryForOverUtilized 에 도달한 경우 시작되지 않습니다.

VM_Evenly_Distributed 스케줄링 정책은 가상 시스템 수에 따라 호스트 간에 가상 시스템을 균등하게 배포합니다. 호스트가 HighVmCount 보다 더 많은 가상 시스템을 실행 중이고 MigrationThreshold 외부에 있는 가상 머신 수가 하나 이상 있는 경우 클러스터가 균형이 맞지 않는 것으로 간주됩니다.

그림 1.5. 절전 예약 정책

Power_Saving 스케줄링 정책은 활용도가 낮은 호스트의 전력 소비를 줄이기 위해 사용 가능한 호스트의 하위 집합에 메모리 및 CPU 처리 부하를 분산합니다. CPU 부하가 정의된 시간 간격보다 긴 사용률 값이 낮은 호스트는 모든 가상 시스템을 다른 호스트로 마이그레이션하여 전원을 끌 수 있습니다. 호스트가 정의된 높은 사용률 값에 도달한 경우 호스트에 연결된 추가 가상 시스템이 시작되지 않습니다.

가상 시스템을 실행하기 위해 호스트 간에 부하 또는 전원 공유가 없도록 None 정책을 설정합니다. 이는 기본값 모드입니다. 가상 시스템이 시작되면 클러스터의 모든 호스트에 메모리 및 CPU 처리 부하가 균등하게 분산됩니다. 해당 호스트가 정의된 CpuOverCommitDurationMinutes,HighUtilization 또는 MaxFreeMemoryForOver Utilized 에 도달하면 호스트에 연결된 추가 가상 시스템이 시작되지 않습니다.

Cluster_Maintenance 스케줄링 정책은 유지 관리 작업 중에 클러스터의 활동을 제한합니다. Cluster_Maintenance 정책이 설정되면 고가용성 가상 시스템을 제외하고 새 가상 시스템을 시작할 수 없습니다. 호스트 오류가 발생하면 고가용성 가상 시스템이 제대로 다시 시작되고 모든 가상 시스템이 마이그레이션될 수 있습니다.

1.1.3.1. 스케줄링 정책 생성

새 스케줄링 정책을 생성하여 Red Hat Virtualization 환경에서 지정된 클러스터 간에 가상 머신이 배포되는 논리를 제어할 수 있습니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- Scheduling Policies(스케줄링 정책 ) 탭을 클릭합니다.

- New (새로 만들기)를 클릭합니다.

- 스케줄링 정책에 Name (이름) 및 Description (설명)을 입력합니다.

필터 모듈을 구성합니다.

- Filter Modules (모듈 필터) 섹션에서 선호하는 필터 모듈을 드래그 앤 드롭하여 Disabled Filters (비활성화된 필터) 섹션에서 스케줄링 정책에 적용합니다.

- 특정 필터 모듈도 기본 최적화를 위해 우선 순위가 가장 높은 첫 번째 또는 가장 낮은 우선 순위를 부여할 수 있습니다. 우선 순위를 설정하려면 필터 모듈을 마우스 오른쪽 단추로 클릭하고 위치 위에 커서를 두고 First 또는 Last 를 선택합니다.

가중치 모듈을 구성합니다.

- Weights 모듈 섹션에서 선호하는 weight 모듈을 드래그 앤 드롭하여 Disabled Weights (비활성화된 가중치) 섹션에서 스케줄링 정책에 적용할 수 있습니다.

- 활성화된 weight 모듈의 왼쪽에 + 및 - 버튼을 사용하여 해당 모듈의 가중치를 늘리거나 줄입니다.

로드 밸런싱 정책을 지정합니다.

- Load Balancer (로드 밸런서 로드) 섹션의 드롭다운 메뉴에서 스케줄링 정책에 적용할 로드 밸런싱 정책을 선택합니다.

- Properties (속성) 섹션의 드롭다운 메뉴에서 스케줄링 정책에 적용할 로드 밸런싱 속성을 선택하고 해당 속성의 오른쪽에 텍스트 필드를 사용하여 값을 지정합니다.

- + 및 - 버튼을 사용하여 추가 속성을 추가하거나 제거합니다.

- OK(확인)를 클릭합니다.

1.1.3.2. 새 스케줄링 정책의 설정 설명 및 스케줄링 정책 편집 창

다음 표에는 New Scheduling Policy(새 스케줄링 정책) 및 Edit Scheduling Policy (스케줄링 정책 편집) 창에서 사용할 수 있는 옵션이 자세히 나와 있습니다.

표 1.12. 새 스케줄링 정책 및 스케줄링 정책 편집

| 필드 이름 | 설명 |

|---|---|

| 이름 | 스케줄링 정책의 이름입니다. Red Hat Virtualization Manager의 스케줄링 정책을 참조하는 데 사용되는 이름입니다. |

| 설명 | 스케줄링 정책에 대한 설명입니다. 이 필드는 권장되지만 필수는 아닙니다. |

| 필터 모듈 | 클러스터의 가상 시스템을 실행할 수 있는 호스트를 제어하는 필터 집합입니다. 필터를 활성화하면 아래에 설명된 대로 해당 필터에서 지정한 조건을 충족하지 않는 호스트를 필터링합니다.

|

| weights 모듈 | 가상 시스템이 실행할 수 있는 클러스터의 호스트를 결정할 때 고려하는 요인의 상대 우선 순위를 제어하는 가중치 집합입니다.

|

| 로드 밸런서 | 이 드롭다운 메뉴에서 적용할 부하 분산 모듈을 선택할 수 있습니다. 부하 분산 모듈은 사용량이 낮은 호스트에서 가상 시스템을 마이그레이션하는 데 사용되는 논리를 판별합니다. |

| 속성 | 이 드롭다운 메뉴를 사용하면 부하 분산 모듈의 속성을 추가하거나 제거할 수 있으며 스케줄링 정책에 대한 부하 분산 모듈을 선택한 경우에만 사용할 수 있습니다. 속성은 기본적으로 정의되지 않으며 사용 가능한 속성은 선택한 부하 분산 모듈에 따라 다릅니다. + 및 - 버튼을 사용하여 부하 분산 모듈에 추가 속성을 추가하거나 제거합니다. |

1.1.4. 인스턴스 유형

인스턴스 유형을 사용하여 가상 시스템의 하드웨어 구성을 정의할 수 있습니다. 가상 시스템을 만들거나 편집할 때 인스턴스 유형을 선택하면 하드웨어 구성 필드가 자동으로 채워집니다. 이를 통해 사용자는 모든 필드를 수동으로 입력하지 않고도 동일한 하드웨어 구성을 사용하여 여러 가상 시스템을 만들 수 있습니다.

인스턴스 유형에 대한 지원은 더 이상 사용되지 않으며 향후 릴리스에서 제거됩니다.

다음 표에 설명된 대로 사전 정의된 인스턴스 유형 집합은 기본적으로 사용할 수 있습니다.

표 1.13. 사전 정의된 인스턴스 유형

| 이름 | 메모리 | vCPU |

|---|---|---|

| 작음 | 512MB | 1 |

| 소 | 2GB | 1 |

| 중간 | 4GB | 2 |

| 대 | 8GB | 2 |

| XLarge | 16GB | 4 |

관리자는 Configure (구성) 창의 Instance Types(인스턴스 유형) 탭에서 인스턴스 유형을 생성, 편집 및 제거할 수도 있습니다.

새 가상 머신 의 필드 및 인스턴스 유형에 바인딩된 가상 머신 창 편집 에는 해당 필드(

) 옆에 체인 링크 이미지가 있습니다. 이러한 필드 중 하나의 값이 변경되면 가상 머신이 인스턴스 유형에서 분리되고 사용자 정의로 변경하면 체인이 손상됩니다(

) 옆에 체인 링크 이미지가 있습니다. 이러한 필드 중 하나의 값이 변경되면 가상 머신이 인스턴스 유형에서 분리되고 사용자 정의로 변경하면 체인이 손상됩니다(

). 그러나 값이 다시 변경되면 체인이 다시 연결되고 인스턴스 유형이 선택한 항목으로 다시 이동합니다.

). 그러나 값이 다시 변경되면 체인이 다시 연결되고 인스턴스 유형이 선택한 항목으로 다시 이동합니다.

1.1.4.1. 인스턴스 유형 생성

관리자는 가상 시스템을 만들거나 편집할 때 사용자가 선택할 수 있는 새 인스턴스 유형을 만들 수 있습니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- Instance Types(인스턴스 유형 ) 탭을 클릭합니다.

- New (새로 만들기)를 클릭합니다.

- 인스턴스 유형에 Name (이름) 및 Description (설명)을 입력합니다.

- Show Advanced Options (고급 옵션 표시)를 클릭하고 필요에 따라 인스턴스 유형 설정을 구성합니다. New Instance Type(새 인스턴스 유형) 창에 표시되는 설정은 New Virtual Machine(새 가상 시스템 ) 창에 있는 설정과 동일하지만 관련 필드만 사용됩니다. 가상 머신 관리 가이드에서 새 가상 머신 및 가상 머신 편집의 설정 설명을 참조하십시오.

- OK(확인)를 클릭합니다.

새 인스턴스 유형은 Configure (구성) 창의 Instance Types(인스턴스 유형 ) 탭에 표시되며, 가상 시스템을 만들거나 편집할 때 Instance Type(인스턴스 유형) 드롭다운 목록에서 선택할 수 있습니다.

1.1.4.2. 인스턴스 유형 편집

관리자는 Configure (구성) 창에서 기존 인스턴스 유형을 편집할 수 있습니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- Instance Types(인스턴스 유형 ) 탭을 클릭합니다.

- 편집할 인스턴스 유형을 선택합니다.

- Edit(편집 )를 클릭합니다.

- 필요에 따라 설정을 변경합니다.

- OK(확인)를 클릭합니다.

인스턴스 유형의 구성이 업데이트됩니다. 이 인스턴스 유형을 기반으로 하는 새 가상 시스템이 생성되거나 이 인스턴스 유형에 따라 기존 가상 시스템이 업데이트되면 새 구성이 적용됩니다.

이 인스턴스 유형을 기반으로 하는 기존 가상 시스템은 업데이트될 체인 아이콘으로 표시된 필드가 표시됩니다. 인스턴스 유형이 변경될 때 기존 가상 시스템이 실행 중인 경우, 인스턴스 유형에 따라 Pending Changes(보류 중인 변경 사항) 아이콘이 표시되고 체인 아이콘이 있는 필드가 다음 다시 시작할 때 업데이트됩니다.

1.1.4.3. 인스턴스 유형 제거

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- Instance Types(인스턴스 유형 ) 탭을 클릭합니다.

- 제거할 인스턴스 유형을 선택합니다.

- Remove(제거)를 클릭합니다.

- 제거할 인스턴스 유형을 기반으로 하는 가상 머신이 있는 경우 연결된 가상 머신을 나열하는 경고 창이 표시됩니다. 인스턴스 유형을 계속 제거하려면 Approve Operation(작업 승인 ) 확인란을 선택합니다. 그렇지 않으면 Cancel(취소)을 클릭합니다.

- OK(확인)를 클릭합니다.

인스턴스 유형은 Instance Types(인스턴스 유형) 목록에서 제거되며 새 가상 머신을 만들 때 더 이상 사용할 수 없습니다. 제거된 인스턴스 유형에 연결된 가상 머신은 이제 Custom (인스턴스 유형 없음)에 연결됩니다.

1.1.5. MAC 주소 풀

MAC 주소 풀은 각 클러스터에 할당된 MAC 주소의 범위를 정의합니다. 각 클러스터에 대해 MAC 주소 풀이 지정됩니다. Red Hat Virtualization은 MAC 주소 풀을 사용하여 새 가상 네트워크 장치에 MAC 주소를 자동으로 생성하고 할당할 수 있으므로 MAC 주소 중복을 방지할 수 있습니다. 클러스터와 관련된 모든 MAC 주소가 할당된 MAC 주소 풀의 범위 내에 있을 때 MAC 주소 풀이 더 메모리가 더 효율적입니다.

동일한 MAC 주소 풀을 여러 클러스터에서 공유할 수 있지만 각 클러스터에는 단일 MAC 주소 풀이 할당됩니다. 기본 MAC 주소 풀은 Red Hat Virtualization에서 생성하며 다른 MAC 주소 풀이 할당되지 않은 경우 사용됩니다. 클러스터에 MAC 주소 풀을 할당하는 방법에 대한 자세한 내용은 새 클러스터 생성을 참조하십시오.

두 개 이상의 Red Hat Virtualization 클러스터가 네트워크를 공유하는 경우 각 클러스터의 가상 머신이 동일한 범위의 MAC 주소를 사용하여 충돌하기 때문에 기본 MAC 주소 풀에만 의존하지 마십시오. MAC 주소 충돌을 방지하려면 MAC 주소 풀 범위를 확인하여 각 클러스터에 고유한 MAC 주소 범위가 할당되어 있는지 확인합니다.

MAC 주소 풀은 풀에 반환된 마지막 주소 뒤에 사용 가능한 다음 MAC 주소를 할당합니다. 범위에 더 이상 남은 주소가 없으면 범위의 처음부터 검색을 다시 시작합니다. 단일 MAC 주소 풀에 정의된 사용 가능한 MAC 주소가 있는 여러 MAC 주소 범위가 있는 경우, 범위는 사용 가능한 MAC 주소를 선택하는 것과 동일한 방식으로 들어오는 요청을 처리합니다.

1.1.5.1. MAC 주소 풀 생성

새 MAC 주소 풀을 생성할 수 있습니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- MAC Address Pools(MA 주소 풀 ) 탭을 클릭합니다.

- 추가를 클릭합니다.

- 새 MAC 주소 풀의 Name (이름) 및 Description (설명)을 입력합니다.

MAC 주소를 풀에서 여러 번 사용할 수 있도록 Allow Duplicates (중복 허용) 확인란을 선택합니다. MAC 주소 풀은 중복 MAC 주소를 자동으로 사용하지 않지만 중복 옵션을 활성화하면 사용자가 중복 MAC 주소를 수동으로 사용할 수 있습니다.

참고하나의 MAC 주소 풀에 중복이 비활성화되어 있고 다른 하나는 중복이 활성화된 경우, 중복이 비활성화된 풀에서 각 MAC 주소를 한 번 사용할 수 있지만 중복이 활성화된 풀에서 여러 번 사용할 수 있습니다.

- 필요한 MAC 주소 범위를 입력합니다. 여러 범위를 시작하려면 From and To(다음에서 및 대상 ) 필드 옆의 더하기 버튼을 클릭합니다.

- OK(확인)를 클릭합니다.

1.1.5.2. MAC 주소 풀 편집

MAC 주소 풀을 편집하여 풀에서 사용할 수 있는 MAC 주소 범위 및 중복이 허용되는지 여부를 포함하여 세부 정보를 변경할 수 있습니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- MAC Address Pools(MA 주소 풀 ) 탭을 클릭합니다.

- 편집할 MAC 주소 풀을 선택합니다.

- Edit(편집 )를 클릭합니다.

Name (이름),Description (설명),Allow Duplicates (배포 허용) 및 MAC Address Ranges(MAC 주소 범위) 필드를 필요에 따라 변경합니다.

참고MAC 주소 범위가 업데이트되면 기존 NIC의 MAC 주소가 다시 할당되지 않습니다. 이미 할당되었지만 새로운 MAC 주소 범위를 벗어나는 MAC 주소는 사용자 지정 MAC 주소로 추가되며 해당 MAC 주소 풀에서 계속 추적됩니다.

- OK(확인)를 클릭합니다.

1.1.5.3. MAC 주소 풀 권한 편집

MAC 주소 풀을 만들고 나면 사용자 권한을 편집할 수 있습니다. 사용자 권한은 MAC 주소 풀을 사용할 수 있는 데이터 센터를 제어합니다. 새 사용자 권한을 추가하는 방법에 대한 자세한 내용은 역할을 참조하십시오.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- MAC Address Pools(MA 주소 풀 ) 탭을 클릭합니다.

- 필수 MAC 주소 풀을 선택합니다.

MAC 주소 풀에 대한 사용자 권한을 편집합니다.

MAC 주소 풀에 사용자 권한을 추가하려면 다음을 수행합니다.

- Configure(구성) 창의 아래쪽에 있는 사용자 권한 창에서 Add (추가)를 클릭합니다.

- 필요한 사용자를 검색하고 선택합니다.

- Role to Assign (할당으로 역할) 드롭다운 목록에서 필요한 역할을 선택합니다.

- OK(확인 )를 클릭하여 사용자 권한을 추가합니다.

MAC 주소 풀에서 사용자 권한을 제거하려면 다음을 수행합니다.

- Configure (구성) 창의 하단에 있는 사용자 권한 창에서 제거할 사용자 권한을 선택합니다.

- Remove(제거 )를 클릭하여 사용자 권한을 제거합니다.

1.1.5.4. MAC 주소 풀 제거

풀이 클러스터와 연결되어 있지 않지만 기본 MAC 주소 풀을 제거할 수 없는 경우 생성된 MAC 주소 풀을 제거할 수 있습니다.

절차

- Administration(관리) Configure(구성 ) 를 클릭합니다.

- MAC Address Pools(MA 주소 풀 ) 탭을 클릭합니다.

- 제거할 MAC 주소 풀을 선택합니다.

- Remove (제거)를 클릭합니다.

- OK(확인)를 클릭합니다.

1.2. 대시보드

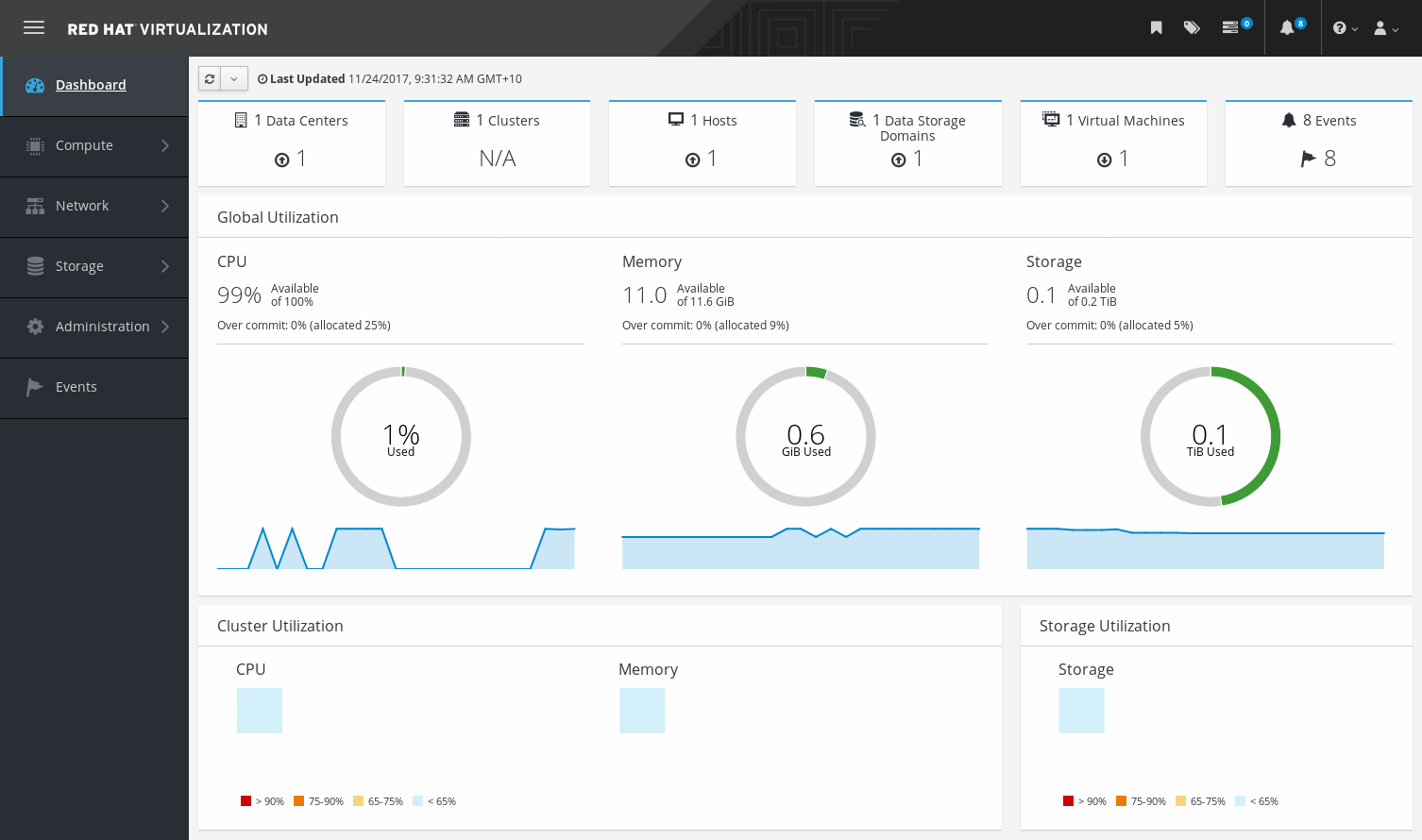

대시보드는 Red Hat Virtualization의 리소스 및 사용률에 대한 요약을 표시하여 Red Hat Virtualization 시스템 상태에 대한 개요를 제공합니다. 이 요약을 통해 문제에 대해 알리고 문제 영역을 분석할 수 있습니다.

대시보드의 정보는 기본적으로 데이터 웨어하우스에서 15분마다 업데이트되며, 기본적으로 Manager API에서 15초마다 업데이트되거나 대시보드가 새로 고쳐질 때마다 업데이트됩니다. 사용자가 다른 페이지에서 다시 변경하거나 수동으로 새로 고침하면 대시보드가 새로 고쳐집니다. 대시보드가 자동으로 새로 고쳐지지 않습니다. 인벤토리 카드 정보는 관리자 API에서 제공하며, 데이터 웨어하우스에서 사용률 정보를 제공합니다. 대시보드는 Manager와 함께 자동으로 설치 및 업그레이드되는 UI 플러그인 구성 요소로 구현됩니다.

그림 1.6. 대시보드

1.2.1. 사전 요구 사항

대시보드를 사용하려면 데이터 웨어하우스가 설치 및 구성되어 있어야 합니다. 데이터 웨어하우스 가이드의 데이터 웨어하우스 설치 및 구성을 참조하십시오.

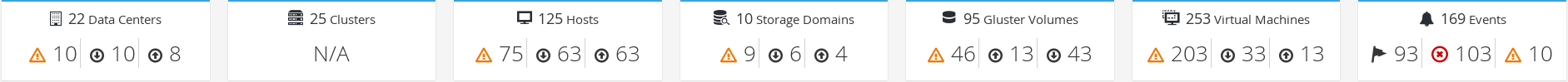

1.2.2. 글로벌 인벤토리

대시보드의 상단 섹션에서는 Red Hat Virtualization 리소스의 글로벌 인벤토리를 제공하며 데이터 센터, 클러스터, 호스트, 스토리지 도메인, 가상 시스템 및 이벤트에 대한 항목을 포함합니다. 아이콘은 각 리소스의 상태를 표시하고 숫자에는 해당 상태가 있는 각 리소스의 수량이 표시됩니다.

그림 1.7. 글로벌 인벤토리

제목은 리소스 유형의 수를 표시하며, 해당 상태는 제목 아래에 표시됩니다. 리소스 제목을 클릭하면 Red Hat Virtualization Manager의 관련 페이지로 이동합니다. 클러스터 의 상태는 항상 N/A로 표시됩니다.

표 1.14. 리소스 상태

| 아이콘 | 상태 |

|---|---|

|

| Red Hat Virtualization에 추가된 리소스가 없습니다. |

|

| 경고 상태의 리소스 수를 표시합니다. 아이콘을 클릭하면 경고 상태로 해당 리소스로 제한된 검색이 있는 적절한 페이지로 이동합니다. 검색은 리소스마다 다르게 제한됩니다.

|

|

| 상태가 up인 리소스 수를 표시합니다. 아이콘을 클릭하면 작동 중인 리소스로 제한된 검색으로 적절한 페이지로 이동합니다. |

|

| 상태가 down인 리소스 수를 표시합니다. 아이콘을 클릭하면 down 상태로 리소스로 제한된 검색을 사용하여 적절한 페이지로 이동합니다. 검색은 리소스마다 다르게 제한됩니다.

|

| images:images/Dashboard_Alert.png[title="Alert icon"] | 경고 상태가 있는 이벤트 수를 표시합니다. 아이콘을 클릭하면 심각도가 alert인 이벤트로 제한된 검색이 있는 이벤트로 이동합니다. |

| images:images/Dashboard_Error.png[title="Error icon"] | 오류 상태의 이벤트 수를 표시합니다. 아이콘을 클릭하면 심각도가 error인 이벤트로 제한된 검색이 있는 Events 로 이동합니다. |

1.2.3. 글로벌 사용률

Global Utilization(글로벌 사용률 ) 섹션에는 CPU, Memory, Storage(메모리 및 스토리지)의 시스템 사용률이 표시됩니다.

그림 1.8. 글로벌 사용률

- top 섹션에서는 사용 가능한 CPU, 메모리 또는 스토리지의 백분율과 오버 커밋 비율을 보여줍니다. 예를 들어, CPU의 오버 커밋 비율은 데이터 웨어하우스의 최신 데이터에 따라 실행 중인 가상 머신에 사용 가능한 물리적 코어 수를 가상 코어 수를 나누어 계산합니다.

- 도넛은 CPU, 메모리 또는 스토리지의 사용량(%)을 표시하고, 지난 5분 동안 평균 사용량에 따라 모든 호스트의 평균 사용량을 표시합니다. 도넛의 섹션을 가리키면 선택한 섹션의 값이 표시됩니다.

- 하단의 줄 그래프에는 지난 24시간 동안 추세가 표시됩니다. 각 데이터 지점에는 특정 시간 동안 평균 사용량이 표시됩니다. 그래프에서 지점을 가리키면 CPU 그래프에 사용된 시간과 백분율, 메모리 및 스토리지 그래프의 사용량 양이 표시됩니다.

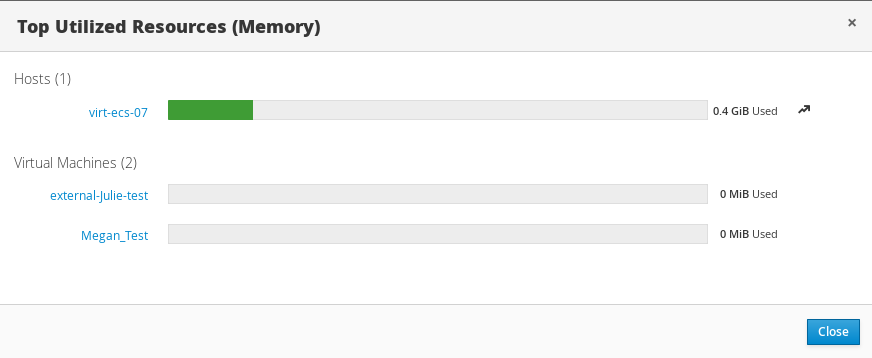

1.2.3.1. 사용률 상위 리소스

그림 1.9. 사용률 상위 리소스 (Memory)

대시보드의 글로벌 사용률 섹션에서 도넛을 클릭하면 CPU, 메모리 또는 스토리지에 가장 많이 사용되는 리소스 목록이 표시됩니다. CPU 및 메모리의 경우 팝업에는 사용량이 가장 높은 10개의 호스트와 가상 시스템 목록이 표시됩니다. 스토리지의 경우 팝업에는 사용된 상위 10개 스토리지 도메인 및 가상 시스템 목록이 표시됩니다. 사용 표시줄 오른쪽에 있는 화살표는 해당 리소스의 사용 추세를 최근 1분 내에 표시합니다.

1.2.4. 클러스터 사용률

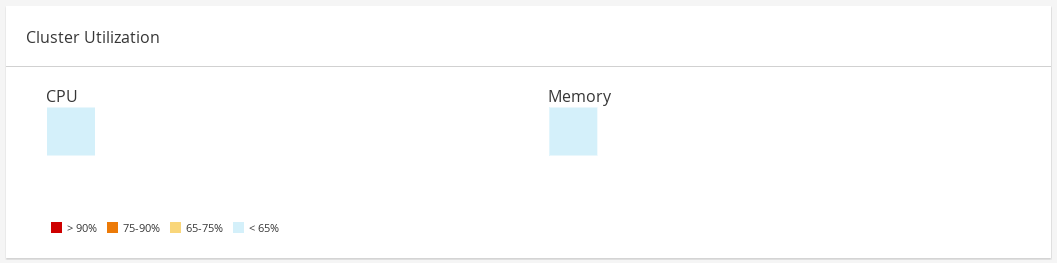

Cluster Utilization(클러스터 사용률 ) 섹션에는 heatmap의 CPU 및 메모리의 클러스터 사용률이 표시됩니다.

그림 1.10. 클러스터 사용률

1.2.4.1. CPU

지난 24시간 동안 CPU의 평균 사용률을 보여주는 특정 클러스터에 대한 CPU 사용률의 heatmap입니다. heatmap을 가리키면 클러스터 이름이 표시됩니다. heatmap을 클릭하면 Compute → Hosts(호스트) 로 이동하여 CPU 사용률에 따라 정렬된 특정 클러스터에서 검색 결과가 표시됩니다. 클러스터의 CPU 사용량을 계산하는 데 사용되는 공식은 클러스터의 평균 호스트 CPU 사용률입니다. 이는 클러스터의 CPU 총 사용량을 찾기 위해 지난 24시간 동안 각 호스트에 대한 평균 호스트 CPU 사용률을 사용하여 계산됩니다.

1.2.4.2. 메모리

마지막 24시간 동안 메모리의 평균 사용률을 보여주는 특정 클러스터에 대한 메모리 사용률의 heatmap입니다. heatmap을 가리키면 클러스터 이름이 표시됩니다. heatmap을 클릭하면 Compute → Hosts(호스트) 로 이동하여 메모리 사용량에 따라 정렬된 특정 클러스터에 대한 검색 결과가 표시됩니다. 클러스터의 메모리 사용량을 계산하는 데 사용되는 공식은 클러스터의 메모리 총 사용률(GB)입니다. 이는 마지막 24시간 동안 각 호스트에 대한 평균 호스트 메모리 사용률을 사용하여 클러스터의 총 메모리 사용량을 찾아 계산합니다.

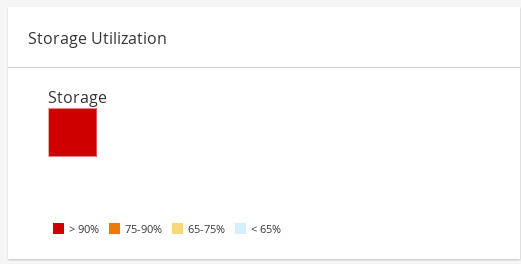

1.2.5. 스토리지 사용률

Storage Utilization(스토리지 사용률 ) 섹션에는 heatmap의 스토리지 사용률이 표시됩니다.

그림 1.11. 스토리지 사용률

heatmap은 지난 24시간 동안 스토리지의 평균 사용률을 보여줍니다. 클러스터의 스토리지 사용량을 계산하는 데 사용하는 공식은 클러스터의 스토리지 총 사용률입니다. 이는 클러스터의 스토리지 총 사용량을 찾기 위해 지난 24시간 동안 각 호스트의 평균 스토리지 사용률을 사용하여 계산됩니다. heatmap을 가리키면 스토리지 도메인 이름이 표시됩니다. heatmap을 클릭하면 사용률에 따라 정렬된 스토리지 도메인을 사용하여 StorageDomains (스토리지 도메인)로 이동합니다.

1.3. 검색

1.3.1. Red Hat Virtualization에서 검색 수행

관리 포털을 사용하면 가상 시스템, 호스트, 사용자 등 수천 개의 리소스를 관리할 수 있습니다. 검색을 수행하려면 검색 쿼리(무료 텍스트 또는 구문 기반)를 검색 표시줄에 입력합니다(각 리소스의 기본 페이지에서 사용 가능). 검색 쿼리는 향후 재사용을 위해 북마크로 저장될 수 있으므로 특정 검색 결과가 필요할 때마다 검색 쿼리를 다시 입력할 필요가 없습니다. 검색은 대소문자를 구분하지 않습니다.

1.3.2. 구문 및 예제 검색

Red Hat Virtualization 리소스에 대한 검색 쿼리 구문은 다음과 같습니다.

결과 유형: {critœ} [sortby sort_spec]

구문 예

다음 예제에서는 검색 쿼리를 사용하는 방법을 설명하고 Red Hat Virtualization이 검색 쿼리 구축을 지원하는 방법을 이해하는 데 도움이 됩니다.

표 1.15. 검색 쿼리 예

| 예제 | 결과 |

|---|---|

| 호스트: VMs.status = 페이지 위로 2 | 작동 중인 가상 시스템을 실행하는 모든 호스트 목록의 2페이지를 표시합니다. |

| VM: domain = qa.company.com | 지정된 도메인에서 실행 중인 모든 가상 시스템 목록을 표시합니다. |

| VM: users.name = | 사용자 이름에 속하는 모든 가상 시스템 목록을 표시합니다. |

| 이벤트: 심각도 > 일반 정렬 | 심각도가 Normal 이상인 모든 이벤트 목록을 표시하고 시간별로 정렬됩니다. |

1.3.3. 자동 완성 검색

관리 포털은 자동 완성 기능을 제공하여 유효하고 강력한 검색 쿼리 생성에 도움이 됩니다. 검색 쿼리의 각 부분을 입력하면 검색바에서 다음 검색 부분에 대한 선택 드롭다운 목록이 열립니다. 목록에서 선택한 다음 검색의 다음 부분을 계속 입력/선택하거나 옵션을 무시하고 수동으로 쿼리를 입력할 수 있습니다.

다음 테이블에서는 관리 포털을 자동 완성하는 방법을 예제로 지정합니다.

호스트: VMs.status = down

표 1.16. 자동 완성을 사용하여 검색 쿼리의 예

| 입력 | 표시된 항목 나열 | 동작 |

|---|---|---|

| h |

|

|

| 호스트: | 모든 호스트 속성 | 유형 v |

| 호스트: v |

|

|

| 호스트: Vms | 모든 가상 머신 속성 | s입력 |

| 호스트: VMs.s |

모든 가상 머신 속성은 |

|

| 호스트: Vms.status |

| 선택 또는 유형 = |

| 호스트: Vms.status = | 모든 상태 값 | 선택 또는 입력 |

1.3.4. 결과 검색 유형 옵션

결과 유형을 사용하면 다음 유형의 리소스를 검색할 수 있습니다.

- 가상 머신 목록 의 VM

- 호스트 목록의 호스트

- 풀 목록의 풀

- 템플릿 목록의 템플릿

- 이벤트 목록 이벤트

- 사용자 목록 사용자

- 클러스터 목록의 클러스터

- 데이터 센터 목록의 데이터센터

- 스토리지 도메인 목록 스토리지

각 리소스 유형에는 고유한 속성 집합과 연결된 다른 리소스 유형 집합이 있으므로 각 검색 유형에는 유효한 구문 조합 세트가 있습니다. 자동 완성 기능을 사용하여 유효한 쿼리를 쉽게 만들 수도 있습니다.

1.3.5. 검색 기준

쿼리에서 콜론 뒤에 검색 기준을 지정할 수 있습니다. {critœ} 구문은 다음과 같습니다.

<prop><operator><value>

또는

<obj-type><prop><operator><value>

예

다음 표에서는 구문의 부분을 설명합니다.

표 1.17. 검색 기준 예

| 부분 | 설명 | 값 | 예제 | 참고 |

|---|---|---|---|---|

| prop |

searched-for 리소스의 속성입니다. 또한 리소스 유형의 속성일 수도 있고( | 특정 속성을 사용하여 개체로 검색을 제한합니다. 예를 들어 status 속성이 있는 오브젝트를 검색합니다. | 상태 | 해당 없음 |

| obj-type | searched-for 리소스와 연결할 수 있는 리소스 유형입니다. | 데이터 센터 및 가상 시스템과 같은 시스템 오브젝트입니다. | 사용자 | 해당 없음 |

| operator | 비교 연산자. | = != (동일하지 않음) > < >= <= | 해당 없음 | 값 옵션은 속성에 따라 다릅니다. |

| 현재의 | 표현식을 와 비교합니다. | 문자열 정수 순위 날짜(지역 설정에 따라 포맷됨) | 마케도니아 256 보통 |

|

1.3.6. 검색: 다중 기준 및 와일드카드

와일드카드는 문자열의 구문의 <value> 부분에서 사용할 수 있습니다. 예를 들어 m으로 시작하는 모든 사용자를 찾으려면 m * 을 입력합니다.

부울 연산자 및 OR 을 사용하여 두 가지 기준을 검색할 수 있습니다. 예를 들면 다음과 같습니다.

VM: users.name = m* and status = Up

이 쿼리는 이름이 "m"으로 시작하는 사용자에 대해 실행 중인 모든 가상 시스템을 반환합니다.

VMs: users.name = m* AND tag = "paris-loc"

이 쿼리는 이름이 "m"으로 시작하는 사용자에 대해 "paris-loc" 태그가 지정된 모든 가상 머신을 반환합니다.

AND 또는 OR 없이 두 가지 기준을 지정하는 경우AND 가 암시됩니다. OR, 또는 우선 순위 및 우선 순위.

1.3.7. 검색: 검색 순서 확인

sortby 를 사용하여 반환된 정보의 정렬 순서를 확인할 수 있습니다. 정렬 방향(오름차순의 경우asc, 내림차순의 경우 desc )을 포함할 수 있습니다.

예를 들면 다음과 같습니다.

이벤트: severity > normal sortby time desc

이 쿼리는 심각도가 Normal 이상인 모든 이벤트를 반환하고, 시간별로 정렬(준비 순서)을 반환합니다.

1.3.8. 데이터 센터 검색

다음 표에는 데이터 센터의 모든 검색 옵션이 설명되어 있습니다.

표 1.18. 데이터 센터 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 데이터 센터와 연결된 클러스터의 속성입니다. |

|

| 문자열 | 데이터 센터의 이름입니다. |

|

| 문자열 | 데이터 센터에 대한 설명입니다. |

|

| 문자열 | 데이터 센터의 유형. |

|

| list | 데이터 센터의 가용성. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

datacenter: type = nfs 및 status != up

이 예제에서는 스토리지 유형이 NFS이고 up 이외의 상태가 있는 데이터 센터 목록을 반환합니다.

1.3.9. 클러스터 검색

다음 테이블에서는 클러스터의 모든 검색 옵션에 대해 설명합니다.

표 1.19. 클러스터 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 클러스터와 연결된 데이터 센터의 속성입니다. |

|

| 문자열 | 클러스터가 속한 데이터 센터입니다. |

|

| 문자열 | 네트워크에서 클러스터를 식별하는 고유 이름입니다. |

|

| 문자열 | 클러스터에 대한 설명입니다. |

|

| 문자열 | 참 또는 False는 클러스터 상태를 나타냅니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

클러스터: initialized = true 또는 name = Default

이 예에서는 초기화되거나 이름이 Default인 클러스터 목록을 반환합니다.

1.3.10. 호스트 검색

다음 테이블에서는 호스트에 대한 모든 검색 옵션을 설명합니다.

표 1.20. 호스트 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 호스트와 연결된 가상 시스템의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 호스트와 연결된 템플릿의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 호스트와 연결된 이벤트의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 호스트와 연결된 사용자의 속성입니다. |

|

| 문자열 | 호스트의 이름입니다. |

|

| list | 호스트의 가용성. |

|

| 문자열 | 외부 시스템 및 플러그인에서 보고한 호스트의 상태입니다. |

|

| 문자열 | 호스트가 속한 클러스터입니다. |

|

| 문자열 | 네트워크에서 호스트를 식별하는 고유 이름입니다. |

|

| 정수 | 사용된 처리 능력의 백분율. |

|

| 정수 | 사용된 메모리의 백분율입니다. |

|

| 정수 | 네트워크 사용량의 백분율입니다. |

|

| 정수 | 지정된 시간 슬라이스당 프로세서당 실행 대기열 에서 실행되도록 대기 중인 작업. |

|

| 정수 | 운영 체제의 버전 번호입니다. |

|

| 정수 | 호스트의 CPU 수입니다. |

|

| 정수 | 사용 가능한 메모리 양입니다. |

|

| 정수 | CPU의 처리 속도입니다. |

|

| 문자열 | CPU 유형입니다. |

|

| 정수 | 현재 실행 중인 가상 시스템의 수입니다. |

|

| 정수 | 현재 마이그레이션 중인 가상 시스템의 수입니다. |

|

| 정수 | 커밋된 메모리의 백분율입니다. |

|

| 문자열 | 호스트에 할당된 태그입니다. |

|

| 문자열 | 호스트 유형입니다. |

|

| 문자열 | 호스트가 속한 데이터 센터입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

hosts: cluster = Default 및 Vms.os = rhel6

이 예제에서는 Red Hat Enterprise Linux 6 운영 체제를 실행하는 Default 클러스터 및 호스트 가상 시스템의 일부인 호스트 목록을 반환합니다.

1.3.11. 네트워크 검색

다음 테이블에서는 네트워크의 모든 검색 옵션에 대해 설명합니다.

표 1.21. 네트워크 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 네트워크와 연결된 클러스터의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 네트워크와 연결된 호스트의 속성입니다. |

|

| 문자열 | 사람이 읽을 수 있는 네트워크를 식별하는 이름입니다. |

|

| 문자열 | 네트워크를 설명하는 키워드 또는 텍스트로, 네트워크를 만들 때 선택적으로 사용됩니다. |

|

| 정수 | 네트워크의 VLAN ID입니다. |

|

| 문자열 | 네트워크에 대해 STP(Spanning Tree Protocol)를 활성화하거나 비활성화할지 여부입니다. |

|

| 정수 | 논리적 네트워크의 최대 전송 단위입니다. |

|

| 문자열 | 네트워크가 가상 시스템 트래픽에만 사용되는지 여부. |

|

| 문자열 | 네트워크를 연결하는 데이터 센터입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

Network: mtu > 1500 and vmnetwork = true

이 예제에서는 최대 전송 단위가 1500바이트보다 크며 가상 시스템에서만 사용하도록 설정된 네트워크 목록을 반환합니다.

1.3.12. 스토리지 검색

다음 테이블에서는 스토리지의 모든 검색 옵션에 대해 설명합니다.

표 1.22. 스토리지 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 스토리지와 연결된 호스트의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 스토리지와 연결된 클러스터의 속성입니다. |

|

| 문자열 | 네트워크에서 스토리지를 식별하는 고유 이름입니다. |

|

| 문자열 | 스토리지 도메인의 상태. |

|

| 문자열 | 외부 시스템 및 플러그인에서 보고한 스토리지 도메인의 상태입니다. |

|

| 문자열 | 스토리지가 속한 데이터 센터입니다. |

|

| 문자열 | 스토리지 유형입니다. |

|

| 정수 | 사용 가능한 스토리지의 크기(GB). |

|

| 정수 | 사용되는 스토리지의 양(GB)입니다. |

|

| 정수 | 사용 가능한 스토리지의 총 용량(GB). |

|

| 정수 | 커밋된 스토리지의 양(GB)입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

스토리지: free_size > 6 GB 및 total_size < 20 GB

이 예에서는 사용 가능한 스토리지 공간이 6GB보다 크거나 총 스토리지 공간이 20GB 미만인 스토리지 목록을 반환합니다.

1.3.13. 디스크 검색

다음 테이블에서는 디스크의 모든 검색 옵션에 대해 설명합니다.

디스크 유형 및 필터링 옵션을 사용하여 표시된 가상 디스크 수를 줄일 수 있습니다.

콘텐츠 유형

표 1.23. 디스크 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 디스크와 연결된 데이터 센터의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 디스크와 연결된 스토리지의 속성입니다. |

|

| 문자열 | 네트워크에서 스토리지를 식별하는 사람이 읽을 수 있는 이름입니다. |

|

| 문자열 | 디스크를 설명하는 키워드 또는 텍스트(디스크 생성 시 선택적으로 사용됩니다. |

|

| 정수 | 디스크의 가상 크기입니다. |

|

| 정수 | 디스크 크기입니다. |

|

| 정수 | 디스크에 할당된 실제 크기입니다. |

|

| 정수 | 디스크를 만든 날짜입니다. |

|

| 문자열 |

디스크를 부팅할 수 있는지 또는 부팅할 수 있는지 여부입니다. 유효한 값은 |

|

| 문자열 |

디스크를 한 번에 둘 이상의 가상 머신에 연결할 수 있는지 여부입니다. 유효한 값은 |

|

| 문자열 |

디스크 형식입니다. |

|

| 문자열 |

디스크 상태입니다. |

|

| 문자열 |

디스크 유형입니다. |

|

| 정수 | 디스크가 연결된 가상 시스템의 수입니다. |

|

| 문자열 | 디스크가 연결된 가상 시스템의 이름입니다. |

|

| 문자열 | 가상 디스크에 적용된 할당량의 이름입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

디스크: 형식 = cow 및 provisioned_size > 8

이 예에서는 QCOW 형식과 할당된 디스크 크기가 8GB보다 큰 가상 디스크 목록을 반환합니다.

1.3.14. 볼륨 검색

다음 표에는 볼륨에 대한 모든 검색 옵션이 설명되어 있습니다.

표 1.24. 볼륨 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 문자열 | 볼륨과 연결된 클러스터의 이름입니다. |

|

| 속성 유형에 따라 다릅니다(예: name, description, comment, architecture) | 볼륨과 연결된 클러스터의 속성입니다. |

|

| 문자열 | 사람이 읽을 수 있는 볼륨을 식별하는 이름입니다. |

|

| 문자열 | 배포, 복제, distributed_replicate, 스트라이프 또는 distributed_stripe 중 하나일 수 있습니다. |

|

| 정수 | TCP 또는 RDMA 중 하나일 수 있습니다. |

|

| 정수 | 복제본 수입니다. |

|

| 정수 | 스트라이프 수. |

|

| 문자열 | 볼륨 상태입니다. Up 또는 Down 중 하나일 수 있습니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

볼륨: transport_type = rdma 및 stripe_count >= 2

이 예에서는 전송 유형이 RDMA로 설정되어 있고 2개 이상의 스트라이프가 있는 볼륨 목록을 반환합니다.

1.3.15. 가상 머신 검색

다음 표에는 가상 시스템의 모든 검색 옵션이 설명되어 있습니다.

현재 Network Label(네트워크 레이블 ),Custom Emulated Machine (사용자 지정 에뮬레이션 시스템) 및 Custom CPU Type 속성은 지원되지 않습니다.

표 1.25. 가상 머신 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 가상 시스템과 연결된 호스트의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 가상 머신과 연결된 템플릿의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 가상 머신과 연결된 이벤트의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 가상 머신과 연결된 사용자의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 가상 머신과 연결된 스토리지 장치의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 가상 머신과 연결된 vNIC의 속성입니다. |

|

| 문자열 | 가상 시스템의 이름입니다. |

|

| list | 가상 시스템의 가용성. |

|

| 정수 | 가상 시스템의 IP 주소입니다. |

|

| 정수 | 가상 시스템이 실행 중인 분(분)입니다. |

|

| 문자열 | 이러한 시스템을 그룹화하는 도메인(일반적으로 Active Directory 도메인)입니다. |

|

| 문자열 | 가상 시스템이 생성될 때 선택한 운영 체제입니다. |

|

| 날짜 | 가상 시스템이 생성된 날짜입니다. |

|

| 문자열 | 네트워크에서 가상 시스템을 식별하는 고유 이름입니다. |

|

| 정수 | 사용된 처리 능력의 백분율. |

|

| 정수 | 사용된 메모리의 백분율입니다. |

|

| 정수 | 사용된 네트워크의 백분율입니다. |

|

| 정수 | 정의된 최대 메모리입니다. |

|

| 문자열 | 현재 가상 시스템에 설치된 애플리케이션입니다. |

|

| list | 가상 시스템이 속한 클러스터입니다. |

|

| list | 가상 시스템이 속한 가상 시스템 풀입니다. |

|

| 문자열 | 현재 가상 시스템에 로그인한 사용자의 이름입니다. |

|

| list | 가상 시스템이 속한 태그입니다. |

|

| 문자열 | 가상 시스템이 속한 데이터 센터입니다. |

|

| list | 가상 머신 유형(서버 또는 데스크탑). |

|

| 문자열 | 가상 머신과 연결된 할당량의 이름입니다. |

|

| 문자열 | 가상 시스템을 설명하는 키워드 또는 텍스트로, 가상 시스템을 생성할 때 선택적으로 사용됩니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

|

| 부울 | 가상 시스템에는 보류 중인 구성 변경 사항이 있습니다. |

예제

VM: template.name = Win* 및 user.name = ""

이 예제에서는 기본 템플릿 이름이 Win 으로 시작되어 사용자에게 할당되는 가상 시스템 목록을 반환합니다.

예제

VM: cluster = Default 및 os = windows7

이 예에서는 Default 클러스터에 속하고 Windows 7을 실행 중인 가상 머신 목록을 반환합니다.

1.3.16. 풀 검색

다음 표에는 풀의 모든 검색 옵션이 설명되어 있습니다.

표 1.26. 풀 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 문자열 | 풀의 이름입니다. |

|

| 문자열 | 풀에 대한 설명입니다. |

|

| list | 풀 유형입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

풀: type = automatic

이 예에서는 유형이 automatic인 풀 목록을 반환합니다 .

1.3.17. 템플릿 검색

다음 표에는 템플릿의 모든 검색 옵션이 설명되어 있습니다.

표 1.27. 템플릿 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 문자열 | 템플릿과 연결된 가상 시스템의 속성입니다. |

|

| 문자열 | 템플릿과 연결된 호스트의 속성입니다. |

|

| 문자열 | 템플릿과 연결된 이벤트의 속성입니다. |

|

| 문자열 | 템플릿과 연결된 사용자의 속성입니다. |

|

| 문자열 | 템플릿의 이름입니다. |

|

| 문자열 | 템플릿의 도메인입니다. |

|

| 문자열 | 운영 체제의 유형입니다. |

|

| 정수 | 템플릿을 만든 날짜입니다. 날짜 형식은mm /dd/y입니다. |

|

| 정수 | 템플릿에서 생성된 가상 시스템의 수입니다. |

|

| 정수 | 정의된 메모리. |

|

| 문자열 | 템플릿에 대한 설명입니다. |

|

| 문자열 | 템플릿의 상태입니다. |

|

| 문자열 | 템플릿과 연결된 클러스터입니다. |

|

| 문자열 | 템플릿과 연결된 데이터 센터입니다. |

|

| 문자열 | 템플릿과 연결된 할당량입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

템플릿: events.severity >= normal 및 Vms.uptime > 0

이 예제에서는 템플릿에서 파생된 가상 시스템에서 일반 또는 심각도가 높은 이벤트가 발생하고 가상 시스템이 여전히 실행 중인 템플릿 목록을 반환합니다.

1.3.18. 사용자 검색

다음 표에는 사용자의 모든 검색 옵션이 설명되어 있습니다.

표 1.28. 사용자 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 사용자와 연결된 가상 시스템의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 사용자와 연결된 호스트의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 사용자와 연결된 템플릿의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 사용자와 연결된 이벤트의 속성입니다. |

|

| 문자열 | 사용자 이름. |

|

| 문자열 | 사용자의 성. |

|

| 문자열 | 사용자의 고유 이름입니다. |

|

| 문자열 | 사용자가 속한 부서입니다. |

|

| 문자열 | 사용자가 속한 그룹입니다. |

|

| 문자열 | 사용자의 제목입니다. |

|

| 문자열 | 사용자 상태. |

|

| 문자열 | 사용자의 역할. |

|

| 문자열 | 사용자가 속한 태그입니다. |

|

| 문자열 | 사용자가 속한 풀입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

사용자: events.severity > normal 및 Vms.status = up 또는 Vms.status = pause

이 예에서는 가상 머신에서 일반 심각도보다 큰 이벤트가 발생하고 가상 시스템이 여전히 실행 중이거나 사용자의 가상 머신이 일시 중지된 사용자 목록을 반환합니다.

1.3.19. 이벤트 검색

다음 테이블에서는 이벤트를 검색하는 데 사용할 수 있는 모든 검색 옵션을 설명합니다. 적절한 여러 옵션에 자동 완성이 제공됩니다.

표 1.29. 이벤트 검색

| 속성(리소스 또는 리소스 유형) | 유형 | 설명 (참조) |

|---|---|---|

|

| 속성 유형에 따라 다릅니다. | 이벤트와 연결된 가상 시스템의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 이벤트와 연결된 호스트의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 이벤트와 연결된 템플릿의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 이벤트와 관련된 사용자의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 이벤트와 연결된 클러스터의 속성입니다. |

|

| 속성 유형에 따라 다릅니다. | 이벤트와 연결된 볼륨의 속성입니다. |

|

| list | 이벤트 유형입니다. |

|

| list | 이벤트 심각도: 경고/오류/Normal. |

|

| 문자열 | 이벤트 유형에 대한 설명입니다. |

|

| list | 이벤트가 발생한 날. |

|

| 문자열 | 이벤트와 연결된 사용자 이름입니다. |

|

| 문자열 | 이벤트와 연결된 호스트입니다. |

|

| 문자열 | 이벤트와 관련된 가상 머신입니다. |

|

| 문자열 | 이벤트와 연결된 템플릿입니다. |

|

| 문자열 | 이벤트와 관련된 스토리지입니다. |

|

| 문자열 | 이벤트와 관련된 데이터 센터입니다. |

|

| 문자열 | 이벤트와 연결된 볼륨입니다. |

|

| 정수 | 이벤트 식별 번호입니다. |

|

| list | 반환된 결과를 리소스 속성 중 하나로 정렬합니다. |

|

| 정수 | 표시할 페이지 결과 수입니다. |

예제

이벤트: VMs.name = testdesktop 및 Hosts.name = gonzo.example.com

이 예제에서는 이벤트 목록을 반환합니다. 여기서 호스트 gonzo.example.com 에서 실행 중 testdesktop 이라는 가상 머신에서 이벤트가 발생했습니다.

1.4. 북마크

1.4.1. 북마크로 쿼리 문자열 저장

북마크를 사용하여 검색 쿼리를 기억하고 다른 사용자와 공유할 수 있습니다.

절차

- 검색바에 원하는 검색 쿼리를 입력하고 검색을 수행합니다.

- 검색바 오른쪽에 있는 별표 북마크 버튼을 클릭합니다. 그러면 New Bookmark(새 북마크 ) 창이 열립니다.

- 북마크 의 이름을 입력합니다.

- 필요한 경우 Search string 필드를 편집합니다.

- OK(확인)를 클릭합니다.

헤더 표시줄에서 북마크 아이콘(

)을 클릭하여 북마크를 찾아 선택합니다.

)을 클릭하여 북마크를 찾아 선택합니다.

1.4.2. 북마크 편집

북마크의 이름 및 검색 문자열을 수정할 수 있습니다.

절차

-

헤더 표시줄에서 북마크 아이콘(

)을 클릭합니다.

)을 클릭합니다.

- 북마크를 선택하고 편집을 클릭합니다.

- Name(이름) 및 Search(검색) 문자열 필드를 필요에 따라 변경합니다.

- OK(확인)를 클릭합니다.

1.4.3. 북마크 삭제

북마크가 더 이상 필요하지 않으면 제거합니다.

절차

-

헤더 표시줄에서 북마크 아이콘(

)을 클릭합니다.

)을 클릭합니다.

- 북마크를 선택하고 Remove(제거 )를 클릭합니다.

- OK(확인)를 클릭합니다.

1.5. 태그

1.5.1. 태그를 사용하여 Red Hat Virtualization과의 상호 작용 사용자 정의

Red Hat Virtualization 플랫폼을 사용자의 요구 사항에 맞게 설정한 후 태그를 사용하여 작업 방식을 사용자 지정할 수 있습니다. 태그를 사용하면 시스템 리소스를 그룹 또는 범주로 정렬할 수 있습니다. 이는 가상화 환경에 많은 객체가 존재하고 관리자가 특정 객체 집합에 집중하고자 하는 경우에 유용합니다.

이 섹션에서는 태그를 생성 및 편집하고 호스트 또는 가상 시스템에 할당하며 태그를 기준으로 사용하여 검색하는 방법을 설명합니다. 태그는 기업의 요구 사항에 맞게 구조와 일치하는 계층 구조로 정렬할 수 있습니다.

관리 포털 태그를 생성, 수정 및 제거하려면 헤더 표시줄에서 태그 아이콘(

)을 클릭합니다.

)을 클릭합니다.

1.5.2. 태그 생성

태그를 사용하여 검색 결과를 필터링할 수 있도록 태그를 생성합니다.

절차

-

헤더 표시줄에서 태그 아이콘(

)을 클릭합니다.

)을 클릭합니다.

- Add(추가 )를 클릭하여 새 태그를 만들거나 태그를 선택하고 New (새로 만들기)를 클릭하여 하위 태그를 만듭니다.

- 새 태그의 Name (이름)과 Description (설명)을 입력합니다.

- OK(확인)를 클릭합니다.

1.5.3. 태그 수정

태그의 이름 및 설명을 편집할 수 있습니다.

태그 수정

-

헤더 표시줄에서 태그 아이콘(

)을 클릭합니다.

)을 클릭합니다.

- 수정할 태그를 선택하고 편집을 클릭합니다.

- 필요한 경우 Name (이름) 및 Description (설명) 필드를 변경합니다.

- OK(확인)를 클릭합니다.

1.5.4. 태그 삭제

태그가 더 이상 필요하지 않으면 제거합니다.

절차

-

헤더 표시줄에서 태그 아이콘(

)을 클릭합니다.

)을 클릭합니다.

- 삭제할 태그를 선택하고 Remove(제거 )를 클릭합니다. 태그를 제거하면 태그의 하위 항목도 모두 제거된다는 메시지가 표시됩니다.

- OK(확인)를 클릭합니다.

태그와 해당 하위 항목을 모두 제거했습니다. 태그는 연결된 모든 오브젝트에서도 제거됩니다.

1.5.5. 오브젝트에 태그 추가 및 제거

호스트, 가상 시스템 및 사용자의 태그를 에 할당하고 제거할 수 있습니다.

절차

- 태그를 지정하거나 태그 취소하려는 객체를 선택합니다.

-

추가 작업 (

)을 클릭한 다음 태그 할당을 클릭합니다.

)을 클릭한 다음 태그 할당을 클릭합니다.

- 확인란을 선택하여 오브젝트에 태그를 할당하거나 확인란을 지워 오브젝트에서 태그를 분리합니다.

- OK(확인)를 클릭합니다.

이제 지정된 태그가 선택한 개체의 사용자 지정 속성으로 추가 또는 제거됩니다.

1.5.6. 태그를 사용하여 오브젝트 검색

tag 를 속성으로, 원하는 값 또는 검색 기준에 따라 검색 쿼리를 입력합니다.

지정한 기준에 태그된 오브젝트는 결과 목록에 나열됩니다.

tag 를 속성으로 사용하여 개체를 검색하는 경우, inequality 연산자 (!=) (예: Host): VMs.tag!=server1 결과 목록에 태그되지 않은 오브젝트가 포함되지 않습니다.

1.5.7. 태그를 사용하여 호스트 사용자 지정

태그를 사용하여 호스트에 대한 정보를 저장할 수 있습니다. 그런 다음 태그를 기반으로 호스트를 검색할 수 있습니다. 검색에 대한 자세한 내용은 검색을 참조하십시오.

절차

- Compute → Hosts (컴퓨팅 호스트)를 클릭하고 호스트를 선택합니다.

-

추가 작업 (

)을 클릭한 다음 태그 할당을 클릭합니다.

)을 클릭한 다음 태그 할당을 클릭합니다.

- 적용 가능한 태그의 확인란을 선택합니다.

- OK(확인)를 클릭합니다.

태그를 사용하여 호스트에 대한 검색 가능한 추가 정보를 추가했습니다.

2장. 리소스 관리

2.1. 서비스 품질

Red Hat Virtualization을 사용하면 환경에 있는 리소스가 액세스할 수 있는 입력 및 출력 수준, 처리 및 네트워킹 기능을 세부적으로 제어할 수 있는 서비스 품질을 정의할 수 있습니다. 서비스 품질 항목은 데이터 센터 수준에서 정의되며 클러스터 및 스토리지 도메인에서 생성된 프로필에 할당됩니다. 그런 다음 이러한 프로필은 프로필이 생성된 클러스터 및 스토리지 도메인의 개별 리소스에 할당됩니다.

2.1.1. 저장 서비스 품질

스토리지 서비스 품질은 스토리지 도메인의 가상 디스크에 대한 최대 수준의 처리량과 최대 수준의 입력 및 출력 작업을 정의합니다. 가상 디스크에 서비스 품질을 할당하면 스토리지 도메인의 성능을 미세 조정하고 한 가상 디스크와 연결된 스토리지 작업이 동일한 스토리지 도메인에 호스팅된 다른 가상 디스크에 사용 가능한 스토리지 기능에 영향을 미치지 않도록 할 수 있습니다.

2.1.1.1. 스토리지 서비스 품질 생성

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- Storage(스토리지 )에서 New (새로 생성)를 클릭합니다.

- QoS Name( QoS 이름 )과 서비스 품질 항목에 대한 설명을 입력합니다.

라디오 버튼 중 하나를 클릭하여 서비스의 중단 품질을 지정합니다.

- 없음

- Total - MB/s 필드에 허용되는 최대 총 처리량을 입력합니다.

- 읽기/쓰기 - 왼쪽 MB/s 필드에 읽기 작업에 대해 허용되는 최대 처리량과 오른쪽 MB/s 필드에 쓰기 작업에 대해 허용되는 최대 처리량을 입력합니다.

라디오 버튼 중 하나를 클릭하여 서비스의IOps(입력 및 출력) 품질을 지정합니다.

- 없음

- 합계 - IOps 필드에 초당 허용되는 최대 입력 및 출력 작업 수를 입력합니다.

- 읽기/쓰기 - 왼쪽 IOps 필드에 초당 허용된 입력 작업 수와 오른쪽 IOps 필드에서 초당 허용되는 최대 출력 작업 수를 입력합니다.

- OK(확인)를 클릭합니다.

스토리지 서비스 품질을 생성하고 데이터 센터에 속한 데이터 스토리지 도메인의 해당 항목에 따라 디스크 프로필을 생성할 수 있습니다.

2.1.1.2. 스토리지 서비스 품질 제거

기존 스토리지 서비스 품질 항목을 제거합니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- Storage (스토리지)에서 스토리지 서비스 품질을 선택하고 Remove(제거 )를 클릭합니다.

- OK(확인)를 클릭합니다.

디스크 프로필이 해당 항목을 기반으로 하는 경우 해당 프로필의 서비스 품질이 자동으로 [무제한] 로 설정됩니다.

2.1.2. 가상 머신 네트워크 서비스 품질

가상 시스템 네트워크 서비스 품질은 개별 가상 네트워크 인터페이스 컨트롤러의 인바운드 및 아웃바운드 트래픽을 제한하는 프로필을 생성할 수 있는 기능입니다. 이 기능을 사용하면 네트워크 리소스의 사용을 제어하는 여러 계층의 대역폭을 제한할 수 있습니다.

2.1.2.1. 가상 머신 네트워크 서비스 품질 생성

가상 시스템 네트워크 인터페이스 프로필이라고도 하는 vNIC(가상 네트워크 인터페이스 컨트롤러) 프로필에 적용할 때 네트워크 트래픽을 규제하는 서비스 항목의 가상 시스템 네트워크 품질을 만듭니다.

가상 머신 네트워크 서비스 품질 생성

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- VM Network(VM 네트워크 )에서 New (새로 생성)를 클릭합니다.

- 가상 시스템 네트워크 서비스 품질 항목의 Name (이름)을 입력합니다.

- 인바운드 및 아웃바운드 네트워크 트래픽에 대한 제한을 입력합니다.

- OK(확인)를 클릭합니다.

가상 네트워크 인터페이스 컨트롤러에서 사용할 수 있는 가상 시스템 네트워크 서비스 품질을 생성했습니다.

2.1.2.2. New Virtual Machine Network QoS 및 Edit Virtual Machine Network QoS Windows의 설정 설명

가상 시스템 네트워크 서비스 품질 설정을 사용하면 인바운드 및 아웃바운드 트래픽에 대한 대역폭 제한을 세 가지 수준에서 구성할 수 있습니다.

표 2.1. 가상 머신 네트워크 QoS 설정

| 필드 이름 | 설명 |

|---|---|

| 데이터 센터 | 가상 시스템 네트워크 QoS 정책을 추가하는 데이터 센터입니다. 이 필드는 선택한 데이터 센터에 따라 자동으로 구성됩니다. |

| 이름 | Manager 내에서 가상 시스템 네트워크 QoS 정책을 나타내는 이름입니다. |

| 인바운드 | 인바운드 트래픽에 적용할 설정입니다. 이러한 설정을 활성화 또는 비활성화하려면 Inbound 확인란을 선택하거나 지웁니다.

|

| 아웃바운드 | 아웃바운드 트래픽에 적용할 설정입니다. 이러한 설정을 활성화 또는 비활성화하려면 아웃바운드 확인란을 선택하거나 지웁니다.

|

Average,Peak 또는 Burst 필드에서 허용되는 최대 값을 변경하려면 engine-config 명령을 사용하여 Max AverageNetworkQoSValue, Max 구성 키 값을 변경합니다. 변경 사항을 적용하려면 ovirt-engine 서비스를 다시 시작해야 합니다. 예를 들면 다음과 같습니다.

PeakNetworkQoSValue 또는 MaxBurstNetworkQo SValue

# engine-config -s MaxAverageNetworkQoSValue=2048 # systemctl restart ovirt-engine

2.1.2.3. 가상 머신 네트워크 서비스 품질 제거

기존 가상 시스템 네트워크 서비스 품질 항목을 제거합니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- VM Network (VM 네트워크)에서 서비스의 가상 시스템 네트워크 품질을 선택하고 Remove(제거 )를 클릭합니다.

- OK(확인)를 클릭합니다.

2.1.3. 호스트 네트워크 서비스 품질

호스트 네트워크 서비스 품질은 물리적 인터페이스를 통해 네트워크 트래픽 제어를 활성화하도록 호스트의 네트워크를 구성합니다. 호스트 네트워크 서비스 품질은 동일한 물리적 네트워크 인터페이스 컨트롤러에서 네트워크 리소스의 사용을 제어하여 네트워크 성능을 미세 조정할 수 있습니다. 이렇게 하면 트래픽이 많기 때문에 하나의 네트워크가 동일한 실제 네트워크 인터페이스 컨트롤러에 연결된 다른 네트워크가 더 이상 작동하지 않는 상황을 방지할 수 있습니다. 호스트 네트워크 서비스 품질을 구성하여 이러한 네트워크가 혼잡 문제 없이 동일한 실제 네트워크 인터페이스 컨트롤러에서 작동할 수 있습니다.

2.1.3.1. 호스트 네트워크 서비스 품질 생성

호스트 네트워크 품질 서비스 항목을 만듭니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- Host Network(호스트 네트워크 )에서 New (새로 생성)를 클릭합니다.

- Qos Name 을 입력하고 서비스 품질 항목에 대한 설명을 입력합니다.

- 가중 공유에 대해 원하는 값, Rate Limit [Mbps] 및 Committed Rate [Mbps] 를 입력합니다.

- OK(확인)를 클릭합니다.

2.1.3.2. 새 호스트 네트워크 서비스 품질 및 Edit Host Network of Service Windows의 설정 설명

호스트 네트워크 서비스 품질 설정을 사용하면 아웃바운드 트래픽에 대한 대역폭 제한을 구성할 수 있습니다.

표 2.2. 호스트 네트워크 QoS 설정

| 필드 이름 | 설명 |

|---|---|

| 데이터 센터 | 호스트 네트워크 QoS 정책을 추가하는 데이터 센터입니다. 이 필드는 선택한 데이터 센터에 따라 자동으로 구성됩니다. |

| QoS 이름 | Manager 내에서 호스트 네트워크 QoS 정책을 나타내는 이름입니다. |

| 설명 | 호스트 네트워크 QoS 정책에 대한 설명입니다. |

| 아웃바운드 | 아웃바운드 트래픽에 적용할 설정입니다.

|

Rate Limit [Mbps] 또는 Committed Rate [Mbps] (요금 제한[Mbps] ) 필드에서 허용되는 최대 값을 변경하려면 engine-config 명령을 사용하여 MaxAverageNetworkQoSValue 구성 키 값을 변경합니다. 변경 사항을 적용하려면 ovirt-engine 서비스를 다시 시작해야 합니다. 예를 들면 다음과 같습니다.

# engine-config -s MaxAverageNetworkQoSValue=2048 # systemctl restart ovirt-engine

2.1.3.3. 호스트 네트워크 서비스 품질 제거

기존 네트워크 서비스 품질 항목을 제거합니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- Host Network(호스트 네트워크 )에서 호스트 네트워크 품질 항목을 선택하고 Remove(제거 )를 클릭합니다.

- 메시지가 표시되면 OK(확인 )를 클릭합니다.

2.1.4. CPU 서비스 품질

서비스의 CPU 품질은 가상 시스템이 실행되는 호스트에서 액세스할 수 있는 최대 처리 기능 크기를 해당 호스트에서 사용할 수 있는 총 처리 기능의 백분율로 정의합니다. 가상 머신에 CPU 서비스 품질을 할당하면 클러스터의 한 가상 시스템의 워크로드가 해당 클러스터의 다른 가상 시스템에 사용 가능한 처리 리소스에 영향을 미치지 않도록 할 수 있습니다.

2.1.4.1. CPU 서비스 품질 입력 생성

CPU 서비스 품질 항목을 만듭니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- CPU 아래에서 New (새로 만들기)를 클릭합니다.

- QoS Name( QoS 이름 )과 서비스 품질 항목에 대한 설명을 입력합니다.

-

Limit(%)(제한(%)) 필드에 허용되는 서비스 품질을 최대 처리 기능을 입력합니다.

%기호를 포함하지 마십시오. - OK(확인)를 클릭합니다.

CPU 품질 서비스 항목을 생성하고 데이터 센터에 속한 클러스터에서 해당 항목을 기반으로 CPU 프로필을 생성할 수 있습니다.

2.1.4.2. CPU 서비스 품질 제거

기존 CPU 서비스 품질 항목을 제거합니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- QoS (QoS) 탭을 클릭합니다.

- CPU에서 CPU quality of service 항목을 선택하고 Remove(제거 )를 클릭합니다.

- OK(확인)를 클릭합니다.

CPU 프로필이 해당 항목을 기반으로 하는 경우 해당 프로필의 서비스 품질 항목이 자동으로 [무제한] 로 설정됩니다.

2.2. 데이터 센터

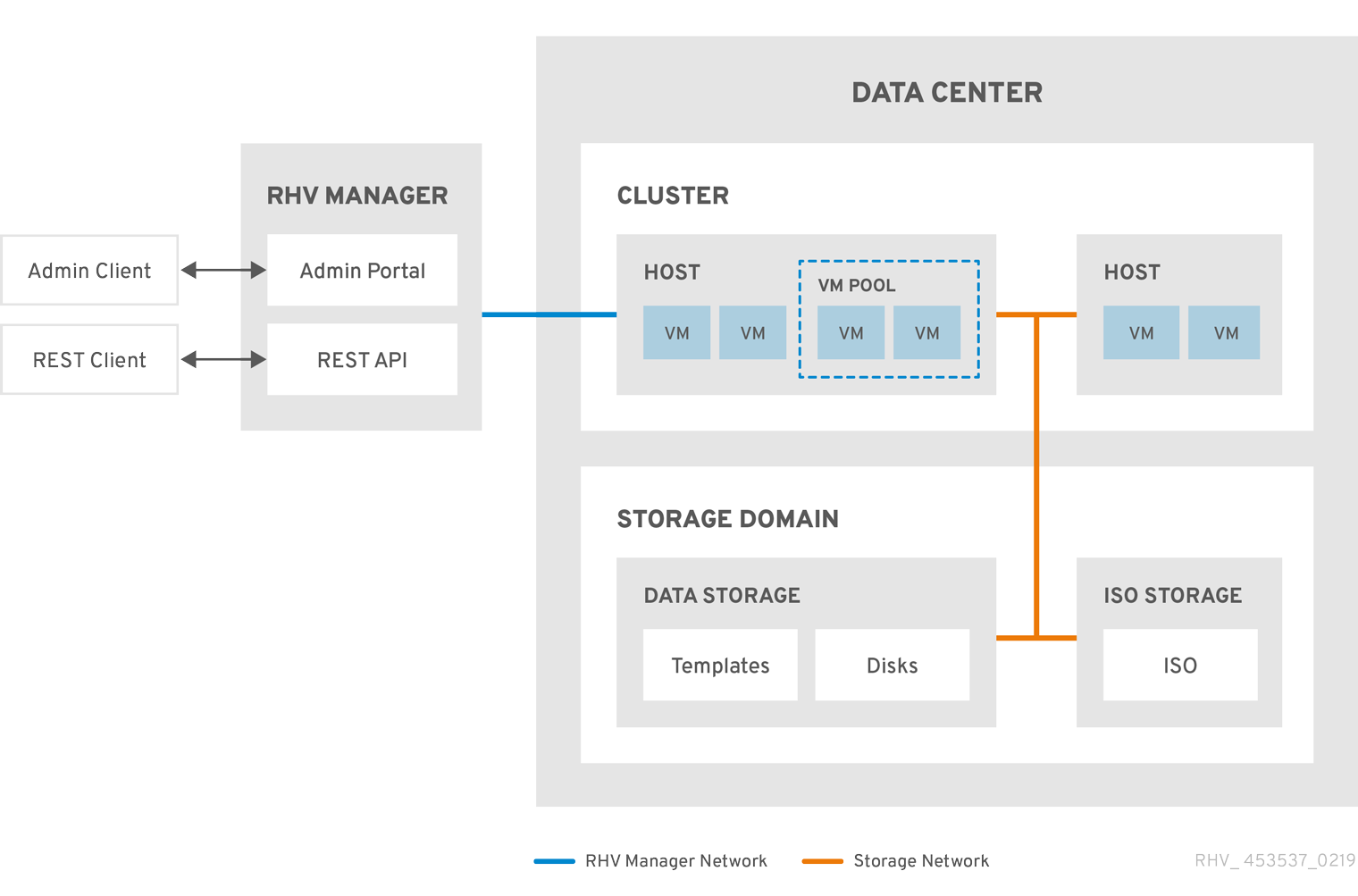

2.2.1. 데이터 센터 소개

데이터 센터는 특정 환경에서 사용되는 리소스 집합을 정의하는 논리적 엔터티입니다. 데이터 센터는 클러스터 및 호스트의 형태로 논리적 리소스, 논리적 네트워크 및 물리적 NIC 형식의 네트워크 리소스, 스토리지 도메인 형식의 스토리지 리소스로 구성된 컨테이너 리소스로 간주됩니다.

데이터 센터에는 여러 호스트가 포함될 수 있는 여러 클러스터가 포함될 수 있으며, 여러 스토리지 도메인이 연결되어 있을 수 있으며 각 호스트에서 여러 가상 시스템을 지원할 수 있습니다. Red Hat Virtualization 환경에는 여러 데이터 센터가 포함될 수 있습니다. 데이터 센터 인프라를 사용하면 이러한 센터를 별도로 유지할 수 있습니다.

모든 데이터 센터는 단일 관리 포털에서 관리됩니다.

그림 2.1. 데이터 센터

Red Hat Virtualization은 설치 중에 기본 데이터 센터를 생성합니다. 기본 데이터 센터를 구성하거나 적절한 이름의 데이터 센터를 새로 설정할 수 있습니다.

2.2.2. 스토리지 풀 관리자

SPM(스토리지 풀 관리자)은 데이터 센터의 스토리지 도메인을 관리할 수 있도록 데이터 센터의 호스트 중 하나에 지정된 역할입니다. SPM 엔터티는 데이터 센터의 모든 호스트에서 실행할 수 있습니다. Red Hat Virtualization Manager는 호스트 중 하나에 역할을 부여합니다. SPM은 표준 작업에서 호스트를 제외하지 않으며, SPM으로 실행되는 호스트에서 여전히 가상 리소스를 호스팅할 수 있습니다.

SPM 엔터티는 스토리지 도메인에서 메타데이터를 조정하여 스토리지에 대한 액세스를 제어합니다. 여기에는 가상 디스크(이미지), 스냅샷 및 템플릿 생성, 삭제 및 조작, SAN에 있는 스파스 블록 장치에 대한 스토리지 할당이 포함됩니다. 이는 독점적인 책임입니다. 메타데이터 무결성을 보장하기 위해 데이터 센터에서는 한 번에 하나의 호스트만 SPM이 될 수 있습니다.

Red Hat Virtualization Manager를 사용하면 SPM을 항상 사용할 수 있습니다. SPM 호스트가 스토리지에 액세스하는 데 문제가 발생하면 Manager가 SPM 역할을 다른 호스트로 이동합니다. SPM이 시작되면 역할이 부여된 유일한 호스트인지 확인할 수 있으므로 스토리지 중심 리스를 확보하게 됩니다. 이 프로세스는 다소 시간이 걸릴 수 있습니다.

2.2.3. SPM 우선 순위

SPM 역할은 호스트의 사용 가능한 리소스 중 일부를 사용합니다. 호스트의 SPM 우선 순위 설정은 SPM 역할을 할당하는 호스트의 가능성을 변경합니다. SPM 우선 순위가 높은 호스트가 SPM 우선 순위가 낮은 호스트가 할당되기 전에 SPM 역할이 할당됩니다. SPM 우선 순위가 낮은 호스트의 중요한 가상 시스템은 호스트 리소스에 대해 SPM 작업을 계속할 필요가 없습니다.

Edit Host (호스트 편집) 창에서 SPM 탭에서 호스트의 SPM 우선 순위를 변경할 수 있습니다.

2.2.4. 데이터 센터 작업

2.2.4.1. 새 데이터 센터 생성

이 절차에서는 가상화 환경에 데이터 센터를 생성합니다. 데이터 센터에서 작동하려면 클러스터, 호스트 및 스토리지 도메인이 작동해야 합니다.

호환성 버전을 설정한 후에는 버전 번호를 낮출 수 없습니다. 버전 회귀는 지원되지 않습니다.

클러스터의 MAC 풀 범위를 지정할 수 있습니다. MAC 풀 범위 설정은 더 이상 지원되지 않습니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- New (새로 만들기)를 클릭합니다.

- 데이터 센터의 Name (이름) 및 Description (설명)을 입력합니다.

- 드롭다운 메뉴에서 데이터 센터의 Storage Type (스토리지 유형),Compatibility Version (호환 버전), Quota Mode (할당량 모드)를 선택합니다.

- OK(확인 )를 클릭하여 데이터 센터를 생성하고 Data Center - Guide Me(데이터 센터 - 안내 ) 창을 엽니다.

-

Guide Me (안내) 창에는 데이터 센터에 대해 구성해야 하는 엔터티가 나열됩니다. Configure Later(나중에 구성) 버튼을 클릭하여 이러한 엔터티 또는 postpone 구성을 구성합니다. 데이터 센터를 선택하고 추가 작업 (

)을 클릭한 다음 가이드를 클릭하여 구성을 다시 시작할 수 있습니다.

)을 클릭한 다음 가이드를 클릭하여 구성을 다시 시작할 수 있습니다.

새 데이터 센터는 클러스터, 호스트 및 스토리지 도메인이 구성 될 때까지 초기화되지 않은 상태로 유지됩니다. Guide Me (안내)를 사용하여 이러한 엔터티를 구성합니다.

2.2.4.2. 새 데이터 센터의 설정 설명 및 데이터 센터 편집 창

아래 표는 New Data Center(새 데이터 센터) 및 Edit Data Center (데이터 센터 편집) 창에 표시된 데이터 센터의 설정을 설명합니다. OK(확인 )를 클릭하면 유효하지 않은 항목이 노란색으로 설명되어 변경 사항이 수락되지 않습니다. 또한 필드 프롬프트는 예상 값 또는 값 범위를 나타냅니다.

표 2.3. 데이터 센터 속성

| 필드 | 설명/액션 |

|---|---|

| 이름 | 데이터 센터의 이름입니다. 이 텍스트 필드에는 40자 제한이 있으며 대문자와 소문자, 숫자, 하이픈, 밑줄이 조합된 고유한 이름이어야 합니다. |

| 설명 | 데이터 센터에 대한 설명입니다. 이 필드는 권장되지만 필수는 아닙니다. |

| 스토리지 유형 | Shared (공유) 또는 Local storage type(로컬 스토리지 유형)을 선택합니다. 스토리지 도메인 유형(iSCSI, NFS, FC, POSIX 및 Gluster)을 동일한 데이터 센터에 추가할 수 있습니다. 그러나 로컬 및 공유 도메인은 혼합할 수 없습니다. 데이터 센터를 초기화한 후 스토리지 유형을 변경할 수 있습니다. 데이터 센터 스토리지 유형 변경을 참조하십시오. |

| Compatibility Version | Red Hat Virtualization의 버전. Red Hat Virtualization Manager를 업그레이드한 후에도 호스트, 클러스터 및 데이터 센터가 이전 버전에 있을 수 있습니다. 데이터 센터의 호환성 수준을 업그레이드하기 전에 모든 호스트를 업그레이드했는지 확인합니다. |

| 쿼터 모드 | 쿼터는 Red Hat Virtualization과 함께 제공되는 리소스 제한 도구입니다. 다음 중 하나를 선택하십시오.

|

| 설명 | 필요한 경우 데이터 센터에 대한 일반 텍스트 주석을 추가합니다. |

2.2.4.3. 데이터 센터 다시 초기화: 복구 절차

이 복구 절차에서는 데이터 센터의 마스터 데이터 도메인을 새 마스터 데이터 도메인으로 교체합니다. 데이터가 손상된 경우 마스터 데이터 도메인을 다시 초기화해야 합니다. 데이터 센터를 다시 초기화하면 클러스터, 호스트 및 문제 없는 스토리지 도메인을 포함하여 데이터 센터와 관련된 기타 모든 리소스를 복원할 수 있습니다.

백업 또는 내보낸 가상 머신 또는 템플릿을 새 마스터 데이터 도메인으로 가져올 수 있습니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭하고 데이터 센터를 선택합니다.

- 데이터 센터에 연결된 스토리지 도메인이 유지 관리 모드인지 확인합니다.

-

추가 작업 (

)을 클릭한 다음 데이터 센터 재구축을 클릭합니다.

)을 클릭한 다음 데이터 센터 재구축을 클릭합니다.

- Data Center Re-Initialize (데이터 센터 다시 초기화) 창에는 사용 가능한 모든(유지 관리 모드) 스토리지 도메인이 나열됩니다. 데이터 센터에 추가하려는 스토리지 도메인의 라디오 버튼을 클릭합니다.

- Approve operation(작업 승인) 확인란을 선택합니다.

- OK(확인)를 클릭합니다.

스토리지 도메인은 마스터 데이터 도메인으로 데이터 센터에 연결되고 활성화됩니다. 백업 또는 내보낸 가상 머신 또는 템플릿을 새 마스터 데이터 도메인으로 가져올 수 있습니다.

2.2.4.4. 데이터 센터 제거

데이터 센터를 제거하려면 활성 호스트가 필요합니다. 데이터 센터를 제거해도 연결된 리소스는 제거되지 않습니다.

절차

- 데이터 센터에 연결된 스토리지 도메인이 유지 관리 모드인지 확인합니다.

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭하고 제거할 데이터 센터를 선택합니다.

- Remove(제거)를 클릭합니다.

- OK(확인)를 클릭합니다.

2.2.4.5. 데이터 센터를 강제로 제거

연결된 스토리지 도메인이 손상되거나 호스트가 Non Responsive 가 되는 경우 데이터 센터는 무응답이 됩니다 . 두 상황에서는 데이터 센터를 제거할 수 없습니다.

force Remove 에는 활성 호스트가 필요하지 않습니다. 연결된 스토리지 도메인도 영구적으로 제거합니다.

데이터 센터를 강제로 제거할 수 있으려면 손상된 스토리지 도메인을 삭제해야 할 수 있습니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭하고 제거할 데이터 센터를 선택합니다.

-

추가 작업 (

)을 클릭한 다음 강제 제거를 클릭합니다.

)을 클릭한 다음 강제 제거를 클릭합니다.

- Approve operation(작업 승인) 확인란을 선택합니다.

- OK를 클릭합니다.

데이터 센터와 연결된 스토리지 도메인은 Red Hat Virtualization 환경에서 영구적으로 제거됩니다.

2.2.4.6. 데이터 센터 스토리지 유형 변경

초기화한 후 데이터 센터의 스토리지 유형을 변경할 수 있습니다. 이는 가상 시스템 또는 템플릿을 이동하는 데 사용되는 데이터 도메인에 유용합니다.

제한

- Local에 공유 - 두 개 이상의 호스트와 둘 이상의 클러스터를 포함하지 않는 데이터 센터의 경우 로컬 데이터 센터에서 지원하지 않기 때문입니다.

- Local to Shared(공유로 로컬) - 로컬 스토리지 도메인을 포함하지 않는 데이터 센터의 경우입니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭하고 변경할 데이터 센터를 선택합니다.

- Edit(편집 )를 클릭합니다.

- 스토리지 유형을 원하는 값으로 변경합니다.

- OK(확인)를 클릭합니다.

2.2.4.7. 데이터 센터 호환성 버전 변경

Red Hat Virtualization 데이터 센터에는 호환성 버전이 있습니다. 호환성 버전은 데이터 센터를 호환하기 위한 Red Hat Virtualization 버전을 나타냅니다. 데이터 센터의 모든 클러스터에서 원하는 호환성 수준을 지원해야 합니다.

사전 요구 사항

- 데이터 센터 호환성 수준을 변경하려면 먼저 데이터 센터에서 모든 클러스터와 가상 시스템의 호환성 버전을 업데이트해야 합니다.

절차

- 관리 포털에서 Compute(컴퓨팅) Data Centers(데이터 센터) 를 클릭합니다.

- 변경할 데이터 센터를 선택하고 Edit(편집 )를 클릭합니다.

- Compatibility Version(호환 버전 )을 원하는 값으로 변경합니다.

- OK(확인)를 클릭합니다. 데이터 센터 호환성 버전 변경 확인 대화 상자가 열립니다.

- OK(확인 )를 클릭하여 확인합니다.

2.2.5. 데이터 센터 및 스토리지 도메인

2.2.5.1. 데이터 센터에 기존 데이터 도메인 연결

연결 해제된 데이터 도메인은 데이터 센터에 연결할 수 있습니다. 여러 유형의 공유 스토리지 도메인(iSCSI, NFS, FC, POSIX 및 Gluster)을 동일한 데이터 센터에 추가할 수 있습니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- Storage(스토리지 ) 탭을 클릭하여 데이터 센터에 이미 연결된 스토리지 도메인을 나열합니다.

- Attach Data (데이터 연결)를 클릭합니다.

- 데이터 도메인의 확인란을 선택하여 데이터 센터에 연결합니다. 여러 개의 확인란을 선택하여 여러 데이터 도메인을 연결할 수 있습니다.

- OK(확인)를 클릭합니다.

데이터 도메인은 데이터 센터에 연결되며 자동으로 활성화됩니다.

2.2.5.2. 데이터 센터에 기존 ISO 도메인 연결

연결 해제된 ISO 도메인을 데이터 센터에 연결할 수 있습니다. ISO 도메인은 데이터 센터와 동일한 스토리지 유형 이어야 합니다.

하나의 ISO 도메인만 데이터 센터에 연결할 수 있습니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- Storage(스토리지 ) 탭을 클릭하여 데이터 센터에 이미 연결된 스토리지 도메인을 나열합니다.

- Attach ISO (ISO 연결)를 클릭합니다.

- 적절한 ISO 도메인의 라디오 버튼을 클릭합니다.

- OK(확인)를 클릭합니다.

ISO 도메인은 데이터 센터에 연결되며 자동으로 활성화됩니다.

2.2.5.3. 데이터 센터에 기존 내보내기 도메인 연결

내보내기 스토리지 도메인은 더 이상 사용되지 않습니다. 스토리지 데이터 도메인은 데이터 센터에서 연결을 해제하고 동일한 환경이나 다른 환경에서 다른 데이터 센터로 가져올 수 있습니다. 그런 다음 가져온 스토리지 도메인에서 연결된 데이터 센터로 가상 시스템, 유동 가상 디스크 및 템플릿을 업로드할 수 있습니다. 스토리지 도메인 가져오기에 대한 자세한 내용은 기존 스토리지 도메인 가져오기를 참조하십시오.

연결 해제된 내보내기 도메인을 데이터 센터에 연결할 수 있습니다. 데이터 센터에 하나의 내보내기 도메인만 연결할 수 있습니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- Storage(스토리지 ) 탭을 클릭하여 데이터 센터에 이미 연결된 스토리지 도메인을 나열합니다.

- Attach Export (내보내기 연결)를 클릭합니다.

- 적절한 내보내기 도메인의 라디오 버튼을 클릭합니다.

- OK(확인)를 클릭합니다.

내보내기 도메인은 데이터 센터에 연결되며 자동으로 활성화됩니다.

2.2.5.4. 데이터 센터에서 스토리지 도메인 분리

데이터 센터에서 스토리지 도메인을 분리하면 데이터 센터가 해당 스토리지 도메인과 연결되지 않습니다. 스토리지 도메인은 Red Hat Virtualization 환경에서 제거되지 않으며 다른 데이터 센터에 연결할 수 있습니다.

가상 시스템 및 템플릿과 같은 데이터는 스토리지 도메인에 계속 연결되어 있습니다.

마지막 마스터 스토리지 도메인을 분리할 수 있지만 권장되지는 않습니다.

마스터 스토리지 도메인을 분리한 경우 다시 초기화해야 합니다.

스토리지 도메인이 다시 초기화되면 모든 데이터가 손실되고 스토리지 도메인이 디스크를 다시 찾지 못할 수 있습니다.

절차

- Compute(컴퓨팅) → Data Centers (데이터 센터)를 클릭합니다.

- 데이터 센터의 이름을 클릭합니다. 그러면 세부 정보 보기가 열립니다.

- Storage(스토리지 ) 탭을 클릭하여 데이터 센터에 연결된 스토리지 도메인을 나열합니다.

-

분리할 스토리지 도메인을 선택합니다. 스토리지 도메인이

Active이면 Maintenance(유지 관리 )를 클릭합니다. - OK(확인 )를 클릭하여 유지 관리 모드를 시작합니다.

- Detach(분리) 를 클릭합니다.

- OK(확인)를 클릭합니다.

스토리지 도메인이 세부 정보 보기에서 사라지는 데 최대 몇 분이 걸릴 수 있습니다.

2.3. 클러스터

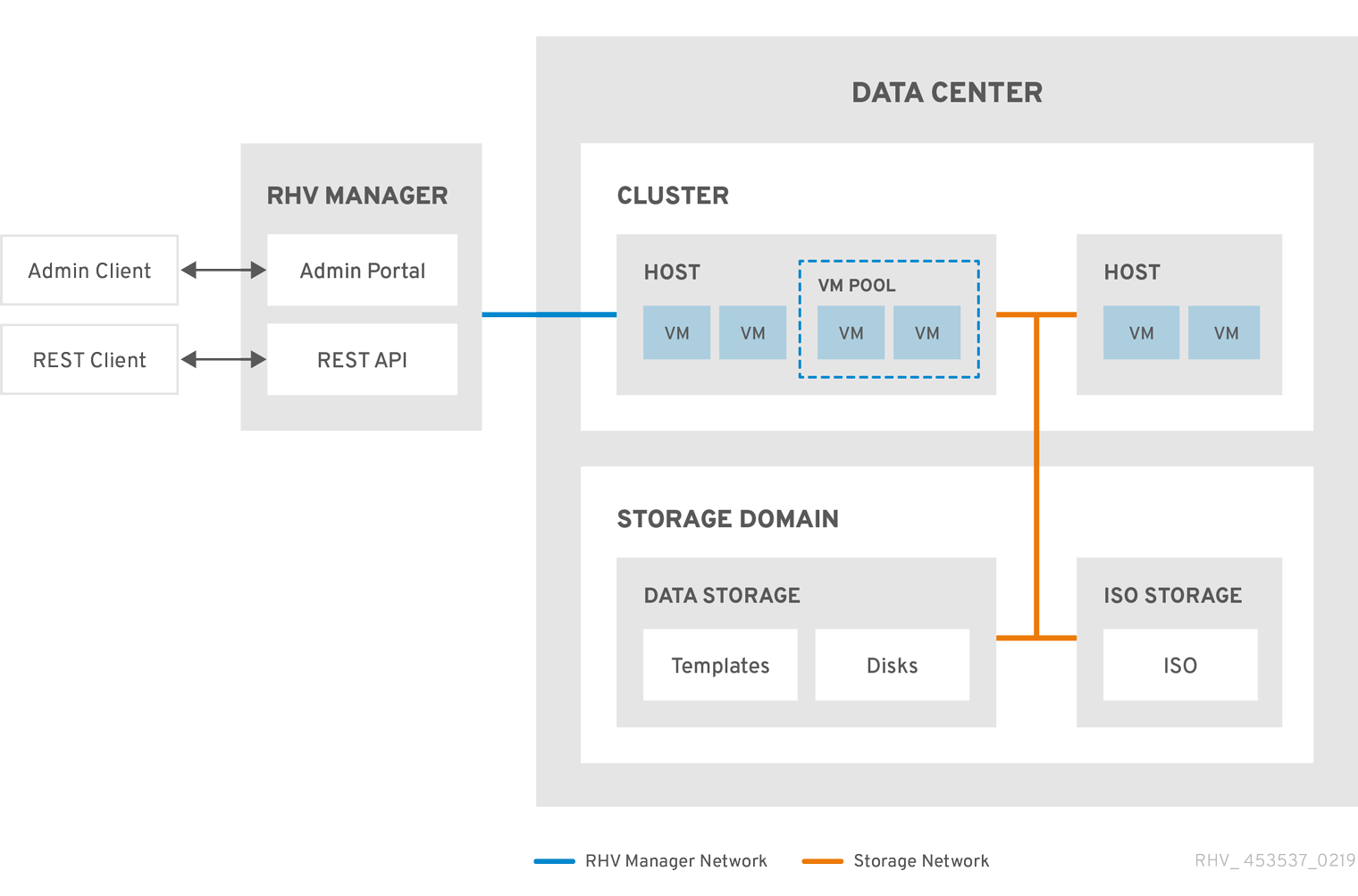

2.3.1. 클러스터 소개

클러스터는 동일한 스토리지 도메인을 공유하고 동일한 유형의 CPU(Intel 또는 AMD)를 갖는 호스트의 논리적 그룹화입니다. 호스트에 다른 CPU 모델이 있는 경우 모든 모델에 있는 기능만 사용합니다.

시스템의 각 클러스터는 데이터 센터에 속해야 하며 시스템의 각 호스트가 클러스터에 속해야 합니다. 가상 시스템은 클러스터의 모든 호스트에 동적으로 할당되며, 가상 시스템의 클러스터 및 설정에 정의된 정책에 따라 클러스터 간에 마이그레이션할 수 있습니다. 클러스터는 전원 및 로드 공유 정책을 정의할 수 있는 최상위 수준입니다.

클러스터에 속하는 호스트 수와 가상 시스템 수는 각각 Host Count(호스트 개수) 및 VM Count (VM 개수) 아래의 결과 목록에 표시됩니다.

클러스터는 가상 시스템 또는 Red Hat Gluster Storage 서버를 실행합니다. 이 두 가지 목적은 함께 사용할 수 없습니다. 단일 클러스터는 가상화 및 스토리지 호스트를 함께 지원할 수 없습니다.

Red Hat Virtualization은 설치 중에 기본 데이터 센터에 기본 클러스터를 생성합니다.

그림 2.2. Cluster

2.3.2. 클러스터 작업

일부 클러스터 옵션은 Gluster 클러스터에 적용되지 않습니다. Red Hat Virtualization과 함께 Red Hat Gluster Storage 사용에 대한 자세한 내용은 Red Hat Gluster Storage를 사용하여 Red Hat Virtualization 구성을 참조하십시오.

2.3.2.1. 새 클러스터 생성

데이터 센터에 여러 클러스터를 포함할 수 있으며 클러스터에 여러 호스트가 포함될 수 있습니다. 클러스터의 모든 호스트에는 동일한 CPU 아키텍처가 있어야 합니다. CPU 유형을 최적화하려면 클러스터를 생성하기 전에 호스트를 생성합니다. 클러스터를 생성한 후 Guide Me (안내) 버튼을 사용하여 호스트를 구성할 수 있습니다.

절차

- Compute(컴퓨팅) Clusters(클러스터) 를 클릭합니다.

- New (새로 만들기)를 클릭합니다.

- 드롭다운 목록에서 클러스터가 속할 Data Center (데이터 센터)를 선택합니다.

- 클러스터의 Name (이름) 및 Description (설명)을 입력합니다.

- Management Network (관리 네트워크) 드롭다운 목록에서 네트워크를 선택하여 관리 네트워크 역할을 할당합니다.

- CPU Architecture (CPU 아키텍처)를 선택합니다.

CPU Type (CPU 유형) 의 경우 이 클러스터의 일부가 될 호스트 중 가장 오래된 CPU 프로세서 제품군 을 선택합니다. CPU 유형은 가장 오래된 유형부터 최신 순으로 나열됩니다.

중요CPU 프로세서 제품군이 CPU 유형으로 지정한 호스트보다 오래된 호스트는 이 클러스터의 일부가 될 수 없습니다. 자세한 내용은 Whath ich CPU family should a RHEV3 or RHV4 cluster be set to?를 참조하십시오.

- 드롭다운 목록에서 클러스터의 FIPS 모드를 선택합니다.

- 드롭다운 목록에서 클러스터의 Compatibility Version (호환 버전)을 선택합니다.

- 드롭다운 목록에서 Switch Type (스위치 유형)을 선택합니다.

클러스터에서 Firewalld (default) 또는 iptables 중 하나를 선택합니다.

참고iptables 는 호환성 버전 4.2 또는 4.3이 있는 클러스터에서만 Red Hat Enterprise Linux 7 호스트에서만 지원됩니다. 방화벽 유형 firewalld가 있는 클러스터에만 Red Hat Enterprise Linux 8 호스트를 추가할 수 있습니다.

- Enable Virt Service (가상 서비스 사용) 또는 Enable Gluster Service (Gluster 서비스 활성화) 확인란을 선택하여 클러스터가 가상 시스템 호스트 또는 Gluster 지원 노드로 채워질지 여부를 정의합니다.

- 선택적으로 Enable to set VM maintenance reason (VM 유지 관리 이유 설정) 확인란을 선택하여 Manager에서 가상 시스템을 종료할 때 선택적 reason 필드를 활성화하여 관리자가 유지 관리에 대한 설명을 제공할 수 있습니다.

- 선택적으로 Enable to set Host maintenance reason (호스트 유지 관리 이유 설정) 확인란을 선택하여 Manager에서 호스트를 유지 관리 모드로 전환할 때 선택적 reason 필드를 활성화하여 관리자가 유지 관리에 대한 설명을 제공할 수 있습니다.

- 선택적으로 /dev/hwrng 소스 (외부 하드웨어 장치) 확인란을 선택하여 클러스터의 모든 호스트에서 사용할 임의 번호 생성기 장치를 지정합니다. /dev/urandom 소스 (Linux 제공 장치)는 기본적으로 활성화되어 있습니다.

- Optimization( 최적화 ) 탭을 클릭하여 클러스터의 임계값을 공유하는 메모리 페이지를 선택하고, 클러스터의 호스트에서 CPU 스레드 처리 및 메모리 증대를 선택적으로 활성화합니다.

- Migration Policy(마이그레이션 정책 ) 탭을 클릭하여 클러스터의 가상 시스템 마이그레이션 정책을 정의합니다.

- 선택 사항으로 스케줄링 정책을 구성하고, 스케줄러 최적화 설정을 구성하고, 클러스터에서 호스트에 대해 신뢰할 수 있는 서비스를 활성화하고, HA 예약을 활성화하고, 일련 번호 정책을 선택하려면 Scheduling Policy (스케줄링 정책) 탭을 클릭합니다.

- Console(콘솔 ) 탭을 클릭하여 글로벌 SPICE 프록시(있는 경우 선택적으로 재정의)를 클릭하고 클러스터의 호스트에 대한 SPICE 프록시 주소를 지정합니다.

- 펜싱 정책 탭을 클릭하여 클러스터에서 펜싱을 활성화하거나 비활성화하고 펜싱 옵션을 선택합니다.

- MAC Address Pool(MAC 주소 풀 ) 탭을 클릭하여 클러스터의 기본 풀 이외의 MAC 주소 풀을 지정합니다. MAC 주소 풀 생성, 편집 또는 제거에 대한 자세한 내용은 MAC Address Pools 를 참조하십시오.

- OK(확인 )를 클릭하여 클러스터를 생성하고 Cluster - Guide Me(클러스터 - 안내 ) 창을 엽니다.

-

Guide Me (안내) 창에는 클러스터에 대해 구성해야 하는 엔터티가 나열됩니다. Configure Later(나중에 구성) 버튼을 클릭하여 이러한 엔터티 또는 postpone 구성을 구성합니다. 클러스터를 선택하고 추가 작업 (

)을 클릭한 다음 가이드를 클릭하여 구성을 다시 시작할 수 있습니다.

)을 클릭한 다음 가이드를 클릭하여 구성을 다시 시작할 수 있습니다.

2.3.2.2. 설명된 일반 클러스터 설정

아래 표는 New Cluster(새 클러스터) 및 Edit Cluster (클러스터 편집) 창의 General(일반 ) 탭에 대한 설정을 설명합니다. OK(확인 )를 클릭하면 유효하지 않은 항목이 노란색으로 설명되어 변경 사항이 수락되지 않습니다. 또한 필드 프롬프트는 예상 값 또는 값 범위를 나타냅니다.

표 2.4. 일반 클러스터 설정

| 필드 | 설명/액션 |

|---|---|

| 데이터 센터 | 클러스터를 포함할 데이터 센터입니다. 클러스터를 추가하기 전에 데이터 센터를 생성해야 합니다. |

| 이름 | 클러스터의 이름입니다. 이 텍스트 필드에는 40자 제한이 있으며 대문자와 소문자, 숫자, 하이픈, 밑줄이 조합된 고유한 이름이어야 합니다. |

| 설명/주석 | 클러스터 또는 추가 노트에 대한 설명입니다. 이러한 필드는 권장되지만 필수는 아닙니다. |

| 관리 네트워크 | 관리 네트워크 역할이 할당될 논리적 네트워크입니다. 기본값은 ovirtmgmt 입니다. 마이그레이션 네트워크가 소스 또는 대상 호스트에 올바르게 연결되지 않은 경우에도 이 네트워크가 가상 머신을 마이그레이션하는 데 사용됩니다. 기존 클러스터에서 관리 네트워크는 세부 정보 보기의 Logical Networks(논리 네트워크) 탭에서 Manage Networks (네트워크 관리) 버튼을 사용해서만 변경할 수 있습니다. |

| CPU 아키텍처 | 클러스터의 CPU 아키텍처입니다. 클러스터의 모든 호스트는 지정한 아키텍처를 실행해야 합니다. 선택한 CPU 아키텍처에 따라 다양한 CPU 유형을 사용할 수 있습니다.

|

| CPU 유형 | 클러스터에서 가장 오래된 CPU 제품군. CPU 유형 목록은 계획 및 사전 요구 사항 가이드의 CPU 요구 사항을 참조하십시오. 중요한 중단 없이 클러스터를 생성한 후에는 이를 변경할 수 없습니다. CPU 유형을 클러스터에서 가장 오래된 CPU 모델로 설정합니다. 모든 모델에 있는 기능만 사용할 수 있습니다. Intel 및 AMD CPU 유형의 경우 나열된 CPU 모델은 가장 오래된 CPU 모델에서 최신 버전까지 논리적 순서로 되어 있습니다. |

| 칩셋/방지 유형 | 이 설정은 클러스터의 CPU 아키텍처 가 x86_64 로 설정된 경우에만 사용할 수 있습니다. 이 설정은 칩셋 및 펌웨어 유형을 지정합니다. 옵션은 다음과 같습니다.

자세한 내용은 관리 가이드 의 UEFI 및 Q35 칩셋 을 참조하십시오. |

| BIOS를 사용하여 기존 VM/Templates를 1440fx에서 Q35 Chipset으로 변경 | 클러스터의 칩셋이 I440FX에서 Q35로 변경될 때 이 확인란을 선택하여 기존 워크로드를 변경합니다. |

| FIPS 모드 | 클러스터에서 사용하는 FIPS 모드입니다. 클러스터의 모든 호스트는 사용자가 지정하는 FIPS 모드를 실행해야 합니다. 그렇지 않으면 작동하지 않습니다.

|

| Compatibility Version | Red Hat Virtualization의 버전. 데이터 센터에 지정된 버전보다 이전에 버전을 선택할 수 없습니다. |

| 스위치 유형 | 클러스터에서 사용하는 스위치 유형입니다. Linux Bridge 는 표준 Red Hat Virtualization 스위치입니다. OVS 는 Open vSwitch 네트워킹 기능을 지원합니다. |

| 방화벽 유형 | 클러스터의 호스트 방화벽 유형을 firewalld (기본값) 또는 iptables로 지정합니다. iptables 는 호환성 버전 4.2 또는 4.3이 있는 클러스터에서만 Red Hat Enterprise Linux 7 호스트에서만 지원됩니다. 방화벽 유형 firewalld 가 있는 클러스터에만 Red Hat Enterprise Linux 8 호스트를 추가할 수 있습니다. 기존 클러스터의 방화벽 유형을 변경하는 경우 변경 사항을 적용하려면 클러스터의 모든 호스트를 다시 설치해야 합니다. |

| 기본 네트워크 공급자 | 클러스터가 사용할 기본 외부 네트워크 공급자를 지정합니다. OVN(Open Virtual Network)을 선택하면 클러스터에 추가된 호스트가 OVN 공급자와 통신하도록 자동으로 구성됩니다. 기본 네트워크 공급자를 변경하는 경우 변경 사항을 적용하려면 클러스터의 모든 호스트를 다시 설치해야 합니다. |

| 최대 로그 메모리 임계값 |

최대 메모리 사용량의 로깅 임계값을 백분율로 지정하거나 절대 값으로 MB로 지정합니다. 호스트의 메모리 사용량이 백분율 값을 초과하거나 호스트의 사용 가능한 메모리가 절대 값(MB)보다 낮은 경우 메시지가 기록됩니다. 기본값은 |

| 가상 서비스 활성화 | 이 확인란을 선택하면 이 클러스터의 호스트를 사용하여 가상 시스템을 실행합니다. |

| Gluster 서비스 활성화 | 이 확인란을 선택하면 이 클러스터의 호스트가 Red Hat Gluster Storage Server 노드로 사용되며 가상 시스템 실행에 대해서는 사용되지 않습니다. |

| 기존 Gluster 구성 가져오기 | 이 확인란은 Enable Gluster Service (Gluster 서비스 활성화) 라디오 버튼을 선택한 경우에만 사용할 수 있습니다. 이 옵션을 사용하면 기존 Gluster 지원 클러스터 및 연결된 모든 호스트를 Red Hat Virtualization Manager에 가져올 수 있습니다. 가져온 클러스터의 각 호스트에는 다음 옵션이 필요합니다.

|

| 추가 임의 번호 생성기 소스 | 확인란을 선택하면 클러스터의 모든 호스트에 사용 가능한 추가 임의 번호 생성기 장치가 있습니다. 따라서 난수 생성기 장치에서 가상 머신으로 엔트로피의 패스스루를 사용할 수 있습니다. |

| Gluster Tuned 프로필 | 이 확인란은 Gluster Service 사용 확인란이 선택된 경우에만 사용할 수 있습니다. 이 옵션은 호스트 성능에 도움이 되는 더러운 메모리 페이지를 더 적극적으로 쓸 수 있도록 virtual-host 튜닝 프로필을 지정합니다. |

2.3.2.3. 최적화 설정 설명

메모리 고려 사항

메모리 페이지 공유를 통해 가상 머신은 다른 가상 시스템에서 사용하지 않는 메모리를 활용하여 할당된 메모리의 최대 200%를 사용할 수 있습니다. 이 프로세스는 Red Hat Virtualization 환경의 가상 머신이 모두 동시에 실행되는 것이 아니라는 가정을 기반으로 하며, 미사용 메모리를 특정 가상 시스템에 일시적으로 할당할 수 있다는 가정을 토대로 합니다.

CPU 고려 사항

CPU 집약적이 아닌 워크로드의 경우 호스트의 코어 수보다 큰 총 프로세서 코어 수를 사용하여 가상 머신을 실행할 수 있습니다(단일 가상 머신의 프로세서 코어 수는 호스트의 코어 수를 초과하지 않아야 함). 다음과 같은 이점을 얻을 수 있습니다.

- 더 많은 수의 가상 시스템을 실행하여 하드웨어 요구 사항을 줄일 수 있습니다.

- 가상 코어 수가 호스트 코어 수와 호스트 스레드 수 사이의 경우와 같이 가능하지 않은 CPU 토폴로지를 사용하여 가상 시스템을 구성할 수 있습니다.

- 최상의 성능, 특히 CPU 사용량이 많은 워크로드 의 경우 호스트와 가상 시스템의 동일한 토폴로지를 사용해야 하므로 호스트와 가상 시스템에 동일한 캐시 사용량이 필요합니다. 호스트에 하이퍼 스레딩이 활성화된 경우 QEMU는 호스트의 하이퍼 스레드를 코어로 처리하므로 가상 시스템이 여러 스레드가 있는 단일 코어에서 실행되고 있음을 인식하지 못합니다. 이 동작은 가상 시스템의 성능에 영향을 줄 수 있습니다. 호스트 코어의 하이퍼스레드에 실제로 해당하는 가상 코어는 동일한 호스트 코어의 다른 하이퍼스레드와 단일 캐시를 공유할 수 있기 때문입니다. 가상 시스템은 이를 별도의 코어로 취급합니다.

아래 표는 New Cluster(새 클러스터) 및 Edit Cluster (클러스터 편집) 창의 Optimization (최적화) 탭에 대한 설정을 설명합니다.

표 2.5. 최적화 설정

| 필드 | 설명/액션 |

|---|---|

| 메모리 최적화 |

|

| CPU 스레드 | Count Threads as Cores 확인란을 선택하면 호스트에서 호스트의 코어 수보다 큰 총 프로세서 코어 수를 사용하여 가상 머신을 실행할 수 있습니다(단일 가상 시스템의 프로세서 코어 수는 호스트의 코어 수를 초과할 수 없음). 이 확인란을 선택하면 노출된 호스트 스레드가 가상 시스템에서 사용할 수 있는 코어로 처리됩니다. 예를 들어 코어당 2개 스레드(총 48개 스레드)가 있는 24코어 시스템은 각각 48개 코어의 가상 시스템을 실행할 수 있으며 호스트 CPU 부하를 계산하기 위한 알고리즘은 사용 가능한 코어 수의 두 배에 비해 부하를 비교합니다. |

| 메모리 증대 | Enable Memory balloon Optimization 확인란을 선택하면 이 클러스터의 호스트에서 실행되는 가상 시스템에서 메모리 과다 할당이 활성화됩니다. 이 확인란을 선택하면 메모리 과다 할당 관리자(MoM)가 가능한 경우 모든 가상 시스템의 메모리 크기가 보장된 메모리 크기 제한으로 ballooning을 시작합니다.

balloon을 실행하려면 가상 시스템에 관련 드라이버가 있는 balloon 장치가 있어야 합니다. 특히 제거되지 않는 한 각 가상 시스템에는 balloon 장치가 포함되어 있습니다. 이 클러스터의 각 호스트는 상태가 일부 시나리오에서 증대는 KSM과 충돌할 수 있다는 점을 이해하는 것이 중요합니다. 이러한 경우 MoM은 충돌을 최소화하기 위해 balloon 크기를 조정하려고 합니다. 또한 일부 시나리오에서는 가상 시스템의 하위 최적화 성능을 유발할 수 있습니다. 관리자는 ballooning 최적화를 주의해서 사용하는 것이 좋습니다. |

| KSM 제어 | Enable KSM( KSM 활성화) 확인란을 선택하면 MoM이 필요할 때 KSM(Kernel Same-page Merging)을 실행하고 CPU 비용을 초과하는 메모리 절약 효과를 얻을 수 있습니다. |

2.3.2.4. 마이그레이션 정책 설정 설명

마이그레이션 정책은 호스트 장애 발생 시 가상 시스템을 실시간 마이그레이션하기 위한 조건을 정의합니다. 이러한 조건에는 마이그레이션 중 가상 머신 가동 중지 시간, 네트워크 대역폭, 가상 시스템의 우선 순위 지정 방법이 포함됩니다.

표 2.6. 마이그레이션 정책 설명

| policy | 설명 |

|---|---|

| 클러스터 기본값(최소 다운타임) |

|

| 가동 중지 시간 최소화 | 일반적인 상황에서 가상 시스템을 마이그레이션할 수 있는 정책입니다. 가상 시스템에는 다운타임이 발생하지 않아야 합니다. 가상 머신 마이그레이션이 오랜 시간 후에 수렴되지 않으면 마이그레이션이 중단됩니다(최대 500밀리초의 QEMU 반복에 종속됨). 게스트 에이전트 후크 메커니즘이 활성화되어 있습니다. |

| 복사 후 마이그레이션 | 사용 시 사후 복사 마이그레이션은 소스 호스트에서 가상 시스템 vCPU 마이그레이션 일시 중단, 최소 메모리 페이지만 전송하고, 대상 호스트에서 가상 시스템 vCPU를 활성화하며, 가상 시스템이 대상 호스트에서 실행 중인 동안 나머지 메모리 페이지를 전송합니다. 사후 복사 정책은 먼저 사전 복사를 시도하여 수렴이 발생할 수 있는지 확인합니다. 오랜 시간 후에 가상 머신 마이그레이션이 수렴되지 않으면 마이그레이션이 사후 복사로 전환됩니다. 따라서 마이그레이션된 가상 시스템의 다운타임을 크게 줄이고 소스 가상 시스템의 메모리 페이지 변경 속도와 관계없이 마이그레이션을 완료할 수 있습니다. 표준 사전 복사 마이그레이션을 통해 마이그레이션할 수 없는 지속적인 사용으로 가상 시스템을 마이그레이션하는 것이 최적입니다. 이 정책의 단점은 복사 후 단계에서 누락된 메모리 부분이 호스트 간에 전송되므로 가상 시스템이 상당히 느려질 수 있다는 것입니다. 주의 사후 복사 프로세스를 완료하기 전에 네트워크 연결이 끊어지면 Manager가 실행 중인 가상 시스템을 일시 중지한 다음 종료합니다. 가상 머신 가용성이 중요하거나 마이그레이션 네트워크가 불안정한 경우에는 사후 복사 마이그레이션을 사용하지 마십시오. |

| 필요한 경우 워크로드 일시 중단 | 워크로드가 많은 가상 시스템을 포함하여 대부분의 상황에서 가상 시스템을 마이그레이션할 수 있는 정책입니다. 이로 인해 가상 머신에 다른 일부 설정보다 더 중요한 다운 타임이 발생할 수 있습니다. 극심한 워크로드로 인해 마이그레이션이 중단될 수 있습니다. 게스트 에이전트 후크 메커니즘이 활성화되어 있습니다. |

대역폭 설정은 호스트당 나가는 마이그레이션과 들어오는 마이그레이션의 최대 대역폭을 정의합니다.

표 2.7. 설명된 대역폭

| policy | 설명 |

|---|---|

| auto | 대역폭은 데이터 센터 Host Network QoS 의 Rate Limit [Mbps] 설정에서 복사됩니다. 속도 제한이 정의되지 않은 경우 네트워크 인터페이스를 보내고 받는 최소 링크 속도로 계산됩니다. 속도 제한을 설정하지 않고 링크 속도를 사용할 수 없는 경우 호스트 전송 시 로컬 VDSM 설정에 의해 결정됩니다. |

| 하이퍼바이저 기본값 | 대역폭은 호스트 전송 시 로컬 VDSM 설정을 통해 제어됩니다. |

| 사용자 지정 | 사용자 정의(Mbps). 이 값은 동시 마이그레이션 수로 나뉩니다(기본값은 진행 중 및 나가는 마이그레이션을 고려하는 2). 따라서 사용자 정의 대역폭은 모든 동시 마이그레이션을 수용할 수 있을 만큼 충분히 커야 합니다.

예를 들어 |

복원력 정책은 가상 시스템이 마이그레이션의 우선 순위를 지정하는 방법을 정의합니다.

표 2.8. 복원력 정책 설정

| 필드 | 설명/액션 |

|---|---|

| 가상 머신 마이그레이션 | 정의된 우선 순위에 따라 모든 가상 시스템을 마이그레이션합니다. |

| Migrate only Highly Available Virtual Machines | 다른 호스트 과부하를 방지하기 위해 고가용성 가상 시스템만 마이그레이션합니다. |

| 가상 머신을 마이그레이션하지 않음 | 가상 시스템이 마이그레이션되지 않도록 합니다. |

표 2.9. 추가 속성 설정

| 필드 | 설명/액션 |

|---|---|

| 마이그레이션 암호화 활성화 | 마이그레이션 중에 가상 시스템을 암호화할 수 있습니다.

|

| 병렬 마이그레이션 | 사용할 병렬 마이그레이션 연결의 여부와 수를 지정할 수 있습니다.

|

| VM 마이그레이션 연결 수 | 이 설정은 Custom 을 선택한 경우에만 사용할 수 있습니다. 2에서 255 사이의 사용자 정의 병렬 마이그레이션 수입니다. |

2.3.2.5. 설명된 스케줄링 정책 설정

스케줄링 정책을 사용하면 사용 가능한 호스트 간에 가상 시스템의 사용 및 배포를 지정할 수 있습니다. 클러스터의 호스트 전체에서 자동 로드 밸런싱을 활성화하도록 스케줄링 정책을 정의합니다. 스케줄링 정책에 관계없이 과부하된 CPU가 있는 호스트에서 가상 시스템이 시작되지 않습니다. 기본적으로 5분 동안 80% 이상의 부하가 있는 경우 호스트의 CPU가 과부하로 간주되지만 스케줄링 정책을 사용하여 이러한 값을 변경할 수 있습니다. 자세한 내용은 관리 가이드 의 스케줄링 정책을 참조하십시오.

표 2.10. 정책 탭 속성 예약

| 필드 | 설명/액션 |

|---|---|

| 정책 선택 | 드롭다운 목록에서 정책을 선택합니다.

|

| 속성 | 다음 속성은 선택한 정책에 따라 표시됩니다. 필요한 경우 편집합니다.

|

| 스케줄러 최적화 | 호스트 가중치/주문에 대한 스케줄링을 최적화합니다.

|

| 신뢰할 수 있는 서비스 활성화 |

OpenAttestation 서버와의 통합을 활성화합니다. 이를 활성화하기 전에 |

| HA 예약 활성화 | Manager를 활성화하여 고가용성 가상 시스템의 클러스터 용량을 모니터링합니다. Manager는 기존 호스트가 예기치 않게 실패하는 경우 마이그레이션하기 위해 고가용성으로 지정된 가상 시스템을 위해 적절한 용량이 클러스터 내에 있도록 합니다. |

| 일련 번호 정책 | 클러스터의 각 새 가상 머신에 일련 번호를 할당하기 위한 정책을 구성합니다.

|

| 사용자 정의 직렬 번호 | 클러스터의 새 가상 머신에 적용할 사용자 정의 일련 번호를 지정합니다. |

호스트의 사용 가능한 메모리가 20% 미만으로 떨어지면 metal .Controllers.Balloon - INFO ballooning guest:half1 from 1096400~172580 과 같은 ballooning 명령이 /var/log/vdsm/mom.log 에 기록됩니다./var/log/vdsm/mom.log 는 Memory Overcommit Manager 로그 파일입니다.

2.3.2.6. MaxFreeMemoryForOverUtilized 및 MinFreeMemoryForUnderUtilized 클러스터 스케줄링 정책 속성

스케줄러에는 현재 클러스터 스케줄링 정책 및 해당 매개 변수에 따라 가상 시스템을 마이그레이션하는 백그라운드 프로세스가 있습니다. 정책의 다양한 기준과 상대적 가중치에 따라 스케줄러는 호스트를 소스 호스트 또는 대상 호스트로 계속 분류하고 개별 가상 시스템을 이전에서 후자로 마이그레이션합니다.