배포 계획

Red Hat OpenShift Data Foundation 4.10을 배포할 때 고려해야 할 중요한 고려 사항

초록

보다 포괄적 수용을 위한 오픈 소스 용어 교체

Red Hat은 코드, 문서, 웹 속성에서 문제가 있는 용어를 교체하기 위해 최선을 다하고 있습니다. 먼저 마스터(master), 슬레이브(slave), 블랙리스트(blacklist), 화이트리스트(whitelist) 등 네 가지 용어를 교체하고 있습니다. 이러한 변경 작업은 작업 범위가 크므로 향후 여러 릴리스에 걸쳐 점차 구현할 예정입니다. 자세한 내용은 CTO Chris Wright의 메시지를 참조하십시오.

Red Hat 문서에 관한 피드백 제공

문서 개선을 위한 의견을 보내 주십시오. Red Hat이 이를 개선하는 방법을 알려 주십시오. 피드백을 제공하려면 다음을 수행하십시오.

특정 문구에 대한 간단한 의견 작성 방법은 다음과 같습니다.

- 문서가 Multi-page HTML 형식으로 표시되는지 확인합니다. 또한 문서 오른쪽 상단에 피드백 버튼이 있는지 확인합니다.

- 마우스 커서를 사용하여 주석 처리하려는 텍스트 부분을 강조 표시합니다.

- 강조 표시된 텍스트 아래에 표시되는 피드백 추가 팝업을 클릭합니다.

- 표시된 지침을 따릅니다.

보다 상세하게 피드백을 제출하려면 다음과 같이 Bugzilla 티켓을 생성하십시오.

- Bugzilla 웹 사이트로 이동하십시오.

- 구성 요소 섹션에서 설명서를 선택합니다.

- Description 필드에 문서 개선을 위한 제안 사항을 기입하십시오. 관련된 문서의 해당 부분 링크를 알려주십시오.

- Submit Bug를 클릭하십시오.

1장. OpenShift Data Foundation 소개

Red Hat OpenShift Data Foundation은 Red Hat OpenShift Container Platform을 위한 클라우드 스토리지 및 데이터 서비스의 고도로 통합된 컬렉션입니다. 간단한 배포 및 관리를 용이하게 하기 위해 운영자로 패키징된 Red Hat OpenShift Container Platform Service Catalog의 일부로 제공됩니다.

Red Hat OpenShift Data Foundation 서비스는 주로 다음 구성 요소를 나타내는 스토리지 클래스를 통해 애플리케이션에서 사용할 수 있습니다.

- 주로 데이터베이스 워크로드에 의존하는 블록 스토리지 장치입니다. 예에는 Red Hat OpenShift Container Platform 로깅 및 모니터링, PostgreSQL이 있습니다.

- 주로 소프트웨어 개발, 메시징 및 데이터 집계 워크로드에 주력하는 공유 및 분산 파일 시스템입니다. Jenkins 빌드 소스 및 아티팩트, Wordpress 업로드 콘텐츠, Red Hat OpenShift Container Platform 레지스트리, JBoss AMQ를 사용한 메시징 등이 있습니다.

- Multicloud 오브젝트 스토리지: 여러 클라우드 오브젝트 저장소에서 데이터를 추상화하고 검색할 수 있는 경량 S3 API 엔드포인트가 있습니다.

- 온프레미스 오브젝트 스토리지에는 주로 데이터 집약적 애플리케이션을 대상으로 하는 수십 페타바이트 및 수십억 개의 오브젝트로 확장되는 강력한 S3 API 엔드포인트가 있습니다. 예를 들어 Spark, Presto, Red Hat AMQ Streams(Kafka) 및 TensorFlow 및 Pytorch와 같은 머신 학습 프레임워크가 포함된 행, 열리기, 반구조적 데이터 스토리지 및 액세스 등이 있습니다.

CephFS 영구 볼륨에서 PostgresSQL 워크로드를 실행하는 것은 지원되지 않으며 RADOS Block Device(RBD) 볼륨을 사용하는 것이 좋습니다.

Red Hat OpenShift Data Foundation 버전 4.x는 다음을 포함한 소프트웨어 프로젝트 컬렉션을 통합합니다.

- Ceph, 블록 스토리지, 공유 및 분산 파일 시스템, 사내 오브젝트 스토리지 제공

- Ceph CSI: 영구 볼륨 및 클레임의 프로비저닝 및 라이프사이클 관리

- NooBaa - Multicloud Object Gateway 제공

- OpenShift Data Foundation, Rook-Ceph 및 NooBaa 운영자로 OpenShift Data Foundation 서비스를 초기화 및 관리합니다.

2장. OpenShift Data Foundation의 아키텍처

Red Hat OpenShift Data Foundation은 에 대한 서비스를 제공하며 Red Hat OpenShift Container Platform에서 내부적으로 실행할 수 있습니다.

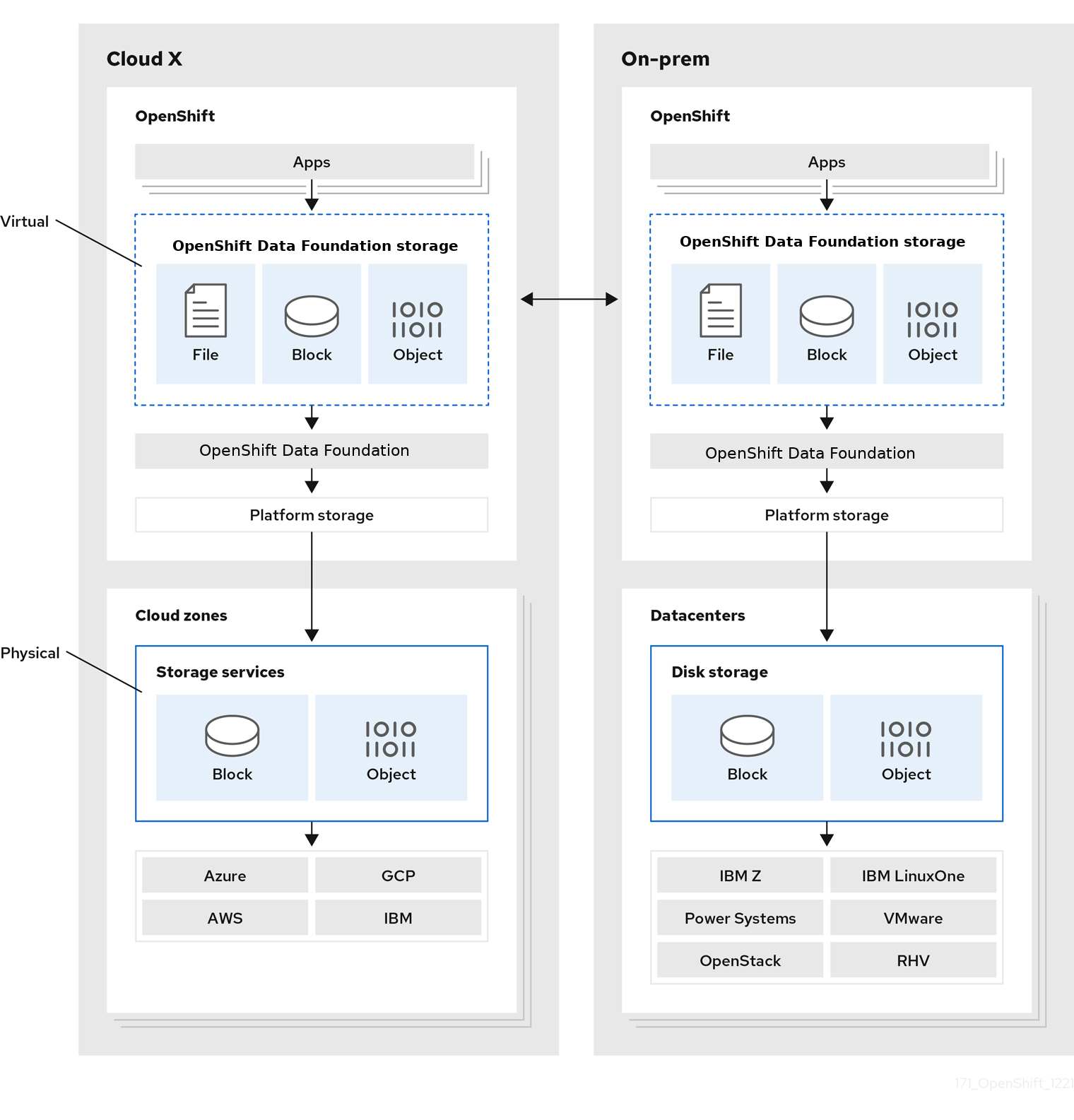

그림 2.1. Red Hat OpenShift Data Foundation 아키텍처

Red Hat OpenShift Data Foundation은 설치 프로그램 프로비저닝 인프라 또는 사용자 프로비저닝 인프라에 배포된 Red Hat OpenShift Container Platform 클러스터에 배포할 수 있도록 지원합니다. 이러한 두 가지 접근 방식에 대한 자세한 내용은 OpenShift Container Platform - 설치 프로세스를 참조하십시오. Red Hat OpenShift Data Foundation 및 Red Hat OpenShift Container Platform의 구성 요소의 상호 운용성에 대한 자세한 내용은 Red Hat OpenShift Data Foundation Supportability 및 Interoperability Checker 를 참조하십시오.

OpenShift Container Platform의 아키텍처 및 라이프사이클에 대한 자세한 내용은 OpenShift Container Platform 아키텍처를 참조하십시오.

IBM Power의 경우 OpenShift Container Platform - 설치 프로세스를 참조하십시오.

2.1. Operator 정보

Red Hat OpenShift Data Foundation은 작업 및 리소스 특성을 쉽게 자동화할 수 있도록 관리 작업과 사용자 지정 리소스를 정리하는 세 가지 기본 연산자로 구성됩니다. 관리자는 원하는 클러스터의 최종 상태를 정의하고 OpenShift Data Foundation 운영자는 클러스터가 해당 상태에 있는지 또는 최소한의 관리자 개입으로 해당 상태에 접근하는지 확인합니다.

OpenShift Data Foundation Operator

테스트된 특정 방법으로 다른 운영자를 대상으로 하여 지원되는 Red Hat OpenShift Data Foundation 배포의 권장 사항 및 요구 사항을 수정하고 적용하는 meta-operator입니다. 이 운영자는 Rook-Ceph 및 NooBaa 운영자가 제공하는 리소스를 래핑하는 스토리지 클러스터 리소스를 제공합니다.

Rook-Ceph Operator

이 운영자는 영구 스토리지 및 파일, 블록 및 오브젝트 서비스의 패키징, 배포, 관리, 업그레이드 및 확장을 자동화합니다. 모든 환경에 대해 블록 및 파일 스토리지 클래스를 생성하고 온프레미스 환경에서 해당 오브젝트 스토리지 클래스 및 서비스 개체 버킷 클레임을 생성합니다.

또한 내부 모드 클러스터의 경우 다음을 나타내는 배포 및 서비스를 관리하는 Ceph 클러스터 리소스를 제공합니다.

- 오브젝트 스토리지 데몬(OSD)

- 모니터(MON)

- 관리자 (MGR)

- 메타데이터 서버(MDS)

- 온프레미스 전용 RGW(오브젝트 게이트웨이)

MCG 연산자

이 운영자는 Multicloud Object Gateway 오브젝트 서비스의 패키징, 배포, 관리, 업그레이드 및 확장을 자동화합니다. 이를 위해 만들어진 오브젝트 스토리지 클래스 및 서비스 오브젝트 버킷 클레임을 생성합니다.

또한 NooBaa 코어, 데이터베이스 및 엔드포인트의 배포 및 서비스를 관리하는 NooBaa 클러스터 리소스를 제공합니다.

2.2. 스토리지 클러스터 배포 접근 방식

유연성은 Red Hat OpenShift Data Foundation의 핵심 원칙으로, 날로 확대되는 운영 형식 목록에서 입증되었습니다. 이 섹션에서는 환경에 가장 적합한 접근 방식을 선택하는 데 도움이 되는 정보를 제공합니다.

Red Hat OpenShift Data Foundation은 OpenShift Container Platform (내부 접근법)에 완전히 배포하거나 OpenShift Container Platform (외부 접근법) 외부에서 실행되는 클러스터에서 서비스를 사용할 수 있습니다.

2.2.1. 내부 접근 방식

Red Hat OpenShift Container Platform에 완전히 Red Hat OpenShift Data Foundation을 배포하면 운영자 기반 배포 및 관리의 모든 이점이 있습니다. 그래픽 사용자 인터페이스에서 내부 연결 장치 접근 방식은 로컬 스토리지 운영자 및 로컬 스토리지 장치를 사용하여 내부 모드로 Red Hat OpenShift Data Foundation을 배포하는 데 사용할 수 있습니다.

배포 및 관리가 OpenShift Container Platform에서 내부적으로 실행되는 OpenShift Data Foundation 서비스의 주요 요소입니다. Red Hat OpenShift Data Foundation이 Red Hat OpenShift Container Platform 내에서 완전히 실행될 때 두 가지 배포 모드를 사용할 수 있습니다.

- 단순

- 최적화

간단한 배포

Red Hat OpenShift Data Foundation 서비스는 Red Hat OpenShift Container Platform의 운영자가 관리하는 애플리케이션과 공동 ID를 실행합니다.

간단한 배포는 다음과 같은 경우에 가장 적합합니다.

- 스토리지 요구사항이 명확하지 않음

- Red Hat OpenShift Data Foundation 서비스는 애플리케이션과 함께 실행됩니다.

- 특정 크기의 노드 인스턴스를 생성하기가 어렵습니다(베어 메탈)

Red Hat OpenShift Data Foundation이 애플리케이션과 함께 상주하려면 로컬 스토리지 장치 또는 EC2의 EBS 볼륨, VMware의 vSphere Virtual Volumes 또는 PowerVC에서 동적으로 프로비저닝한 SAN 볼륨과 같이 동적으로 연결된 이동식 스토리지 장치가 있어야 합니다.

최적화된 배포

Red Hat OpenShift Data Foundation 서비스는 Red Hat OpenShift Container Platform에서 관리하는 전용 인프라 노드에서 실행됩니다.

최적화된 접근 방식은 다음과 같은 경우에 가장 적합합니다.

- 스토리지 요구 사항이 명확합니다.

- Red Hat OpenShift Data Foundation 서비스는 전용 인프라 노드에서 실행됩니다.

- 특정 크기의 노드 인스턴스를 쉽게 만들 수 있습니다(클라우드, 가상화 환경 등)

2.2.2. 외부 접근 방식

Red Hat OpenShift Data Foundation은 OpenShift Container Platform 클러스터 외부에서 실행되는 Red Hat Ceph Storage 서비스를 스토리지 클래스로 제공합니다.

다음과 같은 경우 외부 접근법을 사용하는 것이 가장 좋습니다.

- 스토리지 요구 사항은 매우 큽니다 (600 개 이상의 스토리지 장치)

- 여러 OpenShift Container Platform 클러스터에서 공통 외부 클러스터의 스토리지 서비스를 사용해야 합니다.

- 또 다른 팀(SRE, Storage 등)은 스토리지 서비스를 제공하는 외부 클러스터를 관리해야 합니다. 기존 상태일 수 있습니다.

2.3. 노드 유형

노드는 컨테이너 런타임과 서비스를 실행하여 컨테이너가 실행 중인지 확인하고 포드 간 네트워크 통신과 분리를 유지 관리합니다. OpenShift Data Foundation에는 다음 세 가지 유형의 노드가 있습니다.

표 2.1. 노드 유형

| 노드 유형 | 설명 |

|---|---|

| Master | 이러한 노드는 Kubernetes API를 노출하고, 새로 생성된 포드를 감시 및 예약하고, 노드 상태 및 수량을 유지 관리하며, 기본 클라우드 프로바이더와의 상호 작용을 제어하는 프로세스를 실행합니다. |

| 인프라(Infra) | 인프라 노드는 로깅, 지표, 레지스트리 및 라우팅과 같은 클러스터 수준 인프라 서비스를 실행합니다. OpenShift Container Platform 클러스터에서는 선택 사항입니다. 애플리케이션과 OpenShift Data Foundation 계층 워크로드를 분리하려면 가상화 및 클라우드 환경에서 OpenShift Data Foundation에 인프라 노드를 사용하는 것이 좋습니다.

Infra 노드를 생성하려면 |

| Worker | 작업자 노드는 애플리케이션을 실행하기 때문에 애플리케이션 노드라고도 합니다. OpenShift Data Foundation을 내부 모드로 배포하면 3개의 작업자 노드 최소 클러스터가 필요합니다. 여기서 노드는 가용성을 보장하기 위해 세 개의 다른 랙 또는 가용 영역에 분산하는 것이 좋습니다. OpenShift Data Foundation이 작업자 노드에서 실행되려면 로컬 스토리지 장치 또는 이식 가능한 스토리지 장치가 동적으로 연결되어 있어야 합니다. 외부 모드로 배포하면 여러 노드에서 실행되어 오류가 발생할 경우 사용 가능한 노드에서 K8S로 다시 예약할 수 있습니다. |

OpenShift Data Foundation에는 OpenShift Container Platform과 동일한 수의 하위 작업이 필요합니다. 그러나 OpenShift Data Foundation이 인프라 노드에서 실행 중인 경우 OpenShift는 이러한 노드에 대한 OpenShift Container Platform 서브스크립션이 필요하지 않습니다. 따라서 OpenShift Data Foundation 컨트롤 플레인에는 추가 OpenShift Container Platform 및 OpenShift Data Foundation 서브스크립션이 필요하지 않습니다. 자세한 내용은 6장. 서브스크립션의 내용을 참조하십시오.

3장. 내부 스토리지 서비스

Red Hat OpenShift Data Foundation 서비스는 다음 인프라에서 실행되는 Red Hat OpenShift Container Platform에서 내부적으로 사용할 수 있습니다.

- Amazon Web Services

- 베어 메탈

- VMware vSphere

- Microsoft Azure

- Google Cloud [기술 프리뷰]

- Red Hat Virtualization 4.4.x 이상(IPI)

- Red Hat OpenStack 13 이상(IPI) [기술 프리뷰]

- IBM Power

- IBM Z 및 LinuxONE

내부 클러스터 리소스를 생성하면 OpenShift Data Foundation 기본 서비스의 내부 프로비저닝이 생성되고 애플리케이션에서 추가 스토리지 클래스를 사용할 수 있습니다.

4장. 외부 스토리지 서비스

Red Hat OpenShift Data Foundation은 IBM FlashSystem을 사용하거나 다음 플랫폼에서 실행되는 OpenShift Container Platform 클러스터를 통해 외부 Red Hat Ceph Storage 클러스터의 서비스를 사용할 수 있도록 할 수 있습니다.

- VMware vSphere

- 베어 메탈

- Red Hat OpenStack Platform (기술 프리뷰)

- IBM Power

- IBM Z 인프라

OpenShift Data Foundation 운영자는 외부 서비스에 대한 영구 볼륨 및 오브젝트 버킷 클레임을 충족하기 위해 서비스를 생성하고 관리합니다. 외부 클러스터는 OpenShift Container Platform에서 실행되는 애플리케이션에 대해 블록, 파일 및 오브젝트 스토리지 클래스를 제공할 수 있습니다. 외부 클러스터는 운영자가 배포하거나 관리하지 않습니다.

5장. 보안 고려 사항

5.1. FIPS-140-2

연방 정보 처리 표준 발행 140-2(FIPS-140-2)는 암호화 모듈 사용을 위한 보안 요구 사항을 정의하는 표준입니다. 이 표준은 미국 정부 기관과 계약자를 위한 법률에 따라 규정되며 기타 국제 및 업계별 표준에서 참조됩니다.

Red Hat OpenShift Data Foundation은 이제 RHCOS(Red Hat Enterprise Linux OS/CoreOS)에서 제공하는 FIPS 검증 암호화 모듈을 사용합니다.

암호화 모듈은 현재 CMVP(Cryptographic Module Validation Program)에 의해 처리되고 있으며 해당 상태는 진행 중인 Modules in Process List 에서 확인할 수 있습니다. 최신 정보는 기술 자료 문서를 참조하십시오.

OpenShift Data Foundation을 설치하기 전에 OpenShift Container Platform에서 FIPS 모드를 활성화해야 합니다. RHEL 7의 OpenShift Data Foundation 배포는 이 기능에 대해 지원되지 않으므로 OpenShift Container Platform은 RHCOS 노드에서 실행해야 합니다.

자세한 내용은 FIPS 모드에서 클러스터 설치 및 FIPS 암호화 지원을 참조하십시오.

5.2. 프록시 환경

프록시 환경은 인터넷에 대한 직접 액세스를 거부하고 대신 사용 가능한 HTTP 또는 HTTPS 프록시를 제공하는 프로덕션 환경입니다. Red Hat Openshift Container Platform은 기존 클러스터의 프록시 오브젝트를 수정하거나 새 클러스터의 install-config.yaml 파일에서 프록시 설정을 구성하여 프록시를 사용하도록 구성됩니다.

Red Hat은 클러스터 전체 프록시 구성에 따라 OpenShift Container Platform이 구성된 경우 프록시 환경에서 OpenShift Data Foundation 배포를 지원합니다.

5.3. 데이터 암호화 옵션

암호화를 사용하면 필요한 암호화 키 없이 데이터를 읽을 수 없도록 인코딩할 수 있습니다. 이 메커니즘은 물리적 보안 위반 시 물리적 미디어가 보호되지 않도록 만드는 경우 데이터의 기밀성을 보호합니다. 또한 PV별 암호화는 동일한 OpenShift Container Platform 클러스터 내의 다른 네임스페이스로부터의 액세스를 보호합니다. 데이터는 디스크에 기록될 때 암호화되며 디스크에서 읽을 때 암호를 해독합니다. 암호화된 데이터로 작업하면 성능이 저하될 수 있습니다.

암호화는 Red Hat OpenShift Data Foundation 4.6 이상을 사용하여 배포된 새 클러스터에서만 지원됩니다. 외부 KMS(Key Management System)를 사용하지 않는 기존 암호화된 클러스터는 외부 KMS를 사용하도록 마이그레이션할 수 없습니다.

현재는 클러스터 전체 및 영구 볼륨 암호화에 대해 지원되는 유일한 KMS입니다. OpenShift Data Foundation 4.7.0 및 4.7.1에서는 KV(HookCorp Vault Key/Value) 시크릿 엔진 API만 지원되고 버전 1이 지원됩니다. OpenShift Data Foundation 4.7.2부터 H¢Corp Vault KV 시크릿 엔진 API, 버전 1 및 2가 지원됩니다.

- KMS는 영구 볼륨(PV) 암호화에 필요하며 클러스터 전체 암호화에는 선택 사항입니다.

- 스토리지 클래스 암호화를 시작하려면 유효한 Red Hat OpenShift Data Foundation Advanced 서브스크립션이 필요합니다. 자세한 내용은 OpenShift Data Foundation 서브스크립션에 대한 지식베이스 문서 를 참조하십시오.

Red Hat은 기술 파트너와 협력하여 이 문서를 고객에게 서비스로 제공하고 있습니다. 하지만 Red Hat은 H¢corp 제품에 대한 지원을 제공하지 않습니다. 이 제품에 대한 기술 지원이 필요한 경우 Hsea corp에 문의하십시오.

5.3.1. 클러스터 전체 암호화

Red Hat OpenShift Data Foundation은 스토리지 클러스터의 모든 디스크 및 Multicloud Object Gateway 작업에 대해 클러스터 전체 암호화(encryption-at-rest)를 지원합니다. OpenShift Data Foundation에서는 키 크기가 512비트이고 각 장치에 다른 암호화 키가 있는 aes-xts-plain64 암호화가 포함된 Linux 통합 키 시스템(LUKS) 버전 2 기반 암호화를 사용합니다. 키는 Kubernetes 시크릿 또는 외부 KMS를 사용하여 저장됩니다. 두 방법 모두 상호 배타적이며 메서드 간에 마이그레이션할 수 없습니다.

암호화는 기본적으로 비활성화되어 있습니다. 배포 시 클러스터의 암호화를 활성화할 수 있습니다. 자세한 내용은 배포 가이드를 참조하십시오.

클러스터 전체 암호화는 KMS(Key Management System) 없이 OpenShift Data Foundation 4.6에서 지원되지만 OpenShift Data Foundation 4.7부터는 KMS 없이 지원합니다.

유효한 Red Hat OpenShift Data Foundation Advanced 서브스크립션이 필요합니다. OpenShift Data Foundation의 서브스크립션이 작동하는 방법을 알아보려면 OpenShift Data Foundation 서브스크립션에 대한 기술 자료 문서 를 참조하십시오.

HashiCorp Vault KMS를 사용한 클러스터 광범위한 암호화는 다음 두 가지 인증 방법을 제공합니다.

- 토큰: 이 방법은 자격 증명 모음 토큰을 사용하여 인증을 허용합니다. 자격 증명 모음 토큰을 포함하는 Kubernetes 보안은 openshift-storage 네임스페이스에서 생성되며 인증에 사용됩니다. 이 인증 방법을 선택하면 관리자는 암호화 키가 저장되는 Vault에서 백엔드 경로에 대한 액세스를 제공하는 자격 증명 모음 토큰을 제공해야 합니다.

Kubernetes: 이 방법을 사용하면 serviceaccounts를 사용하여 vault로 인증할 수 있습니다. 이 인증 방법을 선택하면 관리자는 암호화 키가 저장되는 백엔드 경로에 대한 액세스를 제공하는 Vault에 구성된 역할의 이름을 제공해야 합니다. 그러면 이 역할의 값이

ocs-kms-connection-details구성 맵에 추가됩니다. 이 방법은 OpenShift Data Foundation 4.10에서 사용할 수 있습니다.현재 HCorp Vault는 유일하게 지원되는 KMS입니다. OpenShift Data Foundation 4.7.0 및 4.7.1에서는 H¢Corp Vault KV 시크릿 엔진만 지원되고 API 버전 1이 지원됩니다. OpenShift Data Foundation 4.7.2부터 H¢Corp Vault KV 시크릿 엔진 API, 버전 1 및 2가 지원됩니다.

IBM Cloud 플랫폼의 OpenShift Data Foundation은 HashiCorp Vault KMS 외에도 암호화 솔루션으로 HPCS(Hyper Protect Crypto Services)를 암호화 솔루션으로 지원합니다.

Red Hat은 기술 파트너와 협력하여 이 문서를 고객에게 서비스로 제공하고 있습니다. 하지만 Red Hat은 H¢corp 제품에 대한 지원을 제공하지 않습니다. 이 제품에 대한 기술 지원이 필요한 경우 Hsea corp에 문의하십시오.

5.3.2. 스토리지 클래스 암호화

외부 KMS(키 관리 시스템)를 사용하여 스토리지 클래스 암호화로 영구 볼륨(블록 전용)을 암호화하여 장치 암호화 키를 저장할 수 있습니다. 영구 볼륨 암호화는 RADOS 블록 장치(RBD) 영구 볼륨에만 사용할 수 있습니다. 영구 볼륨 암호화를 사용하여 스토리지 클래스를 생성하는 방법을 참조하십시오.

스토리지 클래스 암호화는 OpenShift Data Foundation 4.7 이상에서 지원됩니다.

유효한 Red Hat OpenShift Data Foundation Advanced 서브스크립션이 필요합니다. OpenShift Data Foundation의 서브스크립션이 작동하는 방법을 알아보려면 OpenShift Data Foundation 서브스크립션에 대한 기술 자료 문서 를 참조하십시오.

6장. 서브스크립션

6.1. 서브스크립션 제품

Red Hat OpenShift Data Foundation 서브스크립션은 Red Hat OpenShift Container Platform과 비슷한 "코어 쌍"을 기반으로 합니다. Red Hat OpenShift Data Foundation 2-코어 서브스크립션은 OpenShift Container Platform이 실행되는 시스템의 CPU의 논리적 코어 수를 기반으로 합니다.

OpenShift Container Platform과 마찬가지로:

- OpenShift Data Foundation 서브스크립션은 대규모 호스트를 처리할 수 있도록 스택킹할 수 있습니다.

- 필요한 만큼 코어를 VM(가상 시스템)에 배포할 수 있습니다. 예를 들어 10개의 2코어 서브스크립션은 20개의 코어를 제공하며, IBM Power가 SMT 수준에서 2코어 또는 16개의 vCPU를 제공하는 경우 여러 VM에서 사용할 수 있습니다.

- OpenShift Data Foundation 서브스크립션은 프리미엄 또는 표준 지원에서 사용할 수 있습니다.

6.2. 재해 복구 서브스크립션

Red Hat OpenShift Data Foundation에서 지원하는 재해 복구 기능에는 재해 복구 솔루션을 성공적으로 구현하기 위해 다음 사전 요구 사항이 모두 필요합니다.

- 유효한 Red Hat OpenShift Data Foundation Advanced 인타이틀먼트

- 유효한 Red Hat Advanced Cluster Management for Kubernetes 서브스크립션

소스 또는 대상으로 활성 복제에 참여하는 PV를 포함하는 Red Hat OpenShift Data Foundation Cluster에는 OpenShift Data Foundation Advanced 인타이틀먼트가 필요합니다. 이 서브스크립션은 소스 클러스터와 대상 클러스터에서 모두 활성화되어야 합니다.

OpenShift Data Foundation의 서브스크립션이 작동하는 방법을 알아보려면 OpenShift Data Foundation 서브스크립션에 대한 기술 자료 문서 를 참조하십시오.

6.3. 코어 대 vCPU 및 하이퍼 스레딩

특정 시스템에서 하나 이상의 코어를 사용하는지 여부를 판단하는 것은 현재 해당 시스템에 사용 가능한 하이퍼 스레딩이 있는지 여부에 따라 달라집니다. 하이퍼 스레딩은 Intel CPU의 기능일 뿐입니다. Red Hat 고객 포털을 방문하여 특정 시스템이 하이퍼 스레딩을 지원하는지 확인합니다.

하이퍼 스레딩이 활성화되어 있고 하나의 하이퍼 스레드가 표시된 시스템 코어와 같은 경우 코어 계산은 2 코어에서 4 vCPU의 비율입니다. 따라서 2코어 서브스크립션은 하이퍼스레드 시스템의 vCPU 4개를 지원합니다. 대규모 VM(가상 시스템)에는 8개의 vCPU(예: 4개의 서브스크립션 코어)가 있을 수 있습니다. 서브스크립션이 2코어 단위로 제공되면 이 4코어 또는 8개 vCPU를 적용하려면 2-코어 서브스크립션 2개가 필요합니다.

하이퍼 스레딩이 활성화되지 않고 볼 수 있는 각 시스템 코어가 기본 물리적 코어와 직접 연결되어 있는 경우 코어 계산은 2개 코어에서 2개의 vCPU의 비율입니다.

6.3.1. IBM Power의 코어 대 vCPU 및 동시 멀티스레딩(SMT)

특정 시스템이 하나 이상의 코어를 사용하는지 여부를 판단하는 것은 현재 구성된 SMT(동시 멀티스레딩) 수준에 따라 달라집니다. IBM Power는 아래 표와 같이 vCPU 수에 해당하는 각 코어에 대해 1, 2, 4 또는 8의 동시 멀티스레딩 수준을 제공합니다.

표 6.1. 다른 SMT 수준 및 해당 vCPU

| SMT 수준 | SMT=1 | SMT=2 | SMT=4 | SMT=8 |

|---|---|---|---|---|

| 코어 1개 | # vCPUs=1 | # vCPUs=2 | # vCPUs=4 | # vCPUs=8 |

| 2개 코어 | # vCPUs=2 | # vCPUs=4 | # vCPUs=8 | # vCPUs=16 |

| 4개 코어 | # vCPUs=4 | # vCPUs=8 | # vCPUs=16 | # vCPUs=32 |

SMT가 구성된 시스템의 경우 서브스크립션 목적에 필요한 코어 수에 대한 계산은 SMT 수준에 따라 다릅니다. 따라서 2코어 서브스크립션은 SMT 레벨의 SMT 레벨 2의 vCPU 2개, SMT 레벨 2의 vCPU 4개, SMT 레벨 4개 및 SMT 레벨 8의 vCPU 16개 vCPU에 해당합니다. 대형 가상 머신(VM)에는 16개의 vCPU가 있을 수 있습니다. SMT 수준 8에서는 vCPU #을 SMT-8 = 2의 경우 SMT 수준(16 vCPUs / 8)으로 나누는 2코어 서브스크립션이 필요합니다. 서브스크립션이 2코어 단위로 제공되면 이 2코어 또는 16개 vCPU를 적용하려면 2코어 서브스크립션이 1개 필요합니다.

6.4. 코어 분할

홀수 코어가 필요한 시스템은 전체 2-코어 서브스크립션을 사용해야 합니다. 예를 들어, 1코어만 요구하도록 계산된 시스템은 등록 및 서브스크립션이 완료되면 전체 2-코어 서브스크립션을 사용합니다.

2개의 vCPU가 있는 단일 VM(가상 시스템)이 하이퍼 스레딩을 사용하므로 계산된 vCPU 1개를 사용하면 전체 2-코어 서브스크립션이 필요합니다. 2-코어 서브스크립션은 하이퍼 스레딩을 사용하여 두 개의 VM으로 분할되지 않을 수 있습니다. 자세한 내용은 코어 vs vCPU 및 하이퍼 스레딩 섹션을 참조하십시오.

다수의 코어가 필요하도록 가상 인스턴스의 크기를 조정하는 것이 좋습니다.

6.4.1. IBM Power용 공유 프로세서 풀

IBM Power는 공유 프로세서 풀에 대한 개념이 있습니다. 공유 프로세서 풀의 프로세서는 클러스터의 노드 전체에서 공유할 수 있습니다. Red Hat OpenShift Data Foundation에 필요한 집계 컴퓨팅 용량은 여러 코어 쌍이어야 합니다.

6.5. 서브스크립션 요구 사항

Red Hat OpenShift Data Foundation 구성 요소는 OpenShift Container Platform 작업자 또는 인프라 노드에서 실행할 수 있으며 RHCOS (Red Hat CoreOS) 또는 RHEL (Red Hat Enterprise Linux) 8.4를 호스트 운영 체제로 사용할 수 있습니다. RHEL 7은 더 이상 사용되지 않습니다. OpenShift Data Foundation 서브스크립션은 비율이 1:1인 모든 OpenShift Container Platform 서브스크립션 코어에 필요합니다.

인프라 노드를 사용하는 경우 OpenShift Container Platform 또는 OpenShift Data Foundation 서브스크립션이 필요하지 않더라도 OpenShift Data Foundation에 대한 모든 OpenShift 작업자 노드 코어를 서브스크립션하는 규칙이 적용됩니다. 라벨을 사용하여 노드가 작업자 노드인지 아니면 인프라 노드인지를 확인할 수 있습니다.

자세한 내용은 Managing and Allocating Storage Resources 가이드에서 Red Hat OpenShift Data Foundation 전용 작업자 노드를 사용하는 방법을 참조하십시오.

7장. 인프라 요구 사항

7.1. 플랫폼 요구 사항

Red Hat OpenShift Data Foundation 4.10은 OpenShift Container Platform 버전 4.10 및 다음 마이너 버전에서만 지원됩니다.

이전 버전의 Red Hat OpenShift Data Foundation의 버그 수정은 버그 수정 버전으로 릴리스됩니다. 자세한 내용은 Red Hat OpenShift Container Platform 라이프 사이클 정책을 참조하십시오.

외부 클러스터 서브스크립션 요구 사항은 이 Red Hat 지식베이스 문서를 참조하십시오.

지원되는 플랫폼 버전의 전체 목록은 Red Hat OpenShift Data Foundation 및 Red Hat OpenShift Container Platform 상호 운용성 매트릭스 를 참조하십시오.

7.1.1. Amazon EC2

내부 Red Hat OpenShift Data Foundation 클러스터만 지원합니다.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 스토리지 클래스를 제공하는 스토리지 클래스를 보유해야 합니다.

- aws-ebs 프로비전 프로그램을 통한 EBS 스토리지

OpenShift Data Foundation 버전 4.10은 이제 AWS에서 도입한 gp2 및 gp3 CSI 드라이버를 지원합니다. 이러한 드라이버는 향상된 스토리지 확장 기능(gp2 in-tree)과 월 가격대(gp3) 감소를 제공합니다. 이제 OpenShift Data Foundation 4.10에서 스토리지 클래스를 선택할 때 새 드라이버를 선택할 수 있습니다(gp2가 기본값임).

7.1.2. 베어 메탈

내부 클러스터 지원 및 외부 클러스터 사용.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 Local Storage Operator를 통해 로컬 SSD(NVMe/SATA/SAS, SAN)를 제공하는 스토리지 클래스가 있어야 합니다.

7.1.3. VMware vSphere

내부 클러스터 지원 및 외부 클러스터 사용.

권장 버전:

- vSphere 6.7, Update 2 이상

- vSphere 7.0 이상

자세한 내용은 VMware vSphere 인프라 요구 사항을 참조하십시오.

VMware ESXi에서 장치를 플래시로 인식하지 못하는 경우 해당 장치를 플래시 장치로 표시합니다. Red Hat OpenShift Data Foundation을 배포하기 전에 스토리지 장치를 Flash로 표시합니다.

또한 내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 스토리지 클래스를 제공합니다.

- vsphere-volume 프로비전 프로그램을 통한 VSAN 또는 VMFS 데이터 저장소

- Local Storage Operator를 통한 VMDK, RDM 또는 DirectPath 스토리지 장치.

7.1.4. Microsoft Azure

내부 Red Hat OpenShift Data Foundation 클러스터만 지원합니다.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 스토리지 클래스를 제공하는 스토리지 클래스를 보유해야 합니다.

- azure-disk 프로비저너를 통한 Azure 디스크

7.1.5. Google Cloud [기술 프리뷰]

내부 Red Hat OpenShift Data Foundation 클러스터만 지원합니다.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 스토리지 클래스를 제공하는 스토리지 클래스를 보유해야 합니다.

- gce-pd 프로비저너를 통한 GCE 영구 디스크

7.1.6. Red Hat Virtualization Platform

내부 Red Hat OpenShift Data Foundation 클러스터만 지원합니다.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 Local Storage Operator를 통해 로컬 SSD(NVMe/SATA/SAS, SAN)를 제공하는 스토리지 클래스가 있어야 합니다.

7.1.7. Red Hat OpenStack Platform [기술 프리뷰]

내부 Red Hat OpenShift Data Foundation 클러스터를 지원하고 외부 클러스터를 사용합니다.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 스토리지 클래스를 제공하는 스토리지 클래스를 보유해야 합니다.

- Cinder 프로비저너를 통한 표준 디스크

7.1.8. IBM Power

내부 Red Hat OpenShift Data Foundation 클러스터를 지원하고 외부 클러스터를 사용합니다.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 Local Storage Operator를 통해 로컬 SSD(NVMe/SATA/SAS, SAN)를 제공하는 스토리지 클래스가 있어야 합니다.

7.1.9. IBM Z 및 LinuxONE

내부 Red Hat OpenShift Data Foundation 클러스터만 지원합니다.

내부 클러스터는 스토리지 장치 요구 사항을 모두 충족해야 하며 Local Storage Operator를 통해 로컬 SSD(NVMe/SATA/SAS, SAN)를 제공하는 스토리지 클래스가 있어야 합니다.

7.2. 외부 모드 요구 사항

7.2.1. Red Hat Ceph Storage

RHCS(Red Hat Ceph Storage) 버전 4.2z1 이상이 필요합니다. 지원되는 버전에 대한 자세한 내용은 Red Hat Ceph Storage 릴리스 및 해당 Ceph 패키지 버전에 대한 기술 자료 문서를 참조하십시오.

RHCS 4 클러스터 설치 방법에 대한 지침은 설치 가이드를 참조하십시오.

7.2.2. IBM FlashSystem

IBM FlashSystem을 다른 공급자의 플러그형 외부 스토리지로 사용하려면 IBM FlashSystem 스토리지 클래스를 백업 스토리지로 사용하는 OpenShift Data Foundation을 배포하기 전에 먼저 배포해야 합니다.

지원되는 최신 FlashSystem 제품 및 버전은 IBM 문서의 Spectrum Virtualize 제품군 제품 문서 내에서 참조 > Red Hat OpenShift Data Foundation 지원 요약을 참조하십시오.

OpenShift Data Foundation을 배포하는 방법에 대한 자세한 내용은 외부 IBM FlashSystem 스토리지에 대한 OpenShift Data Foundation Cluster 생성을 참조하십시오.

7.3. 리소스 요구사항

Red Hat OpenShift Data Foundation 서비스는 초기 기본 서비스 세트로 구성되며 추가 장치 세트를 사용하여 확장할 수 있습니다. 이러한 모든 Red Hat OpenShift Data Foundation 서비스 Pod는 리소스 요구 사항에 따라 OpenShift Container Platform 노드에서 kubernetes에 의해 예약됩니다. 각 장애 도메인에 있는 하나의 노드인 3개의 배수로 클러스터를 확장하면 포드 배치 규칙을 쉽게 충족할 수 있습니다.

이러한 요구 사항은 OpenShift Data Foundation 서비스뿐만 아니라 이러한 노드에서 실행 중인 다른 서비스, 운영자 또는 워크로드와는 관련이 있습니다.

표 7.1. Red Hat OpenShift Data Foundation에 대한 중요한 리소스 요구 사항을 집계합니다.

| 배포 모드 | 기본 서비스 | 추가 장치 세트 |

|---|---|---|

| 내부 |

|

|

| 외부 |

| 해당 없음 |

예제: 단일 장치 세트가 있는 내부 모드 배포에서 3개의 노드 클러스터의 경우 최소 3 x 10 = 30개의 CPU 단위가 필요합니다.

자세한 내용은 6장. 서브스크립션 및 CPU 단위를 참조하십시오.

Red Hat OpenShift Data Foundation 클러스터 설계에 대한 추가 지침은 ODF 크기 조정 도구를 참조하십시오.

CPU 단위

이 섹션에서는 1개의 CPU 유닛이 Kubernetes 개념인 1 CPU 단위에 매핑됩니다.

- CPU의 1 단위는 하이퍼바이저가 아닌 CPU의 경우 1코어에 해당합니다.

- 2개의 CPU 단위는 하이퍼스레딩된 CPU의 경우 1코어에 해당합니다.

- Red Hat OpenShift Data Foundation 코어 기반 서브스크립션은 항상 쌍(2코어)으로 제공됩니다.

표 7.2. IBM Power에 대한 최소 리소스 요구 사항 집계

| 배포 모드 | 기본 서비스 |

|---|---|

| 내부 |

|

| 외부 |

|

예제: 내부 연결 장치 모드 배포에서 3개의 노드 클러스터의 경우 최소 3 x 16 = 48개의 CPU 및 3 x 64 = 192GB의 메모리가 필요합니다.

7.3.1. IBM Z 및 LinuxONE 인프라에 대한 리소스 요구 사항

Red Hat OpenShift Data Foundation 서비스는 초기 기본 서비스 세트로 구성되며 추가 장치 세트를 사용하여 확장할 수 있습니다.

이러한 모든 Red Hat OpenShift Data Foundation 서비스 Pod는 리소스 요구 사항에 따라 OpenShift Container Platform 노드에서 kubernetes에 의해 예약됩니다.

각 장애 도메인에 있는 하나의 노드인 3개의 배수로 클러스터를 확장하면 포드 배치 규칙을 쉽게 충족할 수 있습니다.

표 7.3. Red Hat OpenShift Data Foundation에 대해서만 사용 가능한 리소스 요구 사항을 집계합니다 (IBM Z 및 LinuxONE)

| 배포 모드 | 기본 서비스 | 추가 장치 세트 | IBM Z 및 LinuxONE 최소 하드웨어 요구 사항 |

|---|---|---|---|

| 내부 |

|

| 1 IFL |

| 외부 |

| 해당 없음 | 해당 없음 |

- CPU

- 는 하이퍼바이저, IBM z/VM, KVM(커널 가상 시스템) 또는 둘 다에 정의된 가상 코어 수입니다.

- IFL (Linux 통합 기능)

- 는 IBM Z 및 LinuxONE의 물리적 코어입니다.

최소 시스템 환경

- 1개의 LPAR(Logical partition)을 사용하여 최소 클러스터를 운영하려면 6 IFL 위에 한 개의 추가 IFL이 필요합니다. OpenShift Container Platform은 이러한 IFL을 사용합니다.

7.3.2. 최소 배포 리소스 요구사항

표준 배포 리소스 요구 사항이 충족되지 않은 경우 OpenShift Data Foundation 클러스터는 최소 구성으로 배포됩니다.

이러한 요구 사항은 OpenShift Data Foundation 서비스뿐만 아니라 이러한 노드에서 실행 중인 다른 서비스, 운영자 또는 워크로드와는 관련이 있습니다.

표 7.4. OpenShift Data Foundation의 리소스 요구 사항만 집계합니다.

| 배포 모드 | 기본 서비스 |

|---|---|

| 내부 |

|

장치 세트를 추가하려면 최소 배포를 표준 배포로 변환하는 것이 좋습니다.

7.3.3. 간단한 배포 리소스 요구 사항

Red Hat OpenShift Data Foundation은 모든 워크로드가 3개의 강력한 마스터 노드에서 실행되는 3노드 OpenShift 소형 베어 메탈 클러스터에 설치할 수 있습니다. 작업자 또는 스토리지 노드가 없습니다.

이러한 요구 사항은 OpenShift Data Foundation 서비스뿐만 아니라 이러한 노드에서 실행 중인 다른 서비스, 운영자 또는 워크로드와는 관련이 있습니다.

표 7.5. OpenShift Data Foundation의 리소스 요구 사항만 집계합니다.

| 배포 모드 | 기본 서비스 | 추가 장치 세트 |

|---|---|---|

| 내부 |

|

|

소형 베어 메탈 클러스터에서 OpenShift Container Platform을 구성하려면 3-노드 클러스터 구성 및 에지 배포를 위한 3-노드 아키텍처 제공을 참조하십시오.

7.3.4. MCG 배포를 위한 리소스 요구 사항

MCG(Multicloud Object Gateway) 구성 요소와 함께 배포되는 OpenShift Data Foundation 클러스터는 배포의 유연성을 제공하고 리소스 사용량을 줄이는 데 도움이 됩니다.

표 7.6. MCG 배포에 대한 리소스 요구 사항 집계

| 배포 모드 | 코어 | 데이터베이스(DB) | 끝점 |

|---|---|---|---|

| 내부 |

|

|

참고 해충 차 크기는 1 ~ 2 사이입니다. |

7.4. Pod 배치 규칙

Kubernetes는 선언적 배치 규칙에 따라 포드 배치를 담당합니다. 내부 클러스터에 대한 Red Hat OpenShift Data Foundation 기본 서비스 배치 규칙은 다음과 같이 요약할 수 있습니다.

-

노드는

cluster.ocs.openshift.io/openshift-storage키로 레이블이 지정됩니다. - 노드가 없는 경우 노드가 의사 장애 도메인으로 정렬됩니다.

- 고가용성을 필요로 하는 구성 요소가 장애 도메인 전체에 분산됨

- 스토리지 장치는 각 장애 도메인에서 액세스할 수 있어야 합니다.

이렇게 하면 노드가 3개 이상 있고 기존 토폴로지 라벨이 있는 경우 노드가 3개의 개별 랙 또는 영역 장애 도메인에 있어야 합니다.

추가 장치 세트의 경우 스토리지 장치가 있어야 하며 3개의 실패 도메인 각각에 해당 장치를 사용하는 포드에 충분한 리소스가 있어야 합니다. 수동 배치 규칙을 사용하여 기본 배치 규칙을 재정의할 수 있지만, 일반적으로 이 방법은 베어 메탈 배포에만 적합합니다.

7.5. 스토리지 장치 요구 사항

이 섹션을 사용하여 내부 모드 배포 및 업그레이드를 계획할 때 고려할 수 있는 다양한 스토리지 용량 요구 사항을 설명합니다. 일반적으로 노드당 9개의 장치 이하를 권장합니다. 이 권장 사항은 두 노드가 클라우드 프로바이더 동적 스토리지 장치 연결 제한보다 작게 유지되고 로컬 스토리지 장치를 사용하여 노드 장애 후 복구 시간을 제한하도록 합니다. 각 장애 도메인에 있는 하나의 노드인 3개의 배수로 클러스터를 확장하면 포드 배치 규칙을 쉽게 충족할 수 있습니다.

설치 시 선택한 용량의 증가에서만 스토리지 용량을 확장할 수 있습니다.

7.5.1. 동적 스토리지 장치

Red Hat OpenShift Data Foundation에서는 0.5TiB, 2TiB 또는 4TiB 용량을 동적 스토리지 장치 크기에 대한 요청 크기로 선택할 수 있습니다. 노드당 실행할 수 있는 동적 스토리지 장치의 수는 노드 크기, 기본 프로비저너 제한 및 리소스 요구 사항 의 기능입니다.

7.5.2. 로컬 스토리지 장치

로컬 스토리지 배포의 경우 4TiB 이하의 디스크 크기를 사용할 수 있으며 모든 디스크는 동일한 크기와 유형이어야 합니다. 노드별로 실행할 수 있는 로컬 스토리지 장치의 수는 노드 크기 및 리소스 요구 사항 의 기능입니다. 각 장애 도메인에 있는 하나의 노드인 3개의 배수로 클러스터를 확장하면 포드 배치 규칙을 쉽게 충족할 수 있습니다.

디스크 파티셔닝은 지원되지 않습니다.

7.5.3. 용량 계획

항상 사용 가능한 스토리지 용량이 소비보다 먼저 유지되도록 합니다. 사용 가능한 스토리지 용량이 완전히 고갈되면 복구가 어려워지며 단순히 용량을 추가하거나 콘텐츠를 삭제하거나 마이그레이션하는 것보다 더 많은 개입이 필요합니다.

클러스터 스토리지 용량이 75%(near-full) 및 85%(전체)에 도달하면 용량 경고가 발생합니다. 항상 용량 경고를 즉시 처리하고 정기적으로 스토리지를 검토하여 스토리지 공간이 부족하지 않도록 합니다. 75%(near-full)가 있으면 공간을 확보하거나 클러스터를 확장합니다. 85%(전체) 경고가 표시되면 스토리지 공간이 완전히 부족했으며 표준 명령을 사용하여 공간을 확보할 수 없음을 나타냅니다. 이때 Red Hat 고객 지원에 문의하십시오.

다음 표에서는 동적 스토리지 장치가 있는 Red Hat OpenShift Data Foundation의 노드 구성 예를 보여줍니다.

표 7.7. 3개의 노드를 사용한 초기 구성 예

| 저장 장치 크기 | 노드당 스토리지 장치 | 총 용량 | 사용 가능한 스토리지 용량 |

|---|---|---|---|

| 0.5 TiB | 1 | 1.5 TiB | 0.5 TiB |

| 2 TiB | 1 | 6 TiB | 2 TiB |

| 4 TiB | 1 | 12TiB | 4 TiB |

표 7.8. 30개의 노드가 있는 확장 구성 예(N)

| 저장 장치 크기 (D) | 노드당 스토리지 장치 (M) | 총 용량 (D * M * N) | 사용 가능한 스토리지 용량 (D*M*N/3) |

|---|---|---|---|

| 0.5 TiB | 3 | 45TiB | 15TiB |

| 2 TiB | 6 | 360TiB | 120TiB |

| 4 TiB | 9 | collectd TiB | 360TiB |

7.6. 다중 네트워크 플러그인(Multus) 지원 [기술 프리뷰]

기본적으로 Red Hat OpenShift Data Foundation은 Red Hat OpenShift Software Defined Network(SDN)를 사용하도록 구성되어 있습니다. 이 기본 구성에서는 SDN은 다음 유형의 트래픽을 전달합니다.

- Pod 간 트래픽

- OpenShift Data Foundation 트래픽에 대한 포드(OpenShift Data Foundation 공용 네트워크 트래픽)

- OpenShift Data Foundation 클러스터 네트워크 트래픽으로 알려진 OpenShift Data Foundation 복제 및 리밸런싱

그러나 OpenShift Data Foundation 4.8 이상에서는 다양한 유형의 네트워크 트래픽을 격리하여 Multus를 사용하여 보안 및 성능을 향상시키는 기능을 기술 프리뷰로 지원합니다.

Multus 지원은 베어 메탈 및 VMWare 배포에서만 테스트된 기술 프리뷰 기능입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

자세한 내용은 기술 프리뷰 기능 지원 범위를 참조하십시오.

7.6.1. 다중 네트워크 이해하기

Kubernetes에서 컨테이너 네트워킹은 컨테이너 네트워크 인터페이스(CNI)를 구현하는 네트워킹 플러그인에 위임됩니다.

OpenShift Container Platform은 Multus CNI 플러그인을 사용하여 CNI 플러그인 체인을 허용합니다. 클러스터 설치 중에 기본 pod 네트워크를 구성합니다. 기본 네트워크는 클러스터의 모든 일반 네트워크 트래픽을 처리합니다. 사용 가능한 CNI 플러그인을 기반으로 추가 네트워크를 정의하고 이러한 네트워크 중 하나 이상을 pod에 연결할 수 있습니다. 필요에 따라 클러스터에 2개 이상의 추가 네트워크를 정의 할 수 있습니다. 따라서 스위칭 또는 라우팅과 같은 네트워크 기능을 제공하는 pod를 구성할 때 유연성이 제공됩니다.

7.6.1.1. 추가 네트워크 사용 시나리오

데이터 플레인 및 컨트롤 플레인 분리를 포함하여 네트워크 격리가 필요한 상황에서 추가 네트워크를 사용할 수 있습니다. 네트워크 트래픽 격리는 다음과 같은 성능 및 보안상의 이유로 유용합니다.

- 성능

- 각 플레인의 트래픽 수량을 관리하기 위해 두 개의 다른 플레인으로 트래픽을 보낼 수 있습니다.

- 보안

- 보안 고려 사항을 위해 특별히 관리되는 네트워크 플레인으로 중요한 트래픽을 보낼 수 있으며 테넌트 또는 고객 간에 공유되지 않아야 하는 개인 데이터를 분리할 수 있습니다.

클러스터의 모든 pod는 여전히 클러스터 전체의 기본 네트워크를 사용하여 클러스터 전체의 연결을 유지합니다. 모든 pod에는 클러스터 전체 pod 네트워크에 연결된 eth0 인터페이스가 있습니다. oc exec -it <pod_name> -- ip a 명령을 사용하여 pod의 인터페이스를 확인할 수 있습니다. Multus CNI를 사용하는 네트워크 인터페이스를 추가하는 경우 이름은 net1,net2, …, netN.

Pod에 추가 네트워크 인터페이스를 연결하려면 인터페이스 연결 방법을 정의하는 구성을 생성해야 합니다. NetworkAttachmentDefinition CR(사용자 정의 리소스)을 사용하여 각 인터페이스를 지정합니다. 각 CR 내부의 CNI 구성은 해당 인터페이스의 생성 방법을 정의합니다.

7.6.2. Multus를 사용하여 스토리지 트래픽 분리

Multus를 사용하려면 OpenShift Data Foundation 클러스터를 배포하기 전에 나중에 클러스터에 연결될 NAT(네트워크 연결 정의)를 생성해야 합니다. 자세한 내용은 다음을 참조하십시오.

- 베어 메탈에 대한 네트워크 연결 정의 생성

- VMware의 네트워크 연결 정의 생성

Multus를 사용하면 하드웨어 설정 또는 VMWare 인스턴스 네트워크 설정에 따라 다음 구성이 가능합니다.

듀얼 네트워크 인터페이스 권장 구성이 있는 노드

분리된 스토리지 트래픽

- OpenShift SDN에 대한 하나의 인터페이스 구성(포드에서 포드 트래픽으로)

- 모든 OpenShift Data Foundation 트래픽에 대해 하나의 인터페이스 설정

3배의 네트워크 인터페이스 권장 구성이 있는 노드

전체 트래픽 분리

- OpenShift SDN에 대한 하나의 인터페이스 구성(포드에서 포드 트래픽으로)

- OpenShift Data Foundation 트래픽에 대한 모든 포드에 대한 하나의 인터페이스를 구성합니다(OpenShift Data Foundation 공용 트래픽)

- 모든 OpenShift Data Foundation 복제 및 재조정 트래픽(OpenShift Data Foundation 클러스터 트래픽)에 대해 하나의 인터페이스를 구성합니다.

7.6.3. Multus 구성에 권장되는 네트워크 구성 및 요구 사항

Multus 구성을 활용하기로 결정한 경우 다음 사전 요구 사항을 충족해야 합니다.

- OpenShift Data Foundation 배포에 사용되는 모든 노드에는 완전히 작동하는 Multus 구성을 보장하기 위해 네트워크 인터페이스 구성이 동일해야 합니다. 모든 노드의 네트워크 인터페이스 이름은 Multus 공용 네트워크와 Multus 클러스터 네트워크의 동일한 기본 전환 메커니즘에 연결되어 있어야 합니다.

- 영구 스토리지에 OpenShift Data Foundation을 활용하는 애플리케이션을 배포하는 데 사용되는 모든 Worker 노드는 완전한 기능을 갖춘 Multus 구성을 보장하는 네트워크 인터페이스 구성이 같아야 합니다. 두 인터페이스 중 하나는 스토리지 노드에서 Multus 공용 네트워크를 구성하는 데 사용된 인터페이스 이름과 동일해야 합니다. 모든 작업자 네트워크 인터페이스는 스토리지 노드의 Multus 공용 네트워크에 사용된 것과 동일한 기본 전환 메커니즘에 연결되어야 합니다.

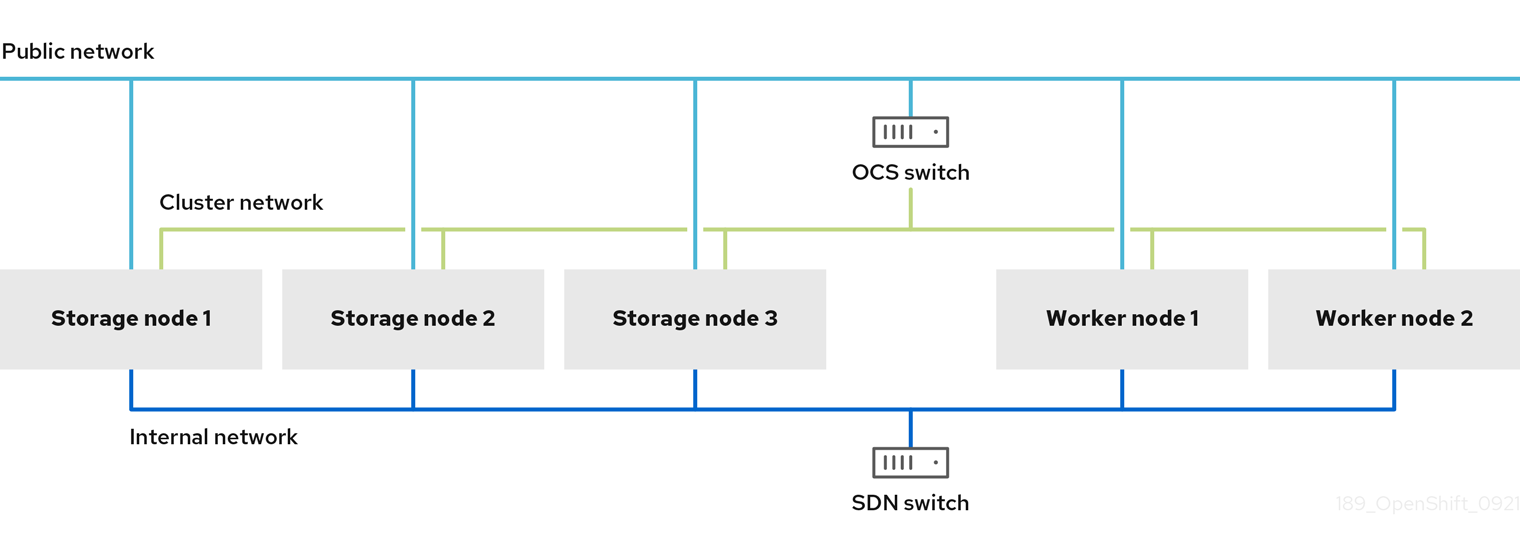

듀얼 네트워크 인터페이스 분리 구성 스키마 예:

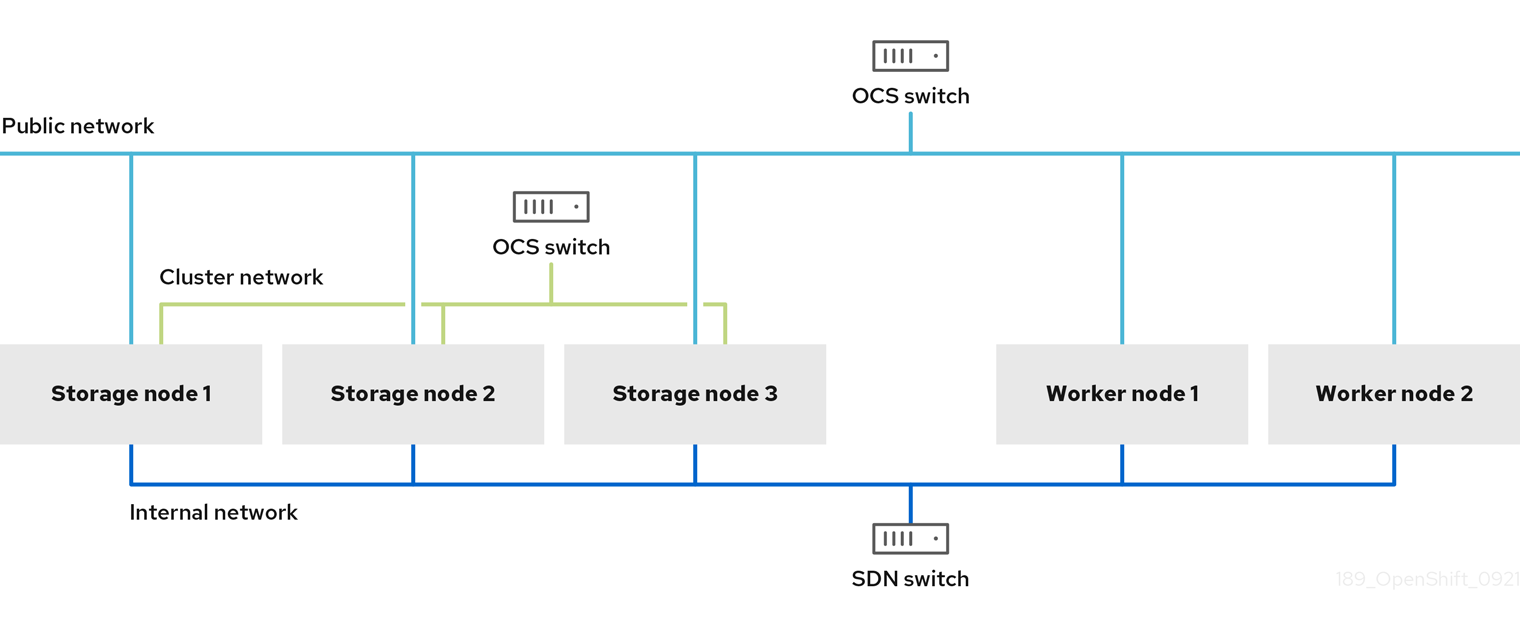

Triple 네트워크 인터페이스 전체 분리된 구성 스키마 예:

OpenShift Data Foundation OSD가 실행 중인 스토리지 노드만 Multus를 통해 구성된 OpenShift Data Foundation 클러스터 네트워크에 액세스해야 합니다.

베어 메탈에서 Multus 기반 구성을 구성하는 데 필요한 단계는 Multus 네트워크 생성을 참조하십시오.

VMware에 Multus 기반 구성을 구성하는 데 필요한 단계는 Multus 네트워크 생성을 참조하십시오.

8장. 재해 복구

재해 복구 (DR)는 조직에서 중단이나 재해가 있을 때 비즈니스에 중요한 기능 또는 정상적인 작업을 복구 및 재개하는 데 도움이 됩니다. OpenShift Data Foundation은 세 가지 광범위한 카테고리로 분류되는 상태 저장 애플리케이션을 위한 HA(고가용성) 및 DR 솔루션을 제공합니다.

- regional-DR: 잠재적인 데이터 손실을 최소화하여 지역 간 보호 [Developer Preview]

- Metro-DR: 데이터 손실없이 단일 지역 및 데이터 센터 간 보호 [개발자 프리뷰]

- 확장 클러스터 - Arbiter: 단일 OpenShift Data Foundation 클러스터는 스토리지 인프라에 재해 복구 기능을 제공하기 위해 두 개의 다른 위치 간에 확장됩니다. [기술 프리뷰]

8.1. regional-DR [Developer Preview]

regional-DR은 Red Hat Advanced Cluster Management for Kubernetes (RHACM) 및 OpenShift Data Foundation 구성 요소로 구성되어 OpenShift Container Platform 클러스터에서 애플리케이션 및 데이터 이동성을 제공합니다. 비동기 데이터 복제를 기반으로 빌드되므로 잠재적인 데이터 손실이 발생할 수 있지만 광범위한 오류 집합에 대한 보호 기능을 제공합니다.

Red Hat OpenShift Data Foundation은 Ceph에서 지원하는 스토리지 공급자로서, Rook에서 관리하는 라이프사이클은 다음과 같은 기능을 통해 향상되었습니다.

- 미러링을 위해 풀을 활성화합니다.

- RBD 풀의 이미지를 자동으로 미러링합니다.

- 영구 볼륨 클레임 미러링별로 관리할 csi-addons를 제공합니다.

이 Region-DR 릴리스는 다른 지역 및 데이터 센터에 배포되는 다중 클러스터 구성을 지원합니다. 예를 들어 두 개의 서로 다른 지역 또는 데이터 센터에 있는 두 개의 관리 클러스터의 양방향 복제입니다. 이 솔루션에는 RHACM(Red Hat Advanced Cluster Management) 및 OpenShift Data Foundation Advanced SKU 및 관련 번들을 사용할 수 있습니다.

사전 요구 사항

Red Hat OpenShift Data Foundation에서 지원하는 재해 복구 기능에는 재해 복구 솔루션을 성공적으로 구현하기 위해 다음 사전 요구 사항이 모두 필요합니다.

- 유효한 Red Hat OpenShift Data Foundation Advanced 인타이틀먼트

- 유효한 Red Hat Advanced Cluster Management for Kubernetes 서브스크립션

OpenShift Data Foundation의 서브스크립션이 작동하는 방법을 알아보려면 OpenShift Data Foundation 서브스크립션에 대한 기술 자료 문서 를 참조하십시오.

자세한 요구 사항은 Regional-DR 요구 사항 및 RHACM 요구 사항을 참조하십시오.

개발자 프리뷰 기능이며 개발자 프리뷰 지원 제한 사항이 적용됩니다. 개발자 프리뷰 릴리스는 프로덕션 환경에서 실행할 수 없으며 Red Hat 고객 포털 케이스 관리 시스템을 통해 지원되지 않습니다. 개발자 프리뷰 기능에 대한 지원이 필요한 경우 ocs-devpreview@redhat.com 메일링 리스트와 Red Hat 개발 팀의 구성원에 문의하여 가용성 및 업무 일정을 기반으로 최대한 빨리 지원할 수 있습니다.

8.2. Metro-DR [Developer Preview]

Metro-DR은 Red Hat Advanced Cluster Management for Kubernetes (RHACM), Red Hat Ceph Storage 및 OpenShift Data Foundation 구성 요소로 구성되며 OpenShift Container Platform 클러스터 전체에서 애플리케이션 및 데이터 이동성을 제공합니다.

이 Metro-DR 솔루션 릴리스는 지리적으로 분산되는 사이트에서 볼륨 영구 데이터 및 메타데이터 복제를 제공합니다. 퍼블릭 클라우드에서 이는 가용 영역 장애로부터 보호하는 것과 유사합니다. Metro-DR은 데이터 손실 없이 데이터 센터를 사용할 수 없는 동안 비즈니스 연속성을 보장합니다. 이 솔루션에는 RHACM(Red Hat Advanced Cluster Management) 및 OpenShift Data Foundation Advanced SKU 및 관련 번들을 사용할 수 있습니다.

사전 요구 사항

Red Hat OpenShift Data Foundation에서 지원하는 재해 복구 기능에는 재해 복구 솔루션을 성공적으로 구현하기 위해 다음 사전 요구 사항이 모두 필요합니다.

- 유효한 Red Hat OpenShift Data Foundation Advanced 인타이틀먼트

- 유효한 Red Hat Advanced Cluster Management for Kubernetes 서브스크립션

OpenShift Data Foundation의 서브스크립션이 작동하는 방법을 알아보려면 OpenShift Data Foundation 서브스크립션에 대한 기술 자료 문서 를 참조하십시오.

자세한 요구 사항은 Metro-DR 요구 사항인 Metro-DR 요구 사항, 중재자 및 RHACM 요구 사항을 사용하는 Red Hat Ceph Storage 스트레치 클러스터에 대한 배포 요구 사항을 참조하십시오.

개발자 프리뷰 기능이며 개발자 프리뷰 지원 제한 사항이 적용됩니다. 개발자 프리뷰 릴리스는 프로덕션 환경에서 실행할 수 없으며 Red Hat 고객 포털 케이스 관리 시스템을 통해 지원되지 않습니다. 개발자 프리뷰 기능에 대한 지원이 필요한 경우 ocs-devpreview@redhat.com 메일링 리스트와 Red Hat 개발 팀의 구성원에 문의하여 가용성 및 업무 일정을 기반으로 최대한 빨리 지원할 수 있습니다.

8.3. 확장된 클러스터 - Arbiter [기술 프리뷰]

이 경우 단일 클러스터는 Arbiter의 위치로 세 번째 영역으로 두 영역으로 확장됩니다. 이는 현재 OpenShift Container Platform 온-프레미스 및 동일한 데이터 센터에 배포하기 위한 기술 프리뷰 기능입니다. 이 솔루션은 여러 데이터 센터에 걸쳐 확장되는 배포에는 권장되지 않습니다. 대신 Metro-DR을 대기 시간이 짧은 여러 데이터 센터에 배포된 데이터 손실 DR 솔루션을 위한 첫 번째 옵션으로 간주합니다.

이 솔루션은 기본 온프레미스 데이터 센터에 상주하는 두 영역의 위치 간 대기 시간(RTT)이 10밀리초의 왕복 시간을 초과하지 않는 경우 배포하도록 설계되었습니다. 대기 시간이 길어질 경우 Red Hat 고객 지원팀에 문의하십시오.

Arbiter 확장 클러스터를 사용하려면

다음 세 영역에 최소 5개의 노드가 있어야 합니다.

- 영역당 두 개의 노드가 각 데이터 센터 영역에 사용되며 한 개의 노드가 있는 추가 영역은 중재자 영역에 사용됩니다(rbiter는 마스터 노드에 있을 수 있음).

클러스터 생성 전에 모든 노드에 영역 레이블을 사용하여 수동으로 레이블이 지정되어야 합니다.

예를 들어 영역에 다음과 같이 레이블이 지정될 수 있습니다.

-

topology.kubernetes.io/zone=arbiter(마스터 또는 작업자 노드) -

topology.kubernetes.io/zone=datacenter1(최소 두 개의 작업자 노드) -

topology.kubernetes.io/zone=datacenter2(최소 두 개의 작업자 노드)

-

자세한 내용은 Configure OpenShift Data Foundation for stretch Cluster를 참조하십시오.

자세한 내용은 다음을 참조하십시오.

확장 클러스터는 기술 프리뷰 기능이며 기술 프리뷰 지원 제한 사항이 적용됩니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

자세한 내용은 기술 프리뷰 기능 지원 범위를 참조하십시오.

9장. 연결이 끊긴 환경

연결이 끊긴 환경은 OLM(Operator Lifecycle Manager)이 인터넷 연결이 필요한 기본 Operator Hub 및 이미지 레지스트리에 액세스할 수 없는 네트워크 제한 환경입니다.

Red Hat은 OpenShift Container Platform이 제한된 네트워크에 설치된 연결이 끊긴 환경에서 OpenShift Data Foundation 배포를 지원합니다.

연결이 끊긴 환경에 OpenShift Data Foundation을 설치하려면 OpenShift Container Platform 설명서의 Operator 가이드의 제한된 네트워크에서 Operator Lifecycle Manager 사용 장을 참조하십시오.

제한된 네트워크 환경에 OpenShift Data Foundation을 설치할 때 기본적으로 인터넷 연결이 OpenShift Container Platform에서 가정되고 chronyd는 *.rhel.pool.ntp.org 서버를 사용하도록 구성되어 있으므로 노드에 사용자 지정 NTP(Network Time Protocol) 구성을 적용합니다. 자세한 내용은 Red Hat Knowledgebase 문서 및 chrony 타임 서비스 구성을 참조하십시오.

OpenShift Data Foundation을 위한 패키지

redhat-operator 인덱스 이미지를 정리할 때 OpenShift Data Foundation 배포를 위한 다음 패키지 목록을 포함합니다.

-

ocs-operator -

odf-operator -

mcg-operator -

odf-csi-addons-operator -

ODF-lvm-operator[현재 기술 프리뷰 기능이며 연결이 끊긴 설치의 경우 지원되지 않음] -

(선택 사항)

local-storage-operator(로컬 스토리지 배포 전용) -

(선택 사항)

odf-multicluster-orarchtrator(지역 재해 복구 구성 전용)

CatalogSource의 이름은 redhat-operators 로 지정해야 합니다.

10장. IBM Power 및 IBM Z 인프라에 지원되는 지원되지 않는 기능

표 10.1. IBM Power 및 IBM Z 인프라에서 지원되는 지원되지 않는 기능 목록

| 기능 | IBM Power | IBM Z 인프라 |

|---|---|---|

| 압축된 배포 | 지원되지 않음 | 지원되지 않음 |

| 동적 스토리지 장치 | 지원되지 않음 | 지원됨 |

| 확장 클러스터 - 중재자 | 지원되지 않음 | 지원되지 않음 |

| FIPS | 지원되지 않음 | 지원되지 않음 |

| 풀 압축 메트릭을 볼 수 있는 기능 | 지원됨 | 지원되지 않음 |

| Multicloud Object Gateway 끝점 Pod의 자동 확장 | 지원됨 | 지원되지 않음 |

| 오버프로비저닝 제어에 대한 경고 | 지원됨 | 지원되지 않음 |

| Ceph 모니터가 공간이 부족할 때 경고 | 지원됨 | 지원되지 않음 |

| 독립형 Multicloud Object Gateway 구성 요소 배포 | 지원됨 | 지원되지 않음 |

| IBM Flashsystem과 같은 플러그형 외부 스토리지를 허용하는 확장된 OpenShift Data Foundation 컨트롤 플레인 | 지원되지 않음 | 지원되지 않음 |

| IPV6 지원 | 지원되지 않음 | 지원되지 않음 |

| Multus | 지원되지 않음 | 지원되지 않음 |

| Multicloud Object Gateway 버킷 복제 | 지원됨 | 지원되지 않음 |

| 개체 데이터에 대한 할당량 지원 | 지원됨 | 지원되지 않음 |

| 최소 배포 | 지원되지 않음 | 지원되지 않음 |

| regional-DR with Red Hat Advanced Cluster Management (RHACM) | 지원되지 않음 | 지원되지 않음 |

| Red Hat Advanced Cluster Management(RHACM)를 포함한 여러 클러스터 | 지원되지 않음 | 지원되지 않음 |

| radio Access Network (RAN)를 위한 단일 노드 솔루션 | 지원되지 않음 | 지원되지 않음 |

11장. 다음 단계

OpenShift Data Foundation 배포를 시작하려면 OpenShift Container Platform 내에서 내부 모드를 사용하거나 외부 모드를 사용하여 OpenShift Container Platform 외부에서 실행되는 클러스터에서 서비스를 사용할 수 있습니다.

요구 사항에 따라 해당 배포 가이드로 이동합니다.

내부 모드

- Amazon 웹 서비스를 사용하여 OpenShift Data Foundation 배포

- 베어 메탈을 사용하여 OpenShift Data Foundation 배포

- VMWare vSphere를 사용하여 OpenShift Data Foundation 배포

- Deploying OpenShift Data Foundation using Microsoft Azure

- Google 클라우드를 사용하여 OpenShift Data Foundation 배포 [기술 프리뷰]

- Red Hat OpenStack Platform을 사용하여 OpenShift Data Foundation 배포 [기술 프리뷰]

- Red Hat Virtualization Platform을 사용하여 OpenShift Data Foundation 배포

- IBM Power에 OpenShift Data Foundation 배포

- IBM Z 인프라에 OpenShift Data Foundation 배포