파일 시스템 관리

Red Hat Enterprise Linux 9에서 파일 시스템 생성, 수정 및 관리

초록

보다 포괄적 수용을 위한 오픈 소스 용어 교체

Red Hat은 코드, 문서, 웹 속성에서 문제가 있는 용어를 교체하기 위해 최선을 다하고 있습니다. 먼저 마스터(master), 슬레이브(slave), 블랙리스트(blacklist), 화이트리스트(whitelist) 등 네 가지 용어를 교체하고 있습니다. 이러한 변경 작업은 작업 범위가 크므로 향후 여러 릴리스에 걸쳐 점차 구현할 예정입니다. 자세한 내용은 CTO Chris Wright의 메시지를 참조하십시오.

Red Hat 문서에 관한 피드백 제공

문서에 대한 피드백에 감사드립니다. 어떻게 개선할 수 있는지 알려주십시오.

특정 문구에 대한 의견 제출

- Multi-page HTML 형식으로 설명서를 보고 페이지가 완전히 로드된 후 오른쪽 상단 모서리에 피드백 버튼이 표시되는지 확인합니다.

- 커서를 사용하여 주석 처리할 텍스트 부분을 강조 표시합니다.

- 강조 표시된 텍스트 옆에 표시되는 피드백 추가 버튼을 클릭합니다.

- 의견을 추가하고 제출 을 클릭합니다.

Bugzilla를 통해 피드백 제출(등록 필요)

- Bugzilla 웹 사이트에 로그인합니다.

- 버전 메뉴에서 올바른 버전을 선택합니다.

- Summary (요약) 필드에 설명 제목을 입력합니다.

- Description (설명) 필드에 개선을 위한 제안을 입력합니다. 문서의 관련 부분에 대한 링크를 포함합니다.

- 버그 제출을 클릭합니다.

1장. 사용 가능한 파일 시스템 개요

애플리케이션에 적합한 파일 시스템을 선택하는 것은 사용 가능한 많은 옵션과 관련된 장단점으로 인해 중요한 결정입니다. 이 장에서는 Red Hat Enterprise Linux 9와 함께 제공되는 일부 파일 시스템에 대해 설명하고 애플리케이션에 맞는 올바른 파일 시스템에 대한 기록 배경과 권장 사항을 제공합니다.

1.1. 파일 시스템 유형

Red Hat Enterprise Linux 9는 다양한 파일 시스템(FS)을 지원합니다. 다양한 유형의 파일 시스템을 통해 다양한 종류의 문제를 해결하고 용도는 애플리케이션에 따라 다릅니다. 가장 일반적인 수준에서 사용 가능한 파일 시스템을 다음과 같은 주요 유형으로 그룹화할 수 있습니다.

표 1.1. 파일 시스템 유형 및 사용 사례

| 유형 | 파일 시스템 | 속성 및 사용 사례 |

|---|---|---|

| 디스크 또는 로컬 FS | XFS | XFS는 RHEL의 기본 파일 시스템입니다. Extent로 파일을 배치하기 때문에 ext4보다 조각화에 덜 취약합니다. 별도로 수행해야 할 이유가 없는 한 로컬 파일 시스템으로 XFS를 로컬 파일 시스템으로 배포할 것을 권장합니다(예: 성능 관련 호환성 또는 코너 케이스). |

| ext4 | ext4는 Linux에서 장기간의 이점을 제공합니다. 따라서 거의 모든 Linux 애플리케이션에서 지원됩니다. 대부분의 경우 성능이 XFS입니다. ext4는 일반적으로 홈 디렉터리에 사용됩니다. | |

| 네트워크 또는 클라이언트-서버 FS | NFS | NFS를 사용하여 동일한 네트워크의 여러 시스템 간에 파일을 공유합니다. |

| SMB | Microsoft Windows 시스템과 파일 공유를 위해 SMB를 사용합니다. | |

| 공유 스토리지 또는 공유 디스크 FS | GFS2 | GFS2에서는 컴퓨팅 클러스터의 멤버에 공유 쓰기 액세스 권한을 제공합니다. 안정성과 신뢰성에 중점을 두고 있으며 가능한 한 로컬 파일 시스템의 기능적 경험을 갖추고 있습니다. SAS Grid, Tibcolibvirt, IBM Websphere 6443 및 Red Hat Active950이 성공적으로 배포되어 있습니다. |

| 볼륨 관리 FS | Stratis(기술 프리뷰) | Stratis는 XFS 및 LVM의 조합을 기반으로 구축된 볼륨 관리자입니다. Stratis의 목적은 RuntimeClass 및 RuntimeClass와 같은 볼륨 관리 파일 시스템에서 제공하는 기능을 에뮬레이션하는 것입니다. 이 스택을 수동으로 빌드할 수 있지만 Stratis는 구성 복잡성을 줄이고, 모범 사례를 구현하고, 오류 정보를 통합합니다. |

1.2. 로컬 파일 시스템

로컬 파일 시스템은 단일 로컬 서버에서 실행되며 스토리지에 직접 연결된 파일 시스템입니다.

예를 들어 로컬 파일 시스템은 내부 SATA 또는 SAS 디스크에 대해 유일한 선택이며 서버에 로컬 드라이브가 있는 하드웨어 RAID 컨트롤러가 있는 경우 사용됩니다. SAN에서 내보낸 장치가 공유되지 않은 경우 로컬 파일 시스템도 SAN 연결 스토리지에서 사용되는 가장 일반적인 파일 시스템입니다.

모든 로컬 파일 시스템은 POSIX와 호환되며 지원되는 모든 Red Hat Enterprise Linux 릴리스와 완벽하게 호환됩니다. POSIX 호환 파일 시스템은 read(), write() 및 search()와 같이 잘 정의된 시스템 호출 세트를 지원합니다.

애플리케이션 프로그래밍 프로그램의 관점에서 볼 때 로컬 파일 시스템간에 상대적으로 약간의 차이점이 있습니다. 사용자 관점과 가장 주목할 만한 차이점은 확장성 및 성능과 관련이 있습니다. 파일 시스템 선택을 고려할 때 파일 시스템의 크기, 보유 가능한 고유한 기능 및 워크로드에서 수행하는 방법을 고려하십시오.

- 사용 가능한 로컬 파일 시스템

- XFS

- ext4

1.3. XFS 파일 시스템

XFS는 단일 호스트에서 매우 큰 파일 및 파일 시스템을 지원하는 확장성이 뛰어난 고성능, 견고하며 성숙한 64비트 저널링 파일 시스템입니다. Red Hat Enterprise Linux 9의 기본 파일 시스템입니다. XFS는 원래 SGI에 의해 Subversions에서 개발되었으며 매우 큰 서버 및 스토리지 어레이에서 실행하는 오랜 기록을 보유하고 있습니다.

XFS의 기능은 다음과 같습니다.

- 신뢰성

- 메타데이터 저널링 - 시스템을 다시 시작하고 파일 시스템을 다시 시작할 때 다시 마운트할 수 있는 파일 시스템 작업 레코드를 유지하여 시스템 충돌 후 파일 시스템 무결성을 보장합니다.

- 광범위한 런타임 메타데이터 일관성 확인

- 확장 가능하고 빠른 복구 유틸리티

- 할당량 저널링. 이렇게 하면 충돌 후 긴 할당량 일관성 점검이 필요하지 않습니다.

- 확장 및 성능

- 지원되는 파일 시스템 크기는 최대 1024TiB

- 다수의 동시 작업을 지원하는 기능

- 여유 공간 관리의 확장성을 위한 B-tree 인덱싱

- 정교한 메타데이터 읽기 알고리즘

- 비디오 워크로드 스트리밍 최적화

- 할당 체계

- 범위 기반 할당

- 스트라이프 인식 할당 정책

- 지연된 할당

- 공간 사전 할당

- 동적으로 할당된 inode

- 기타 기능

- reflink 기반 파일 복사

- 긴밀하게 통합된 백업 및 복원 유틸리티

- 온라인 조각 모음

- 온라인 파일 시스템 확장

- 포괄적인 진단 기능

-

확장 속성(xattr

). 이를 통해 시스템은 파일당 여러 개의 추가 이름/값 쌍을 연결할 수 있습니다. - 프로젝트 또는 디렉터리 할당량입니다. 이렇게 하면 디렉터리 트리에 대한 할당량 제한을 사용할 수 있습니다.

- 2초 타임 스탬프

성능 특성

XFS는 엔터프라이즈 워크로드가 있는 대규모 시스템에서 고성능을 보유하고 있습니다. 대규모 시스템은 비교적 많은 CPU, 여러 HBA 및 외부 디스크 어레이 연결을 사용하는 시스템입니다. XFS는 멀티 스레드 병렬 I/O 워크로드가 있는 소규모 시스템에서도 제대로 작동합니다.

XFS는 단일 스레드에 대해 상대적으로 낮은 성능을 제공합니다. 예를 들어 단일 스레드에서 많은 수의 작은 파일을 생성하거나 삭제하는 워크로드와 같습니다.

1.4. ext4 파일 시스템

ext4 파일 시스템은 ext 파일 시스템 제품군의 네 번째 세대입니다. Red Hat Enterprise Linux 6의 기본 파일 시스템입니다.

ext4 드라이버는 ext2 및 ext3 파일 시스템을 읽고 쓸 수 있지만 ext4 파일 시스템 형식은 ext2 및 ext3 드라이버와 호환되지 않습니다.

ext4는 다음과 같은 몇 가지 새로운 기능과 향상된 기능을 추가합니다.

- 지원되는 파일 시스템 크기 최대 50TiB

- 확장 기반 메타데이터

- 지연된 할당

- journal checksumming

- 대규모 스토리지 지원

범위 기반 메타데이터 및 지연된 할당 기능은 파일 시스템에서 사용된 공간을 추적하는 더 작고 효율적인 방법을 제공합니다. 이러한 기능을 통해 파일 시스템 성능을 개선하고 메타데이터로 소비되는 공간을 줄일 수 있습니다. 지연 할당을 사용하면 데이터가 디스크로 플러시될 때까지 새로 기록된 사용자 데이터에 대한 영구 위치를 파일 시스템을 연기할 수 있습니다. 이를 통해 더 크고 연속된 할당을 허용할 수 있으므로 파일 시스템이 훨씬 더 나은 정보로 결정을 내릴 수 있으므로 성능이 향상됩니다.

ext4에서 fsck 유틸리티를 사용하는 파일 시스템 복구 시간은 ext2 및 ext3보다 훨씬 빠릅니다. 일부 파일 시스템 복구는 성능이 6배 증가했습니다.

1.5. XFS 및 ext4 비교

XFS는 RHEL의 기본 파일 시스템입니다. 이 섹션에서는 XFS 및 ext4의 사용과 기능을 비교합니다.

- 메타데이터 오류 동작

-

ext4에서는 파일 시스템에 메타데이터 오류가 발생할 때 동작을 구성할 수 있습니다. 기본 동작은 작업을 계속하는 것입니다. XFS에서 복구할 수 없는 메타데이터 오류가 발생하면 파일 시스템을 종료하고

EFSCORRUPTED오류를 반환합니다. - 할당량

ext4에서는 기존 파일 시스템에서 파일 시스템을 만들 때 할당량을 활성화할 수 있습니다. 그런 다음 마운트 옵션을 사용하여 할당량 적용을 구성할 수 있습니다.

XFS 할당량은 다시 마운트할 수 없는 옵션이 아닙니다. 초기 마운트에서 할당량을 활성화해야 합니다.

XFS 파일 시스템에서

quotacheck명령을 실행하면 영향을 미치지 않습니다. 할당량 계정을 처음 켜면 XFS는 할당량을 자동으로 확인합니다.- 파일 시스템 크기 조정

- XFS는 파일 시스템의 크기를 줄이는 유틸리티가 없습니다. XFS 파일 시스템의 크기만 늘릴 수 있습니다. 반면 ext4는 파일 시스템의 크기 확장 및 축소를 지원합니다.

- inode 번호

ext4 파일 시스템은 232 개의 inode를 지원하지 않습니다.

XFS는 동적으로 inode를 할당합니다. 파일 시스템에 여유 공간이 있는 한 XFS 파일 시스템은 inode에서 실행되지 않습니다.

특정 애플리케이션은 XFS 파일 시스템에서 232 보다 큰 inode 번호를 올바르게 처리할 수 없습니다. 이러한 애플리케이션은

EOVERFLOW반환 값을 사용하여 32비트 stat 호출을 실패할 수 있습니다. inode 번호는 다음 조건에서 232 를 초과합니다.- 파일 시스템은 256바이트 inode가 있는 1TiB보다 큽니다.

- 파일 시스템은 512바이트 inode가 있는 2TiB보다 큽니다.

애플리케이션이 큰 inode 번호로 실패하면

-o inode32옵션을 사용하여 XFS 파일 시스템을 마운트하여 232 미만의 inode 번호를 적용합니다.inode32를 사용하면 64비트 번호로 이미 할당된 inode에는 영향을 미치지 않습니다.중요특정 환경에 필요한 경우가 아니면

inode32옵션을 사용하지 마십시오.inode32옵션은 할당 동작을 변경합니다. 결과적으로 더 낮은 디스크 블록에서 inode를 할당하는 데 사용할 수 있는 공간이 없는 경우ENOSPC오류가 발생할 수 있습니다.

1.6. 로컬 파일 시스템 선택

애플리케이션 요구 사항을 충족하는 파일 시스템을 선택하려면 파일 시스템을 배포할 대상 시스템을 이해해야 합니다. 다음 질문을 사용하여 결정을 알릴 수 있습니다.

- 대규모 서버가 있습니까?

- 대규모 스토리지 요구 사항이 있거나 로컬의 느린 SATA 드라이브가 있습니까?

- 애플리케이션이 제공될 것으로 예상되는 I/O 워크로드의 유형은 무엇입니까?

- 처리량 및 대기 시간 요구 사항은 무엇입니까?

- 서버 및 스토리지 하드웨어의 안정성은 무엇입니까?

- 파일 및 데이터 세트의 일반적인 크기는 무엇입니까?

- 시스템에 오류가 발생하면 다운타임이 발생할 수 있습니까?

서버와 스토리지 장치가 모두 큰 경우 XFS를 선택하는 것이 좋습니다. 크기가 작은 스토리지 어레이의 경우에도 XFS는 평균 파일 크기가 클 때 매우 잘 작동합니다(예: 크기가 수백 메가바이트).

기존 워크로드가 ext4와 함께 잘 수행된 경우 ext4를 계속 사용하면 애플리케이션에 매우 친숙한 환경을 제공해야 합니다.

ext4 파일 시스템은 I/O 기능이 제한된 시스템에서 더 잘 작동하는 경향이 있습니다. 제한된 대역폭 (200MB/s 미만)과 최대 1000 IOPS 기능에서 더 잘 작동합니다. 높은 기능을 가진 모든 것에 대해 XFS는 더 빠른 경향이 있습니다.

XFS는 ext4와 비교하여 CPU당 두 배 작업을 사용하므로 CPU 바인딩 워크로드를 약간의 동시성이 있는 경우 ext4가 더 빠릅니다. 일반적으로 애플리케이션이 단일 읽기/쓰기 스레드와 작은 파일을 사용하는 경우 ext4가 더 나은 반면, 애플리케이션이 여러 읽기/쓰기 스레드와 더 큰 파일을 사용하는 경우 XFS는 축소됩니다.

XFS 파일 시스템을 축소할 수 없습니다. 파일 시스템을 축소할 수 있어야 하는 경우 오프라인 축소를 지원하는 ext4를 사용하는 것이 좋습니다.

일반적으로 Red Hat은 ext4의 특정 사용 사례가 없는 한 XFS를 사용하도록 권장합니다. 또한 적절한 유형의 파일 시스템을 선택하도록 대상 서버 및 스토리지 시스템에서 특정 애플리케이션의 성능을 측정해야 합니다.

표 1.2. 로컬 파일 시스템 권장 사항 요약

| 시나리오 | 권장되는 파일 시스템 |

|---|---|

| 특별한 사용 사례 없음 | XFS |

| 대규모 서버 | XFS |

| 대규모 스토리지 장치 | XFS |

| 대용량 파일 | XFS |

| 다중 스레드 I/O | XFS |

| 단일 스레드 I/O | ext4 |

| 제한된 I/O 기능 (1000 IOPS 미만) | ext4 |

| 제한된 대역폭 (200MB/s) | ext4 |

| CPU 바인딩된 워크로드 | ext4 |

| 오프라인 축소 지원 | ext4 |

1.7. 네트워크 파일 시스템

네트워크 파일 시스템(클라이언트/서버 파일 시스템이라고도 함)을 사용하면 클라이언트 시스템이 공유 서버에 저장된 파일에 액세스할 수 있습니다. 따라서 여러 시스템의 여러 사용자가 파일 및 스토리지 리소스를 공유할 수 있습니다.

이러한 파일 시스템은 파일 시스템 집합을 하나 이상의 클라이언트로 내보내는 하나 이상의 서버에서 빌드됩니다. 클라이언트 노드는 기본 블록 스토리지에 액세스할 수 없지만 더 나은 액세스 제어를 허용하는 프로토콜을 사용하여 스토리지와 상호 작용합니다.

- 사용 가능한 네트워크 파일 시스템

- RHEL 고객의 가장 일반적인 클라이언트/서버 파일 시스템은 NFS 파일 시스템입니다. RHEL은 네트워크를 통해 로컬 파일 시스템을 내보내는 NFS 서버 구성 요소와 이러한 파일 시스템을 가져올 NFS 클라이언트를 모두 제공합니다.

- RHEL에는 Windows 상호 운용성을 위한 널리 사용되는 Microsoft SMB 파일 서버를 지원하는 CIFS 클라이언트도 포함되어 있습니다. 사용자 공간 Samba 서버는 Windows 클라이언트에 RHEL 서버의 Microsoft SMB 서비스를 제공합니다.

1.8. 공유 스토리지 파일 시스템

클러스터 파일 시스템(클러스터 파일 시스템)이라고도 하는 공유 스토리지 파일 시스템은 클러스터의 각 서버에 로컬 SAN(Storage Area Network)을 통해 공유 블록 장치에 대한 직접 액세스 권한을 제공합니다.

- 네트워크 파일 시스템과 비교

- 클라이언트/서버 파일 시스템과 마찬가지로 공유 스토리지 파일 시스템은 클러스터의 모든 멤버인 서버 집합에서 작동합니다. 그러나 NFS와 달리 단일 서버는 다른 멤버에게 데이터 또는 메타데이터에 대한 액세스를 제공하지 않습니다. 클러스터의 각 멤버는 동일한 스토리지 장치( 공유스토리지 )에 직접 액세스할 수 있으며 모든 클러스터 멤버 노드는 동일한 파일 집합에 액세스합니다.

- 동시성

캐시 일관성은 데이터 일관성과 무결성을 보장하기 위해 클러스터형 파일 시스템의 핵심입니다. 클러스터에 있는 모든 파일의 단일 버전이 클러스터 내의 모든 노드에 표시되어야 합니다. 파일 시스템은 클러스터의 멤버가 동일한 스토리지 블록을 동시에 업데이트하고 데이터 손상을 유발하지 못하도록 해야 합니다. 이를 위해 공유 스토리지 파일 시스템은 클러스터 전체 잠금 메커니즘을 사용하여 스토리지에 대한 액세스를 동시성 제어 메커니즘으로 사용합니다. 예를 들어 새 파일을 만들거나 여러 서버에서 열려 있는 파일에 쓰기 전에 서버의 파일 시스템 구성 요소가 올바른 잠금을 가져와야 합니다.

클러스터 파일 시스템의 요구 사항은 Apache 웹 서버와 같은 고가용성 서비스를 제공하는 것입니다. 클러스터의 모든 멤버는 공유 디스크 파일 시스템에 저장된 데이터의 전체 일관성을 확인하고 모든 업데이트는 잠금 메커니즘에 의해 올바르게 중재됩니다.

- 성능 특성

공유 디스크 파일 시스템은 잠금 오버헤드의 계산 비용으로 인해 동일한 시스템에서 실행되는 로컬 파일 시스템뿐만 아니라 항상 작동하지 않습니다. 공유 디스크 파일 시스템은 각 노드가 다른 노드와 공유되지 않는 특정 파일 집합 또는 노드 집합에서 거의 독점적으로 읽기 전용 방식으로 공유되는 특정 파일 집합에 거의 독점적으로 쓰는 워크로드에서 잘 수행됩니다. 이로 인해 최소 노드 간 캐시가 무효화되고 성능을 극대화할 수 있습니다.

공유 디스크 파일 시스템을 설정하는 것은 복잡하며 공유 디스크 파일 시스템에서 제대로 작동하도록 애플리케이션을 튜닝하는 것은 어려울 수 있습니다.

- 사용 가능한 공유 스토리지 파일 시스템

- Red Hat Enterprise Linux는 GFS2 파일 시스템을 제공합니다. GFS2는 Red Hat Enterprise Linux 고가용성 애드온 및 복구 스토리지 애드온과 긴밀하게 통합됩니다.

Red Hat Enterprise Linux는 2개에서 16개 노드까지의 규모에 해당하는 클러스터에서 GFS2를 지원합니다.

1.9. 네트워크 및 공유 스토리지 파일 시스템 중에서 선택

네트워크 및 공유 스토리지 파일 시스템 중에서 선택할 때 다음 사항을 고려하십시오.

- NFS 기반 네트워크 파일 시스템은 NFS 서버를 제공하는 환경에서 매우 일반적이고 인기 있는 선택 사항입니다.

- 네트워크 파일 시스템은 Infiniband 또는 10 기가비트 이더넷과 같은 고성능 네트워킹 기술을 사용하여 배포할 수 있습니다. 즉, 스토리지에 원시 대역폭을 얻으려면 공유 스토리지 파일 시스템으로 전환해서는 안 됩니다. 액세스 속도가 매우 중요한 경우 NFS를 사용하여 XFS와 같은 로컬 파일 시스템을 내보냅니다.

- 공유 스토리지 파일 시스템은 설정 또는 유지 관리가 쉽지 않으므로 필요한 가용성을 로컬 또는 네트워크 파일 시스템으로 제공할 수 없는 경우에만 배포해야 합니다.

- 클러스터된 환경의 공유 스토리지 파일 시스템을 사용하면 고가용성 서비스 재배치와 관련된 일반적인 장애 해결 시나리오 중에 수행해야 하는 단계를 제거하여 다운타임을 줄일 수 있습니다.

공유 스토리지 파일 시스템에 대한 구체적인 사용 사례가 없는 한 네트워크 파일 시스템을 사용하는 것이 좋습니다. 공유 스토리지 파일 시스템은 주로 다운타임을 최소화하고 엄격한 서비스 수준 요구 사항을 갖춘 고가용성 서비스를 제공해야 하는 배포에 사용됩니다.

1.10. 볼륨 관리 파일 시스템

볼륨 관리 파일 시스템은 단순성 및 스택 내 최적화를 위해 전체 스토리지 스택을 통합합니다.

- 사용 가능한 볼륨 관리 파일 시스템

- Red Hat Enterprise Linux 9는 Stratis 볼륨 관리자를 기술 프리뷰로 제공합니다. Stratis는 XFS를 파일 시스템 계층에 사용하고 LVM, 장치 매퍼 및 기타 구성 요소와 통합합니다.

Stratis는 Red Hat Enterprise Linux 8.0에서 처음 릴리스되었습니다. Red Hat은 Red Hat이 더 이상 사용되지 않을 때 생성된 간격을 채우기 위해 사용됩니다. Stratis 1.0은 사용자에게 복잡성을 숨기는 동안 상당한 스토리지 관리 작업을 수행할 수 있는 직관적인 명령줄 기반 볼륨 관리자입니다.

- 볼륨 관리

- 풀 생성

- 씬 스토리지 풀

- 스냅샷

- 자동화된 읽기 캐시

Stratis는 강력한 기능을 제공하지만 currently lacks certain capabilities of other offerings that it might be compared to, such as RuntimeClass 또는 RuntimeClass. 대부분의 경우 자체 복구로 CRC를 지원하지 않습니다.

2장. RHEL 시스템 역할을 사용하여 로컬 스토리지 관리

Ansible을 사용하여 LVM 및 로컬 파일 시스템(FS)을 관리하려면 RHEL 9에서 사용할 수 있는 RHEL 시스템 역할 중 하나인 스토리지 역할을 사용할 수 있습니다.

스토리지 역할을 사용하면 RHEL 7.7부터 여러 시스템의 디스크 및 논리 볼륨 및 모든 버전의 RHEL에서 파일 시스템을 자동으로 관리할 수 있습니다.

RHEL 시스템 역할 및 해당 역할을 적용하는 방법에 대한 자세한 내용은 RHEL 시스템 역할 소개를 참조하십시오.

2.1. 스토리지 RHEL 시스템 역할 소개

스토리지 역할은 다음을 관리할 수 있습니다.

- 분할되지 않은 디스크의 파일 시스템

- 논리 볼륨 및 파일 시스템을 포함한 LVM 볼륨 그룹 완료

- MD RAID 볼륨 및 파일 시스템

스토리지 역할을 사용하면 다음 작업을 수행할 수 있습니다.

- 파일 시스템 생성

- 파일 시스템 제거

- 파일 시스템 마운트

- 파일 시스템 마운트 해제

- LVM 볼륨 그룹 만들기

- LVM 볼륨 그룹 제거

- 논리 볼륨 생성

- 논리 볼륨 제거

- RAID 볼륨 생성

- RAID 볼륨 제거

- RAID를 사용하여 LVM 볼륨 그룹 생성

- RAID를 사용하여 LVM 볼륨 그룹 제거

- 암호화된 LVM 볼륨 그룹 만들기

- RAID를 사용하여 LVM 논리 볼륨 생성

2.2. 스토리지 RHEL 시스템 역할에서 스토리지 장치를 식별하는 매개변수

스토리지 역할 구성은 다음 변수에 나열된 파일 시스템, 볼륨 및 풀에만 영향을 미칩니다.

storage_volumes관리할 모든 파티션되지 않은 디스크의 파일 시스템 목록입니다.

storage_volumes에는 잘못된 볼륨도 포함할수 있습니다.파티션은 현재 지원되지 않습니다.

storage_pools관리할 풀 목록입니다.

현재 지원되는 유일한 풀 유형은 LVM입니다. LVM을 사용하면 풀이 볼륨 그룹(VG)을 나타냅니다. 각 풀에는 역할에서 관리할 볼륨 목록이 있습니다. LVM을 사용하면 각 볼륨이 파일 시스템의 논리 볼륨(LV)에 해당합니다.

2.3. 예제 Ansible Playbook 블록 장치에 XFS 파일 시스템을 생성

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 기본 매개 변수를 사용하여 블록 장치에 XFS 파일 시스템을 생성하도록 storage 역할을 적용합니다.

스토리지 역할은 분할되지 않은 전체 디스크 또는 논리 볼륨(LV)에서만 파일 시스템을 생성할 수 있습니다. 파티션에 파일 시스템을 만들 수 없습니다.

예 2.1. /dev/sdb에서 XFS를 생성하는 플레이북

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: xfs

roles:

- rhel-system-roles.storage-

볼륨 이름(예의

barefs)은 현재 임의로 사용할 수 있습니다.스토리지역할은disks:속성 아래에 나열된 디스크 장치에서 볼륨을 식별합니다. -

XFS는 RHEL 9의 기본 파일 시스템이므로

fs_type: xfs행을 생략할 수 있습니다. LV에 파일 시스템을 생성하려면 enclosing 볼륨 그룹을 포함하여

disks:속성 아래에 LVM 설정을 제공합니다. 자세한 내용은 Example Ansible Playbook to manage logical volumes 에서 참조하십시오.LV 장치의 경로를 제공하지 마십시오.

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.4. 파일 시스템을 영구적으로 마운트하는 Ansible 플레이북의 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 storage 역할을 적용하여 XFS 파일 시스템을 즉시 지속적으로 마운트합니다.

예 2.2. /dev/sdb에 파일 시스템을 /mnt/data에 마운트하는 플레이북

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: xfs

mount_point: /mnt/data

roles:

- rhel-system-roles.storage-

이 Playbook은

/etc/fstab파일에 파일 시스템을 추가하고 파일 시스템을 즉시 마운트합니다. -

/dev/sdb장치 또는 마운트 지점 디렉터리의 파일 시스템이 존재하지 않는 경우 플레이북에서 해당 시스템을 생성합니다.

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.5. 논리 볼륨을 관리하는 Ansible 플레이북 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 스토리지 역할을 적용하여 볼륨 그룹에 LVM 논리 볼륨을 생성합니다.

예 2.3. myvg 볼륨 그룹에 mylv 논리 볼륨을 생성하는 플레이북

- hosts: all

vars:

storage_pools:

- name: myvg

disks:

- sda

- sdb

- sdc

volumes:

- name: mylv

size: 2G

fs_type: ext4

mount_point: /mnt/data

roles:

- rhel-system-roles.storagemyvg볼륨 그룹은 다음 디스크로 구성됩니다.-

/dev/sda -

/dev/sdb -

/dev/sdc

-

-

myvg볼륨 그룹이 이미 있는 경우 Playbook은 볼륨 그룹에 논리 볼륨을 추가합니다. -

myvg볼륨 그룹이 없으면 플레이북에서 해당 그룹을 생성합니다. -

이 플레이북은

mylv논리 볼륨에 Ext4 파일 시스템을 생성하고/mnt에 파일 시스템을 영구적으로 마운트합니다.

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.6. 온라인 블록 삭제 활성화를 위한 Ansible Playbook 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 Playbook은 온라인 블록 삭제가 활성화된 XFS 파일 시스템을 마운트하는 스토리지 역할을 적용합니다.

예 2.4. /mnt/data/에서 온라인 블록 삭제를 활성화하는 플레이북

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: xfs

mount_point: /mnt/data

mount_options: discard

roles:

- rhel-system-roles.storage추가 리소스

- Ansible 플레이북의 예제로 파일 시스템을 지속적으로 마운트합니다.

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.7. 예시 Ansible Playbook: Ext4 파일 시스템을 생성 및 마운트

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 storage 역할을 적용하여 Ext4 파일 시스템을 생성하고 마운트합니다.

예 2.5. /dev/sdb에 Ext4를 생성하고 /mnt/data에 마운트하는 플레이북

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: ext4

fs_label: label-name

mount_point: /mnt/data

roles:

- rhel-system-roles.storage-

Playbook은

/dev/sdb디스크에 파일 시스템을 생성합니다. -

플레이북은

/mnt/data디렉터리에 파일 시스템을 영구적으로 마운트합니다. -

파일 시스템의 레이블은

label-name입니다.

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.8. ext3 파일 시스템을 생성하고 마운트하는 예제 Ansible Playbook

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 storage 역할을 적용하여 Ext3 파일 시스템을 생성하고 마운트합니다.

예 2.6. /dev/sdb 에 Ext3를 생성하여 /mnt/data에 마운트하는 플레이북

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: ext3

fs_label: label-name

mount_point: /mnt/data

roles:

- rhel-system-roles.storage-

Playbook은

/dev/sdb디스크에 파일 시스템을 생성합니다. -

플레이북은

/mnt/data디렉터리에 파일 시스템을 영구적으로 마운트합니다. -

파일 시스템의 레이블은

label-name입니다.

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.9. 스토리지 RHEL 시스템 역할을 사용하여 기존 Ext4 또는 Ext3 파일 시스템의 크기를 조정하는 Ansible Playbook의 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 Playbook은 스토리지 역할을 적용하여 블록 장치의 기존 Ext4 또는 Ext3 파일 시스템의 크기를 조정합니다.

예 2.7. 디스크에 단일 볼륨을 설정하는 플레이북

---

- name: Create a disk device mounted on /opt/barefs

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- /dev/sdb

size: 12 GiB

fs_type: ext4

mount_point: /opt/barefs

roles:

- rhel-system-roles.storage-

이전 예제의 볼륨이 이미 있는 경우 볼륨 크기를 조정하려면 매개 변수

크기에다른 값을 사용하여 동일한 플레이북을 실행해야 합니다. 예를 들면 다음과 같습니다.

예 2.8. /dev/sdb에서 ext4 의 크기를 조정하는 플레이북

---

- name: Create a disk device mounted on /opt/barefs

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- /dev/sdb

size: 10 GiB

fs_type: ext4

mount_point: /opt/barefs

roles:

- rhel-system-roles.storage- 볼륨 이름(예의barefs)은 현재 임의로입니다. Storage 역할은 disks: 속성 아래에 나열된 디스크 장치에서 볼륨을 식별합니다.

다른 파일 시스템의 작업 크기 조정을 사용하면 작업 중인 장치의 데이터가 손상될 수 있습니다.

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.10. 스토리지 RHEL 시스템 역할을 사용하여 LVM에서 기존 파일 시스템의 크기를 조정하는 Ansible Playbook의 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 스토리지 RHEL 시스템 역할을 적용하여 파일 시스템으로 LVM 논리 볼륨의 크기를 조정합니다.

다른 파일 시스템의 작업 크기 조정을 사용하면 작업 중인 장치의 데이터가 손상될 수 있습니다.

예 2.9. myvg 볼륨 그룹의 기존 mylv1 및 myvl2 논리 볼륨의 크기를 조정하는 플레이북

---

- hosts: all

vars:

storage_pools:

- name: myvg

disks:

- /dev/sda

- /dev/sdb

- /dev/sdc

volumes:

- name: mylv1

size: 10 GiB

fs_type: ext4

mount_point: /opt/mount1

- name: mylv2

size: 50 GiB

fs_type: ext4

mount_point: /opt/mount2

- name: Create LVM pool over three disks

include_role:

name: rhel-system-roles.storage이 Playbook은 다음과 같은 기존 파일 시스템의 크기를 조정합니다.

-

/opt/mount1에 마운트된mylv1볼륨의 Ext4 파일 시스템은 10GiB로 크기를 조정합니다. -

/opt/mount2에 마운트된mylv2볼륨의 Ext4 파일 시스템은 50GiB로 크기를 조정합니다.

-

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.11. 스토리지 RHEL 시스템 역할을 사용하여 스왑 볼륨을 생성하는 Ansible Playbook의 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 스토리지 역할을 적용하여 스왑 볼륨이 없는 경우 또는 기본 매개변수를 사용하는 블록 장치에 스왑 볼륨을 수정하거나 스왑 볼륨이 이미 존재하는 경우 수정합니다.

예 2.10. /dev/sdb에서 기존 XFS를 생성하거나 수정하는 플레이북

---

- name: Create a disk device with swap

- hosts: all

vars:

storage_volumes:

- name: swap_fs

type: disk

disks:

- /dev/sdb

size: 15 GiB

fs_type: swap

roles:

- rhel-system-roles.storage-

볼륨 이름(예의

swap_fs)은 현재 임의적입니다.스토리지역할은disks:속성 아래에 나열된 디스크 장치에서 볼륨을 식별합니다.

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.12. 스토리지 시스템 역할을 사용하여 RAID 볼륨 구성

스토리지 시스템 역할을 사용하면 Red Hat Ansible Automation Platform 및 Ansible-Core를 사용하여 RHEL에서 RAID 볼륨을 구성할 수 있습니다. 매개변수를 사용하여 Ansible 플레이북을 생성하여 요구 사항에 맞게 RAID 볼륨을 구성합니다.

사전 요구 사항

- Ansible Core 패키지는 제어 시스템에 설치됩니다.

-

플레이북을 실행할 시스템에

rhel-system-roles패키지가 설치되어 있습니다. -

스토리지시스템 역할을 사용하여 RAID 볼륨을 배포하려는 시스템을 자세히 설명하는 인벤토리 파일이 있습니다.

절차

다음 콘텐츠를 사용하여 새 playbook.yml 파일을 생성합니다.

--- - name: Configure the storage hosts: managed-node-01.example.com tasks: - name: Create a RAID on sdd, sde, sdf, and sdg include_role: name: rhel-system-roles.storage vars: storage_safe_mode: false storage_volumes: - name: data type: raid disks: [sdd, sde, sdf, sdg] raid_level: raid0 raid_chunk_size: 32 KiB mount_point: /mnt/data state: present주의장치 이름은 예를 들어 시스템에 새 디스크를 추가하는 경우와 같이 특정 상황에서 변경될 수 있습니다. 따라서 데이터 손실을 방지하려면 플레이북에서 특정 디스크 이름을 사용하지 마십시오.

선택 사항: 플레이북 구문을 확인합니다.

# ansible-playbook --syntax-check playbook.yml플레이북을 실행합니다.

# ansible-playbook -i inventory.file /path/to/file/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일 - RHEL System Roles를 사용하도록 제어 노드 및 관리형 노드 준비

2.13. 스토리지 RHEL 시스템 역할을 사용하여 RAID로 LVM 풀 구성

스토리지 시스템 역할을 사용하면 Red Hat Ansible Automation Platform을 사용하여 RHEL에서 RAID로 LVM 풀을 구성할 수 있습니다. 이 섹션에서는 사용 가능한 매개 변수를 사용하여 Ansible 플레이북을 설정하여 RAID로 LVM 풀을 구성하는 방법을 배웁니다.

사전 요구 사항

- Ansible Core 패키지는 제어 시스템에 설치됩니다.

-

플레이북을 실행할 시스템에

rhel-system-roles패키지가 설치되어 있습니다. -

스토리지시스템 역할을 사용하여 RAID로 LVM 풀을 구성하려는 시스템을 자세히 설명하는 인벤토리 파일이 있습니다.

절차

다음 내용으로 새

playbook.yml파일을 생성합니다.- hosts: all vars: storage_safe_mode: false storage_pools: - name: my_pool type: lvm disks: [sdh, sdi] raid_level: raid1 volumes: - name: my_pool size: "1 GiB" mount_point: "/mnt/app/shared" fs_type: xfs state: present roles: - name: rhel-system-roles.storage참고RAID를 사용하여 LVM 풀을 생성하려면

raid_level매개변수를 사용하여 RAID 유형을 지정해야 합니다.선택 사항: 플레이북 구문을 확인합니다.

# ansible-playbook --syntax-check playbook.yml인벤토리 파일에서 플레이북을 실행합니다.

# ansible-playbook -i inventory.file /path/to/file/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.md파일.

2.14. 스토리지 RHEL 시스템 역할을 사용하여 LVM에서 VDO 볼륨을 압축하고 중복 제거하는 Ansible 플레이북의 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 스토리지 RHEL 시스템 역할을 적용하여 VDO(가상 데이터 최적화 도구)를 사용하여 LVM(Logical Volumes) 압축 및 중복 제거를 활성화합니다.

예 2.11. my vg 볼륨 그룹에서 mylv1 LVM VDO 볼륨을 생성하는 플레이북

---

- name: Create LVM VDO volume under volume group 'myvg'

hosts: all

roles:

-rhel-system-roles.storage

vars:

storage_pools:

- name: myvg

disks:

- /dev/sdb

volumes:

- name: mylv1

compression: true

deduplication: true

vdo_pool_size: 10 GiB

size: 30 GiB

mount_point: /mnt/app/shared

이 예제에서는 압축 및 중복 제거 풀이 true로 설정되어 VDO가 사용되도록 지정합니다. 다음은 이러한 매개변수의 사용을 설명합니다.

-

중복 제거는 스토리지 볼륨에 저장된 중복된 데이터를 중복 제거하는 데 사용됩니다. - 압축은 스토리지 볼륨에 저장된 데이터를 압축하는 데 사용되어 스토리지 용량이 증가합니다.

-

vdo_pool_size는 장치에서 사용하는 실제 크기를 지정합니다. VDO 볼륨의 가상 크기는

size매개 변수에 의해 설정됩니다. 알림: LVM VDO의 스토리지 역할 때문에 풀당 하나의 볼륨만 압축 및 중복 제거를 사용할 수 있습니다.

2.15. 스토리지 RHEL 시스템 역할을 사용하여 LUKS 암호화 볼륨 생성

storage 역할을 사용하여 Ansible 플레이북을 실행하여 LUKS로 암호화된 볼륨을 생성하고 구성할 수 있습니다.

사전 요구 사항

-

crypto_policies시스템 역할로 설정하려는 하나 이상의 관리형 노드에 대한 액세스 및 권한. Red Hat Ansible Core가 기타 시스템을 구성하는 시스템인 제어 노드에 대한 액세스 및 권한.

제어 노드에서 다음을 수행합니다.

-

ansible-core및rhel-system-roles패키지가 설치됩니다.

-

RHEL 8.0-8.5는 Ansible 기반 자동화를 위해 Ansible Engine 2.9가 포함된 별도의 Ansible 리포지토리에 대한 액세스를 제공했습니다. Ansible Engine에는 ansible , , ansible -playbookdocker 및 podman 과 같은 커넥터, 여러 플러그인 및 모듈과 같은 명령줄 유틸리티가 포함되어 있습니다. Ansible Engine을 확보하고 설치하는 방법에 대한 자세한 내용은 Red Hat Ansible Engine 지식베이스를 다운로드하고 설치하는 방법 문서를 참조하십시오.

RHEL 8.6 및 9.0에서는 Ansible 명령줄 유틸리티, 명령 및 소규모의 기본 제공 Ansible 플러그인 세트가 포함된 Ansible Core( ansible-core 패키지로 제공)를 도입했습니다. RHEL은 AppStream 리포지토리를 통해 이 패키지를 제공하며 제한된 지원 범위를 제공합니다. 자세한 내용은 RHEL 9 및 RHEL 8.6 이상 AppStream 리포지토리 지식 베이스에 포함된 Ansible Core 패키지에 대한 지원 범위를 참조하십시오.

- 관리 노드를 나열하는 인벤토리 파일.

절차

다음 내용으로 새

playbook.yml파일을 생성합니다.- hosts: all vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: xfs fs_label: label-name mount_point: /mnt/data encryption: true encryption_password: your-password roles: - rhel-system-roles.storage선택 사항: 플레이북 구문을 확인합니다.

# ansible-playbook --syntax-check playbook.yml인벤토리 파일에서 플레이북을 실행합니다.

# ansible-playbook -i inventory.file /path/to/file/playbook.yml

추가 리소스

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile

2.16. 스토리지 RHEL 시스템 역할을 사용하여 백분율로 풀 볼륨 크기를 표시하는 Ansible 플레이북의 예

이 섹션에서는 예제 Ansible 플레이북을 제공합니다. 이 플레이북은 스토리지 시스템 역할을 적용하여 풀의 총 크기의 백분율로 논리 관리자 볼륨(LVM) 볼륨 크기를 표시할 수 있습니다.

예 2.12. 볼륨 크기를 풀 총 크기의 백분율로 표시하는 플레이북

---

- name: Express volume sizes as a percentage of the pool's total size

hosts: all

roles

- rhel-system-roles.storage

vars:

storage_pools:

- name: myvg

disks:

- /dev/sdb

volumes:

- name: data

size: 60%

mount_point: /opt/mount/data

- name: web

size: 30%

mount_point: /opt/mount/web

- name: cache

size: 10%

mount_point: /opt/cache/mount이 예에서는 LVM 볼륨의 크기를 풀 크기의 백분율로 지정합니다. 예를 들면 다음과 같습니다. "60%". 또한 LVM 볼륨의 크기를 사람이 읽을 수 있는 파일 시스템 크기(예: "10g" 또는 "50GiB)"의 풀 크기의 백분율로 지정할 수도 있습니다.

2.17. 추가 리소스

-

/usr/share/doc/rhel-system-roles/storage/ -

/usr/share/ansible/roles/rhel-system-roles.storage/

3장. NFS 공유 마운트

시스템 관리자는 시스템에 원격 NFS 공유를 마운트하여 공유 데이터에 액세스할 수 있습니다.

3.1. NFS 소개

이 섹션에서는 NFS 서비스의 기본 개념에 대해 설명합니다.

NFS(네트워크 파일 시스템)를 사용하면 원격 호스트에서 네트워크를 통해 파일 시스템을 마운트하고 로컬에 마운트된 것처럼 해당 파일 시스템과 상호 작용할 수 있습니다. 이를 통해 네트워크의 중앙 집중식 서버에 리소스를 통합할 수 있습니다.

NFS 서버는 /etc/exports 구성 파일을 참조하여 클라이언트가 내보낸 모든 파일 시스템에 액세스할 수 있는지 여부를 확인합니다. 확인되면 모든 파일 및 디렉터리 작업을 사용자가 사용할 수 있습니다.

3.2. 지원되는 NFS 버전

이 섹션에는 Red Hat Enterprise Linux에서 지원되는 NFS 버전과 해당 기능이 나열되어 있습니다.

현재 Red Hat Enterprise Linux 9는 다음과 같은 주요 버전의 NFS를 지원합니다.

- NFS 버전 3(NFSv3)은 안전한 비동기 쓰기를 지원하며 이전 NFSv2보다 오류 처리 시 더 강력합니다. 또한 64비트 파일 크기 및 오프셋을 지원하여 클라이언트가 2GB 이상의 파일 데이터에 액세스할 수 있습니다.

-

NFS 버전 4(NFSv4)는 방화벽 및 인터넷에서 작동하므로 더 이상 EgressIP

bind서비스가 필요하지 않고 ACL(액세스 제어 목록)을 지원하고 상태 저장 작업을 활용합니다.

NFS 버전 2(NFSv2)는 Red Hat에서 더 이상 지원하지 않습니다.

기본 NFS 버전

Red Hat Enterprise Linux 9의 기본 NFS 버전은 4.2입니다. NFS 클라이언트는 기본적으로 NFSv4.2 사용을 시도하고 서버가 NFSv4.2를 지원하지 않는 경우 NFSv4.1로 돌아갑니다. 나중에 마운트가 NFSv4.0으로 대체된 다음 NFSv3로 돌아갑니다.

마이너 NFS 버전의 기능

다음은 Red Hat Enterprise Linux 9의 NFSv4.2의 기능입니다.

- 서버 측 복사

-

NFS 클라이언트가

copy_file_range()시스템 호출을 사용하여 네트워크 리소스를 낭비하지 않고 데이터를 효율적으로 복사할 수 있습니다. - 스파스 파일

-

파일에 0es만 구성된 할당되지 않았거나 초기화되지 않은 데이터 블록이 하나 이상 있을 수 있습니다. NFSv4.2의

lseek()작업은 search_hole()및seek_data()를 지원하므로 애플리케이션이 스파스 파일에 있는 홀의 위치를 매핑할 수 있습니다. - 공간 예약

-

스토리지 서버가 여유 공간을 예약할 수 있도록 허용하여 서버가 공간이 부족해지는 것을 방지합니다. NFSv4.2에서는

allocate()작업을 지원하여 공간을 예약하고, 공간을 할당 해제하는deallocate()작업, 파일에서 공간을 미리 할당하거나 할당 해제하는fallocate()작업을 지원합니다. - 레이블이 지정된 NFS

- 데이터 액세스 권한을 적용하고 NFS 파일 시스템의 개별 파일에 대해 클라이언트와 서버 간에 SELinux 레이블을 활성화합니다.

- 레이아웃 개선 사항

-

일부 Parallel NFS(pNFS) 서버가 더 나은 성능 통계를 수집할 수 있도록 하는

layoutstats()작업을 제공합니다.

다음은 NFSv4.1의 기능입니다.

- 네트워크의 성능과 보안을 강화하며 pNFS에 대한 클라이언트 측 지원도 포함합니다.

- 더 이상 콜백에 대한 별도의 TCP 연결이 필요하지 않으므로, 예를 들어 NAT 또는 방화벽이 방해하는 경우도 NFS 서버에서 클라이언트에 연결할 수 없는 경우에도 NFS 서버에서 위임을 부여할 수 있습니다.

- 재부팅 작업을 제외하고 정확히 한 번만 의미 체계를 제공하므로, 일부 작업에서 응답이 손실되고 작업을 두 번 전송한 경우 특정 작업에서 부정확한 결과를 반환하는 경우가 있습니다.

3.3. NFS에 필요한 서비스

이 섹션에는 NFS 서버를 실행하거나 NFS 공유를 마운트하는 데 필요한 시스템 서비스가 나열되어 있습니다. Red Hat Enterprise Linux는 이러한 서비스를 자동으로 시작합니다.

Red Hat Enterprise Linux는 커널 수준 지원 및 서비스 프로세스를 결합하여 NFS 파일 공유를 제공합니다. 모든 NFS 버전은 클라이언트와 서버 간의 RPC(Remote Procedure calls)에 의존합니다. NFS 파일 시스템을 공유하거나 마운트하기 위해 다음 서비스가 구현되는 NFS 버전에 따라 함께 작동합니다.

nfsd- 공유 NFS 파일 시스템에 대해 요청하는 NFS 서버 커널 모듈.

rpcbind-

로컬 RPC 서비스의 포트 예약을 허용합니다. 그런 다음 이러한 포트를 사용할 수 있도록 (또는 알림) 해당 원격 RPC 서비스에 액세스할 수 있습니다. E

gressIPbind서비스는 RPC 서비스에 대한 요청에 응답하고 요청된 RPC 서비스에 대한 연결을 설정합니다. NFSv4에서는 사용되지 않습니다. rpc.mountd-

이 프로세스는 NFS 서버에서 NFSv3 클라이언트의

MOUNT요청을 처리하는 데 사용됩니다. 요청된 NFS 공유를 현재 NFS 서버에서 내보내고 클라이언트가 액세스할 수 있는지 확인합니다. 마운트 요청이 허용되는 경우nfs-mountd서비스는 Success 상태로 응답하고 이 NFS 공유에 대한 File-Handle을 다시 NFS 클라이언트로 제공합니다. rpc.nfsd-

이 프로세스를 통해 서버가 광고하는 명시적인 NFS 버전 및 프로토콜을 사용할 수 있습니다. NFS 클라이언트가 연결할 때마다 서버 스레드 제공 등 NFS 클라이언트의 동적 요구를 충족하기 위해 Linux 커널과 함께 작동합니다. 이 프로세스는

nfs-server서비스에 해당합니다. lockd- 이는 클라이언트와 서버에서 모두 실행되는 커널 스레드입니다. NFSv3 클라이언트가 서버의 파일을 잠글 수 있도록 하는 NLM(Network Lock Manager) 프로토콜을 구현합니다. NFS 서버를 실행하고 NFS 파일 시스템이 마운트될 때마다 자동으로 시작됩니다.

rpc.statd-

이 프로세스는 NFV(Network Status Monitor) RPC 프로토콜을 구현하여 NFS 서버가 정상적으로 종료되지 않고 다시 시작될 때 NFS 클라이언트에 알립니다.

RuntimeClass-statd서비스는nfs-server서비스에 의해 자동으로 시작되며 사용자 구성이 필요하지 않습니다. NFSv4에서는 사용되지 않습니다. rpc.rquotad-

이 프로세스는 원격 사용자에게 사용자 할당량 정보를 제공합니다.

quota-rpc패키지에서 제공하는 RuntimeClass-rquotadnfs-server가 시작될 때 사용자가 시작해야 합니다. rpc.idmapd이 프로세스는 NFSv4 클라이언트 및 서버 백업 호출을 제공합니다. 이 호출은

사용자@도메인의 형식의 문자열과 로컬 UID 및 GID 사이에 매핑됩니다.idmapd가 NFSv4에서 작동하려면/etc/idmapd.conf파일을 구성해야 합니다. 최소한 NFSv4 매핑 도메인을 정의하는Domain매개 변수를 지정해야 합니다. NFSv4 매핑 도메인이 DNS 도메인 이름과 동일한 경우 이 매개 변수를 건너뛸 수 있습니다. ID 매핑이 제대로 작동하려면 클라이언트 및 서버는 NFSv4 매핑 도메인에 동의해야 합니다.NFSv4 서버만

nfs-idmapd를 사용합니다. NFSv4 클라이언트는 ID 매핑을 수행하기 위해 커널 온 디맨드에서 호출하는 인증 키 기반idmapd서비스에 의해 시작되는 RuntimeClass.nfsidmap유틸리티를 사용합니다.nfsidmap에 문제가 있는 경우 클라이언트는 Jenkinsfile.idmapd를 다시 사용합니다.

NFSv4를 사용한 RPC 서비스

NFSv4 프로토콜의 마운트 및 잠금 프로토콜이 통합되었습니다. 서버는 또한 잘 알려진 TCP 포트 2049에서 수신 대기합니다. 따라서 NFSv4는 EgressIP bind,lockd, RuntimeClass -statd 서비스와 상호 작용할 필요가 없습니다. nfs-mountd 서비스는 내보내기를 설정하기 위해 NFS 서버에 계속 필요하지만 over-the-wire 작업에는 포함되지 않습니다.

추가 리소스

-

Diffie

bind를 사용하지 않고 NFSv4만 구성.

3.4. NFS 호스트 이름 형식

이 섹션에서는 NFS 공유를 마운트하거나 내보낼 때 호스트를 지정하는 데 사용할 수 있는 다양한 형식을 설명합니다.

다음 형식으로 호스트를 지정할 수 있습니다.

- 단일 머신

다음 중 하나를 수행합니다.

- 정규화된 도메인 이름(서버에서 확인할 수 있음)

- 호스트 이름(서버에서 확인할 수 있음)

- IP 주소.

- IP 네트워크

다음 형식 중 하나가 유효합니다.

-

a.b.c.d/zz는 넷마스크의 비트 수입니다(예:DNS). -

a.b.c.d/netmask넷마스크입니다(예:192.168.100.8/255.255.255.0).

-

- netgroups

-

@group-name형식 . 여기서group-name은 NIS netgroup 이름입니다.

3.5. NFS 설치

이 절차에서는 NFS 공유를 마운트하거나 내보내는 데 필요한 모든 패키지를 설치합니다.

절차

nfs-utils패키지를 설치합니다.# dnf install nfs-utils

3.6. NFS 내보내기 검색

이 절차에서는 지정된 NFSv3 또는 NFSv4 서버 내보내기에 사용할 파일 시스템을 검색합니다.

절차

NFSv3를 지원하는 모든 서버에서

showmount유틸리티를 사용합니다.$ showmount --exports my-server Export list for my-server /exports/foo /exports/bar

NFSv4를 지원하는 서버를 사용하여 루트 디렉토리를 마운트하고 다음을 확인합니다.

# mount my-server:/ /mnt/ # ls /mnt/ exports # ls /mnt/exports/ foo bar

NFSv4 및 NFSv3를 모두 지원하는 서버에서 두 방법 모두 작동하고 동일한 결과를 제공합니다.

추가 리소스

-

showmount(8)도움말 페이지

3.7. mount를 사용하여 NFS 공유 마운트

이 절차에서는 mount 유틸리티를 사용하여 서버에서 내보낸 NFS 공유를 마운트합니다.

절차

NFS 공유를 마운트하려면 다음 명령을 사용하십시오.

# mount -t nfs -o options host:/remote/export /local/directory

이 명령은 다음 변수를 사용합니다.

- 옵션

- 쉼표로 구분된 마운트 옵션 목록입니다.

- 호스트

- 마운트하려는 파일 시스템을 내보내는 서버의 호스트 이름, IP 주소 또는 정규화된 도메인 이름입니다.

- /remote/export

- 서버에서 내보낼 파일 시스템 또는 디렉터리, 즉 마운트하려는 디렉터리입니다.

- /local/directory

- /remote/export 가 마운트된 클라이언트 위치입니다.

추가 리소스

- 일반적인 NFS 마운트 옵션.

- NFS 호스트 이름 형식.

- 마운트를 사용하여 파일 시스템 마운트.

-

mount(8)도움말 페이지 -

export(5) 도움말페이지

3.8. 일반적인 NFS 마운트 옵션

이 섹션에는 NFS 공유를 마운트할 때 일반적으로 사용되는 옵션이 나열되어 있습니다. 이러한 옵션은 수동 마운트 명령, /etc/fstab 설정 및 EgressIP 와 함께 사용할 수 있습니다.

lookupcache=mode-

커널이 지정된 마운트 지점의 디렉터리 항목 캐시를 관리하는 방법을 지정합니다. 모드에 유효한 인수는

모두,none또는positive입니다. nfsvers=version사용할 NFS 프로토콜의 버전을 지정합니다. 여기서 version 은

3,4,4.0,4.1또는4.2입니다. 이는 여러 NFS 서버를 실행하거나 하위 버전으로 마운트 재시도를 비활성화하는 호스트에 유용합니다. 버전을 지정하지 않으면 NFS는 커널 및마운트유틸리티에서 지원되는 최고 버전을 사용합니다.옵션

vers는nfsvers와 동일하며 호환성 이유로 이 릴리스에 포함되어 있습니다.noacl- 모든 ACL 처리를 비활성화합니다. 이는 최신 ACL 기술이 이전 시스템과 호환되지 않기 때문에 이전 버전의 Red Hat Enterprise Linux, Red Hat Linux 또는 솔라리스와 연결할 때 필요할 수 있습니다.

NOLOCK- 파일 잠금을 비활성화합니다. 매우 오래된 NFS 서버에 연결할 때 이 설정이 필요합니다.

noexec- 마운트된 파일 시스템에서 바이너리의 실행을 방지합니다. 이 명령은 호환되지 않는 바이너리가 포함된 Linux 파일 시스템을 마운트할 때 유용합니다.

nosuid-

set-user-identifier및set-group-identifier비트를 비활성화합니다. 이렇게 하면 원격 사용자가setuid프로그램을 실행하여 더 높은 권한을 얻지 못하게 됩니다. port=num-

NFS 서버 포트의 숫자 값을 지정합니다. num 이

0(기본값)이면 사용할 포트 번호에 대해 원격 호스트에 queries를mount합니다.원격 호스트의 NFS 서비스가 rootfsbind서비스에 등록되지 않은 경우 대신 표준 NFS 포트 번호 TCP 2049가 사용됩니다. rsize=num및wsize=num이러한 옵션은 단일 NFS 읽기 또는 쓰기 작업에서 전송할 최대 바이트 수를 설정합니다.

rsize및wsize에 대한 고정 기본값이 없습니다. 기본적으로 NFS는 서버와 클라이언트 모두 지원하는 가능한 가장 큰 값을 사용합니다. Red Hat Enterprise Linux 9에서 클라이언트 및 서버 최대값은 1,048,576바이트입니다. 자세한 내용은 What are the default and maximum values for rsize and wsize with NFS mounts?를 참조하십시오. Kbase 기사입니다.sec=flavors마운트된 내보내기의 파일에 액세스하는 데 사용할 보안 플레이버. 플레이버 값은 콜론으로 구분된 하나 이상의 보안 플레이버 목록입니다.

기본적으로 클라이언트는 클라이언트와 서버 모두 지원하는 보안 플레이버를 찾습니다. 서버가 선택한 플레이버를 지원하지 않으면 마운트 작업이 실패합니다.

사용 가능한 플레이버:

-

head=sys는 로컬 UNIX UID 및 GID를 사용합니다. 이는AUTH_SYS를 사용하여 NFS 작업을 인증합니다. -

et=krb5는 로컬 UNIX UID 및 GID 대신 Kerberos V5를 사용하여 사용자를 인증합니다. -

Attack=krb5i는 사용자 인증을 위해 Kerberos V5를 사용하고 데이터 변조를 방지하기 위해 보안 체크섬을 사용하여 NFS 작업을 무결성 검사를 수행합니다. -

europe=krb5p는 Kerberos V5를 사용하여 사용자 인증, 무결성 검사 및 NFS 트래픽을 암호화하여 트래픽 스니핑을 방지합니다. 이는 가장 안전한 설정이지만 성능 오버헤드가 가장 많습니다.

-

tcp- TCP 프로토콜을 사용하도록 NFS 마운트에 지시합니다.

추가 리소스

-

mount(8)도움말 페이지 -

NFS(5) 도움말페이지

3.9. 추가 리소스

- Linux NFS why

- NFS 공유를 영구적으로 마운트합니다.

- 요청에 따라 NFS 공유 마운트.

4장. NFS 공유 내보내기

시스템 관리자는 NFS 서버를 사용하여 네트워크를 통해 시스템의 디렉터리를 공유할 수 있습니다.

4.1. NFS 소개

이 섹션에서는 NFS 서비스의 기본 개념에 대해 설명합니다.

NFS(네트워크 파일 시스템)를 사용하면 원격 호스트에서 네트워크를 통해 파일 시스템을 마운트하고 로컬에 마운트된 것처럼 해당 파일 시스템과 상호 작용할 수 있습니다. 이를 통해 네트워크의 중앙 집중식 서버에 리소스를 통합할 수 있습니다.

NFS 서버는 /etc/exports 구성 파일을 참조하여 클라이언트가 내보낸 모든 파일 시스템에 액세스할 수 있는지 여부를 확인합니다. 확인되면 모든 파일 및 디렉터리 작업을 사용자가 사용할 수 있습니다.

4.2. 지원되는 NFS 버전

이 섹션에는 Red Hat Enterprise Linux에서 지원되는 NFS 버전과 해당 기능이 나열되어 있습니다.

현재 Red Hat Enterprise Linux 9는 다음과 같은 주요 버전의 NFS를 지원합니다.

- NFS 버전 3(NFSv3)은 안전한 비동기 쓰기를 지원하며 이전 NFSv2보다 오류 처리 시 더 강력합니다. 또한 64비트 파일 크기 및 오프셋을 지원하여 클라이언트가 2GB 이상의 파일 데이터에 액세스할 수 있습니다.

-

NFS 버전 4(NFSv4)는 방화벽 및 인터넷에서 작동하므로 더 이상 EgressIP

bind서비스가 필요하지 않고 ACL(액세스 제어 목록)을 지원하고 상태 저장 작업을 활용합니다.

NFS 버전 2(NFSv2)는 Red Hat에서 더 이상 지원하지 않습니다.

기본 NFS 버전

Red Hat Enterprise Linux 9의 기본 NFS 버전은 4.2입니다. NFS 클라이언트는 기본적으로 NFSv4.2 사용을 시도하고 서버가 NFSv4.2를 지원하지 않는 경우 NFSv4.1로 돌아갑니다. 나중에 마운트가 NFSv4.0으로 대체된 다음 NFSv3로 돌아갑니다.

마이너 NFS 버전의 기능

다음은 Red Hat Enterprise Linux 9의 NFSv4.2의 기능입니다.

- 서버 측 복사

-

NFS 클라이언트가

copy_file_range()시스템 호출을 사용하여 네트워크 리소스를 낭비하지 않고 데이터를 효율적으로 복사할 수 있습니다. - 스파스 파일

-

파일에 0es만 구성된 할당되지 않았거나 초기화되지 않은 데이터 블록이 하나 이상 있을 수 있습니다. NFSv4.2의

lseek()작업은 search_hole()및seek_data()를 지원하므로 애플리케이션이 스파스 파일에 있는 홀의 위치를 매핑할 수 있습니다. - 공간 예약

-

스토리지 서버가 여유 공간을 예약할 수 있도록 허용하여 서버가 공간이 부족해지는 것을 방지합니다. NFSv4.2에서는

allocate()작업을 지원하여 공간을 예약하고, 공간을 할당 해제하는deallocate()작업, 파일에서 공간을 미리 할당하거나 할당 해제하는fallocate()작업을 지원합니다. - 레이블이 지정된 NFS

- 데이터 액세스 권한을 적용하고 NFS 파일 시스템의 개별 파일에 대해 클라이언트와 서버 간에 SELinux 레이블을 활성화합니다.

- 레이아웃 개선 사항

-

일부 Parallel NFS(pNFS) 서버가 더 나은 성능 통계를 수집할 수 있도록 하는

layoutstats()작업을 제공합니다.

다음은 NFSv4.1의 기능입니다.

- 네트워크의 성능과 보안을 강화하며 pNFS에 대한 클라이언트 측 지원도 포함합니다.

- 더 이상 콜백에 대한 별도의 TCP 연결이 필요하지 않으므로, 예를 들어 NAT 또는 방화벽이 방해하는 경우도 NFS 서버에서 클라이언트에 연결할 수 없는 경우에도 NFS 서버에서 위임을 부여할 수 있습니다.

- 재부팅 작업을 제외하고 정확히 한 번만 의미 체계를 제공하므로, 일부 작업에서 응답이 손실되고 작업을 두 번 전송한 경우 특정 작업에서 부정확한 결과를 반환하는 경우가 있습니다.

4.3. NFSv3 및 NFSv4의 TCP 및 UDP 프로토콜

NFSv4에는 IP 네트워크를 통해 실행되는 TCP(Transmission Control Protocol)가 필요합니다.

NFSv3에서는 이전 Red Hat Enterprise Linux 버전에서 UDP(User Datagram Protocol)를 사용할 수도 있었습니다. Red Hat Enterprise Linux 9에서는 UDP를 통한 NFS가 더 이상 지원되지 않습니다. 기본적으로 UDP는 NFS 서버에서 비활성화됩니다.

4.4. NFS에 필요한 서비스

이 섹션에는 NFS 서버를 실행하거나 NFS 공유를 마운트하는 데 필요한 시스템 서비스가 나열되어 있습니다. Red Hat Enterprise Linux는 이러한 서비스를 자동으로 시작합니다.

Red Hat Enterprise Linux는 커널 수준 지원 및 서비스 프로세스를 결합하여 NFS 파일 공유를 제공합니다. 모든 NFS 버전은 클라이언트와 서버 간의 RPC(Remote Procedure calls)에 의존합니다. NFS 파일 시스템을 공유하거나 마운트하기 위해 다음 서비스가 구현되는 NFS 버전에 따라 함께 작동합니다.

nfsd- 공유 NFS 파일 시스템에 대해 요청하는 NFS 서버 커널 모듈.

rpcbind-

로컬 RPC 서비스의 포트 예약을 허용합니다. 그런 다음 이러한 포트를 사용할 수 있도록 (또는 알림) 해당 원격 RPC 서비스에 액세스할 수 있습니다. E

gressIPbind서비스는 RPC 서비스에 대한 요청에 응답하고 요청된 RPC 서비스에 대한 연결을 설정합니다. NFSv4에서는 사용되지 않습니다. rpc.mountd-

이 프로세스는 NFS 서버에서 NFSv3 클라이언트의

MOUNT요청을 처리하는 데 사용됩니다. 요청된 NFS 공유를 현재 NFS 서버에서 내보내고 클라이언트가 액세스할 수 있는지 확인합니다. 마운트 요청이 허용되는 경우nfs-mountd서비스는 Success 상태로 응답하고 이 NFS 공유에 대한 File-Handle을 다시 NFS 클라이언트로 제공합니다. rpc.nfsd-

이 프로세스를 통해 서버가 광고하는 명시적인 NFS 버전 및 프로토콜을 사용할 수 있습니다. NFS 클라이언트가 연결할 때마다 서버 스레드 제공 등 NFS 클라이언트의 동적 요구를 충족하기 위해 Linux 커널과 함께 작동합니다. 이 프로세스는

nfs-server서비스에 해당합니다. lockd- 이는 클라이언트와 서버에서 모두 실행되는 커널 스레드입니다. NFSv3 클라이언트가 서버의 파일을 잠글 수 있도록 하는 NLM(Network Lock Manager) 프로토콜을 구현합니다. NFS 서버를 실행하고 NFS 파일 시스템이 마운트될 때마다 자동으로 시작됩니다.

rpc.statd-

이 프로세스는 NFV(Network Status Monitor) RPC 프로토콜을 구현하여 NFS 서버가 정상적으로 종료되지 않고 다시 시작될 때 NFS 클라이언트에 알립니다.

RuntimeClass-statd서비스는nfs-server서비스에 의해 자동으로 시작되며 사용자 구성이 필요하지 않습니다. NFSv4에서는 사용되지 않습니다. rpc.rquotad-

이 프로세스는 원격 사용자에게 사용자 할당량 정보를 제공합니다.

quota-rpc패키지에서 제공하는 RuntimeClass-rquotadnfs-server가 시작될 때 사용자가 시작해야 합니다. rpc.idmapd이 프로세스는 NFSv4 클라이언트 및 서버 백업 호출을 제공합니다. 이 호출은

사용자@도메인의 형식의 문자열과 로컬 UID 및 GID 사이에 매핑됩니다.idmapd가 NFSv4에서 작동하려면/etc/idmapd.conf파일을 구성해야 합니다. 최소한 NFSv4 매핑 도메인을 정의하는Domain매개 변수를 지정해야 합니다. NFSv4 매핑 도메인이 DNS 도메인 이름과 동일한 경우 이 매개 변수를 건너뛸 수 있습니다. ID 매핑이 제대로 작동하려면 클라이언트 및 서버는 NFSv4 매핑 도메인에 동의해야 합니다.NFSv4 서버만

nfs-idmapd를 사용합니다. NFSv4 클라이언트는 ID 매핑을 수행하기 위해 커널 온 디맨드에서 호출하는 인증 키 기반idmapd서비스에 의해 시작되는 RuntimeClass.nfsidmap유틸리티를 사용합니다.nfsidmap에 문제가 있는 경우 클라이언트는 Jenkinsfile.idmapd를 다시 사용합니다.

NFSv4를 사용한 RPC 서비스

NFSv4 프로토콜의 마운트 및 잠금 프로토콜이 통합되었습니다. 서버는 또한 잘 알려진 TCP 포트 2049에서 수신 대기합니다. 따라서 NFSv4는 EgressIP bind,lockd, RuntimeClass -statd 서비스와 상호 작용할 필요가 없습니다. nfs-mountd 서비스는 내보내기를 설정하기 위해 NFS 서버에 계속 필요하지만 over-the-wire 작업에는 포함되지 않습니다.

추가 리소스

-

Diffie

bind를 사용하지 않고 NFSv4만 구성.

4.5. NFS 호스트 이름 형식

이 섹션에서는 NFS 공유를 마운트하거나 내보낼 때 호스트를 지정하는 데 사용할 수 있는 다양한 형식을 설명합니다.

다음 형식으로 호스트를 지정할 수 있습니다.

- 단일 머신

다음 중 하나를 수행합니다.

- 정규화된 도메인 이름(서버에서 확인할 수 있음)

- 호스트 이름(서버에서 확인할 수 있음)

- IP 주소.

- IP 네트워크

다음 형식 중 하나가 유효합니다.

-

a.b.c.d/zz는 넷마스크의 비트 수입니다(예:DNS). -

a.b.c.d/netmask넷마스크입니다(예:192.168.100.8/255.255.255.0).

-

- netgroups

-

@group-name형식 . 여기서group-name은 NIS netgroup 이름입니다.

4.6. NFS 서버 구성

이 섹션에서는 NFS 서버에서 내보내기를 구성하는 두 가지 방법의 구문 및 옵션에 대해 설명합니다.

-

수동으로

/etc/exports구성 파일 편집 -

명령줄에서

exportfs유틸리티 사용

4.6.1. /etc/exports 구성 파일

/etc/exports 파일은 원격 호스트로 내보낼 파일 시스템을 제어하고 옵션을 지정합니다. 다음 구문 규칙을 따릅니다.

- 빈 줄은 무시됩니다.

-

주석을 추가하려면 해시 표시(# )로 행을 시작합니다.

-

긴 줄을 백슬래시(\)로 래핑할 수 있습니다.

- 내보낸 각 파일 시스템은 고유한 개별 행에 있어야 합니다.

- 내보낸 파일 시스템 이후에 배치된 인증된 호스트 목록은 공백 문자로 구분해야 합니다.

- 호스트와 첫 번째 괄호를 분리하는 공백 없이 호스트 식별자 뒤에 직접 각 호스트에 대한 옵션을 배치해야 합니다.

내보내기 항목

내보낸 파일 시스템의 각 항목에는 다음과 같은 구조가 있습니다.

export host(options)

각 호스트에 대한 특정 옵션과 함께 여러 호스트를 지정할 수도 있습니다. 이렇게 하려면 공백으로 구분된 목록과 동일한 줄에 나열한 다음 각 호스트 이름 뒤에 해당 옵션( 괄호 안에 있음)을 다음과 같이 나열합니다.

export host1(options1) host2(options2) host3(options3)

이 구조에서:

- export

- 내보낼 디렉터리입니다.

- 호스트

- 공유되고 있는 호스트 또는 네트워크

- 옵션

- 호스트에 사용할 옵션

예 4.1. 간단한 /etc/exports 파일

가장 간단한 형식의 /etc/exports 파일은 내보낸 디렉터리와 액세스할 수 있는 호스트만 지정합니다.

/exported/directory bob.example.com

여기에서 bob.example.com 은 NFS 서버에서 /exported/directory/ 를 마운트할 수 있습니다. 이 예제에 옵션이 지정되지 않기 때문에 NFS에서는 기본 옵션을 사용합니다.

/etc/exports 파일의 형식은 특히 공백 문자를 사용하는 것과 관련하여 매우 정확합니다. 내보낸 파일 시스템을 항상 호스트 및 호스트에서 공백 문자를 사용하여 서로 분리해야 합니다. 그러나 주석 행을 제외하고 파일에 다른 공백 문자는 없어야 합니다.

예를 들어 다음 두 줄은 동일한 것을 의미하는 것은 아닙니다.

/home bob.example.com(rw) /home bob.example.com (rw)

첫 번째 줄에서는 bob.example.com 의 사용자만 /home 디렉토리에 대한 읽기 및 쓰기 액세스 권한을 허용합니다. 두 번째 줄에서는 bob.example.com 의 사용자가 디렉터리를 읽기 전용(기본값)으로 마운트할 수 있는 반면 나머지 줄은 읽기/쓰기로 마운트할 수 있습니다.

기본 옵션

내보내기 항목의 기본 옵션은 다음과 같습니다.

ro- 내보낸 파일 시스템은 읽기 전용입니다. 원격 호스트는 파일 시스템에서 공유되는 데이터를 변경할 수 없습니다. 호스트가 파일 시스템(즉, 읽기 및 쓰기)을 변경할 수 있도록 하려면 rw 옵션을 지정합니다.

sync-

이전 요청으로 변경한 내용이 디스크에 기록되기 전에 NFS 서버는 요청에 응답하지 않습니다. 대신 비동기 쓰기를 활성화하려면

async옵션을 지정합니다. wdelay-

NFS 서버는 다른 쓰기 요청이 잘못된 것으로 의심되는 경우 디스크에 쓰는 것을 지연합니다. 이렇게 하면 별도의 쓰기 명령으로 디스크에 액세스해야 하는 횟수가 줄어들어 쓰기 오버헤드가 줄어들어 성능이 향상될 수 있습니다. 이 옵션을 비활성화하려면 기본 동기화 옵션도 지정된 경우에만 사용할 수 있는

no_wdelay옵션을 지정합니다. root_squash이렇게 하면 root 사용자가 (로컬와 달리) root 사용자가 root 권한을 보유하지 못하도록 합니다. 대신 NFS 서버는 사용자 ID

nobody를 할당합니다. 이를 통해 원격 root 사용자의 기능을 가장 낮은 로컬 사용자에게 "스쿼시"하여 원격 서버에서 무단 쓰기를 방지합니다. 루트 스쿼시를 비활성화하려면no_root_squash옵션을 지정합니다.모든 원격 사용자(root 포함)를 스쿼시하려면

all_squash옵션을 사용합니다. NFS 서버에서 특정 호스트의 원격 사용자에게 할당해야 하는 사용자 및 그룹 ID를 지정하려면 다음과 같이anonuid및anongid옵션을 각각 사용합니다.export host(anonuid=uid,anongid=gid)

여기에서 uid 및 gid는 사용자 ID 번호와 그룹 ID 번호입니다.

anonuid및anongid옵션을 사용하면 원격 NFS 사용자가 공유할 수 있는 특수 사용자 및 그룹 계정을 만들 수 있습니다.

기본적으로 ACL(액세스 제어 목록)은 Red Hat Enterprise Linux에서 NFS에서 지원됩니다. 이 기능을 비활성화하려면 파일 시스템을 내보낼 때 no_acl 옵션을 지정합니다.

기본값 및 재정의 옵션

내보낸 모든 파일 시스템의 각 기본값은 명시적으로 재정의해야 합니다. 예를 들어 rw 옵션이 지정되지 않으면 내보낸 파일 시스템이 읽기 전용으로 공유됩니다. 다음은 두 가지 기본 옵션을 재정의하는 /etc/exports 의 샘플 행입니다.

/another/exported/directory 192.168.0.3(rw,async)

이 예에서 192.168.0.3 은 /another/exported/directory/ read 및 write를 마운트할 수 있으며 디스크에 대한 모든 쓰기는 비동기적입니다.

4.6.2. exportfs 유틸리티

exportfs 유틸리티를 사용하면 루트 사용자는 NFS 서비스를 다시 시작하지 않고 디렉터리를 선택적으로 내보내거나 내보내기 해제할 수 있습니다. 적절한 옵션이 제공되는 경우 exportfs 유틸리티는 내보낸 파일 시스템을 /var/lib/nfs/xtab 에 씁니다. nfs-mountd 서비스는 파일 시스템에 대한 액세스 권한을 결정할 때 xtab 파일을 참조하므로 내보낸 파일 시스템 목록에 대한 변경 사항이 즉시 적용됩니다.

공통 exportfs 옵션

다음은 exportfs 에 사용할 수 있는 일반적으로 사용되는 옵션 목록입니다.

-r-

/var/lib/nfs/etab에서 새 내보내기 목록을 구성하여/etc/exports에 나열된 모든 디렉터리를 내보낼 수 있습니다. 이 옵션은/etc/exports에 대한 변경 사항을 사용하여 내보내기 목록을 효과적으로 새로 고칩니다. -a-

exportfs에 전달되는 다른 옵션에 따라 모든 디렉터리를 내보내거나 내보내지도록 합니다. 다른 옵션이 지정되지 않은 경우exportfs는/etc/exports에 지정된 모든 파일 시스템을 내보냅니다. -o file-systems-

/etc/exports에 나열되지 않은 디렉토리를 지정합니다. 내보낼 추가 파일 시스템으로 파일 시스템을 교체합니다. 이러한 파일 시스템은/etc/exports에 지정된 것과 동일한 방식으로 포맷해야 합니다. 이 옵션은 내보낸 파일 시스템 목록에 영구적으로 추가하기 전에 내보낸 파일 시스템을 테스트하는 데 자주 사용됩니다. -i-

/etc/exports를 무시합니다. 명령행에 제공된 옵션만 내보낸 파일 시스템을 정의하는 데 사용됩니다. -u-

Unexports 모든 공유 디렉터리를 해제합니다.

exportfs -ua명령은 모든 NFS 서비스를 유지하는 동안 NFS 파일 공유를 일시 중지합니다. NFS 공유를 다시 활성화하려면exportfs -r을 사용합니다. -v-

exportfs명령이 실행될 때 내보내기 또는 내보내기 해제 중인 파일 시스템이 더 자세히 표시되는 자세한 작업입니다.

exportfs 유틸리티로 옵션이 전달되지 않으면 현재 내보낸 파일 시스템 목록이 표시됩니다.

추가 리소스

4.7. NFS 및 EgressIPbind

E gressIPbind 서비스는 RPC(Remote Procedure call) 서비스를 수신 대기하는 포트에 매핑합니다. RPC 프로세스는 사용자가 수신 대기 중인 포트를 등록하고, 사용할 수 있는 RPC 프로그램 번호를 등록하기 시작할 때 EgressIP bind 에 알립니다. 그런 다음 클라이언트 시스템이 server에서 특정 RPC 프로그램 번호로 bind 에 연결합니다. controlPlane bind 서비스는 클라이언트를 적절한 포트 번호로 리디렉션하여 요청된 서비스와 통신할 수 있도록 합니다.

네트워크 파일 시스템 버전 3(NFSv3)에는 rpcbind 서비스가 필요합니다.

RPC 기반 서비스는verify bind 를 사용하여 들어오는 클라이언트 요청과의 모든 연결을 수행하므로 이러한 서비스를 시작하기 전에 EgressIP bind 를 사용할 수 있어야 합니다.

EgressIP bind에 대한 액세스 제어 규칙은 모든 RPC 기반 서비스에 영향을 미칩니다. 또는 NFS RPC 데몬마다 액세스 제어 규칙을 지정할 수 있습니다.

추가 리소스

-

rpc.mountd(8)man page -

RPC.statd(8)도움말 페이지

4.8. NFS 설치

이 절차에서는 NFS 공유를 마운트하거나 내보내는 데 필요한 모든 패키지를 설치합니다.

절차

nfs-utils패키지를 설치합니다.# dnf install nfs-utils

4.9. NFS 서버 시작

다음 절차에서는 NFS 공유를 내보내는 데 필요한 NFS 서버를 시작하는 방법을 설명합니다.

사전 요구 사항

NFSv3 연결을 지원하는 서버의 경우 N

etNamespacebind서비스가 실행되고 있어야 합니다. EgressIPbind가 활성화되어 있는지 확인하려면 다음 명령을 사용합니다.$ systemctl status rpcbind서비스가 중지된 경우 이를 시작하고 활성화합니다.

$ systemctl enable --now rpcbind

절차

NFS 서버를 시작하고 부팅 시 자동으로 시작되도록 하려면 다음 명령을 사용합니다.

# systemctl enable --now nfs-server

추가 리소스

4.10. NFS 및 EgressIPbind 문제 해결

controlPlane bind 서비스는 RPC 서비스와 통신하는 데 사용되는 포트 번호 간의 조정을 제공하므로 문제를 해결할 때 stderr bind 를 사용하여 현재 RPC 서비스의 상태를 확인하는 것이 유용합니다. RuntimeClass info 유틸리티는 각 RPC 기반 서비스와 포트 번호, RPC 프로그램 번호, 버전 번호, IP 프로토콜 유형(TCP 또는 UDP)을 보여줍니다.

절차

EgressIP

bind에 대해 적절한 NFS RPC 기반 서비스가 활성화되어 있는지 확인하려면 다음 명령을 사용하십시오.# rpcinfo -p예 4.2. RuntimeClassinfo -p 명령 출력

다음은 이 명령의 출력 샘플입니다.

program vers proto port service 100000 4 tcp 111 portmapper 100000 3 tcp 111 portmapper 100000 2 tcp 111 portmapper 100000 4 udp 111 portmapper 100000 3 udp 111 portmapper 100000 2 udp 111 portmapper 100005 1 udp 20048 mountd 100005 1 tcp 20048 mountd 100005 2 udp 20048 mountd 100005 2 tcp 20048 mountd 100005 3 udp 20048 mountd 100005 3 tcp 20048 mountd 100024 1 udp 37769 status 100024 1 tcp 49349 status 100003 3 tcp 2049 nfs 100003 4 tcp 2049 nfs 100227 3 tcp 2049 nfs_acl 100021 1 udp 56691 nlockmgr 100021 3 udp 56691 nlockmgr 100021 4 udp 56691 nlockmgr 100021 1 tcp 46193 nlockmgr 100021 3 tcp 46193 nlockmgr 100021 4 tcp 46193 nlockmgrNFS 서비스 중 하나가 올바르게 시작되지 않으면 E

gressIPbind가 해당 서비스의 RPC 요청을 올바른 포트로 매핑할 수 없습니다.대부분의 경우 NFS가 vGPU

info출력에 없는 경우 NFS를 다시 시작하면 NFS를 다시 시작하면 서비스가 EgressIPbind에 올바르게 등록되고 작동을 시작합니다.# systemctl restart nfs-server

추가 리소스

4.11. 방화벽 뒤에서 실행되도록 NFS 서버 구성

NFS에는 RPC 서비스에 대한 포트를 동적으로 할당하고 방화벽 규칙을 구성하는 데 문제가 발생할 수 있는 EgressIP bind 서비스가 필요합니다. 다음 섹션에서는 지원하려는 경우 방화벽에서 작동하도록 NFS 버전을 구성하는 방법을 설명합니다.

NFSv3

여기에는 NFSv3를 지원하는 모든 서버가 포함됩니다.

- NFSv3- 전용 서버

- NFSv3 및 NFSv4를 모두 지원하는 서버

- NFSv4 전용

4.11.1. 방화벽 뒤에서 실행되도록 NFSv3- 사용 서버 구성

다음 절차에서는 방화벽 뒤에서 실행되도록 NFSv3를 지원하는 서버를 구성하는 방법을 설명합니다. 여기에는 NFSv3 및 NFSv4를 모두 지원하는 NFSv3 전용 서버 및 서버가 포함됩니다.

절차

클라이언트가 방화벽 뒤에서 NFS 공유에 액세스할 수 있도록 하려면 NFS 서버에서 다음 명령을 실행하여 방화벽을 구성합니다.

firewall-cmd --permanent --add-service mountd firewall-cmd --permanent --add-service rpc-bind firewall-cmd --permanent --add-service nfs

다음과 같이

/etc/nfs.conf파일에서 RPC 서비스nlockmgr에서 사용할 포트를 지정합니다.[lockd] port=tcp-port-number udp-port=udp-port-number

또는

/etc/modprobe.d/lockd.conf파일에nlm_tcpport및nlm_udpport를 지정할 수 있습니다.NFS 서버에서 다음 명령을 실행하여 방화벽에서 지정된 포트를 엽니다.

firewall-cmd --permanent --add-port=<lockd-tcp-port>/tcp firewall-cmd --permanent --add-port=<lockd-udp-port>/udp

다음과 같이

/etc/nfs파일의.conf[statd]섹션을 편집하여 alice.statd에 대한 정적 포트를 추가합니다.[statd] port=port-numberNFS 서버에서 다음 명령을 실행하여 방화벽에서 추가된 포트를 엽니다.

firewall-cmd --permanent --add-port=<statd-tcp-port>/tcp firewall-cmd --permanent --add-port=<statd-udp-port>/udp

방화벽 구성을 다시 로드합니다.

firewall-cmd --reload먼저-02

--statd서비스를 다시 시작한 다음nfs-server서비스를 다시 시작합니다.# systemctl restart rpc-statd.service # systemctl restart nfs-server.service

또는

/etc/modprobe.d/포트를 지정한 경우:lockd.conf 파일에 lockd/proc/sys/fs/nfs/nlm_tcpport및/proc/sys/fs/nfs/nlm_udpport의 현재 값을 업데이트합니다.# sysctl -w fs.nfs.nlm_tcpport=<tcp-port> # sysctl -w fs.nfs.nlm_udpport=<udp-port>

-02-

-statd및nfs-server서비스를 다시 시작합니다.# systemctl restart rpc-statd.service # systemctl restart nfs-server.service

4.11.2. 방화벽 뒤에서 실행되도록 NFSv4 전용 서버 구성

다음 절차에서는 방화벽 뒤에서 실행되도록 NFSv4 전용 서버를 구성하는 방법을 설명합니다.

절차

클라이언트가 방화벽 뒤에서 NFS 공유에 액세스할 수 있도록 하려면 NFS 서버에서 다음 명령을 실행하여 방화벽을 구성합니다.

firewall-cmd --permanent --add-service nfs방화벽 구성을 다시 로드합니다.

firewall-cmd --reloadnfs-server를 다시 시작합니다.

# systemctl restart nfs-server

4.11.3. 방화벽 뒤에서 실행되도록 NFSv3 클라이언트 구성

방화벽 뒤에서 실행되도록 NFSv3 클라이언트를 구성하는 절차는 방화벽 뒤에서 실행되도록 NFSv3 서버를 구성하는 절차와 유사합니다.

구성 중인 시스템이 NFS 클라이언트와 NFS 서버 둘 다인 경우, NFSv3- 사용 서버 구성에 설명된 절차에 따라 방화벽 뒤에서 실행됩니다.

다음 절차에서는 방화벽 뒤에서 실행하기 위해서만 NFS 클라이언트인 시스템을 구성하는 방법을 설명합니다.

절차

클라이언트가 방화벽 뒤에 있을 때 NFS 서버가 NFS 클라이언트에 콜백을 수행할 수 있도록 하려면 NFS 클라이언트에서 다음 명령을 실행하여 방화벽에 CHAP

-bind서비스를 추가합니다.firewall-cmd --permanent --add-service rpc-bind다음과 같이

/etc/nfs.conf파일에서 RPC 서비스nlockmgr에서 사용할 포트를 지정합니다.[lockd] port=port-number udp-port=upd-port-number

또는

/etc/modprobe.d/lockd.conf파일에nlm_tcpport및nlm_udpport를 지정할 수 있습니다.NFS 클라이언트에서 다음 명령을 실행하여 방화벽에서 지정된 포트를 엽니다.

firewall-cmd --permanent --add-port=<lockd-tcp-port>/tcp firewall-cmd --permanent --add-port=<lockd-udp-port>/udp

다음과 같이

/etc/nfs파일의.conf[statd]섹션을 편집하여 alice.statd에 대한 정적 포트를 추가합니다.[statd] port=port-numberNFS 클라이언트에서 다음 명령을 실행하여 방화벽에서 추가된 포트를 엽니다.

firewall-cmd --permanent --add-port=<statd-tcp-port>/tcp firewall-cmd --permanent --add-port=<statd-udp-port>/udp

방화벽 구성을 다시 로드합니다.

firewall-cmd --reload-02-

-statd서비스를 다시 시작합니다.# systemctl restart rpc-statd.service또는

/etc/modprobe.d/포트를 지정한 경우:lockd.conf 파일에 lockd/proc/sys/fs/nfs/nlm_tcpport및/proc/sys/fs/nfs/nlm_udpport의 현재 값을 업데이트합니다.# sysctl -w fs.nfs.nlm_tcpport=<tcp-port> # sysctl -w fs.nfs.nlm_udpport=<udp-port>

-02-

-statd서비스를 다시 시작합니다.# systemctl restart rpc-statd.service

4.11.4. 방화벽 뒤에서 실행되도록 NFSv4 클라이언트 구성

클라이언트가 NFSv4.0을 사용하는 경우에만 이 절차를 수행하십시오. 이 경우 NFSv4.0 콜백용 포트를 열어야 합니다.

이후 프로토콜 버전에서는 서버가 클라이언트에서 시작한 동일한 연결에서 콜백을 수행하기 때문에 NFSv4.1 이상에는 이 절차가 필요하지 않습니다.

절차

NFSv4.0 콜백이 방화벽을 통과하도록 허용하려면

/proc/sys/fs/nfs_callback_tcpport를 설정하고 서버가 다음과 같이 클라이언트의 해당 포트에 연결할 수 있습니다.# echo "fs.nfs.nfs_callback_tcpport = <callback-port>" >/etc/sysctl.d/90-nfs-callback-port.conf # sysctl -p /etc/sysctl.d/90-nfs-callback-port.conf

NFS 클라이언트에서 다음 명령을 실행하여 방화벽에서 지정된 포트를 엽니다.

firewall-cmd --permanent --add-port=<callback-port>/tcp방화벽 구성을 다시 로드합니다.

firewall-cmd --reload

4.12. 방화벽을 통해 RPC 할당량 내보내기

디스크 할당량을 사용하는 파일 시스템을 내보내는 경우 quota Remote Procedure call(RPC) 서비스를 사용하여 NFS 클라이언트에 디스크 할당량 데이터를 제공할 수 있습니다.

절차

RuntimeClass

-rquotad서비스를 활성화하고 시작합니다.# systemctl enable --now rpc-rquotad참고nfs

-rquotad서비스는 활성화된 경우 nfs-server 서비스를 시작한 후 자동으로 시작됩니다.방화벽 뒤에서 할당량 RPC 서비스에 액세스할 수 있도록 하려면 TCP(또는 UDP가 활성화된 경우 UDP) 포트 875를 열어야 합니다. 기본 포트 번호는

/etc/services파일에 정의되어 있습니다./etc/sysconfig/rpc번호를 추가하여 기본 포트 번호를 재정의할 수 있습니다.-rquotad파일의RPCRQUOTADOPTS변수에 -p 포트-

기본적으로 원격 호스트는 할당량만 읽을 수 있습니다. 클라이언트가 할당량을 설정할 수 있도록 하려면

/etc/sysconfig/rpc-rquotad파일의RPCRQUOTADOPTS변수에-S옵션을 추가합니다. /etc/sysconfig/파일의 변경 사항을 적용하려면 6443-rquotad를 다시 시작합니다.rpc-rquotad# systemctl restart rpc-rquotad

4.13. NFS over RDMA (NFSoRDMA)

RDMA(Remote Direct Memory Access) 서비스는 Red Hat Enterprise Linux 9의 RDMA 가능 하드웨어에서 자동으로 작동합니다.

절차

rdma-core패키지를 설치합니다.# dnf install rdma-core/etc/rdma/modules/rdma.conf파일에서xprtrdma및svcrdma가 있는 행을 주석 처리했는지 확인합니다.# NFS over RDMA client support xprtrdma # NFS over RDMA server support svcrdma

NFS 서버에서 디렉토리

/mnt/nfsordma를 만들고/etc/exports로 내보냅니다.# mkdir /mnt/nfsordma # echo "/mnt/nfsordma *(fsid=0,rw,async,insecure,no_root_squash)" >> /etc/exports

NFS 클라이언트에서 서버 IP 주소(예:

172.31.0.186)를 사용하여 nfs-share를 마운트합니다.# mount -o rdma,port=20049 172.31.0.186:/mnt/nfs-share /mnt/nfsnfs-server서비스를 다시 시작합니다.# systemctl restart nfs-server

추가 리소스

4.14. 추가 리소스

5장. NFSv4 전용 서버 구성

NFS 서버 관리자는 시스템에서 열려 있는 포트 및 실행 중인 서비스 수를 최소화하는 NFSv4만 지원하도록 NFS 서버를 구성할 수 있습니다.

5.1. NFSv4 전용 서버의 이점 및 단점

이 섹션에서는 NFSv4만 지원하도록 NFS 서버를 구성하는 이점과 단점에 대해 설명합니다.

기본적으로 NFS 서버는 Red Hat Enterprise Linux 9에서 NFSv3 및 NFSv4 연결을 지원합니다. 그러나 NFS 버전 4.0 이상만 지원하도록 NFS를 구성할 수도 있습니다. 이렇게 하면 NFSv4가 네트워크에서 수신 대기할 필요가 없으므로 열린 포트 수와 시스템에서 실행 중인 서비스 수가 최소화됩니다.

NFS 서버가 NFSv4 전용으로 구성된 경우 NFSv3를 사용하여 공유를 마운트하려고 하는 클라이언트는 다음과 같은 오류와 함께 실패합니다.

Requested NFS version or transport protocol is not supported.

선택적으로 NFSv4 전용 사례에 필요하지 않은 RPCBIND,MOUNT, NSM 프로토콜 호출에 대한 수신을 비활성화할 수도 있습니다.

이러한 추가 옵션을 비활성화하는 영향은 다음과 같습니다.

- NFSv3를 사용하여 서버의 공유를 마운트하려는 클라이언트가 응답하지 않습니다.

- NFS 서버 자체는 NFSv3 파일 시스템을 마운트할 수 없습니다.

5.2. NFSv4만 지원하도록 NFS 서버 구성

다음 절차에서는 NFS 버전 4.0 이상만 지원하도록 NFS 서버를 구성하는 방법을 설명합니다.

절차

/etc/nfs.conf구성 파일의[nfsd]섹션에 다음 행을 추가하여 NFSv3를 비활성화합니다.[nfsd] vers3=no

NFSv4 전용 경우에는 필요하지 않은

RPCBIND,MOUNT,NSM프로토콜 호출 수신 대기를 비활성화합니다. 관련 서비스를 비활성화합니다.# systemctl mask --now rpc-statd.service rpcbind.service rpcbind.socket

NFS 서버를 다시 시작합니다.

# systemctl restart nfs-server

변경 사항은 NFS 서버를 시작하거나 다시 시작하는 즉시 적용됩니다.

5.3. NFSv4 전용 구성 확인

이 절차에서는 netstat 유틸리티를 사용하여 NFS 서버가 NFSv4 전용 모드에서 구성되었는지 확인하는 방법을 설명합니다.

절차

netstat유틸리티를 사용하여 TCP 및 UDP 프로토콜에서 수신 대기하는 서비스를 나열합니다.# netstat --listening --tcp --udp

예 5.1. NFSv4 전용 서버의 출력

다음은 NFSv4 전용 서버의

netstat출력 예입니다.RPCBIND,MOUNT,NSM의 수신 대기도 비활성화됩니다. 여기서nfs는 유일하게 수신 대기하는 NFS 서비스입니다.# netstat --listening --tcp --udp Active Internet connections (only servers) Proto Recv-Q Send-Q Local Address Foreign Address State tcp 0 0 0.0.0.0:ssh 0.0.0.0:* LISTEN tcp 0 0 0.0.0.0:nfs 0.0.0.0:* LISTEN tcp6 0 0 [::]:ssh [::]:* LISTEN tcp6 0 0 [::]:nfs [::]:* LISTEN udp 0 0 localhost.locald:bootpc 0.0.0.0:*

예 5.2. NFSv4 전용 서버를 구성하기 전에 출력

비교에서 NFSv4 전용 서버를 구성하기 전에

netstat출력에Sunrpc및mountd서비스가 포함됩니다.# netstat --listening --tcp --udp Active Internet connections (only servers) Proto Recv-Q Send-Q Local Address Foreign Address State tcp 0 0 0.0.0.0:ssh 0.0.0.0:* LISTEN tcp 0 0 0.0.0.0:40189 0.0.0.0:* LISTEN tcp 0 0 0.0.0.0:46813 0.0.0.0:* LISTEN tcp 0 0 0.0.0.0:nfs 0.0.0.0:* LISTEN tcp 0 0 0.0.0.0:sunrpc 0.0.0.0:* LISTEN tcp 0 0 0.0.0.0:mountd 0.0.0.0:* LISTEN tcp6 0 0 [::]:ssh [::]:* LISTEN tcp6 0 0 [::]:51227 [::]:* LISTEN tcp6 0 0 [::]:nfs [::]:* LISTEN tcp6 0 0 [::]:sunrpc [::]:* LISTEN tcp6 0 0 [::]:mountd [::]:* LISTEN tcp6 0 0 [::]:45043 [::]:* LISTEN udp 0 0 localhost:1018 0.0.0.0:* udp 0 0 localhost.locald:bootpc 0.0.0.0:* udp 0 0 0.0.0.0:mountd 0.0.0.0:* udp 0 0 0.0.0.0:46672 0.0.0.0:* udp 0 0 0.0.0.0:sunrpc 0.0.0.0:* udp 0 0 0.0.0.0:33494 0.0.0.0:* udp6 0 0 [::]:33734 [::]:* udp6 0 0 [::]:mountd [::]:* udp6 0 0 [::]:sunrpc [::]:* udp6 0 0 [::]:40243 [::]:*

6장. NFS 보안

NFS 보안 위험을 최소화하고 서버에서 데이터를 보호하려면 서버에서 NFS 파일 시스템을 내보내거나 클라이언트에서 데이터를 마운트할 때 다음 섹션을 고려하십시오.

6.1. AUTH_SYS 및 내보내기 제어를 사용한 NFS 보안

NFS는 내보낸 파일에 대한 액세스를 제어하기 위해 다음과 같은 기존 옵션을 제공합니다.

- 서버는 IP 주소 또는 호스트 이름으로 파일 시스템을 마운트할 수 있는 호스트를 제한합니다.

-

서버는 로컬 사용자와 동일한 방식으로 NFS 클라이언트의 사용자에게 파일 시스템 권한을 적용합니다. 일반적으로 NFS는

AUTH_SYS호출 메시지(AUTH_UNIX라고도 함)를 사용하여 이 작업을 수행합니다. 이 메시지는 클라이언트에 사용자의 UID 및 GID를 나타냅니다. 이는 악의적인 또는 잘못 구성된 클라이언트가 이 오류를 쉽게 가져오고 사용자가 그렇지 않아야 하는 파일에 액세스할 수 있도록 할 수 있음을 의미합니다.

잠재적인 위험을 제한하기 위해 관리자는 종종 액세스를 읽기 전용 또는 squash 사용자 권한으로 일반 사용자 및 그룹 ID로 제한합니다. 유감스럽게도 이러한 솔루션은 NFS 공유를 원래 의도한 방식으로 사용하지 않습니다.

또한 공격자가 NFS 파일 시스템을 내보내는 시스템에서 사용하는 DNS 서버를 제어하면 특정 호스트 이름 또는 정규화된 도메인 이름과 연결된 시스템을 인증되지 않은 시스템으로 가리킬 수 있습니다. 이 시점에 는 NFS 마운트에 대한 추가 보안을 제공하기 위해 사용자 이름 또는 암호 정보가 교환되지 않으므로 인증되지 않은 시스템은 NFS 공유를 마운트할 수 있는 시스템입니다.

와일드카드는 NFS를 통해 디렉터리를 내보낼 때는 의도한 것보다 많은 시스템을 포함할 수 있으므로 와일드카드를 사용해야 합니다.

추가 리소스

-

NFS 및 EgressIP

bind를 보호하려면 예를 들어nftables및firewalld를 사용합니다. -

nft(8)매뉴얼 페이지 -

firewalld-cmd(1)매뉴얼 페이지

6.2. AUTH_GSS를 사용한 NFS 보안

모든 버전의 NFS는 RPCSEC_GSS 및 Kerberos 메커니즘을 지원합니다.

RPCSEC_GSS Kerberos 메커니즘을 사용하는 AUTH_SYS와 달리 서버는 파일에 액세스하는 사용자를 올바르게 나타내기 위해 클라이언트에 의존하지 않습니다. 대신 암호화는 서버에 사용자를 인증하는 데 사용되며 악의적인 클라이언트가 해당 사용자의 Kerberos 자격 증명을 사용하지 않고 가장할 수 있습니다. Kerberos를 구성한 후 추가 설정이 필요 없기 때문에 RPCSEC_GSS Kerberos 메커니즘을 사용하는 가장 간단한 방법은 마운트를 보호하는 가장 간단한 방법입니다.

6.3. Kerberos를 사용하도록 NFS 서버 및 클라이언트 구성

Kerberos는 대칭 암호화 및 신뢰할 수 있는 타사인 NetNamespace를 사용하여 클라이언트와 서버가 서로 인증할 수 있도록 하는 네트워크 인증 시스템입니다. Kerberos 설정을 위해 IdM(Identity Management)을 사용하는 것이 좋습니다.

사전 요구 사항

-

Kerberos 키 배포 센터(mtls

)가 설치 및 구성되어 있습니다.

절차

-

NFS 서버 측에서

nfs/hostname.domain@REALMprincipal를 생성합니다. -

서버와 클라이언트 쪽 모두에

host/hostname.domain@REALMprincipal를 생성합니다. - 클라이언트 및 서버의 키 탭에 해당 키를 추가합니다.

-

NFS 서버 측에서

서버 측에서

sec=옵션을 사용하여 원하는 보안 플레이버를 활성화합니다. 모든 보안 플레이버 및 암호가 아닌 마운트를 활성화하려면 다음을 수행합니다./export *(sec=sys:krb5:krb5i:krb5p)

SEC=옵션과 함께 사용할 유효한 보안 플레이버는 다음과 같습니다.-

sys: no cryptographic protection, the default -

RuntimeClass5: 인증 전용 RuntimeClass5i: 무결성 보호- 사용자 인증에 Kerberos V5를 사용하고 데이터 변조를 방지하기 위해 보안 체크섬을 사용하여 NFS 작업의 무결성 검사를 수행합니다.

RuntimeClass5p: 개인 정보 보호- Kerberos V5를 사용하여 사용자 인증, 무결성 검사 및 NFS 트래픽을 암호화하여 트래픽 스니핑을 방지합니다. 이는 가장 안전한 설정이지만 성능 오버헤드가 가장 많습니다.

-

클라이언트 측에서

sec=krb5i(또는 setup에 따라초)를 마운트 옵션에 추가합니다.=krb5i, 초보5p# mount -o sec=krb5 server:/export /mnt

추가 리소스

- krb5 보안 NFS에서 root로 파일 만들기. 권장되지 않음.

-

export(5) 도움말페이지 -

NFS(5) 도움말페이지

6.4. NFSv4 보안 옵션

NFSv4에는 Microsoft Windows NT 모델의 기능 및 광범위한 배포 때문에 POSIX 모델이 아닌 Microsoft Windows NT 모델을 기반으로 하는 ACL 지원이 포함되어 있습니다.

NFSv4의 또 다른 중요한 보안 기능은 MOUNT 프로토콜 사용을 제거하여 파일 시스템 마운트입니다. MOUNT 프로토콜에는 프로토콜이 파일을 처리하는 방식 때문에 보안 위험이 있었습니다.

6.5. 마운트된 NFS 내보내기에 대한 파일 권한

NFS 파일 시스템이 원격 호스트에서 읽기 또는 읽기 및 쓰기로 마운트되면 각 공유 파일에 대한 유일한 보호 권한이 있습니다. 동일한 사용자 ID 값을 공유하는 두 사용자가 서로 다른 클라이언트 시스템에 동일한 NFS 파일 시스템을 마운트한 경우 서로의 파일을 수정할 수 있습니다. 또한 클라이언트 시스템에서 root로 로그인한 사용자는 su - 명령을 사용하여 NFS 공유로 모든 파일에 액세스할 수 있습니다.

기본적으로 ACL(액세스 제어 목록)은 Red Hat Enterprise Linux에서 NFS에서 지원됩니다. Red Hat은 이 기능을 활성화하는 것을 권장합니다.

기본적으로 NFS는 파일 시스템을 내보낼 때 루트 스쿼딩 을 사용합니다. 이렇게 하면 로컬 시스템에서 root 사용자로 NFS 공유에 액세스하는 사용자의 사용자 ID를 nobody 로 설정합니다. 루트 스쿼시는 기본 옵션 root_squash 에 의해 제어됩니다. 이 옵션에 대한 자세한 내용은 NFS 서버 구성을 참조하십시오.

NFS 공유를 읽기 전용으로 내보낼 때는 all_squash 옵션을 사용하는 것이 좋습니다. 이 옵션을 사용하면 내보낸 파일 시스템에 액세스하는 모든 사용자가 nobody 사용자의 사용자 ID를 사용합니다.

7장. NFS에서 pNFS SCSI 레이아웃 활성화

pNFS SCSI은 데이터에 액세스하는 데 pNFS SCSI 레이아웃을 사용하도록 NFS 서버와 클라이언트를 구성할 수 있습니다. pNFS SCSI은 파일에 대한 장기간 단일 클라이언트 액세스 권한이 필요한 사용 사례에서 유용합니다.

사전 요구 사항

- 클라이언트와 서버는 모두 동일한 블록 장치에 SCSI 명령을 보낼 수 있어야 합니다. 즉, 블록 장치는 공유 SCSI 버스에 있어야 합니다.

- 블록 장치에는 XFS 파일 시스템이 포함되어야 합니다.

- SCSI 장치는 SCSI-3 기본 명령 사양에 설명된 대로 SCSI 영구 예약을 지원해야 합니다.

7.1. PNFS 기술

pNFS 아키텍처는 NFS의 확장성을 향상시킵니다. 서버가 pNFS를 구현하는 경우 클라이언트는 여러 서버를 통해 동시에 데이터에 액세스할 수 있습니다. 이로 인해 성능이 개선될 수 있습니다.

pNFS는 RHEL에서 다음과 같은 스토리지 프로토콜 또는 레이아웃을 지원합니다.

- 파일

- flexfiles

- SCSI

7.2. PNFS SCSI 레이아웃

SCSI 레이아웃은 pNFS 블록 레이아웃 작업을 기반으로 합니다. 레이아웃은 SCSI 장치 간에 정의됩니다. SCSI 영구 예약을 지원할 수 있어야 하는 논리 단위(LU)로 순차적 일련의 고정 크기 블록이 포함되어 있습니다. LU 장치는 SCSI 장치 식별으로 식별됩니다.

pNFS SCSI은 파일에 대한 장기간 단일 클라이언트 액세스와 관련된 사용 사례에서 잘 수행합니다. 예를 들어 메일 서버 또는 클러스터를 보유하는 가상 시스템일 수 있습니다.

클라이언트와 서버 간 작업

NFS 클라이언트가 파일에서 읽거나 쓸 때 클라이언트는 LAYOUTGET 작업을 수행합니다. 서버는 SCSI 장치에 있는 파일의 위치로 응답합니다. 클라이언트는 사용할 SCSI 장치를 결정하기 위해 GETDEVICEINFO 의 추가 작업을 수행해야 할 수 있습니다. 이러한 작업이 올바르게 작동하는 경우 클라이언트는 READ 및 WRITE 작업을 서버로 보내는 대신 SCSI 장치에 직접 I/O 요청을 실행할 수 있습니다.

클라이언트 간의 오류 또는 경합으로 인해 서버에서 레이아웃을 회수하거나 클라이언트에 문제를 발생시키지 않을 수 있습니다. 이러한 경우 클라이언트는 I/O 요청을 SCSI 장치로 직접 보내는 대신 READ 및 WRITE 작업을 서버에 다시 실행합니다.

작업을 모니터링하려면 pNFS SCSI 레이아웃 기능 모니터링 을 참조하십시오.

장치 예약

PNFS SCSI은 예약 할당을 통해 펜싱을 처리합니다. 서버가 클라이언트에 레이아웃을 생성하기 전에 등록된 클라이언트만 장치에 액세스할 수 있도록 SCSI 장치를 예약합니다. 클라이언트가 해당 SCSI 장치에 명령을 실행할 수 있지만 장치에 등록되지 않은 경우 해당 장치의 클라이언트의 많은 작업이 실패합니다. 예를 들어, 서버에 클라이언트에 해당 장치의 레이아웃이 제공되지 않은 경우 클라이언트의 blkid 명령은 XFS 파일 시스템의 UUID를 표시하지 않습니다.

서버가 자체 영구 예약을 제거하지 않습니다. 이렇게 하면 클라이언트 및 서버를 다시 시작해도 장치에서 파일 시스템 내의 데이터가 보호됩니다. SCSI 장치를 다시 사용하려면 NFS 서버에서 영구 예약을 수동으로 제거해야 할 수 있습니다.

7.3. pNFS와 호환되는 SCSI 장치 확인

다음 절차에서는 SCSI 장치가 pNFS SCSI 레이아웃을 지원하는지 확인합니다.

사전 요구 사항

sg3_utils패키지를 설치합니다.# dnf install sg3_utils

절차

서버와 클라이언트 모두에서 적절한 SCSI 장치 지원이 있는지 확인합니다.

# sg_persist --in --report-capabilities --verbose path-to-scsi-devicePersist throughput Power Loss Active (

PTPL_A) bit가 설정되어 있는지 확인합니다.예 7.1. pNFS SCSI을 지원하는 SCSI 장치

다음은 pNFS SCSI을 지원하는 SCSI 장치의

sg_persist출력의 예입니다.PTPL_A비트는1을 보고합니다.inquiry cdb: 12 00 00 00 24 00 Persistent Reservation In cmd: 5e 02 00 00 00 00 00 20 00 00 LIO-ORG block11 4.0 Peripheral device type: disk Report capabilities response: Compatible Reservation Handling(CRH): 1 Specify Initiator Ports Capable(SIP_C): 1 All Target Ports Capable(ATP_C): 1 Persist Through Power Loss Capable(PTPL_C): 1 Type Mask Valid(TMV): 1 Allow Commands: 1 Persist Through Power Loss Active(PTPL_A): 1 Support indicated in Type mask: Write Exclusive, all registrants: 1 Exclusive Access, registrants only: 1 Write Exclusive, registrants only: 1 Exclusive Access: 1 Write Exclusive: 1 Exclusive Access, all registrants: 1

추가 리소스

-

sg_persist(8)매뉴얼 페이지

7.4. 서버에서 pNFS SCSI 설정

이 절차에서는 pNFS SCSI 레이아웃을 내보내도록 NFS 서버를 구성합니다.

절차

- 서버에서 SCSI 장치에 생성된 XFS 파일 시스템을 마운트합니다.

NFS 버전 4.1 이상을 내보내도록 NFS 서버를 구성합니다.

/etc/nfs.conf파일의[nfsd]섹션에 다음 옵션을 설정합니다.[nfsd] vers4.1=y

pnfs옵션을 사용하여 NFS를 통해 XFS 파일 시스템을 내보내도록 NFS 서버를 구성합니다.예 7.2. pNFS SCSI 내보내기를 위한 /etc/exports 항목

/etc/exports구성 파일의 다음 항목에서는/exported/directory/에 마운트된 파일 시스템을allowed.example.com클라이언트에 pNFS SCSI 레이아웃으로 내보냅니다./exported/directory allowed.example.com(pnfs)

참고내보낸 파일 시스템은 파티션뿐만 아니라 전체 블록 장치에 생성해야 합니다.

추가 리소스

7.5. 클라이언트에서 pNFS SCSI 설정

이 절차에서는 NFS 클라이언트가 pNFS SCSI 레이아웃을 마운트하도록 구성합니다.

사전 요구 사항

- NFS 서버는 pNFS SCSI을 통해 XFS 파일 시스템을 내보내도록 구성되어 있습니다. 서버에서 pNFS SCSI 설정을 참조하십시오.

절차

클라이언트에서 NFS 버전 4.1 이상을 사용하여 내보낸 XFS 파일 시스템을 마운트합니다.

# mount -t nfs -o nfsvers=4.1 host:/remote/export /local/directory

NFS 없이 XFS 파일 시스템을 직접 마운트하지 마십시오.

추가 리소스

- NFS 공유 마운트 .

7.6. 서버에서 pNFS SCSI 예약 해제

이 절차에서는 NFS 서버가 SCSI 장치에 보유하고 있는 영구 예약을 해제합니다. 이를 통해 더 이상 pNFS SCSI을 내보낼 필요가 없는 경우 SCSI 장치를 변경할 수 있습니다.

서버에서 예약을 제거해야 합니다. 다른 IT Nexus에서는 제거할 수 없습니다.

사전 요구 사항

sg3_utils패키지를 설치합니다.# dnf install sg3_utils

절차

서버에서 기존 예약을 쿼리합니다.

# sg_persist --read-reservation path-to-scsi-device예 7.3. /dev/sda에서 예약 쿼리

# *sg_persist --read-reservation /dev/sda* LIO-ORG block_1 4.0 Peripheral device type: disk PR generation=0x8, Reservation follows: Key=0x100000000000000 scope: LU_SCOPE, type: Exclusive Access, registrants only서버의 기존 등록을 제거합니다.

# sg_persist --out \ --release \ --param-rk=reservation-key \ --prout-type=6 \ path-to-scsi-device예 7.4. /dev/sda에서 예약 제거

# sg_persist --out \ --release \ --param-rk=0x100000000000000 \ --prout-type=6 \ /dev/sda LIO-ORG block_1 4.0 Peripheral device type: disk

추가 리소스

-

sg_persist(8)매뉴얼 페이지

8장. PNFS SCSI 레이아웃 기능 모니터링

pNFS 클라이언트와 서버가 적절한 pNFS SCSI 작업을 교환하는지 또는 일반 NFS 작업을 다시 사용할 수 있는지 모니터링할 수 있습니다.

사전 요구 사항

- pNFS SCSI 클라이언트와 서버가 구성되어 있습니다.

8.1. nfsstat를 사용하여 서버에서 pNFS SCSI 작업 확인

이 절차에서는 nfsstat 유틸리티를 사용하여 서버에서 pNFS SCSI 작업을 모니터링합니다.

절차

서버에서 제공하는 작업을 모니터링합니다.

# watch --differences \ "nfsstat --server | egrep --after-context=1 read\|write\|layout" Every 2.0s: nfsstat --server | egrep --after-context=1 read\|write\|layout putrootfh read readdir readlink remove rename 2 0% 0 0% 1 0% 0 0% 0 0% 0 0% -- setcltidconf verify write rellockowner bc_ctl bind_conn 0 0% 0 0% 0 0% 0 0% 0 0% 0 0% -- getdevlist layoutcommit layoutget layoutreturn secinfononam sequence 0 0% 29 1% 49 1% 5 0% 0 0% 2435 86%클라이언트 및 서버는 다음과 같은 경우 pNFS SCSI 작업을 사용합니다.

-

layoutget,layoutreturn,layoutcommit카운터가 증가했습니다. 즉, 서버가 레이아웃을 제공하고 있습니다. -

서버

읽기및쓰기카운터가 증가하지 않습니다. 즉, 클라이언트가 SCSI 장치에 직접 I/O 요청을 수행하고 있습니다.

-

8.2. mountstats를 사용하여 클라이언트에서 pNFS SCSI 작업 확인

이 절차에서는 /proc/self/mountstats 파일을 사용하여 클라이언트에서 pNFS SCSI 작업을 모니터링합니다.

절차

마운트별 작업 카운터를 나열합니다.

# cat /proc/self/mountstats \ | awk /scsi_lun_0/,/^$/ \ | egrep device\|READ\|WRITE\|LAYOUT device 192.168.122.73:/exports/scsi_lun_0 mounted on /mnt/rhel7/scsi_lun_0 with fstype nfs4 statvers=1.1 nfsv4: bm0=0xfdffbfff,bm1=0x40f9be3e,bm2=0x803,acl=0x3,sessions,pnfs=LAYOUT_SCSI READ: 0 0 0 0 0 0 0 0 WRITE: 0 0 0 0 0 0 0 0 READLINK: 0 0 0 0 0 0 0 0 READDIR: 0 0 0 0 0 0 0 0 LAYOUTGET: 49 49 0 11172 9604 2 19448 19454 LAYOUTCOMMIT: 28 28 0 7776 4808 0 24719 24722 LAYOUTRETURN: 0 0 0 0 0 0 0 0 LAYOUTSTATS: 0 0 0 0 0 0 0 0결과에서 다음을 수행합니다.

-

LAYOUT통계는 클라이언트 및 서버가 pNFS SCSI 작업을 사용하는 요청을 나타냅니다. -

READ및WRITE통계는 클라이언트 및 서버가 NFS 작업으로 대체되는 요청을 나타냅니다.

-

9장. FS-Cache 시작하기

FS-Cache는 파일 시스템이 네트워크를 통해 검색된 데이터를 가져와 로컬 디스크에 캐시하는 데 사용할 수 있는 영구적인 로컬 캐시입니다. 이를 통해 네트워크를 통해 마운트된 파일 시스템의 데이터에 액세스하는 사용자의 네트워크 트래픽을 최소화할 수 있습니다(예: NFS).

9.1. FS-Cache 개요

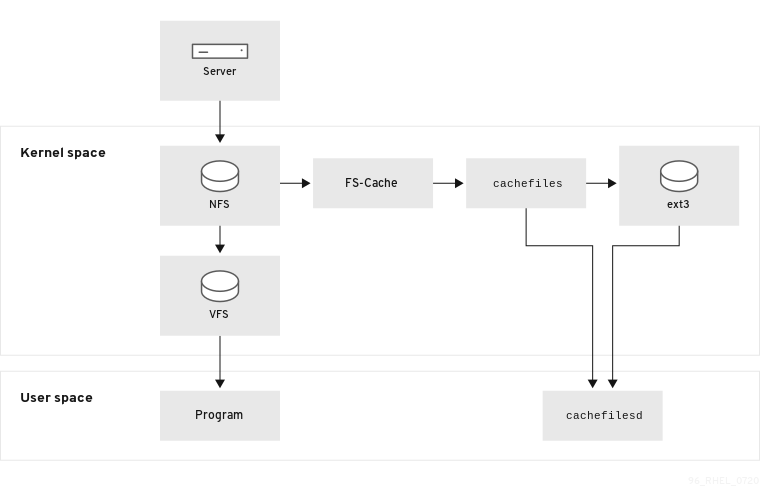

다음 다이어그램은 FS-Cache 작동 방법에 대한 간략한 설명입니다.

그림 9.1. FS-Cache 개요

FS-Cache는 시스템 관리자와 사용자에게 가능한 한 투명하도록 설계되었습니다. 솔라리스의 cachefs 와 달리 FS-Cache를 사용하면 과도한 마운트된 파일 시스템을 만들지 않고도 서버의 파일 시스템이 클라이언트의 로컬 캐시와 직접 상호 작용할 수 있습니다. NFS를 사용하면 마운트 옵션이 클라이언트에 FS-cache가 활성화된 NFS 공유를 마운트하도록 지시합니다. 마운트 지점을 사용하면 두 커널 모듈(fs cache 및 에 대한 자동 업로드가 발생합니다. cachefiles )cachefilesd 데몬은 커널 모듈과 통신하여 캐시를 구현합니다.

FS-Cache는 네트워크를 통해 작동하는 파일 시스템의 기본 작업을 변경하지 않으며, 이는 데이터를 캐시할 수 있는 영구 공간으로 파일 시스템을 제공하기만 하면 됩니다. 예를 들어 클라이언트는 FS-Cache가 활성화되어 있는지 여부에 관계없이 NFS 공유를 계속 마운트할 수 있습니다. 또한 캐시된 NFS는 파일이 부분적으로 캐시될 수 있으므로 캐시에 맞지 않는 파일을 처리할 수 있으며 완전히 읽을 필요가 없습니다. FS-Cache는 클라이언트 파일 시스템 드라이버에서 캐시에 발생하는 모든 I/O 오류도 숨깁니다.

캐싱 서비스를 제공하려면 FS-Cache에 캐시 백엔드 가 필요합니다. 캐시 백엔드는 캐시 파일인 캐싱 서비스를 제공하도록 구성된 스토리지 드라이버입니다. 이 경우 FS-Cache에는 bmap 및 확장 속성(예: ext3)을 캐시 백엔드로 지원하는 마운트된 블록 기반 파일 시스템이 필요합니다.

FS-Cache 캐시 백엔드에 필요한 기능을 지원하는 파일 시스템에는 다음 파일 시스템의 Red Hat Enterprise Linux 9 구현이 포함됩니다.

- ext3 (Extended attributes enabled 포함)

- ext4

- XFS

FS-Cache는 네트워크를 통해 일반적으로 모든 파일 시스템을 캐시할 수 없습니다. 공유 파일 시스템의 드라이버는 FS-Cache, 데이터 스토리지/retrieval, 메타데이터 설정 및 유효성 검사와 상호 작용할 수 있도록 변경해야 합니다. FS-Cache는 지속성을 지원하기 위해 캐시된 파일 시스템의 인덱싱 키와 일관성 데이터를 필요로 합니다. 파일 시스템 개체와 일치하기 위한 인덱싱 키 및 일관성 데이터를 사용하여 캐시 오브젝트가 계속 유효한지 확인합니다.

Red Hat Enterprise Linux 9에서 cachefilesd 패키지는 기본적으로 설치되지 않으므로 수동으로 설치해야 합니다.

9.2. 성능 보장

FS-Cache는 성능 향상을 보장하지 않습니다. 캐시를 사용하면 성능 저하가 발생합니다. 예를 들어 캐시된 NFS 공유에서는 교차 네트워크 조회에 대한 디스크 액세스 권한을 추가합니다. FS-Cache는 가능한 한 비동기로 시도하지만 이것이 가능하지 않은 동기 경로 (예: 읽기)가 있습니다.

예를 들어 FS-Cache를 사용하여 다른 차단되지 않은 GigE 네트워크를 통해 두 컴퓨터 간에 NFS 공유를 캐시하면 파일 액세스 시 성능 향상이 수행되지 않을 수 있습니다. NFS 요청은 로컬 디스크가 아닌 서버 메모리에서 더 빠르게 충족됩니다.

따라서 FS-Cache를 사용하면 다양한 요인이 손상 됩니다. 예를 들어 FS-Cache를 사용하여 NFS 트래픽을 캐시하는 경우 클라이언트의 속도가 약간 느려질 수 있지만 네트워크 대역폭을 사용하지 않고 로컬로 읽기 요청을 충족하기 때문에 네트워크 및 서버 로드가 느려질 수 있습니다.

9.3. 캐시 설정

현재 Red Hat Enterprise Linux 9는 cachefiles 캐싱 백엔드만 제공합니다. cachefilesd 데몬은 cachefiles 를 시작하고 관리합니다. /etc/cachefilesd.conf 파일은 cachefiles 에서 캐싱 서비스를 제공하는 방법을 제어합니다.

캐시 백엔드는 캐시를 호스팅하는 파티션에 특정 양의 여유 공간을 유지하여 작동합니다. 사용 가능한 공간을 사용하여 시스템의 다른 요소에 대한 응답으로 캐시를 확장 및 축소하여 루트 파일 시스템(예: 랩탑에서)을 안전하게 사용할 수 있습니다. FS-Cache는 캐시 큐를 통해 구성할 수 있는 이 동작의 기본값을 설정합니다. 캐시 단서 제한 구성에 대한 자세한 내용은 캐시 단서 제한 구성 을 참조하십시오.

다음 절차에서는 캐시를 설정하는 방법을 설명합니다.

사전 요구 사항

cachefilesd 패키지가 설치되고 서비스가 성공적으로 시작됩니다. 서비스가 실행 중인지 확인하려면 다음 명령을 사용하십시오.

# systemctl start cachefilesd # systemctl status cachefilesd

상태는 활성(실행 중) 이어야 합니다.

절차

캐시 백엔드에서 캐시로 사용할 디렉터리를 구성하고 다음 매개 변수를 사용합니다.

$ dir /path/to/cache일반적으로 캐시 백엔드 디렉터리는 다음과 같이

/etc/cachefilesd.conf에/var/cache/fscache로 설정됩니다.$ dir /var/cache/fscache

캐시 백엔드 디렉터리를 변경하려면 selinux 컨텍스트가

/var/cache/fscache와 동일해야 합니다.# semanage fcontext -a -e /var/cache/fscache /path/to/cache # restorecon -Rv /path/to/cache

- 캐시를 설정하는 동안 /path/to/cache 를 디렉토리 이름으로 바꿉니다.

selinux 컨텍스트를 설정하기 위해 지정된 명령이 작동하지 않으면 다음 명령을 사용하십시오.

# semanage permissive -a cachefilesd_t # semanage permissive -a cachefiles_kernel_t

FS-Cache는

/path/to/cache를 호스팅하는 파일 시스템에 캐시를 저장합니다. 랩탑에서는 루트 파일 시스템(/)을 호스트 파일 시스템으로 사용하는 것이 좋지만, 데스크탑 시스템의 경우 특히 캐시용으로 디스크 파티션을 마운트하는 것이 더 바람직합니다.호스트 파일 시스템은 사용자 정의 확장 속성을 지원해야 합니다. FS-Cache는 이러한 특성을 사용하여 일관성 유지 관리 정보를 저장합니다. ext3 파일 시스템(예:

장치)에 대한 사용자 정의 확장 속성을 활성화하려면 다음을 사용합니다.# tune2fs -o user_xattr /dev/device

마운트 시 파일 시스템의 확장 속성을 활성화하려면 대체 방법으로 다음 명령을 사용합니다.

# mount /dev/device /path/to/cache -o user_xattr

구성 파일이 배치되면

cachefilesd서비스를 시작합니다.# systemctl start cachefilesd

부팅 시 시작되도록

cachefilesd를 구성하려면 root로 다음 명령을 실행합니다.# systemctl enable cachefilesd

9.4. cache cull 제한 구성

cachefilesd 데몬은 공유 파일 시스템의 원격 데이터를 캐싱하여 디스크 공간을 확보하여 작동합니다. 이로 인해 사용 가능한 모든 여유 공간을 소비할 수 있으므로 디스크가 루트 파티션을 배치한 경우 문제가 발생할 수 있습니다. 이를 제어하기 위해 cachefilesd 는 캐시에서 이전 오브젝트(예: 액세스 less recently)를 삭제하여 특정 양의 여유 공간을 유지하려고 합니다. 이 동작을 캐시 큐링 이라고 합니다.

캐시 큐링은 블록 백분율과 기본 파일 시스템에서 사용할 수 있는 파일의 백분율에 따라 수행됩니다. /etc/cachefilesd.conf 에는 6개의 제한을 제어하는 설정이 있습니다.

- Brun N% (블록의 백분율), frun N% (파일의 백분율)

- 사용 가능한 공간의 양과 캐시에 있는 사용 가능한 파일 수가 이 제한보다 높으면 큐링이 해제됩니다.

- bcull N% (블록 부족), fcull N% (파일의 백분율)

- 사용 가능한 공간 또는 캐시에 있는 파일 수가 이러한 제한 중 하나 미만이면 큐링이 시작됩니다.

- bstop N% (블록당량), fstop N% (파일의 백분율)

- 사용 가능한 공간 또는 캐시에 있는 파일 수가 이러한 제한 중 하나 미만으로 떨어지면 큐로 인해 이러한 제한을 초과할 때까지 디스크 공간이나 파일을 더 이상 할당할 수 없습니다.

각 설정 의 기본값은 다음과 같습니다.

-

Brun/frun- 10% -

bcull/fcull- 7% -

bstop/fstop- 3%

이러한 설정을 구성할 때 다음 사항이 충족되어야 합니다.

-

0 ࣘ

bstop<bcull<brun< 100 -

0 ࣘ

fstop<fcull<frun< 100

다음은 사용 가능한 공간 및 사용 가능한 파일의 백분율이며 df 프로그램에서 표시하는 백분율을 100개로 표시하지 않습니다.

큐링은 bxxx 및 fxxx 쌍 모두에 동시에 의존합니다. 사용자는 이를 별도로 처리할 수 없습니다.

9.5. fscache 커널 모듈에서 통계 정보 검색

FS-Cache는 일반 통계 정보를 추적합니다. 다음 절차에서는 이 정보를 얻는 방법을 설명합니다.

절차

FS-Cache에 대한 통계 정보를 보려면 다음 명령을 사용하십시오.

# cat /proc/fs/fscache/stats

FS-Cache 통계에는 의사 결정 지점 및 개체 카운터에 대한 정보가 포함됩니다. 자세한 내용은 다음 커널 문서를 참조하십시오.

/usr/share/doc/kernel-doc-4.18.0/Documentation/filesystems/caching/fscache.txt

9.6. FS-Cache 참조

이 섹션에서는 FS-Cache에 대한 참조 정보를 제공합니다.

cachefilesd및 구성 방법에 대한 자세한 내용은man cachefilesd및man cachefilesd.conf를 참조하십시오. 다음 커널 문서에서도 추가 정보를 제공합니다.-

/usr/share/doc/cachefilesd/README -

/usr/share/man/man5/cachefilesd.conf.5.gz -

/usr/share/man/man8/cachefilesd.8.gz

-

디자인 제약 조건, 사용 가능한 통계 및 기능에 대한 세부 정보를 포함하여 FS-Cache에 대한 일반적인 내용은 다음 커널 문서를 참조하십시오.

/usr/share/doc/kernel-doc-4.18.0/Documentation/filesystems/caching/fscache.txt

10장. NFS에서 캐시 사용

명시적으로 지시하지 않는 한 NFS는 캐시를 사용하지 않습니다. 이 단락에서는 FS-Cache를 사용하여 NFS 마운트를 구성하는 방법을 보여줍니다.

사전 요구 사항

cachefilesd 패키지가 설치되어 실행 중입니다. 실행 중인지 확인하려면 다음 명령을 사용하십시오.

# systemctl start cachefilesd # systemctl status cachefilesd

상태는 활성(실행 중) 이어야 합니다.

다음 옵션을 사용하여 NFS 공유를 마운트합니다.

# mount nfs-share:/ /mount/point -o fsc직접 I/O 또는 쓰기를 위해 파일을 열지 않는 한

/mount/point아래의 파일에 대한 모든 액세스는 캐시를 통과합니다. 자세한 내용은 NFS의 캐시 제한 사항을 참조하십시오.

NFS 색인은 파일 이름이 아닌 NFS 파일 핸들을 사용하여 콘텐츠를 캐시합니다. 따라서 하드 연결된 파일이 캐시를 올바르게 공유합니다.

NFS 버전 3, 4.0, 4.1 및 4.2는 캐싱을 지원합니다. 그러나 각 버전은 캐싱에 서로 다른 분기를 사용합니다.

10.1. NFS 캐시 공유 구성

NFS 캐시 공유에는 몇 가지 잠재적인 문제가 있습니다. 캐시는 영구적이므로 캐시의 데이터 블록은 다음 네 가지 키 순서로 인덱싱됩니다.

- 수준 1: 서버 세부 정보

- 수준 2 일부 마운트 옵션, 보안 유형, FSID; uniquifier

- 수준 3: 파일 처리

- 수준 4: 파일의 페이지 번호

수퍼 블록 간의 일관성 관리 문제를 방지하기 위해 데이터를 캐시하는 데 필요한 모든 NFS 수퍼 블록에는 고유한 레벨 2 키가 있습니다. 일반적으로 동일한 소스 볼륨 및 옵션을 사용하는 두 NFS 마운트는 수퍼 블록을 공유하므로 해당 볼륨 내에서 다른 디렉터리를 마운트하더라도 캐싱을 공유합니다.

다음은 다양한 옵션을 사용하여 캐시 공유를 구성하는 예제입니다.

절차

다음 명령을 사용하여 NFS 공유를 마운트합니다.

mount home0:/disk0/fred /home/fred -o fsc mount home0:/disk0/jim /home/jim -o fsc

여기에서

/home/fred및/home/jim은 특히 NFS 서버(home0)에서 동일한 볼륨/파티션에서 발생하는 경우 수퍼 블록을 공유할 수 있습니다.수퍼 블록을 공유하지 않으려면

mount명령을 다음 옵션과 함께 사용하십시오.mount home0:/disk0/fred /home/fred -o fsc,rsize=8192 mount home0:/disk0/jim /home/jim -o fsc,rsize=65536

이 경우

/home/fred및/home/jim은 수준 2 키의 일부인 다른 네트워크 액세스 매개 변수를 가지고 있으므로 수퍼 블록을 공유하지 않습니다.수퍼 블록을 공유하지 않고 두 개의 하위 트리(

/home/fred1및/home/fred2)의 콘텐츠를 두 번 캐시하려면 다음 명령을 사용하십시오.mount home0:/disk0/fred /home/fred1 -o fsc,rsize=8192 mount home0:/disk0/fred /home/fred2 -o fsc,rsize=65536

수퍼 블록 공유를 방지하는 또 다른 방법은

nosharecache매개 변수를 사용하여 명시적으로 억제하는 것입니다. 동일한 예제를 사용합니다.mount home0:/disk0/fred /home/fred -o nosharecache,fsc mount home0:/disk0/jim /home/jim -o nosharecache,fsc

그러나 이 경우

home0:/disk0/fred및home0:/disk0/jim의 수준 2 키를 구분할 수 없으므로 수퍼 블록 중 하나만 캐시를 사용할 수 있습니다.수퍼 블록에 주소 지정을 지정하려면 마운트 중 하나 이상(예:

fsc=unique-identifier)에 고유 식별자 를 추가합니다.mount home0:/disk0/fred /home/fred -o nosharecache,fsc mount home0:/disk0/jim /home/jim -o nosharecache,fsc=jim

여기서는 고유 식별자

jim이/home/jim의 캐시에 사용된 레벨 2 키에 추가됩니다.

사용자는 다른 통신 또는 프로토콜 매개 변수가 있는 수퍼 블록 간에 캐시를 공유할 수 없습니다. 예를 들어 NFSv4.0과 NFSv3 간 또는 NFSv4.1과 NFSv4.2 간에 다른 수퍼 블록을 강제로 공유하므로 공유할 수 없습니다. 읽기 크기(rsize)와 같은 매개 변수를 설정하면 다른 수퍼 블록을 강제 적용하므로 캐시 공유를 방지할 수 있습니다.

10.2. NFS를 사용한 캐시 제한 사항

NFS에는 몇 가지 캐시 제한 사항이 있습니다.

- 직접 I/O에 대해 공유 파일 시스템에서 파일을 열면 캐시를 자동으로 무시합니다. 이러한 유형의 액세스는 서버로 직접 전송되어야 하기 때문입니다.

- 직접 I/O를 위해 공유 파일 시스템에서 파일을 열거나 파일 캐시된 복사본을 플러시합니다. FS-Cache는 직접 I/O 또는 쓰기를 위해 더 이상 열 수 없을 때까지 파일을 다시 캐시하지 않습니다.

- 또한 FS-Cache의 이 릴리스는 일반 NFS 파일만 캐시합니다. FS-Cache는 디렉토리, 심볼릭 링크, 장치 파일, firstFOs 및 소켓을 캐시 하지 않습니다.

11장. Red Hat Enterprise Linux에서 SMB 공유 마운트

SMB(Server Message Block) 프로토콜은 파일 공유 및 공유 프린터와 같은 서버의 리소스에 액세스하는 데 사용되는 애플리케이션 계층 네트워크 프로토콜을 구현합니다.

SMB의 컨텍스트에서는 SMB의 대화 상자인 CIFS(Common Internet File System) 프로토콜에 대해 언급할 수 있습니다. SMB 및 CIFS 프로토콜이 모두 지원되며, SMB 및 CIFS 공유 마운트에 포함된 커널 모듈과 유틸리티에는 모두 cifs 라는 이름이 사용됩니다.

이 섹션에서는 SMB 서버에서 공유를 마운트하는 방법에 대해 설명합니다.

사전 요구 사항

Microsoft Windows에서는 SMB가 기본적으로 구현됩니다. Red Hat Enterprise Linux에서 커널의 cifs.ko 파일 시스템 모듈은 SMB 공유 마운트를 지원합니다. 따라서 cifs-utils 패키지를 설치합니다.

# dnf install cifs-utils

cifs-utils 패키지는 다음을 수행할 수 있는 유틸리티를 제공합니다.

- SMB 및 CIFS 공유 마운트

- 커널의 인증 키에서 NT Lan Manager(NTLM) 자격 증명을 관리합니다.

- SMB 및 CIFS 공유의 보안 설명자에서 ACL(액세스 제어 목록) 설정 및 표시

11.1. 지원되는 SMB 프로토콜 버전

cifs.ko 커널 모듈은 다음과 같은 SMB 프로토콜 버전을 지원합니다.

SMB 1

주의SMB1 프로토콜은 알려진 보안 문제로 인해 더 이상 사용되지 않으며 사설 네트워크에서만 사용할 수 있습니다. SMB1이 여전히 지원되는 옵션으로 제공되는 주요 이유는 현재 UNIX 확장을 지원하는 유일한 SMB 프로토콜 버전이라는 것입니다. SMB에서 UNIX 확장을 사용할 필요가 없는 경우 SMB2 이상을 사용하는 것이 좋습니다.

- SMB 2.0

- SMB 2.1

- SMB 3.0

- SMB 3.1.1

프로토콜 버전에 따라 일부 SMB 기능이 구현되는 것은 아닙니다.

11.2. UNIX 확장 지원

Samba는 SMB 프로토콜에서 CAP_UNIX 기능 비트를 사용하여 UNIX 확장 기능을 제공합니다. 이러한 확장 기능은 cifs.ko 커널 모듈에서도 지원됩니다. 그러나 Samba와 커널 모듈 모두 SMB 1 프로토콜에서만 UNIX 확장을 지원합니다.

UNIX 확장을 사용하려면 다음을 수행합니다.

-

/etc/hiera/hiera.conf 파일의[global]섹션에서server min protocol매개 변수를NT1로 설정합니다. mount 명령에

-o vers=1.0옵션을 제공하여 SMB 1 프로토콜을 사용하여 공유를 마운트합니다. 예를 들면 다음과 같습니다.# mount -t cifs -o vers=1.0,username=user_name //server_name/share_name /mnt/

기본적으로 커널 모듈은 SMB 2 또는 서버에서 지원하는 가장 높은 이후의 프로토콜 버전을 사용합니다.

-o vers=1.0옵션을mount명령에 전달하면 커널 모듈에서 UNIX 확장을 사용하는 데 필요한 SMB 1 프로토콜을 사용하도록 강제 적용합니다.

UNIX 확장 기능이 활성화되어 있는지 확인하려면 마운트된 공유 옵션을 표시합니다.

# mount

...

//server/share on /mnt type cifs (...,unix,...)

마운트 옵션 목록에 unix 항목이 표시되면 UNIX 확장이 활성화됩니다.

11.3. SMB 공유 수동 마운트

SMB 공유만 임시로 마운트해야 하는 경우 마운트 유틸리티를 사용하여 수동으로 마운트할 수 있습니다.

시스템을 재부팅할 때 수동으로 마운트된 공유는 자동으로 다시 마운트되지 않습니다. Red Hat Enterprise Linux가 시스템 부팅 시 공유를 자동으로 마운트하도록 구성하려면 시스템 부팅 시 SMB 공유 마운트를 자동으로 참조하십시오.

사전 요구 사항

-

cifs-utils패키지가 설치되어 있습니다.

절차

SMB 공유를 수동으로 마운트하려면 -t cifs 매개 변수와 함께 mount 유틸리티를 사용합니다.

# mount -t cifs -o username=user_name //server_name/share_name /mnt/ Password for user_name@//server_name/share_name: password

-o 매개변수에서는 공유를 마운트하는 데 사용되는 옵션을 지정할 수 있습니다. 자세한 내용은 mount.cifs(8) 도움말 페이지 및 자주 사용되는 마운트 옵션 의 OPTIONS 섹션을 참조하십시오.

예 11.1. 암호화된 SMB 3.0 연결을 사용하여 공유 마운트

암호화된 SMB 3.0 연결을 통해 /mnt/ 디렉터리에 대해 \\server\example\ 공유를 DOMAIN\Administrator 사용자로 마운트하려면 다음을 실행합니다.

# mount -t cifs -o username=DOMAIN\Administrator,seal,vers=3.0 //server/example /mnt/ Password for DOMAIN\Administrator@//server_name/share_name: password

11.4. 시스템이 부팅될 때 SMB 공유를 자동으로 마운트

서버에 마운트된 SMB 공유에 대한 액세스가 영구적으로 필요한 경우 부팅 시 공유를 자동으로 마운트합니다.

사전 요구 사항

-

cifs-utils패키지가 설치되어 있습니다.

절차

시스템이 부팅될 때 SMB 공유를 자동으로 마운트하려면 /etc/fstab 파일에 공유에 대한 항목을 추가합니다. 예를 들면 다음과 같습니다.

//server_name/share_name /mnt cifs credentials=/root/smb.cred 0 0

시스템이 공유를 자동으로 마운트할 수 있도록 하려면 사용자 이름, 암호 및 도메인 이름을 자격 증명 파일에 저장해야 합니다. 자세한 내용은 자격 증명 파일을 사용하여 SMB 공유 인증을 참조하십시오.

/etc/fstab 에 있는 행의 네 번째 필드에서 자격 증명 파일 경로와 같은 마운트 옵션을 지정합니다. 자세한 내용은 mount.cifs(8) 도움말 페이지 및 자주 사용되는 마운트 옵션 의 OPTIONS 섹션을 참조하십시오.

공유가 성공적으로 마운트되는지 확인하려면 다음을 입력합니다.

# mount /mnt/

11.5. 자격 증명 파일을 사용하여 SMB 공유에 인증

부팅 시 공유를 자동으로 마운트하는 경우와 같은 특정 상황에서는 사용자 이름 및 암호를 입력하지 않고 공유를 마운트해야 합니다. 이를 구현하려면 자격 증명 파일을 만듭니다.

사전 요구 사항

-

cifs-utils패키지가 설치되어 있습니다.

절차

/root/subject.cred과 같은 파일을 생성하고 해당 파일의 사용자 이름, 암호 및 도메인 이름을 지정합니다.username=user_name password=password domain=domain_name

소유자만 파일에 액세스할 수 있도록 권한을 설정합니다.

# chown user_name /root/smb.cred # chmod 600 /root/smb.cred

이제 credentials=file_name 마운트 옵션을 마운트 유틸리티에 전달하거나 /etc/fstab 파일에서 사용하여 사용자 이름 및 암호를 입력하라는 메시지가 표시되지 않고 공유를 마운트할 수 있습니다.

11.6. 자주 사용되는 마운트 옵션

SMB 공유를 마운트할 때 마운트 옵션이 결정됩니다.

- 서버와의 연결이 설정되는 방법입니다. 예를 들어 서버에 연결할 때 사용되는 SMB 프로토콜 버전은 무엇입니까.

- 공유가 로컬 파일 시스템에 마운트되는 방법. 예를 들어 시스템이 원격 파일 및 디렉터리 권한을 재정의하여 여러 로컬 사용자가 서버의 콘텐츠에 액세스할 수 있도록 합니다.

/etc/fstab 파일의 네 번째 필드 또는 mount 명령의 -o 매개 변수에 여러 옵션을 설정하려면 쉼표로 구분합니다. 예를 들어, multiuser 옵션을 사용하여 공유 마운트를 참조하십시오.

다음 목록은 자주 사용되는 마운트 옵션을 제공합니다.

| 옵션 | 설명 |

|---|---|

| credentials=file_name | 자격 증명 파일의 경로를 설정합니다. 자격 증명 파일을 사용하여 SMB 공유 인증을 참조하십시오. |

| dir_mode=mode | 서버가 CIFS UNIX 확장을 지원하지 않는 경우 디렉터리 모드를 설정합니다. |

| file_mode=mode | 서버가 CIFS UNIX 확장을 지원하지 않는 경우 파일 모드를 설정합니다. |

| password=password |

SMB 서버에 인증하는 데 사용되는 암호를 설정합니다. 또는 |

| seal |

SMB 3.0 또는 이후 프로토콜 버전을 사용하여 연결에 대한 암호화 지원을 활성화합니다. 따라서 |

| sec=security_mode |

ntlmsspi .

서버가

보안상의 이유로 비보안 |

| username=user_name |

SMB 서버에 인증하는 데 사용되는 사용자 이름을 설정합니다. 또는 |

| vers=SMB_protocol_version | 서버와의 통신에 사용되는 SMB 프로토콜 버전을 설정합니다. |

전체 목록은 mount.cifs(8) 도움말 페이지의 OPTIONS 섹션을 참조하십시오.

12장. 다중 사용자 SMB 마운트 수행

공유를 마운트하기 위해 제공하는 인증 정보에는 기본적으로 마운트 지점에 대한 액세스 권한이 결정됩니다. 예를 들어 공유를 마운트할 때 DOMAIN\example 사용자를 사용하는 경우 어떤 로컬 사용자가 작업을 수행하는지 관계없이 공유의 모든 작업이 이 사용자로 실행됩니다.

그러나 특정 상황에서는 관리자가 시스템을 부팅할 때 공유를 자동으로 마운트하려고 하지만 사용자는 자신의 자격 증명을 사용하여 공유 콘텐츠에 대해 작업을 수행해야 합니다. 다중 사용자 마운트 옵션을 사용하면 이 시나리오를 구성할 수 있습니다.

다중 사용자 마운트 옵션을 사용하려면 Citadel 5 또는 자격 증명 파일이 있는 ntlmssp 옵션과 같이 비대화형 방식으로 자격 증명 제공을 지원하는 보안 유형으로도 rootfs 마운트 옵션을 추가로 설정해야 합니다. 자세한 내용은 사용자로 공유 액세스를 참조하십시오.

루트 사용자는 다중 사용자 옵션을 사용하여 공유를 마운트하고 공유 콘텐츠에 대한 최소 액세스 권한이 있는 계정을 생성합니다. 그런 다음 일반 사용자는 cifscreds 유틸리티를 사용하여 사용자 이름과 암호를 현재 세션의 커널 인증 키에 제공할 수 있습니다. 사용자가 마운트된 공유의 콘텐츠에 액세스하는 경우 커널은 공유를 마운트하는 데 처음 사용된 커널 인증 키 대신 커널 인증 키의 자격 증명을 사용합니다.

이 기능을 사용하면 다음 단계로 구성됩니다.

사전 요구 사항

-

cifs-utils패키지가 설치되어 있습니다.

12.1. 다중 사용자 옵션을 사용하여 공유 마운트

사용자가 자신의 자격 증명을 사용하여 공유에 액세스하기 전에 제한된 권한이 있는 계정을 사용하여 root 사용자로 공유를 마운트합니다.

절차

시스템이 부팅될 때 다중 사용자 옵션을 사용하여 공유를 자동으로 마운트하려면 다음을 수행합니다.

/etc/fstab파일에 공유 항목을 만듭니다. 예를 들면 다음과 같습니다.//server_name/share_name /mnt cifs