15.3. Kuryr로 OpenStack에 클러스터 설치

OpenShift Container Platform 버전 4.9에서는 Kuryr SDN을 사용하는 사용자 지정 클러스터를 RHOSP(Red Hat OpenStack Platform)에 설치할 수 있습니다. 설치를 사용자 지정하려면 클러스터를 설치하기 전에 install-config.yaml에서 매개변수를 수정합니다.

15.3.1. 사전 요구 사항

- OpenShift Container Platform 설치 및 업데이트 프로세스에 대한 세부 사항을 검토합니다.

- 클러스터 설치 방법 선택 및 사용자를 위한 준비에 대한 문서를 읽습니다.

- OpenShift Container Platform 4.9가 OpenShift 클러스터에 지원되는 플랫폼 섹션을 사용하여 현재 RHOSP 버전과 호환되는지 확인했습니다. RHOSP 지원 매트릭스의 OpenShift Container Platform을 확인하여 여러 버전의 플랫폼 지원을 비교할 수도 있습니다.

- RHOSP에 블록 스토리지(Cinder) 또는 개체 스토리지(Swift)와 같은 스토리지 서비스가 설치되어 있어야 합니다. 개체 스토리지는 OpenShift Container Platform 레지스트리 클러스터 배포에 권장되는 스토리지 기술입니다. 자세한 정보는 스토리지 최적화를 참조하십시오.

15.3.2. Kuryr SDN 정보

Kuryr 는 Neutron 및 Octavia RHOSP(Red Hat OpenStack Platform) 서비스를 사용하여 Pod 및 서비스에 네트워킹을 제공하는 컨테이너 네트워크 인터페이스(CNI) 플러그인 솔루션입니다.

Kuryr와 OpenShift Container Platform 통합은 주로 RHOSP VM에서 실행되는 OpenShift Container Platform 클러스터를 위해 설계되었습니다. Kuryr는 OpenShift Container Platform Pod를 RHOSP SDN에 연결하여 네트워크 성능을 향상시킵니다. 또한 Pod와 RHOSP 가상 인스턴스 간의 상호 연결성을 제공합니다.

Kuryr 구성 요소는 openshift-kuryr 네임스페이스를 사용하여 OpenShift Container Platform에서 Pod로 설치됩니다.

-

kuryr-controller--master노드에 설치된 단일 서비스 인스턴스로, OpenShift Container Platform에서Deployment개체로 모델링됩니다. -

kuryr- cni- 각 OpenShift Container Platform 노드에서 Kuryr를 CNI 드라이버로 설치 및 구성하는 컨테이너로, OpenShift Container Platform에서DaemonSet개체로 모델링됩니다.

Kuryr 컨트롤러는 OpenShift Container Platform API 서버에서 Pod, 서비스 및 네임스페이스 생성, 업데이트 및 삭제 이벤트를 감시합니다. OpenShift Container Platform API 호출을 Neutron 및 Octavia의 해당 개체에 매핑합니다. 즉 Neutron 트렁크 포트 기능을 구현하는 모든 네트워크 솔루션을 사용하여 Kuryr를 통해 OpenShift Container Platform을 지원할 수 있습니다. 여기에는 OVS(Open vSwitch), OVN(Open Virtual Network)과 같은 오픈 소스 솔루션과 Neutron 호환 상용 SDN이 포함됩니다.

Kuryr는 캡슐화된 RHOSP 테넌트 네트워크에서의 OpenShift Container Platform 배포에 권장되며 RHOSP 네트워크를 통해 캡슐화된 OpenShift Container Platform SDN을 실행하는 경우와 같은 이중 캡슐화를 피할 수 있습니다.

공급자 네트워크 또는 테넌트 VLAN을 사용하는 경우에는 이중 캡슐화를 피하기 위해 Kuryr를 사용하지 않아도 됩니다. 성능상의 이점은 무시할만한 수준입니다. 그러나 구성에 따라 두 개의 오버레이가 없도록 Kuryr을 사용하는 방법이 계속 유용할 수 있습니다.

다음 기준이 모두 해당되는 배포에는 Kuryr가 권장되지 않습니다.

- RHOSP 버전이 16 미만입니다.

- 배포 시 UDP 서비스 또는 소수의 하이퍼바이저에서 많은 수의 TCP 서비스를 사용합니다.

또는

-

ovn-octaviaOctavia 드라이버가 비활성화되었습니다. - 배포 시 소수의 하이퍼바이저에서 많은 수의 TCP 서비스를 사용합니다.

15.3.3. Kuryr를 사용하는 RHOSP에 OpenShift Container Platform을 설치하기 위한 리소스 지침

Kuryr SDN을 사용하는 경우 Pod, 서비스, 네임스페이스, 네트워크 정책은 RHOSP 할당량의 리소스를 사용하며 이로 인해 최소 요구사항이 증가합니다. Kuryr는 또한 기본 설치에 필요한 요구사항 이외에 몇 가지 추가 요구사항을 갖습니다.

기본 클러스터의 최소 요구사항을 충족할 수 있는 할당량은 다음과 같습니다.

표 15.7. Kuryr를 사용하는 RHOSP의 기본 OpenShift Container Platform 클러스터에 권장되는 리소스

| 리소스 이름 | 값 |

|---|---|

| 부동 IP 주소 | 3 - LoadBalancer 유형의 예상 서비스 수 추가 |

| 포트 | 1500 - Pod당 1개 필요 |

| 라우터 | 1 |

| 서브넷 | 250 - 네임스페이스/프로젝트당 1개 필요 |

| 네트워크 | 250 - 네임스페이스/프로젝트당 1개 필요 |

| RAM | 112GB |

| vCPU | 28 |

| 볼륨 스토리지 | 275GB |

| 인스턴스 | 7 |

| 보안 그룹 | 250 - 서비스/NetworkPolicy당 1개 필요 |

| 보안 그룹 규칙 | 1000 |

| 로드 밸런서 | 100 - 서비스당 1개 필요 |

| 로드 밸런서 리스너 | 500 - 서비스 노출 포트당 1개 필요 |

| 로드 밸런서 풀 | 500 - 서비스 노출 포트당 1개 필요 |

권장 리소스보다 적은 리소스로도 클러스터가 작동할 수 있지만 성능은 보장되지 않습니다.

swiftoperator 역할을 가진 사용자 계정으로 RHOSP 개체 스토리지(Swift)를 사용하고 운영하는 경우 OpenShift Container Platform 이미지 레지스트리의 기본 백엔드로 사용됩니다. 이 경우 볼륨 스토리지 요구사항은 175GB입니다. Swift 공간 요구사항은 이미지 레지스트리의 크기에 따라 다릅니다.

OVN Octavia 드라이버가 아닌 Amphora 드라이버와 함께 RHOSP(Red Hat OpenStack Platform) 버전 16을 사용하는 경우 보안 그룹은 사용자 프로젝트 대신 서비스 계정과 연결됩니다.

리소스를 설정할 때 다음 사항을 고려하십시오.

- 필요한 포트 수가 Pod 수보다 많습니다. Kuryr는 포트 풀을 사용하여 Pod가 미리 생성된 포트를 사용할 수 있도록 준비하여 Pod의 부팅 시간을 단축시킵니다.

-

각 NetworkPolicy는 RHOSP 보안 그룹에 매핑되며

NetworkPolicy사양에 따라 하나 이상의 규칙이 보안 그룹에 추가됩니다. 각 서비스는 RHOSP 로드 밸런서에 매핑됩니다. 할당량에 필요한 보안 그룹 수를 추정할 때 이 요구사항을 고려하십시오.

RHOSP 버전 15 이하 또는

ovn-octavia driver를 사용하는 경우 각 로드 밸런서에 사용자 프로젝트와 보안 그룹이 있습니다.할당량은 로드 밸런서 리소스(예: VM 리소스)를 고려하지 않지만 RHOSP 배포 크기를 결정할 때 이러한 리소스를 고려해야 합니다. 기본 설치에는 50개 이상의 로드 밸런서가 있으며 클러스터가 이 로드 밸런서를 수용할 수 있어야 합니다.

OVN Octavia 드라이버가 활성화된 상태에서 RHOSP 버전 16을 사용하는 경우에는 로드 밸런서 VM이 하나만 생성됩니다. 서비스는 OVN 흐름을 통해 부하를 분산시킵니다.

OpenShift Container Platform 배포는 컨트롤 플레인 시스템, 컴퓨팅 시스템, 부트스트랩 시스템으로 구성됩니다.

Kuryr SDN을 활성화하려면 환경이 다음 요구사항을 충족해야 합니다.

- RHOSP 13+를 실행합니다.

- Octavia와 함께 Overcloud가 설치되어 있습니다.

- Neutron 트렁크 포트 확장을 사용합니다.

-

ovs-hybrid대신 ML2/OVS Neutron 드라이버를 사용하는 경우openvswitch를 사용합니다.

15.3.3.1. 할당량 늘리기

Kuryr SDN을 사용하는 경우 Pod, 서비스, 네임스페이스 및 네트워크 정책에서 사용하는 RHOSP(Red Hat OpenStack Platform) 리소스를 충족하기 위해 할당량을 늘려야 합니다.

프로세스

다음 명령을 실행하여 프로젝트 할당량을 늘립니다.

$ sudo openstack quota set --secgroups 250 --secgroup-rules 1000 --ports 1500 --subnets 250 --networks 250 <project>

15.3.3.2. Neutron 구성

Kuryr CNI는 Neutron 트렁크 확장을 활용하여 컨테이너를 RHOSP(Red Hat OpenStack Platform) SDN에 연결하므로 Kuryr이 제대로 작동하려면 trunks 확장을 사용해야 합니다.

또한 기본 ML2/OVS Neutron 드라이버를 활용하는 경우 보안 그룹이 트렁크 서브포트에서 적용되고 Kuryr가 네트워크 정책을 올바르게 처리할 수 있도록 방화벽이 ovs_hybrid 대신 openvswitch로 설정되어야 합니다.

15.3.3.3. Octavia 구성

Kuryr SDN은 RHOSP(Red Hat OpenStack Platform)의 Octavia LBaaS를 사용하여 OpenShift Container Platform 서비스를 구현합니다. 따라서 Kuryr SDN을 사용하려면 RHOSP에서 Octavia 구성 요소를 설치하고 구성해야 합니다.

Octavia를 활성화하려면 RHOSP Overcloud 설치 중에 Octavia 서비스를 포함하거나 Overcloud가 이미 존재하는 경우 Octavia 서비스를 업그레이드해야 합니다. Octavia를 활성화하는 다음 단계는 Overcloud 새로 설치 또는 Overcloud 업데이트에 모두 적용됩니다.

프로세스

로컬 레지스트리를 사용하는 경우 이미지를 레지스트리에 업로드하는 템플릿을 만듭니다. 예를 들면 다음과 같습니다.

(undercloud) $ openstack overcloud container image prepare \ -e /usr/share/openstack-tripleo-heat-templates/environments/services-docker/octavia.yaml \ --namespace=registry.access.redhat.com/rhosp13 \ --push-destination=<local-ip-from-undercloud.conf>:8787 \ --prefix=openstack- \ --tag-from-label {version}-{product-version} \ --output-env-file=/home/stack/templates/overcloud_images.yaml \ --output-images-file /home/stack/local_registry_images.yamllocal_registry_images.yaml파일에 Octavia 이미지가 포함되어 있는지 확인합니다. 예를 들면 다음과 같습니다.... - imagename: registry.access.redhat.com/rhosp13/openstack-octavia-api:13.0-43 push_destination: <local-ip-from-undercloud.conf>:8787 - imagename: registry.access.redhat.com/rhosp13/openstack-octavia-health-manager:13.0-45 push_destination: <local-ip-from-undercloud.conf>:8787 - imagename: registry.access.redhat.com/rhosp13/openstack-octavia-housekeeping:13.0-45 push_destination: <local-ip-from-undercloud.conf>:8787 - imagename: registry.access.redhat.com/rhosp13/openstack-octavia-worker:13.0-44 push_destination: <local-ip-from-undercloud.conf>:8787

참고Octavia 컨테이너 버전은 설치된 특정 RHOSP 릴리스에 따라 다릅니다.

registry.redhat.io에서 Undercloud 노드로 컨테이너 이미지를 가져옵니다.(undercloud) $ sudo openstack overcloud container image upload \ --config-file /home/stack/local_registry_images.yaml \ --verbose

네트워크 및 Undercloud 디스크의 속도에 따라 다소 시간이 걸릴 수 있습니다.

Octavia 로드 밸런서는 OpenShift Container Platform API에 액세스하는 데 사용되므로 연결에 대한 리스너의 기본 제한 시간을 늘려야 합니다. 기본 제한 시간은 50초입니다. 다음 파일을 Overcloud 배포 명령에 전달하여 제한 시간을 20분으로 늘립니다.

(undercloud) $ cat octavia_timeouts.yaml parameter_defaults: OctaviaTimeoutClientData: 1200000 OctaviaTimeoutMemberData: 1200000

참고RHOSP 13.0.13+에는 필요하지 않습니다.

Octavia로 Overcloud 환경을 설치 또는 업데이트합니다.

$ openstack overcloud deploy --templates \ -e /usr/share/openstack-tripleo-heat-templates/environments/services-docker/octavia.yaml \ -e octavia_timeouts.yaml

참고이 명령에는 Octavia와 관련된 파일만 포함됩니다. 해당 파일은 RHOSP의 특정 설치에 따라 다릅니다. 자세한 내용은 RHOSP 문서를 참조하십시오. Octavia 설치 사용자 지정에 대한 자세한 내용은 Director를 사용하여 Octavia 설치를 참조하십시오.

참고Kuryr SDN을 활용하는 경우 Overcloud 설치에는 Neutron

trunk확장이 필요합니다. 이 확장은 기본적으로 디렉터 배포에서 사용할 수 있습니다. Neutron 백엔드가 ML2/OVS인 경우 기본ovs-hybrid대신openvswitch방화벽을 사용합니다. 백엔드가 ML2/OVN인 경우에는 수정하지 않아도 됩니다.RHOSP 13.0.13 이전 버전에서 프로젝트를 생성한 후 프로젝트 ID를

octavia.conf구성 파일에 추가합니다.트래픽이 Octavia 로드 밸런서를 통과할 때와 같이 서비스 전체에 네트워크 정책을 적용하려면 Octavia가 사용자 프로젝트에서 Amphora VM 보안 그룹을 생성해야 합니다.

이 변경으로 인해 필요한 로드 밸런서 보안 그룹이 해당 프로젝트에 속하게 되며 서비스 격리를 적용하도록 업데이트될 수 있습니다.

참고RHOSP 13.0.13 버전 이상에서는 이 작업이 필요하지 않습니다.

Octavia는 로드 밸런서 VIP에 대한 액세스를 제한하는 새로운 ACL API를 구현합니다.

프로젝트 ID 가져오기

$ openstack project show <project>

출력 예

+-------------+----------------------------------+ | Field | Value | +-------------+----------------------------------+ | description | | | domain_id | default | | enabled | True | | id | PROJECT_ID | | is_domain | False | | name | *<project>* | | parent_id | default | | tags | [] | +-------------+----------------------------------+

컨트롤러의

octavia.conf에 프로젝트 ID를 추가합니다.stackrc파일을 소싱합니다.$ source stackrc # Undercloud credentials

Overcloud 컨트롤러를 나열합니다.

$ openstack server list

출력 예

+--------------------------------------+--------------+--------+-----------------------+----------------+------------+ │ | ID | Name | Status | Networks | Image | Flavor | │ +--------------------------------------+--------------+--------+-----------------------+----------------+------------+ │ | 6bef8e73-2ba5-4860-a0b1-3937f8ca7e01 | controller-0 | ACTIVE | ctlplane=192.168.24.8 | overcloud-full | controller | │ | dda3173a-ab26-47f8-a2dc-8473b4a67ab9 | compute-0 | ACTIVE | ctlplane=192.168.24.6 | overcloud-full | compute | │ +--------------------------------------+--------------+--------+-----------------------+----------------+------------+

컨트롤러에 SSH를 적용합니다.

$ ssh heat-admin@192.168.24.8

octavia.conf파일을 편집하여 Amphora 보안 그룹이 사용자 계정에 있는 프로젝트 목록에 프로젝트를 추가합니다.# List of project IDs that are allowed to have Load balancer security groups # belonging to them. amp_secgroup_allowed_projects = PROJECT_ID

Octavia 작업자를 다시 시작하여 새 구성을 로드합니다.

controller-0$ sudo docker restart octavia_worker

RHOSP 환경에 따라 Octavia가 UDP 리스너를 지원하지 않을 수 있습니다. RHOSP 버전 13.0.13 이하에서 Kuryr SDN을 사용하는 경우에는 UDP 서비스가 지원되지 않습니다. RHOSP 버전 16 이상은 UDP를 지원합니다.

15.3.3.3.1. Octavia OVN 드라이버

Octavia는 Octavia API를 통해 여러 공급자 드라이버를 지원합니다.

사용 가능한 모든 Octavia 공급자 드라이버를 보려면 명령줄에서 다음을 입력합니다.

$ openstack loadbalancer provider list

출력 예

+---------+-------------------------------------------------+ | name | description | +---------+-------------------------------------------------+ | amphora | The Octavia Amphora driver. | | octavia | Deprecated alias of the Octavia Amphora driver. | | ovn | Octavia OVN driver. | +---------+-------------------------------------------------+

RHOSP 버전 16부터 Octavia OVN 공급자 드라이버(ovn)는 RHOSP 배포의 OpenShift Container Platform에서 지원됩니다.

ovn은 Octavia와 OVN이 제공하는 로드 밸런싱을 위한 통합 드라이버입니다. 기본 로드 밸런싱 기능을 지원하며 OpenFlow 규칙을 기반으로 합니다. 이 드라이버는 OVN Neutron ML2를 사용하는 배포에서 Director에 의해 Octavia에서 자동으로 활성화됩니다.

기본 드라이버는 Amphora 공급자 드라이버입니다. 그러나 ovn이 활성화되면 Kuryr는 ovn을 사용합니다.

Kuryr가 Amphora 대신 ovn을 사용하는 경우 다음과 같은 이점을 제공합니다.

- 리소스 요구사항 감소. Kuryr는 각 서비스마다 로드 밸런서 VM이 필요하지 않습니다.

- 네트워크 대기 시간 감소.

- 각 서비스마다 VM 대신 OpenFlow 규칙을 사용하므로 서비스 생성 속도가 향상됩니다.

- 로드 밸런싱 작업이 Amphora VM에 집중되지 않고 모든 노드에 분산됩니다.

RHOSP 클라우드가 버전 13에서 버전 16으로 업그레이드된 후 Octavia OVN 드라이버를 사용하도록 클러스터를 구성할 수 있습니다.

15.3.3.4. Kuryr를 사용한 설치의 알려진 제한 사항

Kuryr SDN과 함께 OpenShift Container Platform을 사용하는 경우 몇 가지 알려진 제한 사항이 있습니다.

RHOSP 일반 제한 사항

Kuryr SDN을 사용하는 OpenShift Container Platform 사용에는 모든 버전 및 환경에 적용되는 몇 가지 제한 사항이 있습니다.

-

NodePort유형의Service개체는 지원되지 않습니다. -

OVN Octavia 공급자 드라이버를 사용하는 클러스터는

끝점개체의.spec.selector속성에 노드 또는 포드의 서브넷이 포함된 경우에만.subsets.addresses속성이 지정되지 않은Service개체를 지원합니다. -

시스템이 생성된 서브넷이 라우터에 연결되어 있지 않거나 서브넷이 연결되어 있지만 라우터에 외부 게이트웨이가 설정되지 않은 경우 Kuryr는

LoadBalancer인Service개체에 대한 유동 IP를 생성할 수 없습니다. -

Service오브젝트에sessionAffinity=ClientIP속성을 구성해도 효과가 없습니다. Kuryr는 이 설정을 지원하지 않습니다.

RHOSP 버전 제한 사항

Kuryr SDN을 사용하는 OpenShift Container Platform은 RHOSP 버전에 따라 몇 가지 제한 사항이 있습니다.

버전 16 미만의 RHOSP는 기본 Octavia로드 밸런서 드라이버(Amphora)를 사용합니다. 이 드라이버를 사용하려면 OpenShift Container Platform 서비스당 하나의 Amphora 로드 밸런서 VM이 배포되어야 합니다. 너무 많은 서비스를 생성하면 리소스가 부족해질 수 있습니다.

OVN Octavia 드라이버가 비활성화된 상위 버전의 RHOSP 배포에도 Amphora 드라이버를 사용합니다. 하위 버전의 RHOSP와 동일한 리소스 문제가 있습니다.

- 버전 13.0.13 미만의 Octavia RHOSP는 UDP 리스너를 지원하지 않습니다. 따라서 OpenShift Container Platform UDP 서비스는 지원되지 않습니다.

- 버전 13.0.13 미만의 Octavia RHOSP는 동일한 포트에서 여러 프로토콜을 수신할 수 없습니다. TCP, UDP 등 다른 프로토콜에 동일한 포트를 노출하는 서비스는 지원되지 않습니다.

- Kuryr SDN은 서비스에서 자동 유휴 상태 해제를 지원하지 않습니다.

RHOSP 환경 제한 사항

배포 환경에 따라 Kuryr SDN 사용에 제한이 있습니다.

Octavia는 UDP 프로토콜과 다중 리스너를 지원하지 않으므로 RHOSP 버전이 13.0.13 미만이면 Kuryr에 따라 Pod가 DNS 확인을 위해 TCP를 사용해야 합니다.

Go 버전 1.12 이하에서는 CGO 지원이 비활성화된 상태로 컴파일된 애플리케이션이 UDP만 사용합니다. 이 경우 기본 Go 해결 프로그램이 resolv.conf의 use-vc 옵션을 인식하지 못합니다. 이 옵션은 DNS 확인을 위해 TCP가 적용되는지 여부를 제어합니다. 결과적으로 DNS 확인에 계속 UDP를 사용하여 실패하게 됩니다.

TCP 적용을 허용하려면 환경 변수 CGO_ENABLED를 1로 설정하거나(즉 CGO_ENABLED=1) 변수가 없는지 확인하여 애플리케이션을 컴파일합니다.

Go 버전 1.13 이상에서는 UDP를 사용한 DNS 확인이 실패하면 자동으로 TCP를 사용합니다.

Alpine 기반 컨테이너를 포함한 musl 기반 컨테이너는 use-vc 옵션을 지원하지 않습니다.

RHOSP 업그레이드 제한 사항

RHOSP 업그레이드 프로세스에 따라 Octavia API가 변경될 수 있으며 로드 밸런서에 사용되는 Amphora 이미지로 업그레이드해야 할 수 있습니다.

API 변경은 개별적으로 처리할 수 있습니다.

Amphora 이미지가 업그레이드되면 RHOSP Operator가 다음 두 가지 방법으로 기존 로드 밸런서 VM을 처리할 수 있습니다.

- 로드 밸런서 장애 조치를 트리거하여 각 VM을 업그레이드합니다.

- VM 업그레이드를 사용자가 처리하게 합니다.

Operator가 첫 번째 옵션을 선택하는 경우 장애 조치 중에 가동 중지 시간이 짧아질 수 있습니다.

Operator가 두 번째 옵션을 선택하는 경우 기존 로드 밸런서는 UDP 리스너와 같은 업그레이드된 Octavia API 기능을 지원하지 않습니다. 이 경우 이러한 기능을 사용하려면 사용자가 서비스를 다시 만들어야 합니다.

OpenShift Container Platform이 UDP 로드 밸런싱을 지원하는 새로운 Octavia 버전을 감지하면 DNS 서비스를 자동으로 다시 생성합니다. 서비스를 다시 생성함으로써 서비스는 기본적으로 UDP 로드 밸런싱을 지원하게 됩니다.

서비스를 다시 생성하는 경우 DNS 서비스 가동이 약 1분 동안 중지됩니다.

15.3.3.5. 컨트롤 플레인 머신

기본적으로 OpenShift Container Platform 설치 프로세스는 세 개의 컨트롤 플레인 시스템을 생성합니다.

각 시스템의 요구사항은 다음과 같습니다.

- RHOSP 할당량의 인스턴스

- RHOSP 할당량의 포트

- 최소 16GB 메모리 및 vCPU 4개가 있는 플레이버

- RHOSP 할당량에서 최소 100GB 스토리지 공간

15.3.3.6. 컴퓨팅 머신

기본적으로 OpenShift Container Platform 설치 프로세스는 세 개의 컴퓨팅 시스템을 생성합니다.

각 시스템의 요구사항은 다음과 같습니다.

- RHOSP 할당량의 인스턴스

- RHOSP 할당량의 포트

- 8GB 메모리 및 vCPU 2개 이상 있는 플레이버

- RHOSP 할당량에서 최소 100GB 스토리지 공간

컴퓨팅 시스템은 OpenShift Container Platform에서 실행하는 애플리케이션을 호스팅합니다. 최대한 많이 실행하는 것이 좋습니다.

15.3.3.7. 부트스트랩 시스템

설치하는 동안 컨트롤 플레인을 유지하기 위해 부트스트랩 시스템이 임시로 프로비저닝됩니다. 프로덕션 컨트롤 플레인이 준비되면 부트스트랩 시스템이 프로비저닝 해제됩니다.

부트스트랩 시스템의 요구사항은 다음과 같습니다.

- RHOSP 할당량의 인스턴스

- RHOSP 할당량의 포트

- 최소 16GB 메모리 및 vCPU 4개가 있는 플레이버

- RHOSP 할당량에서 최소 100GB 스토리지 공간

15.3.4. OpenShift Container Platform 용 인터넷 액세스

OpenShift Container Platform 4.9에서 클러스터를 설치하려면 인터넷 액세스가 필요합니다.

다음의 경우 인터넷 액세스가 필요합니다.

- OpenShift Cluster Manager 에 액세스하여 설치 프로그램을 다운로드하고 서브스크립션 관리를 수행합니다. 클러스터가 인터넷에 액세스할 수 있고 Telemetry 서비스를 비활성화하지 않은 경우, 클러스터에 자동으로 권한이 부여됩니다.

- Quay.io에 액세스. 클러스터를 설치하는 데 필요한 패키지를 받을 수 있습니다.

- 클러스터 업데이트를 수행하는 데 필요한 패키지를 받을 수 있습니다.

클러스터가 직접 인터넷에 액세스할 수 없는 경우, 프로비저닝하는 일부 유형의 인프라에서 제한된 네트워크 설치를 수행할 수 있습니다. 이 프로세스 동안 필요한 콘텐츠를 다운로드하고 이를 사용하여 설치 패키지로 미러 레지스트리를 채웁니다. 설치 유형에 따라서는 클러스터를 설치하는 환경에 인터넷 액세스가 필요하지 않을 수도 있습니다. 클러스터를 업데이트하기 전에 미러 레지스트리의 내용을 업데이트합니다.

15.3.5. RHOSP에서 Swift 활성화

Swift는 swiftoperator 역할을 가진 사용자 계정으로 운영됩니다. 설치 프로그램을 실행하려면 먼저 계정에 이 역할을 추가합니다.

RHOSP(Red Hat OpenStack Platform) 개체 스토리지 서비스(일반적으로 Swift로 알려짐)를 사용할 수 있는 경우 OpenShift Container Platform이 이미지 레지스트리 스토리지로 사용합니다. 이 서비스를 사용할 수 없는 경우에는 설치 프로그램이 RHOSP 블록 스토리지 서비스(일반적으로 Cinder로 알려짐)를 사용합니다.

Swift가 있고 Swift를 사용하려면 액세스를 활성화해야 합니다. 존재하지 않거나 사용하지 않으려면 이 섹션을 건너 뛰십시오.

사전 요구 사항

- 대상 환경에 RHOSP 관리자 계정이 있습니다.

- Swift 서비스가 설치되어 있습니다.

-

Ceph RGW에서

url의 계정옵션이 활성화되어 있습니다.

프로세스

RHOSP에서 Swift를 활성화하려면:

RHOSP CLI의 관리자로서 Swift에 액세스할 계정에

swiftoperator역할을 추가하십시오.$ openstack role add --user <user> --project <project> swiftoperator

이제 RHOSP 배포에서 이미지 레지스트리에 Swift를 사용할 수 있습니다.

15.3.6. 외부 네트워크 액세스 확인

OpenShift Container Platform 설치 프로세스에는 외부 네트워크에 액세스해야 합니다. 외부 네트워크값을 제공해야 하며 그렇지 않으면 배포가 실패합니다. 프로세스를 시작하기 전에 외부 라우터 유형의 네트워크가 RHOSP(Red Hat OpenStack Platform)에 있는지 확인합니다.

프로세스

RHOSP CLI를 사용하여 '외부' 네트워크의 이름과 ID를 확인합니다.

$ openstack network list --long -c ID -c Name -c "Router Type"

출력 예

+--------------------------------------+----------------+-------------+ | ID | Name | Router Type | +--------------------------------------+----------------+-------------+ | 148a8023-62a7-4672-b018-003462f8d7dc | public_network | External | +--------------------------------------+----------------+-------------+

외부 라우터 유형의 네트워크가 네트워크 목록에 나타납니다. 네트워크가 하나 이상 나타나지 않으면 기본 부동 IP 네트워크 생성 및 기본 공급자 네트워크 생성을 참조하십시오.

외부 네트워크의 CIDR 범위가 기본 네트워크 범위 중 하나와 겹치는 경우 설치 프로세스를 시작하기 전에 install-config.yaml 파일에서 일치하는 네트워크 범위를 변경해야 합니다.

기본 네트워크 범위는 다음과 같습니다.

| 네트워크 | 범위 |

|---|---|

|

| 10.0.0.0/16 |

|

| 172.30.0.0/16 |

|

| 10.128.0.0/14 |

설치 프로그램이 이름이 같은 여러 네트워크를 발견하면 그 중 하나를 무작위로 설정합니다. 이 동작을 방지하려면 RHOSP에서 리소스의 고유한 이름을 만듭니다.

Neutron 트렁크 서비스 플러그인이 활성화된 경우 기본적으로 트렁크 포트가 생성됩니다. 자세한 내용은 Neutron 트렁크 포트를 참조하십시오.

15.3.7. 설치 프로그램에 대한 매개변수 정의

OpenShift Container Platform 설치 프로그램은 clouds.yaml 파일을 사용합니다. 이 파일은 프로젝트 이름, 로그인 정보, 인증 서비스 URL 등 RHOSP(Red Hat OpenStack Platform) 구성 매개변수를 설명합니다.

프로세스

clouds.yaml파일을 만듭니다.RHOSP 배포에 Horizon 웹 UI가 포함되어 있으면 그 안에

clouds.yaml파일을 만듭니다.중요auth필드에 암호를 추가해야 합니다.clouds.yaml과 별도의 파일에 비밀을 저장할 수도 있습니다.RHOSP 배포에 Horizon 웹 UI가 포함되어 있지 않거나 Horizon을 사용하지 않으려면 파일을 직접 만듭니다.

clouds.yaml에 대한 자세한 내용은 RHOSP 문서의 구성 파일을 참조하십시오.clouds: shiftstack: auth: auth_url: http://10.10.14.42:5000/v3 project_name: shiftstack username: shiftstack_user password: XXX user_domain_name: Default project_domain_name: Default dev-env: region_name: RegionOne auth: username: 'devuser' password: XXX project_name: 'devonly' auth_url: 'https://10.10.14.22:5001/v2.0'

RHOSP 설치에서 끝점 인증을 위해 자체 서명된 CA(인증 기관) 인증서를 사용하는 경우:

- 인증 기관 파일을 시스템에 복사합니다.

cacerts키를clouds.yaml파일에 추가합니다. 값은 CA 인증서에 대한 루트가 아닌 액세스 가능한 절대 경로여야 합니다.clouds: shiftstack: ... cacert: "/etc/pki/ca-trust/source/anchors/ca.crt.pem"작은 정보사용자 지정 CA 인증서로 설치 관리자를 실행한 후

cloud-provider-config키맵에서ca-cert.pem키의 값을 편집하여 인증서를 업데이트할 수 있습니다. 명령줄에서 다음을 실행합니다.$ oc edit configmap -n openshift-config cloud-provider-config

clouds.yaml파일을 다음 위치 중 하나에 배치합니다.-

OS_CLIENT_CONFIG_FILE환경 변수의 값 - 현재 디렉터리

-

Unix 전용 사용자 구성 디렉터리(예:

~/.config/openstack/clouds.yaml) Unix 전용 사이트 구성 디렉터리(예:

/etc/openstack/clouds.yaml)설치 프로그램은

clouds.yaml을 이 순서대로 검색합니다.

-

15.3.8. 클라우드 공급자 옵션 설정

선택적으로 클러스터의 클라우드 공급자 구성을 편집할 수 있습니다. 클라우드 공급자 구성은 OpenShift Container Platform이 RHOSP(Red Hat OpenStack Platform)와 상호 작용하는 방법을 제어합니다.

클라우드 공급자 구성 매개변수의 전체 목록은 "OpenStack 클라우드 구성 참조 가이드" 페이지의 "OpenStack 클라우드 구성 참조 가이드" 페이지를 참조하십시오.

프로세스

클러스터에 대해 이미 생성된 매니페스트 파일이 없는 경우 다음 명령을 실행하여 생성합니다.

$ openshift-install --dir <destination_directory> create manifests

텍스트 편집기에서 cloud-provider 구성 매니페스트 파일을 엽니다. 예를 들면 다음과 같습니다.

$ vi openshift/manifests/cloud-provider-config.yaml

클라우드 구성 사양에 따라 옵션을 수정합니다.

로드 밸런싱을 위해 Octavia를 구성하는 것은 Kuryr를 사용하지 않는 클러스터의 일반적인 사례입니다. 예를 들면 다음과 같습니다.

#... [LoadBalancer] use-octavia=true 1 lb-provider = "amphora" 2 floating-network-id="d3deb660-4190-40a3-91f1-37326fe6ec4a"3 #...

중요변경 사항을 저장하기 전에 파일이 올바르게 구성되었는지 확인합니다. 속성을 적절한 섹션에 배치하지 않으면 클러스터가 실패할 수 있습니다.

중요Kuryr를 사용하는 설치의 경우 Kuryr는 관련 서비스를 처리합니다. 클라우드 공급자에서 Octavia 로드 밸런싱을 구성할 필요가 없습니다.

변경 사항을 파일에 저장하고 설치를 진행합니다.

작은 정보설치 프로그램을 실행한 후 클라우드 공급자 구성을 업데이트할 수 있습니다. 명령줄에서 다음을 실행합니다.

$ oc edit configmap -n openshift-config cloud-provider-config

변경 사항을 저장한 후 클러스터를 재구성하는 데 다소 시간이 걸립니다. 노드가

SchedulingDisabled상태가 없는 경우 프로세스가 완료됩니다.

추가 리소스

- 클라우드 공급자 구성에 대한 자세한 내용은 OpenStack 클라우드 공급자 옵션을 참조하십시오.

15.3.9. 설치 프로그램 받기

OpenShift Container Platform을 설치하기 전에 로컬 컴퓨터에 설치 파일을 다운로드합니다.

사전 요구 사항

- 500MB의 로컬 디스크 공간이 있는 Linux 또는 macOS를 실행하는 컴퓨터가 있습니다.

프로세스

- OpenShift Cluster Manager 사이트의 인프라 공급자 페이지에 액세스합니다. Red Hat 계정이 있으면 사용자 자격 증명으로 로그인합니다. 계정이 없으면 계정을 만드십시오.

- 인프라 공급자를 선택합니다.

설치 유형 페이지로 이동한 다음, 운영 체제에 맞는 설치 프로그램을 다운로드하여 설치 구성 파일을 저장할 디렉터리에 파일을 저장합니다.

중요설치 프로그램은 클러스터를 설치하는 데 사용하는 컴퓨터에 여러 파일을 만듭니다. 클러스터 설치를 마친 후 설치 프로그램과 설치 프로그램으로 생성되는 파일을 보관해야 합니다. 클러스터를 삭제하려면 두 파일이 모두 필요합니다.

중요클러스터 설치에 실패하거나 설치 프로그램으로 만든 파일을 삭제해도 클러스터는 제거되지 않습니다. 클러스터를 제거하려면 해당 클라우드 공급자에 적용되는 OpenShift Container Platform 설치 제거 절차를 완료해야 합니다.

설치 프로그램 파일의 압축을 풉니다. 예를 들어 Linux 운영 체제를 사용하는 컴퓨터에서 다음 명령을 실행합니다.

$ tar -xvf openshift-install-linux.tar.gz

- Red Hat OpenShift Cluster Manager에서 설치 풀 시크릿 을 다운로드합니다. 이 풀 시크릿을 사용하면 OpenShift Container Platform 구성 요소에 대한 컨테이너 이미지를 제공하는 Quay.io를 포함하여 인증 기관에서 제공하는 서비스로 인증할 수 있습니다.

15.3.10. 설치 구성 파일 만들기

RHOSP(Red Hat OpenStack Platform)에 설치하는 OpenShift Container Platform 클러스터를 사용자 지정할 수 있습니다.

사전 요구 사항

- OpenShift Container Platform 설치 프로그램과 클러스터의 풀 시크릿을 받습니다.

- 서브스크립션 수준에서 서비스 주체 권한을 획득합니다.

프로세스

install-config.yaml파일을 생성합니다.설치 프로그램이 포함된 디렉터리로 변경하고 다음 명령을 실행합니다.

$ ./openshift-install create install-config --dir <installation_directory> 1- 1

<installation_directory>는 설치 프로그램이 생성하는 파일을 저장할 디렉터리 이름을 지정합니다.

중요비어 있는 디렉터리를 지정합니다. 부트스트랩 X.509 인증서와 같은 일부 설치 자산은 단기간에 만료되므로 설치 디렉터리를 재사용해서는 안 됩니다. 다른 클러스터 설치의 개별 파일을 재사용하려면 해당 파일을 사용자 디렉터리에 복사하면 됩니다. 그러나 설치 자산의 파일 이름은 릴리스간에 변경될 수 있습니다. 따라서 이전 OpenShift Container Platform 버전에서 설치 파일을 복사할 때는 주의하십시오.

화면에 나타나는 지시에 따라 클라우드에 대한 구성 세부 사항을 입력합니다.

선택사항: 클러스터 시스템에 액세스하는 데 사용할 SSH 키를 선택합니다.

참고설치 디버깅 또는 재해 복구 수행을 원하는 프로덕션 환경 OpenShift Container Platform 클러스터의 경우

ssh-agent프로세스에 사용할 SSH 키를 지정하십시오.- 대상 플랫폼으로 openstack을 선택합니다.

- 클러스터 설치에 사용할 RHOSP(Red Hat OpenStack Platform) 외부 네트워크 이름을 지정합니다.

- OpenShift API에 대한 외부 액세스에 사용할 부동 IP 주소를 지정합니다.

- 컨트롤 플레인 노드에 사용할 최소 16GB의 RAM과 컴퓨팅 노드에 8GB RAM이 있는 RHOSP 플레이버를 지정합니다.

- 클러스터를 배포할 기본 도메인을 선택합니다. 모든 DNS 레코드는 이 기본 도메인의 하위 도메인이 되므로 클러스터 이름을 포함합니다.

- 클러스터 이름을 입력합니다. 이름은 14자 이하여야 합니다.

- Red Hat OpenShift Cluster Manager에서 풀 시크릿 을 붙여넣습니다.

-

install-config.yaml파일을 수정합니다. 사용 가능한 매개변수에 대한 자세한 정보는 “설치 구성 매개변수” 섹션에서 확인할 수 있습니다. 여러 클러스터를 설치하는 데 사용할 수 있도록

install-config.yaml파일을 백업합니다.중요install-config.yaml파일은 설치 과정에서 사용됩니다. 이 파일을 재사용하려면 지금 백업해야 합니다.

15.3.10.1. 설치 중 클러스터 단위 프록시 구성

프로덕션 환경에서는 인터넷에 대한 직접 액세스를 거부하고 대신 HTTP 또는 HTTPS 프록시를 사용할 수 있습니다. install-config.yaml 파일에서 프록시 설정을 구성하여 프록시가 사용되도록 새 OpenShift Container Platform 클러스터를 구성할 수 있습니다.

Kuryr 설치의 기본값은 HTTP 프록시입니다.

사전 요구 사항

프록시오브젝트를 사용하는 제한된 네트워크에 Kuryr를 설치하려면 프록시가 클러스터가 사용하는 라우터에 응답할 수 있어야 합니다. 프록시 구성에 대한 정적 경로를 추가하려면 root 사용자로 명령줄에서 다음을 입력합니다.$ ip route add <cluster_network_cidr> via <installer_subnet_gateway>

-

제한된 서브넷에는 정의된 게이트웨이가 있고 Kuryr에서 생성하는

Router리소스에 연결할 수 있는 게이트웨이가 있어야 합니다. -

기존

install-config.yaml파일이 있습니다. 클러스터에서 액세스해야 하는 사이트를 검토하고 프록시를 바이패스해야 하는지 확인했습니다. 기본적으로 호스팅 클라우드 공급자 API에 대한 호출을 포함하여 모든 클러스터 발신(Egress) 트래픽이 프록시됩니다. 필요한 경우 프록시를 바이패스하기 위해

Proxy오브젝트의spec.noProxy필드에 사이트를 추가했습니다.참고Proxy오브젝트의status.noProxy필드는 설치 구성에 있는networking.machineNetwork[].cidr,networking.clusterNetwork[].cidr,networking.serviceNetwork[]필드의 값으로 채워집니다.Amazon Web Services (AWS), Google Cloud Platform (GCP), Microsoft Azure 및 Red Hat OpenStack Platform (RHOSP)에 설치하는 경우

Proxy오브젝트status.noProxy필드도 인스턴스 메타데이터 끝점(169.254.169.254)로 채워집니다.

프로세스

install-config.yaml파일을 편집하고 프록시 설정을 추가합니다. 예를 들면 다음과 같습니다.apiVersion: v1 baseDomain: my.domain.com proxy: httpProxy: http://<username>:<pswd>@<ip>:<port> 1 httpsProxy: https://<username>:<pswd>@<ip>:<port> 2 noProxy: example.com 3 additionalTrustBundle: | 4 -----BEGIN CERTIFICATE----- <MY_TRUSTED_CA_CERT> -----END CERTIFICATE----- ...

- 1

- 클러스터 외부에서 HTTP 연결을 구축하는 데 사용할 프록시 URL입니다. URL 스키마는

http여야 합니다. - 2

- 클러스터 외부에서 HTTPS 연결을 구축하는 데 사용할 프록시 URL입니다.

- 3

- 대상 도메인 이름, IP 주소 또는 프록시에서 제외할 기타 네트워크 CIDR로 이루어진 쉼표로 구분된 목록입니다. 하위 도메인과 일치하려면 도메인 앞에

.을 입력합니다. 예를 들어,.y.com은x.y.com과 일치하지만y.com은 일치하지 않습니다.*를 사용하여 모든 대상에 대해 프록시를 바이패스합니다. - 4

- 이 값을 제공하면 설치 프로그램에서 추가 CA 인증서를 보유할

openshift이라는 구성 맵을 생성합니다.-config 네임스페이스에 user-ca-bundleadditionalTrustBundle및 하나 이상의 프록시 설정을 제공하는 경우프록시오브젝트는trustedCA필드의user-ca-bundle구성 맵을 참조하도록 구성됩니다. 그러면 Cluster Network Operator에서trustedCA매개변수에 대해 지정된 콘텐츠를 RHCOS 신뢰 번들과 병합하는trusted-ca-bundle구성 맵을 생성합니다. 프록시의 ID 인증서를 RHCOS 트러스트 번들에 있는 기관에서 서명하지 않은 경우additionalTrustBundle필드가 있어야 합니다.

참고설치 프로그램에서 프록시

adinessEndpoints필드를 지원하지 않습니다.- 파일을 저장해 놓고 OpenShift Container Platform을 설치할 때 참조하십시오.

제공되는 install-config.yaml 파일의 프록시 설정을 사용하는 cluster라는 이름의 클러스터 전체 프록시가 설치 프로그램에 의해 생성됩니다. 프록시 설정을 제공하지 않아도 cluster Proxy 오브젝트는 계속 생성되지만 spec은 nil이 됩니다.

cluster라는 Proxy 오브젝트만 지원되며 추가 프록시는 생성할 수 없습니다.

15.3.11. 설치 구성 매개변수

OpenShift Container Platform 클러스터를 배포하기 전에 매개변수 값을 제공하여 클러스터를 호스팅할 클라우드 플랫폼에서 사용자 계정을 설명하고 선택사항으로 클러스터의 플랫폼을 사용자 지정합니다. install-config.yaml 설치 구성 파일을 생성할 때 명령줄을 통해 필요한 매개변수 값을 제공합니다. 클러스터를 사용자 지정하면 install-config.yaml 파일을 수정하여 플랫폼에 대한 세부 정보를 제공할 수 있습니다.

설치한 후에는 install-config.yaml 파일에서 이러한 매개변수를 수정할 수 없습니다.

openshift-install 명령은 매개변수의 필드 이름을 검증하지 않습니다. 잘못된 이름이 지정되면 관련 파일 또는 오브젝트가 생성되지 않으며 오류가 보고되지 않습니다. 지정된 매개변수의 필드 이름이 올바른지 확인합니다.

15.3.11.1. 필수 구성 매개변수

필수 설치 구성 매개변수는 다음 표에 설명되어 있습니다.

표 15.8. 필수 매개 변수

| 매개변수 | 설명 | 값 |

|---|---|---|

|

|

| 문자열 |

|

|

클라우드 공급자의 기본 도메인입니다. 기본 도메인은 OpenShift Container Platform 클러스터 구성 요소에 대한 경로를 생성하는 데 사용됩니다. 클러스터의 전체 DNS 이름은 |

정규화된 도메인 또는 하위 도메인 이름(예: |

|

|

Kubernetes 리소스 | 개체 |

|

|

클러스터의 이름입니다. 클러스터의 DNS 레코드는 |

소문자, 하이픈( |

|

|

설치를 수행할 특정 플랫폼에 대한 구성: | 개체 |

|

| Red Hat OpenShift Cluster Manager에서 풀 시크릿 을 가져와서 Quay.io와 같은 서비스에서 OpenShift Container Platform 구성 요소의 컨테이너 이미지 다운로드를 인증합니다. |

{

"auths":{

"cloud.openshift.com":{

"auth":"b3Blb=",

"email":"you@example.com"

},

"quay.io":{

"auth":"b3Blb=",

"email":"you@example.com"

}

}

}

|

15.3.11.2. 네트워크 구성 매개변수

기존 네트워크 인프라의 요구 사항에 따라 설치 구성을 사용자 지정할 수 있습니다. 예를 들어 클러스터 네트워크의 IP 주소 블록을 확장하거나 기본값과 다른 IP 주소 블록을 제공할 수 있습니다.

IPv4 주소만 지원됩니다.

표 15.9. 네트워크 매개변수

| 매개변수 | 설명 | 값 |

|---|---|---|

|

| 클러스터의 네트워크의 구성입니다. | 개체 참고

설치한 후에는 |

|

| 설치할 클러스터 네트워크 공급자 CNI(Container Network Interface) 플러그인입니다. |

|

|

| Pod의 IP 주소 블록입니다.

기본값은 여러 IP 주소 블록을 지정하는 경우 블록이 겹치지 않아야 합니다. | 개체의 배열입니다. 예를 들면 다음과 같습니다. networking:

clusterNetwork:

- cidr: 10.128.0.0/14

hostPrefix: 23

|

|

|

IPv4 네트워크입니다. |

CIDR(Classless Inter-Domain Routing) 표기법의 IP 주소 블록입니다. IPv4 블록의 접두사 길이는 |

|

|

개별 노드 각각에 할당할 서브넷 접두사 길이입니다. 예를 들어 | 서브넷 접두사입니다.

기본값은 |

|

|

서비스의 IP 주소 블록입니다. 기본값은 OpenShift SDN 및 OVN-Kubernetes 네트워크 공급자는 서비스 네트워크에 대한 단일 IP 주소 블록만 지원합니다. | CIDR 형식의 IP 주소 블록이 있는 어레이입니다. 예를 들면 다음과 같습니다. networking: serviceNetwork: - 172.30.0.0/16 |

|

| 시스템의 IP 주소 블록입니다. 여러 IP 주소 블록을 지정하는 경우 블록이 겹치지 않아야 합니다. | 개체의 배열입니다. 예를 들면 다음과 같습니다. networking: machineNetwork: - cidr: 10.0.0.0/16 |

|

|

| CIDR 표기법의 IP 네트워크 블록입니다.

예: 참고

기본 NIC가 상주하는 CIDR과 일치하도록 |

15.3.11.3. 선택적 구성 매개변수

선택적 설치 구성 매개변수는 다음 표에 설명되어 있습니다.

표 15.10. 선택적 매개변수

| 매개변수 | 설명 | 값 |

|---|---|---|

|

| 노드의 신뢰할 수 있는 인증서 스토리지에 추가되는 PEM 인코딩 X.509 인증서 번들입니다. 이 신뢰할 수 있는 번들은 프록시가 구성되었을 때에도 사용할 수 있습니다. | 문자열 |

|

| 컴퓨팅 노드를 구성하는 시스템의 구성입니다. |

|

|

|

풀에 있는 시스템의 명령어 집합 아키텍처를 결정합니다. 이기종 클러스터는 현재 지원되지 않으므로 모든 풀이 동일한 아키텍처를 지정해야 합니다. 유효한 값은 | 문자열 |

|

|

컴퓨팅 시스템에서 동시 멀티스레딩 또는 중요 동시 멀티스레딩을 비활성화하는 경우 용량 계획에서 시스템 성능이 크게 저하될 수 있는 문제를 고려해야 합니다. |

|

|

|

|

|

|

|

|

|

|

| 프로비저닝할 컴퓨팅 시스템(작업자 시스템이라고도 함) 수입니다. |

|

|

| 컨트롤 플레인을 구성하는 시스템들의 구성입니다. |

|

|

|

풀에 있는 시스템의 명령어 집합 아키텍처를 결정합니다. 현재 이기종 클러스터는 지원되지 않으므로 모든 풀에서 동일한 아키텍처를 지정해야 합니다. 유효한 값은 | 문자열 |

|

|

컨트롤 플레인 시스템에서 동시 멀티스레딩 또는 중요 동시 멀티스레딩을 비활성화하는 경우 용량 계획에서 시스템 성능이 크게 저하될 수 있는 문제를 고려해야 합니다. |

|

|

|

|

|

|

|

|

|

|

| 프로비저닝하는 컨트롤 플레인 시스템의 수입니다. |

지원되는 유일한 값은 기본값인 |

|

| Cloud Credential Operator (CCO) 모드입니다. 모드가 지정되지 않은 경우 CCO는 여러 모드가 지원되는 플랫폼에서 Mint 모드가 우선으로 되어 지정된 인증 정보의 기능을 동적으로 확인하려고합니다. 참고 모든 클라우드 공급자에서 모든 CCO 모드가 지원되는 것은 아닙니다. CCO 모드에 대한 자세한 내용은 Cluster Operators 의 Cloud Credential Operator 를 참조하십시오. 참고

AWS 계정에 SCP(서비스 제어 정책)가 활성화된 경우 |

|

|

|

FIPS 모드를 활성화 또는 비활성화합니다. 기본값은 중요

FIPS 검증 / 진행중인 모듈 암호화 라이브러리 사용은 참고 Azure File 스토리지를 사용하는 경우 FIPS 모드를 활성화할 수 없습니다. |

|

|

| 릴리스 이미지 내용의 소스 및 리포지토리입니다. |

개체의 배열입니다. 이 표의 다음 행에 설명된 대로 |

|

|

| 문자열 |

|

| 동일한 이미지를 포함할 수도 있는 하나 이상의 리포지토리를 지정합니다. | 문자열 배열 |

|

| Kubernetes API, OpenShift 경로와 같이 클러스터의 사용자 끝점을 게시하거나 노출하는 방법입니다. |

이 필드를 |

|

| 클러스터 시스템 액세스 인증에 필요한 하나 이상의 SSH 키입니다. 참고

설치 디버깅 또는 재해 복구를 수행하려는 프로덕션 OpenShift Container Platform 클러스터의 경우 | 하나 이상의 키입니다. 예를 들면 다음과 같습니다. sshKey: <key1> <key2> <key3> |

15.3.11.4. 추가 RHOSP(Red Hat OpenStack Platform) 구성 매개변수

추가 RHOSP 구성 매개변수는 다음 표에 설명되어 있습니다.

표 15.11. 추가 RHOSP 매개변수

| 매개변수 | 설명 | 값 |

|---|---|---|

|

| 컴퓨팅 시스템의 경우 루트 볼륨의 크기(GB)입니다. 이 값을 설정하지 않으면 시스템은 임시 스토리지를 사용합니다. |

정수 (예: |

|

| 컴퓨팅 시스템의 경우 루트 볼륨의 유형입니다. |

문자열 (예: |

|

| 컨트롤 플레인 시스템의 경우 루트 볼륨의 크기(GB)입니다. 이 값을 설정하지 않으면 시스템은 임시 스토리지를 사용합니다. |

정수 (예: |

|

| 컨트롤 플레인 시스템의 경우 루트 볼륨의 유형입니다. |

문자열 (예: |

|

|

|

문자열 (예: |

|

| 설치에 사용할 RHOSP 외부 네트워크 이름입니다. |

문자열 (예: |

|

| 컨트롤 플레인 및 컴퓨팅 시스템에 사용할 RHOSP 버전입니다.

이 속성은 더 이상 사용되지 않습니다. 모든 머신 풀에 플레이버를 기본값으로 사용하려면 |

문자열 (예: |

15.3.11.5. 선택적 RHOSP 구성 매개변수

선택적 RHOSP 구성 매개변수는 다음 표에 설명되어 있습니다.

표 15.12. 선택적 RHOSP 매개변수

| 매개변수 | 설명 | 값 |

|---|---|---|

|

| 컴퓨팅 시스템과 관련된 추가 네트워크입니다. 추가 네트워크에는 허용되는 주소 쌍이 생성되지 않습니다. |

하나 이상의 UUID 목록을 문자열로 나타냅니다. 예: |

|

| 컴퓨팅 시스템과 관련된 추가 보안 그룹입니다. |

하나 이상의 UUID 목록을 문자열로 나타냅니다. 예: |

|

| 머신을 설치할 RHOSP Compute (Nova) 가용성 영역 (AZ). 이 매개 변수가 설정되지 않은 경우 설치 프로그램은 RHOSP 관리자가 구성한 Nova의 기본 설정을 사용합니다. Kuryr를 사용하는 클러스터에서 RHOSP Octavia는 가용성 영역을 지원하지 않습니다. 로드 밸런서 및 Amphora 공급자 드라이버를 사용하는 경우 Amphora VM에 의존하는 OpenShift Container Platform 서비스는이 속성의 값에 따라 생성되지 않습니다. |

문자열 목록입니다. 예: |

|

| 컴퓨팅 시스템의 경우 루트 볼륨을 설치할 가용성 영역입니다. 이 매개변수의 값을 설정하지 않으면 설치 프로그램에서 기본 가용성 영역을 선택합니다. |

문자열 목록(예: |

|

| 컨트롤 플레인 시스템과 관련된 추가 네트워크입니다. 추가 네트워크에는 허용되는 주소 쌍이 생성되지 않습니다. |

하나 이상의 UUID 목록을 문자열로 나타냅니다. 예: |

|

| 컨트롤 플레인 시스템과 관련된 추가 보안 그룹입니다. |

하나 이상의 UUID 목록을 문자열로 나타냅니다. 예: |

|

| 머신을 설치할 RHOSP Compute (Nova) 가용성 영역 (AZ). 이 매개 변수가 설정되지 않은 경우 설치 프로그램은 RHOSP 관리자가 구성한 Nova의 기본 설정을 사용합니다. Kuryr를 사용하는 클러스터에서 RHOSP Octavia는 가용성 영역을 지원하지 않습니다. 로드 밸런서 및 Amphora 공급자 드라이버를 사용하는 경우 Amphora VM에 의존하는 OpenShift Container Platform 서비스는이 속성의 값에 따라 생성되지 않습니다. |

문자열 목록입니다. 예: |

|

| 컨트롤 플레인 시스템의 경우 루트 볼륨을 설치할 가용성 영역입니다. 이 값을 설정하지 않으면 설치 프로그램에서 기본 가용성 영역을 선택합니다. |

문자열 목록(예: |

|

| 설치 프로그램이 RHCOS 이미지를 다운로드하는 위치입니다. 네트워크가 제한된 환경에서 설치를 수행하려면이 매개 변수를 설정해야 합니다. | HTTP 또는 HTTPS URL (선택 옵션으로 SHA-256 형식의 체크섬을 사용)

예: |

|

|

Glance의 설치 프로그램에서 업로드된 ClusterOSImage에 추가할 속성입니다.

이 속성을 사용하여 노드당 26 PV의 RHOSP의 기본 PV(영구 볼륨) 제한을 초과할 수 있습니다. 제한을 초과하려면

이 속성을 사용하면 |

키-값 문자열 쌍 목록입니다. 예를 들면 |

|

| 기본 시스템 풀 플랫폼 구성입니다. |

{

"type": "ml.large",

"rootVolume": {

"size": 30,

"type": "performance"

}

}

|

|

|

Ingress 포트와 연결할 기존 부동 IP 주소입니다. 이 속성을 사용하려면 |

IP 주소 (예: |

|

|

로드 밸런서 API와 연결할 기존 부동 IP 주소입니다. 이 속성을 사용하려면 |

IP 주소 (예: |

|

| 클러스터 인스턴스가 DNS 확인에 사용하는 외부 DNS 서버의 IP 주소입니다. |

IP 주소 목록을 문자열로 나타냅니다. 예: |

|

| 클러스터 노드가 사용하는 RHOSP 서브넷의 UUID입니다. 이 서브넷에 노드와 가상 IP(VIP) 포트가 생성됩니다.

사용자 지정 서브넷에 배포하는 경우 OpenShift Container Platform 설치 관리자에 외부 DNS 서버를 지정할 수 없습니다. 대신 RHOSP의 서브넷에 DNS를 추가합니다. |

문자열의 UUID입니다. 예: |

15.3.11.6. RHOSP 배포의 사용자 지정 서브넷

선택한 RHOSP(Red Hat OpenStack Platform) 서브넷에 클러스터를 배포할 수도 있습니다. 서브넷의 GUID는 install-config.yaml 파일에서 platform.openstack.machinesSubnet 값으로 전달됩니다.

이 서브넷은 클러스터의 기본 서브넷으로 사용됩니다. 기본적으로 노드와 포트가 이 서브넷에서 생성됩니다. platform.openstack.machinesSubnet 속성의 값을 서브넷의 UUID로 설정하여 다른 RHOSP 서브넷에서 노드 및 포트를 생성할 수 있습니다.

사용자 지정 서브넷으로 OpenShift Container Platform 설치 관리자를 실행하기 전에 구성이 다음 요구 사항을 충족하는지 확인하십시오.

-

platform.openstack.machinesSubnet에서 사용하는 서브넷에 DHCP가 활성화되어 있습니다. -

platform.openstack.machinesSubnet의 CIDR은networking.machineNetwork의 CIDR과 일치합니다. - 설치 프로그램 사용자에게 고정 IP 주소가 있는 포트를 포함하여 이 네트워크에 포트를 생성할 수 있는 권한이 있습니다.

사용자 지정 서브넷을 사용하는 클러스터에는 다음과 같은 제한 사항이 있습니다.

-

유동 IP 주소를 사용하는 클러스터를 설치하려는 경우

platform.openstack.machinesSubnet서브넷이externalNetwork네트워크에 연결된 라우터에 연결되어 있어야 합니다. -

platform.openstack.machinesSubnet값이install-config.yaml파일에 설정된 경우 설치 프로그램에서 RHOSP 머신의 프라이빗 네트워크 또는 서브넷을 생성하지 않습니다. -

사용자 지정 서브넷과 동시에

platform.openstack.externalDNS속성을 사용할 수 없습니다. 사용자 지정 서브넷을 사용하는 클러스터에 DNS를 추가하려면 RHOSP 네트워크에서 DNS를 구성합니다.

기본적으로 API VIP는 x.x.x.5를 가져오고 Ingress VIP는 네트워크의 CIDR 블록에서 x.x.x.7을 가져옵니다. 이러한 기본값을 재정의하려면 DHCP 할당 풀 외부에 있는platform.openstack.apiVIP 및 platform.openstack.ingressVIP의 값을 설정합니다.

15.3.11.7. Kuryr를 사용한 RHOSP용 샘플 사용자 지정 install-config.yaml 파일

기본 OpenShift SDN 대신 Kuryr SDN으로 배포하려면 Kuryr를 원하는 networking.networkType으로 포함하도록 install-config.yaml 파일을 수정하고 기본 OpenShift Container Platform SDN 설치 단계를 진행해야 합니다. 이 샘플 install-config.yaml은 가능한 모든 RHOSP(Red Hat OpenStack Platform ) 사용자 지정 옵션을 보여줍니다.

이 샘플 파일은 참조용으로만 제공됩니다. install-config.yaml 파일은 설치 프로그램을 사용하여 받아야 합니다.

apiVersion: v1

baseDomain: example.com

controlPlane:

name: master

platform: {}

replicas: 3

compute:

- name: worker

platform:

openstack:

type: ml.large

replicas: 3

metadata:

name: example

networking:

clusterNetwork:

- cidr: 10.128.0.0/14

hostPrefix: 23

machineNetwork:

- cidr: 10.0.0.0/16

serviceNetwork:

- 172.30.0.0/16 1

networkType: Kuryr

platform:

openstack:

cloud: mycloud

externalNetwork: external

computeFlavor: m1.xlarge

apiFloatingIP: 128.0.0.1

trunkSupport: true 2

octaviaSupport: true 3

pullSecret: '{"auths": ...}'

sshKey: ssh-ed25519 AAAA...- 1

- Amphora Octavia 드라이버는 로드 밸런서당 두 개의 포트를 생성합니다. 결과적으로 설치 프로그램이 생성하는 서비스 서브넷은

serviceNetwork속성 값으로 지정된 CIDR의 두 배 크기입니다. IP 주소 충돌을 방지하려면 더 큰 범위가 필요합니다. - 2 3

- 설치 관리자는

trunkSupport와octaviaSupport를 자동으로 검색하므로 직접 설정하지 않아도 됩니다. 그러나 사용자 환경이 두 요구사항을 모두 충족하지 않으면 Kuryr SDN이 제대로 작동하지 않습니다. Pod를 RHOSP 네트워크에 연결하려면 트렁크가 필요하며 OpenShift Container Platform 서비스를 생성하려면 Octavia가 필요합니다.

15.3.11.8. RHOSP 공급자 네트워크에서 클러스터 배포

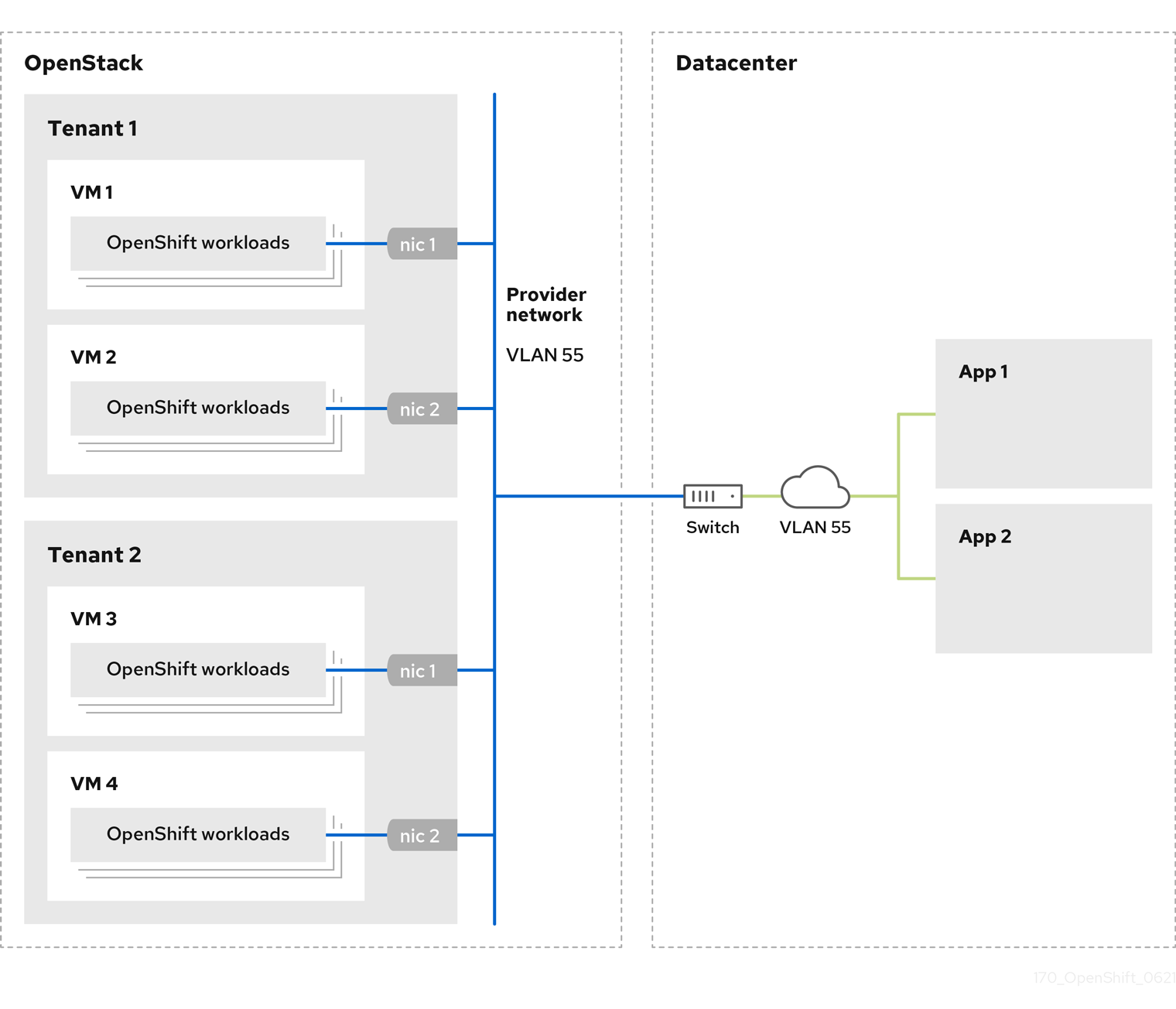

공급자 네트워크의 기본 네트워크 인터페이스를 사용하여 RHOSP(Red Hat OpenStack Platform)에 OpenShift Container Platform 클러스터를 배포할 수 있습니다. 공급자 네트워크는 일반적으로 프로젝트에 인터넷에 연결하는 데 사용할 수 있는 공용 네트워크에 직접 액세스할 수 있는 권한을 부여하는 데 사용됩니다. 네트워크 생성 프로세스의 일부로 프로젝트 간에 공급자 네트워크를 공유할 수도 있습니다.

RHOSP 공급자 네트워크는 데이터 센터의 기존 실제 네트워크에 직접 매핑됩니다. RHOSP 관리자가 이를 생성해야 합니다.

다음 예에서 OpenShift Container Platform 워크로드는 공급자 네트워크를 사용하여 데이터 센터에 연결됩니다.

공급자 네트워크에 설치된 OpenShift Container Platform 클러스터에는 테넌트 네트워크 또는 유동 IP 주소가 필요하지 않습니다. 설치 프로그램에서 설치하는 동안 이러한 리소스를 생성하지 않습니다.

공급자 네트워크 유형에는 flat(태그되지 않음) 및 VLAN(802.1Q 태그)이 포함됩니다.

클러스터는 네트워크 유형에서 허용하는 만큼의 공급자 네트워크 연결을 지원할 수 있습니다. 예를 들어 VLAN 네트워크는 일반적으로 최대 4096개의 연결을 지원합니다.

RHOSP 설명서에서 공급자 및 테넌트 네트워크에 대해 자세히 알아볼 수 있습니다.

15.3.11.8.1. 클러스터 설치를 위한 RHOSP 공급자 네트워크 요구 사항

OpenShift Container Platform 클러스터를 설치하기 전에 RHOSP(Red Hat OpenStack Platform) 배포 및 공급자 네트워크가 다음과 같은 여러 조건을 충족해야 합니다.

- RHOSP 네트워킹 서비스(Neutron)가 활성화되어 RHOSP 네트워킹 API를 통해 액세스할 수 있습니다.

- RHOSP 네트워킹 서비스에는 포트 보안 및 허용되는 주소 쌍 확장 기능이 활성화되어 있습니다.

공급자 네트워크는 다른 테넌트와 공유할 수 있습니다.

작은 정보openstack network create명령을--share플래그와 함께 사용하여 공유할 수 있는 네트워크를 생성합니다.클러스터를 설치하는 데 사용하는 RHOSP 프로젝트는 공급자 네트워크와 적절한 서브넷을 소유해야 합니다.

작은 정보- "openshift"라는 프로젝트의 네트워크를 만들려면 다음 명령을 입력합니다.

$ openstack network create --project openshift

- "openshift"라는 프로젝트의 서브넷을 만들려면 다음 명령을 입력합니다.

$ openstack subnet create --project openshift

RHOSP에서 네트워크 생성에 대한 자세한 내용은 공급자 네트워크 설명서를 참조하십시오.

admin사용자가 클러스터를 소유하는 경우 해당 사용자로 설치 프로그램을 실행하여 네트워크에서 포트를 생성해야 합니다.중요공급자 네트워크는 클러스터를 생성하는 데 사용되는 RHOSP 프로젝트에서 소유해야 합니다. RHOSP 컴퓨팅 서비스(Nova)는 해당 네트워크의 포트를 요청할 수 없습니다.

공급자 네트워크가 기본적으로 RHOSP 메타데이터 서비스 IP 주소

169.254.169.254에 연결할 수 있는지 확인합니다.RHOSP SDN 및 네트워킹 서비스 구성에 따라 서브넷을 생성할 때 경로를 제공해야 할 수 있습니다. 예를 들면 다음과 같습니다.

$ openstack subnet create --dhcp --host-route destination=169.254.169.254/32,gateway=192.0.2.2 ...

- 선택 사항: 네트워크를 보호하려면 단일 프로젝트에 대한 네트워크 액세스를 제한하는 역할 기반 액세스 제어(RBAC) 규칙을 생성합니다.

15.3.11.8.2. 공급자 네트워크에 기본 인터페이스가 있는 클러스터 배포

RHOSP(Red Hat OpenStack Platform) 공급자 네트워크에 기본 네트워크 인터페이스가 있는 OpenShift Container Platform 클러스터를 배포할 수 있습니다.

- RHOSP(Red Hat OpenStack Platform) 배포는 "클러스터 설치를 위한 RHOSP 공급자 네트워크 요구 사항"에 설명된 대로 구성됩니다.

프로세스

-

텍스트 편집기에서

install-config.yaml파일을 엽니다. -

platform.openstack.apiVIP속성의 값을 API VIP의 IP 주소로 설정합니다. -

platform.openstack.ingressVIP속성 값을 Ingress VIP의 IP 주소로 설정합니다. -

platform.openstack.machinesSubnet속성 값을 공급자 네트워크 서브넷의 UUID로 설정합니다. -

networking.machineNetwork.cidr속성 값을 공급자 네트워크 서브넷의 CIDR 블록으로 설정합니다.

platform.openstack.apiVIP 및 platform.openstack.ingressVIP 속성은 모두 networking.machineNetwork.cidr 블록에서 할당되지 않은 IP 주소여야 합니다.

RHOSP 공급자 네트워크를 사용하는 클러스터의 설치 구성 파일 섹션

...

platform:

openstack:

apiVIP: 192.0.2.13

ingressVIP: 192.0.2.23

machinesSubnet: fa806b2f-ac49-4bce-b9db-124bc64209bf

# ...

networking:

machineNetwork:

- cidr: 192.0.2.0/24

기본 네트워크 인터페이스에 공급자 네트워크를 사용하는 동안 platform.openstack.externalNetwork 또는 platform.openstack.externalDNS 매개변수를 설정할 수 없습니다.

클러스터를 배포할 때 설치 프로그램에서 install-config.yaml 파일을 사용하여 공급자 네트워크에 클러스터를 배포합니다.

공급자 네트워크를 포함한 다른 네트워크를 platform.openstack.additionalNetworkIDs 목록에 추가할 수 있습니다.

클러스터를 배포한 후 Pod를 추가 네트워크에 연결할 수 있습니다. 자세한 내용은 여러 네트워크 이해를 참조하십시오.

15.3.11.9. Kuryr 포트 풀

Kuryr 포트 풀은 Pod 생성을 위해 대기 중인 다수의 포트를 유지 관리합니다.

포트를 대기 상태로 유지하면 Pod 생성 시간이 최소화됩니다. 포트 풀이 없으면 Kuryr는 Pod를 생성하거나 삭제할 때마다 포트 생성 또는 삭제를 명시적으로 요청해야 합니다.

Kuryr가 사용하는 Neutron 포트는 네임스페이스에 연결된 서브넷에 생성됩니다. 이러한 Pod 포트도 OpenShift Container Platform 클러스터 노드의 기본 포트에 하위 포트로 추가됩니다.

Kuryr는 각 네임스페이스를 별도의 서브넷에 유지하므로 각 네임스페이스-작업자 쌍에 대해 별도의 포트 풀이 유지됩니다.

클러스터를 설치하기 전에 cluster-network-03-config.yml 매니페스트 파일에서 다음 매개변수를 설정하여 포트 풀 동작을 구성할 수 있습니다.

-

enablePortPoolsPrepopulation매개변수는 풀 사전 채우기를 제어하므로 새 호스트가 추가되거나 새 네임스페이스가 생성되는 경우와 같이 풀 생성 시 Kuryr가 풀에 포트를 추가하도록 합니다. 기본값은false입니다. -

poolMinPorts매개변수는 풀에 보관되는 사용 가능한 최소 포트 수입니다. 기본값은1입니다. poolMaxPorts매개변수는 풀에 보관되는 사용 가능한 최대 포트 수입니다. 값이0이면 해당 상한이 비활성화됩니다. 이 설정은 기본 설정입니다.OpenStack 포트 할당량이 낮거나 pod 네트워크에 IP 주소가 제한된 경우 이 옵션을 설정하여 불필요한 포트가 삭제되었는지 확인합니다.

-

poolBatchPorts매개 변수는 한 번에 생성할 수 있는 최대 Neutron 포트 수를 정의합니다. 기본값은3입니다.

15.3.11.10. 설치 중에 Kuryr 포트 풀 조정

설치하는 동안 Kuryr가 RHOSP(Red Hat OpenStack Platform) Neutron 포트를 관리하여 Pod 생성 속도와 효율성을 제어하는 방법을 구성할 수 있습니다.

사전 요구 사항

-

install-config.yaml파일을 생성하고 수정합니다.

프로세스

명령줄에서 매니페스트 파일을 생성합니다.

$ ./openshift-install create manifests --dir <installation_directory> 1- 1

<installation_directory>는 클러스터의install-config.yaml파일이 포함된 디렉터리의 이름을 지정합니다.

<installation_directory>/ manifests/디렉토리에cluster-network-03-config.yml이라는 이름으로 파일을 만듭니다.$ touch <installation_directory>/manifests/cluster-network-03-config.yml 1- 1

<installation_directory>는 클러스터의manifests /디렉터리가 포함된 디렉터리 이름을 지정합니다.

파일이 생성되면 다음과 같이 여러 네트워크 구성 파일이

manifests/디렉토리에 나타납니다.$ ls <installation_directory>/manifests/cluster-network-*

출력 예

cluster-network-01-crd.yml cluster-network-02-config.yml cluster-network-03-config.yml

편집기에서

cluster-network-03-config.yml파일을 열고 원하는 Cluster Network Operator 구성을 설명하는 CR(사용자 정의 리소스)을 입력합니다.$ oc edit networks.operator.openshift.io cluster

요구 사항에 맞게 설정을 편집합니다. 다음 파일은 예제로 제공됩니다.

apiVersion: operator.openshift.io/v1 kind: Network metadata: name: cluster spec: clusterNetwork: - cidr: 10.128.0.0/14 hostPrefix: 23 serviceNetwork: - 172.30.0.0/16 defaultNetwork: type: Kuryr kuryrConfig: enablePortPoolsPrepopulation: false 1 poolMinPorts: 1 2 poolBatchPorts: 3 3 poolMaxPorts: 5 4 openstackServiceNetwork: 172.30.0.0/15 5- 1

- Kuryr가 네임스페이스를 생성하거나 클러스터에 새 노드를 추가한 후 Kuryr가 새 Neutron 포트를 생성하도록 하려면

enablePortPoolsPrepopulation값을true로 설정합니다. 이 설정은 Neutron 포트 할당량을 높이지만 pod를 생성하는 데 필요한 시간을 줄일 수 있습니다. 기본값은false입니다. - 2

- Kuryr는 풀의 사용 가능한 포트 수가

poolMinPorts값보다 낮은 경우 풀에 대한 새 포트를 만듭니다. 기본값은1입니다. - 3

poolBatchPorts는 사용 가능한 포트 수가poolMinPorts값보다 낮은 경우 생성되는 새 포트 수를 제어합니다. 기본값은3입니다.- 4

- 풀에서 사용 가능한 포트 수가

poolMaxPorts값보다 크면 Kuryr는 숫자가 해당 값과 일치할 때까지 해당 포트를 삭제합니다. 이 값을0으로 설정하면 이 상한이 비활성화되므로 풀이 축소되지 않습니다. 기본값은0입니다. - 5

openStackServiceNetwork매개변수는 IP 주소가 RHOSP Octavia의 LoadBalancers에 할당되는 네트워크의 CIDR 범위를 정의합니다.

이 매개변수가 Amphora 드라이버와 함께 사용되는 경우 Octavia는 각 로드 밸런서에 대해 이 네트워크에서 두 개의 IP 주소를 사용합니다. 하나는 OpenShift 및 VRRP 연결에 사용됩니다. 이러한 IP 주소는 각각 OpenShift Container Platform 및 Neutron에서 관리하므로 서로 다른 풀에서 가져와야 합니다. 따라서

openStackServiceNetwork의 값은serviceNetwork값의 2배 이상이어야 하며serviceNetwork의 값은openStackServiceNetwork에서 정의된 범위와 완전히 겹쳐야 합니다.CNO는 이 매개변수에서 정의한 범위에서 가져온 VRRP IP 주소가

serviceNetwork매개변수에 정의된 범위와 겹치지 않음을 확인합니다.이 매개변수가 설정되지 않은 경우 CNO는 접두사 크기를 1로 줄임으로써 결정되는

serviceNetwork의 확장된 값을 사용합니다.-

cluster-network-03-config.yml파일을 저장하고 텍스트 편집기를 종료합니다. -

선택사항:

manifests/cluster-network-03-config.yml파일을 백업합니다. 설치 프로그램은 클러스터를 생성하는 동안manifests/디렉터리를 삭제합니다.

15.3.12. 컴퓨팅 머신 유사성 설정

선택적으로 설치하는 동안 컴퓨팅 시스템의 선호도 정책을 설정할 수 있습니다. 설치 프로그램은 기본적으로 컴퓨팅 시스템의 선호도 정책을 선택하지 않습니다.

설치 후 특정 RHOSP 서버 그룹을 사용하는 머신 세트를 생성할 수도 있습니다.

컨트롤 플레인 시스템은 soft-anti-affinity 정책을 사용하여 생성됩니다.

RHOSP 인스턴스 스케줄링 및 배치에 대한 자세한 내용은 RHOSP 설명서에서 확인할 수 있습니다.

사전 요구 사항

-

install-config.yaml파일을 생성하고 수정합니다.

프로세스

RHOSP 명령줄 인터페이스를 사용하여 컴퓨팅 시스템의 서버 그룹을 생성합니다. 예를 들면 다음과 같습니다.

$ openstack \ --os-compute-api-version=2.15 \ server group create \ --policy anti-affinity \ my-openshift-worker-group자세한 내용은

서버 그룹 생성명령 설명서를 참조하십시오.설치 프로그램이 포함된 디렉터리로 변경하고 매니페스트를 생성합니다.

$ ./openshift-install create manifests --dir <installation_directory>

다음과 같습니다.

installation_directory-

클러스터의

install-config.yaml파일이 포함된 디렉토리의 이름을 지정합니다.

-

MachineSet정의파일인 manifests/99_openshift-cluster-api_worker-machineset-0.yaml을 엽니다. spec.template.spec.providerSpec.value속성 아래에 있는 정의에 속성serverGroupID를 추가합니다. 예를 들면 다음과 같습니다.apiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: labels: machine.openshift.io/cluster-api-cluster: <infrastructure_ID> machine.openshift.io/cluster-api-machine-role: <node_role> machine.openshift.io/cluster-api-machine-type: <node_role> name: <infrastructure_ID>-<node_role> namespace: openshift-machine-api spec: replicas: <number_of_replicas> selector: matchLabels: machine.openshift.io/cluster-api-cluster: <infrastructure_ID> machine.openshift.io/cluster-api-machineset: <infrastructure_ID>-<node_role> template: metadata: labels: machine.openshift.io/cluster-api-cluster: <infrastructure_ID> machine.openshift.io/cluster-api-machine-role: <node_role> machine.openshift.io/cluster-api-machine-type: <node_role> machine.openshift.io/cluster-api-machineset: <infrastructure_ID>-<node_role> spec: providerSpec: value: apiVersion: openstackproviderconfig.openshift.io/v1alpha1 cloudName: openstack cloudsSecret: name: openstack-cloud-credentials namespace: openshift-machine-api flavor: <nova_flavor> image: <glance_image_name_or_location> serverGroupID: aaaaaaaa-bbbb-cccc-dddd-eeeeeeeeeeee 1 kind: OpenstackProviderSpec networks: - filter: {} subnets: - filter: name: <subnet_name> tags: openshiftClusterID=<infrastructure_ID> securityGroups: - filter: {} name: <infrastructure_ID>-<node_role> serverMetadata: Name: <infrastructure_ID>-<node_role> openshiftClusterID: <infrastructure_ID> tags: - openshiftClusterID=<infrastructure_ID> trunk: true userDataSecret: name: <node_role>-user-data availabilityZone: <optional_openstack_availability_zone>- 1

- 서버 그룹의 UUID를 여기에 추가합니다.

-

선택 사항:

manifests/99_openshift-cluster-api_worker-machineset-0.yaml파일을 백업합니다. 설치 프로그램은 클러스터를 생성할 때manifests/디렉터리를 삭제합니다.

클러스터를 설치할 때 설치 프로그램은 수정한 MachineSet 정의를 사용하여 RHOSP 서버 그룹 내에서 컴퓨팅 머신을 생성합니다.

15.3.13. 클러스터 노드 SSH 액세스를 위한 키 쌍 생성

OpenShift Container Platform을 설치하는 동안 SSH 공개 키를 설치 프로그램에 지정할 수 있습니다. 키는 Ignition 구성 파일을 통해 RHCOS(Red Hat Enterprise Linux CoreOS) 노드에 전달되며 노드에 대한 SSH 액세스를 인증하는 데 사용됩니다. 키는 각 노드에서 core 사용자의 ~/.ssh/authorized_keys 목록에 추가되어 암호 없는 인증을 활성화합니다.

키가 노드에 전달되면 키 쌍을 사용하여 사용자 core로 RHCOS 노드에 SSH로 SSH 연결을 수행할 수 있습니다 . SSH를 통해 노드에 액세스하려면 로컬 사용자의 SSH에서 개인 키 ID를 관리해야 합니다.

설치 디버깅 또는 재해 복구를 수행하기 위해 클러스터 노드에 SSH를 실행하려면 설치 프로세스 중에 SSH 공용 키를 지정해야 합니다. ./openshift-install gather 명령에도 SSH 공개 키가 클러스터 노드에 있어야 합니다.

재해 복구 및 디버깅이 필요한 프로덕션 환경에서는이 단계를 생략하지 마십시오.

프로세스

로컬 시스템에 클러스터 노드의 인증에 사용할 기존 SSH 키 쌍이 없는 경우 새로 생성합니다. 예를 들어 Linux 운영 체제를 사용하는 컴퓨터에서 다음 명령을 실행합니다.

$ ssh-keygen -t ed25519 -N '' -f <path>/<file_name> 1- 1

- 새 SSH 키의 경로 및 파일 이름(예:

~/.ssh/id_ed25519)을 지정합니다. 기존 키 쌍이 있는 경우 공개 키가'~/.ssh디렉터리에 있는지 확인하십시오.

참고x86_64아키텍처에 FIPS 검증 / 진행중인 모듈 (Modules in Process) 암호화 라이브러리를 사용하는 OpenShift Container Platform 클러스터를 설치하려면ed25519알고리즘을 사용하는 키를 생성하지 마십시오. 대신rsa또는ecdsa알고리즘을 사용하는 키를 생성합니다.공개 SSH 키를 확인합니다.

$ cat <path>/<file_name>.pub

예를 들어 다음을 실행하여

~/.ssh/id_ed25519.pub공개 키를 확인합니다.$ cat ~/.ssh/id_ed25519.pub

아직 추가되지 않은 경우 로컬 사용자의 SSH 에이전트에 SSH 개인 키 ID를 추가합니다. 키의 SSH 에이전트 관리는 클러스터 노드에 암호 없는 SSH 인증을 수행하거나

./openshift-install gather명령을 사용하려는 경우 필요합니다.참고일부 배포에서는

~/.ssh/id_rsa및~/.ssh/id_dsa와 같은 기본 SSH 개인 키 ID가 자동으로 관리됩니다.ssh-agent프로세스가 로컬 사용자에 대해 실행되지 않은 경우 백그라운드 작업으로 시작합니다.$ eval "$(ssh-agent -s)"

출력 예

Agent pid 31874

참고클러스터가 FIPS 모드인 경우 FIPS 호환 알고리즘만 사용하여 SSH 키를 생성합니다. 키는 RSA 또는 ECDSA여야 합니다.

ssh-agent에 SSH 개인 키를 추가합니다.$ ssh-add <path>/<file_name> 1- 1

- SSH 개인 키의 경로 및 파일 이름을 지정합니다(예:

~/.ssh/id_ed25519).

출력 예

Identity added: /home/<you>/<path>/<file_name> (<computer_name>)

다음 단계

- OpenShift Container Platform을 설치할 때 SSH 공개 키를 설치 프로그램에 지정합니다.

15.3.14. 환경에 대한 액세스 활성화

배포 시 모든 OpenShift Container Platform 시스템은 RHOSP(Red Hat OpenStack Platform) 테넌트 네트워크에서 생성됩니다. 따라서 대부분의 RHOSP 배포에서 직접 액세스할 수 없습니다.

설치시 부동 IP 주소 (FIP)를 사용하여 OpenShift Container Platform API 및 애플리케이션의 액세스를 설정할 수 있습니다. FIP를 구성하지 않고 설치를 완료 할 수도 있지만 설치 프로그램은 외부에서 API 또는 애플리케이션에 액세스하는 방법을 설정하지 않습니다.

15.3.14.1. 부동 IP 주소로 액세스 활성화

OpenShift Container Platform API 및 클러스터 애플리케이션에 대한 외부 액세스 용으로 유동 IP (FIP) 주소를 생성합니다.

프로세스

RHOSP(Red Hat OpenStack Platform) CLI를 사용하여 API FIP를 생성합니다.

$ openstack floating ip create --description "API <cluster_name>.<base_domain>" <external_network>

RHOSP(Red Hat OpenStack Platform) CLI를 사용하여 앱 또는 Ingress, FIP를 생성합니다.

$ openstack floating ip create --description "Ingress <cluster_name>.<base_domain>" <external_network>

API 및 Ingress FIP의 DNS 서버에 이러한 패턴에 따라 레코드를 추가합니다.

api.<cluster_name>.<base_domain>. IN A <API_FIP> *.apps.<cluster_name>.<base_domain>. IN A <apps_FIP>

참고DNS 서버를 제어하지 않으면

/etc/hosts파일에 다음과 같은 클러스터 도메인 이름을 추가하여 클러스터에 액세스할 수 있습니다.-

<api_floating_ip> api.<cluster_name>.<base_domain> -

<application_floating_ip> grafana-openshift-monitoring.apps.<cluster_name>.<base_domain> -

<application_floating_ip> prometheus-k8s-openshift-monitoring.apps.<cluster_name>.<base_domain> -

<application_floating_ip> oauth-openshift.apps.<cluster_name>.<base_domain> -

<application_floating_ip> console-openshift-console.apps.<cluster_name>.<base_domain> -

application_floating_ip integrated-oauth-server-openshift-authentication.apps.<cluster_name>.<base_domain>

/etc/hosts파일의 클러스터 도메인 이름은 웹 콘솔과 클러스터의 모니터링 인터페이스에 로컬로 액세스할 수 있는 권한을 부여합니다.kubectl또는oc에서도 사용할 수 있습니다. <application_floating_ip>를 가리키는 추가 항목을 사용하여 사용자 애플리케이션에 액세스할 수 있습니다. 이 작업을 수행하면 사용자만 API 및 애플리케이션에 액세스할 수 있어 프로덕션 배포에는 적합하지 않지만 개발 및 테스트용 설치는 가능합니다.-

FIP를 다음 매개 변수의 값으로

install-config.yaml파일에 추가하십시오.-

platform.openstack.ingressFloatingIP -

platform.openstack.apiFloatingIP

-

이러한 값을 사용하는 경우 install-config.yaml 파일에서 platform.openstack.externalNetwork 매개 변수 값으로 외부 네트워크를 입력해야 합니다.

부동 IP 주소를 할당하고 방화벽 구성을 업데이트하여 클러스터 외부에서 OpenShift Container Platform 리소스를 사용할 수 있습니다.

15.3.14.2. 유동 IP 주소없이 설치 완료

유동 IP 주소를 지정하지 않고도 Red Hat OpenStack Platform (RHOSP)에 OpenShift Container Platform을 설치할 수 있습니다.

install-config.yaml 파일에서 다음 매개 변수를 정의하지 마십시오.

-

platform.openstack.ingressFloatingIP -

platform.openstack.apiFloatingIP

외부 네트워크를 제공 할 수 없는 경우 platform.openstack.externalNetwork를 비워 둘 수도 있습니다. platform.openstack.externalNetwork 값을 지정하지 않으면 라우터가 생성되지 않으며 추가 작업없이 설치 프로그램이 Glance에서 이미지를 검색하지 못합니다. 외부 연결을 직접 구성해야 합니다.

유동 IP 주소 또는 이름 확인 부족으로 인해 클러스터 API에 연결할 수 없는 시스템에서 설치 프로그램을 실행하면 설치에 실패합니다. 이러한 경우 설치 실패를 방지하기 위해 프록시 네트워크를 사용하거나 시스템과 동일한 네트워크에있는 시스템에서 설치 프로그램을 실행할 수 있습니다.

API 및 Ingress 포트의 DNS 레코드를 생성하여 이름 확인을 활성화할 수 있습니다. 예를 들면 다음과 같습니다.

api.<cluster_name>.<base_domain>. IN A <api_port_IP> *.apps.<cluster_name>.<base_domain>. IN A <ingress_port_IP>

DNS 서버를 제어하지 않으면 /etc/hosts 파일에 레코드를 추가할 수 있습니다. 이 작업을 수행하면 사용자만 API에 액세스할 수 있어 프로덕션 배포에는 적합하지 않지만 개발 및 테스트용 설치는 가능합니다.

15.3.15. 클러스터 배포

호환되는 클라우드 플랫폼에 OpenShift Container Platform을 설치할 수 있습니다.

최초 설치 과정에서 설치 프로그램의 create cluster 명령을 한 번만 실행할 수 있습니다.

사전 요구 사항

- OpenShift Container Platform 설치 프로그램과 클러스터의 풀 시크릿을 받습니다.

프로세스

설치 프로그램이 포함된 디렉터리로 변경하고 클러스터 배포를 초기화합니다.

$ ./openshift-install create cluster --dir <installation_directory> \ 1 --log-level=info 2

참고호스트에 구성된 클라우드 공급자 계정에 클러스터를 배포하기에 충분한 권한이 없는 경우, 설치 프로세스가 중단되고 누락된 권한을 알리는 메시지가 표시됩니다.

클러스터 배포가 완료되면 웹 콘솔로 연결되는 링크와

kubeadmin사용자의 인증 정보가 포함된 클러스터 액세스 지침이 사용자 터미널에 표시됩니다.출력 예

... INFO Install complete! INFO To access the cluster as the system:admin user when using 'oc', run 'export KUBECONFIG=/home/myuser/install_dir/auth/kubeconfig' INFO Access the OpenShift web-console here: https://console-openshift-console.apps.mycluster.example.com INFO Login to the console with user: "kubeadmin", and password: "4vYBz-Ee6gm-ymBZj-Wt5AL" INFO Time elapsed: 36m22s

참고설치에 성공하면 클러스터 액세스 및 인증 정보도

<installation_directory>/.openshift_install.log로 출력됩니다.중요-

설치 프로그램에서 생성하는 Ignition 구성 파일에 24시간 후에 만료되는 인증서가 포함되어 있습니다. 이 인증서는 그 후에 갱신됩니다. 인증서를 갱신하기 전에 클러스터가 종료되고 24시간이 지난 후에 클러스터가 다시 시작되면 클러스터는 만료된 인증서를 자동으로 복구합니다. 예외적으로 kubelet 인증서를 복구하려면 대기 중인

node-bootstrapper인증서 서명 요청(CSR)을 수동으로 승인해야 합니다. 자세한 내용은 만료된 컨트롤 플레인 인증서에서 복구 문서를 참조하십시오. - 클러스터를 설치한 후 24시간에서 22시간까지의 인증서가 교체되기 때문에 생성된 후 12시간 이내에 Ignition 구성 파일을 사용하는 것이 좋습니다. 12시간 이내에 Ignition 구성 파일을 사용하면 설치 중에 인증서 업데이트가 실행되는 경우 설치 실패를 방지할 수 있습니다.

중요설치 프로그램에서 생성되는 파일이나 설치 프로그램을 삭제해서는 안 됩니다. 클러스터를 삭제하려면 두 가지가 모두 필요합니다.

-

설치 프로그램에서 생성하는 Ignition 구성 파일에 24시간 후에 만료되는 인증서가 포함되어 있습니다. 이 인증서는 그 후에 갱신됩니다. 인증서를 갱신하기 전에 클러스터가 종료되고 24시간이 지난 후에 클러스터가 다시 시작되면 클러스터는 만료된 인증서를 자동으로 복구합니다. 예외적으로 kubelet 인증서를 복구하려면 대기 중인

15.3.16. 클러스터 상태 확인

설치 중 또는 설치 후 OpenShift Container Platform 클러스터의 상태를 확인할 수 있습니다.

프로세스

클러스터 환경에서 관리자의 kubeconfig 파일을 내보냅니다.

$ export KUBECONFIG=<installation_directory>/auth/kubeconfig 1- 1

<installation_directory>는 설치 파일을 저장한 디렉터리의 경로를 지정합니다.

kubeconfig파일에는 CLI에서 올바른 클러스터 및 API 서버에 클라이언트를 연결하는 데 사용하는 클러스터에 대한 정보가 포함되어 있습니다.배포 후 생성된 컨트롤 플레인 및 컴퓨팅 시스템을 확인합니다.

$ oc get nodes

클러스터 버전을 확인합니다.

$ oc get clusterversion

Operator 상태를 확인합니다.

$ oc get clusteroperator

클러스터에서 실행 중인 모든 Pod를 확인합니다.

$ oc get pods -A

15.3.17. CLI를 사용하여 클러스터에 로그인

클러스터 kubeconfig 파일을 내보내서 기본 시스템 사용자로 클러스터에 로그인할 수 있습니다. kubeconfig 파일에는 CLI에서 올바른 클러스터 및 API 서버에 클라이언트를 연결하는 데 사용하는 클러스터에 대한 정보가 포함되어 있습니다. 이 파일은 클러스터별로 고유하며 OpenShift Container Platform 설치 과정에서 생성됩니다.

사전 요구 사항

- OpenShift Container Platform 클러스터를 배포했습니다.

-

ocCLI를 설치했습니다.

프로세스

kubeadmin인증 정보를 내보냅니다.$ export KUBECONFIG=<installation_directory>/auth/kubeconfig 1- 1

<installation_directory>는 설치 파일을 저장한 디렉터리의 경로를 지정합니다.

내보낸 구성을 사용하여

oc명령을 성공적으로 실행할 수 있는지 확인합니다.$ oc whoami

출력 예

system:admin

추가 리소스

- OpenShift Container Platform 웹 콘솔 액세스 및 이해에 대한 자세한 내용은 웹 콘솔에 액세스를 참조하십시오.

15.3.18. OpenShift Container Platform의 Telemetry 액세스

OpenShift Container Platform 4.9에서는 클러스터 상태 및 업데이트 진행에 대한 메트릭을 제공하기 위해 기본적으로 실행되는 Telemetry 서비스에 인터넷 액세스가 필요합니다. 클러스터가 인터넷에 연결되어 있으면 Telemetry가 자동으로 실행되고 OpenShift Cluster Manager 에 클러스터가 자동으로 등록됩니다.

OpenShift Cluster Manager 인벤토리가 올바르거나 OpenShift Cluster Manager를 사용하여 자동으로 또는 OpenShift Cluster Manager를 사용하여 수동으로 유지 관리되는지 확인한 후 subscription watch를 사용하여 계정 또는 다중 클러스터 수준에서 OpenShift Container Platform 서브스크립션을 추적합니다.

추가 리소스

- Telemetry 서비스에 대한 자세한 내용은 원격 상태 모니터링 정보를 참조하십시오.

15.3.19. 다음 단계

- 클러스터를 사용자 지정합니다.

- 필요한 경우 원격 상태 보고 옵트아웃을 수행할 수 있습니다.

- 노드 포트에 대한 외부 액세스를 활성화해야 하는 경우 노드 포트를 사용하여 Ingress 클러스터 트래픽을 구성합니다.

- 유동 IP 주소를 통한 애플리케이션 트래픽을 허용하도록 RHOSP를 구성하지 않은 경우 유동 IP 주소로 RHOSP 액세스를 구성합니다.