확장 및 성능

프로덕션 환경에서 OpenShift Container Platform 클러스터 스케일링 및 성능 튜닝

초록

1장. 호스트 관련 권장 사례

이 주제에서는 OpenShift Container Platform의 호스트 관련 권장 사례를 설명합니다.

이러한 지침은 OVN(Open Virtual Network)이 아닌 SDN(소프트웨어 정의 네트워킹)을 사용하는 OpenShift Container Platform에 적용됩니다.

1.1. 노드 호스트 관련 권장 사례

OpenShift Container Platform 노드 구성 파일에는 중요한 옵션이 포함되어 있습니다. 예를 들어 두 개의 매개변수 podsPerCore 및 maxPods는 하나의 노드에 대해 예약할 수 있는 최대 Pod 수를 제어합니다.

옵션을 둘 다 사용하는 경우 한 노드의 Pod 수는 두 값 중 작은 값으로 제한됩니다. 이 값을 초과하면 다음과 같은 결과가 발생할 수 있습니다.

- CPU 사용률 증가

- Pod 예약 속도 저하

- 노드의 메모리 크기에 따라 메모리 부족 시나리오 발생

- IP 주소 모두 소진

- 리소스 초과 커밋으로 인한 사용자 애플리케이션 성능 저하

Kubernetes의 경우 단일 컨테이너를 보유한 하나의 Pod에서 실제로 두 개의 컨테이너가 사용됩니다. 두 번째 컨테이너는 실제 컨테이너 시작 전 네트워킹 설정에 사용됩니다. 따라서 10개의 Pod를 실행하는 시스템에서는 실제로 20개의 컨테이너가 실행됩니다.

클라우드 공급자의 디스크 IOPS 제한이 CRI-O 및 kubelet에 영향을 미칠 수 있습니다. 노드에서 다수의 I/O 집약적 Pod가 실행되고 있는 경우 오버로드될 수 있습니다. 노드에서 디스크 I/O를 모니터링하고 워크로드에 대해 처리량이 충분한 볼륨을 사용하는 것이 좋습니다.

podsPerCore는 노드의 프로세서 코어 수에 따라 노드가 실행할 수 있는 Pod 수를 설정합니다. 예를 들어 프로세서 코어가 4개인 노드에서 podsPerCore가 10으로 설정된 경우 노드에 허용되는 최대 Pod 수는 40이 됩니다.

kubeletConfig: podsPerCore: 10

podsPerCore를 0으로 설정하면 이 제한이 비활성화됩니다. 기본값은 0입니다. podsPerCore는 maxPods를 초과할 수 없습니다.

maxPods는 노드의 속성에 관계없이 노드가 실행할 수 있는 Pod 수를 고정된 값으로 설정합니다.

kubeletConfig:

maxPods: 2501.2. KubeletConfig CRD를 생성하여 kubelet 매개변수 편집

kubelet 구성은 현재 Ignition 구성으로 직렬화되어 있으므로 직접 편집할 수 있습니다. 하지만 MCC(Machine Config Controller)에 새 kubelet-config-controller도 추가되어 있습니다. 이를 통해 KubeletConfig CR(사용자 정의 리소스)을 사용하여 kubelet 매개변수를 편집할 수 있습니다.

kubeletConfig 오브젝트의 필드가 Kubernetes 업스트림에서 kubelet으로 직접 전달되므로 kubelet은 해당 값을 직접 검증합니다. kubeletConfig 오브젝트의 값이 유효하지 않으면 클러스터 노드를 사용할 수 없게 될 수 있습니다. 유효한 값은 Kubernetes 설명서를 참조하십시오.

다음 지침 사항을 고려하십시오.

-

해당 풀에 필요한 모든 구성 변경 사항을 사용하여 각 머신 구성 풀에 대해 하나의

KubeletConfigCR을 생성합니다. 모든 풀에 동일한 콘텐츠를 적용하는 경우 모든 풀에 대해 하나의KubeletConfigCR만 필요합니다. -

기존

KubeletConfigCR을 편집하여 각 변경 사항에 대한 CR을 생성하는 대신 기존 설정을 수정하거나 새 설정을 추가합니다. 변경 사항을 되돌릴 수 있도록 다른 머신 구성 풀을 수정하거나 임시로 변경하려는 변경 사항만 수정하기 위해 CR을 생성하는 것이 좋습니다. -

필요에 따라 클러스터당 10개로 제한되는 여러

KubeletConfigCR을 생성합니다. 첫 번째KubeletConfigCR의 경우 MCO(Machine Config Operator)는kubelet에 추가된 머신 구성을 생성합니다. 이후 각 CR을 통해 컨트롤러는 숫자 접미사가 있는 다른kubelet머신 구성을 생성합니다. 예를 들어,-2접미사가 있는kubelet머신 구성이 있는 경우 다음kubelet머신 구성에-3이 추가됩니다.

머신 구성을 삭제하려면 제한을 초과하지 않도록 해당 구성을 역순으로 삭제합니다. 예를 들어 kubelet-2 머신 구성을 삭제하기 전에 kubelet-3 머신 구성을 삭제합니다.

kubelet-9 접미사가 있는 머신 구성이 있고 다른 KubeletConfig CR을 생성하는 경우 kubelet 머신 구성이 10개 미만인 경우에도 새 머신 구성이 생성되지 않습니다.

KubeletConfig CR 예

$ oc get kubeletconfig

NAME AGE set-max-pods 15m

KubeletConfig 머신 구성 표시 예

$ oc get mc | grep kubelet

... 99-worker-generated-kubelet-1 b5c5119de007945b6fe6fb215db3b8e2ceb12511 3.2.0 26m ...

다음 프로세스는 작업자 노드의 각 노드에 대한 최대 Pod 수를 구성하는 방법을 보여줍니다.

사전 요구 사항

구성하려는 노드 유형의 정적

MachineConfigPoolCR와 연관된 라벨을 가져옵니다. 다음 중 하나를 실행합니다.Machine config pool을 표시합니다.

$ oc describe machineconfigpool <name>

예를 들면 다음과 같습니다.

$ oc describe machineconfigpool worker

출력 예

apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfigPool metadata: creationTimestamp: 2019-02-08T14:52:39Z generation: 1 labels: custom-kubelet: set-max-pods 1- 1

- 라벨이 추가되면

labels아래에 표시됩니다.

라벨이 없으면 키/값 쌍을 추가합니다.

$ oc label machineconfigpool worker custom-kubelet=set-max-pods

절차

이 명령은 선택할 수 있는 사용 가능한 머신 구성 오브젝트를 표시합니다.

$ oc get machineconfig

기본적으로 두 개의 kubelet 관련 구성은

01-master-kubelet및01-worker-kubelet입니다.노드당 최대 Pod의 현재 값을 확인하려면 다음을 실행합니다.

$ oc describe node <node_name>

예를 들면 다음과 같습니다.

$ oc describe node ci-ln-5grqprb-f76d1-ncnqq-worker-a-mdv94

Allocatable스탠자에서value: pods: <value>를 찾습니다.출력 예

Allocatable: attachable-volumes-aws-ebs: 25 cpu: 3500m hugepages-1Gi: 0 hugepages-2Mi: 0 memory: 15341844Ki pods: 250

작업자 노드에서 노드당 최대 Pod 수를 설정하려면 kubelet 구성이 포함된 사용자 정의 리소스 파일을 생성합니다.

apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: set-max-pods spec: machineConfigPoolSelector: matchLabels: custom-kubelet: set-max-pods 1 kubeletConfig: maxPods: 500 2참고kubelet이 API 서버와 통신하는 속도는 QPS(초당 쿼리) 및 버스트 값에 따라 달라집니다. 노드마다 실행되는 Pod 수가 제한된 경우 기본 값인

50(kubeAPIQPS인 경우) 및100(kubeAPIBurst인 경우)이면 충분합니다. 노드에 CPU 및 메모리 리소스가 충분한 경우 kubelet QPS 및 버스트 속도를 업데이트하는 것이 좋습니다.apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: set-max-pods spec: machineConfigPoolSelector: matchLabels: custom-kubelet: set-max-pods kubeletConfig: maxPods: <pod_count> kubeAPIBurst: <burst_rate> kubeAPIQPS: <QPS>라벨을 사용하여 작업자의 머신 구성 풀을 업데이트합니다.

$ oc label machineconfigpool worker custom-kubelet=large-pods

KubeletConfig오브젝트를 생성합니다.$ oc create -f change-maxPods-cr.yaml

KubeletConfig오브젝트가 생성되었는지 확인합니다.$ oc get kubeletconfig

출력 예

NAME AGE set-max-pods 15m

클러스터의 작업자 노드 수에 따라 작업자 노드가 하나씩 재부팅될 때까지 기다립니다. 작업자 노드가 3개인 클러스터의 경우 약 10~15분이 걸릴 수 있습니다.

변경 사항이 노드에 적용되었는지 확인합니다.

작업자 노드에서

maxPods값이 변경되었는지 확인합니다.$ oc describe node <node_name>

Allocatable스탠자를 찾습니다.... Allocatable: attachable-volumes-gce-pd: 127 cpu: 3500m ephemeral-storage: 123201474766 hugepages-1Gi: 0 hugepages-2Mi: 0 memory: 14225400Ki pods: 500 1 ...- 1

- 이 예에서

pods매개변수는KubeletConfig오브젝트에 설정한 값을 보고해야 합니다.

KubeletConfig오브젝트에서 변경 사항을 확인합니다.$ oc get kubeletconfigs set-max-pods -o yaml

상태가 표시되어야 합니다. "true"및type:Success:spec: kubeletConfig: maxPods: 500 machineConfigPoolSelector: matchLabels: custom-kubelet: set-max-pods status: conditions: - lastTransitionTime: "2021-06-30T17:04:07Z" message: Success status: "True" type: Success

1.3. 사용할 수 없는 작업자 노드 수 수정

기본적으로 kubelet 관련 구성을 사용 가능한 작업자 노드에 적용하는 경우 하나의 머신만 사용할 수 없는 상태로 둘 수 있습니다. 대규모 클러스터의 경우 구성 변경사항을 반영하는 데 시간이 오래 걸릴 수 있습니다. 언제든지 업데이트하는 머신 수를 조정하여 프로세스 속도를 높일 수 있습니다.

절차

worker머신 구성 풀을 편집합니다.$ oc edit machineconfigpool worker

maxUnavailable을 원하는 값으로 설정합니다.spec: maxUnavailable: <node_count>

중요값을 설정하는 경우 클러스터에서 실행 중인 애플리케이션에 영향을 미치지 않고 사용 가능한 상태로 둘 수 있는 작업자 노드 수를 고려하십시오.

1.4. 컨트롤 플레인 노드 크기 조정

컨트롤 플레인 노드 리소스 요구사항은 클러스터의 노드 수에 따라 달라집니다. 다음 컨트롤 플레인 노드 크기 권장 사항은 컨트롤 플레인 밀도 중심 테스트 결과를 기반으로 합니다. 컨트롤 플레인 테스트에서는 노드 수에 따라 각 네임스페이스의 클러스터에서 다음 오브젝트를 생성합니다.

- 12개의 이미지 스트림

- 3개의 빌드 구성

- 6개의 빌드

- 각각 두 개의 시크릿을 마운트하는 2개의 Pod 복제본이 있는 배포 1개

- 2개의 배포에 1개의 Pod 복제본이 2개의 시크릿을 마운트함

- 이전 배포를 가리키는 서비스 3개

- 이전 배포를 가리키는 경로 3개

- 10개의 시크릿, 이 중 2 개는 이전 배포에 의해 마운트됨

- 10개의 구성 맵, 이 중 두 개는 이전 배포에 의해 마운트됨

| 작업자 노드 수 | 클러스터 로드(네임스페이스) | CPU 코어 수 | 메모리(GB) |

|---|---|---|---|

| 25 | 500 | 4 | 16 |

| 100 | 1000 | 8 | 32 |

| 250 | 4000 | 16 | 96 |

3개의 마스터 또는 컨트롤 플레인 노드가 있는 대규모 및 고밀도 클러스터에서는 노드 중 하나가 중지되거나, 재부팅 또는 실패할 때 CPU 및 메모리 사용량이 증가합니다. 비용 절감을 위해 클러스터를 종료한 후 클러스터를 재시작하는 의도적인 경우 외에도 전원, 네트워크 또는 기본 인프라와 관련된 예기치 않은 문제로 인해 오류가 발생할 수 있습니다. 나머지 두 컨트롤 플레인 노드는 고가용성이 되기 위해 부하를 처리하여 리소스 사용량을 늘려야 합니다. 이는 마스터가 직렬로 연결, 드레이닝, 재부팅되어 운영 체제 업데이트를 적용하고 컨트롤 플레인 Operator 업데이트를 적용하기 때문에 업그레이드 중에도 이 문제가 발생할 수 있습니다. 단계적 오류를 방지하려면 컨트롤 플레인 노드의 전체 CPU 및 메모리 리소스 사용량을 리소스 사용량 급증을 처리하기 위해 사용 가능한 모든 용량의 60%로 유지합니다. 리소스 부족으로 인한 다운타임을 방지하기 위해 컨트롤 플레인 노드에서 CPU 및 메모리를 늘립니다.

노드 크기 조정은 클러스터의 노드 수와 개체 수에 따라 달라집니다. 또한 클러스터에서 개체가 현재 생성되는지에 따라 달라집니다. 개체 생성 중에 컨트롤 플레인은 개체가 running 단계에 있을 때보다 리소스 사용량 측면에서 더 활성화됩니다.

OLM(Operator Lifecycle Manager)은 컨트롤 플레인 노드에서 실행되며, 메모리 공간은 OLM이 클러스터에서 관리해야 하는 네임스페이스 및 사용자 설치된 operator 수에 따라 다릅니다. OOM이 종료되지 않도록 컨트를 플레인 노드의 크기를 적절하게 조정해야 합니다. 다음 데이터 지점은 클러스터 최대값 테스트 결과를 기반으로 합니다.

| 네임스페이스 수 | 유휴 상태의 OLM 메모리(GB) | 5명의 사용자 operator가 설치된 OLM 메모리(GB) |

|---|---|---|

| 500 | 0.823 | 1.7 |

| 1000 | 1.2 | 2.5 |

| 1500 | 1.7 | 3.2 |

| 2000 | 2 | 4.4 |

| 3000 | 2.7 | 5.6 |

| 4000 | 3.8 | 7.6 |

| 5000 | 4.2 | 9.02 |

| 6000 | 5.8 | 11.3 |

| 7000 | 6.6 | 12.9 |

| 8000 | 6.9 | 14.8 |

| 9000 | 8 | 17.7 |

| 10,000 | 9.9 | 21.6 |

설치 관리자 프로비저닝 인프라 설치 방법을 사용하는 경우 실행 중인 OpenShift Container Platform 4.8 클러스터에서 컨트롤 플레인 노드 크기를 변경할 수 없습니다. 대신 총 노드 수를 추정하고 설치하는 동안 권장되는 컨트롤 플레인 노드 크기를 사용해야 합니다.

권장 사항은 OpenShift SDN이 있는 OpenShift Container Platform 클러스터에서 네트워크 플러그인으로 캡처된 데이터 포인트를 기반으로 합니다.

OpenShift Container Platform 3.11 및 이전 버전과 비교하면, OpenShift Container Platform 4.8에서는 기본적으로 CPU 코어의 절반(500밀리코어)이 시스템에 의해 예약되어 있습니다. 이러한 점을 고려하여 크기가 결정됩니다.

1.4.1. AWS(Amazon Web Services) 마스터 인스턴스의 플레이버 크기 증가

클러스터에 AWS 마스터 노드에 과부하가 발생하고 마스터 노드에 더 많은 리소스가 필요한 경우 마스터 인스턴스의 플레이버 크기를 늘릴 수 있습니다.

AWS 마스터 인스턴스의 플레이버 크기를 늘리기 전에 etcd를 백업하는 것이 좋습니다.

사전 요구 사항

- AWS에 IPI(설치 프로그램 프로비저닝 인프라) 또는 UPI(사용자 프로비저닝 인프라) 클러스터가 있습니다.

절차

- AWS 콘솔을 열고 마스터 인스턴스를 가져옵니다.

- 하나의 마스터 인스턴스를 중지합니다.

- 중지된 인스턴스를 선택하고 작업 → 인스턴스 설정 → 인스턴스 유형 변경을 클릭합니다.

-

인스턴스를 더 큰 유형으로 변경하고 유형이 이전 선택과 동일한 기본인지 확인하고 변경 사항을 적용합니다. 예를 들어

m5.xlarge를 m로 변경할 수 있습니다.5.2xlarge또는m5.4xlarge - 인스턴스를 백업하고 다음 master 인스턴스에 대한 단계를 반복합니다.

추가 리소스

1.5. etcd 관련 권장 사례

etcd는 디스크에 데이터를 쓰고 디스크에 제안을 유지하므로 디스크 성능에 따라 성능이 달라집니다. etcd는 특별히 I/O 집약적이 아니지만 성능과 안정성을 최적화하려면 대기 시간이 짧은 블록 장치가 필요합니다. etcd의 비관성 프로토콜은 메타데이터를 로그에 영구적으로 저장하는 데 따라 달라지므로 etcd는 디스크 쓰기 대기 시간에 민감합니다. 디스크 속도가 느리고 다른 프로세스의 디스크 활동이 길어지면 fsync 대기 시간이 길어질 수 있습니다.

이러한 대기 시간 동안 etcd가 하트비트를 놓치고 새 제안을 제때 디스크에 커밋하지 않고 궁극적으로 요청 시간 초과 및 임시 리더 손실이 발생할 수 있습니다. 또한 쓰기 대기 시간이 길면 OpenShift API 속도가 느려 클러스터 성능에 영향을 미칩니다. 이러한 이유로 컨트롤 플레인 노드에서 다른 워크로드가 배치되지 않도록 합니다.

대기 시간에서는 블록 장치 위에서 etcd를 실행하여 8000바이트 이상의 IOPS를 순차적으로 작성할 수 있습니다. 즉, 대기 시간이 20ms인 경우 fdatasync를 사용하여 WAL의 각 쓰기를 동기화하는 것을 염두에 두십시오. 로드된 클러스터의 경우 8000바이트(2ms)의 순차적 500 IOPS를 사용하는 것이 좋습니다. 이 숫자를 측정하려면 fio와 같은 벤치마킹 도구를 사용할 수 있습니다.

이러한 성능을 얻으려면 대기 시간이 짧고 처리량이 높은 SSD 또는 NVMe 디스크가 지원되는 머신에서 etcd를 실행하십시오. 메모리 셀당 1 비트를 제공하고, 내구성이 있고 신뢰할 수 있으며 쓰기 집약적인 워크로드에 이상적입니다.

다음 하드 디스크 기능은 최적의 etcd 성능을 제공합니다.

- 빠른 읽기 작업을 지원하기 위한 대기 시간이 짧습니다.

- 더 빠른 압축 및 조각 모음을 위한 높은 대역폭 쓰기

- 고 대역폭 읽기를 통해 실패로 인한 복구 속도가 빨라집니다.

- 솔리드 스테이트 드라이브는 최소 선택이지만 NVMe 드라이브가 우선합니다.

- 신뢰성을 높이기 위해 다양한 제조 업체의 서버 등급 하드웨어.

- 성능 향상을 위한 RAID 0 기술

- 전용 etcd 드라이브 etcd 드라이브에 로그 파일 또는 기타 많은 워크로드를 배치하지 마십시오.

NAS 또는 SAN 설정 및 회전 드라이브를 사용하지 마십시오. 항상 fio와 같은 유틸리티를 사용하여 벤치마크를 수행합니다. 증가하는 동안 클러스터 성능을 지속적으로 모니터링합니다.

NFS(Network File System) 프로토콜 또는 기타 네트워크 기반 파일 시스템을 사용하지 마십시오.

배포된 OpenShift Container Platform 클러스터에서 모니터링하기 위한 몇 가지 주요 메트릭은 etcd 디스크 미리 쓰기 시 미리 쓰기 시간 및 etcd 리더 변경 횟수입니다. 이러한 지표를 추적하려면 Prometheus를 사용하십시오.

OpenShift Container Platform 클러스터를 생성하기 전이나 후에 etcd 하드웨어를 확인하려면 fio를 사용할 수 있습니다.

사전 요구 사항

- Podman 또는 Docker와 같은 컨테이너 런타임은 테스트 중인 머신에 설치됩니다.

-

데이터는

/var/lib/etcd경로에 작성됩니다.

프로세스

Fio를 실행하고 결과를 분석합니다.

Podman을 사용하는 경우 다음 명령을 실행합니다.

$ sudo podman run --volume /var/lib/etcd:/var/lib/etcd:Z quay.io/openshift-scale/etcd-perf

Docker를 사용하는 경우 다음 명령을 실행합니다.

$ sudo docker run --volume /var/lib/etcd:/var/lib/etcd:Z quay.io/openshift-scale/etcd-perf

실행에서 캡처된 fsync 지표의 99번째 백분위수를 비교하여 20ms 미만인지 확인하여 디스크 속도가 etcd를 호스팅하기에 충분한지 여부를 출력에서 보고합니다. I/O 성능의 영향을 받을 수 있는 가장 중요한 etcd 지표 중 일부는 다음과 같습니다.

-

etcd_disk_wal_fsync_duration_seconds_bucket지표가 etcd의 WAL fsync 기간 보고 -

etcd_disk_backend_commit_duration_seconds_bucket지표에서 etcd 백엔드 커밋 대기 시간 보고 -

etcd_server_leader_changes_seen_total지표에서 리더 변경을 보고

etcd는 모든 멤버 간에 요청을 복제하므로 성능은 네트워크 입력/출력(I/O) 대기 시간에 따라 크게 달라집니다. 네트워크 대기 시간이 길면 etcd 하트비트가 선택 시간 초과보다 오래 걸리므로 리더 선택이 발생하여 클러스터가 손상될 수 있습니다. 배포된 OpenShift Container Platform 클러스터에서 모니터링되는 주요 메트릭은 각 etcd 클러스터 멤버에서 etcd 네트워크 피어 대기 시간의 99번째 백분위 수입니다. 이러한 메트릭을 추적하려면 Prometheus를 사용하십시오.

histogram_quantile(0.99, rate(etcd_network_peer_round_trip_time_seconds_bucket[2m]) 지표에서 etcd가 멤버 간 클라이언트 요청을 복제하기 위한 왕복 시간을 보고합니다. 50ms보다 작은지 확인하십시오.

1.6. etcd 데이터 조각 모음

대규모 및 밀도가 높은 클러스터의 경우 키 공간이 너무 커져서 공간 할당량을 초과하면 etcd 성능이 저하될 수 있습니다. 주기적으로 etcd를 유지 관리하고 조각 모음하여 데이터 저장소에서 공간을 확보합니다. etcd 지표에 대한 Prometheus를 모니터링하고 필요한 경우 조각 모음을 모니터링합니다. 그러지 않으면 etcd에서 키 읽기 및 삭제만 수락하는 유지 관리 모드로 클러스터를 배치하는 클러스터 전체 알람을 생성할 수 있습니다.

다음 주요 메트릭을 모니터링합니다.

-

etcd_server_quota_backend_bytes, 현재 할당량 제한 -

etcd_mvcc_db_total_size_in_use_in_bytes. 이는 기록 압축 후 실제 데이터베이스 사용량을 나타냅니다. -

etcd_debugging_mvcc_db_total_size_in_bytes. 여기에는 조각 모음 대기 중인 여유 공간을 포함하여 데이터베이스 크기가 표시됩니다.

etcd 기록 압축과 같은 디스크 조각화를 초래하는 이벤트 후 디스크 공간을 회수하기 위해 etcd 데이터를 조각 모음합니다.

기록 압축은 5분마다 자동으로 수행되며 백엔드 데이터베이스에서 공백이 남습니다. 이 분할된 공간은 etcd에서 사용할 수 있지만 호스트 파일 시스템에서 사용할 수 없습니다. 호스트 파일 시스템에서 이 공간을 사용할 수 있도록 etcd 조각을 정리해야 합니다.

etcd는 디스크에 데이터를 쓰기 때문에 etcd 성능은 디스크 성능에 따라 크게 달라집니다. 매달 또는 한달에 한 두 번 또는 클러스터에 필요한 경우 etcd를 조각을 정리하는 것이 좋습니다. etcd_db_total_size_in_bytes 메트릭을 모니터링하여 조각 모음이 필요한지 여부를 결정할 수도 있습니다.

PromQL 표현식을 사용하여 조각 모음을 사용하여 해제할 etcd 데이터베이스 크기를 MB 단위로 확인하여 조각 모음이 필요한지 여부를 확인할 수도 있습니다. (etcd_mvcc_db_total_size_in_in_bytes - etcd_mvcc_in_in_use_in_bytes)/1024/1024

etcd를 분리하는 것은 차단 작업입니다. 조각화 처리가 완료될 때까지 etcd 멤버는 응답하지 않습니다. 따라서 각 pod의 조각 모음 작업 간에 클러스터가 정상 작동을 재개할 수 있도록 1분 이상 대기해야 합니다.

각 etcd 멤버의 etcd 데이터 조각 모음을 수행하려면 다음 절차를 따릅니다.

사전 요구 사항

-

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있어야 합니다.

절차

리더가 최종 조각화 처리를 수행하므로 어떤 etcd 멤버가 리더인지 확인합니다.

etcd pod 목록을 가져옵니다.

$ oc get pods -n openshift-etcd -o wide | grep -v quorum-guard | grep etcd

출력 예

etcd-ip-10-0-159-225.example.redhat.com 3/3 Running 0 175m 10.0.159.225 ip-10-0-159-225.example.redhat.com <none> <none> etcd-ip-10-0-191-37.example.redhat.com 3/3 Running 0 173m 10.0.191.37 ip-10-0-191-37.example.redhat.com <none> <none> etcd-ip-10-0-199-170.example.redhat.com 3/3 Running 0 176m 10.0.199.170 ip-10-0-199-170.example.redhat.com <none> <none>

Pod를 선택하고 다음 명령을 실행하여 어떤 etcd 멤버가 리더인지 확인합니다.

$ oc rsh -n openshift-etcd etcd-ip-10-0-159-225.example.redhat.com etcdctl endpoint status --cluster -w table

출력 예

Defaulting container name to etcdctl. Use 'oc describe pod/etcd-ip-10-0-159-225.example.redhat.com -n openshift-etcd' to see all of the containers in this pod. +---------------------------+------------------+---------+---------+-----------+------------+-----------+------------+--------------------+--------+ | ENDPOINT | ID | VERSION | DB SIZE | IS LEADER | IS LEARNER | RAFT TERM | RAFT INDEX | RAFT APPLIED INDEX | ERRORS | +---------------------------+------------------+---------+---------+-----------+------------+-----------+------------+--------------------+--------+ | https://10.0.191.37:2379 | 251cd44483d811c3 | 3.4.9 | 104 MB | false | false | 7 | 91624 | 91624 | | | https://10.0.159.225:2379 | 264c7c58ecbdabee | 3.4.9 | 104 MB | false | false | 7 | 91624 | 91624 | | | https://10.0.199.170:2379 | 9ac311f93915cc79 | 3.4.9 | 104 MB | true | false | 7 | 91624 | 91624 | | +---------------------------+------------------+---------+---------+-----------+------------+-----------+------------+--------------------+--------+

이 출력의

ISLEADER 열에 따르면https://10.0.199.170:2379엔드 포인트가 리더입니다. 이전 단계의 출력과 이 앤드 포인트가 일치하면 리더의 Pod 이름은etcd-ip-10-0199-170.example.redhat.com입니다.

etcd 멤버를 분리합니다.

실행중인 etcd 컨테이너에 연결하고 리더가 아닌 pod 이름을 전달합니다.

$ oc rsh -n openshift-etcd etcd-ip-10-0-159-225.example.redhat.com

ETCDCTL_ENDPOINTS환경 변수를 설정 해제합니다.sh-4.4# unset ETCDCTL_ENDPOINTS

etcd 멤버를 분리합니다.

sh-4.4# etcdctl --command-timeout=30s --endpoints=https://localhost:2379 defrag

출력 예

Finished defragmenting etcd member[https://localhost:2379]

시간 초과 오류가 발생하면 명령이 성공할 때까지

--command-timeout의 값을 늘립니다.데이터베이스 크기가 감소되었는지 확인합니다.

sh-4.4# etcdctl endpoint status -w table --cluster

출력 예

+---------------------------+------------------+---------+---------+-----------+------------+-----------+------------+--------------------+--------+ | ENDPOINT | ID | VERSION | DB SIZE | IS LEADER | IS LEARNER | RAFT TERM | RAFT INDEX | RAFT APPLIED INDEX | ERRORS | +---------------------------+------------------+---------+---------+-----------+------------+-----------+------------+--------------------+--------+ | https://10.0.191.37:2379 | 251cd44483d811c3 | 3.4.9 | 104 MB | false | false | 7 | 91624 | 91624 | | | https://10.0.159.225:2379 | 264c7c58ecbdabee | 3.4.9 | 41 MB | false | false | 7 | 91624 | 91624 | | 1 | https://10.0.199.170:2379 | 9ac311f93915cc79 | 3.4.9 | 104 MB | true | false | 7 | 91624 | 91624 | | +---------------------------+------------------+---------+---------+-----------+------------+-----------+------------+--------------------+--------+이 예에서는 etcd 멤버의 데이터베이스 크기가 시작 크기인 104MB와 달리 현재 41MB임을 보여줍니다.

다음 단계를 반복하여 다른 etcd 멤버에 연결하고 조각 모음을 수행합니다. 항상 리더의 조각 모음을 마지막으로 수행합니다.

etcd pod가 복구될 수 있도록 조각 모음 작업에서 1분 이상 기다립니다. etcd pod가 복구될 때까지 etcd 멤버는 응답하지 않습니다.

공간 할당량을 초과하여

NOSPACE경고가 발생하는 경우 이를 지우십시오.NOSPACE경고가 있는지 확인합니다.sh-4.4# etcdctl alarm list

출력 예

memberID:12345678912345678912 alarm:NOSPACE

경고를 지웁니다.

sh-4.4# etcdctl alarm disarm

1.7. OpenShift Container Platform 인프라 구성 요소

다음 인프라 워크로드에서는 OpenShift Container Platform 작업자 서브스크립션이 발생하지 않습니다.

- 마스터에서 실행되는 Kubernetes 및 OpenShift Container Platform 컨트롤 플레인 서비스

- 기본 라우터

- 통합된 컨테이너 이미지 레지스트리

- HAProxy 기반 Ingress 컨트롤러

- 사용자 정의 프로젝트를 모니터링하기위한 구성 요소를 포함한 클러스터 메트릭 수집 또는 모니터링 서비스

- 클러스터 집계 로깅

- 서비스 브로커

- Red Hat Quay

- Red Hat OpenShift Container Storage

- Red Hat Advanced Cluster Manager

- Red Hat Advanced Cluster Security for Kubernetes

- Red Hat OpenShift GitOps

- Red Hat OpenShift Pipelines

다른 컨테이너, Pod 또는 구성 요소를 실행하는 모든 노드는 서브스크립션을 적용해야 하는 작업자 노드입니다.

추가 리소스

- 인프라 노드 및 인프라 노드에서 실행할 수 있는 구성 요소에 대한 자세한 내용은 엔터프라이즈 Kubernetes 문서의 OpenShift 크기 조정 및 서브스크립션 가이드의 "Red Hat OpenShift 컨트롤 플레인 및 인프라 노드" 섹션을 참조하십시오.

1.8. 모니터링 솔루션 이동

모니터링 스택에는 Prometheus, Grafana, Alertmanager를 포함한 여러 구성 요소가 포함됩니다. Cluster Monitoring Operator는 이 스택을 관리합니다. 모니터링 스택을 인프라 노드에 재배포하려면 사용자 정의 구성 맵을 생성하고 적용할 수 있습니다.

프로세스

cluster-monitoring-config구성 맵을 편집하고infra레이블을 사용하도록nodeSelector를 변경합니다.$ oc edit configmap cluster-monitoring-config -n openshift-monitoring

apiVersion: v1 kind: ConfigMap metadata: name: cluster-monitoring-config namespace: openshift-monitoring data: config.yaml: |+ alertmanagerMain: nodeSelector: 1 node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute prometheusK8s: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute prometheusOperator: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute grafana: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute k8sPrometheusAdapter: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute kubeStateMetrics: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute telemeterClient: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute openshiftStateMetrics: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute thanosQuerier: nodeSelector: node-role.kubernetes.io/infra: "" tolerations: - key: node-role.kubernetes.io/infra value: reserved effect: NoSchedule - key: node-role.kubernetes.io/infra value: reserved effect: NoExecute모니터링 pod가 새 머신으로 이동하는 것을 확인합니다.

$ watch 'oc get pod -n openshift-monitoring -o wide'

구성 요소가

infra노드로 이동하지 않은 경우 이 구성 요소가 있는 pod를 제거합니다.$ oc delete pod -n openshift-monitoring <pod>

삭제된 pod의 구성 요소가

infra노드에 다시 생성됩니다.

1.9. 기본 레지스트리 이동

Pod를 다른 노드에 배포하도록 레지스트리 Operator를 구성합니다.

전제 조건

- OpenShift Container Platform 클러스터에서 추가 머신 세트를 구성합니다.

프로세스

config/instance개체를 표시합니다.$ oc get configs.imageregistry.operator.openshift.io/cluster -o yaml

출력 예

apiVersion: imageregistry.operator.openshift.io/v1 kind: Config metadata: creationTimestamp: 2019-02-05T13:52:05Z finalizers: - imageregistry.operator.openshift.io/finalizer generation: 1 name: cluster resourceVersion: "56174" selfLink: /apis/imageregistry.operator.openshift.io/v1/configs/cluster uid: 36fd3724-294d-11e9-a524-12ffeee2931b spec: httpSecret: d9a012ccd117b1e6616ceccb2c3bb66a5fed1b5e481623 logging: 2 managementState: Managed proxy: {} replicas: 1 requests: read: {} write: {} storage: s3: bucket: image-registry-us-east-1-c92e88cad85b48ec8b312344dff03c82-392c region: us-east-1 status: ...config/instance개체를 편집합니다.$ oc edit configs.imageregistry.operator.openshift.io/cluster

spec: affinity: podAntiAffinity: preferredDuringSchedulingIgnoredDuringExecution: - podAffinityTerm: namespaces: - openshift-image-registry topologyKey: kubernetes.io/hostname weight: 100 logLevel: Normal managementState: Managed nodeSelector: 1 node-role.kubernetes.io/infra: "" tolerations: - effect: NoSchedule key: node-role.kubernetes.io/infra value: reserved - effect: NoExecute key: node-role.kubernetes.io/infra value: reserved- 1

- 적절한 값이 설정된

nodeSelector매개변수를 이동하려는 구성 요소에 추가합니다. 표시된 형식으로nodeSelector를 사용하거나 노드에 지정된 값에 따라<key>: <value>쌍을 사용할 수 있습니다. 인프라 노드에 테인트를 추가한 경우 일치하는 톨러레이션도 추가합니다.

레지스트리 pod가 인프라 노드로 이동되었는지 검증합니다.

다음 명령을 실행하여 레지스트리 pod가 있는 노드를 식별합니다.

$ oc get pods -o wide -n openshift-image-registry

노드에 지정된 레이블이 있는지 확인합니다.

$ oc describe node <node_name>

명령 출력을 확인하고

node-role.kubernetes.io/infra가LABELS목록에 있는지 확인합니다.

1.10. 라우터 이동

라우터 Pod를 다른 머신 세트에 배포할 수 있습니다. 기본적으로 Pod는 작업자 노드에 배포됩니다.

전제 조건

- OpenShift Container Platform 클러스터에서 추가 머신 세트를 구성합니다.

프로세스

라우터 Operator의

IngressController사용자 정의 리소스를 표시합니다.$ oc get ingresscontroller default -n openshift-ingress-operator -o yaml

명령 출력은 다음 예제와 유사합니다.

apiVersion: operator.openshift.io/v1 kind: IngressController metadata: creationTimestamp: 2019-04-18T12:35:39Z finalizers: - ingresscontroller.operator.openshift.io/finalizer-ingresscontroller generation: 1 name: default namespace: openshift-ingress-operator resourceVersion: "11341" selfLink: /apis/operator.openshift.io/v1/namespaces/openshift-ingress-operator/ingresscontrollers/default uid: 79509e05-61d6-11e9-bc55-02ce4781844a spec: {} status: availableReplicas: 2 conditions: - lastTransitionTime: 2019-04-18T12:36:15Z status: "True" type: Available domain: apps.<cluster>.example.com endpointPublishingStrategy: type: LoadBalancerService selector: ingresscontroller.operator.openshift.io/deployment-ingresscontroller=defaultingresscontroller리소스를 편집하고infra레이블을 사용하도록nodeSelector를 변경합니다.$ oc edit ingresscontroller default -n openshift-ingress-operator

spec: nodePlacement: nodeSelector: 1 matchLabels: node-role.kubernetes.io/infra: "" tolerations: - effect: NoSchedule key: node-role.kubernetes.io/infra value: reserved - effect: NoExecute key: node-role.kubernetes.io/infra value: reserved- 1

- 적절한 값이 설정된

nodeSelector매개변수를 이동하려는 구성 요소에 추가합니다. 표시된 형식으로nodeSelector를 사용하거나 노드에 지정된 값에 따라<key>: <value>쌍을 사용할 수 있습니다. 인프라 노드에 테인트를 추가한 경우 일치하는 허용 오차도 추가합니다.

라우터 pod가

infra노드에서 실행되고 있는지 확인합니다.라우터 pod 목록을 표시하고 실행중인 pod의 노드 이름을 기록해 둡니다.

$ oc get pod -n openshift-ingress -o wide

출력 예

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES router-default-86798b4b5d-bdlvd 1/1 Running 0 28s 10.130.2.4 ip-10-0-217-226.ec2.internal <none> <none> router-default-955d875f4-255g8 0/1 Terminating 0 19h 10.129.2.4 ip-10-0-148-172.ec2.internal <none> <none>

이 예에서 실행중인 pod는

ip-10-0-217-226.ec2.internal노드에 있습니다.실행중인 pod의 노드 상태를 표시합니다.

$ oc get node <node_name> 1- 1

- pod 목록에서 얻은

<node_name>을 지정합니다.

출력 예

NAME STATUS ROLES AGE VERSION ip-10-0-217-226.ec2.internal Ready infra,worker 17h v1.21.0

역할 목록에

infra가 포함되어 있으므로 pod가 올바른 노드에서 실행됩니다.

1.11. 인프라 노드 크기 조정

인프라 노드는 OpenShift Container Platform 환경의 일부를 실행하도록 레이블이 지정된 노드입니다. 인프라 노드 리소스 요구사항은 클러스터 사용 기간, 노드, 클러스터의 오브젝트에 따라 달라집니다. 이러한 요인으로 인해 Prometheus의 지표 또는 시계열 수가 증가할 수 있기 때문입니다. 다음 인프라 노드 크기 권장 사항은 클러스터 최대값 및 컨트롤 플레인 밀도 중심 테스트 결과를 기반으로 합니다.

| 작업자 노드 수 | CPU 코어 수 | 메모리(GB) |

|---|---|---|

| 25 | 4 | 16 |

| 100 | 8 | 32 |

| 250 | 16 | 128 |

| 500 | 32 | 128 |

일반적으로 클러스터당 세 개의 인프라 노드를 사용하는 것이 좋습니다.

이러한 크기 조정 권장 사항은 클러스터에서 많은 수의 오브젝트를 생성하는 스케일링 테스트를 기반으로 합니다. 이 테스트에는 일부 클러스터 최대값에 도달하는 테스트가 포함되어 있습니다. OpenShift Container Platform 4.8 클러스터에서 노드 수가 250~500개인 경우 최대값은 Pod가 61,000개, 배포가 10,000개, 보안이 181,000개, 구성 맵이 400개 등인 네임스페이스 10,000개입니다. Prometheus는 고도의 메모리 집약적 애플리케이션입니다. 리소스 사용량은 노드 수, 오브젝트, Prometheus 지표 스크래핑 간격, 지표 또는 시계열, 클러스터 사용 기간 등 다양한 요인에 따라 달라집니다. 디스크 크기도 보존 기간에 따라 달라집니다. 이와 같은 요인을 고려하여 적절하게 크기를 조정해야 합니다.

이러한 크기 조정 권장 사항은 클러스터 설치 중에 설치되는 인프라 구성 요소인 Prometheus, 라우터 및 레지스트리에만 적용됩니다. 로깅은 Day 2 작업에서 이러한 권장 사항은 포함되어 있지 않습니다.

OpenShift Container Platform 3.11 및 이전 버전과 비교하면, OpenShift Container Platform 4.8에서는 기본적으로 CPU 코어의 절반(500밀리코어)이 시스템에 의해 예약되어 있습니다. 명시된 크기 조정 권장 사항은 이러한 요인의 영향을 받습니다.

1.12. 추가 리소스

2장. IBM Z 및 LinuxONE 환경에 대한 권장 호스트 사례

이 주제에서는 IBM Z 및 LinuxONE의 OpenShift Container Platform에 대한 호스트 권장 사례를 설명합니다.

s390x 아키텍처는 여러 면에서 고유합니다. 따라서 여기에 제시된 일부 권장 사항은 다른 플랫폼에 적용되지 않을 수 있습니다.

별도로 명시하지 않는 한, 이러한 방법은 IBM Z 및 LinuxONE에 z/VM 및 RHEL(Red Hat Enterprise Linux) KVM 설치에 모두 적용됩니다.

2.1. CPU 과다 할당 관리

고도로 가상화된 IBM Z 환경에서는 인프라 설정 및 크기 조정을 신중하게 계획해야 합니다. 가상화의 가장 중요한 기능 중 하나는 리소스 과다 할당을 수행하여 하이퍼바이저 수준에서 실제로 사용 가능한 것보다 가상 시스템에 더 많은 리소스를 할당하는 기능입니다. 이 방법은 워크로드에 따라 다르며 모든 설정에 적용할 수 있는 결정적인 규칙이 없습니다.

설정에 따라 CPU 과다 할당과 관련된 모범 사례를 고려하십시오.

- LPAR 레벨(PR/SM 하이퍼바이저)에서는 사용 가능한 모든 물리적 코어(IFL)를 각 LPAR에 할당하지 않도록 합니다. 예를 들어, 물리적 IFL 4개를 사용할 수 있는 경우 각각 4개의 논리적 IFL이 있는 3개의 LPAR을 정의해서는 안 됩니다.

- LPAR 공유 및 가중치 확인 및 이해.

- 과도한 가상 CPU 수는 성능에 부정적인 영향을 줄 수 있습니다. 논리 프로세서가 LPAR에 정의된 것보다 게스트에 더 많은 가상 프로세서를 정의하지 마십시오.

- 게스트당 가상 프로세서 수를 최대 업무 부하가 아닌 구성.

- 소규모로 시작하고 워크로드를 모니터링합니다. 필요에 따라 vCPU 수를 점진적으로 늘립니다.

- 모든 워크로드가 높은 과다 할당 비율에 적합한 것은 아닙니다. 워크로드가 CPU를 많이 사용하는 경우 성능 문제 없이 높은 비율을 달성할 수 없을 것입니다. I/O 집약성이 높은 워크로드는 높은 과다 할당 비율을 통해서도 일관된 성능을 유지할 수 있습니다.

2.2. Transparent Huge Pages 비활성화

THP(Transparent Huge Pages)는 대규모 페이지를 생성, 관리 및 사용하는 대부분의 측면을 자동화하려고 합니다. THP는 대규모 페이지를 자동으로 관리하므로 모든 유형의 워크로드에 대해 항상 최적으로 처리되지는 않습니다. THP는 많은 애플리케이션에서 자체적으로 대규모 페이지를 처리하므로 성능 저하가 발생할 수 있습니다. 따라서 THP를 비활성화하는 것이 좋습니다.

2.3. 수신 흐름으로 네트워킹 성능 향상

RFS(Receive Packet Buildering)는 네트워크 대기 시간을 추가로 줄임으로써 수신 패킷 제거(RPS)를 확장합니다. ss는 기술적으로 RPS를 기반으로 하며 CPU 캐시 적중 속도를 늘려 패킷 처리 효율성을 향상시킵니다. 이를 통해 이를 달성하고, 캐시 적중이 CPU 내에서 발생할 가능성이 높아지도록 계산에 가장 편리한 CPU를 결정함으로써 대기열 길이를 고려합니다. 따라서 CPU 캐시가 무효화되고 캐시를 다시 빌드하려면 더 적은 사이클이 필요합니다. 이렇게 하면 패킷 처리 실행 시간을 줄일 수 있습니다.

2.3.1. MCO(Machine Config Operator)를 사용하여 HFSS 활성화

절차

다음 MCO 샘플 프로필을 YAML 파일에 복사합니다. 예를 들어

enable-rfs.yaml:apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: worker name: 50-enable-rfs spec: config: ignition: version: 2.2.0 storage: files: - contents: source: data:text/plain;charset=US-ASCII,%23%20turn%20on%20Receive%20Flow%20Steering%20%28RFS%29%20for%20all%20network%20interfaces%0ASUBSYSTEM%3D%3D%22net%22%2C%20ACTION%3D%3D%22add%22%2C%20RUN%7Bprogram%7D%2B%3D%22/bin/bash%20-c%20%27for%20x%20in%20/sys/%24DEVPATH/queues/rx-%2A%3B%20do%20echo%208192%20%3E%20%24x/rps_flow_cnt%3B%20%20done%27%22%0A filesystem: root mode: 0644 path: /etc/udev/rules.d/70-persistent-net.rules - contents: source: data:text/plain;charset=US-ASCII,%23%20define%20sock%20flow%20enbtried%20for%20%20Receive%20Flow%20Steering%20%28RFS%29%0Anet.core.rps_sock_flow_entries%3D8192%0A filesystem: root mode: 0644 path: /etc/sysctl.d/95-enable-rps.confMCO 프로필을 생성합니다.

$ oc create -f enable-rfs.yaml

50-enable-rfs라는 항목이 나열되는지확인합니다.$ oc get mc

비활성화하려면 다음을 입력합니다.

$ oc delete mc 50-enable-rfs

추가 리소스

- IBM Z의 OpenShift Container Platform: an network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the network performance with the

- 수신 흐름 제거(RFS) 구성

- Linux 네트워킹 스택에서 확장

2.4. 네트워크 설정을 선택하십시오

네트워킹 스택은 OpenShift Container Platform과 같은 Kubernetes 기반 제품에 가장 중요한 구성 요소 중 하나입니다. IBM Z 설정의 경우 네트워킹 설정은 선택한 하이퍼바이저에 따라 다릅니다. 워크로드 및 애플리케이션에 따라 일반적으로 사용 사례 및 트래픽 패턴에 따라 가장 적합한 것이 좋습니다.

설정에 따라 다음 모범 사례를 고려하십시오.

- 트래픽 패턴을 최적화하려면 네트워킹 장치와 관련된 모든 옵션을 고려하십시오. OSA-Express, RoCE Express, HiperSockets, z/VM VSwitch, Linux Bridge(KVM) 등의 장점을 살펴보고 설치 시 가장 큰 이점을 제공하는 옵션을 결정하십시오.

- 항상 사용 가능한 최신 NIC 버전을 사용합니다. 예를 들어 OSA Express 7S 10 GbE는 모두 10GbE 어댑터이지만 트랜잭션 워크로드 유형의 OSA Express 6S 10GbE에 비해 훨씬 향상되었습니다.

- 각 가상 스위치는 추가 대기 시간 계층을 추가합니다.

- 로드 밸런서는 클러스터 외부의 네트워크 통신에 중요한 역할을 합니다. 애플리케이션이 중요한 경우 프로덕션급 하드웨어 로드 밸런서를 사용하는 것이 좋습니다.

- OpenShift Container Platform SDN에는 네트워킹 성능에 영향을 주는 흐름과 규칙이 도입되었습니다. 통신이 중요한 서비스의 지역으로부터 혜택을 받으려면 포드 선호도 및 배치를 고려해야 합니다.

- 성능과 기능 간의 장단점 균형을 맞추십시오.

2.5. z/VM에서 HyperPAV로 높은 디스크 성능 확인

DASD 및 ECKD 장치는 일반적으로 IBM Z 환경에서 디스크 유형으로 사용됩니다. z/VM 환경의 일반적인 OpenShift Container Platform 설정에서 DASD 디스크는 노드의 로컬 스토리지를 지원하는 데 일반적으로 사용됩니다. z/VM 게스트를 지원하는 DASD 디스크에 대해 더 많은 처리량과 전반적으로 개선된 I/O 성능을 제공하도록 HyperPAV 별칭 장치를 설정할 수 있습니다.

로컬 스토리지 장치에 HyperPAV를 사용하면 성능이 크게 향상됩니다. 그러나 처리량과 CPU 비용 간에 장단점이 있다는 점에 유의해야 합니다.

2.5.1. z/VM full-pack minidisks를 사용하여 노드에서 HyperPAV 별칭을 활성화하려면 MCO(Machine Config Operator)를 사용합니다.

전체 팩 미니 디스크를 사용하는 z/VM 기반 OpenShift Container Platform 설정의 경우 모든 노드에서 HyperPAV 별칭을 활성화하여 MCO 프로필의 이점을 활용할 수 있습니다. 컨트롤 플레인 및 컴퓨팅 노드 모두에 YAML 구성을 추가해야 합니다.

절차

다음 MCO 샘플 프로필을 컨트롤 플레인 노드의 YAML 파일에 복사합니다. 예를 들면

05-master-kernelarg-hpav.yaml:$ cat 05-master-kernelarg-hpav.yaml apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: master name: 05-master-kernelarg-hpav spec: config: ignition: version: 3.1.0 kernelArguments: - rd.dasd=800-805다음 MCO 샘플 프로필을 계산 노드의 YAML 파일에 복사합니다. 예를 들면

05-worker-kernelarg-hpav.yaml:$ cat 05-worker-kernelarg-hpav.yaml apiVersion: machineconfiguration.openshift.io/v1 kind: MachineConfig metadata: labels: machineconfiguration.openshift.io/role: worker name: 05-worker-kernelarg-hpav spec: config: ignition: version: 3.1.0 kernelArguments: - rd.dasd=800-805참고장치 ID에 맞게

rd.dasd인수를 수정해야 합니다.MCO 프로필을 생성합니다.

$ oc create -f 05-master-kernelarg-hpav.yaml

$ oc create -f 05-worker-kernelarg-hpav.yaml

비활성화하려면 다음을 입력합니다.

$ oc delete -f 05-master-kernelarg-hpav.yaml

$ oc delete -f 05-worker-kernelarg-hpav.yaml

2.6. IBM Z 호스트의 RHEL KVM 권장 사항

KVM 가상 서버 환경 최적화는 가상 서버의 워크로드와 사용 가능한 리소스에 따라 크게 달라집니다. 한 환경에서 성능을 개선하는 것과 동일한 조치는 다른 환경에서 부정적인 영향을 미칠 수 있습니다. 특정 설정의 최적의 균형을 찾는 것은 어려운 일이며, 종종 실험이 필요합니다.

다음 섹션에서는 IBM Z 및 LinuxONE 환경에서 RHEL KVM과 함께 OpenShift Container Platform을 사용할 때 몇 가지 모범 사례를 소개합니다.

2.6.1. VirtIO 네트워크 인터페이스에 여러 큐 사용

여러 가상 CPU를 사용하면 들어오고 나가는 패킷에 여러 큐를 제공하는 경우 동시에 패키지를 전송할 수 있습니다. 드라이버 요소의 queues 특성을 사용하여 여러 큐를 구성합니다. 가상 서버의 가상 CPU 수를 초과하지 않는 정수 2를 지정합니다.

다음 예제 사양은 네트워크 인터페이스에 대해 두 개의 입력 및 출력 대기열을 구성합니다.

<interface type="direct">

<source network="net01"/>

<model type="virtio"/>

<driver ... queues="2"/>

</interface>다중 대기열은 네트워크 인터페이스에 향상된 성능을 제공하도록 설계되었지만 메모리 및 CPU 리소스도 사용합니다. 사용 중인 인터페이스에 사용할 두 개의 큐 정의로 시작합니다. 그런 다음 사용 중인 인터페이스에 대해 트래픽이 적거나 대기열이 2개 이상인 인터페이스에 대해 두 개의 대기열을 시도합니다.

2.6.2. 가상 블록 장치에 I/O 스레드 사용

가상 블록 장치가 I/O 스레드를 사용하도록 하려면 이러한 I/O 스레드 중 하나를 사용하도록 가상 서버 및 각 가상 블록 장치에 대해 하나 이상의 I/O 스레드를 구성해야 합니다.

다음 예제에서는 연속 10진수 스레드 ID 1, 2 및 3을 사용하여 3개의 I /O 스레드를 구성하도록 <iothreads>3</iothreads>를 지정합니다. The iothread" 매개 변수는 ID 2와 함께 I/O 스레드를 사용하도록 디스크 장치의 드라이버 요소를 지정합니다.

I/O 스레드 사양 샘플

... <domain> <iothreads>3</iothreads>1 ... <devices> ... <disk type="block" device="disk">2 <driver ... iothread="2"/> </disk> ... </devices> ... </domain>

스레드는 디스크 장치의 I/O 작업의 성능을 향상시킬 수 있지만 메모리 및 CPU 리소스도 사용합니다. 동일한 스레드를 사용하도록 여러 장치를 구성할 수 있습니다. 스레드를 장치에 가장 잘 매핑하는 방법은 사용 가능한 리소스 및 워크로드에 따라 다릅니다.

소수의 I/O 스레드로 시작합니다. 종종 모든 디스크 장치에 대한 단일 I/O 스레드만으로 충분합니다. 가상 CPU 수보다 많은 스레드를 구성하지 말고 유휴 스레드를 구성하지 마십시오.

virsh iothreadadd 명령을 사용하여 실행 중인 가상 서버에 특정 스레드 ID가 있는 I/O 스레드를 추가할 수 있습니다.

2.6.3. 가상 SCSI 장치 방지

SCSI별 인터페이스를 통해 장치를 해결해야 하는 경우에만 가상 SCSI 장치를 구성합니다. 호스트의 백업과 관계없이 디스크 공간을 가상 SCSI 장치가 아닌 가상 블록 장치로 구성합니다.

그러나 다음을 위해 SCSI 관련 인터페이스가 필요할 수 있습니다.

- 호스트에서 SCSI 연결 테이프 드라이브의 LUN입니다.

- 가상 DVD 드라이브에 마운트된 호스트 파일 시스템의 DVD ISO 파일입니다.

2.6.4. 디스크에 게스트 캐싱 설정

호스트가 아닌 게스트가 캐싱을 수행하도록 디스크 장치를 구성합니다.

디스크 장치의 드라이버 요소에 cache="none" 및 매개변수가 포함되어 있는지 확인합니다.

io="native"

<disk type="block" device="disk">

<driver name="qemu" type="raw" cache="none" io="native" iothread="1"/>

...

</disk>2.6.5. 메모리 증대 장치 제외

동적 메모리 크기가 필요하지 않은 경우 메모리 balloon 장치를 정의하지 말고 libvirt가 사용자를 위해 파일을 생성하지 않도록 합니다. memballoon 매개 변수를 도메인 구성 XML 파일의 devices 요소의 하위 항목으로 포함합니다.

활성 프로파일 목록을 확인합니다.

<memballoon model="none"/>

2.6.6. 호스트 스케줄러의 CPU 마이그레이션 알고리즘 조정

결과를 이해하는 전문가인 경우가 아니면 스케줄러 설정을 변경하지 마십시오. 테스트하지 않고 프로덕션 시스템에 변경 사항을 적용하지 않고 변경 사항을 적용하고 의도한 영향을 미치는지 확인하지 마십시오.

kernel.sched_migration_cost_ns 매개변수는 나노초 단위로 시간 간격을 지정합니다. 작업을 마지막으로 실행한 후에는 이 간격이 만료될 때까지 CPU 캐시에 유용한 콘텐츠가 있는 것으로 간주됩니다. 이 간격을 늘리면 작업 마이그레이션이 줄어듭니다. 기본값은 500000 ns입니다.

실행 가능한 프로세스가 있을 때 CPU 유휴 시간이 예상보다 크면 이 간격을 줄이십시오. CPU 또는 노드 간에 너무 자주 바운싱되는 경우 작업을 늘리십시오.

간격을 60000 ns로 동적으로 설정하려면 다음 명령을 입력합니다.

# sysctl kernel.sched_migration_cost_ns=60000

값을 60000 ns로 영구적으로 변경하려면 /etc/sysctl.conf에 다음 항목을 추가합니다.

kernel.sched_migration_cost_ns=60000

2.6.7. cpuset cgroup 컨트롤러 비활성화

이 설정은 cgroup 버전 1이 있는 KVM 호스트에만 적용됩니다. 호스트에서 CPU 핫플러그를 활성화하려면 cgroup 컨트롤러를 비활성화합니다.

절차

-

선택한 편집기를 사용하여

/etc/libvirt/qemu.conf를 엽니다. -

cgroup_controllers행으로 이동합니다. - 전체 행을 복제하고 복사에서 선행 기호(#)를 제거합니다.

다음과 같이

cpuset항목을 제거합니다.cgroup_controllers = [ "cpu", "devices", "memory", "blkio", "cpuacct" ]

새 설정을 적용하려면 libvirtd 데몬을 다시 시작해야 합니다.

- 모든 가상 시스템을 중지합니다.

다음 명령을 실행합니다.

# systemctl restart libvirtd

- 가상 시스템을 다시 시작합니다.

이 설정은 호스트 재부팅 시 유지됩니다.

2.6.8. 유휴 가상 CPU의 폴링 기간 조정

가상 CPU가 유휴 상태가 되면 KVM은 호스트 리소스를 할당하기 전에 가상 CPU의 시작 조건을 폴링합니다. /sys/module/kvm/parameters/halt_poll_ns 의 sysfs에서 폴링이 발생하는 시간 간격을 지정할 수 있습니다. 지정된 시간 동안 폴링을 수행하면 리소스 사용량을 희생할 때 가상 CPU의 대기 시간이 줄어듭니다. 워크로드에 따라 폴링 시간이 길거나 짧을 수 있습니다. 시간 간격은 나노초 단위로 지정됩니다. 기본값은 50000 ns입니다.

낮은 CPU 소비를 최적화하려면 작은 값을 입력하거나 0을 작성하여 폴링을 비활성화합니다.

# echo 0 > /sys/module/kvm/parameters/halt_poll_ns

트랜잭션 워크로드의 경우 대기 시간이 짧도록 최적화하려면 큰 값을 입력합니다.

# echo 80000 > /sys/module/kvm/parameters/halt_poll_ns

3장. 클러스터 스케일링 관련 권장 사례

이 섹션의 지침은 클라우드 공급자 통합을 통한 설치에만 관련이 있습니다.

이러한 지침은 OVN(Open Virtual Network)이 아닌 SDN(소프트웨어 정의 네트워킹)을 사용하는 OpenShift Container Platform에 적용됩니다.

다음 모범 사례를 적용하여 OpenShift Container Platform 클러스터의 작업자 머신 수를 스케일링하십시오. 작업자 머신 세트에 정의된 복제본 수를 늘리거나 줄여 작업자 머신을 스케일링합니다.

3.1. 클러스터 스케일링에 대한 권장 사례

노드 수가 많아지도록 클러스터를 확장하는 경우 다음을 수행합니다.

- 고가용성을 위해 모든 사용 가능한 영역으로 노드를 분산합니다.

- 한 번에 확장하는 머신 수가 25~50개를 넘지 않도록 합니다.

- 주기적인 공급자 용량 제약 조건을 완화하는 데 도움이 되도록 유사한 크기의 대체 인스턴스 유형을 사용하여 사용 가능한 각 영역에 새 머신 세트를 생성하는 것을 고려해 봅니다. 예를 들어 AWS에서 m5.large 및 m5d.large를 사용합니다.

클라우드 제공자는 API 서비스 할당량을 구현할 수 있습니다. 따라서 점진적으로 클러스터를 스케일링하십시오.

머신 세트의 복제본이 한 번에 모두 더 높은 숫자로 설정되면 컨트롤러가 머신을 생성하지 못할 수 있습니다. OpenShift Container Platform이 배포된 클라우드 플랫폼에서 처리할 수 있는 요청 수는 프로세스에 영향을 미칩니다. 컨트롤러는 상태를 사용하여 머신을 생성하고, 점검하고, 업데이트하는 동안 더 많이 쿼리하기 시작합니다. OpenShift Container Platform이 배포된 클라우드 플랫폼에는 API 요청 제한이 있으며 과도한 쿼리는 클라우드 플랫폼 제한으로 인한 머신 생성 실패로 이어질 수 있습니다.

노드 수가 많아지도록 스케일링하는 경우 머신 상태 점검을 활성화하십시오. 실패가 발생하면 상태 점검에서 상태를 모니터링하고 비정상 머신을 자동으로 복구합니다.

대규모 및 밀도가 높은 클러스터의 노드 수를 줄이는 경우 이 프로세스가 종료할 노드에서 실행되는 개체의 드레이닝 또는 제거가 동시에 실행되기 때문에 많은 시간이 걸릴 수 있습니다. 또한 제거할 개체가 너무 많으면 클라이언트 요청 처리에 병목 현상이 발생할 수 있습니다. 기본 클라이언트 QPS 및 버스트 비율은 현재 5 및 10으로 각각 설정되어 있으며 OpenShift Container Platform에서 수정할 수 없습니다.

3.2. 머신 세트 수정

머신 세트를 변경하려면 MachineSet YAML을 편집합니다. 다음으로 각 머신을 삭제하거나 복제본 수가 0이 되도록 머신 세트를 축소하여 머신 세트와 연관된 모든 머신을 제거합니다. 복제본을 필요한 수로 다시 조정합니다. 머신 세트를 변경해도 기존 머신에는 영향을 미치지 않습니다.

다른 변경을 수행하지 않고 머신 세트를 스케일링해야 하는 경우 머신을 삭제할 필요가 없습니다.

기본적으로 OpenShift Container Platform 라우터 Pod는 작업자에게 배포됩니다. 라우터는 웹 콘솔을 포함한 일부 클러스터 리소스에 액세스해야 하므로 먼저 라우터 Pod를 재배치하지 않는 한 작업자 머신 세트를 0으로 스케일링하지 마십시오.

전제 조건

-

OpenShift Container Platform 클러스터 및

oc명령행을 설치합니다. -

cluster-admin권한이 있는 사용자로oc에 로그인합니다.

프로세스

머신 세트를 편집합니다.

$ oc edit machineset <machineset> -n openshift-machine-api

머신 세트를

0으로 축소합니다.$ oc scale --replicas=0 machineset <machineset> -n openshift-machine-api

또는 다음을 수행합니다.

$ oc edit machineset <machineset> -n openshift-machine-api

작은 정보다음 YAML을 적용하여 머신 세트를 확장할 수도 있습니다.

apiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: name: <machineset> namespace: openshift-machine-api spec: replicas: 0

머신이 제거될 때까지 기다립니다.

필요에 따라 머신 세트를 확장합니다.

$ oc scale --replicas=2 machineset <machineset> -n openshift-machine-api

또는 다음을 수행합니다.

$ oc edit machineset <machineset> -n openshift-machine-api

작은 정보다음 YAML을 적용하여 머신 세트를 확장할 수도 있습니다.

apiVersion: machine.openshift.io/v1beta1 kind: MachineSet metadata: name: <machineset> namespace: openshift-machine-api spec: replicas: 2

머신이 시작될 때까지 기다립니다. 새 머신에는 머신 세트에 대한 변경사항이 포함되어 있습니다.

3.3. 머신 상태 점검 정보

머신 상태 점검에서는 특정 머신 풀의 비정상적인 머신을 자동으로 복구합니다.

머신 상태를 모니터링하기 위해 컨트롤러 구성을 정의할 리소스를 만듭니다. NotReady 상태를 5 분 동안 유지하거나 노드 문제 탐지기(node-problem-detector)에 영구적인 조건을 표시하는 등 검사할 조건과 모니터링할 머신 세트의 레이블을 설정합니다.

마스터 역할이 있는 머신에는 머신 상태 점검을 적용할 수 없습니다.

MachineHealthCheck 리소스를 관찰하는 컨트롤러에서 정의된 상태를 확인합니다. 머신이 상태 확인에 실패하면 머신이 자동으로 삭제되고 대체할 머신이 만들어집니다. 머신이 삭제되면 machine deleted 이벤트가 표시됩니다.

머신 삭제로 인한 영향을 제한하기 위해 컨트롤러는 한 번에 하나의 노드 만 드레인하고 삭제합니다. 대상 머신 풀에서 허용된 maxUnhealthy 임계값 보다 많은 비정상적인 머신이 있는 경우 수동 개입이 수행될 수 있도록 복구가 중지됩니다.

워크로드 및 요구 사항을 살펴보고 신중하게 시간 초과를 고려하십시오.

- 시간 제한이 길어지면 비정상 머신의 워크로드에 대한 다운타임이 길어질 수 있습니다.

-

시간 초과가 너무 짧으면 수정 루프가 발생할 수 있습니다. 예를 들어

NotReady상태를 확인하는 시간은 머신이 시작 프로세스를 완료할 수 있을 만큼 충분히 길어야 합니다.

검사를 중지하려면 리소스를 제거합니다.

예를 들어 클러스터의 노드를 일시적으로 사용할 수 없게 되므로 업그레이드 프로세스 중에 검사를 중지해야 합니다. MachineHealthCheck는 비정상적인 노드를 식별하고 재부팅할 수 있습니다. 이러한 노드를 재부팅하지 않으려면 클러스터를 업데이트하기 전에 배포한 MachineHealthCheck 리소스를 제거합니다. 그러나 기본적으로 배포되는 MachineHealthCheck 리소스(예: machine-api-termination-handler)는 제거할 수 없으며 다시 생성됩니다.

3.3.1. 머신 상태 검사 배포 시 제한 사항

머신 상태 점검을 배포하기 전에 고려해야 할 제한 사항은 다음과 같습니다.

- 머신 세트가 소유한 머신만 머신 상태 검사를 통해 업데이트를 적용합니다.

- 컨트롤 플레인 시스템은 현재 지원되지 않으며 비정상적인 경우 업데이트 적용되지 않습니다.

- 머신의 노드가 클러스터에서 제거되면 머신 상태 점검에서 이 머신을 비정상적으로 간주하고 즉시 업데이트를 적용합니다.

-

nodeStartupTimeout후 시스템의 해당 노드가 클러스터에 참여하지 않으면 업데이트가 적용됩니다. -

Machine리소스 단계가Failed하면 즉시 머신에 업데이트를 적용합니다.

3.4. MachineHealthCheck 리소스 샘플

베어 메탈 이외의 모든 클라우드 기반 설치 유형에 대한 MachineHealthCheck 리소스는 다음 YAML 파일과 유사합니다.

apiVersion: machine.openshift.io/v1beta1 kind: MachineHealthCheck metadata: name: example 1 namespace: openshift-machine-api spec: selector: matchLabels: machine.openshift.io/cluster-api-machine-role: <role> 2 machine.openshift.io/cluster-api-machine-type: <role> 3 machine.openshift.io/cluster-api-machineset: <cluster_name>-<label>-<zone> 4 unhealthyConditions: - type: "Ready" timeout: "300s" 5 status: "False" - type: "Ready" timeout: "300s" 6 status: "Unknown" maxUnhealthy: "40%" 7 nodeStartupTimeout: "10m" 8

- 1

- 배포할 머신 상태 점검의 이름을 지정합니다.

- 2 3

- 확인할 머신 풀의 레이블을 지정합니다.

- 4

- 추적할 머신 세트를

<cluster_name>-<label>-<zone>형식으로 지정합니다. 예를 들어prod-node-us-east-1a입니다. - 5 6

- 노드 상태에 대한 시간 제한을 지정합니다. 시간 제한 기간 중 상태가 일치되면 머신이 수정됩니다. 시간 제한이 길어지면 비정상 머신의 워크로드에 대한 다운타임이 길어질 수 있습니다.

- 7

- 대상 풀에서 동시에 복구할 수 있는 시스템 수를 지정합니다. 이는 백분율 또는 정수로 설정할 수 있습니다. 비정상 머신의 수가

maxUnhealthy에서의 설정 제한을 초과하면 복구가 수행되지 않습니다. - 8

- 머신 상태가 비정상으로 확인되기 전에 노드가 클러스터에 참여할 때까지 기다려야 하는 시간 초과 기간을 지정합니다.

matchLabels는 예제일 뿐입니다. 특정 요구에 따라 머신 그룹을 매핑해야 합니다.

3.4.1. 쇼트 서킷 (Short Circuit) 머신 상태 점검 및 수정

쇼트 서킷 (Short Circuit)은 클러스터가 정상일 경우에만 머신 상태 점검을 통해 머신을 조정합니다. 쇼트 서킷은 MachineHealthCheck 리소스의 maxUnhealthy 필드를 통해 구성됩니다.

사용자가 시스템을 조정하기 전에 maxUnhealthy 필드 값을 정의하는 경우 MachineHealthCheck는 비정상적으로 결정된 대상 풀 내의 maxUnhealthy 값과 비교합니다. 비정상 머신의 수가 maxUnhealthy 제한을 초과하면 수정을 위한 업데이트가 수행되지 않습니다.

maxUnhealthy가 설정되지 않은 경우 기본값은 100%로 설정되고 클러스터 상태와 관계없이 머신이 수정됩니다.

적절한 maxUnhealthy 값은 배포하는 클러스터의 규모와 MachineHealthCheck에서 다루는 시스템 수에 따라 달라집니다. 예를 들어 maxUnhealthy 값을 사용하여 여러 가용 영역에서 여러 머신 세트를 처리할 수 있으므로 전체 영역을 손실하면 maxUnhealthy 설정이 클러스터 내에서 추가 수정을 방지 할 수 있습니다.

maxUnhealthy 필드는 정수 또는 백분율로 설정할 수 있습니다. maxUnhealthy 값에 따라 다양한 수정을 적용할 수 있습니다.

3.4.1.1. 절대 값을 사용하여 maxUnhealthy 설정

maxUnhealthy가 2로 설정된 경우

- 2개 이상의 노드가 비정상인 경우 수정을 위한 업데이트가 수행됩니다.

- 3개 이상의 노드가 비정상이면 수정을 위한 업데이트가 수행되지 않습니다

이러한 값은 머신 상태 점검에서 확인할 수 있는 머신 수와 관련이 없습니다.

3.4.1.2. 백분율을 사용하여 maxUnhealthy 설정

maxUnhealthy가 40%로 설정되어 있고 25 대의 시스템이 확인되고 있는 경우 다음을 수행하십시오.

- 10개 이상의 노드가 비정상인 경우 수정을 위한 업데이트가 수행됩니다.

- 11개 이상의 노드가 비정상인 경우 수정을 위한 업데이트가 수행되지 않습니다.

maxUnhealthy가 40%로 설정되어 있고 6 대의 시스템이 확인되고 있는 경우 다음을 수행하십시오.

- 2개 이상의 노드가 비정상인 경우 수정을 위한 업데이트가 수행됩니다.

- 3개 이상의 노드가 비정상이면 수정을 위한 업데이트가 수행되지 않습니다

maxUnhealthy 머신의 백분율이 정수가 아닌 경우 허용되는 머신 수가 반올림됩니다.

3.5. MachineHealthCheck 리소스 만들기

클러스터의 모든 MachineSets에 대해 MachineHealthCheck 리소스를 생성할 수 있습니다. 컨트롤 플레인 시스템을 대상으로 하는 MachineHealthCheck 리소스를 생성해서는 안 됩니다.

사전 요구 사항

-

oc명령행 인터페이스를 설치합니다.

프로세스

-

머신 상태 점검 정의가 포함된

healthcheck.yml파일을 생성합니다. healthcheck.yml파일을 클러스터에 적용합니다.$ oc apply -f healthcheck.yml

4장. Node Tuning Operator 사용

Node Tuning Operator에 대해 알아보고, Node Tuning Operator를 사용하여 Tuned 데몬을 오케스트레이션하고 노드 수준 튜닝을 관리하는 방법도 알아봅니다.

4.1. Node Tuning Operator 정보

Node Tuning Operator는 TuneD 데몬을 오케스트레이션하여 노드 수준 튜닝을 관리하는 데 도움이 됩니다. 대부분의 고성능 애플리케이션에는 일정 수준의 커널 튜닝이 필요합니다. Node Tuning Operator는 노드 수준 sysctls 사용자에게 통합 관리 인터페이스를 제공하며 사용자의 필요에 따라 지정되는 사용자 정의 튜닝을 추가할 수 있는 유연성을 제공합니다.

Operator는 OpenShift Container Platform의 컨테이너화된 TuneD 데몬을 Kubernetes 데몬 세트로 관리합니다. 클러스터에서 실행되는 모든 컨테이너화된 TuneD 데몬에 사용자 정의 튜닝 사양이 데몬이 이해할 수 있는 형식으로 전달되도록 합니다. 데몬은 클러스터의 모든 노드에서 노드당 하나씩 실행됩니다.

컨테이너화된 TuneD 데몬을 통해 적용되는 노드 수준 설정은 프로필 변경을 트리거하는 이벤트 시 또는 컨테이너화된 TuneD 데몬이 종료 신호를 수신하고 처리하여 정상적으로 종료될 때 롤백됩니다.

버전 4.1 이상에서는 Node Tuning Operator가 표준 OpenShift Container Platform 설치에 포함되어 있습니다.

4.2. Node Tuning Operator 사양 예에 액세스

이 프로세스를 사용하여 Node Tuning Operator 사양 예에 액세스하십시오.

프로세스

다음을 실행합니다.

$ oc get Tuned/default -o yaml -n openshift-cluster-node-tuning-operator

기본 CR은 OpenShift Container Platform 플랫폼의 표준 노드 수준 튜닝을 제공하기 위한 것이며 Operator 관리 상태를 설정하는 경우에만 수정할 수 있습니다. Operator는 기본 CR에 대한 다른 모든 사용자 정의 변경사항을 덮어씁니다. 사용자 정의 튜닝의 경우 고유한 Tuned CR을 생성합니다. 새로 생성된 CR은 노드 또는 Pod 라벨 및 프로필 우선 순위에 따라 OpenShift Container Platform 노드에 적용된 기본 CR 및 사용자 정의 튜닝과 결합됩니다.

특정 상황에서는 Pod 라벨에 대한 지원이 필요한 튜닝을 자동으로 제공하는 편리한 방법일 수 있지만 이러한 방법은 권장되지 않으며 특히 대규모 클러스터에서는 이러한 방법을 사용하지 않는 것이 좋습니다. 기본 Tuned CR은 Pod 라벨이 일치되지 않은 상태로 제공됩니다. Pod 라벨이 일치된 상태로 사용자 정의 프로필이 생성되면 해당 시점에 이 기능이 활성화됩니다. Pod 레이블 기능은 Node Tuning Operator의 향후 버전에서 더 이상 사용되지 않을 수 있습니다.

4.3. 클러스터에 설정된 기본 프로필

다음은 클러스터에 설정된 기본 프로필입니다.

apiVersion: tuned.openshift.io/v1

kind: Tuned

metadata:

name: default

namespace: openshift-cluster-node-tuning-operator

spec:

profile:

- name: "openshift"

data: |

[main]

summary=Optimize systems running OpenShift (parent profile)

include=${f:virt_check:virtual-guest:throughput-performance}

[selinux]

avc_cache_threshold=8192

[net]

nf_conntrack_hashsize=131072

[sysctl]

net.ipv4.ip_forward=1

kernel.pid_max=>4194304

net.netfilter.nf_conntrack_max=1048576

net.ipv4.conf.all.arp_announce=2

net.ipv4.neigh.default.gc_thresh1=8192

net.ipv4.neigh.default.gc_thresh2=32768

net.ipv4.neigh.default.gc_thresh3=65536

net.ipv6.neigh.default.gc_thresh1=8192

net.ipv6.neigh.default.gc_thresh2=32768

net.ipv6.neigh.default.gc_thresh3=65536

vm.max_map_count=262144

[sysfs]

/sys/module/nvme_core/parameters/io_timeout=4294967295

/sys/module/nvme_core/parameters/max_retries=10

- name: "openshift-control-plane"

data: |

[main]

summary=Optimize systems running OpenShift control plane

include=openshift

[sysctl]

# ktune sysctl settings, maximizing i/o throughput

#

# Minimal preemption granularity for CPU-bound tasks:

# (default: 1 msec# (1 + ilog(ncpus)), units: nanoseconds)

kernel.sched_min_granularity_ns=10000000

# The total time the scheduler will consider a migrated process

# "cache hot" and thus less likely to be re-migrated

# (system default is 500000, i.e. 0.5 ms)

kernel.sched_migration_cost_ns=5000000

# SCHED_OTHER wake-up granularity.

#

# Preemption granularity when tasks wake up. Lower the value to

# improve wake-up latency and throughput for latency critical tasks.

kernel.sched_wakeup_granularity_ns=4000000

- name: "openshift-node"

data: |

[main]

summary=Optimize systems running OpenShift nodes

include=openshift

[sysctl]

net.ipv4.tcp_fastopen=3

fs.inotify.max_user_watches=65536

fs.inotify.max_user_instances=8192

recommend:

- profile: "openshift-control-plane"

priority: 30

match:

- label: "node-role.kubernetes.io/master"

- label: "node-role.kubernetes.io/infra"

- profile: "openshift-node"

priority: 404.4. TuneD 프로필이 적용되었는지 검증

클러스터 노드에 적용되는 TuneD 프로필을 확인합니다.

$ oc get profile -n openshift-cluster-node-tuning-operator

출력 예

NAME TUNED APPLIED DEGRADED AGE master-0 openshift-control-plane True False 6h33m master-1 openshift-control-plane True False 6h33m master-2 openshift-control-plane True False 6h33m worker-a openshift-node True False 6h28m worker-b openshift-node True False 6h28m

-

NAME: Profile 오브젝트의 이름입니다. 노드당 하나의 Profile 오브젝트가 있고 해당 이름이 일치합니다. -

TUNED: 적용할 TuneD 프로필의 이름입니다. -

적용됨: TuneD 데몬이 원하는 프로필을 적용한 경우True입니다. (True/False/Unknown). -

DEGRADED: TuneD 프로파일 적용 중에 오류가 보고된 경우True/False/Unknown입니다. -

AGE: Profile 오브젝트 생성 이후 경과 시간입니다.

4.5. 사용자 정의 튜닝 사양

Operator의 CR(사용자 정의 리소스)에는 두 가지 주요 섹션이 있습니다. 첫 번째 섹션인 profile:은 TuneD 프로필 및 해당 이름의 목록입니다. 두 번째인 recommend:은 프로필 선택 논리를 정의합니다.

여러 사용자 정의 튜닝 사양은 Operator의 네임스페이스에 여러 CR로 존재할 수 있습니다. 새로운 CR의 존재 또는 오래된 CR의 삭제는 Operator에서 탐지됩니다. 기존의 모든 사용자 정의 튜닝 사양이 병합되고 컨테이너화된 TuneD 데몬의 해당 오브젝트가 업데이트됩니다.

관리 상태

Operator 관리 상태는 기본 Tuned CR을 조정하여 설정됩니다. 기본적으로 Operator는 Managed 상태이며 기본 Tuned CR에는 spec.managementState 필드가 없습니다. Operator 관리 상태에 유효한 값은 다음과 같습니다.

- Managed: 구성 리소스가 업데이트되면 Operator가 해당 피연산자를 업데이트합니다.

- Unmanaged: Operator가 구성 리소스에 대한 변경을 무시합니다.

- Removed: Operator가 프로비저닝한 해당 피연산자 및 리소스를 Operator가 제거합니다.

프로필 데이터

profile: 섹션에는 TuneD 프로필 및 해당 이름이 나열됩니다.

profile:

- name: tuned_profile_1

data: |

# TuneD profile specification

[main]

summary=Description of tuned_profile_1 profile

[sysctl]

net.ipv4.ip_forward=1

# ... other sysctl's or other TuneD daemon plugins supported by the containerized TuneD

# ...

- name: tuned_profile_n

data: |

# TuneD profile specification

[main]

summary=Description of tuned_profile_n profile

# tuned_profile_n profile settings권장 프로필

profile: 선택 논리는 CR의 recommend: 섹션에 의해 정의됩니다. recommend: 섹션은 선택 기준에 따라 프로필을 권장하는 항목의 목록입니다.

recommend: <recommend-item-1> # ... <recommend-item-n>

목록의 개별 항목은 다음과 같습니다.

- machineConfigLabels: 1 <mcLabels> 2 match: 3 <match> 4 priority: <priority> 5 profile: <tuned_profile_name> 6 operand: 7 debug: <bool> 8

- 1

- 선택 사항입니다.

- 2

- 키/값

MachineConfig라벨 사전입니다. 키는 고유해야 합니다. - 3

- 생략하면 우선 순위가 높은 프로필이 먼저 일치되거나

machineConfigLabels가 설정되어 있지 않으면 프로필이 일치하는 것으로 가정합니다. - 4

- 선택사항 목록입니다.

- 5

- 프로필 순서 지정 우선 순위입니다. 숫자가 작을수록 우선 순위가 높습니다(

0이 가장 높은 우선 순위임). - 6

- 일치에 적용할 TuneD 프로필입니다. 예를 들어

tuned_profile_1이 있습니다. - 7

- 선택적 피연산자 구성입니다.

- 8

- TuneD 데몬의 디버깅을 켜거나 끕니다. off의 경우 on 또는

false의 경우 옵션이true입니다. 기본값은false입니다.

<match>는 다음과 같이 재귀적으로 정의되는 선택사항 목록입니다.

- label: <label_name> 1 value: <label_value> 2 type: <label_type> 3 <match> 4

<match>를 생략하지 않으면 모든 중첩 <match> 섹션도 true로 평가되어야 합니다. 생략하면 false로 가정하고 해당 <match> 섹션이 있는 프로필을 적용하지 않거나 권장하지 않습니다. 따라서 중첩(하위 <match> 섹션)은 논리 AND 연산자 역할을 합니다. 반대로 <match> 목록의 항목이 일치하면 전체 <match> 목록이 true로 평가됩니다. 따라서 이 목록이 논리 OR 연산자 역할을 합니다.

machineConfigLabels 가 정의되면 지정된 recommend: 목록 항목에 대해 머신 구성 풀 기반 일치가 설정됩니다. <mcLabels> 는 머신 구성의 라벨을 지정합니다. 머신 구성은 <tuned_profile_name> 프로필에 대해 커널 부팅 매개변수와 같은 호스트 설정을 적용하기 위해 자동으로 생성됩니다. 여기에는 <mcLabels>와 일치하는 머신 구성 선택기가 있는 모든 머신 구성 풀을 찾고 머신 구성 풀이 할당된 모든 노드에서 <tuned_profile_name> 프로필을 설정하는 작업이 포함됩니다. 마스터 및 작업자 역할이 모두 있는 노드를 대상으로 하려면 마스터 역할을 사용해야 합니다.

목록 항목 match 및 machineConfigLabels는 논리 OR 연산자로 연결됩니다. match 항목은 단락 방식으로 먼저 평가됩니다. 따라서 true로 평가되면 machineConfigLabels 항목이 고려되지 않습니다.

머신 구성 풀 기반 일치를 사용하는 경우 동일한 하드웨어 구성을 가진 노드를 동일한 머신 구성 풀로 그룹화하는 것이 좋습니다. 이 방법을 따르지 않으면 TuneD 피연산자가 동일한 머신 구성 풀을 공유하는 두 개 이상의 노드에 대해 충돌하는 커널 매개변수를 계산할 수 있습니다.

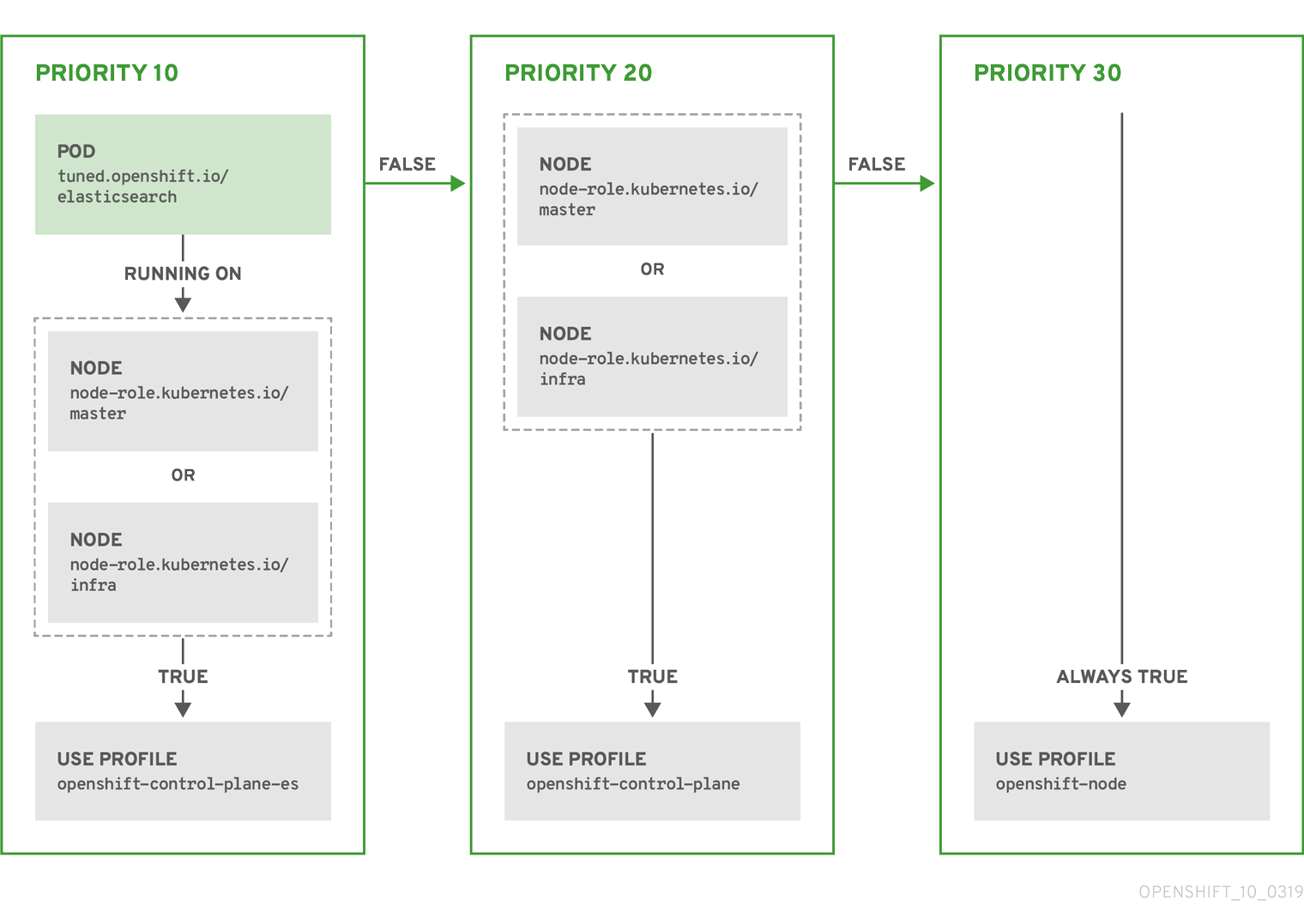

예: 노드 또는 Pod 라벨 기반 일치

- match:

- label: tuned.openshift.io/elasticsearch

match:

- label: node-role.kubernetes.io/master

- label: node-role.kubernetes.io/infra

type: pod

priority: 10

profile: openshift-control-plane-es

- match:

- label: node-role.kubernetes.io/master

- label: node-role.kubernetes.io/infra

priority: 20

profile: openshift-control-plane

- priority: 30

profile: openshift-node

위의 CR은 컨테이너화된 TuneD 데몬의 프로필 우선 순위에 따라 recommended.conf 파일로 변환됩니다. 우선 순위가 가장 높은 프로필(10)이 openshift-control-plane-es이므로 이 프로필을 첫 번째로 고려합니다. 지정된 노드에서 실행되는 컨테이너화된 TuneD 데몬은 tuned.openshift.io/elasticsearch 라벨이 설정된 동일한 노드에서 실행되는 Pod가 있는지 확인합니다. 없는 경우 전체 <match> 섹션이 false로 평가됩니다. 라벨이 있는 Pod가 있는 경우 <match> 섹션을 true로 평가하려면 노드 라벨도 node-role.kubernetes.io/master 또는 node-role.kubernetes.io/infra여야 합니다.

우선 순위가 10인 프로필의 라벨이 일치하면 openshift-control-plane-es 프로필이 적용되고 다른 프로필은 고려되지 않습니다. 노드/Pod 라벨 조합이 일치하지 않으면 두 번째로 높은 우선 순위 프로필(openshift-control-plane)이 고려됩니다. 컨테이너화된 TuneD Pod가 node-role.kubernetes.io/master 또는 node-role.kubernetes.io/infra. 라벨이 있는 노드에서 실행되는 경우 이 프로필이 적용됩니다.

마지막으로, openshift-node 프로필은 우선 순위가 가장 낮은 30입니다. 이 프로필에는 <match> 섹션이 없으므로 항상 일치합니다. 지정된 노드에서 우선 순위가 더 높은 다른 프로필이 일치하지 않는 경우 openshift-node 프로필을 설정하는 데 catch-all 프로필 역할을 합니다.

예: 머신 구성 풀 기반 일치

apiVersion: tuned.openshift.io/v1

kind: Tuned

metadata:

name: openshift-node-custom

namespace: openshift-cluster-node-tuning-operator

spec:

profile:

- data: |

[main]

summary=Custom OpenShift node profile with an additional kernel parameter

include=openshift-node

[bootloader]

cmdline_openshift_node_custom=+skew_tick=1

name: openshift-node-custom

recommend:

- machineConfigLabels:

machineconfiguration.openshift.io/role: "worker-custom"

priority: 20

profile: openshift-node-custom

노드 재부팅을 최소화하려면 머신 구성 풀의 노드 선택기와 일치하는 라벨로 대상 노드에 라벨을 지정한 후 위의 Tuned CR을 생성하고 마지막으로 사용자 정의 머신 구성 풀을 생성합니다.

4.6. 사용자 정의 튜닝 예

기본 CR에서 TuneD 프로파일 사용

다음 CR에서는 tuned.openshift.io/ingress-node-label 레이블이 임의의 값으로 설정된 OpenShift Container Platform 노드에 대해 사용자 정의 노드 수준 튜닝을 적용합니다.

예: openshift-control-plane TuneD 프로필을 사용한 사용자 정의 튜닝

apiVersion: tuned.openshift.io/v1

kind: Tuned

metadata:

name: ingress

namespace: openshift-cluster-node-tuning-operator

spec:

profile:

- data: |

[main]

summary=A custom OpenShift ingress profile

include=openshift-control-plane

[sysctl]

net.ipv4.ip_local_port_range="1024 65535"

net.ipv4.tcp_tw_reuse=1

name: openshift-ingress

recommend:

- match:

- label: tuned.openshift.io/ingress-node-label

priority: 10

profile: openshift-ingress

사용자 정의 프로필 작성자는 기본 TuneD CR에 제공된 기본 Tuned 데몬 프로필을 포함하는 것이 좋습니다. 위의 예에서는 기본 openshift-control-plane 프로필을 사용하여 작업을 수행합니다.

내장된 TuneD 프로필 사용

NTO 관리 데몬 세트가 성공적으로 롤아웃되면 TuneD 피연산자는 모두 동일한 버전의 TuneD 데몬을 관리합니다. 데몬에서 지원하는 기본 제공 TuneD 프로필을 나열하려면 다음 방식으로 TuneD Pod를 쿼리합니다.

$ oc exec $tuned_pod -n openshift-cluster-node-tuning-operator -- find /usr/lib/tuned/ -name tuned.conf -printf '%h\n' | sed 's|^.*/||'

사용자 정의 튜닝 사양에서 이 명령으로 검색한 프로필 이름을 사용할 수 있습니다.

예: 기본 제공 hpc-compute TuneD 프로필 사용

apiVersion: tuned.openshift.io/v1

kind: Tuned

metadata:

name: openshift-node-hpc-compute

namespace: openshift-cluster-node-tuning-operator

spec:

profile:

- data: |

[main]

summary=Custom OpenShift node profile for HPC compute workloads

include=openshift-node,hpc-compute

name: openshift-node-hpc-compute

recommend:

- match:

- label: tuned.openshift.io/openshift-node-hpc-compute

priority: 20

profile: openshift-node-hpc-compute

기본 제공 hpc-compute 프로필 외에도 위의 예제에는 기본 Tuned CR 내에 제공된 openshift-node TuneD 데몬 프로필이 포함되어 컴퓨팅 노드에 OpenShift별 튜닝을 사용합니다.

4.7. 지원되는 TuneD 데몬 플러그인

Tuned CR의 profile: 섹션에 정의된 사용자 정의 프로필을 사용하는 경우 [main] 섹션을 제외한 다음 TuneD 플러그인이 지원됩니다.

- audio

- cpu

- disk

- eeepc_she

- modules

- mounts

- net

- scheduler

- scsi_host

- selinux

- sysctl

- sysfs

- usb

- video

- vm

일부 플러그인에서 제공하는 동적 튜닝 기능은 지원되지 않습니다. 다음 TuneD 플러그인은 현재 지원되지 않습니다.

- bootloader

- script

- systemd

자세한 내용은 사용 가능한 TuneD 플러그인 및 TuneD 시작하기 를 참조하십시오.

5장. Cluster Loader 사용

Cluster Loader는 많은 수의 다양한 오브젝트를 클러스터에 배포하여 사용자 정의 클러스터 오브젝트를 생성하는 툴입니다. Cluster Loader를 빌드하고, 구성하고, 실행하여 다양한 클러스터 상태에서 OpenShift Container Platform 배포의 성능 지표를 측정하십시오.

클러스터 로더는 더 이상 사용되지 않으며 향후 릴리스에서 제거됩니다.

5.1. Cluster Loader 설치

프로세스

컨테이너 이미지를 가져오려면 다음을 실행합니다.

$ podman pull quay.io/openshift/origin-tests:4.8

5.2. Cluster Loader 실행

전제 조건

- 리포지토리에서 인증하라는 메시지를 표시합니다. 레지스트리 자격 증명을 사용하면 공개적으로 제공되지 않는 이미지에 액세스할 수 있습니다. 설치의 기존 인증 자격 증명을 사용하십시오.

프로세스

다섯 개의 템플릿 빌드를 배포하고 완료될 때까지 대기하는 내장 테스트 구성을 사용하여 Cluster Loader를 실행합니다.

$ podman run -v ${LOCAL_KUBECONFIG}:/root/.kube/config:z -i \ quay.io/openshift/origin-tests:4.8 /bin/bash -c 'export KUBECONFIG=/root/.kube/config && \ openshift-tests run-test "[sig-scalability][Feature:Performance] Load cluster \ should populate the cluster [Slow][Serial] [Suite:openshift]"'또는

VIPERCONFIG환경 변수를 설정하여 사용자 정의 구성으로 Cluster Loader를 실행합니다.$ podman run -v ${LOCAL_KUBECONFIG}:/root/.kube/config:z \ -v ${LOCAL_CONFIG_FILE_PATH}:/root/configs/:z \ -i quay.io/openshift/origin-tests:4.8 \ /bin/bash -c 'KUBECONFIG=/root/.kube/config VIPERCONFIG=/root/configs/test.yaml \ openshift-tests run-test "[sig-scalability][Feature:Performance] Load cluster \ should populate the cluster [Slow][Serial] [Suite:openshift]"'이 예에서는

${LOCAL_KUBECONFIG}가 로컬 파일 시스템의kubeconfig경로를 참조합니다.test.yaml구성 파일이 있는 컨테이너에 마운트되는${LOCAL_CONFIG_FILE_PATH}디렉터리도 있습니다.test.yaml이 외부 템플릿 파일 또는 podspec 파일을 참조하는 경우 해당 파일도 컨테이너에 마운트되어야 합니다.

5.3. Cluster Loader 구성

이 툴에서는 여러 템플릿 또는 Pod를 포함하는 여러 네임스페이스(프로젝트)를 생성합니다.

5.3.1. Cluster Loader 구성 파일 예

Cluster Loader 구성 파일은 기본 YAML 파일입니다.

provider: local 1 ClusterLoader: cleanup: true projects: - num: 1 basename: clusterloader-cakephp-mysql tuning: default ifexists: reuse templates: - num: 1 file: cakephp-mysql.json - num: 1 basename: clusterloader-dancer-mysql tuning: default ifexists: reuse templates: - num: 1 file: dancer-mysql.json - num: 1 basename: clusterloader-django-postgresql tuning: default ifexists: reuse templates: - num: 1 file: django-postgresql.json - num: 1 basename: clusterloader-nodejs-mongodb tuning: default ifexists: reuse templates: - num: 1 file: quickstarts/nodejs-mongodb.json - num: 1 basename: clusterloader-rails-postgresql tuning: default templates: - num: 1 file: rails-postgresql.json tuningsets: 2 - name: default pods: stepping: 3 stepsize: 5 pause: 0 s rate_limit: 4 delay: 0 ms

이 예에서는 외부 템플릿 파일 또는 Pod 사양 파일에 대한 참조도 컨테이너에 마운트되었다고 가정합니다.

Microsoft Azure에서 Cluster Loader를 실행하는 경우 AZURE_AUTH_LOCATION 변수를 설치 프로그램 디렉터리에 있는 terraform.azure.auto.tfvars.json 출력이 포함된 파일로 설정해야 합니다.

5.3.2. 구성 필드

표 5.1. 최상위 수준 Cluster Loader 필드

| 필드 | 설명 |

|---|---|

|

|

|

|

|

정의가 하나 이상인 하위 오브젝트입니다. |

|

|

구성당 하나의 정의가 있는 하위 오브젝트입니다. |

|

| 구성당 정의가 하나인 선택적 하위 오브젝트입니다. 오브젝트 생성 중 동기화 가능성을 추가합니다. |

표 5.2. projects 아래 필드

| 필드 | 설명 |

|---|---|

|

| 정수입니다. 생성할 프로젝트 수에 대한 하나의 정의입니다. |

|

|

문자열입니다. 프로젝트의 기본 이름에 대한 하나의 정의입니다. 충돌을 방지하도록 동일한 네임스페이스 수가 |

|

| 문자열입니다. 오브젝트에 적용할 튜닝 세트에 대한 하나의 정의로, 이 네임스페이스 내에서 배포합니다. |

|

|

|

|

| 키-값 쌍 목록입니다. 키는 구성 맵 이름이고 값은 구성 맵을 생성하는 파일의 경로입니다. |

|

| 키-값 쌍 목록입니다. 키는 보안 이름이고 값은 보안을 생성하는 파일의 경로입니다. |

|

| 배포할 Pod 정의가 하나 이상인 하위 오브젝트입니다. |

|

| 배포할 템플릿 정의가 하나 이상인 하위 오브젝트입니다. |

표 5.3. pods 및 templates 아래 필드

| 필드 | 설명 |

|---|---|

|

| 정수입니다. 배포할 Pod 또는 템플릿 수입니다. |

|

| 문자열입니다. docker 이미지를 가져올 수 있는 리포지토리에 대한 docker 이미지 URL입니다. |

|

| 문자열입니다. 생성할 템플릿(또는 Pod)의 기본 이름에 대한 하나의 정의입니다. |

|

| 문자열입니다. 생성할 Pod 사양 또는 템플릿이 있는 로컬 파일에 대한 경로입니다. |

|

|

키-값 쌍입니다. |

표 5.4. tuningsets 아래 필드

| 필드 | 설명 |

|---|---|

|

| 문자열입니다. 프로젝트에서 튜닝을 정의할 때 지정된 이름과 일치하는 튜닝 세트의 이름입니다. |

|

|

Pod에 적용할 |

|

|

템플릿에 적용할 |

표 5.5. tuningsets pods 또는 tuningsets templates 아래 필드

| 필드 | 설명 |

|---|---|

|

| 하위 오브젝트입니다. 단계 생성 패턴으로 오브젝트를 생성하려는 경우 사용되는 스테핑 구성입니다. |

|

| 하위 오브젝트입니다. 오브젝트 생성 속도를 제한하는 속도 제한 튜닝 세트 구성입니다. |

표 5.6. tuningsets pods 또는 tuningsets templates, stepping 아래 필드

| 필드 | 설명 |

|---|---|

|

| 정수입니다. 오브젝트 생성을 정지하기 전 생성할 오브젝트 수입니다. |

|

|

정수입니다. |

|

| 정수입니다. 오브젝트 생성에 성공하지 못하는 경우 실패 전 대기하는 시간(초)입니다. |

|

| 정수입니다. 생성 요청 간에 대기하는 시간(밀리초)입니다. |

표 5.7. sync 아래 필드

| 필드 | 설명 |

|---|---|

|

|

|

|

|

부울입니다. |

|

|

부울입니다. |

|

|

|

|

|

문자열입니다. Pod가 |

5.4. 알려진 문제

- 구성없이 Cluster Loader를 호출하는 경우 실패합니다. (BZ#1761925)

IDENTIFIER매개변수가 사용자 템플릿에 정의되어 있지 않으면 템플릿 생성에 실패하고error: unknown parameter name "IDENTIFIER"가 표시됩니다. 템플릿을 배포하는 경우 다음과 같이 이 매개변수를 템플릿에 추가하여 오류를 방지하십시오.{ "name": "IDENTIFIER", "description": "Number to append to the name of resources", "value": "1" }Pod를 배포하는 경우 매개변수를 추가할 필요가 없습니다.

6장. CPU 관리자 사용

CPU 관리자는 CPU 그룹을 관리하고 워크로드를 특정 CPU로 제한합니다.

CPU 관리자는 다음과 같은 속성 중 일부가 포함된 워크로드에 유용합니다.

- 가능한 한 많은 CPU 시간이 필요합니다.

- 프로세서 캐시 누락에 민감합니다.

- 대기 시간이 짧은 네트워크 애플리케이션입니다.

- 다른 프로세스와 조정하고 단일 프로세서 캐시 공유를 통해 얻는 이점이 있습니다.

6.1. CPU 관리자 설정

절차

선택 사항: 노드에 레이블을 지정합니다.

# oc label node perf-node.example.com cpumanager=true

CPU 관리자를 활성화해야 하는 노드의

MachineConfigPool을 편집합니다. 이 예에서는 모든 작업자의 CPU 관리자가 활성화됩니다.# oc edit machineconfigpool worker

작업자 머신 구성 풀에 레이블을 추가합니다.

metadata: creationTimestamp: 2020-xx-xxx generation: 3 labels: custom-kubelet: cpumanager-enabledKubeletConfig,cpumanager-kubeletconfig.yaml, CR(사용자 정의 리소스)을 생성합니다. 이전 단계에서 생성한 레이블을 참조하여 올바른 노드가 새 kubelet 구성으로 업데이트되도록 합니다.machineConfigPoolSelector섹션을 참조하십시오.apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: cpumanager-enabled spec: machineConfigPoolSelector: matchLabels: custom-kubelet: cpumanager-enabled kubeletConfig: cpuManagerPolicy: static 1 cpuManagerReconcilePeriod: 5s 2동적 kubelet 구성을 생성합니다.

# oc create -f cpumanager-kubeletconfig.yaml

그러면 kubelet 구성에 CPU 관리자 기능이 추가되고 필요한 경우 MCO(Machine Config Operator)가 노드를 재부팅합니다. CPU 관리자를 활성화하는 데는 재부팅이 필요하지 않습니다.

병합된 kubelet 구성을 확인합니다.

# oc get machineconfig 99-worker-XXXXXX-XXXXX-XXXX-XXXXX-kubelet -o json | grep ownerReference -A7

출력 예

"ownerReferences": [ { "apiVersion": "machineconfiguration.openshift.io/v1", "kind": "KubeletConfig", "name": "cpumanager-enabled", "uid": "7ed5616d-6b72-11e9-aae1-021e1ce18878" } ]작업자에서 업데이트된

kubelet.conf를 확인합니다.# oc debug node/perf-node.example.com sh-4.2# cat /host/etc/kubernetes/kubelet.conf | grep cpuManager

출력 예

cpuManagerPolicy: static 1 cpuManagerReconcilePeriod: 5s 2

코어를 하나 이상 요청하는 Pod를 생성합니다. 제한 및 요청 둘 다 해당 CPU 값이 정수로 설정되어야 합니다. 해당 숫자는 이 Pod 전용으로 사용할 코어 수입니다.

# cat cpumanager-pod.yaml

출력 예

apiVersion: v1 kind: Pod metadata: generateName: cpumanager- spec: containers: - name: cpumanager image: gcr.io/google_containers/pause-amd64:3.0 resources: requests: cpu: 1 memory: "1G" limits: cpu: 1 memory: "1G" nodeSelector: cpumanager: "true"Pod를 생성합니다.

# oc create -f cpumanager-pod.yaml

레이블 지정한 노드에 Pod가 예약되어 있는지 검증합니다.

# oc describe pod cpumanager

출력 예

Name: cpumanager-6cqz7 Namespace: default Priority: 0 PriorityClassName: <none> Node: perf-node.example.com/xxx.xx.xx.xxx ... Limits: cpu: 1 memory: 1G Requests: cpu: 1 memory: 1G ... QoS Class: Guaranteed Node-Selectors: cpumanager=truecgroups가 올바르게 설정되었는지 검증합니다.pause프로세스의 PID(프로세스 ID)를 가져옵니다.# ├─init.scope │ └─1 /usr/lib/systemd/systemd --switched-root --system --deserialize 17 └─kubepods.slice ├─kubepods-pod69c01f8e_6b74_11e9_ac0f_0a2b62178a22.slice │ ├─crio-b5437308f1a574c542bdf08563b865c0345c8f8c0b0a655612c.scope │ └─32706 /pause

QoS(Quality of Service) 계층

Guaranteed의 Pod는kubepods.slice에 있습니다. 다른 QoS 계층의 Pod는kubepods의 하위cgroups에 있습니다.# cd /sys/fs/cgroup/cpuset/kubepods.slice/kubepods-pod69c01f8e_6b74_11e9_ac0f_0a2b62178a22.slice/crio-b5437308f1ad1a7db0574c542bdf08563b865c0345c86e9585f8c0b0a655612c.scope # for i in `ls cpuset.cpus tasks` ; do echo -n "$i "; cat $i ; done

출력 예

cpuset.cpus 1 tasks 32706

작업에 허용되는 CPU 목록을 확인합니다.

# grep ^Cpus_allowed_list /proc/32706/status

출력 예

Cpus_allowed_list: 1

GuaranteedPod용으로 할당된 코어에서는 시스템의 다른 Pod(이 경우burstableQoS 계층의 Pod)를 실행할 수 없는지 검증합니다.# cat /sys/fs/cgroup/cpuset/kubepods.slice/kubepods-besteffort.slice/kubepods-besteffort-podc494a073_6b77_11e9_98c0_06bba5c387ea.slice/crio-c56982f57b75a2420947f0afc6cafe7534c5734efc34157525fa9abbf99e3849.scope/cpuset.cpus 0 # oc describe node perf-node.example.com

출력 예

... Capacity: attachable-volumes-aws-ebs: 39 cpu: 2 ephemeral-storage: 124768236Ki hugepages-1Gi: 0 hugepages-2Mi: 0 memory: 8162900Ki pods: 250 Allocatable: attachable-volumes-aws-ebs: 39 cpu: 1500m ephemeral-storage: 124768236Ki hugepages-1Gi: 0 hugepages-2Mi: 0 memory: 7548500Ki pods: 250 ------- ---- ------------ ---------- --------------- ------------- --- default cpumanager-6cqz7 1 (66%) 1 (66%) 1G (12%) 1G (12%) 29m Allocated resources: (Total limits may be over 100 percent, i.e., overcommitted.) Resource Requests Limits -------- -------- ------ cpu 1440m (96%) 1 (66%)

이 VM에는 두 개의 CPU 코어가 있습니다.

system-reserved설정은 500밀리코어로 설정되었습니다. 즉,Node Allocatable양이 되는 노드의 전체 용량에서 한 코어의 절반이 감산되었습니다.Allocatable CPU는 1500 밀리코어임을 확인할 수 있습니다. 즉, Pod마다 하나의 전체 코어를 사용하므로 CPU 관리자 Pod 중 하나를 실행할 수 있습니다. 전체 코어는 1000밀리코어에 해당합니다. 두 번째 Pod를 예약하려고 하면 시스템에서 해당 Pod를 수락하지만 Pod가 예약되지 않습니다.NAME READY STATUS RESTARTS AGE cpumanager-6cqz7 1/1 Running 0 33m cpumanager-7qc2t 0/1 Pending 0 11s

7장. 토폴로지 관리자 사용

토폴로지 관리자는 동일한 NUMA(Non-Uniform Memory Access) 노드의 모든 QoS(Quality of Service) 클래스에 대해 CPU 관리자, 장치 관리자, 기타 힌트 공급자로부터 힌트를 수집하여 CPU, SR-IOV VF, 기타 장치 리소스 등의 Pod 리소스를 정렬합니다.

토폴로지 관리자는 토폴로지 관리자 정책 및 요청된 Pod 리소스를 기반으로 수집된 힌트의 토폴로지 정보를 사용하여 노드에서 Pod를 수락하거나 거부할 수 있는지 결정합니다.

토폴로지 관리자는 하드웨어 가속기를 사용하여 대기 시간이 중요한 실행과 처리량이 높은 병렬 계산을 지원하는 워크로드에 유용합니다.

토폴로지 관리자를 사용하려면 정책이 static 상태인 CPU 관리자를 사용해야 합니다. CPU 관리자에 대한 자세한 내용은 CPU 관리자 사용을 참조하십시오.

7.1. 토폴로지 관리자 정책

토폴로지 관리자는 CPU 관리자 및 장치 관리자와 같은 힌트 공급자로부터 토폴로지 힌트를 수집하고 수집된 힌트로 Pod 리소스를 정렬하는 방법으로 모든 QoS(Quality of Service) 클래스의 Pod 리소스를 정렬합니다.

Pod 사양에서 요청된 다른 리소스와 CPU 리소스를 정렬하려면 static CPU 관리자 정책을 사용하여 CPU 관리자를 활성화해야 합니다.

토폴로지 관리자는 cpumanager-enabled CR(사용자 정의 리소스)에서 할당하는 데 다음 4가지 할당 정책을 지원합니다.

none정책- 기본 정책으로, 토폴로지 정렬을 수행하지 않습니다.

best-effort정책-

best-effort토폴로지 관리 정책을 사용하는 Pod의 각 컨테이너에서는 kubelet이 각 힌트 공급자를 호출하여 해당 리소스 가용성을 검색합니다. 토폴로지 관리자는 이 정보를 사용하여 해당 컨테이너의 기본 NUMA 노드 선호도를 저장합니다. 선호도를 기본 설정하지 않으면 토폴로지 관리자가 해당 정보를 저장하고 노드에 대해 Pod를 허용합니다. restricted정책-

restricted토폴로지 관리 정책을 사용하는 Pod의 각 컨테이너에서는 kubelet이 각 힌트 공급자를 호출하여 해당 리소스 가용성을 검색합니다. 토폴로지 관리자는 이 정보를 사용하여 해당 컨테이너의 기본 NUMA 노드 선호도를 저장합니다. 선호도를 기본 설정하지 않으면 토폴로지 관리자가 노드에서 이 Pod를 거부합니다. 그러면 Pod는Terminated상태가 되고 Pod 허용 실패가 발생합니다. single-numa-node정책-

single-numa-node토폴로지 관리 정책을 사용하는 Pod의 각 컨테이너에서는 kubelet이 각 힌트 공급자를 호출하여 해당 리소스 가용성을 검색합니다. 토폴로지 관리자는 이 정보를 사용하여 단일 NUMA 노드 선호도가 가능한지 여부를 결정합니다. 가능한 경우 노드에 대해 Pod가 허용됩니다. 단일 NUMA 노드 선호도가 가능하지 않은 경우 토폴로지 관리자가 노드에서 Pod를 거부합니다. 그러면 Pod는 Terminated 상태가 되고 Pod 허용 실패가 발생합니다.

7.2. 토폴로지 관리자 설정

토폴로지 관리자를 사용하려면 cpumanager-enabled CR(사용자 정의 리소스)에서 할당 정책을 구성해야 합니다. CPU 관리자를 설정한 경우 해당 파일이 존재할 수 있습니다. 파일이 없으면 파일을 생성할 수 있습니다.

전제 조건

-

CPU 관리자 정책을

static으로 구성하십시오. 확장 및 성능 섹션에서 CPU 관리자 사용을 확인하십시오.

절차

토폴로지 관리자를 활성화하려면 다음을 수행합니다.

cpumanager-enabledCR(사용자 정의 리소스)에서 토폴로지 관리자 할당 정책을 구성합니다.$ oc edit KubeletConfig cpumanager-enabled

apiVersion: machineconfiguration.openshift.io/v1 kind: KubeletConfig metadata: name: cpumanager-enabled spec: machineConfigPoolSelector: matchLabels: custom-kubelet: cpumanager-enabled kubeletConfig: cpuManagerPolicy: static 1 cpuManagerReconcilePeriod: 5s topologyManagerPolicy: single-numa-node 2

추가 리소스

- CPU 관리자에 대한 자세한 내용은 CPU 관리자 사용을 참조하십시오.

7.3. Pod와 토폴로지 관리자 정책 간의 상호 작용

아래 Pod 사양의 예는 Pod와 토폴로지 관리자 간 상호 작용을 보여주는 데 도움이 됩니다.

다음 Pod는 리소스 요청 또는 제한이 지정되어 있지 않기 때문에 BestEffort QoS 클래스에서 실행됩니다.

spec:

containers:

- name: nginx

image: nginx

다음 Pod는 요청이 제한보다 작기 때문에 Burstable QoS 클래스에서 실행됩니다.

spec:

containers:

- name: nginx

image: nginx

resources:

limits:

memory: "200Mi"

requests:

memory: "100Mi"

선택한 정책이 none이 아니면 토폴로지 관리자는 이러한 Pod 사양 중 하나를 고려하지 않습니다.

아래 마지막 예의 Pod는 요청이 제한과 동일하기 때문에 Guaranteed QoS 클래스에서 실행됩니다.

spec:

containers:

- name: nginx

image: nginx

resources:

limits:

memory: "200Mi"

cpu: "2"

example.com/device: "1"

requests:

memory: "200Mi"

cpu: "2"

example.com/device: "1"토폴로지 관리자는 이러한 Pod를 고려합니다. 토폴로지 관리자는 사용 가능한 CPU의 토폴로지를 반환하는 CPU 관리자 static 정책을 참조합니다. 토폴로지 관리자는 example.com/device에 대해 사용 가능한 장치의 토폴로지를 검색하는 장치 관리자도 참조합니다.

토폴로지 관리자는 이러한 정보를 사용하여 이 컨테이너에 가장 적합한 토폴로지를 저장합니다. 이 Pod의 경우 CPU 관리자와 장치 관리자는 리소스 할당 단계에서 이러한 저장된 정보를 사용합니다.

8장. Cluster Monitoring Operator 스케일링

OpenShift Container Platform에서는 Cluster Monitoring Operator가 수집하여 Prometheus 기반 모니터링 스택에 저장하는 지표를 공개합니다. 관리자는 시스템 리소스, 컨테이너 및 구성 요소 지표를 하나의 대시보드 인터페이스인 Grafana에서 볼 수 있습니다.

8.1. Prometheus 데이터베이스 스토리지 요구사항

Red Hat은 여러 스케일링 크기에 대해 다양한 테스트를 수행했습니다.

아래 Prometheus 스토리지 요구 사항은 규정되어 있지 않습니다. 워크로드 활동 및 리소스 사용량에 따라 클러스터에서 리소스 사용량이 높아질 수 있습니다.

표 8.1. 클러스터의 노드/Pod 수에 따른 Prometheus 데이터베이스 스토리지 요구사항

| 노드 수 | Pod 수 | Prometheus 스토리지 증가(1일당) | Prometheus 스토리지 증가(15일당) | RAM 공간(스케일링 크기당) | 네트워크(tsdb 청크당) |

|---|---|---|---|---|---|

| 50 | 1800 | 6.3GB | 94GB | 6GB | 16MB |

| 100 | 3600 | 13GB | 195GB | 10GB | 26MB |

| 150 | 5400 | 19GB | 283GB | 12GB | 36MB |

| 200 | 7200 | 25GB | 375GB | 14GB | 46MB |

스토리지 요구사항이 계산된 값을 초과하지 않도록 예상 크기의 약 20%가 오버헤드로 추가되었습니다.

위의 계산은 기본 OpenShift Container Platform Cluster Monitoring Operator용입니다.

CPU 사용률은 약간의 영향을 미칩니다. 50개 노드 및 1,800개 Pod당 비율이 약 40개 중 1개 코어입니다.

OpenShift Container Platform 권장 사항

- 인프라 노드를 3개 이상 사용하십시오.

- NVMe(Non-Volatile Memory Express) 드라이브를 사용하는 경우 openshift-container-storage 노드를 3개 이상 사용하십시오.

8.2. 클러스터 모니터링 구성

클러스터 모니터링 스택에서 Prometheus 구성 요소의 스토리지 용량을 늘릴 수 있습니다.

프로세스

Prometheus의 스토리지 용량을 늘리려면 다음을 수행합니다.

YAML 구성 파일

cluster-monitoring-config.yaml을 생성합니다. 예를 들면 다음과 같습니다.apiVersion: v1 kind: ConfigMap data: config.yaml: | prometheusK8s: retention: {{PROMETHEUS_RETENTION_PERIOD}} 1 nodeSelector: node-role.kubernetes.io/infra: "" volumeClaimTemplate: spec: storageClassName: {{STORAGE_CLASS}} 2 resources: requests: storage: {{PROMETHEUS_STORAGE_SIZE}} 3 alertmanagerMain: nodeSelector: node-role.kubernetes.io/infra: "" volumeClaimTemplate: spec: storageClassName: {{STORAGE_CLASS}} 4 resources: requests: storage: {{ALERTMANAGER_STORAGE_SIZE}} 5 metadata: name: cluster-monitoring-config namespace: openshift-monitoring- 1

- 일반적인 값은

PROMETHEUS_RETENTION_PERIOD=15d입니다. 단위는 s, m, h, d 접미사 중 하나를 사용하는 시간으로 측정됩니다. - 2 4

- 클러스터의 스토리지 클래스입니다.

- 3

- 일반적인 값은

PROMETHEUS_STORAGE_SIZE=2000Gi입니다. 스토리지 값은 일반 정수이거나 이러한 접미사 중 하나를 사용하는 고정 포인트 정수일 수 있습니다. E, P, T, G, M, K. 2의 거듭제곱을 사용할 수도 있습니다: EI, Pi, Ti, Gi, Mi, Ki. - 5

- 일반적인 값은

ALERTMANAGER_STORAGE_SIZE=20Gi입니다. 스토리지 값은 일반 정수이거나 이러한 접미사 중 하나를 사용하는 고정 포인트 정수일 수 있습니다. E, P, T, G, M, K. 2의 거듭제곱을 사용할 수도 있습니다: EI, Pi, Ti, Gi, Mi, Ki.

- 보존 기간, 스토리지 클래스 및 스토리지 크기에 대한 값을 추가합니다.

- 파일을 저장합니다.

다음을 실행하여 변경사항을 적용합니다.

$ oc create -f cluster-monitoring-config.yaml

9장. Node Feature Discovery Operator

Node Feature Discovery (NFD) Operator 및 이를 사용하여 하드웨어 기능과 시스템 구성을 감지하기 위한 Kubernetes 애드온 기능인 NFD(Node Feature Discovery)을 오케스트레이션하여 노드 수준 정보를 공개하는 방법을 설명합니다.

9.1. Node Feature Discovery Operator 정보

NFD(Node Feature Discovery Operator)는 하드웨어 관련 정보로 노드에 레이블을 지정하여 OpenShift Container Platform 클러스터에서 하드웨어 기능 및 구성 검색을 관리합니다. NFD는 PCI 카드, 커널, 운영 체제 버전과 같은 노드별 속성을 사용하여 호스트에 레이블을 지정합니다.

NFD Operator는 "Node Feature Discovery"을 검색하여 Operator Hub에서 확인할 수 있습니다.

9.2. Node Feature Discovery Operator 설치

NFD(Node Feature Discovery) Operator는 NFD 데몬 세트를 실행하는 데 필요한 모든 리소스를 오케스트레이션합니다. 클러스터 관리자는 OpenShift Container Platform CLI 또는 웹 콘솔을 사용하여 NFD Operator를 설치할 수 있습니다.

9.2.1. CLI를 사용하여 NFD Operator 설치

클러스터 관리자는 CLI를 사용하여 NFD Operator를 설치할 수 있습니다.

사전 요구 사항

- OpenShift Container Platform 클러스터

-

OpenShift CLI(

oc)를 설치합니다. -

cluster-admin권한이 있는 사용자로 로그인합니다.

절차

NFD Operator의 네임스페이스를 생성합니다.

openshift-nfd네임스페이스를 정의하는 다음NamespaceCR(사용자 정의 리소스)을 생성하고nfd-namespace.yaml파일에 YAML을 저장합니다.apiVersion: v1 kind: Namespace metadata: name: openshift-nfd

다음 명령을 실행하여 네임스페이스를 생성합니다.

$ oc create -f nfd-namespace.yaml

다음 오브젝트를 생성하여 이전 단계에서 생성한 네임스페이스에 NFD Operator를 설치합니다.

다음

OperatorGroupCR을 생성하고 해당 YAML을nfd-operatorgroup.yaml파일에 저장합니다.apiVersion: operators.coreos.com/v1 kind: OperatorGroup metadata: generateName: openshift-nfd- name: openshift-nfd namespace: openshift-nfd spec: targetNamespaces: - openshift-nfd

다음 명령을 실행하여

OperatorGroupCR을 생성합니다.$ oc create -f nfd-operatorgroup.yaml

다음 명령을 실행하여 후속 단계에 필요한

채널값을 가져옵니다.$ oc get packagemanifest nfd -n openshift-marketplace -o jsonpath='{.status.defaultChannel}'출력 예

4.8

다음

SubscriptionCR을 생성하고 해당 YAML을nfd-sub.yaml파일에 저장합니다.서브스크립션의 예

apiVersion: operators.coreos.com/v1alpha1 kind: Subscription metadata: name: nfd namespace: openshift-nfd spec: channel: "4.8" installPlanApproval: Automatic name: nfd source: redhat-operators sourceNamespace: openshift-marketplace

다음 명령을 실행하여 서브스크립션 오브젝트를 생성합니다.

$ oc create -f nfd-sub.yaml

openshift-nfd프로젝트로 변경합니다.$ oc project openshift-nfd

검증

Operator 배포가 완료되었는지 확인하려면 다음을 실행합니다.

$ oc get pods

출력 예

NAME READY STATUS RESTARTS AGE nfd-controller-manager-7f86ccfb58-vgr4x 2/2 Running 0 10m

성공적인 배포에는

Running상태가 표시됩니다.

9.2.2. 웹 콘솔을 사용하여 NFD Operator 설치

클러스터 관리자는 웹 콘솔을 사용하여 NFD Operator를 설치할 수 있습니다.

이전 섹션에서 언급한 것처럼 Namespace를 만들 것을 권장합니다.

절차

- OpenShift Container Platform 웹 콘솔에서 Operator → OperatorHub를 클릭합니다.

- 사용 가능한 Operator 목록에서 Node Feature Discovery를 선택한 다음 설치를 클릭합니다.

- Operator 설치 페이지에서 클러스터에서 특정 네임스페이스를 선택하고 이전 섹션에서 생성된 네임스페이스를 선택한 다음 설치를 클릭합니다.

검증

다음과 같이 NFD Operator가 설치되었는지 확인합니다.

- Operator → 설치된 Operator 페이지로 이동합니다.

Node Feature Discovery가 openshift-nfd 프로젝트에 InstallSucceeded 상태로 나열되어 있는지 확인합니다.

참고설치 중에 Operator는 실패 상태를 표시할 수 있습니다. 나중에 InstallSucceeded 메시지와 함께 설치에 성공하면 이 실패 메시지를 무시할 수 있습니다.

문제 해결

Operator가 설치된 것으로 나타나지 않으면 다음과 같이 추가 문제 해결을 수행합니다.

- Operator → 설치된 Operator 페이지로 이동하고 Operator 서브스크립션 및 설치 계획 탭의 상태에 장애나 오류가 있는지 검사합니다.

-

Workloads → Pod 페이지로 이동하여

openshift-nfd프로젝트에서 Pod 로그를 확인합니다.

9.3. Node Feature Discovery Operator 사용

NFD(Node Feature Discovery) Operator는 NodeFeatureDiscovery CR을 확인하여 Node-Versionature-Discovery 데몬 세트를 실행하는 데 필요한 모든 리소스를 오케스트레이션합니다. NodefeatureatureDiscovery CR을 기반으로 Operator는 원하는 네임스페이스에 피연산자(NFD) 구성 요소를 생성합니다. CR을 편집하여 다른 옵션 중에서 다른 namespace, image, imagePullPolicy, nfd-worker-conf를 선택할 수 있습니다.

클러스터 관리자는 OpenShift Container Platform CLI 또는 웹 콘솔을 사용하여 NodeFeatureDiscovery 인스턴스를 만들 수 있습니다.

9.3.1. CLI를 사용하여 NodeEnatureDiscovery 인스턴스 생성

클러스터 관리자는 CLI를 사용하여 NodefeatureatureDiscovery CR 인스턴스를 생성할 수 있습니다.

사전 요구 사항

- OpenShift Container Platform 클러스터

-

OpenShift CLI(

oc)를 설치합니다. -

cluster-admin권한이 있는 사용자로 로그인합니다. - NFD Operator를 설치합니다.

절차

다음

NodeEnatureDiscovery사용자 정의 리소스(CR)를 생성한 다음 YAML을NodefeatureatureDiscovery.yaml파일에 저장합니다.apiVersion: nfd.openshift.io/v1 kind: NodeFeatureDiscovery metadata: name: nfd-instance namespace: openshift-nfd spec: instance: "" # instance is empty by default operand: namespace: openshift-nfd image: quay.io/openshift/origin-node-feature-discovery:4.8 imagePullPolicy: Always workerConfig: configData: | #core: # labelWhiteList: # noPublish: false # sleepInterval: 60s # sources: [all] # klog: # addDirHeader: false # alsologtostderr: false # logBacktraceAt: # logtostderr: true # skipHeaders: false # stderrthreshold: 2 # v: 0 # vmodule: ## NOTE: the following options are not dynamically run-time configurable ## and require a nfd-worker restart to take effect after being changed # logDir: # logFile: # logFileMaxSize: 1800 # skipLogHeaders: false #sources: # cpu: # cpuid: ## NOTE: whitelist has priority over blacklist # attributeBlacklist: # - "BMI1" # - "BMI2" # - "CLMUL" # - "CMOV" # - "CX16" # - "ERMS" # - "F16C" # - "HTT" # - "LZCNT" # - "MMX" # - "MMXEXT" # - "NX" # - "POPCNT" # - "RDRAND" # - "RDSEED" # - "RDTSCP" # - "SGX" # - "SSE" # - "SSE2" # - "SSE3" # - "SSE4.1" # - "SSE4.2" # - "SSSE3" # attributeWhitelist: # kernel: # kconfigFile: "/path/to/kconfig" # configOpts: # - "NO_HZ" # - "X86" # - "DMI" # pci: # deviceClassWhitelist: # - "0200" # - "03" # - "12" # deviceLabelFields: # - "class" # - "vendor" # - "device" # - "subsystem_vendor" # - "subsystem_device" # usb: # deviceClassWhitelist: # - "0e" # - "ef" # - "fe" # - "ff" # deviceLabelFields: # - "class" # - "vendor" # - "device" # custom: # - name: "my.kernel.feature" # matchOn: # - loadedKMod: ["example_kmod1", "example_kmod2"] # - name: "my.pci.feature" # matchOn: # - pciId: # class: ["0200"] # vendor: ["15b3"] # device: ["1014", "1017"] # - pciId : # vendor: ["8086"] # device: ["1000", "1100"] # - name: "my.usb.feature" # matchOn: # - usbId: # class: ["ff"] # vendor: ["03e7"] # device: ["2485"] # - usbId: # class: ["fe"] # vendor: ["1a6e"] # device: ["089a"] # - name: "my.combined.feature" # matchOn: # - pciId: # vendor: ["15b3"] # device: ["1014", "1017"] # loadedKMod : ["vendor_kmod1", "vendor_kmod2"] customConfig: configData: | # - name: "more.kernel.features" # matchOn: # - loadedKMod: ["example_kmod3"] # - name: "more.features.by.nodename" # value: customValue # matchOn: # - nodename: ["special-.*-node-.*"]다음 명령어를 실행하여

NodeFeatureDiscoveryCR 인스턴스를 만듭니다.$ oc create -f NodeFeatureDiscovery.yaml

검증

인스턴스가 생성되었는지 확인하려면 다음을 실행합니다.

$ oc get pods

출력 예

NAME READY STATUS RESTARTS AGE nfd-controller-manager-7f86ccfb58-vgr4x 2/2 Running 0 11m nfd-master-hcn64 1/1 Running 0 60s nfd-master-lnnxx 1/1 Running 0 60s nfd-master-mp6hr 1/1 Running 0 60s nfd-worker-vgcz9 1/1 Running 0 60s nfd-worker-xqbws 1/1 Running 0 60s

성공적인 배포에는

Running상태가 표시됩니다.

9.3.2. 웹 콘솔을 사용하여 NodeEnatureDiscovery CR 만들기

절차

- Operator → 설치된 Operator 페이지로 이동합니다.

- Node Feature Discovery를 찾고 제공된 APIs아래에 있는 상자를 확인합니다.

- 인스턴스 만들기를 클릭합니다.

-

NodefeatureatureDiscoveryCR의 값을 편집합니다. - 생성을 클릭합니다.

9.4. Node Feature Discovery Operator 설정

9.4.1. 코어

core 섹션에는 특정 기능 소스와 관련이 없는 일반적인 구성 설정이 포함되어 있습니다.

core.sleepInterval

core.sleepInterval은 기능 검색 또는 재검색의 연속 통과 간격과 노드 레이블 재지정 간격을 지정합니다. 양수가 아닌 값은 무한 절전 상태를 의미합니다. 재검색되거나 레이블이 다시 지정되지 않습니다.

이 값은 지정된 경우 더 이상 사용되지 않는 --sleep-interval 명령줄 플래그로 재정의됩니다.

사용 예

core:

sleepInterval: 60s 1

기본값은 60s입니다.

core.sources

core.sources는 활성화된 기능 소스 목록을 지정합니다. 특수한 값 all은 모든 기능 소스를 활성화합니다.

이 값은 지정된 경우 더 이상 사용되지 않는 --sources 명령줄 플래그로 재정의됩니다.

기본값: [all]

사용 예

core:

sources:

- system

- custom

core.labelWhiteList