Migration Toolkit for Containers

OpenShift Container Platform 4로 마이그레이션

초록

1장. Migration Toolkit for Containers 정보

MTC(Migration Toolkit for Containers)를 사용하면 네임스페이스 단위로 OpenShift Container Platform 4 클러스터 간에 상태 저장 애플리케이션 워크로드를 마이그레이션할 수 있습니다.

OpenShift Container Platform 3에서 마이그레이션하는 경우 OpenShift Container Platform 3 에서 4로 마이그레이션하고 OpenShift Container Platform 3 에 레거시 Migration Toolkit for Containers Operator 설치 정보를 참조하십시오.

상태 마이그레이션을 사용하여 동일한 클러스터 또는 클러스터 간에 애플리케이션을 마이그레이션할 수 있습니다.

MTC는 마이그레이션을 제어하고 애플리케이션 다운타임을 최소화할 수 있도록 Kubernetes 사용자 지정 리소스를 기반으로 하는 웹 콘솔 및 API를 제공합니다.

MTC 콘솔은 기본적으로 대상 클러스터에 설치되어 있습니다. 원격 클러스터에 콘솔을 설치하도록 Migration Toolkit for Containers Operator를 구성할 수 있습니다.

다음에 대한 자세한 내용은 고급 마이그레이션 옵션을 참조하십시오.

- 마이그레이션 후크 및 MTC API를 사용하여 마이그레이션 자동화.

- 리소스를 제외하고 대규모 마이그레이션을 지원하며 직접 볼륨 마이그레이션을 위해 자동 PV 크기 조정을 활성화하도록 마이그레이션 계획을 구성.

1.1. 용어

표 1.1. MTC 용어

| 용어 | 정의 |

|---|---|

| 소스 클러스터 | 애플리케이션이 마이그레이션되는 클러스터입니다. |

| 대상 클러스터[1] | 애플리케이션이 마이그레이션될 대상 클러스터입니다. |

| 복제 리포지토리 | 간접 마이그레이션 중 또는 직접 볼륨 마이그레이션 또는 직접 이미지 마이그레이션 중에 Kubernetes 오브젝트에 대한 이미지, 볼륨 및 Kubernetes 오브젝트 복사에 사용되는 오브젝트 스토리지입니다. 복제 리포지토리는 모든 클러스터에서 액세스할 수 있어야 합니다. |

| 호스트 클러스터 |

호스트 클러스터에 직접 이미지 마이그레이션을 위해 노출된 레지스트리 경로가 필요하지 않습니다. |

| 원격 클러스터 | 원격 클러스터는 일반적으로 소스 클러스터이지만 필수는 아닙니다.

원격 클러스터에는 원격 클러스터에는 직접 이미지 마이그레이션을 위해 노출된 보안 레지스트리 경로가 필요합니다. |

| 간접 마이그레이션 | 이미지, 볼륨 및 Kubernetes 오브젝트는 소스 클러스터에서 복제 리포지토리로 복사한 다음 복제 리포지토리에서 대상 클러스터로 복사됩니다. |

| 직접 볼륨 마이그레이션 | 영구 볼륨은 소스 클러스터에서 대상 클러스터로 직접 복사됩니다. |

| 직접 이미지 마이그레이션 | 이미지가 소스 클러스터에서 대상 클러스터로 직접 복사됩니다. |

| 마이그레이션 단계 | 애플리케이션을 중지하지 않고 데이터가 대상 클러스터에 복사됩니다. 단계적 마이그레이션을 여러 번 실행하면 컷오버 마이그레이션 기간이 단축됩니다. |

| 컷오버 마이그레이션 | 소스 클러스터에서 애플리케이션이 중지되고 해당 리소스가 대상 클러스터로 마이그레이션됩니다. |

| 상태 마이그레이션 | 애플리케이션 상태는 특정 영구 볼륨 클레임을 대상 클러스터에 복사하여 마이그레이션됩니다. |

| 마이그레이션 롤백 | 마이그레이션 롤백은 완료된 마이그레이션을 롤백합니다. |

1 MTC 웹 콘솔에서 대상 클러스터를 호출합니다.

1.2. MTC 워크플로

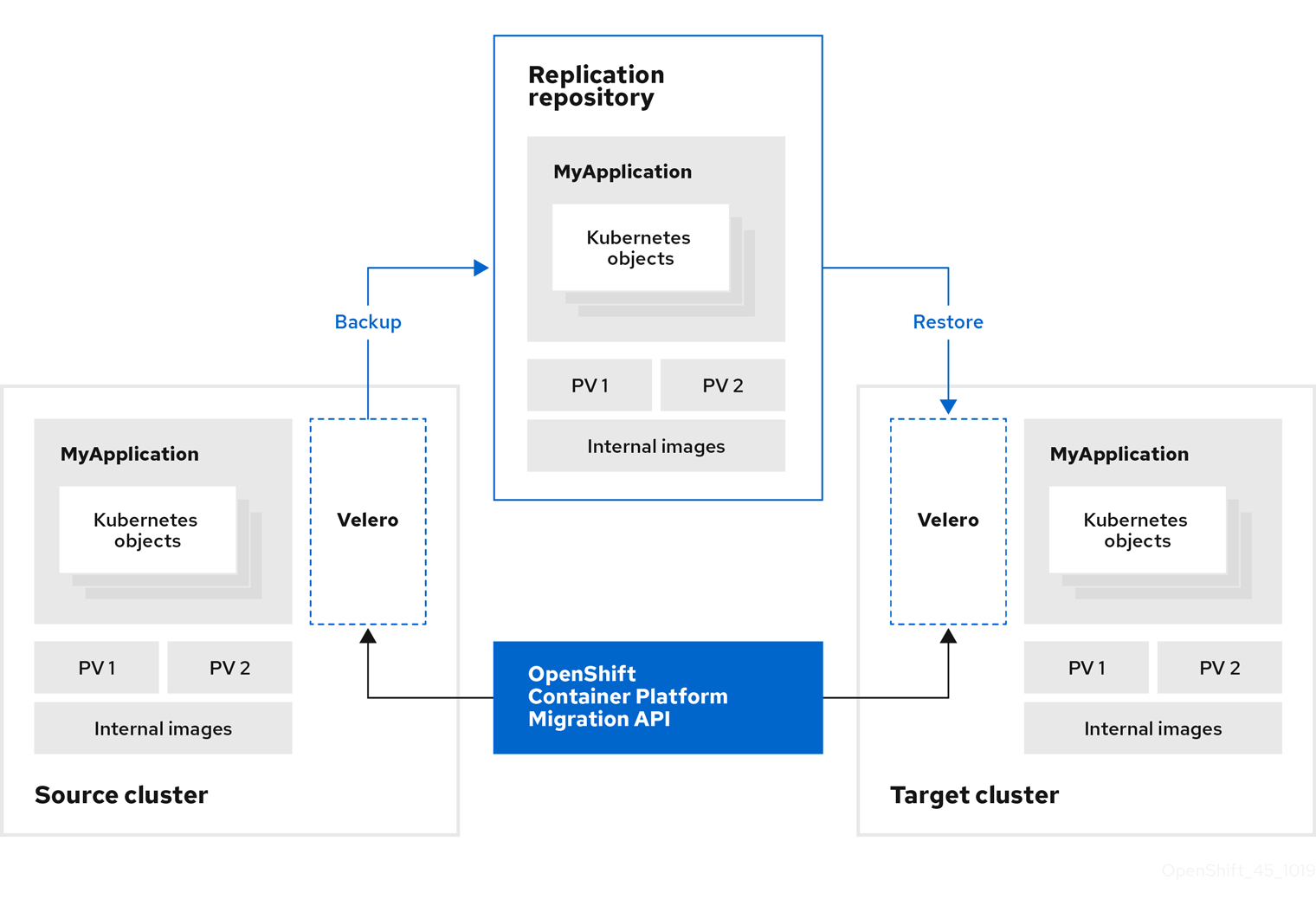

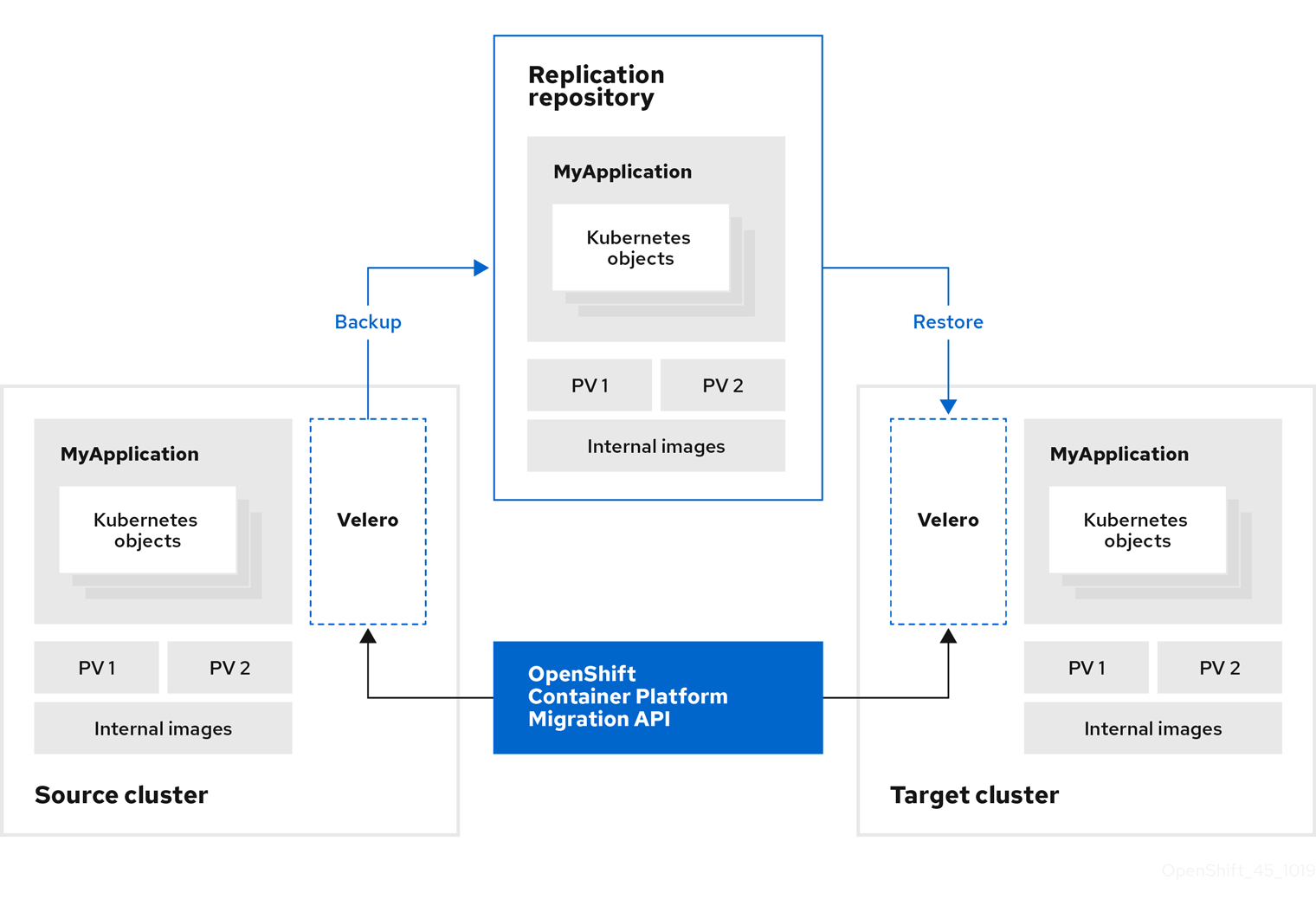

MTC(Migration Toolkit for Containers) 웹 콘솔 또는 Kubernetes API를 사용하여 Kubernetes 리소스, 영구 볼륨 데이터 및 내부 컨테이너 이미지를 OpenShift Container Platform 4.8로 마이그레이션할 수 있습니다.

(MTC)는 다음 리소스를 마이그레이션합니다.

- 마이그레이션 계획에 지정된 네임스페이스입니다.

네임스페이스 범위 리소스: MTC가 네임스페이스를 마이그레이션하면 서비스 또는 포드와 같은 해당 네임스페이스와 연결된 모든 오브젝트 및 리소스를 마이그레이션합니다. 또한 네임스페이스에 존재하지만 클러스터 수준에 없는 리소스가 클러스터 수준에 존재하는 리소스에 따라 달라지는 경우 MTC가 두 개의 리소스 모두를 마이그레이션합니다.

예를 들어 SCC(보안 컨텍스트 제약 조건)는 클러스터 수준에 존재하는 리소스이며, 서비스 계정(SA)은 네임스페이스 수준에 존재하는 리소스입니다. MTC가 마이그레이션하는 네임스페이스에 SA가 있는 경우 MTC는 SA에 연결된 모든 SCC를 자동으로 찾고 해당 SCC도 마이그레이션합니다. 마찬가지로 MTC는 네임스페이스의 영구 볼륨에 연결된 영구 볼륨 클레임을 마이그레이션합니다.

참고리소스에 따라 클러스터 범위 리소스를 수동으로 마이그레이션해야 할 수 있습니다.

- CR(사용자 정의 리소스) 및 CRD(사용자 정의 리소스 정의) MTC는 네임스페이스 수준에서 CR 및 CRD를 자동으로 마이그레이션합니다.

MTC 웹 콘솔을 사용하여 애플리케이션을 마이그레이션하는 데는 다음 단계가 포함됩니다.

모든 클러스터에 Migration Toolkit for Containers Operator를 설치합니다.

인터넷 액세스가 제한되거나 없는 제한된 환경에서 Migration Toolkit for Containers Operator를 설치할 수 있습니다. 소스 및 대상 클러스터는 상호 액세스 권한 및 미러 레지스트리에 대한 네트워크 액세스 권한이 있어야 합니다.

MTC가 데이터를 마이그레이션하는 데 사용하는 중간 오브젝트 스토리지인 복제 리포지토리를 구성합니다.

소스 및 대상 클러스터는 마이그레이션 중에 복제 리포지토리에 대한 네트워크 액세스 권한이 있어야 합니다. 제한된 환경에서 MCG(Multi-Cloud Object Gateway)를 사용할 수 있습니다. 프록시 서버를 사용하는 경우 복제 리포지토리와 클러스터 간의 네트워크 트래픽을 허용하도록 해당 서버를 구성해야 합니다.

- MTC 웹 콘솔에 소스 클러스터를 추가합니다.

- MTC 웹 콘솔에 복제 리포지토리를 추가합니다.

다음 데이터 마이그레이션 옵션 중 하나를 사용하여 마이그레이션 계획을 생성합니다.

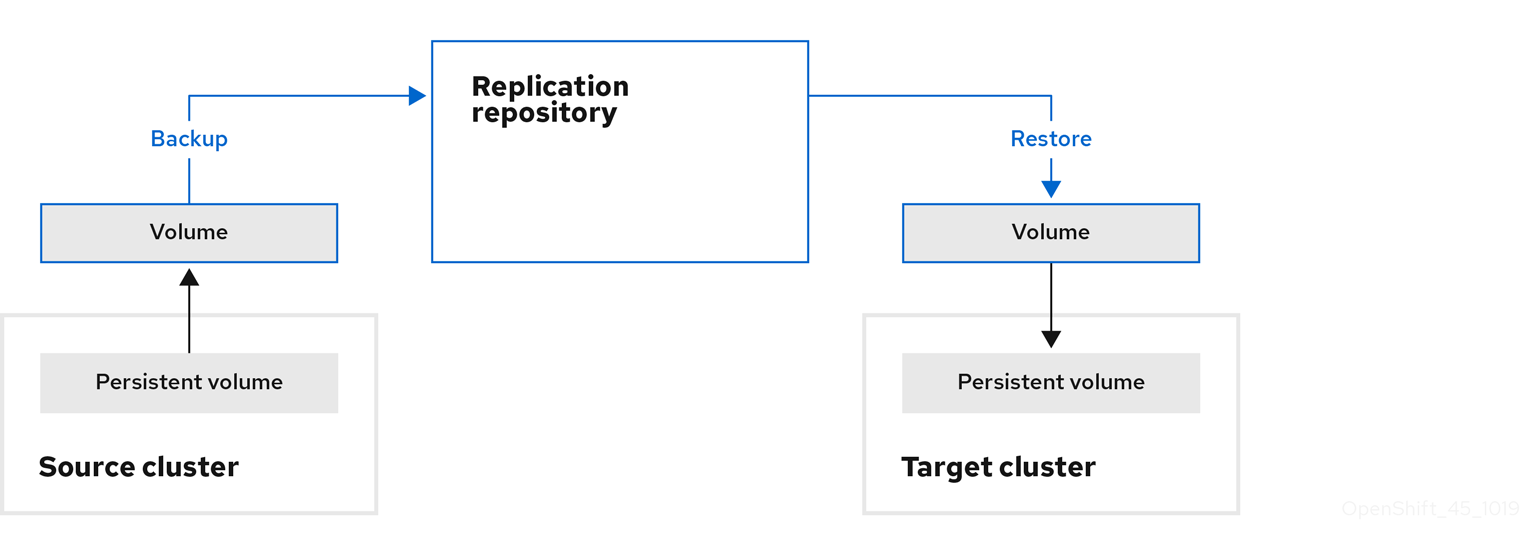

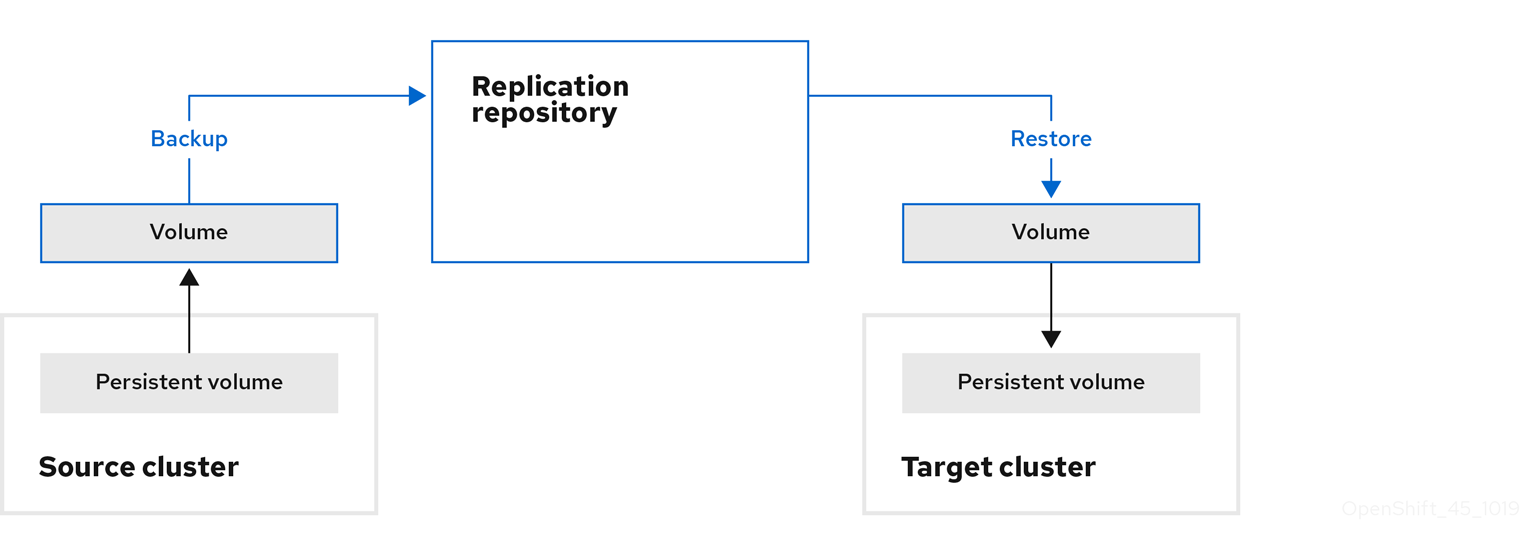

복사: MTC는 소스 클러스터에서 복제 리포지토리로 데이터를 복사하고 복제 리포지토리에서 대상 클러스터로 복사합니다.

참고직접 이미지 마이그레이션 또는 직접 볼륨 마이그레이션을 사용하는 경우 소스 클러스터에서 대상 클러스터로 이미지 또는 볼륨이 직접 복사됩니다.

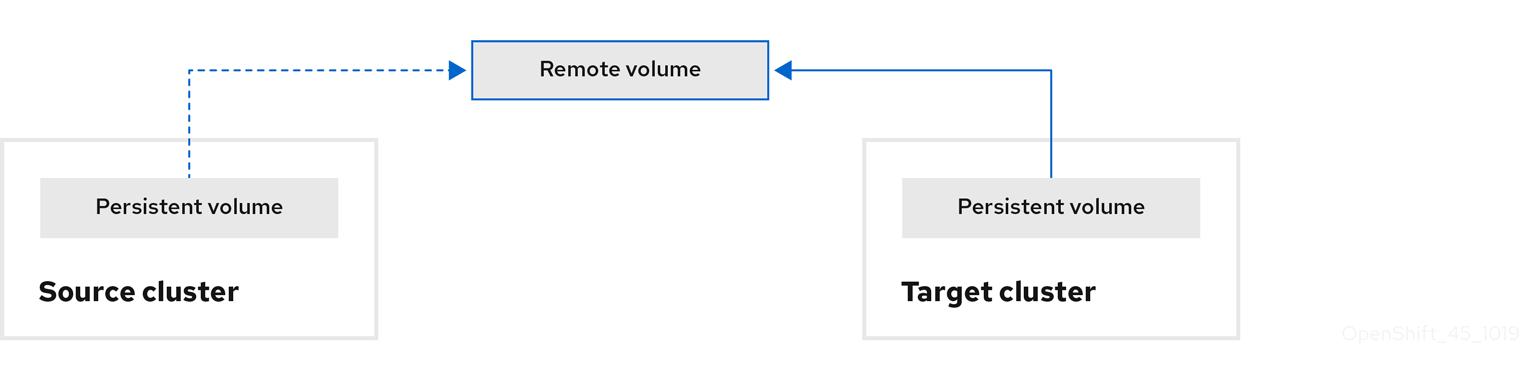

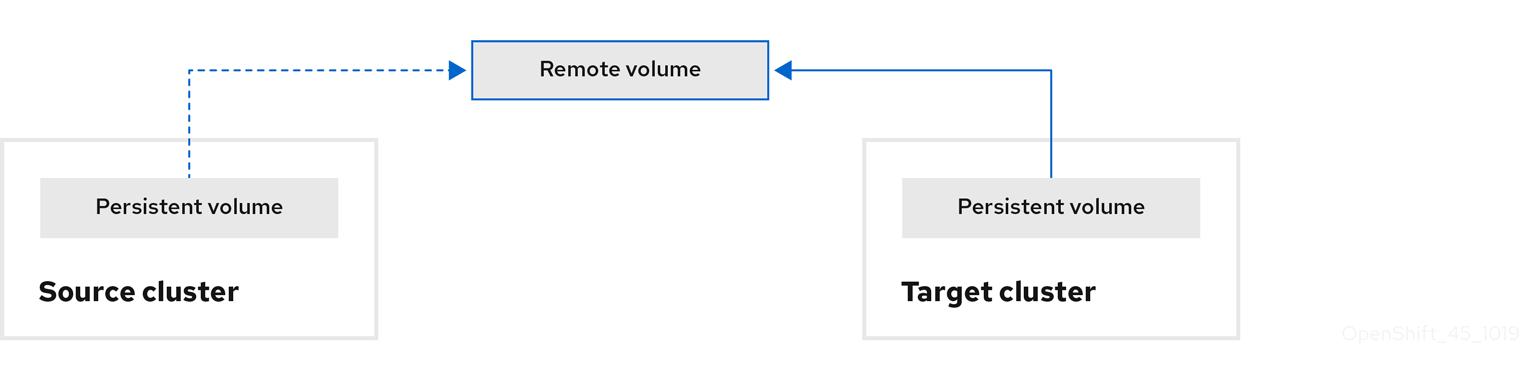

이동: MTC는 소스 클러스터에서 원격 볼륨(예: NFS)을 마운트 해제하고 원격 볼륨을 가리키는 대상 클러스터에 PV 리소스를 생성한 다음 대상 클러스터에 원격 볼륨을 마운트합니다. 대상 클러스터에서 실행되는 애플리케이션은 소스 클러스터와 동일한 원격 볼륨을 사용합니다. 소스 및 대상 클러스터가 원격 볼륨에 액세스할 수 있어야 합니다.

참고이 다이어그램에는 복제 리포지토리가 나타나지 않지만 마이그레이션에는 필수입니다.

다음 옵션 중 하나를 사용하여 마이그레이션 계획을 실행합니다.

스테이지 (Stage)는 애플리케이션을 중지하지 않고 데이터를 대상 클러스터에 복사합니다.

스테이지 마이그레이션을 마이그레이션 전에 대부분의 데이터가 대상에 복사되도록 여러 번 실행할 수 있습니다. 하나 이상의 단계적 마이그레이션을 실행하면 컷오버 마이그레이션 기간이 단축됩니다.

컷오버 (Cutover)는 소스 클러스터에서 애플리케이션을 중지하고 리소스를 대상 클러스터로 이동합니다.

선택 사항: 마이그레이션 중에 소스 클러스터에서 Halt 트랜잭션을 지울 수 있습니다.

1.3. 데이터 복사 방법 정보

Migration Toolkit for Containers(MTC)는 소스 클러스터에서 대상 클러스터로 데이터를 마이그레이션하기 위한 파일 시스템 및 스냅샷 데이터 복사 방법을 지원합니다. 환경에 적합하고 스토리지 공급자가 지원하는 방법을 선택할 수 있습니다.

1.3.1. 파일 시스템 복사 방법

MTC는 소스 클러스터에서 복제 리포지토리로 데이터 파일을 복사하고 다시 대상 클러스터로 복사합니다.

파일 시스템 복사 방법은 간접 마이그레이션에 Restic을 사용하거나 직접 볼륨 마이그레이션에 Rsync를 사용합니다.

표 1.2. 파일 시스템 복사 방법 요약

| 혜택 | 제한 |

|---|---|

|

|

Restic 및 Rsync PV 마이그레이션은 지원되는 PV가 volumeMode=filesystem 인 것으로 가정합니다. 파일 시스템 마이그레이션에는 volumeMode=Block 을 사용할 수 없습니다.

1.3.2. 스냅샷 복사 방법

MTC는 소스 클러스터 데이터의 스냅샷을 클라우드 공급자의 복제 리포지토리에 복사합니다. 대상 클러스터에서 데이터가 복원됩니다.

스냅샷 복사 방법은 Amazon Web Services, Google Cloud Provider 및 Microsoft Azure와 함께 사용할 수 있습니다.

표 1.3. 스냅샷 복사 방법 요약

| 혜택 | 제한 |

|---|---|

|

|

1.4. 직접 볼륨 마이그레이션 및 직접 이미지 마이그레이션

직접 이미지 마이그레이션(DIM) 및 직접 볼륨 마이그레이션(DVM)을 사용하여 소스 클러스터에서 대상 클러스터로 직접 이미지 및 데이터를 마이그레이션할 수 있습니다.

다른 가용성 영역에 있는 노드에서 DVM을 실행하는 경우 마이그레이션된 Pod가 영구 볼륨 클레임에 액세스할 수 없기 때문에 마이그레이션이 실패할 수 있습니다.

DIM 및 DVM은 소스 클러스터에서 복제 리포지토리로 파일을 백업하고 복제 리포지토리에서 대상 클러스터로 파일을 복원하는 중간 단계를 건너뛰기 때문에 상당한 성능 이점을 지닙니다. Rsync를 사용하여 데이터를 전송합ㅌ니다.

DIM과 DVM에는 다른 사전 요구 사항이 있습니다.

2장. Migration Toolkit for Containers 릴리스 노트

MTC(Migration Toolkit for Containers)를 사용하면 네임스페이스 단위로 OpenShift Container Platform 클러스터 간에 애플리케이션 워크로드를 마이그레이션할 수 있습니다.

OpenShift Container Platform 3에서 4.8로 마이그레이션하고 OpenShift Container Platform 4 클러스터 간에 마이그레이션할 수 있습니다.

MTC는 마이그레이션을 제어하고 애플리케이션 다운타임을 최소화할 수 있도록 Kubernetes 사용자 지정 리소스를 기반으로 하는 웹 콘솔 및 API를 제공합니다.

2.1. Migration Toolkit for Containers 1.6 릴리스 노트

MTC(Migration Toolkit for Containers) 버전 1.6 릴리스 노트에서는 새로운 기능 및 개선 사항, 사용되지 않는 기능 및 알려진 문제에 대해 설명합니다.

2.1.1. 새로운 기능 및 개선 사항

이 릴리스에는 다음과 같은 새로운 기능 및 개선 사항이 있습니다.

- 상태 마이그레이션: 특정 PVC(영구 볼륨 클레임)를 선택하여 반복 가능한 상태 전용 마이그레이션을 수행할 수 있습니다.

- "새 운영자 버전 사용 가능" 알림: MTC 웹 콘솔의 클러스터 페이지에 새 Migration Toolkit for Containers Operator를 사용할 수 있는 경우 알림이 표시됩니다.

2.1.2. 더 이상 사용되지 않는 기능

더 이상 사용되지 않는 기능은 다음과 같습니다.

- MTC 버전 1.4는 더 이상 지원되지 않습니다.

2.1.3. 확인된 문제

이 릴리스에는 다음과 같은 알려진 문제가 있습니다.

-

OpenShift Container Platform 3.10에서

MigrationControllerPod는 재시작하는 데 시간이 너무 오래 걸립니다. Bugzilla 보고서에는 해결방법이 포함되어 있습니다. (BZ#1986796) -

IBM Cloud의 기존 OpenShift Container Platform 소스 클러스터에서 직접 볼륨을 마이그레이션하는 동안

스테이지Pod가 실패합니다. IBM 블록 스토리지 플러그인에서는 동일한 노드의 여러 포드에 동일한 볼륨을 마운트할 수 없습니다. 결과적으로 PVC를 Rsync Pod와 애플리케이션 Pod에 동시에 마운트할 수 없습니다. 이 문제를 해결하려면 마이그레이션 전에 애플리케이션 포드를 중지합니다. (BZ#1887526) -

AWS gp2 PVC에 사용 가능한 공간이 없는 경우

MigPlan사용자 정의 리소스에 경고가 표시되지 않습니다. (BZ#1963927) - IBM Cloud용 블록 스토리지는 동일한 가용성 영역에 있어야 합니다. 가상 사설 클라우드용 블록 스토리지는 IBM FAQ를 참조하십시오.

2.2. Migration Toolkit for Containers 1.5 릴리스 노트

MTC(Migration Toolkit for Containers) 버전 1.5의 릴리스 노트는 새로운 기능, 개선 사항 및 알려진 문제에 대해 설명합니다.

2.2.1. 새로운 기능 및 개선 사항

이 릴리스에는 다음과 같은 새로운 기능 및 개선 사항이 있습니다.

- 웹 콘솔의 마이그레이션 세부 정보 페이지의 마이그레이션 리소스 트리는 마이그레이션 모니터링 및 디버깅을 위한 추가 리소스, Kubernetes 이벤트 및 실시간 상태 정보로 향상되었습니다.

- 웹 콘솔은 수백 개의 마이그레이션 계획을 지원할 수 있습니다.

- 소스 네임스페이스는 마이그레이션 계획의 다른 대상 네임스페이스에 매핑될 수 있습니다. 이전에는 소스 네임스페이스가 동일한 이름의 대상 네임스페이스에 매핑되었습니다.

- 상태 정보가 있는 후크 단계는 마이그레이션 중에 웹 콘솔에 표시됩니다.

- 직접 볼륨 마이그레이션 중에 Rsync 재시도 시도 횟수가 웹 콘솔에 표시됩니다.

- 직접 볼륨 마이그레이션에 대해 영구 볼륨(PV) 크기 조정을 활성화하여 대상 클러스터에 디스크 공간이 부족하지 않도록 할 수 있습니다.

- PV 크기 조정을 트리거하는 임계값을 구성할 수 있습니다. 이전에는 디스크 사용량이 97%를 초과하면 PV 크기 조정이 발생했습니다.

- Velero가 버전 1.6으로 업데이트되어 다양한 수정 사항 및 개선 사항을 제공합니다.

- 캐시된 Kubernetes 클라이언트를 활성화하여 성능을 향상시킬 수 있습니다.

2.2.2. 더 이상 사용되지 않는 기능

더 이상 사용되지 않는 기능은 다음과 같습니다.

- MTC 버전 1.2 및 1.3은 더 이상 지원되지 않습니다.

-

oc convert명령이 더 이상 사용되지 않으므로 사용되지 않는 API를 업데이트하는 절차는 설명서의 문제 해결 섹션에서 제거되었습니다.

2.2.3. 확인된 문제

이 릴리스에는 다음과 같은 알려진 문제가 있습니다.

-

400개 이상의 마이그레이션 계획을 생성하는 경우 Microsoft Azure 스토리지를 사용할 수 없습니다.

MigStorage사용자 정의 리소스에는 다음 메시지가 표시됩니다.작업 유형에 대해 한도에 도달하면 요청이 제한됩니다. (BZ#1977226) - 마이그레이션에 실패하면 마이그레이션 계획에서 quiesced Pod에 대한 사용자 정의 PV(영구 볼륨) 설정이 유지되지 않습니다. 마이그레이션을 수동으로 롤백하고 마이그레이션 계획을 삭제하고 PV 설정으로 새 마이그레이션 계획을 생성해야 합니다. (BZ#1784899)

-

pv_resizing_threshold가 42% 이상인 경우가 아니면 PV 크기 조정은 AWS gp2 스토리지에 대해 예상대로 작동하지 않습니다. (BZ#1973148) 다음 시나리오의 OpenShift Container Platform 3.7 및 3.9 소스 클러스터에서 PV 크기 조정이 작동하지 않습니다.

- MTC를 설치한 후 애플리케이션이 설치되었습니다.

MTC를 설치한 후 애플리케이션 pod가 다른 노드에 다시 예약되었습니다.

OpenShift Container Platform 3.7 및 3.9는 Velero가

ResticPod에 자동으로 PV를 마운트할 수 있도록 하는 Mount Propagation 기능을 지원하지 않습니다.MigAnalyticCR(사용자 정의 리소스)은ResticPod에서 PV 데이터를 수집하지 못하고 리소스를0으로 보고합니다.MigPlanCR에는 다음과 유사한 상태가 표시됩니다.출력 예

status: conditions: - category: Warn lastTransitionTime: 2021-07-15T04:11:44Z message: Failed gathering extended PV usage information for PVs [nginx-logs nginx-html], please see MigAnalytic openshift-migration/ocp-24706-basicvolmig-migplan-1626319591-szwd6 for details reason: FailedRunningDf status: "True" type: ExtendedPVAnalysisFailedPV 크기 조정을 활성화하려면 소스 클러스터에서 Restic 데몬 세트를 수동으로 다시 시작하거나 애플리케이션과 동일한 노드에서

ResticPod를 다시 시작할 수 있습니다. Restic을 다시 시작하지 않으면 PV 크기 조정 없이 직접 볼륨 마이그레이션을 실행할 수 있습니다. (BZ#1982729)

2.2.4. 기술 변경 사항

이 릴리스에는 다음과 같은 기술 변경 사항이 있습니다.

- 기존 Migration Toolkit for Containers Operator 버전 1.5.1은 OpenShift Container Platform 버전 3.7에서 4.5로 수동으로 설치됩니다.

- Migration Toolkit for Containers Operator 버전 1.5.1은 Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 버전 4.6 이상에 설치됩니다.

2.3. Migration Toolkit for Containers 1.4 릴리스 노트

MTC(Migration Toolkit for Containers) 버전 1.4의 릴리스 노트는 새로운 기능, 개선 사항 및 알려진 문제에 대해 설명합니다.

2.3.1. 확인된 문제

- MTC 1.4.6은 OpenShift Container Platform 3.9 (BZ#1981794) 또는 3.10(BZ#1981537)에 배포할 수 없습니다.

3장. MTC 설치

OpenShift Container Platform 4에 MTC(Migration Toolkit for Containers)를 설치할 수 있습니다.

OpenShift Container Platform 3에 MTC를 설치하려면 OpenShift Container Platform 3에 레거시 Migration Toolkit for Containers Operator 설치를 참조하십시오.

기본적으로 MTC 웹 콘솔 및 Migration Controller Pod는 대상 클러스터에서 실행됩니다. 원격 클러스터에서 MTC 웹 콘솔 및 Migration Controller Pod를 실행하도록 Migration Controller 사용자 정의 리소스 매니페스트를 구성할 수 있습니다.

MTC를 설치한 후에는 복제 리포지토리로 사용할 오브젝트 스토리지를 구성해야 합니다.

MTC를 설치 제거하려면 MTC 설치 및 리소스 삭제를 참조하십시오.

3.1. 호환성 지침

OpenShift Container Platform 버전과 호환되는 MTC(Migration Toolkit for Containers) Operator를 설치해야 합니다.

정의

- 기존 플랫폼

- OpenShift Container Platform 4.5 및 이전 버전.

- 최신 플랫폼

- OpenShift Container Platform 4.6 이상

- 기존 Operator

- 레거시 플랫폼을 위해 설계된 MTC Operator입니다.

- 최신 Operator

- 최신 플랫폼을 위해 설계된 MTC Operator입니다.

- 클러스터 제어

- MTC 컨트롤러 및 GUI를 실행하는 클러스터입니다.

- 원격 클러스터

- Velero를 실행하는 마이그레이션의 소스 또는 대상 클러스터입니다. Control Cluster는 Velero API를 통해 원격 클러스터와 통신하여 마이그레이션을 구동합니다.

표 3.1. MTC 호환성: 기존 플랫폼에서 마이그레이션

| OpenShift Container Platform 4.5 또는 이전 | OpenShift Container Platform 4.6 이상 | |

|---|---|---|

| 안정적인 MTC 버전 | MTC 1.7.z

legacy 1.7 operator: 중요 이 클러스터는 제어 클러스터가 될 수 없습니다. | MTC 1.7.z

OLM과 함께 설치, 릴리스 채널 |

현대 클러스터가 마이그레이션에 관련된 다른 클러스터에 연결하지 못하도록 하는 에지 사례가 있습니다. 예를 들어 온프레미스의 OpenShift Container Platform 3.11 클러스터에서 클라우드의 최신 OpenShift Container Platform 클러스터로 마이그레이션할 때 최신 클러스터가 OpenShift Container Platform 3.11 클러스터에 연결할 수 없습니다.

MTC 1.7을 사용하면 네트워크 제한으로 인해 원격 클러스터 중 하나가 컨트롤 클러스터와 통신할 수 없는 경우 crane tunnel-api 명령을 사용합니다.

안정적인 MTC 릴리스에서는 항상 최신 클러스터를 제어 클러스터로 지정해야 하지만 이 특정 경우 레거시 클러스터를 제어 클러스터로 지정하고 워크로드를 원격 클러스터로 푸시할 수 있습니다.

3.2. OpenShift Container Platform 4.2에서 4.5로 레거시 Migration Toolkit for Containers Operator 설치

OpenShift Container Platform 버전 4.2에서 4.5로 레거시 Migration Toolkit for Containers Operator를 수동으로 설치할 수 있습니다.

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다. -

registry.redhat.io에 대한 액세스 권한이 있어야 합니다. -

podman이 설치되어 있어야 합니다.

절차

Red Hat Customer Portal 자격 증명을 사용하여

registry.redhat.io에 로그인합니다.$ sudo podman login registry.redhat.io

다음 명령을 입력하여

operator.yml파일을 다운로드합니다.$ sudo podman cp $(sudo podman create \ registry.redhat.io/rhmtc/openshift-migration-legacy-rhel8-operator:v1.7):/operator.yml ./

다음 명령을 입력하여

controller.yml파일을 다운로드합니다.$ sudo podman cp $(sudo podman create \ registry.redhat.io/rhmtc/openshift-migration-legacy-rhel8-operator:v1.7):/controller.yml ./

- 소스 클러스터에 로그인합니다.

클러스터가

registry.redhat.io로 인증할 수 있는지 확인합니다.$ oc run test --image registry.redhat.io/ubi8 --command sleep infinity

Migration Toolkit for Containers Operator 오브젝트 생성:

$ oc create -f operator.yml

출력 예

namespace/openshift-migration created rolebinding.rbac.authorization.k8s.io/system:deployers created serviceaccount/migration-operator created customresourcedefinition.apiextensions.k8s.io/migrationcontrollers.migration.openshift.io created role.rbac.authorization.k8s.io/migration-operator created rolebinding.rbac.authorization.k8s.io/migration-operator created clusterrolebinding.rbac.authorization.k8s.io/migration-operator created deployment.apps/migration-operator created Error from server (AlreadyExists): error when creating "./operator.yml": rolebindings.rbac.authorization.k8s.io "system:image-builders" already exists 1 Error from server (AlreadyExists): error when creating "./operator.yml": rolebindings.rbac.authorization.k8s.io "system:image-pullers" already exists- 1

Error from server (AlreadyExists)메시지를 무시할 수 있습니다. 이는 Migration Toolkit for Containers Operator가 이후 릴리스에서 제공되는 OpenShift Container Platform 4 이전 버전에 대한 리소스를 생성하기 때문에 발생합니다.

MigrationController오브젝트를 만듭니다.$ oc create -f controller.yml

MTC pod가 실행 중인지 확인합니다.

$ oc get pods -n openshift-migration

3.3. OpenShift Container Platform 4.8에 Migration Toolkit for Containers Operator 설치

Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 4.8에 Migration Toolkit for Containers Operator를 설치합니다.

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다.

절차

- OpenShift Container Platform 웹 콘솔에서 Operator → OperatorHub를 클릭합니다.

- 키워드로 필터링 필드를 사용하여 Migration Toolkit for Containers Operator를 찾습니다.

- Migration Toolkit for Containers Operator를 선택하고 설치를 클릭합니다.

설치를 클릭합니다.

설치된 Operators 페이지에서 Migration Toolkit for Containers Operator는 openshift-migration 프로젝트에 Succeeded 상태로 나타납니다.

- Migration Toolkit for Containers Operator를 클릭합니다.

- 제공된 API 아래에서 마이그레이션 컨트롤러 타일을 찾고 인스턴스 작성을 클릭합니다.

- 생성을 클릭합니다.

- 워크로드 → Pod를 클릭하여 MTC pod가 실행 중인지 확인합니다.

3.4. 프록시 설정

OpenShift Container Platform 4.1 및 이전 버전의 경우 이러한 버전은 클러스터 전체 프록시 오브젝트를 지원하지 않기 때문에 Migration Toolkit for Containers Operator를 설치한 후 MigrationController CR(사용자 정의 리소스) 매니페스트에서 proxy를 구성해야 합니다.

OpenShift Container Platform 4.2에서 4.8로, MTC(Migration Toolkit for Containers)는 클러스터 전체 프록시 설정을 상속합니다. 클러스터 전체 프록시 설정을 재정의하려면 프록시 매개변수를 변경할 수 있습니다.

3.4.1. 직접 볼륨 마이그레이션

MTC 1.4.2에서 직접 볼륨 마이그레이션(DVM)이 도입되었습니다. DVM은 하나의 프록시만 지원합니다. 대상 클러스터가 프록시 뒤에 있는 경우 소스 클러스터는 대상 클러스터의 경로에 액세스할 수 없습니다.

프록시 뒤에서 소스 클러스터에서 DVM을 수행하려면 전송 계층에서 작동하는 TCP 프록시를 구성하고 자체 SSL 인증서로 암호를 해독하고 재암호화하지 않고도 SSL 연결을 투명하게 전달해야 합니다. Stunnel 프록시는 이러한 프록시의 예입니다.

3.4.1.1. DVM용 TCP 프록시 설정

TCP 프록시를 통해 소스와 대상 클러스터 간에 직접 연결하고 프록시를 사용하도록 MigrationController CR에서 stunnel_tcp_proxy 변수를 구성할 수 있습니다.

apiVersion: migration.openshift.io/v1alpha1 kind: MigrationController metadata: name: migration-controller namespace: openshift-migration spec: [...] stunnel_tcp_proxy: http://username:password@ip:port

직접 볼륨 마이그레이션(DVM)은 프록시에 대한 기본 인증만 지원합니다. 또한 DVM은 TCP 연결을 투명하게 터널링할 수 있는 프록시 뒤에서만 작동합니다. 중간자 모드에서 HTTP/HTTPS 프록시가 작동하지 않습니다. 기존 클러스터 전체 프록시에서 이 동작을 지원하지 않을 수 있습니다. 결과적으로 DVM의 프록시 설정은 의도적으로 MTC의 일반 프록시 구성과 다르게 유지됩니다.

3.4.1.2. HTTP/HTTPS 프록시 대신 TCP 프록시를 사용하는 이유는 무엇입니까?

OpenShift 경로를 통해 소스와 대상 클러스터 간에 Rsync를 실행하여 DVM을 활성화할 수 있습니다. 트래픽은 TCP 프록시인 Stunnel을 사용하여 암호화됩니다. 소스 클러스터에서 실행되는 Stunnel은 대상 Stunnel을 사용한 TLS 연결을 시작하고 암호화된 채널을 통해 데이터를 전송합니다.

OpenShift의 클러스터 전체 HTTP/HTTPS 프록시는 일반적으로 자체 TLS 세션을 외부 서버와 협상하는 중간자 모드로 구성됩니다. 그러나 이 작업은 Stunnel에서는 작동하지 않습니다. Stunnel은 프록시에서 TLS 세션을 그대로 전환해야 하므로 기본적으로 프록시를 통해 TCP 연결을 그대로 전달하는 투명한 터널로 프록시를 설정해야 합니다. 따라서 TCP 프록시를 사용해야 합니다.

3.4.1.3. 알려진 문제

마이그레이션 실패 오류 업그레이드 요청 필요

마이그레이션 컨트롤러는 SPDY 프로토콜을 사용하여 원격 Pod 내에서 명령을 실행합니다. 원격 클러스터가 프록시 또는 SPDY 프로토콜을 지원하지 않는 방화벽 뒤에 있는 경우 마이그레이션 컨트롤러가 원격 명령을 실행하지 못합니다. 오류 메시지 업그레이드 요청 과 함께 마이그레이션이 실패합니다. 해결방법: SPDY 프로토콜을 지원하는 프록시를 사용합니다.

SPDY 프로토콜 지원 외에도 프록시 또는 방화벽은 Upgrade HTTP 헤더를 API 서버에 전달해야 합니다. 클라이언트는 이 헤더를 사용하여 API 서버와의 websocket 연결을 엽니다. 업그레이드 헤더가 프록시 또는 방화벽에 의해 차단된 경우 마이그레이션은 오류 메시지 업그레이드 요청 필요 와 함께 실패합니다. 해결방법: 프록시가 Upgrade 헤더를 전달하도록 합니다.

3.4.2. 마이그레이션을 위한 네트워크 정책 튜닝

OpenShift는 클러스터에서 사용하는 네트워크 플러그인을 기반으로 NetworkPolicy 또는 EgressFirewall 을 사용하여 Pod로 트래픽을 제한할 수 있습니다. 마이그레이션과 관련된 소스 네임스페이스가 이러한 메커니즘을 사용하여 네트워크 트래픽을 포드로 제한하는 경우 제한이 마이그레이션 중에 Rsync pod로의 트래픽을 실수로 중지할 수 있습니다.

소스 및 대상 클러스터에서 둘 다 실행되는 rsync Pod는 OpenShift 경로를 통해 서로 연결되어야 합니다. 기존 NetworkPolicy 또는 EgressNetworkPolicy 오브젝트는 이러한 트래픽 제한에서 Rsync Pod를 자동으로 제외하도록 구성할 수 있습니다.

3.4.2.1. NetworkPolicy 구성

3.4.2.1.1. Rsync Pod의 송신 트래픽

소스 또는 대상 네임스페이스의 NetworkPolicy 구성이 이러한 유형의 트래픽을 차단하는 경우 Rsync Pod의 고유한 레이블을 사용하여 송신 트래픽이 해당 트래픽에서 전달되도록 허용할 수 있습니다. 다음 정책은 네임스페이스의 Rsync Pod에서 모든 송신 트래픽을 허용합니다.

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-all-egress-from-rsync-pods

spec:

podSelector:

matchLabels:

owner: directvolumemigration

app: directvolumemigration-rsync-transfer

egress:

- {}

policyTypes:

- Egress3.4.2.1.2. Rsync pod로의 수신 트래픽

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-all-egress-from-rsync-pods

spec:

podSelector:

matchLabels:

owner: directvolumemigration

app: directvolumemigration-rsync-transfer

ingress:

- {}

policyTypes:

- Ingress3.4.2.2. EgressNetworkPolicy 구성

EgressNetworkPolicy 오브젝트 또는 Egress Firewalls 는 클러스터를 나가는 송신 트래픽을 차단하도록 설계된 OpenShift 구조입니다.

NetworkPolicy 오브젝트와 달리 Egress Firewall은 네임스페이스의 모든 포드에 적용되므로 프로젝트 수준에서 작동합니다. 따라서 Rsync Pod의 고유 레이블은 제한 사항에서 Rsync Pod만 제외하지 않습니다. 그러나 두 클러스터 간에 직접 연결을 설정할 수 있도록 소스 또는 대상 클러스터의 CIDR 범위를 정책의 허용 규칙에 추가할 수 있습니다.

Egress Firewall이 있는 클러스터를 기반으로 다른 클러스터의 CIDR 범위를 추가하여 둘 사이의 송신 트래픽을 허용할 수 있습니다.

apiVersion: network.openshift.io/v1

kind: EgressNetworkPolicy

metadata:

name: test-egress-policy

namespace: <namespace>

spec:

egress:

- to:

cidrSelector: <cidr_of_source_or_target_cluster>

type: Deny3.4.2.3. Rsync Pod에 대한 추가 그룹 구성

PVC에서 공유 스토리지를 사용하는 경우 Pod에서 액세스를 허용하기 위해 Rsync Pod 정의에 추가 그룹을 추가하여 해당 스토리지에 대한 액세스를 구성할 수 있습니다.

표 3.2. Rsync Pod의 보조 그룹

| 변수 | 유형 | 기본값 | 설명 |

|---|---|---|---|

|

| string | 설정되지 않음 | 소스 Rsync Pod에 대한 콤마로 구분된 추가 그룹 목록 |

|

| string | 설정되지 않음 | 대상 Rsync Pod에 대한 콤마로 구분된 추가 그룹 목록 |

사용 예

MigrationController CR을 업데이트하여 이러한 추가 그룹에 대한 값을 설정할 수 있습니다.

spec: src_supplemental_groups: "1000,2000" target_supplemental_groups: "2000,3000"

3.4.3. 프록시 구성

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다.

프로세스

MigrationControllerCR 매니페스트를 가져옵니다.$ oc get migrationcontroller <migration_controller> -n openshift-migration

프록시 매개변수를 업데이트합니다.

apiVersion: migration.openshift.io/v1alpha1 kind: MigrationController metadata: name: <migration_controller> namespace: openshift-migration ... spec: stunnel_tcp_proxy: http://<username>:<password>@<ip>:<port> 1 noProxy: example.com 2

하위 도메인과 일치하려면 도메인 앞에

.을 입력합니다. 예를 들어,.y.com은x.y.com과 일치하지만y.com은 일치하지 않습니다.*를 사용하여 모든 대상에 대해 프록시를 바이패스합니다.networking.machineNetwork[].cidr필드에 의해 정의된 네트워크에 포함되어 있지 않은 작업자를 설치 구성에서 확장하려면 연결 문제를 방지하기 위해 이 목록에 해당 작업자를 추가해야 합니다.httpProxy또는httpsProxy필드가 설정되지 않은 경우 이 필드는 무시됩니다.-

매니페스트를

migration-controller.yaml로 저장합니다. 업데이트된 매니페스트를 적용합니다.

$ oc replace -f migration-controller.yaml -n openshift-migration

자세한 내용은 클러스터 전체 프록시 구성을 참조하십시오.

3.5. 복제 리포지토리 구성

복제 리포지토리로 사용할 오브젝트 스토리지를 구성해야 합니다. MTC(Migration Toolkit for Containers)는 소스 클러스터에서 복제 리포지토리로 데이터를 복사한 다음 복제 리포지토리에서 대상 클러스터로 데이터를 복사합니다.

MTC는 소스 클러스터에서 대상 클러스터로 데이터를 마이그레이션하기 위한 파일 시스템 및 스냅샷 데이터 복사 방법을 지원합니다. 환경에 적합하며 스토리지 공급자가 지원하는 방법을 선택합니다.

MTC는 다음과 같은 스토리지 제공자를 지원합니다.

- MCG(Multi-Cloud Object Gateway)

- AWS(Amazon Web Services) S3

- GCP(Google Cloud Platform)

- Microsoft Azure Blob

- 일반 S3 오브젝트 스토리지(예: Minio 또는 Ceph S3)

3.5.1. 사전 요구 사항

- 모든 클러스터에는 복제 리포지토리에 대한 중단없는 네트워크 액세스 권한이 있어야 합니다.

- 내부 호스팅 복제 리포지토리와 함께 프록시 서버를 사용하는 경우 프록시가 복제 리포지토리에 액세스할 수 있는지 확인해야 합니다.

3.5.2. MCG(Multi-Cloud Object Gateway) 구성

OpenShift Container Storage Operator를 설치하고 MCG(Multi-Cloud Object Gateway) 스토리지 버킷을 MTC(Migration Toolkit for Containers)의 복제 리포지토리로 구성할 수 있습니다.

3.5.2.1. OpenShift Container Storage Operator 설치

OperatorHub에서 OpenShift Container Storage Operator를 설치할 수 있습니다.

프로세스

- OpenShift Container Platform 웹 콘솔에서 Operator → OperatorHub를 클릭합니다.

- 키워드로 필터링(이 경우 OCS)을 사용하여 OpenShift Container Storage Operator를 찾습니다.

- OpenShift Container Storage Operator를 선택하고 설치를 클릭합니다.

- 업데이트 채널, 설치 모드 및 승인 전략을 선택합니다.

설치를 클릭합니다.

설치된 운영자 페이지에서 OpenShift Container Storage Operator가 openshift-storage 프로젝트에 Succeeded 상태로 나타납니다.

3.5.2.2. Multi-Cloud Object Gateway 스토리지 버킷 작성

MCG(Multi-Cloud Object Gateway) 스토리지 버킷의 사용자 정의 리소스(CR)를 생성할 수 있습니다.

프로세스

OpenShift Container Platform 클러스터에 로그인합니다.

$ oc login -u <username>

다음과 같은 내용과 함께

NooBaaCR 구성 파일,noobaa.yml을 생성합니다.apiVersion: noobaa.io/v1alpha1 kind: NooBaa metadata: name: <noobaa> namespace: openshift-storage spec: dbResources: requests: cpu: 0.5 1 memory: 1Gi coreResources: requests: cpu: 0.5 2 memory: 1GiNooBaa오브젝트를 생성합니다.$ oc create -f noobaa.yml

다음과 같은 내용과 함께

BackingStoreCR 구성 파일bs.yml을 생성합니다.apiVersion: noobaa.io/v1alpha1 kind: BackingStore metadata: finalizers: - noobaa.io/finalizer labels: app: noobaa name: <mcg_backing_store> namespace: openshift-storage spec: pvPool: numVolumes: 3 1 resources: requests: storage: <volume_size> 2 storageClass: <storage_class> 3 type: pv-poolBackingStore오브젝트를 생성합니다.$ oc create -f bs.yml

다음과 같은 내용으로

BucketClassCR 구성 파일,bc.yml을 생성합니다.apiVersion: noobaa.io/v1alpha1 kind: BucketClass metadata: labels: app: noobaa name: <mcg_bucket_class> namespace: openshift-storage spec: placementPolicy: tiers: - backingStores: - <mcg_backing_store> placement: SpreadBucketClass오브젝트를 생성합니다.$ oc create -f bc.yml

다음과 같은 내용과 함께

ObjectBucketClaimCR 구성 파일,obc.yml을 생성합니다.apiVersion: objectbucket.io/v1alpha1 kind: ObjectBucketClaim metadata: name: <bucket> namespace: openshift-storage spec: bucketName: <bucket> 1 storageClassName: <storage_class> additionalConfig: bucketclass: <mcg_bucket_class>- 1

- MTC 웹 콘솔에 복제 리포지토리를 추가하기 위한 버킷 이름을 기록합니다.

ObjectBucketClaim오브젝트를 생성합니다.$ oc create -f obc.yml

리소스 생성 프로세스를 보고

ObjectBucketClaim상태가Bound인지 확인합니다.$ watch -n 30 'oc get -n openshift-storage objectbucketclaim migstorage -o yaml'

이 프로세스는 5-10분 정도 걸릴 수 있습니다.

MTC 웹 콘솔에 복제 리포지토리를 추가할 때 필요한 다음 값을 확보하고 기록합니다.

S3 끝점:

$ oc get route -n openshift-storage s3

S3 공급자 액세스 키:

$ oc get secret -n openshift-storage migstorage \ -o go-template='{{ .data.AWS_ACCESS_KEY_ID }}' | base64 --decodeS3 공급자 보안 액세스 키:

$ oc get secret -n openshift-storage migstorage \ -o go-template='{{ .data.AWS_SECRET_ACCESS_KEY }}' | base64 --decode

3.5.3. Amazon Web Services S3 구성

MTC(Migration Toolkit for Containers)의 복제 리포지토리로 AWS(Amazon Web Services) S3 스토리지 버킷을 구성할 수 있습니다.

사전 요구 사항

- 소스 및 대상 클러스터에서 AWS S3 스토리지 버킷에 액세스할 수 있어야 합니다.

- AWS CLI가 설치되어 있어야 합니다.

스냅샷 복사 방법을 사용하는 경우:

- EC2 EBS(Elastic Block Storage)에 액세스할 수 있어야 합니다.

- 소스 및 대상 클러스터는 동일한 지역에 있어야 합니다.

- 소스 및 대상 클러스터는 동일한 스토리지 클래스를 보유해야 합니다.

- 스토리지 클래스는 스냅샷과 호환 가능해야 합니다.

프로세스

AWS S3 버킷을 생성합니다.

$ aws s3api create-bucket \ --bucket <bucket> \ 1 --region <bucket_region> 2IAM 사용자

velero를 생성합니다.$ aws iam create-user --user-name velero

EC2 EBS 스냅샷 정책을 생성합니다.

$ cat > velero-ec2-snapshot-policy.json <<EOF { "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Action": [ "ec2:DescribeVolumes", "ec2:DescribeSnapshots", "ec2:CreateTags", "ec2:CreateVolume", "ec2:CreateSnapshot", "ec2:DeleteSnapshot" ], "Resource": "*" } ] } EOF하나 또는 모든 S3 버킷에 대한 AWS S3 액세스 정책을 생성합니다.

$ cat > velero-s3-policy.json <<EOF { "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Action": [ "s3:GetObject", "s3:DeleteObject", "s3:PutObject", "s3:AbortMultipartUpload", "s3:ListMultipartUploadParts" ], "Resource": [ "arn:aws:s3:::<bucket>/*" 1 ] }, { "Effect": "Allow", "Action": [ "s3:ListBucket", "s3:GetBucketLocation", "s3:ListBucketMultipartUploads" ], "Resource": [ "arn:aws:s3:::<bucket>" 2 ] } ] } EOF출력 예

"Resource": [ "arn:aws:s3:::*"EC2 EBS 정책을

velero에 연결합니다.$ aws iam put-user-policy \ --user-name velero \ --policy-name velero-ebs \ --policy-document file://velero-ec2-snapshot-policy.json

AWS S3 정책을

velero에 연결합니다.$ aws iam put-user-policy \ --user-name velero \ --policy-name velero-s3 \ --policy-document file://velero-s3-policy.json

velero에 대한 액세스 키를 생성합니다.$ aws iam create-access-key --user-name velero { "AccessKey": { "UserName": "velero", "Status": "Active", "CreateDate": "2017-07-31T22:24:41.576Z", "SecretAccessKey": <AWS_SECRET_ACCESS_KEY>, 1 "AccessKeyId": <AWS_ACCESS_KEY_ID> 2 } }AWS_SECRET_ACCESS_KEY및AWS_ACCESS_KEY_ID를 기록합니다. 인증 정보를 사용하여 AWS를 복제 리포지토리로 추가합니다.

3.5.4. GCP(Google Cloud Platform) 구성

GCP(Google Cloud Platform) 스토리지 버킷을 MTC(Migration Toolkit for Containers)의 복제 리포지토리로 구성할 수 있습니다.

사전 요구 사항

- 소스 및 대상 클러스터에서 GCP 스토리지 버킷에 액세스할 수 있어야 합니다.

-

gsutil이 설치되어 있어야 합니다. 스냅샷 복사 방법을 사용하는 경우:

- 소스 및 대상 클러스터는 동일한 지역에 있어야 합니다.

- 소스 및 대상 클러스터는 동일한 스토리지 클래스를 보유해야 합니다.

- 스토리지 클래스는 스냅샷과 호환 가능해야 합니다.

프로세스

gsutil에 로그인합니다.$ gsutil init

출력 예

Welcome! This command will take you through the configuration of gcloud. Your current configuration has been set to: [default] To continue, you must login. Would you like to login (Y/n)?

BUCKET변수를 설정합니다.$ BUCKET=<bucket> 1스토리지 버킷을 생성합니다.

$ gsutil mb gs://$BUCKET/

PROJECT_ID변수를 활성 프로젝트로 설정합니다.$ PROJECT_ID=`gcloud config get-value project`

VeleroIAM 서비스 계정을 생성합니다.$ gcloud iam service-accounts create velero \ --display-name "Velero Storage"SERVICE_ACCOUNT_EMAIL변수를 생성합니다.$ SERVICE_ACCOUNT_EMAIL=`gcloud iam service-accounts list \ --filter="displayName:Velero Storage" \ --format 'value(email)'`

ROLE_PERMISSIONS변수를 생성합니다.$ ROLE_PERMISSIONS=( compute.disks.get compute.disks.create compute.disks.createSnapshot compute.snapshots.get compute.snapshots.create compute.snapshots.useReadOnly compute.snapshots.delete compute.zones.get )velero.server사용자 정의 역할을 생성합니다.$ gcloud iam roles create velero.server \ --project $PROJECT_ID \ --title "Velero Server" \ --permissions "$(IFS=","; echo "${ROLE_PERMISSIONS[*]}")"프로젝트에 IAM 정책 바인딩을 추가합니다.

$ gcloud projects add-iam-policy-binding $PROJECT_ID \ --member serviceAccount:$SERVICE_ACCOUNT_EMAIL \ --role projects/$PROJECT_ID/roles/velero.serverIAM 서비스 계정을 업데이트합니다.

$ gsutil iam ch serviceAccount:$SERVICE_ACCOUNT_EMAIL:objectAdmin gs://${BUCKET}IAM 서비스 계정 키를 현재 디렉터리의

credentials-velero파일에 저장합니다.$ gcloud iam service-accounts keys create credentials-velero \ --iam-account $SERVICE_ACCOUNT_EMAIL

credentials-velero파일을 사용하여 GCP를 복제 리포지토리로 추가합니다.

3.5.5. Microsoft Azure Blob 구성

Microsoft Azure Blob 스토리지 컨테이너를 MTC(Migration Toolkit for Containers)의 복제 리포지토리로 구성할 수 있습니다.

사전 요구 사항

- Azure 스토리지 계정이 있어야 합니다.

- Azure CLI가 설치되어 있어야 합니다.

- Azure Blob 스토리지 컨테이너는 소스 및 대상 클러스터에 액세스할 수 있어야 합니다.

스냅샷 복사 방법을 사용하는 경우:

- 소스 및 대상 클러스터는 동일한 지역에 있어야 합니다.

- 소스 및 대상 클러스터는 동일한 스토리지 클래스를 보유해야 합니다.

- 스토리지 클래스는 스냅샷과 호환 가능해야 합니다.

프로세스

AZURE_RESOURCE_GROUP변수를 설정합니다.$ AZURE_RESOURCE_GROUP=Velero_Backups

Azure 리소스 그룹을 생성합니다.

$ az group create -n $AZURE_RESOURCE_GROUP --location <CentralUS> 1- 1

- 위치를 지정합니다.

AZURE_STORAGE_ACCOUNT_ID변수를 설정합니다.$ AZURE_STORAGE_ACCOUNT_ID=velerobackups

Azure 스토리지 계정을 생성합니다.

$ az storage account create \ --name $AZURE_STORAGE_ACCOUNT_ID \ --resource-group $AZURE_RESOURCE_GROUP \ --sku Standard_GRS \ --encryption-services blob \ --https-only true \ --kind BlobStorage \ --access-tier Hot

BLOB_CONTAINER변수를 설정합니다.$ BLOB_CONTAINER=velero

Azure Blob 스토리지 컨테이너를 생성합니다.

$ az storage container create \ -n $BLOB_CONTAINER \ --public-access off \ --account-name $AZURE_STORAGE_ACCOUNT_ID

velero에 대한 서비스 주체 및 자격 증명을 생성합니다.$ AZURE_SUBSCRIPTION_ID=`az account list --query '[?isDefault].id' -o tsv` \ AZURE_TENANT_ID=`az account list --query '[?isDefault].tenantId' -o tsv` \ AZURE_CLIENT_SECRET=`az ad sp create-for-rbac --name "velero" \ --role "Contributor" --query 'password' -o tsv` \ AZURE_CLIENT_ID=`az ad sp list --display-name "velero" \ --query '[0].appId' -o tsv`

credentials-velero파일에 서비스 주체 자격 증명을 저장합니다.$ cat << EOF > ./credentials-velero AZURE_SUBSCRIPTION_ID=${AZURE_SUBSCRIPTION_ID} AZURE_TENANT_ID=${AZURE_TENANT_ID} AZURE_CLIENT_ID=${AZURE_CLIENT_ID} AZURE_CLIENT_SECRET=${AZURE_CLIENT_SECRET} AZURE_RESOURCE_GROUP=${AZURE_RESOURCE_GROUP} AZURE_CLOUD_NAME=AzurePublicCloud EOFcredentials-velero파일을 사용하여 Azure를 복제 리포지토리로 추가합니다.

3.5.6. 추가 리소스

3.6. MTC 설치 제거 및 리소스 삭제

MTC(Migration Toolkit for Containers)를 설치 제거하고 해당 리소스를 삭제하여 클러스터를 정리할 수 있습니다.

velero CRD를 삭제하면 클러스터에서 Velero가 제거됩니다.

사전 요구 사항

-

cluster-admin권한이 있는 사용자로 로그인해야 합니다.

프로세스

모든 클러스터에서

MigrationControllerCR(사용자 정의 리소스)을 삭제합니다.$ oc delete migrationcontroller <migration_controller>

- Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 4에서 Migration Toolkit for Containers Operator를 설치 제거합니다.

다음 명령을 실행하여 모든 클러스터에서 클러스터 범위 리소스를 삭제합니다.

migrationCRD(사용자 정의 리소스 정의):$ oc delete $(oc get crds -o name | grep 'migration.openshift.io')

VeleroCRD:$ oc delete $(oc get crds -o name | grep 'velero')

migration클러스터 역할:$ oc delete $(oc get clusterroles -o name | grep 'migration.openshift.io')

migration-operator클러스터 역할:$ oc delete clusterrole migration-operator

Velero클러스터 역할:$ oc delete $(oc get clusterroles -o name | grep 'velero')

migration클러스터 역할 바인딩:$ oc delete $(oc get clusterrolebindings -o name | grep 'migration.openshift.io')

migration-operator클러스터 역할 바인딩:$ oc delete clusterrolebindings migration-operator

Velero클러스터 역할 바인딩:$ oc delete $(oc get clusterrolebindings -o name | grep 'velero')

4장. 제한된 네트워크 환경에서 MTC 설치

다음 절차를 수행하여 제한된 네트워크 환경에서 OpenShift Container Platform 4에 MTC(Migration Toolkit for Containers)를 설치할 수 있습니다.

미러링된 Operator 카탈로그를 생성합니다.

이 프로세스에서는

registry.redhat.io이미지와 미러 레지스트리 이미지 간의 매핑을 포함하는mapping.txt파일을 생성합니다. OpenShift Container Platform 4.2에서 4.5 소스 클러스터에 레거시 Migration Toolkit for Containers Operator를 설치하는 데mapping.txt파일이 필요합니다.Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 4.8 대상 클러스터에 Migration Toolkit for Containers Operator를 설치합니다.

기본적으로 MTC 웹 콘솔 및

Migration ControllerPod는 대상 클러스터에서 실행됩니다. 원격 클러스터에서 MTC 웹 콘솔 및Migration ControllerPod를 실행하도록Migration Controller사용자 정의 리소스 매니페스트를 구성할 수 있습니다.소스 클러스터에 Migration Toolkit for Containers Operator를 설치합니다.

- OpenShift Container Platform 4.6 이상: Operator Lifecycle Manager를 사용하여 Migration Toolkit for Containers Operator를 설치합니다.

- OpenShift Container Platform 4.2에서 4.5로: 명령줄 인터페이스에서 레거시 Migration Toolkit for Containers Operator를 설치합니다.

- 복제 리포지토리로 사용할 오브젝트 스토리지를 구성합니다.

OpenShift Container Platform 3에 MTC를 설치하려면 OpenShift Container Platform 3에 레거시 Migration Toolkit for Containers Operator 설치를 참조하십시오.

MTC를 설치 제거하려면 MTC 설치 및 리소스 삭제를 참조하십시오.

4.1. 호환성 지침

OpenShift Container Platform 버전과 호환되는 MTC(Migration Toolkit for Containers) Operator를 설치해야 합니다.

정의

- 기존 플랫폼

- OpenShift Container Platform 4.5 및 이전 버전.

- 최신 플랫폼

- OpenShift Container Platform 4.6 이상

- 기존 Operator

- 레거시 플랫폼을 위해 설계된 MTC Operator입니다.

- 최신 Operator

- 최신 플랫폼을 위해 설계된 MTC Operator입니다.

- 클러스터 제어

- MTC 컨트롤러 및 GUI를 실행하는 클러스터입니다.

- 원격 클러스터

- Velero를 실행하는 마이그레이션의 소스 또는 대상 클러스터입니다. Control Cluster는 Velero API를 통해 원격 클러스터와 통신하여 마이그레이션을 구동합니다.

표 4.1. MTC 호환성: 기존 플랫폼에서 마이그레이션

| OpenShift Container Platform 4.5 또는 이전 | OpenShift Container Platform 4.6 이상 | |

|---|---|---|

| 안정적인 MTC 버전 | MTC 1.7.z

legacy 1.7 operator: 중요 이 클러스터는 제어 클러스터가 될 수 없습니다. | MTC 1.7.z

OLM과 함께 설치, 릴리스 채널 |

현대 클러스터가 마이그레이션에 관련된 다른 클러스터에 연결하지 못하도록 하는 에지 사례가 있습니다. 예를 들어 온프레미스의 OpenShift Container Platform 3.11 클러스터에서 클라우드의 최신 OpenShift Container Platform 클러스터로 마이그레이션할 때 최신 클러스터가 OpenShift Container Platform 3.11 클러스터에 연결할 수 없습니다.

MTC 1.7을 사용하면 네트워크 제한으로 인해 원격 클러스터 중 하나가 컨트롤 클러스터와 통신할 수 없는 경우 crane tunnel-api 명령을 사용합니다.

안정적인 MTC 릴리스에서는 항상 최신 클러스터를 제어 클러스터로 지정해야 하지만 이 특정 경우 레거시 클러스터를 제어 클러스터로 지정하고 워크로드를 원격 클러스터로 푸시할 수 있습니다.

4.2. OpenShift Container Platform 4.8에 Migration Toolkit for Containers Operator 설치

Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 4.8에 Migration Toolkit for Containers Operator를 설치합니다.

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다. - 로컬 레지스트리의 미러 이미지에서 Operator 카탈로그를 생성해야 합니다.

절차

- OpenShift Container Platform 웹 콘솔에서 Operator → OperatorHub를 클릭합니다.

- 키워드로 필터링 필드를 사용하여 Migration Toolkit for Containers Operator를 찾습니다.

- Migration Toolkit for Containers Operator를 선택하고 설치를 클릭합니다.

설치를 클릭합니다.

설치된 Operators 페이지에서 Migration Toolkit for Containers Operator는 openshift-migration 프로젝트에 Succeeded 상태로 나타납니다.

- Migration Toolkit for Containers Operator를 클릭합니다.

- 제공된 API 아래에서 마이그레이션 컨트롤러 타일을 찾고 인스턴스 작성을 클릭합니다.

- 생성을 클릭합니다.

- 워크로드 → Pod를 클릭하여 MTC pod가 실행 중인지 확인합니다.

4.3. OpenShift Container Platform 4.2에서 4.5로 레거시 Migration Toolkit for Containers Operator 설치

OpenShift Container Platform 버전 4.2에서 4.5로 레거시 Migration Toolkit for Containers Operator를 수동으로 설치할 수 있습니다.

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다. -

registry.redhat.io에 대한 액세스 권한이 있어야 합니다. -

podman이 설치되어 있어야 합니다. -

registry.redhat.io에서 파일을 다운로드하려면 네트워크 액세스 권한이 있는 Linux 워크스테이션이 있어야 합니다. - Operator 카탈로그의 미러 이미지를 생성해야 합니다.

- OpenShift Container Platform 4.8의 미러링된 Operator 카탈로그에서 Migration Toolkit for Containers Operator를 설치해야 합니다.

절차

Red Hat Customer Portal 자격 증명을 사용하여

registry.redhat.io에 로그인합니다.$ sudo podman login registry.redhat.io

다음 명령을 입력하여

operator.yml파일을 다운로드합니다.$ sudo podman cp $(sudo podman create \ registry.redhat.io/rhmtc/openshift-migration-legacy-rhel8-operator:v1.7):/operator.yml ./

다음 명령을 입력하여

controller.yml파일을 다운로드합니다.$ sudo podman cp $(sudo podman create \ registry.redhat.io/rhmtc/openshift-migration-legacy-rhel8-operator:v1.7):/controller.yml ./

다음 명령을 실행하여 Operator 이미지 매핑을 가져옵니다.

$ grep openshift-migration-legacy-rhel8-operator ./mapping.txt | grep rhmtc

Operator 카탈로그를 미러링할 때

mapping.txt파일이 생성되었습니다. 출력은registry.redhat.io이미지와 미러 레지스트리 이미지 간의 매핑을 보여줍니다.출력 예

registry.redhat.io/rhmtc/openshift-migration-legacy-rhel8-operator@sha256:468a6126f73b1ee12085ca53a312d1f96ef5a2ca03442bcb63724af5e2614e8a=<registry.apps.example.com>/rhmtc/openshift-migration-legacy-rhel8-operator

operator.yml파일에서ansible및operator컨테이너의image값과REGISTRY값을 업데이트합니다.containers: - name: ansible image: <registry.apps.example.com>/rhmtc/openshift-migration-legacy-rhel8-operator@sha256:<468a6126f73b1ee12085ca53a312d1f96ef5a2ca03442bcb63724af5e2614e8a> 1 ... - name: operator image: <registry.apps.example.com>/rhmtc/openshift-migration-legacy-rhel8-operator@sha256:<468a6126f73b1ee12085ca53a312d1f96ef5a2ca03442bcb63724af5e2614e8a> 2 ... env: - name: REGISTRY value: <registry.apps.example.com> 3- 소스 클러스터에 로그인합니다.

Migration Toolkit for Containers Operator 오브젝트 생성:

$ oc create -f operator.yml

출력 예

namespace/openshift-migration created rolebinding.rbac.authorization.k8s.io/system:deployers created serviceaccount/migration-operator created customresourcedefinition.apiextensions.k8s.io/migrationcontrollers.migration.openshift.io created role.rbac.authorization.k8s.io/migration-operator created rolebinding.rbac.authorization.k8s.io/migration-operator created clusterrolebinding.rbac.authorization.k8s.io/migration-operator created deployment.apps/migration-operator created Error from server (AlreadyExists): error when creating "./operator.yml": rolebindings.rbac.authorization.k8s.io "system:image-builders" already exists 1 Error from server (AlreadyExists): error when creating "./operator.yml": rolebindings.rbac.authorization.k8s.io "system:image-pullers" already exists- 1

Error from server (AlreadyExists)메시지를 무시할 수 있습니다. 이는 Migration Toolkit for Containers Operator가 이후 릴리스에서 제공되는 OpenShift Container Platform 4 이전 버전에 대한 리소스를 생성하기 때문에 발생합니다.

MigrationController오브젝트를 만듭니다.$ oc create -f controller.yml

MTC pod가 실행 중인지 확인합니다.

$ oc get pods -n openshift-migration

4.4. 프록시 설정

OpenShift Container Platform 4.1 및 이전 버전의 경우 이러한 버전은 클러스터 전체 프록시 오브젝트를 지원하지 않기 때문에 Migration Toolkit for Containers Operator를 설치한 후 MigrationController CR(사용자 정의 리소스) 매니페스트에서 proxy를 구성해야 합니다.

OpenShift Container Platform 4.2에서 4.8로, MTC(Migration Toolkit for Containers)는 클러스터 전체 프록시 설정을 상속합니다. 클러스터 전체 프록시 설정을 재정의하려면 프록시 매개변수를 변경할 수 있습니다.

4.4.1. 직접 볼륨 마이그레이션

MTC 1.4.2에서 직접 볼륨 마이그레이션(DVM)이 도입되었습니다. DVM은 하나의 프록시만 지원합니다. 대상 클러스터가 프록시 뒤에 있는 경우 소스 클러스터는 대상 클러스터의 경로에 액세스할 수 없습니다.

프록시 뒤에서 소스 클러스터에서 DVM을 수행하려면 전송 계층에서 작동하는 TCP 프록시를 구성하고 자체 SSL 인증서로 암호를 해독하고 재암호화하지 않고도 SSL 연결을 투명하게 전달해야 합니다. Stunnel 프록시는 이러한 프록시의 예입니다.

4.4.1.1. DVM용 TCP 프록시 설정

TCP 프록시를 통해 소스와 대상 클러스터 간에 직접 연결하고 프록시를 사용하도록 MigrationController CR에서 stunnel_tcp_proxy 변수를 구성할 수 있습니다.

apiVersion: migration.openshift.io/v1alpha1 kind: MigrationController metadata: name: migration-controller namespace: openshift-migration spec: [...] stunnel_tcp_proxy: http://username:password@ip:port

직접 볼륨 마이그레이션(DVM)은 프록시에 대한 기본 인증만 지원합니다. 또한 DVM은 TCP 연결을 투명하게 터널링할 수 있는 프록시 뒤에서만 작동합니다. 중간자 모드에서 HTTP/HTTPS 프록시가 작동하지 않습니다. 기존 클러스터 전체 프록시에서 이 동작을 지원하지 않을 수 있습니다. 결과적으로 DVM의 프록시 설정은 의도적으로 MTC의 일반 프록시 구성과 다르게 유지됩니다.

4.4.1.2. HTTP/HTTPS 프록시 대신 TCP 프록시를 사용하는 이유는 무엇입니까?

OpenShift 경로를 통해 소스와 대상 클러스터 간에 Rsync를 실행하여 DVM을 활성화할 수 있습니다. 트래픽은 TCP 프록시인 Stunnel을 사용하여 암호화됩니다. 소스 클러스터에서 실행되는 Stunnel은 대상 Stunnel을 사용한 TLS 연결을 시작하고 암호화된 채널을 통해 데이터를 전송합니다.

OpenShift의 클러스터 전체 HTTP/HTTPS 프록시는 일반적으로 자체 TLS 세션을 외부 서버와 협상하는 중간자 모드로 구성됩니다. 그러나 이 작업은 Stunnel에서는 작동하지 않습니다. Stunnel은 프록시에서 TLS 세션을 그대로 전환해야 하므로 기본적으로 프록시를 통해 TCP 연결을 그대로 전달하는 투명한 터널로 프록시를 설정해야 합니다. 따라서 TCP 프록시를 사용해야 합니다.

4.4.1.3. 알려진 문제

마이그레이션 실패 오류 업그레이드 요청 필요

마이그레이션 컨트롤러는 SPDY 프로토콜을 사용하여 원격 Pod 내에서 명령을 실행합니다. 원격 클러스터가 프록시 또는 SPDY 프로토콜을 지원하지 않는 방화벽 뒤에 있는 경우 마이그레이션 컨트롤러가 원격 명령을 실행하지 못합니다. 오류 메시지 업그레이드 요청 과 함께 마이그레이션이 실패합니다. 해결방법: SPDY 프로토콜을 지원하는 프록시를 사용합니다.

SPDY 프로토콜 지원 외에도 프록시 또는 방화벽은 Upgrade HTTP 헤더를 API 서버에 전달해야 합니다. 클라이언트는 이 헤더를 사용하여 API 서버와의 websocket 연결을 엽니다. 업그레이드 헤더가 프록시 또는 방화벽에 의해 차단된 경우 마이그레이션은 오류 메시지 업그레이드 요청 필요 와 함께 실패합니다. 해결방법: 프록시가 Upgrade 헤더를 전달하도록 합니다.

4.4.2. 마이그레이션을 위한 네트워크 정책 튜닝

OpenShift는 클러스터에서 사용하는 네트워크 플러그인을 기반으로 NetworkPolicy 또는 EgressFirewall 을 사용하여 Pod로 트래픽을 제한할 수 있습니다. 마이그레이션과 관련된 소스 네임스페이스가 이러한 메커니즘을 사용하여 네트워크 트래픽을 포드로 제한하는 경우 제한이 마이그레이션 중에 Rsync pod로의 트래픽을 실수로 중지할 수 있습니다.

소스 및 대상 클러스터에서 둘 다 실행되는 rsync Pod는 OpenShift 경로를 통해 서로 연결되어야 합니다. 기존 NetworkPolicy 또는 EgressNetworkPolicy 오브젝트는 이러한 트래픽 제한에서 Rsync Pod를 자동으로 제외하도록 구성할 수 있습니다.

4.4.2.1. NetworkPolicy 구성

4.4.2.1.1. Rsync Pod의 송신 트래픽

소스 또는 대상 네임스페이스의 NetworkPolicy 구성이 이러한 유형의 트래픽을 차단하는 경우 Rsync Pod의 고유한 레이블을 사용하여 송신 트래픽이 해당 트래픽에서 전달되도록 허용할 수 있습니다. 다음 정책은 네임스페이스의 Rsync Pod에서 모든 송신 트래픽을 허용합니다.

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-all-egress-from-rsync-pods

spec:

podSelector:

matchLabels:

owner: directvolumemigration

app: directvolumemigration-rsync-transfer

egress:

- {}

policyTypes:

- Egress4.4.2.1.2. Rsync pod로의 수신 트래픽

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-all-egress-from-rsync-pods

spec:

podSelector:

matchLabels:

owner: directvolumemigration

app: directvolumemigration-rsync-transfer

ingress:

- {}

policyTypes:

- Ingress4.4.2.2. EgressNetworkPolicy 구성

EgressNetworkPolicy 오브젝트 또는 Egress Firewalls 는 클러스터를 나가는 송신 트래픽을 차단하도록 설계된 OpenShift 구조입니다.

NetworkPolicy 오브젝트와 달리 Egress Firewall은 네임스페이스의 모든 포드에 적용되므로 프로젝트 수준에서 작동합니다. 따라서 Rsync Pod의 고유 레이블은 제한 사항에서 Rsync Pod만 제외하지 않습니다. 그러나 두 클러스터 간에 직접 연결을 설정할 수 있도록 소스 또는 대상 클러스터의 CIDR 범위를 정책의 허용 규칙에 추가할 수 있습니다.

Egress Firewall이 있는 클러스터를 기반으로 다른 클러스터의 CIDR 범위를 추가하여 둘 사이의 송신 트래픽을 허용할 수 있습니다.

apiVersion: network.openshift.io/v1

kind: EgressNetworkPolicy

metadata:

name: test-egress-policy

namespace: <namespace>

spec:

egress:

- to:

cidrSelector: <cidr_of_source_or_target_cluster>

type: Deny4.4.2.3. Rsync Pod에 대한 추가 그룹 구성

PVC에서 공유 스토리지를 사용하는 경우 Pod에서 액세스를 허용하기 위해 Rsync Pod 정의에 추가 그룹을 추가하여 해당 스토리지에 대한 액세스를 구성할 수 있습니다.

표 4.2. Rsync Pod의 보조 그룹

| 변수 | 유형 | 기본값 | 설명 |

|---|---|---|---|

|

| string | 설정되지 않음 | 소스 Rsync Pod에 대한 콤마로 구분된 추가 그룹 목록 |

|

| string | 설정되지 않음 | 대상 Rsync Pod에 대한 콤마로 구분된 추가 그룹 목록 |

사용 예

MigrationController CR을 업데이트하여 이러한 추가 그룹에 대한 값을 설정할 수 있습니다.

spec: src_supplemental_groups: "1000,2000" target_supplemental_groups: "2000,3000"

4.4.3. 프록시 구성

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다.

절차

MigrationControllerCR 매니페스트를 가져옵니다.$ oc get migrationcontroller <migration_controller> -n openshift-migration

프록시 매개변수를 업데이트합니다.

apiVersion: migration.openshift.io/v1alpha1 kind: MigrationController metadata: name: <migration_controller> namespace: openshift-migration ... spec: stunnel_tcp_proxy: http://<username>:<password>@<ip>:<port> 1 noProxy: example.com 2

하위 도메인과 일치하려면 도메인 앞에

.을 입력합니다. 예를 들어,.y.com은x.y.com과 일치하지만y.com은 일치하지 않습니다.*를 사용하여 모든 대상에 대해 프록시를 바이패스합니다.networking.machineNetwork[].cidr필드에 의해 정의된 네트워크에 포함되어 있지 않은 작업자를 설치 구성에서 확장하려면 연결 문제를 방지하기 위해 이 목록에 해당 작업자를 추가해야 합니다.httpProxy또는httpsProxy필드가 설정되지 않은 경우 이 필드는 무시됩니다.-

매니페스트를

migration-controller.yaml로 저장합니다. 업데이트된 매니페스트를 적용합니다.

$ oc replace -f migration-controller.yaml -n openshift-migration

자세한 내용은 클러스터 전체 프록시 구성을 참조하십시오.

4.5. 복제 리포지토리 구성

복제 리포지토리로 사용할 오브젝트 스토리지를 구성해야 합니다. MTC(Migration Toolkit for Containers)는 소스 클러스터에서 복제 리포지토리로 데이터를 복사한 다음 복제 리포지토리에서 대상 클러스터로 데이터를 복사합니다. MCG(Multi-Cloud Object Gateway)는 제한된 네트워크 환경에 지원되는 유일한 옵션입니다.

MTC는 소스 클러스터에서 대상 클러스터로 데이터를 마이그레이션하기 위한 파일 시스템 및 스냅샷 데이터 복사 방법을 지원합니다. 환경에 적합하고 스토리지 공급자가 지원하는 방법을 선택할 수 있습니다.

4.5.1. 사전 요구 사항

- 모든 클러스터에는 복제 리포지토리에 대한 중단없는 네트워크 액세스 권한이 있어야 합니다.

- 내부 호스팅 복제 리포지토리와 함께 프록시 서버를 사용하는 경우 프록시가 복제 리포지토리에 액세스할 수 있는지 확인해야 합니다.

4.5.2. MCG(Multi-Cloud Object Gateway) 구성

OpenShift Container Storage Operator를 설치하고 MCG(Multi-Cloud Object Gateway) 스토리지 버킷을 MTC(Migration Toolkit for Containers)의 복제 리포지토리로 구성할 수 있습니다.

4.5.2.1. OpenShift Container Storage Operator 설치

OperatorHub에서 OpenShift Container Storage Operator를 설치할 수 있습니다.

프로세스

- OpenShift Container Platform 웹 콘솔에서 Operator → OperatorHub를 클릭합니다.

- 키워드로 필터링(이 경우 OCS)을 사용하여 OpenShift Container Storage Operator를 찾습니다.

- OpenShift Container Storage Operator를 선택하고 설치를 클릭합니다.

- 업데이트 채널, 설치 모드 및 승인 전략을 선택합니다.

설치를 클릭합니다.

설치된 운영자 페이지에서 OpenShift Container Storage Operator가 openshift-storage 프로젝트에 Succeeded 상태로 나타납니다.

4.5.2.2. Multi-Cloud Object Gateway 스토리지 버킷 작성

MCG(Multi-Cloud Object Gateway) 스토리지 버킷의 사용자 정의 리소스(CR)를 생성할 수 있습니다.

절차

OpenShift Container Platform 클러스터에 로그인합니다.

$ oc login -u <username>

다음과 같은 내용과 함께

NooBaaCR 구성 파일,noobaa.yml을 생성합니다.apiVersion: noobaa.io/v1alpha1 kind: NooBaa metadata: name: <noobaa> namespace: openshift-storage spec: dbResources: requests: cpu: 0.5 1 memory: 1Gi coreResources: requests: cpu: 0.5 2 memory: 1GiNooBaa오브젝트를 생성합니다.$ oc create -f noobaa.yml

다음과 같은 내용과 함께

BackingStoreCR 구성 파일bs.yml을 생성합니다.apiVersion: noobaa.io/v1alpha1 kind: BackingStore metadata: finalizers: - noobaa.io/finalizer labels: app: noobaa name: <mcg_backing_store> namespace: openshift-storage spec: pvPool: numVolumes: 3 1 resources: requests: storage: <volume_size> 2 storageClass: <storage_class> 3 type: pv-poolBackingStore오브젝트를 생성합니다.$ oc create -f bs.yml

다음과 같은 내용으로

BucketClassCR 구성 파일,bc.yml을 생성합니다.apiVersion: noobaa.io/v1alpha1 kind: BucketClass metadata: labels: app: noobaa name: <mcg_bucket_class> namespace: openshift-storage spec: placementPolicy: tiers: - backingStores: - <mcg_backing_store> placement: SpreadBucketClass오브젝트를 생성합니다.$ oc create -f bc.yml

다음과 같은 내용과 함께

ObjectBucketClaimCR 구성 파일,obc.yml을 생성합니다.apiVersion: objectbucket.io/v1alpha1 kind: ObjectBucketClaim metadata: name: <bucket> namespace: openshift-storage spec: bucketName: <bucket> 1 storageClassName: <storage_class> additionalConfig: bucketclass: <mcg_bucket_class>- 1

- MTC 웹 콘솔에 복제 리포지토리를 추가하기 위한 버킷 이름을 기록합니다.

ObjectBucketClaim오브젝트를 생성합니다.$ oc create -f obc.yml

리소스 생성 프로세스를 보고

ObjectBucketClaim상태가Bound인지 확인합니다.$ watch -n 30 'oc get -n openshift-storage objectbucketclaim migstorage -o yaml'

이 프로세스는 5-10분 정도 걸릴 수 있습니다.

MTC 웹 콘솔에 복제 리포지토리를 추가할 때 필요한 다음 값을 확보하고 기록합니다.

S3 끝점:

$ oc get route -n openshift-storage s3

S3 공급자 액세스 키:

$ oc get secret -n openshift-storage migstorage \ -o go-template='{{ .data.AWS_ACCESS_KEY_ID }}' | base64 --decodeS3 공급자 보안 액세스 키:

$ oc get secret -n openshift-storage migstorage \ -o go-template='{{ .data.AWS_SECRET_ACCESS_KEY }}' | base64 --decode

4.5.3. 추가 리소스

- Red Hat OpenShift Container Storage 설명서의 연결이 끊긴 환경.

- MTC 워크플로

- 데이터 복사 방법 정보

- MTC 웹 콘솔에 복제 리포지토리 추가

4.6. MTC 설치 제거 및 리소스 삭제

MTC(Migration Toolkit for Containers)를 설치 제거하고 해당 리소스를 삭제하여 클러스터를 정리할 수 있습니다.

velero CRD를 삭제하면 클러스터에서 Velero가 제거됩니다.

사전 요구 사항

-

cluster-admin권한이 있는 사용자로 로그인해야 합니다.

절차

모든 클러스터에서

MigrationControllerCR(사용자 정의 리소스)을 삭제합니다.$ oc delete migrationcontroller <migration_controller>

- Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 4에서 Migration Toolkit for Containers Operator를 설치 제거합니다.

다음 명령을 실행하여 모든 클러스터에서 클러스터 범위 리소스를 삭제합니다.

migrationCRD(사용자 정의 리소스 정의):$ oc delete $(oc get crds -o name | grep 'migration.openshift.io')

VeleroCRD:$ oc delete $(oc get crds -o name | grep 'velero')

migration클러스터 역할:$ oc delete $(oc get clusterroles -o name | grep 'migration.openshift.io')

migration-operator클러스터 역할:$ oc delete clusterrole migration-operator

Velero클러스터 역할:$ oc delete $(oc get clusterroles -o name | grep 'velero')

migration클러스터 역할 바인딩:$ oc delete $(oc get clusterrolebindings -o name | grep 'migration.openshift.io')

migration-operator클러스터 역할 바인딩:$ oc delete clusterrolebindings migration-operator

Velero클러스터 역할 바인딩:$ oc delete $(oc get clusterrolebindings -o name | grep 'velero')

5장. Migration Toolkit for Containers 업그레이드

Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 4.8에서 MTC(Migration Toolkit for Containers)를 업그레이드할 수 있습니다.

레거시 Migration Toolkit for Containers Operator를 다시 설치하여 OpenShift Container Platform 4.5 및 이전 버전에서 MTC를 업그레이드할 수 있습니다.

MTC 버전 1.3에서 업그레이드하는 경우 MigPlan 사용자 정의 리소스(CR)를 업데이트하려면 추가 절차를 수행해야 합니다.

5.1. OpenShift Container Platform 4.8에서 Migration Toolkit for Containers 업그레이드

Operator Lifecycle Manager를 사용하여 OpenShift Container Platform 4.8에서 MTC(Migration Toolkit for Containers)를 업그레이드할 수 있습니다.

사전 요구 사항

-

cluster-admin권한이 있는 사용자로 로그인해야 합니다.

절차

OpenShift Container Platform 콘솔에서 Operators > 설치된 Operators로 이동합니다.

보류 중인 업그레이드가 있는 Operator에 업그레이드 사용 가능 상태가 표시됩니다.

- Migration Toolkit for Containers Operator를 클릭합니다.

- 서브스크립션 탭을 클릭합니다. 승인이 필요한 업그레이드는 업그레이드 상태 옆에 표시됩니다. 예를 들어 1 승인 필요가 표시될 수 있습니다.

- 1 승인 필요를 클릭한 다음 설치 계획 프리뷰를 클릭합니다.

- 업그레이드에 사용할 수 있는 리소스를 보고 승인을 클릭합니다.

- Operator → 설치된 Operator 페이지로 이동하여 업그레이드 진행 상황을 모니터링합니다. 완료되면 상태가 성공 및 최신으로 변경됩니다.

- 워크로드 → Pod를 클릭하여 MTC pod가 실행 중인지 확인합니다.

5.2. OpenShift Container Platform 버전 4.2에서 4.5로 Migration Toolkit for Containers 업그레이드

레거시 MTC(Migration Toolkit for Containers Operator)를 수동으로 설치하여 OpenShift Container Platform 버전 4.2에서 MTC(Migration Toolkit for Containers)를 업그레이드할 수 있습니다.

사전 요구 사항

-

cluster-admin권한이 있는 사용자로 로그인해야 합니다. -

registry.redhat.io에 대한 액세스 권한이 있어야 합니다. -

podman이 설치되어 있어야 합니다.

절차

다음 명령을 입력하여 Red Hat Customer Portal 자격 증명을 사용하여

registry.redhat.io에 로그인합니다.$ sudo podman login registry.redhat.io

다음 명령을 입력하여 operator.yml 파일을 다운로드합니다.

+

$ sudo podman cp $(sudo podman create \ registry.redhat.io/rhmtc/openshift-migration-legacy-rhel8-operator:v1.7):/operator.yml ./

다음 명령을 입력하여 Migration Toolkit for Containers Operator를 교체합니다.

$ oc replace --force -f operator.yml

다음 명령을 입력하여

migration-operator배포를0으로 확장하여 배포를 중지합니다.$ oc scale -n openshift-migration --replicas=0 deployment/migration-operator

migration-operator배포를1로 확장하여 배포를 시작하고 다음 명령을 입력하여 변경 사항을 적용합니다.$ oc scale -n openshift-migration --replicas=1 deployment/migration-operator

다음 명령을 입력하여

migration-operator가 업그레이드되었는지 확인합니다.$ oc -o yaml -n openshift-migration get deployment/migration-operator | grep image: | awk -F ":" '{ print $NF }'다음 명령을 입력하여

controller.yml파일을 다운로드합니다.$ sudo podman cp $(sudo podman create \ registry.redhat.io/rhmtc/openshift-migration-legacy-rhel8-operator:v1.7):/controller.yml ./

다음 명령을 입력하여

migration-controller오브젝트를 생성합니다.$ oc create -f controller.yml

다음 명령을 입력하여 MTC Pod가 실행 중인지 확인합니다.

$ oc get pods -n openshift-migration

5.3. MTC 1.3을 1.7로 업그레이드

MTC(Migration Toolkit for Containers) 버전 1.3.x를 1.7로 업그레이드하는 경우 MigrationController Pod가 실행 중인 클러스터에서 MigPlan 사용자 정의 리소스(CR) 매니페스트를 업데이트해야 합니다.

indirectImageMigration 및 indirectVolumeMigration 매개변수는 MTC 1.3에 존재하지 않기 때문에 버전 1.4의 기본값은 false이며 직접 이미지 마이그레이션 및 직접 볼륨 마이그레이션이 활성화됩니다. 직접 마이그레이션 요구 사항이 충족되지 않기 때문에 이러한 매개변수 값이 true로 변경되지 않는 한 마이그레이션 계획에서 Ready 상태에 도달할 수 없습니다.

사전 요구 사항

-

cluster-admin권한이 있는 사용자로 로그인해야 합니다.

절차

-

MigrationControllerPod를 실행하는 클러스터에 로그인합니다. MigPlanCR 매니페스트를 가져옵니다.$ oc get migplan <migplan> -o yaml -n openshift-migration

다음 매개변수 값을 업데이트하고 파일을

migplan.yaml로 저장합니다.... spec: indirectImageMigration: true indirectVolumeMigration: true

MigPlanCR 매니페스트를 교체하여 변경 사항을 적용합니다.$ oc replace -f migplan.yaml -n openshift-migration

업데이트된

MigPlanCR 매니페스트를 가져와 변경 사항을 확인합니다.$ oc get migplan <migplan> -o yaml -n openshift-migration

6장. 마이그레이션 전 체크리스트

MTC(Migration Toolkit for Containers)를 사용하여 애플리케이션 워크로드를 마이그레이션하기 전에 다음 체크리스트를 검토하십시오.

6.1. 클러스터 상태 체크리스트

- ❏ 클러스터는 특정 플랫폼 및 설치 방법(예: 베어 메탈)에 대한 최소 하드웨어 요구 사항을 충족합니다.

- ❏ 모든 MTC 사전 요구 사항을 충족합니다.

- ❏ 모든 노드에는 유효한 OpenShift Container Platform 서브스크립션이 있습니다.

- ❏ 노드 상태를 확인했습니다.

- ❏ ID 공급자가 작동 중입니다.

- ❏ 마이그레이션 네트워크의 최소 처리량은 10Gbps입니다.

❏ 클러스터에 마이그레이션에 필요한 충분한 리소스가 있습니다.

참고일반 워크로드에서 마이그레이션을 실행하려면 클러스터에 추가 메모리, CPU 및 스토리지가 필요합니다. 실제 리소스 요구 사항은 단일 마이그레이션 계획에서 마이그레이션되는 Kubernetes 리소스 수에 따라 다릅니다. 리소스 요구 사항을 추정하려면 비 프로덕션 환경에서 마이그레이션을 테스트해야 합니다.

-

❏

fio는 클러스터의 etcd 디스크 성능을 확인하는 데 사용되었습니다.

6.2. 소스 클러스터 체크리스트

❏ 다음 명령을 실행하여 종료 중 상태에서 비정상적으로 설정된 PV(영구 볼륨)가 있는지 확인했습니다.

$ oc get pv

❏ 다음 명령을 실행하여 실행 중 또는 완료 이외의 상태인 Pod를 확인했습니다.

$ oc get pods --all-namespaces | egrep -v 'Running | Completed'

❏ 다음 명령을 실행하여 재시작 횟수가 높은 Pod를 확인했습니다.

$ oc get pods --all-namespaces --field-selector=status.phase=Running \ -o json | jq '.items[]|select(any( .status.containerStatuses[]; \ .restartCount > 3))|.metadata.name'

Pod가 실행 중 상태인 경우에도 재시작 횟수가 많으면 기본적인 문제가 될 수 있습니다.

- ❏ 클러스터 인증서는 마이그레이션 프로세스 기간 동안 유효합니다.

❏ 다음 명령을 실행하여 보류 중인 인증서 서명 요청이 있는지 확인했습니다.

$ oc get csr -A | grep pending -i

- ❏ 레지스트리는 권장 스토리지 유형을 사용합니다.

- ❏ 레지스트리에 이미지를 읽고 쓸 수 있습니다.

- ❏ etcd 클러스터는 정상입니다.

- ❏ 소스 클러스터의 평균 API 서버 응답 시간은 50ms 미만입니다.

6.3. 대상 클러스터 체크리스트

- ❏ 클러스터에 올바른 네트워크 구성과 외부 서비스(예: 데이터베이스, 소스 코드 저장소, 컨테이너 미러 레지스트리, CI/CD 툴)에 액세스할 수 있는 권한이 있습니다.

- ❏ 클러스터에서 제공하는 서비스를 사용하는 외부 애플리케이션과 서비스에는 클러스터에 액세스할 수 있는 올바른 네트워크 구성 및 권한이 있습니다.

- ❏ 내부 컨테이너 이미지에 필요한 종속성을 충족합니다.

- ❏ 대상 클러스터와 복제 리포지토리에 충분한 스토리지 공간이 있습니다.

7장. 네트워크 고려 사항

마이그레이션 후 애플리케이션 네트워크 트래픽을 리디렉션하는 전략을 검토합니다.

7.1. DNS 고려 사항

대상 클러스터의 DNS 도메인은 소스 클러스터의 도메인과 다릅니다. 기본적으로 애플리케이션은 마이그레이션 후 대상 클러스터의 FQDN을 가져옵니다.

마이그레이션된 애플리케이션의 소스 DNS 도메인을 보존하려면 아래에 설명된 두 옵션 중 하나를 선택합니다.

7.1.1. 클라이언트에서 대상 클러스터의 DNS 도메인 격리

소스 클러스터의 DNS 도메인으로 전송된 클라이언트의 요청이 대상 클러스터를 클라이언트에 노출하지 않고 대상 클러스터의 DNS 도메인에 도달할 수 있도록 허용할 수 있습니다.

절차

- 클라이언트와 대상 클러스터 간에 애플리케이션 로드 밸런서 또는 역방향 프록시와 같은 기타 네트워크 구성 요소를 배치합니다.

- DNS 서버의 소스 클러스터에서 애플리케이션 FQDN을 업데이트하여 가상 네트워크 구성 요소의 IP 주소를 반환합니다.

- 소스 도메인의 애플리케이션에 대해 수신된 요청을 대상 클러스터 도메인의 로드 밸런서에 보내도록 네트워크 구성 요소를 구성합니다.

-

소스 클러스터의 로드 밸런서의 IP 주소를 가리키는

*.apps.source.example.com도메인에 대한 와일드카드 DNS 레코드를 만듭니다. - 대상 클러스터 앞의 브릿지 네트워크 구성 요소의 IP 주소를 가리키는 각 애플리케이션에 대한 DNS 레코드를 만듭니다. 특정 DNS 레코드는 와일드카드 레코드보다 우선 순위가 높으므로 애플리케이션 FQDN이 확인되면 충돌이 발생하지 않습니다.

- 기존의 네트워크 구성 요소는 모든 보안 TLS 연결을 종료해야 합니다. 연결이 대상 클러스터 로드 밸런서 장치로 전달되면 대상 애플리케이션의 FQDN이 클라이언트에 노출되고 인증서 오류가 발생합니다.

- 애플리케이션은 대상 클러스터 도메인을 클라이언트에 참조하는 링크를 반환해서는 안 됩니다. 그렇지 않으면 애플리케이션 일부가 제대로 로드되거나 작동하지 않을 수 있습니다.

7.1.2. 소스 DNS 도메인을 허용하도록 대상 클러스터 설정

소스 클러스터의 DNS 도메인에서 마이그레이션된 애플리케이션에 대한 요청을 수락하도록 대상 클러스터를 설정할 수 있습니다.

절차

비보안 HTTP 액세스 및 보안 HTTPS 액세스 모두에서 다음 단계를 수행합니다.

소스 클러스터에서 애플리케이션의 FQDN으로 주소가 지정된 요청을 수락하도록 구성된 대상 클러스터의 프로젝트에서 경로를 생성합니다.

$ oc expose svc <app1-svc> --hostname <app1.apps.source.example.com> \ -n <app1-namespace>

이 새 경로를 적용하면 서버는 해당 FQDN에 대한 모든 요청을 수락하고 해당 애플리케이션 포드로 보냅니다. 또한 애플리케이션을 마이그레이션하면 대상 클러스터 도메인에 또 다른 경로가 생성됩니다. 요청은 이러한 호스트 이름 중 하나를 사용하여 마이그레이션된 애플리케이션에 연결합니다.

소스 클러스터의 애플리케이션의 FQDN을 가리키고 대상 클러스터의 기본 로드 밸런서의 IP 주소를 가리키는 DNS 공급자를 사용하여 DNS 레코드를 생성합니다. 그러면 소스 클러스터에서 대상 클러스터로 트래픽이 리디렉션됩니다.

애플리케이션의 FQDN은 대상 클러스터의 로드 밸런서로 확인됩니다. 기본 수신 컨트롤러 라우터는 해당 호스트 이름의 경로가 노출되므로 해당 FQDN에 대한 요청을 수락합니다.

보안 HTTPS 액세스를 위해 다음 추가 단계를 수행합니다.

- 설치 프로세스 중에 생성된 기본 수신 컨트롤러의 x509 인증서를 사용자 지정 인증서로 교체합니다.

subjectAltName필드에 소스 및 대상 클러스터의 와일드카드 DNS 도메인을 포함하도록 이 인증서를 구성합니다.새 인증서는 DNS 도메인을 사용하여 만든 연결 보안에 유효합니다.

추가 리소스

- 자세한 내용은 기본 수신 인증서 교체를 참조하십시오.

7.2. 네트워크 트래픽 리디렉션 전략

마이그레이션에 성공한 후 소스 클러스터에서 대상 클러스터로 상태 비저장 애플리케이션의 네트워크 트래픽을 리디렉션해야 합니다.

네트워크 트래픽을 리디렉션하는 전략은 다음과 같은 가정을 기반으로 합니다.

- 애플리케이션 포드는 소스 클러스터와 대상 클러스터에서 모두 실행됩니다.

- 각 애플리케이션에는 소스 클러스터 호스트 이름이 포함된 경로가 있습니다.

- 소스 클러스터 호스트 이름이 있는 경로에는 CA 인증서가 포함되어 있습니다.

- HTTPS의 경우 대상 라우터 CA 인증서에는 소스 클러스터의 와일드카드 DNS 레코드에 대한 주체 대체 이름이 포함되어 있습니다.

다음 전략을 고려하여 목표를 충족하는 전략을 선택합니다.

모든 애플리케이션에 대한 모든 네트워크 트래픽 리디렉션 동시에

대상 클러스터의 가상 IP 주소(VIP)를 가리키도록 소스 클러스터의 와일드카드 DNS 레코드를 변경합니다.

이 전략은 간단한 애플리케이션 또는 소규모 마이그레이션에 적합합니다.

개별 애플리케이션에 대한 네트워크 트래픽 리디렉션

대상 클러스터 라우터의 VIP를 가리키는 소스 클러스터 호스트 이름을 사용하여 각 애플리케이션의 DNS 레코드를 만듭니다. 이 DNS 레코드는 소스 클러스터 와일드카드 DNS 레코드보다 우선합니다.

개별 애플리케이션에 대해 네트워크 트래픽 점진적 리디렉션

- 각 애플리케이션에 대해 소스 클러스터 라우터의 VIP와 대상 클러스터 라우터의 VIP로 트래픽을 보낼 수 있는 프록시를 만듭니다.

- 프록시를 가리키는 소스 클러스터 호스트 이름을 사용하여 각 애플리케이션에 대한 DNS 레코드를 만듭니다.

- 트래픽의 백분율을 대상 클러스터 라우터의 VIP로 라우팅하고 나머지 트래픽을 소스 클러스터 라우터의 VIP로 라우팅하도록 애플리케이션의 프록시 항목을 구성합니다.

- 모든 네트워크 트래픽이 리디렉션될 때까지 대상 클러스터 라우터의 VIP로 라우팅하는 트래픽의 백분율을 점차 늘립니다.

개별 애플리케이션에 대한 사용자 기반 트래픽 리디렉션

이 전략을 사용하면 사용자 요청의 TCP/IP 헤더를 필터링하여 사전 정의된 사용자 그룹의 네트워크 트래픽을 리디렉션할 수 있습니다. 이를 통해 전체 네트워크 트래픽을 리디렉션하기 전에 특정 사용자 수에 대한 리디렉션 프로세스를 테스트할 수 있습니다.

- 각 애플리케이션에 대해 소스 클러스터 라우터의 VIP와 대상 클러스터 라우터의 VIP로 트래픽을 보낼 수 있는 프록시를 만듭니다.

- 프록시를 가리키는 소스 클러스터 호스트 이름을 사용하여 각 애플리케이션에 대한 DNS 레코드를 만듭니다.

-

테스트 고객과같이 지정된 헤더 패턴과 일치하는 트래픽을 대상 클러스터 라우터의 VIP로 라우팅하고 나머지 트래픽을 소스 클러스터 라우터의 VIP로 라우팅하도록 애플리케이션의 프록시 항목을 구성합니다. - 모든 트래픽이 대상 클러스터 라우터의 VIP에 있을 때까지 트래픽을 단계별로 대상 클러스터 라우터의 VIP로 리디렉션합니다.

8장. 애플리케이션 마이그레이션

MTC(Migration Toolkit for Containers) 웹 콘솔 또는 명령줄 을 사용하여 애플리케이션을 마이그레이션할 수 있습니다.

대부분의 클러스터 범위 리소스는 아직 MTC에서 처리되지 않습니다. 애플리케이션에 클러스터 범위의 리소스가 필요한 경우 대상 클러스터에서 수동으로 리소스를 생성해야 할 수 있습니다.

스테이지 마이그레이션과 컷오버 마이그레이션을 사용하여 클러스터 간에 애플리케이션을 마이그레이션할 수 있습니다.

- 스테이지 마이그레이션은 애플리케이션을 중지하지 않고 소스 클러스터에서 대상 클러스터로 데이터를 복사합니다. 스테이지 마이그레이션을 여러 번 실행하여 할당 마이그레이션 기간을 줄일 수 있습니다.

- 컷오버 마이그레이션은 소스 클러스터에서 트랜잭션을 중지하고 리소스를 대상 클러스터로 이동합니다.

상태 마이그레이션을 사용하여 애플리케이션 상태를 마이그레이션할 수 있습니다.

- 상태 마이그레이션은 선택한 PVC(영구 볼륨 클레임)를 복사합니다.

- 상태 마이그레이션을 사용하여 동일한 클러스터 내에서 네임스페이스를 마이그레이션할 수 있습니다.

마이그레이션 중에 MTC(Migration Toolkit for Containers)는 다음 네임스페이스 주석을 유지합니다.

-

openshift.io/sa.scc.mcs -

openshift.io/sa.scc.supplemental-groups openshift.io/sa.scc.uid-range이러한 주석은 UID 범위를 유지하여 컨테이너가 대상 클러스터에 대한 파일 시스템 권한을 유지하도록 합니다. 마이그레이션된 UID가 대상 클러스터의 기존 또는 향후 네임스페이스 내에서 UID를 복제할 위험이 있습니다.

8.1. 마이그레이션 사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다.

직접 이미지 마이그레이션

- 소스 클러스터의 보안 내부 레지스트리가 노출되었는지 확인해야 합니다.

- 노출된 레지스트리에 대한 경로를 생성해야 합니다.

직접 볼륨 마이그레이션

- 클러스터에서 프록시를 사용하는 경우 Stunnel TCP 프록시를 구성해야 합니다.

클러스터

- 소스 클러스터를 최신 MTC z-stream 릴리스로 업그레이드해야 합니다.

- MTC 버전은 모든 클러스터에서 동일해야 합니다.

네트워크

- 클러스터는 서로 및 복제 리포지토리에 제한 없이 네트워크 액세스할 수 있습니다.

-

move를 사용하여 영구 볼륨을 복사하는 경우 클러스터에 원격 볼륨에 대한 무제한 네트워크 액세스 권한이 있어야 합니다. OpenShift Container Platform 4 클러스터에서 다음 포트를 활성화해야 합니다.

-

6443(API 서버) -

443(라우트) -

53(DNS)

-

-

TLS를 사용하는 경우 복제 리포지토리에서 포트

443을 활성화해야 합니다.

영구 볼륨 (PV)

- PV가 유효해야 합니다.

- PV를 영구 볼륨 클레임에 바인딩해야 합니다.

스냅샷을 사용하여 PV를 복사하는 경우 다음과 같은 추가 사전 요구 사항이 적용됩니다.

- 클라우드 공급자는 스냅샷을 지원해야 합니다.

- PV는 동일한 클라우드 공급자에 있어야 합니다.

- PV는 동일한 지역 리전에 있어야 합니다.

- PV는 동일한 스토리지 클래스를 보유해야 합니다.

8.2. MTC 웹 콘솔을 사용하여 애플리케이션 마이그레이션

MTC 웹 콘솔을 사용하여 클러스터와 복제 리포지토리를 구성할 수 있습니다. 그러면 마이그레이션 계획을 생성하고 실행할 수 있습니다.

8.2.1. MTC 웹 콘솔 시작

브라우저에서 MTC(Migration Toolkit for Containers) 웹 콘솔을 시작할 수 있습니다.

사전 요구 사항

- MTC 웹 콘솔에는 OpenShift Container Platform 웹 콘솔에 대한 네트워크 액세스 권한이 있어야 합니다.

- MTC 웹 콘솔에는 OAuth 인증 서버에 대한 네트워크 액세스 권한이 있어야 합니다.

절차

- MTC를 설치한 OpenShift Container Platform 클러스터에 로그인합니다.

다음 명령을 입력하여 MTC 웹 콘솔 URL을 확보합니다.

$ oc get -n openshift-migration route/migration -o go-template='https://{{ .spec.host }}'출력은

https://migration-openshift-migration.apps.cluster.openshift.com과 유사합니다.브라우저를 시작하고 MTC 웹 콘솔로 이동합니다.

참고Migration Toolkit for Containers Operator를 설치한 직후 MTC 웹 콘솔에 액세스하려고 하면 Operator가 여전히 클러스터를 구성하고 있기 때문에 콘솔이 로드되지 않을 수 있습니다. 몇 분 기다렸다가 다시 시도하십시오.

- 자체 서명된 CA 인증서를 사용하는 경우 소스 클러스터 API 서버의 CA 인증서를 수락하라는 메시지가 표시됩니다. 웹 페이지는 나머지 인증서 수락 프로세스를 안내합니다.

- OpenShift Container Platform 사용자 이름 및 암호로 로그인합니다.

8.2.2. MTC 웹 콘솔에 클러스터 추가

MTC(Migration Toolkit for Containers) 웹 콘솔에 클러스터를 추가할 수 있습니다.

사전 요구 사항

Azure 스냅샷을 사용하여 데이터를 복사하는 경우:

- 클러스터의 Azure 리소스 그룹 이름을 지정해야 합니다.

- 클러스터는 동일한 Azure 리소스 그룹에 있어야 합니다.

- 클러스터는 동일한 지역 위치에 있어야 합니다.

- 직접 이미지 마이그레이션을 사용하는 경우 공개적으로 라우팅해야 합니다.

절차

- 클러스터에 로그인합니다.

migration-controller서비스 계정 토큰을 확보합니다.$ oc sa get-token migration-controller -n openshift-migration

출력 예

eyJhbGciOiJSUzI1NiIsImtpZCI6IiJ9.eyJpc3MiOiJrdWJlcm5ldGVzL3NlcnZpY2VhY2NvdW50Iiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9uYW1lc3BhY2UiOiJtaWciLCJrdWJlcm5ldGVzLmlvL3NlcnZpY2VhY2NvdW50L3NlY3JldC5uYW1lIjoibWlnLXRva2VuLWs4dDJyIiwia3ViZXJuZXRlcy5pby9zZXJ2aWNlYWNjb3VudC9zZXJ2aWNlLWFjY291bnQubmFtZSI6Im1pZyIsImt1YmVybmV0ZXMuaW8vc2VydmljZWFjY291bnQvc2VydmljZS1hY2NvdW50LnVpZCI6ImE1YjFiYWMwLWMxYmYtMTFlOS05Y2NiLTAyOWRmODYwYjMwOCIsInN1YiI6InN5c3RlbTpzZXJ2aWNlYWNjb3VudDptaWc6bWlnIn0.xqeeAINK7UXpdRqAtOj70qhBJPeMwmgLomV9iFxr5RoqUgKchZRG2J2rkqmPm6vr7K-cm7ibD1IBpdQJCcVDuoHYsFgV4mp9vgOfn9osSDp2TGikwNz4Az95e81xnjVUmzh-NjDsEpw71DH92iHV_xt2sTwtzftS49LpPW2LjrV0evtNBP_t_RfskdArt5VSv25eORl7zScqfe1CiMkcVbf2UqACQjo3LbkpfN26HAioO2oH0ECPiRzT0Xyh-KwFutJLS9Xgghyw-LD9kPKcE_xbbJ9Y4Rqajh7WdPYuB0Jd9DPVrslmzK-F6cgHHYoZEv0SvLQi-PO0rpDrcjOEQQ

- MTC 웹 콘솔에서 클러스터를 클릭합니다.

- 클러스터 추가를 클릭합니다.

다음 필드를 작성합니다.

-

클러스터 이름: 클러스터 이름은 소문자(a

-z) 및 숫자(0-9)를 포함할 수있습니다. 공백이나 국제 문자를 포함해서는 안 됩니다. -

URL: API 서버 URL을 지정합니다(예:

https://<www.example.com>:8443). -

서비스 계정 토큰:

migration-controller서비스 계정 토큰을 붙여넣습니다. 이미지 레지스트리에 노출된 경로 호스트: 직접 이미지 마이그레이션을 사용하는 경우 소스 클러스터의 이미지 레지스트리에 노출된 경로를 지정합니다.

다음 명령을 실행하여 라우트를 생성합니다.

OpenShift Container Platform 3의 경우:

$ oc create route passthrough --service=docker-registry --port=5000 -n default

OpenShift Container Platform 4의 경우:

$ oc create route passthrough --service=image-registry --port=5000 -n openshift-image-registry

- Azure 클러스터: Azure 스냅샷을 사용하여 데이터를 복사하는 경우 이 옵션을 선택해야 합니다.

- Azure 리소스 그룹: Azure 클러스터가 선택된 경우 이 필드가 표시됩니다. Azure 리소스 그룹을 지정합니다.

- SSL 확인 필요 : 선택 사항: 이 옵션을 선택하여 클러스터에 대한 SSL 연결을 확인합니다.

- CA 번들 파일: Require SSL 확인이 선택되어 있으면 이 필드가 표시됩니다. 자체 서명된 인증서에 대한 사용자 정의 CA 인증서 번들 파일을 생성한 경우 찾아보기를 클릭하고 CA 번들 파일을 선택하여 업로드합니다.

-

클러스터 이름: 클러스터 이름은 소문자(a

클러스터 추가를 클릭합니다.

클러스터가 클러스터 목록에 나타납니다.

8.2.3. MTC 웹 콘솔에 복제 리포지토리 추가

MTC(Migration Toolkit for Containers) 웹 콘솔에 복제 리포지토리로 오브젝트 스토리지를 추가할 수 있습니다.

MTC는 다음과 같은 스토리지 제공자를 지원합니다.

- AWS(Amazon Web Services) S3

- MCG(Multi-Cloud Object Gateway)

- 일반 S3 오브젝트 스토리지(예: Minio 또는 Ceph S3)

- GCP(Google Cloud Provider)

- Microsoft Azure Blob

사전 요구 사항

- 복제 리포지토리로 오브젝트 스토리지를 구성해야 합니다.

절차

- MTC 웹 콘솔에서 복제 리포지토리를 클릭합니다.

- 리포지토리 추가를 클릭합니다.

스토리지 공급자 유형을 선택하고 다음 필드를 작성합니다.

AWS 및 MCG를 포함한 S3 공급자용 AWS:

- 복제 리포지터리 이름: MTC 웹 콘솔에서 복제 리포지토리 이름을 지정합니다.

- S3 버킷 이름: S3 버킷의 이름을 지정합니다.

- S3 버킷 영역: S3 버킷 리전을 지정합니다. AWS S3의 경우 필수입니다. 일부 S3 공급자의 경우 선택 사항입니다. S3 공급자의 제품 문서에서 예상되는 값을 확인합니다.

-

S3 끝점: 버킷이 아닌 S3 서비스의 URL을 지정합니다(예:

https://<s3-storage.apps.cluster.com>). 일반 S3 공급자의 경우 필수입니다.https://접두사를 사용해야 합니다. -

S3 공급자 액세스 키: AWS의 경우

<AWS_SECRET_ACCESS_KEY>또는 MCG 및 기타 S3 공급자의 경우 S3 공급자 액세스 키를 지정합니다. -

S3 공급자 보안 액세스 키: AWS의 경우

<AWS_ACCESS_KEY_ID>또는 MCG 및 기타 S3 공급자의 경우 S3 공급자 보안 액세스 키를 지정합니다. - SSL 확인 필요 : 일반 S3 공급자를 사용하는 경우 이 확인란을 지웁니다.

- 자체 서명된 인증서에 대한 사용자 정의 CA 인증서 번들 파일을 생성한 경우 검색을 클릭하고 Base64로 인코딩된 파일을 검색합니다.

GCP:

- 복제 리포지터리 이름: MTC 웹 콘솔에서 복제 리포지토리 이름을 지정합니다.

- GCP 버킷 이름: GCP 버킷의 이름을 지정합니다.

-

GCP 자격 증명 JSON blob:

credentials-velero파일에서 문자열을 지정합니다.

Azure:

- 복제 리포지터리 이름: MTC 웹 콘솔에서 복제 리포지토리 이름을 지정합니다.

- Azure 리소스 그룹: Azure Blob 스토리지의 리소스 그룹을 지정합니다.

- Azure 스토리지 계정 이름: Azure Blob 스토리지 계정 이름을 지정합니다.

-

Azure 인증 정보 - INI 파일 콘텐츠:

credentials-velero파일에서 문자열을 지정합니다.

- 리포지토리 추가를 클릭하고 연결 유효성 검사를 기다립니다.

닫기를 클릭합니다.

새 리포지토리가 복제 리포지토리 목록에 나타납니다.

8.2.4. MTC 웹 콘솔에서 마이그레이션 계획 생성

MTC(Migration Toolkit for Containers) 웹 콘솔에서 마이그레이션 계획을 생성할 수 있습니다.

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다. - 동일한 MTC 버전이 모든 클러스터에 설치되어 있는지 확인해야 합니다.

- MTC 웹 콘솔에 클러스터와 복제 리포지토리를 추가해야 합니다.

- 이동 데이터 복사 방법을 사용하여 PV(영구 볼륨)를 마이그레이션하려면 소스 및 대상 클러스터에 원격 볼륨에 대한 중단되지 않은 네트워크 액세스가 있어야 합니다.

-

직접 이미지 마이그레이션을 사용하려면 소스 클러스터의 이미지 레지스트리에 노출된 경로를 지정해야 합니다. MTC 웹 콘솔을 사용하거나

MigCluster사용자 정의 리소스 매니페스트를 업데이트하여 수행할 수 있습니다.

절차

- MTC 웹 콘솔에서 마이그레이션 계획을 클릭합니다.

- 마이그레이션 계획 추가를 클릭합니다.

계획 이름을 입력합니다.

마이그레이션 계획 이름에서 253자의 소문자 영숫자(

a-z, 0-9)를 초과해서는 안 되며 공백이나 밑줄(_)을 포함해서는 안 됩니다.- 소스 클러스터, 대상 클러스터, 리포지토리를 선택합니다.

- 다음을 클릭합니다.

- 마이그레이션할 프로젝트를 선택합니다.

- 선택 사항: 프로젝트 옆에 있는 편집 아이콘을 클릭하여 대상 네임스페이스를 변경합니다.

- 다음을 클릭합니다.

각 PV의 마이그레이션 유형을 선택합니다.

- 복사 옵션은 소스 클러스터의 PV에 있는 데이터를 복제 리포지토리에 복사한 다음 대상 클러스터에서 비슷한 특성을 가진 새로 생성된 PV에 데이터를 복원합니다.

- 이동 옵션은 소스 클러스터에서 원격 볼륨(예: NFS)을 마운트 해제하고 원격 볼륨을 가리키는 대상 클러스터에 PV 리소스를 생성한 다음 대상 클러스터에 원격 볼륨을 마운트합니다. 대상 클러스터에서 실행되는 애플리케이션은 소스 클러스터와 동일한 원격 볼륨을 사용합니다.

- 다음을 클릭합니다.

각 PV의 복사 방법을 선택합니다.

- 스냅샷 복사는 클라우드 공급자의 스냅샷 기능을 사용하여 데이터를 백업 및 복원합니다. 파일 시스템 복사.보다 훨씬 빠릅니다.

파일 시스템 복사는 소스 클러스터에서 파일을 백업하고 대상 클러스터에서 해당 파일을 복원합니다.

직접 볼륨 마이그레이션에는 파일 시스템 복사 방법이 필요합니다.

- 복사 확인을 선택하여 파일 시스템 복사로 마이그레이션된 데이터를 확인할 수 있습니다. 데이터는 각 소스 파일에 대한 체크섬을 생성하고 복원 후 체크섬을 확인합니다. 데이터 확인으로 성능이 크게 저하합니다.

대상 스토리지 클래스를 선택합니다.

파일 시스템 복사를 선택한 경우 대상 스토리지 클래스를 변경할 수 있습니다.

- 다음을 클릭합니다.

마이그레이션 옵션 페이지에서 소스 클러스터에 대해 노출된 이미지 레지스트리 경로를 지정한 경우 직접 이미지 마이그레이션 옵션이 선택됩니다. 파일 시스템 복사로 데이터를 마이그레이션하는 경우 직접 PV 마이그레이션 옵션이 선택됩니다.

직접 마이그레이션 옵션은 소스 클러스터에서 대상 클러스터로 직접 이미지 및 파일을 복사합니다. 이 옵션은 소스 클러스터에서 복제 리포지토리로 이미지 및 파일을 복사한 다음 복제 리포지토리에서 대상 클러스터로 복사합니다.

- 다음을 클릭합니다.

선택 사항: 후크 추가를 클릭하여 마이그레이션 계획에 후크를 추가합니다.

후크는 사용자 지정 코드를 실행합니다. 단일 마이그레이션 계획에 최대 4개의 후크를 추가할 수 있습니다. 각 후크는 다른 마이그레이션 단계에서 실행됩니다.

- 웹 콘솔에 표시할 후크 이름을 입력합니다.

- 후크가 Ansible 플레이북인 경우 Ansible 플레이북을 선택하고 찾아보기를 클릭하여 플레이북을 업로드하거나 필드에 플레이북 콘텐츠를 붙여넣습니다.

- 선택 사항: 기본 후크 이미지를 사용하지 않는 경우 Ansible 런타임 이미지를 지정합니다.

후크가 Ansible 플레이북이 아닌 경우 사용자 정의 컨테이너 이미지를 선택하고 이미지 이름과 경로를 지정합니다.

사용자 정의 컨테이너 이미지에는 Ansible 플레이북이 포함될 수 있습니다.

- 소스 클러스터 또는 대상 클러스터를 선택합니다.

- 서비스 계정 이름과 서비스 계정 네임스페이스를 입력합니다.

후크의 마이그레이션 단계를 선택합니다.

- preBackup: 애플리케이션 워크로드를 소스 클러스터에서 백업하기 전에

- postBackup: 소스 클러스터에서 애플리케이션 워크로드를 백업한 후

- preRestore: 대상 클러스터에서 애플리케이션 워크로드를 복원하기 전에

- postRestore: 대상 클러스터에서 애플리케이션 워크로드를 복원한 후

- 추가를 클릭합니다.

완료를 클릭합니다.

마이그레이션 계획이 마이그레이션 계획 목록에 표시됩니다.

영구 볼륨 복사 방법에 대한 추가 리소스

8.2.5. MTC 웹 콘솔에서 마이그레이션 계획 실행

MTC(Migration Toolkit for Containers) 웹 콘솔에서 생성한 마이그레이션 계획을 사용하여 애플리케이션 및 데이터를 마이그레이션할 수 있습니다.

마이그레이션 프로세스 중에 MTC는 마이그레이션된 PV(영구 볼륨)의 회수 정책을 대상 클러스터에서 Retain으로 설정합니다.

Backup 사용자 정의 리소스에는 원래 회수 정책을 나타내는 PVOriginalReclaimPolicy 주석이 포함되어 있습니다. 마이그레이션된 PV의 회수 정책을 수동으로 복원할 수 있습니다.

사전 요구 사항

MTC 웹 콘솔에는 다음이 포함되어야 합니다.

-

Ready상태의 소스 클러스터 -

Ready상태의 대상 클러스터 - 복제 리포지토리

- 유효한 마이그레이션 계획

절차

- MTC 웹 콘솔에 로그인하고 마이그레이션 계획을 클릭합니다.

마이그레이션 계획 옆에 있는 옵션 메뉴를 클릭하고 마이그레이션에서 다음 옵션 중 하나를 선택합니다.

마이그레이션 계획 옆에 있는 옵션 메뉴를 클릭하고 마이그레이션에서 다음 옵션 중 하나를 선택합니다.

- 스테이지에서는 애플리케이션을 중지하지 않고 소스 클러스터에서 대상 클러스터로 데이터를 복사합니다.

컷오버는 소스 클러스터에서 트랜잭션을 중지하고 리소스를 대상 클러스터로 이동합니다.

선택 사항: 단축 마이그레이션 대화 상자에서 마이그레이션 중에 소스 클러스터에서 Halt 트랜잭션을 지울 수 있습니다.

상태 복사는 선택한 PVC(영구 볼륨 클레임)를 복사합니다.

중요클러스터 간에 네임스페이스를 마이그레이션하는 데 상태 마이그레이션을 사용하지 마십시오. 대신 스테이지 또는 컷오버 마이그레이션을 사용합니다.

- 상태 마이그레이션 대화 상자에서 하나 이상의 PVC를 선택하고 마이그레이션을 클릭합니다.

마이그레이션이 완료되면 OpenShift Container Platform 웹 콘솔에서 애플리케이션이 성공적으로 마이그레이션되었는지 확인합니다.

- 홈 → 프로젝트를 클릭합니다.

- 마이그레이션된 프로젝트를 클릭하여 상태를 봅니다.

- 경로 섹션에서 위치를 클릭하여 해당되는 경우 애플리케이션이 작동하는지 확인합니다.

- 워크로드 → 포드를 클릭하여 포드가 마이그레이션된 네임스페이스에서 실행 중인지 확인합니다.

- 스토리지 → 영구 볼륨을 클릭하여 마이그레이션된 영구 볼륨이 올바르게 프로비저닝되었는지 확인합니다.

9장. 고급 마이그레이션 옵션

대규모 마이그레이션을 수행하고 성능을 개선하기 위해 마이그레이션을 자동화하고 MigPlan 및 MigrationController 사용자 정의 리소스를 수정할 수 있습니다.

9.1. 용어

표 9.1. MTC 용어

| 용어 | 정의 |

|---|---|

| 소스 클러스터 | 애플리케이션이 마이그레이션되는 클러스터입니다. |

| 대상 클러스터[1] | 애플리케이션이 마이그레이션될 대상 클러스터입니다. |

| 복제 리포지토리 | 간접 마이그레이션 중 또는 직접 볼륨 마이그레이션 또는 직접 이미지 마이그레이션 중에 Kubernetes 오브젝트에 대한 이미지, 볼륨 및 Kubernetes 오브젝트 복사에 사용되는 오브젝트 스토리지입니다. 복제 리포지토리는 모든 클러스터에서 액세스할 수 있어야 합니다. |

| 호스트 클러스터 |

호스트 클러스터에 직접 이미지 마이그레이션을 위해 노출된 레지스트리 경로가 필요하지 않습니다. |

| 원격 클러스터 | 원격 클러스터는 일반적으로 소스 클러스터이지만 필수는 아닙니다.

원격 클러스터에는 원격 클러스터에는 직접 이미지 마이그레이션을 위해 노출된 보안 레지스트리 경로가 필요합니다. |

| 간접 마이그레이션 | 이미지, 볼륨 및 Kubernetes 오브젝트는 소스 클러스터에서 복제 리포지토리로 복사한 다음 복제 리포지토리에서 대상 클러스터로 복사됩니다. |

| 직접 볼륨 마이그레이션 | 영구 볼륨은 소스 클러스터에서 대상 클러스터로 직접 복사됩니다. |

| 직접 이미지 마이그레이션 | 이미지가 소스 클러스터에서 대상 클러스터로 직접 복사됩니다. |

| 마이그레이션 단계 | 애플리케이션을 중지하지 않고 데이터가 대상 클러스터에 복사됩니다. 단계적 마이그레이션을 여러 번 실행하면 컷오버 마이그레이션 기간이 단축됩니다. |

| 컷오버 마이그레이션 | 소스 클러스터에서 애플리케이션이 중지되고 해당 리소스가 대상 클러스터로 마이그레이션됩니다. |

| 상태 마이그레이션 | 애플리케이션 상태는 특정 영구 볼륨 클레임을 대상 클러스터에 복사하여 마이그레이션됩니다. |

| 마이그레이션 롤백 | 마이그레이션 롤백은 완료된 마이그레이션을 롤백합니다. |

1 MTC 웹 콘솔에서 대상 클러스터를 호출합니다.

9.2. 명령줄을 사용하여 애플리케이션 마이그레이션

마이그레이션을 자동화하기 위해 CLI(명령줄 인터페이스)를 사용하여 MTC API로 애플리케이션을 마이그레이션할 수 있습니다.

9.2.1. 마이그레이션 사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다.

직접 이미지 마이그레이션

- 소스 클러스터의 보안 내부 레지스트리가 노출되었는지 확인해야 합니다.

- 노출된 레지스트리에 대한 경로를 생성해야 합니다.

직접 볼륨 마이그레이션

- 클러스터에서 프록시를 사용하는 경우 Stunnel TCP 프록시를 구성해야 합니다.

클러스터

- 소스 클러스터를 최신 MTC z-stream 릴리스로 업그레이드해야 합니다.

- MTC 버전은 모든 클러스터에서 동일해야 합니다.

네트워크

- 클러스터는 서로 및 복제 리포지토리에 제한 없이 네트워크 액세스할 수 있습니다.

-

move를 사용하여 영구 볼륨을 복사하는 경우 클러스터에 원격 볼륨에 대한 무제한 네트워크 액세스 권한이 있어야 합니다. OpenShift Container Platform 4 클러스터에서 다음 포트를 활성화해야 합니다.

-

6443(API 서버) -

443(라우트) -

53(DNS)

-

-

TLS를 사용하는 경우 복제 리포지토리에서 포트

443을 활성화해야 합니다.

영구 볼륨 (PV)

- PV가 유효해야 합니다.

- PV를 영구 볼륨 클레임에 바인딩해야 합니다.

스냅샷을 사용하여 PV를 복사하는 경우 다음과 같은 추가 사전 요구 사항이 적용됩니다.

- 클라우드 공급자는 스냅샷을 지원해야 합니다.

- PV는 동일한 클라우드 공급자에 있어야 합니다.

- PV는 동일한 지역 리전에 있어야 합니다.

- PV는 동일한 스토리지 클래스를 보유해야 합니다.

9.2.2. 직접 이미지 마이그레이션을 위한 레지스트리 경로 생성

직접 이미지 마이그레이션의 경우 모든 원격 클러스터에서 공용 내부 레지스트리에 대한 경로를 생성해야 합니다.

사전 요구 사항

내부 레지스트리는 모든 원격 클러스터의 외부 트래픽에 노출되어야 합니다.

OpenShift Container Platform 4 레지스트리는 기본적으로 공개됩니다.

절차

OpenShift Container Platform 4 레지스트리에 대한 경로를 생성하려면 다음 명령을 실행합니다.

$ oc create route passthrough --service=image-registry -n openshift-image-registry

9.2.3. 프록시 설정

OpenShift Container Platform 4.1 및 이전 버전의 경우 이러한 버전은 클러스터 전체 프록시 오브젝트를 지원하지 않기 때문에 Migration Toolkit for Containers Operator를 설치한 후 MigrationController CR(사용자 정의 리소스) 매니페스트에서 proxy를 구성해야 합니다.

OpenShift Container Platform 4.2에서 4.8로, MTC(Migration Toolkit for Containers)는 클러스터 전체 프록시 설정을 상속합니다. 클러스터 전체 프록시 설정을 재정의하려면 프록시 매개변수를 변경할 수 있습니다.

9.2.3.1. 직접 볼륨 마이그레이션

MTC 1.4.2에서 직접 볼륨 마이그레이션(DVM)이 도입되었습니다. DVM은 하나의 프록시만 지원합니다. 대상 클러스터가 프록시 뒤에 있는 경우 소스 클러스터는 대상 클러스터의 경로에 액세스할 수 없습니다.

프록시 뒤에서 소스 클러스터에서 DVM을 수행하려면 전송 계층에서 작동하는 TCP 프록시를 구성하고 자체 SSL 인증서로 암호를 해독하고 재암호화하지 않고도 SSL 연결을 투명하게 전달해야 합니다. Stunnel 프록시는 이러한 프록시의 예입니다.

9.2.3.1.1. DVM용 TCP 프록시 설정

TCP 프록시를 통해 소스와 대상 클러스터 간에 직접 연결하고 프록시를 사용하도록 MigrationController CR에서 stunnel_tcp_proxy 변수를 구성할 수 있습니다.

apiVersion: migration.openshift.io/v1alpha1 kind: MigrationController metadata: name: migration-controller namespace: openshift-migration spec: [...] stunnel_tcp_proxy: http://username:password@ip:port

직접 볼륨 마이그레이션(DVM)은 프록시에 대한 기본 인증만 지원합니다. 또한 DVM은 TCP 연결을 투명하게 터널링할 수 있는 프록시 뒤에서만 작동합니다. 중간자 모드에서 HTTP/HTTPS 프록시가 작동하지 않습니다. 기존 클러스터 전체 프록시에서 이 동작을 지원하지 않을 수 있습니다. 결과적으로 DVM의 프록시 설정은 의도적으로 MTC의 일반 프록시 구성과 다르게 유지됩니다.

9.2.3.1.2. HTTP/HTTPS 프록시 대신 TCP 프록시를 사용하는 이유는 무엇입니까?

OpenShift 경로를 통해 소스와 대상 클러스터 간에 Rsync를 실행하여 DVM을 활성화할 수 있습니다. 트래픽은 TCP 프록시인 Stunnel을 사용하여 암호화됩니다. 소스 클러스터에서 실행되는 Stunnel은 대상 Stunnel을 사용한 TLS 연결을 시작하고 암호화된 채널을 통해 데이터를 전송합니다.

OpenShift의 클러스터 전체 HTTP/HTTPS 프록시는 일반적으로 자체 TLS 세션을 외부 서버와 협상하는 중간자 모드로 구성됩니다. 그러나 이 작업은 Stunnel에서는 작동하지 않습니다. Stunnel은 프록시에서 TLS 세션을 그대로 전환해야 하므로 기본적으로 프록시를 통해 TCP 연결을 그대로 전달하는 투명한 터널로 프록시를 설정해야 합니다. 따라서 TCP 프록시를 사용해야 합니다.

9.2.3.1.3. 알려진 문제

마이그레이션 실패 오류 업그레이드 요청 필요

마이그레이션 컨트롤러는 SPDY 프로토콜을 사용하여 원격 Pod 내에서 명령을 실행합니다. 원격 클러스터가 프록시 또는 SPDY 프로토콜을 지원하지 않는 방화벽 뒤에 있는 경우 마이그레이션 컨트롤러가 원격 명령을 실행하지 못합니다. 오류 메시지 업그레이드 요청 과 함께 마이그레이션이 실패합니다. 해결방법: SPDY 프로토콜을 지원하는 프록시를 사용합니다.

SPDY 프로토콜 지원 외에도 프록시 또는 방화벽은 Upgrade HTTP 헤더를 API 서버에 전달해야 합니다. 클라이언트는 이 헤더를 사용하여 API 서버와의 websocket 연결을 엽니다. 업그레이드 헤더가 프록시 또는 방화벽에 의해 차단된 경우 마이그레이션은 오류 메시지 업그레이드 요청 필요 와 함께 실패합니다. 해결방법: 프록시가 Upgrade 헤더를 전달하도록 합니다.

9.2.3.2. 마이그레이션을 위한 네트워크 정책 튜닝

OpenShift는 클러스터에서 사용하는 네트워크 플러그인을 기반으로 NetworkPolicy 또는 EgressFirewall 을 사용하여 Pod로 트래픽을 제한할 수 있습니다. 마이그레이션과 관련된 소스 네임스페이스가 이러한 메커니즘을 사용하여 네트워크 트래픽을 포드로 제한하는 경우 제한이 마이그레이션 중에 Rsync pod로의 트래픽을 실수로 중지할 수 있습니다.

소스 및 대상 클러스터에서 둘 다 실행되는 rsync Pod는 OpenShift 경로를 통해 서로 연결되어야 합니다. 기존 NetworkPolicy 또는 EgressNetworkPolicy 오브젝트는 이러한 트래픽 제한에서 Rsync Pod를 자동으로 제외하도록 구성할 수 있습니다.

9.2.3.2.1. NetworkPolicy 구성

9.2.3.2.1.1. Rsync Pod의 송신 트래픽

소스 또는 대상 네임스페이스의 NetworkPolicy 구성이 이러한 유형의 트래픽을 차단하는 경우 Rsync Pod의 고유한 레이블을 사용하여 송신 트래픽이 해당 트래픽에서 전달되도록 허용할 수 있습니다. 다음 정책은 네임스페이스의 Rsync Pod에서 모든 송신 트래픽을 허용합니다.

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-all-egress-from-rsync-pods

spec:

podSelector:

matchLabels:

owner: directvolumemigration

app: directvolumemigration-rsync-transfer

egress:

- {}

policyTypes:

- Egress9.2.3.2.1.2. Rsync pod로의 수신 트래픽

apiVersion: networking.k8s.io/v1

kind: NetworkPolicy

metadata:

name: allow-all-egress-from-rsync-pods

spec:

podSelector:

matchLabels:

owner: directvolumemigration

app: directvolumemigration-rsync-transfer

ingress:

- {}

policyTypes:

- Ingress9.2.3.2.2. EgressNetworkPolicy 구성

EgressNetworkPolicy 오브젝트 또는 Egress Firewalls 는 클러스터를 나가는 송신 트래픽을 차단하도록 설계된 OpenShift 구조입니다.

NetworkPolicy 오브젝트와 달리 Egress Firewall은 네임스페이스의 모든 포드에 적용되므로 프로젝트 수준에서 작동합니다. 따라서 Rsync Pod의 고유 레이블은 제한 사항에서 Rsync Pod만 제외하지 않습니다. 그러나 두 클러스터 간에 직접 연결을 설정할 수 있도록 소스 또는 대상 클러스터의 CIDR 범위를 정책의 허용 규칙에 추가할 수 있습니다.

Egress Firewall이 있는 클러스터를 기반으로 다른 클러스터의 CIDR 범위를 추가하여 둘 사이의 송신 트래픽을 허용할 수 있습니다.

apiVersion: network.openshift.io/v1

kind: EgressNetworkPolicy

metadata:

name: test-egress-policy

namespace: <namespace>

spec:

egress:

- to:

cidrSelector: <cidr_of_source_or_target_cluster>

type: Deny9.2.3.2.3. Rsync Pod에 대한 추가 그룹 구성

PVC에서 공유 스토리지를 사용하는 경우 Pod에서 액세스를 허용하기 위해 Rsync Pod 정의에 추가 그룹을 추가하여 해당 스토리지에 대한 액세스를 구성할 수 있습니다.

표 9.2. Rsync Pod의 보조 그룹

| 변수 | 유형 | 기본값 | 설명 |

|---|---|---|---|

|

| string | 설정되지 않음 | 소스 Rsync Pod에 대한 콤마로 구분된 추가 그룹 목록 |

|

| string | 설정되지 않음 | 대상 Rsync Pod에 대한 콤마로 구분된 추가 그룹 목록 |

사용 예

MigrationController CR을 업데이트하여 이러한 추가 그룹에 대한 값을 설정할 수 있습니다.

spec: src_supplemental_groups: "1000,2000" target_supplemental_groups: "2000,3000"

9.2.3.3. 프록시 구성

사전 요구 사항

-

모든 클러스터에서

cluster-admin권한이 있는 사용자로 로그인합니다.

절차

MigrationControllerCR 매니페스트를 가져옵니다.$ oc get migrationcontroller <migration_controller> -n openshift-migration

프록시 매개변수를 업데이트합니다.

apiVersion: migration.openshift.io/v1alpha1 kind: MigrationController metadata: name: <migration_controller> namespace: openshift-migration ... spec: stunnel_tcp_proxy: http://<username>:<password>@<ip>:<port> 1 noProxy: example.com 2

하위 도메인과 일치하려면 도메인 앞에

.을 입력합니다. 예를 들어,.y.com은x.y.com과 일치하지만y.com은 일치하지 않습니다.*를 사용하여 모든 대상에 대해 프록시를 바이패스합니다.networking.machineNetwork[].cidr필드에 의해 정의된 네트워크에 포함되어 있지 않은 작업자를 설치 구성에서 확장하려면 연결 문제를 방지하기 위해 이 목록에 해당 작업자를 추가해야 합니다.httpProxy또는httpsProxy필드가 설정되지 않은 경우 이 필드는 무시됩니다.-

매니페스트를

migration-controller.yaml로 저장합니다. 업데이트된 매니페스트를 적용합니다.

$ oc replace -f migration-controller.yaml -n openshift-migration

9.2.4. MTC API를 사용하여 애플리케이션 마이그레이션

MTC(Migration Toolkit for Containers) API를 사용하여 명령줄에서 애플리케이션을 마이그레이션할 수 있습니다.

절차

호스트 클러스터에 대한

MigClusterCR 매니페스트를 생성합니다.$ cat << EOF | oc apply -f - apiVersion: migration.openshift.io/v1alpha1 kind: MigCluster metadata: name: <host_cluster> namespace: openshift-migration spec: isHostCluster: true EOF

각 원격 클러스터에 대한

SecretCR 매니페스트를 생성합니다.$ cat << EOF | oc apply -f - apiVersion: v1 kind: Secret metadata: name: <cluster_secret> namespace: openshift-config type: Opaque data: saToken: <sa_token> 1 EOF- 1

- 원격 클러스터의 base64로 인코딩된

migration-controller서비스 계정(SA) 토큰을 지정합니다. 다음 명령을 실행하여 토큰을 가져올 수 있습니다.

$ oc sa get-token migration-controller -n openshift-migration | base64 -w 0

각 원격 클러스터에 대해

MigClusterCR 매니페스트를 생성합니다.$ cat << EOF | oc apply -f - apiVersion: migration.openshift.io/v1alpha1 kind: MigCluster metadata: name: <remote_cluster> 1 namespace: openshift-migration spec: exposedRegistryPath: <exposed_registry_route> 2 insecure: false 3 isHostCluster: false serviceAccountSecretRef: name: <remote_cluster_secret> 4 namespace: openshift-config url: <remote_cluster_url> 5 EOF

모든 클러스터가

Ready상태에 있는지 확인합니다.$ oc describe cluster <cluster>

복제 리포지토리의

SecretCR 매니페스트를 생성합니다.$ cat << EOF | oc apply -f - apiVersion: v1 kind: Secret metadata: namespace: openshift-config name: <migstorage_creds> type: Opaque data: aws-access-key-id: <key_id_base64> 1 aws-secret-access-key: <secret_key_base64> 2 EOF

AWS 인증 정보는 기본적으로 base64로 인코딩됩니다. 다른 스토리지 공급자의 경우 각 키로 다음 명령을 실행하여 인증 정보를 인코딩해야 합니다.

$ echo -n "<key>" | base64 -w 0 1- 1

- 키 ID 또는 시크릿 키를 지정합니다. 두 키 모두 base64로 인코딩되어야 합니다.

복제 리포지토리에 대한

MigStorageCR 매니페스트를 생성합니다.$ cat << EOF | oc apply -f - apiVersion: migration.openshift.io/v1alpha1 kind: MigStorage metadata: name: <migstorage> namespace: openshift-migration spec: backupStorageConfig: awsBucketName: <bucket> 1 credsSecretRef: name: <storage_secret> 2 namespace: openshift-config backupStorageProvider: <storage_provider> 3 volumeSnapshotConfig: credsSecretRef: name: <storage_secret> 4 namespace: openshift-config volumeSnapshotProvider: <storage_provider> 5 EOFMigStorageCR이Ready상태에 있는지 확인합니다.$ oc describe migstorage <migstorage>