백업 및 복원

OpenShift Container Platform 클러스터 백업 및 복원

초록

1장. 백업 및 복원

1.1. 컨트롤 플레인 백업 및 복원 작업

클러스터 관리자는 기간 동안 OpenShift Container Platform 클러스터를 중지하고 나중에 다시 시작해야 할 수 있습니다. 클러스터를 다시 시작하는 몇 가지 이유는 클러스터에서 유지보수를 수행하거나 리소스 비용을 절감해야 한다는 것입니다. OpenShift Container Platform에서는 나중에 클러스터를 쉽게 다시 시작할 수 있도록 클러스터의 정상 종료 를 수행할 수 있습니다.

클러스터를 종료하기 전에 etcd 데이터를 백업 해야 합니다. etcd는 모든 리소스 오브젝트의 상태를 유지하는 OpenShift Container Platform의 키-값 저장소입니다. etcd 백업은 재해 복구에 중요한 역할을 합니다. OpenShift Container Platform에서는 비정상적인 etcd 멤버도 교체할 수 있습니다.

클러스터를 다시 실행하려면 클러스터를 정상적으로 다시 시작합니다.

클러스터 인증서는 설치 날짜 이후 1년 후에 만료됩니다. 인증서가 여전히 유효한 상태에서 클러스터를 종료하고 정상적으로 다시 시작할 수 있습니다. 클러스터는 만료된 컨트롤 플레인 인증서를 자동으로 검색하지만 CSR(인증서 서명 요청)을 계속 승인해야 합니다.

OpenShift Container Platform이 예상대로 작동하지 않는 여러 상황이 발생할 수 있습니다.

- 노드 장애 또는 네트워크 연결 문제와 같은 예기치 않은 조건으로 인해 재시작 후 작동하지 않는 클러스터가 있습니다.

- 실수로 클러스터에서 중요한 것을 삭제했습니다.

- 대부분의 컨트롤 플레인 호스트가 손실되어 etcd 쿼럼이 손실됩니다.

저장된 etcd 스냅샷을 사용하여 클러스터를 이전 상태로 복원하면 항상 재해 상황을 복구할 수 있습니다.

추가 리소스

1.2. 애플리케이션 백업 및 복원 작업

클러스터 관리자는 OADP(OpenShift API for Data Protection)를 사용하여 OpenShift Container Platform에서 실행되는 애플리케이션을 백업하고 복원할 수 있습니다.

OADP는 Velero CLI 툴 다운로드 의 표에 따라 설치하는 OADP 버전에 적합한 Velero 버전을 사용하여 네임스페이스 단위로 Kubernetes 리소스 및 내부 이미지를 백업 및 복원합니다. OADP는 스냅샷 또는 Restic을 사용하여 PV(영구 볼륨)를 백업하고 복원합니다. 자세한 내용은 OADP 기능을 참조하십시오.

1.2.1. OADP 요구사항

OADP에는 다음과 같은 요구 사항이 있습니다.

-

cluster-admin역할의 사용자로 로그인해야 합니다. 다음 스토리지 유형 중 하나와 같이 백업을 저장하기 위한 오브젝트 스토리지가 있어야 합니다.

- OpenShift Data Foundation

- Amazon Web Services

- Microsoft Azure

- Google Cloud Platform

- S3 호환 오브젝트 스토리지

OCP 4.11 이상에서 CSI 백업을 사용하려면 OADP 1.1.x 를 설치하십시오.

OADP 1.0.x 는 OCP 4.11 이상에서 CSI 백업을 지원하지 않습니다. OADP 1.0.x 에는 Velero 1.7이 포함되어 있으며 OCP 4.11 이상에는 존재하지 않는 API 그룹 snapshot.storage.k8s.io/v1beta1 이 예상됩니다.

S3 스토리지의 CloudStorage API는 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 기술 프리뷰 기능 지원 범위를 참조하십시오.

스냅샷으로 PV를 백업하려면 기본 스냅샷 API가 있거나 다음 공급자와 같은 CSI(Container Storage Interface) 스냅샷을 지원하는 클라우드 스토리지가 있어야 합니다.

- Amazon Web Services

- Microsoft Azure

- Google Cloud Platform

- Ceph RBD 또는 Ceph FS와 같은 CSI 스냅샷 지원 클라우드 스토리지

스냅샷을 사용하여 PV를 백업하지 않으려면 기본적으로 OADP Operator에 의해 설치된 Restic 을 사용할 수 있습니다.

1.2.2. 애플리케이션 백업 및 복원

Backup CR(사용자 정의 리소스)을 생성하여 애플리케이션을 백업합니다. Backup CR 생성을 참조하십시오. 다음 백업 옵션을 구성할 수 있습니다.

- 백업 작업 전후에 명령을 실행할 백업 후크 생성

- 백업 예약

- Restic 백업

-

복원(CR)을 생성하여 애플리케이션 백업을

복원합니다. Restore CR 생성을 참조하십시오. - 복원 작업 중에 init 컨테이너 또는 애플리케이션 컨테이너에서 명령을 실행하도록 복원 후크 를 구성할 수 있습니다.

2장. 클러스터를 안전하게 종료

이 문서에서는 클러스터를 안전하게 종료하는 프로세스를 설명합니다. 유지 관리를 위해 또는 리소스 비용을 절약하기 위해 일시적으로 클러스터를 종료해야 할 수 있습니다.

2.1. 전제 조건

클러스터를 종료하기 전에 etcd 백업을 수행하십시오.

중요클러스터를 다시 시작할 때 문제가 발생할 경우 클러스터를 복원 할 수 있도록 이 단계를 수행하기 전에 etcd 백업을 해 두는 것이 중요합니다.

예를 들어 다음 조건으로 인해 재시작된 클러스터가 손상될 수 있습니다.

- 종료 중 etcd 데이터 손상

- 하드웨어로 인한 노드 오류

- 네트워크 연결 문제

클러스터를 복구하지 못하는 경우 다음 단계에 따라 이전 클러스터 상태로 복원 하십시오.

2.2. 클러스터 종료

나중에 클러스터를 다시 시작하기 위해 안전한 방법으로 클러스터를 종료할 수 있습니다.

설치 날짜부터 1년까지 클러스터를 종료하고 정상적으로 다시 시작할 수 있습니다. 설치 날짜로부터 1년 후에는 클러스터 인증서가 만료됩니다.

사전 요구 사항

-

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. - etcd 백업이 수행되었습니다.

절차

장기간 클러스터를 종료하려는 경우 클러스터 인증서가 만료되는 날짜를 확인합니다.

인증서가 만료되기 전에 클러스터를 다시 시작해야 합니다. 클러스터가 재시작되면 프로세스에서 kubelet 인증서를 복구하기 위해 보류 중인 인증서 서명 요청(CSR)을 수동으로 승인해야 할 수 있습니다.

kube-apiserver-to-kubelet-signerCA 인증서의 만료 날짜를 확인합니다.$ oc -n openshift-kube-apiserver-operator get secret kube-apiserver-to-kubelet-signer -o jsonpath='{.metadata.annotations.auth\.openshift\.io/certificate-not-after}{"\n"}'출력 예

2023-08-05T14:37:50Z

kubelet 인증서의 만료 날짜를 확인합니다.

다음 명령을 실행하여 컨트롤 플레인 노드의 디버그 세션을 시작합니다.

$ oc debug node/<node_name>

다음 명령을 실행하여 root 디렉토리를

/host로 변경합니다.sh-4.4# chroot /host

다음 명령을 실행하여 kubelet 클라이언트 인증서 만료 날짜를 확인합니다.

sh-5.1# openssl x509 -in /var/lib/kubelet/pki/kubelet-client-current.pem -noout -enddate

출력 예

notAfter=Jun 6 10:50:07 2023 GMT

다음 명령을 실행하여 kubelet 서버 인증서 만료 날짜를 확인합니다.

sh-5.1# openssl x509 -in /var/lib/kubelet/pki/kubelet-server-current.pem -noout -enddate

출력 예

notAfter=Jun 6 10:50:07 2023 GMT

- 디버그 세션을 종료합니다.

- 이 단계를 반복하여 모든 컨트롤 플레인 노드에서 인증서 만료 날짜를 확인합니다. 클러스터를 정상적으로 다시 시작할 수 있도록 인증서 만료일보다 먼저 다시 시작합니다.

클러스터의 모든 노드를 종료합니다. 클라우드 공급자의 웹 콘솔에서 이 작업을 수행하거나 다음 루프를 실행할 수 있습니다.

$ for node in $(oc get nodes -o jsonpath='{.items[*].metadata.name}'); do oc debug node/${node} -- chroot /host shutdown -h 1; done 1- 1

-H 1은 컨트롤 플레인 노드가 종료되기 전에 이 프로세스가 몇 분 내에 지속되는지를 나타냅니다. 10개 이상의 노드가 있는 대규모 클러스터의 경우 모든 컴퓨팅 노드를 먼저 종료할 시간이 있도록 10분 이상 설정합니다.

출력 예

Starting pod/ip-10-0-130-169us-east-2computeinternal-debug ... To use host binaries, run `chroot /host` Shutdown scheduled for Mon 2021-09-13 09:36:17 UTC, use 'shutdown -c' to cancel. Removing debug pod ... Starting pod/ip-10-0-150-116us-east-2computeinternal-debug ... To use host binaries, run `chroot /host` Shutdown scheduled for Mon 2021-09-13 09:36:29 UTC, use 'shutdown -c' to cancel.

이러한 방법 중 하나를 사용하여 노드를 종료하면 pod가 정상적으로 종료되어 데이터 손상 가능성을 줄일 수 있습니다.

참고대규모 클러스터의 경우 종료 시간을 더 길게 조정합니다.

$ for node in $(oc get nodes -o jsonpath='{.items[*].metadata.name}'); do oc debug node/${node} -- chroot /host shutdown -h 10; done참고종료하기 전에 OpenShift Container Platform과 함께 제공되는 표준 Pod의 컨트롤 플레인 노드를 드레인할 필요가 없습니다.

클러스터 관리자는 클러스터를 다시 시작한 후 워크로드를 완전히 다시 시작해야 합니다. 사용자 지정 워크로드로 인해 종료하기 전에 컨트롤 플레인 노드를 드레 이한 경우 다시 시작한 후 클러스터가 다시 작동하기 전에 컨트롤 플레인 노드를 스케줄 대상으로 표시해야합니다.

외부 스토리지 또는 LDAP 서버와 같이 더 이상 필요하지 않은 클러스터 종속성을 중지합니다. 이 작업을 수행하기 전에 공급 업체의 설명서를 확인하십시오.

중요클라우드 공급자 플랫폼에 클러스터를 배포한 경우, 연결된 클라우드 리소스를 종료, 일시 중단 또는 삭제하지 마십시오. 중단된 가상 머신의 클라우드 리소스를 삭제하면 OpenShift Container Platform이 성공적으로 복원되지 않을 수 있습니다.

2.3. 추가 리소스

3장. 클러스터를 정상적으로 다시 시작

이 문서에서는 정상 종료 후 클러스터를 다시 시작하는 프로세스에 대해 설명합니다.

다시 시작한 후 클러스터가 정상적으로 작동할 것으로 예상되지만 예상치 못한 상황으로 인해 클러스터가 복구되지 않을 수 있습니다. 예를 들면 다음과 같습니다.

- 종료 중 etcd 데이터 손상

- 하드웨어로 인한 노드 오류

- 네트워크 연결 문제

클러스터를 복구하지 못하는 경우 다음 단계에 따라 이전 클러스터 상태로 복원 하십시오.

3.1. 전제 조건

3.2. 클러스터를 다시 시작

클러스터가 정상적으로 종료된 후 클러스터를 다시 시작할 수 있습니다.

전제 조건

-

cluster-admin역할의 사용자로 클러스터에 액세스할 수 있습니다. - 이 프로세스에서는 클러스터를 정상적으로 종료하고 있는 것을 전제로 하고 있습니다.

프로세스

- 외부 스토리지 또는 LDAP 서버와 같은 클러스터의 종속 장치를 시작합니다.

모든 클러스터 시스템을 시작합니다.

클라우드 제공 업체의 웹 콘솔에서 시스템을 시작하는 것과 같이 클라우드 환경에 적합한 방법을 사용하여 시스템을 시작합니다.

약 10분 정도 기다린 후 컨트롤 플레인 노드의 상태를 확인합니다.

모든 컨트롤 플레인 노드가 준비되었는지 확인합니다.

$ oc get nodes -l node-role.kubernetes.io/master

다음 출력에 표시된 대로 노드의 상태가

Ready인 경우 컨트롤 플레인 노드는 준비된 것입니다.NAME STATUS ROLES AGE VERSION ip-10-0-168-251.ec2.internal Ready master 75m v1.24.0 ip-10-0-170-223.ec2.internal Ready master 75m v1.24.0 ip-10-0-211-16.ec2.internal Ready master 75m v1.24.0

컨트롤 플레인 노드가 준비되지 않은 경우 승인해야하는 보류중인 인증서 서명 요청(CSR)이 있는지 확인합니다.

현재 CSR의 목록을 가져옵니다.

$ oc get csr

CSR의 세부 사항을 검토하여 CSR이 유효한지 확인합니다.

$ oc describe csr <csr_name> 1- 1

<csr_name>은 현재 CSR 목록에 있는 CSR의 이름입니다.

각각의 유효한 CSR을 승인합니다.

$ oc adm certificate approve <csr_name>

컨트롤 플레인 노드가 준비되면 모든 작업자 노드가 준비되었는지 확인합니다.

$ oc get nodes -l node-role.kubernetes.io/worker

다음 출력에 표시된 대로 작업자 노드의 상태가

Ready인 경우 작업자 노드는 준비된 것입니다.NAME STATUS ROLES AGE VERSION ip-10-0-179-95.ec2.internal Ready worker 64m v1.24.0 ip-10-0-182-134.ec2.internal Ready worker 64m v1.24.0 ip-10-0-250-100.ec2.internal Ready worker 64m v1.24.0

작업자 노드가 준비되지 않은 경우 승인해야하는 보류중인 인증서 서명 요청(CSR)이 있는지 확인합니다.

현재 CSR의 목록을 가져옵니다.

$ oc get csr

CSR의 세부 사항을 검토하여 CSR이 유효한지 확인합니다.

$ oc describe csr <csr_name> 1- 1

<csr_name>은 현재 CSR 목록에 있는 CSR의 이름입니다.

각각의 유효한 CSR을 승인합니다.

$ oc adm certificate approve <csr_name>

클러스터가 제대로 시작되었는지 확인합니다.

성능이 저하된 클러스터 Operator가 없는지 확인합니다.

$ oc get clusteroperators

DEGRADED조건이True로 설정된 클러스터 Operator가 없는지 확인합니다.NAME VERSION AVAILABLE PROGRESSING DEGRADED SINCE authentication 4.10.0 True False False 59m cloud-credential 4.10.0 True False False 85m cluster-autoscaler 4.10.0 True False False 73m config-operator 4.10.0 True False False 73m console 4.10.0 True False False 62m csi-snapshot-controller 4.10.0 True False False 66m dns 4.10.0 True False False 76m etcd 4.10.0 True False False 76m ...

모든 노드가

Ready상태에 있는지 확인합니다.$ oc get nodes

모든 노드의 상태가

Ready상태인지 확인합니다.NAME STATUS ROLES AGE VERSION ip-10-0-168-251.ec2.internal Ready master 82m v1.24.0 ip-10-0-170-223.ec2.internal Ready master 82m v1.24.0 ip-10-0-179-95.ec2.internal Ready worker 70m v1.24.0 ip-10-0-182-134.ec2.internal Ready worker 70m v1.24.0 ip-10-0-211-16.ec2.internal Ready master 82m v1.24.0 ip-10-0-250-100.ec2.internal Ready worker 69m v1.24.0

클러스터가 제대로 시작되지 않은 경우 etcd 백업을 사용하여 클러스터를 복원해야 할 수 있습니다.

추가 리소스

4장. OADP 애플리케이션 백업 및 복원

4.1. 데이터 보호를 위한 OpenShift API 소개

OADP(OpenShift API for Data Protection) 제품은 OpenShift Container Platform에서 고객 애플리케이션을 보호합니다. OpenShift Container Platform 애플리케이션, 애플리케이션 관련 클러스터 리소스, 영구 볼륨 및 내부 이미지를 다루는 포괄적인 재해 복구 보호 기능을 제공합니다. OADP는 컨테이너화된 애플리케이션과 VM(가상 머신)을 모두 백업할 수 있습니다.

그러나 OADP는 etcd 또는 OpenShift Operator의 재해 복구 솔루션 역할을 하지 않습니다.

4.1.1. OpenShift API for Data Protection API

OADP(OpenShift API for Data Protection)는 여러 가지 접근 방식을 통해 백업을 사용자 지정하고 불필요하거나 부적절한 리소스가 포함되지 않도록 하는 API를 제공합니다.

OADP는 다음 API를 제공합니다.

추가 리소스

4.2. OADP 릴리스 정보

OADP(OpenShift API for Data Protection) 릴리스 노트에서는 새로운 기능 및 향상된 기능, 더 이상 사용되지 않는 기능, 제품 권장 사항, 알려진 문제 및 해결된 문제를 설명합니다.

4.2.1. OADP 1.2.3 릴리스 노트

4.2.1.1. 새로운 기능

OADP(OpenShift API for Data Protection) 1.2.3 릴리스에는 새로운 기능이 없습니다.

4.2.1.2. 해결된 문제

다음 강조 표시된 문제는 OADP 1.2.3에서 해결됩니다.

여러 HTTP/2가 활성화된 웹 서버는 DDoS 공격(Rapid Reset Attack)에 취약합니다.

이전 버전의 OADP 1.2에서는 요청 취소가 여러 스트림을 빠르게 재설정할 수 있기 때문에 HTTP/2 프로토콜이 서비스 거부 공격에 취약했습니다. 서버는 스트림을 설정하고 해체하는 동시에 연결당 최대 활성 스트림 수에 대한 서버 측 제한에 도달하지 않아야 했습니다. 이로 인해 서버 리소스 사용량으로 인해 서비스가 거부되었습니다. 이 CVE와 관련된 모든 OADP 문제 목록은 다음 Jira 목록을 참조하십시오.

자세한 내용은 CVE-2023-39325 (Rapid Reset Attack) 를 참조하십시오.

OADP 1.2.3 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.2.3 해결된 문제 목록을 참조하십시오.

4.2.1.3. 확인된 문제

OADP 1.2.3 릴리스에는 알려진 문제가 없습니다.

4.2.2. OADP 1.2.2 릴리스 노트

4.2.2.1. 새로운 기능

OADP(OpenShift API for Data Protection) 1.2.2 릴리스에는 새로운 기능이 없습니다.

4.2.2.2. 해결된 문제

다음 강조 표시된 문제는 OADP 1.2.2에서 해결됩니다.

Pod 보안 표준으로 인해 Restic 복원이 부분적으로 실패했습니다.

이전 릴리스의 OADP 1.2에서 OpenShift Container Platform 4.14는 Restic 복원 프로세스 중에 Pod 준비 상태를 방해하는 PSA(Pod 보안 승인) 정책을 적용했습니다.

이 문제는 OADP 1.2.2 및 OADP 1.1.6 릴리스에서 해결되었습니다. 따라서 사용자는 이러한 릴리스로 업그레이드하는 것이 좋습니다.

자세한 내용은 변경된 PSA 정책으로 인해 OCP 4.14에서 부분적으로 실패한 Restic 복원을 참조하십시오. (OADP-2094)

내부 이미지가 있는 앱 백업이 플러그인 패닉 오류와 함께 부분적으로 실패했습니다.

이전 릴리스의 OADP 1.2 릴리스에서는 플러그인 패닉 오류가 반환되어 내부 이미지가 부분적으로 실패한 애플리케이션의 백업이 실패했습니다. Velero 로그에서 이 오류와 함께 백업이 부분적으로 실패합니다.

time="2022-11-23T15:40:46Z" level=info msg="1 errors encountered backup up item" backup=openshift-adp/django-persistent-67a5b83d-6b44-11ed-9cba-902e163f806c logSource="/remote-source/velero/app/pkg/backup/backup.go:413" name=django-psql-persistent time="2022-11-23T15:40:46Z" level=error msg="Error backing up item" backup=openshift-adp/django-persistent-67a5b83d-6b44-11ed-9cba-902e163f8

이 문제는 OADP 1.2.2에서 해결되었습니다. (OADP-1057).

복원 주문으로 인해 ACM 클러스터 복원이 예상대로 작동하지 않았습니다.

이전 릴리스의 OADP 1.2에서는 복원 주문으로 인해 ACM 클러스터 복원이 예상대로 작동하지 않았습니다. ACM 애플리케이션은 복원 활성화 후 관리 클러스터에서 제거 및 다시 생성되었습니다. (OADP-2505)

볼륨 크기 불일치로 인해 백업 및 복원 시 VM의 filesystemOverhead 사용 실패

이전 릴리스에서는 스토리지 공급자 구현 선택 사항으로 인해 애플리케이션 PVC(영구 볼륨 클레임) 스토리지 요청과 동일한 PVC의 스냅샷 크기에 차이가 있을 때마다 백업 및 복원 시 VM의 filesystemOverhead가 실패했습니다. 이 문제는 OADP 1.2.2의 데이터 Mover에서 해결되었습니다. (OADP-2144)

OADP에는 collectdSync 복제 소스 정리 간격을 설정하는 옵션이 포함되어 있지 않았습니다.

이전 릴리스의 OADP 1.2에서는 ballSync 복제 소스 pruneInterval 을 설정할 수 있는 옵션이 없었습니다. (OADP-2052)

Velero가 여러 네임스페이스에 설치된 경우 가능한 Pod 볼륨 백업 실패

이전 릴리스의 OADP 1.2 릴리스에서는 Velero가 여러 네임스페이스에 설치된 경우 Pod 볼륨 백업 오류가 발생할 수 있었습니다. (OADP-2409)

VSL에서 사용자 정의 시크릿을 사용하는 경우 백업 스토리지 위치가 사용할 수 없는 단계로 이동

이전 릴리스의 OADP 1.2 릴리스에서는 Volume Snapshot Location이 사용자 정의 시크릿을 사용한 경우 Backup Storage Locations를 사용할 수 없는 단계로 이동했습니다. (OADP-1737)

OADP 1.2.2 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.2.2 해결된 문제 목록을 참조하십시오.

4.2.2.3. 확인된 문제

다음 문제는 OADP 1.2.2 릴리스에서 알려진 문제로 강조되어 있습니다.

must-gather 명령이 ClusterRoleBinding 리소스를 제거하지 못했습니다

oc adm must-gather 명령은 승인 Webhook로 인해 클러스터에 남아 있는 ClusterRoleBinding 리소스를 제거하지 못합니다. 따라서 ClusterRoleBinding 리소스 제거 요청이 거부됩니다. (OADP-27730)

admission webhook "clusterrolebindings-validation.managed.openshift.io" denied the request: Deleting ClusterRoleBinding must-gather-p7vwj is not allowed

이 릴리스에서 알려진 모든 문제의 전체 목록은 Jira의 OADP 1.2.2 알려진 문제 목록을 참조하십시오.

4.2.3. OADP 1.2.1 릴리스 노트

4.2.3.1. 새로운 기능

OADP(OpenShift API for Data Protection) 1.2.1 릴리스에는 새로운 기능이 없습니다.

4.2.3.2. 해결된 문제

OADP 1.2.1 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.2.1 해결 문제 목록을 참조하십시오.

4.2.3.3. 확인된 문제

다음 문제는 OADP 1.2.1 릴리스에서 알려진 문제로 강조되어 있습니다.

DataMover Restic 유지 및 정리 정책이 예상대로 작동하지 않음

CryostatSync 및 Restic이 제공하는 보존 및 정리 기능은 예상대로 작동하지 않습니다. collectdSync 복제에 정리 간격을 설정하는 작업 옵션이 없으므로 OADP 외부에서 S3 스토리지에 원격으로 저장된 백업을 관리하고 정리해야 합니다. 자세한 내용은 다음을 참조하십시오.

OADP Data Mover는 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 기술 프리뷰 기능 지원 범위를 참조하십시오.

이 릴리스에서 알려진 모든 문제의 전체 목록은 Jira의 OADP 1.2.1 알려진 문제 목록을 참조하십시오.

4.2.4. OADP 1.2.0 릴리스 노트

OADP 1.2.0 릴리스 노트에는 새로운 기능, 버그 수정 및 알려진 문제에 대한 정보가 포함되어 있습니다.

4.2.4.1. 새로운 기능

리소스 제한 시간

새 resourceTimeout 옵션은 다양한 Velero 리소스에서 대기할 때까지 시간 초과 기간을 분 단위로 지정합니다. 이 옵션은 Velero CRD 가용성, volumeSnapshot 삭제 및 백업 리포지토리 가용성과 같은 리소스에 적용됩니다. 기본 기간은 10분입니다.

AWS S3 호환 백업 스토리지 공급자

AWS S3 호환 공급자에서 오브젝트 및 스냅샷을 백업할 수 있습니다. 자세한 내용은 Amazon Web Services 구성을 참조하십시오.

4.2.4.1.1. 기술 프리뷰 기능

Data Mover

OADP Data Mover를 사용하면 CSI(Container Storage Interface) 볼륨 스냅샷을 원격 오브젝트 저장소에 백업할 수 있습니다. Data Mover를 활성화하면 실수로 클러스터 삭제, 클러스터 장애 또는 데이터 손상의 경우 오브젝트 저장소에서 가져온 CSI 볼륨 스냅샷을 사용하여 상태 저장 애플리케이션을 복원할 수 있습니다. 자세한 내용은 CSI 스냅샷에 데이터 Mover 사용을 참조하십시오.

OADP Data Mover는 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 기술 프리뷰 기능 지원 범위를 참조하십시오.

4.2.4.2. 해결된 문제

이 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.2.0 해결 문제 목록을 참조하십시오.

4.2.4.3. 확인된 문제

다음 문제는 OADP 1.2.0 릴리스에서 알려진 문제로 강조되어 있습니다.

여러 HTTP/2가 활성화된 웹 서버는 DDoS 공격(Rapid Reset Attack)에 취약합니다.

요청 취소가 여러 스트림을 빠르게 재설정할 수 있으므로 HTTP/2 프로토콜은 서비스 거부 공격에 취약합니다. 서버는 스트림을 설정하고 해체해야 하지만 연결당 최대 활성 스트림 수에 대한 서버 측 제한에 도달하지 않아야 합니다. 이로 인해 서버 리소스 사용량으로 인해 서비스 거부가 발생합니다. 이 CVE와 관련된 모든 OADP 문제 목록은 다음 Jira 목록을 참조하십시오.

이 문제를 해결하려면 OADP 1.2.3으로 업그레이드하는 것이 좋습니다.

자세한 내용은 CVE-2023-39325 (Rapid Reset Attack) 를 참조하십시오.

4.2.5. OADP 1.1.7 릴리스 노트

OADP 1.1.7 릴리스 노트에는 해결된 문제와 알려진 문제가 나열되어 있습니다.

4.2.5.1. 해결된 문제

다음의 강조된 문제는 OADP 1.1.7에서 해결됩니다.

여러 HTTP/2가 활성화된 웹 서버는 DDoS 공격(Rapid Reset Attack)에 취약합니다.

이전 버전의 OADP 1.1에서는 요청 취소가 여러 스트림을 빠르게 재설정할 수 있기 때문에 HTTP/2 프로토콜이 서비스 거부 공격에 취약했습니다. 서버는 스트림을 설정하고 해체하는 동시에 연결당 최대 활성 스트림 수에 대한 서버 측 제한에 도달하지 않아야 했습니다. 이로 인해 서버 리소스 사용량으로 인해 서비스가 거부되었습니다. 이 CVE와 관련된 모든 OADP 문제 목록은 다음 Jira 목록을 참조하십시오.

자세한 내용은 CVE-2023-39325 (Rapid Reset Attack) 를 참조하십시오.

OADP 1.1.7 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.1.7 문제 목록을 참조하십시오.

4.2.5.2. 확인된 문제

OADP 1.1.7 릴리스에는 알려진 문제가 없습니다.

4.2.6. OADP 1.1.6 릴리스 노트

OADP 1.1.6 릴리스 노트에는 새로운 기능, 해결된 문제 및 버그, 알려진 문제가 나열되어 있습니다.

4.2.6.1. 해결된 문제

Pod 보안 표준으로 인해 Restic 복원이 부분적으로 실패함

OCP 4.14에서는 권한 있는 프로필이 적용됨을 나타내는 Pod 보안 표준이 도입 되었습니다. 이전 릴리스의 OADP에서 이 프로필로 인해 Pod에서 권한 거부 오류가 발생했습니다. 이 문제는 복원 순서 때문에 발생했습니다. Pod는 SCC(보안 컨텍스트 제약 조건) 리소스 전에 생성되었습니다. 이 Pod가 Pod 보안 표준을 위반했기 때문에 Pod가 거부되어 실패했습니다. OADP-2420

작업 리소스에 대해 부분적으로 실패함

이전 릴리스의 OADP에서는 OCP 4.14에서 작업 리소스 복원이 부분적으로 실패했습니다. 이 문제는 이전 OCP 버전에서 볼 수 없었습니다. 이 문제는 이전 OCP 버전에 없는 작업 리소스에 대한 추가 레이블로 인해 발생했습니다. OADP-2530

이 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.1.6 해결 문제 목록을 참조하십시오.

4.2.6.2. 확인된 문제

이 릴리스에서 알려진 모든 문제의 전체 목록은 Jira의 OADP 1.1.6 알려진 문제 목록을 참조하십시오.

4.2.7. OADP 1.1.5 릴리스 노트

OADP 1.1.5 릴리스 노트에는 새로운 기능, 해결된 문제 및 버그, 알려진 문제가 나열되어 있습니다.

4.2.7.1. 새로운 기능

이 버전의 OADP는 서비스 릴리스입니다. 이 버전에는 새로운 기능이 추가되지 않습니다.

4.2.7.2. 해결된 문제

이 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.1.5 해결 문제 목록을 참조하십시오.

4.2.7.3. 확인된 문제

이 릴리스에서 알려진 모든 문제의 전체 목록은 Jira의 OADP 1.1.5 알려진 문제 목록을 참조하십시오.

4.2.8. OADP 1.1.4 릴리스 노트

OADP 1.1.4 릴리스 노트에는 새로운 기능, 해결된 문제 및 알려진 문제가 나열되어 있습니다.

4.2.8.1. 새로운 기능

이 버전의 OADP는 서비스 릴리스입니다. 이 버전에는 새로운 기능이 추가되지 않습니다.

4.2.8.2. 해결된 문제

모든 velero 배포 서버 인수에 대한 지원 추가

이전 릴리스에서 OADP는 모든 업스트림 Velero 서버 인수를 지원하지 않았습니다. 이 문제는 OADP 1.1.4에서 해결되었으며 모든 업스트림 Velero 서버 인수가 지원됩니다. OADP-1557

복원 이름과 pvc 이름에 두 개 이상의 VSR이 있는 경우 데이터 Mover가 잘못된 스냅샷에서 복원할 수 있습니다.

이전 릴리스에서는 동일한 Velero 복원 이름 및 영구 볼륨 클레임(pvc) 이름에 대해 클러스터에 VSR( Volume Snapshot Restore) 리소스가 두 개 이상 있는 경우 OADP Data Mover가 잘못된 스냅샷에서 복원할 수 있었습니다. OADP-1822

Cloud Storage API BSL에 OwnerReference 필요

이전 릴리스에서 ACM BackupSchedules는 dpa.spec.backupLocations.bucket 으로 생성된 백업 스토리지 위치(BSL)에서 누락된 OwnerReference 로 인해 검증에 실패했습니다. OADP-1511

이 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.1.4 해결 문제 목록을 참조하십시오.

4.2.8.3. 확인된 문제

이 릴리스에는 다음과 같은 알려진 문제가 있습니다.

클러스터에서 UID/GID 범위가 변경될 수 있으므로 OADP 백업이 실패할 수 있습니다.

OADP 백업은 애플리케이션이 복원된 클러스터에서 UID/GID 범위가 변경될 수 있기 때문에 실패할 수 있으며, OADP가 OpenShift Container Platform UID/GID 범위 메타데이터를 백업하지 않고 복원하지 않습니다. 문제를 방지하려면 백업 애플리케이션에 특정 UUID가 필요한 경우 복원 시 범위를 사용할 수 있는지 확인하십시오. 추가 해결 방법은 OADP가 복원 작업에 네임스페이스를 생성하도록 허용하는 것입니다.

ArgoCD에서 사용하는 레이블로 인해 프로세스 중에 ArgoCD를 사용하는 경우 복원이 실패할 수 있습니다.

ArgoCD, app.kubernetes.io/instance 에서 사용하는 레이블로 인해 프로세스 중에 ArgoCD를 사용하는 경우 복원이 실패할 수 있습니다. 이 레이블은 ArgoCD를 관리해야 하는 리소스를 식별하여 복원 시 리소스를 관리하는 OADP 절차와 충돌을 생성할 수 있습니다. 이 문제를 해결하려면 ArgoCD YAML에서 .spec.resource>-<ingMethod 를 annotation+label 또는 주석 으로 설정합니다. 문제가 계속되면 복원을 시작하기 전에 ArgoCD를 비활성화하고 복원이 완료되면 다시 활성화합니다.

OADP Velero 플러그인 반환 "Received EOF, stop recv loop" 메시지

Velero 플러그인은 별도의 프로세스로 시작됩니다. Velero 작업이 완료되면 해당 작업이 성공적으로 종료됩니다. 따라서 디버그 로그에서 recv 루프 메시지를 중지하는 EOF가 수신되면 오류가 발생하지 않습니다. 이 메시지는 플러그인 작업이 완료되었음을 나타냅니다. OADP-2176

이 릴리스에서 알려진 모든 문제의 전체 목록은 Jira의 OADP 1.1.4 알려진 문제 목록을 참조하십시오.

4.2.9. OADP 1.1.3 릴리스 노트

OADP 1.1.3 릴리스 노트에는 새로운 기능, 해결된 문제 및 버그, 알려진 문제가 나열되어 있습니다.

4.2.9.1. 새로운 기능

이 버전의 OADP는 서비스 릴리스입니다. 이 버전에는 새로운 기능이 추가되지 않습니다.

4.2.9.2. 해결된 문제

이 릴리스에서 해결된 모든 문제의 전체 목록은 Jira의 OADP 1.1.3 해결 문제 목록을 참조하십시오.

4.2.9.3. 확인된 문제

이 릴리스에서 알려진 모든 문제의 전체 목록은 Jira의 OADP 1.1.3 알려진 문제 목록을 참조하십시오.

4.2.10. OADP 1.1.2 릴리스 노트

OADP 1.1.2 릴리스 노트에는 제품 권장 사항, 수정된 버그 목록 및 알려진 문제에 대한 설명이 포함되어 있습니다.

4.2.10.1. 제품 권장 사항

VolSync

IKEvSync 0.5.1에서 dess stable 채널에서 사용 가능한 최신 버전으로 업그레이드를 준비하려면 다음 명령을 실행하여 openshift-adp 네임스페이스에 이 주석을 추가해야 합니다.

$ oc annotate --overwrite namespace/openshift-adp volsync.backube/privileged-movers='true'

Velero

이번 릴리스에서는 Velero가 버전 1.9.2에서 버전 1.9.5 로 업그레이드되었습니다.

Restic

이번 릴리스에서는 Restic이 버전 0.13.1에서 버전 0.14.0 으로 업그레이드되었습니다.

4.2.10.2. 해결된 문제

이번 릴리스에서는 다음 문제가 해결되었습니다.

4.2.10.3. 확인된 문제

이 릴리스에는 다음과 같은 알려진 문제가 있습니다.

4.2.11. OADP 1.1.1 릴리스 노트

OADP 1.1.1 릴리스 노트에는 제품 권장 사항 및 알려진 문제에 대한 설명이 포함되어 있습니다.

4.2.11.1. 제품 권장 사항

OADP 1.1.1를 설치하기 전에ECDHESync 0.5.1을 설치하거나 업그레이드 하는 것이 좋습니다.

4.2.11.2. 확인된 문제

이 릴리스에는 다음과 같은 알려진 문제가 있습니다.

여러 HTTP/2가 활성화된 웹 서버는 DDoS 공격(Rapid Reset Attack)에 취약합니다.

요청 취소가 여러 스트림을 빠르게 재설정할 수 있으므로 HTTP/2 프로토콜은 서비스 거부 공격에 취약합니다. 서버는 스트림을 설정하고 해체해야 하지만 연결당 최대 활성 스트림 수에 대한 서버 측 제한에 도달하지 않아야 합니다. 이로 인해 서버 리소스 사용량으로 인해 서비스 거부가 발생합니다. 이 CVE와 관련된 모든 OADP 문제 목록은 다음 Jira 목록을 참조하십시오.

이 문제를 해결하려면 OADP 1.1.7 또는 1.2.3으로 업그레이드하는 것이 좋습니다.

자세한 내용은 CVE-2023-39325 (Rapid Reset Attack) 를 참조하십시오.

- OADP는 현재 Velero의 restic (OADP-778)을 사용하여 AWS EFS 볼륨의 백업 및 복원을 지원하지 않습니다.

PVC당

VolumeSnapshotContent스냅샷의 Ceph 제한으로 인해 CSI 백업이 실패할 수 있습니다.동일한 PVC(영구 볼륨 클레임)의 스냅샷을 여러 개 생성할 수 있지만 스냅샷의 주기적 생성은 예약할 수 없습니다.

4.3. OADP 기능 및 플러그인

OADP(OpenShift API for Data Protection) 기능은 애플리케이션 백업 및 복원 옵션을 제공합니다.

기본 플러그인을 사용하면 Velero가 특정 클라우드 공급자와 통합하고 OpenShift Container Platform 리소스를 백업 및 복원할 수 있습니다.

4.3.1. OADP 기능

OADP(OpenShift API for Data Protection)는 다음과 같은 기능을 지원합니다.

- Backup

OADP를 사용하여 OpenShift Platform의 모든 애플리케이션을 백업하거나 유형, 네임스페이스 또는 레이블별로 리소스를 필터링할 수 있습니다.

OADP는 Kubernetes 오브젝트 및 내부 이미지를 오브젝트 스토리지의 아카이브 파일로 저장하여 백업합니다. OADP는 네이티브 클라우드 스냅샷 API 또는 CSI(Container Storage Interface)를 사용하여 스냅샷을 생성하여 PV(영구 볼륨)를 백업합니다. 스냅샷을 지원하지 않는 클라우드 공급자의 경우 OADP는 Restic을 사용하여 리소스 및 PV 데이터를 백업합니다.

참고백업 및 복원에 성공하려면 애플리케이션의 백업에서 Operator를 제외해야 합니다.

- Restore

백업에서 리소스 및 PV를 복원할 수 있습니다. 백업의 모든 오브젝트를 복원하거나 네임스페이스, PV 또는 라벨별로 오브젝트를 필터링할 수 있습니다.

참고백업 및 복원에 성공하려면 애플리케이션의 백업에서 Operator를 제외해야 합니다.

- 스케줄

- 지정된 간격으로 백업을 예약할 수 있습니다.

- 후크

-

후크를 사용하여 Pod의 컨테이너에서 명령을 실행할 수 있습니다(예:

fsfreeze) 파일 시스템을 정지합니다. 백업 또는 복원 전후에 실행되도록 후크를 구성할 수 있습니다. 복구 후크는 init 컨테이너 또는 애플리케이션 컨테이너에서 실행될 수 있습니다.

4.3.2. OADP 플러그인

OADP(OpenShift API for Data Protection)는 백업 및 스냅샷 작업을 지원하기 위해 스토리지 공급자와 통합된 기본 Velero 플러그인을 제공합니다. Velero 플러그인을 기반으로 사용자 지정 플러그인 을 생성할 수 있습니다.

OADP는 OpenShift Container Platform 리소스 백업, OpenShift Virtualization 리소스 백업 및 CSI(Container Storage Interface) 스냅샷에 대한 플러그인도 제공합니다.

표 4.1. OADP 플러그인

| OADP 플러그인 | 함수 | 스토리지 위치 |

|---|---|---|

|

| Kubernetes 오브젝트를 백업하고 복원합니다. | AWS S3 |

| 스냅샷을 사용하여 볼륨을 백업하고 복원합니다. | AWS EBS | |

|

| Kubernetes 오브젝트를 백업하고 복원합니다. | Microsoft Azure Blob 스토리지 |

| 스냅샷을 사용하여 볼륨을 백업하고 복원합니다. | Microsoft Azure 관리 디스크 | |

|

| Kubernetes 오브젝트를 백업하고 복원합니다. | Google Cloud Storage |

| 스냅샷을 사용하여 볼륨을 백업하고 복원합니다. | Google Compute Engine Disks | |

|

| OpenShift Container Platform 리소스를 백업하고 복원합니다. [1] | 오브젝트 저장소 |

|

| OpenShift Virtualization 리소스를 백업하고 복원합니다. [2] | 오브젝트 저장소 |

|

| CSI 스냅샷을 사용하여 볼륨을 백업 및 복원합니다. [3] | CSI 스냅샷을 지원하는 클라우드 스토리지 |

- 필수 항목입니다.

- 가상 머신 디스크는 CSI 스냅샷 또는 Restic으로 백업됩니다.

-

csi플러그인은 Velero CSI 베타 스냅샷 API 를 사용합니다.

4.3.3. OADP Velero 플러그인 정보

Velero를 설치할 때 다음 두 가지 유형의 플러그인을 구성할 수 있습니다.

- 기본 클라우드 공급자 플러그인

- 사용자 정의 플러그인

두 가지 유형의 플러그인은 모두 선택 사항이지만 대부분의 사용자는 하나 이상의 클라우드 공급자 플러그인을 구성합니다.

4.3.3.1. 기본 Velero 클라우드 공급자 플러그인

배포 중에 oadp_v1alpha1_dpa.yaml 파일을 구성할 때 다음과 같은 기본 Velero 클라우드 공급자 플러그인을 설치할 수 있습니다.

-

AWS(Amazon Web Services) -

GCP(Google Cloud Platform) -

azure(Microsoft Azure) -

OpenShift(OpenShift Velero 플러그인) -

CSI(컨테이너 스토리지 인터페이스) -

KubeVirt(KubeVirt)

배포 중에 oadp_v1alpha1_dpa.yaml 파일에 원하는 기본 플러그인을 지정합니다.

예제 파일

다음 .yaml 파일은 openshift,aws,azure, gcp 플러그인을 설치합니다.

apiVersion: oadp.openshift.io/v1alpha1

kind: DataProtectionApplication

metadata:

name: dpa-sample

spec:

configuration:

velero:

defaultPlugins:

- openshift

- aws

- azure

- gcp4.3.3.2. 사용자 정의 Velero 플러그인

배포 중에 oadp_v1alpha1_dpa.yaml 파일을 구성할 때 플러그인 이미지 및 이름을 지정하여 사용자 정의 Velero 플러그인을 설치할 수 있습니다.

배포 중에 oadp_v1alpha1_dpa.yaml 파일에 원하는 사용자 지정 플러그인을 지정합니다.

예제 파일

다음 .yaml 파일은 기본 openshift,azure, gcp 플러그인 및 이름이 custom-plugin-example 이고 quay.io/example-repo/custom-velero-plugin 이미지가 있는 사용자 정의 플러그인을 설치합니다.

apiVersion: oadp.openshift.io/v1alpha1

kind: DataProtectionApplication

metadata:

name: dpa-sample

spec:

configuration:

velero:

defaultPlugins:

- openshift

- azure

- gcp

customPlugins:

- name: custom-plugin-example

image: quay.io/example-repo/custom-velero-plugin4.3.3.3. Velero 플러그인에서 "received EOF, stop recv loop" 메시지를 반환

Velero 플러그인은 별도의 프로세스로 시작됩니다. Velero 작업이 성공적으로 완료되거나 실패하면 종료됩니다. 디버그 로그에서 recv 루프 메시지를 중지하여 수신된 EOF 를 수신하면 플러그인 작업이 완료되었음을 나타냅니다. 이는 오류가 발생했음을 의미하지 않습니다.

4.3.4. OADP에서 지원되는 아키텍처

OADP(OpenShift API for Data Protection)는 다음과 같은 아키텍처를 지원합니다.

- AMD64

- ARM64

- PPC64le

- s390x

OADP 1.2.0 이상 버전은 ARM64 아키텍처를 지원합니다.

4.3.5. IBM Power 및 IBM Z에 대한 OADP 지원

OADP(OpenShift API for Data Protection)는 플랫폼 중립적입니다. 다음 정보는 IBM Power 및 IBM Z에 대해서만 관련이 있습니다.

OADP 1.1.0은 IBM Power 및 IBM Z의 OpenShift Container Platform 4.11에 대해 성공적으로 테스트되었습니다. 다음 섹션에서는 이러한 시스템의 백업 위치 측면에서 OADP 1.1.0에 대한 테스트 및 지원 정보를 제공합니다.

4.3.5.1. IBM Power를 사용하여 대상 백업 위치에 대한 OADP 지원

OpenShift Container Platform 4.11 및 4.12에서 실행되는 IBM Power와 OADP(OpenShift API for Data Protection) 1.1.2가 AWS S3 백업 위치 대상에 대해 성공적으로 테스트되었습니다. 이 테스트는 AWS S3 대상만 포함되었지만 Red Hat은 AWS가 아닌 모든 S3 백업 위치 대상에 대해 OpenShift Container Platform 4.11 및 OADP 1.1.2를 사용하여 IBM Power를 실행할 수 있도록 지원합니다.

4.3.5.2. IBM Z를 사용하여 대상 백업 위치에 대한 OADP 테스트 및 지원

OpenShift Container Platform 4.11 및 4.12에서 실행되는 IBM Z와 OADP(OpenShift API for Data Protection) 1.1.2가 AWS S3 백업 위치 대상에 대해 성공적으로 테스트되었습니다. 이 테스트는 AWS S3 대상만 포함되었지만 Red Hat은 AWS가 아닌 모든 S3 백업 위치 대상에 대해 OpenShift Container Platform 4.11 및 OADP 1.1.2를 사용하여 IBM Z를 실행할 수 있도록 지원합니다.

4.4. OADP 설치 및 구성

4.4.1. OADP 설치 정보

클러스터 관리자는 OADP Operator를 설치하여 데이터 보호(OADP)를 OpenShift API를 설치합니다. OADP Operator는 Velero 1.11 을 설치합니다.

OADP 1.0.4부터 모든 OADP 1.0.z 버전은 MTC Operator의 종속성으로만 사용할 수 있으며 독립 실행형 Operator로 사용할 수 없습니다.

Kubernetes 리소스 및 내부 이미지를 백업하려면 다음 스토리지 유형 중 하나와 같은 백업 위치로 오브젝트 스토리지가 있어야 합니다.

- Amazon Web Services

- Microsoft Azure

- Google Cloud Platform

- Multicloud Object Gateway

- AWS S3 호환 오브젝트 스토리지(예: Multicloud Object Gateway 또는 MinIO)

달리 지정하지 않는 한 "NooBa"는 경량 오브젝트 스토리지를 제공하는 오픈 소스 프로젝트를 나타내며 "MCG(Multicloud Object Gateway)는 NooBaa의 Red Hat 배포를 나타냅니다.

MCG에 대한 자세한 내용은 애플리케이션을 사용하여 Multicloud Object Gateway 액세스를 참조하십시오.

오브젝트 스토리지를 위한 버킷 생성을 자동화하는 CloudStorage API는 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 기술 프리뷰 기능 지원 범위를 참조하십시오.

스냅샷 또는 Restic을 사용하여 PV(영구 볼륨)를 백업할 수 있습니다.

스냅샷으로 PV를 백업하려면 다음 클라우드 공급자 중 하나와 같은 네이티브 스냅샷 API 또는 CSI(Container Storage Interface) 스냅샷을 지원하는 클라우드 공급자가 있어야 합니다.

- Amazon Web Services

- Microsoft Azure

- Google Cloud Platform

- OpenShift Data Foundation과 같은 CSI 스냅샷 지원 클라우드 공급자

OCP 4.11 이상에서 CSI 백업을 사용하려면 OADP 1.1.x 를 설치하십시오.

OADP 1.0.x 는 OCP 4.11 이상에서 CSI 백업을 지원하지 않습니다. OADP 1.0.x 에는 Velero 1.7이 포함되어 있으며 OCP 4.11 이상에는 존재하지 않는 API 그룹 snapshot.storage.k8s.io/v1beta1 이 예상됩니다.

클라우드 공급자가 스냅샷을 지원하지 않거나 스토리지가 NFS인 경우 오브젝트 스토리지에서 Restic 백업을 사용하여 애플리케이션을 백업할 수 있습니다.

기본 보안을 생성한 다음 데이터 보호 애플리케이션을 설치합니다.

4.4.1.1. AWS S3 호환 백업 스토리지 공급자

OADP는 다양한 백업 및 스냅샷 작업에 사용하기 위해 많은 오브젝트 스토리지 공급자와 호환됩니다. 여러 오브젝트 스토리지 공급자가 완전히 지원되며, 일부 오브젝트 스토리지 공급자는 지원되지만 작동하지 않으며 일부에는 알려진 제한 사항이 있습니다.

4.4.1.1.1. 지원되는 백업 스토리지 공급자

다음 AWS S3 호환 오브젝트 스토리지 공급자는 AWS 플러그인을 통해 백업 스토리지 위치로 사용하기 위해 OADP에서 완전히 지원합니다.

- MinIO

- MCG(Multicloud Object Gateway)

- AWS(Amazon Web Services) S3

다음과 같은 호환 오브젝트 스토리지 공급자가 지원되며 자체 Velero 오브젝트 저장소 플러그인이 있습니다.

- GCP(Google Cloud Platform)

- Microsoft Azure

4.4.1.1.2. 지원되지 않는 백업 스토리지 공급자

다음 AWS S3 호환 오브젝트 스토리지 공급자는 백업 스토리지 위치로 사용하기 위해 AWS 플러그인을 통해 Velero와 함께 작업하는 것으로 알려져 있지만 이는 지원되지 않으며 Red Hat에서 테스트하지 않았습니다.

- IBM Cloud

- Oracle Cloud

- DigitalOcean

- MCG(Multicloud Object Gateway)를 사용하여 설치하지 않는 한 NooBaa

- Tencent Cloud

- Ceph RADOS v12.2.7

- Quobyte

- Cloudian HyperStore

달리 지정하지 않는 한 "NooBa"는 경량 오브젝트 스토리지를 제공하는 오픈 소스 프로젝트를 나타내며 "MCG(Multicloud Object Gateway)는 NooBaa의 Red Hat 배포를 나타냅니다.

MCG에 대한 자세한 내용은 애플리케이션을 사용하여 Multicloud Object Gateway 액세스를 참조하십시오.

4.4.1.1.3. 알려진 제한이 있는 백업 스토리지 공급자

다음 AWS S3 호환 오브젝트 스토리지 공급자는 제한된 기능 세트로 AWS 플러그인을 통해 Velero와 함께 작동하는 것으로 알려져 있습니다.

- Swift - 백업 스토리지의 백업 스토리지 위치로 사용하기 위해 작동하지만 파일 시스템 기반 볼륨 백업 및 복원에는 Restic과 호환되지 않습니다.

4.4.1.2. OpenShift Data Foundation에서 재해 복구를 위해 MCG(Multicloud Object Gateway) 구성

OpenShift Data Foundation에서 MCG 버킷 backupStorageLocation 에 클러스터 스토리지를 사용하는 경우 MCG를 외부 오브젝트 저장소로 구성합니다.

MCG를 외부 오브젝트 저장소로 구성하지 않으면 백업을 사용할 수 없게 될 수 있습니다.

달리 지정하지 않는 한 "NooBa"는 경량 오브젝트 스토리지를 제공하는 오픈 소스 프로젝트를 나타내며 "MCG(Multicloud Object Gateway)는 NooBaa의 Red Hat 배포를 나타냅니다.

MCG에 대한 자세한 내용은 애플리케이션을 사용하여 Multicloud Object Gateway 액세스를 참조하십시오.

절차

- 하이브리드 또는 Multicloud용 스토리지 리소스 추가 에 설명된 대로 MCG를 외부 오브젝트 저장소로 구성합니다.

추가 리소스

4.4.1.3. OADP 업데이트 채널 정보

OADP Operator를 설치할 때 업데이트 채널을 선택합니다. 이 채널은 OADP Operator 및 수신하는 Velero에 대한 업그레이드를 결정합니다. 언제든지 채널을 변경할 수 있습니다.

다음 업데이트 채널을 사용할 수 있습니다.

-

stable 채널이 더 이상 사용되지 않습니다. stable 채널에는

oadp.v1.1.z및oadp.v1.0.z의 이전 버전에 대한 OADPClusterServiceVersion의 패치 (z-stream 업데이트)가 포함되어 있습니다. -

stable-1.0 채널에는 최신 OADP 1.0

ClusterServiceVersion인oadp.v1.0.z가 포함되어 있습니다. -

stable-1.1 채널에는 최신 OADP 1.1

ClusterServiceVersion인oadp.v1.1.z가 포함되어 있습니다. -

stable-1.2 채널에는 최신 OADP 1.2

ClusterServiceVersion인oadp.v1.2.z가 포함되어 있습니다. -

stable-1.3 채널에는 최신 OADP 1.3

ClusterServiceVersion인oadp.v1.3.z가 포함되어 있습니다.

어떤 업데이트 채널을 사용할 수 있습니까?

-

stable 채널이 더 이상 사용되지 않습니다. 이미 stable 채널을 사용하고 있는 경우

oadp.v1.1.z.에서 업데이트를 계속 받을 수 있습니다. - stable-1.y 업데이트 채널을 선택하여 OADP 1.y 를 설치하고 계속 패치를 수신합니다. 이 채널을 선택하면 버전 1에 대한 모든 z-stream 패치가 제공됩니다.y.z.

언제 업데이트 채널을 전환해야합니까?

- OADP 1.y 가 설치되어 있고 해당 y-stream에 대한 패치만 받으려면 stable 업데이트 채널에서 stable-1 로 전환해야 합니다. 그런 다음 버전 1.y. z에 대한 모든z -stream 패치가 제공됩니다.

- OADP 1.0이 설치되어 있고 OADP 1.1로 업그레이드하려는 경우 패치는 stable-1.0 업데이트 채널에서 stable-1.1 업데이트 채널로 전환해야 합니다. 그런 다음 버전 1.1.z 에 대한 모든 z-stream 패치가 제공됩니다.

- OADP 1. y 가 0보다 크게 설치되어 있고 OADP 1.0으로 전환하려는 경우 OADP Operator를 제거한 다음 stable-1.0 업데이트 채널을 사용하여 다시 설치해야 합니다. 그러면 버전 1.0.z 에 대한 모든 z-stream 패치가 제공됩니다.

업데이트 채널을 전환하여 OADP 1.y 에서 OADP 1.0으로 전환할 수 없습니다. Operator를 제거한 다음 다시 설치해야 합니다.

4.4.1.4. 여러 네임스페이스에 OADP 설치

OADP를 동일한 클러스터의 여러 네임스페이스에 설치할 수 있으므로 여러 프로젝트 소유자가 자체 OADP 인스턴스를 관리할 수 있습니다. 이 사용 사례는 Restic 및 CSI에서 검증되었습니다.

다음 추가 요구 사항을 사용하여 이 문서에 포함된 플랫폼별 절차에 따라 OADP의 각 인스턴스를 설치합니다.

- 동일한 클러스터에 있는 OADP의 모든 배포는 동일한 버전이어야 합니다(예: 1.1.4). 동일한 클러스터에 다른 버전의 OADP를 설치할 수 없습니다.

-

OADP의 각 개별 배포에는 고유한 자격 증명 세트와 고유한

BackupStorageLocation구성이 있어야 합니다. - 기본적으로 각 OADP 배포에는 네임스페이스에서 클러스터 수준 액세스 권한이 있습니다. OpenShift Container Platform 관리자는 보안 및 RBAC 설정을 주의 깊게 검토하고 각 OADP 인스턴스에 올바른 권한이 있는지 확인하기 위해 필요한 사항을 변경해야 합니다.

추가 리소스

4.4.1.5. 수집된 데이터를 기반으로 하는 Velero CPU 및 메모리 요구 사항

다음 권장 사항은 규모 및 성능 랩에서 수행된 성능 관찰을 기반으로 합니다. 백업 및 복원 리소스는 플러그인 유형, 해당 백업 또는 복원에 필요한 리소스 양, 해당 리소스와 관련된 PV(영구 볼륨)에 포함된 해당 데이터의 영향을 받을 수 있습니다.

4.4.1.5.1. 구성에 대한 CPU 및 메모리 요구 사항

| 구성 유형 | [1] 평균 사용량 | [2] 대규모 사용 | resourceTimeouts |

|---|---|---|---|

| CSI | Velero: cpu- 요청 200m, 제한 1000m memory - 256Mi 요청, 제한 1024Mi | Velero: CPU- 요청 200m, 제한 2000m memory- requests 256Mi, Limits 2048Mi | 해당 없음 |

| Restic | [3] Restic: CPU- 요청 1000m, 제한 2000m memory - 16Gi 요청, 32Gi 제한 | [4] Restic: CPU - 2000m 요청, 8000m 제한 Memory - 16Gi 요청, 제한 40Gi | 900m |

| [5] DataMover | 해당 없음 | 해당 없음 | 10m - 평균 사용량 60m - 대규모 사용 |

- 평균 사용량 - 대부분의 사용 상황에 대해 이러한 설정을 사용합니다.

- 대규모 사용 - 대규모 PV(500GB 사용), 다중 네임스페이스(100+) 또는 단일 네임스페이스(2000 pods+) 내의 여러 Pod 및 대규모 데이터 세트와 관련된 백업 및 복원을 위한 최적의 성능을 위해 이러한 설정을 사용합니다.

- Restic 리소스 사용량은 데이터 양 및 데이터 유형에 해당합니다. 예를 들어 많은 작은 파일 또는 대량의 데이터가 있으면 Restic이 대량의 리소스를 활용할 수 있습니다. Velero 문서는 500m을 제공된 기본값으로 참조합니다. 대부분의 테스트에서는 1000m 제한으로 적합한 200m 요청을 발견했습니다. Velero 문서에서 인용한 대로 정확한 CPU 및 메모리 사용은 환경 제한 외에도 파일 및 디렉터리의 크기에 따라 달라집니다.

- CPU를 늘리면 백업 및 복원 시간 개선에 큰 영향을 미칩니다.

- DataMover - DataMover 기본 리소스 제한 시간은 10m입니다. 테스트 결과 대규모 PV(500GB 사용량)를 복원하려면 resourceTimeout을 60m로 늘려야 합니다.

가이드 전체에 나열된 리소스 요구 사항은 평균 사용량 전용입니다. 큰 용도의 경우 위의 표에 설명된 대로 설정을 조정합니다.

4.4.1.5.2. 대규모 사용을 위한 nodeagent CPU

테스트 결과 NodeAgent CPU를 늘리면 OADP(OpenShift API for Data Protection)를 사용할 때 백업 및 복원 시간을 크게 향상시킬 수 있습니다.

Kopia의 적극적인 리소스 사용으로 인해 프로덕션 워크로드를 실행하는 노드의 프로덕션 환경에서 제한 없이 Kopia를 사용하지 않는 것이 좋습니다. 그러나 너무 낮은 제한으로 Kopia를 실행하면 CPU 제한 및 백업 속도가 느려지고 복원 상황이 발생합니다. 테스트 결과 20개 코어 및 32Gi 메모리가 있는 Kopia를 실행하면 100GB 이상의 데이터, 여러 네임스페이스 또는 2000개 이상의 Pod가 단일 네임스페이스에서 백업 및 복원 작업을 지원했습니다.

이러한 리소스 사양을 사용하여 CPU 제한 또는 메모리 포화 상태로 감지된 테스트입니다.

rook-ceph Pod에서 CPU 및 메모리 리소스 변경 절차에 따라 Ceph MDS Pod 에서 이러한 제한을 설정할 수 있습니다.

제한을 설정하려면 스토리지 클러스터 CR(사용자 정의 리소스)에 다음 행을 추가해야 합니다.

resources:

mds:

limits:

cpu: "3"

memory: 128Gi

requests:

cpu: "3"

memory: 8Gi4.4.2. OADP Operator 설치

OLM(Operator Lifecycle Manager)을 사용하여 OpenShift Container Platform 4.11에 OADP(OpenShift API for Data Protection) Operator를 설치할 수 있습니다.

OADP Operator는 Velero 1.11 을 설치합니다.

사전 요구 사항

-

cluster-admin권한이 있는 사용자로 로그인해야 합니다.

절차

- OpenShift Container Platform 웹 콘솔에서 Operator → OperatorHub를 클릭합니다.

- 키워드로 필터링 필드를 사용하여 OADP Operator 를 찾습니다.

- OADP Operator 를 선택하고 설치를 클릭합니다.

-

openshift-adp프로젝트에 Operator를 설치하려면 설치를 클릭합니다. - Operators → 설치된 Operators 를 클릭하여 설치를 확인합니다.

4.4.2.1. OADP-Velero-OpenShift Container Platform 버전 관계

4.4.3. Amazon Web Services를 사용하여 데이터 보호를 위한 OpenShift API 구성

OADP Operator를 설치하여 AWS(Amazon Web Services)와 함께 OADP(OpenShift API for Data Protection)를 설치합니다. Operator는 Velero 1.11 을 설치합니다.

OADP 1.0.4부터 모든 OADP 1.0.z 버전은 MTC Operator의 종속성으로만 사용할 수 있으며 독립 실행형 Operator로 사용할 수 없습니다.

Velero에 대한 AWS를 구성하고 기본 시크릿 을 생성한 다음 데이터 보호 애플리케이션을 설치합니다. 자세한 내용은 OADP Operator 설치를 참조하십시오.

제한된 네트워크 환경에 OADP Operator를 설치하려면 먼저 기본 OperatorHub 소스를 비활성화하고 Operator 카탈로그를 미러링해야 합니다. 자세한 내용은 제한된 네트워크에서 Operator Lifecycle Manager 사용을 참조하십시오.

4.4.3.1. Amazon Web Services 구성

OADP(OpenShift API for Data Protection)를 위해 AWS(Amazon Web Services)를 구성합니다.

사전 요구 사항

- AWS CLI 가 설치되어 있어야 합니다.

절차

BUCKET변수를 설정합니다.$ BUCKET=<your_bucket>

REGION변수를 설정합니다.$ REGION=<your_region>

AWS S3 버킷을 생성합니다.

$ aws s3api create-bucket \ --bucket $BUCKET \ --region $REGION \ --create-bucket-configuration LocationConstraint=$REGION 1- 1

us-east-1은LocationConstraint를 지원하지 않습니다. 리전이us-east-1인 경우--create-bucket-configuration LocationConstraint=$REGION을 생략합니다.

IAM 사용자를 생성합니다.

$ aws iam create-user --user-name velero 1- 1

- Velero를 사용하여 여러 S3 버킷이 있는 여러 클러스터를 백업하려면 각 클러스터에 대해 고유한 사용자 이름을 생성합니다.

velero-policy.json파일을 생성합니다.$ cat > velero-policy.json <<EOF { "Version": "2012-10-17", "Statement": [ { "Effect": "Allow", "Action": [ "ec2:DescribeVolumes", "ec2:DescribeSnapshots", "ec2:CreateTags", "ec2:CreateVolume", "ec2:CreateSnapshot", "ec2:DeleteSnapshot" ], "Resource": "*" }, { "Effect": "Allow", "Action": [ "s3:GetObject", "s3:DeleteObject", "s3:PutObject", "s3:AbortMultipartUpload", "s3:ListMultipartUploadParts" ], "Resource": [ "arn:aws:s3:::${BUCKET}/*" ] }, { "Effect": "Allow", "Action": [ "s3:ListBucket", "s3:GetBucketLocation", "s3:ListBucketMultipartUploads" ], "Resource": [ "arn:aws:s3:::${BUCKET}" ] } ] } EOF정책을 연결하여

velero사용자에게 필요한 최소 권한을 부여합니다.$ aws iam put-user-policy \ --user-name velero \ --policy-name velero \ --policy-document file://velero-policy.json

velero사용자에 대한 액세스 키를 생성합니다.$ aws iam create-access-key --user-name velero

출력 예

{ "AccessKey": { "UserName": "velero", "Status": "Active", "CreateDate": "2017-07-31T22:24:41.576Z", "SecretAccessKey": <AWS_SECRET_ACCESS_KEY>, "AccessKeyId": <AWS_ACCESS_KEY_ID> } }credentials-velero파일을 생성합니다.$ cat << EOF > ./credentials-velero [default] aws_access_key_id=<AWS_ACCESS_KEY_ID> aws_secret_access_key=<AWS_SECRET_ACCESS_KEY> EOF

Data Protection 애플리케이션을 설치하기 전에

credentials-velero파일을 사용하여 AWS용Secret오브젝트를 생성합니다.

4.4.3.2. 백업 및 스냅샷 위치 및 시크릿 정보

DataProtectionApplication CR(사용자 정의 리소스)에서 백업 및 스냅샷 위치와 해당 시크릿을 지정합니다.

백업 위치

Multicloud Object Gateway 또는 MinIO와 같은 S3 호환 오브젝트 스토리지를 백업 위치로 지정합니다.

Velero는 OpenShift Container Platform 리소스, Kubernetes 오브젝트 및 내부 이미지를 오브젝트 스토리지의 아카이브 파일로 백업합니다.

스냅샷 위치

클라우드 공급자의 네이티브 스냅샷 API를 사용하여 영구 볼륨을 백업하는 경우 클라우드 공급자를 스냅샷 위치로 지정해야 합니다.

CSI(Container Storage Interface) 스냅샷을 사용하는 경우 CSI 드라이버를 등록할 VolumeSnapshotClass CR을 생성하므로 스냅샷 위치를 지정할 필요가 없습니다.

Restic을 사용하는 경우 Restic이 오브젝트 스토리지의 파일 시스템을 백업하므로 스냅샷 위치를 지정할 필요가 없습니다.

보안

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 시크릿 을 생성합니다.

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 다음 두 개의 시크릿 오브젝트를 생성합니다.

-

DataProtectionApplicationCR에서 지정하는 백업 위치에 대한 사용자 지정시크릿입니다. -

DataProtectionApplicationCR에서 참조되지 않는 스냅샷 위치의 기본시크릿입니다.

데이터 보호 애플리케이션에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다.

설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 보안을 생성할 수 있습니다.

4.4.3.2.1. 기본 보안 생성

백업 및 스냅샷 위치에 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 보안을 생성합니다.

시크릿 의 기본 이름은 cloud-credentials 입니다.

DataProtectionApplication CR(사용자 정의 리소스)에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다. 백업 위치 Secret 의 이름이 지정되지 않은 경우 기본 이름이 사용됩니다.

설치 중에 백업 위치 인증 정보를 사용하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 이름으로 보안을 생성할 수 있습니다.

사전 요구 사항

- 오브젝트 스토리지 및 클라우드 스토리지(있는 경우)는 동일한 인증 정보를 사용해야 합니다.

- Velero의 오브젝트 스토리지를 구성해야 합니다.

-

적절한 형식으로 오브젝트 스토리지에 대한

credentials-velero파일을 생성해야 합니다.

절차

기본 이름으로 보안을 생성합니다.

$ oc create secret generic cloud-credentials -n openshift-adp --from-file cloud=credentials-velero

데이터 보호 애플리케이션을 설치할 때 DataProtectionApplication CR의 spec.backupLocations.credential 블록에서 시크릿 을 참조합니다.

4.4.3.2.2. 다양한 인증 정보에 대한 프로필 생성

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 credentials-velero 파일에 별도의 프로필을 생성합니다.

그런 다음 Secret 오브젝트를 생성하고 DataProtectionApplication CR(사용자 정의 리소스)에서 프로필을 지정합니다.

절차

다음 예와 같이 백업 및 스냅샷 위치에 대한 별도의 프로필을 사용하여

credentials-velero파일을 생성합니다.[backupStorage] aws_access_key_id=<AWS_ACCESS_KEY_ID> aws_secret_access_key=<AWS_SECRET_ACCESS_KEY> [volumeSnapshot] aws_access_key_id=<AWS_ACCESS_KEY_ID> aws_secret_access_key=<AWS_SECRET_ACCESS_KEY>

credentials-velero파일을 사용하여Secret오브젝트를 생성합니다.$ oc create secret generic cloud-credentials -n openshift-adp --from-file cloud=credentials-velero 1다음 예와 같이

DataProtectionApplicationCR에 프로필을 추가합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: ... backupLocations: - name: default velero: provider: aws default: true objectStorage: bucket: <bucket_name> prefix: <prefix> config: region: us-east-1 profile: "backupStorage" credential: key: cloud name: cloud-credentials snapshotLocations: - name: default velero: provider: aws config: region: us-west-2 profile: "volumeSnapshot"

4.4.3.3. 데이터 보호 애플리케이션 구성

Velero 리소스 할당을 설정하거나 자체 서명된 CA 인증서를 활성화하여 데이터 보호 애플리케이션을 구성할 수 있습니다.

4.4.3.3.1. Velero CPU 및 메모리 리소스 할당 설정

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 Velero Pod에 대한 CPU 및 메모리 리소스 할당을 설정합니다.

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR 매니페스트의spec.configuration.velero.podConfig.ResourceAllocations블록의 값을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... configuration: velero: podConfig: nodeSelector: <node selector> 1 resourceAllocations: 2 limits: cpu: "1" memory: 1024Mi requests: cpu: 200m memory: 256Mi

4.4.3.3.2. 자체 서명 CA 인증서 활성화

알 수 없는 기관에서 서명한 인증서를 방지하기 위해 활성화해야 합니다.

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 오브젝트 스토리지에 대해 자체 서명 CA 인증서를

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

DataProtectionApplicationCR 매니페스트의spec.backupLocations.velero.objectStorage.caCert매개변수 및spec.backupLocations.velero.config매개변수를 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... backupLocations: - name: default velero: provider: aws default: true objectStorage: bucket: <bucket> prefix: <prefix> caCert: <base64_encoded_cert_string> 1 config: insecureSkipTLSVerify: "false" 2 ...

4.4.3.4. 데이터 보호 애플리케이션 설치

DataProtectionApplication API 인스턴스를 생성하여 DPA( Data Protection Application )를 설치합니다.

사전 요구 사항

- OADP Operator를 설치해야 합니다.

- 오브젝트 스토리지를 백업 위치로 구성해야 합니다.

- 스냅샷을 사용하여 PV를 백업하는 경우 클라우드 공급자는 네이티브 스냅샷 API 또는 CSI(Container Storage Interface) 스냅샷을 지원해야 합니다.

-

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하는 경우 기본 이름

cloud-credentials로Secret을 생성해야 합니다. 백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 백업 및 스냅샷 위치 자격 증명에 대한 별도의 프로필이 포함된 기본 이름

cloud-credentials을 사용하여 보안을 생성해야 합니다.참고설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈

credentials-velero파일을사용하여기본 보안을 생성할 수 있습니다. 기본Secret이 없으면 설치에 실패합니다.참고Velero는 기본 백업 리포지토리 암호가 포함된 OADP 네임스페이스에

velero-repo-credentials라는 시크릿을 생성합니다. 백업 리포지토리를 대상으로 하는 첫 번째 백업을 실행하기 전에 base64로 인코딩된 고유한 암호로 시크릿을 업데이트할 수 있습니다. 업데이트할 키의 값은Data[repository-password]입니다.DPA를 생성한 후 백업 리포지토리를 대상으로 하는 백업을 처음 실행하면 Velero에서 시크릿이 기본 암호 또는 교체한 암호가 포함된

velero-repo-credentials인 백업 리포지토리를 생성합니다. 첫 번째 백업 후 시크릿 암호를 업데이트하면 새 암호가velero-repo-credentials의 암호와 일치하지 않으므로 Velero는 이전 백업과 연결할 수 없습니다.

절차

- Operators → 설치된 Operator 를 클릭하고 OADP Operator를 선택합니다.

- 제공된 API 아래에서 DataProtectionApplication 상자에서 인스턴스 생성을 클릭합니다.

YAML 보기를 클릭하고

DataProtectionApplication매니페스트의 매개변수를 업데이트합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: configuration: velero: defaultPlugins: - openshift 1 - aws resourceTimeout: 10m 2 restic: enable: true 3 podConfig: nodeSelector: <node_selector> 4 backupLocations: - name: default velero: provider: aws default: true objectStorage: bucket: <bucket_name> 5 prefix: <prefix> 6 config: region: <region> profile: "default" credential: key: cloud name: cloud-credentials 7 snapshotLocations: 8 - name: default velero: provider: aws config: region: <region> 9 profile: "default"- 1

openshift플러그인은 필수입니다.- 2

- Velero CRD 가용성, volumeSnapshot 삭제, 백업 리포지토리 가용성과 같이 시간 초과가 발생하기 전에 여러 Velero 리소스를 대기하는 분을 지정합니다. 기본값은 10m입니다.

- 3

- Restic 설치를 비활성화하려면 이 값을

false로 설정합니다. Restic은 데몬 세트를 배포합니다. 즉, Restic pod는 각 작업 노드에서 실행됩니다. OADP 버전 1.2 이상에서는BackupCR에spec.defaultVolumesToFsBackup: true를 추가하여 백업에 대해 Restic을 구성할 수 있습니다. OADP 버전 1.1에서BackupCR에spec.defaultVolumesToRestic: true를 추가합니다. - 4

- Restic을 사용할 수 있는 노드를 지정합니다. 기본적으로 Restic은 모든 노드에서 실행됩니다.

- 5

- 버킷을 백업 스토리지 위치로 지정합니다. 버킷이 Velero 백업의 전용 버킷이 아닌 경우 접두사를 지정해야 합니다.

- 6

- 버킷이 여러 목적으로 사용되는 경우 Velero 백업의 접두사(예:

velero)를 지정합니다. - 7

- 생성한

Secret오브젝트의 이름을 지정합니다. 이 값을 지정하지 않으면 기본 이름cloud-credentials가 사용됩니다. 사용자 지정 이름을 지정하면 백업 위치에 사용자 지정 이름이 사용됩니다. - 8

- CSI 스냅샷 또는 Restic을 사용하여 PV를 백업하지 않는 한 스냅샷 위치를 지정합니다.

- 9

- 스냅샷 위치는 PV와 동일한 리전에 있어야 합니다.

- 생성을 클릭합니다.

OADP 리소스를 확인하여 설치를 확인합니다.

$ oc get all -n openshift-adp

출력 예

NAME READY STATUS RESTARTS AGE pod/oadp-operator-controller-manager-67d9494d47-6l8z8 2/2 Running 0 2m8s pod/restic-9cq4q 1/1 Running 0 94s pod/restic-m4lts 1/1 Running 0 94s pod/restic-pv4kr 1/1 Running 0 95s pod/velero-588db7f655-n842v 1/1 Running 0 95s NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/oadp-operator-controller-manager-metrics-service ClusterIP 172.30.70.140 <none> 8443/TCP 2m8s NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE NODE SELECTOR AGE daemonset.apps/restic 3 3 3 3 3 <none> 96s NAME READY UP-TO-DATE AVAILABLE AGE deployment.apps/oadp-operator-controller-manager 1/1 1 1 2m9s deployment.apps/velero 1/1 1 1 96s NAME DESIRED CURRENT READY AGE replicaset.apps/oadp-operator-controller-manager-67d9494d47 1 1 1 2m9s replicaset.apps/velero-588db7f655 1 1 1 96s

4.4.3.4.1. DataProtectionApplication CR에서 CSI 활성화

CSI 스냅샷을 사용하여 영구 볼륨을 백업하기 위해 DataProtectionApplication CR(사용자 정의 리소스)에서 CSI(Container Storage Interface)를 활성화합니다.

사전 요구 사항

- 클라우드 공급자는 CSI 스냅샷을 지원해야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication ... spec: configuration: velero: defaultPlugins: - openshift - csi 1- 1

csi기본 플러그인을 추가합니다.

4.4.4. Microsoft Azure를 사용하여 데이터 보호를 위한 OpenShift API 구성

OADP Operator를 설치하여 Microsoft Azure와 함께 OADP(OpenShift API for Data Protection)를 설치합니다. Operator는 Velero 1.11 을 설치합니다.

OADP 1.0.4부터 모든 OADP 1.0.z 버전은 MTC Operator의 종속성으로만 사용할 수 있으며 독립 실행형 Operator로 사용할 수 없습니다.

Velero에 대한 Azure를 구성하고 기본 시크릿 을 생성한 다음 데이터 보호 애플리케이션을 설치합니다. 자세한 내용은 OADP Operator 설치를 참조하십시오.

제한된 네트워크 환경에 OADP Operator를 설치하려면 먼저 기본 OperatorHub 소스를 비활성화하고 Operator 카탈로그를 미러링해야 합니다. 자세한 내용은 제한된 네트워크에서 Operator Lifecycle Manager 사용을 참조하십시오.

4.4.4.1. Microsoft Azure 구성

OADP(OpenShift API for Data Protection)를 위해 Microsoft Azure를 구성합니다.

사전 요구 사항

- Azure CLI 가 설치되어 있어야 합니다.

절차

Azure에 로그인합니다.

$ az login

AZURE_RESOURCE_GROUP변수를 설정합니다.$ AZURE_RESOURCE_GROUP=Velero_Backups

Azure 리소스 그룹을 생성합니다.

$ az group create -n $AZURE_RESOURCE_GROUP --location CentralUS 1- 1

- 위치를 지정합니다.

AZURE_STORAGE_ACCOUNT_ID변수를 설정합니다.$ AZURE_STORAGE_ACCOUNT_ID="velero$(uuidgen | cut -d '-' -f5 | tr '[A-Z]' '[a-z]')"

Azure 스토리지 계정을 생성합니다.

$ az storage account create \ --name $AZURE_STORAGE_ACCOUNT_ID \ --resource-group $AZURE_RESOURCE_GROUP \ --sku Standard_GRS \ --encryption-services blob \ --https-only true \ --kind BlobStorage \ --access-tier HotBLOB_CONTAINER변수를 설정합니다.$ BLOB_CONTAINER=velero

Azure Blob 스토리지 컨테이너를 생성합니다.

$ az storage container create \ -n $BLOB_CONTAINER \ --public-access off \ --account-name $AZURE_STORAGE_ACCOUNT_ID

스토리지 계정 액세스 키를 가져옵니다.

$ AZURE_STORAGE_ACCOUNT_ACCESS_KEY=`az storage account keys list \ --account-name $AZURE_STORAGE_ACCOUNT_ID \ --query "[?keyName == 'key1'].value" -o tsv`

필요한 최소 권한이 있는 사용자 지정 역할을 생성합니다.

AZURE_ROLE=Velero az role definition create --role-definition '{ "Name": "'$AZURE_ROLE'", "Description": "Velero related permissions to perform backups, restores and deletions", "Actions": [ "Microsoft.Compute/disks/read", "Microsoft.Compute/disks/write", "Microsoft.Compute/disks/endGetAccess/action", "Microsoft.Compute/disks/beginGetAccess/action", "Microsoft.Compute/snapshots/read", "Microsoft.Compute/snapshots/write", "Microsoft.Compute/snapshots/delete", "Microsoft.Storage/storageAccounts/listkeys/action", "Microsoft.Storage/storageAccounts/regeneratekey/action" ], "AssignableScopes": ["/subscriptions/'$AZURE_SUBSCRIPTION_ID'"] }'credentials-velero파일을 생성합니다.$ cat << EOF > ./credentials-velero AZURE_SUBSCRIPTION_ID=${AZURE_SUBSCRIPTION_ID} AZURE_TENANT_ID=${AZURE_TENANT_ID} AZURE_CLIENT_ID=${AZURE_CLIENT_ID} AZURE_CLIENT_SECRET=${AZURE_CLIENT_SECRET} AZURE_RESOURCE_GROUP=${AZURE_RESOURCE_GROUP} AZURE_STORAGE_ACCOUNT_ACCESS_KEY=${AZURE_STORAGE_ACCOUNT_ACCESS_KEY} 1 AZURE_CLOUD_NAME=AzurePublicCloud EOF- 1

- 필수 항목입니다.

credentials-velero파일에 서비스 주체 자격 증명만 포함된 경우 내부 이미지를 백업할 수 없습니다.

credentials-velero파일을 사용하여 데이터 보호 애플리케이션을 설치하기 전에 Azure용Secret오브젝트를 생성합니다.

4.4.4.2. 백업 및 스냅샷 위치 및 시크릿 정보

DataProtectionApplication CR(사용자 정의 리소스)에서 백업 및 스냅샷 위치와 해당 시크릿을 지정합니다.

백업 위치

Multicloud Object Gateway 또는 MinIO와 같은 S3 호환 오브젝트 스토리지를 백업 위치로 지정합니다.

Velero는 OpenShift Container Platform 리소스, Kubernetes 오브젝트 및 내부 이미지를 오브젝트 스토리지의 아카이브 파일로 백업합니다.

스냅샷 위치

클라우드 공급자의 네이티브 스냅샷 API를 사용하여 영구 볼륨을 백업하는 경우 클라우드 공급자를 스냅샷 위치로 지정해야 합니다.

CSI(Container Storage Interface) 스냅샷을 사용하는 경우 CSI 드라이버를 등록할 VolumeSnapshotClass CR을 생성하므로 스냅샷 위치를 지정할 필요가 없습니다.

Restic을 사용하는 경우 Restic이 오브젝트 스토리지의 파일 시스템을 백업하므로 스냅샷 위치를 지정할 필요가 없습니다.

보안

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 시크릿 을 생성합니다.

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 다음 두 개의 시크릿 오브젝트를 생성합니다.

-

DataProtectionApplicationCR에서 지정하는 백업 위치에 대한 사용자 지정시크릿입니다. -

DataProtectionApplicationCR에서 참조되지 않는 스냅샷 위치의 기본시크릿입니다.

데이터 보호 애플리케이션에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다.

설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 보안을 생성할 수 있습니다.

4.4.4.2.1. 기본 보안 생성

백업 및 스냅샷 위치에 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 보안을 생성합니다.

시크릿 의 기본 이름은 cloud-credentials-azure 입니다.

DataProtectionApplication CR(사용자 정의 리소스)에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다. 백업 위치 Secret 의 이름이 지정되지 않은 경우 기본 이름이 사용됩니다.

설치 중에 백업 위치 인증 정보를 사용하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 이름으로 보안을 생성할 수 있습니다.

사전 요구 사항

- 오브젝트 스토리지 및 클라우드 스토리지(있는 경우)는 동일한 인증 정보를 사용해야 합니다.

- Velero의 오브젝트 스토리지를 구성해야 합니다.

-

적절한 형식으로 오브젝트 스토리지에 대한

credentials-velero파일을 생성해야 합니다.

절차

기본 이름으로 보안을 생성합니다.

$ oc create secret generic cloud-credentials-azure -n openshift-adp --from-file cloud=credentials-velero

데이터 보호 애플리케이션을 설치할 때 DataProtectionApplication CR의 spec.backupLocations.credential 블록에서 시크릿 을 참조합니다.

4.4.4.2.2. 다른 인증 정보에 대한 보안 생성

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 두 개의 Secret 오브젝트를 생성해야 합니다.

-

사용자 지정 이름이 있는 백업 위치

시크릿. 사용자 지정 이름은DataProtectionApplicationCR(사용자 정의 리소스)의spec.backupLocations블록에 지정됩니다. -

기본 이름이

cloud-credentials-azure인 스냅샷 위치시크릿. 이보안은DataProtectionApplicationCR에 지정되지 않습니다.

절차

-

클라우드 공급자에 대한 적절한 형식으로 스냅샷 위치에 대한

credentials-velero파일을 만듭니다. 기본 이름을 사용하여 스냅샷 위치에 대한 보안을 생성합니다.

$ oc create secret generic cloud-credentials-azure -n openshift-adp --from-file cloud=credentials-velero

-

오브젝트 스토리지에 적합한 형식으로 백업 위치에 대한

credentials-velero파일을 생성합니다. 사용자 지정 이름을 사용하여 백업 위치에 대한 보안을 생성합니다.

$ oc create secret generic <custom_secret> -n openshift-adp --from-file cloud=credentials-velero

다음

예와 같이 사용자 지정 이름으로 보안을DataProtectionApplicationCR에 추가합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: ... backupLocations: - velero: config: resourceGroup: <azure_resource_group> storageAccount: <azure_storage_account_id> subscriptionId: <azure_subscription_id> storageAccountKeyEnvVar: AZURE_STORAGE_ACCOUNT_ACCESS_KEY credential: key: cloud name: <custom_secret> 1 provider: azure default: true objectStorage: bucket: <bucket_name> prefix: <prefix> snapshotLocations: - velero: config: resourceGroup: <azure_resource_group> subscriptionId: <azure_subscription_id> incremental: "true" name: default provider: azure- 1

- 사용자 지정 이름이 있는 백업 위치

시크릿.

4.4.4.3. 데이터 보호 애플리케이션 구성

Velero 리소스 할당을 설정하거나 자체 서명된 CA 인증서를 활성화하여 데이터 보호 애플리케이션을 구성할 수 있습니다.

4.4.4.3.1. Velero CPU 및 메모리 리소스 할당 설정

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 Velero Pod에 대한 CPU 및 메모리 리소스 할당을 설정합니다.

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR 매니페스트의spec.configuration.velero.podConfig.ResourceAllocations블록의 값을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... configuration: velero: podConfig: nodeSelector: <node selector> 1 resourceAllocations: 2 limits: cpu: "1" memory: 1024Mi requests: cpu: 200m memory: 256Mi

4.4.4.3.2. 자체 서명 CA 인증서 활성화

알 수 없는 기관에서 서명한 인증서를 방지하기 위해 활성화해야 합니다.

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 오브젝트 스토리지에 대해 자체 서명 CA 인증서를

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

DataProtectionApplicationCR 매니페스트의spec.backupLocations.velero.objectStorage.caCert매개변수 및spec.backupLocations.velero.config매개변수를 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... backupLocations: - name: default velero: provider: aws default: true objectStorage: bucket: <bucket> prefix: <prefix> caCert: <base64_encoded_cert_string> 1 config: insecureSkipTLSVerify: "false" 2 ...

4.4.4.4. 데이터 보호 애플리케이션 설치

DataProtectionApplication API 인스턴스를 생성하여 DPA( Data Protection Application )를 설치합니다.

사전 요구 사항

- OADP Operator를 설치해야 합니다.

- 오브젝트 스토리지를 백업 위치로 구성해야 합니다.

- 스냅샷을 사용하여 PV를 백업하는 경우 클라우드 공급자는 네이티브 스냅샷 API 또는 CSI(Container Storage Interface) 스냅샷을 지원해야 합니다.

-

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하는 경우 기본 이름

cloud-credentials-azure로 보안을 생성해야 합니다. 백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 다음 두 개의

시크릿을 생성해야 합니다.-

백업 위치에 대한 사용자 정의 이름이 있는

시크릿입니다. 이 보안을DataProtectionApplicationCR에 추가합니다. 스냅샷 위치의 기본 이름

cloud-credentials-azure를 사용하는시크릿입니다. 이보안은DataProtectionApplicationCR에서 참조되지 않습니다.참고설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈

credentials-velero파일을사용하여기본 보안을 생성할 수 있습니다. 기본Secret이 없으면 설치에 실패합니다.참고Velero는 기본 백업 리포지토리 암호가 포함된 OADP 네임스페이스에

velero-repo-credentials라는 시크릿을 생성합니다. 백업 리포지토리를 대상으로 하는 첫 번째 백업을 실행하기 전에 base64로 인코딩된 고유한 암호로 시크릿을 업데이트할 수 있습니다. 업데이트할 키의 값은Data[repository-password]입니다.DPA를 생성한 후 백업 리포지토리를 대상으로 하는 백업을 처음 실행하면 Velero에서 시크릿이 기본 암호 또는 교체한 암호가 포함된

velero-repo-credentials인 백업 리포지토리를 생성합니다. 첫 번째 백업 후 시크릿 암호를 업데이트하면 새 암호가velero-repo-credentials의 암호와 일치하지 않으므로 Velero는 이전 백업과 연결할 수 없습니다.

-

백업 위치에 대한 사용자 정의 이름이 있는

절차

- Operators → 설치된 Operator 를 클릭하고 OADP Operator를 선택합니다.

- 제공된 API 아래에서 DataProtectionApplication 상자에서 인스턴스 생성을 클릭합니다.

YAML 보기를 클릭하고

DataProtectionApplication매니페스트의 매개변수를 업데이트합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: configuration: velero: defaultPlugins: - azure - openshift 1 resourceTimeout: 10m 2 restic: enable: true 3 podConfig: nodeSelector: <node_selector> 4 backupLocations: - velero: config: resourceGroup: <azure_resource_group> 5 storageAccount: <azure_storage_account_id> 6 subscriptionId: <azure_subscription_id> 7 storageAccountKeyEnvVar: AZURE_STORAGE_ACCOUNT_ACCESS_KEY credential: key: cloud name: cloud-credentials-azure 8 provider: azure default: true objectStorage: bucket: <bucket_name> 9 prefix: <prefix> 10 snapshotLocations: 11 - velero: config: resourceGroup: <azure_resource_group> subscriptionId: <azure_subscription_id> incremental: "true" name: default provider: azure- 1

openshift플러그인은 필수입니다.- 2

- Velero CRD 가용성, volumeSnapshot 삭제, 백업 리포지토리 가용성과 같이 시간 초과가 발생하기 전에 여러 Velero 리소스를 대기하는 분을 지정합니다. 기본값은 10m입니다.

- 3

- Restic 설치를 비활성화하려면 이 값을

false로 설정합니다. Restic은 데몬 세트를 배포합니다. 즉, Restic pod는 각 작업 노드에서 실행됩니다. OADP 버전 1.2 이상에서는BackupCR에spec.defaultVolumesToFsBackup: true를 추가하여 백업에 대해 Restic을 구성할 수 있습니다. OADP 버전 1.1에서BackupCR에spec.defaultVolumesToRestic: true를 추가합니다. - 4

- Restic을 사용할 수 있는 노드를 지정합니다. 기본적으로 Restic은 모든 노드에서 실행됩니다.

- 5

- Azure 리소스 그룹을 지정합니다.

- 6

- Azure 스토리지 계정 ID를 지정합니다.

- 7

- Azure 서브스크립션 ID를 지정합니다.

- 8

- 이 값을 지정하지 않으면 기본 이름

cloud-credentials-azure이 사용됩니다. 사용자 지정 이름을 지정하면 백업 위치에 사용자 지정 이름이 사용됩니다. - 9

- 버킷을 백업 스토리지 위치로 지정합니다. 버킷이 Velero 백업의 전용 버킷이 아닌 경우 접두사를 지정해야 합니다.

- 10

- 버킷이 여러 목적으로 사용되는 경우 Velero 백업의 접두사(예:

velero)를 지정합니다. - 11

- PV를 백업하려면 CSI 스냅샷 또는 Restic을 사용하는 경우 스냅샷 위치를 지정할 필요가 없습니다.

- 생성을 클릭합니다.

OADP 리소스를 확인하여 설치를 확인합니다.

$ oc get all -n openshift-adp

출력 예

NAME READY STATUS RESTARTS AGE pod/oadp-operator-controller-manager-67d9494d47-6l8z8 2/2 Running 0 2m8s pod/restic-9cq4q 1/1 Running 0 94s pod/restic-m4lts 1/1 Running 0 94s pod/restic-pv4kr 1/1 Running 0 95s pod/velero-588db7f655-n842v 1/1 Running 0 95s NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/oadp-operator-controller-manager-metrics-service ClusterIP 172.30.70.140 <none> 8443/TCP 2m8s NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE NODE SELECTOR AGE daemonset.apps/restic 3 3 3 3 3 <none> 96s NAME READY UP-TO-DATE AVAILABLE AGE deployment.apps/oadp-operator-controller-manager 1/1 1 1 2m9s deployment.apps/velero 1/1 1 1 96s NAME DESIRED CURRENT READY AGE replicaset.apps/oadp-operator-controller-manager-67d9494d47 1 1 1 2m9s replicaset.apps/velero-588db7f655 1 1 1 96s

4.4.4.4.1. DataProtectionApplication CR에서 CSI 활성화

CSI 스냅샷을 사용하여 영구 볼륨을 백업하기 위해 DataProtectionApplication CR(사용자 정의 리소스)에서 CSI(Container Storage Interface)를 활성화합니다.

사전 요구 사항

- 클라우드 공급자는 CSI 스냅샷을 지원해야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication ... spec: configuration: velero: defaultPlugins: - openshift - csi 1- 1

csi기본 플러그인을 추가합니다.

4.4.5. Google Cloud Platform을 사용하여 데이터 보호를 위한 OpenShift API 구성

OADP Operator를 설치하여 GCP(Google Cloud Platform)를 사용하여 OADP(Data Protection)를 OpenShift API를 설치합니다. Operator는 Velero 1.11 을 설치합니다.

OADP 1.0.4부터 모든 OADP 1.0.z 버전은 MTC Operator의 종속성으로만 사용할 수 있으며 독립 실행형 Operator로 사용할 수 없습니다.

Velero에 대한 GCP를 구성하고 기본 시크릿 을 생성한 다음 데이터 보호 애플리케이션을 설치합니다. 자세한 내용은 OADP Operator 설치를 참조하십시오.

제한된 네트워크 환경에 OADP Operator를 설치하려면 먼저 기본 OperatorHub 소스를 비활성화하고 Operator 카탈로그를 미러링해야 합니다. 자세한 내용은 제한된 네트워크에서 Operator Lifecycle Manager 사용을 참조하십시오.

4.4.5.1. GCP(Google Cloud Platform) 구성

OADP(Data Protection)를 위해 OpenShift API를 위해 GCP(Google Cloud Platform)를 구성합니다.

사전 요구 사항

-

gcloud및gsutilCLI 툴이 설치되어 있어야 합니다. 자세한 내용은 Google 클라우드 설명서를 참조하십시오.

절차

GCP에 로그인합니다.

$ gcloud auth login

BUCKET변수를 설정합니다.$ BUCKET=<bucket> 1- 1

- 버킷 이름을 지정합니다.

스토리지 버킷을 생성합니다.

$ gsutil mb gs://$BUCKET/

PROJECT_ID변수를 활성 프로젝트로 설정합니다.$ PROJECT_ID=$(gcloud config get-value project)

서비스 계정을 생성합니다.

$ gcloud iam service-accounts create velero \ --display-name "Velero service account"서비스 계정을 나열합니다.

$ gcloud iam service-accounts list

email값과 일치하도록SERVICE_ACCOUNT_EMAIL변수를 설정합니다.$ SERVICE_ACCOUNT_EMAIL=$(gcloud iam service-accounts list \ --filter="displayName:Velero service account" \ --format 'value(email)')정책을 연결하여

velero사용자에게 필요한 최소 권한을 부여합니다.$ ROLE_PERMISSIONS=( compute.disks.get compute.disks.create compute.disks.createSnapshot compute.snapshots.get compute.snapshots.create compute.snapshots.useReadOnly compute.snapshots.delete compute.zones.get storage.objects.create storage.objects.delete storage.objects.get storage.objects.list iam.serviceAccounts.signBlob )velero.server사용자 정의 역할을 생성합니다.$ gcloud iam roles create velero.server \ --project $PROJECT_ID \ --title "Velero Server" \ --permissions "$(IFS=","; echo "${ROLE_PERMISSIONS[*]}")"프로젝트에 IAM 정책 바인딩을 추가합니다.

$ gcloud projects add-iam-policy-binding $PROJECT_ID \ --member serviceAccount:$SERVICE_ACCOUNT_EMAIL \ --role projects/$PROJECT_ID/roles/velero.serverIAM 서비스 계정을 업데이트합니다.

$ gsutil iam ch serviceAccount:$SERVICE_ACCOUNT_EMAIL:objectAdmin gs://${BUCKET}IAM 서비스 계정 키를 현재 디렉터리의

credentials-velero파일에 저장합니다.$ gcloud iam service-accounts keys create credentials-velero \ --iam-account $SERVICE_ACCOUNT_EMAILData Protection 애플리케이션을 설치하기 전에

credentials-velero파일을 사용하여 GCP용Secret오브젝트를 생성합니다.

4.4.5.2. 백업 및 스냅샷 위치 및 시크릿 정보

DataProtectionApplication CR(사용자 정의 리소스)에서 백업 및 스냅샷 위치와 해당 시크릿을 지정합니다.

백업 위치

Multicloud Object Gateway 또는 MinIO와 같은 S3 호환 오브젝트 스토리지를 백업 위치로 지정합니다.

Velero는 OpenShift Container Platform 리소스, Kubernetes 오브젝트 및 내부 이미지를 오브젝트 스토리지의 아카이브 파일로 백업합니다.

스냅샷 위치

클라우드 공급자의 네이티브 스냅샷 API를 사용하여 영구 볼륨을 백업하는 경우 클라우드 공급자를 스냅샷 위치로 지정해야 합니다.

CSI(Container Storage Interface) 스냅샷을 사용하는 경우 CSI 드라이버를 등록할 VolumeSnapshotClass CR을 생성하므로 스냅샷 위치를 지정할 필요가 없습니다.

Restic을 사용하는 경우 Restic이 오브젝트 스토리지의 파일 시스템을 백업하므로 스냅샷 위치를 지정할 필요가 없습니다.

보안

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 시크릿 을 생성합니다.

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 다음 두 개의 시크릿 오브젝트를 생성합니다.

-

DataProtectionApplicationCR에서 지정하는 백업 위치에 대한 사용자 지정시크릿입니다. -

DataProtectionApplicationCR에서 참조되지 않는 스냅샷 위치의 기본시크릿입니다.

데이터 보호 애플리케이션에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다.

설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 보안을 생성할 수 있습니다.

4.4.5.2.1. 기본 보안 생성

백업 및 스냅샷 위치에 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 보안을 생성합니다.

보안의 기본 이름은 입니다.

cloud -credentials-gcp

DataProtectionApplication CR(사용자 정의 리소스)에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다. 백업 위치 Secret 의 이름이 지정되지 않은 경우 기본 이름이 사용됩니다.

설치 중에 백업 위치 인증 정보를 사용하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 이름으로 보안을 생성할 수 있습니다.

사전 요구 사항

- 오브젝트 스토리지 및 클라우드 스토리지(있는 경우)는 동일한 인증 정보를 사용해야 합니다.

- Velero의 오브젝트 스토리지를 구성해야 합니다.

-

적절한 형식으로 오브젝트 스토리지에 대한

credentials-velero파일을 생성해야 합니다.

절차

기본 이름으로 보안을 생성합니다.

$ oc create secret generic cloud-credentials-gcp -n openshift-adp --from-file cloud=credentials-velero

데이터 보호 애플리케이션을 설치할 때 DataProtectionApplication CR의 spec.backupLocations.credential 블록에서 시크릿 을 참조합니다.

4.4.5.2.2. 다른 인증 정보에 대한 보안 생성

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 두 개의 Secret 오브젝트를 생성해야 합니다.

-

사용자 지정 이름이 있는 백업 위치

시크릿. 사용자 지정 이름은DataProtectionApplicationCR(사용자 정의 리소스)의spec.backupLocations블록에 지정됩니다. -

기본 이름이

cloud-credentials-gcp인 스냅샷 위치시크릿. 이보안은DataProtectionApplicationCR에 지정되지 않습니다.

절차

-

클라우드 공급자에 대한 적절한 형식으로 스냅샷 위치에 대한

credentials-velero파일을 만듭니다. 기본 이름을 사용하여 스냅샷 위치에 대한 보안을 생성합니다.

$ oc create secret generic cloud-credentials-gcp -n openshift-adp --from-file cloud=credentials-velero

-

오브젝트 스토리지에 적합한 형식으로 백업 위치에 대한

credentials-velero파일을 생성합니다. 사용자 지정 이름을 사용하여 백업 위치에 대한 보안을 생성합니다.

$ oc create secret generic <custom_secret> -n openshift-adp --from-file cloud=credentials-velero

다음

예와 같이 사용자 지정 이름으로 보안을DataProtectionApplicationCR에 추가합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: ... backupLocations: - velero: provider: gcp default: true credential: key: cloud name: <custom_secret> 1 objectStorage: bucket: <bucket_name> prefix: <prefix> snapshotLocations: - velero: provider: gcp default: true config: project: <project> snapshotLocation: us-west1- 1

- 사용자 지정 이름이 있는 백업 위치

시크릿.

4.4.5.3. 데이터 보호 애플리케이션 구성

Velero 리소스 할당을 설정하거나 자체 서명된 CA 인증서를 활성화하여 데이터 보호 애플리케이션을 구성할 수 있습니다.

4.4.5.3.1. Velero CPU 및 메모리 리소스 할당 설정

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 Velero Pod에 대한 CPU 및 메모리 리소스 할당을 설정합니다.

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR 매니페스트의spec.configuration.velero.podConfig.ResourceAllocations블록의 값을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... configuration: velero: podConfig: nodeSelector: <node selector> 1 resourceAllocations: 2 limits: cpu: "1" memory: 1024Mi requests: cpu: 200m memory: 256Mi

4.4.5.3.2. 자체 서명 CA 인증서 활성화

알 수 없는 기관에서 서명한 인증서를 방지하기 위해 활성화해야 합니다.

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 오브젝트 스토리지에 대해 자체 서명 CA 인증서를

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

DataProtectionApplicationCR 매니페스트의spec.backupLocations.velero.objectStorage.caCert매개변수 및spec.backupLocations.velero.config매개변수를 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... backupLocations: - name: default velero: provider: aws default: true objectStorage: bucket: <bucket> prefix: <prefix> caCert: <base64_encoded_cert_string> 1 config: insecureSkipTLSVerify: "false" 2 ...

4.4.5.4. 데이터 보호 애플리케이션 설치

DataProtectionApplication API 인스턴스를 생성하여 DPA( Data Protection Application )를 설치합니다.

사전 요구 사항

- OADP Operator를 설치해야 합니다.

- 오브젝트 스토리지를 백업 위치로 구성해야 합니다.

- 스냅샷을 사용하여 PV를 백업하는 경우 클라우드 공급자는 네이티브 스냅샷 API 또는 CSI(Container Storage Interface) 스냅샷을 지원해야 합니다.

-

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하는 경우 기본 이름

cloud-credentials-gcp를 사용하여 보안을 생성해야 합니다. 백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 다음 두 개의

시크릿을 생성해야 합니다.-

백업 위치에 대한 사용자 정의 이름이 있는

시크릿입니다. 이 보안을DataProtectionApplicationCR에 추가합니다. 스냅샷 위치의 기본 이름

cloud-credentials-gcp를 사용하는시크릿입니다. 이보안은DataProtectionApplicationCR에서 참조되지 않습니다.참고설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈

credentials-velero파일을사용하여기본 보안을 생성할 수 있습니다. 기본Secret이 없으면 설치에 실패합니다.참고Velero는 기본 백업 리포지토리 암호가 포함된 OADP 네임스페이스에

velero-repo-credentials라는 시크릿을 생성합니다. 백업 리포지토리를 대상으로 하는 첫 번째 백업을 실행하기 전에 base64로 인코딩된 고유한 암호로 시크릿을 업데이트할 수 있습니다. 업데이트할 키의 값은Data[repository-password]입니다.DPA를 생성한 후 백업 리포지토리를 대상으로 하는 백업을 처음 실행하면 Velero에서 시크릿이 기본 암호 또는 교체한 암호가 포함된

velero-repo-credentials인 백업 리포지토리를 생성합니다. 첫 번째 백업 후 시크릿 암호를 업데이트하면 새 암호가velero-repo-credentials의 암호와 일치하지 않으므로 Velero는 이전 백업과 연결할 수 없습니다.

-

백업 위치에 대한 사용자 정의 이름이 있는

절차

- Operators → 설치된 Operator 를 클릭하고 OADP Operator를 선택합니다.

- 제공된 API 아래에서 DataProtectionApplication 상자에서 인스턴스 생성을 클릭합니다.

YAML 보기를 클릭하고

DataProtectionApplication매니페스트의 매개변수를 업데이트합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: configuration: velero: defaultPlugins: - gcp - openshift 1 resourceTimeout: 10m 2 restic: enable: true 3 podConfig: nodeSelector: <node_selector> 4 backupLocations: - velero: provider: gcp default: true credential: key: cloud name: cloud-credentials-gcp 5 objectStorage: bucket: <bucket_name> 6 prefix: <prefix> 7 snapshotLocations: 8 - velero: provider: gcp default: true config: project: <project> snapshotLocation: us-west1 9- 1

openshift플러그인은 필수입니다.- 2

- Velero CRD 가용성, volumeSnapshot 삭제, 백업 리포지토리 가용성과 같이 시간 초과가 발생하기 전에 여러 Velero 리소스를 대기하는 분을 지정합니다. 기본값은 10m입니다.

- 3

- Restic 설치를 비활성화하려면 이 값을

false로 설정합니다. Restic은 데몬 세트를 배포합니다. 즉, Restic pod는 각 작업 노드에서 실행됩니다. OADP 버전 1.2 이상에서는BackupCR에spec.defaultVolumesToFsBackup: true를 추가하여 백업에 대해 Restic을 구성할 수 있습니다. OADP 버전 1.1에서BackupCR에spec.defaultVolumesToRestic: true를 추가합니다. - 4

- Restic을 사용할 수 있는 노드를 지정합니다. 기본적으로 Restic은 모든 노드에서 실행됩니다.

- 5

- 이 값을 지정하지 않으면 기본 이름

cloud-credentials-gcp가 사용됩니다. 사용자 지정 이름을 지정하면 백업 위치에 사용자 지정 이름이 사용됩니다. - 6

- 버킷을 백업 스토리지 위치로 지정합니다. 버킷이 Velero 백업의 전용 버킷이 아닌 경우 접두사를 지정해야 합니다.

- 7

- 버킷이 여러 목적으로 사용되는 경우 Velero 백업의 접두사(예:

velero)를 지정합니다. - 8

- CSI 스냅샷 또는 Restic을 사용하여 PV를 백업하지 않는 한 스냅샷 위치를 지정합니다.

- 9

- 스냅샷 위치는 PV와 동일한 리전에 있어야 합니다.

- 생성을 클릭합니다.

OADP 리소스를 확인하여 설치를 확인합니다.

$ oc get all -n openshift-adp

출력 예

NAME READY STATUS RESTARTS AGE pod/oadp-operator-controller-manager-67d9494d47-6l8z8 2/2 Running 0 2m8s pod/restic-9cq4q 1/1 Running 0 94s pod/restic-m4lts 1/1 Running 0 94s pod/restic-pv4kr 1/1 Running 0 95s pod/velero-588db7f655-n842v 1/1 Running 0 95s NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/oadp-operator-controller-manager-metrics-service ClusterIP 172.30.70.140 <none> 8443/TCP 2m8s NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE NODE SELECTOR AGE daemonset.apps/restic 3 3 3 3 3 <none> 96s NAME READY UP-TO-DATE AVAILABLE AGE deployment.apps/oadp-operator-controller-manager 1/1 1 1 2m9s deployment.apps/velero 1/1 1 1 96s NAME DESIRED CURRENT READY AGE replicaset.apps/oadp-operator-controller-manager-67d9494d47 1 1 1 2m9s replicaset.apps/velero-588db7f655 1 1 1 96s

4.4.5.4.1. DataProtectionApplication CR에서 CSI 활성화

CSI 스냅샷을 사용하여 영구 볼륨을 백업하기 위해 DataProtectionApplication CR(사용자 정의 리소스)에서 CSI(Container Storage Interface)를 활성화합니다.

사전 요구 사항

- 클라우드 공급자는 CSI 스냅샷을 지원해야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication ... spec: configuration: velero: defaultPlugins: - openshift - csi 1- 1

csi기본 플러그인을 추가합니다.

4.4.6. Multicloud Object Gateway를 사용하여 데이터 보호를 위한 OpenShift API 구성

OADP Operator를 설치하여 MCG(Multicloud Object Gateway)와 함께 OADP(OpenShift API for Data Protection)를 설치합니다. Operator는 Velero 1.11 을 설치합니다.

OADP 1.0.4부터 모든 OADP 1.0.z 버전은 MTC Operator의 종속성으로만 사용할 수 있으며 독립 실행형 Operator로 사용할 수 없습니다.

Multicloud Object Gateway 를 백업 위치로 구성합니다. MCG는 OpenShift Data Foundation의 구성 요소입니다. MCG를 DataProtectionApplication CR(사용자 정의 리소스)에서 백업 위치로 구성합니다.

오브젝트 스토리지를 위한 버킷 생성을 자동화하는 CloudStorage API는 기술 프리뷰 기능 전용입니다. 기술 프리뷰 기능은 Red Hat 프로덕션 서비스 수준 계약(SLA)에서 지원되지 않으며 기능적으로 완전하지 않을 수 있습니다. 따라서 프로덕션 환경에서 사용하는 것은 권장하지 않습니다. 이러한 기능을 사용하면 향후 제품 기능을 조기에 이용할 수 있어 개발 과정에서 고객이 기능을 테스트하고 피드백을 제공할 수 있습니다.

Red Hat 기술 프리뷰 기능의 지원 범위에 대한 자세한 내용은 기술 프리뷰 기능 지원 범위를 참조하십시오.

백업 위치에 대한 보안을 생성한 다음 데이터 보호 애플리케이션을 설치합니다. 자세한 내용은 OADP Operator 설치를 참조하십시오.

제한된 네트워크 환경에 OADP Operator를 설치하려면 먼저 기본 OperatorHub 소스를 비활성화하고 Operator 카탈로그를 미러링해야 합니다. 자세한 내용은 제한된 네트워크에서 Operator Lifecycle Manager 사용을 참조하십시오.

4.4.6.1. 멀티 클라우드 오브젝트 게이트웨이 인증 정보 검색

OADP(데이터 보호)용 OpenShift API에 대한 Secret CR(사용자 정의 리소스)을 생성하려면 MCG(Multicloud Object Gateway) 인증 정보를 검색해야 합니다.

MCG는 OpenShift Data Foundation의 구성 요소입니다.

사전 요구 사항

- 적절한 OpenShift Data Foundation 배포 가이드를 사용하여 OpenShift Data Foundation 을 배포해야 합니다.

절차

-

NooBaa사용자 정의 리소스에서describe명령을 실행하여 S3 끝점,AWS_ACCESS_KEY 및AWS_SECRET_ACCESS_KEY를 가져옵니다. credentials-velero파일을 생성합니다.$ cat << EOF > ./credentials-velero [default] aws_access_key_id=<AWS_ACCESS_KEY_ID> aws_secret_access_key=<AWS_SECRET_ACCESS_KEY> EOF

credentials-velero파일을 사용하여 Data Protection 애플리케이션을 설치할 때Secret오브젝트를 생성합니다.

4.4.6.2. 백업 및 스냅샷 위치 및 시크릿 정보

DataProtectionApplication CR(사용자 정의 리소스)에서 백업 및 스냅샷 위치와 해당 시크릿을 지정합니다.

백업 위치

Multicloud Object Gateway 또는 MinIO와 같은 S3 호환 오브젝트 스토리지를 백업 위치로 지정합니다.

Velero는 OpenShift Container Platform 리소스, Kubernetes 오브젝트 및 내부 이미지를 오브젝트 스토리지의 아카이브 파일로 백업합니다.

스냅샷 위치

클라우드 공급자의 네이티브 스냅샷 API를 사용하여 영구 볼륨을 백업하는 경우 클라우드 공급자를 스냅샷 위치로 지정해야 합니다.

CSI(Container Storage Interface) 스냅샷을 사용하는 경우 CSI 드라이버를 등록할 VolumeSnapshotClass CR을 생성하므로 스냅샷 위치를 지정할 필요가 없습니다.

Restic을 사용하는 경우 Restic이 오브젝트 스토리지의 파일 시스템을 백업하므로 스냅샷 위치를 지정할 필요가 없습니다.

보안

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 시크릿 을 생성합니다.

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 다음 두 개의 시크릿 오브젝트를 생성합니다.

-

DataProtectionApplicationCR에서 지정하는 백업 위치에 대한 사용자 지정시크릿입니다. -

DataProtectionApplicationCR에서 참조되지 않는 스냅샷 위치의 기본시크릿입니다.

데이터 보호 애플리케이션에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다.

설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 보안을 생성할 수 있습니다.

4.4.6.2.1. 기본 보안 생성

백업 및 스냅샷 위치에 동일한 인증 정보를 사용하거나 스냅샷 위치가 필요하지 않은 경우 기본 보안을 생성합니다.

시크릿 의 기본 이름은 cloud-credentials 입니다.

DataProtectionApplication CR(사용자 정의 리소스)에는 기본 시크릿 이 필요합니다. 그러지 않으면 설치에 실패합니다. 백업 위치 Secret 의 이름이 지정되지 않은 경우 기본 이름이 사용됩니다.

설치 중에 백업 위치 인증 정보를 사용하지 않으려면 빈 credentials-velero 파일을 사용하여 기본 이름으로 보안을 생성할 수 있습니다.

사전 요구 사항

- 오브젝트 스토리지 및 클라우드 스토리지(있는 경우)는 동일한 인증 정보를 사용해야 합니다.

- Velero의 오브젝트 스토리지를 구성해야 합니다.

-

적절한 형식으로 오브젝트 스토리지에 대한

credentials-velero파일을 생성해야 합니다.

절차

기본 이름으로 보안을 생성합니다.

$ oc create secret generic cloud-credentials -n openshift-adp --from-file cloud=credentials-velero

데이터 보호 애플리케이션을 설치할 때 DataProtectionApplication CR의 spec.backupLocations.credential 블록에서 시크릿 을 참조합니다.

4.4.6.2.2. 다른 인증 정보에 대한 보안 생성

백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 두 개의 Secret 오브젝트를 생성해야 합니다.

-

사용자 지정 이름이 있는 백업 위치

시크릿. 사용자 지정 이름은DataProtectionApplicationCR(사용자 정의 리소스)의spec.backupLocations블록에 지정됩니다. -

기본 이름이

cloud-credentials인 스냅샷 위치시크릿. 이보안은DataProtectionApplicationCR에 지정되지 않습니다.

절차

-

클라우드 공급자에 대한 적절한 형식으로 스냅샷 위치에 대한

credentials-velero파일을 만듭니다. 기본 이름을 사용하여 스냅샷 위치에 대한 보안을 생성합니다.

$ oc create secret generic cloud-credentials -n openshift-adp --from-file cloud=credentials-velero

-

오브젝트 스토리지에 적합한 형식으로 백업 위치에 대한

credentials-velero파일을 생성합니다. 사용자 지정 이름을 사용하여 백업 위치에 대한 보안을 생성합니다.

$ oc create secret generic <custom_secret> -n openshift-adp --from-file cloud=credentials-velero

다음

예와 같이 사용자 지정 이름으로 보안을DataProtectionApplicationCR에 추가합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: ... backupLocations: - velero: config: profile: "default" region: minio s3Url: <url> insecureSkipTLSVerify: "true" s3ForcePathStyle: "true" provider: aws default: true credential: key: cloud name: <custom_secret> 1 objectStorage: bucket: <bucket_name> prefix: <prefix>- 1

- 사용자 지정 이름이 있는 백업 위치

시크릿.

4.4.6.3. 데이터 보호 애플리케이션 구성

Velero 리소스 할당을 설정하거나 자체 서명된 CA 인증서를 활성화하여 데이터 보호 애플리케이션을 구성할 수 있습니다.

4.4.6.3.1. Velero CPU 및 메모리 리소스 할당 설정

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 Velero Pod에 대한 CPU 및 메모리 리소스 할당을 설정합니다.

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR 매니페스트의spec.configuration.velero.podConfig.ResourceAllocations블록의 값을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... configuration: velero: podConfig: nodeSelector: <node selector> 1 resourceAllocations: 2 limits: cpu: "1" memory: 1024Mi requests: cpu: 200m memory: 256Mi

4.4.6.3.2. 자체 서명 CA 인증서 활성화

알 수 없는 기관에서 서명한 인증서를 방지하기 위해 활성화해야 합니다.

DataProtectionApplication CR(사용자 정의 리소스) 매니페스트를 편집하여 오브젝트 스토리지에 대해 자체 서명 CA 인증서를

사전 요구 사항

- OADP(OpenShift API for Data Protection) Operator가 설치되어 있어야 합니다.

절차

DataProtectionApplicationCR 매니페스트의spec.backupLocations.velero.objectStorage.caCert매개변수 및spec.backupLocations.velero.config매개변수를 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> spec: ... backupLocations: - name: default velero: provider: aws default: true objectStorage: bucket: <bucket> prefix: <prefix> caCert: <base64_encoded_cert_string> 1 config: insecureSkipTLSVerify: "false" 2 ...

4.4.6.4. 데이터 보호 애플리케이션 설치

DataProtectionApplication API 인스턴스를 생성하여 DPA( Data Protection Application )를 설치합니다.

사전 요구 사항

- OADP Operator를 설치해야 합니다.

- 오브젝트 스토리지를 백업 위치로 구성해야 합니다.

- 스냅샷을 사용하여 PV를 백업하는 경우 클라우드 공급자는 네이티브 스냅샷 API 또는 CSI(Container Storage Interface) 스냅샷을 지원해야 합니다.

-

백업 및 스냅샷 위치에서 동일한 인증 정보를 사용하는 경우 기본 이름

cloud-credentials로Secret을 생성해야 합니다. 백업 및 스냅샷 위치에서 다른 인증 정보를 사용하는 경우 다음 두 개의

시크릿을 생성해야 합니다.-

백업 위치에 대한 사용자 정의 이름이 있는

시크릿입니다. 이 보안을DataProtectionApplicationCR에 추가합니다. 스냅샷 위치의 기본 이름

cloud-credentials를 사용하는시크릿입니다. 이보안은DataProtectionApplicationCR에서 참조되지 않습니다.참고설치 중에 백업 또는 스냅샷 위치를 지정하지 않으려면 빈

credentials-velero파일을사용하여기본 보안을 생성할 수 있습니다. 기본Secret이 없으면 설치에 실패합니다.참고Velero는 기본 백업 리포지토리 암호가 포함된 OADP 네임스페이스에

velero-repo-credentials라는 시크릿을 생성합니다. 백업 리포지토리를 대상으로 하는 첫 번째 백업을 실행하기 전에 base64로 인코딩된 고유한 암호로 시크릿을 업데이트할 수 있습니다. 업데이트할 키의 값은Data[repository-password]입니다.DPA를 생성한 후 백업 리포지토리를 대상으로 하는 백업을 처음 실행하면 Velero에서 시크릿이 기본 암호 또는 교체한 암호가 포함된

velero-repo-credentials인 백업 리포지토리를 생성합니다. 첫 번째 백업 후 시크릿 암호를 업데이트하면 새 암호가velero-repo-credentials의 암호와 일치하지 않으므로 Velero는 이전 백업과 연결할 수 없습니다.

-

백업 위치에 대한 사용자 정의 이름이 있는

절차

- Operators → 설치된 Operator 를 클릭하고 OADP Operator를 선택합니다.

- 제공된 API 아래에서 DataProtectionApplication 상자에서 인스턴스 생성을 클릭합니다.

YAML 보기를 클릭하고

DataProtectionApplication매니페스트의 매개변수를 업데이트합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication metadata: name: <dpa_sample> namespace: openshift-adp spec: configuration: velero: defaultPlugins: - aws - openshift 1 resourceTimeout: 10m 2 restic: enable: true 3 podConfig: nodeSelector: <node_selector> 4 backupLocations: - velero: config: profile: "default" region: minio s3Url: <url> 5 insecureSkipTLSVerify: "true" s3ForcePathStyle: "true" provider: aws default: true credential: key: cloud name: cloud-credentials 6 objectStorage: bucket: <bucket_name> 7 prefix: <prefix> 8- 1

openshift플러그인은 필수입니다.- 2

- Velero CRD 가용성, volumeSnapshot 삭제, 백업 리포지토리 가용성과 같이 시간 초과가 발생하기 전에 여러 Velero 리소스를 대기하는 분을 지정합니다. 기본값은 10m입니다.

- 3

- Restic 설치를 비활성화하려면 이 값을

false로 설정합니다. Restic은 데몬 세트를 배포합니다. 즉, Restic pod는 각 작업 노드에서 실행됩니다. OADP 버전 1.2 이상에서는BackupCR에spec.defaultVolumesToFsBackup: true를 추가하여 백업에 대해 Restic을 구성할 수 있습니다. OADP 버전 1.1에서BackupCR에spec.defaultVolumesToRestic: true를 추가합니다. - 4

- Restic을 사용할 수 있는 노드를 지정합니다. 기본적으로 Restic은 모든 노드에서 실행됩니다.

- 5

- S3 끝점의 URL을 지정합니다.

- 6

- 이 값을 지정하지 않으면 기본 이름

cloud-credentials가 사용됩니다. 사용자 지정 이름을 지정하면 백업 위치에 사용자 지정 이름이 사용됩니다. - 7

- 버킷을 백업 스토리지 위치로 지정합니다. 버킷이 Velero 백업의 전용 버킷이 아닌 경우 접두사를 지정해야 합니다.

- 8

- 버킷이 여러 목적으로 사용되는 경우 Velero 백업의 접두사(예:

velero)를 지정합니다.

- 생성을 클릭합니다.

OADP 리소스를 확인하여 설치를 확인합니다.

$ oc get all -n openshift-adp

출력 예

NAME READY STATUS RESTARTS AGE pod/oadp-operator-controller-manager-67d9494d47-6l8z8 2/2 Running 0 2m8s pod/restic-9cq4q 1/1 Running 0 94s pod/restic-m4lts 1/1 Running 0 94s pod/restic-pv4kr 1/1 Running 0 95s pod/velero-588db7f655-n842v 1/1 Running 0 95s NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE service/oadp-operator-controller-manager-metrics-service ClusterIP 172.30.70.140 <none> 8443/TCP 2m8s NAME DESIRED CURRENT READY UP-TO-DATE AVAILABLE NODE SELECTOR AGE daemonset.apps/restic 3 3 3 3 3 <none> 96s NAME READY UP-TO-DATE AVAILABLE AGE deployment.apps/oadp-operator-controller-manager 1/1 1 1 2m9s deployment.apps/velero 1/1 1 1 96s NAME DESIRED CURRENT READY AGE replicaset.apps/oadp-operator-controller-manager-67d9494d47 1 1 1 2m9s replicaset.apps/velero-588db7f655 1 1 1 96s

4.4.6.4.1. DataProtectionApplication CR에서 CSI 활성화

CSI 스냅샷을 사용하여 영구 볼륨을 백업하기 위해 DataProtectionApplication CR(사용자 정의 리소스)에서 CSI(Container Storage Interface)를 활성화합니다.

사전 요구 사항

- 클라우드 공급자는 CSI 스냅샷을 지원해야 합니다.

절차

다음 예와 같이

DataProtectionApplicationCR을 편집합니다.apiVersion: oadp.openshift.io/v1alpha1 kind: DataProtectionApplication ... spec: configuration: velero: defaultPlugins: - openshift - csi 1- 1

csi기본 플러그인을 추가합니다.

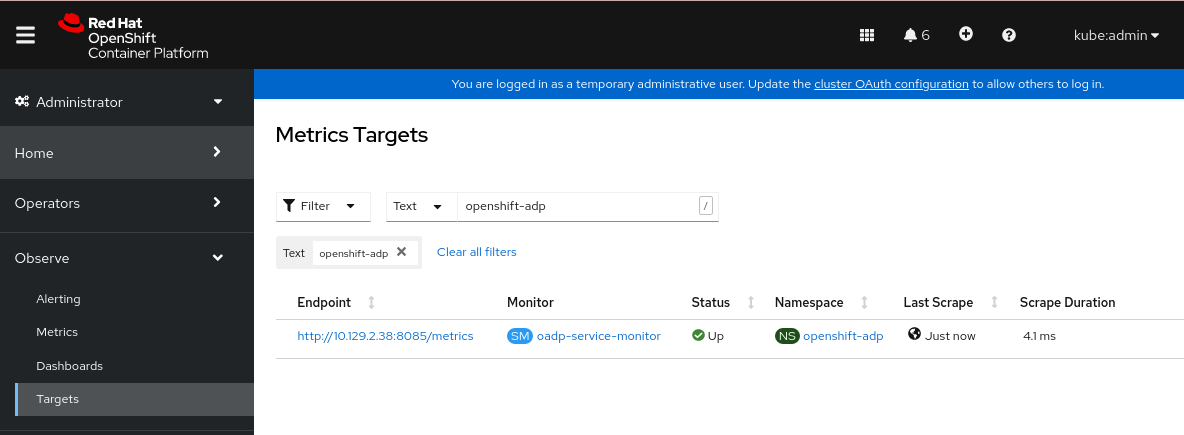

4.4.7. OpenShift Data Foundation으로 데이터 보호를 위한 OpenShift API 구성

OADP Operator를 설치하고 백업 위치와 스냅샷 위치를 구성하여 OpenShift Data Foundation과 함께 OADP(OpenShift API for Data Protection)를 설치합니다. 그런 다음 데이터 보호 애플리케이션을 설치합니다.

OADP 1.0.4부터 모든 OADP 1.0.z 버전은 MTC Operator의 종속성으로만 사용할 수 있으며 독립 실행형 Operator로 사용할 수 없습니다.