Red Hat Training

A Red Hat training course is available for OpenShift Container Platform

개발자 가이드

OpenShift Container Platform 3.11 개발자 참조

초록

1장. 개요

이 안내서는 애플리케이션 개발자를 대상으로 하며 OpenShift Container Platform 클라우드 환경에서 애플리케이션을 개발하고 배포하기 위해 워크스테이션을 설정하고 구성하는 방법에 대한 지침을 제공합니다. 여기에는 개발자를 돕기 위한 자세한 지침 및 예제가 포함되어 있습니다.

2장. 애플리케이션 라이프사이클 관리

2.1. 개발 프로세스 계획

2.1.1. 개요

OpenShift Container Platform은 애플리케이션을 빌드하고 배포하기 위해 설계되었습니다. 개발 프로세스에서 OpenShift Container Platform과 관련된 크기에 따라 다음을 선택할 수 있습니다.

- OpenShift Container Platform 프로젝트 내에서 개발에 중점을 둡니다. 이를 사용하여 처음부터 애플리케이션을 빌드한 다음 지속적으로 애플리케이션을 빌드하고 라이프사이클을 개발 및 관리

- 이미 별도의 환경에서 개발한 애플리케이션(예: 바이너리, 컨테이너 이미지, 소스 코드)을 가져와 OpenShift Container Platform에 배포합니다.

2.1.2. OpenShift Container Platform을 개발 환경으로 사용

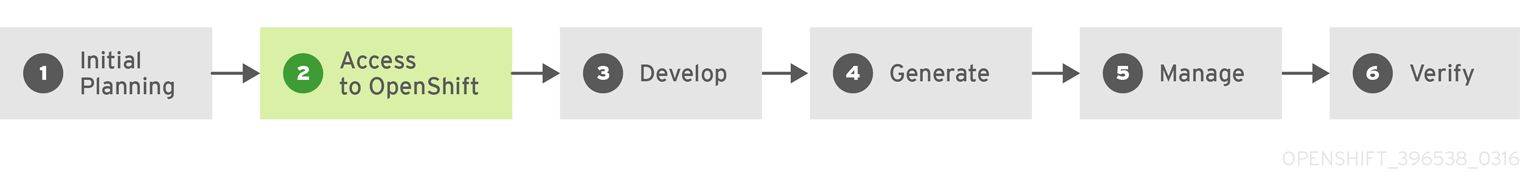

OpenShift Container Platform을 직접 사용하여 애플리케이션의 개발을 처음부터 시작할 수 있습니다. 이러한 유형의 개발 프로세스를 계획할 때 다음 단계를 고려하십시오.

초기 계획

- 애플리케이션은 어떻게 해야 합니까?

- 어떤 프로그래밍 언어가 개발됩니까?

OpenShift Container Platform에 액세스

- 사용자 또는 조직 내의 관리자가 OpenShift Container Platform을 설치해야 합니다.

개발

- 선택한 편집기 또는 IDE를 사용하여 애플리케이션의 기본 스keleton을 생성합니다. OpenShift Container Platform이 어떤 종류의 애플리케이션이 있는지 알릴 수 있을 만큼 충분히 개발되어야 합니다.

- 코드를 Git 리포지토리로 내보냅니다.

generate

-

oc new-app명령을 사용하여 기본 애플리케이션을 생성합니다. OpenShift Container Platform은 빌드 및 배포 구성을 생성합니다.

관리

- 애플리케이션 코드 개발을 시작합니다.

- 애플리케이션이 성공적으로 빌드되는지 확인합니다.

- 로컬에서 코드를 개발하고 연마하십시오.

- 코드를 Git 리포지토리로 내보냅니다.

- 필요한 추가 구성이 있습니까? 자세한 옵션은 개발자 가이드 를 참조하십시오.

verify

-

여러 가지 방법으로 애플리케이션을 확인할 수 있습니다. 변경 사항을 애플리케이션의 Git 리포지토리로 내보내고 OpenShift Container Platform을 사용하여 애플리케이션을 다시 빌드하고 재배포할 수 있습니다. 또는

rsync를 사용하여 핫 디플로이먼트를 사용하여 코드 변경 사항을 실행 중인 Pod에 동기화할 수 있습니다.

2.1.3. OpenShift Container Platform에 배포할 애플리케이션 가져오기

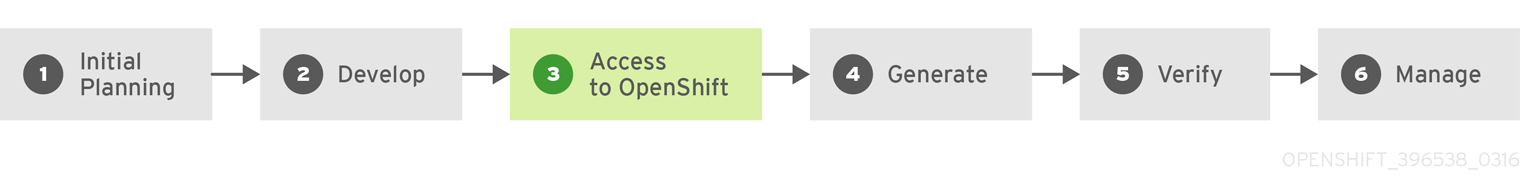

가능한 또 다른 애플리케이션 개발 전략은 로컬에서 개발한 다음 OpenShift Container Platform을 사용하여 완전히 개발한 애플리케이션을 배포하는 것입니다. 애플리케이션 코드가 이미 있어야 하는 경우 다음 프로세스를 사용하여 완료되면 OpenShift Container Platform 설치를 빌드하고 배포하십시오.

초기 계획

- 애플리케이션은 어떻게 해야 합니까?

- 어떤 프로그래밍 언어가 개발됩니까?

개발

- 편집기 또는 선택한 IDE를 사용하여 애플리케이션 코드를 개발합니다.

- 애플리케이션 코드를 로컬로 빌드하고 테스트합니다.

- 코드를 Git 리포지토리로 내보냅니다.

OpenShift Container Platform에 액세스

- 사용자 또는 조직 내의 관리자가 OpenShift Container Platform을 설치해야 합니다.

generate

-

oc new-app명령을 사용하여 기본 애플리케이션을 생성합니다. OpenShift Container Platform은 빌드 및 배포 구성을 생성합니다.

verify

- 위의 Generate 단계에서 빌드 및 배포한 애플리케이션이 OpenShift Container Platform에서 성공적으로 실행되고 있는지 확인합니다.

관리

- 결과에 만족할 때까지 애플리케이션 코드를 계속 개발하십시오.

- OpenShift Container Platform에서 애플리케이션을 다시 빌드하여 새로 내보낸 코드를 수락합니다.

- 필요한 추가 구성이 있습니까? 자세한 옵션은 개발자 가이드 를 참조하십시오.

2.2. 새 애플리케이션 생성

2.2.1. 개요

OpenShift CLI 또는 웹 콘솔을 사용하여 소스 또는 바이너리 코드, 이미지 및/또는 템플릿을 포함한 구성 요소에서 새 OpenShift Container Platform 애플리케이션을 생성할 수 있습니다.

2.2.2. CLI를 사용하여 애플리케이션 생성

2.2.2.1. 소스 코드에서 애플리케이션 생성

new-app 명령을 사용하면 로컬 또는 원격 Git 리포지토리의 소스 코드에서 애플리케이션을 생성할 수 있습니다.

로컬 디렉터리의 Git 리포지토리를 사용하여 애플리케이션을 생성하려면 다음을 수행합니다.

$ oc new-app /path/to/source/code

로컬 Git 리포지토리를 사용하는 경우 리포지토리에는 OpenShift Container Platform 클러스터에서 액세스할 수 있는 URL을 가리키는 origin 이라는 원격이 있어야 합니다. 인식된 원격이 없는 경우 new-app 은 바이너리 빌드 를 생성합니다.

원격 Git 리포지토리를 사용하여 애플리케이션을 생성하려면 다음을 수행합니다.

$ oc new-app https://github.com/sclorg/cakephp-ex

프라이빗 원격 Git 리포지토리를 사용하여 애플리케이션을 생성하려면 다음을 수행합니다.

$ oc new-app https://github.com/youruser/yourprivaterepo --source-secret=yoursecret

프라이빗 원격 Git 리포지토리를 사용하는 경우 --source-secret 플래그를 사용하여 BuildConfig 에 삽입할 기존 소스 복제 보안을 지정하여 리포지토리에 액세스할 수 있습니다.

--context-dir 플래그를 지정하여 소스 코드 리포지토리의 하위 디렉터리를 사용할 수 있습니다. 원격 Git 리포지토리 및 컨텍스트 하위 디렉터리를 사용하여 애플리케이션을 생성하려면 다음을 수행합니다.

$ oc new-app https://github.com/sclorg/s2i-ruby-container.git \

--context-dir=2.0/test/puma-test-app

또한 원격 URL을 지정하면 URL 끝에 #<branch_name>을 추가하여 사용할 Git 분기를 지정할 수 있습니다.

$ oc new-app https://github.com/openshift/ruby-hello-world.git#beta4

new-app 명령은 소스 코드에서 새 애플리케이션 이미지를 생성하는 빌드 구성 을 생성합니다. 또한 new-app 명령은 일반적으로 새 이미지를 배포하는 배포 구성과 이미지를 실행하는 배포에 부하 분산 액세스 권한을 제공하는 서비스를 생성합니다.

OpenShift Container Platform은 Docker, Pipeline 또는 소스 빌드 전략을 사용해야 하는지 여부를 자동으로 감지하고, 소스 빌드의 경우 적절한 언어 빌더 이미지를 탐지합니다.

빌드 전략 탐지

Jenkinsfile 이 새 애플리케이션을 생성할 때 소스 리포지토리의 루트 또는 지정된 컨텍스트 디렉터리에 있는 경우 OpenShift Container Platform은 Pipeline 빌드 전략을 생성합니다. 그러지 않으면 Dockerfile 이 발견되면 OpenShift Container Platform에서 Docker 빌드 전략을 생성합니다. 그러지 않으면 소스 빌드 전략을 생성합니다.

--strategy 플래그를 docker,pipeline 또는 source 로 설정하여 빌드 전략을 재정의할 수 있습니다.

$ oc new-app /home/user/code/myapp --strategy=docker

oc 명령을 실행하려면 빌드 소스가 포함된 파일이 원격 Git 리포지토리에 제공되어야 합니다. 모든 소스 빌드에 git remote -v를 사용해야 합니다.

언어 탐지

소스 빌드 전략을 사용하는 경우 new-app 은 리포지토리의 루트 또는 지정된 컨텍스트 디렉터리에 특정 파일이 있는지에 따라 사용할 언어 빌더를 결정합니다.

표 2.1. new-app에서 감지하는 언어

| 언어 | 파일 |

|---|---|

|

| project.json, *.csproj |

|

| pom.xml |

|

| app.json, package.json |

|

| cpanfile, index.pl |

|

| composer.json, index.php |

|

| requirements.txt, setup.py |

|

| Gemfile, Rakefile, config.ru |

|

| build.sbt |

|

| Godeps, main.go |

언어를 탐지한 후 new-app 은 OpenShift Container Platform 서버에서 탐지된 언어와 일치하는 supports 주석이 있는 이미지 스트림 태그 또는 탐지된 언어의 이름과 일치하는 이미지 스트림을 검색합니다. 일치 항목이 없는 경우 new-app은 Docker Hub 레지스트리에서 이름을 기반으로 탐지된 언어와 일치하는 이미지를 검색합니다.

이미지(이미지 스트림 또는 컨테이너 사양) 및 리포지토리를 구분 기호로 지정하여 빌더에서 특정 소스 리포지토리에 사용하는 이미지를 재정의 할 수 있습니다. 이 작업이 완료되면 빌드 전략 탐지 및 언어 탐지 가 수행되지 않습니다.

예를 들어 원격 리포지토리의 소스와 함께 myproject/my-ruby 이미지 스트림을 사용하려면 다음을 실행합니다.

$ oc new-app myproject/my-ruby~https://github.com/openshift/ruby-hello-world.git

로컬 리포지토리의 소스에 openshift/ruby-20-centos7:latest 컨테이너 이미지 스트림을 사용하려면 다음을 실행합니다.

$ oc new-app openshift/ruby-20-centos7:latest~/home/user/code/my-ruby-app

언어 탐지 기능에는 리포지토리를 복제하고 검사할 수 있도록 Git 클라이언트를 로컬에 설치해야 합니다. Git을 사용할 수 없는 경우 <image>~<repository> 구문으로 리포지토리에 사용할 빌더 이미지를 지정하여 언어 탐지 단계가 수행되지 않도록 수 있습니다.

-i <image> <repository> 호출을 사용하려면 new-app 에서 아티팩트 유형이 무엇인지 확인하기 위해 repository 를 복제해야 하므로 Git을 사용할 수 없는 경우 이 작업이 실패합니다.

마찬가지로 -i <image> --code <repository> 호출을 사용하려면 이미지를 소스 코드의 빌더로 사용해야 하는지 아니면 데이터베이스 이미지의 경우와 같이 별도로 배포해야 하는지 확인하기 위해 new-app 에서 repository 를 복제해야 합니다.

2.2.2.2. 이미지에서 애플리케이션 생성

기존 이미지에서 애플리케이션을 배포할 수 있습니다. 이미지는 OpenShift Container Platform 서버의 이미지 스트림, 특정 레지스트리 또는 Docker Hub 레지스트리의 이미지 또는 로컬 Docker 서버의 이미지에서 가져올 수 있습니다.

new-app 명령은 전달된 인수에 지정된 이미지 유형을 확인합니다. 그러나 image가 컨테이너 이미지인지(- docker-image 인수를 사용하여) 또는 이미지 스트림( 인수를 사용하여)인지 -i|--image new-app 에 명시적으로 알릴 수 있습니다.

로컬 Docker 리포지토리에서 이미지를 지정하는 경우 OpenShift Container Platform 클러스터 노드에서 동일한 이미지를 사용할 수 있는지 확인해야 합니다.

예를 들어 DockerResourceOverride MySQL 이미지에서 애플리케이션을 생성하려면 다음을 실행합니다.

$ oc new-app mysql

프라이빗 레지스트리의 이미지를 사용하여 애플리케이션을 생성하려면 전체 컨테이너 이미지 사양을 지정합니다.

$ oc new-app myregistry:5000/example/myimage

이미지가 포함된 레지스트리가 SSL로 보호되지 않은 경우 클러스터 관리자는 OpenShift Container Platform 노드 호스트의 Docker 데몬이 해당 레지스트리를 가리키는 --insecure-registry 플래그를 사용하여 실행해야 합니다. --insecure-registry 플래그를 사용하여 비보안 레지스트리에서 이미지가 제공되었음을 new-app 에 알려야 합니다.

기존 이미지 스트림 및 선택적 이미지 스트림 태그 에서 애플리케이션을 생성할 수 있습니다.

$ oc new-app my-stream:v1

2.2.2.3. 템플릿에서 애플리케이션 생성

템플릿 이름을 인수로 지정하여 이전에 저장된 템플릿 또는 템플릿 파일에서 애플리케이션을 생성할 수 있습니다. 예를 들어 샘플 애플리케이션 템플릿을 저장하고 이를 사용하여 애플리케이션을 생성할 수 있습니다.

저장된 템플릿에서 애플리케이션을 생성하려면 다음을 수행합니다.

$ oc create -f examples/sample-app/application-template-stibuild.json $ oc new-app ruby-helloworld-sample

OpenShift Container Platform에 먼저 저장하지 않고 로컬 파일 시스템에서 템플릿을 직접 사용하려면 -f|--file 인수를 사용합니다.

$ oc new-app -f examples/sample-app/application-template-stibuild.json

템플릿 매개 변수

템플릿을 기반으로 애플리케이션을 생성할 때 -p|--param 인수를 사용하여 템플릿에 정의된 매개변수 값을 설정합니다.

$ oc new-app ruby-helloworld-sample \

-p ADMIN_USERNAME=admin -p ADMIN_PASSWORD=mypassword

템플릿을 인스턴스화할 때 해당 매개변수를 파일에 저장한 다음 해당 파일을 --param-file과 함께 사용할 수 있습니다. 표준 입력에서 매개변수를 읽으려면 --param-file=- 을 사용합니다.

$ cat helloworld.params ADMIN_USERNAME=admin ADMIN_PASSWORD=mypassword $ oc new-app ruby-helloworld-sample --param-file=helloworld.params $ cat helloworld.params | oc new-app ruby-helloworld-sample --param-file=-

2.2.2.4. 애플리케이션 생성 추가 수정

new-app 명령은 생성되는 애플리케이션을 빌드, 배포, 실행할 OpenShift Container Platform 오브젝트를 생성합니다. 일반적으로 이러한 오브젝트는 입력 소스 리포지토리 또는 입력 이미지에서 파생된 이름을 사용하여 현재 프로젝트에서 생성됩니다. 그러나 new-app 을 사용하면 이 동작을 수정할 수 있습니다.

new-app으로 생성되는 오브젝트 세트는 입력을 통해 전달되는 아티팩트(소스 리포지토리, 이미지 또는 템플릿)에 따라 다릅니다.

표 2.2. new-app 출력 오브젝트

| 개체 | 설명 |

|---|---|

|

|

명령줄에 지정된 각 소스 리포지토리에 대해 |

|

|

|

|

|

|

|

|

|

| 기타 | 다른 오브젝트는 템플릿에 따라 템플릿을 인스턴스화할 때 생성될 수 있습니다. |

2.2.2.4.1. 환경 변수 지정

템플릿,소스 또는 이미지에서 애플리케이션을 생성할 때 -e|--env 인수를 사용하여 런타임 시 환경 변수를 애플리케이션 컨테이너에 전달할 수 있습니다.

$ oc new-app openshift/postgresql-92-centos7 \

-e POSTGRESQL_USER=user \

-e POSTGRESQL_DATABASE=db \

-e POSTGRESQL_PASSWORD=password

이 변수는 --env-file 인수를 사용하여 파일에서 읽을 수도 있습니다.

$ cat postgresql.env POSTGRESQL_USER=user POSTGRESQL_DATABASE=db POSTGRESQL_PASSWORD=password $ oc new-app openshift/postgresql-92-centos7 --env-file=postgresql.env

또한 --env-file=-을 사용하여 환경 변수를 표준 입력에 제공할 수 있습니다.

$ cat postgresql.env | oc new-app openshift/postgresql-92-centos7 --env-file=-

자세한 내용은 환경 변수 관리를 참조하십시오.

new-app 처리의 일부로 생성된 모든 BuildConfig 오브젝트는 -e|--env 또는 --env-file 인수를 통해 전달되는 환경 변수로 업데이트되지 않습니다.

2.2.2.4.2. 빌드 환경 변수 지정

템플릿,소스 또는 이미지에서 애플리케이션을 생성할 때 --build-env 인수를 사용하여 런타임 시 환경 변수를 빌드 컨테이너에 전달할 수 있습니다.

$ oc new-app openshift/ruby-23-centos7 \

--build-env HTTP_PROXY=http://myproxy.net:1337/ \

--build-env GEM_HOME=~/.gem

이 변수는 --build-env-file 인수를 사용하여 파일에서 읽을 수도 있습니다.

$ cat ruby.env HTTP_PROXY=http://myproxy.net:1337/ GEM_HOME=~/.gem $ oc new-app openshift/ruby-23-centos7 --build-env-file=ruby.env

또한 --build-env-file=-을 사용하여 환경 변수를 표준 입력에 제공할 수 있습니다.

$ cat ruby.env | oc new-app openshift/ruby-23-centos7 --build-env-file=-

2.2.2.4.3. 라벨 지정

소스,이미지 또는 템플릿에서 애플리케이션을 생성할 때 -l|--label 인수를 사용하여 생성된 오브젝트에 라벨을 추가할 수 있습니다. 라벨을 사용하면 애플리케이션과 관련된 오브젝트를 전체적으로 선택, 구성, 삭제할 수 있습니다.

$ oc new-app https://github.com/openshift/ruby-hello-world -l name=hello-world

2.2.2.4.4. 생성을 사용하지 않는 출력 보기

new-app 이 생성할 것인지의 시험 실행을 보려면 -o|--output 인수를 yaml 또는 json 값과 함께 사용할 수 있습니다. 그런 다음 출력을 사용하여 생성할 오브젝트를 미리 보거나 편집할 파일로 리디렉션할 수 있습니다. 충족되면 oc create 를 사용하여 OpenShift Container Platform 오브젝트를 생성할 수 있습니다.

new-app 아티팩트를 파일에 출력하려면 파일을 편집한 후 생성합니다.

$ oc new-app https://github.com/openshift/ruby-hello-world \

-o yaml > myapp.yaml

$ vi myapp.yaml

$ oc create -f myapp.yaml2.2.2.4.5. 다른 이름으로 오브젝트 생성

new-app으로 생성한 오브젝트는 일반적으로 소스 리포지토리 또는 해당 오브젝트를 생성하는 데 사용된 이미지의 이름을 따서 이름이 지정됩니다. 명령에 --name 플래그를 추가하여 생성한 오브젝트의 이름을 설정할 수 있습니다.

$ oc new-app https://github.com/openshift/ruby-hello-world --name=myapp

2.2.2.4.6. 다른 프로젝트에서 오브젝트 생성

일반적으로 new-app은 현재 프로젝트에서 오브젝트를 생성합니다. 그러나 -n|--namespace 인수를 사용하여 액세스할 수 있는 다른 프로젝트에서 오브젝트를 생성할 수 있습니다.

$ oc new-app https://github.com/openshift/ruby-hello-world -n myproject

2.2.2.4.7. 여러 오브젝트 생성

new-app 명령을 사용하면 new-app에 다양한 매개변수를 지정하는 애플리케이션을 여러 개 생성할 수 있습니다. 명령 줄에서 지정된 라벨은 단일 명령으로 생성된 모든 개체에 적용됩니다. 환경 변수는 소스 또는 이미지에서 생성한 모든 구성 요소에 적용됩니다.

소스 리포지토리 및 Docker Hub 이미지에서 애플리케이션을 생성하려면 다음을 실행합니다.

$ oc new-app https://github.com/openshift/ruby-hello-world mysql

소스 코드 리포지토리와 빌더 이미지가 별도의 인수로 지정되면 new-app에서 빌더 이미지를 소스 코드 저장소의 빌더로 사용합니다. 이를 원하지 않는 경우 ~ 구분자를 사용하여 소스에 필요한 빌더 이미지를 지정합니다.

2.2.2.4.8. 단일 Pod에서 이미지 및 소스 그룹화

new-app 명령을 사용하면 단일 Pod에 여러 이미지를 함께 배포할 수 있습니다. 함께 그룹화할 이미지를 지정하려면 + 구분자를 사용합니다. --group 명령줄 인수를 사용하여 함께 그룹화해야 하는 이미지를 지정할 수도 있습니다. 소스 리포지토리에서 빌드한 이미지를 기타 이미지와 함께 그룹화하려면 그룹에 해당 빌더 이미지를 지정합니다.

$ oc new-app ruby+mysql

소스에서 빌드한 이미지를 외부 이미지와 함께 배포하려면 다음을 실행합니다.

$ oc new-app \

ruby~https://github.com/openshift/ruby-hello-world \

mysql \

--group=ruby+mysql2.2.2.4.9. 이미지, 템플릿 및 기타 입력 검색

oc new-app 명령에 대한 이미지, 템플릿 및 기타 입력을 검색하려면 --search 및 --list플래그를 추가합니다. 예를 들어 PHP를 포함하는 모든 이미지 또는 템플릿을 찾으려면 다음을 실행합니다.

$ oc new-app --search php

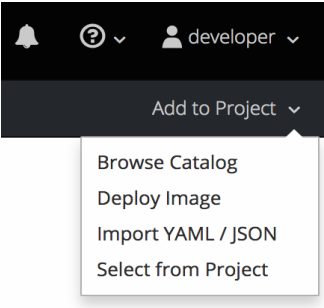

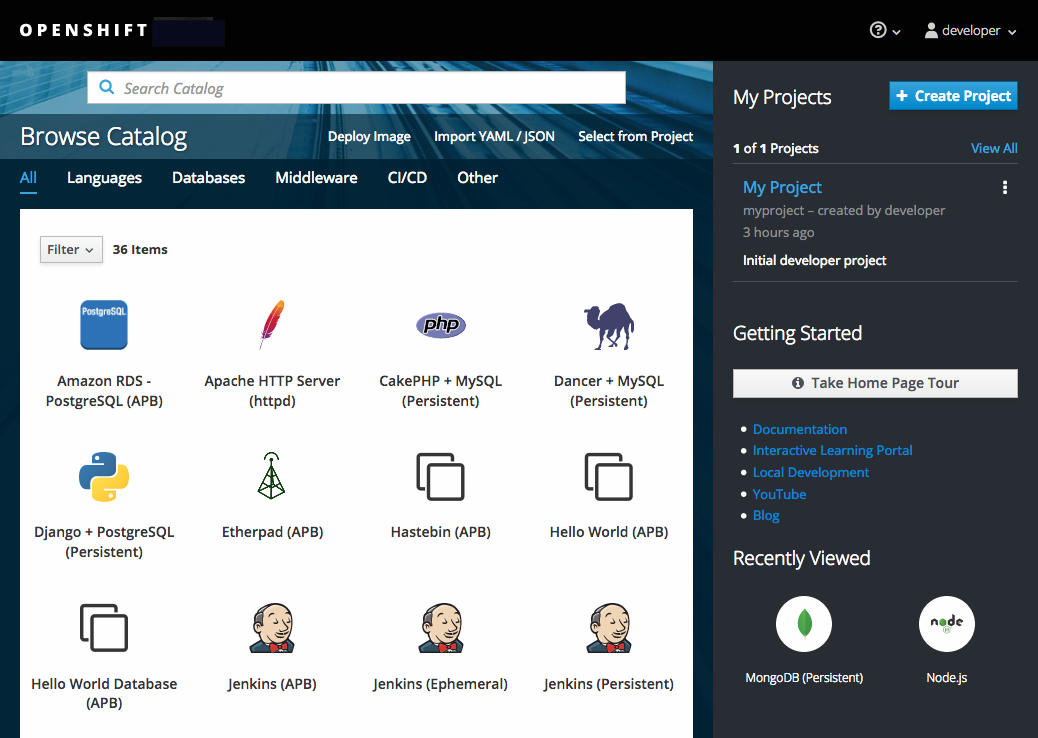

2.2.3. 웹 콘솔을 사용하여 애플리케이션 생성

원하는 프로젝트에 있을 때 프로젝트에 추가를 클릭합니다.

프로젝트의 이미지 목록 또는 서비스 카탈로그에서 빌더 이미지를 선택합니다.

참고

참고여기에 설명된 것처럼, 주석에 builder 태그가 나열된 이미지 스트림 태그만 이 목록에 나타납니다.

kind: "ImageStream" apiVersion: "v1" metadata: name: "ruby" creationTimestamp: null spec: dockerImageRepository: "registry.redhat.io/openshift3/ruby-20-rhel7" tags: - name: "2.0" annotations: description: "Build and run Ruby 2.0 applications" iconClass: "icon-ruby" tags: "builder,ruby" 1 supports: "ruby:2.0,ruby" version: "2.0"- 1

- 여기에 빌더를 포함하면 이

ImageStreamTag는 웹 콘솔에 빌더로 표시됩니다.

새 애플리케이션 화면에서 설정을 수정하여 애플리케이션을 지원하도록 오브젝트를 구성합니다.

2.3. 환경 간에 애플리케이션 승격

2.3.1. 개요

애플리케이션 승격은 일반적으로 다양한 런타임 환경을 통해 애플리케이션을 이동하는 것을 의미합니다. 예를 들어, 애플리케이션은 결국 프로덕션 환경으로 승격되기 전에 개발 환경에서 시작하여 추가 테스트를 위해 스테이지 환경으로 승격될 수 있습니다. 변경 사항이 애플리케이션에 도입되면 변경 사항이 개발에서 시작되고 단계와 프로덕션 단계를 통해 승격됩니다.

현재 "애플리케이션"은 Java, Perl, Python 등으로 작성된 소스 코드 그 이상입니다. 이제 애플리케이션의 언어별 런타임에 대한 정적 웹 콘텐츠, 통합 스크립트 또는 관련 구성보다 많습니다. 해당 언어별 런타임에서 사용하는 애플리케이션별 아카이브보다 많습니다.

OpenShift Container Platform과 Kubernetes 및 Docker의 통합 기반에서 추가 애플리케이션 아티팩트는 다음과 같습니다.

- 다양한 메타데이터 및 관련 툴링이 있는 컨테이너 이미지.

- 애플리케이션 사용을 위해 컨테이너에 삽입되는 환경 변수 입니다.

API 오브젝트 (리소스 정의라고도 함)는 OpenShift Container Platform의 핵심 개념( Core Concepts)을 참조하십시오.

- 애플리케이션 사용을 위해 컨테이너에 삽입됩니다.

- OpenShift Container Platform에서 컨테이너 및 Pod를 관리하는 방법을 지정합니다.

OpenShift Container Platform에서 애플리케이션을 승격하는 방법을 살펴보면 이 주제는 다음과 같습니다.

- 애플리케이션 정의에 도입된 이러한 새로운 아티팩트를 자세히 설명합니다.

- 애플리케이션 승격 파이프라인에 대해 다양한 환경을 해제하는 방법을 설명합니다.

- 이러한 새로운 아티팩트를 관리하기 위한 방법론과 툴에 대해 설명합니다.

- 애플리케이션 승격에 다양한 개념, 구성, 방법론 및 툴을 적용하는 예제를 제공합니다.

2.3.2. 애플리케이션 구성 요소

2.3.2.1. API 오브젝트

OpenShift Container Platform 및 Kubernetes 리소스 정의(애플리케이션 인벤토리에 새로 도입된 항목)와 관련하여 애플리케이션 승격 주제를 고려할 때 다시 살펴볼 수 있는 API 오브젝트의 몇 가지 주요 설계 지점이 있습니다.

먼저 OpenShift Container Platform 문서 전체에서 강조 표시된 것처럼 모든 API 오브젝트를 JSON 또는 YAML을 통해 표현할 수 있으므로 기존 소스 제어 및 스크립팅을 통해 이러한 리소스 정의를 쉽게 관리할 수 있습니다.

또한 API 오브젝트는 시스템의 원하는 상태를 지정하는 오브젝트의 일부 및 시스템의 상태 또는 현재 상태를 반영하는 기타 부분이 있도록 설계되었습니다. 이는 입력 및 출력으로 간주될 수 있습니다. 입력 부분은 JSON 또는 YAML로 표현될 때, 특히 SCM(소스 제어 관리) 아티팩트에 적합한 항목입니다.

API 오브젝트의 입력 또는 사양 부분은 템플릿 처리를 통한 변수 대체 가 인스턴스화될 수 있다는 점에서 완전히 정적 또는 동적일 수 있습니다.

API 오브젝트와 관련하여 이러한 포인트의 결과는 표현식을 JSON 또는 YAML 파일로 사용하여 애플리케이션 구성을 코드로 처리할 수 있다는 것입니다.

결과적으로 거의 모든 API 오브젝트는 조직에서 애플리케이션 아티팩트로 간주할 수 있습니다. 다음은 애플리케이션 배포 및 관리와 가장 일반적으로 관련된 오브젝트입니다.

- BuildConfigs

-

이는 애플리케이션 승격의 컨텍스트에서 특수한 사례 리소스입니다.

BuildConfig는 특히 개발자 관점에서 애플리케이션의 일부이지만 일반적으로BuildConfig는 파이프라인을 통해 승격되지 않습니다. 파이프라인을 통해 승격된이미지(다른 항목과 함께)를 생성합니다. - 템플릿

-

애플리케이션 승격 측면에서

템플릿은 지정된 스테이징 환경에서 리소스를 설정하는 시작점으로, 특히 매개변수화 기능을 사용하여 사용할 수 있습니다. 추가 복원 후 변경은 애플리케이션이 승격 파이프라인을 통해 이동할 때에도 매우 신뢰할 수 있습니다. 이에 대한 자세한 내용은 시나리오 및 예제 를 참조하십시오. - 라우트

-

이는 경로를 통해 애플리케이션에 액세스하는 다양한 단계의 테스트로 인해 애플리케이션 승격 파이프라인에서 스테이징되는 가장 일반적인 리소스

입니다. 또한 수동 사양 또는 호스트 이름의 자동 생성 및경로의 HTTP 수준 보안과 관련된 옵션이 있습니다. - 서비스

-

지정된 애플리케이션 승격 단계(이전 단계에서 개별 개발자의 단순성을 위한 단순화를 위해 수행됨)에서 router 및

Routes가 발생하지 않도록 하는 이유가 있는 경우클러스터IP 주소와 포트를 통해 애플리케이션에 액세스할 수 있습니다.사용하는 경우 단계 간 주소와 포트의 일부 관리가 보증될 수 있습니다. - 끝점

-

특정 애플리케이션 수준 서비스(예: 많은 엔터프라이즈의 데이터베이스 인스턴스)는 OpenShift Container Platform에서 관리하지 않을 수 있습니다. 그렇다면 관련 서비스에 필요한 수정 사항과 함께 해당

엔드포인트를 직접 생성하는 경우(서비스의선택기 필드 제거)는 단계 간에 복제되거나 공유되는 활동입니다(사용자의 환경 설명에 따라). - 보안

-

Secrets에 의해 캡슐화된 중요한 정보는 해당 엔티티(OpenShift Container Platform에서 관리하는서비스또는 OpenShift Container Platform 외부에서 관리되는 외부 서비스)가 공유될 때 스테이징 환경 간에 공유됩니다. 애플리케이션 승격 파이프라인의 다른 단계에 언급된 엔티티의 다른 버전이 있는 경우 파이프라인의 각 단계에서 별도의 보안을 유지하거나 파이프라인을 통해 통과할 때 이를 수정해야 할 수 있습니다.또한 보안을 SCM에 JSON 또는 YAML로저장하는 경우 중요한 정보를 보호하기 위한 일부 암호화 형식이 보증될 수 있습니다. - DeploymentConfigs

- 이 오브젝트는 지정된 애플리케이션 승격 파이프라인 단계에 대한 환경을 정의하고 범위를 지정하는 기본 리소스입니다. 이는 애플리케이션이 시작되는 방식을 제어합니다. 모든 다른 단계에서 일반적인 측면이 있지만 애플리케이션 승격 파이프라인을 통해 진행되거나 각 단계의 환경의 차이점을 반영하기 위해 애플리케이션 승격 파이프라인을 통해 변경되거나 애플리케이션이 지원해야 하는 다양한 시나리오를 쉽게 테스트하기 위해 시스템의 동작 변경 사항이 있을 것입니다.

- 이미지 스트림, ImageStreamTag 및 ImageStreamImage

- 이미지 및 이미지 스트림 섹션에 자세히 설명된 이러한 오브젝트는 컨테이너 이미지 관리 관련 OpenShift Container Platform 추가의 핵심입니다.

- serviceaccounts 및 RoleBindings

-

OpenShift Container Platform 및 외부 서비스 내의 다른 API 오브젝트에 대한 권한 관리는 애플리케이션 관리에 기본적으로 있습니다.

Secrets와 유사하게ServiceAccounts및RoleBindings오브젝트는 서로 다른 환경을 공유하거나 분리해야 하는 요구 사항에 따라 애플리케이션 승격 파이프라인의 다양한 단계를 공유하는 방법에 따라 다를 수 있습니다. - PersistentVolumeClaims

- 데이터베이스와 같은 상태 저장 서비스 관련, 서로 다른 애플리케이션 승격 단계 간에 이러한 값을 공유하는 값은 조직이 애플리케이션 데이터의 복사본을 공유하는 방법과 직접 상관 관계가 있습니다.

- ConfigMaps

-

Pod 자체에서

PodPod동작이 필요한 경우 다양한 스테이징 환경에서 공유할 수 있습니다. 또한Pod동작을 변경하기 위해 단계 간에 수정할 수도 있습니다(일반적으로 애플리케이션의 다른 측면이 다른 단계에서 확인됨).

2.3.2.2. 이미지

앞에서 언급한 것처럼 컨테이너 이미지는 이제 애플리케이션의 아티팩트입니다. 실제로 새로운 애플리케이션 아티팩트, 이미지 및 이미지 관리가 애플리케이션 승격과 관련된 주요 요소입니다. 경우에 따라 이미지가 애플리케이션 전체를 캡슐화할 수 있으며 애플리케이션 승격 흐름은 이미지 관리만으로 구성됩니다.

이전 시스템에서 애플리케이션 바이너리가 아닌 것처럼 이미지는 일반적으로 SCM 시스템에서 관리되지 않습니다. 그러나 바이너리와 마찬가지로 설치 가능한 아티팩트 및 해당 리포지토리(예: RPM, RPM 리포지토리 또는 Nexus)는 SCM과 유사한 의미로 구성됩니다. 따라서 SCM과 유사한 이미지 관리에 대한 구성 및 용어가 나타납니다.

- 이미지 레지스트리 == SCM 서버

- 이미지 리포지토리 == SCM 리포지토리

이미지가 레지스트리에 있기 때문에 해당 이미지에 표시된 애플리케이션을 실행해야 하는 환경에서 액세스할 수 있는 레지스트리에 적절한 이미지가 있는지 확인하는 애플리케이션 승격과 관련이 있습니다.

애플리케이션 정의에서는 이미지를 직접 참조하지 않고 일반적으로 이미지 스트림에 참조를 추상화합니다. 즉, 이미지 스트림은 애플리케이션 구성 요소를 구성하는 다른 API 오브젝트가 됩니다. 이미지 스트림에 대한 자세한 내용은 핵심 개념을 참조하십시오.

2.3.2.3. 요약

이제 노트, 이미지 및 API 오브젝트의 애플리케이션 아티팩트가 OpenShift Container Platform 내에서 애플리케이션 승격 컨텍스트에 자세히 설명되었으므로 프로모션 파이프라인의 다양한 단계에서 애플리케이션을 실행하는 위치는 다음과 같습니다.

2.3.3. 배포 환경

이 컨텍스트에서 배포 환경은 CI/CD 파이프라인의 특정 단계에서 애플리케이션을 실행할 수 있는 별도의 공간을 설명합니다. 일반적인 환경에는 개발,테스트,단계, 프로덕션 이 포함됩니다. 환경 경계는 다음과 같은 다양한 방법으로 정의할 수 있습니다.

- 단일 프로젝트 내에서 레이블과 고유한 이름을 지정합니다.

- 클러스터 내의 개별 프로젝트를 통해.

- 서로 다른 클러스터를 통해

또한 귀하의 조직은 세 가지를 모두 활용할 수 있습니다.

2.3.3.1. 고려 사항

일반적으로 배포 환경을 구성하는 방법에 대한 자세한 내용은 다음과 같습니다.

- 승격 흐름의 다양한 단계를 공유하는 리소스 양을 허용합니다.

- 승격 흐름에 필요한 다양한 단계를 격리할 수 있습니다.

- 프로모션 흐름의 다양한 단계를 중앙에 위치(또는 지리적으로 분산)하는 방법

또한 OpenShift Container Platform 클러스터 및 프로젝트가 이미지 레지스트리와 관련된 방법에 대한 몇 가지 중요한 알림이 있습니다.

- 동일한 클러스터의 여러 프로젝트에서 동일한 이미지 스트림에 액세스할 수 있습니다.

- 여러 클러스터는 동일한 외부 레지스트리에 액세스할 수 있습니다.

- OpenShift Container Platform 내부 이미지 레지스트리가 경로를 통해 노출되는 경우에만 레지스트리를 공유할 수 있습니다.

2.3.3.2. 요약

배포 환경이 정의된 후 파이프라인 내 단계의 줄 바꿈이 있는 승격 흐름을 구현할 수 있습니다. 이러한 승격 흐름 구현을 구성하는 방법과 도구는 다음 설명의 지점입니다.

2.3.4. 방법 및 도구

근본적으로 애플리케이션 승격은 앞서 언급한 애플리케이션 구성 요소를 한 환경에서 다른 환경으로 이동하는 프로세스입니다. 다음 하위 섹션에서는 애플리케이션 승격 자동화에 대한 총체 솔루션에 대해 논의하기 전에 다양한 구성 요소를 직접 이동하는 데 사용할 수 있는 툴을 간략하게 설명합니다.

빌드 및 배포 프로세스 중 사용할 수 있는 삽입 지점이 많이 있습니다. BuildConfig 및 DeploymentConfig API 오브젝트 내에서 정의됩니다. 이러한 후크를 사용하면 데이터베이스와 같은 배포된 구성 요소 및 OpenShift Container Platform 클러스터 자체와 상호 작용할 수 있는 사용자 정의 스크립트를 호출할 수 있습니다.

따라서 후크를 사용하여 환경 간에 애플리케이션을 효과적으로 이동하는 구성 요소 관리 작업을 수행할 수 있습니다(예: 후크 내에서 이미지 태그 작업을 수행하여). 그러나 다양한 후크 포인트는 애플리케이션 구성 요소를 환경 간에 이동하는 대신 지정된 환경 내에서 애플리케이션의 라이프사이클을 관리하는 데 가장 적합합니다(예: 새 버전의 애플리케이션을 배포할 때 데이터베이스 스키마 마이그레이션을 수행하는 데 사용).

2.3.4.1. API 오브젝트 관리

한 환경에 정의된 리소스는 새 환경으로 가져오기 위해 JSON 또는 YAML 파일 내용으로 내보냅니다. 따라서 API 오브젝트의 표현식은 애플리케이션 파이프라인을 통해 API 오브젝트를 승격하는 작업의 단위 역할을 합니다. oc CLI는 이 콘텐츠를 내보내고 가져오는 데 사용됩니다.

파일에 저장된 JSON 또는 YAML을 사용하여 OpenShift Container Platform으로 승격 흐름을 승격할 필요는 없지만 SCM 시스템에서 콘텐츠를 저장하고 검색하는 것이 좋습니다. 이를 통해 분기 생성, 다양한 라벨 또는 버전 관련 태그 할당 및 쿼리 등 SCM의 버전 관리 관련 기능을 활용할 수 있습니다.

2.3.4.1.1. API 오브젝트 상태 내보내기

API 오브젝트 사양은 oc get --export 를 사용하여 캡처해야 합니다. 이 작업은 오브젝트 정의(예: 현재 네임스페이스 또는 할당된 IP 주소)에서 환경 특정 데이터를 제거하고 다른 환경에서 다시 생성할 수 있도록 합니다(예: oc get operations, which output an unfiltered state of the object).

API 오브젝트에서 레이블을 추가, 수정 또는 제거할 수 있는 oc 레이블은 단일 작업에서 Pod 그룹을 선택하고 관리할 수 있으므로 승격된 흐름을 위해 수집된 오브젝트 세트를 구성하는 데 유용할 수 있습니다. 이렇게 하면 올바른 오브젝트 세트를 내보내는 것이 더 쉬워집니다. 레이블은 새 환경에서 오브젝트가 생성될 때 전달되므로 각 환경에서 애플리케이션 구성 요소를 보다 쉽게 관리할 수 있습니다.

API 오브젝트에는 보안을 참조하는 DeploymentConfig 와 같은 참조가 포함되는 경우가 많습니다. 한 환경에서 다른 환경으로 API 오브젝트를 이동할 때 이러한 참조도 새 환경으로 이동해야 합니다.

마찬가지로 DeploymentConfig 와 같은 API 오브젝트에는 외부 레지스트리를 참조하는 ImageStreams 에 대한 참조가 포함되는 경우가 많습니다. 한 환경에서 다른 환경으로 API 오브젝트를 이동할 때 새 환경에서 해당 참조를 확인할 수 있는지 확인해야 합니다. 즉, 참조를 확인할 수 있어야 하며 ImageStream 은 새 환경에서 액세스 가능한 레지스트리를 참조해야 합니다. 자세한 내용은 Moving Images and Promotion Caveats 를 참조하십시오.

2.3.4.1.2. API 오브젝트 상태 가져오기

2.3.4.1.2.1. 초기 생성

애플리케이션이 새 환경에 처음 도입되는 경우 API 오브젝트의 사양을 나타내는 JSON 또는 YAML을 가져와서 oc create 를 실행하여 적절한 환경에서 생성할 수 있습니다. oc create 를 사용하는 경우 --save-config 옵션을 염두에 두십시오. 주석 목록에 있는 오브젝트의 구성 요소를 저장하면 나중에 oc apply 를 사용하여 오브젝트를 수정할 수 있습니다.

2.3.4.1.2.2. 반복적 수정

다양한 스테이징 환경이 처음 설정된 후 승격 주기가 시작되고 애플리케이션이 스테이지에서 스테이지로 이동하면 애플리케이션 업데이트에 애플리케이션의 일부인 API 오브젝트 수정이 포함될 수 있습니다. 이러한 API 오브젝트의 변경 사항은 OpenShift Container Platform 시스템의 구성을 나타내기 때문에 사용할 수 있습니다. 이러한 변경에 대한 동기 부여는 다음과 같습니다.

- 스테이징 환경 간의 환경 차이점을 설명합니다.

- 애플리케이션에서 지원하는 다양한 시나리오 확인.

API 오브젝트를 다음 단계의 환경으로 이전하는 것은 oc CLI를 사용하여 수행됩니다. API 오브젝트를 수정하는 다양한 oc 명령 세트가 있지만 이 주제에서는 오브젝트 간 차이를 계산하고 적용하는 oc apply 에 중점을 둡니다.

특히 oc apply 를 기존 오브젝트 정의와 함께 입력으로 파일 또는 stdin을 사용하는 3방향 병합으로 볼 수 있습니다. 이 명령은 3방향 병합을 수행합니다.

- 명령에 대한 입력,

- 오브젝트의 현재 버전 및

- 최근 사용자가 지정한 오브젝트 정의는 현재 오브젝트의 주석으로 저장됩니다.

그런 다음 기존 오브젝트가 결과로 업데이트됩니다.

오브젝트가 소스 및 대상 환경 간에 동일할 것으로 예상되지 않은 경우와 마찬가지로 API 오브젝트의 사용자 정의가 추가로 필요한 경우 와 같은 oc 명령을 사용하여 업스트림 환경에서 최신 오브젝트 정의를 적용한 후 오브젝트를 수정할 수 있습니다.

oc set

일부 특정 용도는 시나리오 및 예에 인용됩니다.

2.3.4.2. 이미지 및 이미지 스트림 관리

OpenShift Container Platform의 이미지는 일련의 API 오브젝트를 통해 관리됩니다. 그러나 이미지 관리는 대부분 툴과 API 오브젝트에 대한 토론을 애플리케이션 승격 및 이미지에 직접 연결하여 별도의 토론을 보증하는 애플리케이션 승격의 핵심입니다. 이미지 승격(파이프링을 통한 이미지 전파)을 관리하는 데 도움이 되는 수동 및 자동화된 양식이 있습니다.

2.3.4.2.1. 이미지 이동

이미지 관리와 관련된 모든 세부 사항의 경우 이미지 관리 주제를 참조하십시오.

2.3.4.2.1.1. 레지스트리 공유 환경 태그 지정

스테이징 환경에서 동일한 OpenShift Container Platform 레지스트리를 공유하는 경우(예: 동일한 OpenShift Container Platform 클러스터에 있는 경우) 애플리케이션 승격 파이프라인의 단계 간에 이미지를 이동하는 기본 방법 두 가지 작업이 있습니다.

-

먼저

docker tag및git태그와 유사하게oc tag명령을 사용하면 특정 이미지에 대한 참조로 OpenShift Container Platform 이미지 스트림을 업데이트할 수 있습니다. 또한 클러스터의 다른 프로젝트에서도 한 이미지 스트림에서 다른 이미지 스트림의 특정 버전의 이미지에 대한 참조를 복사할 수 있습니다. -

두 번째로

oc import-image는 외부 레지스트리와 이미지 스트림 간의 브리지 역할을 합니다. 레지스트리에서 지정된 이미지의 메타데이터를 가져와서 이미지 스트림 태그 로 저장합니다. 프로젝트의 다양한 BuildConfig및DeploymentConfigs는 이러한 특정 이미지를 참조할 수 있습니다.

2.3.4.2.1.2. 환경 태그 지정 시 다른 레지스트리 사용

스테이징 환경이 다른 OpenShift Container Platform 레지스트리를 활용하는 경우 고급 사용량이 발생합니다.

내부 레지스트리에 액세스하는 경우 단계에 대해 자세히 설명하지만 요약하면 다음과 같습니다.

-

docker로그인 명령에 제공할 OpenShift Container Platform 액세스 토큰을 가져오는 docker명령을 함께 사용하십시오. -

OpenShift Container Platform 레지스트리에 로그인한 후

docker pull,docker tag및docker push를 사용하여 이미지를 전송합니다. -

파이프라인의 다음 환경의 레지스트리에서 이미지를 사용할 수 있게 되면 필요에 따라

oc tag를 사용하여 이미지 스트림을 채웁니다.

2.3.4.2.2. 배포

기본 애플리케이션 이미지 또는 애플리케이션을 구성하는 API 오브젝트를 변경하면 일반적으로 승격된 변경 사항을 선택하는 데 배포가 필요합니다. 애플리케이션 이미지가 변경되는 경우(예: oc tag 작업 또는 업스트림 환경에서 이미지 승격의 일부로 docker push 로 인해) DeploymentConfig 의 ImageChangeTriggers 가 새 배포를 트리거할 수 있습니다. 마찬가지로 DeploymentConfig API 오브젝트 자체를 변경하는 경우 승격 단계에서 API 오브젝트를 업데이트할 때 ConfigChangeTrigger 가 배포를 시작할 수 있습니다(예: oc apply).

그렇지 않으면 수동 배포를 용이하게 하는 oc 명령은 다음과 같습니다.

-

oc rollout: 기록 관리와 관련된 의미 및 풍부한 기능을 일시 중지 및 재개하는 등 배포를 관리하는 새로운 접근 방식입니다. -

oc rollback: 이전 배포를 다시 실행할 수 있습니다. 승격 시나리오에서 새 버전 테스트에 문제가 발생하는 경우 이전 버전에서 계속 작동하는지 확인할 수 있습니다.

2.3.4.2.3. Jenkins를 사용하여 프로모션 흐름 자동화

승격할 때 환경 간에 이동해야 하는 애플리케이션 구성 요소와 구성 요소를 이동하는 데 필요한 단계를 이해한 후 워크플로를 오케스트레이션하고 자동화하기 시작할 수 있습니다. OpenShift Container Platform은 이 프로세스에 도움이 되는 Jenkins 이미지 및 플러그인을 제공합니다.

OpenShift Container Platform Jenkins 이미지는 Jenkins 및 Jenkins 파이프라인을 쉽게 통합할 수 있는 OpenShift Container Platform 중심 플러그인 세트를 포함하여 이미지 사용에 자세히 설명되어 있습니다. 또한 Pipeline 빌드 전략을 사용하면 Jenkins Pipeline과 OpenShift Container Platform 간의 통합이 용이해집니다. 이러한 모든 요소는 애플리케이션 승격을 포함하여 CI/CD의 다양한 측면을 활성화하는 데 중점을 둡니다.

애플리케이션 승격 단계가 수동 실행을 초과할 때 OpenShift Container Platform에서 제공하는 Jenkins 관련 기능을 염두에 두어야 합니다.

- OpenShift Container Platform은 OpenShift Container Platform 클러스터에서 쉽게 배포할 수 있도록 사용자 정의된 Jenkins 이미지를 제공합니다.

- Jenkins 이미지에는 승격 워크플로를 구현하기 위한 빌딩 블록을 제공하는 OpenShift 파이프라인 플러그인이 포함되어 있습니다. 이러한 빌드 블록에는 이미지 스트림이 변경될 때 Jenkins 작업 트리거 및 해당 작업 내의 빌드 및 배포가 트리거됩니다.

-

OpenShift Container Platform Jenkins Pipeline 빌드 전략을 사용하는

BuildConfig를 사용하면 Jenkinsfile 기반 Jenkins 파이프라인 작업을 실행할 수 있습니다. 파이프라인 작업은 복잡한 승격 흐름을 위한 Jenkins 내의 전략적 방향이며 OpenShift Pipeline 플러그인에서 제공하는 단계를 활용할 수 있습니다.

2.3.4.2.4. 프로모션 에스컬레이션

2.3.4.2.4.1. API 오브젝트 참조

API 오브젝트는 다른 오브젝트를 참조할 수 있습니다. 이에 대한 일반적인 사용은 이미지 스트림을 참조하는 DeploymentConfig가 있지만 다른 참조 관계도 존재할 수 있습니다.

한 환경에서 다른 환경으로 API 오브젝트를 복사할 때 대상 환경에서 모든 참조를 여전히 해결할 수 있어야 합니다. 고려해야 할 몇 가지 참조 시나리오가 있습니다.

- 참조는 프로젝트의 "local"입니다. 이 경우 참조된 오브젝트는 이를 참조하는 오브젝트와 동일한 프로젝트에 있습니다. 일반적으로 수행할 올바른 작업은 참조된 오브젝트를 참조하는 오브젝트와 동일한 프로젝트의 대상 환경에 복사해야 합니다.

이 참조는 다른 프로젝트의 오브젝트에 대한 참조입니다. 이는 여러 애플리케이션 프로젝트에서 공유 프로젝트의 이미지 스트림을 사용하는 경우가 일반적입니다. 이 경우 참조 오브젝트를 새 환경에 복사할 때 대상 환경에서 확인할 수 있도록 필요에 따라 참조를 업데이트해야 합니다. 이는 다음을 의미합니다.

- 대상 환경에서 공유 프로젝트에 다른 이름이 있는 경우 프로젝트 참조를 로 변경합니다.

- 참조된 오브젝트를 대상 환경의 로컬 프로젝트로 이동하고 기본 오브젝트를 대상 환경으로 이동할 때 로컬 프로젝트를 가리키도록 참조를 업데이트합니다.

- 참조된 오브젝트를 대상 환경에 복사하고 해당 참조를 업데이트하는 다른 조합입니다.

일반적으로 이 지침은 새 환경에 복사되는 개체에서 참조하는 오브젝트를 고려하고 대상 환경에서 참조를 확인할 수 있는지 확인하는 것입니다. 그렇지 않은 경우 해당 작업을 수행하여 참조를 수정하고 대상 환경에서 참조된 개체를 사용할 수 있도록 합니다.

2.3.4.2.4.2. 이미지 레지스트리 참조

이미지 스트림은 나타내는 이미지 소스를 나타내기 위해 이미지 리포지토리를 가리킵니다. 이미지 스트림이 한 환경에서 다른 환경으로 이동하는 경우 레지스트리 및 리포지토리 참조도 변경해야 하는지를 고려해야 합니다.

- 테스트 환경과 프로덕션 환경 간의 격리를 선언하는 데 다른 이미지 레지스트리를 사용하는 경우.

- 다른 이미지 리포지토리를 사용하여 테스트 및 프로덕션 준비 이미지를 분리합니다.

이러한 경우 이미지 스트림이 올바른 이미지로 확인되도록 소스 환경에서 대상 환경으로 복사할 때 이미지 스트림을 수정해야 합니다. 이는 시나리오 및 예제에 설명된 단계를 수행하여 하나의 레지스트리 및 리포지토리에서 다른 레지스트리로 이미지를 복사하는 것입니다.

2.3.4.3. 요약

이 시점에서 다음이 정의됩니다.

- 배포된 애플리케이션을 구성하는 새 애플리케이션 아티팩트입니다.

- OpenShift Container Platform에서 제공하는 툴 및 개념과 애플리케이션 승격 활동을 상관관계합니다.

- OpenShift Container Platform과 CI/CD 파이프라인 엔진 Jenkins 간 통합

OpenShift Container Platform 내에 애플리케이션 승격 흐름을 함께 작성하는 것이 이 항목의 마지막 단계입니다.

2.3.5. 시나리오 및 예

Docker, Kubernetes 및 OpenShift Container Platform 에코시스템에서 도입한 새 애플리케이션 아티팩트 구성 요소를 정의한 이 섹션에서는 OpenShift Container Platform에서 제공하는 메커니즘 및 툴을 사용하여 환경 간에 해당 구성 요소를 승격하는 방법을 설명합니다.

애플리케이션을 구성하는 구성 요소 중 이미지는 노트의 기본 아티팩트입니다. 이러한 온프레미스를 가져와서 애플리케이션 승격으로 확장하면 코어, 기본 애플리케이션 승격 패턴은 이미지 단위인 이미지 승격 패턴입니다. 대다수의 애플리케이션 승격 시나리오에는 승격 파이프라인을 통해 이미지의 관리 및 전파가 포함됩니다.

간단한 시나리오는 파이프라인을 통해 이미지 관리 및 전파만 처리합니다. 승격 시나리오가 범위를 넓기 때문에 다른 애플리케이션 아티팩트, 특히 API 오브젝트는 파이프라인을 통해 관리 및 전파되는 항목의 인벤토리에 포함됩니다.

이 주제에서는 수동 및 자동화된 접근 방식을 사용하여 이미지뿐만 아니라 API 오브젝트를 승격하는 방법에 대한 몇 가지 구체적인 예를 설명합니다. 그러나 먼저 애플리케이션 승격 파이프라인에 대한 환경 설정 시 다음 사항에 유의하십시오.

2.3.5.1. 프로모션 설정

애플리케이션의 초기 버전 개발을 완료한 후 다음 논리적 단계는 애플리케이션 내용을 패키지화하여 승격 파이프라인의 후속 스테이징 환경으로 전송할 수 있도록 하는 것입니다.

먼저 표시되는 모든 API 오브젝트를 전송 가능으로 그룹화하고 공통

레이블을 적용합니다.labels: promotion-group: <application_name>

앞에서 설명한 것처럼

oc label명령은 다양한 API 오브젝트를 사용하여 레이블을 쉽게 관리할 수 있습니다.작은 정보OpenShift Container Platform 템플릿에서 API 오브젝트를 처음 정의하는 경우 승격을 준비하기 위해 내보낼 때 쿼리하는 데 사용할 모든 관련 라벨이 공통 레이블이 있는지 쉽게 확인할 수 있습니다.

후속 쿼리에 해당 라벨을 활용할 수 있습니다. 예를 들어 애플리케이션의 API 오브젝트를 전송할 수 있는 다음

oc명령 호출 세트를 고려하십시오.$ oc login <source_environment> $ oc project <source_project> $ oc get -o yaml --export dc,is,svc,route,secret,sa -l promotion-group=<application_name> > export.yaml $ oc login <target_environment> $ oc new-project <target_project> 1 $ oc create -f export.yaml- 1

- 또는

oc project <target_project>가 이미 있는 경우.

참고oc get --export명령에 이미지 스트림의 유형이 포함되는지 여부는파이프라인의 다양한 환경에서 이미지, 이미지 스트림 및 레지스트리를 관리하는 방법에 따라 달라집니다. 이에 대한 경고는 아래에서 설명합니다. 이미지 관리 주제도 참조하십시오.또한 승격 파이프라인의 다른 스테이징 환경에서 사용되는 각 레지스트리에 대해 작동하는 데 필요한 토큰을 가져와야 합니다. 각 환경에 대해 다음을 수행합니다.

환경에 로그인합니다.

$ oc login <each_environment_with_a_unique_registry>

다음을 사용하여 액세스 토큰을 가져옵니다.

$ oc whoami -t

- 나중에 사용할 수 있도록 토큰 값을 복사하여 붙여넣습니다.

2.3.5.2. 반복 가능한 프로모션 프로세스

파이프라인에 대한 다른 스테이징 환경의 초기 설정 후 승격 파이프라인을 통해 각 애플리케이션 반복을 확인하는 반복 가능한 단계 세트가 시작될 수 있습니다. 이러한 기본 단계는 소스 환경의 이미지 또는 API 오브젝트가 변경될 때마다 수행됩니다.

업데이트된 이미지 이동 → 업데이트된 API 오브젝트 이동 → 환경별 사용자 정의 적용

일반적으로 첫 번째 단계는 애플리케이션과 관련된 모든 업데이트를 파이프라인의 다음 단계로 승격하는 것입니다. 위에서 언급했듯이 이미지 승격의 주요 차이점은 OpenShift Container Platform 레지스트리가 스테이징 환경 간에 공유되는지 여부입니다.

레지스트리가 공유되는 경우

oc tag를 사용하기만 하면 됩니다.$ oc tag <project_for_stage_N>/<imagestream_name_for_stage_N>:<tag_for_stage_N> <project_for_stage_N+1>/<imagestream_name_for_stage_N+1>:<tag_for_stage_N+1>

레지스트리가 공유되지 않은 경우 소스 및 대상 레지스트리 모두에 로그인하여 애플리케이션 이미지를 적절하게 가져오고 태그 지정, 푸시할 때 각 승격 파이프라인 레지스트리에 대한 액세스 토큰을 활용할 수 있습니다.

소스 환경 레지스트리에 로그인합니다.

$ docker login -u <username> -e <any_email_address> -p <token_value> <src_env_registry_ip>:<port>

애플리케이션 이미지를 가져옵니다.

$ docker pull <src_env_registry_ip>:<port>/<namespace>/<image name>:<tag>

대상 스테이징 환경을 준수하기 위해 필요에 따라 애플리케이션 이미지를 대상 레지스트리의 위치에 태그하고, 네임스페이스, 이름 및 태그를 업데이트합니다.

$ docker tag <src_env_registry_ip>:<port>/<namespace>/<image name>:<tag> <dest_env_registry_ip>:<port>/<namespace>/<image name>:<tag>

대상 스테이징 환경 레지스트리에 로그인합니다.

$ docker login -u <username> -e <any_email_address> -p <token_value> <dest_env_registry_ip>:<port>

이미지를 대상으로 푸시합니다.

$ docker push <dest_env_registry_ip>:<port>/<namespace>/<image name>:<tag>

작은 정보외부 레지스트리에서 이미지의 새 버전을 자동으로 가져오기 위해

oc tag명령에는--scheduled옵션이 있습니다. 사용하는 경우ImageStreamTag참조는 이미지를 호스팅하는 레지스트리에서 주기적으로 가져옵니다.

다음으로 애플리케이션의 진화는 API 오브젝트에 대한 근본적인 변경이나 애플리케이션을 구성하는 API 오브젝트 집합에서 추가 및 삭제되는 경우가 있습니다. 애플리케이션의 API 오브젝트에서 이러한 진화가 발생하면 OpenShift Container Platform CLI에서는 하나의 스테이징 환경에서 다음 단계로 변경 사항을 전송할 수 있는 다양한 옵션을 제공합니다.

승격 파이프라인을 처음 설정할 때 했던 것과 동일한 방식으로 시작하십시오.

$ oc login <source_environment> $ oc project <source_project> $ oc get -o yaml --export dc,is,svc,route,secret,sa -l promotion-group=<application_name> > export.yaml $ oc login <target_environment> $ oc <target_project>

새 환경에서 단순히 리소스를 생성하는 대신 해당 리소스를 업데이트합니다. 이 작업을 몇 가지 방법으로 수행할 수 있습니다.

보다 보수적인 접근 방식은

oc apply를 활용하고 대상 환경의 각 API 오브젝트에 새 변경 사항을 병합하는 것입니다. 이렇게 하면--dry-run=true옵션을 사용하여 실제로 오브젝트를 변경하기 전에 결과 오브젝트를 검사할 수 있습니다.$ oc apply -f export.yaml --dry-run=true

충족되면 실제로

apply명령을 실행합니다.$ oc apply -f export.yaml

apply명령은 더 복잡한 시나리오에 도움이 되는 추가 인수를 사용합니다. 자세한 내용은oc apply --help를 참조하십시오.또는 더 간단하면서도 공격적인 접근 방식은

oc replace를 활용하는 것입니다. 이 업데이트 및 교체 관련 예행은 없습니다. 가장 기본적인 방법에서는 다음을 실행합니다.$ oc replace -f export.yaml

apply와 마찬가지로,replace는 보다 정교한 동작에 대한 추가 인수를 사용합니다. 자세한 내용은oc replace --help를 참조하십시오.

-

이전 단계에서는 도입된 새 API 오브젝트를 자동으로 처리하지만 소스 환경에서 API 오브젝트가 삭제된 경우

oc delete를 사용하여 대상 환경에서 수동으로 삭제해야 합니다. API 오브젝트에 포함된 환경 변수 튜닝은 스테이징 환경마다 원하는 값이 다를 수 있으므로 필요할 수 있습니다. 이를 위해

oc set env를 사용하십시오.$ oc set env <api_object_type>/<api_object_ID> <env_var_name>=<env_var_value>

-

마지막으로

oc rollout명령을 사용하거나 위의 Deployments 섹션에서 설명하는 다른 메커니즘 중 하나를 사용하여 업데이트된 애플리케이션의 새 배포를 트리거합니다.

2.3.5.3. Jenkins를 사용하여 반복 가능한 프로모션 프로세스

OpenShift Container Platform의 Jenkins Docker 이미지에 정의된 OpenShift 샘플 작업은 Jenkins 구성 내의 OpenShift Container Platform 내에서 이미지 승격의 예입니다. 이 샘플의 설정은 OpenShift Origin 소스 리포지토리에 있습니다.

이 샘플에는 다음이 포함됩니다.

- Jenkins를 CI/CD 엔진으로 사용합니다.

-

Jenkins용 OpenShift Pipeline 플러그인을 사용합니다. 이 플러그인은 Jenkins Freestyle 및 DSL 작업 단계로 패키지된 OpenShift Container Platform용

ocCLI에서 제공하는 기능의 하위 집합을 제공합니다.oc바이너리는 OpenShift Container Platform의 Jenkins Docker 이미지에 포함되어 있으며 Jenkins 작업에서 OpenShift Container Platform과 상호 작용하는 데 사용할 수도 있습니다. - Jenkins를 위한 OpenShift Container Platform 제공 템플릿 임시 스토리지와 영구 스토리지를 위한 템플릿이 있습니다.

-

샘플 애플리케이션: OpenShift Origin 소스 리포지토리에 정의된 이 애플리케이션은 승격 파이프라인의 다른 단계에 해당하는

ImageStreams,ImageChangeTriggers,ImageStreamTags,BuildConfigs, separateDeploymentConfigs및Services를 활용합니다.

다음은 OpenShift 샘플 작업의 다양한 부분을 자세히 설명합니다.

-

첫 번째 단계는

oc scale dc --replicas=0호출과 동일합니다. 이 단계는 실행 중인 이전 버전의 애플리케이션 이미지를 가져오기 위한 것입니다. -

두 번째 단계는

oc start-build frontend호출과 동일합니다. -

세 번째 단계는

oc rollout 최신 dc/frontend호출과 동일합니다. - 네 번째 단계는 이 샘플의 "테스트"입니다. 이 애플리케이션의 관련 서비스가 네트워크 관점에서 실제로 액세스할 수 있도록 합니다. covers 아래에서 소켓 연결이 OpenShift Container Platform 서비스와 연결된 IP 주소 및 포트에 대해 시도됩니다. 물론 추가 테스트(OpenShift Pipepline 플러그인 단계를 통해 제공되지 않는 경우) Jenkins Shell 단계를 사용하여 애플리케이션을 테스트할 수 있습니다.

-

다섯 번째 단계는 애플리케이션 테스트가 통과했음을 가정하고, 따라서 이미지를 "ready"로 표시하려고 합니다. 이 단계에서는 최신 이미지에서 애플리케이션 이미지에 대한 새 prod 태그가 생성됩니다. 해당 태그에

ImageChangeTrigger가 정의된 frontendDeploymentConfig를 사용하면 해당 "production" 배포가 시작됩니다. - 여섯 번째 단계 및 마지막 단계는 플러그인에서 OpenShift Container Platform이 "프로덕션" 배포에 필요한 복제본 수를 시작했음을 확인하는 확인 단계입니다.

3장. 인증

3.1. 웹 콘솔 인증

<master_public_addr>:8443 의 브라우저에서 웹 콘솔에 액세스하는 경우 로그인 페이지로 자동 리디렉션됩니다.

웹 콘솔에 액세스하는 데 사용할 수 있는 브라우저 버전 및 운영 체제를 검토합니다.

이 페이지에서 로그인 인증 정보를 제공하여 API 호출을 위한 토큰을 가져올 수 있습니다. 로그인하면 웹 콘솔 을 사용하여 프로젝트를 탐색할 수 있습니다.

3.2. CLI 인증

CLI 명령 oc login 을 사용하여 명령줄에서 인증할 수 있습니다. 옵션 없이 이 명령을 실행하여 CLI를 시작할 수 있습니다.

$ oc login

명령의 대화형 흐름을 통해 제공된 인증 정보를 사용하여 OpenShift Container Platform 서버에 세션을 설정할 수 있습니다. OpenShift Container Platform 서버에 성공적으로 로그인하는 데 필요한 정보가 제공되지 않으면 명령에서 필요에 따라 사용자 입력을 묻는 메시지를 표시합니다. 구성이 자동으로 저장되고 모든 후속 명령에 사용됩니다.

명령 출력에 나열된 oc login 명령에 대한 모든 구성 옵션은 선택 사항입니다. 다음 예제에서는 몇 가지 일반적인 옵션이 있는 사용법을 보여줍니다.

oc login --help

$ oc login [-u=<username>] \ [-p=<password>] \ [-s=<server>] \ [-n=<project>] \ [--certificate-authority=</path/to/file.crt>|--insecure-skip-tls-verify]

다음 표에서는 이러한 일반적인 옵션을 설명합니다.

표 3.1. 일반적인 CLI 구성 옵션

| 옵션 | 구문 | 설명 |

|---|---|---|

|

|

$ oc login -s=<server> | OpenShift Container Platform 서버의 호스트 이름을 지정합니다. 이 플래그를 통해 서버가 제공되면 명령에서 대화형으로 요청하지 않습니다. 이 플래그는 이미 CLI 구성 파일이 있고 다른 서버로 로그인하여 전환하려는 경우에도 사용할 수 있습니다. |

|

|

$ oc login -u=<username> -p=<password> | OpenShift Container Platform 서버에 로그인할 인증 정보를 지정할 수 있습니다. 이러한 플래그를 통해 사용자 이름 또는 암호를 제공하면 명령에서 대화형으로 요청하지 않습니다. 이러한 플래그는 세션 토큰이 설정된 구성 파일이 이미 있고 다른 사용자 이름으로 로그인하여 전환하려는 경우에도 사용할 수 있습니다. |

|

|

$ oc login -u=<username> -p=<password> -n=<project> |

|

|

|

$ oc login --certificate-authority=<path/to/file.crt> | HTTPS를 사용하는 OpenShift Container Platform 서버로 정확하고 안전하게 인증합니다. 인증 기관 파일의 경로를 제공해야 합니다. |

|

|

$ oc login --insecure-skip-tls-verify |

서버 인증서 확인을 바이패스하는 HTTPS 서버와의 상호 작용을 허용하지만 안전하지 않음에 유의하십시오. 유효한 인증서를 제공하지 않는 HTTPS 서버에 |

CLI 구성 파일을 사용하면 여러 CLI 프로필을 쉽게 관리할 수 있습니다.

관리자 자격 증명에 액세스할 수 있지만 더 이상 기본 시스템 사용자 system:admin 으로 로그인하지 않은 경우 CLI 구성 파일에 인증 정보가 계속 있는 한 언제든지 이 사용자로 다시 로그인할 수 있습니다. 다음 명령은 기본 프로젝트에 로그인하여 전환합니다.

$ oc login -u system:admin -n default

4장. 권한 부여

4.1. 개요

이 주제에는 클러스터 관리자가 지정하는 대로 애플리케이션 개발자 및 해당 기능에 대한 권한 부여 작업이 포함되어 있습니다.

4.2. 사용자가 Pod를 만들 수 있는지 확인

scc-review 및 scc-subject-review 옵션을 사용하여 개별 사용자 또는 특정 서비스 계정에서 사용자가 Pod를 생성하거나 업데이트할 수 있는지 확인할 수 있습니다.

scc-review 옵션을 사용하여 서비스 계정에서 Pod를 생성하거나 업데이트할 수 있는지 확인할 수 있습니다. 명령은 리소스를 허용하는 보안 컨텍스트 제약 조건을 출력합니다.

예를 들어 system:serviceaccount:projectname:default 서비스 계정이 있는 사용자가 Pod를 생성할 수 있는지 확인하려면 다음을 수행합니다.

$ oc policy scc-review -z system:serviceaccount:projectname:default -f my_resource.yaml

scc-subject-review 옵션을 사용하여 특정 사용자가 Pod를 생성하거나 업데이트할 수 있는지 확인할 수도 있습니다.

$ oc policy scc-subject-review -u <username> -f my_resource.yaml

특정 그룹에 속하는 사용자가 특정 파일에 Pod를 생성할 수 있는지 확인하려면 다음을 수행합니다.

$ oc policy scc-subject-review -u <username> -g <groupname> -f my_resource.yaml

4.3. 인증된 사용자로 수행할 수 있는 작업 확인

OpenShift Container Platform 프로젝트 내에서 모든 네임스페이스 범위 리소스(타사 리소스 포함)에 대해 수행할 수 있는 동사 를 확인할 수 있습니다.

can-i 명령 옵션은 사용자 및 역할의 범위를 테스트합니다.

$ oc policy can-i --list --loglevel=8

출력을 통해 정보를 수집하기 위해 필요한 API 요청을 결정하는 데 도움이 됩니다.

사용자가 읽을 수 있는 형식으로 다시 정보를 받으려면 다음을 실행합니다.

$ oc policy can-i --list

출력은 전체 목록을 제공합니다.

특정 동사를 수행할 수 있는지 확인하려면 다음을 실행합니다.

$ oc policy can-i <verb> <resource>

사용자 범위는 지정된 범위에 대한 자세한 정보를 제공할 수 있습니다. 예를 들면 다음과 같습니다.

$ oc policy can-i <verb> <resource> --scopes=user:info

5장. 프로젝트

5.1. 개요

사용자 커뮤니티는 프로젝트를 통해 다른 커뮤니티와 별도로 콘텐츠를 구성하고 관리할 수 있습니다.

5.2. 프로젝트 생성

클러스터 관리자가 허용하는 경우 CLI 또는 웹 콘솔 을 사용하여 새 프로젝트를 생성할 수 있습니다.

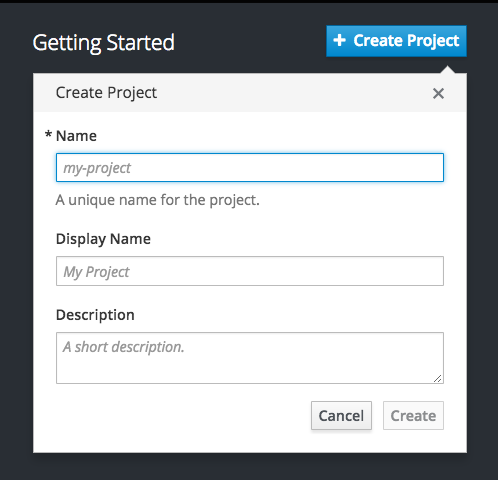

5.2.1. 웹 콘솔 사용

웹 콘솔을 사용하여 새 프로젝트를 생성하려면 프로젝트 패널 또는 프로젝트 페이지에서 프로젝트 생성 버튼을 클릭합니다.

Create Project (프로젝트 만들기) 버튼은 기본적으로 표시되지만 선택적으로 숨겨지거나 사용자 지정할 수 있습니다.

5.2.2. CLI 사용

CLI를 사용하여 새 프로젝트를 생성하려면 다음을 수행합니다.

$ oc new-project <project_name> \

--description="<description>" --display-name="<display_name>"예를 들면 다음과 같습니다.

$ oc new-project hello-openshift \

--description="This is an example project to demonstrate OpenShift v3" \

--display-name="Hello OpenShift"작성할 수 있는 프로젝트 수는 시스템 관리자가 제한할 수 있습니다. 제한에 도달하면 새 프로젝트를 생성하려면 기존 프로젝트를 삭제해야 할 수 있습니다.

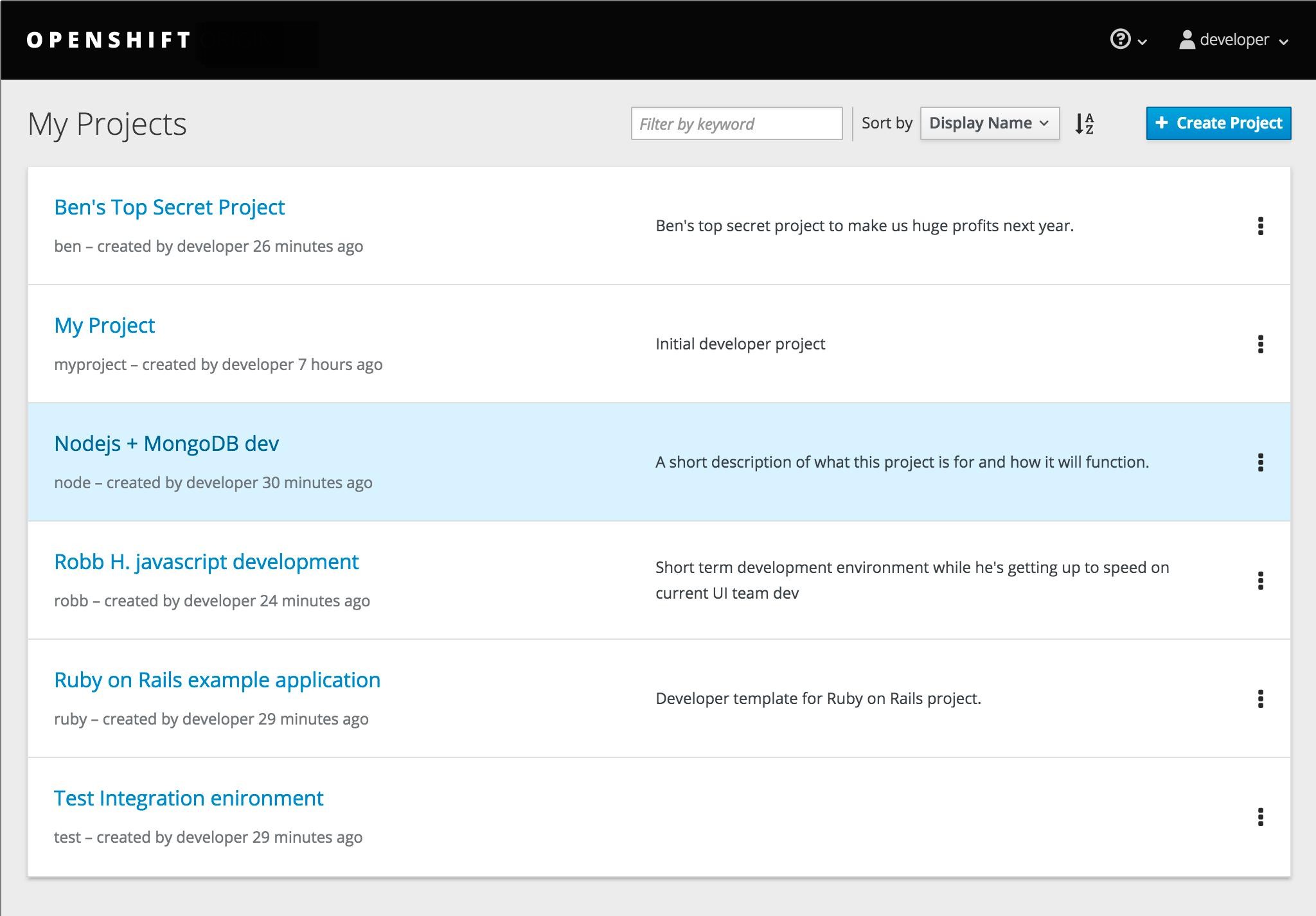

5.3. 프로젝트 보기

프로젝트를 볼 때 권한 부여 정책에 따라 볼 수 있는 액세스 권한이 있는 프로젝트만 볼 수 있습니다.

프로젝트 목록을 보려면 다음을 수행합니다.

$ oc get projects

CLI 작업을 위해 현재 프로젝트에서 다른 프로젝트로 변경할 수 있습니다. 그러면 지정된 프로젝트가 프로젝트 범위의 콘텐츠를 조작하는 모든 후속 작업에서 사용됩니다.

$ oc project <project_name>

웹 콘솔 을 사용하여 프로젝트를 보고 변경할 수도 있습니다. 인증 및 로그인한 후 액세스 권한이 있는 프로젝트 목록이 표시됩니다.

서비스 카탈로그와 함께 표시된 오른쪽 패널은 가장 최근에 액세스하는 프로젝트(최대 5개의 프로젝트)에 빠르게 액세스할 수 있습니다. 전체 프로젝트 목록은 오른쪽 패널 상단에 제공된 View All 링크를 사용합니다.

CLI를 사용하여 새 프로젝트를 생성하는 경우 브라우저의 페이지를 새로 고침하여 새 프로젝트를 볼 수 있습니다.

프로젝트를 선택하면 해당 프로젝트의 프로젝트 개요 가 표시됩니다.

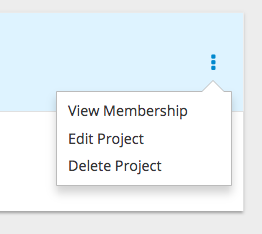

특정 프로젝트의 kebab 메뉴를 클릭하면 다음 옵션이 표시됩니다.

5.4. 프로젝트 상태 확인

oc status 명령은 현재 프로젝트에 대한 상위 수준 개요와 해당 구성 요소 및 해당 관계를 제공합니다. 이 명령은 인수를 사용하지 않습니다.

$ oc status

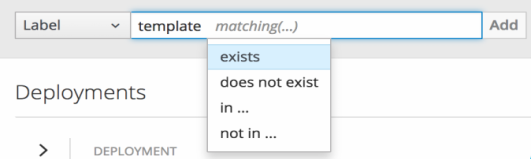

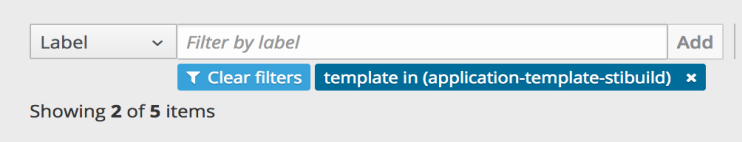

5.5. 라벨로 필터링

리소스 레이블 을 사용하여 웹 콘솔에서 프로젝트 페이지 내용을 필터링할 수 있습니다. 제안된 레이블 이름과 값을 선택하거나 직접 입력할 수 있습니다. 여러 개의 필터를 추가할 수 있습니다. 여러 필터가 적용되면 리소스가 모든 필터와 일치하여 표시되게 해야 합니다.

라벨로 필터링하려면 다음을 수행합니다.

레이블 유형 선택:

다음 명령 중 하나를 선택합니다.

존재하는

레이블 이름이 존재하지만 해당 값은 무시합니다.

존재하지 않음

레이블 이름이 존재하지 않지만 해당 값은 무시합니다.

in

레이블 이름이 존재하고 선택한 값 중 하나와 같은지 확인합니다.

제공되지 않음

레이블 이름이 존재하지 않거나 선택한 값과 일치하지 않는지 확인합니다.

에서 선택하거나 그렇지 않은 경우 값 집합을 선택한 다음 필터 를 선택합니다.

필터를 추가한 후 모든 필터 지우기를 선택하거나 개별 필터를 클릭하여 필터링을 중지할 수 있습니다.

5.6. 페이지 상태 표시

OpenShift Container Platform 웹 콘솔에서 는 레이블 필터 및 기타 설정을 저장하는 데 도움이 되는 페이지 상태 표시를 확인합니다.

탭 간 전환과 같이 페이지 상태를 변경하기 위해 작업을 수행하면 브라우저의 탐색 표시줄의 URL이 자동으로 업데이트됩니다.

5.7. 프로젝트 삭제

프로젝트를 삭제하면 서버에서 프로젝트 상태를 활성에서 종료로 업데이트합니다. 그러면 서버는 프로젝트를 완전히 제거하기 전에 종료 중인 프로젝트의 모든 콘텐츠를 지웁니다. 프로젝트 상태가 종료인 동안에는 프로젝트에 새 콘텐츠를 추가할 수 없습니다. CLI 또는 웹 콘솔에서 프로젝트를 삭제할 수 있습니다.

CLI를 사용하여 프로젝트를 삭제하려면 다음을 수행합니다.

$ oc delete project <project_name>

6장. 애플리케이션 마이그레이션

6.1. 개요

이 주제에서는 OpenShift 버전 2(v2) 애플리케이션의 마이그레이션 절차를 OpenShift 버전 3(v3)으로 마이그레이션하는 방법에 대해 설명합니다.

이 주제에서는 OpenShift v2에 고유한 일부 용어를 사용합니다. OpenShift Enterprise 2와 OpenShift Enterprise 3를 비교하면 두 버전과 사용되는 언어의 차이점을 파악할 수 있습니다.

OpenShift v2 애플리케이션을 OpenShift Container Platform v3로 마이그레이션하려면 v2 애플리케이션의 모든 토너너는 OpenShift Container Platform v3의 해당 이미지 또는 템플릿과 동일하며 개별적으로 마이그레이션해야 하므로 v2 애플리케이션 내의 모든 테트리너를 기록해야 합니다. 각 토너트의 경우 모든 종속 항목 또는 필수 패키지도 v3 이미지에 포함되어야 하므로 기록해야 합니다.

일반 마이그레이션 절차는 다음과 같습니다.

v2 애플리케이션을 백업합니다.

- 웹 다이제스트: 소스 코드는 GitHub의 리포지토리로 푸시하는 등의 Git 리포지토리로 백업할 수 있습니다.

-

데이터베이스 토너: 데이터베이스는 덤프 명령(

mongodump,mysqldump,pg_dump)을 사용하여 데이터베이스를 백업할 수 있습니다. 웹 및 데이터베이스 토너리트:

rhc클라이언트 툴에서는 여러 개의 토너리를 백업할 수 있는 스냅샷 기능을 제공합니다.$ rhc snapshot save <app_name>

스냅샷은 압축을 풀 수 있는 tar 파일이며, 해당 내용은 애플리케이션 소스 코드와 데이터베이스 덤프입니다.

- 애플리케이션에 데이터베이스 리셀러가 있는 경우 v3 데이터베이스 애플리케이션을 생성하고 데이터베이스 덤프를 새 v3 데이터베이스 애플리케이션의 Pod에 동기화한 다음 database restore 명령을 사용하여 v3 데이터베이스 애플리케이션의 v2 데이터베이스를 복원합니다.

- 웹 프레임워크 애플리케이션의 경우 애플리케이션 소스 코드를 편집하여 v3와 호환되도록 합니다. 그런 다음 Git 리포지토리의 해당 파일에 필요한 종속 항목 또는 패키지를 추가합니다. v2 환경 변수를 해당 v3 환경 변수로 변환합니다.

- 소스( Git 리포지토리)에서 v3 애플리케이션을 생성하거나 Git URL을 사용하여 퀵 스타트에서 생성합니다. 또한 데이터베이스 서비스 매개 변수를 새 애플리케이션에 추가하여 데이터베이스 애플리케이션을 웹 애플리케이션에 연결합니다.

- v2에는 통합 Git 환경과 애플리케이션이 v2 Git 리포지토리로 변경될 때마다 애플리케이션이 자동으로 다시 빌드 및 다시 시작됩니다. v3에서 공개 Git 리포지토리로 푸시된 소스 코드 변경으로 인해 빌드가 자동으로 트리거되도록 하려면 v3의 초기 빌드가 완료된 후 웹 후크 를 설정해야 합니다.

6.2. 데이터베이스 애플리케이션 마이그레이션

6.2.1. 개요

이 주제에서는 MySQL, PostgreSQL 및 MongoDB 데이터베이스 애플리케이션을 OpenShift 버전 2(v2)에서 OpenShift 버전 3(v3)으로 마이그레이션하는 방법을 검토합니다.

6.2.2. 지원되는 데이터베이스

| v2 | v3 |

|---|---|

| MongoDB: 2.4 | MongoDB: 2.4, 2.6 |

| MySQL: 5.5 | MySQL: 5.5, 5.6 |

| PostgreSQL: 9.2 | PostgreSQL: 9.2, 9.4 |

6.2.3. MySQL

모든 데이터베이스를 덤프 파일로 내보내고 로컬 시스템(현재 디렉토리에 있음)에 복사합니다.

$ rhc ssh <v2_application_name> $ mysqldump --skip-lock-tables -h $OPENSHIFT_MYSQL_DB_HOST -P ${OPENSHIFT_MYSQL_DB_PORT:-3306} -u ${OPENSHIFT_MYSQL_DB_USERNAME:-'admin'} \ --password="$OPENSHIFT_MYSQL_DB_PASSWORD" --all-databases > ~/app-root/data/all.sql $ exit로컬 머신으로 dbdump 를 다운로드합니다.

$ mkdir mysqldumpdir $ rhc scp -a <v2_application_name> download mysqldumpdir app-root/data/all.sql

템플릿에서 v3 mysql-persistent Pod를 생성합니다.

$ oc new-app mysql-persistent -p \ MYSQL_USER=<your_V2_mysql_username> -p \ MYSQL_PASSWORD=<your_v2_mysql_password> -p MYSQL_DATABASE=<your_v2_database_name>

Pod를 사용할 준비가 되었는지 확인합니다.

$ oc get pods

Pod가 실행 중이고 실행되면 데이터베이스 아카이브 파일을 v3 MySQL 포드에 복사합니다.

$ oc rsync /local/mysqldumpdir <mysql_pod_name>:/var/lib/mysql/data

실행 중인 v3 Pod에서 데이터베이스를 복원합니다.

$ oc rsh <mysql_pod> $ cd /var/lib/mysql/data/mysqldumpdir

v3에서 데이터베이스를 복원하려면 root 사용자로 MySQL에 액세스해야 합니다.

v2에서

$OPENSHIFT_MYSQL_DB_USERNAME은 모든 데이터베이스에 대한 전체 권한이 있습니다. v3에서는 각 데이터베이스에 대해$MYSQL_USER에 권한을 부여해야 합니다.$ mysql -u root $ source all.sql

<dbname> 에 대한 모든 권한을

<your_v2_username>@localhost에 부여한 다음 권한을 플러시합니다.Pod에서 덤프 디렉터리를 제거합니다.

$ cd ../; rm -rf /var/lib/mysql/data/mysqldumpdir

지원되는 MySQL 환경 변수

| v2 | v3 |

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| |

|

| |

|

| |

|

| |

|

| |

|

|

6.2.4. PostgreSQL

툴바이크에서 v2 PostgreSQL 데이터베이스를 백업합니다.

$ rhc ssh -a <v2-application_name> $ mkdir ~/app-root/data/tmp $ pg_dump <database_name> | gzip > ~/app-root/data/tmp/<database_name>.gz

백업 파일을 로컬 시스템으로 다시 추출합니다.

$ rhc scp -a <v2_application_name> download <local_dest> app-root/data/tmp/<db-name>.gz $ gzip -d <database-name>.gz

참고4단계에 대해 백업 파일을 별도의 폴더에 저장합니다.

v2 애플리케이션 데이터베이스 이름, 사용자 이름 및 암호를 사용하여 PostgreSQL 서비스를 생성하여 새 서비스를 생성합니다.

$ oc new-app postgresql-persistent -p POSTGRESQL_DATABASE=dbname -p POSTGRESQL_PASSWORD=password -p POSTGRESQL_USER=username

Pod를 사용할 준비가 되었는지 확인합니다.

$ oc get pods

Pod가 가동되어 실행되면 백업 디렉터리를 Pod에 동기화합니다.

$ oc rsync /local/path/to/dir <postgresql_pod_name>:/var/lib/pgsql/data

Pod에 원격으로 액세스합니다.

$ oc rsh <pod_name>

데이터베이스를 복원합니다.

psql dbname < /var/lib/pgsql/data/<database_backup_file>

더 이상 필요하지 않은 백업 파일을 모두 제거합니다.

$ rm /var/lib/pgsql/data/<database-backup-file>

지원되는 PostgreSQL 환경 변수

| v2 | v3 |

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

|

6.2.5. MongoDB

- For OpenShift v3: MongoDB 쉘 버전 3.2.6

- For OpenShift v2: MongoDB 쉘 버전 2.4.9

ssh명령을 통해 v2 애플리케이션에 원격으로 액세스합니다.$ rhc ssh <v2_application_name>

-d <database_name> -c <collections>으로 단일 데이터베이스를 지정하여 mongodump 를 실행합니다. 이러한 옵션이 없으면 모든 데이터베이스를 덤프합니다. 각 데이터베이스는 자체 디렉터리에서 덤프됩니다.$ mongodump -h $OPENSHIFT_MONGODB_DB_HOST -o app-root/repo/mydbdump -u 'admin' -p $OPENSHIFT_MONGODB_DB_PASSWORD $ cd app-root/repo/mydbdump/<database_name>; tar -cvzf dbname.tar.gz $ exit

mongodump 디렉터리의 로컬 머신으로 dbdump 를 다운로드합니다.

$ mkdir mongodump $ rhc scp -a <v2 appname> download mongodump \ app-root/repo/mydbdump/<dbname>/dbname.tar.gz

v3에서 MongoDB 포드를 시작합니다. 최신 이미지(3.2.6)에는 mongo-tools,

mongorestore또는mongoimport명령을 사용하려면mongo-tools, "mongodb:2.4"가 포함된 이미지 태그를 지정하기 위해 기본 mongodb-persistent 템플릿을 편집해야 합니다. 따라서 다음oc get --export명령 및 편집이 필요합니다.$ oc get -o json --export template mongodb-persistent -n openshift > mongodb-24persistent.json

mongodb-24persistent.json 의 L80을 편집하고

mongodb:latest를mongodb:2.4로 바꿉니다.$ oc new-app --template=mongodb-persistent -n <project-name-that-template-was-created-in> \ MONGODB_USER=user_from_v2_app -p \ MONGODB_PASSWORD=password_from_v2_db -p \ MONGODB_DATABASE=v2_dbname -p \ MONGODB_ADMIN_PASSWORD=password_from_v2_db $ oc get pods

mongodb 포드가 가동되어 실행되면 데이터베이스 아카이브 파일을 v3 MongoDB Pod에 복사합니다.

$ oc rsync local/path/to/mongodump <mongodb_pod_name>:/var/lib/mongodb/data $ oc rsh <mongodb_pod>

MongoDB 포드에서 복원하려는 각 데이터베이스에 대해 다음을 완료합니다.

$ cd /var/lib/mongodb/data/mongodump $ tar -xzvf dbname.tar.gz $ mongorestore -u $MONGODB_USER -p $MONGODB_PASSWORD -d dbname -v /var/lib/mongodb/data/mongodump

데이터베이스가 복원되었는지 확인합니다.

$ mongo admin -u $MONGODB_USER -p $MONGODB_ADMIN_PASSWORD $ use dbname $ show collections $ exit

Pod에서 mongodump 디렉터리를 제거합니다.

$ rm -rf /var/lib/mongodb/data/mongodump

지원되는 MongoDB 환경 변수

| v2 | v3 |

|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

| |

|

|

6.3. 웹 프레임워크 애플리케이션 마이그레이션

6.3.1. 개요

이 주제에서는 Python, Ruby, PHP, Perl, Node.js, WordPress, Ghost, JBoss EAP, JBoss WS(Tomcat) 및 Wildfly 10(JBoss AS) 웹 프레임워크 애플리케이션을 OpenShift 버전 2(v2)에서 OpenShift 버전 3(v3)으로 마이그레이션하는 방법을 검토합니다.

6.3.2. Python

새 GitHub 리포지토리를 설정하고 현재 로컬 v2 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>.git

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

setup.py, wsgi.py, requirements.txt 등 과 같은 중요한 파일이 모두 새 리포지토리로 푸시되었는지 확인하십시오.

- 애플리케이션에 필요한 모든 패키지가 requirements.txt 에 포함되어 있는지 확인합니다.

oc명령을 사용하여 빌더 이미지 및 소스 코드에서 새 Python 애플리케이션을 시작합니다.$ oc new-app --strategy=source python:3.3~https://github.com/<github-id>/<repo-name> --name=<app-name> -e <ENV_VAR_NAME>=<env_var_value>

지원되는 Python 버전

| v2 | v3 |

|---|---|

| python: 2.6, 2.7, 3.3 | |

| Django | Django-psql-example (quickstart) |

6.3.3. Ruby

새 GitHub 리포지토리를 설정하고 현재 로컬 v2 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>.git

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

Gemfile이 없고 간단한 랙 애플리케이션을 실행 중인 경우 이 Gemfile을 소스의 루트에 복사합니다.

https://github.com/sclorg/ruby-ex/blob/master/Gemfile

참고Ruby 2.0을 지원하는 랙 gem의 최신 버전은 1.6.4이므로 Gemfile을

gem 'rack', "1.6.4"로 수정해야 합니다.Ruby 2.2 이상에서는 랙 gem 2.0 이상을 사용하십시오.

oc명령을 사용하여 빌더 이미지 및 소스 코드에서 새 Ruby 애플리케이션을 시작합니다.$ oc new-app --strategy=source ruby:2.0~https://github.com/<github-id>/<repo-name>.git

지원되는 Ruby 버전

| v2 | v3 |

|---|---|

| ruby: 1.8, 1.9, 2.0 | |

| Ruby on Rails: 3, 4 | Rails-postgresql-example(quickstart) |

| Sinatra |

6.3.4. PHP

새 GitHub 리포지토리를 설정하고 현재 로컬 v2 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

oc명령을 사용하여 빌더 이미지 및 소스 코드에서 새 PHP 애플리케이션을 시작합니다.$ oc new-app https://github.com/<github-id>/<repo-name>.git --name=<app-name> -e <ENV_VAR_NAME>=<env_var_value>

지원되는 PHP 버전

| v2 | v3 |

|---|---|

| PHP: 5.3, 5.4 | |

| PHP 5.4 with Zend Server 6.1 | |

| CodeIgniter 2 | |

| HHVM | |

| Laravel 5.0 | |

| CakePHP-mysql-example (quickstart) |

6.3.5. Perl

새 GitHub 리포지토리를 설정하고 현재 로컬 v2 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

로컬 Git 리포지토리를 편집하고 변경 사항을 업스트림으로 내보내 v3와 호환되도록 합니다.

v2에서 CPAN 모듈은 .openshift/cpan.txt 에 있습니다. v3에서 s2i 빌더는 소스의 루트 디렉터리에서 cpanfile 이라는 파일을 찾습니다.

$ cd <local-git-repository> $ mv .openshift/cpan.txt cpanfile

약간 다른 형식이 있으므로 cpanfile을 편집합니다.

cpanfile 형식 cpan.txt 형식 requires ‘cpan::mod’;

cpan::mod

'Dancer'가 필요합니다.

dar

'YAML' 필요

YAML

.openshift 디렉토리 제거

참고v3에서는 action_hooks 및 cron 작업이 동일한 방식으로 지원되지 않습니다. 자세한 내용은 Action Hooks for more information를 참조하십시오.

-

oc명령을 사용하여 빌더 이미지 및 소스 코드에서 새 Perl 애플리케이션을 시작합니다.

$ oc new-app https://github.com/<github-id>/<repo-name>.git

지원되는 Perl 버전

| v2 | v3 |

|---|---|

| perl: 5.10 | |

| dancer-mysql-example (quickstart) |

6.3.6. Node.js

새 GitHub 리포지토리를 설정하고 현재 로컬 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

로컬 Git 리포지토리를 편집하고 변경 사항을 업스트림으로 내보내 v3와 호환되도록 합니다.

.openshift 디렉터리를 제거합니다.

참고v3에서는 action_hooks 및 cron 작업이 동일한 방식으로 지원되지 않습니다. 자세한 내용은 Action Hooks for more information를 참조하십시오.

server.js 를 편집합니다.

- L116 server.js: 'self.app = express();'

- L25 server.js: self.ipaddress = '0.0.0.0';

L26 server.js: self.port = 8080;

참고라인(L)은 기본 V2 타겟 서버.js .js 에서 가져온 것입니다.

oc명령을 사용하여 빌더 이미지 및 소스 코드에서 새 Node.js 애플리케이션을 시작합니다.$ oc new-app https://github.com/<github-id>/<repo-name>.git --name=<app-name> -e <ENV_VAR_NAME>=<env_var_value>

지원되는 Node.js 버전

| v2 | v3 |

|---|---|

| Node.js 0.10 | |

| nodejs-mongodb-example. 이 빠른 시작 템플릿은 Node.js 버전 6만 지원합니다. |

6.3.7. WordPress

현재 WordPress 애플리케이션을 마이그레이션하는 지원은 Red Hat 지원이 아닌 커뮤니티에서 제공합니다.

WordPress 애플리케이션을 OpenShift Container Platform v3로 마이그레이션하는 방법에 대한 자세한 내용은 OpenShift 블로그를 참조하십시오.

6.3.8. 유감스럽

현재 Ghost 애플리케이션 마이그레이션 지원은 Red Hat이 지원하는 것이 아니라 커뮤니티에서만 제공합니다.

Ghost 애플리케이션을 OpenShift Container Platform v3로 마이그레이션하는 방법에 대한 자세한 내용은 OpenShift 블로그를 참조하십시오.

6.3.9. JBoss EAP

새 GitHub 리포지토리를 설정하고 현재 로컬 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

- 리포지토리에 사전 빌드된 .war 파일이 포함된 경우 배포 디렉터리에 리포지토리의 루트 디렉터리가 있어야 합니다.

JBoss EAP 7 빌더 이미지(jboss-eap70-openshift) 및 GitHub의 소스 코드 리포지토리를 사용하여 새 애플리케이션을 생성합니다.

$ oc new-app --strategy=source jboss-eap70-openshift:1.6~https://github.com/<github-id>/<repo-name>.git

6.3.10. JBoss WS(Tomcat)

새 GitHub 리포지토리를 설정하고 현재 로컬 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

- 리포지토리에 사전 빌드된 .war 파일이 포함된 경우 배포 디렉터리에 리포지토리의 루트 디렉터리가 있어야 합니다.

JBoss Web Server 3(Tomcat 7) 빌더 이미지(jboss-webserver30-tomcat7)와 GitHub의 소스 코드 리포지토리를 사용하여 새 애플리케이션을 생성합니다.

$ oc new-app --strategy=source jboss-webserver30-tomcat7-openshift~https://github.com/<github-id>/<repo-name>.git --name=<app-name> -e <ENV_VAR_NAME>=<env_var_value>

6.3.11. JBoss AS(Wildfly 10)

새 GitHub 리포지토리를 설정하고 현재 로컬 Git 리포지토리에 원격 분기로 추가합니다.

$ git remote add <remote-name> https://github.com/<github-id>/<repo-name>

로컬 v2 소스 코드를 새 리포지토리로 내보냅니다.

$ git push -u <remote-name> master

로컬 Git 리포지토리를 편집하고 변경 사항을 업스트림으로 내보내 v3와 호환되도록 합니다.

.openshift 디렉토리를 제거합니다.

참고v3에서는 action_hooks 및 cron 작업이 동일한 방식으로 지원되지 않습니다. 자세한 내용은 Action Hooks for more information를 참조하십시오.

- 소스 리포지토리의 루트에 배포 디렉터리를 추가합니다. .war 파일을 'deployments' 디렉터리로 이동합니다.

oc명령을 사용하여 빌더 이미지 및 소스 코드에서 새 Wildfly 애플리케이션을 시작합니다.$ oc new-app https://github.com/<github-id>/<repo-name>.git --image-stream=”openshift/wildfly:10.0" --name=<app-name> -e <ENV_VAR_NAME>=<env_var_value>

참고인수

--name은 애플리케이션 이름을 지정하는 선택 사항입니다. 인수-e는 빌드 및 배포 프로세스에 필요한 환경 변수 (예:OPENSHIFT_PYTHON_DIR)를 추가하기 위한 선택 사항입니다.

6.3.12. 지원되는 JBoss 버전

| v2 | v3 |

|---|---|

| JBoss App Server 7 | |

| Tomcat 6 (JBosshiera 1.0) | |

| Tomcat 7(JBosshiera 2.0) | |

| Vert.x 2.1 | |

| WildFly App Server 10 | |

| WildFly App Server 8.2.1.Final | |

| WildFly App Server 9 | |

| CapeDwarf | |

| JBoss Data Virtualization 6 | |

| JBoss EAP(Enterprise App Platform) 6 | |

| JBoss Unified Push Server 1.0.0.Beta1, Beta2 | |

| JBoss BPM 제품군 | |

| JBoss BRMS | |

| jboss-eap70-openshift: 1.3-beta | |

| eap64-https-s2i | |

| eap64-mongodb-persistent-s2i | |

| eap64-mysql-persistent-s2i | |

| eap64-psql-persistent-s2i |

6.4. 빠른 시작 예

6.4.1. 개요

v2 빠른 시작 v3 빠른 시작에 대한 명확한 마이그레이션 경로는 없지만 현재 v3에서 다음 빠른 시작을 사용할 수 있습니다. oc new-app 을 사용하여 애플리케이션을 생성하는 대신 데이터베이스가 있는 애플리케이션이 있는 경우 oc new-app 을 다시 사용하여 별도의 데이터베이스 서비스를 시작하고 두 개를 공통 환경 변수로 연결하면 다음 중 하나를 사용하여 소스 코드가 포함된 GitHub 리포지토리에서 한 번에 연결된 애플리케이션 및 데이터베이스를 인스턴스화할 수 있습니다. oc get templates -n openshift:를 사용하여 사용 가능한 모든 템플릿을 나열할 수 있습니다.

CakePHP MySQL https://github.com/sclorg/cakephp-ex

- 템플릿: cakephp-mysql-example

Node.js MongoDB https://github.com/sclorg/nodejs-ex

- 템플릿: nodejs-mongodb-example

Django PosgreSQL https://github.com/sclorg/django-ex

- template: django-psql-example

Dancer MySQL https://github.com/sclorg/dancer-ex

- template: dancer-mysql-example

Rails PostgreSQL https://github.com/sclorg/rails-ex

- template: rails-postgresql-example

6.4.2. 워크플로

위의 템플릿 URL 중 하나의 git clone 을 로컬에서 실행합니다. 애플리케이션 소스 코드를 추가하고 커밋하고 GitHub 리포지토리를 내보낸 다음 위에 나열된 템플릿 중 하나에서 v3 빠른 시작 애플리케이션을 시작합니다.

- 애플리케이션용 GitHub 리포지토리를 생성합니다.

빠른 시작 템플릿을 복제하고 GitHub 리포지토리를 원격으로 추가합니다.

$ git clone <one-of-the-template-URLs-listed-above> $ cd <your local git repository> $ git remote add upstream <https://github.com/<git-id>/<quickstart-repo>.git> $ git push -u upstream master

소스 코드를 GitHub로 커밋하고 내보냅니다.

$ cd <your local repository> $ git commit -am “added code for my app” $ git push origin master

v3에서 새 애플리케이션을 생성합니다.

$ oc new-app --template=<template> \ -p SOURCE_REPOSITORY_URL=<https://github.com/<git-id>/<quickstart_repo>.git> \ -p DATABASE_USER=<your_db_user> \ -p DATABASE_NAME=<your_db_name> \ -p DATABASE_PASSWORD=<your_db_password> \ -p DATABASE_ADMIN_PASSWORD=<your_db_admin_password> 1- 1

- MongoDB에만 적용됩니다.

이제 두 개의 포드, 웹 프레임워크 포드, 데이터베이스 포드가 실행 중이어야 합니다. 웹 프레임워크 포드 환경이 데이터베이스 포드 환경과 일치해야 합니다.

oc set env pod/<pod_name> --list:를 사용하여 환경 변수를 나열할 수 있습니다.-

8443_NAME이 이제<DB_SERVICE>_DATABASE -

DATABASE_USER는 이제<DB_SERVICE>_USER입니다. -

8443_PASSWORD이 이제<DB_SERVICE>_PASSWORD RuntimeClass_ADMIN_PASSWORD은 이제MONGODB_ADMIN_PASSWORD입니다(MongoDB에만 적용 가능)SOURCE_REPOSITORY_URL이 지정되지 않은 경우 템플릿은 위에 나열된 템플릿 URL(https://github.com/openshift/<quickstart>-ex)을 소스 리포지토리로 사용하고 hello-welcome 애플리케이션이 시작됩니다.

-

데이터베이스를 마이그레이션하는 경우 데이터베이스를 덤프 파일로 내보내고 새 v3 데이터베이스 Pod에서 데이터베이스를 복원합니다. 데이터베이스 포드가 이미 시작되어 실행 중이므로

oc new-app단계를 건너뛰는 데이터베이스 애플리케이션에 설명된 단계를 참조하십시오.

6.5. 연속 통합 및 배포(CI/CD)

6.5.1. 개요

이 주제에서는 OpenShift 버전 2(v2)와 OpenShift 버전 3(v3) 간의 지속적인 통합 및 배포(CI/CD) 애플리케이션의 차이점과 이러한 애플리케이션을 v3 환경으로 마이그레이션하는 방법을 검토합니다.

6.5.2. Jenkins

OpenShift 버전 2(v2) 및 OpenShift 버전 3(v3)의 Jenkins 애플리케이션은 아키텍처의 기본 차이로 인해 다르게 구성됩니다. 예를 들어, v2에서 애플리케이션은 톱니바이너에서 호스팅되는 통합 Git 리포지토리를 사용하여 소스 코드를 저장합니다. v3에서 소스 코드는 Pod 외부에서 호스팅되는 퍼블릭 또는 프라이빗 Git 리포지토리에 있습니다.

또한 OpenShift v3에서는 Jenkins 작업을 소스 코드 변경 사항에 따라 트리거할 수 있을 뿐만 아니라 ImageStream을 변경하면 소스 코드와 함께 애플리케이션을 빌드하는 데 사용되는 이미지가 변경됩니다. 따라서 v3에서 새 Jenkins 애플리케이션을 생성한 다음 OpenShift v3 환경에 적합한 구성으로 작업을 다시 생성하여 Jenkins 애플리케이션을 수동으로 마이그레이션하는 것이 좋습니다.

Jenkins 애플리케이션을 생성하고, 작업을 구성하고, Jenkins 플러그인을 올바르게 사용하는 방법에 대한 자세한 내용은 다음 리소스를 참조하십시오.

6.6. Webhook 및 Action Hooks

6.6.1. 개요

이 주제에서는 OpenShift 버전 2(v2)와 OpenShift 버전 3(v3) 간의 웹 후크와 작업 후크의 차이점을 살펴보고 이러한 애플리케이션을 v3 환경으로 마이그레이션하는 방법을 검토합니다.

6.6.2. Webhook

GitHub 리포지토리에서

BuildConfig를 생성한 후 다음을 실행합니다.$ oc describe bc/<name-of-your-BuildConfig>

그러면 다음과 같은 Webhook GitHub URL이 출력됩니다.

<https://api.starter-us-east-1.openshift.com:443/oapi/v1/namespaces/nsname/buildconfigs/bcname/webhooks/secret/github>.

- GitHub 웹 콘솔에서 이 URL을 잘라내어 GitHub에 붙여넣습니다.

- GitHub 리포지토리의 설정 → Webhook에서 Webhook 추가 를 선택합니다.

- URL 출력(위와 동일)을 Payload URL 필드에 붙여넣습니다.

-

콘텐츠 유형을

application/json으로 설정합니다. - Webhook 추가를 클릭합니다.

GitHub에서 Webhook가 성공적으로 구성되었음을 알리는 메시지가 표시됩니다.

이제 GitHub 리포지토리에 변경 사항을 내보낼 때마다 새 빌드가 자동으로 시작되고 빌드가 성공하면 새 배포가 시작됩니다.

애플리케이션을 삭제하거나 다시 생성하는 경우 GitHub에서 새 BuildConfig Webhook URL을 사용하여 Payload URL 필드를 업데이트해야 합니다.

6.6.3. 작업 후크

OpenShift 버전 2(v2)에는 .openshift/action_hooks 디렉터리에 있는 build, deploy, post_deploy 및 pre_build 스크립트 또는 action_hooks가 있습니다. v3에서 이러한 함수의 일대일 매핑은 없지만 v3의 S2I 툴에 는 지정된 URL 또는 소스 리포지토리의 .s2i/bin 디렉터리에 사용자 지정 가능한 스크립트 를 추가하는 옵션이 있습니다.

OpenShift 버전 3(v3)은 빌드 후 이미지를 기본 테스트 및 레지스트리로 푸시하기 전에 실행 후 빌드 후 후크 를 제공합니다. 배포 후크 는 배포 구성에 구성됩니다.

v2에서 action_hooks는 일반적으로 환경 변수를 설정하는 데 사용됩니다. v2에서 모든 환경 변수는 다음을 사용하여 전달해야 합니다.

$ oc new-app <source-url> -e ENV_VAR=env_var

또는 다음을 수행합니다.

$ oc new-app <template-name> -p ENV_VAR=env_var

또한 다음을 사용하여 환경 변수를 추가하거나 변경할 수 있습니다.

$ oc set env dc/<name-of-dc> ENV_VAR1=env_var1 ENV_VAR2=env_var2’

6.7. S2I 툴

6.7.1. 개요

S 2I(Source-to-Image) 툴 은 컨테이너 이미지에 애플리케이션 소스 코드를 삽입하고 최종 제품은 빌더 이미지와 빌드 소스 코드를 통합하는 새로운 즉시 실행 가능한 컨테이너 이미지입니다. S2I 툴은 리포지토리에서 OpenShift Container Platform 없이 로컬 머신에 설치할 수 있습니다.

S2I 툴은 OpenShift Container Platform에서 사용하기 전에 애플리케이션 및 이미지를 로컬에서 테스트하고 확인하는 매우 강력한 도구입니다.

6.7.2. 컨테이너 이미지 생성

- 애플리케이션에 필요한 빌더 이미지를 식별합니다. Red Hat은 Python, Ruby, Perl, PHP 및 Node.js를 비롯한 다양한 언어에 대해 여러 빌더 이미지를 제공합니다. 다른 이미지는 커뮤니티 스페이스에서 사용할 수 있습니다.

S2I는 로컬 파일 시스템의 소스 코드 또는 Git 리포지토리에서 이미지를 빌드할 수 있습니다. 빌더 이미지 및 소스 코드에서 새 컨테이너 이미지를 빌드하려면 다음을 수행합니다.

$ s2i build <source-location> <builder-image-name> <output-image-name>

참고<source-location>은 Git 리포지토리 URL 또는 로컬 파일 시스템의 소스 코드 디렉터리일 수 있습니다.Docker 데몬을 사용하여 빌드 이미지를 테스트합니다.

$ docker run -d --name <new-name> -p <port-number>:<port-number> <output-image-name> $ curl localhost:<port-number>

- 새 이미지를 OpenShift 레지스트리에 내보냅니다.

oc명령을 사용하여 OpenShift 레지스트리의 이미지에서 새 애플리케이션을 생성합니다.$ oc new-app <image-name>

6.8. 지원 가이드

6.8.1. 개요

이 주제에서는 OpenShift 버전 2(v2) 및 OpenShift 버전 3(v3)에 대해 지원되는 언어, 프레임워크, 데이터베이스 및 마커를 검토합니다.

OpenShift Container Platform 고객이 사용하는 공통 조합에 대한 자세한 내용은 OpenShift Container Platform 테스트 통합을 참조하십시오.

6.8.2. 지원되는 데이터베이스

데이터베이스 응용 프로그램 주제의 지원되는 데이터베이스 섹션을 참조하십시오.

6.8.3. 지원되는 언어

6.8.4. 지원되는 프레임워크

표 6.1. 지원되는 프레임워크

| v2 | v3 |

|---|---|

| Jenkins 서버 | jenkins-persistent |

| 서드 (Vustive 7) | |

| 유감스럽게 0.7.5 | |

| WordPress 4 | |

| Ceylon | |

| Go | |

| MEAN |

6.8.5. 지원되는 마커

표 6.2. Python

| v2 | v3 |

|---|---|

| pip_install | 리포지토리에 requirements.txt 가 포함된 경우 기본적으로 pip가 호출됩니다. 그렇지 않으면 pip 가 사용되지 않습니다. |

표 6.3. Ruby

| v2 | v3 |

|---|---|

| disable_asset_compilation |

이 작업은 buildconfig 전략 정의에서 |

표 6.4. Perl

| v2 | v3 |

|---|---|

| enable_cpan_tests |

이 작업은 빌드 구성에서 |

표 6.5. PHP

| v2 | v3 |

|---|---|

| use_composer | Composer는 소스 리포지토리에 루트 디렉터리에 composer.json 이 포함된 경우 항상 사용됩니다. |

표 6.6. Node.js

| v2 | v3 |

|---|---|

| NODEJS_VERSION | 해당 없음 |

| use_npm |

npm 은 KnativeServing |

표 6.7. JBoss EAP, JBoss WS, WildFly

| v2 | v3 |

|---|---|

| enable_debugging |

이 옵션은 비어 있지 않은 값으로 설정하여 배포 구성에 설정된 |

| skip_maven_build | pom.xml 이 있는 경우 maven이 실행됩니다. |

| java7 | 해당 없음 |

| java8 | preview는 JDK8을 사용하고 있습니다. |

표 6.8. Jenkins

| v2 | v3 |

|---|---|

| enable_debugging | 해당 없음 |

표 6.9. all

| v2 | v3 |

|---|---|

| force_clean_build | buildconfig 의 noCache 필드에는 컨테이너 빌드가 각 계층을 재실행하도록 강제 적용하므로 v3에 유사한 개념이 있습니다. S2I 빌드에서 incremental 플래그는 기본적으로 false이며, 이 플래그는 클린 빌드 를 나타냅니다. |

| hot_deploy | |

| enable_public_server_status | 해당 없음 |

| disable_auto_scaling | 자동 스케일링은 기본적으로 꺼져 있으며 Pod 자동 확장을 통해 켜질 수 있습니다. |

6.8.6. 지원되는 환경 변수

7장. 튜토리얼

7.1. 개요

이 주제 그룹에는 OpenShift Container Platform에서 애플리케이션을 가져오고 실행하는 방법에 대한 정보가 포함되어 있으며 다양한 언어 및 프레임워크를 다룹니다.

7.2. 빠른 시작 템플릿

7.2.1. 개요

빠른 시작은 OpenShift Container Platform에서 실행되는 애플리케이션의 기본 예입니다. 빠른 시작은 다양한 언어와 프레임워크로 제공되며 일련의 서비스, 빌드 구성 및 배포 구성으로 구성된 템플릿으로 정의됩니다. 이 템플릿은 애플리케이션을 빌드하고 배포하는 데 필요한 이미지 및 소스 리포지터리를 참조합니다.

빠른 시작을 살펴보려면 템플릿에서 애플리케이션을 생성합니다. 관리자가 이미 OpenShift Container Platform 클러스터에 이러한 템플릿을 이미 설치했을 수 있으며, 이 경우 간단히 웹 콘솔에서 선택할 수 있습니다. 템플릿을 업로드, 생성 및 수정하는 방법에 대한 자세한 내용은 템플릿 설명서를 참조하십시오.

빠른 시작은 애플리케이션 소스 코드가 포함된 소스 리포지터리를 참조합니다. 빠른 시작을 사용자 지정하려면 리포지터리를 포크하고 템플릿에서 애플리케이션을 생성할 때 기본 소스 리포지토리 이름을 포크된 리포지토리로 대체합니다. 그러면 제공된 소스 예 대신 소스 코드를 사용하여 수행되는 빌드가 생성됩니다. 그런 다음, 소스 리포지터리에서 코드를 업데이트하고 새 빌드를 시작하여 배포된 애플리케이션에 변경 사항이 반영된 것을 확인할 수 있습니다.

7.2.2. Web Framework 빠른 시작 템플릿

이 빠른 시작은 표시된 프레임워크 및 언어의 기본 애플리케이션을 제공합니다.

7.3. Ruby on Rails

7.3.1. 개요

Ruby on Rails는 Ruby 로 작성된 인기 있는 웹 프레임워크입니다. 이 안내서에서는 OpenShift Container Platform에서 Rails 4를 사용하는 방법을 설명합니다.

OpenShift Container Platform에서 애플리케이션을 실행하는 데 필요한 모든 단계에 대한 개요를 제공하기 위해 전체 튜토리얼을 살펴보는 것이 좋습니다. 문제가 발생하면 전체 자습서를 읽어보고 다시 돌아가 문제를 해결하십시오. 이전 단계를 검토하여 모든 단계가 제대로 실행되었는지 확인하는 것도 유용할 수 있습니다.

이 가이드에서는 다음이 필요합니다.

- 기본 Ruby/Rails 지식

- Ruby 2.0.0+, Rubygems, Bundler의 로컬 설치 버전

- Git에 대한 기본 지식

- OpenShift Container Platform v3의 실행 중인 인스턴스

7.3.2. 로컬 워크스테이션 설정

먼저 OpenShift Container Platform 인스턴스가 실행 중이고 사용 가능한지 확인합니다. OpenShift Container Platform을 시작하고 실행하는 방법에 대한 자세한 내용은 설치 방법을 확인하십시오. 또한 이메일 주소와 암호로 로그인 할 수 있도록 oc CLI 클라이언트가 설치되어 있고 명령 쉘에서 명령에 액세스할 수 있는지 확인합니다.

7.3.2.1. 데이터베이스 설정

Rails 애플리케이션은 거의 항상 데이터베이스와 함께 사용됩니다. 로컬 개발을 위해 PostgreSQL 데이터베이스를 선택했습니다. 설치 유형을 사용하려면 다음을 수행합니다.

$ sudo yum install -y postgresql postgresql-server postgresql-devel

다음으로 데이터베이스를 초기화해야 합니다.

$ sudo postgresql-setup initdb

이 명령은 데이터를 저장할 /var/lib/pgsql/data 디렉토리를 생성합니다.

다음을 입력하여 데이터베이스를 시작합니다.

$ sudo systemctl start postgresql.service

데이터베이스가 실행 중이면 rails 사용자를 생성합니다.

$ sudo -u postgres createuser -s rails

생성된 사용자에게는 암호가 없습니다.

7.3.3. 애플리케이션 작성

Rails 애플리케이션을 처음부터 시작하는 경우 Rails gem을 먼저 설치해야 합니다.

$ gem install rails Successfully installed rails-4.2.0 1 gem installed

Rails gem을 설치한 후 PostgreSQL을 데이터베이스로 사용하여 새 애플리케이션을 생성합니다.

$ rails new rails-app --database=postgresql

그런 다음 새 애플리케이션 디렉터리로 변경합니다.

$ cd rails-app

이미 애플리케이션이 있으면 pg(postgresql) gem이 Gemfile에 있는지 확인합니다. gem을 추가하여 Gemfile 을 편집하지 않는 경우:

gem 'pg'

모든 종속 항목이 있는 새 Gemfile.lock 을 생성하려면 다음을 실행합니다.

$ bundle install

pg gem과 함께 postgresql 데이터베이스를 사용하는 것 외에도 config/database.yml 에서 postgresql 어댑터를 사용하는지 확인해야 합니다.

config/database.yml 파일의 default 섹션이 다음과 같이 표시되도록 업데이트되었는지 확인합니다.

default: &default adapter: postgresql encoding: unicode pool: 5 host: localhost username: rails password:

이 rake 명령을 사용하여 애플리케이션의 개발 및 테스트 데이터베이스를 생성합니다.

$ rake db:create

PostgreSQL 서버에 development 및 test 데이터베이스가 생성됩니다.

7.3.3.1. 시작 페이지 생성

Rails 4는 더 이상 프로덕션에서 정적 public/index.html 페이지를 제공하지 않으므로 새 루트 페이지를 생성해야 합니다.

사용자 정의 시작 페이지를 생성하려면 다음 단계를 수행해야 합니다.

- 인덱스 작업을 사용하여 컨트롤러 생성

-

welcome컨트롤러index작업의 뷰 페이지 생성 - 생성된 컨트롤러 및 뷰를 통해 애플리케이션 루트 페이지를 제공할 경로 생성

Rails는 필요한 모든 단계를 수행할 생성기를 제공합니다.

$ rails generate controller welcome index

필요한 모든 파일이 생성되었으므로 config/routes.rb 파일의 2행을 다음과 같이 편집해야 합니다.

root 'welcome#index'

rails 서버를 실행하여 페이지가 사용 가능한지 확인합니다.

$ rails server

브라우저에서 http://localhost:3000으로 가서 페이지를 확인해야 합니다. 페이지가 표시되지 않으면 서버로 출력되는 로그를 확인하여 디버그합니다.

7.3.3.2. OpenShift Container Platform의 애플리케이션 구성

OpenShift Container Platform에서 실행할 PostgreSQL 데이터베이스 서비스와 통신하는 애플리케이션을 사용하려면 데이터베이스 서비스 생성 시 나중에 정의할 환경 변수를 사용하도록 config/database.yml 의 default 섹션을 편집해야 합니다.

편집된 config/database.yml 의 기본 섹션은 다음과 같아야 합니다.

<% user = ENV.key?("POSTGRESQL_ADMIN_PASSWORD") ? "root" : ENV["POSTGRESQL_USER"] %>

<% password = ENV.key?("POSTGRESQL_ADMIN_PASSWORD") ? ENV["POSTGRESQL_ADMIN_PASSWORD"] : ENV["POSTGRESQL_PASSWORD"] %>

<% db_service = ENV.fetch("DATABASE_SERVICE_NAME","").upcase %>

default: &default

adapter: postgresql

encoding: unicode

# For details on connection pooling, see rails configuration guide

# http://guides.rubyonrails.org/configuring.html#database-pooling

pool: <%= ENV["POSTGRESQL_MAX_CONNECTIONS"] || 5 %>

username: <%= user %>

password: <%= password %>

host: <%= ENV["#{db_service}_SERVICE_HOST"] %>

port: <%= ENV["#{db_service}_SERVICE_PORT"] %>

database: <%= ENV["POSTGRESQL_DATABASE"] %>최종 파일을 확인하는 방법에 대한 예제는 Ruby on Rails 예제 애플리케이션 config/database.yml 을 참조하십시오.

7.3.3.3. Git에 애플리케이션 저장

OpenShift Container Platform에는 git 이 설치되어 있지 않은 경우 이를 설치해야 합니다.

OpenShift Container Platform에서 애플리케이션을 빌드하려면 일반적으로 소스 코드를 git 리포지터리에 저장해야 하므로 git 이 아직 없는 경우 설치해야 합니다.

ls -1 명령을 실행하여 Rails 애플리케이션 디렉토리에 있는지 확인합니다. 명령 출력은 다음과 같아야 합니다.

$ ls -1 app bin config config.ru db Gemfile Gemfile.lock lib log public Rakefile README.rdoc test tmp vendor

Rails 앱 디렉터리에서 이러한 명령을 실행하여 코드를 초기화하고 git으로 커밋합니다.

$ git init $ git add . $ git commit -m "initial commit"

애플리케이션을 커밋한 후에는 원격 리포지토리로 내보내야 합니다. 이를 위해 새 리포지토리를 생성하는 GitHub 계정이 필요합니다.

git 리포지터리를 가리키는 remote를 설정합니다.

$ git remote add origin git@github.com:<namespace/repository-name>.git

그런 다음 애플리케이션을 원격 git 리포지터리로 내보냅니다.

$ git push

7.3.4. OpenShift Container Platform에 애플리케이션 배포

Ruby on Rails 애플리케이션을 배포하려면 애플리케이션을 위한 새 프로젝트를 생성합니다.

$ oc new-project rails-app --description="My Rails application" --display-name="Rails Application"

rails-app 프로젝트를 생성하면 자동으로 새 프로젝트 네임스페이스로 전환됩니다.

OpenShift Container Platform에서 애플리케이션을 배포하려면 다음 세 단계를 수행해야 합니다.

- OpenShift Container Platform의 PostgreSQL 이미지에서데이터베이스 서비스 생성

- OpenShift Container Platform의 Ruby 2.0 빌더 이미지 및 Ruby on Rails 소스 코드에서 프런트 엔드 서비스 생성

- 애플리케이션 경로를 생성합니다.

7.3.4.1. 데이터베이스 서비스 생성

Rails 애플리케이션에는 실행 중인 데이터베이스 서비스가 필요합니다. 이 서비스에는 PostgeSQL 데이터베이스 이미지를 사용하십시오.

데이터베이스 서비스를 생성하려면 oc new-app 명령을 사용합니다. 데이터베이스 컨테이너 내에서 사용할 몇 가지 필요한 환경 변수를 이 명령으로 전달해야 합니다. 이러한 환경 변수는 사용자 이름, 암호 및 데이터베이스 이름을 설정하는 데 필요합니다. 이러한 환경 변수 의 값을 원하는 대로 변경할 수 있습니다. 설정하려는 변수는 다음과 같습니다.

- POSTGRESQL_DATABASE

- POSTGRESQL_USER

- POSTGRESQL_PASSWORD

이러한 변수를 설정하면 다음과 같은 결과를 얻을 수 있습니다.

- 지정된 이름의 데이터베이스가 있습니다.

- 지정된 이름의 사용자가 있습니다.

- 사용자가 지정된 암호를 사용하여 지정된 데이터베이스에 액세스할 수 있습니다.

예를 들면 다음과 같습니다.

$ oc new-app postgresql -e POSTGRESQL_DATABASE=db_name -e POSTGRESQL_USER=username -e POSTGRESQL_PASSWORD=password

데이터베이스 관리자의 암호도 설정하려면 다음 행을 이전 명령에 추가합니다.

-e POSTGRESQL_ADMIN_PASSWORD=admin_pw

이 명령의 진행 상황을 확인하려면 다음을 수행합니다.

$ oc get pods --watch

7.3.4.2. frontend 서비스 생성

애플리케이션을 OpenShift Container Platform으로 가져오려면 Creating the Database Service 에 설정한 데이터베이스 관련 환경 변수를 지정해야 하는 oc new-app 명령을 다시 사용하여 애플리케이션이 있는 리포지토리를 지정해야 합니다.

$ oc new-app path/to/source/code --name=rails-app -e POSTGRESQL_USER=username -e POSTGRESQL_PASSWORD=password -e POSTGRESQL_DATABASE=db_name -e DATABASE_SERVICE_NAME=postgresql

이 명령을 사용하면 OpenShift Container Platform에서 소스 코드를 가져오고, 빌더 이미지를 설정하고, 애플리케이션 이미지를 빌드 하며, 새로 생성된 이미지를 지정된 환경 변수 와 함께 배포합니다. 애플리케이션 이름은 rails-app으로 지정됩니다.

rails-app DeploymentConfig의 JSON 문서를 보고 환경 변수가 추가되었는지 확인할 수 있습니다.

$ oc get dc rails-app -o json

다음 섹션이 표시되어야 합니다.

env": [

{

"name": "POSTGRESQL_USER",

"value": "username"

},

{

"name": "POSTGRESQL_PASSWORD",

"value": "password"

},

{

"name": "POSTGRESQL_DATABASE",

"value": "db_name"

},

{

"name": "DATABASE_SERVICE_NAME",

"value": "postgresql"

}

],빌드 프로세스를 확인하려면 다음을 수행합니다.

$ oc logs -f build/rails-app-1

빌드가 완료되면 OpenShift Container Platform에서 실행 중인 Pod를 확인할 수 있습니다.

$ oc get pods

myapp-<number>-<hash>로 시작되는 행이 표시되어야 합니다. OpenShift Container Platform에서 실행 중인 애플리케이션을 나타냅니다.

애플리케이션이 작동하려면 데이터베이스 마이그레이션 스크립트를 실행하여 데이터베이스를 초기화해야 합니다. 이 작업을 수행하는 방법은 다음 두 가지입니다.

- 실행 중인 프런트 엔드 컨테이너에서 수동으로 수행합니다.

먼저 rsh 명령을 사용하여 프런트 엔드 컨테이너에 exec를 실행해야 합니다.

$ oc rsh <FRONTEND_POD_ID>

컨테이너 내부에서 마이그레이션을 실행합니다.

$ RAILS_ENV=production bundle exec rake db:migrate

Rails 애플리케이션을 개발 또는 테스트 환경에서 실행 중인 경우 RAILS_ENV 환경 변수를 지정할 필요가 없습니다.

- 템플릿에 사전 배포 라이프사이클 후크를 추가하여 수행합니다. 예를 들어 Rails 예제 애플리케이션에서 후크 예제 를 확인합니다.

7.3.4.3. 애플리케이션 경로 생성

www.example.com 과 같이 외부에서 액세스할 수 있는 호스트 이름을 지정하여 서비스를 공개하려면 OpenShift Container Platform 경로를 사용합니다. 이 경우 다음을 입력하여 프런트 엔드 서비스를 공개해야 합니다.

$ oc expose service rails-app --hostname=www.example.com

사용자가 지정하는 호스트 이름이 라우터의 IP 주소로 해석되는지 확인해야 합니다. 자세한 내용은 다음 주소에 있는 OpenShift Container Platform 설명서를 참조하십시오.

7.4. Maven의 Nexus 미러 설정

7.4.1. 소개

Java 및 Maven을 사용하여 애플리케이션을 개발하는 동안 여러 번 구축할 가능성이 높습니다. 포드의 빌드 시간을 단축하기 위해 Maven 종속성을 로컬 Nexus 리포지토리에 캐시할 수 있습니다. 이 튜토리얼에서는 클러스터에 Nexus 리포지토리를 생성하는 방법을 안내합니다.

이 튜토리얼에서는 Maven에 사용하기 위해 이미 설정된 프로젝트로 작업하고 있다고 가정합니다. Java 프로젝트와 함께 Maven을 사용하려면 가이드를 확인하는 것이 좋습니다.

또한 애플리케이션의 이미지에서 Maven 미러 기능을 확인하십시오. Maven을 사용하는 대부분의 이미지에는 이 프로세스를 간소화하는 데 사용할 수 있는 MAVEN_MIRROR_URL 환경 변수가 있습니다. 이 기능이 없는 경우 Nexus 설명서를 읽고 빌드를 올바르게 구성합니다.

또한 각 Pod에서 제대로 작동하는 데 충분한 리소스를 부여해야 합니다. Nexus 배포 구성에서 Pod 템플릿을 편집하여 더 많은 리소스를 요청해야 할 수 있습니다.

7.4.2. Nexus 설정

공식 Nexus 컨테이너 이미지를 다운로드하여 배포합니다.

oc new-app sonatype/nexus

새로 생성된 Nexus 서비스를 노출하여 경로를 생성합니다.

oc expose svc/nexus

oc get routes 를 사용하여 Pod의 새 외부 주소를 찾습니다.

oc get routes

출력은 다음과 유사해야 합니다.

NAME HOST/PORT PATH SERVICES PORT TERMINATION nexus nexus-myproject.192.168.1.173.xip.io nexus 8081-tcp

- 브라우저를 HOST/PORT 아래의 URL로 이동하여 Nexus가 실행 중인지 확인합니다. Nexus에 로그인하기 위해 기본 관리자 사용자 이름은 admin 이고 암호는 admin123 입니다.

Nexus는 중앙 리포지토리에 대해 사전 구성되어 있지만 애플리케이션에 다른 항목이 필요할 수 있습니다. 대부분의 Red Hat 이미지의 경우 Maven 리포지토리에 jboss-ga 리포지토리를 추가하는 것이 좋습니다.

7.4.2.1. 프로브를 사용하여 성공 확인

이제 준비 상태 프로브와 활성 프로브 를 설정하는 것이 좋습니다. 이를 통해 Nexus가 올바르게 실행되고 있는지 주기적으로 확인합니다.

$ oc set probe dc/nexus \ --liveness \ --failure-threshold 3 \ --initial-delay-seconds 30 \ -- echo ok $ oc set probe dc/nexus \ --readiness \ --failure-threshold 3 \ --initial-delay-seconds 30 \ --get-url=http://:8081/nexus/content/groups/public

7.4.2.2. Nexus에 persistence 추가

영구 스토리지가 필요하지 않은 경우 계속 Nexus에 연결합니다. 그러나 어떠한 이유로든 Pod를 다시 시작하면 캐시된 종속성과 구성 사용자 지정이 손실됩니다.

서버를 실행하는 Pod가 종료될 때 캐시된 종속성이 손실되지 않도록 Nexus에 대한 PVC(영구 볼륨 클레임)를 생성합니다. PVC에는 클러스터에 사용 가능한 PV(영구 볼륨)가 필요합니다. 사용 가능한 PV가 없고 클러스터에 관리자 액세스 권한이 없는 경우 시스템 관리자에게 읽기/쓰기 영구 볼륨을 생성하도록 요청합니다.

그렇지 않으면 영구 볼륨 생성에 대한 지침은 OpenShift Container Platform 의 영구 스토리지를 참조하십시오.

Nexus 배포 구성에 PVC를 추가합니다.

$ oc set volume dc/nexus --add \ --name 'nexus-volume-1' \ --type 'pvc' \ --mount-path '/sonatype-work/' \ --claim-name 'nexus-pv' \ --claim-size '1G' \ --overwrite

이렇게 하면 배포 구성에 대한 이전 emptyDir 볼륨이 제거되고 /sonatype-work 에 마운트된 하나의 hugeabyte 영구 스토리지에 대한 클레임을 추가합니다. 구성 변경으로 인해 Nexus Pod가 자동으로 재배포됩니다.

Nexus가 실행 중인지 확인하려면 브라우저에서 Nexus 페이지를 새로 고칩니다. 다음을 사용하여 배포의 진행 상황을 모니터링할 수 있습니다.

$ oc get pods -w

7.4.3. Nexus에 연결

다음 단계에서는 새 Nexus 리포지토리를 사용하는 빌드를 정의하는 방법을 보여줍니다. 튜토리얼의 나머지 부분에서는 wildfly-100-centos7 이 있는 이 예제 리포지토리 를 빌더로 사용하지만 이러한 변경 사항이 모든 프로젝트에서 작동해야 합니다.

예제 빌더 이미지는 환경의 일부로 MAVEN_MIRROR_URL 을 지원하므로 이를 사용하여 빌더 이미지를 Nexus 리포지토리로 가리킬 수 있습니다. 이미지가 환경 변수를 사용하여 Maven 미러를 구성하는 것을 지원하지 않는 경우 Nexus 미러를 가리키도록 올바른 Maven 설정을 제공하도록 빌더 이미지를 수정해야 할 수 있습니다.

$ oc new-build openshift/wildfly-100-centos7:latest~https://github.com/openshift/jee-ex.git \ -e MAVEN_MIRROR_URL='http://nexus.<Nexus_Project>:8081/nexus/content/groups/public' $ oc logs build/jee-ex-1 --follow

<Nexus_Project> 를 Nexus 리포지토리의 프로젝트 이름으로 바꿉니다. 사용하는 애플리케이션과 동일한 프로젝트에 있는 경우 <Nexus_Project>를 제거할 수 있습니다. OpenShift Container Platform의 DNS 확인에 대해 자세히 알아보십시오.

7.4.4. 성공 확인

웹 브라우저에서 http://<NexusIP>:8081/ 6443/content/groups/public 으로 이동하여 애플리케이션의 종속 항목을 저장했는지 확인합니다. 빌드 로그를 확인하여 Maven이 Nexus 미러를 사용하고 있는지 확인할 수도 있습니다. 성공하면 URL http://nexus:8081 을 참조하는 출력이 표시됩니다.

7.4.5. 추가 리소스

7.5. OpenShift Pipeline 빌드

7.5.1. 소개

간단한 웹 사이트 또는 복잡한 마이크로 서비스를 생성하는 등 OpenShift Pipelines를 사용하여 OpenShift에서 애플리케이션을 빌드, 테스트, 배포 및 승격합니다.

OpenShift Jenkins 이미지는 표준 Jenkins Pipeline Syntax 외에도 OpenShift Jenkins 클라이언트 플러그인 (OpenShift Jenkins Client Plug-in을 통해) OpenShift Domain Specific Language (DSL)을 제공합니다. OpenShift API 서버와의 풍부한 상호 작용을 위해 읽기 쉽고 간결하며 포괄적이며 유창한 구문을 제공하여 OpenShift 클러스터에서 애플리케이션을 빌드, 배포, 승격을 보다 효과적으로 제어할 수 있습니다.

이 예제에서는 nodejs-mongodb.json 템플릿을 사용하여 Node.js/MongoDB 애플리케이션을 빌드, 배포, 확인하는 OpenShift Pipeline을 생성하는 방법을 보여줍니다.

7.5.2. Jenkins 마스터 생성

Jenkins 마스터를 생성하려면 다음을 실행합니다.

$ oc project <project_name> 1 $ oc new-app jenkins-ephemeral 2

Jenkins 자동 프로비저닝이 클러스터에서 활성화되어 있고 Jenkins 마스터에 사용자 정의를 만들 필요가 없는 경우 이전 단계를 건너뛸 수 있습니다.

Jenkins 자동 프로비저닝에 대한 자세한 내용은 파이프라인 실행 구성을 참조하십시오.

7.5.3. Pipeline 빌드 구성

이제 Jenkins 마스터가 가동되어 실행 중이므로 Jenkins 파이프라인 전략을 사용하여 Node.js/MongoDB 예제 애플리케이션을 빌드, 배포, 스케일링하는 BuildConfig를 생성합니다.

다음 콘텐츠를 사용하여 nodejs-sample-pipeline.yaml이라는 파일을 생성합니다.

kind: "BuildConfig"

apiVersion: "v1"

metadata:

name: "nodejs-sample-pipeline"

spec:

strategy:

jenkinsPipelineStrategy:

jenkinsfile: <pipeline content from below>

type: JenkinsPipeline파이프라인 빌드 전략 구성에 대한 자세한 내용은 파이프라인 전략 옵션을 참조하십시오.

7.5.4. Jenkinsfile

jenkinsPipelineStrategy 를 사용하여 BuildConfig를 생성하면 인라인 jenkinsfile 을 사용하여 파이프라인에 수행할 작업을 지시합니다. 이 예에서는 애플리케이션에 대한 Git 리포지토리를 설정하지 않습니다.

다음 jenkinsfile 콘텐츠는 OpenShift DSL을 사용하여 Groovy로 작성됩니다. 소스 리포지토리에 jenkinsfile 을 포함하는 것이 기본 방법이지만 이 예제에서는 YAML 리터럴 스타일 을 사용하여 BuildConfig에 인라인 콘텐츠를 포함합니다.

완료된 BuildConfig는 예제 디렉터리 nodejs-sample-pipeline.yaml 의 OpenShift Origin 리포지토리에서 볼 수 있습니다.

def templatePath = 'https://raw.githubusercontent.com/openshift/nodejs-ex/master/openshift/templates/nodejs-mongodb.json' 1 def templateName = 'nodejs-mongodb-example' 2 pipeline { agent { node { label 'nodejs' 3 } } options { timeout(time: 20, unit: 'MINUTES') 4 } stages { stage('preamble') { steps { script { openshift.withCluster() { openshift.withProject() { echo "Using project: ${openshift.project()}" } } } } } stage('cleanup') { steps { script { openshift.withCluster() { openshift.withProject() { openshift.selector("all", [ template : templateName ]).delete() 5 if (openshift.selector("secrets", templateName).exists()) { 6 openshift.selector("secrets", templateName).delete() } } } } } } stage('create') { steps { script { openshift.withCluster() { openshift.withProject() { openshift.newApp(templatePath) 7 } } } } } stage('build') { steps { script { openshift.withCluster() { openshift.withProject() { def builds = openshift.selector("bc", templateName).related('builds') timeout(5) { 8 builds.untilEach(1) { return (it.object().status.phase == "Complete") } } } } } } } stage('deploy') { steps { script { openshift.withCluster() { openshift.withProject() { def rm = openshift.selector("dc", templateName).rollout().latest() timeout(5) { 9 openshift.selector("dc", templateName).related('pods').untilEach(1) { return (it.object().status.phase == "Running") } } } } } } } stage('tag') { steps { script { openshift.withCluster() { openshift.withProject() { openshift.tag("${templateName}:latest", "${templateName}-staging:latest") 10 } } } } } } }

- 1

- 사용할 템플릿의 경로입니다.

- 2

- 생성할 템플릿의 이름입니다.

- 3

- 이 빌드를 실행할

node.js슬레이브 포드를 가동합니다. - 4

- 이 파이프라인에 타임아웃을 20분으로 설정합니다.

- 5

- 이 템플릿 라벨이 있는 모든 항목을 삭제합니다.

- 6

- 이 템플릿 라벨을 사용하여 모든 보안을 삭제합니다.

- 7

templatePath에서 새 애플리케이션을 생성합니다.- 8

- 빌드가 완료될 때까지 최대 5분 동안 기다립니다.

- 9

- 배포가 완료될 때까지 최대 5분 정도 기다립니다.

- 10

- 다른 모든 과정이 성공하면

$ {templateName}:latest이미지에$ {templateName}-staging:latest태그를 지정합니다. 스테이징 환경에 대한 파이프라인 BuildConfig는$ {templateName}-staging:latest이미지가 변경될 때까지 기다린 다음 스테이징 환경에 배포할 수 있습니다.

이전 예제는 선언적 파이프라인 스타일로 작성되었지만 오래된 스크립팅된 파이프라인 스타일도 지원됩니다.

7.5.5. Pipeline 생성

다음을 실행하여 OpenShift 클러스터에 BuildConfig를 생성할 수 있습니다.

$ oc create -f nodejs-sample-pipeline.yaml

자체 파일을 생성하지 않으려면 다음을 실행하여 원래 리포지토리의 샘플을 사용하면 됩니다.

$ oc create -f https://raw.githubusercontent.com/openshift/origin/master/examples/jenkins/pipeline/nodejs-sample-pipeline.yaml

여기에서 사용되는 OpenShift DSL 구문에 대한 자세한 내용은 OpenShift Jenkins 클라이언트 플러그인 을 참조하십시오.

7.5.6. Pipeline 시작

다음 명령을 사용하여 파이프라인을 시작합니다.

$ oc start-build nodejs-sample-pipeline

또는 빌드 → 파이프라인 섹션으로 이동하여 파이프라인 시작을 클릭하거나 Jenkins 콘솔을 방문하여 생성한 파이프라인 으로 이동한 다음 지금 빌드 를 클릭하여 OpenShift 웹 콘솔에서 파이프라인을 시작할 수 있습니다.

파이프라인이 시작되면 프로젝트 내에서 수행되는 다음 작업이 표시되어야 합니다.

- Jenkins 서버에서 작업 인스턴스가 생성됩니다.

- 파이프라인에 필요한 경우 슬레이브 Pod가 시작됩니다.

파이프라인은 슬레이브 Pod에서 실행되거나 슬레이브가 필요하지 않은 경우 마스터에서 실행됩니다.

-

template=nodejs-mongodb-example라벨을 사용하여 이전에 생성한 리소스는 삭제됩니다. -

새 애플리케이션 및 이 애플리케이션의 모든 관련 리소스는

nodejs-mongodb-example템플릿에서 생성됩니다. nodejs-mongodb-exampleBuildConfig를 사용하여 빌드가 시작됩니다.- 파이프라인은 빌드가 완료될 때까지 기다린 후 다음 단계를 트리거합니다.