Red Hat Training

A Red Hat training course is available for Red Hat Gluster Storage

インストールガイド

Red Hat Gluster Storage 3.4 のインストール

概要

第1章 Red Hat Gluster Storage のインストール計画

1.1. Red Hat Gluster Storage について

Red Hat Gluster Storage Server for On-Premise

Red Hat Gluster Storage Server for On-Premise を使用すると、企業は、コモディティーサーバーおよびストレージハードウェアを使用し、物理ストレージを仮想化された、スケーラブルな、かつ一元管理されるストレージプールとして処理できます。

Red Hat Gluster Storage Server for Public Cloud

Red Hat Gluster Storage Server for Public Cloud は、AWS パブリッククラウドでスケーラブルな NAS をデプロイするために GlusterFS を Amazon Machine Image (AMI) としてパッケージ化します。この強力なストレージサーバーは、Amazon ユーザー向けに、可用性が高く、スケーラブルで仮想化および一元管理されたストレージのプールを提供します。

1.2. 前提条件

1.2.1. マルチサイトクラスターのレイテンシー

# ping -c100 -q site_ip_address/site_hostname

1.2.2. ファイルシステムの要件

ext3 または ext4 を使用している既存の Gluster Storage Software Appliance のお客様が、XFS バックエンドファイルシステムを使用してサポートされているバージョンの Red Hat Gluster Storage にアップグレードできるよう支援します。

1.2.3. 論理ボリュームマネージャー

1.2.4. ネットワーク時間の設定

1.2.4.1. chrony を使用した時間同期の設定

# clockdiff node-hostname

1.2.4.2. Network Time Protocol を使用した時間同期の設定

ntpd デーモンを設定します。

- vim、nano などのテキストエディターで NTP 設定ファイル

/etc/ntp.confを編集します。# nano /etc/ntp.conf

- 以下のように、

ntp.confファイル内のパブリック NTP サーバーの一覧を追加または編集します。server 0.rhel.pool.ntp.org server 1.rhel.pool.ntp.org server 2.rhel.pool.ntp.org

このファイルの Red Hat Enterprise Linux 6 バージョンには、すでに必要な情報が含まれています。カスタマイズが必要な場合は、このファイルの内容を編集します。特定の Red Hat Gluster Storage リリースについてサポートされる Red Hat Enterprise Linux バージョンについての詳細は、「Red Hat Gluster Storage のサポートマトリックス」を参照してください。 - オプションで、iburst ディレクティブを各行に追加して、初期の同期速度を引き上げます。

server 0.rhel.pool.ntp.org iburst server 1.rhel.pool.ntp.org iburst server 2.rhel.pool.ntp.org iburst

- サーバーの一覧について完了したら、同じファイルに必要なパーミッションを設定します。

localhostにのみ無制限のアクセスがあることを確認します。restrict default kod nomodify notrap nopeer noquery restrict -6 default kod nomodify notrap nopeer noquery restrict 127.0.0.1 restrict -6 ::1

- すべての変更を保存してエディターを終了し、NTP デーモンを再起動します。

# service ntpd restart

- 起動時に ntpd デーモンが起動することを確認します。

# chkconfig ntpd on

1.3. ハードウェアの互換性

1.4. ポート情報

# iptables -A INPUT -m state --state NEW -m tcp -p tcp --dport 5667 -j ACCEPT # service iptables save

# firewall-cmd --zone=zone_name --add-service=glusterfs # firewall-cmd --zone=zone_name --add-service=glusterfs --permanent

# firewall-cmd --zone=zone_name --add-port=port/protocol # firewall-cmd --zone=zone_name --add-port=port/protocol --permanent

# firewall-cmd --zone=public --add-port=5667/tcp # firewall-cmd --zone=public --add-port=5667/tcp --permanent

表1.1 すべてのストレージサーバーで以下のポートを開きます。

| 接続ソース | TCP ポート | UDP ポート | 推奨 | 用途 |

|---|---|---|---|---|

| 有効な SSH キーを持つ認証されたネットワークエンティティー | 22 | - | すべての設定 | geo レプリケーションを使用したリモートバックアップ |

| 認証されたネットワークエンティティー。他の RPC サービスと競合しないように注意してください。 | 111 | 111 | すべての設定 | RPC ポートマッパーおよび RPC バインド |

| 認証された SMB/CIFS クライアント | 139 および 445 | 137 および 138 | SMB/CIFS を使用したストレージの共有 | SMB/CIFS プロトコル |

| 認証された NFS クライアント | 2049 | 2049 | Gluster NFS または NFS-Ganesha を使用したストレージの共有 | NFS プロトコルを使用したエクスポート |

| Samba-CTDB クラスターのすべてのサーバー | 4379 | - | SMB および Gluster NFS を使用したストレージの共有 | CTDB |

| 認証されたネットワークエンティティー | 24007 | - | すべての設定 | glusterd を使用した管理プロセス |

| 認証されたネットワークエンティティー | 24009 | - | すべての設定 | Gluster イベントデーモン |

| Nagios によって監視されるネットワークエンティティー | 5666 | - | Red Hat Gluster Storage コンソールおよび Nagios を使用した監視 | NRPE サービス |

| NFSv3 クライアント | 662 | 662 | NFS-Ganesha および Gluster NFS を使用したストレージの共有 | statd |

| NFSv3 クライアント | 32803 | 32803 | NFS-Ganesha および Gluster NFS を使用したストレージの共有 | NLM プロトコル |

| マウント要求を送信する NFSv3 クライアント | - | 32769 | Gluster NFS を使用したストレージの共有 | Gluster NFS MOUNT プロトコル |

| マウント要求を送信する NFSv3 クライアント | 20048 | 20048 | NFS-Ganesha を使用したストレージの共有 | NFS-Ganesha MOUNT プロトコル |

| NFS クライアント | 875 | 875 | NFS-Ganesha を使用したストレージの共有 | NFS-Ganesha RQUOTA プロトコル(クォータ情報の取得) |

| pacemaker/corosync クラスターのサーバー | 2224 | - | NFS-Ganesha を使用したストレージの共有 | pcsd |

| pacemaker/corosync クラスターのサーバー | 3121 | - | NFS-Ganesha を使用したストレージの共有 | pacemaker_remote |

| pacemaker/corosync クラスターのサーバー | - | 5404 および 5405 | NFS-Ganesha を使用したストレージの共有 | corosync |

| pacemaker/corosync クラスターのサーバー | 21064 | - | NFS-Ganesha を使用したストレージの共有 | dlm |

| SSL/TLS モードで gluster-swift プロキシーサーバーにアクセスするための承認されたネットワークエンティティー。SSL/TLS 証明書が必要です。 | 443 | - | オブジェクトストレージの設定 | HTTPS 要求 |

| 有効なオブジェクトサーバー gluster-swift 認証情報を使用した承認されたネットワークエンティティー | 6010 | - | オブジェクトストレージの設定 | オブジェクトサーバー |

| 有効なコンテナーサーバー gluster-swift 認証情報を使用した承認されたネットワークエンティティー | 6011 | - | オブジェクトストレージの設定 | コンテナーサーバー |

| 有効な gluster-swift アカウントクレデンシャルを使用した承認されたネットワークエンティティー | 6012 | - | オブジェクトストレージの設定 | アカウントサーバー |

| 有効な gluster-swift プロキシークレデンシャルを使用した承認されたネットワークエンティティー | 8080 | - | オブジェクトストレージの設定 | プロキシーサーバー |

| 認証されたネットワークエンティティー | 49152 - 49664 | - | すべての設定 | ブリック通信ポート必要なポートの合計数は、ノード上のブリックの数によって異なります。マシンのブリックごとに 1 つのポートが必要です。 |

表1.2 NFS-Ganesha および Gluster NFS ストレージクライアントで以下のポートを開く

| 接続ソース | TCP ポート | UDP ポート | 推奨 | 用途 |

|---|---|---|---|---|

| NFSv3 サーバー | 662 | 662 | NFS-Ganesha および Gluster NFS を使用したストレージの共有 | statd |

| NFSv3 サーバー | 32803 | 32803 | NFS-Ganesha および Gluster NFS を使用したストレージの共有 | NLM プロトコル |

表1.3 すべての Nagios サーバーで次のポートを開く

| 接続ソース | TCP ポート | UDP ポート | 推奨 | 用途 |

|---|---|---|---|---|

| コンソールクライアント | 80 | - | Red Hat Gluster Storage コンソールおよび Nagios を使用した監視 | Nagios サーバーが Red Hat Gluster Storage サーバーで実行される場合の HTTP プロトコル |

| コンソールクライアント | 443 | - | Red Hat Gluster Storage コンソールおよび Nagios を使用した監視 | Nagios サーバーが Red Hat Gluster Storage サーバーで実行される場合の HTTPS プロトコル |

| Nagios が監視するサーバー | 5667 | - | Red Hat Gluster Storage コンソールおよび Nagios を使用した監視 | Nagios サーバーが Red Hat Gluster Storage サーバーで実行される場合の NSCA サービス |

1.5. サポート対象の Red Hat Gluster Storage バージョン

表1.4 バージョンの詳細

| RHGS バージョン | glusterfs および glusterfs-fuse | RHGS op-version | SMB | NFS | gDeploy | Ansible |

|---|---|---|---|---|---|---|

| 3.4 | 3.12.2-18 | 31302 | SMB 1、2.0、2.1、3.0、3.1.1 | NFSv3, NFSv4 | gdeploy-2.0.2-27 | - |

| 3.4 Batch 1 更新 | 3.12.2-25 | 31303 | SMB 1、2.0、2.1、3.0、3.1.1 | NFSv3, NFSv4 | gdeploy-2.0.2-30 | - |

| 3.4 Batch 2 更新 | 3.12.2-32 | 31304 | SMB 1、2.0、2.1、3.0、3.1.1 | NFSv3, NFSv4 | gdeploy-2.0.2-31 | gluster-ansible-infra-1.0.2-2 |

| 3.4 Batch 3 更新 | 3.12.2-40 | 31305 | SMB 1、2.0、2.1、3.0、3.1.1 | NFSv3, NFSv4 | gdeploy-2.0.2-31 | gluster-ansible-infra-1.0.2-2 |

| 3.4 Batch 4 更新 | 3.12.2-47 | 31305 | SMB 1、2.0、2.1、3.0、3.1.1 | NFSv3, NFSv4 | gdeploy-2.0.2-32 | gluster-ansible-infra-1.0.3-3 |

| 3.4 非同期更新 | 3.12.2-47.5 | 31306 | SMB 1、2.0、2.1、3.0、3.1.1 | NFSv3, NFSv4 | gdeploy-2.0.2-32 | gluster-ansible-infra-1.0.3-3 |

- For Red Hat Enterprise Linux 7 clients:

rhel-x86_64-server-7-rh-gluster-3-client - For Red Hat Enterprise Linux 6 clients:

rhel-x86_64-server-rhsclient-6

1.6. 機能互換性サポート

表1.5 Red Hat Gluster Storage バージョンでサポートされる機能

| 機能 | バージョン |

|---|---|

| Arbiter ブリック | 3.2 |

| Bitrot 検出 | 3.1 |

| Erasure コーディング | 3.1 |

| Google Compute Engine | 3.1.3 |

| メタデータのキャッシュ | 3.2 |

| Microsoft Azure | 3.1.3 |

| NFS バージョン 4 | 3.1 |

| SELinux | 3.1 |

| シャード化 | 3.2.0 |

| スナップショット | 3.0 |

| スナップショット、クローン作成 | 3.1.3 |

| スナップショット、ユーザーサービスが可能 | 3.0.3 |

| 階層化 | 3.1.2 |

| Volume Shadow Copy (VSS) | 3.1.3 |

表1.6 ボリュームタイプ別にサポートされる機能

表1.7 クライアントプロトコルでサポートされる機能

| 機能 | FUSE | gluster-NFS | NFS-Ganesha | SMB | Swift/S3 |

|---|---|---|---|---|---|

| Arbiter | はい | はい | はい | はい | ❌ |

| Bitrot 検出 | はい | はい | いいえ | はい | ❌ |

| dm-cache | はい | はい | はい | はい | はい |

| 暗号化 (TLS-SSL) | はい | はい | はい | はい | ❌ |

| Erasure コーディング | はい | はい | はい | はい | ❌ |

| Export サブディレクトリー | はい | はい | はい | 該当なし | 該当なし |

| geo-レプリケーション | はい | はい | はい | はい | はい |

| クォータ | はい | はい | はい | はい | ❌ |

| RDMA | はい | いいえ | いいえ | ❌ | 該当なし |

| スナップショット | はい | はい | はい | はい | はい |

| スナップショットのクローン作成 | はい | はい | はい | はい | はい |

| 階層化 | はい | はい | 該当なし | 該当なし | 該当なし |

1.7. Red Hat Gluster Storage のサポートマトリックス

表1.8 Red Hat Gluster Storage のサポートマトリックス

| Red Hat Enterprise Linux のバージョン | Red Hat Gluster Storage のバージョン |

|---|---|

| 6.5 | 3.0 |

| 6.6 | 3.0.2、3.0.3、3.0.4 |

| 6.7 | 3.1、3.1.1、3.1.2 |

| 6.8 | 3.1.3 |

| 6.9 | 3.2 |

| 6.9 | 3.3 |

| 6.9 | 3.3.1 |

| 6.10 | 3.4 |

| 7.1 | 3.1、3.1.1 |

| 7.2 | 3.1.2 |

| 7.2 | 3.1.3 |

| 7.3 | 3.2 |

| 7.4 | 3.2 |

| 7.4 | 3.3 |

| 7.4 | 3.3.1 |

| 7.5 | 3.3.1、3.4 |

| 7.6 | 3.3.1、3.4 |

第2章 Red Hat Gluster Storage のインストール

- テクノロジープレビューパッケージは、Red Hat Gluster Storage Server のこのインストールでもインストールされます。テクノロジープレビュー機能の一覧についての詳細は、『 『Red Hat Gluster Storage 3.4 リリースノート』』 の「 『テクノロジー』 プレビュー機能」の章を参照してください。

- Red Hat Gluster Storage Server がインストールされている仮想マシンのクローンを作成する場合には、クローンを作成する前に

/var/lib/glusterd/glusterd.infoファイル (ある場合) を削除する必要があります。このファイルを削除しないと、クローン作成されるマシンの UUID が同一になります。このファイルは、クローン作成された仮想マシン上の glusterd デーモンの初回起動時に UUID を使用して自動的に再作成されます。

2.1. Red Hat Gluster Storage の取得

2.1.1. Red Hat Gluster Storage Server for On-Premise の取得

- Red Hat カスタマーポータル (https://access.redhat.com/login) にアクセスし、ユーザー名およびパスワードを入力してログインします。

- Downloads をクリックし、 Software & Download Center に移動します。

- Red Hat Gluster Storage Server 領域で Download Software をクリックし、最新バージョンのソフトウェアをダウンロードします。

2.1.2. Red Hat Gluster Storage Server for Public Cloud の取得

2.2. ISO イメージからのインストール

2.2.1. Red Hat Enterprise Linux 6.7 以降への Red Hat Gluster Storage 3.4 のインストール

- の説明に従って、Red Hat Gluster Storage Server の ISO イメージファイルをダウンロードします。 「Red Hat Gluster Storage の取得」ISO イメージファイルを使用してシステムを起動すると、インストールプロセスが自動的に起動します。Enter を押してインストールプロセスを開始します。注記ハイパーバイザーによっては、仮想マシンに Red Hat Gluster Storage をインストールする際に、

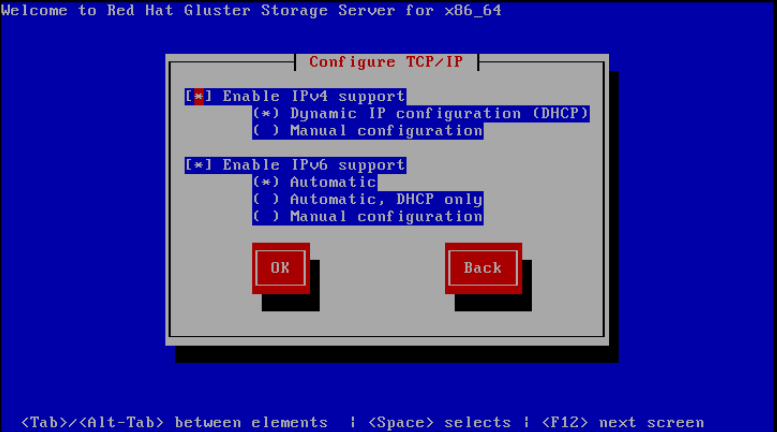

基本的なビデオドライバーで Install Systemを選択する必要があります。 - Configure TCP/IP 画面が表示されます。コンピューターが TCP/IP をサポートするように設定するには、Internet Protocol Version 4(IPv4)および Internet Protocol Version 6(IPv6)のデフォルト値を受け入れ、OK をクリックします。または、Internet Protocol Version 4(IPv4)とインターネットプロトコルバージョン 6(IPv6)の両方のネットワーク設定を手動で設定できます。重要Red Hat Gluster Storage の NLM ロッキングプロトコル実装は、IPv6 上のクライアントをサポートしません。

図2.1 TCP/IP の設定

- Welcome 画面が表示されます。Next をクリックします。

- 言語の選択画面が 表示されます。インストールの優先言語とシステムのデフォルトを選択し、Next をクリックします。

- Keyboard Configuration 画面が表示されます。インストールのキーボードレイアウトとシステムのデフォルトを選択し、Next をクリックします。

- ストレージデバイス 画面が 表示されます。Basic Storage Devices を選択します。Next をクリックします。

- ホスト名 設定画面が表示されます。コンピューターのホスト名を入力します。必要に応じて、ネットワークインターフェースを設定することもできます。Next をクリックします。

- Time Zone Configuration 画面が表示されます。お使いのコンピューターの物理的な場所に最も近い都市を選択して、タイムゾーンを設定します。

- Set Root Password 画面が表示されます。root アカウントの認証情報は、パッケージのインストール、RPM のアップグレード、およびほとんどのシステムメンテナンスの実行に使用されます。そのため、root アカウントおよびパスワードの設定は、インストールプロセスで最も重要な手順の 1 つです。注記root ユーザー(スーパーユーザーとしても知られる)には、システム全体への完全なアクセスがあります。このため、システムのメンテナンスや管理を行うのは、root ユーザーとしてログインする だけ で済みます。「 Set Root Password 」画面では、システムの root パスワードを設定するように求められます。root パスワードを入力せずにインストールプロセスの次のステージに進むことはできません。root パスワード フィールドに root パスワードを 入力し ます。入力した文字はセキュリティー上の理由からマスクされます。次に、確認 フィールドに同じパスワードを入力して、パスワードが 正しく設定されていることを確認します。root パスワードを設定したら、Next をクリックします。

- パーティションタイプ 画面が 表示されます。パーティション設定により、ハードドライブを、それぞれが独自のハードドライブとして動作する分離セクションに分割できます。パーティション設定は、複数のオペレーティングシステムを実行する場合に特に便利です。システムのパーティション設定方法が分からない場合は、『 『Red Hat Enterprise Linux 6 インストールガイド』』 の「 『ディスクパーティションの概要』 」を参照してください。重要Red Hat Enterprise Linux 7.5 でサポートされる Virtual Data Optimizer (VDO) ボリュームは、現時点では Red Hat Gluster Storage でサポートされていません。VDO は、Red Hat Hyperconverged Infrastructure for Virtualization 2.0 の一部として使用されている場合にのみサポートされます。詳細は、 VDO について参照してください。この画面では、デフォルトのパーティションレイアウトを 4 種類の方法で作成することも、カスタムレイアウトを作成するために手動でストレージデバイスを選択したりすることもできます。システムのパーティション設定に慣れていない場合は、最初の 4 つのオプションから 1 つ選択します。このオプションを使用すると、ストレージデバイスをパーティション設定しなくても自動インストールを実行できます。選択したオプションに応じて、どのデータがシステムから削除されるかを制御できます。オプションは以下のとおりです。

- すべてのスペースを使用する

- 既存の Linux システムの置き換え

- 現在のシステムの縮小

- 空き領域の使用

- カスタムレイアウトの作成

ダイアログボックスで説明の左側にあるラジオボタンをクリックして、希望のパーティション方法を選択します。選択した後に Next をクリックします。ディスクパーティション 『設定』 の詳細は、『 『Red Hat Enterprise Linux 6 インストールガイド』』 の「ディスクパーティションの設定」を参照してください。重要- ログファイルには十分な大きさ (50GB - 100GB) の別個の

/varパーティション、geo-レプリケーション関連の各種ファイルおよびその他のファイルを作成することが推奨されます。 - ユーザーが カスタムレイアウトの作成 を選択しない場合は、接続済み/検出されたすべてのディスクが / および

/home

- Boot Loader 画面にデフォルト設定が表示されます。Next をクリックします。

- 最小選択画面が 表示されます。Next をクリックしてデフォルトの選択を維持し、インストールを続行します。

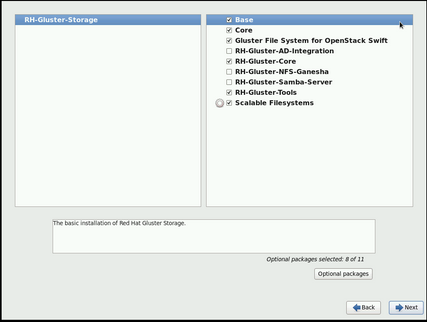

- パッケージセットをさらにカスタマイズするには、Customize now オプションを選択して Next をクリックします。これにより、ソフトウェアの選択 画面のカスタマイズ が表示されます。Next をクリックしてデフォルトの選択を維持し、インストールを続行します。

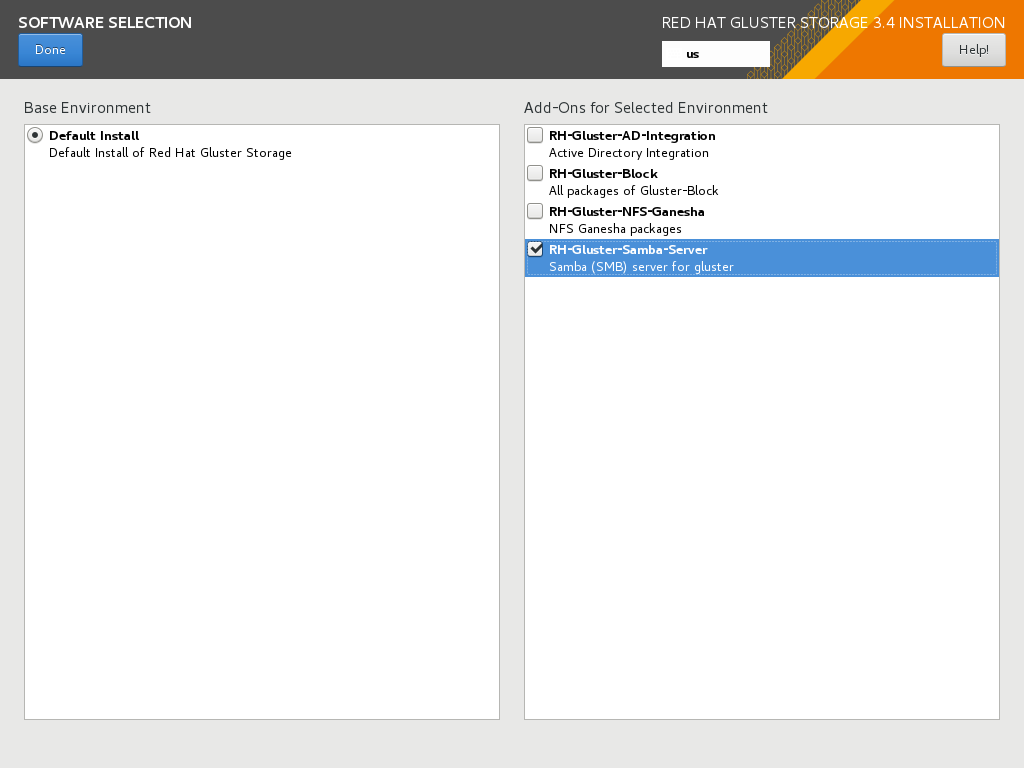

- Red Hat Gluster Storage 3.0.4 以降では、Samba パッケージが必要な場合は、「 ソフトウェアの選択のカスタマイズ」画面で RH-Gluster-Samba-Server コンポーネントを選択するようにして ください。gluster との samba アクティブディレクトリー統合が必要な場合は、RH-Gluster-AD-Integration コンポーネントを選択してください。NFS-Ganesha の場合は RH-Gluster-NFS-Ganesha を選択します。

図2.2 パッケージのカスタマイズ

- Package Installation 画面が表示されます。Red Hat Gluster Storage Server は、システムに選択したパッケージをインストールすると、画面に進捗を報告します。

- 正常に完了すると、Installation Complete の画面が表示されます。

- Reboot をクリックしてシステムを再起動し、Red Hat Gluster Storage Server のインストールを完了します。インストールメディアが再起動時に自動的に検出されない場合は、必ず削除してください。お疲れさまでした。これで、Red Hat Gluster Storage Server のインストールが完了しました。

2.2.2. Red Hat Enterprise Linux 7.5 以降への Red Hat Gluster Storage 3.4 のインストール

- 「Red Hat Gluster Storage の取得」に説明されているように Red Hat Gluster Storage Server の ISO イメージファイルをダウンロードします。

- Welcome to Red Hat Gluster Storage 3.4 画面で、残りのインストールに使用する言語を選択し、Continue をクリックします。この選択内容が、後に変更しない限り、インストール済みシステムのデフォルトになります。注記1 つの言語が一覧の上部に事前に設定されます。この時点でネットワークアクセスが設定されている場合 (たとえば、ローカルメディアではなくネットワークサーバーから起動した場合など)、事前に選択した言語は、GeoIP モジュールの使用による場所の自動検出に基づいて決定されます。

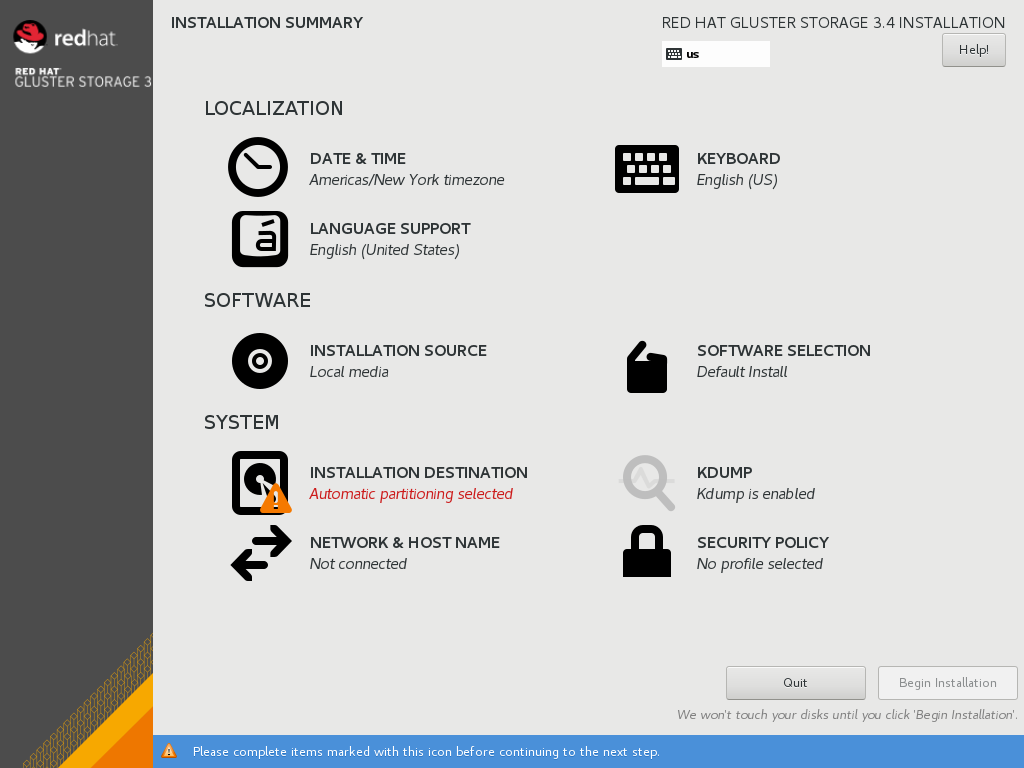

- Installation Summary 画面で、主なインストール設定を行います。

図2.3 インストールの概要

連続して画面を指定する代わりに、Red Hat Enterprise Linux 7.5 上の Red Hat Gluster Storage 3.4 インストールプログラムでは、選択した順序でインストールを設定できます。インストールのセクションを設定するためにメニュー項目を選択します。セクションの設定が完了した後にそのセクションを後で完了することを希望する場合は、画面左上にある Done ボタンをクリックします。警告シンボルのマークが付いたセクションのみが必須です。画面の下部の注で警告されているように、これらをインストールを開始する前に選択する必要があります。残りのセクションはオプションです。各セクションのタイトルの下には、現在の設定の概要が示されます。これを使用して、追加で設定するセクションに移動する必要があるかどうかを判断できます。以下の一覧は、Installation Summary 画面の各メニュー項目の簡単な要約を示します。

連続して画面を指定する代わりに、Red Hat Enterprise Linux 7.5 上の Red Hat Gluster Storage 3.4 インストールプログラムでは、選択した順序でインストールを設定できます。インストールのセクションを設定するためにメニュー項目を選択します。セクションの設定が完了した後にそのセクションを後で完了することを希望する場合は、画面左上にある Done ボタンをクリックします。警告シンボルのマークが付いたセクションのみが必須です。画面の下部の注で警告されているように、これらをインストールを開始する前に選択する必要があります。残りのセクションはオプションです。各セクションのタイトルの下には、現在の設定の概要が示されます。これを使用して、追加で設定するセクションに移動する必要があるかどうかを判断できます。以下の一覧は、Installation Summary 画面の各メニュー項目の簡単な要約を示します。日付と時間

NTP を設定するには、以下の手順を実行します。重要Gluster インストールには、NTP の設定が必須です。- Date & Time をクリックし、システムクロックの精度を維持するためにタイムゾーンを指定します。

- Network Time スイッチを ON に切り替えます。注記デフォルトで、ネットワークに接続している場合は Network Time スイッチが有効になります。

- 設定アイコンをクリックして新しい NTP サーバーを追加するか、または既存のサーバーを選択します。

- 追加または選択が完了したら、Done をクリックして Installation Summary 画面に戻ります。

注記NTP サーバーはインストール時に利用できない場合があります。この場合、これらを有効にしても時間は自動的に設定されません。サーバーが利用可能になると、日付と時刻が更新されます。言語サポート

追加のロケールおよび言語のサポートをインストールするには、Language Support を選択します。

キーボード設定

複数のキーボードレイアウトをシステムに追加するには、Keyboard を選択します。

インストールソース

Red Hat Enterprise Linux のインストール元となるファイルまたは場所を指定するには、Installation Source を選択します。この画面では、DVD や ISO ファイル、またはネットワークの場所など、ローカルで利用可能なインストールメディアを選択できます。

ネットワークおよびホスト名

システムに必要なネットワーク機能を設定するには、Network & Hostname を選択します。

重要Red Hat Enterprise Linux 7.5 のインストールで Red Hat Gluster Storage 3.4 が終了し、システムを初めて起動すると、インストール中に設定したネットワークインターフェースがすべてアクティベートされます。ただし、インストールは、一般的なインストールパス上でネットワークインターフェースを設定するように要求しません。たとえば、Red Hat Gluster Storage 3.4 を DVD からローカルのハードドライブにインストールする場合などです。ローカルのインストールソースからローカルストレージデバイスに Red Hat Gluster Storage 3.4 を Red Hat Enterprise Linux 7.5 にインストールする場合は、システムの初回起動時にネットワークアクセスが必要な場合には、ネットワークインターフェースを手動で設定する必要があります。また、設定を編集した場合は、起動後に自動で接続が行われるよう接続の設定もしておく必要があります。ソフトウェアの選択

インストールするパッケージを指定するには、Software Selection を選択します。以下のオプションのアドオンが必要な場合は、必要なアドオンを選択して Done をクリックします。

- RH-Gluster-AD-Integration

- RH-Gluster-NFS-Ganesha

- RH-Gluster-Samba-Server

インストール先

ディスクを選択し、Red Hat Gluster Storage をインストールするストレージ領域のパーティションを設定するには、Installation Destination を選択します。詳細は、Red Hat Enterprise Linux 7 インストールガイドの『Installation Destination』を参照してください。

Kdump

kdump は、カーネルクラッシュをダンプするメカニズムであり、システムクラッシュが発生時にクラッシュの原因を判別するのに極めて重要となる情報をキャプチャーします。このオプションは、システムで Kdump を使用するかどうかを選択する場合に使用します。

- 必要な設定を行ったら、インストール Installation Summary 画面で Begin Installation をクリックします。警告インストールプロセスのこの時点では、永続的な変更はコンピューターに加えられていません。Begin Installation をクリックすると、インストールプログラムはハードドライブの領域を割り当て、Red Hat Gluster Storage をこの領域に移動します。選択するパーティショニングオプションによっては、このプロセスにコンピューター上にすでに存在するデータの消去が含まれる場合があります。この時点までに行った選択のいずれかを変更するには、Installation Summary 画面の該当セクションに戻ります。インストールを完全に中止するには、Quit をクリックするか、コンピューターの電源を切ります。インストールのカスタマイズを終了し、インストールを続行する場合は、Begin Installation をクリックします。Begin Installation をクリックした後に、インストールプロセスを完了させます。たとえば、コンピューターの電源をオフにしたり、コンピューターをリセットしたり、電源異常が発生するなどでプロセスが中断された場合、Red Hat Gluster Storage のインストールプロセスを再開し、これを完了するまで、てコンピューターを使用できない可能性があります。

- Begin Installation をクリックすると、進捗画面が表示されます。Red Hat Gluster Storage では、選択したパッケージをシステムに書き込む際に画面にインストールの進捗が報告されます。以下は、この画面上のオプションの簡単な説明です。

root パスワード

Root Password メニュー項目は、root アカウントのパスワードを設定するために使用されます。root アカウントは、重要なシステム管理および管理タスクを実行するために使用されます。パスワードは、パッケージのインストール中またはその後に設定可能ですが、これが設定されるまでインストールプロセスを完了できません。

ユーザーの作成

ユーザーアカウントの作成はオプションであり、インストール後に実行できますが、この画面上で行うことが推奨されます。ユーザーアカウントは、通常の作業やシステムへのアクセスに使用されます。ベストプラクティスとして、root アカウントではなく、ユーザーアカウントを使用して常にシステムにアクセスすることが推奨されます。

- インストールが完了したら、Reboot をクリックしてシステムを再起動し、Red Hat Gluster Storage の使用を開始します。

2.3. Red Hat Gluster Storage Server の Red Hat Enterprise Linux へのインストール (階層化インストール)

/var パーティション、geo-レプリケーション関連の各種ファイルおよびその他のファイルを作成することが推奨されます。

Red Hat Enterprise Linux Server のベースインストールの実行

Red Hat Gluster Storage には、カーネルバージョン 2.6.32-431.17.1 以降が必要です。これは、Red Hat Enterprise Linux 6.5 以降、および Red Hat Enterprise Linux 7 で利用できます。システムの Subscription Manager への登録

以下のコマンドを実行して、システムを Red Hat Network に登録するために必要な Red Hat Network のユーザー名およびパスワードを入力します。# subscription-manager register

利用可能なエンタイトルメントプールの特定

以下のコマンドを実行して、Red Hat Gluster Storage のインストールに必要なリポジトリーが含まれるエンタイトルメントプールを見つけます。# subscription-manager list --available

システムへのエンタイトルメントプールのアタッチ

先の手順で特定したプール ID を使用して、Red Hat Enterprise Linux ServerおよびRed Hat Gluster Storageのエンタイトルメントをシステムにアタッチします。以下のコマンドを実行してエンタイトルメントをアタッチします。# subscription-manager attach --pool=[POOLID]

以下に例を示します。# subscription-manager attach --pool=8a85f9814999f69101499c05aa706e47

必要なチャンネルの有効化

Red Hat Enterprise Linux 6.7 以降における Red Hat Gluster Storage 3.4 向け

- 以下のコマンドを実行して、Red Hat Gluster Storage のインストールに必要なリポジトリーを有効にします。

# subscription-manager repos --enable=rhel-6-server-rpms # subscription-manager repos --enable=rhel-scalefs-for-rhel-6-server-rpms # subscription-manager repos --enable=rhs-3-for-rhel-6-server-rpms

- Red Hat Gluster Storage 3.0.4 以降では、Samba が必要な場合は、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-6-server-rpms

Samba のインストールに関する詳細は、3章Samba の Red Hat Gluster Storage へのデプロイを参照してください。 - NFS-Ganesha は、Red Hat Enterprise Linux 6 ベースのインストールではサポートされません。

Red Hat Enterprise Linux 7.x 上の Red Hat Gluster Storage 3.4 の場合

- 以下のコマンドを実行して、Red Hat Gluster Storage のインストールに必要なリポジトリーを有効にします。

# subscription-manager repos --enable=rhel-7-server-rpms # subscription-manager repos --enable=rh-gluster-3-for-rhel-7-server-rpms

- Red Hat Gluster Storage 3.0.4 以降では、Samba が必要な場合は、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-7-server-rpms

Samba のインストールに関する詳細は、3章Samba の Red Hat Gluster Storage へのデプロイを参照してください。 - NFS-Ganesha が必要な場合には、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-nfs-for-rhel-7-server-rpms --enable=rhel-ha-for-rhel-7-server-rpms

NFS-Ganesha のインストールについての詳細は、4章NFS-Ganesha の Red Hat Gluster Storage への NFS-Ganesha へのデプロイを参照してください。

チャンネルが有効であるかどうかの確認

以下のコマンドを実行して、チャンネルが有効であるかどうかを確認します。# yum repolist

カーネルバージョンの要件

Red Hat Gluster Storage では、kernel-2.6.32-431.17.1.el6 バージョン以降をシステムで使用する必要があります。以下のコマンドを実行して、インストール済みの実行中のカーネルのバージョンを確認します。# rpm -q kernel kernel-2.6.32-431.el6.x86_64 kernel-2.6.32-431.17.1.el6.x86_64

# uname -r 2.6.32-431.17.1.el6.x86_64

すべてのパッケージの更新

以下のコマンドを実行して、すべてのパッケージが最新の状態であることを確認します。# yum update

重要いずれかのカーネルパッケージを更新した場合は、以下のコマンドを実行してシステムを再起動します。# shutdown -r now

Red Hat Gluster Storage のインストール

以下のコマンドを実行して Red Hat Gluster Storage をインストールします。# yum install redhat-storage-server

- Red Hat Gluster Storage 3.0.4 以降では、Samba が必要な場合は、以下のコマンドを実行して Samba をインストールします。

# yum groupinstall RH-Gluster-Samba-Server

- Samba Active Directory の gluster との統合が必要な場合は、以下のコマンドを実行します。

# yum groupinstall RH-Gluster-AD-Integration

- NFS-Ganesha をインストールするには、4章NFS-Ganesha の Red Hat Gluster Storage への NFS-Ganesha へのデプロイを参照してください。

再起動

システムを再起動します。

2.4. PXE サーバーからのインストール

Network Boot または Boot Services のラベルを付けられる場合があります。PXE ブートを適切に設定すると、コンピューターは他のメディアなしで Red Hat Gluster Storage Server インストールシステムを起動できます。

- ネットワークケーブルが接続されていることを確認します。コンピューターの電源がオンになっていない場合でも、ネットワークソケットのリンクインジケーターのライトがオンになっているはずです。

- コンピューターの電源を入れます。

- メニュー画面が表示されます。優先オプションに対応する数字キーを押します。

2.5. Red Hat Satellite Server からのインストール

2.5.1. Red Hat Satellite Server 6.x の使用

- 新規マニフェストファイルを作成し、Satellite 6 サーバーにマニフェストをアップロードします。

- 必要な Red Hat Gluster Storage リポジトリーを検索し、それらを有効にします。

- Red Hat Gluster Storage について有効にされているすべてのリポジトリーを同期します。

- 新規のコンテンツビューを作成し、必要なすべての製品を追加します。

- コンテンツビューを公開し、アクティベーションキーを作成します。

- 必要なクライアントの登録

# rpm -Uvh satellite-server-host-address/pub/katello-ca-consumer-latest.noarch.rpm # subscription-manager register --org=”Organization_Name” --activationkey=”Activation_Key”

- 利用可能なエンタイトルメントプールの特定

# subscription-manager list --available

- システムへのエンタイトルメントプールのアタッチ

# subscription-manager attach --pool=Pool_ID

- 必要なチャンネルのサブスクライブ

- RHEL および Gluster チャンネルの有効化

# subscription-manager repos --enable=rhel-7-server-rpms --enable=rh-gluster-3-for-rhel-7-server-rpms

- Samba が必要な場合は、そのリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-7-server-rpms

- NFS-Ganesha が必要な場合は、そのリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-nfs-for-rhel-7-server-rpms

- HA が必要な場合は、そのリポジトリーを有効にします。

# subscription-manager repos --enable=rhel-ha-for-rhel-7-server-rpms

- gdeploy が必要な場合は、Ansible リポジトリーを有効にします。

# subscription-manager repos --enable=rhel-7-server-ansible-2-rpms

- Web 管理が必要な場合は、「Web 管理 のインストール」を参照してください。

- Red Hat Gluster Storage のインストール

# yum install redhat-storage-server

2.5.2. Red Hat Satellite Server 5.x の使用

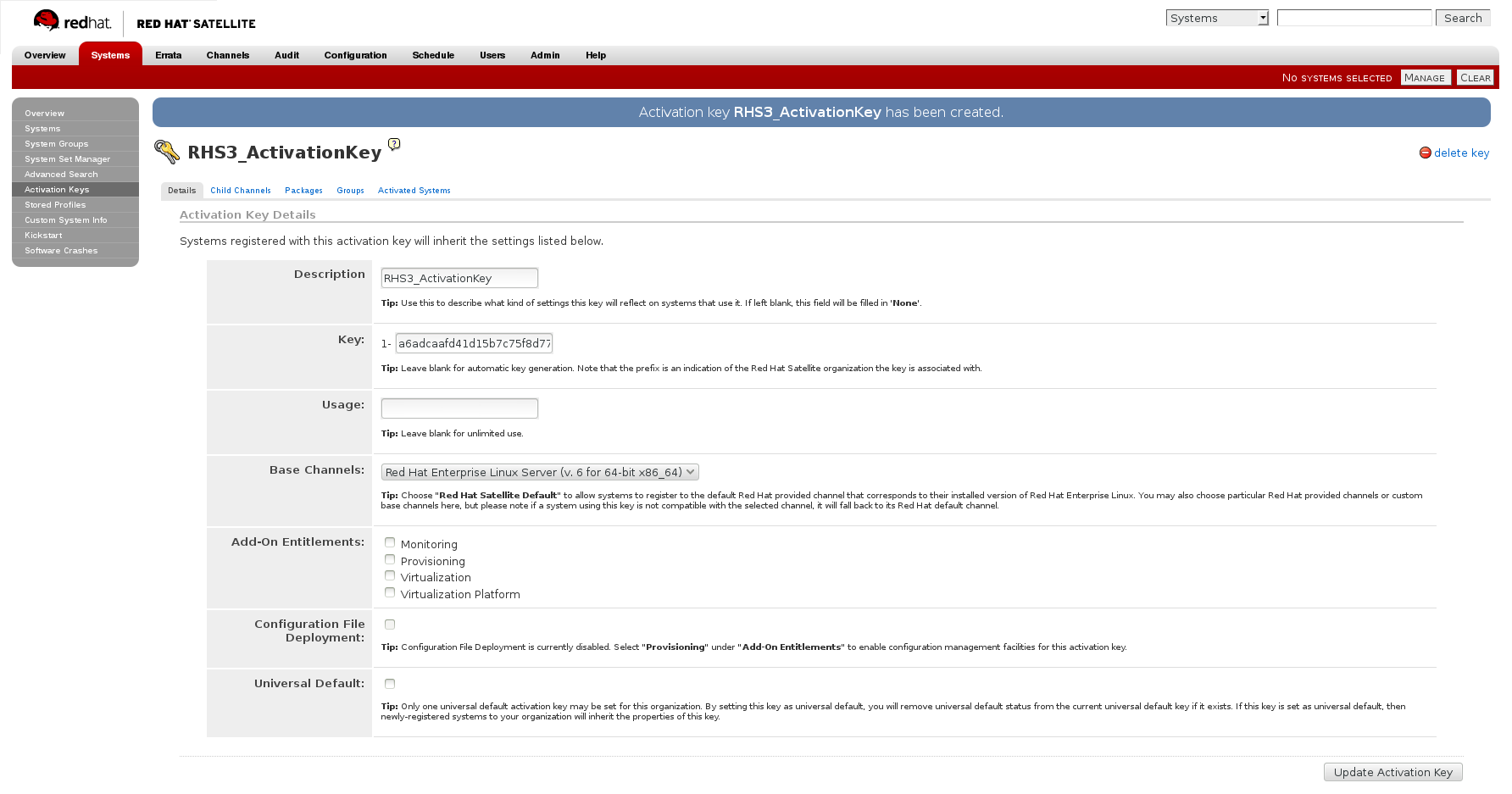

アクティベーションキーの作成

アクティベーションキーの作成方法について詳しくは、『 『Red Hat Network Satellite リファレンスガイド』』 の「 『アクティベーションキー』 」を参照してください。

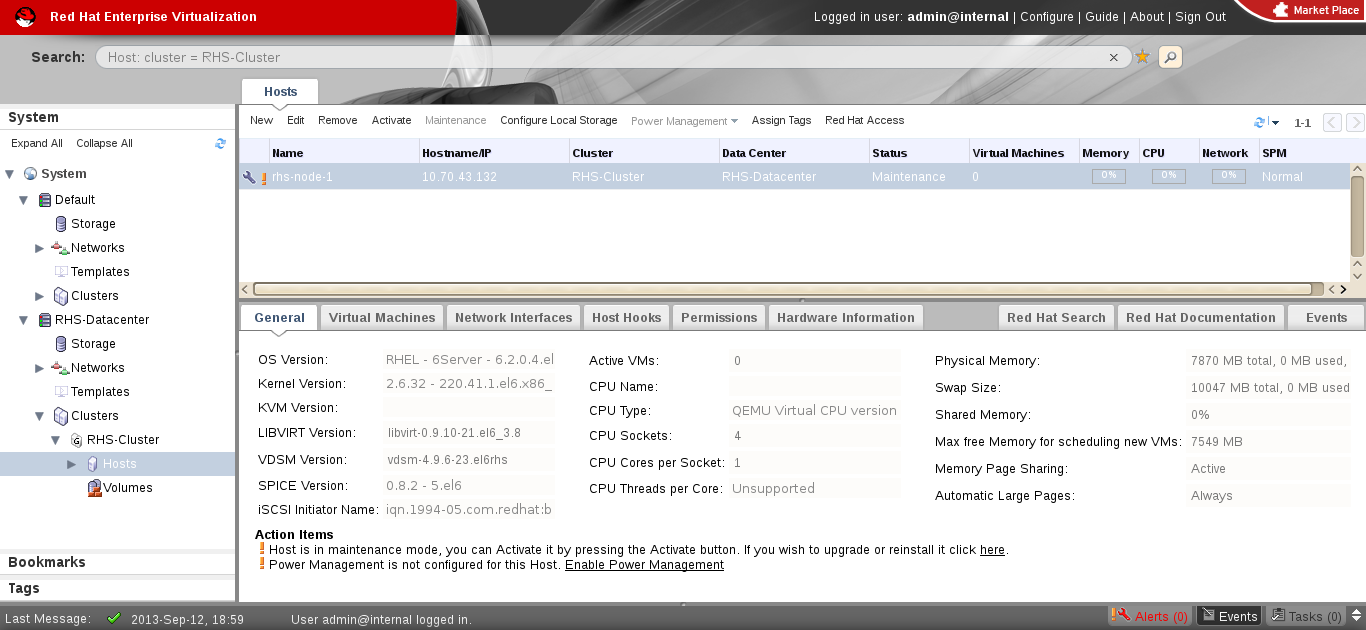

- Activation Keys 画面の Details タブで、Base Channels ドロップダウンリストから

Red Hat Enterprise Linux Server (v.6 for 64-bit x86_64)を選択します。図2.4 ベースチャンネル

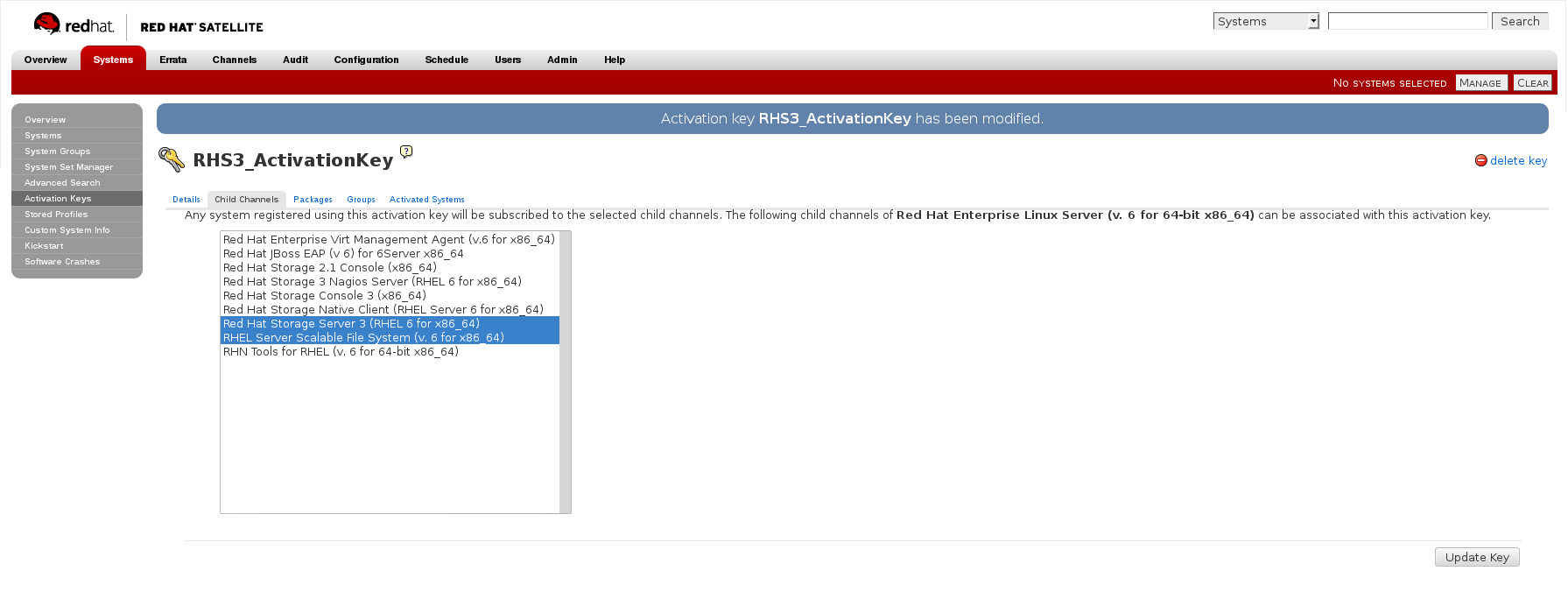

- Activation Keys 画面の Child Channels タブで、以下の子チャンネルを選択します。

RHEL Server Scalable File System (v. 6 for x86_64) Red Hat Gluster Storage Server 3 (RHEL 6 for x86_64)

Red Hat Gluster Storage 3.0.4 以降では、Samba パッケージが必要な場合は、以下の子チャンネルを選択します。Red Hat Gluster 3 Samba (RHEL 6 for x86_64)

図2.5 子チャンネル

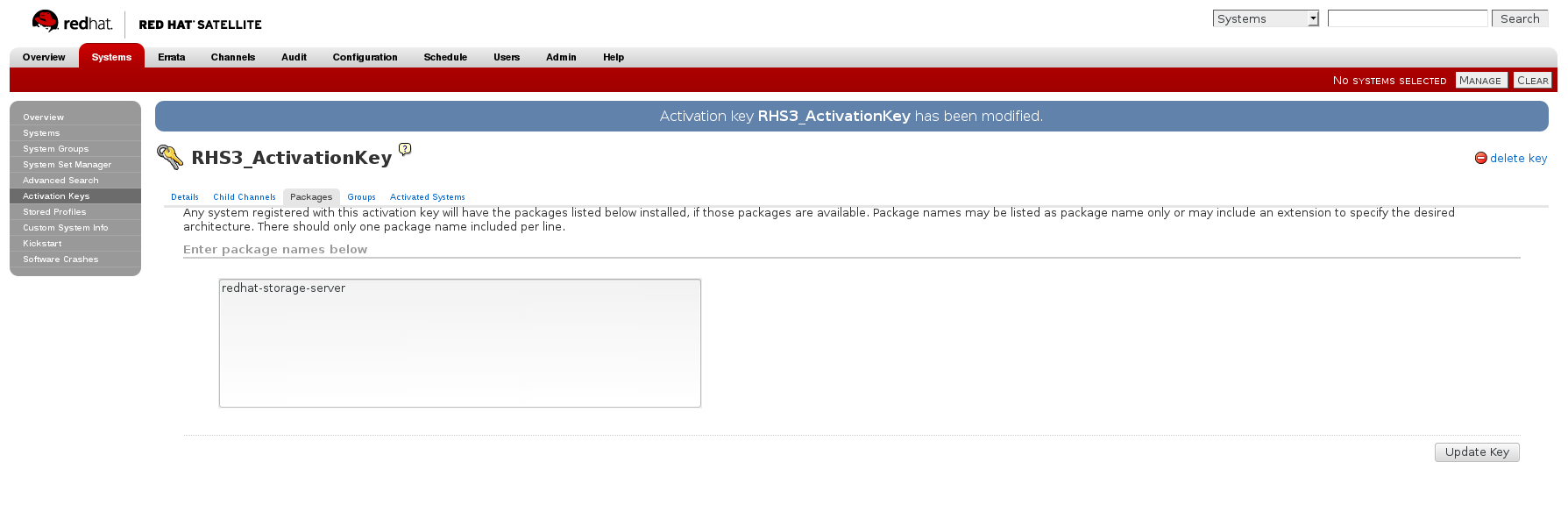

- Activation Keys 画面の Packages タブで、以下のパッケージ名を入力します。

redhat-storage-server

図2.6 Package

- Red Hat Gluster Storage 3.0.4 以降の場合は、Samba パッケージが必要な場合は、以下のパッケージ名を入力します。

samba

キックスタートプロファイルの作成

キックスタートプロファイルの作成方法は、『 『Red Hat Network Satellite リファレンスガイド』』 の「 『キック』 スタート」を参照してください。

- キックスタートプロファイルを作成する場合は、以下の

Base ChannelおよびTreeを選択する必要があります。Base Channel: Red Hat Enterprise Linux Server(64 ビット x86_64 の場合は v.6)Tree: ks-rhel-x86_64-server-6-6.5 - 子チャンネルはキックスタートプロファイルに関連付けないでください。

- 以前に作成したアクティベーションキーをキックスタートプロファイルに関連付けます。

- デフォルトで、キックスタートプロファイルは、ユーザーパスワードのハッシュアルゴリズムとして

md5を選択します。キックスタートプロファイルのKickstart Details、Advanced Optionsページのauthフィールドに以下の設定を指定し、このアルゴリズムをsha512に変更する必要があります。--enableshadow --passalgo=sha512

- キックスタートプロファイルを作成したら、キックスタートプロファイルの Kickstart Details、Advanced Options ページで root パスワードを変更し、準備済みの sha512 ハッシュアルゴリズムに基づいて root パスワードを追加する必要があります。

キックスタートプロファイルを使用した Red Hat Gluster Storage Server のインストール

キックスタートプロファイルを使用して Red Hat Gluster Storage Server をインストールする方法は、『 『Red Hat Network Satellite リファレンスガイド』』 の「キックスタート」を参照してください。『』

2.6. Red Hat Gluster Storage Server チャンネルのサブスクライブ

Subscription Manager の使用

システムの Subscription Manager への登録

以下のコマンドを実行して、Red Hat Network のユーザー名およびパスワードを入力して、システムを Subscription Manager に登録します。# subscription-manager register

利用可能なエンタイトルメントプールの特定

以下のコマンドを実行して、Red Hat Gluster Storage のインストールに必要なリポジトリーが含まれるエンタイトルメントプールを見つけます。# subscription-manager list --available | grep -A8 "Red Hat Enterprise Linux Server" # subscription-manager list --available | grep -A8 "Red Hat Storage"

システムへのエンタイトルメントプールのアタッチ

先の手順で特定したプール ID を使用して、Red Hat Enterprise Linux ServerおよびRed Hat Gluster Storageのエンタイトルメントをシステムにアタッチします。以下のコマンドを実行してエンタイトルメントをアタッチします。# subscription-manager attach --pool=[POOLID]

以下に例を示します。# subscription-manager attach --pool=8a85f9814999f69101499c05aa706e47

Red Hat Enterprise Linux で Red Hat Gluster Storage に必要なチャンネルの有効化

Red Hat Enterprise Linux 6.7 以降における Red Hat Gluster Storage 3.4 向け

- 以下のコマンドを実行して、Red Hat Gluster Storage のインストールに必要なリポジトリーを有効にします。

# subscription-manager repos --enable=rhel-6-server-rpms # subscription-manager repos --enable=rhel-scalefs-for-rhel-6-server-rpms # subscription-manager repos --enable=rhs-3-for-rhel-6-server-rpms

- Red Hat Gluster Storage 3.0.4 以降では、Samba が必要な場合は、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-6-server-rpms

- NFS-Ganesha は、Red Hat Enterprise Linux 6 ベースのインストールではサポートされません。

Red Hat Enterprise Linux 7.5 上の Red Hat Gluster Storage 3.4 の場合

- 以下のコマンドを実行して、Red Hat Gluster Storage のインストールに必要なリポジトリーを有効にします。

# subscription-manager repos --enable=rhel-7-server-rpms # subscription-manager repos --enable=rh-gluster-3-for-rhel-7-server-rpms

- Red Hat Gluster Storage 3.0.4 以降では、Samba が必要な場合は、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-7-server-rpms

- Red Hat Gluster Storage 3.4 では、NFS-Ganesha が必要な場合は、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-nfs-for-rhel-7-server-rpms --enable=rhel-ha-for-rhel-7-server-rpms

- Red Hat Gluster Storage 3.4 では、CtrlC が必要な場合は、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-7-server-rpms

チャンネルが有効であるかどうかの確認

以下のコマンドを実行して、チャンネルが有効であるかどうかを確認します。# yum repolist

Red Hat Satellite Server の使用

Red Hat Satellite にアクセスするためのクライアントシステムの設定

Red Hat Satellite にアクセスできるようにクライアントシステムを設定します。『『Red Hat Satellite 5.6 Client Configuration Guide』』の「『Registering Clients with Red Hat Satellite Server』」のセクションを参照してください。Red Hat Satellite Server への登録

以下のコマンドを実行して、システムを Red Hat Satellite Server に登録します。# rhn_register

標準ベースチャンネルへの登録

利用可能なオペレーティングシステムのリリースページで、すべての利用可能な更新を選択し、プロンプトに従ってシステムを RHEL 6 - rhel-x86_64-server-6 の標準のベースチャンネルに登録します。RHEL 7 の標準ベースチャンネルは RHEL7-rhel-x86_64-server-7 です。必要な Red Hat Gluster Storage Server チャンネルのサブスクライブ

Red Hat Enterprise Linux 6.7 以降における Red Hat Gluster Storage 3.4 向け

- 以下のコマンドを実行して、必要な Red Hat Gluster Storage サーバーチャンネルにシステムをサブスクライブします。

# rhn-channel --add --channel rhel-x86_64-server-6-rhs-3 --channel rhel-x86_64-server-sfs-6

- Red Hat Gluster Storage 3.0.4 以降では、Samba が必要な場合は、以下のコマンドを実行して必要なチャネルを有効にします。

# rhn-channel --add --channel rhel-x86_64-server-6-rh-gluster-3-samba

- NFS-Ganesha は、Red Hat Enterprise Linux 6 ベースのインストールではサポートされません。

Red Hat Enterprise Linux 7.5 上の Red Hat Gluster Storage 3.4 の場合

- 以下のコマンドを実行して、RHEL 7 に必要な Red Hat Gluster Storage サーバーチャネルにシステムをサブスクライブします。

# rhn-channel --add --channel rhel-x86_64-server-7-rh-gluster-3

- Red Hat Gluster Storage 3.0.4 以降では、Samba が必要な場合は、以下のコマンドを実行して必要なチャネルを有効にします。

# rhn-channel --add --channel rhel-x86_64-server-7-rh-gluster-3-samba

- Red Hat Gluster Storage 3.4 では、NFS-Ganesha の場合は以下のチャネルを有効にします。

# rhn-channel --add --channel rhel-x86_64-server-7-rh-gluster-3-nfs --channel rhel-x86_64-server-ha-7

- Red Hat Gluster Storage 3.4 では、IaaS が必要な場合は、以下のチャンネルを有効にします。

# rhn-channel --add --channel rhel-x86_64-server-7-rh-gluster-3-samba

システムが正常に登録されたかどうかを確認します。

以下のコマンドを実行して、システムが正常に登録されていることを確認します。# rhn-channel --list rhel-x86_64-server-7 rhel-x86_64-server-7-rh-gluster-3

2.7. glusterd サービスの管理

glusterd サービスは、信頼できるストレージプールのすべてのサーバーで自動的に起動します。このサービスは、glusterd サービスのコマンドを使用して手動で起動および停止できます。信頼されたストレージプールの作成に関する情報は、『 『Red Hat Gluster Storage 3.4 Administration Guide :https://access.redhat.com/documentation/ja-jp/red_hat_gluster_storage/3.4/html-single/administration_guide/#idm140612789187008 』』 を参照してください。

glusterd は柔軟性のあるボリューム管理を行います。

2.7.1. glusterd の手動による起動および停止

glusterd サービスを手動で起動し、停止します。

- 以下のように glusterd を手動で起動します。

# /etc/init.d/glusterd start

または# service glusterd start

- 以下のように glusterd を手動で停止します。

# /etc/init.d/glusterd stop

または# service glusterd stop

2.8. Gdeploy をサポートする Ansible のインストール

- 以下のコマンドを実行して、Ansible のインストールに必要なリポジトリーを有効にします。

# subscription-manager repos --enable=rhel-7-server-ansible-2-rpms

- 以下のコマンドを実行して、

ansibleをインストールします。# yum install ansible

2.9. ネイティブクライアントのインストール

第3章 Samba の Red Hat Gluster Storage へのデプロイ

3.1. 前提条件

- Red Hat Gluster Storage Server 3.0.4 をターゲットサーバーにインストールする必要があります。警告

- Red Hat Gluster Storage の階層化インストールの場合、Red Hat Enterprise Linux から Samba または CTDB パッケージがインストールされていない状態で、デフォルトの Red Hat Enterprise Linux サーバーインストールのみがあることを確認します。

- Samba バージョン 3 は、Red Hat Gluster Storage 3.0 Update 4 で非推奨にされていいます。samba-3.x では、それ以降の更新は提供されません。セキュリティー更新を含むすべての更新について、別のチャンネルまたはリポジトリーで提供される Samba-4.x にアップグレードすることが推奨されます。

- CTDB バージョン 2.5 は、Red Hat Gluster Storage 3.1 Update 2 ではサポートされていません。Red Hat Gluster Storage 3.1.2 以降で CTDB を使用するには、システムを Red Hat Gluster Storage の Samba チャンネルで提供される CTDB 4.x にアップグレードする必要があります。

- Samba 4.x から Samba 3.x への Samba のダウングレードはサポートされていません。

- 同じクラスターで異なるバージョンの Samba を実行するとデータが破損するため、Samba がすべてのノードで同時にアップグレードされることを確認します。

- Samba パッケージが利用可能なチャンネルを有効にします。

Red Hat Enterprise Linux 6.x 上の Red Hat Gluster Storage 3.4 の場合

- Red Hat Subscription Manager を使用してマシンを登録した場合は、以下のコマンドを実行してリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-6-server-rpms

- Satellite サーバーを使用してマシンを登録している場合は、以下のコマンドを実行してチャンネルを有効にします。

# rhn-channel --add --channel rhel-x86_64-server-6-rh-gluster-3-samba

Red Hat Enterprise Linux 7.x 上の Red Hat Gluster Storage 3.4 の場合

- Red Hat Subscription Manager を使用してマシンを登録した場合は、以下のコマンドを実行してリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-7-server-rpms

- Satellite サーバーを使用してマシンを登録している場合は、以下のコマンドを実行してチャンネルを有効にします。

# rhn-channel --add --channel rhel-x86_64-server-7-rh-gluster-3-samba

3.2. ISO を使用した Samba のインストール

図3.1 パッケージのカスタマイズ

3.3. yum を使用した Samba のインストール

# yum groupinstall RH-Gluster-Samba-Server

# yum groupinstall RH-Gluster-AD-Integration

Samba は、以下の手順に従ってインストールすることもできます。

- 基本的な Samba パッケージをインストールするには、以下のコマンドを実行します。

# yum install samba

smbclientをサーバーで必要とする場合は、以下のコマンドを実行します。# yum install samba-client

- Active ディレクトリーの設定が必要な場合は、以下のコマンドを実行します。

# yum install samba-winbind # yum install samba-winbind-clients # yum install samba-winbind-krb5-locator

- 以下のパッケージがインストールされているかどうかを確認します。

samba-libs samba-winbind-krb5-locator samba-winbind-modules samba-vfs-glusterfs samba-winbind samba-client samba-common samba-winbind-clients samba

第4章 NFS-Ganesha の Red Hat Gluster Storage への NFS-Ganesha へのデプロイ

- yum を使用した NFS-Ganesha のインストール

- ISO インストール時の NFS-Ganesha のインストール

4.1. 前提条件

Red Hat Enterprise Linux 7.x 上の Red Hat Gluster Storage 3.4 の場合

NFS-Ganesha パッケージが利用可能なチャンネルを有効にします。

- Red Hat Subscription Manager を使用してマシンを登録した場合は、以下のコマンドを実行してリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-nfs-for-rhel-7-server-rpms

HA リポジトリーを追加するには、以下のコマンドを実行します。# subscription-manager repos --enable=rhel-7-server-rpms --enable=rhel-ha-for-rhel-7-server-rpms

- Satellite サーバーを使用してマシンを登録している場合は、以下のコマンドを実行してチャンネルを有効にします。

# rhn-channel --add --channel rhel-x86_64-server-7-rh-gluster-3-nfs

HA チャンネルにサブスクライブするには、以下のコマンドを実行します。# rhn-channel --add --channel rhel-x86_64-server-ha-7

4.2. ISO インストール時の NFS-Ganesha のインストール

- ISO を使用して Red Hat Storage をインストールする場合は、Customizing the Software Selection 画面で RH-Gluster-NFS-Ganesha を選択し、Next をクリックします。

- Red Hat Gluster Storage のインストールの残りのインストール手順に進んでください。ISO を使用して Red Hat Storage をインストールする方法についての詳細は、「ISO イメージからのインストール」を参照してください。

4.3. yum を使用した NFS-Ganesha のインストール

- 以下のコマンドを使用して、glusterfs-ganesha パッケージをインストールできます。

# yum install glusterfs-ganesha

NFS-Ganesha は上記のパッケージと共にインストールされます。nfs-ganesha-gluster および HA パッケージもインストールされます。

第5章 Red Hat Gluster Storage への gstatus のデプロイ

- ISO インストール時の gstatus のインストール

- yum または Red Hat Satellite Server または Red Hat Network を使用したインストール

5.1. ISO インストール時の gstatus のインストール

- ISO を使用して Red Hat Storage をインストールする際に、ソフトウェアの選択画面のカスタマイズ で Red Hat Storage Tools グループ を選択し、Optional Packages をクリックします。

- パッケージ一覧から gstatus を選択し、Close をクリックします。

- Red Hat Storage のインストールには、残りのインストール手順に進んでください。ISO を使用して Red Hat Storage をインストールする方法の詳細は、「ISO イメージ 『からのインストール」を参照してください』。

5.2. yum または Red Hat Satellite Server または Red Hat Network を使用したインストール

# yum install gstatus

# yum list gstatus Installed Packages gstatus.x86_640.65-1@rhs-3-for-rhel-6-server-rpms

第6章 3.4.x から 3.4.y への Red Hat Gluster Storage の更新

- これは、同じメジャーバージョンバージョンのマイナーリリース間の更新です。メジャーバージョン間のアップグレードを行う場合は、7章Red Hat Gluster Storage 3.4 へのアップグレード を参照してください。

- Red Hat Gluster Storage の非同期エラータ更新リリースには、最後にリリースしてから累積更新として非同期にリリースされた修正がすべて含まれます。

- 非常に多くのブリックまたはスナップショットをホストする Red Hat Gluster Storage サーバーノードが更新されると、すべてのブリックおよびスナップショットに対してすべてのブリックプロセスを同時に開始しようとするため、クラスター管理コマンドは応答しなくなることがあります。250 を超えるブリックまたはスナップショットが 1 つのノードでホストされる場合、Red Hat は更新が完了するまでスナップショットを無効にすることを推奨します。

- NFS-Ganesha のインサービスアップグレードを実行すると、新しい設定ファイルは

/etc/ganeshaフォルダーにganesha.conf.rpmnewという名前で保存されます。古い設定ファイルは、インサービスアップグレードプロセス時に上書きされません。ただし、アップグレード後、ganesha.conf.rpmnewから、/etc/ganeshaフォルダーにある既存のganesha.confファイルに、新しい設定変更を手動でコピーする必要があります。

6.1. アップデート前の注意事項

- オペレーティングシステムパーティションにない場所にバックアップします。

- 完全バックアップに十分な空き領域があることを確認してください。

- データファイルをコピーする前に、

.glusterfsディレクトリーをコピーします。 - 以下の設定ディレクトリーおよびファイルがバックアップされていることを確認します。

/var/lib/glusterd/etc/swift/etc/samba/etc/ctdb/etc/glusterfs/var/lib/samba/var/lib/ctdb/var/run/gluster/shared_storage/nfs-ganesha

NFS-Ganesha を使用する場合は、全ノードの以下のファイルがバックアップされていることを確認します。/etc/ganesha/exports/export.*.conf/etc/ganesha/ganesha.conf/etc/ganesha/ganesha-ha.conf

- すべての拡張属性、ACL、所有者、グループ、シンボリックリンク、およびシンボリックリンクがバックアップされていることを確認します。

- バックアップまたは更新プロセス時に、Red Hat Gluster Storage ファイルシステムに新しいファイルが作成されていないことを確認してください。

- 更新を行う前に、バックアップが正常に復元されていることを確認します。

- シンプロビジョニングされた論理ボリュームを新たに作成します。詳細は、https://access.redhat.com/site/documentation/en-US/Red_Hat_Enterprise_Linux/6/html/Logical_Volume_Manager_Administration/thinprovisioned_volumes.html を参照してください。

- バックアップしたコンテンツを、新たに作成したシンプロビジョニング論理ボリュームに復元します。

Red Hat Gluster Storage Web Administration Update

- 要約された Web 管理更新シーケンスは、Red Hat Gluster Storage 全体のオフライン更新またはサービスの更新の一部です。スタンドアロンコンポーネントとしての Web 管理の更新はサポートされていません。

- このセクション 7.2 に戻ります。オフラインモードでの Red Hat Gluster Storage の更新 を参照してください。Red Hat Gluster Storage を 3.4.x から 3.4.y に更新し、『Red Hat Gluster Storage インストールガイド』の「オフラインまたはサービスの更新」に記載の手順を実行します。

6.2. オフラインモードでの Red Hat Gluster Storage の更新

- 更新プロセス中にボリュームがオフラインになると、オフラインの更新によりサーバーのダウンタイムが発生します。

- クライアントを更新する前に、すべての Red Hat Gluster Storage サーバーに対して完全な更新を行います。

オフラインモードでの Red Hat Gluster Storage 3.4 の更新

- 「アップデート前の注意事項」 の説明に従って、作業用のバックアップがあることを確認します。

- すべてのボリュームを停止します。

# for vol in `gluster volume list`; do gluster --mode=script volume stop $vol; sleep 2s; done - 1 度に 1 つのサーバーで以下のコマンドを実行します。

- すべての gluster サービスを停止します。Red Hat Enterprise Linux 7 の場合:

# systemctl stop glusterd # pkill glusterfs # pkill glusterfsd

Red Hat Enterprise Linux 6 の場合:# service glusterd stop # pkill glusterfs # pkill glusterfsd

- この更新の一部として Gluster NFS から NFS Ganesha に移行する場合は、以下の追加の手順を実行します。

- stop および disable します。これにより、更新プロセス中に複数のバージョンの Samba がクラスターで実行されなくなり、データの破損を回避します。

# systemctl stop ctdb # systemctl disable ctdb

- xmvn サービスおよび NFS サービスが停止していることを確認します。

ps axf | grep -E '(ctdb|nfs)[d]'

- 以下のコマンドを実行してブリックボリュームを削除します。

# gluster vol delete <ctdb_vol_name>

- システムを更新します。

# yum update

更新するパッケージを確認し、プロンプトが表示されたらyと入力して更新を続行します。更新が完了するまで待ちます。 - カーネルパッケージへの更新がある場合や、今回の更新の一部として Gluster NFS から NFS Ganesha に移行する場合は、システムを再起動します。

- glusterd を起動します。Red Hat Enterprise Linux 7 の場合:

# systemctl start glusterd

Red Hat Enterprise Linux 6 の場合:# service glusterd start

- すべてのサーバーを更新したら、以下のコマンドを実行してクラスターの操作バージョンを更新します。これにより、クラスター内の互換性の問題を防ぐことができます。

# gluster volume set all cluster.op-version 31306

注記31306は、Red Hat Gluster Storage 3.4 Async Update のcluster.op-versionの値に使用されます。他のバージョンの正しいcluster.op-version値については、「サポート対象の Red Hat Gluster Storage バージョン」 を参照してください。 - この更新の一部として Gluster NFS から NFS Ganesha に移行するには、4章NFS-Ganesha の Red Hat Gluster Storage への NFS-Ganesha へのデプロイ の説明に従って NFS-Ganesha パッケージをインストールして、『Red Hat Gluster Storage 3.4 管理ガイド』 の NFS Ganesha セクションにある情報を使用して NFS Ganesha クラスターを設定します。

- すべてのボリュームを起動します。

# for vol in `gluster volume list`; do gluster --mode=script volume start $vol; sleep 2s; done - 更新プロセスの一部として再起動しなかった場合は、以下のコマンドを実行してメタボリュームを再マウントします。

# mount /var/run/gluster/shared_storage/

このコマンドが機能しない場合は、/etc/fstabの内容を確認して、共有ストレージのエントリーが正しく設定されていることを確認して、mount コマンドを再実行します。/etc/fstabファイルのメタボリュームの行は以下のようになります。hostname:/gluster_shared_storage /var/run/gluster/shared_storage/ glusterfs defaults 0 0

- Gluster NFS を使用してボリュームにアクセスする場合は、以下のコマンドを使用して Gluster NFS を有効にします。

# gluster volume set volname nfs.disable off

以下に例を示します。# gluster volume set testvol nfs.disable off volume set: success

- geo レプリケーションを使用する場合は、アップグレードが完了したら geo レプリケーションセッションを再起動します。

# gluster volume geo-replication MASTER_VOL SLAVE_HOST::SLAVE_VOL start

状況によっては、forceパラメーターを追加して正常に再起動する必要がある場合があります。詳細は、BZ#1347625 を参照してください。

6.3. In-service Software Update from Red Hat Gluster Storage

- クライアントを更新する前に、すべての Red Hat Gluster Storage サーバーに対して完全な更新を行います。

- geo レプリケーションが使用されている場合は、マスターノードを更新する前に、すべてのスレーブノードに対して完全な更新を実行します。

disperse.optimistic-change-logおよびdisperse.eager-lockオプションがoffに設定されている場合に限り、イレイジャーコード化されたボリューム(disperspersed)ボリュームを更新できます。これらのオプションを無効にしてから 2 分間待機してからアップグレードを試行し、これらの設定の変更が I/O 操作で有効になるようにします。- Samba を更新する場合は、同じクラスターで異なるバージョンの Samba を実行する場合、データが破損するため、Samba がすべてのノードで同時にアップグレードされていることを確認します。

- 更新を受け取るには、システムを Red Hat Network に登録しておく必要があります。詳細はを参照してください。 「Red Hat Gluster Storage Server チャンネルのサブスクライブ」

- クラスターが更新されている間は、ボリュームの操作は実行しないでください。

サービスモードでの Red Hat Gluster Storage 3.4 の更新

- 「アップデート前の注意事項」 の説明に従って、作業用のバックアップがあることを確認します。

- 複製された設定がある場合は、レプリカセットのすべてのノードで以下の手順を実行します。分散複製設定がある場合は、すべてのレプリカセットに対して、レプリカセットに対してこれらのステップを一度に実行します。

- Geo レプリケーションセッションを停止します。

# gluster volume geo-replication MASTER_VOL SLAVE_HOST::SLAVE_VOL stop

- このノードが NFS-Ganehsa クラスターの一部である場合は、ノードをスタンバイモードにします。

# pcs cluster standby

- 保留中の自己修復がないことを確認します。

# gluster volume heal volname info

自己修復操作が完了するのを待機してから続行します。 - このノードが NFS-Ganesha クラスターの一部である場合は、以下を実行します。

- PCS クラスターを無効にして、これが停止していることを確認します。

# pcs cluster disable # pcs status

- nfs-ganesha サービスを停止します。

# systemctl stop nfs-ganesha

- イレイジャーコード(disperspersed)ボリュームを更新する必要がある場合は、

disperse.optimistic-change-logおよびdisperse.eager-lockオプションをoffに設定します。これらのオプションを無効にしてから 2 分間待機してからアップグレードを試行し、これらの設定の変更が I/O 操作で有効になるようにします。# gluster volume set volname disperse.optimistic-change-log off # gluster volume set volname disperse.eager-lock off

- 以下のコマンドを使用して、ストレージサーバー上の gluster サービスを停止します。Red Hat Enterprise Linux 7 の場合:

# systemctl stop glusterd # pkill glusterfs # pkill glusterfsd

Red Hat Enterprise Linux 6 の場合:# service glusterd stop # pkill glusterfs # pkill glusterfsd

- Samba を使用する場合:

- 必要なリポジトリーを有効にします。Red Hat Enterprise Linux 6.7 以降の場合:

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-6-server-rpms

Red Hat Enterprise Linux 7 の場合:# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-7-server-rpms

- 以下のコマンドを使用して、Samba クラスターのすべてのノード全体でpid および SMB サービスを停止します。また、CtrlC サービスを停止すると、SMB サービスも停止します。Red Hat Enterprise Linux 7 の場合:

# systemctl stop ctdb # systemctl disable ctdb

Red Hat Enterprise Linux 6 の場合:# service ctdb stop # chkconfig ctdb off

これにより、すべての Samba ノードが更新されるまで、異なるバージョンの Samba が同じ Samba クラスターで実行されないようにします。 - 以下のコマンドを実行して、CtrlC サービスおよび SMB サービスが停止していることを確認します。

ps axf | grep -E '(ctdb|smb|winbind|nmb)[d]'

- 以下のコマンドを使用してサーバーを更新します。

# yum update

更新しているパッケージを書き留めて、更新が完了するまで待ちます。 - 直前の手順で更新プロセスの一部としてカーネルアップデートが含まれている場合は、サーバーを再起動します。

- サーバーの再起動が必要ない場合は、以下のコマンドを使用してストレージサーバーで gluster サービスを起動します。Red Hat Enterprise Linux 7 の場合:

# systemctl start glusterd

Red Hat Enterprise Linux 6 の場合:# service glusterd start

- Red Hat Gluster Storage サーバーの最新バージョンに更新されていることを確認します。

# gluster --version

出力と、「サポート対象の Red Hat Gluster Storage バージョン」 で必要なバージョンを比較します。 - すべてのブリックがオンラインであることを確認します。ステータスを確認するには、以下のコマンドを実行します。

# gluster volume status

- ボリュームで自己修復を開始します。

# gluster volume heal volname

- 以下のコマンドを使用して、レプリカで自己修復が完了していることを確認します。

# gluster volume heal volname info

- 共有ストレージがマウントされていることを確認します。

# mount | grep /run/gluster/shared_storage

- ボリューム内の全ノードを更新したら、以下のコマンドを実行してクラスターの

op-versionを更新します。これにより、クラスター内の互換性の問題を防ぐことができます。# gluster volume set all cluster.op-version 31306

注記31306は、Red Hat Gluster Storage 3.4 Async Update のcluster.op-versionの値に使用されます。他のバージョンの正しいcluster.op-version値については、「サポート対象の Red Hat Gluster Storage バージョン」 を参照してください。 - Samba を使用する場合:

- 以下のコマンドを実行して、getfacl を起動する前に

/gluster/lockをマウントします。# mount -a

- SMB でアクセスしたボリュームをホストするすべてのサーバーが更新されている場合は、以下のコマンドを実行して、Samba サービスおよび Samba サービスを開始して再度有効にします。Red Hat Enterprise Linux 7 の場合:

# systemctl start ctdb # systemctl enable ctdb

Red Hat Enterprise Linux 6 の場合:# service ctdb start # chkconfig ctdb on

- CTDB サービスおよび SMB サービスが起動していることを確認するには、以下のコマンドを実行します。

ps axf | grep -E '(ctdb|smb|winbind|nmb)[d]'

- このアップグレード前にメタボリュームを設定しており、アップグレードプロセスの一部として再起動しない場合は、メタボリュームをマウントします。

# mount /var/run/gluster/shared_storage/

このコマンドが機能しない場合は、/etc/fstabの内容を確認して、共有ストレージのエントリーが正しく設定されていることを確認して、mount コマンドを再実行します。/etc/fstabファイルのメタボリュームの行は以下のようになります。hostname:/gluster_shared_storage /var/run/gluster/shared_storage/ glusterfs defaults 0 0

- このノードが NFS-Ganesha クラスターの一部である場合は、以下を実行します。

- SELinux を使用している場合は、

ganesha_use_fusefsブール値をonに設定します。# setsebool -P ganesha_use_fusefs on

- nfs-ganesha サービスを起動します。

# systemctl start nfs-ganesha

- クラスターを有効にし、起動します。

# pcs cluster enable # pcs cluster start

- ノードをスタンバイモードからリリースします。

# pcs cluster unstandby

- PCS クラスターが実行中で、ボリュームが正しくエクスポートされていることを確認します。

# pcs status # showmount -e

上記の手順を実施した後、NFS-ganesha は短い猶予期間に入ります。I/O 操作はこの猶予期間に停止します。ganesha.logファイルにNFS Server Now NOT IN GRACEが表示されるのを確認してから続行します。

- geo レプリケーションを使用する場合は、アップグレードが完了したら geo レプリケーションセッションを再起動します。

# gluster volume geo-replication MASTER_VOL SLAVE_HOST::SLAVE_VOL start

注記BZ#1347625 では、状況によってはforceパラメーターを使用して正常に再起動する必要がある場合があります。# gluster volume geo-replication MASTER_VOL SLAVE_HOST::SLAVE_VOL start force

- イレイジャーコーディングされた(dispersed)ボリュームを更新するために

disperse.optimistic-change-logオプションおよびdisperse.eager-lockオプションを無効にしている場合は、これらの設定を再度有効にします。# gluster volume set volname disperse.optimistic-change-log on # gluster volume set volname disperse.eager-lock on

/etc/ganesha フォルダーにganesha.conf.rpmnewという名前で保存されます。古い設定ファイルは、インサービスアップグレードプロセス時に上書きされません。ただし、アップグレード後、ganesha.conf.rpmnewから、/etc/ganeshaフォルダーにある既存のganesha.confファイルに、新しい設定変更を手動でコピーする必要があります。

第7章 Red Hat Gluster Storage 3.4 へのアップグレード

アップグレードサポートの制限

- Red Hat Enterprise Linux 6 ベースの Red Hat Gluster Storage から Red Hat Enterprise Linux 7 ベースの Red Hat Gluster Storage へのアップグレードはサポートされていません。

- Red Hat Enterprise Linux 7.5 でサポートされる Virtual Data Optimizer (VDO) ボリュームは、現時点では Red Hat Gluster Storage でサポートされていません。VDO は、Red Hat Hyperconverged Infrastructure for Virtualization 2.0 の一部として使用されている場合にのみサポートされます。詳細は、 VDO について参照してください。

- クライアントをアップグレードする前に、サーバーをアップグレードする必要があります。

- Red Hat Gluster Storage 3.1 Update 2 以前からアップグレードする場合は、サーバーとクライアントを同時にアップグレードする必要があります。

- NFS-Ganesha を使用する場合、サポートされる Red Hat Gluster Storage 3.4 へのアップグレードパスは、アップグレード元のバージョンにより異なります。バージョン 3.1.x から 3.4 にアップグレードする場合は、「Red Hat Gluster Storage 3.4 へのオフラインアップグレード」 を使用します。バージョン 3.3 から 3.4 にアップグレードする場合は、「In-Service ソフトウェアの Red Hat Gluster Storage 3.3 から Red Hat Gluster Storage 3.4 へのアップグレード」 を使用します。

7.1. Red Hat Gluster Storage 3.4 へのオフラインアップグレード

7.1.1. Red Hat Network にサブスクライブしているシステム向けの Red Hat Gluster Storage 3.4 へのアップグレード

手順7.1 アップグレード前

- オペレーティングシステムパーティション上ではない場所に、設定ディレクトリーとファイルをバックアップします。

/var/lib/glusterd/etc/swift/etc/samba/etc/ctdb/etc/glusterfs/var/lib/samba/var/lib/ctdb/var/run/gluster/shared_storage/nfs-ganesha

NFS-Ganesha を使用する場合は、すべてのノードから以下のファイルをバックアップします。/etc/ganesha/exports/export.*.conf/etc/ganesha/ganesha.conf/etc/ganesha/ganesha-ha.conf

- すべてのクライアントから gluster ボリュームをアンマウントします。クライアントで以下のコマンドを使用して、マウントポイントからボリュームをアンマウントします。

# umount mount-point

- NFS-Ganesha を使用する場合は、gluster サーバーで以下のコマンドを実行して nfs-ganesha サービスを無効にします。

# gluster nfs-ganesha disable

- gluster サーバーで、共有ボリュームを無効にします。

# gluster volume set all cluster.enable-shared-storage disable

- すべてのボリュームを停止します。

# for vol in `gluster volume list`; do gluster --mode=script volume stop $vol; sleep 2s; done - すべてのボリュームが停止していることを確認します。

# gluster volume info

- 以下のコマンドを使用してサーバーからデータパーティションをアンマウントします。

# umount mount-point

- 以下のコマンドを使用して、すべてのサーバーで

glusterdサービスを停止します。# service glusterd stop # pkill glusterfs # pkill glusterfsd

- pcsd サービスを停止します。

# systemctl stop pcsd

手順7.2 yum を使用したアップグレード

- システムがレガシーの Red Hat Network Classic 更新システムにないことを確認します。

# migrate-rhs-classic-to-rhsm --status

Red Hat Network Classic を依然として使用している場合には、以下のコマンドを実行して Red Hat Subscription Manager に移行します。# migrate-rhs-classic-to-rhsm --rhn-to-rhsm

次にステータスが変更されたことを確認します。# migrate-rhs-classic-to-rhsm --status

- Samba を使用する場合:

- Red Hat Enterprise Linux 6.7 以降では、以下のリポジトリーを有効にします。

# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-6-server-rpms

Red Hat Enterprise Linux 7 の場合は、以下のリポジトリーを有効にします。# subscription-manager repos --enable=rh-gluster-3-samba-for-rhel-7-server-rpms

- 同じクラスターで異なるバージョンの Samba を実行するとデータが破損するため、Samba がすべてのノードで同時にアップグレードされることを確認します。xmvn サービスおよび SMB サービスを停止し、それらが停止していることを確認します。

# service ctdb stop

# ps axf | grep -E '(ctdb|smb|winbind|nmb)[d]'

- このアップグレードの一環として Gluster NFS から NFS Ganesha に移行する場合は、以下の追加の手順を実行します。

- stop および disable します。これにより、更新プロセス中に複数のバージョンの Samba がクラスターで実行されなくなり、データの破損を回避します。

# systemctl stop ctdb # systemctl disable ctdb

- xmvn サービスおよび NFS サービスが停止していることを確認します。

ps axf | grep -E '(ctdb|nfs)[d]'

- 以下のコマンドを実行してブリックボリュームを削除します。

# gluster vol delete <ctdb_vol_name>

- サーバーを Red Hat Gluster Storage 3.4 にアップグレードします。

# yum update

更新が完了するまで待ちます。 - サーバーを再起動して、カーネルの更新が適用されるようにします。

- glusterd サービスおよび pcsd サービスが起動していることを確認します。

# systemctl start glusterd # systemctl start pcsd

- すべてのノードがアップグレードされたら、以下のコマンドを実行してクラスターの

op-versionを更新します。これにより、クラスター内の互換性の問題を防ぐことができます。# gluster volume set all cluster.op-version 31306

注記31306は、Red Hat Gluster Storage 3.4 Async Update のcluster.op-versionの値に使用されます。他のバージョンの正しいcluster.op-version値については、「サポート対象の Red Hat Gluster Storage バージョン」 を参照してください。 - このアップグレードの一環として Gluster NFS から NFS Ganesha に移行するには、4章NFS-Ganesha の Red Hat Gluster Storage への NFS-Ganesha へのデプロイ の説明に従って NFS-Ganesha パッケージをインストールして、『Red Hat Gluster Storage 3.4 管理ガイド』 の NFS Ganesha セクションにある情報を使用して NFS Ganesha クラスターを設定します。

- すべてのボリュームを起動します。

# for vol in `gluster volume list`; do gluster --mode=script volume start $vol; sleep 2s; done - NFS-Ganesha を使用している場合:

- ボリュームのエクスポート情報を

ganesha.confのバックアップコピーから、新しい/etc/ganesha/ganesha.confファイルにコピーします。バックアップファイルのエクスポート情報は、以下のようになります。%include "/etc/ganesha/exports/export.v1.conf" %include "/etc/ganesha/exports/export.v2.conf" %include "/etc/ganesha/exports/export.v3.conf"

- バックアップディレクトリーから以下のコマンドを実行し、バックアップボリュームのエクスポートファイルをバックアップディレクトリーから

/etc/ganesha/exportsにコピーします。# cp export.* /etc/ganesha/exports/

- 新しいサービスおよびポートのファイアウォール設定を有効にします。詳細は、『 『Red Hat Gluster Storage 3.4 管理ガイド』』 を参照し https://access.redhat.com/documentation/ja-jp/red_hat_gluster_storage/3.4/html/administration_guide/chap-getting_started てください。

- 共有ボリュームを有効にします。

# gluster volume set all cluster.enable-shared-storage enable

- 共有ストレージボリュームがサーバーにマウントされていることを確認します。ボリュームがマウントされていない場合は、以下のコマンドを実行します。

# mount -t glusterfs hostname:gluster_shared_storage /var/run/gluster/shared_storage

/var/run/gluster/shared_storage/nfs-ganeshaディレクトリーが作成されていることを確認します。# cd /var/run/gluster/shared_storage/ # mkdir nfs-ganesha

- NFS-Ganesha を使用する場合:

ganesha.confファイルおよびganesha-ha.confファイル、および/etc/ganesha/exportsディレクトリーを/var/run/gluster/shared_storage/nfs-ganeshaディレクトリーにコピーします。# cd /etc/ganesha/ # cp ganesha.conf ganesha-ha.conf /var/run/gluster/shared_storage/nfs-ganesha/ # cp -r exports/ /var/run/gluster/shared_storage/nfs-ganesha/

ganesha.confファイルのエクスポートエントリーのパスを更新します。# sed -i 's/\/etc\/ganesha/\/var\/run\/gluster\/shared_storage\/nfs-ganesha/' /var/run/gluster/shared_storage/nfs-ganesha/ganesha.conf

- 以下のコマンドを実行して、既存のクラスター設定をクリーンアップします。

/usr/libexec/ganesha/ganesha-ha.sh --cleanup /var/run/gluster/shared_storage/nfs-ganesha

- Red Hat Enterprise Linux 7.4 以降にアップグレードする場合は、以下の SELinux ブール値を設定します。

# setsebool -P ganesha_use_fusefs on # setsebool -P gluster_use_execmem on

- ctdb サービス (および使用している場合は nfs-ganesha サービス) を起動し、すべてのノードが機能していることを確認します。

# systemctl start ctdb # gluster nfs-ganesha enable

- このデプロイメントで NFS-Ganesha を使用する場合は、すべてのボリュームで NFS-Ganesha を有効にします。

# gluster volume set volname ganesha.enable on

7.1.2. Red Hat Network Satellite Server にサブスクライブしているシステム向けの Red Hat Gluster Storage 3.4 へのアップグレード

手順7.3 アップグレード前

- オペレーティングシステムパーティション上ではない場所に、設定ディレクトリーとファイルをバックアップします。

/var/lib/glusterd/etc/swift/etc/samba/etc/ctdb/etc/glusterfs/var/lib/samba/var/lib/ctdb/var/run/gluster/shared_storage/nfs-ganesha

NFS-Ganesha を使用する場合は、すべてのノードから以下のファイルをバックアップします。/etc/ganesha/exports/export.*.conf/etc/ganesha/ganesha.conf/etc/ganesha/ganesha-ha.conf

- すべてのクライアントから gluster ボリュームをアンマウントします。クライアントで以下のコマンドを使用して、マウントポイントからボリュームをアンマウントします。

# umount mount-point

- NFS-Ganesha を使用する場合は、gluster サーバーで以下のコマンドを実行して nfs-ganesha サービスを無効にします。

# gluster nfs-ganesha disable

- gluster サーバーで、共有ボリュームを無効にします。

# gluster volume set all cluster.enable-shared-storage disable

- すべてのボリュームを停止します。

# for vol in `gluster volume list`; do gluster --mode=script volume stop $vol; sleep 2s; done - すべてのボリュームが停止していることを確認します。

# gluster volume info

- 以下のコマンドを使用してサーバーからデータパーティションをアンマウントします。

# umount mount-point

- 以下のコマンドを使用して、すべてのサーバーで

glusterdサービスを停止します。# service glusterd stop # pkill glusterfs # pkill glusterfsd

- pcsd サービスを停止します。

# systemctl stop pcsd

手順7.4 Satellite を使用したアップグレード

- Red Hat Satellite Server でアクティベーションキーを作成し、以下のチャンネルに関連付けます。詳細は、「Red Hat Satellite Server からのインストール」 を参照してください。

- Red Hat Enterprise Linux 6.7 以降の場合:

Base Channel: Red Hat Enterprise Linux Server (v.6 for 64-bit x86_64) Child channels: RHEL Server Scalable File System (v. 6 for x86_64) Red Hat Gluster Storage Server 3 (RHEL 6 for x86_64)

Samba を使用する場合は、以下のチャンネルを追加します。Red Hat Gluster 3 Samba (RHEL 6 for x86_64)

- Red Hat Enterprise Linux 7 の場合

Base Channel: Red Hat Enterprise Linux Server (v.7 for 64-bit x86_64) Child channels: RHEL Server Scalable File System (v. 7 for x86_64) Red Hat Gluster Storage Server 3 (RHEL 7 for x86_64)

Samba を使用する場合は、以下のチャンネルを追加します。Red Hat Gluster 3 Samba (RHEL 6 for x86_64)

- 以下の手順を実行して、Red Hat Network Satellite からシステムの登録を解除します。

- Red Hat Network Satellite サーバーにログインします。

- 上部のナビゲーションバーの Systems タブをクリックし、System List で古いシステムまたは重複システムの名前をクリックします。

- ページの右上にある delete system リンクをクリックします。

- システムプロファイルの削除を確認するには、Delete System ボタンをクリックします。

- 先の手順で作成した認証情報とアクティベーションキーを使用して、Red Hat Gluster Storage サーバーで以下のコマンドを実行します。これにより、Red Hat Network Satellite Server の Red Hat Gluster Storage 3.4 チャンネルにシステムが再登録されます。

# rhnreg_ks --username username --password password --force --activationkey Activation Key ID

- チャンネルのサブスクリプションが更新されていることを確認します。Red Hat Enterprise Linux

6.7 以降では、Samba を使用する場合は、以下のチャンネルと、rhel-x86_64-server-6-rh-gluster-3-sambaチャンネルを探します。# rhn-channel --list rhel-x86_64-server-6 rhel-x86_64-server-6-rhs-3 rhel-x86_64-server-sfs-6

Red Hat Enterprise Linux 7 では、Samba を使用する場合は、以下のチャンネル、rhel-x86_64-server-7-rh-gluster-3-sambaチャンネルを探します。# rhn-channel --list rhel-x86_64-server-7 rhel-x86_64-server-7-rhs-3 rhel-x86_64-server-sfs-7

- Red Hat Gluster Storage 3.4 にアップグレードします。

# yum update

- サーバーを再起動して、ボリュームとデータの整合性チェックを実行します。

- すべてのノードがアップグレードされたら、以下のコマンドを実行してクラスターの

op-versionを更新します。これにより、クラスター内の互換性の問題を防ぐことができます。# gluster volume set all cluster.op-version 31306

注記31306は、Red Hat Gluster Storage 3.4 Async Update のcluster.op-versionの値に使用されます。その他のバージョンの正しい 「サポート対象の Red Hat Gluster Storage バージョン」 の値は、cluster.op-versionを参照してください。 - すべてのボリュームを起動します。

# for vol in `gluster volume list`; do gluster --mode=script volume start $vol; sleep 2s; done - NFS-Ganesha を使用している場合:

- ボリュームのエクスポート情報を

ganesha.confのバックアップコピーから、新しい/etc/ganesha/ganesha.confファイルにコピーします。バックアップファイルのエクスポート情報は、以下のようになります。%include "/etc/ganesha/exports/export.v1.conf" %include "/etc/ganesha/exports/export.v2.conf" %include "/etc/ganesha/exports/export.v3.conf"

- バックアップディレクトリーから以下のコマンドを実行し、バックアップボリュームのエクスポートファイルをバックアップディレクトリーから

/etc/ganesha/exportsにコピーします。# cp export.* /etc/ganesha/exports/

- 新しいサービスおよびポートのファイアウォール設定を有効にします。詳細は、『 『Red Hat Gluster Storage 3.4 管理ガイド』』 を参照し https://access.redhat.com/documentation/ja-jp/red_hat_gluster_storage/3.4/html/administration_guide/chap-getting_started てください。

- 共有ボリュームを有効にします。

# gluster volume set all cluster.enable-shared-storage enable

- 共有ストレージボリュームがサーバーにマウントされていることを確認します。ボリュームがマウントされていない場合は、以下のコマンドを実行します。

# mount -t glusterfs hostname:gluster_shared_storage /var/run/gluster/shared_storage

/var/run/gluster/shared_storage/nfs-ganeshaディレクトリーが作成されていることを確認します。# cd /var/run/gluster/shared_storage/ # mkdir nfs-ganesha

- NFS-Ganesha を使用する場合:

ganesha.confファイルおよびganesha-ha.confファイル、および/etc/ganesha/exportsディレクトリーを/var/run/gluster/shared_storage/nfs-ganeshaディレクトリーにコピーします。# cd /etc/ganesha/ # cp ganesha.conf ganesha-ha.conf /var/run/gluster/shared_storage/nfs-ganesha/ # cp -r exports/ /var/run/gluster/shared_storage/nfs-ganesha/

ganesha.confファイルのエクスポートエントリーのパスを更新します。# sed -i 's/\/etc\/ganesha/\/var\/run\/gluster\/shared_storage\/nfs-ganesha/' /var/run/gluster/shared_storage/nfs-ganesha/ganesha.conf

- 以下のコマンドを実行して、既存のクラスター設定をクリーンアップします。

/usr/libexec/ganesha/ganesha-ha.sh --cleanup /var/run/gluster/shared_storage/nfs-ganesha

- Red Hat Enterprise Linux 7.4 以降にアップグレードする場合は、以下の SELinux ブール値を設定します。

# setsebool -P ganesha_use_fusefs on # setsebool -P gluster_use_execmem on

- ctdb サービス (および使用している場合は nfs-ganesha サービス) を起動し、すべてのノードが機能していることを確認します。

# systemctl start ctdb # gluster nfs-ganesha enable

- このデプロイメントで NFS-Ganesha を使用する場合は、すべてのボリュームで NFS-Ganesha を有効にします。

# gluster volume set volname ganesha.enable on

7.2. In-Service ソフトウェアの Red Hat Gluster Storage 3.3 から Red Hat Gluster Storage 3.4 へのアップグレード

/etc/ganesha フォルダーにganesha.conf.rpmnewという名前で保存されます。古い設定ファイルは、インサービスアップグレードプロセス時に上書きされません。ただし、アップグレード後、ganesha.conf.rpmnewから、/etc/ganeshaフォルダーにある既存のganesha.confファイルに、新しい設定変更を手動でコピーする必要があります。

7.2.1. アップグレード前のタスク

7.2.1.1. Red Hat Gluster Storage 3.4 のアップグレード要件

- サービス内のソフトウェアのアップグレードは、レプリケート、分散複製、またはイレイジャーコード(disperspersed)ボリュームを持つノードでのみサポートされます。

- 既存の環境にスナップショットを使用する場合は、各ブリックは独立したシンプロビジョニング論理ボリューム (LV) である必要があります。スナップショットを使用する予定がない場合、「シック」プロビジョニングされたボリュームは引き続きサポートされます。

- ブリックを含む論理ボリュームは、その他の目的では使用できません。

- Red Hat Gluster Storage 3.4 では、リニア LVM のみがサポートされます。詳細はを参照してください。 https://access.redhat.com/documentation/ja-JP/Red_Hat_Enterprise_Linux/7/html/Logical_Volume_Manager_Administration/lv_overview.html#linear_volumes

- サーバー側のクォーラム (定足数) が有効にされている場合、1 つのノードをダウンしてもサーバー側のクォーラム (定足数) に違反しないことを確認します。ダミーのピアを追加して、以下のコマンドを使用し、ローリングアップグレードが完了するまでサーバー側のクォーラム (定足数) の違反が生じないようにします。

# gluster peer probe dummynode

注記Geo レプリケーションセッションがある場合は、『 『Red Hat Gluster Storage Administration Guide』 』の「Start『Geo-replication for a New Brick or New Node』 」に記載されている手順に従います。たとえば、各マシンに 2 ノードと 1 ブリックのある単純なレプリケーションボリュームについてサーバー側のクォーラム (定足数) の割合がデフォルト値(>50%) に設定される場合、上記のコマンドを使用して、ブリックを含まないダミーノードを信頼できるストレージプールに追加し、ボリュームの高可用性を確保する必要があります。3 ノードで構成されるクラスターでは、サーバー側のクォーラム (定足数) の割合が 77% に設定される場合、1 つのノードがダウンするとサーバー側のクォーラム (定足数) の違反が生じます。このシナリオでは、サーバー側のクォーラム (定足数) を満たすために 2 つのダミーノードを追加する必要があります。 - レプリカ 2 ボリュームの場合は、クライアント側のクォーラムを無効にします。レプリカ 3 ボリュームでは、スプリットブレインの状況開発のリスクが増大するため、これは推奨されません。

# gluster volume reset <vol-name> cluster.quorum-type

- マスターとスレーブ間で実行されている geo レプリケーションセッションを停止します。

# gluster volume geo-replication MASTER_VOL SLAVE_HOST::SLAVE_VOL stop

- 以下のコマンドを使用して、インサービスソフトウェアアップグレードに進む前に保留中の自己修復がないことを確認します。

# gluster volume heal volname info

- Red Hat Gluster Storage サーバーが必要なチャンネルに登録されていることを確認します。Red Hat Enterprise Linux 6 の場合:

rhel-x86_64-server-6 rhel-x86_64-server-6-rhs-3 rhel-x86_64-server-sfs-6

Red Hat Enterprise Linux 7 の場合:rhel-x86_64-server-7 rhel-x86_64-server-7-rhs-3 rhel-x86_64-server-sfs-7

チャンネルにサブスクライブするには、以下のコマンドを実行します。# subscription-manager repos --enable=repo-name

7.2.1.2. インサービスソフトウェアアップグレードの制限

- NFS-Ganesha クラスターのサービスアップグレードは、Red Hat Gluster Storage 3.3 から Red Hat Gluster Storage 3.4 でのみサポートされます。Red Hat Gluster Storage 3.1 からアップグレードし、NFS-Ganesha を使用する場合は、代わりにオフラインアップグレード方法を使用してください。

disperse.optimistic-change-logオプションおよびdisperse.eager-lockオプションがoffに設定されている場合に限り、イレイジャーコード化されたボリューム(disperspersed)ボリュームを、サービス内(in-service)にアップグレードできます。これらのオプションを無効にしてから 2 分間待機してからアップグレードを試行し、これらの設定の変更が I/O 操作で有効になるようにします。- インサービスソフトウェアアップグレードの実行前のシステムのワークロードが少なくし、アップグレード時に自己修復プロセスで過剰なエントリーを修復する必要がないようにします。また、システムのワークロードが高くなると、修復に時間がかかることになります。

- Red Hat Gluster Storage サーバーではボリューム操作を実行しないでください。

- ハードウェア設定を変更しないでください。

- Red Hat Gluster Storage の複数バージョンが混在した状態でそれらのバージョンを長期間実行しないでください。たとえば、Red Hat Gluster Storage 3.3 と Red Hat Gluster Storage 3.4 を混在させないでください。

- 異なるアップグレード方法を組み合わせることはできません。

- シンプロビジョニングされたボリュームへの移行にインサービスソフトウェアアップグレードを使用することは推奨されませんが、オフラインアップグレードシナリオで使用できます。詳細はを参照してください。 「Red Hat Gluster Storage 3.4 へのオフラインアップグレード」

7.2.1.3. ISO を使用してアップグレードするためのリポジトリーの設定

- 以下のコマンドを使用して、任意のディレクトリーに ISO イメージファイルをマウントします。

# mount -o loop <ISO image file> <mount-point>

以下に例を示します。# mount -o loop RHGS-3.4-RHEL-7-x86_64-dvd-1.iso /mnt

- 以下の場所にあるファイルにリポジトリーオプションを設定します。

/etc/yum.repos.d/<file_name.repo>

- 以下の情報をリポジトリーファイルに追加します。

[local] name=local baseurl=file:///mnt enabled=1 gpgcheck=0

7.2.1.4. アップグレードアクティビティーの準備およびモニタリング

- ピアおよびボリュームの状態を確認して、すべてのピアが接続され、アクティブなボリュームタスクがないことを確認します。

# gluster peer status

# gluster volume status

- 以下のコマンドを使用してリバランスのステータスを確認します。

# gluster volume rebalance r2 status Node Rebalanced-files size scanned failures skipped status run time in secs --------- ----------- --------- -------- --------- ------ -------- -------------- 10.70.43.198 0 0Bytes 99 0 0 completed 1.00 10.70.43.148 49 196Bytes 100 0 0 completed 3.00

- イレイジャーコード(disperspersed)ボリュームをアップグレードする必要がある場合は、

disperse.optimistic-change-logおよびdisperse.eager-lockオプションをoffに設定します。これらのオプションを無効にしてから 2 分間待機してからアップグレードを試行し、これらの設定の変更が I/O 操作で有効になるようにします。# gluster volume set volname disperse.optimistic-change-log off # gluster volume set volname disperse.eager-lock off

- 以下のコマンドを使用して、保留中の自己修復がないことを確認します。

# gluster volume heal volname info

以下の例は、保留中の自己修復がないことを示しています。# gluster volume heal drvol info Gathering list of entries to be healed on volume drvol has been successful Brick 10.70.37.51:/rhs/brick1/dir1 Number of entries: 0 Brick 10.70.37.78:/rhs/brick1/dir1 Number of entries: 0 Brick 10.70.37.51:/rhs/brick2/dir2 Number of entries: 0 Brick 10.70.37.78:/rhs/brick2/dir2 Number of entries: 0

7.2.2. インサービスアップグレードのサービスへの影響

SWIFT

移行中の REST リクエストは、サービスソフトウェアのアップグレード時に失敗します。したがって、以下のコマンドを使用してサービスソフトウェアをアップグレードする前に、swift サービスをすべて停止することが推奨されます。

# service openstack-swift-proxy stop # service openstack-swift-account stop # service openstack-swift-container stop # service openstack-swift-object stop

Gluster NFS

Gluster NFS を使用してボリュームをマウントすると、そのファイルシステムで新しいファイルまたは未処理のファイル操作が、サーバーがアップグレードされるまでサービスソフトウェアのアップグレード中に中断されずにハングします。

Samba / CTDB

Samba 共有の継続中の I/O は、Samba 共有がインサービスソフトウェアアップグレード時に一時的に利用できなくなるために失敗します。そのため、以下のコマンドを使用して Samba サービスを停止することが推奨されます。

# service ctdb stop ;Stopping CTDB will also stop the SMB service.

ボリュームの分散

インサービスソフトウェアアップグレードは、分散ボリュームではサポートされません。クラスターに分散ボリュームがある場合は、アップグレード期間中そのボリュームを停止します。

# gluster volume stop <VOLNAME>

仮想マシンストア

仮想マシンのイメージは常に変更される可能性があります。volume heal コマンドの出力に仮想マシンが一覧表示されている場合、仮想マシンの自己修復が完了していないことを示す訳ではありません。これは、仮想マシンの変更が継続的に行われていることを意味します。

7.2.3. インサービスソフトウェアアップグレード

- オペレーティングシステムパーティション上ではない場所に、設定ディレクトリーとファイルをバックアップします。

/var/lib/glusterd/etc/swift/etc/samba/etc/ctdb/etc/glusterfs/var/lib/samba/var/lib/ctdb/var/run/gluster/shared_storage/nfs-ganesha

NFS-Ganesha を使用する場合は、すべてのノードから以下のファイルをバックアップします。/etc/ganesha/exports/export.*.conf/etc/ganesha/ganesha.conf/etc/ganesha/ganesha-ha.conf

- ノードが NFS-Ganesha クラスターの一部である場合には、ノードをスタンバイモードにします。

# pcs cluster standby

- 保留中の自己修復操作がないことを確認します。

# gluster volume heal volname info

- このノードが NFS-Ganesha クラスターの一部である場合は、以下を実行します。

- PCS クラスターを無効にして、これが停止していることを確認します。

# pcs cluster disable # pcs status

- nfs-ganesha サービスを停止します。

# systemctl stop nfs-ganesha

- ノード上のすべての gluster サービスを停止し、それらが停止していることを確認します。

# systemctl stop glusterd # pkill glusterfs # pkill glusterfsd # pgrep gluster

- システムがレガシーの Red Hat Classic 更新ソフトウェアを使用していないことを確認します。

# migrate-rhs-classic-to-rhsm --status

システムでこのレガシーソフトウェアを使用している場合、Red Hat Subscription Manager に移行し、移行の完了時にステータスが変更されていることを確認します。# migrate-rhs-classic-to-rhsm --rhn-to-rhsm

# migrate-rhs-classic-to-rhsm --status

- 以下のコマンドを使用してサーバーを更新します。

# yum update

- ボリュームがシックプロビジョニングされ、スナップショットを使用する予定の場合は、以下の手順を実行してシンプロビジョニングされたボリュームに移行します。注記インサービスソフトウェアアップグレード時にシックプロビジョニングされたボリュームからシンプロビジョニングされたボリュームに移行するには、ブリックにあるデータに応じて長い時間がかかります。スナップショットを使用する予定がない場合は、この手順を省略できます。ただし、既存の環境でスナップショットを使用する場合は、オフラインでアップグレードする方法が推奨されます。オフラインアップグレードの詳細は、を参照してください。 「Red Hat Gluster Storage 3.4 へのオフラインアップグレード」インサービスソフトウェアアップグレードを使用してシックプロビジョニングされたボリュームからシンプロビジョニングされたボリュームに移行する前に、Red Hat サポート担当者にお問い合わせください。

- 以下のコマンドを実行して、ボリュームに関連付けられたブリックをすべてアンマウントします。

# umount mount_point

- 以下のコマンドを実行して、ブリックに関連付けられた LVM を削除します。

# lvremove logical_volume_name

以下に例を示します。# lvremove /dev/RHS_vg/brick1

- 以下のコマンドを実行してボリュームグループを削除します。

# vgremove -ff volume_group_name

以下に例を示します。# vgremove -ff RHS_vg

- 以下のコマンドを実行して物理ボリュームを削除します。

# pvremove -ff physical_volume

- 物理ボリューム (PV) が作成されていない場合は、以下のコマンドを実行して RAID 6 ボリュームの PV を作成します。それ以外の場合は、次の手順に進みます。

# pvcreate --dataalignment 2560K /dev/vdb

詳細は、『 『Red Hat Gluster Storage 3.4 管理ガイドhttps://access.redhat.com/documentation/ja-jp/red_hat_gluster_Storage/3.4/html-single/administration_guide/#Formatting_and_Mounting_Bricks 』を』 参照してください。 - 以下のコマンドを実行して、PV から単一のボリュームグループを作成します。

# vgcreate volume_group_name disk

以下に例を示します。# vgcreate RHS_vg /dev/vdb

- 以下のコマンドを使用して、シンプールを作成します。

# lvcreate -L size --poolmetadatasize md_size --chunksize chunk_size -T pool_device

以下に例を示します。# lvcreate -L 2T --poolmetadatasize 16G --chunksize 256 -T /dev/RHS_vg/thin_pool

- 以下のコマンドを実行して、プールからシンボリュームを作成します。

# lvcreate -V size -T pool_device -n thinvol_name

以下に例を示します。# lvcreate -V 1.5T -T /dev/RHS_vg/thin_pool -n thin_vol

- 以下のコマンドを実行して、新規ボリュームにファイルシステムを作成します。

# mkfs.xfs -i size=512 thin_vol

以下に例を示します。# mkfs.xfs -i size=512 /dev/RHS_vg/thin_vol

バックエンドがシンプロビジョニングされたボリュームに変換されるようになりました。 - シンプロビジョニングされたボリュームをブリックディレクトリーにマウントし、ブリックに拡張属性を設定します。以下に例を示します。

# setfattr -n trusted.glusterfs.volume-id \ -v 0x$(grep volume-id /var/lib/glusterd/vols/volname/info \ | cut -d= -f2 | sed 's/-//g') $brick

- glusterd を無効にします。

# systemctl disable glusterd

これにより、これがシステムの起動時に起動されるのを防ぐことができ、ノードがクラスターに再度参加する前に正常であることを確認できます。 - サーバーを再起動します。

# shutdown -r now "Shutting down for upgrade to Red Hat Gluster Storage 3.4"

- 重要この手順は、直前の手順でシンプロビジョニングされたボリュームに移行した各シックプロビジョニングボリュームに対してのみ実行します。Automatic File Replication 拡張属性を別のノードから変更し、修復プロセスがレプリカサブボリュームのブリックからシンプロビジョニングされたブリックに対して実行されるようにします。

- FUSE マウントポイントを作成して、拡張属性を編集します。

# mount -t glusterfs HOSTNAME_or_IPADDRESS:/VOLNAME /MOUNTDIR

- マウントポイントに新しいディレクトリーを作成し、この名前のディレクトリーがまだ存在していないことを確認します。

# mkdir /MOUNTDIR/name-of-nonexistent-dir

- ディレクトリーを削除し、拡張属性を設定します。

# rmdir /MOUNTDIR/name-of-nonexistent-dir

# setfattr -n trusted.non-existent-key -v abc /MOUNTDIR # setfattr -x trusted.non-existent-key /MOUNTDIR

- レプリカのサブボリューム内のブリックの拡張属性がゼロ (zero) に設定されていないことを確認します。

# getfattr -d -m. -e hex brick_path

以下の例では、/dev/RHS_vg/brick2の拡張属性であるtrusted.afr.repl3-client-1はゼロ (zero) に設定されていません。# getfattr -d -m. -e hex /dev/RHS_vg/brick2 getfattr: Removing leading '/' from absolute path names # file: /dev/RHS_vg/brick2 trusted.afr.dirty=0x000000000000000000000000 trusted.afr.repl3-client-1=0x000000000000000400000002 trusted.gfid=0x00000000000000000000000000000001 trusted.glusterfs.dht=0x000000010000000000000000ffffffff trusted.glusterfs.volume-id=0x924c2e2640d044a687e2c370d58abec9

glusterdサービスを起動します。# systemctl start glusterd

- Red Hat Gluster Storage の最新バージョンにアップグレードしていることを確認します。

# gluster --version

- すべてのブリックがオンラインであることを確認します。

# gluster volume status

以下に例を示します。# gluster volume status Status of volume: r2 Gluster process Port Online Pid ------------------------------------------------------------------------------ Brick 10.70.43.198:/brick/r2_0 49152 Y 32259 Brick 10.70.42.237:/brick/r2_1 49152 Y 25266 Brick 10.70.43.148:/brick/r2_2 49154 Y 2857 Brick 10.70.43.198:/brick/r2_3 49153 Y 32270 NFS Server on localhost 2049 Y 25280 Self-heal Daemon on localhost N/A Y 25284 NFS Server on 10.70.43.148 2049 Y 2871 Self-heal Daemon on 10.70.43.148 N/A Y 2875 NFS Server on 10.70.43.198 2049 Y 32284 Self-heal Daemon on 10.70.43.198 N/A Y 32288 Task Status of Volume r2 ------------------------------------------------------------------------------ There are no active volume tasks

- ボリュームで自己修復を開始します。

# gluster volume heal volname

- ボリューム上の自己修復が完了していることを確認します。

# gluster volume heal volname info

以下の例は、完了した自己修復操作を示しています。# gluster volume heal drvol info Gathering list of entries to be healed on volume drvol has been successful Brick 10.70.37.51:/rhs/brick1/dir1 Number of entries: 0 Brick 10.70.37.78:/rhs/brick1/dir1 Number of entries: 0 Brick 10.70.37.51:/rhs/brick2/dir2 Number of entries: 0 Brick 10.70.37.78:/rhs/brick2/dir2 Number of entries: 0

- 共有ストレージがマウントされていることを確認します。

# mount | grep /run/gluster/shared_storage

- このノードが NFS-Ganesha クラスターの一部である場合は、以下を実行します。

- システムが SELinux により管理されている場合は、

ganesha_use_fusefsのブール値をonに設定します。# setsebool -P ganesha_use_fusefs on

- NFS-Ganesha サービスを起動します。

# systemctl start nfs-ganesha

- クラスターを有効にし、起動します。

# pcs cluster enable # pcs cluster start

- ノードをスタンバイモードからリリースします。

# pcs cluster unstandby

- pcs クラスターが実行されており、ボリュームがアップグレード後に正しくエクスポートされていることを確認します。

# pcs status # showmount -e

上記の手順を実施した後、NFS-ganesha は短い猶予期間に入ります。I/O 操作はこの猶予期間に停止します。ganesha.logファイルにNFS Server Now NOT IN GRACEが表示されるのを確認してから続行します。

- オプションで、システムの起動時に glusterd サービスが起動するようにします。

# systemctl enable glusterd

- レプリカのペアの他のノードで上記の手順を繰り返します。分散レプリケーションの設定の場合、すべてのレプリカのペアで上記の手順を繰り返します。

- すべてのノードがアップグレードされたら、以下のコマンドを実行してクラスターの

op-versionを更新します。これにより、クラスター内の互換性の問題を防ぐことができます。# gluster volume set all cluster.op-version 31306

注記31306は、Red Hat Gluster Storage 3.4 Async Update のcluster.op-versionの値に使用されます。他のバージョンの正しいcluster.op-version値については、「サポート対象の Red Hat Gluster Storage バージョン」 を参照してください。注記スナップショットを有効にする場合は、『 『Red Hat Gluster Storage 3.4 Administration Guide :https://access.redhat.com/documentation/ja-jp/red_hat_gluster_Storage/3.4/html-single/administration_guide/#Troubleshooting1 』』 を参照してください。 - アップグレード前にクライアント側のクォーラが無効にされている場合は、以下のコマンドを実行してこれをアップグレードします。

# gluster volume set volname cluster.quorum-type auto

- ダミーノードを以前に作成している場合は、以下のコマンドを実行してそのノードの割り当てを解除します。

# gluster peer detach <dummy_node name>

- アップグレード前にマスターとスレーブ間の geo レプリケーションセッションが無効になっている場合は、メタボリュームを設定してセッションを再起動します。

# gluster volume set all cluster.enable-shared-storage enable

# gluster volume geo-replication Volume1 example.com::slave-vol config use_meta_volume true

# gluster volume geo-replication MASTER_VOL SLAVE_HOST::SLAVE_VOL start

- イレイジャーコーディングされた(dispersed)ボリュームをアップグレードするために

disperse.optimistic-change-logオプションおよびdisperse.eager-lockオプションを無効にしている場合は、これらの設定を再度有効にします。# gluster volume set volname disperse.optimistic-change-log on # gluster volume set volname disperse.eager-lock on

7.2.4. インサービスソフトウェアアップグレードに関する特別な考慮事項

7.2.4.1. 「In-Service Software Upgrade for a inactive Setup Setup」

- 再起動後にこれが自動的に起動しないようにするには、iscsiadm クラスターの各ノードで以下のコマンドを実行します。

# systemctl disable ctdb

- Red Hat Gluster Storage ノードの各ノードで以下のコマンドを実行して、Red Hat Gluster Storage サービスを停止します。

# systemctl stop ctdb

- xmvn サービスおよび SMB サービスが停止しているかどうかを確認するには、以下のコマンドを実行します。

# ps axf | grep -E '(ctdb|smb|winbind|nmb)[d]'

- 以下のコマンドを使用して、ストレージサーバー上の gluster サービスを停止します。

# systemctl stop glusterd # pkill glusterfs # pkill glusterfsd

/etc/fstabで、以下の例のようにpid service に使用されるボリュームを含む行をコメントアウトします。# HostName:/volname /gluster/lock glusterfs defaults,transport=tcp 0 0

- 以下のコマンドを使用してサーバーを更新します。

# yum update

- SELinux サポートが必要な場合は、の手順に従い SELinux を有効にします。 10章SELinux の有効化

- SELinux を有効にしたら、以下のブール値を設定します。

Samba の場合

setsebool -P samba_load_libgfapi 1

(402 の場合)

setsebool -P use_fusefs_home_dirs 1

- 再起動後に

glusterdサービスが自動的に起動しないようにするには、以下のコマンドを実行します。# systemctl disable glusterd

- サーバーを再起動します。

- 以下のスクリプトの gluster ボリューム情報を使用して META=all を更新します。

/var/lib/glusterd/hooks/1/start/post/S29CTDBsetup.sh /var/lib/glusterd/hooks/1/stop/pre/S29CTDB-teardown.sh

/etc/fstabで、以下の例のようにpid サービスに使用されるボリュームを含む行をコメント解除します。HostName:/volname /gluster/lock glusterfs defaults,transport=tcp 0 0

- システムの起動時に

glusterdデーモンを自動的に起動するには、以下のコマンドを実行します。# systemctl enable glusterd

- システムの起動時に ctdb デーモンを自動的に起動するには、以下のコマンドを実行します。

# systemctl enable ctdb

- 以下のコマンドを使用して

glusterdサービスを起動します。# systemctl start glusterd

- NFS を使用してボリュームにアクセスする場合は、以下のコマンドを使用して gluster-NFS を有効にします。

# gluster volume set <volname> nfs.disable off

以下に例を示します。# gluster volume set testvol nfs.disable off volume set: success

- 以下のコマンドを実行して、pidgin ボリュームをマウントします。

# mount -a

- 以下のコマンドを使用して、pidgin サービスを起動します。

# systemctl start ctdb

- Hadoop が正常に実行されているかどうかを確認するには、以下のコマンドを実行します。

# ctdb status # ctdb ip # ctdb ping -n all

Hadoop のアップグレード

Red Hat Gluster Storage サーバーをアップグレードしてから、以下の手順に従ってこれをアップグレードします。

- データの破損を避けるために、全ノードでこれを同時にアップグレードする必要があります。

- 以下の手順は、pidgin を 1.x から 00:00:0 4.x にアップグレードするときにのみ実行する必要があります。

- 以下のコマンドを実行して、getfacl クラスターの全ノードでこれを停止します。これは、2 つの異なるバージョンのブリックを同時に実行できないため、すべてのノードで同時に実行するようにしてください。

# systemctl stop ctdb

- samba サーバーとして使用するすべてのノードで、以下の操作を実行します。

- 以下のソフトリンクを削除します。

/etc/sysconfig/ctdb /etc/ctdb/nodes /etc/ctdb/public_addresses

- clustering クラスターの各ノードで以下のコマンドを実行して、以下のファイルを対応する場所にコピーします。

cp /gluster/lock/nodes /etc/ctdb/nodes cp /gluster/lock/public_addresses /etc/ctdb/public_addresses

- いずれかのノードで以下のコマンドを実行して、pid ボリュームを停止して削除します。

# gluster volume stop volname

# gluster volume delete volname

- アップデートするには、以下のコマンドを実行します。

# yum update

7.2.4.2. インサービスソフトウェアアップグレードの検証

# gluster --version

7.2.4.3. ネイティブクライアントのアップグレード

第8章 Red Hat Gluster Storage の Red Hat Enterprise Linux 7 へのアップグレード

- RHEL 6 から RHEL 7 へのアップグレードを実行中にヘルプが必要な場合は、詳細について Red Hat サポートにご連絡ください。

- RHEL 6 から RHEL 7 へのアップグレードはオフライン手順であり、アップグレードプロセス時にボリュームがオフラインであるため、Gluster ノードのダウンタイムが発生します。

- クライアントをアップグレードする前に、サーバーをアップグレードする必要があります。

8.1. アップグレードのためのシステムの準備

Red Hat Network Classic から Red Hat Subscription Manager に移行します。

システムがレガシーの Red Hat Network Classic 更新システムにないことを確認します。# migrate-rhs-classic-to-rhsm --status

システムが Red Hat Network Classic にない場合は、この手順を省略します。システムが Red Hat Network Classic にある場合は、「Migrating from RHN to RHSM in Red Hat Enterprise Linux」を参照して Red Hat Subscription Manager に移行します。システムをサブスクリプションマネージャーに登録します。

重要Subscription Manager を使用してシステムがすでに登録されている場合は、登録の手順を省略して、Gluster 設定ファイルのバックアップを開始します。システムを Red Hat Network に登録するには、以下のコマンドを実行し、RHEL エンタイトルメントのある Red Hat Network ユーザー名およびパスワードを入力します。# subscription-manager register --username=user_name --password=password

利用可能なエンタイトルメントプールを特定します。

RHEL 6 リポジトリーを含むエンタイトルメントプールを検索します。# subscription-manager list --available

システムにエンタイトルメントプールをアタッチします。

前の手順で特定したプール識別子を使用して、RHEL 6 のエンタイトルメントをシステムに割り当てます。# subscription-manager attach --pool=pool_ID

リポジトリーを有効にする

RHEL 6、scalefs、および Red Hat Gluster Storage リポジトリーを有効にします。# subscription-manager repos --enable=rhel-6-server-rpms --enable=rhel-scalefs-for-rhel-6-server-rpms --enable=rhs-3-for-rhel-6-server-rpms

Gluster 設定ファイルのバックアップ

注記システムを更新する前に、信頼できるバックアップソリューションを使用して完全バックアップを作成することが推奨されます。このナレッジベースソリューションでは、次のような方法があり https://access.redhat.com/solutions/1484053 ます。- 以下の設定ディレクトリーとファイルがバックアップされていることを確認します。

/var/lib/glusterd/etc/glusterfs

- samba-ctdb が有効にされたシステムの場合は、バックアップを保存する新しいディレクトリーを作成します。

# mkdir backup_folder_name # cd backup_folder_name

- 以下のコマンドを実行して、samba-ctdb データのバックアップを作成します。

for each in `ctdb getdbmap | grep PERSISTENT | cut -d" " -f2 | cut -d":" -f2`; do echo $each ; ctdb backup_folder_name $each ${each}.bak; done

すべての Gluster サービス、ボリューム、およびプロセスを停止します。

- geo レプリケーションセッションを停止します。

# gluster volume geo-replication MASTER_VOL SLAVE_HOST::SLAVE_VOL stop

- Nagios プロセスを停止します。

# service nrpe stop

- すべてのボリュームを停止します。

# for vol in `gluster volume list`; do gluster --mode=script volume stop $vol; sleep 2s; done

- Gluster プロセスを停止します。

# service glusterd stop # pkill glusterfs # pkill glusterfsd

- samba-ctdb が有効なシステムの場合は、ctdb サービスを停止します。

# service ctdb stop

システムを更新して再起動します。

システムを RHEL 6 の最新のマイナーバージョンに更新し、更新の完了後に再起動します。# yum update # reboot

バージョン番号を確認します。

以下のコマンドを使用して、更新された RHEL 6 システムの現在のバージョン番号を確認します。# cat /etc/redhat-release

重要バージョン番号は6.10である必要があります。

8.2. システム評価の実行

preupgrade- Assistant のインストール

preupgrade- Assistant は、既存の RHEL 6 システムをスキャンし、システムが RHEL 7 にアップグレードする方法と準備状態を判断するツールです。以下のコマンドを使用して、必要なリポジトリーにサブスクライブし、preupgrade-assistant ツールをインストールします。# subscription-manager repos --enable rhel-6-server-extras-rpms --enable rhel-6-server-optional-rpms # yum install preupgrade-assistant preupgrade-assistant-el6toel7

preupgrade ツールを実行します。

preupgrade ツールを起動します。# preupg -v

結果を評価します。

- ブラウザーで preupgrade ツールの結果を表示します。

/root/preupgrade/result.html FailedおよびNeeds Actionとマークされているすべてのコンポーネントを書き留めます。- アップグレードプロセスを支援する Red Hat のマネージメントにハイライトを共有してください。

RHEL 7 の SELinux ポリシー

RHEL 6 と RHEL 7 との間で SELinux ポリシーが変更になりました。RHEL 7 で作業中の SELinux ポリシーの場合は、以下のコマンドを実行します。# semodule -r sandbox

クラスターおよび HA 関連パッケージのアンインストール

重要システムにインストールされているクラスターおよび HA 関連のパッケージについては、移行ができません。以下のコマンドを実行して、クラスターおよび HA 関連パッケージをアンインストールします。# yum remove modcluster ricci openais corosync

8.3. RHEL 6.X から RHEL 7.X へのアップグレード

移行ツールのインストール

ツールをインストールして、RHEL 6 から RHEL 7 への移行を実行します。# yum install redhat-upgrade-tool # yum install yum-utils

すべてのリポジトリーを無効にします

有効にされているすべてのリポジトリーを無効にします。# yum-config-manager --disable \*

最新の RHEL 7 ISO をダウンロードする

Red Hat Customer Service Portal(https://access.redhat.com/downloads)の ソフトウェアおよびダウンロードセンター にアクセスし、最新の RHEL 7 ISO イメージファイル を取得します。有効な Red Hat サブスクリプションを使用して、完全なインストールファイルのダウンロードや、評価用の無料インストールの取得を行うか、またはこのページのリンクにアクセスして新規の Red Hat サブスクリプションを購入します。Red Hat サブスクリプションまたは Red Hat 評価サブスクリプションを使用して RHEL 7 インストールファイルをダウンロードするには、以下の手順を実行します。- Red Hat カスタマーポータル (https://access.redhat.com/login) にアクセスし、ユーザー名およびパスワードを入力してログインします。

- Downloads をクリックし、 Software & Download Center に移動します。

- Red Hat Enterprise Linux エリアで Download Software をクリックして、最新バージョンのソフトウェアをダウンロードします。

ISO を使用して RHEL 7 にアップグレードします。

Red Hat アップグレードツールを使用して RHEL 7 にアップグレードし、アップグレードプロセスの完了後に再起動します。# redhat-upgrade-tool --iso RHEL7_ISO_filepath --cleanup-post # reboot

重要アップグレードプロセスは、システムの設定やデータ量によって異なります。

8.4. Red Hat Gluster Storage 3.4 へのアップグレード

すべてのリポジトリーを無効にします

# subscription-manager repos --disable=’*’

RHEL 7 チャンネルへのサブスクライブ

# subscription-manager repos --enable=rhel-7-server-rpms

古い RHEL 6 パッケージの確認

アップグレード後に、古い RHEL 6 パッケージをメモします。# rpm -qa | grep el6

更新および再起動