director のインストールと使用方法

Red Hat Enterprise Linux OpenStack Platform director を使用した OpenStack クラウド作成のエンドツーエンドシナリオ

概要

第1章 はじめに

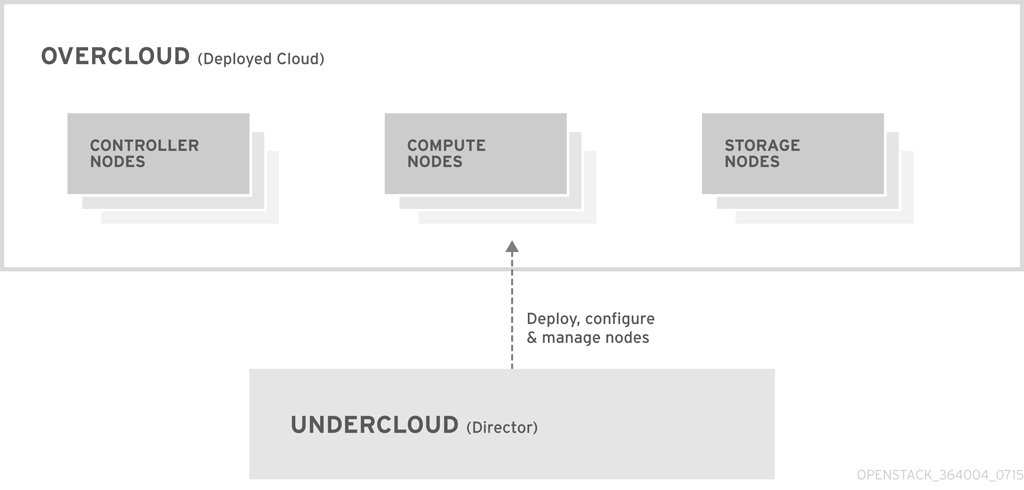

図1.1 アンダークラウドおよびオーバークラウドの基本レイアウト

1.1. アンダークラウド

- 環境プランニング: アンダークラウドは、コンピュート、コントローラー、各種ストレージロールなどの Red Hat Enterprise Linux OpenStack Platform ロールを割り当てるプランニング機能を提供します。

- ベアメタルシステムの制御: アンダークラウドは、電源管理の制御には各ノードの Intelligent Platform Management Interface (IPMI) を使用し、ハードウェア属性の検出や OpenStack の各ノードへのインストールには PXE ベースのサービスを使用します。この機能により、ベアメタルシステムを OpenStack ノードとしてプロビジョニングする方法が提供されます。

- オーケストレーション: アンダークラウドは、OpenStack 環境を構築するための YAML テンプレートセットの提供および読み込みを行います。

- OpenStack Dashboard (Horizon): director の Web ベースのダッシュボード

- OpenStack Bare Metal (Ironic) および OpenStack Compute (Nova): ベアメタルノードの管理

- OpenStack Networking (Neutron) および Open vSwitch: ベアメタルノードのネットワークの制御

- OpenStack Image Server (Glance): ベアメタルマシンへ書き込むイメージの格納

- OpenStack Orchestation (Heat) および Puppet: director がオーバークラウドイメージをディスクに書き込んだ後のノードのオーケストレーションおよび設定

- OpenStack Telemetry (Ceilometer): 監視とデータの収集

- OpenStack Identity (Keystone): director のコンポーネントの認証

- MariaDB: director のデータベース

- RabbitMQ: director コンポーネントのメッセージキュー

1.2. オーバークラウド

- コントローラー: OpenStack 環境に管理、ネットワーク、高可用性機能を提供するノード。理想的な OpenStack 環境には、高可用性のクラスターに 3 つのコントローラーノードが設定されていることが推奨されます。デフォルトのコントローラーノードには、Horizon、Keystone、Nova API、Neutron Server、Open vSwitch、Glance、Cinder Volume、Cinder API、Swift Storage、Swift Proxy、Heat Engine、Heat API、Ceilometer、MariaDB、RabbitMQ のコンポーネントが含まれています。また、コントローラーは高可用性機能に Pacemaker や Galera も使用します。

- コンピュート: OpenStack 環境にコンピュートリソースを提供するために使用するノード。環境を徐々にスケーリングするにはコンピュートノードをさらに追加します。デフォルトのコンピュートノードには、Nova、Compute、Nova KVM、Ceilometer Agent、Open vSwitch といったコンポーネントが含まれます。

- ストレージ: OpenStack 環境にストレージを提供するノード。これには、以下のストレージ用のノードが含まれます。

- Ceph Storage ノード: ストレージクラスターを構成するために使用します。各ノードには、Ceph Object Storage Daemon (OSD) が含まれており、Ceph Storage ノードをデプロイする場合には、director により Ceph Monitor がコンピュートノードにインストールされます。

- Block Storage (Cinder): HA コントローラーノードの外部ブロックストレージとして使用します。このノードには、Cinder Volume、Ceilometer Agent、Open vSwitch といったコンポーネントが含まれます。

- Object Storage (swift): これらのノードは、OpenStack Swift の外部ストレージ層を提供します。コントローラーノードは、Swift プロキシーを介してこれらのノードにアクセスします。このノードには、swift ストレージ、ceilometer エージェント、Open vSwitch コンポーネントが含まれます。

1.3. 高可用性

- Pacemaker: Pacemaker はクラスターリソースマネージャーで、クラスター内の全マシンにおける OpenStack コンポーネントの可用性を管理/監視します。

- HA Proxy: クラスターに負荷分散およびプロキシーサービスを提供します。

- Galera: クラスター全体の OpenStack Platform データベースの複製を提供します。

- Memcached: データベースのキャッシュを提供します。

注記

1.4. Ceph Storage

第2章 要件

2.1. 環境要件

最低要件

- Red Hat Enterprise Linux OpenStack Platform director 用のホストマシン 1 台

- Red Hat Enterprise Linux OpenStack Platform コンピュートノード用のホストマシン 1 台

- Red Hat Enterprise Linux OpenStack Platform コントローラーノード用のホストマシン 1 台

推奨要件

- Red Hat Enterprise Linux OpenStack Platform director 用のホストマシン 1 台

- Red Hat Enterprise Linux OpenStack Platform コンピュートノード用のホストマシン 3 台

- Red Hat Enterprise Linux OpenStack Platform コントローラーノード用のホストマシン 1 台

- クラスター内に Red Hat Ceph Storage ノード用のホストマシン 3 台

- 全ノードにはベアメタルシステムを使用することを推奨します。最低でも、コンピュートノードにはベアメタルシステムが必要です。

- director は電源管理制御を行うため、オーバークラウドのベアメタルシステムにはすべて、Intelligent Platform Management Interface (IPMI) が必要です。

2.2. アンダークラウドの要件

- Intel 64 または AMD64 CPU 拡張機能をサポートする、8 コア 64 ビット x86 プロセッサー

- 最小で 16 GB の RAM

- 最小 40 GB の空きディスク領域。オーバークラウドのデプロイまたは更新を試みる前には、空き領域が少なくとも 10 GB あることを確認してください。この空き領域は、イメージの変換やノードのプロビジョニングプロセスのキャッシュに使用されます。

- 最小 2 枚の 1 Gbps ネットワークインターフェースカード。ただし、特にオーバークラウド環境で多数のノードをプロビジョニングする場合には、ネットワークトラフィックのプロビジョニング用に 10 Gbps インターフェースを使用することを推奨します。

- ホストのオペレーティングシステムに Red Hat Enterprise Linux 7.2 がインストール済みであること

2.3. ネットワーク要件

- プロビジョニングネットワーク: これは、director がオーバークラウドノードのプロビジョニング/管理に使用するプライベートネットワークです。プロビジョニングネットワークは、オーバークラウドで使用するベアメタルシステムの検出がしやすくなるように、DHCP および PXE ブート機能を提供します。director が PXE ブートおよび DHCP の要求に対応できるように、このネットワークはトランキングされたインターフェースでネイティブ VLAN を使用する必要があります。これは、Intelligent Platform Management Interface (IPMI) での全オーバークラウドノードの電源管理制御に使用するネットワークでもあります。

- 外部ネットワーク: 全ノードへのリモート接続に使用する別個のネットワーク。このネットワークに接続するこのインターフェースには、静的または外部の DHCP サービス経由で動的に定義された、ルーティング可能な IP アドレスが必要です。

- すべてのマシンに少なくとも 2 つの NIC が必要です。標準的な最小設定の場合には、以下のいずれかを使用します。

- プロビジョニングネットワーク用の NIC を 1 つと、外部ネットワーク用の NIC を 1 つ。

- ネイティブの VLAN 上にプロビジョニングネットワーク用の NIC を 1 つと、異なる種別のオーバークラウドネットワークのサブネットを使用するタグ付けされた VLAN 用の NIC を 1 つ。

- 追加の物理 NIC は、個別のネットワークの分離、ボンディングインターフェースの作成、タグ付された VLAN トラフィックの委譲に使用することができます。

- ネットワークトラフィックの種別を分離するのに VLAN を使用している場合には、802.1Q 標準をサポートするスイッチを使用してタグ付けされた VLAN を提供します。

- オーバークラウドの作成時に NIC を参照する場合は、全オーバークラウドマシンで 1 つの名前を使用します。理想としては、混乱を避けるため、対象のネットワークごとに、各システムで同じ NIC を使用してください。たとえば、プロビジョニングネットワークにはプライマリー NIC を使用して、OpenStack サービスにはセカンダリー NIC を使用します。

- プロビジョニングネットワークの NIC は director マシン上でリモート接続に使用する NIC とは異なります。director のインストールでは、プロビジョニング NIC を使用してブリッジが作成され、リモート接続はドロップされます。director システムへリモート接続する場合には、外部 NIC を使用します。

- プロビジョニングネットワークには、環境のサイズに適した IP 範囲が必要です。以下のガイドラインを使用して、この範囲に含めるべき IP アドレスの数を決定してください。

- 最小で、プロビジョニングネットワークに接続されているノード 1 台につき 1 IP アドレスを含めます。

- 高可用性を設定する予定がある場合には、クラスターの仮想 IP 用に追加の IP アドレスを含めます。

- 環境のスケーリング用の追加の IP アドレスを範囲に追加します。

注記

プロビジョニングネットワーク上で IP アドレスが重複するのを避ける必要があります。 詳しい説明は、「プロビジョニングネットワーク上での IP アドレスの競合の回避」を参照してください。注記

ストレージ、プロバイダー、テナントネットワークの IP アドレスの使用範囲をプランニングすることに関する情報は、『ネットワークガイド』を参照してください。 - すべてのオーバークラウドシステムをプロビジョニング NIC から PXE ブートするように設定して、同システム上の外部 NIC およびその他の NIC の PXE ブートを無効にします。また、プロビジョニング NIC の PXE ブートは、ハードディスクや CD/DVD ドライブよりも優先されるように、起動順序の最上位に指定します。

- director は各ノードの電源管理制御を行うため、オーバークラウドのベアメタルシステムにはすべて、プロビジョニングネットワークに接続された Intelligent Platform Management Interface (IPMI) が必要です。

- 各オーバークラウドシステムの詳細 (プロビジョニング NIC の MAC アドレス、IPMI NIC の IP アドレス、IPMI ユーザー名、IPMI パスワード) をメモしてください。この情報は、オーバークラウドノードの設定時に役立ちます。

- 1 つのブリッジには単一のインターフェースまたは単一のボンディングのみをメンバーにすると、Open vSwitch でネットワークループが発生するリスクを緩和することができます。複数のボンディングまたはインターフェースが必要な場合には、複数のブリッジを設定することが可能です。

重要

- ネットワークのセグメント化を使用して、ネットワークトラフィックを軽減し、機密データを分離します。フラットなネットワークはセキュリティーレベルがはるかに低くなります。

- サービスアクセスとポートを最小限に制限します。

- 適切なファイアウォールルールとパスワードが使用されるようにします。

- SELinux が有効化されていることを確認します。

2.4. オーバークラウドの要件

注記

2.4.1. コンピュートノードの要件

- プロセッサー

- Intel 64 または AMD64 CPU 拡張機能をサポートする 64 ビット x86 プロセッサーで Intel VT または AMD-V のハードウェア仮想化拡張機能が有効化されていること。このプロセッサーには最小でも 4 つのコアが搭載されていることを推奨しています。

- メモリー

- 最小で 6 GB の RAMこの要件には、仮想マシンインスタンスに割り当てるメモリー容量に基づいて、追加の RAM を加算します。

- ディスク領域

- 最小 40 GB の空きディスク領域

- ネットワークインターフェースカード

- 最小 1 枚の 1 Gbps ネットワークインターフェースカード (実稼働環境では最低でも NIC を 2 枚使用することを推奨)。タグ付けされた VLAN トラフィックを委譲する場合や、ボンディングインターフェース向けの場合には追加のネットワークインターフェースを使用します。

- Intelligent Platform Management Interface (IPMI)

- 各コンピュートノードには、サーバーのマザーボード上に IPMI 機能が必要です。

2.4.2. コントローラーノードの要件

- プロセッサー

- Intel 64 または AMD64 CPU 拡張機能をサポートする 64 ビット x86 プロセッサー

- メモリー

- 最小 6 GB の RAM

- ディスク領域

- 最小 40 GB の空きディスク領域

- ネットワークインターフェースカード

- 最小 2 枚の 1 Gbps ネットワークインターフェースカード。タグ付けされた VLAN トラフィックを委譲する場合や、ボンディングインターフェース向けの場合には追加のネットワークインターフェースを使用します。

- Intelligent Platform Management Interface (IPMI)

- 各コントローラーノードには、サーバーのマザーボード上に IPMI 機能が必要です。

2.4.3. Ceph Storage ノードの要件

- プロセッサー

- Intel 64 または AMD64 CPU 拡張機能をサポートする 64 ビット x86 プロセッサー

- メモリー

- メモリー要件はストレージ容量によって異なります。ハードディスク容量 1 TB あたり最小で 1 GB のメモリーを使用するのが理想的です。

- ディスク領域

- ストレージ要件はメモリーの容量によって異なります。ハードディスク容量 1 TB あたり最小で 1 GB のメモリーを使用するのが理想的です。

- ディスクのレイアウト

- 推奨される Red Hat Ceph Storage ノードの設定には、以下のようなディスクレイアウトが必要です。

/dev/sda: root ディスク。director は、主なオーバークラウドイメージをディスクにコピーします。/dev/sdb: ジャーナルディスク。このディスクは、/dev/sdb1、/dev/sdb2、/dev/sdb3などのように、Ceph OSD 向けにパーティションを分割します。ジャーナルディスクは通常、システムパフォーマンス向上に役立つ Solid State Drive (SSD) です。/dev/sdc以降: OSD ディスク。ストレージ要件で必要な数のディスクを使用します。

本ガイドには、Ceph Storage ディスクを director にマッピングするために必要な手順を記載しています。 - ネットワークインターフェースカード

- 最小で 1 x 1 Gbps ネットワークインターフェースカード (実稼動環境では、最低でも NIC を 2 つ以上使用することを推奨します)。ボンディングされたインターフェース向けの場合や、タグ付けされた VLAN トラフィックを委譲する場合には、追加のネットワークインターフェースを使用します。特に大量のトラフィックにサービスを提供する OpenStack Platform 環境を構築する場合には、ストレージノードには 10 Gbps インターフェースを使用することを推奨します。

- Intelligent Platform Management Interface (IPMI)

- 各 Ceph ノードには、サーバーのマザーボード上に IPMI 機能が必要です。

重要

# parted [device] mklabel gpt

2.5. リポジトリーの要件

表2.1 OpenStack Platform リポジトリー

|

名前

|

リポジトリー

|

要件の説明

|

|---|---|---|

|

Red Hat Enterprise Linux 7 Server (RPMs)

| rhel-7-server-rpms

|

ベースオペレーティングシステムのリポジトリー

|

|

Red Hat Enterprise Linux 7 Server - Extras (RPMs)

| rhel-7-server-extras-rpms

|

Red Hat OpenStack Platform の依存関係が含まれます。

|

|

Red Hat Enterprise Linux 7 Server - RH Common (RPMs)

| rhel-7-server-rh-common-rpms

|

Red Hat OpenStack Platform のデプロイと設定ツールが含まれます。

|

|

Red Hat Satellite Tools for RHEL 7 Server RPMs x86_64

| rhel-7-server-satellite-tools-6.1-rpms

|

Red Hat Satellite 6 でのホスト管理ツール

|

|

Red Hat Enterprise Linux High Availability (for RHEL 7 Server) (RPMs)

| rhel-ha-for-rhel-7-server-rpms

|

Red Hat Enterprise Linux の高可用性ツール。コントローラーノードの高可用性に使用します。

|

|

Red Hat Enterprise Linux OpenStack Platform 7.0 director for RHEL 7 (RPMs)

| rhel-7-server-openstack-7.0-director-rpms

|

Red Hat OpenStack Platform director のリポジトリー

|

|

Red Hat Enterprise Linux OpenStack Platform 7.0 for RHEL 7 (RPMs)

| rhel-7-server-openstack-7.0-rpms

|

Red Hat OpenStack Platform のコアリポジトリー

|

|

Red Hat Ceph Storage OSD 1.3 for Red Hat Enterprise Linux 7 Server (RPMs)

| rhel-7-server-rhceph-1.3-osd-rpms

|

(Ceph Storage ノード向け) Ceph Storage Object Storage デーモンのリポジトリー。Ceph Storage ノードにインストールします。

|

|

Red Hat Ceph Storage MON 1.3 for Red Hat Enterprise Linux 7 Server (RPMs)

| rhel-7-server-rhceph-1.3-mon-rpms

|

(Ceph Storage ノード向け) Ceph Storage Monitor デーモンのリポジトリー。Ceph Storage ノードを使用して OpenStack 環境にあるコントローラーノードにインストールします。

|

第3章 アンダークラウドのインストール

3.1. director のインストールユーザーの作成

stack という名前のユーザーを作成して、パスワードを設定します。

[root@director ~]# useradd stack [root@director ~]# passwd stack # specify a password

sudo の使用時にはパスワードなしでログインできるようにします。

[root@director ~]# echo "stack ALL=(root) NOPASSWD:ALL" | tee -a /etc/sudoers.d/stack [root@director ~]# chmod 0440 /etc/sudoers.d/stack

stack ユーザーに切り替えます。

[root@director ~]# su - stack [stack@director ~]$

stack ユーザーで director のインストールを続行します。

3.2. テンプレートとイメージ用のディレクトリーの作成

$ mkdir ~/images $ mkdir ~/templates

3.3. システムのホスト名設定

$ hostname # Checks the base hostname $ hostname -f # Checks the long hostname (FQDN)

hostnamectl を使用してホスト名を設定します。

$ sudo hostnamectl set-hostname manager.example.com $ sudo hostnamectl set-hostname --transient manager.example.com

/etc/hosts にシステムのホスト名とベース名も入力する必要があります。たとえば、システムの名前が manager.example.com の場合には、/etc/hosts には以下のように入力する必要があります。

127.0.0.1 manager.example.com manager localhost localhost.localdomain localhost4 localhost4.localdomain4

3.4. システムの登録

手順3.1 サブスクリプションマネージャーを使用して必要なチャンネルをサブスクライブする手順

- コンテンツ配信ネットワークにシステムを登録します。プロンプトが表示されたら、カスタマーポータルのユーザー名とパスワードを入力します。

$ sudo subscription-manager register

- Red Hat Enterprise Linux OpenStack Platform director のエンタイトルメントプールを検索します。

$ sudo subscription-manager list --available --all

- 上記のステップで特定したプール ID を使用して、Red Hat Enterprise Linux OpenStack Platform 7 のエンタイトルメントをアタッチします。

$ sudo subscription-manager attach --pool=pool_id

- デフォルトのリポジトリーをすべて無効にしてから、必要な Red Hat Enterprise Linux リポジトリーを有効にします。

$ sudo subscription-manager repos --disable=* $ sudo subscription-manager repos --enable=rhel-7-server-rpms --enable=rhel-7-server-extras-rpms --enable=rhel-7-server-openstack-7.0-rpms --enable=rhel-7-server-openstack-7.0-director-rpms --enable rhel-7-server-rh-common-rpms

これらのリポジトリーには、director のインストールに必要なパッケージが含まれます。重要

上記にリストしたリポジトリーのみを有効にします。追加のリポジトリーを使用すると、パッケージとソフトウェアの競合が発生する場合があります。他のリポジトリーは有効にしないでください。 - システムで更新を実行して、ベースシステムパッケージを最新の状態にします。

$ sudo yum update -y $ sudo reboot

3.5. director パッケージのインストール

[stack@director ~]$ sudo yum install -y python-rdomanager-oscplugin

3.6. director の設定

stack ユーザーのホームディレクトリーに undercloud.conf として配置されているテンプレートに保存されています。

stack ユーザーのホームディレクトリーにコピーします。

$ cp /usr/share/instack-undercloud/undercloud.conf.sample ~/undercloud.conf

- local_ip

- director のプロビジョニング NIC 用に定義する IP アドレス。これは、director が DCHP および PXE ブートサービスに使用する IP アドレスでもあります。使用環境の既存の IP アドレスまたはサブネットと競合するなど、プロビジョニングネットワークに別のサブネットを使用する場合以外は、この値はデフォルトの

192.0.2.1/24のままにしてください。 - undercloud_public_vip

- director のパブリック API 用に定義する IP アドレス。他の IP アドレスまたはアドレス範囲と競合しないプロビジョニングネットワークの IP アドレスを使用します。たとえば、

192.0.2.2で、director の設定により、この IP アドレスは/32ネットマスクを使用するルーティングされた IP アドレスとしてソフトウェアブリッジに接続されます。 - undercloud_admin_vip

- director の管理 API 用に定義する IP アドレス。他の IP アドレスまたはアドレス範囲と競合しないプロビジョニングネットワークの IP アドレスを使用します。たとえば、

192.0.2.3で、director の設定により、この IP アドレスは/32ネットマスクを使用するルーティングされた IP アドレスとしてソフトウェアブリッジに接続されます。 - undercloud_service_certificate

- OpenStack SSL 通信の証明書の場所とファイル名。理想的には、信頼できる認証局から、この証明書を取得します。それ以外の場合は、「 付録B SSL/TLS 証明書の設定」のガイドラインを使用して独自の自己署名の証明書を作成します。これらのガイドラインには、自己署名の証明書か認証局からの証明書に拘らず、証明書の SELinux コンテキストを設定する方法が含まれています。

- local_interface

- director のプロビジョニング NIC 用に選択するインターフェース。これは、director が DCHP および PXE ブートサービスに使用するデバイスでもあります。どのデバイスが接続されているかを確認するには、

ip addrを使用します。以下にip addrコマンドの出力結果の例を示します。2: eth0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc pfifo_fast state UP qlen 1000 link/ether 52:54:00:75:24:09 brd ff:ff:ff:ff:ff:ff inet 192.168.122.178/24 brd 192.168.122.255 scope global dynamic eth0 valid_lft 3462sec preferred_lft 3462sec inet6 fe80::5054:ff:fe75:2409/64 scope link valid_lft forever preferred_lft forever 3: eth1: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 1500 qdisc noop state DOWN link/ether 42:0b:c2:a5:c1:26 brd ff:ff:ff:ff:ff:ffこの例では、外部 NIC はeth0を、プロビジョニング NIC は未設定のeth1を使用します。今回は、local_interfaceをeth1に設定します。この設定スクリプトにより、このインターフェースがdiscovery_interfaceパラメーターで定義したカスタムのブリッジにアタッチされます。 - masquerade_network

- 外部アクセス向けにネットワークをマスカレードに定義します。これにより、プロビジョニングネットワークにネットワークアドレス変換 (NAT) の範囲が提供され、director 経由で外部アクセスが可能になります。プロビジョニングネットワークに別のサブネットを使用しない限り、この値はデフォルト (

192.0.2.0/24) のままにします。 - dhcp_start, dhcp_end

- オーバークラウドノードの DHCP 割り当て範囲 (開始アドレスと終了アドレス)。お使いのノードを割り当てるのに十分な IP アドレスがこの範囲に含まれるようにします。

- network_cidr

- オーバークラウドインスタンスの管理に director が使用するネットワーク。これはプロビジョニングネットワークです。プロビジョニングネットワークに別のサブネットを使用しない限り、この値はデフォルト (

192.0.2.0/24) のままにします。 - network_gateway

- オーバークラウドインスタンスのゲートウェイ。外部ネットワークにトラフィックを転送する検出ホストです。director に別の IP アドレスを使用する場合または外部ゲートウェイを直接使用する場合以外は、この値はデフォルト (

192.0.2.1) のままにします。注記

director の設定スクリプトは、適切なsysctlカーネルパラメーターを使用して IP フォワーディングを自動的に有効にする操作も行います。 - discovery_interface

- ノードの検出に director が使用するブリッジ。これは、director の設定により作成されるカスタムのブリッジです。

LOCAL_INTERFACEでこのブリッジをアタッチします。これは、デフォルトのbr-ctlplaneのままにします。 - discovery_iprange

- director の検出サービスが PXE ブートとプロビジョニングプロセスの際に使用する IP アドレス範囲。この範囲の開始アドレスと終了アドレスの定義には、

192.0.2.100,192.0.2.120などのように、コンマ区切りの値を使用します。この範囲には、お使いのノードの IP アドレスが含まれており、dhcp_startとdhcp_endの範囲と競合がないようにします。 - discovery_runbench

- ノード検出時に一連のベンチマークを実行します。有効にするには、

1に設定します。このオプションは、高度なシナリオで登録ノードのハードウェアを検査する際にベンチマーク分析を実行する場合に必要です。詳細は、「Automated Health Check (AHC) ツールを使用したノードの自動タグ付け」 を参照してください。 - undercloud_debug

- アンダークラウドサービスのログレベルを

DEBUGに設定します。この値はtrueに設定して有効化します。 - undercloud_db_password, undercloud_admin_token, undercloud_admin_password, undercloud_glance_password, など

- 残りのパラメーターは、全 director サービスのアクセス詳細を指定します。値を変更する必要はありません。

undercloud.confで空欄になっている場合には、これらの値は director の設定スクリプトによって自動的に生成されます。設定スクリプトの完了後には、すべての値を取得することができます。重要

これらのパラメーターの設定ファイルの例では、プレースホルダーの値に<None>を使用しています。これらの値を<None>に設定すると、デプロイメントでエラーが発生します。

$ openstack undercloud install

undercloud.conf の設定に合わせてサービスを設定します。このスクリプトは、完了までに数分かかります。

undercloud-passwords.conf: director サービスの全パスワード一覧stackrc: director のコマンドラインツールへアクセスできるようにする初期化変数セット

stack ユーザーを初期化してコマンドラインツールを使用するには、以下のコマンドを実行します。

$ source ~/stackrc

3.7. オーバークラウドノードのイメージの取得

- 検出カーネルおよび ramdisk: PXE ブートでのベアメタルシステムの検出に使用

- デプロイメントカーネルおよび ramdisk: システムのプロビジョニングおよびデプロイメントに使用

- オーバークラウドカーネル、ramdisk、完全なイメージ: ノードのハードディスクに書きこまれるベースのオーバークラウドシステム

stack ユーザーのホーム (/home/stack/images/) の images ディレクトリーにダウンロードしてください。このアーカイブからイメージを抽出します。

$ cd ~/images $ for tarfile in *.tar; do tar -xf $tarfile; done

$ openstack overcloud image upload --image-path /home/stack/images/

bm-deploy-kernel、bm-deploy-ramdisk、overcloud-full、overcloud-full-initrd、overcloud-full-vmlinuz のイメージを director にアップロードします。これらは、デプロイメントおよびオーバークラウド用のイメージです。また、このスクリプトにより、director の PXE サーバーに検出イメージがインストールされます。

$ openstack image list +--------------------------------------+------------------------+ | ID | Name | +--------------------------------------+------------------------+ | 765a46af-4417-4592-91e5-a300ead3faf6 | bm-deploy-ramdisk | | 09b40e3d-0382-4925-a356-3a4b4f36b514 | bm-deploy-kernel | | ef793cd0-e65c-456a-a675-63cd57610bd5 | overcloud-full | | 9a51a6cb-4670-40de-b64b-b70f4dd44152 | overcloud-full-initrd | | 4f7e33f4-d617-47c1-b36f-cbe90f132e5d | overcloud-full-vmlinuz | +--------------------------------------+------------------------+

discovery-ramdisk.*) は表示されません。director は、これらのファイルを /httpboot にコピーします。

[stack@host1 ~]$ ls -l /httpboot total 151636 -rw-r--r--. 1 ironic ironic 269 Sep 19 02:43 boot.ipxe -rw-r--r--. 1 root root 252 Sep 10 15:35 discoverd.ipxe -rwxr-xr-x. 1 root root 5027584 Sep 10 16:32 discovery.kernel -rw-r--r--. 1 root root 150230861 Sep 10 16:32 discovery.ramdisk drwxr-xr-x. 2 ironic ironic 4096 Sep 19 02:45 pxelinux.cfg

注記

/httpboot 内の boot.ipxe ファイルと pxelinux.cfg ディレクトリーを管理します。これらのファイルは、このディレクトリーを確認しても見えない可能性があります。

3.8. アンダークラウドの Neutron サブネットでのネームサーバーの設定

neutron サブネットで定義されます。以下のコマンドを使用して、この環境のネームサーバーを定義します。

$ neutron subnet-list $ neutron subnet-update [subnet-uuid] --dns-nameserver [nameserver-ip]

$ neutron subnet-show [subnet-uuid] +-------------------+-----------------------------------------------+ | Field | Value | +-------------------+-----------------------------------------------+ | ... | | | dns_nameservers | 8.8.8.8 | | ... | | +-------------------+-----------------------------------------------+

重要

DnsServer パラメーターを使用します。これは、「高度なオーバークラウドのネットワーク環境ファイルの作成」の高度な設定シナリオで説明します。

3.9. アンダークラウドの設定完了

第4章 オーバークラウドのプランニング

4.1. ノードのデプロイメントロールのプランニング

- コントローラー

- 環境を制御するための主要なサービスを提供します。これには、Dashboard (Horizon)、認証 (Keystone)、イメージストレージ (Glance)、ネットワーク (Neutron)、オーケストレーション (Heat)、高可用性サービス (複数のコントローラーノードを使用する場合) が含まれます。Red Hat OpenStack Platform 環境に以下のいずれかが必要です。

- 基本的な環境にはノードを 1 台

- 高可用性環境にはノードを 3 台

2 台のノードまたは 3 台以上のノードで構成される環境はサポートされません。 - コンピュート

- ハイパーバイザーとして機能し、環境内で仮想マシンを実行するのに必要な処理能力を提供するホスト。基本的な Red Hat Enterprise Linux OpenStack Platform 環境には少なくとも 1 つのコンピュートノードが必要です。

- Ceph-Storage

- Red Hat Ceph Storage を提供するホスト。Ceph Storage ホストはクラスターに追加され、クラスターをスケーリングします。このデプロイメントロールはオプションです。

- Cinder-Storage

- OpenStack の Cinder Service に外部ブロックストレージを提供するホスト。このデプロイメントロールはオプションです。

- Swift-Storage

- OpenStack の Swift Service に外部オブジェクトストレージを提供するホスト。このデプロイメントロールはオプションです。

表4.1 各種シナリオに使用するノードデプロイメントロール

| |

コントローラー

|

コンピュート

|

Ceph-Storage

|

Swift-Storage

|

Cinder-Storage

|

合計

|

|---|---|---|---|---|---|---|

|

基本環境

|

1

|

1

|

-

|

-

|

-

|

2

|

|

Ceph Storage の高度な環境

|

3

|

3

|

3

|

-

|

-

|

9

|

4.2. ネットワークのプランニング

表4.2 ネットワーク種別の割り当て

|

ネットワーク種別

|

説明

|

そのネットワーク種別を使用するノード

|

|---|---|---|

|

IPMI

|

ノードの電源管理に使用するネットワーク。このネットワークは、アンダークラウドのインストール前に事前定義されます。

|

全ノード

|

|

プロビジョニング

|

director は、このネットワークトラフィック種別を使用して、PXE ブートで新規ノードをデプロイし、オーバークラウドベアメタルサーバーに OpenStack Platform のインストールをオーケストレーションします。このネットワークは、アンダークラウドのインストール前に事前定義されます。

|

全ノード

|

|

内部 API

|

内部 API ネットワークは、API 通信、RPC メッセージ、データベース通信経由で OpenStack のサービス間の通信を行う際に使用します。

|

コントローラー、コンピュート、Cinder Storage、Swift Storage

|

|

テナント

|

Neutron は、VLAN 分離 (各テナントネットワークがネットワーク VLAN) または VXLAN か GRE 経由のトンネリングを使用した独自のネットワークを各テナントに提供します。ネットワークトラフィックは、テナントのネットワークごとに分割されます。テナントネットワークには IP サブネットが割り当てられおり、複数のテナントネットワークが同じアドレスを使用する場合があります。

|

コントローラー、コンピュート

|

|

ストレージ

|

Block Storage、NFS、iSCSI など。理想的には、これはパフォーマンスの関係上、全く別のスイッチファブリックに分離します。

|

全ノード

|

|

ストレージ管理

|

OpenStack Object Storage (swift) は、このネットワークを使用して、参加するレプリカノード間でデータオブジェクトを同期します。プロキシーサービスは、ユーザー要求と背後にあるストレージ層の間の仲介インターフェースとして機能します。プロキシーは、受信要求を受け取り、必要なレプリカの位置を特定して要求データを取得します。Ceph バックエンドを使用するサービスは、Ceph と直接対話せずにフロントエンドのサービスを使用するため、ストレージ管理ネットワーク経由で接続を確立します。RBD ドライバーは例外で、このトラフィックは直接 Ceph に接続する点に注意してください。

|

コントローラー、Ceph Storage、Cinder Storage、Swift Storage

|

|

外部

|

グラフィカルシステム管理用の OpenStack Dashboard (Horizon)、OpenStack サービス用のパブリック API をホストして、インスタンスへの受信トラフィック向けに SNAT を実行します。外部ネットワークがプライベート IP アドレスを使用する場合には (RFC-1918 に準拠)、インターネットからのトラフィックに対して、さらに NAT を実行する必要があります。

|

コントローラー

|

|

Floating IP

|

受信トラフィックが Floating IP アドレスとテナントネットワーク内のインスタンスに実際に割り当てられた IP アドレスとの間の 1 対 1 の IP アドレスマッピングを使用してインスタンスに到達できるようにします。外部ネットワークからは分離した VLAN 上で Floating IP をホストする場合には、Floating IP VLAN をコントローラーノードにトランキングして、オーバークラウドの作成後に Neutron を介して VLAN を追加します。これにより、複数のブリッジに接続された複数の Floating IP ネットワークを作成する手段が提供されます。VLAN は、トランキングされますが、インスタンスとしては設定されません。その代わりに、Neutron は各 Floating IP ネットワークに選択したブリッジ上の VLAN セグメンテーション ID を使用して、OVS ポートを作成します。

|

コントローラー

|

注記

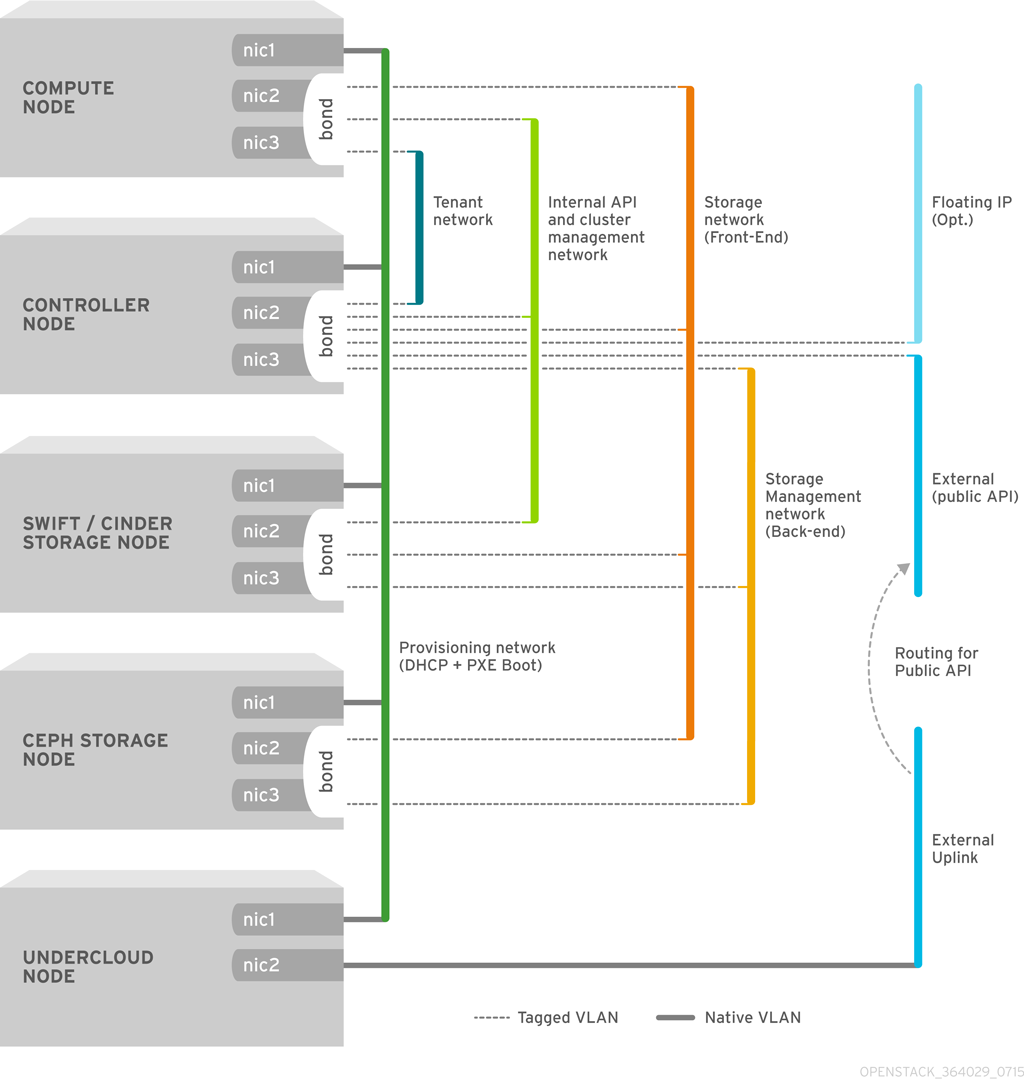

- 内部 API

- ストレージ

- ストレージ管理

- テナントネットワーク

- 外部

nic2 および nic3) のインターフェースを使用して、対象の VLAN 経由でこれらのネットワークを提供します。また、各オーバークラウドのノードは、ネイティブの VLAN (nic1) を使用するプロビジョニングネットワークでアンダークラウドと通信します。

図4.1 ボンディングインターフェースを使用する VLAN トポロジーの例

表4.3 ネットワークマッピング

| |

マッピング

|

インターフェースの総数

|

VLAN の総数

|

|---|---|---|---|

|

基本環境

|

ネットワーク 1: プロビジョニング、内部 API、ストレージ、ストレージ管理、テナントネットワーク

ネットワーク 2: 外部、Floating IP (オーバークラウドの作成後にマッピング)

|

2

|

2

|

|

Ceph Storage の高度な環境

|

ネットワーク 1: プロビジョニング

ネットワーク 2: 内部 API

ネットワーク 3: テナントネットワーク

ネットワーク 4: ストレージ

ネットワーク 5: ストレージ管理

ネットワーク 6: 外部、Floating IP (オーバークラウドの作成後にマッピング)

|

3 (ボンディングインターフェース 2 つを含む)

|

6

|

4.3. ストレージのプランニング

- Ceph Storage ノード

- director は、Red Hat Ceph Storage を使用して拡張可能なストレージノードセットを作成します。オーバークラウドは、各種ノードを以下の目的で使用します。

- イメージ: OpenStack Glance は仮想マシンのイメージを管理します。イメージは変更しないため、OpenStack はイメージバイナリーブロブとして処理し、それに応じてイメージをダウンロードします。Ceph Block Device でイメージを格納するには、OpenStack Glance を使用することができます。

- ボリューム: OpenStack Cinder ボリュームはブロックデバイスです。OpenStack は、仮想マシンの起動や、実行中の仮想マシンへのボリュームのアタッチにボリュームを使用し、Cinder サービスを使用してボリュームを管理します。さらに、イメージの CoW (Copy-on-Write) のクローンを使用して仮想マシンを起動する際には Cinder を使用します。

- ゲストディスク: ゲストディスクは、ゲストオペレーティングシステムのディスクです。デフォルトでは、Nova で仮想マシンを起動すると、ディスクは、ハイパーバイザーのファイルシステム上のファイルとして表示されます (通常

/var/lib/nova/instances/<uuid>/の配下)。Cinder を使用せずに直接 Ceph 内にある全仮想マシンを起動することができます。これは、ライブマイグレーションのプロセスで簡単にメンテナンス操作を実行できるため好都合です。また、ハイパーバイザーが停止した場合には、nova evacuateをトリガーして仮想マシンをほぼシームレスに別の場所で実行することもできるので便利です。

重要

Ceph では、仮想マシンディスクのホスティングに対する QCOW2 のサポートはありません。Ceph で仮想マシンを起動するには (一時バックエンドまたはボリュームからの起動)、Glance のイメージ形式はRAWでなければなりません。その他の情報については、『Red Hat Ceph Storage Architecture Guide』を参照してください。 - Cinder Storage ノード

- director は、外部ブロックストレージノードを作成します。これは、オーバークラウド環境でコントローラーノードをスケーリングまたは置き換える必要があるが、高可用性クラスター外にブロックストレージを保つ必要がある場合に便利です。

- Swift Storage ノード

- director は、外部オブジェクトストレージノードを作成します。これは、オーバークラウド環境でコントローラーノードをスケーリングまたは置き換える必要があるが、高可用性クラスター外にオブジェクトストレージを保つ必要がある場合に便利です。

第5章 Heat テンプレートについての理解

5.1. Heat テンプレート

- Parameters: これらは Heat に渡す設定で、スタックや値を指定しないパラメーターのデフォルト値をカスタマイズする方法を提供します。これらの設定は、テンプレートの

parametersセクションで定義します。 - Resources: これらはスタックの一部として作成/設定する固有のオブジェクトです。OpenStack には全コンポーネントに対応するコアのリソースセットが含まれています。これらの設定は、テンプレートの

resourcesセクションで定義されます。 - Output: これらは、スタックの作成後に heat から渡される値です。これらの値には、Heat API またはクライアントツールを使用してアクセスすることができます。これらは、テンプレートの

outputセクションで定義されます。

heat_template_version: 2013-05-23

description: > A very basic Heat template.

parameters:

key_name:

type: string

default: lars

description: Name of an existing key pair to use for the instance

flavor:

type: string

description: Instance type for the instance to be created

default: m1.small

image:

type: string

default: cirros

description: ID or name of the image to use for the instance

resources:

my_instance:

type: OS::Nova::Server

properties:

name: My Cirros Instance

image: { get_param: image }

flavor: { get_param: flavor }

key_name: { get_param: key_name }

output:

instance_name:

description: Get the instance's name

value: { get_attr: [ my_instance, name ] }

type: OS::Nova::Server のリソース種別を使用して、特定のフレーバー、イメージ、キーを指定した my_instance と呼ばれるインスタンスを作成します。このスタックは、My Cirros Instance という instance_name の値を返します。

5.2. 環境ファイル

- Parameters: これらは、テンプレートのパラメーターに適用する共通設定で、環境ファイルの

parametersセクションで定義します。 - Parameter Defaults: これらのパラメーターは、テンプレートのパラメーターのデフォルト値を変更します。これらの設定は、環境ファイルの

parameter_defaultsセクションで定義します。 - Resource Registry: このセクションでは、カスタムのリソース名、他の Heat テンプレートへのリンクを定義します。これは実質的に、コアリソースコレクションに存在しないカスタムのリソースを作成する方法を提供します。この設定は、環境ファイルの

resource_registryセクションで定義されます。

resource_registry: OS::Nova::Server::MyServer: myserver.yaml parameter_defaults: NetworkName: my_network parameters: MyIP: 192.168.0.1

OS::Nova::Server::MyServer と呼ばれる新しいリソース種別が作成されます。myserver.yaml ファイルは、このリソース種別を実装する Heat テンプレートファイルで、このファイルでの設定が元の設定よりも優先されます。

5.3. デフォルトの director プラン

$ openstack management plan list

overcloud というプランが表示されます。このオーバークラウドプランの詳細を表示するには、以下を実行します。

$ openstack management plan show [UUID]

stack ユーザーの templates ディレクトリーの中のディレクトリーにダウンロードします。

$ mkdir ~/templates/overcloud-plan $ openstack management plan download [UUID] -O ~/templates/overcloud-plan/

plan.yaml) と環境ファイル (environment.yaml) が含まれており、またテンプレートコレクションには、環境ファイルのリソースとして登録されているさまざまなディレクトリーおよびテンプレートファイルが含まれます。

5.4. デフォルトの director テンプレート

/usr/share/openstack-tripleo-heat-templates に保存されています。

overcloud-without-mergepy.yaml: これはオーバークラウド環境を作成するために使用する主要なテンプレートファイルです。overcloud-resource-registry-puppet.yaml: これは、オーバークラウド環境の作成に使用する主要な環境ファイルで、オーバークラウドイメージ上に保存される Puppet モジュールの設定セットを提供します。director により各ノードにオーバークラウドのイメージが書き込まれると、Heat は環境ファイルに登録されているリソースを使用して各ノードに Puppet の設定を開始します。overcloud-resource-registry.yaml: これは、オーバークラウド環境の作成に使用する標準の環境ファイルです。overcloud-resource-registry-puppet.yamlは、このファイルをベースにしており、お使いの環境をカスタム設定する際に使用します。

overcloud-without-mergepy.yaml テンプレートと overcloud-resource-registry-puppet.yaml 環境ファイルを使用して、ノードごとにオーバークラウドのイメージを設定します。また、基本的/高度なシナリオのいずれの場合も、ネットワークの分離設定を行うには、環境ファイルも作成します。

第6章 オーバークラウドのインストール

表6.1 シナリオの概要

|

シナリオ

|

レベル

|

トピック

|

|---|---|---|

|

基本オーバークラウド

|

中

|

CLI ツールの使用、ノードの登録、手動でのノードのタグ付け、基本的なネットワークの分離、プランベースのオーバークラウドの作成

|

|

高度なオーバークラウド

|

高

|

CLI ツールの使用、ノードの登録、ハードウェアをベースにしたノードの自動タグ付け、Ceph Storage の設定、高度なネットの分離、オーバークラウドの作成、高可用性のフェンシング設定

|

6.1. 基本シナリオ: NFS ストレージを使用する小規模なオーバークラウドの作成

ワークフロー

- ノード定義のテンプレートを作成して director で空のノードを登録します。

- 全ノードのハードウェアを検証します。

- 手動でロールにノードをタグ付けします。

- フレーバーを作成してロールにタグ付けします。

- Heat テンプレートを作成して外部ネットワークを分離します。

- デフォルトの Heat テンプレートコレクションと追加のネットワーク分離テンプレートを使用してオーバークラウド環境を作成します。

要件

- 「3章アンダークラウドのインストール」で作成した director ノード

- ベアメタルマシン 2 台。これらのマシンは、コントローラーノードおよびコンピュートノードに設定された要件に準拠する必要があります。要件については以下を参照してください。director により Red Hat Enterprise Linux 7 のイメージが各ノードにコピーされるため、これらのノードではオペレーティングシステムは必要ありません。

- ネイティブ VLAN として設定したプロビジョニングネットワーク用のネットワーク接続 1 つ。全ノードは、このネイティブに接続して、「ネットワーク要件」で設定した要件に準拠する必要があります。この例では、以下の IP アドレスの割り当てで、プロビジョニングサブネットとして 192.0.2.0/24 を使用します。

表6.2 プロビジョニングネットワークの IP 割り当て

ノード名IP アドレスMAC アドレスIPMI IP アドレスdirector192.0.2.1aa:aa:aa:aa:aa:aaコントローラー定義済みの DHCPbb:bb:bb:bb:bb:bb192.0.2.205コンピュート定義済みの DHCPcc:cc:cc:cc:cc:cc192.0.2.206 - 外部ネットワークのネットワーク接続 1 つ。コントローラーノードはすべて、このネットワークに接続する必要があります。今回の例では、外部ネットワークには 10.1.1.0/24 を使用します。

- その他のネットワーク種別はすべて、OpenStack サービスにプロビジョニングネットワークを使用します。

- このシナリオでは、プロビジョニングネットワーク上の別のサーバーで NFS 共有も使用します。このサーバーの IP アドレスは 192.0.2.230 です。

6.1.1. 基本オーバークラウドへのノードの登録

instackenv.json) は JSON ファイル形式で、2 つのノードのハードウェアおよび電源管理の詳細が含まれます。

- mac

- ノード上のネットワークインターフェースの MAC アドレス一覧。各システムのプロビジョニング NIC の MAC アドレスのみを使用します。

- pm_type

- 使用する電源管理ドライバー。この例では IPMI ドライバーを使用します (

pxe_ipmitool)。 - pm_user, pm_password

- IPMI のユーザー名およびパスワード

- pm_addr

- IPMI デバイスの IP アドレス

- cpu

- ノード上の CPU 数

- memory

- メモリーサイズ (MB)

- disk

- ハードディスクのサイズ (GB)

- arch

- システムアーキテクチャー

{

"nodes":[

{

"mac":[

"bb:bb:bb:bb:bb:bb"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.205"

},

{

"mac":[

"cc:cc:cc:cc:cc:cc"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.206"

}

]

}

注記

stack ユーザーのホームディレクトリー (/home/stack/instackenv.json) にファイルを保存してから、director にインポートします。これには、以下のコマンドを実行します。

$ openstack baremetal import --json ~/instackenv.json

$ openstack baremetal configure boot

$ openstack baremetal list

6.1.2. ノードのハードウェアの検証

$ openstack baremetal introspection bulk start

$ sudo journalctl -l -u openstack-ironic-discoverd -u openstack-ironic-discoverd-dnsmasq -u openstack-ironic-conductor -f

重要

$ ironic node-set-maintenance [NODE UUID] true $ openstack baremetal introspection start [NODE UUID] $ ironic node-set-maintenance [NODE UUID] false

6.1.3. ノードの手動でのタグ付け

properties/capabilities パラメーターに profile オプションを追加します。たとえば、2 つのノードをタグ付けしてコントローラープロファイルとコンピュートプロファイルをそれぞれ使用するには、以下のコマンドを実行します。

$ ironic node-update 58c3d07e-24f2-48a7-bbb6-6843f0e8ee13 add properties/capabilities='profile:compute,boot_option:local' $ ironic node-update 1a4e30da-b6dc-499d-ba87-0bd8a3819bc0 add properties/capabilities='profile:control,boot_option:local'

profile:compute と profile:control オプションを追加することで、この 2 つのノードがそれぞれのプロファイルにタグ付けされます。

boot_option:local パラメーターを設定します。

重要

6.1.4. 基本シナリオのフレーバーの作成

$ openstack flavor create --id auto --ram 6144 --disk 40 --vcpus 4 control $ openstack flavor create --id auto --ram 6144 --disk 40 --vcpus 4 compute

control と compute) が作成されました。また、各フレーバーに追加のプロパティーを設定します。

$ openstack flavor set --property "cpu_arch"="x86_64" --property "capabilities:boot_option"="local" --property "capabilities:profile"="compute" compute $ openstack flavor set --property "cpu_arch"="x86_64" --property "capabilities:boot_option"="local" --property "capabilities:profile"="control" control

capabilities:boot_option はフレーバーのブートモードを設定し、capabilities:profile は使用するプロファイルを定義します。これにより、「ノードの手動でのタグ付け」 でタグ付けされた対象の各ノード上にある同じタグにリンクされます。

重要

baremetal というデフォルトのフレーバーが必要です。このフレーバーがない場合には作成します。

$ openstack flavor create --id auto --ram 4096 --disk 40 --vcpus 1 baremetal

6.1.5. NFS ストレージの設定

/usr/share/openstack-tripleo-heat-templates/environments/ には一連の環境ファイルが格納されています。これらは、director で作成したオーバークラウドでサポートされている一部の機能のカスタム設定に役立つ環境テンプレートです。これには、ストレージ設定に有用な環境ファイルが含まれます。このファイルは、/usr/share/openstack-tripleo-heat-templates/environments/storage-environment.yaml に配置されています。このファイルを stack ユーザーのテンプレートディレクトリーにコピーしてください。

$ cp /usr/share/openstack-tripleo-heat-templates/environments/storage-environment.yaml ~/templates/.

- CinderEnableIscsiBackend

- iSCSI バックエンドを有効にするパラメーター。

falseに設定してください。 - CinderEnableRbdBackend

- Ceph Storage バックエンドを有効にするパラメーター。

falseに設定してください。 - CinderEnableNfsBackend

- NFS バックエンドを有効にするパラメーター。

trueに設定してください。 - NovaEnableRbdBackend

- Nova エフェメラルストレージ用に Ceph Storage を有効にするパラメーター。

falseに設定します。 - GlanceBackend

- Glance に使用するバックエンドを定義するパラメーター。イメージ用にファイルベースストレージを使用するには

fileに設定してください。オーバークラウドは、Glance 用にマウントされた NFS 共有にこれらのファイルを保存します。 - CinderNfsMountOptions

- ボリュームストレージ用の NFS マウントオプション

- CinderNfsServers

- ボリュームストレージ用にマウントする NFS 共有 (例:

192.168.122.1:/export/cinder) - GlanceFilePcmkManage

- イメージストレージ用の共有を管理するための Pacemaker を有効にするパラメーター。無効に設定されている場合には、オーバークラウドはコントローラーノードのファイルシステムにイメージを保管します。

trueに設定してください。 - GlanceFilePcmkFstype

- Pacemaker がイメージストレージ用に使用するファイルシステムの種別を定義するパラメーター。

nfsに設定します。 - GlanceFilePcmkDevice

- イメージストレージをマウントするための NFS 共有 (例:

192.168.122.1:/export/glance) - GlanceFilePcmkOptions

- イメージストレージ用の NFS マウントオプション

parameters: CinderEnableIscsiBackend: false CinderEnableRbdBackend: false CinderEnableNfsBackend: true NovaEnableRbdBackend: false GlanceBackend: 'file' CinderNfsMountOptions: 'rw,sync' CinderNfsServers: '192.0.2.230:/cinder' GlanceFilePcmkManage: true GlanceFilePcmkFstype: 'nfs' GlanceFilePcmkDevice: '192.0.2.230:/glance' GlanceFilePcmkOptions: 'rw,sync,context=system_u:object_r:glance_var_lib_t:s0'

重要

/var/lib ディレクトリーにアクセスできるようにするには、GlanceFilePcmkOptions パラメーターに context=system_u:object_r:glance_var_lib_t:s0 と記載します。この SELinux コンテキストがない場合には、Glance はマウントポイントへの書き込みに失敗することになります。

6.1.6. 外部ネットワークの分離

- ネットワーク 1: プロビジョニングネットワーク。内部 API、ストレージ、ストレージ管理、テナントネットワークもこのネットワークを使用します。

- ネットワーク 2: 外部ネットワーク。このネットワークは、オーバークラウドの外部に接続する専用インターフェースを使用します。

6.1.6.1. カスタムのインターフェーステンプレートの作成

/usr/share/openstack-tripleo-heat-templates/network/config/single-nic-vlans: このディレクトリーには、ロールごとに VLAN が設定された単一 NIC のテンプレートが含まれます。/usr/share/openstack-tripleo-heat-templates/network/config/bond-with-vlans: このディレクトリーには、ロール別のボンディング NIC 設定のテンプレートが含まれます。

nic-configs として、stack ユーザーのホームディレクトリーにコピーします。

$ cp -r /usr/share/openstack-tripleo-heat-templates/network/config/single-nic-vlans ~/templates/nic-configs

parameters、resources、output が含まれます。今回のシナリオでは、resources セクションのみを編集します。各 resources セクションは、以下のように開始されます。

resources:

OsNetConfigImpl:

type: OS::Heat::StructuredConfig

properties:

group: os-apply-config

config:

os_net_config:

network_config:

os-apply-config コマンドと os-net-config サブコマンドがノードのネットワークプロパティーを設定するように要求が作成されます。network_config セクションには、種別順に並べられたカスタムのインターフェース設定が含まれます。これらの種別には以下が含まれます。

- interface

- 単一のネットワークインターフェースを定義します。この設定では、実際のインターフェース名 (eth0、eth1、enp0s25) または番号付きのインターフェース (nic1、nic2、nic3) を使用して各インターフェースを定義します。

- type: interface name: nic2 - vlan

- VLAN を定義します。

parametersセクションから渡された VLAN ID およびサブネットを使用します。- type: vlan vlan_id: {get_param: ExternalNetworkVlanID} addresses: - ip_netmask: {get_param: ExternalIpSubnet} - ovs_bond

- Open vSwitch のボンディングを定義します。ボンディングでは、2 つ以上の

interfacesを結合して、冗長性や帯域幅を向上させます。- type: ovs_bond name: bond1 members: - type: interface name: nic2 - type: interface name: nic3 - ovs_bridge

- Open vSwitch のブリッジを定義します。ブリッジは、複数の

interface、bond、vlanオブジェクトを接続します。- type: ovs_bridge name: {get_input: bridge_name} members: - type: ovs_bond name: bond1 members: - type: interface name: nic2 primary: true - type: interface name: nic3 - type: vlan device: bond1 vlan_id: {get_param: ExternalNetworkVlanID} addresses: - ip_netmask: {get_param: ExternalIpSubnet}

nic2 に移動するように、各インターフェーステンプレートを変更します。これにより、各ノードの 2 番目のネットワークインターフェースが外部ネットワークに使用されるようになります。たとえば、templates/nic-configs/controller.yaml のテンプレートは以下のようになります。

network_config:

- type: ovs_bridge

name: {get_input: bridge_name}

use_dhcp: true

members:

- type: interface

name: nic1

# force the MAC address of the bridge to this interface

primary: true

- type: vlan

vlan_id: {get_param: InternalApiNetworkVlanID}

addresses:

- ip_netmask: {get_param: InternalApiIpSubnet}

- type: vlan

vlan_id: {get_param: StorageNetworkVlanID}

addresses:

- ip_netmask: {get_param: StorageIpSubnet}

- type: vlan

vlan_id: {get_param: StorageMgmtNetworkVlanID}

addresses:

- ip_netmask: {get_param: StorageMgmtIpSubnet}

- type: vlan

vlan_id: {get_param: TenantNetworkVlanID}

addresses:

- ip_netmask: {get_param: TenantIpSubnet}

- type: interface

name: nic2

addresses:

- ip_netmask: {get_param: ExternalIpSubnet}

routes:

- ip_netmask: 0.0.0.0/0

next_hop: {get_param: ExternalInterfaceDefaultRoute}

nic2) を作成して外部ネットワークアドレスを再割り当てし、新規インターフェースにルーティングします。

get_param 関数を使用する点に注意してください。これらのパラメーターは、使用するネットワーク専用に作成した環境ファイルで定義します。

重要

nic4) が含まれる可能性があり、このインターフェースは OpenStack のサービス用の IP 割り当てを使用しませんが、DHCP やデフォルトルートを使用します。ネットワークの競合を回避するには、使用済みのインターフェースを ovs_bridge デバイスから削除し、DHCP とデフォルトのルート設定を無効にします。

- type: interface name: nic4 use_dhcp: false defroute: false

6.1.6.2. 基本オーバークラウドのネットワーク環境のテンプレート

/home/stack/templates/network-environment.yaml で保存した下記のネットワーク環境ファイルを使用します。

resource_registry:

OS::TripleO::BlockStorage::Net::SoftwareConfig: /home/stack/templates/nic-configs/cinder-storage.yaml

OS::TripleO::Compute::Net::SoftwareConfig: /home/stack/templates/nic-configs/compute.yaml

OS::TripleO::Controller::Net::SoftwareConfig: /home/stack/templates/nic-configs/controller.yaml

OS::TripleO::ObjectStorage::Net::SoftwareConfig: /home/stack/templates/nic-configs/swift-storage.yaml

OS::TripleO::CephStorage::Net::SoftwareConfig: /home/stack/templates/nic-configs/ceph-storage.yaml

parameter_defaults:

ExternalNetCidr: 10.1.1.0/24

ExternalAllocationPools: [{'start': '10.1.1.2', 'end': '10.1.1.50'}]

ExternalNetworkVlanID: 100

# Set to the router gateway on the external network

ExternalInterfaceDefaultRoute: 10.1.1.1

# Gateway router for the provisioning network (or Undercloud IP)

ControlPlaneDefaultRoute: 192.0.2.254

# The IP address of the EC2 metadata server. Generally the IP of the Undercloud

EC2MetadataIp: 192.0.2.1

# Define the DNS servers (maximum 2) for the overcloud nodes

DnsServers: ["8.8.8.8","8.8.4.4"]

# Set to "br-ex" if using floating IPs on native VLAN on bridge br-ex

NeutronExternalNetworkBridge: "''"

resource_registry セクションには、各ノードロールのネットワークインターフェーステンプレートへのリンクが含まれます。ExternalAllocationPools パラメーターは狭い範囲の IP アドレスしか定義しません。これは、別の範囲の IP アドレスを後ほど定義できるようにするためです。

parameter_defaults セクションには、各ネットワーク種別のネットワークオプションを定義するパラメーター一覧が含まれます。これらのオプションについての詳しい参考情報は「付録G ネットワーク環境のオプション」を参照してください。

重要

6.1.7. 基本オーバークラウドの作成

注記

$ openstack overcloud deploy --templates -e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml -e /home/stack/templates/network-environment.yaml -e /home/stack/templates/storage-environment.yaml --control-flavor control --compute-flavor compute --ntp-server pool.ntp.org --neutron-network-type vxlan --neutron-tunnel-types vxlan

--templates:/usr/share/openstack-tripleo-heat-templatesにある Heat テンプレートコレクションを使用してオーバークラウドを作成します。-e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml:-eオプションはオーバークラウドプランに別の環境ファイルを追加します。この場合、これはネットワーク分離の設定を初期化する環境ファイルです。-e /home/stack/templates/network-environment.yaml:-eオプションはオーバークラウドプランに別の環境ファイルを追加します。この場合は 「基本オーバークラウドのネットワーク環境のテンプレート」 で作成したネットワーク環境ファイルです。-e /home/stack/templates/storage-environment.yaml:-eのオプションにより、オーバークラウドプランに環境ファイルが追加されます。上記の例では、「NFS ストレージの設定」で作成したストレージの環境ファイルを指定しています。--control-flavor control: 対象のコントローラーノードに特定のフレーバーを使用します。--compute-flavor compute: 対象のコンピュートノードに特定のフレーバーを使用します。--ntp-server pool.ntp.org: 時刻の同期に NTP サーバーを使用します。これは、コントローラーノードクラスターの同期を保つ際に便利です。--neutron-network-type vxlan: オーバークラウドの Neutron ネットワークに Virtual Extensible LAN (VXLAN) を使用します。--neutron-tunnel-types vxlan: オーバークラウドの Neutron トンネリングに Virtual Extensible LAN (VXLAN) を使用します。

注記

$ openstack help overcloud deploy

stack ユーザーとして別のターミナルを開き、以下を実行します。

$ source ~/stackrc # Initializes the stack user to use the CLI commands $ heat stack-list --show-nested

heat stack-list --show-nested コマンドは、オーバークラウド作成の現在のステージを表示します。

警告

-e オプションを使用してオーバークラウドに追加した環境ファイルはいずれも、オーバークラウドのスタック定義の一部となります。director は、「7章オーバークラウド作成後のタスクの実行」に記載の再デプロイおよびデプロイ後の機能にこれらの環境ファイルを必要とします。これらのファイルが含まれていない場合には、オーバークラウドが破損することになる場合があります。

openstack overcloud deploy のコマンドを再度実行します。オーバークラウドを手動で編集しても、director を使用してオーバークラウドスタックの更新を行う際に director の設定で上書きされてしまうので、設定は直接編集しないでください。

警告

openstack overcloud deploy を実行しないでください。バックグラウンドのプロセスとして開始された場合にはオーバークラウドの作成は途中で停止してしまう可能性があります。

6.1.8. 基本オーバークラウドへのアクセス

overcloudrc) を stack ユーザーのホームディレクトリーに保存します。このファイルを使用するには以下のコマンドを実行します。

$ source ~/overcloudrc

$ source ~/stackrc

6.1.9. 基本オーバークラウドの完了

6.2. 高度なシナリオ: Ceph Storage ノードを使用する大型のオーバークラウドの作成

- 高可用性のコントローラーノード x 3

- コンピュートノード x 3

- クラスター内の Red Hat Ceph Storage ノード x 3

ワークフロー

- ノード定義のテンプレートを作成して director で空のノードを登録します。

- 全ノードのハードウェアおよびベンチマークを検証します。

- Automated Health Check (AHC) ツールを使用して自動的にノードをロールにタグ付けするポリシーを定義します。

- フレーバーを作成してロールにタグ付けします。

- 環境ファイルを使用して、Ceph Storage を設定します。

- Heat テンプレートを作成して全ネットワークを分離します。

- デフォルトの Heat テンプレートコレクションと追加のネットワーク分離テンプレートを使用してオーバークラウド環境を作成します。

- 高可用性クラスター内の各コントローラーノードに関するフェンシング情報を追加します。

要件

- 「3章アンダークラウドのインストール」で作成した director ノード

- ベアメタルマシン 9 台。これらのマシンは、コントローラーノード、コンピュートノード、Ceph Storage ノードに設定された要件に準拠する必要があります。要件については以下を参照してください。director により Red Hat Enterprise Linux 7 のイメージが各ノードにコピーされるため、これらのノードではオペレーティングシステムは必要ありません。

- ネイティブ VLAN として設定したプロビジョニングネットワーク用のネットワーク接続 1 つ。全ノードは、このネイティブに接続して、「ネットワーク要件」で設定した要件に準拠する必要があります。この例では、以下の IP アドレスの割り当てで、プロビジョニングサブネットとして 192.0.2.0/24 を使用します。

表6.3 プロビジョニングネットワークの IP 割り当て

ノード名IP アドレスMAC アドレスIPMI IP アドレスdirector192.0.2.1aa:aa:aa:aa:aa:aaコントローラー 1定義済みの DHCPb1:b1:b1:b1:b1:b1192.0.2.205コントローラー 2定義済みの DHCPb2:b2:b2:b2:b2:b2192.0.2.206コントローラー 3定義済みの DHCPb3:b3:b3:b3:b3:b3192.0.2.207コンピュート 1定義済みの DHCPc1:c1:c1:c1:c1:c1192.0.2.208コンピュート 2定義済みの DHCPc2:c2:c2:c2:c2:c2192.0.2.209コンピュート 3定義済みの DHCPc3:c3:c3:c3:c3:c3192.0.2.210Ceph 1定義済みの DHCPd1:d1:d1:d1:d1:d1192.0.2.211Ceph 2定義済みの DHCPd2:d2:d2:d2:d2:d2192.0.2.212Ceph 3定義済みの DHCPd3:d3:d3:d3:d3:d3192.0.2.213 - 各オーバークラウドノードは、タグ付けられた VLAN でネットワークを提供するために、ボンディング内の残りのネットワークインターフェース 2 つを使用します。以下のネットワーク割り当ては、このボンディングに適用されます。

表6.4 ネットワークサブネットおよび VLAN 割り当て

ネットワーク種別サブネットVLAN内部 API172.16.0.0/24201テナント172.17.0.0/24202ストレージ172.18.0.0/24203ストレージ管理172.19.0.0/24204外部 / Floating IP10.1.1.0/24100

6.2.1. 高度なオーバークラウドのノード登録

instackenv.json) は JSON ファイル形式で、9 つのノードのハードウェアおよび電源管理の詳細が含まれます。

- mac

- ノード上のネットワークインターフェースの MAC アドレス一覧。各システムのプロビジョニング NIC の MAC アドレスのみを使用します。

- pm_type

- 使用する電源管理ドライバー。この例では IPMI ドライバーを使用します (

pxe_ipmitool)。 - pm_user, pm_password

- IPMI のユーザー名およびパスワード

- pm_addr

- IPMI デバイスの IP アドレス

- cpu

- ノード上の CPU 数

- memory

- メモリーサイズ (MB)

- disk

- ハードディスクのサイズ (GB)

- arch

- システムアーキテクチャー

{

"nodes":[

{

"mac":[

"b1:b1:b1:b1:b1:b1"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.205"

},

{

"mac":[

"b2:b2:b2:b2:b2:b2"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.206"

},

{

"mac":[

"b3:b3:b3:b3:b3:b3"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.207"

},

{

"mac":[

"c1:c1:c1:c1:c1:c1"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.208"

},

{

"mac":[

"c2:c2:c2:c2:c2:c2"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.209"

},

{

"mac":[

"c3:c3:c3:c3:c3:c3"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.210"

},

{

"mac":[

"d1:d1:d1:d1:d1:d1"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.211"

},

{

"mac":[

"d2:d2:d2:d2:d2:d2"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.212"

},

{

"mac":[

"d3:d3:d3:d3:d3:d3"

],

"cpu":"4",

"memory":"6144",

"disk":"40",

"arch":"x86_64",

"pm_type":"pxe_ipmitool",

"pm_user":"admin",

"pm_password":"p@55w0rd!",

"pm_addr":"192.0.2.213"

}

]

}

注記

stack ユーザーのホームディレクトリー (instackenv.json) にファイルを保存してから、director にインポートします。これには、以下のコマンドを実行します。

$ openstack baremetal import --json ~/instackenv.json

$ openstack baremetal configure boot

$ openstack baremetal list

6.2.2. ノードのハードウェアの検証

重要

discovery_runbench オプションを true に設定する必要があります (「director の設定」 を参照)。

/httpboot/discoverd.ipxe を編集して RUNBENCH カーネルパラメーターを 1 に設定します。

$ openstack baremetal introspection bulk start

$ sudo journalctl -l -u openstack-ironic-discoverd -u openstack-ironic-discoverd-dnsmasq -u openstack-ironic-conductor -f

重要

$ ironic node-set-maintenance [NODE UUID] true $ openstack baremetal introspection start [NODE UUID] $ ironic node-set-maintenance [NODE UUID] false

6.2.3. Automated Health Check (AHC) ツールを使用したノードの自動タグ付け

$ sudo yum install -y ahc-tools

ahc-report: ベンチマークテストからのレポートを提供します。ahc-match: ポリシーに応じて、ノードを特定のロールにタグ付けします。

重要

/etc/ahc-tools/ahc-tools.conf ファイルで設定した Ironic と Swift の認証情報が必要になります。認証情報は、/etc/ironic-discoverd/discoverd.conf と同じです。以下のコマンドを使用して、設定ファイルをコピーして /etc/ahc-tools/ahc-tools.conf にカスタマイズします。

$ sudo -i # mkdir /etc/ahc-tools # sed 's/\[discoverd/\[ironic/' /etc/ironic-discoverd/discoverd.conf > /etc/ahc-tools/ahc-tools.conf # chmod 0600 /etc/ahc-tools/ahc-tools.conf # exit

6.2.3.1. ahc-report

ahc-report のスクリプトは、ノードに関するさまざまなレポートを作成します。完全なレポートを表示するには --full オプションを使用します。

$ sudo ahc-report --full

ahc-report コマンドは、レポートの特定の場所にフォーカスすることも可能です。たとえば、--categories を使用して、ハードウェア別にノードを分類することができます (プロセッサー、ネットワークインターフェース、ファームウェア、メモリー、さまざまなハードウェアコントローラー)。またこのコマンドは、同様のハードウェアプロファイルのノードをグループ化します。たとえば、2 つのサンプルノードの Processors セクションは以下のような一覧になります。

###################### ##### Processors ##### 2 identical systems : [u'7F8831F1-0D81-464E-A767-7577DF49AAA5', u'7884BC95-6EF8-4447-BDE5-D19561718B29'] [(u'cpu', u'logical', u'number', u'4'), (u'cpu', u'physical', u'number', u'4'), (u'cpu', u'physical_0', u'flags', u'fpu fpu_exception wp de pse tsc msr pae mce cx8 apic sep mtrr pge mca cmov pse36 clflush mmx fxsr sse sse2 syscall nx x86-64 rep_good nopl pni cx16 hypervisor lahf_lm'), (u'cpu', u'physical_0', u'frequency', u'2000000000'), (u'cpu', u'physical_0', u'physid', u'0'), (u'cpu', u'physical_0', u'product', u'Intel(R) Xeon(TM) CPU E3-1271v3 @ 3.6GHz'), (u'cpu', u'physical_0', u'vendor', u'GenuineIntel'), (u'cpu', u'physical_1', u'flags', u'fpu fpu_exception wp de pse tsc msr pae mce cx8 apic sep mtrr pge mca cmov pse36 clflush mmx fxsr sse sse2 syscall nx x86-64 rep_good nopl pni cx16 hypervisor lahf_lm'), (u'cpu', u'physical_0', u'frequency', u'2000000000'), (u'cpu', u'physical_0', u'physid', u'0'), (u'cpu', u'physical_0', u'product', u'Intel(R) Xeon(TM) CPU E3-1271v3 @ 3.6GHz'), (u'cpu', u'physical_0', u'vendor', u'GenuineIntel') ... ]

ahc-report ツールもノードコレクションの外れ値を特定します。--outliers スイッチを使用して、この機能を有効化します。

$ sudo ahc-report --outliers Group 0 : Checking logical disks perf standalone_randread_4k_KBps : INFO : sda : Group performance : min=45296.00, mean=53604.67, max=67923.00, stddev=12453.21 standalone_randread_4k_KBps : ERROR : sda : Group's variance is too important : 23.23% of 53604.67 whereas limit is set to 15.00% standalone_randread_4k_KBps : ERROR : sda : Group performance : UNSTABLE standalone_read_1M_IOps : INFO : sda : Group performance : min= 1199.00, mean= 1259.00, max= 1357.00, stddev= 85.58 standalone_read_1M_IOps : INFO : sda : Group performance = 1259.00 : CONSISTENT standalone_randread_4k_IOps : INFO : sda : Group performance : min=11320.00, mean=13397.33, max=16977.00, stddev= 3113.39 standalone_randread_4k_IOps : ERROR : sda : Group's variance is too important : 23.24% of 13397.33 whereas limit is set to 15.00% standalone_randread_4k_IOps : ERROR : sda : Group performance : UNSTABLE standalone_read_1M_KBps : INFO : sda : Group performance : min=1231155.00, mean=1292799.67, max=1393152.00, stddev=87661.11 standalone_read_1M_KBps : INFO : sda : Group performance = 1292799.67 : CONSISTENT ...

ahc-report は、全ノードの標準偏差が許容可能な閾値よりも高いため、standalone_randread_4k_KBps および standalone_randread_4k_IOps のディスクメトリックを不安定としてマークしました。この例では、2 つのノードのディスク転送速度が大きく違う場合に、このような結果になる可能性があります。

ahc-match コマンドを使用してノードに特定のロールを割り当てます。

6.2.3.2. ahc-match

ahc-match コマンドは、ノードを特定のロールに割り当てられるように、オーバークラウドプランにポリシーセットを適用します。このコマンドを使用する前に、適切なノードとロールを照合するポリシーセットを作成します。

ahc-tools パッケージは、/etc/ahc-tools/edeploy に、以下のような一連のポリシーファイルをインストールします。

state: 各ロールのノード数を記載する状態ファイルcompute.specs、control.specs: コンピュートノードとコントローラーノードを照合するポリシーファイルcompute.cmdb.sampleおよびcontrol.cmdb.sample: Sample Configuration Management Database (CMDB) ファイル。RAID および BIOS の ready-state 設定 (Dell DRAC のみ) のためのキー/値の設定値が含まれます。

状態ファイル

state ファイルは、各ロールのノード数を指定します。デフォルトの設定ファイルは以下のとおりです。

[('control', '1'), ('compute', '*')]

ahc-match により 1 つのコントローラーノードと任意数のコンピュートノードが割り当てられます。このシナリオでは、このファイルを以下のように編集します。

[('control', '3'), ('ceph-storage', '3'), ('compute', '*')]

ポリシーファイル

compute.specs および control.specs ファイルは、対象ロールごとに割り当てルールを一覧表示します。ファイルの内容は、以下の例のようなタプル形式です。

[

('cpu', 'logical', 'number', 'ge(2)'),

('disk', '$disk', 'size', 'gt(4)'),

('network', '$eth', 'ipv4', 'network(192.0.2.0/24)'),

('memory', 'total', 'size', 'ge(4294967296)'),

]

network(): 指定のネットワーク内にあるネットワークインターフェースgt()、ge(): 指定値以上lt()、le(): 指定値以下in(): 照合するアイテムは指定のセットに含まれる必要があります。regexp(): 正規表現に一致するものor()、and()、not(): Boolean 関数。or()、and()に指定可能なパラメーターは 2 つ、not()のパラメーターは 1 つです。

standalone_randread_4k_KBps と standalone_randread_4k_IOps の値を使用して、平均よりもディスクアクセス速度が早いノードだけにコントローラーロールを制限します。各値のルールは、以下のとおりです。

[

('disk', '$disk', 'standalone_randread_4k_KBps', 'gt(53604)'),

('disk', '$disk', 'standalone_randread_4k_IOps', 'gt(13397)')

]

ceph-storage.spec プロファイルを作成します。これらのファイル名 (拡張子なし) は state ファイルに含まれるようにします。

ready-state のファイル (Dell DRAC のみ)

bios_settings キーの各設定とターゲット値を定義する JSON タプルを定義します。以下に例を示します。

[

{

'bios_settings': {'ProcVirtualization': 'Enabled', 'ProcCores': 4}

}

]

- 物理ディスク ID を一覧表示する方法:

controller、size_gb、raid_level、physical_disksの属性を使用して物理ディスク ID の一覧を指定します。controllerには、DRAC によって割り当てられる RAID コントローラーの FQDD を指定する必要があります。同様に、physical_disksの一覧には、DRAC カードによって割り当てられる物理ディスクの FQDD の一覧を指定する必要があります。[ { 'logical_disks': [ {'controller': 'RAID.Integrated.1-1', 'size_gb': 100, 'physical_disks': [ 'Disk.Bay.0:Enclosure.Internal.0-1:RAID.Integrated.1-1', 'Disk.Bay.1:Enclosure.Internal.0-1:RAID.Integrated.1-1', 'Disk.Bay.2:Enclosure.Internal.0-1:RAID.Integrated.1-1'], 'raid_level': '5'}, ] } ] - Ironic により物理ディスクを RAID ボリュームに割り当てる方法:

controller、size_gb、raid_level、number_of_physical_disksの属性が必要となります。controllerには、DRAC カードによって割り当てられる RAID コントローラーの FQDD を指定する必要があります。[ { 'logical_disks': [ {'controller': 'RAID.Integrated.1-1', 'size_gb': 50, 'raid_level': '1', 'number_of_physical_disks': 2}, ] } ]

照合ツールの実行

ahc-match ツールを実行してノードを割り当てます。

$ sudo ahc-match

/etc/ahc-tools/edeploy/state に定義したロールと照合します。ノードがロールに一致する場合は、ahc-match により、Ironic でノードにロールが 1 つのケイパビリティーとして追加されます。

$ ironic node-show b73fb5fa-1a2c-49c6-b38e-8de41e3c0532 | grep properties -A2

| properties | {u'memory_mb': u'6144', u'cpu_arch': u'x86_64', u'local_gb': u'40', |

| | u'cpus': u'4', u'capabilities': u'profile:control,boot_option:local'} |

| instance_uuid | None |

profile タグを使用して、同じタグを持つロールとフレーバーを照合します。

$ instack-ironic-deployment --configure-nodes

6.2.4. ハードウェアプロファイルの作成

$ openstack flavor create --id auto --ram 6144 --disk 40 --vcpus 4 control $ openstack flavor create --id auto --ram 6144 --disk 40 --vcpus 4 compute $ openstack flavor create --id auto --ram 6144 --disk 40 --vcpus 4 ceph-storage

重要

$ openstack flavor set --property "cpu_arch"="x86_64" --property "capabilities:boot_option"="local" --property "capabilities:profile"="compute" compute $ openstack flavor set --property "cpu_arch"="x86_64" --property "capabilities:boot_option"="local" --property "capabilities:profile"="control" control $ openstack flavor set --property "cpu_arch"="x86_64" --property "capabilities:boot_option"="local" --property "capabilities:profile"="ceph-storage" ceph-storage

capabilities:boot_option はフレーバーのブートモードを設定し、capabilities:profile は使用するプロファイルを定義します。

重要

baremetal というデフォルトのフレーバーが必要です。このフレーバーがない場合には作成します。

$ openstack flavor create --id auto --ram 4096 --disk 40 --vcpus 1 baremetal

6.2.5. Ceph Storage の設定

storage-environment.yaml 環境ファイルを stack ユーザーの templates ディレクトリーにコピーしてください。

$ cp /usr/share/openstack-tripleo-heat-templates/environments/storage-environment.yaml ~/templates/.

storage-environment.yaml のコピーで、以下のオプションを修正します。

- CinderEnableIscsiBackend

- iSCSI バックエンドを有効にするパラメーター。

falseに設定してください。 - CinderEnableRbdBackend

- Ceph Storage バックエンドを有効にするパラメーター。

trueに設定してください。 - CinderEnableNfsBackend

- NFS バックエンドを有効にするパラメーター。

falseに設定してください。 - NovaEnableRbdBackend

- Nova エフェメラルストレージ用に Ceph Storage を有効にするパラメーター。

trueに設定します。 - GlanceBackend

- Glance で使用するバックエンドを定義します。イメージに Ceph Storage を使用するには、

rbdに設定します。

注記

storage-environment.yaml には、Heat を直接使用して Ceph Storage を設定するためのオプションも含まれています。ただし、director はこれらのノードを作成して、このシナリオでは、自動的に設定値を定義するので、これらのオプションは必要ありません。

parameter_defaults:

ExtraConfig:

ceph::profile::params::osds:

ceph::profile::params::osds パラメーターを使用して、関連するジャーナルのパーティションとディスクをマッピングします。たとえば、ディスクが 4 つある Ceph ノードは、以下のように割り当てることができます。

/dev/sda: オーバークラウドのイメージを含む root ディスク/dev/sdb: ディスクにはジャーナルのパーティションが含まれます。これは通常、システムパフォーマンスの向上に役立つソリッドステートドライブ (SSD) です。/dev/sdcおよび/dev/sdd: OSD ディスク

ceph::profile::params::osds:

'/dev/sdc':

journal: '/dev/sdb'

'/dev/sdd':

journal: '/dev/sdb'

journal パラメーターには空の値を渡します。

ceph::profile::params::osds:

'/dev/sdb': {}

'/dev/sdc': {}

'/dev/sdd': {}

storage-environment.yaml ファイルのオプションは、以下の例のように設定されるはずです。

parameters:

CinderEnableIscsiBackend: false

CinderEnableRbdBackend: true

CinderEnableNfsBackend: false

NovaEnableRbdBackend: true

parameter_defaults:

ExtraConfig:

ceph::profile::params::osds:

'/dev/sdc':

journal: '/dev/sdb'

'/dev/sdd':

journal: '/dev/sdb'

storage-environment.yaml を保存して、オーバークラウドのデプロイ時に Ceph Storage ノードにディスクマッピングとカスタム設定が使用されるようにします。また、デプロイメント内にこのファイルを追加して、ストレージに必要な設定が開始されるようにします。

重要

# parted [device] mklabel gpt

6.2.6. VLAN への全ネットワークの分離

- ネットワーク 1: プロビジョニング

- ネットワーク 2: 内部 API

- ネットワーク 3: テナントネットワーク

- ネットワーク 4: ストレージ

- ネットワーク 5: ストレージ管理

- ネットワーク 6: 外部、Floating IP (オーバークラウドの作成後にマッピング)

6.2.6.1. カスタムのインターフェーステンプレートの作成

/usr/share/openstack-tripleo-heat-templates/network/config/single-nic-vlans: このディレクトリーには、ロールごとに VLAN が設定された単一 NIC のテンプレートが含まれます。/usr/share/openstack-tripleo-heat-templates/network/config/bond-with-vlans: このディレクトリーには、ロール別のボンディング NIC 設定のテンプレートが含まれます。

/usr/share/openstack-tripleo-heat-templates/network/config/bond-with-vlans にあるバージョンをコピーします。

$ cp -r /usr/share/openstack-tripleo-heat-templates/network/config/bond-with-vlans ~/templates/nic-configs

parameters、resources、output が含まれます。今回のシナリオでは、resources セクションのみを編集します。各 resources セクションは、以下のように開始されます。

resources:

OsNetConfigImpl:

type: OS::Heat::StructuredConfig

properties:

group: os-apply-config

config:

os_net_config:

network_config:

os-apply-config コマンドと os-net-config サブコマンドがノードのネットワークプロパティーを設定するように要求が作成されます。network_config セクションには、種別順に並べられたカスタムのインターフェース設定が含まれます。これらの種別には以下が含まれます。

- interface

- 単一のネットワークインターフェースを定義します。この設定では、実際のインターフェース名 (eth0、eth1、enp0s25) または番号付きのインターフェース (nic1、nic2、nic3) を使用して各インターフェースを定義します。

- type: interface name: nic2 - vlan

- VLAN を定義します。

parametersセクションから渡された VLAN ID およびサブネットを使用します。- type: vlan vlan_id: {get_param: ExternalNetworkVlanID} addresses: - ip_netmask: {get_param: ExternalIpSubnet} - ovs_bond

- Open vSwitch のボンディングを定義します。ボンディングでは、2 つ以上の

interfacesを結合して、冗長性や帯域幅を向上させます。- type: ovs_bond name: bond1 members: - type: interface name: nic2 - type: interface name: nic3 - ovs_bridge

- Open vSwitch のブリッジを定義します。ブリッジは、複数の

interface、bond、vlanオブジェクトを接続します。- type: ovs_bridge name: {get_input: bridge_name} members: - type: ovs_bond name: bond1 members: - type: interface name: nic2 primary: true - type: interface name: nic3 - type: vlan device: bond1 vlan_id: {get_param: ExternalNetworkVlanID} addresses: - ip_netmask: {get_param: ExternalIpSubnet} - linux_bridge

- Linux ブリッジを定義します。Open vSwitch ブリッジと同様に、このブリッジは、複数の

interface、bond、vlanオブジェクトを接続します。- type: linux_bridge name: bridge1 members: - type: interface name: nic1 primary: true - type: vlan device: bridge1 vlan_id: {get_param: ExternalNetworkVlanID} addresses: - ip_netmask: {get_param: ExternalIpSubnet}

/home/stack/templates/nic-configs/controller.yaml テンプレートは以下の network_config を使用します。

network_config:

- type: interface

name: nic1

use_dhcp: false

addresses:

- ip_netmask:

list_join:

- '/'

- - {get_param: ControlPlaneIp}

- {get_param: ControlPlaneSubnetCidr}

routes:

- ip_netmask: 169.254.169.254/32

next_hop: {get_param: EC2MetadataIp}

- type: ovs_bridge

name: {get_input: bridge_name}

dns_servers: {get_param: DnsServers}

members:

- type: ovs_bond

name: bond1

ovs_options: {get_param: BondInterfaceOvsOptions}

members:

- type: interface

name: nic2

primary: true

- type: interface

name: nic3

- type: vlan

device: bond1

vlan_id: {get_param: ExternalNetworkVlanID}

addresses:

- ip_netmask: {get_param: ExternalIpSubnet}

routes:

- ip_netmask: 0.0.0.0/0

next_hop: {get_param: ExternalInterfaceDefaultRoute}

- type: vlan

device: bond1

vlan_id: {get_param: InternalApiNetworkVlanID}

addresses:

- ip_netmask: {get_param: InternalApiIpSubnet}

- type: vlan

device: bond1

vlan_id: {get_param: StorageNetworkVlanID}

addresses:

- ip_netmask: {get_param: StorageIpSubnet}

- type: vlan

device: bond1

vlan_id: {get_param: StorageMgmtNetworkVlanID}

addresses:

- ip_netmask: {get_param: StorageMgmtIpSubnet}

- type: vlan

device: bond1

vlan_id: {get_param: TenantNetworkVlanID}

addresses:

- ip_netmask: {get_param: TenantIpSubnet}

br-ex という名前の外部ブリッジ) を定義し、nic2 と nic3 の 2 つの番号付きインターフェースから、bond1 と呼ばれるボンディングインターフェースを作成します。ブリッジにはタグ付けされた VLAN デバイスの番号が含まれており、bond1 を親デバイスとして使用します。

get_param 関数を使用する点に注意してください。これらのパラメーターは、使用するネットワーク専用に作成した環境ファイルで定義します。

重要

nic4) が含まれる可能性があり、このインターフェースは OpenStack のサービス用の IP 割り当てを使用しませんが、DHCP やデフォルトルートを使用します。ネットワークの競合を回避するには、使用済みのインターフェースを ovs_bridge デバイスから削除し、DHCP とデフォルトのルート設定を無効にします。

- type: interface name: nic4 use_dhcp: false defroute: false

6.2.6.2. 高度なオーバークラウドのネットワーク環境ファイルの作成

/home/stack/templates/network-environment.yaml で保存した下記のネットワーク環境ファイルを使用します。

resource_registry:

OS::TripleO::BlockStorage::Net::SoftwareConfig: /home/stack/templates/nic-configs/cinder-storage.yaml

OS::TripleO::Compute::Net::SoftwareConfig: /home/stack/templates/nic-configs/compute.yaml

OS::TripleO::Controller::Net::SoftwareConfig: /home/stack/templates/nic-configs/controller.yaml

OS::TripleO::ObjectStorage::Net::SoftwareConfig: /home/stack/templates/nic-configs/swift-storage.yaml

OS::TripleO::CephStorage::Net::SoftwareConfig: /home/stack/templates/nic-configs/ceph-storage.yaml

parameter_defaults:

InternalApiNetCidr: 172.16.0.0/24

TenantNetCidr: 172.17.0.0/24

StorageNetCidr: 172.18.0.0/24

StorageMgmtNetCidr: 172.19.0.0/24

ExternalNetCidr: 10.1.1.0/24

InternalApiAllocationPools: [{'start': '172.16.0.10', 'end': '172.16.0.200'}]

TenantAllocationPools: [{'start': '172.17.0.10', 'end': '172.17.0.200'}]

StorageAllocationPools: [{'start': '172.18.0.10', 'end': '172.18.0.200'}]

StorageMgmtAllocationPools: [{'start': '172.19.0.10', 'end': '172.19.0.200'}]

# Leave room for floating IPs in the External allocation pool

ExternalAllocationPools: [{'start': '10.1.1.10', 'end': '10.1.1.50'}]

# Set to the router gateway on the external network

ExternalInterfaceDefaultRoute: 10.1.1.1

# Gateway router for the provisioning network (or Undercloud IP)

ControlPlaneDefaultRoute: 192.0.2.254

# The IP address of the EC2 metadata server. Generally the IP of the Undercloud

EC2MetadataIp: 192.0.2.1

# Define the DNS servers (maximum 2) for the overcloud nodes

DnsServers: ["8.8.8.8","8.8.4.4"]

InternalApiNetworkVlanID: 201

StorageNetworkVlanID: 202

StorageMgmtNetworkVlanID: 203

TenantNetworkVlanID: 204

ExternalNetworkVlanID: 100

# Set to "br-ex" if using floating IPs on native VLAN on bridge br-ex

NeutronExternalNetworkBridge: "''"

# Customize bonding options if required

BondInterfaceOvsOptions:

"bond_mode=balance-slb"

resource_registry セクションには、各ノードロールのネットワークインターフェーステンプレートへのリンクが含まれます。

parameter_defaults セクションには、各ネットワーク種別のネットワークオプションを定義するパラメーター一覧が含まれます。これらのオプションについての詳しい参考情報は「付録G ネットワーク環境のオプション」を参照してください。

BondInterfaceOvsOptions オプションは、nic2 および nic3 を使用するボンディングインターフェースのオプションを提供します。ボンディングオプションについての詳しい情報は、「付録H ボンディングオプション」を参照してください。

重要

6.2.6.3. OpenStack サービスの分離ネットワークへの割り当て

/home/stack/templates/network-environment.yaml) で新たにネットワークマッピングを定義することで、OpenStack サービスを異なるネットワーク種別に再割り当てすることができます。ServiceNetMap パラメーターにより、各サービスに使用するネットワーク種別が決定されます。

...

parameter_defaults:

ServiceNetMap:

NeutronTenantNetwork: tenant

CeilometerApiNetwork: internal_api

MongoDbNetwork: internal_api

CinderApiNetwork: internal_api

CinderIscsiNetwork: storage

GlanceApiNetwork: storage

GlanceRegistryNetwork: internal_api

KeystoneAdminApiNetwork: internal_api

KeystonePublicApiNetwork: internal_api

NeutronApiNetwork: internal_api

HeatApiNetwork: internal_api

NovaApiNetwork: internal_api

NovaMetadataNetwork: internal_api

NovaVncProxyNetwork: internal_api

SwiftMgmtNetwork: storage_mgmt

SwiftProxyNetwork: storage

HorizonNetwork: internal_api

MemcachedNetwork: internal_api

RabbitMqNetwork: internal_api

RedisNetwork: internal_api

MysqlNetwork: internal_api

CephClusterNetwork: storage_mgmt

CephPublicNetwork: storage

# Define which network will be used for hostname resolution

ControllerHostnameResolveNetwork: internal_api

ComputeHostnameResolveNetwork: internal_api

BlockStorageHostnameResolveNetwork: internal_api

ObjectStorageHostnameResolveNetwork: internal_api

CephStorageHostnameResolveNetwork: storage

storage に変更すると、対象のサービスがストレージ管理ネットワークではなく、ストレージネットワークに割り当てられます。つまり、ストレージ管理ネットワークではなくストレージネットワークに parameter_defaults セットを定義するだけで結構です。

6.2.7. オーバークラウドの SSL/TLS の有効化

SSL/TLS の有効化

enable-tls.yaml の環境ファイルをコピーします。

$ cp -r /usr/share/openstack-tripleo-heat-templates/environments/enable-tls.yaml ~/templates/.

parameter_defaults:

- SSLCertificate:

- 証明書ファイルのコンテンツを

SSLCertificateパラメーターにコピーします。以下に例を示します。parameter_defaults: SSLCertificate: | -----BEGIN CERTIFICATE----- MIIDgzCCAmugAwIBAgIJAKk46qw6ncJaMA0GCSqGSIb3DQEBCwUAMFgxCzAJBgNV ... sFW3S2roS4X0Af/kSSD8mlBBTFTCMBAj6rtLBKLaQbIxEpIzrgvp -----END CERTIFICATE-----重要

この認証局のコンテンツで、新しく追加する行は、すべて同じレベルにインデントする必要があります。 - SSLKey:

- 以下のように、秘密鍵の内容を

SSLKeyパラメーターにコピーします。parameter_defaults: ... SSLKey: | -----BEGIN RSA PRIVATE KEY----- MIIEowIBAAKCAQEAqVw8lnQ9RbeI1EdLN5PJP0lVO9hkJZnGP6qb6wtYUoy1bVP7 ... ctlKn3rAAdyumi4JDjESAXHIKFjJNOLrBmpQyES4XpZUC7yhqPaU -----END RSA PRIVATE KEY-----重要

この秘密鍵のコンテンツにおいて、新しく追加する行はすべて同じ ID レベルに指定する必要があります。 - EndpointMap:

EndpointMapには、HTTPS および HTTP 通信を使用したサービスのマッピングが含まれます。SSL 通信に DNS を使用する場合は、このセクションをデフォルト設定のままにしておいてください。ただし、SSL 証明書の共通名に IP アドレスを使用する場合は (「付録B SSL/TLS 証明書の設定」参照)、CLOUDNAMEのインスタンスをすべてIP_ADDRESSに置き換えてください。これには以下のコマンドを使用してください。$ sed -i 's/CLOUDNAME/IP_ADDRESS/' ~/templates/enable-tls.yaml

重要

IP_ADDRESSまたはCLOUDNAMEは、実際の値に置き換えないでください。Heat により、オーバークラウドの作成時にこれらの変数が適切な値に置き換えられます。

resource_registry:

- OS::TripleO::NodeTLSData:

OS::TripleO::NodeTLSData:のリソース URL を絶対 URL に変更します。resource_registry: OS::TripleO::NodeTLSData: /usr/share/openstack-tripleo-heat-templates/puppet/extraconfig/tls/tls-cert-inject.yaml

ルート証明書の注入

inject-trust-anchor.yaml 環境ファイルをコピーします。

$ cp -r /usr/share/openstack-tripleo-heat-templates/environments/inject-trust-anchor.yaml ~/templates/.

parameter_defaults:

- SSLRootCertificate:

SSLRootCertificateパラメーターにルート認証局ファイルの内容をコピーします。以下に例を示します。parameter_defaults: SSLRootCertificate: | -----BEGIN CERTIFICATE----- MIIDgzCCAmugAwIBAgIJAKk46qw6ncJaMA0GCSqGSIb3DQEBCwUAMFgxCzAJBgNV ... sFW3S2roS4X0Af/kSSD8mlBBTFTCMBAj6rtLBKLaQbIxEpIzrgvp -----END CERTIFICATE-----重要

この認証局のコンテンツで、新しく追加する行は、すべて同じレベルにインデントする必要があります。

resource_registry:

- OS::TripleO::NodeTLSCAData:

OS::TripleO::NodeTLSCAData:のリソース URL を絶対 URL に変更します。resource_registry: OS::TripleO::NodeTLSCAData: /usr/share/openstack-tripleo-heat-templates/puppet/extraconfig/tls/ca-inject.yaml

DNS エンドポイントの設定

~/templates/cloudname.yaml) を作成して、オーバークラウドのエンドポイントのホスト名を定義します。以下のパラメーターを使用してください。

parameter_defaults:

- CloudName:

- オーバークラウドエンドポイントの DNS ホスト名

- DnsServers:

- 使用する DNS サーバー一覧。設定済みの DNS サーバーには、パブリック API の IP アドレスに一致する設定済みの

CloudNameへのエントリーが含まれていなければなりません。

parameter_defaults: CloudName: overcloud.example.com DnsServers: ["10.0.0.1"]

オーバークラウド作成時の環境ファイルの追加

openstack overcloud deploy) は、-e オプションを使用して環境ファイルを追加します。以下の順番にこのセクションから環境ファイルを追加します。

- SSL/TLS を有効化する環境ファイル (

enable-tls.yaml) - DNS ホスト名を設定する環境ファイル (

cloudname.yaml) - ルート認証局を注入する環境ファイル (

inject-trust-anchor.yaml)

$ openstack overcloud deploy --templates [...] -e /home/stack/templates/enable-tls.yaml -e ~/templates/cloudname.yaml -e ~/templates/inject-trust-anchor.yaml

6.2.8. オーバークラウドの登録

方法 1: コマンドライン

openstack overcloud deploy) は、一連のオプションを使用して登録情報を定義します。「付録I デプロイメントパラメーター」の表には、これらのオプションと説明についてまとめています。これらのオプションは、「高度なオーバークラウドの作成」でデプロイメントのコマンドを実行する時に追加してください。以下に例を示します。

# openstack overcloud deploy --templates --rhel-reg --reg-method satellite --reg-sat-url http://example.satellite.com --reg-org MyOrg --reg-activation-key MyKey --reg-force [...]

方法 2: 環境ファイル

$ cp -r /usr/share/openstack-tripleo-heat-templates/extraconfig/pre_deploy/rhel-registration ~/templates/.

~/templates/rhel-registration/environment-rhel-registration.yaml を編集し、登録の方法と詳細に応じて以下の値を変更します。

- rhel_reg_method

- 登録の方法を選択します。

portal、satellite、disableのいずれかです。 - rhel_reg_type

- 登録するユニットの種別。

systemとして登録するには空欄のままにします。 - rhel_reg_auto_attach

- 互換性のあるサブスクリプションをこのシステムに自動的にアタッチします。

trueに設定して有効にするか、falseに設定して無効にします。 - rhel_reg_service_level

- 自動アタッチメントに使用するサービスレベル

- rhel_reg_release

- このパラメーターを使用して、自動アタッチメント用のリリースバージョンを設定します。Red Hat Subscription Manager からのデフォルトを使用するには、空欄のままにします。

- rhel_reg_pool_id

- 使用するサブスクリプションプール ID。サブスクリプションを自動でアタッチしない場合に使用します。

- rhel_reg_sat_url

- オーバークラウドノードを登録する Satellite サーバーのベース URL。このパラメーターには、HTTPS URL ではなく、Satellite の HTTP URL を使用します。たとえば、

https://satellite.example.comではなくhttp://satellite.example.comを使用します。オーバークラウドの作成プロセスではこの URL を使用して、どのサーバーが Red Hat Satellite 5 または Red Hat Satellite 6 サーバーであるかを判断します。Red Hat Satellite 5 サーバーの場合は、オーバークラウドはkatello-ca-consumer-latest.noarch.rpmファイルを取得してsubscription-managerに登録し、katello-agentをインストールします。Red Hat Satellite 6 サーバーの場合はオーバークラウドはRHN-ORG-TRUSTED-SSL-CERTファイルを取得してrhnreg_ksに登録します。 - rhel_reg_server_url

- 使用するサブスクリプションサービスのホスト名を指定します。デフォルトは、カスタマーポータルのサブスクリプション管理、

subscription.rhn.redhat.comです。このオプションを使用しない場合、システムはカスタマーポータルのサブスクリプション管理に登録されます。サブスクリプションサーバーの URL は、https://hostname:port/prefixの形式を使用します。 - rhel_reg_base_url

- 更新を受信するためのコンテンツ配信サーバーのホスト名を指定します。デフォルトは

https://cdn.redhat.comです。Satellite 6 は独自のコンテンツをホストするため、URL は Satellite 6 で登録されているシステムに使用する必要があります。コンテンツのベース URL はhttps://hostname:port/prefixの形式を使用します。 - rhel_reg_org

- 登録に使用する組織

- rhel_reg_environment

- 選択した組織内で使用する環境

- rhel_reg_repos

- 有効化するリポジトリーのコンマ区切りリスト

- rhel_reg_activation_key

- 登録に使用するアクティベーションキー

- rhel_reg_user, rhel_reg_password

- 登録用のユーザー名およびパスワード。可能な場合には、登録用のアクティベーションキーを使用します。

- rhel_reg_machine_name

- マシン名。ノードのホスト名を使用するには、空欄のままにします。

- rhel_reg_force

- 登録のオプションを強制するには

trueに設定します (例:ノードの再登録時など)。

openstack overcloud deploy) は、-e オプションを使用して環境ファイルを追加します。~/templates/rhel-registration/environment-rhel-registration.yaml と ~/templates/rhel-registration/rhel-registration-resource-registry.yaml の両方を追加します。以下に例を示します。

$ openstack overcloud deploy --templates [...] -e /home/stack/templates/rhel-registration/environment-rhel-registration.yaml -e /home/stack/templates/rhel-registration/rhel-registration-resource-registry.yaml

重要

OS::TripleO::NodeExtraConfig Heat リソースにように設定されます。これは、このリソースを登録のみに使用できることを意味します。詳しくは、「オーバークラウドの設定前のカスタマイズ」を参照してください。

6.2.9. 高度なオーバークラウドの作成

注記

$ openstack overcloud deploy --templates -e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml -e ~/templates/network-environment.yaml -e ~/templates/storage-environment.yaml --control-scale 3 --compute-scale 3 --ceph-storage-scale 3 --control-flavor control --compute-flavor compute --ceph-storage-flavor ceph-storage --ntp-server pool.ntp.org --neutron-network-type vxlan --neutron-tunnel-types vxlan

--templates:/usr/share/openstack-tripleo-heat-templatesの Heat テンプレートコレクションを使用してオーバークラウドを作成します。-e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml:-eオプションは、オーバークラウドデプロイメントに別の環境ファイルを追加します。この場合は、ネットワーク分離の設定を初期化する環境ファイルです。-e ~/templates/network-environment.yaml:-eオプションはオーバークラウドデプロイメントに別の環境ファイルを追加します。この場合は、「高度なオーバークラウドのネットワーク環境ファイルの作成」で作成したネットワーク環境ファイルです。-e ~/templates/storage-environment.yaml:-eオプションはオーバークラウドデプロイメントに別の環境ファイルを追加します。この場合は、ストレージの設定を初期化する環境ファイルです。--control-scale 3: コントローラーノードを 3 つにスケーリングします。--compute-scale 3: コンピュートノードを 3 つにスケーリングします。--ceph-storage-scale 3: Ceph Storage ノードを 3 つにスケーリングします。--control-flavor control: 対象のコントローラーノードに特定のフレーバーを使用します。--compute-flavor compute: 対象のコンピュートノードに特定のフレーバーを使用します。--ceph-storage-flavor ceph-storage: Ceph Storage ノードに特定のフレーバーを使用します。--ntp-server pool.ntp.org: 時刻の同期に NTP サーバーを使用します。これは、コントローラーノードクラスターの同期を保つ際に便利です。--neutron-network-type vxlan: オーバークラウドの Neutron ネットワークに Virtual Extensible LAN (VXLAN) を使用します。--neutron-tunnel-types vxlan- オーバークラウドの Neutron トンネリングに Virtual Extensible LAN (VXLAN) を使用します。

注記

$ openstack help overcloud deploy

stack ユーザーとして別のターミナルを開き、以下を実行します。

$ source ~/stackrc # Initializes the stack user to use the CLI commands $ heat stack-list --show-nested

heat stack-list --show-nested コマンドは、オーバークラウド作成の現在のステージを表示します。

警告

-e オプションを使用してオーバークラウドに追加した環境ファイルはいずれも、オーバークラウドのスタック定義の一部となります。director は、「7章オーバークラウド作成後のタスクの実行」に記載の再デプロイおよびデプロイ後の機能にこれらの環境ファイルを必要とします。これらのファイルが含まれていない場合には、オーバークラウドが破損することになる場合があります。

openstack overcloud deploy のコマンドを再度実行します。オーバークラウドを手動で編集しても、director を使用してオーバークラウドスタックの更新を行う際に director の設定で上書きされてしまうので、設定は直接編集しないでください。

deploy-overcloud.sh という名前のスクリプトファイルでデプロイメントコマンドを保存するには、以下のように編集します。

#!/bin/bash openstack overcloud deploy --templates \ -e /usr/share/openstack-tripleo-heat-templates/environments/network-isolation.yaml \ -e ~/templates/network-environment.yaml \ -e ~/templates/storage-environment.yaml \ -t 150 \ --control-scale 3 \ --compute-scale 3 \ --ceph-storage-scale 3 \ --swift-storage-scale 0 \ --block-storage-scale 0 \ --compute-flavor compute \ --control-flavor control \ --ceph-storage-flavor ceph-storage \ --swift-storage-flavor swift-storage \ --block-storage-flavor block-storage \ --ntp-server pool.ntp.org \ --neutron-network-type vxlan \ --neutron-tunnel-types vxlan \ --libvirt-type qemu

警告

openstack overcloud deploy を実行しないでください。バックグラウンドのプロセスとして開始された場合にはオーバークラウドの作成は途中で停止してしまう可能性があります。

6.2.10. 高度なオーバークラウドへのアクセス

stack ユーザーのホームディレクトリーにこのファイル (overcloudrc) を保存します。このファイルを使用するには、以下のコマンドを実行します。

$ source ~/overcloudrc

$ source ~/stackrc

6.2.11. コンピュートノードのフェンシング

注記

stack ユーザーから、heat-admin ユーザーとして各ノードにログインします。オーバークラウドを作成すると自動的に stack ユーザーの SSH キーが各ノードの heat-admin にコピーされます。

pcs status を使用して、クラスターが実行していることを確認します。

$ sudo pcs status Cluster name: openstackHA Last updated: Wed Jun 24 12:40:27 2015 Last change: Wed Jun 24 11:36:18 2015 Stack: corosync Current DC: lb-c1a2 (2) - partition with quorum Version: 1.1.12-a14efad 3 Nodes configured 141 Resources configured

pcs property show で、STONITH が無効化されていることを確認します。

$ sudo pcs property show

Cluster Properties:

cluster-infrastructure: corosync

cluster-name: openstackHA

dc-version: 1.1.12-a14efad

have-watchdog: false

stonith-enabled: false表6.5 フェンスエージェント

|

デバイス

|

種別

|

|---|---|

fence_ipmilan

|

Intelligent Platform Management Interface (IPMI)

|

fence_idrac、fence_drac5

|

Dell Remote Access Controller (DRAC)

|

fence_ilo

|

Integrated Lights-Out (iLO)

|

fence_ucs

|

Cisco UCS: 詳しい情報は 「Configuring Cisco Unified Computing System (UCS) Fencing on an OpenStack High Availability Environment」 の記事を参照してください。

|

fence_xvm、fence_virt

|

Libvirt と SSH

|

fence_ipmilan) を例として使用します。

$ sudo pcs stonith describe fence_ipmilan

stonith デバイスを追加する必要があります。クラスターに以下のコマンドを実行します。

注記

$ sudo pcs stonith create my-ipmilan-for-controller01 fence_ipmilan pcmk_host_list=overcloud-controller-0 ipaddr=192.0.2.205 login=admin passwd=p@55w0rd! lanplus=1 cipher=1 op monitor interval=60s $ sudo pcs constraint location my-ipmilan-for-controller01 avoids overcloud-controller-0

$ sudo pcs stonith create my-ipmilan-for-controller02 fence_ipmilan pcmk_host_list=overcloud-controller-1 ipaddr=192.0.2.206 login=admin passwd=p@55w0rd! lanplus=1 cipher=1 op monitor interval=60s $ sudo pcs constraint location my-ipmilan-for-controller02 avoids overcloud-controller-1

$ sudo pcs stonith create my-ipmilan-for-controller03 fence_ipmilan pcmk_host_list=overcloud-controller-2 ipaddr=192.0.2.207 login=admin passwd=p@55w0rd! lanplus=1 cipher=1 op monitor interval=60s $ sudo pcs constraint location my-ipmilan-for-controller03 avoids overcloud-controller-2

$ sudo pcs stonith show

$ sudo pcs stonith show [stonith-name]

stonith プロパティーを true に設定して、フェンシングを有効にします。

$ sudo pcs property set stonith-enabled=true

$ sudo pcs property show

6.2.12. 高度なオーバークラウドの完了

第7章 オーバークラウド作成後のタスクの実行

7.1. オーバークラウドのテナントネットワークの作成

overcloud を読み込んで、Neutron で初期テナントネットワークを作成します。以下に例を示します。

$ source ~/overcloudrc $ neutron net-create default $ neutron subnet-create --name default --gateway 172.20.1.1 default 172.20.0.0/16

default という名前の基本的な Neutron ネットワークが作成されます。オーバークラウドは、内部 DHCP メカニズムを使用したこのネットワークから、IP アドレスを自動的に割り当てます。

neutron net-list で作成したネットワークを確認します。

$ neutron net-list +-----------------------+-------------+----------------------------------------------------+ | id | name | subnets | +-----------------------+-------------+----------------------------------------------------+ | 95fadaa1-5dda-4777... | default | 7e060813-35c5-462c-a56a-1c6f8f4f332f 172.20.0.0/16 | +-----------------------+-------------+----------------------------------------------------+

7.2. オーバークラウドの外部ネットワークの作成

ネイティブ VLAN の使用

overcloud を読み込み、Neutron で外部ネットワークを作成します。以下に例を示します。

$ source ~/overcloudrc $ neutron net-create nova --router:external --provider:network_type flat --provider:physical_network datacentre $ neutron subnet-create --name nova --enable_dhcp=False --allocation-pool=start=10.1.1.51,end=10.1.1.250 --gateway=10.1.1.1 nova 10.1.1.0/24

nova という名前のネットワークを作成します。オーバークラウドには、デフォルトの Floating IP プールにこの特定の名前が必要です。このネットワークは、「オーバークラウドの検証」の検証テストでも重要となります。