ストレージデバイスの管理

ローカルおよびリモートのストレージデバイスの設定と管理

概要

- 要件に従ってディスクパーティションを作成します。ディスク暗号化を使用して、ブロックデバイス上のデータを保護します。

- RAID (Redundant Array of Independent Disks) を作成して、複数のドライブにデータを保存し、データ損失を回避します。

- iSCSI および NVMe over Fabric を使用して、ネットワーク経由でストレージにアクセスします。

- 物理ストレージデバイスのプールを管理するように Stratis をセットアップします。

多様性を受け入れるオープンソースの強化

Red Hat では、コード、ドキュメント、Web プロパティーにおける配慮に欠ける用語の置き換えに取り組んでいます。まずは、マスター (master)、スレーブ (slave)、ブラックリスト (blacklist)、ホワイトリスト (whitelist) の 4 つの用語の置き換えから始めます。この取り組みは膨大な作業を要するため、今後の複数のリリースで段階的に用語の置き換えを実施して参ります。詳細は、Red Hat CTO である Chris Wright のメッセージ をご覧ください。

Red Hat ドキュメントへのフィードバック (英語のみ)

Red Hat ドキュメントに関するご意見やご感想をお寄せください。また、改善点があればお知らせください。

Jira からのフィードバック送信 (アカウントが必要)

- Jira の Web サイトにログインします。

- 上部のナビゲーションバーで Create をクリックします。

- Summary フィールドにわかりやすいタイトルを入力します。

- Description フィールドに、ドキュメントの改善に関するご意見を記入してください。ドキュメントの該当部分へのリンクも追加してください。

- ダイアログの下部にある Create をクリックします。

第1章 利用可能なストレージオプションの概要

Red Hat Enterprise Linux 9 では、複数のローカル、リモート、およびクラスターベースのストレージオプションを利用できます。

ローカルストレージは、ストレージデバイスがシステムにインストールされているか、システムに直接接続されていることを意味します。

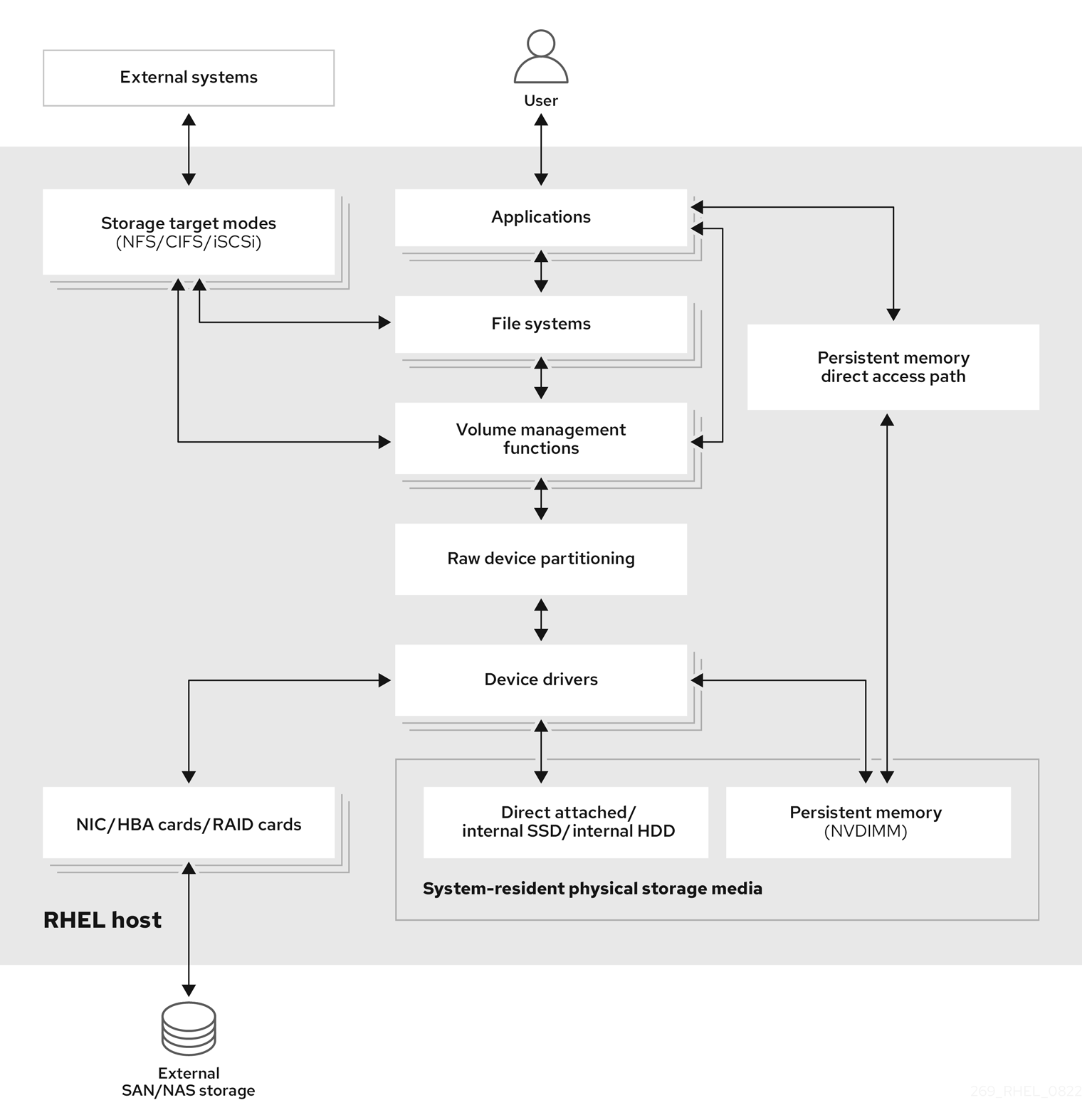

リモートストレージでは、LAN、インターネット、またはファイバーチャネルネットワークを介してデバイスにアクセスします。以下の Red Hat Enterprise Linux ストレージダイアグラムの概要では、さまざまなストレージオプションを説明します。

図1.1 Red Hat Enterprise Linux ストレージダイアグラム (概要)

1.1. ローカルストレージの概要

Red Hat Enterprise Linux 9 は、ローカルストレージオプションを複数提供します。

- 基本的なディスク管理:

partedとfdiskを使用して、ディスクパーティションの作成、変更、削除、および表示を行うことができます。パーティショニングレイアウトの標準は以下のようになります。- マスターブートレコード (MBR)

- BIOS ベースのコンピューターで使用されます。プライマリーパーティション、拡張パーティション、および論理パーティションを作成できます。

- GUID パーティションテーブル (GPT)

- GUID (Globally Unique identifier) を使用し、一意のディスクおよびパーティション GUID を提供します。

パーティションを暗号化するには、LUKS (Linux Unified Key Setup-on-disk-format) を使用します。パーティションを暗号化する場合は、インストール時にオプションを選択し、パスフレーズを入力させるプロンプトを表示します。このパスフレーズにより、暗号化キーのロックが解除されます。

- ストレージ使用オプション

- NVDIMM (Non-Volatile Dual In-line Memory Modules) の管理

- メモリーとストレージの組み合わせです。システムに接続した NVDIMM デバイスで、さまざまな種類のストレージを有効にして管理できます。

- ブロックストレージ管理

- 各ブロックに固有の識別子を持つブロックの形式でデータを保存します。

- ファイルストレージ

- データは、ローカルシステムのファイルレベルに保存されます。これらのデータは、XFS (デフォルト) または ext4 を使用してローカルでアクセスしたり、NFS と SMB を使用してネットワーク上でアクセスできます。

- 論理ボリューム

- 論理ボリュームマネージャー (LVM)

物理デバイスから論理デバイスを作成します。論理ボリューム (LV) は、物理ボリューム (PV) とボリュームグループ (VG) の組み合わせです。LVM の設定には以下が含まれます。

- ハードドライブから PV の作成

- 物理ボリュームからボリュームグループの作成

- ボリュームグループから論理ボリュームを作成すると、マウントポイントが論理ボリュームに割り当てられます。

- VDO (Virtual Data Optimizer)

重複排除、圧縮、およびシンプロビジョニングを使用して、データの削減に使用されます。VDO の下で論理ボリュームを使用すると、次のことができます。

- VDO ボリュームの拡張

- 複数のデバイスにまたがる VDO ボリューム

- ローカルファイルシステム

- XFS

- デフォルトの RHEL ファイルシステム。

- Ext4

- レガシーファイルシステム。

- Stratis

- Stratis は、高度なストレージ機能に対応する、ユーザーとカーネルのハイブリッドローカルストレージ管理システムです。

1.2. リモートストレージの概要

Red Hat Enterprise Linux 9 で利用可能なリモートストレージオプションは次のとおりです。

- ストレージの接続オプション

- iSCSI

- RHEL 9 は targetcli ツールを使用して、iSCSI ストレージの相互接続を追加、削除、表示、および監視します。

- ファイバーチャンネル (FC)

RHEL 9 は、以下のネイティブファイバーチャネルドライバーを提供します。

-

lpfc -

qla2xxx -

Zfcp

-

- NVMe (Non-volatile Memory Express)

ホストソフトウェアユーティリティーがソリッドステートドライブと通信できるようにするインターフェイス。次の種類はファブリックトランスポートを使用して、NVMe over fabrics を設定します。

- RDMA (Remote Direct Memory Access) を使用する NVMe over fabrics

- ファイバーチャネル (FC) を使用した NVMe over fabrics

- Device Mapper Multipath (DM Multipath)

- サーバーノードとストレージアレイ間の複数の I/O パスを 1 つのデバイスに設定できます。これらの I/O パスは、個別のケーブル、スイッチ、コントローラーを含むことができる物理的な SAN 接続です。

- ネットワークファイルシステム

- NFS

- SMB

1.3. GFS2 ファイルシステムの概要

Red Hat Global File System 2 (GFS2) ファイルシステムは、64 ビットの対称クラスターファイルシステムで、共有名前空間を提供し、一般的なブロックデバイスを共有する複数のノード間の一貫性を管理します。GFS2 ファイルシステムは、ローカルファイルシステムに可能な限り近い機能セットを提供すると同時に、ノード間でクラスターの完全な整合性を強制することを目的としています。これを実現するため、ノードはファイルシステムリソースにクラスター全体のロックスキームを使用します。このロックスキームは、TCP/IP などの通信プロトコルを使用して、ロック情報を交換します。

場合によっては、Linux ファイルシステム API では、GFS2 のクラスター化された性質を完全に透過的にすることができません。たとえば、GFS2 で POSIX ロックを使用しているプログラムは、GETLK の使用を回避する必要があります。なぜなら、クラスター環境では、プロセス ID が、クラスター内の別のノードに対するものである可能性があるためです。ただし、ほとんどの場合、GFS2 ファイルシステムの機能は、ローカルファイルシステムのものと同じです。

Red Hat Enterprise Linux Resilient Storage Add-On は GFS2 を提供します。GFS2 が必要とするクラスター管理の提供は Red Hat Enterprise Linux High Availability Add-On により提供されます。

gfs2.ko カーネルモジュールは GFS2 ファイルシステムを実装し、GFS2 クラスターノードに読み込まれます。

GFS2 環境を最大限に利用するためにも、基礎となる設計に起因するパフォーマンス事情を考慮することが重要です。GFS2 では、ローカルファイルシステムと同様、ページキャッシュで、頻繁に使用されるデータのローカルキャッシングを行ってパフォーマンスを向上します。クラスターのノード間で一貫性を維持するために、glock ステートマシンでキャッシュ制御が提供されます。

関連情報

第2章 永続的な命名属性

ストレージデバイスを識別および管理する方法により、システムの安定性と予測可能性が確保されます。Red Hat Enterprise Linux 9 は、この目的のために、従来のデバイス名と永続的な命名属性という 2 つの主要な命名スキームを使用します。

従来のデバイス名

従来のデバイス名は、システム内のデバイスの物理的な場所に基づいて Linux カーネルによって決定されます。たとえば、通常、最初の SATA ドライブには /dev/sda というラベルが付けられ、2 番目の SATA ドライブには /dev/sdb というラベルが付けられます。これらの名前は単純なものですが、デバイスが追加または削除されたとき、またはハードウェア設定が変更されたときに変更される可能性があります。これにより、スクリプトと設定ファイルに問題が生じる可能性があります。さらに、従来の名前には、デバイスの目的や特性についての説明的な情報が欠けています。

永続的な命名属性

永続的な命名属性はストレージデバイスの固有の特性に基づいているため、システムの再起動後もストレージデバイスがより安定し、予測可能になります。PNA の実装には、従来の命名と比較してより詳細な初期設定が必要です。PNA の主な利点の 1 つは、ハードウェア設定の変更に対する回復力であり、一貫した命名規則を維持するのに最適であることです。PNA を使用すると、予期しない名前の変更を心配することなく、スクリプト、設定ファイル、管理ツール内でストレージデバイスを参照できます。さらに、PNA にはデバイスの種類や製造元情報などの有用なメタデータが含まれることが多く、効果的なデバイスの識別と管理のための記述性が向上します。

2.1. ファイルシステムとブロックデバイスを識別するための永続属性

Red Hat Enterprise Linux 9 のストレージでは、永続的な命名属性 (PNA) は、システムの再起動、ハードウェアの変更、またはその他のイベント全体にわたってストレージデバイスに一貫した信頼性の高い命名を提供するメカニズムです。これらの属性は、ストレージデバイスが追加、削除、または再設定された場合でも、一貫してストレージデバイスを識別するために使用されます。

PNA はファイルシステムとブロックデバイスの両方を識別するために使用されますが、目的は異なります。

- ファイルシステムを識別するための永続属性

ユニバーサル一意識別子 (UUID)

UUID は主に、ストレージデバイス上のファイルシステムを一意に識別するために使用されます。各ファイルシステムには独自の UUID があり、この識別子は、ファイルシステムがアンマウントされたり、再マウントされたり、デバイスが切り離されて再接続されたりしても、一定のままです。

ラベル

ラベルは、ユーザーがファイルシステムに割り当てた名前です。これらはファイルシステムの識別と参照に使用できますが、UUID ほど標準化されていません。ラベルは、設定ファイルでファイルシステムを指定するための UUID の代替としてよく使用されます。

ファイルシステムにラベルを割り当てると、そのラベルはファイルシステムのメタデータの一部になります。このラベルは、ファイルシステムを別のマウントポイントまたは別のシステムにマウントした場合でも、ファイルシステムとともに存続します。

- ブロックデバイスを識別するための永続属性

ユニバーサル一意識別子 (UUID)

UUID を使用してストレージブロックデバイスを識別できます。ストレージデバイスがフォーマットされるとき、またはストレージデバイス上にファイルシステムが作成されるとき、多くの場合、UUID がデバイス自体に割り当てられます。この UUID はファイルシステムのメタデータまたはパーティションテーブル内に埋め込まれ、永続的なデバイス命名行う際に参照として使用されます。これにより、ファイルシステムを変更したり再フォーマットしたりした場合でも、ブロックデバイスを一意に識別できます。

World Wide Identifier (WWID)

WWID は、ストレージブロックデバイスに関連付けられたグローバルに一意の識別子です。これらは、サーバーを SAN ストレージデバイスに接続するホストバスアダプター (HBA) またはネットワークインターフェイスを識別するために、ファイバーチャネルストレージエリアネットワーク (SAN) で一般的に使用されます。WWID は、サーバーと SAN ストレージデバイス間の一貫した通信を実現し、ストレージデバイスへの冗長パスの管理に役立ちます。

シリアル番号

シリアル番号は、製造元によって各ストレージブロックデバイスに割り当てられる一意の識別子です。これはストレージデバイスを区別するために使用できます。デバイス管理のために UUID や WWID などの他の属性と組み合わせて使用することもできます。

2.2. udev デバイスの命名規則

ユーザー空間デバイスマネージャー (udev) サブシステムを使用すると、デバイスに永続的な名前を割り当てるためのルールを定義できます。これらのルールは、/etc/udev/rules.d/ ディレクトリー内の .rules 拡張子が付いたファイルに保存されます。これらのルールの目的は、システムの再起動後や設定の変更後も、ストレージデバイスが一貫して予測どおりに識別されるようにすることです。

udev ルールは、キーと値のペアを使用して人間が判読できる形式で記述されます。デバイスが検出または初期化されると、udev はこれらのルールを定義された順序に基づいて順番に評価します。最初に一致したルールがデバイスに適用され、デバイスの名前とシステム内での識別方法が決定されます。

ストレージデバイスの場合、udev ルールは /dev/disk/ ディレクトリーにシンボリックリンクを作成します。これらのシンボリックリンクはストレージデバイスに使いやすいエイリアスを提供するため、これらのデバイスの参照と管理がより便利になります。

カスタムの udev ルールを作成して、シリアル番号、WWN (World Wide Name) 識別子、その他のデバイス固有の特性などのさまざまな属性に基づいてデバイスに名前を付ける方法を指定できます。特定の命名規則を定義することにより、システム内でデバイスを識別する方法を正確に制御できます。

udev ルールには主に 2 つの場所があります。

-

/lib/udev/rules.d/ディレクトリーには、udevパッケージに付属するデフォルトのルールが含まれています。 -

/etc/udev/rules.dディレクトリーはカスタムudevルール用です。

udev ルールは非常に柔軟ですが、udev の制限事項に注意することが重要です。

-

アクセス可能なタイミング: 一部のストレージデバイスは、

udevクエリー時にアクセスできない場合があります。 -

イベントベースの処理: カーネルはいつでも

udevイベントを送信できます。そのため、デバイスがアクセスできない場合は、ルール処理とリンクの削除をトリガーする可能性があります。 - 処理の遅延: 特に多数のデバイスがある場合、イベントの生成と処理の間に遅延が発生する可能性があります。これにより、カーネルがデバイスを検出してからリンクが利用可能になるまでに遅れが生じます。

-

デバイスのアクセシビリティー:

udevルールによって呼び出される外部プログラム (blkidなど) がデバイスを一時的に開き、他のタスクからデバイスに一時的にアクセスできなくなる可能性があります。 -

リンクの更新:

/dev/disk/でudevによって管理されるデバイス名は、メジャーリリース間で変更される可能性があります。その場合、リンクの更新が必要になります。

関連情報

-

udevman ページ

第3章 RHEL システムロールを使用したローカルストレージの管理

Ansible を使用して LVM とローカルファイルシステム (FS) を管理するには、RHEL7.9 で使用可能な RHEL システムロールの 1 つである storage ロールを使用できます。

storage ロールを使用すると、ディスク上のファイルシステム、複数のマシンにある論理ボリューム、および RHEL 7.7 以降の全バージョンでのファイルシステムの管理を自動化できます。

RHEL システムロールと、その適用方法の詳細は、RHEL システムロールの概要 を参照してください。

3.1. storage RHEL システムロールの概要

storage ロールは以下を管理できます。

- パーティションが分割されていないディスクのファイルシステム

- 論理ボリュームとファイルシステムを含む完全な LVM ボリュームグループ

- MD RAID ボリュームとそのファイルシステム

storage ロールを使用すると、次のタスクを実行できます。

- ファイルシステムを作成する

- ファイルシステムを削除する

- ファイルシステムをマウントする

- ファイルシステムをアンマウントする

- LVM ボリュームグループを作成する

- LVM ボリュームグループを削除する

- 論理ボリュームを作成する

- 論理ボリュームを削除する

- RAID ボリュームを作成する

- RAID ボリュームを削除する

- RAID で LVM ボリュームグループを作成する

- RAID で LVM ボリュームグループを削除する

- 暗号化された LVM ボリュームグループを作成する

- RAID で LVM 論理ボリュームを作成する

3.2. storage システムロールでストレージデバイスを識別するパラメーター

storage ロールの設定は、以下の変数に記載されているファイルシステム、ボリューム、およびプールにのみ影響します。

storage_volumesマネージドのパーティションが分割されていない全ディスク上のファイルシステムのリスト

storage_volumesにはraidボリュームを含めることもできます。現在、パーティションはサポートされていません。

storage_pools管理するプールのリスト

現在、サポートされている唯一のプールタイプは LVM です。LVM では、プールはボリュームグループ (VG) を表します。各プールの下には、ロールで管理されるボリュームのリストがあります。LVM では、各ボリュームは、ファイルシステムを持つ論理ボリューム (LV) に対応します。

3.3. ブロックデバイスに XFS ファイルシステムを作成する Ansible Playbook の例

Ansible Playbook の例では、storage ロールを適用して、デフォルトのパラメーターを使用してブロックデバイス上に XFS ファイルシステムを作成します。

storage ロールは、パーティションが分割されていないディスク全体または論理ボリューム (LV) でのみファイルシステムを作成できます。パーティションにファイルシステムを作成することはできません。

例3.1 /dev/sdb に XFS を作成する Playbook

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: xfs

roles:

- rhel-system-roles.storage-

現在、ボリューム名 (この例では

barefs) は任意です。storageロールは、disks:属性にリスト表示されているディスクデバイスでボリュームを特定します。 -

XFS は RHEL 9 のデフォルトファイルシステムであるため、

fs_type: xfs行を省略することができます。 論理ボリュームにファイルシステムを作成するには、エンクロージングボリュームグループを含む

disks:属性の下に LVM 設定を指定します。詳細は、論理ボリュームを管理する Ansible Playbook の例 を参照してください。LV デバイスへのパスを指定しないでください。

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.4. ファイルシステムを永続的にマウントする Ansible Playbook の例

Ansible の例では、storage ロールを適用して、XFS ファイルシステムを即時かつ永続的にマウントします。

例3.2 /dev/sdb のファイルシステムを /mnt/data にマウントする Playbook

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: xfs

mount_point: /mnt/data

mount_user: somebody

mount_group: somegroup

mount_mode: 0755

roles:

- rhel-system-roles.storage-

この Playbook では、ファイルシステムが

/etc/fstabファイルに追加され、すぐにファイルシステムをマウントします。 -

/dev/sdbデバイス上のファイルシステム、またはマウントポイントのディレクトリーが存在しない場合は、Playbook により作成されます。

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.5. 論理ボリュームを管理する Ansible Playbook の例

Ansible Playbook の例では、storage ロールを適用して、ボリュームグループに LVM 論理ボリュームを作成します。

例3.3 myvg ボリュームグループに mylv 論理ボリュームを作成する Playbook

- hosts: all

vars:

storage_pools:

- name: myvg

disks:

- sda

- sdb

- sdc

volumes:

- name: mylv

size: 2G

fs_type: ext4

mount_point: /mnt/data

roles:

- rhel-system-roles.storagemyvgボリュームグループは、次のディスクで設定されます。-

/dev/sda -

/dev/sdb -

/dev/sdc

-

-

myvgボリュームグループがすでに存在する場合は、Playbook により論理ボリュームがボリュームグループに追加されます。 -

myvgボリュームグループが存在しない場合は、Playbook により作成されます。 -

Playbook は、

mylv論理ボリューム上に Ext4 ファイルシステムを作成し、/mntファイルシステムを永続的にマウントします。

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.6. オンラインのブロック破棄を有効にする Ansible Playbook の例

Ansible Playbook の例では、storage ロールを適用して、オンラインのブロック破棄を有効にして XFS ファイルシステムをマウントします。

例3.4 /mnt/data/ でのオンラインのブロック破棄を有効にする Playbook

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: xfs

mount_point: /mnt/data

mount_options: discard

roles:

- rhel-system-roles.storage関連情報

- ファイルシステムを永続的にマウントする Ansible Playbook の例

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.7. Ext4 ファイルシステムを作成してマウントする Ansible Playbook の例

Ansible Playbook の例では、storage ロールを適用して、Ext4 ファイルシステムを作成してマウントします。

例3.5 /dev/sdb に Ext4 を作成し、/mnt/data にマウントする Playbook

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: ext4

fs_label: label-name

mount_point: /mnt/data

roles:

- rhel-system-roles.storage-

Playbook は、

/dev/sdbディスクにファイルシステムを作成します。 -

Playbook は、

/mnt/dataディレクトリーにファイルシステムを永続的にマウントします。 -

ファイルシステムのラベルは

label-nameです。

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.8. ext3 ファイルシステムを作成してマウントする Ansible Playbook の例

Ansible Playbook の例では、storage ロールを適用して Ext3 ファイルシステムを作成してマウントします。

例3.6 /dev/sdb に Ext3 を作成し、/mnt/data にマウントする Playbook

---

- hosts: all

vars:

storage_volumes:

- name: barefs

type: disk

disks:

- sdb

fs_type: ext3

fs_label: label-name

mount_point: /mnt/data

mount_user: somebody

mount_group: somegroup

mount_mode: 0755

roles:

- rhel-system-roles.storage-

Playbook は、

/dev/sdbディスクにファイルシステムを作成します。 -

Playbook は、

/mnt/dataディレクトリーにファイルシステムを永続的にマウントします。 -

ファイルシステムのラベルは

label-nameです。

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.9. storage RHEL システムロールを使用して LVM 上の既存のファイルシステムのサイズを変更する Ansible Playbook の例

Ansible Playbook の例では、storage RHEL システムロールを適用して、ファイルシステムを使用して LVM 論理ボリュームのサイズを変更します。

他のファイルシステムで Resizing アクションを使用すると、作業しているデバイスのデータを破棄する可能性があります。

例3.7 myvg ボリュームグループの既存の mylv1 および myvl2 論理ボリュームのサイズを変更する Playbook

---

- hosts: all

vars:

storage_pools:

- name: myvg

disks:

- /dev/sda

- /dev/sdb

- /dev/sdc

volumes:

- name: mylv1

size: 10 GiB

fs_type: ext4

mount_point: /opt/mount1

- name: mylv2

size: 50 GiB

fs_type: ext4

mount_point: /opt/mount2

- name: Create LVM pool over three disks

include_role:

name: rhel-system-roles.storageこの Playbook は、以下の既存のファイルシステムのサイズを変更します。

-

/opt/mount1にマウントされるmylv1ボリュームの Ext4 ファイルシステムは、そのサイズを 10 GiB に変更します。 -

/opt/mount2にマウントされるmylv2ボリュームの Ext4 ファイルシステムは、そのサイズを 50 GiB に変更します。

-

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.10. storage RHEL System Role を使用してスワップボリュームを作成する Ansible Playbook の例

本セクションでは、Ansible Playbook の例を紹介します。この Playbook は、storage ロールを適用して、スワップボリュームが存在しない場合は作成し、スワップボリュームがすでに存在する場合は、デフォルトのパラメーターを使用してブロックデバイスに変更します。

例3.8 /dev/sdb で既存の XFS を作成または変更する Playbook

---

- name: Create a disk device with swap

- hosts: all

vars:

storage_volumes:

- name: swap_fs

type: disk

disks:

- /dev/sdb

size: 15 GiB

fs_type: swap

roles:

- rhel-system-roles.storage-

現在、ボリューム名 (この例では

swap_fs) は任意です。storageロールは、disks:属性にリスト表示されているディスクデバイスでボリュームを特定します。

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.11. Storage システムロールを使用した RAID ボリュームの設定

storage システムロールを使用すると、Red Hat Ansible Automation Platform と Ansible-Core を使用して RHEL に RAID ボリュームを設定できます。要件に合わせて RAID ボリュームを設定するためのパラメーターを使用して、Ansible Playbook を作成します。

前提条件

- Ansible Core パッケージがコントロールマシンにインストールされている。

-

Playbook を実行するシステムに

rhel-system-rolesパッケージがインストールされている。 -

storageシステムロールを使用して、RAID ボリュームをデプロイするシステムの詳細を記録したインベントリーファイルがある。

手順

以下のコンテンツを含む新しい playbook.yml ファイルを作成します。

--- - name: Configure the storage hosts: managed-node-01.example.com tasks: - name: Create a RAID on sdd, sde, sdf, and sdg include_role: name: rhel-system-roles.storage vars: storage_safe_mode: false storage_volumes: - name: data type: raid disks: [sdd, sde, sdf, sdg] raid_level: raid0 raid_chunk_size: 32 KiB mount_point: /mnt/data state: present警告特定の状況でデバイス名が変更する場合があります。たとえば、新しいディスクをシステムに追加するときなどです。したがって、データの損失を防ぐために、Playbook で特定のディスク名を使用しないでください。

オプション: Playbook の構文を確認します。

# ansible-playbook --syntax-check playbook.ymlPlaybook を実行します。

# ansible-playbook -i inventory.file /path/to/file/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル - RHEL System Roles を使用するための制御ノードと管理対象ノードの準備

3.12. storage RHEL System Role を使用して RAID で LVM プールを設定する

storage システムロールを使用すると、Red Hat Ansible Automation Platform を使用して RHEL に LVM pool with RAID を設定できます。利用可能なパラメーターを使用して Ansible Playbook をセットアップし、RAID を使用して LVM プールを設定できます。

前提条件

- Ansible Core パッケージがコントロールマシンにインストールされている。

-

Playbook を実行するシステムに

rhel-system-rolesパッケージがインストールされている。 -

storageシステムロールを使用して、LVM pool with RAID を設定するシステムの詳細を記録したインベントリーファイルがある。

手順

以下の内容を含む新しい

playbook.ymlファイルを作成します。- hosts: all vars: storage_safe_mode: false storage_pools: - name: my_pool type: lvm disks: [sdh, sdi] raid_level: raid1 volumes: - name: my_volume size: "1 GiB" mount_point: "/mnt/app/shared" fs_type: xfs state: present roles: - name: rhel-system-roles.storage注記LVM pool with RAID を作成するには、

raid_levelパラメーターを使用して RAID タイプを指定する必要があります。オプション: Playbook の構文を確認します。

# ansible-playbook --syntax-check playbook.ymlインベントリーファイルで Playbook を実行します。

# ansible-playbook -i inventory.file /path/to/file/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.13. storage RHEL システムロールを使用した RAID LVM ボリュームのストライプサイズの設定

storage システムロールを使用すると、Red Hat Ansible Automation Platform を使用して RHEL の RAID LVM ボリュームのストライプサイズを設定できます。利用可能なパラメーターを使用して Ansible Playbook をセットアップし、RAID を使用して LVM プールを設定できます。

前提条件

- Ansible Core パッケージがコントロールマシンにインストールされている。

- Playbook を実行するシステムに rhel-system-roles パッケージがインストールされている。

- storage システムロールを使用して LVM pool with RAID を設定するシステムの詳細を記録したインベントリーファイルがある。

手順

以下のコンテンツを含む新しい

playbook.ymlファイルを作成します。hosts: all vars: storage_safe_mode: false storage_pools: - name: my_pool type: lvm disks: [sdh, sdi] volumes: - name: my_volume size: "1 GiB" mount_point: "/mnt/app/shared" fs_type: xfs raid_level: raid1 raid_stripe_size: "256 KiB" state: present roles: - name: rhel-system-roles.storageオプション: Playbook の構文を確認します。

# ansible-playbook --syntax-check playbook.ymlインベントリーファイルで Playbook を実行します。

# ansible-playbook -i inventory.file /path/to/file/playbook.yml

関連情報

- RAID の管理

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdファイル

3.14. storage RHEL システムロールを使用し、LVM 上の VDO ボリュームを圧縮および重複排除する Ansible Playbook の例

Ansible Playbook の例では、storage RHEL システムロールを適用して、Virtual Data Optimizer (VDO) を使用した論理ボリューム (LVM) の圧縮と重複排除を有効にします。

例3.9 myvg ボリュームグループに、mylv1 LVM VDO ボリュームを作成する Playbook

---

- name: Create LVM VDO volume under volume group 'myvg'

hosts: all

roles:

-rhel-system-roles.storage

vars:

storage_pools:

- name: myvg

disks:

- /dev/sdb

volumes:

- name: mylv1

compression: true

deduplication: true

vdo_pool_size: 10 GiB

size: 30 GiB

mount_point: /mnt/app/shared

この例では、compression プールおよび deduplication プールを true に設定します。これは、VDO が使用されることを指定します。以下では、このパラメーターの使用方法を説明します。

-

deduplicationは、ストレージボリュームに保存されている重複データの重複排除に使用されます。 - 圧縮は、ストレージボリュームに保存されているデータを圧縮するために使用されます。これにより、より大きなストレージ容量が得られます。

-

vdo_pool_size は、ボリュームがデバイスで使用する実際のサイズを指定します。VDO ボリュームの仮想サイズは、

sizeパラメーターで設定します。注記: LVM VDO はストレージロールで使用されるため、プールごとに圧縮と重複排除を使用できるボリュームは 1 つだけです。

3.15. storage RHEL システムロールを使用した LUKS2 暗号化ボリュームの作成

storage ロールを使用し、Ansible Playbook を実行して、LUKS で暗号化されたボリュームを作成および設定できます。

前提条件

-

crypto_policiesシステムロールで設定するシステムである 1 つ以上の管理対象ノードへのアクセスとパーミッションがある。 - 管理対象ノードが記載されているインベントリーファイルがある。

-

コントロールノード (このシステムから Red Hat Ansible Core は他のシステムを設定) へのアクセスおよびパーミッション。

ansible-coreパッケージおよびrhel-system-rolesパッケージがコントロールノードにインストールされている。

RHEL 8.0-8.5 では、別の Ansible リポジトリーへのアクセス権を指定されており、Ansible をベースにする自動化用の Ansible Engine 2.9 が含まれています。Ansible Engine には、ansible、ansible-playbook などのコマンドラインユーティリティー、docker や podman などのコネクター、プラグインとモジュールが多く含まれています。Ansible Engine を入手してインストールする方法の詳細は、ナレッジベースのアーティクル記事 How to download and install Red Hat Ansible Engine を参照してください。

RHEL 8.6 および 9.0 では、Ansible Core (ansible-core パッケージとして提供) が導入されました。これには、Ansible コマンドラインユーティリティー、コマンド、およびビルトイン Ansible プラグインのセットが含まれています。RHEL は、AppStream リポジトリーを介してこのパッケージを提供し、サポート範囲は限定的です。詳細については、ナレッジベースの Scope of support for the Ansible Core package included in the RHEL 9 and RHEL 8.6 and later AppStream repositories を参照してください。

手順

以下の内容を含む新しい

playbook.ymlファイルを作成します。- hosts: all vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: xfs fs_label: label-name mount_point: /mnt/data encryption: true encryption_password: your-password roles: - rhel-system-roles.storageplaybook.yml ファイルに、

encryption_key、encryption_cipher、encryption_key_size、およびencryption_luksバージョンなどの他の暗号化パラメーターを追加することもできます。オプション: Playbook の構文を確認します。

# ansible-playbook --syntax-check playbook.ymlインベントリーファイルで Playbook を実行します。

# ansible-playbook -i inventory.file /path/to/file/playbook.yml

検証

暗号化ステータスを表示します。

# cryptsetup status sdb /dev/mapper/sdb is active and is in use. type: LUKS2 cipher: aes-xts-plain64 keysize: 512 bits key location: keyring device: /dev/sdb [...]

作成された LUKS 暗号化ボリュームを確認します。

# cryptsetup luksDump /dev/sdb Version: 2 Epoch: 6 Metadata area: 16384 [bytes] Keyslots area: 33521664 [bytes] UUID: a4c6be82-7347-4a91-a8ad-9479b72c9426 Label: (no label) Subsystem: (no subsystem) Flags: allow-discards Data segments: 0: crypt offset: 33554432 [bytes] length: (whole device) cipher: aes-xts-plain64 sector: 4096 [bytes] [...]storageロールがサポートするplaybook.ymlファイル内のcryptsetupパラメーターを表示します。# cat ~/playbook.yml - hosts: all vars: storage_volumes: - name: foo type: disk disks: - nvme0n1 fs_type: xfs fs_label: label-name mount_point: /mnt/data encryption: true #encryption_password: passwdpasswd encryption_key: /home/passwd_key encryption_cipher: aes-xts-plain64 encryption_key_size: 512 encryption_luks_version: luks2 roles: - rhel-system-roles.storage

関連情報

- LUKS を使用したブロックデバイスの暗号化

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile

3.16. storage RHEL システムロールを使用し、プールのボリュームサイズをパーセンテージで表す Ansible Playbook の例

Ansible Playbook の例では、storage システムロールを適用して、論理マネージャーボリューム (LVM) のボリュームサイズをプールの合計サイズのパーセンテージとして表現できるようにします。

例3.10 ボリュームのサイズをプールの合計サイズのパーセンテージで表現する Playbook

---

- name: Express volume sizes as a percentage of the pool's total size

hosts: all

roles

- rhel-system-roles.storage

vars:

storage_pools:

- name: myvg

disks:

- /dev/sdb

volumes:

- name: data

size: 60%

mount_point: /opt/mount/data

- name: web

size: 30%

mount_point: /opt/mount/web

- name: cache

size: 10%

mount_point: /opt/cache/mountこの例では、LVM ボリュームのサイズを、プールサイズのパーセンテージで指定します (例: "60%")。また、LVM ボリュームのサイズを、人間が判読できるファイルシステムのサイズ ("10g" や "50 GiB" など) で、プールサイズのパーセンテージで指定することもできます。

3.17. 関連情報

-

/usr/share/doc/rhel-system-roles/storage/ -

/usr/share/ansible/roles/rhel-system-roles.storage/

第4章 ディスクパーティション

ディスクを 1 つ以上の論理領域に分割するには、ディスクのパーティション設定ユーティリティーを使用します。これにより、各パーティションを個別に管理できます。

4.1. パーティションの概要

ハードディスクは、パーティションテーブルの各ディスクパーティションの場所とサイズに関する情報を保存します。オペレーティングシステムは、パーティションテーブルの情報を使用して、各パーティションを論理ディスクとして扱います。ディスクパーティション設定には、次のような利点があります。

- 物理ボリュームの管理上の見落としの可能性を減らす。

- 十分なバックアップを確保する。

- 効率的なディスク管理を提供する。

4.2. ディスクのパーティション変更前の留意事項

ディスクパーティションを作成、削除、またはサイズ変更する前に、次の点を考慮してください。

デバイスでは、パーティションテーブルのタイプによって、個々のパーティションの最大数とサイズが決まります。

パーティションの最大数:

マスターブートレコード (MBR) パーティションテーブルでフォーマットされたデバイスでは、次の数だけパーティションを設定できます。

- 最大 4 つのプライマリーパーティション

最大 3 つのプライマリーパーティション、1 つの拡張パーティション

- 拡張パーティション内の複数の論理パーティション

GUID パーティションテーブル (GPT) でフォーマットしたデバイスには、以下を設定できます。

partedユーティリティーを使用している場合は、最大 128 のパーティション。- GPT 仕様では、パーティションテーブルの予約サイズを増やすことで、より多くのパーティションを作成できますが、parted ユーティリティーは 128 のパーティションに必要な領域に制限しています。

パーティションの最大サイズ:

Master Boot Record (MBR) パーティションテーブルでフォーマットされたデバイスの場合:

- 512b セクタードライブを使用している場合、最大サイズは 2 TiB です。

- 4k セクタードライブを使用している場合、最大サイズは 16 TiB です。

GUID パーティションテーブル (GPT) でフォーマットされたデバイスの場合:

- 512b セクタードライブを使用している場合、最大サイズは 8 ZiB です。

- 4k セクタードライブを使用している場合、最大サイズは 64 ZiB です。

parted ユーティリティーを使用すると、複数の異なる接尾辞を使用してパーティションサイズを指定できます。

MiB、GiB、または TiB

- サイズは 2 のべき乗で表示されます。

- パーティションの開始点は、サイズが指定する正確なセクターに調整されます。

- 終了点は、指定されたサイズから 1 セクターを引いたサイズに調整されます。

MB、GB、TB:

- サイズは 10 のべき乗で表示されます。

- 開始点と終了点は、指定されたユニットの半分以内に配置されます。たとえば、接尾辞 MB を使用する場合は ±500KB です。

このセクションでは、IBM Z アーキテクチャーに固有の DASD パーティションテーブルを説明しません。

4.3. パーティションテーブルの種類の比較

デバイスでパーティションを有効にするには、さまざまな種類のパーティションテーブルでブロックデバイスをフォーマットします。次の表では、ブロックデバイスで作成できるさまざまな種類のパーティションテーブルのプロパティーを比較しています。

表4.1 パーティションテーブルの種類

| パーティションテーブル | パーティションの最大数 | パーティションの最大サイズ |

|---|---|---|

| マスターブートレコード (MBR) | 4 つのプライマリーパーティション、または 3 つのプライマリーパーティションと 12 の論理パーティションを持つ 1 つの拡張パーティション | 2TiB |

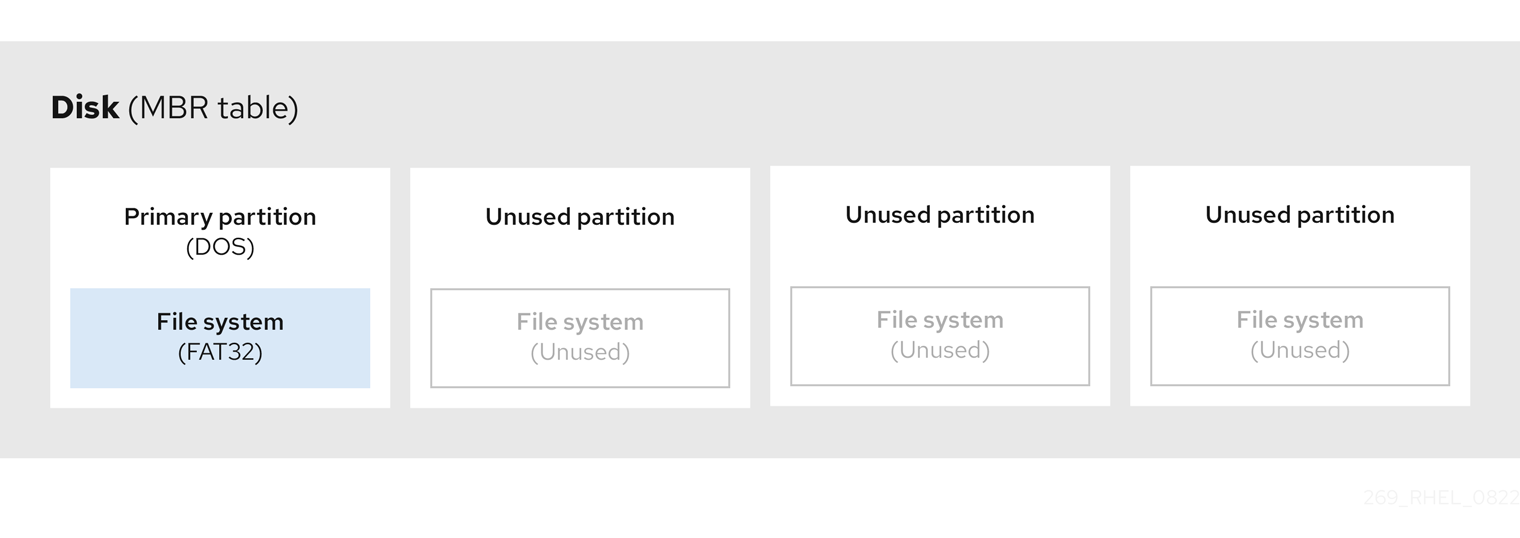

| GUID パーティションテーブル (GPT) | 128 | 8ZiB |

4.4. MBR ディスクパーティション

パーティションテーブルはそのディスクの先頭部分となる、他のファイルシステムまたはユーザーデータの前に格納されています。わかりやすくするために、次の図ではパーティションテーブルを区切って示しています。

図4.1 MBR パーティションテーブルがあるディスク

上記の図で示したとおり、パーティションテーブルは使用していない 4 つのプライマリーパーティションの 4 つのセクションに分けられます。プライマリーパーティションは、論理ディスクドライブ (またはセクション) を 1 つだけ含むハードドライブのパーティションです。各論理ドライブは、1 つのパーティションの定義に必要な情報を保持できます。つまり、パーティションテーブルで定義できるプライマリーパーティションは 4 つまでです。

各パーティションテーブルエントリーには、パーティションの重要な特徴が含まれています。

- ディスク上のパーティションの開始点と終了点

-

パーティションの状態 (

アクティブとしてフラグを立てることができるのは 1 つのパーティションのみ) - パーティションのタイプ

開始点と終了点は、ディスク上のパーティションのサイズと場所を定義します。一部のオペレーティングシステムブートローダーは、active フラグを使用します。つまり、active とマークされているパーティションのオペレーティングシステムが起動します。

タイプとは、パーティションの用途を識別する番号です。一部のオペレーティングシステムでは、パーティションの種類を使用して以下を行います。

- 特定のファイルシステムタイプを示します。

- 特定のオペレーティングシステムに関連付けられているパーティションにフラグを付けます。

- パーティションに起動可能なオペレーティングシステムが含まれていることを示します。

以下の図は、パーティションが 1 つあるドライブの例を示しています。この例では、最初のパーティションには DOS パーティションタイプのラベルが付けられています。

図4.2 1 つのパーティションを持つディスク

関連情報

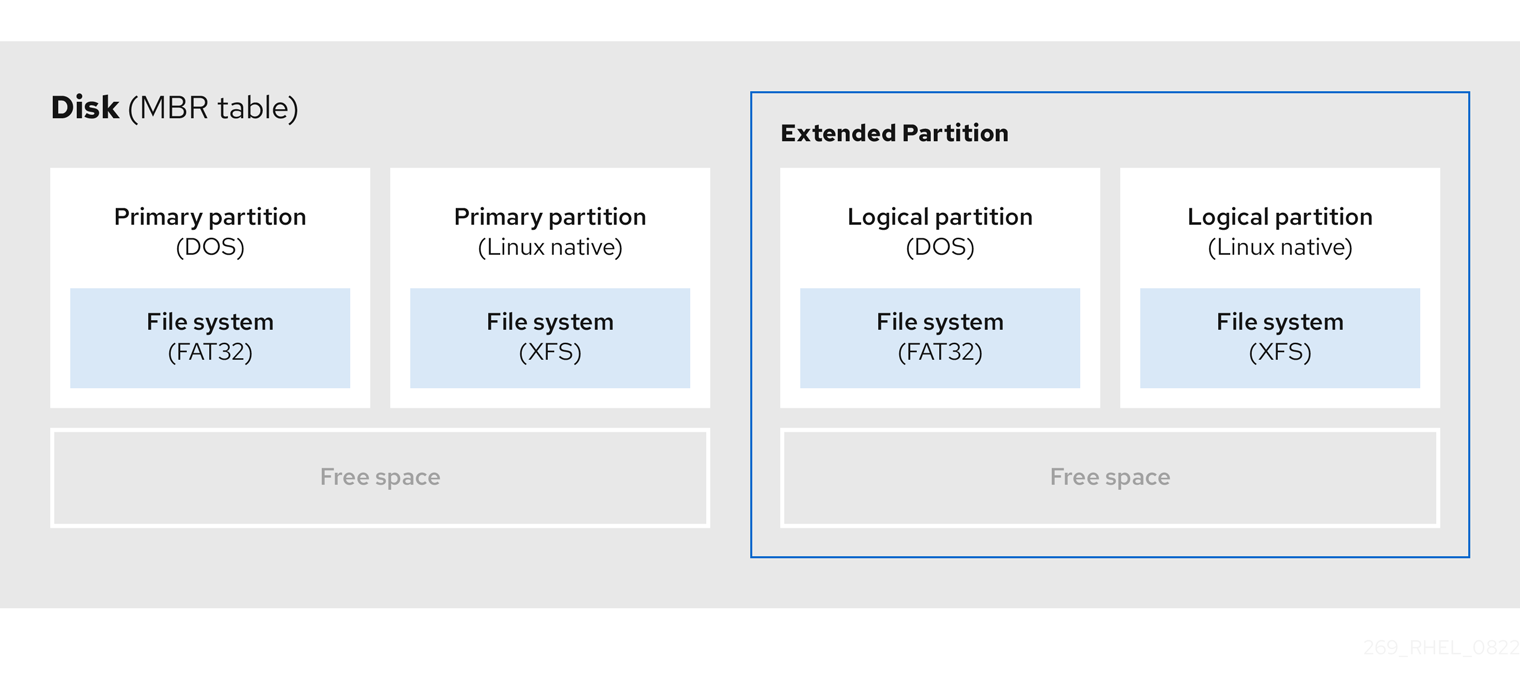

4.5. 拡張 MBR パーティション

必要があれば、タイプを extended に設定して追加のパーティションを作成します。

拡張パーティションは、ディスクドライブに似ています。拡張パーティション内に完全に含まれる 1 つ以上の論理パーティションを指す独自のパーティションテーブルがあります。次の図は、2 つのプライマリーパーティションと、2 つの論理パーティションを含む 1 つの拡張パーティションおよびいくつかの未パーティションの空き領域を備えたディスクドライブを示しています。

図4.3 2 つのプライマリーパーティションと拡張 MBR パーティションの両方を備えたディスク

最大 4 つのプライマリーパーティションと拡張パーティションのみを使用できますが、論理パーティションの数に制限はありません。パーティションにアクセスする場合の Linux の制限として、1 つのディスクドライブで最大 15 の論理パーティションが許可されます。

4.6. MBR パーティションタイプ

次の表は、最も一般的に使用される MBR パーティションタイプとそれらを表す 16 進数のリストです。

表4.2 MBR パーティションタイプ

| MBR パーティションタイプ | 値 | MBR パーティションタイプ | 値 |

| Empty | 00 | Novell Netware 386 | 65 |

| DOS 12 ビット FAT | 01 | PIC/IX | 75 |

| XENIX root | O2 | 旧 MINIX | 80 |

| XENIX usr | O3 | Linux/MINUX | 81 |

| DOS 16 ビット (32M 以下) | 04 | Linux swap | 82 |

| Extended | 05 | Linux ネイティブ | 83 |

| DOS 16 ビット (32 以上) | 06 | Linux 拡張 | 85 |

| OS/2 HPFS | 07 | Amoeba | 93 |

| AIX | 08 | Amoeba BBT | 94 |

| AIX ブート可能 | 09 | BSD/386 | a5 |

| OS/2 Boot Manager | 0a | OpenBSD | a6 |

| Win95 FAT32 | 0b | NEXTSTEP | a7 |

| Win95 FAT32 (LBA) | 0c | BSDI fs | b7 |

| Win95 FAT16 (LBA) | 0e | BSDI swap | b8 |

| Win95 Extended (LBA) | 0f | Syrinx | c7 |

| Venix 80286 | 40 | CP/M | db |

| Novell | 51 | DOS アクセス | e1 |

| PRep Boot | 41 | DOS R/O | e3 |

| GNU HURD | 63 | DOS セカンダリー | f2 |

| Novell Netware 286 | 64 | BBT | ff |

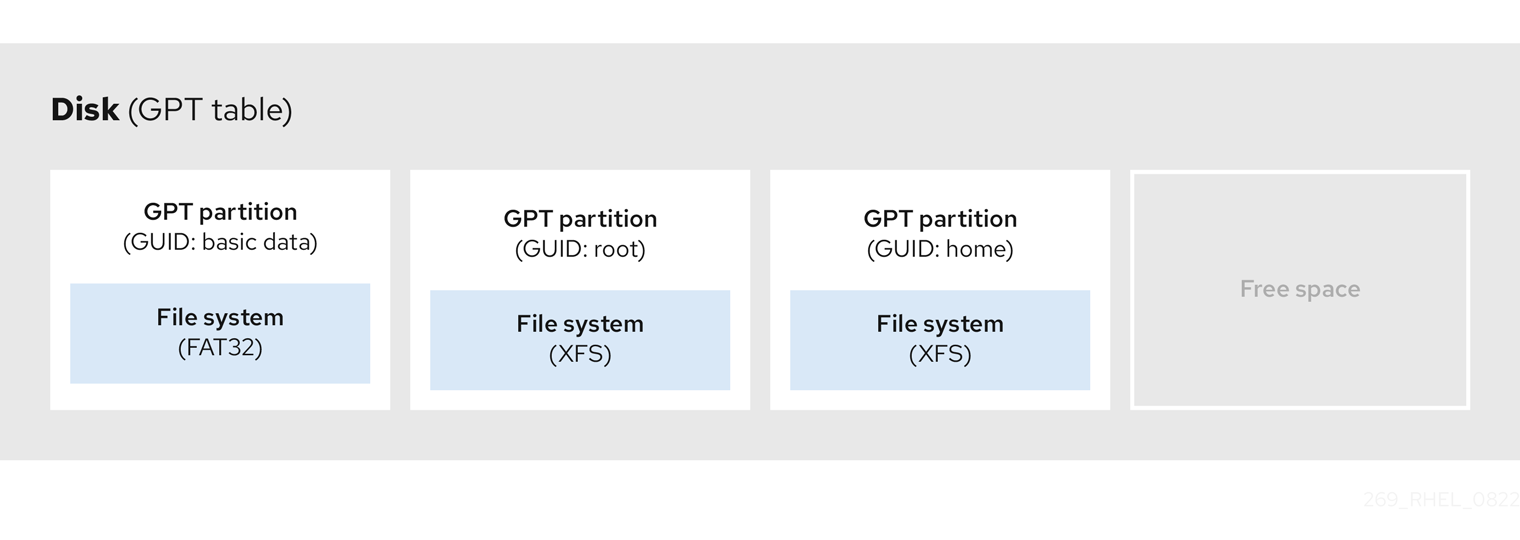

4.7. GUID パーティションテーブル

GUID パーティションテーブル (GPT) は、Globally Unique Identifier (GUID) に基づくパーティション設定スキームです。

GPT は、Mater Boot Record (MBR) パーティションテーブルの制限に対処します。MBR パーティションテーブルは、約 2.2 TB に相当する 2 TiB を超えるストレージに対応できません。代わりに、GPT は大容量のハードディスクをサポートします。アドレス指定可能な最大ディスクサイズは、512b セクタードライブを使用する場合は 8 ZiB、4096b セクタードライブを使用する場合は 64 ZiB です。さらに、デフォルトで、GPT は最大 128 のプライマリーパーティションの作成をサポートします。パーティションテーブルにより多くの領域を割り当てて、プライマリーパーティションの最大量を拡張します。

GPT には GUID に基づくパーティションタイプがあります。特定のパーティションには特定の GUID が必要です。たとえば、Extensible Firmware Interface (EFI) ブートローダーのシステムパーティションには、GUID C12A7328-F81F-11D2-BA4B-00A0C93EC93B が必要です。

GPT ディスクは、論理ブロックアドレス指定 (LBA) とパーティションレイアウトを以下のように使用します。

- MBR ディスクとの下位互換性のために、システムは MBR データ用に GPT の最初のセクター (LBA 0) を予約し、protective MBR という名前を適用します。

プライマリー GPT

- ヘッダーは、デバイスの 2 番目の論理ブロック (LBA 1) から始まります。ヘッダーには、ディスク GUID、プライマリーパーティションテーブルの場所、セカンダリー GPT ヘッダーの場所、および CRC32 チェックサム、およびプライマリーパーティションテーブルが含まれます。また、テーブルにあるパーティションエントリーの数も指定します。

- デフォルトでは、プライマリー GPT には 128 のパーティションエントリーが含まれます。各パーティションには、128 バイトのエントリーサイズ、パーティションタイプ GUID 、一意のパーティション GUID があります。

セカンダリー GPT

- リカバリーの場合は、プライマリーパーティションテーブルが破損した場合にバックアップテーブルとして役立ちます。

- ディスクの最後の論理セクターにはセカンダリー GPT ヘッダーが含まれており、プライマリーヘッダーが破損した場合に備えて GPT 情報を回復します。

以下が含まれます。

- ディスク GUID

- セカンダリーパーティションテーブルとプライマリー GPT ヘッダーの場所

- それ自体の CRC32 チェックサム

- セカンダリーパーティションテーブル

- 可能なパーティションエントリーの数

図4.4 GUID パーティションテーブルを含むディスク

GPT ディスクにブートローダーを正常にインストールするには、BIOS ブートパーティションが存在する必要があります。ディスクにすでに BIOS ブートパーティションが含まれている場合にのみ、再利用が可能です。これには、Anaconda インストールプログラムによって初期化されたディスクが含まれます。

4.8. パーティションタイプ

パーティションタイプを管理する方法は複数あります。

-

fdiskユーティリティーは、16 進数コードを指定することで、あらゆる種類のパーティションタイプに対応します。 -

systemd-gpt-auto-generatorはユニットジェネレーターユーティリティーで、パーティションタイプを使用してデバイスを自動的に識別し、マウントします。 partedユーティリティーは、フラグ を使用してパーティションタイプをマップします。partedユーティリティーは、LVM、swap、RAID など、特定のパーティションタイプのみを処理します。partedユーティリティーは、次のフラグの設定をサポートしています。-

boot -

root -

swap -

hidden -

raid -

lvm -

lba -

legacy_boot -

irst -

esp -

palo

-

parted 3.5 を使用する Red Hat Enterprise Linux 9 では、追加のフラグ chromeos_kernel および bls_boot を使用できます。

parted ユーティリティーは、パーティションを作成するときにオプションでファイルシステムタイプ引数を受け付けます。parted でのパーティションの作成 で、

必要な条件の一覧を参照してください。値を使用して以下を行います。

- MBR にパーティションフラグを設定します。

-

GPT にパーティションの UUID タイプを設定します。たとえば、ファイルシステムタイプの

swap、fat、またはhfsには、異なる GUID が設定されます。デフォルト値は Linux Data GUID です。

この引数では、パーティションのファイルシステムは変更されません。サポート対象フラグと GUID のみ区別します。

次のファイルシステムのタイプがサポートされています。

-

xfs -

ext2 -

ext3 -

ext4 -

fat16 -

fat32 -

hfs -

hfs+ -

linux-swap -

ntfs -

reiserfs

4.9. パーティション命名スキーム

Red Hat Enterprise Linux は、/dev/xxyN 形式のファイル名を持つファイルベースの命名スキームを使用します。

デバイスおよびパーティション名は、以下の構造で設定されています。

/dev/-

すべてのデバイスファイルが含まれるディレクトリーの名前。ハードディスクにはパーティションが含まれるため、すべてのパーティションを表すファイルは

/devにあります。 xx- パーティション名の最初の 2 文字は、パーティションを含むデバイスのタイプを示します。

y-

この文字は、パーティションを含む特定のデバイスを示します。たとえば、

/dev/sdaは最初のハードディスク、/dev/sdbは 2 番目のハードディスクです。ドライブの数が 26 を超えるシステムでは、さらに多くの文字を使用できます (例:/dev/sdaa1)。 N-

最後の文字は、パーティションを表す数字を示します。最初の 4 つのパーティション (プライマリーまたは拡張) のパーティションには、

1から4までの番号が付けられます。論理パーティションは5から始まります。たとえば、/dev/sda3は 1 番目のハードディスクの 3 番目のプライマリーパーティションまたは拡張パーティションで、2 番目のハードディスク上の 2 番目の論理パーティション/dev/sdb6です。ドライブのパーティション番号は、MBR パーティションテーブルにのみ適用されます。N は常にパーティションを意味するものではないことに注意してください。

Red Hat Enterprise Linux が すべて のタイプのディスクパーティションを識別して参照できる場合でも、ファイルシステムを読み取れないため、すべてのパーティションタイプに保存されているデータにアクセスできます。ただし、多くの場合、別のオペレーティングシステム専用のパーティション上にあるデータには問題なくアクセスすることができます。

4.10. マウントポイントとディスクパーティション

Red Hat Enterprise Linux では、各パーティションは、ファイルおよびディレクトリーの単一セットをサポートするのに必要なストレージの一部を形成します。パーティションをマウントすると、指定されたディレクトリー (マウントポイント と呼ばれる) を開始点としてそのパーティションのストレージが利用可能になります。

たとえば、パーティション /dev/sda5 が /usr/ にマウントされている場合、/usr/ 下にあるすべてのファイルとディレクトリーは物理的に /dev/sda5 上に存在することになります。ファイル /usr/share/doc/FAQ/txt/Linux-FAQ は /dev/sda5 にありますが、ファイル /etc/gdm/custom.conf はありません。

また、この例では、/usr/ 以下の 1 つ以上のディレクトリーが他のパーティションのマウントポイントになる可能性もあります。たとえば、/usr/local にマウントされた /dev/sda7 パーティションが含まれる場合、/usr/local/man/whatis は /dev/sda5 ではなく /dev/sda7 にあります。

第5章 パーティションの使用

ディスクパーティション設定を使用して、ディスクを 1 つ以上の論理領域に分割し、各パーティションで個別に作業できるようにします。ハードディスクは、パーティションテーブルの各ディスクパーティションの場所とサイズに関する情報を保存します。このテーブルを使用すると、各パーティションはオペレーティングシステムへの論理ディスクとして表示されます。その後、それらの個々のディスクで読み取りと書き込みを行うことができます。

ブロックデバイスでパーティションを使用する場合のメリットとデメリットの概要については、利点と欠点の概要については 直接または LVM を間に入れて、LUN でパーティション設定を使用するメリットとデメリットは何ですか ? を参照してください。

5.1. parted でディスクにパーティションテーブルを作成

parted ユーティリティーを使用して、より簡単にパーティションテーブルでブロックデバイスをフォーマットできます。

パーティションテーブルを使用してブロックデバイスをフォーマットすると、そのデバイスに保存されているすべてのデータが削除されます。

手順

インタラクティブな

partedシェルを起動します。# parted block-deviceデバイスにパーティションテーブルがあるかどうかを確認します。

# (parted) print

デバイスにパーティションが含まれている場合は、次の手順でパーティションを削除します。

新しいパーティションテーブルを作成します。

# (parted) mklabel table-typetable-type を、使用するパーティションテーブルのタイプに置き換えます。

-

msdos(MBR の場合) -

gpt(GPT の場合)

-

例5.1 GUID パーティションテーブル (GPT) テーブルの作成

ディスクに GPT テーブルを作成するには、次のコマンドを使用します。

# (parted) mklabel gpt

このコマンドを入力すると、変更の適用が開始されます。

パーティションテーブルを表示して、作成されたことを確認します。

# (parted) print

partedシェルを終了します。# (parted) quit

関連情報

-

parted(8)man ページ

5.2. parted でパーティションテーブルの表示

ブロックデバイスのパーティションテーブルを表示して、パーティションレイアウトと個々のパーティションの詳細を確認します。parted ユーティリティーを使用して、ブロックデバイスのパーティションテーブルを表示できます。

手順

partedユーティリティーを起動します。たとえば、次の出力は、デバイス/dev/sdaをリストします。# parted /dev/sda

パーティションテーブルを表示します。

# (parted) print Model: ATA SAMSUNG MZNLN256 (scsi) Disk /dev/sda: 256GB Sector size (logical/physical): 512B/512B Partition Table: msdos Disk Flags: Number Start End Size Type File system Flags 1 1049kB 269MB 268MB primary xfs boot 2 269MB 34.6GB 34.4GB primary 3 34.6GB 45.4GB 10.7GB primary 4 45.4GB 256GB 211GB extended 5 45.4GB 256GB 211GB logical

オプション: 次に調べるデバイスに切り替えます。

# (parted) select block-device

print コマンドの出力の詳細については、以下を参照してください。

Model: ATA SAMSUNG MZNLN256 (scsi)- ディスクタイプ、製造元、モデル番号、およびインターフェイス。

Disk /dev/sda: 256GB- ブロックデバイスへのファイルパスとストレージ容量。

Partition Table: msdos- ディスクラベルの種類。

Number-

パーティション番号。たとえば、マイナー番号 1 のパーティションは、

/dev/sda1に対応します。 StartおよびEnd- デバイスにおけるパーティションの開始場所と終了場所。

Type- 有効なタイプは、メタデータ、フリー、プライマリー、拡張、または論理です。

File system-

ファイルシステムの種類。ファイルシステムの種類が不明な場合は、デバイスの

File systemフィールドに値が表示されません。partedユーティリティーは、暗号化されたデバイスのファイルシステムを認識できません。 Flags-

パーティションのフラグ設定リスト。利用可能なフラグは、

boot、root、swap、hidden、raid、lvm、またはlbaです。

関連情報

-

parted(8)man ページ

5.3. parted でパーティションの作成

システム管理者は、parted ユーティリティーを使用してディスクに新しいパーティションを作成できます。

必要なパーティションは、swap、/boot/、および /(root) です。

前提条件

- ディスクのパーティションテーブル。

- 2TiB を超えるパーティションを作成する場合は、GUID Partition Table (GPT) でディスクをフォーマットしておく。

手順

partedユーティリティーを起動します。# parted block-device現在のパーティションテーブルを表示し、十分な空き領域があるかどうかを確認します。

# (parted) print

- 十分な空き容量がない場合は、パーティションのサイズを変更してください。

パーティションテーブルから、以下を確認します。

- 新しいパーティションの開始点と終了点

- MBR で、どのパーティションタイプにすべきか

新しいパーティションを作成します。

# (parted) mkpart part-type name fs-type start end

-

part-type を

primary、logical、またはextendedに置き換えます。これは MBR パーティションテーブルにのみ適用されます。 - name を任意のパーティション名に置き換えます。これは GPT パーティションテーブルに必要です。

-

fs-type を、

xfs、ext2、ext3、ext4、fat16、fat32、hfs、hfs+、linux-swap、ntfs、またはreiserfsに置き換えます。fs-type パラメーターは任意です。partedユーティリティーは、パーティションにファイルシステムを作成しないことに注意してください。 -

start と end を、パーティションの開始点と終了点を決定するサイズに置き換えます (ディスクの開始からカウントします)。

512MiB、20GiB、1.5TiBなどのサイズ接尾辞を使用できます。デフォルトサイズの単位はメガバイトです。

例5.2 小さなプライマリーパーティションの作成

MBR テーブルに 1024MiB から 2048MiB までのプライマリーパーティションを作成するには、次のコマンドを使用します。

# (parted) mkpart primary 1024MiB 2048MiB

コマンドを入力すると、変更の適用が開始されます。

-

part-type を

パーティションテーブルを表示して、作成されたパーティションのパーティションタイプ、ファイルシステムタイプ、サイズが、パーティションテーブルに正しく表示されていることを確認します。

# (parted) print

partedシェルを終了します。# (parted) quit

新規デバイスノードを登録します。

# udevadm settle

カーネルが新しいパーティションを認識していることを確認します。

# cat /proc/partitions

関連情報

-

parted(8)man ページ - parted でディスクにパーティションテーブルを作成

- parted でパーティションのサイズ変更

5.4. fdisk でパーティションタイプの設定

fdisk ユーティリティーを使用して、パーティションタイプまたはフラグを設定できます。

前提条件

- ディスク上のパーティション。

手順

インタラクティブな

fdiskシェルを起動します。# fdisk block-device現在のパーティションテーブルを表示して、パーティションのマイナー番号を確認します。

Command (m for help): print現在のパーティションタイプは

Type列で、それに対応するタイプ ID はId列で確認できます。パーティションタイプコマンドを入力し、マイナー番号を使用してパーティションを選択します。

Command (m for help): type Partition number (1,2,3 default 3): 2

オプション: リストを 16 進数コードで表示します。

Hex code (type L to list all codes): Lパーティションタイプを設定します。

Hex code (type L to list all codes): 8e変更を書き込み、

fdiskシェルを終了します。Command (m for help): write The partition table has been altered. Syncing disks.変更を確認します。

# fdisk --list block-device

5.5. parted でパーティションのサイズ変更

parted ユーティリティーを使用して、パーティションを拡張して未使用のディスク領域を利用したり、パーティションを縮小してその容量をさまざまな目的に使用したりできます。

前提条件

- パーティションを縮小する前にデータをバックアップする。

- 2TiB を超えるパーティションを作成する場合は、GUID Partition Table (GPT) でディスクをフォーマットしておく。

- パーティションを縮小する場合は、サイズを変更したパーティションより大きくならないように、最初にファイルシステムを縮小しておく。

XFS は縮小に対応していません。

手順

partedユーティリティーを起動します。# parted block-device現在のパーティションテーブルを表示します。

# (parted) print

パーティションテーブルから、以下を確認します。

- パーティションのマイナー番号。

- 既存のパーティションの位置とサイズ変更後の新しい終了点。

パーティションのサイズを変更します。

# (parted) resizepart 1 2GiB

- 1 を、サイズを変更するパーティションのマイナー番号に置き換えます。

-

2 を、サイズを変更するパーティションの新しい終了点を決定するサイズに置き換えます (ディスクの開始からカウントします)。

512MiB、20GiB、1.5TiBなどのサイズ接尾辞を使用できます。デフォルトサイズの単位はメガバイトです。

パーティションテーブルを表示して、サイズ変更したパーティションのサイズが、パーティションテーブルで正しく表示されていることを確認します。

# (parted) print

partedシェルを終了します。# (parted) quit

カーネルが新しいパーティションを登録していることを確認します。

# cat /proc/partitions

- オプション: パーティションを拡張した場合は、そこにあるファイルシステムも拡張します。

関連情報

-

parted(8)man ページ - parted でディスクにパーティションテーブルを作成

- ext4 ファイルシステムのサイズ変更

- XFS ファイルシステムのサイズの拡大

5.6. parted でパーティションの削除

parted ユーティリティーを使用すると、ディスクパーティションを削除して、ディスク領域を解放できます。

パーティションを削除すると、そのパーティションに保存されているすべてのデータが削除されます。

手順

インタラクティブな

partedシェルを起動します。# parted block-device-

block-device を、パーティションを削除するデバイスへのパス (例:

/dev/sda) に置き換えます。

-

block-device を、パーティションを削除するデバイスへのパス (例:

現在のパーティションテーブルを表示して、削除するパーティションのマイナー番号を確認します。

(parted) print

パーティションを削除します。

(parted) rm minor-number- minor-number を、削除するパーティションのマイナー番号に置き換えます。

このコマンドを実行すると、すぐに変更の適用が開始されます。

パーティションテーブルからパーティションが削除されたことを確認します。

(parted) print

partedシェルを終了します。(parted) quit

パーティションが削除されたことをカーネルが登録していることを確認します。

# cat /proc/partitions

-

パーティションが存在する場合は、

/etc/fstabファイルからパーティションを削除します。削除したパーティションを宣言している行を見つけ、ファイルから削除します。 システムが新しい

/etc/fstab設定を登録するように、マウントユニットを再生成します。# systemctl daemon-reload

スワップパーティション、または LVM の一部を削除した場合は、カーネルコマンドラインからパーティションへの参照をすべて削除します。

アクティブなカーネルオプションを一覧表示し、削除されたパーティションを参照するオプションがないか確認します。

# grubby --info=ALL

削除されたパーティションを参照するカーネルオプションを削除します。

# grubby --update-kernel=ALL --remove-args="option"

アーリーブートシステムに変更を登録するには、

initramfsファイルシステムを再構築します。# dracut --force --verbose

関連情報

-

parted(8)man ページ

第6章 ディスクを再設定するストラテジー

ディスクのパーティションを再設定する方法は複数あります。これには以下が含まれます。

- パーティションが分割されていない空き領域が利用できる。

- 未使用のパーティションが利用可能である。

- アクティブに使用されているパーティションの空き領域が利用可能である。

以下の例は、わかりやすくするために単純化されており、実際に Red Hat Enterprise Linux をインストールするときの正確なパーティションレイアウトは反映していません。

6.1. パーティションが分割されていない空き領域の使用

すでに定義されているパーティションはハードディスク全体にまたがらないため、定義されたパーティションには含まれない未割り当ての領域が残されます。次の図は、これがどのようになるかを示しています。

図6.1 パーティションが分割されていない空き領域があるディスク

最初の図は、1 つのプライマリーパーティションと未割り当て領域のある未定義のパーティションを持つディスクを表しています。2 番目の図は、スペースが割り当てられた 2 つの定義済みパーティションを持つディスクを表しています。

未使用のハードディスクもこのカテゴリーに分類されます。唯一の違いは、すべて の領域が定義されたパーティションの一部ではないことです。

新しいディスクでは、未使用の領域から必要なパーティションを作成できます。ほとんどのオペレーティングシステムは、ディスクドライブ上の利用可能な領域をすべて取得するように設定されています。

6.2. 未使用パーティションの領域の使用

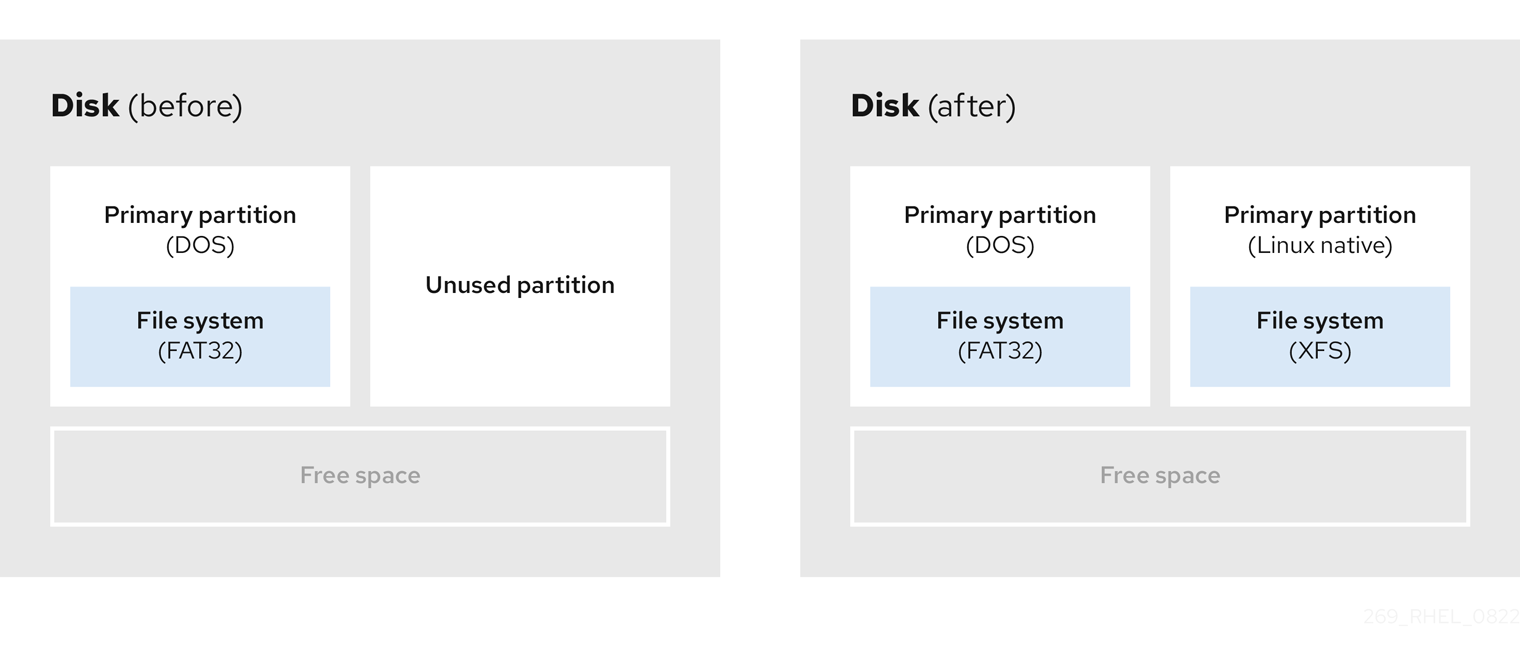

次の例の最初の図は、未使用のパーティションを持つディスクを表しています。2 番目の図は、Linux の未使用パーティションの再割り当てを表しています。

図6.2 未使用のパーティションがあるディスク

未使用のパーティションに割り当てられた領域を使用するには、パーティションを削除してから、代わりに適切な Linux パーティションを作成します。または、インストールプロセス時に未使用のパーティションを削除し、新しいパーティションを手動で作成します。

6.3. アクティブなパーティションの空き領域の使用

すでに使用されているアクティブなパーティションには、必要な空き領域が含まれているため、このプロセスの管理は困難な場合があります。ほとんどの場合、ソフトウェアが事前にインストールされているコンピューターのハードディスクには、オペレーティングシステムとデータを保持する大きなパーティションが 1 つ含まれます。

アクティブなパーティションでオペレーティングシステム (OS) を使用する場合は、OS を再インストールする必要があります。ソフトウェアが事前にインストールされている一部のコンピューターには、元の OS を再インストールするためのインストールメディアが含まれていないことに注意してください。元のパーティションと OS インストールを破棄する前に、これが OS に当てはまるか確認してください。

使用可能な空き領域の使用を最適化するには、破壊的または非破壊的なパーティション再設定の方法を使用できます。

6.3.1. 破壊的な再設定

破壊的なパーティション再設定は、ハードドライブのパーティションを破棄し、代わりにいくつかの小さなパーティションを作成します。この方法は完全にコンテンツを削除するため、元のパーティションから必要なデータをバックアップします。

既存のオペレーティングシステム用に小規模なパーティションを作成すると、以下が可能になります。

- ソフトウェアをの再インストール。

- データの復元。

- Red Hat Enterprise Linux インストールの開始。

以下の図は、破壊的なパーティション再設定の方法を使用を簡潔に示しています。

図6.3 ディスク上での破壊的な再パーティション処理

このメソッドは、元のパーティションに保存されたデータをすべて削除します。

6.3.2. 非破壊的な再パーティション

非破壊的なパーティション再設定では、データの損失なしにパーティションのサイズを変更します。この方法は信頼性できますが、大きなドライブでは処理に時間がかかります。

以下は、破壊的なパーティション再設定の開始に役立つメソッドのリストです。

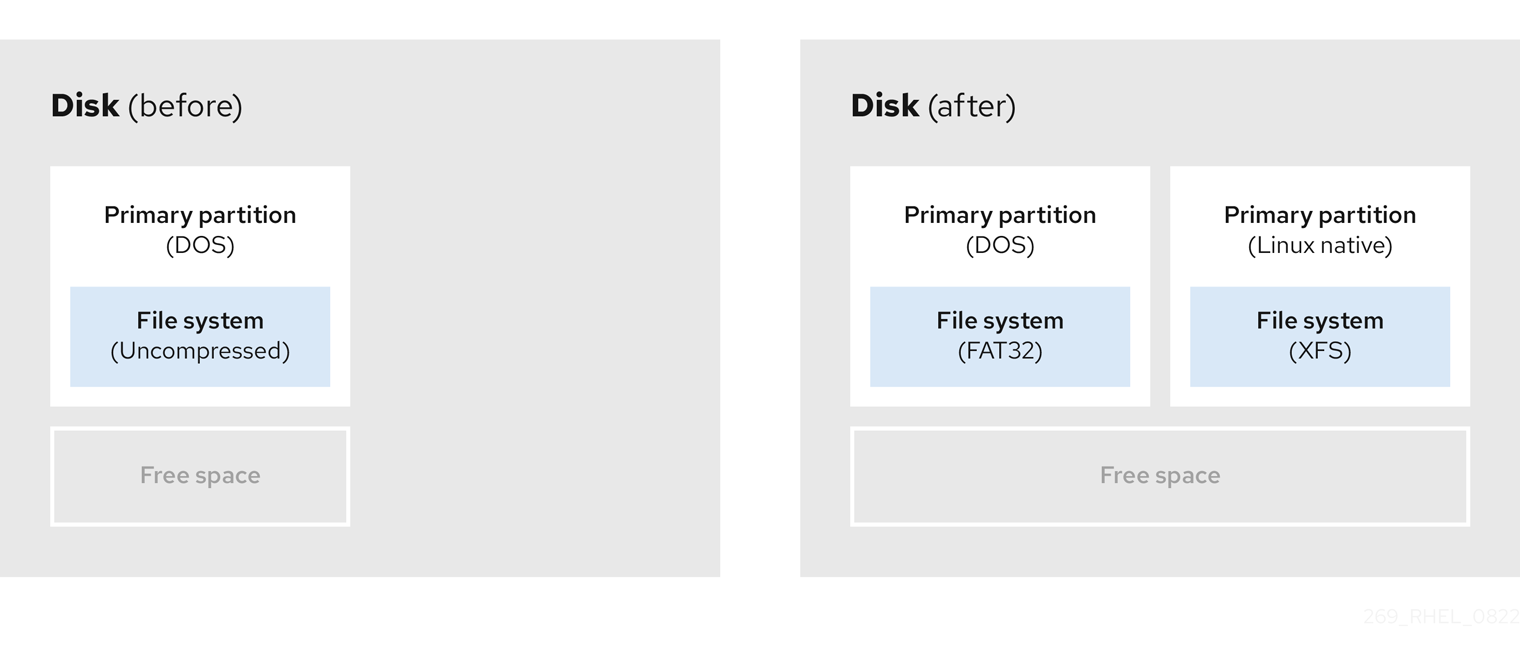

- 既存データの圧縮

一部のデータの保存場所は変更できません。これにより、必要なサイズへのパーティションのサイズ変更が妨げられ、最終的に破壊的なパーティション再設定プロセスが必要になる可能性があります。既存のパーティションでデータを圧縮すると、必要に応じてパーティションのサイズを変更できます。また、使用可能な空き容量を最大化することもできます。

以下の図は、このプロセスを簡略化したものです。

図6.4 ディスク上でのデータ圧縮

データ損失の可能性を回避するには、圧縮プロセスを続行する前にバックアップを作成します。

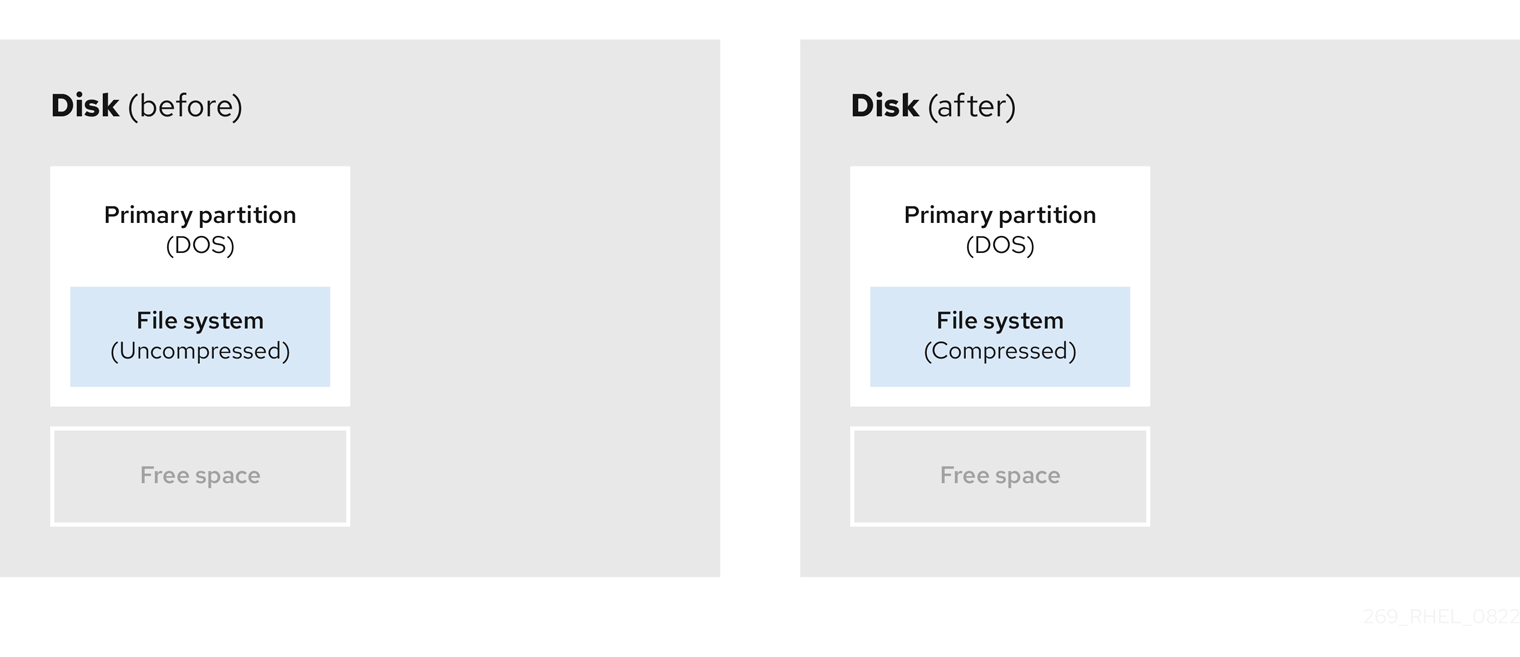

- 既存パーティションのサイズ変更

既存のパーティションのサイズを変更すると、より多くの領域を解放できます。結果は、サイズ変更ソフトウェアにより異なります。多くの場合、元のパーティションと同じタイプのフォーマットされていない新しいパーティションを作成できます。

サイズ変更後の手順は、使用するソフトウェアにより異なります。以下の例では、新しい DOS (Disk Operating System) パーティションを削除し、代わりに Linux パーティションを作成することを推奨します。サイズ変更プロセスを開始する前に、何がディスクに最適か確認してください。

図6.5 ディスク上でのパーティションのサイズ変更

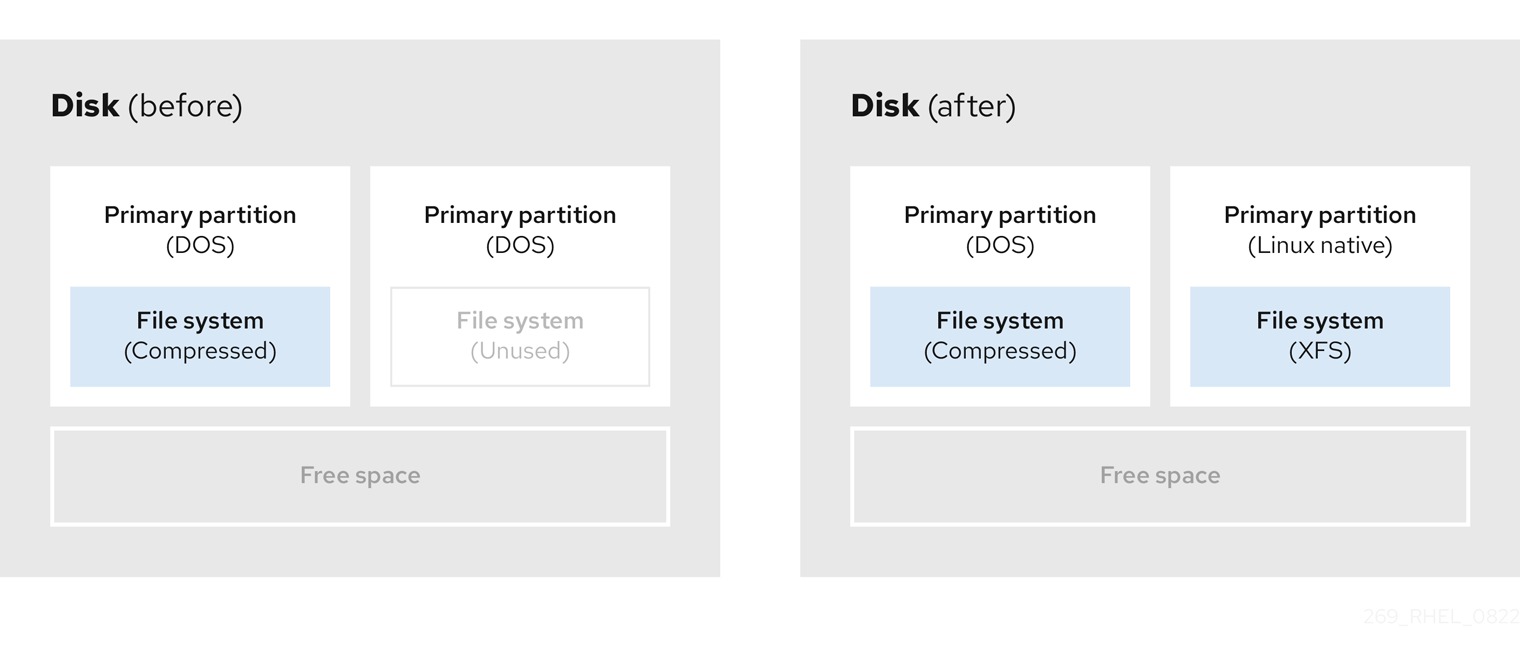

- オプション: 新規パーティションの作成

一部のサイズ変更ソフトウェアは、Linux ベースのシステムをサポートしています。この場合、サイズ変更後に新たに作成されたパーティションを削除する必要はありません。新しいパーティションの作成方法は、使用するソフトウェアによって異なります。

以下の図は、新しいパーティションを作成する前後のディスクの状態を示しています。

図6.6 最終パーティション設定のディスク

第7章 iSCSI ターゲットの設定

Red Hat Enterprise Linux では、コマンドラインインターフェイスとして targetcli シェルを使用し、以下の操作を行います。

- iSCSI ハードウェアを使用できるように iSCSI ストレージ相互接続を追加、削除、表示、監視します。

- ファイル、ボリューム、ローカル SCSI デバイス、またはリモートシステムへの RAM ディスクで対応しているローカルストレージリソースをエクスポートします。

targetcli ツールには、組み込みタブ補完、自動補完サポート、インラインドキュメントなどのツリーベースのレイアウトがあります。

7.1. targetcli のインストール

targetcli ツールをインストールして、iSCSI ストレージの相互接続を追加、監視、削除します。

手順

targetcliツールをインストールします。# dnf install targetcli

ターゲットサービスを起動します。

# systemctl start target

システムの起動時にターゲットサービスが起動するように設定するには、次のコマンドを実行します。

# systemctl enable target

ファイアウォールの

3260ポートを開き、ファイアウォール設定を再読み込みします。# firewall-cmd --permanent --add-port=3260/tcp Success # firewall-cmd --reload Success

検証

targetcliレイアウトを表示します。# targetcli /> ls o- /........................................[...] o- backstores.............................[...] | o- block.................[Storage Objects: 0] | o- fileio................[Storage Objects: 0] | o- pscsi.................[Storage Objects: 0] | o- ramdisk...............[Storage Objects: 0] o- iscsi...........................[Targets: 0] o- loopback........................[Targets: 0]

関連情報

-

man ページの

targetcli(8)

7.2. iSCSI ターゲットの作成

iSCSI ターゲットを作成すると、クライアントの iSCSI イニシエーターが、サーバーのストレージデバイスにアクセスできるようになります。ターゲットとイニシエーターにはどちらも一意の識別名があります。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。

手順

iSCSI ディレクトリーに移動します。

/> iscsi/

注記cdコマンドは、ディレクトリーを変更したり、移動するパスのリストを表示するために使用されます。iSCSI ターゲットを作成するには、以下のいずれかのオプションを使用します。

デフォルトのターゲット名を使用した iSCSI ターゲットの作成:

/iscsi> create Created target iqn.2003-01.org.linux-iscsi.hostname.x8664:sn.78b473f296ff Created TPG1

特定の名前を使用した iSCSI ターゲットの作成:

/iscsi> create iqn.2006-04.com.example:444 Created target iqn.2006-04.com.example:444 Created TPG1 Here

iqn.2006-04.com.example:444is target_iqn_nameiqn.2006-04.com.example:444 を、特定のターゲット名に置き換えます。

新たに作成されたターゲットを確認します。

/iscsi> ls o- iscsi.......................................[1 Target] o- iqn.2006-04.com.example:444................[1 TPG] o- tpg1...........................[enabled, auth] o- acls...............................[0 ACL] o- luns...............................[0 LUN] o- portals.........................[0 Portal]

関連情報

-

man ページの

targetcli(8)

7.3. iSCSI バックストア

iSCSI バックストアは、エクスポートした LUN のデータをローカルマシンに保存するさまざまな方法に対応します。ストレージオブジェクトを作成して、バックストアが使用するリソースを定義します。

管理者は、LIO (Linux-IO) が対応する以下のバックストアデバイスのいずれかを選択できます。

fileioバックストア-

ローカルファイルシステム上の通常のファイルをディスクイメージとして使用する場合は、

fileioストレージオブジェクトを作成します。fileioバックストアの作成については、fileio ストレージオブジェクトの作成 を参照してください。 blockバックストア-

ローカルのブロックデバイスおよび論理デバイスを使用している場合には、

ブロックストレージオブジェクトを作成します。blockバックストアの作成については、ブロックストレージオブジェクトの作成 を参照してください。 pscsiバックストア-

ストレージオブジェクトが SCSI コマンドの直接パススルーに対応している場合は、

pscsiストレージオブジェクトを作成します。pscsiバックストアの作成については、pscsi ストレージオブジェクトの作成 を参照してください。 ramdiskバックストア-

一時的な RAM 対応デバイスを作成する場合は、

ramdiskストレージオブジェクトを作成します。ramdiskバックストアの作成については、メモリーコピーの RAM ディスクストレージオブジェクトの作成 を参照してください。

関連情報

-

man ページの

targetcli(8)

7.4. fileio ストレージオブジェクトの作成

fileio ストレージオブジェクトは、write_back 操作または write_ thru 操作のいずれかに対応します。write_back 操作では、ローカルファイルシステムキャッシュが有効になります。これにより、パフォーマンスが向上しますが、データの損失のリスクが高まります。

write_thru 操作を優先させるために、write_back=false を使用して write_back 操作を無効にすることが推奨されます。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。

手順

backstores/ディレクトリーからfileio/に移動します。/> backstores/fileio

fileioストレージオブジェクトを作成します。/backstores/fileio> create file1 /tmp/disk1.img 200M write_back=false Created fileio file1 with size 209715200

検証

作成された

fileioストレージオブジェクトを確認します。/backstores/fileio> ls

関連情報

-

man ページの

targetcli(8)

7.5. ブロックストレージオブジェクトの作成

ブロックドライバーを使用すると、/sys/block/ ディレクトリーにあるブロックデバイスを LIO (Linux-IO) で使用できます。これには、HDD、SSD、CD、DVD などの物理デバイス、およびソフトウェアやハードウェアの RAID ボリューム、LVM ボリュームなどの論理デバイスが含まれます。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。

手順

backstores/ディレクトリーからblock/に移動します。/> backstores/block/

blockバックストアを作成します。/backstores/block> create name=block_backend dev=/dev/sdb Generating a wwn serial. Created block storage object block_backend using /dev/vdb.

検証

作成された

blockストレージオブジェクトを確認します。/backstores/block> ls

注記blockバックストアは、論理ボリュームにも作成できます。

関連情報

-

man ページの

targetcli(8)

7.6. pscsi ストレージオブジェクトの作成

SCSI エミュレーションなしで SCSI コマンドの直接パススルーに対応するストレージオブジェクト、および /proc/scsi/scsi に lsscsi とともに表示される基盤の SCSI デバイス (SAS ハードドライブなど) で SCSI コマンドの直接パススルーに対応するストレージオブジェクトは、バックストアとして設定できます。このサブシステムでは、SCSI-3 以降に対応しています。

pscsi は、上級ユーザーのみが使用してください。非対称論理ユニット割り当て (ALUA) や永続予約 (VMware ESX や vSphere で使用される永続予約など) は、通常はデバイスのファームウェアに実装されず、誤作動やクラッシュが発生する原因となることがあります。確信が持てない場合は、実稼働の設定に block バックストアを使用してください。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。

手順

backstores/ディレクトリーからpscsi/に移動します。/> backstores/pscsi/

この例では、

/dev/sr0を使用して物理 SCSI デバイスである TYPE_ROM デバイスのpscsiバックストアを作成します。/backstores/pscsi> create name=pscsi_backend dev=/dev/sr0 Generating a wwn serial. Created pscsi storage object pscsi_backend using /dev/sr0

検証

作成した

pscsiストレージオブジェクトを確認します。/backstores/pscsi> ls

関連情報

-

man ページの

targetcli(8)

7.7. メモリーコピーの RAM ディスクストレージオブジェクトの作成

メモリーコピー RAM ディスク (ramdisk) は、完全な SCSI エミュレーションと、イニシエーターのメモリーコピーを使用した個別のメモリーマッピングが含まれる RAM ディスクを提供します。これにより、マルチセッションの機能を利用できます。これは、特に実稼働環境での高速で不揮発性の大容量ストレージで有用です。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。

手順

backstores/ディレクトリーからramdisk/に移動します。/> backstores/ramdisk/

1GB RAM ディスクバックストアを作成します。

/backstores/ramdisk> create name=rd_backend size=1GB Generating a wwn serial. Created rd_mcp ramdisk rd_backend with size 1GB.

検証

作成した

ramdiskストレージオブジェクトを確認します。/backstores/ramdisk> ls

関連情報

-

man ページの

targetcli(8)

7.8. iSCSI ポータルの作成

iSCSI ポータルを作成すると、ターゲットの有効性を維持するターゲットに IP アドレスとポートが追加されます。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。 - ターゲットポータルグループ (TPG) に関連付けられた iSCSI ターゲット。詳細は、iSCSI ターゲットの作成 を参照してください。

手順

TPG ディレクトリーに移動します。

/iscsi> iqn.2006-04.example:444/tpg1/

iSCSI ポータルを作成するには、以下のいずれかのオプションを使用します。

デフォルトポータルを作成するには、デフォルトの iSCSI ポート

3260を使用し、ターゲットがそのポートのすべての IP アドレスをリッスンできるようにします。/iscsi/iqn.20...mple:444/tpg1> portals/ create Using default IP port 3260 Binding to INADDR_Any (0.0.0.0) Created network portal 0.0.0.0:3260

注記iSCSI ターゲットが作成されると、デフォルトのポータルも作成されます。このポータルは、デフォルトのポート番号

0.0.0.0:3260ですべての IP アドレスをリッスンするように設定されます。デフォルトのポータルを削除するには、次のコマンドを使用します。

/iscsi/iqn-name/tpg1/portals delete ip_address=0.0.0.0 ip_port=3260

特定の IP アドレスを使用したポータルの作成:

/iscsi/iqn.20...mple:444/tpg1> portals/ create 192.168.122.137 Using default IP port 3260 Created network portal 192.168.122.137:3260

検証

新たに作成されたポータルを確認します。

/iscsi/iqn.20...mple:444/tpg1> ls o- tpg.................................. [enambled, auth] o- acls ......................................[0 ACL] o- luns ......................................[0 LUN] o- portals ................................[1 Portal] o- 192.168.122.137:3260......................[OK]

関連情報

-

man ページの

targetcli(8)

7.9. iSCSI LUN の作成

論理ユニット番号 (LUN) は、iSCSI バックストアで対応している物理デバイスです。各 LUN には固有の番号があります。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。 - ターゲットポータルグループ (TPG) に関連付けられた iSCSI ターゲット。詳細は、iSCSI ターゲットの作成 を参照してください。

- 作成したストレージオブジェクト。詳細は、iSCSI バックストア を参照してください。

手順

作成したストレージオブジェクトの LUN を作成します。

/iscsi/iqn.20...mple:444/tpg1> luns/ create /backstores/ramdisk/rd_backend Created LUN 0. /iscsi/iqn.20...mple:444/tpg1> luns/ create /backstores/block/block_backend Created LUN 1. /iscsi/iqn.20...mple:444/tpg1> luns/ create /backstores/fileio/file1 Created LUN 2.

作成した LUN を確認します。

/iscsi/iqn.20...mple:444/tpg1> ls o- tpg.................................. [enambled, auth] o- acls ......................................[0 ACL] o- luns .....................................[3 LUNs] | o- lun0.........................[ramdisk/ramdisk1] | o- lun1.................[block/block1 (/dev/vdb1)] | o- lun2...................[fileio/file1 (/foo.img)] o- portals ................................[1 Portal] o- 192.168.122.137:3260......................[OK]デフォルトの LUN 名は

0から始まります。重要デフォルトでは、読み書きパーミッションを持つ LUN が作成されます。ACL の作成後に新しい LUN が追加されると、LUN は自動的に利用可能なすべての ACL にマッピングされ、セキュリティー上のリスクが発生します。読み取り専用権限を持つ LUN の作成については、Creating a read-only iSCSI LUN を参照してください。

- ACL を設定します。詳細は、iSCSI ACL の作成 を参照してください。

関連情報

-

man ページの

targetcli(8)

7.10. 読み取り専用の iSCSI LUN の作成

デフォルトでは、読み書きパーミッションを持つ LUN が作成されます。この手順では、読み取り専用の LUN を作成する方法を説明します。

前提条件

-

targetcliをインストールして、実行している。詳細は、targetcli のインストール を参照してください。 - ターゲットポータルグループ (TPG) に関連付けられた iSCSI ターゲット。詳細は、iSCSI ターゲットの作成 を参照してください。

- 作成したストレージオブジェクト。詳細は、iSCSI バックストア を参照してください。

手順

読み取り専用パーミッションを設定します。

/> set global auto_add_mapped_luns=false Parameter auto_add_mapped_luns is now 'false'.

これにより、LUN が既存の ACL へ自動的にマッピングされないようになり、LUN を手動でマッピングできるようになります。

initiator_iqn_name ディレクトリーに移動します。

/> iscsi/target_iqn_name/tpg1/acls/initiator_iqn_name/LUN を作成します。

/iscsi/target_iqn_name/tpg1/acls/initiator_iqn_name> create mapped_lun=next_sequential_LUN_number tpg_lun_or_backstore=backstore write_protect=1たとえば、以下のようになります。

/iscsi/target_iqn_name/tpg1/acls/2006-04.com.example:888> create mapped_lun=1 tpg_lun_or_backstore=/backstores/block/block2 write_protect=1 Created LUN 1. Created Mapped LUN 1.

作成した LUN を確認します。

/iscsi/target_iqn_name/tpg1/acls/2006-04.com.example:888> ls o- 2006-04.com.example:888 .. [Mapped LUNs: 2] | o- mapped_lun0 .............. [lun0 block/disk1 (rw)] | o- mapped_lun1 .............. [lun1 block/disk2 (ro)]

(mapped_lun0 の (

rw) とは異なり) mapped_lun1 行の最後に (ro) が表示されますが、これは、読み取り専用であることを表しています。- ACL を設定します。詳細は、iSCSI ACL の作成 を参照してください。

関連情報

-

man ページの

targetcli(8)

7.11. iSCSI ACL の作成

targetcli サービスは、アクセスコントロールリスト (ACL) を使用してアクセスルールを定義し、各イニシエーターに論理ユニット番号 (LUN) へのアクセスを許可します。

ターゲットとイニシエーターにはどちらも一意の識別名があります。ACL を設定するには、イニシエーターの一意の名前を知っている必要があります。iscsi-initiator-utils パッケージによって提供される /etc/iscsi/initiatorname.iscsi ファイルには、iSCSI イニシエーター名が含まれています。

前提条件

-

targetcliサービスが インストール され、実行されている。 - ターゲットポータルグループ (TPG) に関連付けられた iSCSI ターゲット。

手順

- オプション: ACL への LUN の自動マッピングを無効にするには、読み取り専用の iSCSI LUN の作成 を参照してください。

acls ディレクトリーへ移動します。

/> iscsi/target_iqn_name/tpg_name/acls/ACL を作成するには、以下のいずれかのオプションを使用します。

イニシエーターの

/etc/iscsi/initiatorname.iscsiファイルの initiator_iqn_name を使用します。iscsi/target_iqn_name/tpg_name/acls> create initiator_iqn_name Created Node ACL for initiator_iqn_name Created mapped LUN 2. Created mapped LUN 1. Created mapped LUN 0.

Custom_name を使用し、それに一致するようにイニシエーターを更新します。

iscsi/target_iqn_name/tpg_name/acls> create custom_name Created Node ACL for custom_name Created mapped LUN 2. Created mapped LUN 1. Created mapped LUN 0.

イニシエーター名の更新については、iSCSI イニシエーターの作成 を参照してください。

検証

作成した ACL を確認します。

iscsi/target_iqn_name/tpg_name/acls> ls o- acls .................................................[1 ACL] o- target_iqn_name ....[3 Mapped LUNs, auth] o- mapped_lun0 .............[lun0 ramdisk/ramdisk1 (rw)] o- mapped_lun1 .................[lun1 block/block1 (rw)] o- mapped_lun2 .................[lun2 fileio/file1 (rw)]

関連情報

-

man ページの

targetcli(8)

7.12. ターゲットのチャレンジハンドシェイク認証プロトコルの設定

Challenge-Handshake Authentication Protocol (CHAP) を使用すると、パスワードでターゲットを保護できます。イニシエーターは、このパスワードでターゲットに接続できることを認識している必要があります。

前提条件

- iSCSI ACL を作成している。詳細は、iSCSI ACL の作成 を参照してください。

手順

属性認証を設定します。

/iscsi/iqn.20...mple:444/tpg1> set attribute authentication=1 Parameter authentication is now '1'.

useridとpasswordを設定します。/tpg1> set auth userid=redhat Parameter userid is now 'redhat'. /iscsi/iqn.20...689dcbb3/tpg1> set auth password=redhat_passwd Parameter password is now 'redhat_passwd'.

関連情報

-

man ページの

targetcli(8)

7.13. targetcli ツールで iSCSI オブジェクトの削除

この手順では、targetcli ツールを使用して iSCSI オブジェクトを削除する方法を説明します。

手順

ターゲットからログオフします。

# iscsiadm -m node -T iqn.2006-04.example:444 -uターゲットへのログイン方法は、iSCSI イニシエーターの作成 を参照してください。

ACL、LUN、およびポータルのすべてを含め、ターゲット全体を削除します。

/> iscsi/ delete iqn.2006-04.com.example:444iqn.2006-04.com.example:444 を target_iqn_name に置き換えます。

iSCSI バックストアを削除するには、次のコマンドを実行します。

/> backstores/backstore-type/ delete block_backend

-

backstore-type を

fileio、block、pscsi、またはramdiskに置き換えます。 - block_backend を、削除する バックストア名 に置き換えます。

-

backstore-type を

ACL などの iSCSI ターゲットの一部を削除するには、次のコマンドを実行します。

/> /iscsi/iqn-name/tpg/acls/ delete iqn.2006-04.com.example:444

検証

変更を表示します。

/> iscsi/ ls

関連情報

-

man ページの

targetcli(8)

第8章 iSCSI イニシエーターの設定

iSCSI イニシエーターは iSCSI ターゲットに接続するセッションを形成します。デフォルトでは、iSCSI サービスは起動に時間がかかり、iscsiadm コマンドの実行後にサービスが起動します。root が iSCSI デバイスにない場合や、node.startup = automatic でマークされたノードがない場合は、iscsiadm コマンドが実行するまで iSCSI サービスが起動しなくなります。これには、カーネルモジュール iscsid または iscsi の起動が必要になります。

root で systemctl start iscsid.service コマンドを実行し、iscsid デーモンを強制的に実行して、iSCSI カーネルモジュールを読み込みます。

8.1. iSCSI イニシエーターの作成

サーバー上のストレージデバイスにアクセスするために、iSCSI ターゲットに接続するための iSCSI イニシエーターを作成します。

前提条件

iSCSI ターゲットのホスト名と IP アドレスがあります。

- 外部ソフトウェアが作成したストレージターゲットに接続している場合は、ストレージ管理者からターゲットのホスト名と IP アドレスを取得します。

- iSCSI ターゲットを作成する場合は、iSCSI ターゲットの作成 を参照してください。

手順

クライアントマシンに

iscsi-initiator-utilsをインストールします。# dnf install iscsi-initiator-utils

イニシエーター名を確認します。

# cat /etc/iscsi/initiatorname.iscsi InitiatorName=iqn.2006-04.com.example:888

iSCSI ACL の作成 で ACL にカスタム名を指定した場合は、ACL と一致するようにイニシエーター名を更新します。

/etc/iscsi/initiatorname.iscsiファイルを開き、イニシエーター名を変更します。# vi /etc/iscsi/initiatorname.iscsi InitiatorName=custom-nameiscsidサービスを再起動します。# systemctl restart iscsid

ターゲットを検出し、表示されたターゲット IQN でターゲットにログインします。

# iscsiadm -m discovery -t st -p 10.64.24.179 10.64.24.179:3260,1 iqn.2006-04.example:444 # iscsiadm -m node -T iqn.2006-04.example:444 -l Logging in to [iface: default, target: iqn.2006-04.example:444, portal: 10.64.24.179,3260] (multiple) Login to [iface: default, target: iqn.2006-04.example:444, portal: 10.64.24.179,3260] successful.

10.64.24.179 を、target-ip-address に置き換えます。

この手順では、iSCSI ACL の作成 で説明されているように、それぞれのイニシエーター名が ACL に追加されている場合は、同じターゲットに接続されている任意の数のイニシエーターに対してこの手順を使用できます。

iSCSI ディスク名を確認して、この iSCSI ディスクにファイルシステムを作成します。

# grep "Attached SCSI" /var/log/messages # mkfs.ext4 /dev/disk_namedisk_name を、

/var/log/messagesファイルに記載されている iSCSI ディスク名に置き換えます。ファイルシステムをマウントします。

# mkdir /mount/point # mount /dev/disk_name /mount/point

/mount/point を、パーティションのマウントポイントに置き換えます。

システムの起動時にファイルシステムを自動的にマウントするように

/etc/fstabを編集します。# vi /etc/fstab /dev/disk_name /mount/point ext4 _netdev 0 0disk_name を iSCSI ディスク名に置き換え、/mount/point を、パーティションのマウントポイントに置き換えます。

関連情報

-

man ページの

targetcli(8)およびiscsiadm(8)

8.2. イニシエーター用のチャレンジハンドシェイク認証プロトコルの設定

Challenge-Handshake Authentication Protocol (CHAP) を使用すると、パスワードでターゲットを保護できます。イニシエーターは、このパスワードでターゲットに接続できることを認識している必要があります。

前提条件

- iSCSI イニシエーターを作成しました。詳細は、iSCSI イニシエーターの作成 を参照してください。

-

ターゲットの

CHAPを設定します。詳細は、ターゲットのチャレンジハンドシェイク認証プロトコルの設定 を参照してください。

手順

iscsid.confファイルで CHAP 認証を有効にします。# vi /etc/iscsi/iscsid.conf node.session.auth.authmethod = CHAP

デフォルトでは、

node.session.auth.authmethodはNoneに設定されています。ターゲットの

usernameとpasswordをiscsid.confファイルに追加します。node.session.auth.username = redhat node.session.auth.password = redhat_passwd

iscsidデーモンを起動します。# systemctl start iscsid.service

関連情報

-

man ページの

iscsiadm(8)

8.3. iscsiadm ユーティリティーで iSCSI セッションの監視

この手順では、iscsiadm ユーティリティーを使用して iscsi セッションを監視する方法を説明します。

デフォルトでは、iSCSI サービスの起動は lazily で、iscsiadm コマンドの実行後にサービスが起動します。root が iSCSI デバイスにない場合や、node.startup = automatic でマークされたノードがない場合は、iscsiadm コマンドが実行するまで iSCSI サービスが起動しなくなります。これには、カーネルモジュール iscsid または iscsi の起動が必要になります。

root で systemctl start iscsid.service コマンドを実行し、iscsid デーモンを強制的に実行して、iSCSI カーネルモジュールを読み込みます。

手順

クライアントマシンに

iscsi-initiator-utilsをインストールします。# dnf install iscsi-initiator-utils

実行中のセッションに関する情報を検索します。

# iscsiadm -m session -P 3

このコマンドは、セッションまたはデバイスの状態、セッション ID (sid)、いくつかのネゴシエートしたパラメーター、およびセッション経由でアクセス可能な SCSI デバイスを表示します。

より短い出力 (たとえば

sid-to-node間のマッピングのみの表示) には、次のコマンドを実行します。# iscsiadm -m session -P 0 or # iscsiadm -m session tcp [2] 10.15.84.19:3260,2 iqn.1992-08.com.netapp:sn.33615311 tcp [3] 10.15.85.19:3260,3 iqn.1992-08.com.netapp:sn.33615311このコマンドは、

driver [sid] target_ip:port,target_portal_group_tag proper_target_nameの形式で実行中のセッションのリストを表示します。

関連情報

-

/usr/share/doc/iscsi-initiator-utils-version/READMEファイル -

man ページの

iscsiadm(8)

8.4. DM Multipath がデバイスタイムアウトの上書き

recovery_tmo sysfs オプションは、特定の iSCSI デバイスのタイムアウトを制御します。次のオプションは、システム全体の recovery_tmo 値を上書きします。

-

replacement_timeout設定オプションは、システム全体で全 iSCSI デバイスのrecovery_tmo値を上書きします。 DM Multipath が管理するすべての iSCSI デバイスで、DM Multipath の

fast_io_fail_tmoオプションは、システム全体のrecovery_tmo値を上書きします。DM Multipath の

fast_io_fail_tmoオプションは、ファイバーチャネルデバイスのfast_io_fail_tmoオプションを上書きします。

DM Multipath の fast_io_fail_tmo オプションは replacement_timeout よりも優先します。Red Hat では、replacement_timeou を使用して、DM Multipath が管理するデバイスの recovery_tmo を上書きすることは推奨しません。これは、multipathd サービスが再読み込みを行うと、DM Multipath が常に recovery_tmo をリセットするためです。

第9章 ファイバーチャネルデバイスの使用

Red Hat Enterprise Linux 9 は、以下のネイティブファイバーチャネルドライバーを提供します。

-

lpfc -

qla2xxx -

zfcp

9.1. ファイバーチャネル論理ユニットのサイズ変更

システム管理者は、ファイバーチャネルの論理ユニットのサイズを変更できます。

手順

multipath論理ユニットのパスとなるデバイスを特定します。multipath -ll

マルチパスを使用するシステムで、ファイバーチャネル論理ユニットを再スキャンします。

$ echo 1 > /sys/block/sdX/device/rescan

関連情報

-

man ページの

multipath(8)

9.2. ファイバーチャネルでデバイスのリンク切れ動作の特定

ドライバーがトランスポートの dev_loss_tmo コールバックを実装している場合、トランスポートの問題が検出されるとリンクを経由したデバイスへのアクセス試行がブロックされます。

手順

リモートポートの状態を判断します。

$ cat /sys/class/fc_remote_port/rport-host:bus:remote-port/port_state

このコマンドは、以下のいずれかの出力を返します。

-

リモートポートからアクセスしたデバイスとともにリモートポートがブロックされると

Blockedとなります。 リモートポートが正常に動作しているときには

Onlineとなりますdev_loss_tmo秒以内に問題が解決されない場合は、rportおよびデバイスのブロックが解除されます。そのデバイスで実行しているすべての I/O は、そのデバイスに送信された新しい I/O とともにすべて失敗します。

-

リモートポートからアクセスしたデバイスとともにリモートポートがブロックされると

リンクロスが dev_loss_tmo を超えると、scsi_device デバイスおよび sd_N_ デバイスが削除されます。通常、ファイバーチャネルクラスはデバイスをそのままにします。つまり、/dev/sdx は、/dev/sdx のままになります。これは、ターゲットバインディングがファイバーチャネルドライバーによって保存され、ターゲットポートが戻されると、SCSI アドレスは同様に再作成されます。ただし、これは保証されません。LUN のストレージ内ボックス設定に追加の変更がない場合に限り、sdx デバイスが復元されます。

関連情報

-

man ページの

multipath.conf(5) - Recommended tuning at scsi,multipath and at application layer while configuring Oracle RAC cluster (ナレッジベースの記事)

9.3. ファイバーチャネル設定ファイル

以下は、ユーザー空間の API をファイバーチャネルに提供する /sys/class/ ディレクトリーの設定ファイルのリストです。

項目は以下の変数を使用します。

H- ホスト番号

B- バス番号

T- ターゲット

L- 論理ユニット (LUN)

-R- リモートポート番号

システムでマルチパスソフトウェアを使用している場合は、本セクションで説明されている値を変更する前にハードウェアベンダーにお問い合わせください。

/sys/class/fc_transport/targetH:B:T/ のトランスポート設定

port_id- 24 ビットのポート ID/アドレス

node_name- 64 ビットのノード名

port_name- 64 ビットのポート名

/sys/class/fc_remote_ports/rport-H:B-R/ のリモートポート設定

-

port_id -

node_name -

port_name dev_loss_tmoscsi デバイスがシステムから削除されるタイミングを制御します。

dev_loss_tmoがトリガーされると、scsi デバイスが削除されます。multipath.confファイルでは、dev_loss_tmoをinfinityに設定できます。Red Hat Enterprise Linux 9 では、

fast_io_fail_tmoオプションを設定しないと、dev_loss_tmoは600秒に制限されます。デフォルトでは、multipathdサービスが実行している場合は、Red Hat Enterprise Linux 9 でfast_io_fail_tmoが5秒に設定されています。それ以外の場合はoffに設定されます。fast_io_fail_tmoリンクに bad のマークが付くまでの待機秒数を指定します。リンクに bad のマークが付けられると、対応するパス上の既存の実行中の I/O または新しい I/O が失敗します。

I/O がブロックされたキューに存在する場合は、

dev_loss_tmoの期限が切れ、キューのブロックが解除されるまでエラーを起こしません。fast_io_fail_tmoを off 以外の値に設定すると、dev_loss_tmoは取得されません。fast_io_fail_tmoを off に設定すると、システムからデバイスが削除されるまで I/O は失敗します。fast_io_fail_tmoに数値を設定すると、fast_io_fail_tmoタイムアウトが発生するとすぐに I/O が失敗します。

/sys/class/fc_host/hostH/ のホスト設定

-

port_id -

node_name -

port_name issue_lipリモートポートを再検出するようにドライバーに指示します。

9.4. DM Multipath がデバイスタイムアウトの上書き

recovery_tmo sysfs オプションは、特定の iSCSI デバイスのタイムアウトを制御します。次のオプションは、システム全体の recovery_tmo 値を上書きします。

-

replacement_timeout設定オプションは、システム全体で全 iSCSI デバイスのrecovery_tmo値を上書きします。 DM Multipath が管理するすべての iSCSI デバイスで、DM Multipath の

fast_io_fail_tmoオプションは、システム全体のrecovery_tmo値を上書きします。DM Multipath の

fast_io_fail_tmoオプションは、ファイバーチャネルデバイスのfast_io_fail_tmoオプションを上書きします。

DM Multipath の fast_io_fail_tmo オプションは replacement_timeout よりも優先します。Red Hat では、replacement_timeou を使用して、DM Multipath が管理するデバイスの recovery_tmo を上書きすることは推奨しません。これは、multipathd サービスが再読み込みを行うと、DM Multipath が常に recovery_tmo をリセットするためです。

第10章 スナップショットを使用したシステムアップグレードの管理

Red Hat Enterprise Linux システムのロールバック可能なアップグレードを実行して、以前のバージョンのオペレーティングシステムに戻します。Boom Boot Manager と Leapp オペレーティングシステム最新化フレームワークを使用できます。

オペレーティングシステムのアップグレードを実行する前に、次の点を考慮してください。

-

スナップショットを使用したシステムアップグレードは、システムツリー内の複数のファイルシステム (別の

/varパーティションや/usrパーティションなど) では機能しません。 - スナップショットを使用したシステムのアップグレードは、Red Hat Update Infrastructure (RHUI) システムでは機能しません。Boom ユーティリティーを使用する代わりに、仮想マシン (VM) のスナップショットを作成することを検討してください。

10.1. Boom プロセスの概要

Boom Boot Manager を使用してブートエントリーを作成すると、GRUB ブートローダーメニューからこれらのエントリーを選択してアクセスできるようになります。ブートエントリーを作成すると、ロールバック可能なアップグレードの準備プロセスが簡素化されます。

次のブートエントリーは、アップグレードおよびロールバックプロセスの一部です。

ブートエントリーのアップグレードLeapp アップグレード環境を起動します。

leappユーティリティーを使用して、このブートエントリーを作成および管理します。Leappアップグレードプロセスでは、このエントリーは自動的に削除されます。Red Hat Enterprise Linux 9 ブートエントリーアップグレードシステム環境を起動します。アップグレードプロセスが正常に完了したら、

leappユーティリティーを使用してこのブートエントリーを作成します。スナップショットのブートエントリー元のシステムのスナップショットを起動します。これを使用して、アップグレードの成功後または失敗後に、以前のオペレーティングシステムの状態を確認およびテストします。オペレーティングシステムをアップグレードする前に、

boomコマンドを使用してこのブートエントリーを作成します。ロールバックのブートエントリーアップグレード前のシステムの環境で起動し、アップグレードが行われている部分を以前のシステムの状態にロールバックします。アップグレード手順のロールバックを開始するときに、

boomコマンドを使用してこのブートエントリーを作成します。

関連情報

-

boom(1)man ページ

10.2. Boom Boot Manager を使用した別のバージョンへのアップグレード

Boom Boot Manager を使用して、Red Hat Enterprise Linux オペレーティングシステムのアップグレードを実行します。

前提条件

- 最新バージョンの Red Hat Enterprise Linux を実行している。

-

最新バージョンの

boom-bootパッケージ (バージョン boom-1.3-3.el9、理想的には boom-1.4-4.el9 以降) がインストールされている。 - スナップショットに使用できる十分な領域がある。元のインストールのサイズに基づいてサイズを推定します。マウントされているすべての論理ボリュームをリストします。

-

leappパッケージがインストールされている。 - ソフトウェアリポジトリーが有効になっている。

-

スナップショットボリュームがアクティブ化されている。アクティブでない場合、

boomコマンドが失敗します。

追加のブートエントリーに /usr または /var が含まれる場合があります。

手順

root 論理ボリュームのスナップショットを作成します。

root ファイルシステムがシンプロビジョニングを使用する場合は、シンスナップショットを作成します。

# lvcreate -s rhel/root -kn -n root_snapshot_before_changesここでは、以下のようになります。

-

-sはスナップショットを作成します。 -

rhel/rootはファイルシステムを論理ボリュームにコピーします。 -nroot_snapshot_before_changes はスナップショットの名前を示します。シンスナップショットを作成している間は、スナップショットのサイズを定義することができません。スナップショットは、シンプールから割り当てられます。

-

root ファイルシステムがシックプロビジョニングを使用する場合は、シックスナップショットを作成します。

# lvcreate -s rhel/root -n root_snapshot_before_changes -L 25g

ここでは、以下のようになります。

-

-sはスナップショットを作成します。 -

rhel/rootはファイルシステムを論理ボリュームにコピーします。 -

-nroot_snapshot_before_changes はスナップショットの名前を示します。 -L25g はスナップショットのサイズです。元のインストールのサイズに基づいてサイズを推定します。シックスナップショットを作成する際は、アップグレード中にすべての変更を保持できるスナップショットサイズを定義します。

重要作成されたスナップショットには、追加のシステム変更は含まれません。

-

プロファイルを作成します。

# boom profile create --from-host --uname-pattern el9

元のブートイメージのバックアップコピーを使用して、元のシステムのスナップショットブートエントリーを作成します。

# boom create --backup --title "Root LV snapshot before changes" --rootlv rhel/root_snapshot_before_changes

ここでは、以下のようになります。

-

--titleRoot LV snapshot before changes は、システム起動時にブートエントリーリストに表示されるブートエントリーの名前です。 -

--rootlvは、新しいブートエントリーに対応する root 論理ボリュームです。 - 前の手順を完了すると、アップグレード前の元のシステムにアクセスできるブートエントリーが作成されます。

-

Leapp ユーティリティーを使用して Red Hat Enterprise Linux 9 にアップグレードします。

# leapp upgrade

-

Leapp upgradeコマンドのレポートで表示されたブロッカーを確認して解決します。

-

アップグレードされたブートエントリーで再起動します。

# leapp upgrade --reboot

- GRUB ブート画面から Red Hat Enterprise Linux Upgrade Initramfs エントリーを選択します。

Leappユーティリティーがアップグレードブートエントリーを作成します。上記のコマンドを実行してアップグレードブートエントリーで再起動し、Red Hat Enterprise Linux 9 へのインプレースアップグレードの実行に進みます。この reboot 引数は、アップグレードプロセス後に自動システムの再起動を開始します。再起動中に GRUB 画面が表示されます。注記GRUB ブート画面の Snapshots サブメニューは、Red Hat Enterprise Linux 9 では使用できません。

検証手順

- アップグレードを続行し、新しい Red Hat Enterprise Linux 9 RPM パッケージをインストールします。アップグレードが完了すると、システムが自動的に再起動します。GRUB 画面に、使用可能なオペレーティングシステムのアップグレードされたバージョンと古いバージョンが表示されます。アップグレードされたシステムバージョンがデフォルトの選択です。

- ブートエントリー Root LV snapshot before changes が GRUB メニューにあるかどうかを確認します。存在する場合、アップグレード前のオペレーティングシステムの状態に即座にアクセスできます。

関連情報

-

boom(1)man ページ - What is BOOM and how to install it?

- BOOM ブートエントリーを作成する方法

10.3. Red Hat Enterprise Linux のバージョン間の切り替え

マシン上の Red Hat Enterprise Linux の最新バージョンと以前のバージョンに同時にアクセスします。Boom Boot Manager を使用してさまざまなオペレーティングシステムのバージョンにアクセスすると、オペレーティングシステムのアップグレードに伴うリスクが軽減され、ハードウェアのダウンタイムも削減されます。環境を切り替えるこの機能により、次のことが可能になります。

- サイドバイサイド方式で両環境をすばやく比較する。

- 最小限のオーバーヘッドで環境を切り替える。

- ファイルシステムの古いコンテンツを復元する。

- アップグレードしたホストの実行中も古いシステムへのアクセスを継続する。

- 更新自体が実行中でも、更新プロセスをいつでも中止して、元に戻す。

前提条件

- 最新バージョンの Red Hat Enterprise Linux を実行している。

手順

システムを再起動します。

# reboot

- GRUB ブートローダー画面から必要なブートエントリーを選択します。

検証手順

選択したブートボリュームが表示されていることを確認します。

# cat /proc/cmdline root=/dev/rhel/root_snapshot_before_changes ro rd.lvm.lv=rhel/root_snapshot_before_changes rd.lvm.lv=vg_root/swap rhgb quiet

関連情報

-

boom(1)man ページ - Boom Boot Manager を使用した別のバージョンへのアップグレード

10.4. 論理ボリュームのスナップショットの削除

現在のオペレーティングシステムのスナップショットを作成すると、オペレーティングシステムの以前の状態にアクセスし、それを確認およびテストすることができます。オペレーティングシステムのスナップショットの使用が終了したら、スナップショットを削除してストレージ領域を解放できます。

論理ボリューム (LV) のスナップショットを削除すると、それ以上操作を実行できません。

前提条件

- 最新バージョンの Red Hat Enterprise Linux を実行している。

手順

GRUB エントリーから Red Hat Enterprise Linux 9 を起動します。以下の出力で、新規スナップショットが選択されていることを確認します。

# boom list BootID Version Name RootDevice 6d2ec72 3.10.0-957.21.3.el8.x86_64 Red Hat Enterprise Linux Server /dev/rhel/root_snapshot_before_changes

BootIDの値を使用してスナップショットエントリーを削除します。# boom delete --boot-id 6d2ec72- これにより、GRUB メニューからブートエントリーが削除されます。

論理ボリューム (LV) のスナップショットを削除します。

# lvremove rhel/root_snapshot_before_changes Do you really want to remove active logical volume rhel/root_snapshot_before_changes? [y/n]: y Logical volume "root_snapshot_before_changes" successfully removed

関連情報

-

boom(1)man ページ - Boom Boot Manager を使用した別のバージョンへのアップグレード

10.5. ロールバックブートエントリーの作成

ロールバックブートエントリーを使用して、アップグレード前の状態のオペレーティングシステム環境にアクセスします。さらに、オペレーティングシステムのアップグレードを元に戻すこともできます。

ロールバックブートエントリーは、アップグレードしたシステムまたはスナップショット環境から準備します。

前提条件

- 最新バージョンの Red Hat Enterprise Linux を実行している。

手順

スナップショットを元のボリューム (作成元) とマージします。

# lvconvert --merge rhel/root_snapshot_before_changes警告スナップショットをマージした後、データの損失を防ぐために、この手順の残りのすべてのステップを続けて実行する必要があります。

マージされたスナップショットのロールバックブートエントリーを作成します。

boom-0.9の場合:boom create --title "RHEL Rollback" --rootlv rhel/rootboom-1.2以降のバージョンの場合:boom create --backup --title "RHEL Rollback" --rootlv rhel/root

オプション: マシンを再起動して、オペレーティングシステムの状態を復元します。

# reboot

- システムが再起動したら、GRUB 画面から Red Hat Enterprise Linux Rollback ブートエントリーを選択します。

root論理ボリュームがアクティブになると、システムは自動的にスナップショットのマージ操作を開始します。重要マージ操作が開始されると、スナップショットボリュームは使用できなくなります。Red Hat Enterprise Linux ロールバックブートエントリーが正常に起動すると、ルート LV スナップショットブートエントリー が機能しなくなります。スナップショットの論理ボリュームをマージすると、ルート LV スナップショットが破棄され、元のボリュームの以前の状態が復元されます。

オプション: マージ操作が完了したら、未使用のエントリーを削除し、元のブートエントリーを復元します。

未使用の Red Hat Enterprise Linux 9 ブートエントリーを

/bootファイルシステムから削除し、変更を有効にするためにgrub.cfgファイルを再構築します。# grub2-mkconfig -o /boot/grub2/grub.cfg

元の Red Hat Enterprise Linux ブートエントリーを復元します。

# new-kernel-pkg --update $(uname -r)

システムへのロールバックに成功したら、

boomブートエントリーを削除します。# boom list # boom delete boot-id

関連情報

-

boom(1)man ページ - Boom Boot Manager を使用した別のバージョンへのアップグレード

第11章 NVMe/RDMA を使用した NVMe over Fabric の設定

Non-volatile Memory Express™ (NVMe™) over RDMA (NVMe™/RDMA) 設定では、NVMe コントローラーと NVMe イニシエーターを設定します。

システム管理者として、次のタスクを実行して NVMe/RDMA 設定をデプロイします。

11.1. NVMe over fabric デバイスの概要

Non-volatile Memory Express™ (NVMe™) は、ホストソフトウェアユーティリティーがソリッドステートドライブと通信できるようにするインターフェイスです。

次の種類のファブリックトランスポートを使用して、NVMe over fabric デバイスを設定します。

- NVMe over Remote Direct Memory Access (NVMe/RDMA)

- NVMe™/RDMA の設定方法については、NVMe/RDMA を使用した NVMe over Fabric の設定 を参照してください。

- NVMe over Fibre Channel (NVMe/FC)

- NVMe™/FC の設定方法については、NVMe/FC を使用した NVMe over Fabric の設定 を参照してください。

- NVMe over TCP (NVMe/TCP)

- NVMe/FC の設定方法については、Configuring NVMe over fabrics using NVMe/TCP を参照してください。

ファブリック上で NVMe を使用する場合、ソリッドステートドライブはシステムに対してローカルである必要はありません。NVMe over Fabrics デバイスを介してリモートで設定できます。

11.2. configfs を使用した NVMe/RDMA コントローラーのセットアップ

configfs を使用して Non-volatile Memory Express™ (NVMe™) over RDMA (NVMe™/RDMA) コントローラーを設定するには、この手順を使用します。

前提条件

-

nvmetサブシステムに割り当てるブロックデバイスがあることを確認する。

手順

nvmet-rdmaサブシステムを作成します。# modprobe nvmet-rdma # mkdir /sys/kernel/config/nvmet/subsystems/testnqn # cd /sys/kernel/config/nvmet/subsystems/testnqn

testnqn を、サブシステム名に置き換えます。

すべてのホストがこのコントローラーに接続できるようにします。

# echo 1 > attr_allow_any_host

namespace を設定します。

# mkdir namespaces/10 # cd namespaces/10

10 を、namespace の数値に置き換えます。

NVMe デバイスへのパスを設定します。

# echo -n /dev/nvme0n1 > device_pathnamespace を有効にします。

# echo 1 > enable

NVMe ポートでディレクトリーを作成します。

# mkdir /sys/kernel/config/nvmet/ports/1 # cd /sys/kernel/config/nvmet/ports/1

mlx5_ib0 の IP アドレスを表示します。

# ip addr show mlx5_ib0 8: mlx5_ib0: <BROADCAST,MULTICAST,UP,LOWER_UP> mtu 4092 qdisc mq state UP group default qlen 256 link/infiniband 00:00:06:2f:fe:80:00:00:00:00:00:00:e4:1d:2d:03:00:e7:0f:f6 brd 00:ff:ff:ff:ff:12:40:1b:ff:ff:00:00:00:00:00:00:ff:ff:ff:ff inet 172.31.0.202/24 brd 172.31.0.255 scope global noprefixroute mlx5_ib0 valid_lft forever preferred_lft forever inet6 fe80::e61d:2d03:e7:ff6/64 scope link noprefixroute valid_lft forever preferred_lft foreverコントローラーのトランスポートアドレスを設定します。

# echo -n 172.31.0.202 > addr_traddr

RDMA をトランスポートタイプとして設定します。

# echo rdma > addr_trtype # echo 4420 > addr_trsvcid

ポートのアドレスファミリーを設定します。

# echo ipv4 > addr_adrfam

ソフトリンクを作成します。

# ln -s /sys/kernel/config/nvmet/subsystems/testnqn /sys/kernel/config/nvmet/ports/1/subsystems/testnqn

検証

NVMe コントローラーが指定されたポートでリッスンしていて、接続要求の準備ができていることを確認します。

# dmesg | grep "enabling port" [ 1091.413648] nvmet_rdma: enabling port 1 (172.31.0.202:4420)

関連情報

-

man ページの

nvme(1)

11.3. nvmetcli を使用した NVMe/RDMA コントローラーのセットアップ

nvmetcli ユーティリティーを使用して、Non-volatile Memory Express™ (NVMe™) コントローラーを編集、表示、起動します。nvmetcli ユーティリティーには、コマンドラインと対話式のシェルオプションが用意されています。nvmetcli によって NVMe™/RDMA コントローラーを設定するには、この手順を使用します。

前提条件

-

nvmetサブシステムに割り当てるブロックデバイスがあることを確認する。 -

root で、以下の

nvmetcli操作を実行する。

手順

nvmetcliパッケージをインストールします。# dnf install nvmetcli

rdma.jsonファイルをダウンロードします。# wget http://git.infradead.org/users/hch/nvmetcli.git/blob_plain/0a6b088db2dc2e5de11e6f23f1e890e4b54fee64:/rdma.json

-

rdma.jsonファイルを編集して、traddrの値を172.31.0.202に変更します。 NVMe コントローラー設定ファイルをロードして、コントローラーをセットアップします。

# nvmetcli restore rdma.json

NVMe コントローラー設定ファイル名を指定しない場合は、nvmetcli が /etc/nvmet/config.json ファイルを使用します。

検証

NVMe コントローラーが指定されたポートでリッスンしていて、接続要求の準備ができていることを確認します。

# dmesg | tail -1 [ 4797.132647] nvmet_rdma: enabling port 2 (172.31.0.202:4420)

オプション: 現在の NVMe コントローラーをクリアします。

# nvmetcli clear

関連情報

-

man ページの

nvmetcliおよびnvme(1)

11.4. NVMe/RDMA ホストの設定

NVMe 管理コマンドラインインターフェイス (nvme-cli) ツールを使用して、Non-volatile Memory Express™ (NVMe™) over RDMA (NVMe™/RDMA) ホストを設定するには、次の手順を実行します。

手順

nvme-cliツールをインストールします。# dnf install nvme-cli

nvme-rdmaモジュールが読み込まれていない場合は、読み込みます。# modprobe nvme-rdma

NVMe コントローラーで使用可能なサブシステムを検出します。

# nvme discover -t rdma -a 172.31.0.202 -s 4420 Discovery Log Number of Records 1, Generation counter 2 =====Discovery Log Entry 0====== trtype: rdma adrfam: ipv4 subtype: nvme subsystem treq: not specified, sq flow control disable supported portid: 1 trsvcid: 4420 subnqn: testnqn traddr: 172.31.0.202 rdma_prtype: not specified rdma_qptype: connected rdma_cms: rdma-cm rdma_pkey: 0x0000

検出されたサブシステムに接続します。

# nvme connect -t rdma -n testnqn -a 172.31.0.202 -s 4420 # lsblk NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT sda 8:0 0 465.8G 0 disk ├─sda1 8:1 0 1G 0 part /boot └─sda2 8:2 0 464.8G 0 part ├─rhel_rdma--virt--03-root 253:0 0 50G 0 lvm / ├─rhel_rdma--virt--03-swap 253:1 0 4G 0 lvm [SWAP] └─rhel_rdma--virt--03-home 253:2 0 410.8G 0 lvm /home nvme0n1 # cat /sys/class/nvme/nvme0/transport rdma

testnqn を NVMe サブシステム名に置き換えます。

172.31.0.202 をコントローラーの IP アドレスに置き換えます。

4420 を、ポート番号に置き換えます。

検証

現在接続されている NVMe デバイスのリストを表示します。

# nvme list

オプション: コントローラーから切断します。

# nvme disconnect -n testnqn NQN:testnqn disconnected 1 controller(s) # lsblk NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT sda 8:0 0 465.8G 0 disk ├─sda1 8:1 0 1G 0 part /boot └─sda2 8:2 0 464.8G 0 part ├─rhel_rdma--virt--03-root 253:0 0 50G 0 lvm / ├─rhel_rdma--virt--03-swap 253:1 0 4G 0 lvm [SWAP] └─rhel_rdma--virt--03-home 253:2 0 410.8G 0 lvm /home

関連情報

-

man ページの

nvme(1) - Nvme-cli Github repository

11.5. 次のステップ

第12章 NVMe/FC を使用した NVMe over Fabric の設定

Non-volatile Memory Express™ (NVMe™) over Fibre Channel (NVMe™/FC) トランスポートは、特定の Broadcom Emulex および Marvell Qlogic ファイバーチャネルアダプターと共に使用する場合、ホストモードで完全にサポートされます。システム管理者として、以下のセクションのタスクを完了し、FC-NVMe 設定をデプロイします。

12.1. NVMe over fabric デバイスの概要

Non-volatile Memory Express™ (NVMe™) は、ホストソフトウェアユーティリティーがソリッドステートドライブと通信できるようにするインターフェイスです。

次の種類のファブリックトランスポートを使用して、NVMe over fabric デバイスを設定します。

- NVMe over Remote Direct Memory Access (NVMe/RDMA)

- NVMe™/RDMA の設定方法については、NVMe/RDMA を使用した NVMe over Fabric の設定 を参照してください。

- NVMe over Fibre Channel (NVMe/FC)

- NVMe™/FC の設定方法については、NVMe/FC を使用した NVMe over Fabric の設定 を参照してください。

- NVMe over TCP (NVMe/TCP)

- NVMe/FC の設定方法については、Configuring NVMe over fabrics using NVMe/TCP を参照してください。

ファブリック上で NVMe を使用する場合、ソリッドステートドライブはシステムに対してローカルである必要はありません。NVMe over Fabrics デバイスを介してリモートで設定できます。

12.2. Broadcom アダプターの NVMe ホストの設定

NVMe 管理コマンドラインインターフェイス (nvme-cli) ユーティリティーを使用して、Broadcom アダプタークライアントの Non-volatile Memory Express™ (NVMe™) ホストを設定するには、次の手順を実行します。

手順

nvme-cliユーティリティーをインストールします。# dnf install nvme-cliこれにより、

/etc/nvme/ディレクトリーにhostnqnファイルが作成されます。hostnqnファイルは、NVMe ホストを識別します。ローカルポートとリモートポートのワールドワイドノード名 (WWNN) とワールドワイドポート名 (WWPN) 識別子を見つけます。