ファイルシステムの管理

Red Hat Enterprise Linux 9 でのファイルシステムの作成、変更、管理

概要

多様性を受け入れるオープンソースの強化

Red Hat では、コード、ドキュメント、Web プロパティーにおける配慮に欠ける用語の置き換えに取り組んでいます。まずは、マスター (master)、スレーブ (slave)、ブラックリスト (blacklist)、ホワイトリスト (whitelist) の 4 つの用語の置き換えから始めます。この取り組みは膨大な作業を要するため、今後の複数のリリースで段階的に用語の置き換えを実施して参ります。詳細は、Red Hat CTO である Chris Wright のメッセージ をご覧ください。

Red Hat ドキュメントへのフィードバック (英語のみ)

Red Hat ドキュメントに関するご意見やご感想をお寄せください。また、改善点があればお知らせください。

Jira からのフィードバック送信 (アカウントが必要)

- Jira の Web サイトにログインします。

- 上部のナビゲーションバーで Create をクリックします。

- Summary フィールドにわかりやすいタイトルを入力します。

- Description フィールドに、ドキュメントの改善に関するご意見を記入してください。ドキュメントの該当部分へのリンクも追加してください。

- ダイアログの下部にある Create をクリックします。

第1章 利用可能なファイルシステムの概要

利用可能な選択肢と、関連するトレードオフが多数あるため、アプリケーションに適したファイルシステムを選択することが重要になります。

次のセクションでは、Red Hat Enterprise Linux 9 にデフォルトで含まれるファイルシステムと、アプリケーションに最適なファイルシステムに関する推奨事項について説明します。

1.1. ファイルシステムの種類

Red Hat Enterprise Linux 9 は、さまざまなファイルシステム (FS) に対応します。さまざまな種類のファイルシステムがさまざまな問題を解決し、その使用はアプリケーションによって異なります。最も一般的なレベルでは、利用可能なファイルシステムを以下の主要なタイプにまとめることができます。

表1.1 ファイルシステムの種類とそのユースケース

| タイプ | ファイルシステム | 属性とユースケース |

|---|---|---|

| ディスクまたはローカルのファイルシステム | XFS | XFS は、RHEL におけるデフォルトファイルシステムです。Red Hat は、互換性や、パフォーマンスおいて稀に発生する難しい問題などの特別な理由がない限り、XFS をローカルファイルシステムとしてデプロイすることを推奨します。 |

| ext4 | 従来の ext2 および ext3 ファイルシステムから進化した ext4 には、Linux で馴染みやすいという利点があります。多くの場合、パフォーマンスでは XFS に匹敵します。ext4 ファイルシステムとファイルサイズのサポート制限は、XFS よりも小さくなっています。 | |

| ネットワーク、またはクライアント/サーバーのファイルシステム | NFS | NFS は、同じネットワークにある複数のシステムでのファイル共有に使用します。 |

| SMB | SMB は、Microsoft Windows システムとのファイル共有に使用します。 | |

| 共有ストレージまたは共有ディスクのファイルシステム | GFS2 | GFS2 は、コンピュートクラスターのメンバーに共有書き込みアクセスを提供します。可能な限り、ローカルファイルシステムの機能的経験を備えた安定性と信頼性に重点が置かれています。SAS Grid、Tibco MQ、IBM Websphere MQ、および Red Hat Active MQ は、GFS2 に問題なくデプロイされています。 |

| ボリューム管理ファイルシステム | Stratis | Stratis は、XFS と LVM を組み合わせて構築されたボリュームマネージャーです。Stratis の目的は、Btrfs や ZFS などのボリューム管理ファイルシステムにより提供される機能をエミュレートすることです。このスタックを手動で構築することは可能ですが、Stratis は設定の複雑さを軽減し、ベストプラクティスを実装し、エラー情報を統合します。 |

1.2. ローカルファイルシステム

ローカルファイルシステムは、1 台のローカルサーバーで実行し、ストレージに直接接続されているファイルシステムです。

たとえば、ローカルファイルシステムは、内部 SATA ディスクまたは SAS ディスクにおける唯一の選択肢であり、ローカルドライブを備えた内蔵ハードウェア RAID コントローラーがサーバーにある場合に使用されます。ローカルファイルシステムは、SAN にエクスポートされたデバイスが共有されていない場合に、SAN が接続したストレージに最もよく使用されているファイルシステムです。

ローカルファイルシステムはすべて POSIX に準拠しており、サポートされているすべての Red Hat Enterprise Linux リリースと完全に互換性があります。POSIX 準拠のファイルシステムは、read()、write()、seek() など、明確に定義されたシステムコールのセットに対応します。

アプリケーションプログラマーの観点では、ローカルファイルシステム間の違いは比較的少なくなります。ユーザーの観点で最も重要な違いは、スケーラビリティーとパフォーマンスに関するものです。ファイルシステムの選択を検討する際に、ファイルシステムのサイズ、必要な固有の機能、実際のワークロードにおける実行方法を考慮してください。

- 利用可能なローカルファイルシステム

- XFS

- ext4

1.3. XFS ファイルシステム

XFS は、拡張性が高く、高性能で堅牢な、成熟した 64 ビットのジャーナリングファイルシステムで、1 台のホストで非常に大きなファイルおよびファイルシステムに対応します。Red Hat Enterprise Linux 9 ではデフォルトのファイルシステムになります。XFS は、元々 1990 年代の前半に SGI により開発され、極めて大規模なサーバーおよびストレージアレイで実行されてきた長い歴史があります。

XFS の機能は次のとおりです。

- 信頼性

- メタデータジャーナリング - システムの再起動時、およびファイルシステムの再マウント時に再生できるファイルシステム操作の記録を保持することで、システムクラッシュ後のファイルシステムの整合性を確保します。

- 広範囲に及ぶランタイムメタデータの整合性チェック

- 拡張性が高く、高速な修復ユーティリティー

- クォータジャーナリングクラッシュ後に行なわれる、時間がかかるクォータの整合性チェックが不要になります。

- スケーラビリティーおよびパフォーマンス

- 対応するファイルシステムのサイズが最大 1024 TiB

- 多数の同時操作に対応する機能

- 空き領域管理のスケーラビリティーに関する B-Tree インデックス

- 高度なメタデータ先読みアルゴリズム

- ストリーミングビデオのワークロードの最適化

- 割り当てスキーム

- エクステント (領域) ベースの割り当て

- ストライプを認識できる割り当てポリシー

- 遅延割り当て

- 領域の事前割り当て

- 動的に割り当てられる inode

- その他の機能

- Reflink ベースのファイルのコピー

- 密接に統合されたバックアップおよび復元のユーティリティー

- オンラインのデフラグ

- オンラインのファイルシステム拡張

- 包括的な診断機能

-

拡張属性 (

xattr)。これにより、システムが、ファイルごとに、名前と値の組み合わせを追加で関連付けられるようになります。 - プロジェクトまたはディレクトリーのクォータ。ディレクトリーツリー全体にクォータ制限を適用できます。

- サブセカンド (一秒未満) のタイムスタンプ

パフォーマンスの特徴

XFS は、エンタープライズレベルのワークロードがある大規模なシステムで優れたパフォーマンスを発揮します。大規模なシステムとは、相対的に CPU 数が多く、さらには複数の HBA、および外部ディスクアレイへの接続を備えたシステムです。XFS は、マルチスレッドの並列 I/O ワークロードを備えた小規模のシステムでも適切に実行します。

XFS は、シングルスレッドで、メタデータ集約型のワークロードのパフォーマンスが比較的低くなります。たとえば、シングルスレッドで小さなファイルを多数作成し、削除するワークロードがこれに当てはまります。

1.4. ext4 ファイルシステム

ext4 ファイルシステムは、ext ファイルシステムファミリーの第 4 世代です。これは、Red Hat Enterprise Linux 6 でデフォルトのファイルシステムです。

ext4 ドライバーは、ext2 および ext3 のファイルシステムの読み取りと書き込みが可能ですが、ext4 ファイルシステムのフォーマットは、ext2 ドライバーおよび ext3 ドライバーと互換性がありません。

ext4 には、以下のような新機能、および改善された機能が追加されました。

- 対応するファイルシステムのサイズが最大 50 TiB

- エクステントベースのメタデータ

- 遅延割り当て

- ジャーナルのチェックサム

- 大規模なストレージサポート

エクステントベースのメタデータと遅延割り当て機能は、ファイルシステムで使用されている領域を追跡する、よりコンパクトで効率的な方法を提供します。このような機能により、ファイルシステムのパフォーマンスが向上し、メタデータが使用する領域が低減します。遅延割り当てにより、ファイルシステムは、データがディスクにフラッシュされるまで、新しく書き込まれたユーザーデータの永続的な場所の選択を保留できます。これにより、より大きく、より連続した割り当てが可能になり、より優れた情報に基づいてファイルシステムが決定を下すことができるため、パフォーマンスが向上します。

ext4 で fsck ユーティリティーを使用するファイルシステムの修復時間は、ext2 と ext3 よりも高速です。一部のファイルシステムの修復では、最大 6 倍のパフォーマンスの向上が実証されています。

1.5. XFS と ext4 の比較

XFS は、RHEL におけるデフォルトファイルシステムです。このセクションでは、XFS および ext4 の使用方法と機能を比較します。

- メタデータエラーの動作

-

ext4 では、ファイルシステムがメタデータのエラーに遭遇した場合の動作を設定できます。デフォルトの動作では、操作を継続します。XFS が復旧できないメタデータエラーに遭遇すると、ファイルシステムをシャットダウンし、

EFSCORRUPTEDエラーを返します。 - クォータ

ext4 では、既存のファイルシステムにファイルシステムを作成する場合にクォータを有効にできます。次に、マウントオプションを使用してクォータの適用を設定できます。

XFS クォータは再マウントできるオプションではありません。初期マウントでクォータをアクティブにする必要があります。

XFS ファイルシステムで

quotacheckコマンドを実行すると影響しません。クォータアカウンティングを初めてオンにすると、XFS はクォータを自動的にチェックします。- ファイルシステムのサイズ変更

- XFS には、ファイルシステムのサイズを縮小するユーティリティーがありません。XFS ファイルシステムのサイズのみを増やすことができます。ext4 は、ファイルシステムの拡張と縮小の両方をサポートします。

- Inode 番号

ext4 ファイルシステムは、232 個を超える inode をサポートしません。

XFS は inode を動的に割り当てます。XFS ファイルシステムは、ファイルシステムに空き領域がある限り、inode からは実行できません。

特定のアプリケーションは、XFS ファイルシステムで 232 個を超える inode を適切に処理できません。このようなアプリケーションでは、戻り値

EOVERFLOWで 32 ビットの統計呼び出しに失敗する可能性があります。Inode 番号は、以下の条件下で 232 個を超えます。- ファイルシステムが 256 バイトの inode を持つ 1 TiB を超える。

- ファイルシステムが 512 バイトの inode を持つ 2 TiB を超える。

inode 番号が大きくてアプリケーションが失敗した場合は、

-o inode32オプションを使用して XFS ファイルシステムをマウントし、232 未満の inode 番号を実施します。inode32を使用しても、すでに 64 ビットの数値が割り当てられている inode には影響しません。重要特定の環境に必要な場合を除き、

inode32オプション は使用しないでください。inode32オプションは割り当ての動作を変更します。これにより、下層のディスクブロックに inode を割り当てるための領域がない場合に、ENOSPCエラーが発生する可能性があります。

1.6. ローカルファイルシステムの選択

アプリケーションの要件を満たすファイルシステムを選択するには、ファイルシステムをデプロイするターゲットシステムを理解する必要があります。以下の項目で、選択肢を確認できます。

- 大容量のサーバーがあるか

- ストレージの要件は大きいか、ローカルで低速な SATA ドライブが存在するか

- アプリケーションで期待される I/O ワークロードの種類

- スループットとレイテンシーの要件

- サーバーおよびストレージハードウェアの安定性

- ファイルとデータセットの標準的なサイズ

- システムで障害が発生した場合のダウンタイムの長さ

サーバーとストレージデバイスの両方が大きい場合は、XFS が最適です。ストレージアレイが小さくても、XFS は、平均のファイルサイズが大きい場合 (たとえば、数百メガバイト) に、非常に優れたパフォーマンスを発揮します。

既存のワークロードが ext4 で良好に機能している場合は、ext4 を引き続き使用することで、ユーザーとアプリケーションに非常に馴染みのある環境を提供できます。

ext4 ファイルシステムは、I/O 機能が制限されているシステムでパフォーマンスが向上する傾向があります。限られた帯域幅 (200MB/s 未満) と、最大約 1000 の IOPS 機能でパフォーマンスが向上します。より高い機能を備えたものであれば、XFS はより高速になる傾向があります。

XFS は、ext4 と比較して、メタデータあたりの CPU の動作を約 2 倍消費します。そのため、同時に処理できることがほとんどない、CPU にバインドされたワークロードがあると、ext4 の方が高速になります。通常、アプリケーションが 1 つの読み取り/書き込みスレッドと小さなファイルを使用する場合は ext4 の方が優れていますが、アプリケーションが複数の読み取り/書き込みスレッドと大きなファイルを使用する場合は、XFS の方が優れています。

XFS ファイルシステムを縮小することはできません。ファイルシステムを縮小できるようにする必要がある場合は、オフライン縮小に対応する ext4 を使用することを検討してください。

通常、Red Hat は、ext4 に対する特別なユースケースがない限り、XFS を使用することを推奨します。また、ターゲットサーバーとストレージシステムで特定のアプリケーションのパフォーマンスを測定して、適切なタイプのファイルシステムを選択するようにしてください。

表1.2 ローカルファイルシステムに関する推奨事項の概要

| シナリオ | 推奨されるファイルシステム |

|---|---|

| 特別なユースケースなし | XFS |

| 大規模サーバー | XFS |

| 大規模なストレージデバイス | XFS |

| 大規模なファイル | XFS |

| マルチスレッド I/O | XFS |

| シングルスレッド I/O | ext4 |

| 制限された I/O 機能 (1000 IOPS 未満) | ext4 |

| 制限された帯域幅 (200MB/s 未満) | ext4 |

| CPU にバインドされているワークロード | ext4 |

| オフラインの縮小への対応 | ext4 |

1.7. ネットワークファイルシステム

クライアント/サーバーファイルシステムとも呼ばれるネットワークファイルシステムにより、クライアントシステムは、共有サーバーに保存されているファイルにアクセスできます。これにより、複数のシステムの、複数のユーザーが、ファイルやストレージリソースを共有できます。

このようなファイルシステムは、ファイルシステムのセットを 1 つ以上のクライアントにエクスポートする、1 つ以上のサーバーから構築されます。クライアントノードは、基盤となるブロックストレージにアクセスできませんが、より良いアクセス制御を可能にするプロトコルを使用してストレージと対話します。

- 利用可能なネットワークファイルシステム

- RHEL で最も一般的なクライアント/サーバーファイルシステムは、NFS ファイルシステムです。RHEL は、ネットワーク経由でローカルファイルシステムをエクスポートする NFS サーバーコンポーネントと、このようなファイルシステムをインポートする NFS クライアントの両方を提供します。

- RHEL には、Windows の相互運用性で一般的に使用されている Microsoft SMB ファイルサーバーに対応する CIFS クライアントも含まれています。ユーザー空間 Samba サーバーは、RHEL サーバーから Microsoft SMB サービスを使用する Windows クライアントを提供します。

1.8. 共有ストレージファイルシステム

クラスターファイルシステムとも呼ばれる共有ストレージファイルシステムにより、クラスター内の各サーバーは、ローカルストレージエリアネットワーク (SAN) を介して共有ブロックデバイスに直接アクセスできます。

- ネットワークファイルシステムとの比較

- クライアント/サーバーのファイルシステムと同様、共有ストレージファイルシステムは、クラスターのすべてのメンバーであるサーバーのセットで機能します。ただし、NFS とは異なり、1 台のサーバーでは、その他のメンバーにデータまたはメタデータへのアクセスを提供しません。クラスターの各メンバーが同じストレージデバイス (共有ストレージ) に直接アクセスし、すべてのクラスターメンバーノードが同じファイルセットにアクセスできるようになります。

- 同時並行性

キャッシュの一貫性は、データの一貫性と整合性を確保するためにクラスター化されたファイルシステムで重要になります。クラスター内のすべてのノードに表示される、クラスター内のすべてのファイルのバージョンが 1 つ必要です。ファイルシステムは、クラスターのメンバーが同じストレージブロックを同時に更新して、データ破損を引き起こさないようにする必要があります。共有ストレージファイルシステムは、クラスター全体のロックメカニズムを使用して、同時実行制御メカニズムとしてストレージへのアクセスを調整します。たとえば、新しいファイルを作成したり、複数のサーバーで開いているファイルに書き込む前に、サーバーにあるファイルシステムコンポーネントが正しいロックを取得する必要があります。

クラスターファイルシステムの要件は、Apache Web サーバーのような可用性の高いサービスを提供することです。クラスターのすべてのメンバーに、共有ディスクのファイルシステムに保存されているデータに関する、完全に一貫した表示が提供され、すべての更新がロックメカニズムにより正しく調整されます。

- パフォーマンスの特徴

共有ディスクファイルシステムは、ロックオーバーヘッドの計算コストのため、同じシステムで実行しているローカルファイルシステムと同じように機能するとは限りません。共有ディスクのファイルシステムは、各ノードが、その他のノードと共有していない特定のファイルセットにほぼ排他的に書き込むか、ファイルセットが、ノードセット間でほぼ排他的に読み取り専用で共有されるワークロードで良好に機能します。これにより、ノード間のキャッシュの無効化が最小限に抑えられ、パフォーマンスを最大化できます。

共有ディスクファイルシステムの設定は複雑で、共有ディスクのファイルシステムで適切に動作するようにアプリケーションを調整することが困難な場合があります。

- 利用可能な共有ストレージファイルシステム

- Red Hat Enterprise Linux は、GFS2 ファイルシステムを提供します。GFS2 は、Red Hat Enterprise Linux High Availability Add-On および Resilient Storage Add-On と密接に統合されています。

Red Hat Enterprise Linux は、サイズが 2 ノードから 16 ノードのクラスターで GFS2 に対応します。

1.9. ネットワークと共有ストレージファイルシステムの選択

ネットワークと共有ストレージのファイルシステムのいずれかを選択する際は、以下の点を考慮してください。

- NFS ベースのネットワークファイルシステムは、NFS サーバーを提供する環境において、ごく一般的で評判が良い選択肢です。

- ネットワークファイルシステムは、Infiniband や 10 ギガビットイーサネットなど、非常に高性能なネットワークテクノロジーを使用してデプロイできます。これは、ストレージに、生の帯域幅を取得するだけのために、共有ストレージのファイルシステムを有効にすべきではないことを意味します。アクセスの速度が非常に重要な場合は、NFS を使用して、XFS などのローカルファイルシステムをエクスポートします。

- 共有ストレージのファイルシステムは、設定や維持が容易ではないため、ローカルまたはネットワークのファイルシステムのいずれかで必要な可用性を提供できない場合に限りデプロイしてください。

- クラスター環境の共有ストレージのファイルシステムは、高可用性サービスの再配置を伴う一般的なフェイルオーバーシナリオで、マウント解除およびマウントに必要な手順を省くことで、ダウンタイムを短縮できます。

Red Hat は、共有ストレージのファイルシステムに対する特別なユースケースがない限り、ネットワークのファイルシステムを使用することを推奨します。共有ストレージのファイルシステムは、主に、最小限のダウンタイムで高可用性サービスを提供する必要があり、サービスレベルの要件が厳しいデプロイメントに使用します。

1.10. ボリューム管理ファイルシステム

ボリューム管理ファイルシステムは、簡素化とスタック内の最適化の目的で、ストレージスタック全体を統合します。

- 利用可能なボリューム管理ファイルシステム

- Red Hat Enterprise Linux 9 は Stratis ボリュームマネージャーを提供します。Stratis は、ファイルシステム層に XFS を使用し、LVM、Device Mapper、およびその他のコンポーネントと統合します。

Stratis は、Red Hat Enterprise Linux 8.0 で初めてリリースされました。Red Hat が Btrfs を非推奨にした時に生じたギップを埋めると考えられています。Stratis 1.0 は、ユーザーによる複雑さを隠しつつ、重要なストレージ管理操作を実行できる直感的なコマンドラインベースのボリュームマネージャーです。

- ボリュームの管理

- プールの作成

- シンストレージプール

- スナップショット

- 自動化読み取りキャッシュ

Stratis は強力な機能を提供しますが、現時点では Btrfs や ZFS といったその他の製品と比較される可能性がある機能をいつくか欠いています。たとえば、セルフ修復を含む CRC には対応していません。

第2章 RHEL システムロールを使用したローカルストレージの管理

Ansible を使用して LVM とローカルファイルシステム (FS) を管理するには、RHEL 9 で使用可能な RHEL システムロールの 1 つである storage ロールを使用できます。

storage ロールを使用すると、ディスク上のファイルシステム、複数のマシンにある論理ボリューム、および RHEL 7.7 以降の全バージョンでのファイルシステムの管理を自動化できます。

RHEL システムロールと、その適用方法の詳細は、RHEL システムロールの概要 を 参照してください。

2.1. storage RHEL システムロールの概要

storage ロールは以下を管理できます。

- パーティションが分割されていないディスクのファイルシステム

- 論理ボリュームとファイルシステムを含む完全な LVM ボリュームグループ

- MD RAID ボリュームとそのファイルシステム

storage ロールを使用すると、次のタスクを実行できます。

- ファイルシステムを作成する

- ファイルシステムを削除する

- ファイルシステムをマウントする

- ファイルシステムをアンマウントする

- LVM ボリュームグループを作成する

- LVM ボリュームグループを削除する

- 論理ボリュームを作成する

- 論理ボリュームを削除する

- RAID ボリュームを作成する

- RAID ボリュームを削除する

- RAID で LVM ボリュームグループを作成する

- RAID で LVM ボリュームグループを削除する

- 暗号化された LVM ボリュームグループを作成する

- RAID で LVM 論理ボリュームを作成する

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.2. storage RHEL システムロールのストレージデバイスを識別するパラメーター

storage ロールの設定は、以下の変数に記載されているファイルシステム、ボリューム、およびプールにのみ影響します。

storage_volumesマネージドのパーティションが分割されていない全ディスク上のファイルシステムのリスト

storage_volumesにはraidボリュームを含めることもできます。現在、パーティションはサポートされていません。

storage_pools管理するプールのリスト

現在、サポートされている唯一のプールタイプは LVM です。LVM では、プールはボリュームグループ (VG) を表します。各プールの下には、ロールで管理されるボリュームのリストがあります。LVM では、各ボリュームは、ファイルシステムを持つ論理ボリューム (LV) に対応します。

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.3. storage RHEL システムロールを使用してブロックデバイスに XFS ファイルシステムを作成する

Ansible Playbook の例では、storage ロールを適用して、デフォルトのパラメーターを使用してブロックデバイス上に XFS ファイルシステムを作成します。

storage ロールは、パーティションが分割されていないディスク全体または論理ボリューム (LV) でのみファイルシステムを作成できます。パーティションにファイルシステムを作成することはできません。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: xfs-

現在、ボリューム名 (この例では

barefs) は任意です。storageロールは、disks:属性にリスト表示されているディスクデバイスでボリュームを特定します。 -

XFS は RHEL 9 のデフォルトファイルシステムであるため、

fs_type: xfs行を省略することができます。 論理ボリュームにファイルシステムを作成するには、エンクロージングボリュームグループを含む

disks:属性の下に LVM 設定を指定します。詳細は、storage RHEL システムロールを使用して論理ボリュームを管理する を参照してください。LV デバイスへのパスを指定しないでください。

-

現在、ボリューム名 (この例では

Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.4. storage RHEL システムロールを使用してファイルシステムを永続的にマウントする

Ansible の例では、storage ロールを適用して、XFS ファイルシステムを即時かつ永続的にマウントします。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: xfs mount_point: /mnt/data mount_user: somebody mount_group: somegroup mount_mode: 0755-

この Playbook は、ファイルシステムを

/etc/fstabファイルに追加し、ファイルシステムを即座にマウントします。 -

/dev/sdbデバイス上のファイルシステム、またはマウントポイントのディレクトリーが存在しない場合は、Playbook により作成されます。

-

この Playbook は、ファイルシステムを

Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.5. storage RHEL システムロールを使用して論理ボリュームを管理する

Ansible Playbook の例では、storage ロールを適用して、ボリュームグループに LVM 論理ボリュームを作成します。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。- hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_pools: - name: myvg disks: - sda - sdb - sdc volumes: - name: mylv size: 2G fs_type: ext4 mount_point: /mnt/dat-

myvgボリュームグループは、ディスク/dev/sda、/dev/sdb、および/dev/sdcで構成されています。 -

myvgボリュームグループがすでに存在する場合は、Playbook により論理ボリュームがボリュームグループに追加されます。 -

myvgボリュームグループが存在しない場合は、Playbook により作成されます。 -

この Playbook は、

mylv論理ボリュームに Ext4 ファイルシステムを作成し、そのファイルシステムを/mntに永続的にマウントします。

-

Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.6. storage RHEL システムロールを使用してオンラインのブロック破棄を有効にする

Ansible Playbook の例では、storage ロールを適用して、オンラインのブロック破棄を有効にして XFS ファイルシステムをマウントします。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: xfs mount_point: /mnt/data mount_options: discardPlaybook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.7. storage RHEL システムロールを使用して Ext4 ファイルシステムを作成およびマウントする

Ansible Playbook の例では、storage ロールを適用して、Ext4 ファイルシステムを作成してマウントします。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: ext4 fs_label: label-name mount_point: /mnt/data-

Playbook は、

/dev/sdbディスクにファイルシステムを作成します。 -

この Playbook は、ファイルシステムを

/mnt/dataディレクトリーに永続的にマウントします。 -

ファイルシステムのラベルは

label-nameです。

-

Playbook は、

Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.8. storage RHEL システムロールを使用して Ext3 ファイルシステムを作成およびマウントする

Ansible Playbook の例では、storage ロールを適用して Ext3 ファイルシステムを作成してマウントします。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - hosts: all roles: - rhel-system-roles.storage vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: ext3 fs_label: label-name mount_point: /mnt/data mount_user: somebody mount_group: somegroup mount_mode: 0755-

Playbook は、

/dev/sdbディスクにファイルシステムを作成します。 -

この Playbook は、ファイルシステムを

/mnt/dataディレクトリーに永続的にマウントします。 -

ファイルシステムのラベルは

label-nameです。

-

Playbook は、

Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.9. storage RHEL システムロールを使用して LVM 上の既存のファイルシステムのサイズを変更する

このサンプル Ansible Playbook は、storage RHEL システムロールを適用して、ファイルシステムを持つ LVM 論理ボリュームのサイズを変更します。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Create LVM pool over three disks hosts: managed-node-01.example.com tasks: - name: Resize LVM logical volume with file system ansible.builtin.include_role: name: rhel-system-roles.storage vars: storage_pools: - name: myvg disks: - /dev/sda - /dev/sdb - /dev/sdc volumes: - name: mylv1 size: 10 GiB fs_type: ext4 mount_point: /opt/mount1 - name: mylv2 size: 50 GiB fs_type: ext4 mount_point: /opt/mount2この Playbook は、以下の既存のファイルシステムのサイズを変更します。

-

/opt/mount1にマウントされるmylv1ボリュームの Ext4 ファイルシステムは、そのサイズを 10 GiB に変更します。 -

/opt/mount2にマウントされるmylv2ボリュームの Ext4 ファイルシステムは、そのサイズを 50 GiB に変更します。

-

Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.10. storage RHEL システムロールを使用してスワップボリュームを作成する

本セクションでは、Ansible Playbook の例を紹介します。この Playbook は、storage ロールを適用し、デフォルトのパラメーターを使用して、ブロックデバイスにスワップボリュームが存在しない場合は作成し、スワップボリュームがすでに存在する場合はそれを変更します。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Create a disk device with swap hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_volumes: - name: swap_fs type: disk disks: - /dev/sdb size: 15 GiB fs_type: swap現在、ボリューム名 (この例では

swap_fs) は任意です。storageロールは、disks:属性にリスト表示されているディスクデバイスでボリュームを特定します。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.11. storage システムロールを使用して RAID ボリュームを設定する

storage システムロールを使用すると、Red Hat Ansible Automation Platform と Ansible-Core を使用して RHEL に RAID ボリュームを設定できます。要件に合わせて RAID ボリュームを設定するためのパラメーターを使用して、Ansible Playbook を作成します。

特定の状況でデバイス名が変更する場合があります。たとえば、新しいディスクをシステムに追加するときなどです。したがって、データの損失を防ぐために、Playbook で特定のディスク名を使用しないでください。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Configure the storage hosts: managed-node-01.example.com tasks: - name: Create a RAID on sdd, sde, sdf, and sdg ansible.builtin.include_role: name: rhel-system-roles.storage vars: storage_safe_mode: false storage_volumes: - name: data type: raid disks: [sdd, sde, sdf, sdg] raid_level: raid0 raid_chunk_size: 32 KiB mount_point: /mnt/data state: presentPlaybook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.12. storage RHEL システムロールを使用して RAID を備えた LVM プールを設定する

storage システムロールを使用すると、Red Hat Ansible Automation Platform を使用して、RAID を備えた LVM プールを RHEL に設定できます。利用可能なパラメーターを使用して Ansible Playbook をセットアップし、LVM pool with RAID を設定できます。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Configure LVM pool with RAID hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_safe_mode: false storage_pools: - name: my_pool type: lvm disks: [sdh, sdi] raid_level: raid1 volumes: - name: my_volume size: "1 GiB" mount_point: "/mnt/app/shared" fs_type: xfs state: presentRAID を備えた LVM プールを作成するには、

raid_levelパラメーターを使用して RAID タイプを指定する必要があります。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー - RAID の管理

2.13. storage RHEL システムロールを使用して RAID LVM ボリュームのストライプサイズを設定する

storage システムロールを使用すると、Red Hat Ansible Automation Platform を使用して、RHEL の RAID LVM ボリュームのストライプサイズを設定できます。利用可能なパラメーターを使用して Ansible Playbook をセットアップし、LVM pool with RAID を設定できます。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Configure stripe size for RAID LVM volumes hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_safe_mode: false storage_pools: - name: my_pool type: lvm disks: [sdh, sdi] volumes: - name: my_volume size: "1 GiB" mount_point: "/mnt/app/shared" fs_type: xfs raid_level: raid1 raid_stripe_size: "256 KiB" state: presentPlaybook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー - RAID の管理

2.14. storage RHEL システムロールを使用して LVM 上の VDO ボリュームを圧縮および重複排除する

このサンプル Ansible Playbook は、storage RHEL システムロールを適用し、Virtual Data Optimizer (VDO) を使用した論理ボリューム (LVM) の圧縮と重複排除を有効にします。

storage システムロールが LVM VDO を使用するため、圧縮と重複排除を使用できるのはプールごとに 1 つのボリュームのみです。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。- name: Create LVM VDO volume under volume group 'myvg' hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_pools: - name: myvg disks: - /dev/sdb volumes: - name: mylv1 compression: true deduplication: true vdo_pool_size: 10 GiB size: 30 GiB mount_point: /mnt/app/sharedこの例では、

compressionプールおよびdeduplicationプールを true に設定します。これは、VDO が使用されることを指定します。以下では、このパラメーターの使用方法を説明します。-

deduplicationは、ストレージボリュームに保存されている重複データの重複排除に使用されます。 - 圧縮は、ストレージボリュームに保存されているデータを圧縮するために使用されます。これにより、より大きなストレージ容量が得られます。

-

vdo_pool_size は、ボリュームがデバイスで使用する実際のサイズを指定します。VDO ボリュームの仮想サイズは、

sizeパラメーターで設定します。

-

Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

2.15. storage RHEL システムロールを使用して LUKS2 暗号化ボリュームを作成する

storage ロールを使用し、Ansible Playbook を実行して、LUKS で暗号化されたボリュームを作成および設定できます。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Create and configure a volume encrypted with LUKS hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_volumes: - name: barefs type: disk disks: - sdb fs_type: xfs fs_label: label-name mount_point: /mnt/data encryption: true encryption_password: <password>また、

encryption_key、encryption_cipher、encryption_key_size、encryption_luksなど、他の暗号化パラメーターを Playbook ファイルに追加することもできます。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

検証

暗号化ステータスを表示します。

# cryptsetup status sdb /dev/mapper/sdb is active and is in use. type: LUKS2 cipher: aes-xts-plain64 keysize: 512 bits key location: keyring device: /dev/sdb ...作成された LUKS 暗号化ボリュームを確認します。

# cryptsetup luksDump /dev/sdb Version: 2 Epoch: 6 Metadata area: 16384 [bytes] Keyslots area: 33521664 [bytes] UUID: a4c6be82-7347-4a91-a8ad-9479b72c9426 Label: (no label) Subsystem: (no subsystem) Flags: allow-discards Data segments: 0: crypt offset: 33554432 [bytes] length: (whole device) cipher: aes-xts-plain64 sector: 4096 [bytes] ...

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー - LUKS を使用したブロックデバイスの暗号化

2.16. storage RHEL システムロールを使用してプールボリュームのサイズをパーセンテージで表す

このサンプル Ansible Playbook は、storage システムロールを適用して、論理マネージャーボリューム (LVM) のボリュームサイズをプールの合計サイズのパーセンテージで表現できるようにします。

前提条件

- 制御ノードと管理ノードを準備している

- 管理対象ノードで Playbook を実行できるユーザーとしてコントロールノードにログインしている。

-

管理対象ノードへの接続に使用するアカウントに、そのノードに対する

sudo権限がある。

手順

次の内容を含む Playbook ファイル (例:

~/playbook.yml) を作成します。--- - name: Express volume sizes as a percentage of the pool's total size hosts: managed-node-01.example.com roles: - rhel-system-roles.storage vars: storage_pools: - name: myvg disks: - /dev/sdb volumes: - name: data size: 60% mount_point: /opt/mount/data - name: web size: 30% mount_point: /opt/mount/web - name: cache size: 10% mount_point: /opt/cache/mountこの例では、LVM ボリュームのサイズをプールサイズのパーセンテージで指定します (例:

60%)。LVM ボリュームのサイズは、人間が判読できるファイルシステムのサイズ (例:10gまたは50 GiB) に占めるプールサイズのパーセンテージで指定することもできます。Playbook の構文を検証します。

$ ansible-playbook --syntax-check ~/playbook.ymlこのコマンドは構文を検証するだけであり、有効だが不適切な設定から保護するものではないことに注意してください。

Playbook を実行します。

$ ansible-playbook ~/playbook.yml

関連情報

-

/usr/share/ansible/roles/rhel-system-roles.storage/README.mdfile -

/usr/share/doc/rhel-system-roles/storage/ディレクトリー

第3章 NFS 共有のマウント

システム管理者は、システムにリモート NFS 共有をマウントすると、共有データにアクセスできます。

3.1. NFS ホスト名の形式

本セクションでは、NFS 共有をマウントまたはエクスポートするときにホストの指定に使用するさまざまな形式を説明します。

次の形式でホストを指定できます。

- 単独のマシン

次のいずれかになります。

- 完全修飾ドメイン名 (サーバーにより解決)

- ホスト名 (サーバーにより解決)

- IP アドレス

- IP ネットワーク

以下のいずれかの形式が有効です。

-

a.b.c.d/z-a.b.c.dがネットワークで、zがネットマスクのビット数になります (例:192.168.0.0/24)。 -

a.b.c.d/netmask-a.b.c.dがネットワークで、netmaskがネットマスクになります (例:192.168.100.8/255.255.255.0)。

-

- Netgroup

-

@group-name形式 -group-nameは NIS netgroup 名です。

3.2. ファイアウォールの内側で動作するように NFSv3 クライアントを設定する手順

ファイアウォールの内側で実行するように NFSv3 クライアントを設定する手順は、ファイアウォールの内側で実行するように NFSv3 サーバーを設定する手順と似ています。

設定するマシンが NFS クライアントとサーバーの両方である場合には、Configuring an NFSv3 server with optional NFSv4 support で説明されている手順に従います。

以下の手順では、ファイアウォールの内側でのみ NFS クライアントマシンを設定する方法を説明します。

手順

クライアントがファイアウォールの内側で NFS クライアントにコールバックを実行できるようにするには、NFS クライアントで以下のコマンドを実行して

rpc-bindサービスをファイアウォールに追加します。firewall-cmd --permanent --add-service rpc-bind/etc/nfs.confファイルで、RPC サービスnlockmgrが使用するポートを次のように指定します。[lockd] port=port-number udp-port=upd-port-number

または、

/etc/modprobe.d/lockd.confファイルで、nlm_tcpportおよびnlm_udpportを指定することもできます。NFS クライアントで以下のコマンドを実行して、ファイアウォールで指定したポートを開きます。

firewall-cmd --permanent --add-port=<lockd-tcp-port>/tcp firewall-cmd --permanent --add-port=<lockd-udp-port>/udp

以下のように、

/etc/nfs.confファイルの[statd]セクションを編集して、rpc.statdの静的ポートを追加します。[statd] port=port-numberNFS クライアントで以下のコマンドを実行して、ファイアウォールに追加したポートを開きます。

firewall-cmd --permanent --add-port=<statd-tcp-port>/tcp firewall-cmd --permanent --add-port=<statd-udp-port>/udp

ファイアウォール設定を再読み込みします。

firewall-cmd --reloadrpc-statdサービスを再起動します。# systemctl restart rpc-statd.serviceまたは、

/etc/modprobe.d/lockd.confファイルのlockdポートを指定した場合は、次のコマンドを実行します。/proc/sys/fs/nfs/nlm_tcpportと/proc/sys/fs/nfs/nlm_udpportの現在の値を更新します。# sysctl -w fs.nfs.nlm_tcpport=<tcp-port> # sysctl -w fs.nfs.nlm_udpport=<udp-port>

rpc-statdサービスを再起動します。# systemctl restart rpc-statd.service

3.3. ファイアウォールの内側で動作するように NFSv4 クライアントを設定する手順

この手順は、クライアントが NFSv4.0 を使用している場合に限り行います。その場合は、NFSv4.0 コールバックのポートを開く必要があります。

この手順は、NFSv4.1 以降では必要ありません。これは、新しいプロトコルバージョンでは、クライアントによって開始された同じ接続でサーバーがコールバックを実行するためです。

手順

NFSv4.0 コールバックがファイアウォールを通過できるようにするには、以下のように

/proc/sys/fs/nfs/nfs_callback_tcpportを設定して、サーバーがクライアントのそのポートに接続できるようにします。# echo "fs.nfs.nfs_callback_tcpport = <callback-port>" >/etc/sysctl.d/90-nfs-callback-port.conf # sysctl -p /etc/sysctl.d/90-nfs-callback-port.conf

NFS クライアントで以下のコマンドを実行して、ファイアウォールの指定のポートを開きます。

firewall-cmd --permanent --add-port=<callback-port>/tcpファイアウォール設定を再読み込みします。

firewall-cmd --reload

3.4. NFS エクスポートの検出

この手順では、特定の NFSv3 または NFSv4 サーバーがエクスポートしているファイルシステムを検出します。

手順

NFSv3 に対応しているサーバーで、

showmountユーティリティーを使用します。$ showmount --exports my-server Export list for my-server /exports/foo /exports/bar

NFSv4 に対応しているサーバーで、root ディレクトリーをマウントして確認します。

# mount my-server:/ /mnt/ # ls /mnt/ exports # ls /mnt/exports/ foo bar

NFSv4 と NFSv3 の両方に対応するサーバーでは、上記の方法はいずれも有効で、同じ結果となります。

関連情報

-

showmount(8)man ページ

3.5. mount で NFS 共有のマウント

mount ユーティリティーを使用して、サーバーからエクスポートされた NFS 共有をマウントします。

NFS クライアントが同じ短いホスト名を使用している場合は、NFSv4 clientid で競合が発生し、それらが突然期限切れになることがあります。NFSv4 clientid が突然期限切れになる可能性を回避するには、使用しているシステムに応じて、NFS クライアントに一意のホスト名を使用するか、各コンテナーで識別子を設定する必要があります。詳細については、ナレッジベース記事 NFSv4 clientid was expired suddenly due to use same hostname on several NFS clients を参照してください。

手順

NFS 共有をマウントするには、次のコマンドを使用します。

# mount -t nfs -o options host:/remote/export /local/directory

このコマンドは、以下のような変数を使用します。

- options

- マウントオプションのコンマ区切りリスト

- host

- マウントするファイルシステムをエクスポートするサーバーのホスト名、IP アドレス、または完全修飾ドメイン名。

- /remote/export

- サーバーからエクスポートされるファイルシステムまたはディレクトリー、つまりマウントするディレクトリー。

- /local/directory

- /remote/export がマウントされているクライアントの場所

関連情報

- 一般的な NFS マウントオプション

- NFS ホスト名の形式

-

mount(8)の man ページ -

exports(5)man ページ

3.6. クライアントで pNFS SCSI の設定

この手順では、pNFS SCSI レイアウトをマウントするように NFS クライアントを設定します。

前提条件

- NFS サーバーは、pNFS SCSI で XFS ファイルシステムをエクスポートするように設定されています。

手順

クライアントで、NFS バージョン 4.1 以降を使用して、エクスポートした XFS ファイルシステムをマウントします。

# mount -t nfs -o nfsvers=4.1 host:/remote/export /local/directory

NFS なしで XFS ファイルシステムを直接マウントしないでください。

3.7. mountstats でクライアントからの pNFS SCSI 操作のチェック

この手順では、/proc/self/mountstats ファイルを使用して、クライアントから pNFS SCSI 操作を監視します。

手順

マウントごとの操作カウンターをリスト表示します。

# cat /proc/self/mountstats \ | awk /scsi_lun_0/,/^$/ \ | egrep device\|READ\|WRITE\|LAYOUT device 192.168.122.73:/exports/scsi_lun_0 mounted on /mnt/rhel7/scsi_lun_0 with fstype nfs4 statvers=1.1 nfsv4: bm0=0xfdffbfff,bm1=0x40f9be3e,bm2=0x803,acl=0x3,sessions,pnfs=LAYOUT_SCSI READ: 0 0 0 0 0 0 0 0 WRITE: 0 0 0 0 0 0 0 0 READLINK: 0 0 0 0 0 0 0 0 READDIR: 0 0 0 0 0 0 0 0 LAYOUTGET: 49 49 0 11172 9604 2 19448 19454 LAYOUTCOMMIT: 28 28 0 7776 4808 0 24719 24722 LAYOUTRETURN: 0 0 0 0 0 0 0 0 LAYOUTSTATS: 0 0 0 0 0 0 0 0結果は以下のようになります。

-

LAYOUT統計は、クライアントとサーバーが pNFS SCSI 操作を使用する要求を示します。 -

READおよびWRITEの統計は、クライアントとサーバーが NFS 操作にフォールバックする要求を示します。

-

3.8. 一般的な NFS マウントオプション

以下は、NFS 共有をマウントするときに一般的に使用されるオプションです。これらのオプションは、手動 mount コマンド、/etc/fstab 設定、および autofs で使用できます。

lookupcache=mode-

任意のマウントポイントに対して、カーネルがディレクトリーエントリーのキャッシュを管理する方法を指定します。mode の有効な引数は、

all、none、またはpositiveです。 nfsvers=version使用する NFS プロトコルのバージョンを指定します。version は、

3、4、4.0、4.1、または4.2になります。これは、複数の NFS サーバーを実行しているホストや、より低いバージョンでのマウントの再試行を無効にするのに役立ちます。バージョンを指定しないと、NFS により、カーネルとmountユーティリティーで対応している最新バージョンが使用されます。versオプションはnfsversと同じで、互換性のためにこのリリースに含まれています。noacl- ACL の処理をすべてオフにします。古いバージョンの Red Hat Enterprise Linux、Red Hat Linux、または Solaris と連動させる場合に必要となることがあります。こうした古いシステムには、最新の ACL テクノロジーに対する互換性がないためです。

nolock- ファイルのロック機能を無効にします。この設定は、非常に古いバージョンの NFS サーバーに接続する場合に必要となる場合があります。

noexec- マウントしたファイルシステムでバイナリーが実行されないようにします。互換性のないバイナリーを含む、Linux 以外のファイルシステムをマウントしている場合に便利です。

nosuid-

set-user-identifierビットおよびset-group-identifierビットを無効にします。これにより、リモートユーザーは、setuidプログラムを実行してより高い権限を取得できなくなります。 port=num-

NFS サーバーポートの数値を指定します。num が

0(デフォルト値) の場合、mountは、使用するポート番号を、リモートホストのrpcbindサービスに問い合わせます。リモートホストの NFS サービスがそのrpcbindサービスに登録されていない場合は、代わりに TCP 2049 の標準 NFS ポート番号が使用されます。 rsize=numandwsize=numこのオプションは、1 回の NFS 読み取り操作または書き込み操作で転送される最大バイト数を設定します。

rsizeとwsizeには、固定のデフォルト値がありません。デフォルトでは、NFS はサーバーとクライアントの両方がサポートしている最大の値を使用します。Red Hat Enterprise Linux 9 では、クライアントとサーバーの最大値は 1,048,576 バイトです。詳細は、NFS マウントを使用した場合の rsize と wsize のデフォルト値と最大値 参照してください。KBase の記事。sec=flavorsマウントされたエクスポート上のファイルにアクセスするために使用するセキュリティーフレーバーです。flavors の値は、複数のセキュリティーフレーバーのコロンで区切られたリストです。

デフォルトでは、クライアントは、クライアントとサーバーの両方をサポートするセキュリティーフレーバーの検索を試みます。サーバーが選択したフレーバーのいずれかに対応していない場合、マウント操作は失敗します。

利用可能なフレーバー:

-

sec=sysは、ローカルの UNIX UID および GID を使用します。AUTH_SYSを使用して NFS 操作を認証します。 -

sec=krb5は、ユーザー認証に、ローカルの UNIX の UID と GID ではなく、Kerberos V5 を使用します。 -

sec=krb5iは、ユーザー認証に Kerberos V5 を使用し、データの改ざんを防ぐ安全なチェックサムを使用して、NFS 操作の整合性チェックを行います。 -

sec=krb5pは、ユーザー認証に Kerberos V5 を使用し、整合性チェックを実行し、トラフィックの傍受を防ぐため NFS トラフィックの暗号化を行います。これが最も安全な設定になりますが、パフォーマンスのオーバーヘッドも最も高くなります。

-

tcp- NFS マウントが TCP プロトコルを使用するよう指示します。

関連情報

-

mount(8)の man ページ -

nfs(5)man ページ

3.9. NFS でユーザー設定の保存

NFS ホームディレクトリーを使用するシステムで GNOME を使用する場合は、dconf データベースの keyfile バックエンドを設定する必要があります。そうしないと、dconf が正常に機能しない可能性があります。この設定では、dconf は設定を ~/.config/dconf-keyfile/user ファイルに保存します。

手順

-

すべてのクライアントで

/etc/dconf/profile/userファイルを作成または編集します。 /etc/dconf/profile/userファイルの先頭に、次の行を追加します。service-db:keyfile/user

ユーザーはログアウトしてから再度ログインする必要があります。

dconfはkeyfileバックエンドをポーリングして更新が行われたかどうかを判断するため、設定がすぐに更新されない可能性があります。

3.10. FS-Cache の使用

FS-Cache は、ファイルシステムがネットワーク経由で取得したデータをローカルディスクにキャッシュするために使用できる永続的なローカルキャッシュです。これは、ネットワーク経由でマウントされたファイルシステムからデータにアクセスするユーザーのネットワークトラフィックを最小限に抑えます (例: NFS)。

3.10.1. FS-Cache の概要

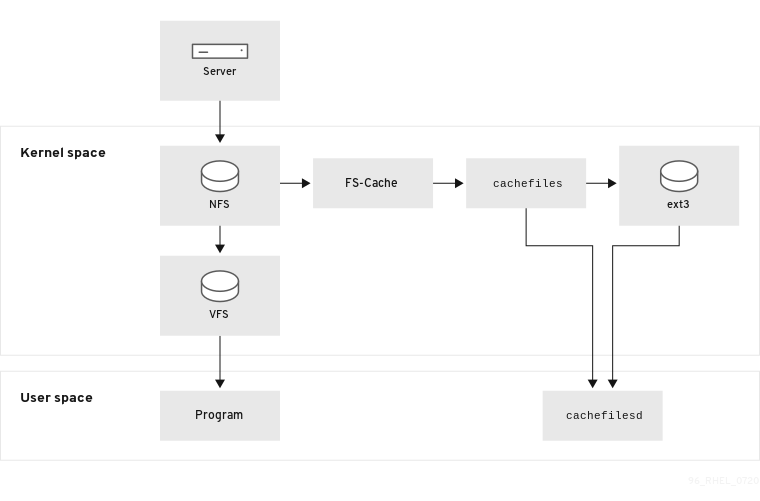

以下の図は、FS-Cache の仕組みの概要を示しています。

図3.1 FS-Cache の概要

FS-Cache は、システムのユーザーおよび管理者が可能な限り透過的になるように設計されています。Solaris では cachefs とは異なり、サーバー上のファイルシステムは、オーバーマウントしたファイルシステムを作成せずに、クライアントのローカルキャッシュと直接対話できます。NFS では、マウントオプションにより、FS-cache が有効になっている NFS 共有をマウントするようにクライアントに指示します。マウントポイントにより、fscache と cachefiles の 2 つのカーネルモジュールの自動アップロードが実行します。cachefilesd デーモンは、カーネルモジュールと通信してキャッシュを実装します。

FS-Cache はネットワーク上で機能するファイルシステムの基本操作を変更せず、単にデータをキャッシュできる永続的な場所でファイルシステムを提供するだけです。たとえば、クライアントは FS-Cache が有効になっているかどうかに関わらず、NFS 共有をマウントできます。さらに、キャッシュされた NFS は、ファイルが部分的にキャッシュされ、事前完全に読み込む必要がないため、ファイル (個別または一括) に収まらないファイルを処理できます。また、FS-Cache は、クライアントファイルシステムドライバーからキャッシュで発生するすべての I/O エラーも非表示にします。

キャッシングサービスを提供するには、キャッシュバックエンド が必要です。キャッシュバックエンドは、cachefiles であるキャッシングサービスを提供するように設定されたストレージドライバーです。この場合、FS-Cache には、キャッシュバックエンドとして bmap および拡張属性をサポートするマウントされたブロックベースのファイルシステム (ext3 など) が必要です。

FS-Cache のキャッシュバックエンドで必要とされる機能に対応するファイルシステムには、以下のファイルシステムの Red Hat Enterprise Linux 9 実装が含まれます。

- ext3 (拡張属性が有効)

- ext4

- XFS

FS-Cache は、ネットワークを介するかどうかに関係なく、ファイルシステムを任意にキャッシュすることはできません。共有ファイルシステムのドライバーを変更して、FS-Cache、データストレージ/検索、メタデータのセットアップと検証を操作できるようにする必要があります。FS-Cache では、永続性に対応するためにキャッシュされたファイルシステムの インデックスキー と 一貫性データ が必要になります。インデックスキーはファイルシステムオブジェクトをキャッシュオブジェクトに一致させ、一貫性データを使用してキャッシュオブジェクトが有効のままかどうかを判断します。

Red Hat Enterprise Linux 9 では、cachefilesd パッケージはデフォルトでインストールされていないため、手動でインストールする必要があります。

3.10.2. パフォーマンスに関する保証

FS-Cache は、パフォーマンスの向上を 保証しません。キャッシュを使用するとパフォーマンスが低下します。たとえば、キャッシュされた NFS 共有では、ネットワーク間のルックアップにディスクアクセスが追加されます。FS-Cache は可能な限り非同期となりますが、非同期にできない同期パス (read 操作など) があります。

たとえば、FS-Cache を使用して、通常は負荷のない GigE ネットワークを介して 2 台のコンピューター間の NFS 共有をキャッシュしても、ファイルアクセスのパフォーマンスは向上しない可能性があります。代わりに、NFS 要求はローカルディスクからではなく、サーバーメモリーより早く満たされます。

したがって、FS-Cache の使用は、さまざまな要因における 妥協 です。たとえば、NFS トラフィックのキャッシュに FS-Cache を使用すると、クライアントは多少遅くなりますが、ネットワークの帯域幅を消費せずにローカルに読み取り要求を満たすことでネットワークおよびサーバーの読み込み負荷が大幅に削減されます。

3.10.3. NFS でのキャッシュの使用

明示的に指示されない限り、NFS はキャッシュを使用しません。ここでは、FS-Cache を使用して NFS マウントを設定する方法を説明します。

NFS インデックスは NFS ファイルハンドルを使用してコンテンツをキャッシュします。ファイル名ではなく、ハードリンクされたファイルはキャッシュを正しく共有します。

NFS バージョン 3、4.0、4.1、および 4.2 はキャッシュに対応します。ただし、各バージョンはキャッシュに異なるブランチを使用します。

前提条件

cachefilesd パッケージがインストールされ、実行している。これを実行していることを確認するには、次のコマンドを使用します。

# systemctl start cachefilesd # systemctl status cachefilesd

ステータスは active (running) である必要があります。

手順

以下のオプションで NFS 共有をマウントします。

# mount nfs-share:/ /mount/point -o fscファイルがダイレクト I/O や書き込みのために開いていない限り、

/mount/pointの下にあるファイルへのアクセスはすべてキャッシュを経由します。

3.10.4. キャッシュの設定

現在、Red Hat Enterprise Linux 9 は cachefiles キャッシュバックエンドのみを提供します。cachefilesd デーモンは cachefiles を開始し、管理します。/etc/cachefilesd.conf ファイルは、cachefiles によるキャッシュサービスの提供方法を制御します。

キャッシュバックエンドは、キャッシュをホストしているパーティション上の一定の空き領域を維持することで動作します。空き領域を使用する他の要素に応じてキャッシュを増大および縮小し、root ファイルシステム (ラップトップなど) で安全に使用できるようにします。FS-Cache ではこの動作でデフォルト値を設定します。これは、キャッシュカリング制限 で設定できます。キャッシュカリング制限の設定方法は、キャッシュカリング制限の設定 を参照してください。

この手順では、キャッシュを設定する方法を説明します。

前提条件

cachefilesd パッケージがインストールされ、サービスが正常に起動しました。サービスが実行中であることを確認するには、次のコマンドを使用します。

# systemctl start cachefilesd # systemctl status cachefilesd

ステータスは active (running) である必要があります。

手順

キャッシュとして使用するディレクトリーをキャッシュバックエンドで設定するには、次のパラメーターを使用します。

$ dir /path/to/cache一般的に、キャッシュバックエンドディレクトリーは、以下のように

/etc/cachefilesd.conf内に/var/cache/fscacheとして設定されます。$ dir /var/cache/fscache

キャッシュバックエンドのディレクトリーを変更する場合、selinux コンテキストは

/var/cache/fscacheと同じである必要があります。# semanage fcontext -a -e /var/cache/fscache /path/to/cache # restorecon -Rv /path/to/cache

- キャッシュを設定する際に、/path/to/cache をディレクトリー名に置き換えます。

selinux コンテキストを設定するコマンドが機能しない場合は、以下のコマンドを使用します。

# semanage permissive -a cachefilesd_t # semanage permissive -a cachefiles_kernel_t

FS-Cache は、

/path/to/cacheをホストするファイルシステムにキャッシュを保存します。ラップトップでは、root ファイルシステム (/) をホストのファイルシステムとして使用することが推奨されますが、デスクトップマシンの場合は、キャッシュ専用のディスクパーティションをマウントするより慎重に行ってください。ホストのファイルシステムは、ユーザー定義の拡張属性をサポートする必要があります。FS-Cache はこれらの属性を使用して、一貫性維持情報を保存します。ext3 ファイルシステムを備えたデバイスでユーザー定義の拡張属性を有効にするには、次のように入力します。

# tune2fs -o user_xattr /dev/device

代わりに、マウント時にファイルシステムの拡張属性を有効にするには、次のコマンドを使用します。

# mount /dev/device /path/to/cache -o user_xattr

設定ファイルを置いたら、

cachefilesdサービスを起動します。# systemctl start cachefilesd

起動時に

cachefilesdが起動するように設定するには、root で次のコマンドを実行します。# systemctl enable cachefilesd

3.10.5. NFS キャッシュ共有の設定

NFS キャッシュの共有には潜在的な問題がいくつかあります。キャッシュは永続的であるため、キャッシュ内のデータブロックは 4 つのキーのシーケンスでインデックス化されます。

- レベル 1: サーバーの詳細

- レベル 2: 一部のマウントオプション、セキュリティータイプ、FSID、識別子

- レベル 3: ファイルハンドル

- レベル 4: ファイル内のページ番号

スーパーブロック間の整合性の管理に関する問題を回避するには、データのキャッシュを必要とする NFS のすべてのスーパーブロックに、固有のレベル 2 キーを設定します。通常、同じソースボリュームとオプションを持つ 2 つの NFS マウントはスーパーブロックを共有しているため、そのボリューム内に異なるディレクトリーをマウントする場合でもキャッシュを共有することになります。

以下は、異なるオプションでキャッシュ共有を設定する方法の例になります。

手順

次のコマンドで NFS 共有をマウントします。

mount home0:/disk0/fred /home/fred -o fsc mount home0:/disk0/jim /home/jim -o fsc

/home/fredおよび/home/jimには同じオプションがあるため、スーパーブロックを共有する可能性が高くなります。特に NFS サーバー上の同じボリュームやパーティションから作成されている場合は共有する可能性が高くなります (home0)。スーパーブロックを共有しないようにするには、

mountコマンドに以下のオプションを付けて実行します。mount home0:/disk0/fred /home/fred -o fsc,rsize=8192 mount home0:/disk0/jim /home/jim -o fsc,rsize=65536

この場合、

/home/fredと/home/jimは、レベル 2 キーの異なるネットワークアクセスパラメーターを持つため、スーパーブロックを共有しません。2 つのサブツリー (

/home/fred1と/home/fred2) のコンテンツを 2 回 キャッシュしてスーパーブロックを共有しないようにするには、次のコマンドを使用します。mount home0:/disk0/fred /home/fred1 -o fsc,rsize=8192 mount home0:/disk0/fred /home/fred2 -o fsc,rsize=65536

スーパーブロックの共有を回避するもう 1 つの方法は、

nosharecacheパラメーターで明示的に共有を回避することです。同じ例を使用します。mount home0:/disk0/fred /home/fred -o nosharecache,fsc mount home0:/disk0/jim /home/jim -o nosharecache,fsc

ただし、この場合は、レベル 2 キーの

home0:/disk0/fredおよびhome0:/disk0/jimを区別することができないため、使用できるスーパーブロックは 1 つだけとなります。スーパーブロックにアドレスを指定するには、

fsc=unique-identifierマウントオプションを使用して、少なくとも 1 つのマウントに 一意の識別子 を設定します。次に例を示します。mount home0:/disk0/fred /home/fred -o nosharecache,fsc mount home0:/disk0/jim /home/jim -o nosharecache,fsc=jim

/home/jimのキャッシュで使用されるレベル 2 キーに固有識別子のjimが追加されます。

ユーザーは、異なる通信またはプロトコルパラメーターを持つスーパーブロック間でキャッシュを共有することはできません。たとえば、NFSv4.0 と NFSv3 の間、NFSv4.1 と NFSv4.2 間で共有することはできません。これは、強制されるスーパーブロックが異なるためです。また、読み込みサイズ (rsize) などのパラメーターを設定すると、キャッシュの共有が回避されます。これは、別のスーパーブロックを強制するためです。

3.10.6. NFS でのキャッシュの制限

NFS にはキャッシュの制限がいくつかあります。

- ダイレクト I/O で共有ファイルシステムからファイルを開くと、自動的にキャッシュが回避されます。これは、この種のアクセスがサーバーに直接行なわれる必要があるためです。

- ダイレクト I/O または書き込みのいずれかで共有ファイルシステムからファイルを開くと、キャッシュされたファイルのコピーがフラッシュされます。ダイレクト I/O や書き込みのためにファイルが開かれなくなるまで、FS-Cache はファイルを再キャッシュしません。

- さらに、FS-Cache の今回のリリースでは、通常の NFS ファイルのみをキャッシュします。FS-Cache はディレクトリー、シンボリックリンク、デバイスファイル、FIFO、ソケットを キャッシュしません。

3.10.7. キャッシュカリング制限の設定

cachefilesd デーモンは、共有ファイルシステムからディスクの空き領域にリモートデータをキャッシュすることで機能します。これにより、利用可能な空き領域がすべて消費される可能性があり、ディスクがルートパーティションも格納している場合は問題になる可能性があります。これを制御するために、cachefilesd は、最近のアクセスが少ないオブジェクトなどの古いオブジェクトをキャッシュから破棄することで、一定量の空き領域を維持しようとします。この動作は キャッシュカリング と呼ばれます。

キャッシュカリングは、基盤となるファイルシステムで使用可能なブロックのパーセンテージとファイルのパーセンテージに基づいて行われます。/etc/cachefilesd.conf には、6 つの制限を制御する設定が存在します。

- brun N% (ブロックのパーセンテージ)、frun N% (ファイルのパーセンテージ)

- キャッシュの空き領域と利用可能なファイルの数がこれらの制限を上回ると、カリングはオフになります。

- bcull N% (ブロックのパーセンテージ)、fcull N% (ファイルのパーセンテージ)

- キャッシュの空き領域と利用可能なファイルの数がこれらの制限のいずれかを下回ると、カリング動作が開始します。

- bstop N% (ブロックのパーセンテージ)、fstop N% (ファイルのパーセンテージ)

- キャッシュ内の使用可能な領域または使用可能なファイルの数がこの制限のいずれかを下回ると、カリングによってこれらの制限を超える状態になるまで、ディスク領域またはファイルのそれ以上の割り当ては許可されません。

各設定の N のデフォルト値は以下の通りです。

-

brun/frun- 10% -

bcull/fcull- 7% -

bstop/fstop- 3%

この設定を行う場合は、以下の条件を満たす必要があります。

-

0 ≤

bstop<bcull<brun< 100 -

0 ≤

fstop<fcull<frun< 100

これは、空き領域と利用可能なファイルの割合であり、100 から、df プログラムで表示される割合を引いたものではありません。

カリングは、bxxx と fxxx のペアを同時に依存します。ユーザーが個別に処理することはできません。

3.10.8. fscache カーネルモジュールからの統計情報の取得

FS-Cache は一般的な統計情報も追跡します。以下の手順では、この情報を取得する方法を説明します。

手順

FS-Cache に関する統計情報を表示するには、次のコマンドを使用します。

# cat /proc/fs/fscache/stats

FS-Cache 統計には、デシジョンポイントとオブジェクトカウンターに関する情報が含まれます。詳細は、以下のカーネルドキュメントを参照してください。

/usr/share/doc/kernel-doc-4.18.0/Documentation/filesystems/caching/fscache.txt

3.10.9. FS-Cache の参考資料

本セクションでは、FS-Cache の参考情報を詳細します。

achefilesdとその設定方法の詳細については、man queuefilesdおよびman queuefilesd.confを参照してください。その他にも、以下のカーネルドキュメントを参照してください。-

/usr/share/doc/cachefilesd/README -

/usr/share/man/man5/cachefilesd.conf.5.gz -

/usr/share/man/man8/cachefilesd.8.gz

-

設計上の制約、利用可能な統計、機能など、FS-Cache に関する一般的な情報は、以下のカーネルドキュメントを参照してください。

/usr/share/doc/kernel-doc-4.18.0/Documentation/filesystems/caching/fscache.txt

第4章 NFS サーバーのデプロイ

ネットワークファイルシステム(NFS)プロトコルを使用すると、リモートユーザーはネットワーク経由で共有ディレクトリーをマウントし、ローカルにマウントされたように使用できます。また、リソースを、ネットワークの集中化サーバーに統合できるようになります。

4.1. NFSv4 のマイナーバージョンの主な機能

各マイナーバージョン NFSv4 では、パフォーマンスとセキュリティーを強化することを目的とした機能強化が行われています。この改善を使用して NFSv4 を最大限に活用し、ネットワーク全体で効率的で信頼性の高いファイル共有を確保します。

NFSv4.2 の主な機能

- サーバー側コピー

- サーバー側のコピーは、ネットワーク上でデータを転送せずにサーバー上のファイルをコピーする NFS サーバーの機能です。

- スパースファイル

- ファイルに、ゼロのみで設定される未割り当てまたは初期化されていないデータブロックである 1 つ以上の空白またはギャップを持たせることができます。これにより、アプリケーションはスパースファイルのホールの場所をマッピングできるようになります。

- 領域の予約

- クライアントは、データを書き込む前にストレージサーバーに領域を予約または割り当てることができます。これにより、サーバーが領域を使い果たすのを防ぎます。

- ラベル付き NFS

- データアクセス権を強制し、NFS ファイルシステム上の個々のファイルに対して、クライアントとサーバーとの間の SELinux ラベルを有効にします。

- レイアウトの機能強化

- Parallel NFS (pNFS)サーバーが、より良いパフォーマンス統計を収集することを有効にする機能を提供します。

NFSv4.1 の主な機能

- pNFS のクライアント側のサポート

- クラスター化されたサーバーへの高速 I/O のサポートにより、複数のマシンにデータを保存し、データへの直接アクセスを提供し、メタデータへの更新の同期を行うことができます。

- Sessions

- セッションは、クライアントに属する接続に対してサーバーの状態を維持します。これらのセッションにより、各リモートプロシージャコール(RPC)操作の接続の確立と終了に関連するオーバーヘッドが削減されるため、パフォーマンスと効率が向上します。

NFSv4.0 の主な機能

- RPC および security

-

RPCSEC_GSSフレームワークは、RPC セキュリティーを強化します。NFSv4 プロトコルでは、インバンドセキュリティーネゴシエーションの新しい操作が導入されました。これにより、クライアントはサーバーポリシーに対してファイルシステムリソースに安全にアクセスできるようになります。 - 手順および操作構造

-

NFS 4.0 では

COMPOUNDの手順が導入され、クライアントは複数の操作を 1 つのリクエストにマージして RPC を減らすことができます。 - ファイルシステムモデル

NFS 4.0 は、階層的なファイルシステムモデルを保持し、ファイルをバイトストリームとして扱い、国際化のために UTF-8 でエンコーディング名を処理します。

ファイルハンドルの種類

揮発性ファイルハンドルを使用すると、サーバーはファイルシステムの変更を調整し、永続的なファイルハンドルを必要とせずに、クライアントが必要に応じて調整できます。

属性タイプ

file 属性構造には、それぞれ個別の目的に対応する required、recommended、および名前付きの属性が含まれます。NFSv3 から派生する必須の属性は、ファイルタイプを区別するために不可欠ですが、ACL などの推奨される属性は、強化されたアクセス制御を提供します。

マルチサーバー名前空間

名前空間は複数のサーバーにまたがるため、属性に基づいてファイルシステムの転送を簡素化し、参照、冗長性、およびシームレスなサーバーの移行をサポートします。

- OPEN および CLOSE 操作

- これらの操作は、ファイルルックアップ、作成、およびセマンティック共有を 1 つのポイントで組み合わせて、ファイルアクセス管理をより効率的にすることができます。

- ファイルのロック

- ファイルのロックはプロトコルの一部であるため、RPC コールバックが不要になります。ファイルロックの状態は、リースベースのモデル下のサーバーによって管理されます。リースの更新に失敗すると、サーバーによって状態がリリースされる可能性があります。

- クライアントキャッシュおよび委譲

- 属性およびディレクトリーのキャッシュに対するクライアントが決定したタイムアウトが原因で、キャッシュは以前のバージョンに類似しています。NFS 4.0 の委譲により、サーバーは特定の責任をクライアントに割り当て、特定のファイル共有セマンティクスが保証され、サーバーの対話をすぐに行わずにローカルファイル操作を有効にできます。

4.2. AUTH_SYS 認証方式

AUTH_UNIX としても知られている AUTH_SYS メソッドは、クライアント認証メカニズムです。AUTH_SYS では、クライアントはユーザーのユーザー ID (UID)とグループ ID (GID)をサーバーに送信し、ファイルにアクセスするときにその ID とパーミッションを確認します。クライアント提供の情報に依存し、誤って設定された場合に不正アクセスを受けやすいようにするため、安全性は低くなります。

マッピングメカニズムにより、UID および GID の割り当てがシステム間で異なる場合でも、NFS クライアントがサーバー上で適切な権限を持つファイルにアクセスできるようになります。UID および GID は、以下のメカニズムにより、NFS クライアントとサーバー間でマッピングされます。

- 直接マッピング

UID および GID は、ローカルシステムとリモートシステム間で NFS サーバーおよびクライアントによって直接マッピングされます。これには、NFS ファイル共有に参加しているすべてのシステムで、一貫性のある UID および GID の割り当てが必要になります。たとえば、クライアントで UID 1000 のユーザーは、サーバー上で UID 1000 のユーザーがアクセス可能な共有上のファイルにのみアクセスできます。

NFS 環境で ID 管理を簡素化するために、管理者は多くの場合、複数のシステムにわたる UID および GID のマッピングを管理するために、LDAP やネットワーク情報サービス(NIS)などの集中型サービスに依存します。

- ユーザーおよびグループ ID のマッピング

-

NFS サーバーとクライアントは、

idmapdサービスを使用して、UID と GID を別のシステム間で変換し、一貫した識別と権限の割り当てを行うことができます。

4.3. AUTH_GSS 認証方式

Kerberos は、セキュアでないネットワーク上でのクライアントおよびサーバーに対するセキュアな認証を可能にするネットワーク認証プロトコルです。対称鍵暗号を使用し、ユーザーとサービスを認証するために、信頼できるキー配布センター(KDC)が必要です。

AUTH_SYS とは異なり、RPCSEC_GSS Kerberos メカニズムでは、サーバーは、どのユーザーがそのファイルにアクセスしているかを正しく表すことをクライアントに依存しません。代わりに、暗号を使用してサーバーにユーザーを認証し、悪意のあるクライアントがそのユーザーの Kerberos 認証情報を持たずにユーザーになりすますことがないようにします。

/etc/exports ファイルでは、sec オプションは共有が提供する Kerberos セキュリティーのメソッドを 1 つまたは複数定義し、クライアントはこれらの方法のいずれかで共有をマウントできます。sec オプションは、以下の値をサポートします。

-

sys: 暗号化保護なし(デフォルト) -

krb5- 認証のみ -

krb5i- 認証および整合性の保護 -

krb5p- 認証、整合性チェック、およびトラフィック暗号化

ある方法が提供する暗号化機能が多いほど、パフォーマンスは低下することに注意してください。

4.4. エクスポートするファイルシステムのファイル権限

エクスポートしたファイルシステムのファイル権限は、NFS 経由でそのファイルにアクセスするクライアントのファイルおよびディレクトリーへのアクセス権限を決定します。

NFS ファイルシステムがリモートホストによりマウントされると、各共有ファイルの唯一の保護はファイルシステムのパーミッションになります。同じユーザー ID (UID)の値を共有する 2 つのユーザーが、異なるクライアントシステムに同じ NFS ファイルシステムをマウントすると、ユーザーは互いのファイルを修正できるようになります。

NFS は、クライアントの root ユーザーを、サーバーの root ユーザーと同等のものとして扱います。ただし、デフォルトでは、NFS 共有にアクセスするときに、NFS サーバーは root を nobody アカウントにマッピングします。root_squash オプションは、この動作を制御します。

関連情報

-

exports(5)man ページ

4.5. NFS サーバーに必要なサービス

Red Hat Enterprise Linux (RHEL)は、カーネルモジュールとユーザー空間プロセスの組み合わせを使用して、NFS ファイル共有を提供します。

表4.1 NFS サーバーに必要なサービス

| サービス名 | NFS バージョン | 説明 |

|---|---|---|

|

| 3, 4 | 共有 NFS ファイルシステムに対する要求を処理する NFS カーネルモジュールです。 |

|

| 3 |

このプロセスは、ローカルのリモートプロシージャコール(RPC)サービスからポート予約を受け入れ、それらを利用可能にするか、アドバタイズされるようにして、対応するリモートの RPC サービスがそれらにアクセスできるようにします。 |

|

| 3, 4 |

このサービスは NFSv3 クライアントの 要求されている NFS 共有が現在 NFS サーバーによりエクスポートされているか、またその共有へのクライアントのアクセスが許可されているかを確認します。 |

|

| 3, 4 | このプロセスは、サーバーが定義する明示的な NFS バージョンとプロトコルをアドバタイズします。NFS クライアントが接続するたびにサーバースレッドを提供するなど、NFS クライアントの動的な要求を満たすためにカーネルで動作します。

|

|

| 3 | このカーネルモジュールは、Network Lock Manager (NLM)プロトコルを実装し、クライアントがサーバー上のファイルをロックできるようにします。RHEL は、NFS サーバーの実行時にモジュールを自動的に読み込みます。 |

|

| 3, 4 | このサービスは、リモートユーザーのユーザークォータ情報を提供します。 |

|

| 4 | このプロセスは、NFSv4 の名前(user @domain 形式の文字列)と、ローカルユーザーおよびグループ ID とマッピングを行う NFSv4 のクライアントおよびサーバーのアップコールを提供します。 |

|

| 3, 4 |

このサービスは、 |

|

| 4 | このサービスは、NFSv4 クライアント追跡デーモンを提供します。このデーモンは、ネットワークパーティションがサーバーの再起動と組み合わせて他のクライアントがロックの競合が発生した場合に、サーバーがロックの回収を許可しないようにします。 |

|

| 3 | このサービスは、ローカルホストの再起動時に他の NFSv3 クライアントに対して通知を提供し、リモート NFSv3 ホストの再起動時にカーネルに通知を提供します。 |

関連情報

-

rpcbind (8)、rpc.mountd (8)、rpc.nfsd (8)、rpc.statd (8)、rpc.rquotad (8)、rpc.idmapd (8)、nfsdcld (8)のman ページ

4.6. /etc/exports 設定ファイル

/etc/exports ファイルは、サーバーがエクスポートするディレクトリーを制御します。各行には、エクスポートポイント、ディレクトリーのマウントが許可されているクライアントの空白区切りリスト、および各クライアントのオプションが含まれています。

<directory> <host_or_network_1>(<options_1>) <host_or_network_n>(<options_n>)...

以下は、/etc/exports エントリーの個々の部分です。

- <export>

- エクスポートされるディレクトリー。

- <host_or_network>

- エクスポートを共有するホストまたはネットワークたとえば、ホスト名、IP アドレス、または IP ネットワークを指定できます。

- <options>

- ホストまたはネットワークのオプション。

クライアントとオプションの間にスペースを追加して、動作を変更します。たとえば、以下の行は同じ意味ではありません。

/projects client.example.com(rw) /projects client.example.com (rw)

最初の行では、サーバーは client.example.com のみが読み取り/書き込みモードで /projects ディレクトリーをマウントすることを許可し、他のホストは共有をマウントできません。ただし、2 行目の client.example.com と (rw) の間のスペースにより、サーバーはディレクトリーを読み取り専用モード(デフォルト設定)で client.example.com にエクスポートしますが、他のすべてのホストは共有を読み取り/書き込みモードでマウントできます。

NFS サーバーは、エクスポートされるディレクトリーごとに次のデフォルト設定を使用します。

表4.2 /etc/exports のエントリーのデフォルトオプション

| デフォルト設定 | 説明 |

|---|---|

|

| ディレクトリーを読み取り専用モードでエクスポートします。 |

|

| NFS サーバーは、以前の要求で発生した変更がディスクに書き込まれるまで、要求に応答しません。 |

|

| 別の書き込み要求が保留中であると思われる場合、サーバーはディスクへの書き込みを遅らせます。 |

|

|

クライアントの |

4.7. NFSv4 専用サーバーの設定

ネットワークに NFSv3 クライアントがない場合は、NFSv4 または特定のマイナープロトコルバージョンのみに対応するように NFS サーバーを設定できます。サーバーで NFSv4 のみを使用すると、ネットワークに開くポートの数が減ります。

手順

nfs-utilsパッケージをインストールします。# dnf install nfs-utils/etc/nfs.confファイルを編集し、以下の変更を加えます。[nfsd]セクションのvers3パラメーターを無効にして、NFSv3 を無効にします。[nfsd] vers3=n

オプション:特定の NFSv4 マイナーバージョンのみが必要な場合は、すべての

vers4.<minor_version> パラメーターのコメントを解除して、それに応じて設定します。以下に例を示します。[nfsd] vers3=n # vers4=y vers4.0=n vers4.1=n vers4.2=y

この設定では、サーバーは NFS バージョン 4.2 のみを提供します。

重要特定の NFSv4 マイナーバージョンのみが必要な場合は、マイナーバージョンのパラメーターのみを設定します。マイナーバージョンの予期しないアクティブ化や非アクティブ化を避けるために、

vers4パラメーターのコメントを解除しないでください。デフォルトでは、vers4パラメーターはすべての NFSv4 マイナーバージョンを有効または無効にします。ただし、この動作は、vers4を他のversパラメーターとともに設定すると変更されます。

NFSv3 関連のサービスをすべて無効にします。

# systemctl mask --now rpc-statd.service rpcbind.service rpcbind.socketオプション:共有するディレクトリーを作成します。以下に例を示します。

# mkdir -p /nfs/projects/既存のディレクトリーを共有する場合は、この手順を省略します。

/nfs/projects/ディレクトリーで必要なパーミッションを設定します。# chmod 2770 /nfs/projects/ # chgrp users /nfs/projects/

これらのコマンドは、

/nfs/projects/ディレクトリーのユーザーグループに書き込み権限を設定し、このディレクトリーに作成した新規エントリーに同じグループが自動的に設定されるようにします。共有する各ディレクトリーの

/etc/exportsファイルにエクスポートポイントを追加します。/nfs/projects/ 192.0.2.0/24(rw) 2001:db8::/32(rw)

このエントリーは、

/nfs/projects/ディレクトリーを共有し、192.0.2.0/24 および2001:db8::/32 サブネット内のクライアントへの読み取りおよび書き込みアクセスでアクセスできます。firewalldで関連するポートを開きます。# firewall-cmd --permanent --add-service nfs # firewall-cmd --reload

NFS サーバーを有効にして起動します。

# systemctl enable --now nfs-server

検証

サーバーで、設定した NFS バージョンのみをサーバーが提供していることを確認します。

# cat /proc/fs/nfsd/versions -3 +4 -4.0 -4.1 +4.2クライアントで以下の手順を実行します。

nfs-utilsパッケージをインストールします。# dnf install nfs-utilsエクスポートされた NFS 共有をマウントします。

# mount server.example.com:/nfs/projects/ /mnt/ユーザーグループのメンバーであるユーザーとして、

/mnt/にファイルを作成します。# touch /mnt/fileディレクトリーを一覧表示して、ファイルが作成されたことを確認します。

# ls -l /mnt/ total 0 -rw-r--r--. 1 demo users 0 Jan 16 14:18 file

4.8. オプションの NFSv4 サポートを使用した NFSv3 サーバーの設定

NFSv3 クライアントを依然として使用しているネットワークでは、NFSv3 プロトコルを使用して共有を提供するようにサーバーを設定します。ネットワークに新しいクライアントも存在する場合は、さらに NFSv4 を有効にできます。デフォルトでは、Red Hat Enterprise Linux NFS クライアントは、サーバーが提供する最新の NFS バージョンを使用します。

手順

nfs-utilsパッケージをインストールします。# dnf install nfs-utilsオプション:デフォルトでは、NFSv3 と NFSv4 が有効になります。NFSv4 または特定のマイナーバージョンのみが必要ない場合は、すべての

vers4.<minor_version> パラメーターをアンコメントして、適切に設定します。[nfsd] # vers3=y # vers4=y vers4.0=n vers4.1=n vers4.2=y

この設定では、サーバーは NFS バージョン 3 および 4.2 のみを提供します。

重要特定の NFSv4 マイナーバージョンのみが必要な場合は、マイナーバージョンのパラメーターのみを設定します。マイナーバージョンの予期しないアクティブ化や非アクティブ化を避けるために、

vers4パラメーターのコメントを解除しないでください。デフォルトでは、vers4パラメーターはすべての NFSv4 マイナーバージョンを有効または無効にします。ただし、この動作は、vers4を他のversパラメーターとともに設定すると変更されます。デフォルトでは、NFSv3 RPC サービスはランダムポートを使用します。ファイアウォールの設定を有効にするには、

/etc/nfs.confファイルで固定ポート番号を設定します。[lockd]セクションで、nlockmgrRPC サービスに固定ポート番号を設定します。次に例を示します。[lockd] port=5555この設定により、サービスは UDP プロトコルおよび TCP プロトコルの両方にこのポート番号を自動的に使用します。

[statd]セクションで、rpc.statdサービスに固定ポート番号を設定します。次に例を示します。[statd] port=6666この設定により、サービスは UDP プロトコルおよび TCP プロトコルの両方にこのポート番号を自動的に使用します。

オプション:共有するディレクトリーを作成します。以下に例を示します。

# mkdir -p /nfs/projects/既存のディレクトリーを共有する場合は、この手順を省略します。

/nfs/projects/ディレクトリーで必要なパーミッションを設定します。# chmod 2770 /nfs/projects/ # chgrp users /nfs/projects/

これらのコマンドは、

/nfs/projects/ディレクトリーのユーザーグループに書き込み権限を設定し、このディレクトリーに作成した新規エントリーに同じグループが自動的に設定されるようにします。共有する各ディレクトリーの

/etc/exportsファイルにエクスポートポイントを追加します。/nfs/projects/ 192.0.2.0/24(rw) 2001:db8::/32(rw)

このエントリーは、

/nfs/projects/ディレクトリーを共有し、192.0.2.0/24 および2001:db8::/32 サブネット内のクライアントへの読み取りおよび書き込みアクセスでアクセスできます。firewalldで関連するポートを開きます。# firewall-cmd --permanent --add-service={nfs,rpc-bind,mountd} # firewall-cmd --permanent --add-port={5555/tcp,5555/udp,6666/tcp,6666/udp} # firewall-cmd --reload

NFS サーバーを有効にして起動します。

# systemctl enable --now rpc-statd nfs-server

検証

サーバーで、設定した NFS バージョンのみをサーバーが提供していることを確認します。

# cat /proc/fs/nfsd/versions +3 +4 -4.0 -4.1 +4.2クライアントで以下の手順を実行します。

nfs-utilsパッケージをインストールします。# dnf install nfs-utilsエクスポートされた NFS 共有をマウントします。

# mount -o vers=<version> server.example.com:/nfs/projects/ /mnt/指定した NFS バージョンで共有がマウントされていることを確認します。

# mount | grep "/mnt" server.example.com:/nfs/projects/ on /mnt type nfs (rw,relatime,vers=3,...

ユーザーグループのメンバーであるユーザーとして、

/mnt/にファイルを作成します。# touch /mnt/fileディレクトリーを一覧表示して、ファイルが作成されたことを確認します。

# ls -l /mnt/ total 0 -rw-r--r--. 1 demo users 0 Jan 16 14:18 file

4.9. NFS サーバーでのクォータサポートの有効化

ユーザーまたはグループが保存できるデータ量を制限する場合は、ファイルシステムにクォータを設定できます。NFS サーバーでは、rpc-rquotad により、クォータが NFS クライアントのユーザーにも適用されるようにします。

手順

エクスポートするディレクトリーでクォータが有効になっていることを確認します。

ext ファイルシステムの場合は、次のように入力します。

# quotaon -p /nfs/projects/ group quota on /nfs/projects (/dev/sdb1) is on user quota on /nfs/projects (/dev/sdb1) is on project quota on /nfs/projects (/dev/sdb1) is offXFS ファイルシステムの場合は、次のように入力します。

# findmnt /nfs/projects TARGET SOURCE FSTYPE OPTIONS /nfs/projects /dev/sdb1 xfs rw,relatime,seclabel,attr2,inode64,logbufs=8,logbsize=32k,usrquota,grpquota

quota-rpcパッケージをインストールします。# dnf install rpc-quotadオプション: デフォルトでは、クォータ RPC サービスはポート 875 で実行されます。別のポートでサービスを実行する場合は、

/etc/sysconfig/rpc> を追加します。-rquotadファイルのRPCRQUOTADOPTS変数に -p <port_numberRPCRQUOTADOPTS="-p __<port_number>__"

オプション:デフォルトでは、リモートホストはクォータのみを読み取ることができます。クライアントがクォータを設定できるようにするには、

/etc/sysconfig/rpc-rquotadファイルのRPCRQUOTADOPTS変数に-Sオプションを追加します。RPCRQUOTADOPTS="-S"

firewalldでポートを開きます。# firewall-cmd --permanent --add-port=875/udp # firewall-cmd --reload

rpc-quotadサービスを有効にして起動します。# systemctl enable --now rpc-rquotad

検証

クライアント上:

エクスポートした共有をマウントします。

# mount server.example.com:/nfs/projects/ /mnt/クォータを表示します。コマンドは、エクスポートされたディレクトリーのファイルシステムによって異なります。以下に例を示します。

マウントされているすべての ext ファイルシステムで特定ユーザーのクォータを表示するには、次のコマンドを実行します。

# quota -u <user_name> Disk quotas for user demo (uid 1000): Filesystem space quota limit grace files quota limit grace server.example.com:/nfs/projects 0K 100M 200M 0 0 0XFS ファイルシステムでユーザーおよびグループのクォータを表示するには、次のコマンドを実行します。

# xfs_quota -x -c "report -h" /mnt/ User quota on /nfs/projects (/dev/vdb1) Blocks User ID Used Soft Hard Warn/Grace ---------- --------------------------------- root 0 0 0 00 [------] demo 0 100M 200M 00 [------]

関連情報

-

quota (1)の man ページ -

xfs_quota(8)man page

4.10. NFS サーバーでの NFS over RDMA の有効化

Remote Direct Memory Access (RDMA)は、クライアントシステムがストレージサーバーのメモリーから独自のメモリーにデータを直接転送できるようにするプロトコルです。これにより、ストレージスループットが向上し、サーバーとクライアント間のデータ転送のレイテンシーが短縮され、両端の CPU 負荷が軽減されます。NFS サーバーとクライアントの両方が RDMA 経由で接続されている場合、クライアントは NFSoRDMA を使用してエクスポートされたディレクトリーをマウントできます。

前提条件

- NFS サービスが稼働し、設定されている。

- InfiniBand デバイスまたは RDMA over Converged Ethernet (RoCE)デバイスがサーバーにインストールされている。

- IP over InfiniBand (IPoIB)がサーバーで設定され、InfiniBand デバイスに IP アドレスが割り当てられています。

手順

rdma-coreパッケージをインストールします。# dnf install rdma-coreパッケージがすでにインストールされている場合は、

/etc/rdma/modules/rdma.confファイルのxprtrdmaモジュールおよびsvcrdmaモジュールがコメント解除されていることを確認します。# NFS over RDMA client support xprtrdma # NFS over RDMA server support svcrdma

オプション: デフォルトでは、RDMA 上の NFS はポート 20049 を使用します。別のポートを使用する場合は、

/etc/nfs.confファイルの[nfsd]セクションでrdma-portを設定します。rdma-port=_<port>_

firewalldで NFSo RDMA ポートを開きます。# firewall-cmd --permanent --add-port={20049/tcp,20049/udp} # firewall-cmd --reload

20049 以外のポートを設定する場合は、ポート番号を調整します。

nfs-serverサービスを再起動します。# systemctl restart nfs-server

検証

InfiniBand ハードウェアを持つクライアントで、以下の手順を実行します。

以下のパッケージをインストールします。

# dnf install nfs-utils rdma-coreRDMA でエクスポートされた NFS 共有をマウントします。

# mount -o rdma server.example.com:/nfs/projects/ /mnt/デフォルト(20049)以外のポート番号を設定する場合は、port

= <port_number> をコマンドに渡します。# mount -o rdma,port=<port_number> server.example.com:/nfs/projects/ /mnt/共有が

rdmaオプションでマウントされていることを確認します。# mount | grep "/mnt" server.example.com:/nfs/projects/ on /mnt type nfs (...,proto=rdma,...)

4.11. Red Hat Identity Management ドメインで Kerberos を使用した NFS サーバーの設定

Red Hat Identity Management (IdM)を使用する場合は、NFS サーバーを IdM ドメインに参加させることができます。これにより、ユーザーおよびグループを一元管理し、認証、整合性の保護、およびトラフィック暗号化に Kerberos を使用できます。

前提条件

- NFS サーバーが Red Hat Identity Management (IdM)ドメインに 登録され ている。

- NFS サーバーが稼働しており、設定されている。

手順

IdM 管理者として kerberos チケットを取得します。

# kinit adminnfs/<FQDN> サービスプリンシパルを作成します。# ipa service-add nfs/nfs_server.idm.example.comIdM から

nfsサービスプリンシパルを取得し、/etc/krb5.keytabファイルに保存します。# ipa-getkeytab -s idm_server.idm.example.com -p nfs/nfs_server.idm.example.com -k /etc/krb5.keytabオプション:

/etc/krb5.keytabファイルのプリンシパルを表示します。# klist -k /etc/krb5.keytab Keytab name: FILE:/etc/krb5.keytab KVNO Principal ---- -------------------------------------------------------------------------- 1 nfs/nfs_server.idm.example.com@IDM.EXAMPLE.COM 1 nfs/nfs_server.idm.example.com@IDM.EXAMPLE.COM 1 nfs/nfs_server.idm.example.com@IDM.EXAMPLE.COM 1 nfs/nfs_server.idm.example.com@IDM.EXAMPLE.COM 7 host/nfs_server.idm.example.com@IDM.EXAMPLE.COM 7 host/nfs_server.idm.example.com@IDM.EXAMPLE.COM 7 host/nfs_server.idm.example.com@IDM.EXAMPLE.COM 7 host/nfs_server.idm.example.com@IDM.EXAMPLE.COMデフォルトでは、ホストを IdM ドメインに参加させる際に、IdM クライアントはホストプリンシパルを

/etc/krb5.keytabファイルに追加します。ホストプリンシパルがない場合は、ipa-getkeytab -s idm_server.idm.example.com -p host/nfs_server.idm.example.com -k /etc/krb5.keytabコマンドを使用して追加します。ipa-client-automountユーティリティーを使用して、IdM ID のマッピングを設定します。# ipa-client-automount Searching for IPA server... IPA server: DNS discovery Location: default Continue to configure the system with these values? [no]: yes Configured /etc/idmapd.conf Restarting sssd, waiting for it to become available. Started autofs

/etc/exportsファイルを更新し、Kerberos セキュリティーメソッドをクライアントオプションに追加します。以下に例を示します。/nfs/projects/ 192.0.2.0/24(rw,sec=krb5i)クライアントが複数のセキュリティーメソッドから選択できるようにするには、コロンで区切って指定します。

/nfs/projects/ 192.0.2.0/24(rw,sec=krb5:krb5i:krb5p)エクスポートしたファイルシステムをリロードします。

# exportfs -r

第5章 SMB 共有のマウント

Server Message Block (SMB) プロトコルは、アプリケーション層のネットワークプロトコルを実装します。これは、ファイル共有や共有プリンターなど、サーバー上のリソースにアクセスするために使用されます。

SMB のコンテキストでは、SMB ダイアレクトである CIFS (Common Internet File System) プロトコルが言及されています。SMB と CIFS の両方のプロトコルがサポートされており、SMB 共有と CIFS 共有のマウントに関連するカーネルモジュールとユーティリティーはどちらも cifs という名前を使用します。

cifs-utils パッケージには、以下を行うユーティリティーがあります。

- SMB 共有と CIFS 共有をマウントする

- カーネルのキーリングで、NT LAN Manager (NTLM) の認証情報を管理する

- SMB 共有および CIFS 共有のセキュリティー記述子で、アクセス制御リスト (ACL) を設定して、表示する

5.1. 対応している SMB プロトコルのバージョン

cifs.ko カーネルモジュールは、以下の SMB プロトコルバージョンをサポートします。

SMB 1

警告SMB1 プロトコルは既知のセキュリティー問題により非推奨となり、プライベートネットワークでのみ安全に使用する ことができます。SMB1 がサポートされているオプションとして推奨される主な理由は、現在 UNIX 拡張機能をサポートする唯一の SMB プロトコルバージョンであるためです。SMB で UNIX 拡張を使用する必要がない場合は、Red Hat は、SMB2 以降を使用することを強く推奨します。

- SMB 2.0

- SMB 2.1

- SMB 3.0

- SMB 3.1.1

プロトコルのバージョンによっては、一部の SMB 機能しか実装されていません。

5.2. UNIX 拡張機能のサポート

Samba は、SMB プロトコルの CAP_UNIX 機能ビットを使用して UNIX 拡張機能を提供します。これらの拡張機能は、cifs.ko カーネルモジュールでも対応します。ただし、Samba とカーネルモジュールはいずれも、SMB 1 プロトコルでのみ UNIX 拡張機能に対応します。

前提条件

-

cifs-utilsパッケージがインストールされている。

手順

-

/etc/samba/smb.confファイルの[global]セクションにあるserver min protocolパラメーターをNT1に設定します。 マウントコマンドに

-o vers=1.0オプションを指定し、SMB 1 プロトコルを使用して共有をマウントします。以下に例を示します。# mount -t cifs -o vers=1.0,username=<user_name> //<server_name>/<share_name> /mnt/デフォルトで、カーネルモジュールは、SMB 2 またはサーバーでサポートされている最新のプロトコルバージョンを使用します。

-o vers=1.0オプションをmountコマンドに渡すと、UNIX 拡張機能の使用に必要な SMB 1 プロトコルをカーネルモジュールが使用することが強制されます。

検証

マウントされた共有のオプションを表示します。

# mount ... //<server_name>/<share_name> on /mnt type cifs (...,unix,...)

マウントオプションのリストに

unixエントリーが表示されている場合は、UNIX 拡張機能が有効になっています。

5.3. SMB 共有の手動マウント

SMB 共有のみを一時的にマウントする必要がある場合は、mount ユーティリティーを使用して手動でマウントできます。

手動でマウントされた共有は、システムを再起動しても自動的にはマウントされません。システムの起動時に、Red Hat Enterprise Linux が自動的に共有をマウントするように設定する場合は、システムの起動時に自動的に SMB 共有をマウントする を参照してください。

前提条件

-

cifs-utilsパッケージがインストールされている。

手順

-t cifsパラメーターを指定してmountユーティリティーを使用して、SMB 共有をマウントします。# mount -t cifs -o username=<user_name> //<server_name>/<share_name> /mnt/ Password for <user_name>@//<server_name>/<share_name>: password

-oパラメーターでは、共有のマウントに使用されるオプションを指定できます。詳細は、mount.cifs(8)の man ページおよび 頻繁に使用されるマウントオプション のOPTIONSセクションを参照してください。例5.1 暗号化された SMB 3.0 接続を使用した共有のマウント

暗号化された SMB 3.0 接続で、

DOMAIN\Administratorユーザーとして\\server\example\共有を/mnt/ディレクトリーにマウントする場合は、次の手順を実行します。# mount -t cifs -o username=DOMAIN\Administrator,seal,vers=3.0 //server/example /mnt/ Password for DOMAIN\Administrator@//server_name/share_name: password

検証

マウントされた共有の内容をリスト表示します。

# ls -l /mnt/ total 4 drwxr-xr-x. 2 root root 8748 Dec 4 16:27 test.txt drwxr-xr-x. 17 root root 4096 Dec 4 07:43 Demo-Directory

5.4. システム起動時の SMB 共有の自動マウント

マウントされた SMB 共有へのアクセスがサーバー上で恒久的に必要とされる場合は、システムの起動時に共有を自動的にマウントします。

前提条件

-

cifs-utilsパッケージがインストールされている。

手順

共有のエントリーを

/etc/fstabファイルに追加します。以下に例を示します。//<server_name>/<share_name> /mnt cifs credentials=/root/smb.cred 0 0

重要システムが自動的に共有をマウントできるようにするには、ユーザー名、パスワード、およびドメイン名を認証情報ファイルに保存する必要があります。詳細は、SMB 共有に対して認証するための認証情報ファイルの作成 を参照してください。

/etc/fstabの行の 4 つ目のフィールドで、認証情報ファイルへのパスなど、マウントオプションを指定します。詳細は、mount.cifs(8)の man ページおよび 頻繁に使用されるマウントオプション のOPTIONSセクションを参照してください。

検証

マウントポイントを指定して共有をマウントします。

# mount /mnt/

5.5. SMB 共有に対して認証するための認証情報ファイルの作成

特定の状況 (システムの起動時に共有を自動的にマウントする場合など) では、ユーザー名とパスワードを入力することなく共有がマウントされる必要があります。これを実装するには、認証情報ファイルを作成します。

前提条件

-

cifs-utilsパッケージがインストールされている。

手順

/root/smb.credなどのファイルを作成し、そのファイルのユーザー名、パスワード、およびドメイン名を指定します。username=user_name password=password domain=domain_name

所有者だけがファイルにアクセスできるようにパーミッションを設定します。

# chown user_name /root/smb.cred # chmod 600 /root/smb.cred

mount ユーティリティーに credentials=file_name マウントオプションを渡すか、/etc/fstab ファイルでこのオプションを使用して、ユーザー名とパスワードの入力を求められずに共有をマウントできます。

5.6. マルチユーザー SMB マウントの実行

共有をマウントするために指定した認証情報により、デフォルトでマウントポイントのアクセス権が決まります。たとえば、共有をマウントするときに DOMAIN\example ユーザーを使用した場合は、どのローカルユーザーが操作を実行しても、共有に対するすべての操作はこのユーザーとして実行されます。

ただし特定の状況では、システムの起動時に管理者が自動的に共有をマウントしたい場合でも、ユーザーは自分の認証情報を使用して共有のコンテンツに対して操作を実行する必要があります。このとき、multiuser マウントオプションを使用すると、このシナリオを設定できます。

multiuser マウントオプションを使用するには、認証情報ファイルの krb5 オプションや ntlmssp オプションなど、非対話式の方法で認証情報の提供に対応するセキュリティータイプに、sec マウントオプションを追加で設定する必要があります。詳細は、ユーザーとしての共有へのアクセス を参照してください。

root ユーザーは、multiuser オプションと、共有内のコンテンツへの最低限のアクセスを持つアカウントを使用して、共有をマウントします。通常のユーザーは、cifscreds ユーティリティーを使用して、現在のセッションのカーネルキーリングに、自身のユーザー名とパスワードを渡すことができます。マウントされた共有のコンテンツにユーザーがアクセスすると、カーネルは、共有のマウントに最初に使用されたものではなく、カーネルキーリングからの認証情報を使用します。

この機能の使用は、以下の手順で設定されます。

前提条件

-

cifs-utilsパッケージがインストールされている。

5.6.1. multiuser オプションを使用した共有のマウント

ユーザーが自身の認証情報を使用して共有にアクセスする場合は、パーミッションが制限されたアカウントを使用して、root ユーザーとして共有をマウントする必要があります。

手順

システムの起動時に、multiuser オプションを使用して自動的に共有をマウントするには、次の手順を実行します。

/etc/fstabファイルに共有のエントリーを作成します。以下に例を示します。//server_name/share_name /mnt cifs

multiuser,sec=ntlmssp,credentials=/root/smb.cred 0 0共有をマウントします。

# mount /mnt/

システムの起動時に共有を自動的にマウントしない場合は、-o multiuser,sec=security_type を mount コマンドに渡して手動で共有をマウントします。SMB 共有を手動でマウントする方法は、SMB 共有の手動マウント を参照してください。

5.6.2. SMB 共有が multiuser オプションを使用してマウントされているかどうかの確認

共有が multiuser オプションを使用してマウントされているかどうかを確認するには、マウントオプションを表示します。

手順

# mount

...

//server_name/share_name on /mnt type cifs (sec=ntlmssp,multiuser,...)

マウントオプションのリストに multiuser エントリーが表示されている場合は、機能が有効になっています。

5.6.3. ユーザーとして共有へのアクセス

SMB 共有が multiuser オプションを使用してマウントされている場合、ユーザーはサーバーの認証情報をカーネルのキーリングに提供できます。

# cifscreds add -u SMB_user_name server_name Password: password

マウントされた SMB 共有を含むディレクトリーでユーザーが操作を実行すると、サーバーは、共有がマウントされたときに最初に使用されたものではなく、このユーザーのファイルシステムのパーミッションを適用します。

複数のユーザーが、マウントされた共有で、自身の認証情報を使用して同時に操作を実行できます。

5.7. よく使用される SMB マウントオプション

SMB 共有をマウントすると、マウントオプションにより次のことが決まります。

- サーバーとの接続がどのように確立されるか。たとえば、サーバーに接続するときに使用される SMB プロトコルバージョンはどれか。

- 共有が、ローカルファイルシステムにどのようにマウントされるか。たとえば、複数のローカルユーザーが、サーバーのコンテンツにアクセスできるようにするために、システムがリモートファイルとディレクトリーのパーミッションを上書きする場合など。

/etc/fstab ファイルの 4 番目のフィールド、またはマウントコマンドの -o パラメーターで複数のオプションを設定するには、オプションをコンマで区切ります。たとえば、multiuser オプションを使用した共有のマウント を参照してください。

次のリストは、よく使用されるマウントオプションを示しています。

| オプション | 説明 |

|---|---|

| credentials=file_name | 認証情報ファイルへのパスを設定します。認証情報ファイルを使用した SMB 共有への認証 を参照してください。 |

| dir_mode=mode | サーバーが CIFS UNIX 拡張機能をサポートしていない場合は、ディレクトリーモードを設定します。 |

| file_mode=mode | サーバーが CIFS UNIX 拡張機能をサポートしていない場合は、ファイルモードを設定します。 |

| password=password |

SMB サーバーへの認証に使用されるパスワードを設定します。あるいは、 |

| seal |

SMB 3.0 以降のプロトコルバージョンを使用した接続に対する暗号化サポートを有効にします。そのため、 |

| sec=security_mode |

サーバーが

セキュリティー上の理由から、安全でない |

| username=user_name |

SMB サーバーへの認証に使用されるユーザー名を設定します。あるいは、 |

| vers=SMB_protocol_version | サーバーとの通信に使用される SMB プロトコルバージョンを設定します。 |

完全なリストは、man ページの mount.cifs(8) の OPTIONS セクションを参照してください。

第6章 永続的な命名属性の概要

システム管理者は、永続的な命名属性を使用してストレージボリュームを参照し、再起動を何度も行っても信頼できるストレージ設定を構築する必要があります。

6.1. 非永続的な命名属性のデメリット

Red Hat Enterprise Linux では、ストレージデバイスを識別する方法が複数あります。特にドライブへのインストール時やドライブの再フォーマット時に誤ったデバイスにアクセスしないようにするため、適切なオプションを使用して各デバイスを識別することが重要になります。

従来、/dev/sd(メジャー番号)(マイナー番号) の形式の非永続的な名前は、ストレージデバイスを参照するために Linux 上で使用されます。メジャー番号とマイナー番号の範囲、および関連する sd 名は、検出されると各デバイスに割り当てられます。つまり、デバイスの検出順序が変わると、メジャー番号とマイナー番号の範囲、および関連する sd 名の関連付けが変わる可能性があります。

このような順序の変更は、以下の状況で発生する可能性があります。

- システム起動プロセスの並列化により、システム起動ごとに異なる順序でストレージデバイスが検出された場合。

-

ディスクが起動しなかったり、SCSI コントローラーに応答しなかった場合。この場合は、通常のデバイスプローブにより検出されません。ディスクはシステムにアクセスできなくなり、後続のデバイスは関連する次の

sd名が含まれる、メジャー番号およびマイナー番号の範囲があります。たとえば、通常sdbと呼ばれるディスクが検出されないと、sdcと呼ばれるディスクがsdbとして代わりに表示されます。 -

SCSI コントローラー (ホストバスアダプターまたは HBA) が初期化に失敗し、その HBA に接続されているすべてのディスクが検出されなかった場合。後続のプローブされた HBA に接続しているディスクは、別のメジャー番号およびマイナー番号の範囲、および関連する別の

sd名が割り当てられます。 - システムに異なるタイプの HBA が存在する場合は、ドライバー初期化の順序が変更する可能性があります。これにより、HBA に接続されているディスクが異なる順序で検出される可能性があります。また、HBA がシステムの他の PCI スロットに移動した場合でも発生する可能性があります。

-

ストレージアレイや干渉するスイッチの電源が切れた場合など、ストレージデバイスがプローブされたときに、ファイバーチャネル、iSCSI、または FCoE アダプターを持つシステムに接続されたディスクがアクセスできなくなる可能性があります。システムが起動するまでの時間よりもストレージアレイがオンラインになるまでの時間の方が長い場合に、電源の障害後にシステムが再起動すると、この問題が発生する可能性があります。一部のファイバーチャネルドライバーは WWPN マッピングへの永続 SCSI ターゲット ID を指定するメカニズムをサポートしますが、メジャー番号およびマイナー番号の範囲や関連する

sd名は予約されず、一貫性のある SCSI ターゲット ID 番号のみが提供されます。

そのため、/etc/fstab ファイルなどにあるデバイスを参照するときにメジャー番号およびマイナー番号の範囲や関連する sd 名を使用することは望ましくありません。誤ったデバイスがマウントされ、データが破損する可能性があります。

しかし、場合によっては他のメカニズムが使用される場合でも sd 名の参照が必要になる場合もあります (デバイスによりエラーが報告される場合など)。これは、Linux カーネルはデバイスに関するカーネルメッセージで sd 名 (および SCSI ホスト、チャネル、ターゲット、LUN タプル) を使用するためです。

6.2. ファイルシステムおよびデバイスの識別子

このセクションでは、ファイルシステムおよびブロックデバイスを識別する永続的な属性の相違点を説明します。

ファイルシステムの識別子

ファイルシステムの識別子は、ブロックデバイス上に作成された特定のファイルシステムに関連付けられます。識別子はファイルシステムの一部としても格納されます。ファイルシステムを別のデバイスにコピーしても、ファイルシステム識別子は同じです。一方、mkfs ユーティリティーでフォーマットするなどしてデバイスを書き換えると、デバイスはその属性を失います。

ファイルシステムの識別子に含まれるものは、次のとおりです。

- 一意の ID (UUID)

- ラベル

デバイスの識別子

デバイス識別子は、ブロックデバイス (ディスクやパーティションなど) に関連付けられます。mkfs ユーティリティーでフォーマットするなどしてデバイスを書き換えた場合、デバイスはファイルシステムに格納されていないため、属性を保持します。

デバイスの識別子に含まれるものは、次のとおりです。

- World Wide Identifier (WWID)

- パーティション UUID

- シリアル番号

推奨事項

- 論理ボリュームなどの一部のファイルシステムは、複数のデバイスにまたがっています。Red Hat は、デバイスの識別子ではなくファイルシステムの識別子を使用してこのファイルシステムにアクセスすることを推奨します。

6.3. /dev/disk/ にある udev メカニズムにより管理されるデバイス名

udev メカニズムは、Linux のすべてのタイプのデバイスに使用され、ストレージデバイスだけに限定されません。/dev/disk/ ディレクトリーにさまざまな種類の永続的な命名属性を提供します。ストレージデバイスの場合、Red Hat Enterprise Linux には /dev/disk/ ディレクトリーにシンボリックリンクを作成する udev ルールが含まれています。これにより、次の方法でストレージデバイスを参照できます。

- ストレージデバイスのコンテンツ

- 一意の ID

- シリアル番号

udev の命名属性は永続的なものですが、システムを再起動しても自動的には変更されないため、設定可能なものもあります。

6.3.1. ファイルシステムの識別子

/dev/disk/by-uuid/ の UUID 属性

このディレクトリーのエントリーは、デバイスに格納されているコンテンツ (つまりデータ) 内の 一意の ID (UUID) によりストレージデバイスを参照するシンボリック名を提供します。以下に例を示します。

/dev/disk/by-uuid/3e6be9de-8139-11d1-9106-a43f08d823a6

次の構文を使用することで、UUID を使用して /etc/fstab ファイルのデバイスを参照できます。

UUID=3e6be9de-8139-11d1-9106-a43f08d823a6ファイルシステムを作成する際に UUID 属性を設定できます。後で変更することもできます。

/dev/disk/by-label/ のラベル属性

このディレクトリーのエントリーは、デバイスに格納されているコンテンツ (つまりデータ) 内の ラベル により、ストレージデバイスを参照するシンボリック名を提供します。

以下に例を示します。

/dev/disk/by-label/Boot

次の構文を使用することで、ラベルを使用して /etc/fstab ファイルのデバイスを参照できます。

LABEL=Bootファイルシステムを作成するときにラベル属性を設定できます。また、後で変更することもできます。

6.3.2. デバイスの識別子

/dev/disk/by-id/ の WWID 属性

World Wide Identifier (WWID) は永続的で、SCSI 規格によりすべての SCSI デバイスが必要とする システムに依存しない識別子 です。各ストレージデバイスの WWID 識別子は一意となることが保証され、デバイスのアクセスに使用されるパスに依存しません。この識別子はデバイスのプロパティーですが、デバイスのコンテンツ (つまりデータ) には格納されません。

この識別子は、SCSI Inquiry を発行して Device Identification Vital Product Data (0x83 ページ) または Unit Serial Number (0x80 ページ) を取得することにより獲得できます。

Red Hat Enterprise Linux では、WWID ベースのデバイス名から、そのシステムの現在の /dev/sd 名への正しいマッピングを自動的に維持します。デバイスへのパスが変更したり、別のシステムからそのデバイスへのアクセスがあった場合にも、アプリケーションはディスク上のデータ参照に /dev/disk/by-id/ を使用できます。

NVMe デバイスを使用している場合、デバイスのシリアル番号の先頭に空白があると、一部のベンダーのディスク ID による名前変更が発生する可能性があります。

例6.1 WWID マッピング

| WWID シンボリックリンク | 非永続的なデバイス | 備考 |

|---|---|---|

|

|

|

ページ |

|

|

|

ページ |

|

|

| ディスクパーティション |

システムにより提供される永続的な名前のほかに、udev ルールを使用して独自の永続的な名前を実装し、ストレージの WWID にマップすることもできます。

/dev/disk/by-partuuid のパーティション UUID 属性

パーティション UUID (PARTUUID) 属性は、GPT パーティションテーブルにより定義されているパーティションを識別します。

例6.2 パーティション UUID のマッピング

| PARTUUID シンボリックリンク | 非永続的なデバイス |

|---|---|

|

|

|

|

|

|

|

|

|

/dev/disk/by-path/ のパス属性

この属性は、デバイスへのアクセスに使用される ハードウェアパス がストレージデバイスを参照するシンボル名を提供します。

ハードウェアパス (PCI ID、ターゲットポート、LUN 番号など) の一部が変更されると、パス属性に失敗します。このため、パス属性は信頼性に欠けます。ただし、パス属性は以下のいずれかのシナリオで役に立ちます。

- 後で置き換える予定のディスクを特定する必要があります。

- 特定の場所にあるディスクにストレージサービスをインストールする予定です。

6.4. DM Multipath を使用した World Wide Identifier

Device Mapper (DM) Multipath を設定して、World Wide Identifier (WWID) と非永続的なデバイス名をマッピングできます。

システムからデバイスへのパスが複数ある場合、DM Multipath はこれを検出するために WWID を使用します。その後、DM Multipath は /dev/mapper/wwid ディレクトリー (例: /dev/mapper/3600508b400105df70000e00000ac0000) に単一の "疑似デバイス" を表示します。

コマンド multipath -l は、非永続的な識別子へのマッピングを示します。

-

Host:Channel:Target:LUN -

/dev/sd名 -

major:minor数値

例6.3 マルチパス設定での WWID マッピング

multipath -l コマンドの出力例:

3600508b400105df70000e00000ac0000 dm-2 vendor,product [size=20G][features=1 queue_if_no_path][hwhandler=0][rw] \_ round-robin 0 [prio=0][active] \_ 5:0:1:1 sdc 8:32 [active][undef] \_ 6:0:1:1 sdg 8:96 [active][undef] \_ round-robin 0 [prio=0][enabled] \_ 5:0:0:1 sdb 8:16 [active][undef] \_ 6:0:0:1 sdf 8:80 [active][undef]

DM Multipath は、各 WWID ベースのデバイス名から、システムで対応する /dev/sd 名への適切なマッピングを自動的に維持します。これらの名前は、パスが変更しても持続し、他のシステムからデバイスにアクセスする際に一貫性を保持します。

DM Multipath の user_friendly_names 機能を使用すると、WWID は /dev/mapper/mpathN 形式の名前にマップされます。デフォルトでは、このマッピングは /etc/multipath/bindings ファイルに保持されています。これらの mpathN 名は、そのファイルが維持されている限り永続的です。

user_friendly_names を使用する場合は、クラスター内で一貫した名前を取得するために追加の手順が必要です。

6.5. udev デバイス命名規則の制約

udev 命名規則の制約の一部は次のとおりです。

-

udevイベントに対してudevルールが処理されるときに、udevメカニズムはストレージデバイスをクエリーする機能に依存する可能性があるため、クエリーの実行時にデバイスにアクセスできない可能性があります。これは、ファイバーチャネル、iSCSI、または FCoE ストレージデバイスといった、デバイスがサーバーシャーシにない場合に発生する可能性が高くなります。 -

カーネルは

udevイベントをいつでも送信する可能性があるため、デバイスにアクセスできない場合に/dev/disk/by-*/リンクが削除される可能性があります。 -

udevイベントが生成されそのイベントが処理されるまでに遅延が生じる場合があります (大量のデバイスが検出され、ユーザー空間のudevサービスによる各デバイスのルールを処理するのにある程度の時間がかかる場合など)。これにより、カーネルがデバイスを検出してから、/dev/disk/by-*/の名前が利用できるようになるまでに遅延が生じる可能性があります。 -

ルールに呼び出される

blkidなどの外部プログラムによってデバイスが短期間開き、他の目的でデバイスにアクセスできなくなる可能性があります。 -

/dev/disk/ の

udevメカニズムで管理されるデバイス名は、メジャーリリース間で変更される可能性があるため、リンクの更新が必要になる場合があります。

6.6. 永続的な命名属性のリスト表示

この手順では、非永続的なストレージデバイスの永続命名属性を確認する方法を説明します。

手順

UUID 属性とラベル属性をリスト表示するには、

lsblkユーティリティーを使用します。$ lsblk --fs storage-device以下に例を示します。

例6.4 ファイルシステムの UUID とラベルの表示

$ lsblk --fs /dev/sda1 NAME FSTYPE LABEL UUID MOUNTPOINT sda1 xfs Boot afa5d5e3-9050-48c3-acc1-bb30095f3dc4 /boot

PARTUUID 属性をリスト表示するには、

--output +PARTUUIDオプションを指定してlsblkユーティリティーを使用します。$ lsblk --output +PARTUUID

以下に例を示します。

例6.5 パーティションの PARTUUID 属性の表示

$ lsblk --output +PARTUUID /dev/sda1 NAME MAJ:MIN RM SIZE RO TYPE MOUNTPOINT PARTUUID sda1 8:1 0 512M 0 part /boot 4cd1448a-01

WWID 属性をリスト表示するには、

/dev/disk/by-id/ディレクトリーのシンボリックリンクのターゲットを調べます。以下に例を示します。例6.6 システムにある全ストレージデバイスの WWID の表示