Dashboard ガイド

Ceph Dashboard を使用した Ceph クラスターのモニタリング

概要

第1章 Ceph Dashboard の概要

ストレージ管理者は、Red Hat Ceph Storage Dashboard は管理機能および監視機能を提供します。これにより、クラスターの管理および設定が可能になり、それに関連する情報およびパフォーマンス統計を可視化を可能にします。ダッシュボードは、ceph-mgr デーモンがホストする Web サーバーを使用します。

ダッシュボードは Web ブラウザーからアクセスでき、たとえばマネージャーモジュールの設定や OSD の状態の監視などの有用な管理機能および監視機能が含まれます。

1.1. 前提条件

- システム管理者レベルの経験

1.2. Ceph Dashboard コンポーネント

ダッシュボードの機能は複数のコンポーネントで提供されます。

- デプロイメント用の Cephadm アプリケーション。

-

埋め込みダッシュボードである

ceph-mgrモジュール。 -

埋め込み Prometheus である

ceph-mgrモジュール。 - Prometheus の時系列データベース。

- ストレージクラスターの各ホストで実行される Prometheus の node-exporter デーモン。

- 監視ユーザーインターフェイスおよびアラートを提供する Grafana プラットフォーム。

関連情報

- 詳細は、Prometheus の Web サイト を参照してください。

- 詳細は、Grafana のウェブサイト を参照してください。

1.3. Ceph Dashboard 機能

Ceph Dashboard には、次の機能があります。

- マルチユーザーとロールの管理: ダッシュボードは、異なる権限とロールが割り当てられた複数のユーザーアカウントをサポートします。ユーザーアカウントとロールは、コマンドラインと Web ユーザーインターフェイスの両方を使用して管理できます。ダッシュボードは、パスワードセキュリティーの強化に向けたさまざまな方法をサポートしています。ユーザーは最初のログイン後または設定可能な期間の後にパスワードを変更する必要があるなど、パスワードの複雑性ルールは設定できます。

- シングルサインオン (SSO): ダッシュボードは、SAML 2.0 プロトコルを使用した外部 ID プロバイダーとの認証をサポートしています。

- 監査: ダッシュボードバックエンドは、すべての PUT、POST、および DELETE API 要求を Ceph マネージャーログに記録するように設定できます。

管理機能

- クラスターの階層の表示: CRUSH マップを表示できます。たとえば、特定の OSD ID が実行されているホストを判別できます。これは、OSD に問題がある場合に便利です。

- マネージャーモジュールの設定: Ceph マネージャーモジュールのパラメーターを表示および変更できます。

- 埋め込み Grafana ダッシュボード: Ceph Dashboard の Grafana ダッシュボードは、Prometheus モジュールによって収集された情報とパフォーマンスメトリックを表示するために、外部アプリケーションや Web ページに埋め込まれている場合があります。

- ログの表示および絞り込み: イベントおよび監査クラスターのログを表示し、優先順位、キーワード、日付、または時間範囲に基づいてフィルタリングできます。

- ダッシュボードコンポーネントの切り替え: ダッシュボードのコンポーネントを有効および無効にできるため、必要な機能のみが利用可能になります。

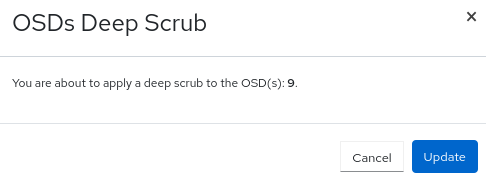

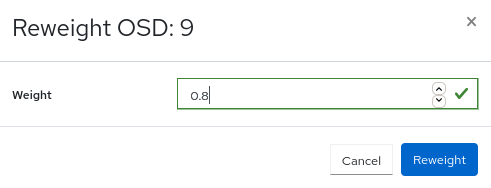

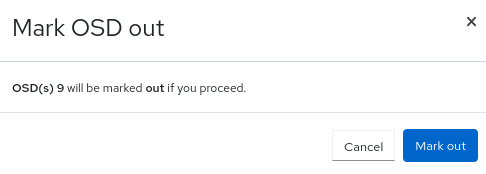

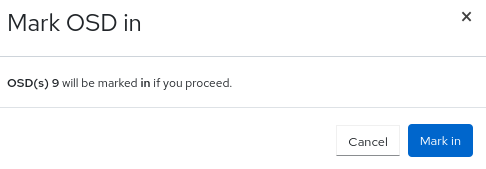

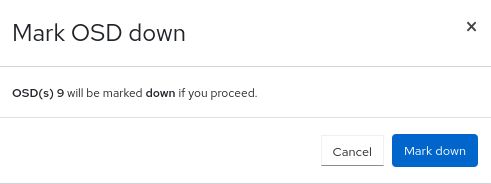

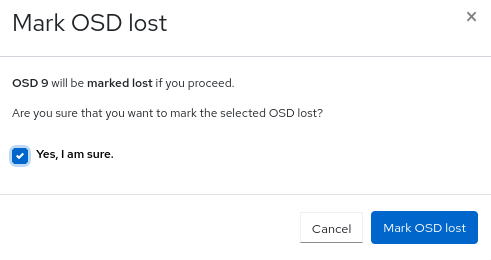

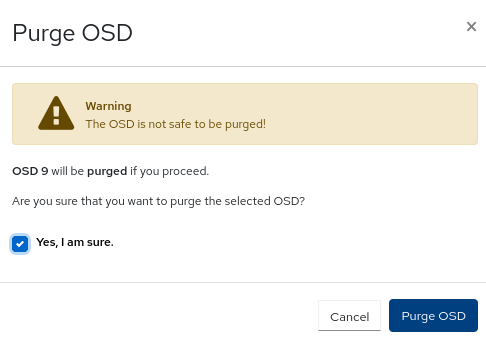

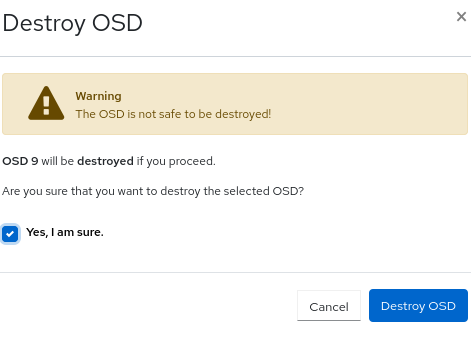

- OSD 設定の管理: ダッシュボードを使用してクラスター全体の OSD フラグを設定できます。また、OSD のアップ、ダウン、またはアウトのマーク付け、OSD のパージと加重付け、スクラブ操作の実行、さまざまなスクラブ関連の設定オプションの変更、プロファイルの選択によるバックフィルアクティビティーのレベル調整なども可能です。OSD のデバイスクラスを設定および変更して、デバイスクラス別に OSD を表示して並べ替えることができます。OSD を新しいドライブおよびホストにデプロイできます。

- iSCSI 管理: iSCSI ターゲットを作成、変更、および削除します。

- アラートの表示 アラートページでは、現在のアラートの詳細を表示できます。

- イメージのサービス品質: IOPS の制限や、BPS バーストレートの読み取りなど、イメージにパフォーマンス制限を設定できます。

監視機能

- ユーザー名およびパスワード保護: 設定可能なユーザー名とパスワードのみを使用してダッシュボードにアクセスできます。

- クラスター全体のヘルス: パフォーマンスと容量のメトリックを表示します。クラスター全体のステータス、ストレージ使用率 (オブジェクトの数、Raw 容量、プールごとの使用量など)、プールのリストおよびそれらのステータスと使用状況の統計を表示します。

- ホスト: 実行中のサービスおよびインストールされた Ceph バージョンと共に、クラスターに関連付けられたホストのリストを提供します。

- パフォーマンスカウンター: 実行中の各サービスの詳細統計を表示します。

- モニター: モニター、クォーラムのステータス、およびオープンセッションのリストを表示します。

- 設定エディター: 使用可能なすべての設定オプション、説明、タイプ、デフォルト、および現在設定されている値を表示します。これらの値は編集可能です。

- クラスターログ: クラスターのイベントおよび監査ログファイルの最新の更新を、優先度、日付、またはキーワード別に表示およびフィルタリングします。

- デバイス管理: オーケストレーターが認識しているすべてのホストをリスト表示します。ホストに接続されているすべてのドライブとそのプロパティーをリスト表示します。ドライブのヘルス予測、SMART データ、点滅エンクロージャー LED を表示します。

- ストレージクラスターの容量の表示: Red Hat Ceph Storage クラスターの Raw ストレージ容量は、Ceph Dashboard の Capacity パネルで確認できます。

- Pools: すべての Ceph プールとその詳細をリスト表示および管理します。たとえば、アプリケーション、配置グループ、レプリケーションサイズ、EC プロファイル、クォータ、CRUSH ルールセットなどです。

- OSD: すべての OSD、それらのステータスおよび使用状況の統計に加えて、属性 (OSD マップ)、メタデータ、読み取り/書き込み操作のパフォーマンスカウンターなどの詳細情報をリスト表示および管理します。OSD に関連付けられているすべてのドライブをリスト表示します。

- iSCSI: tcmu-runner サービスを実行するホストのリストを表示し、読み取り/書き込み操作やトラフィックなど、すべてのイメージとそのパフォーマンスの特性を表示します。また、iSCSI ゲートウェイのステータスおよびアクティブなイニシエーターに関する情報も表示します。

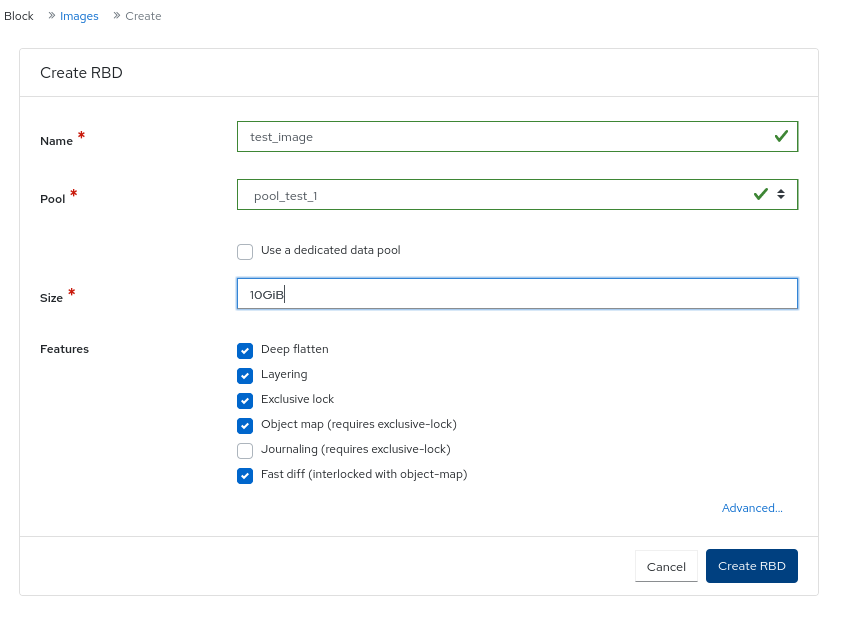

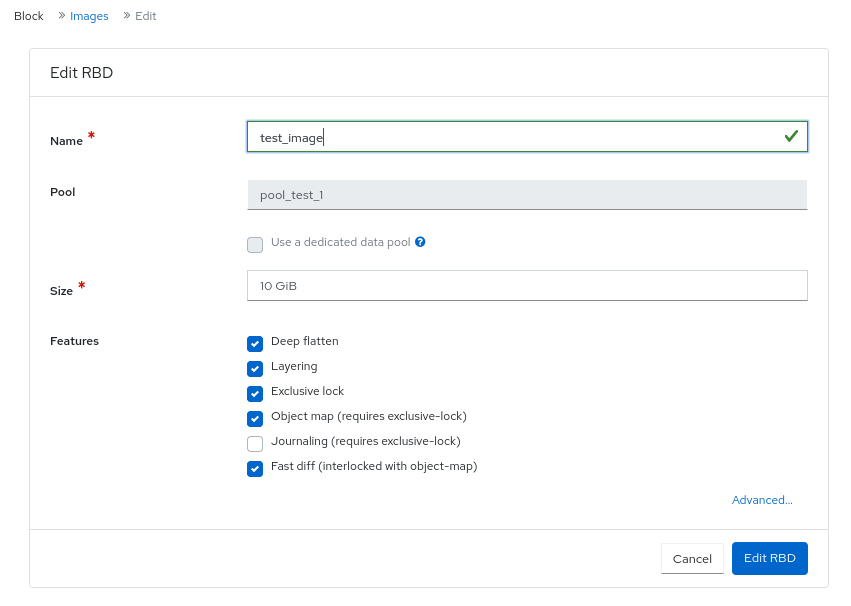

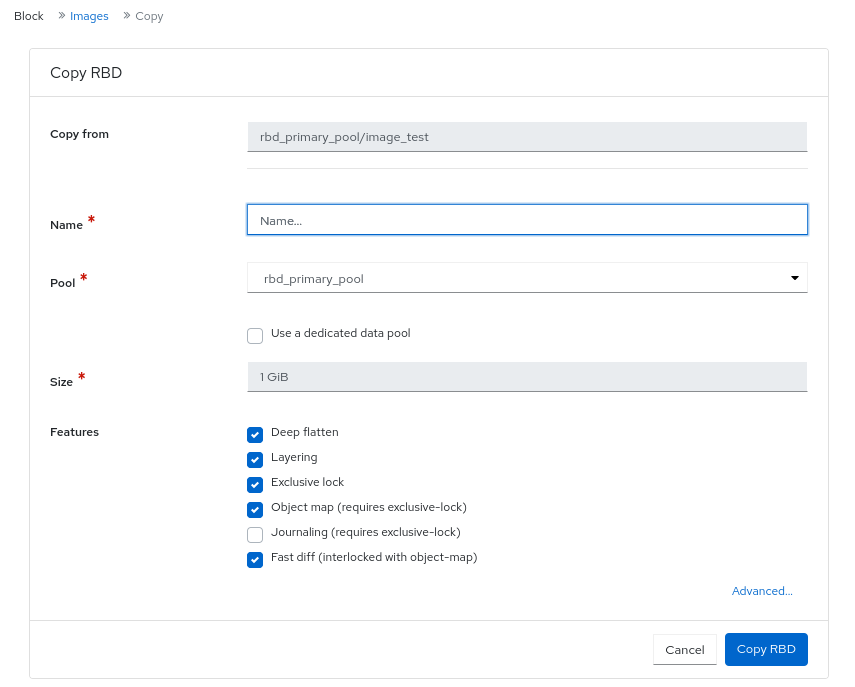

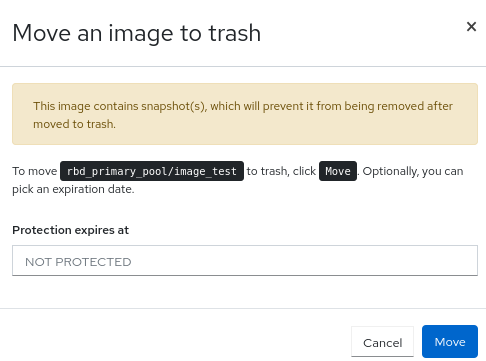

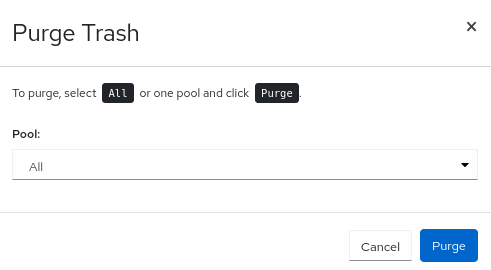

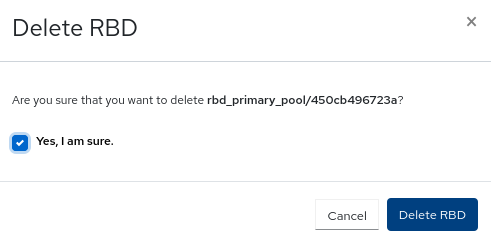

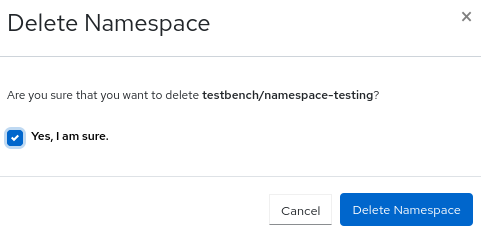

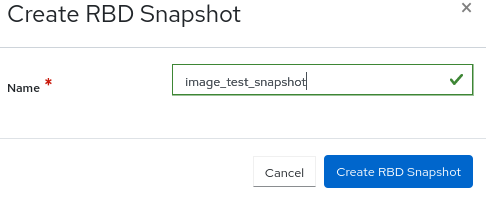

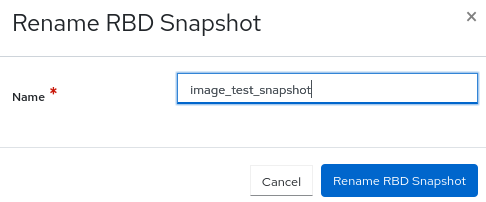

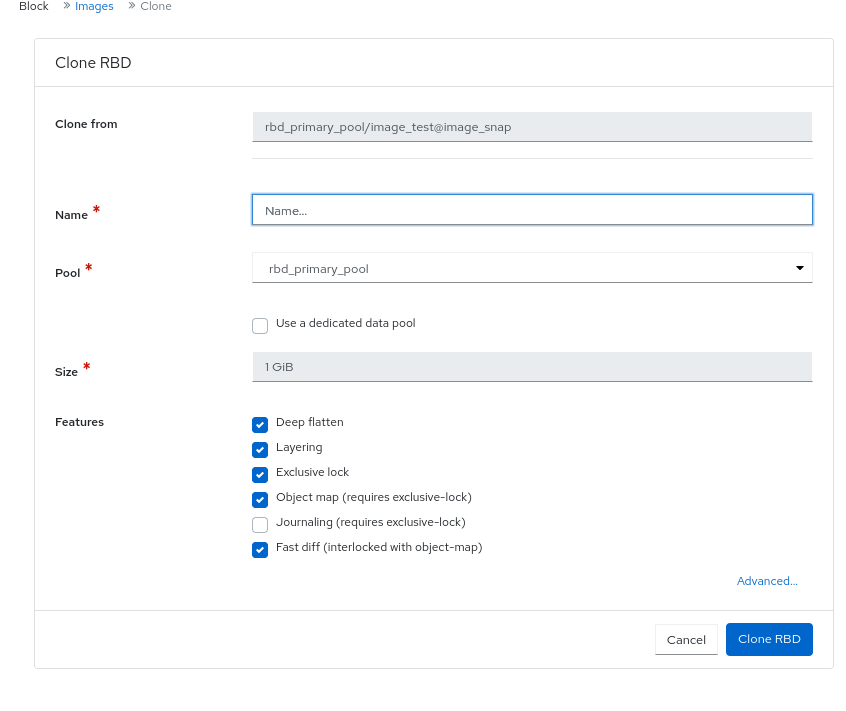

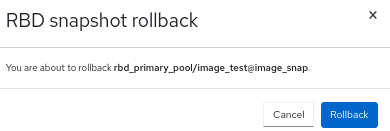

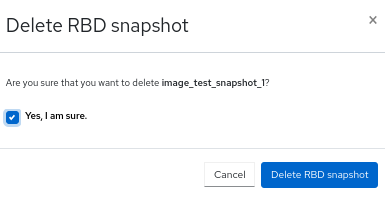

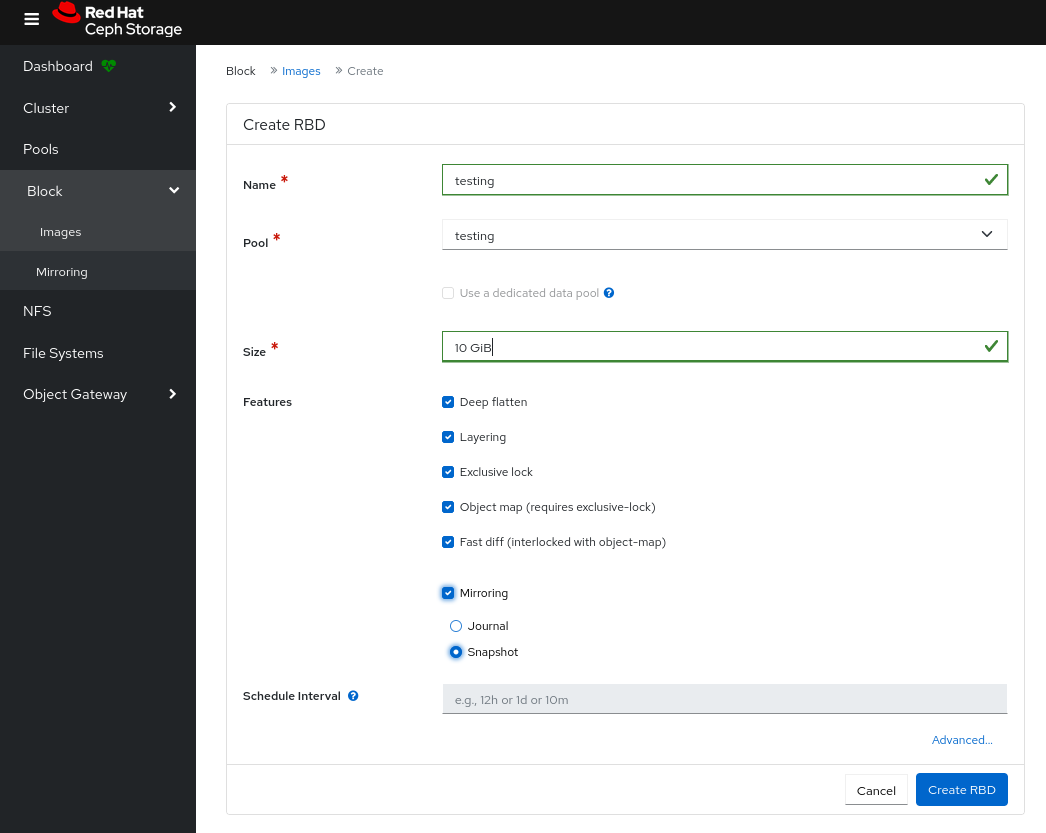

イメージ: サイズ、オブジェクト、機能などのすべての RBD イメージと、そのプロパティーを表示します。RBD イメージの作成、コピー、変更、および削除を行います。選択したイメージのスナップショットを作成、削除、およびロールバックし、変更に対してこのスナップショットを保護するか、保護を解除します。スナップショットをコピーまたは複製し、複製されたイメージを平坦化します。

注記特定のイメージの Overall Performance タブの I/O 変更のパフォーマンスグラフには、Cluster > Manager modules > Prometheus の

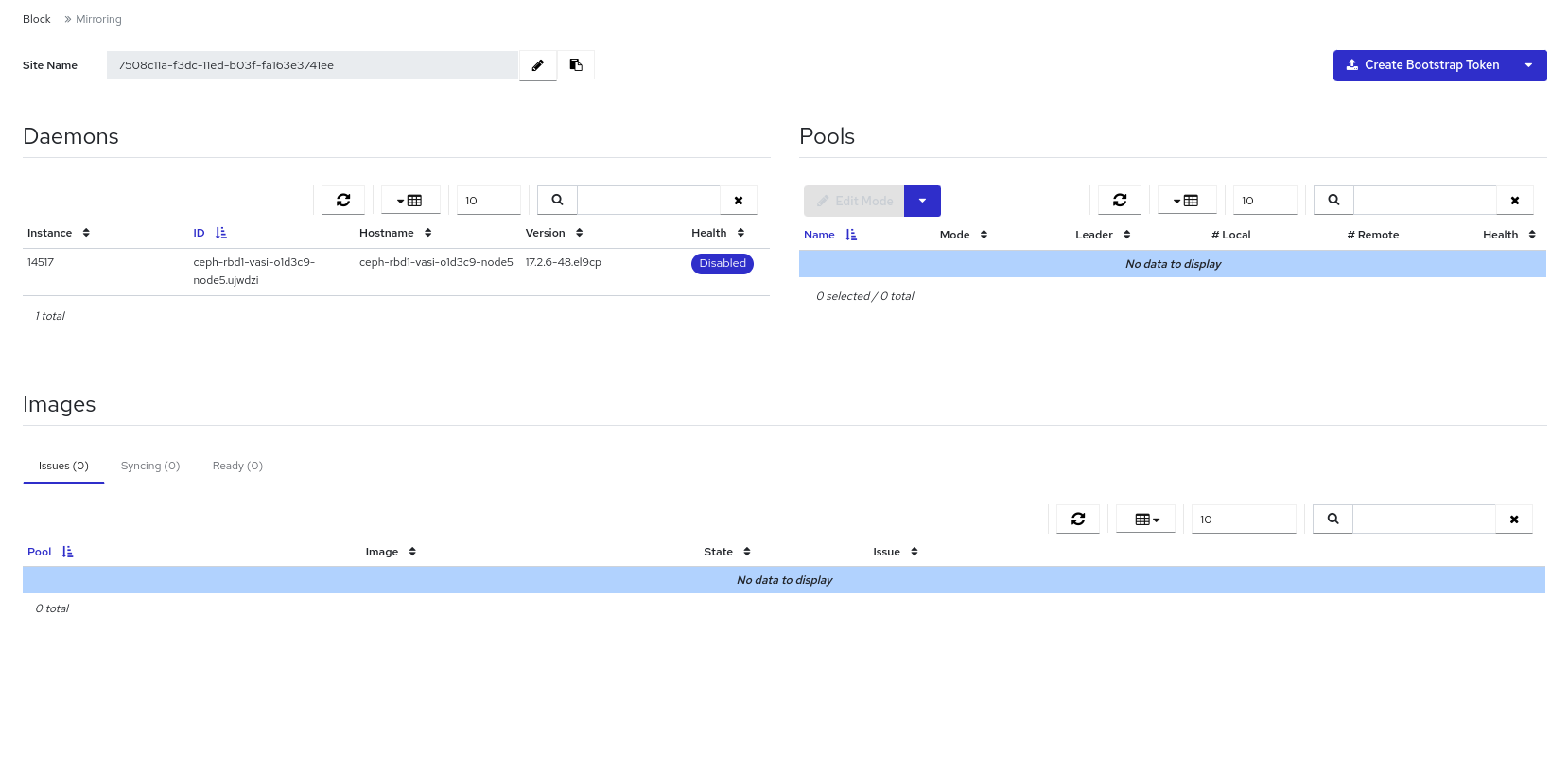

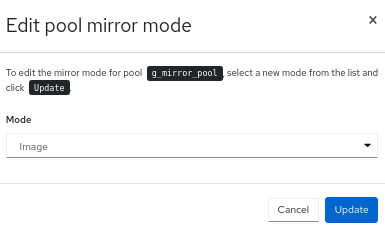

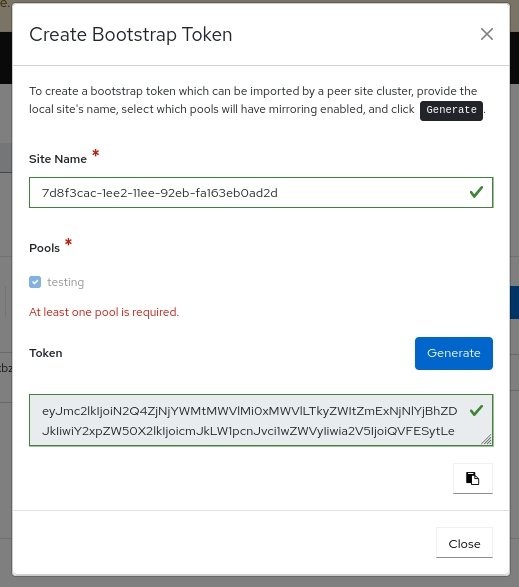

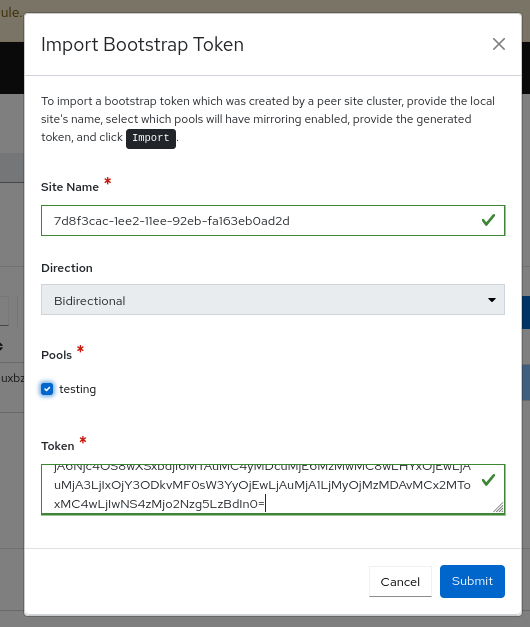

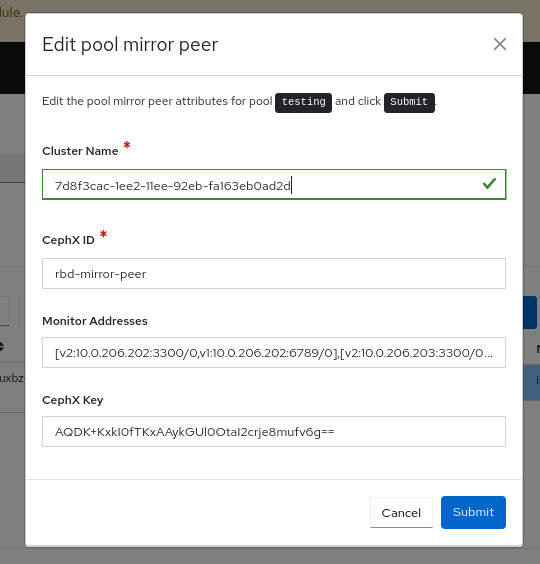

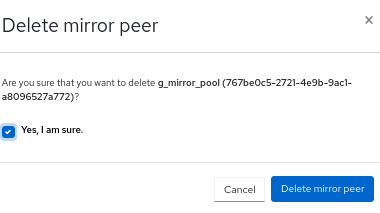

rbd_stats_poolパラメーターを設定すると、そのイメージを含むプールを指定した後にのみ値が表示されます。- RBD ミラーリング: リモート Ceph サーバーへの RBD ミラーリングを有効化および設定します。同期状態を含む、すべてのアクティブな同期デーモンとそのステータス、プール、および RBD イメージのリストを表示します。

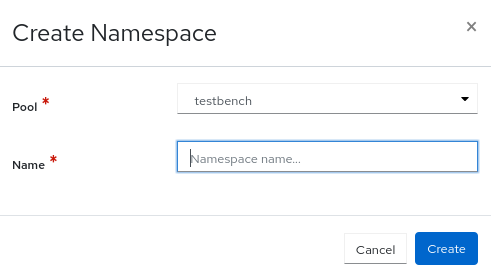

- Ceph ファイルシステム: アクティブな Ceph ファイルシステム (CephFS) クライアントと関連するプール (使用状況の統計を含む) のリストを表示します。アクティブな CephFS クライアントを退避し、CephFS クォータとスナップショットを管理して、CephFS ディレクトリー構造を参照します。

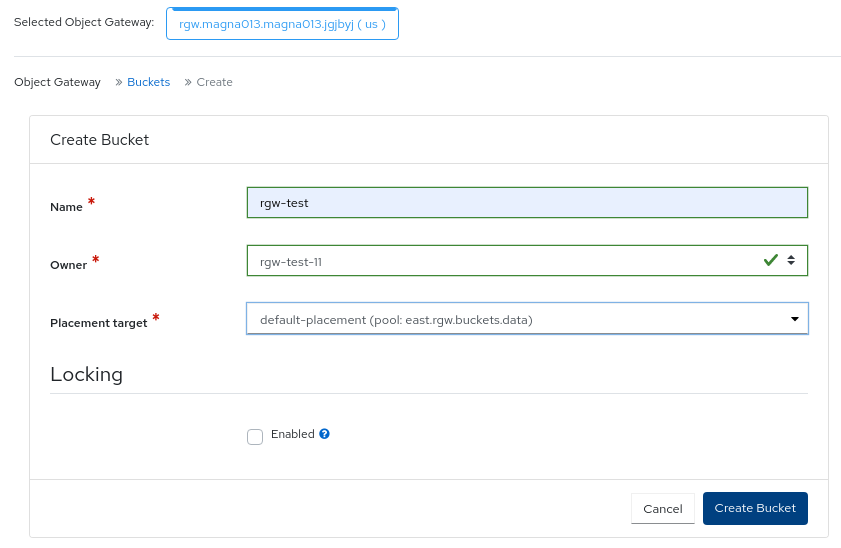

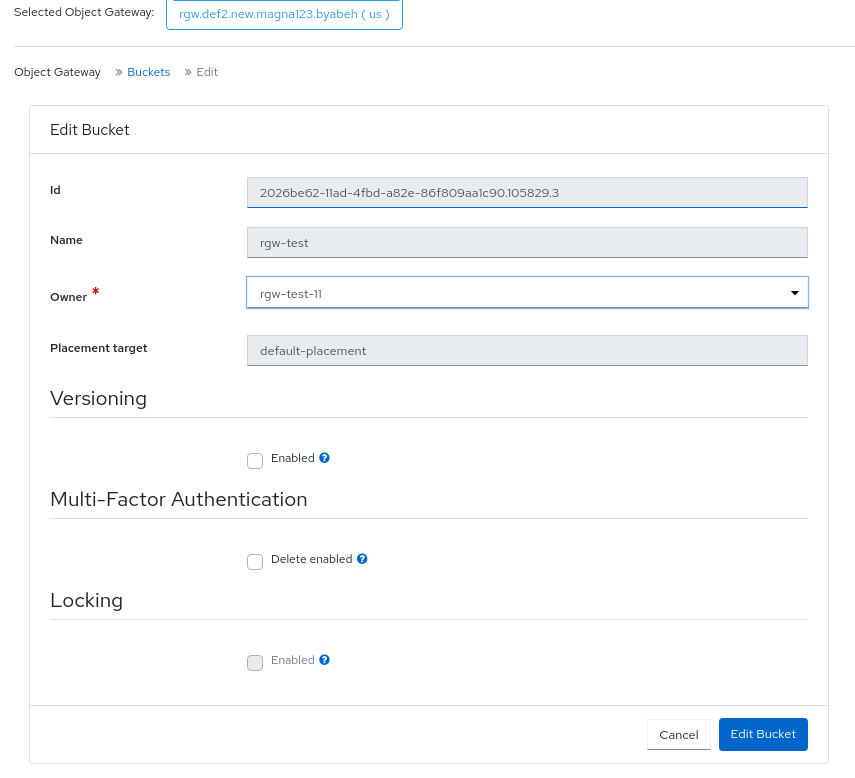

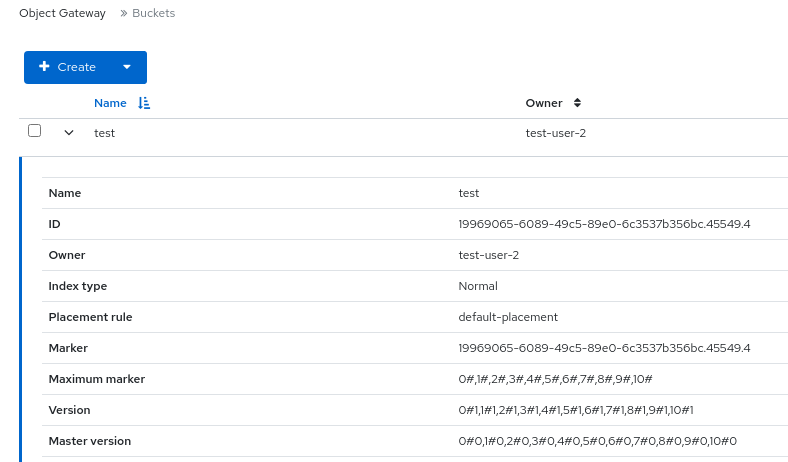

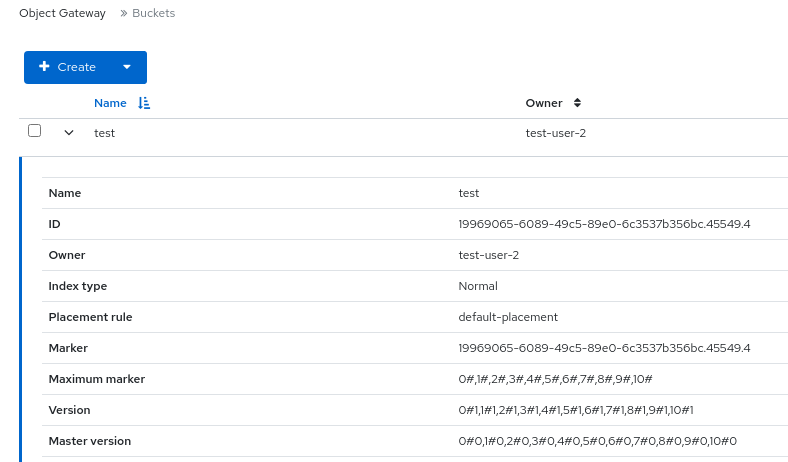

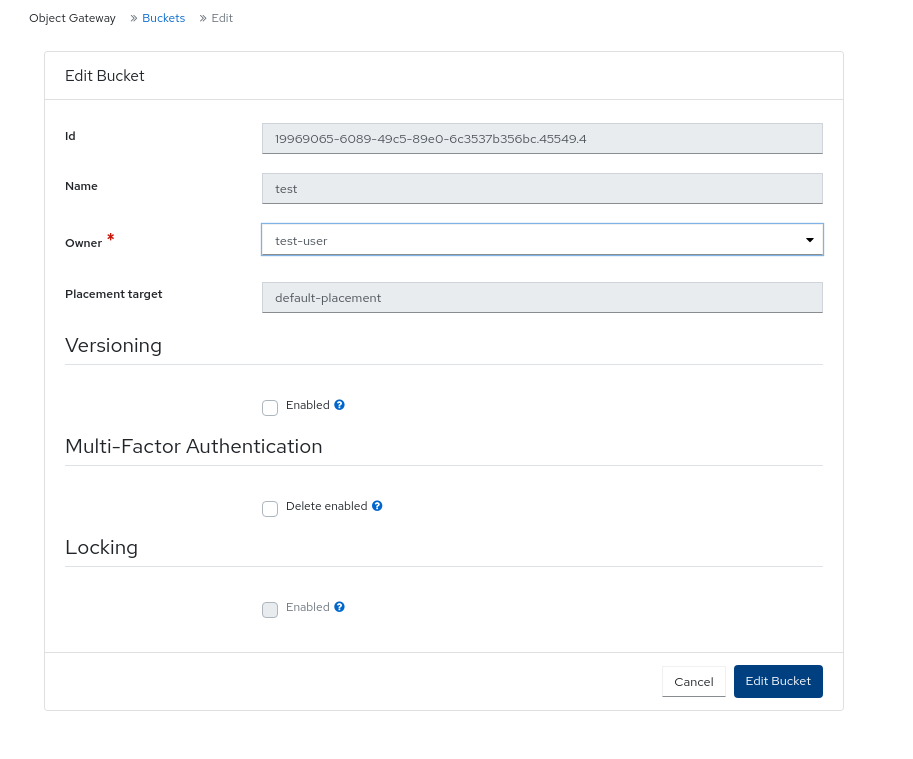

- Object Gateway (RGW): アクティブなすべてのObject Gateway とそのパフォーマンスカウンターを表示します。オブジェクトゲートウェイユーザーの表示および管理 (追加、編集、削除) およびその詳細 (クォータなど)、ユーザーのバケットおよびその詳細 (例: 所有者、クォータなど) を表示および管理します。

- NFS: NFS Ganesha を使用して CephFS および Ceph オブジェクトゲートウェイ S3 バケットの NFS エクスポートを管理します。

セキュリティー機能

- SSL および TLS のサポート: Web ブラウザーとダッシュボード間の HTTP 通信はすべて SSL 経由で保護されます。自己署名証明書は組み込みコマンドで作成できますが、認証局 (CA) が署名して発行したカスタム証明書をインポートすることもできます。

関連情報

- 詳細については、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard 機能の切り替え を参照してください。

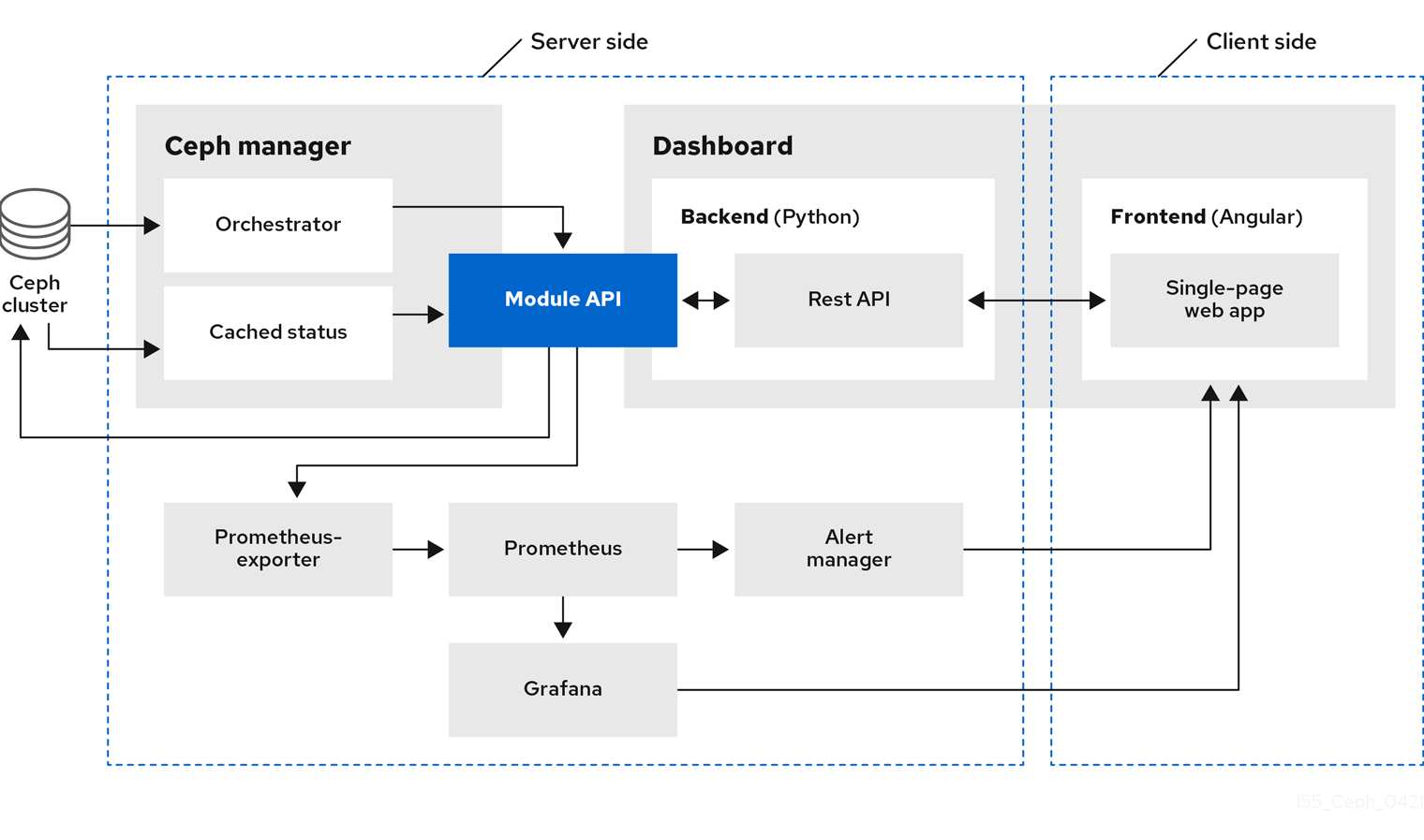

1.4. Red Hat Ceph ストレージダッシュボードアーキテクチャー

Dashboard アーキテクチャーは、Ceph Manager のダッシュボードプラグインおよびその他のコンポーネントによって異なります。以下の図を参照し、どのように連携するかを確認します。

第2章 Ceph Dashboard のインストールおよびアクセス

システム管理者は、クラスターのブートストラップ時に提示された認証情報を使用してダッシュボードにアクセスできます。

Cephadm はデフォルトでダッシュボードをインストールします。以下は、ダッシュボード URL の例です。

URL: https://host01:8443/ User: admin Password: zbiql951ar

ダッシュボード URL にアクセスする前に、ブラウザーを更新して Cookie をクリアします。

Ceph Dashboard 設定で使用できる Cephadm ブートストラップオプションを以下に示します。

- [—initial-dashboard-user INITIAL_DASHBOARD_USER] - 初期ダッシュボードユーザーを設定するには、ブートストラップ中にこのオプションを使用します。

- [—initial-dashboard-password] - 初期ダッシュボードパスワードを設定するには、ブートストラップ中にこのオプションを使用します。

- [-SSL-dashboard-port SSL_DASHBOARD_PORT] - このオプションを使用して、ブートストラップ時にデフォルトの 8443 以外のカスタムダッシュボードポートを設定します。

- [—dashboard-key DASHBOARD_KEY] - SSL のカスタムキーを設定するには、ブートストラップ中にこのオプションを使用します。

- [—dashboard-crt DASHBOARD_CRT] - SSL のカスタム証明書を設定するには、ブートストラップ中にこのオプションを使用します。

- [—skip-dashboard] - ダッシュボードなしで Ceph をデプロイするには、ブートストラップ中にこのオプションを使用します。

- [—dashboard-password-noupdate] - 上記の 2 つのオプションを使用して初回ログイン時にパスワードをリセットしない場合は、ブートストラップ中にこのオプションを使用します。

- [—allow-Fqdn-hostname] - 完全修飾ホスト名を使用できるようにするには、ブートストラップ中にこのオプションを使用します。

- [—skip-prepare-host] - ホストの準備をスキップするには、ブートストラップ中にこのオプションを使用します。

ダッシュボード関連の外部 URL の接続の問題を回避するには、ホスト名に完全修飾ドメイン名 (FQDN) を使用します (例:host01.ceph.redhat.com)。

クライアントのインターネットブラウザーで Grafana URL を直接開き、セキュリティー例外を受け入れ、Ceph Dashboard のグラフを確認します。ブラウザーをリロードして、変更を表示します。

例:

[root@host01 ~]# cephadm bootstrap --mon-ip 127.0.0.1 --registry-json cephadm.txt --initial-dashboard-user admin --initial-dashboard-password zbiql951ar --dashboard-password-noupdate --allow-fqdn-hostname

cephadm を使用してストレージクラスターをブートストラップするときに、カスタムコンテナーイメージまたはローカルコンテナーイメージに —image オプションを使用できます。

ブートストラップ時に —dashboard-password-noupdate オプションを使用しない場合にのみ、ブートストラップ時に指定した認証情報を使用してダッシュボードへの初回ログイン時にパスワードを変更する必要があります。Ceph Dashboard の認証情報は var/log/ceph/cephadm.log ファイルにあります。Ceph Dashboard is now available at という文字列で検索します。

このセクションでは、次のタスクについて説明します。

- Ceph Dashboard のネットワークポート要件

- Ceph Dashboard へのアクセス

- Ceph ダッシュボードでのログインバナーの設定

- Ceph ダッシュボードでの今日のメッセージの設定

- Ceph Dashboard でのクラスターのデプロイメント

- Ceph Dashboard 機能の切り替え

- Ceph Dashboard のランディングページの理解

- Red Hat Ceph Storage Dashboard の手動での有効化

- Ceph Dashboard を使用したダッシュボードパスワードの変更

- コマンドラインインターフェイスを使用した Ceph Dashboard のパスワードの変更

-

Grafana の

adminユーザーパスワードの設定 - Ceph Dashboard にユーザーを同期するための管理者アカウントの作成

- Red Hat シングルサインオンを使用した Ceph Dashboard とユーザーの同期

- Ceph Dashboard のシングルサインオンの有効化

- Ceph Dashboard のシングルサインオンの無効化

2.1. Ceph Dashboard のネットワークポート要件

Ceph Dashboard のコンポーネントは、アクセス可能である必要のある、特定の TCP ネットワークポートを使用します。デフォルトでは、Red Hat Ceph Storage のインストール時に、ネットワークポートは firewalld で自動的に開きます。

表2.1 TCP ポート要件

| ポート | 下記を使用して、 | 発信元ホスト | 宛先ホスト |

|---|---|---|---|

| 8443 | ダッシュボードの Web インターフェイス | AlertManager サービスはアラートを報告するために Dashboard への接続も開始できるため、Ceph Dashboard UI および Grafana サーバー配下のホストにアクセスする必要がある IP アドレス。 | Ceph Manager ホスト。 |

| 3000 | Grafana | Grafana Dashboard UI およびすべての Ceph Manager ホストと Grafana サーバーへのアクセスが必要な IP アドレス。 | Grafana サーバーを実行しているホスト (1 つまたは複数)。 |

| 2049 | NFS-Ganesha | NFS にアクセスする必要がある IP アドレス。 | NFS サービスを提供する IP アドレス。 |

| 9095 | 基本的な Prometheus グラフ用のデフォルトの Prometheus サーバー | Prometheus UI およびすべての Ceph Manager ホストと Grafana サーバーまたは Prometheus を実行しているホストへのアクセスが必要な IP アドレス。 | Prometheus を実行しているホスト。 |

| 9093 | Prometheus Alertmanager | Alertmanager Web UI およびすべての Ceph Manager ホストと Grafana サーバーまたは Prometheus を実行しているホストへのアクセスが必要な IP アドレス。 | すべての Ceph Manager ホストと Grafana サーバー配下のホスト。 |

| 9094 | 複数のインスタンスから作成された可用性の高いクラスターを設定するための Prometheus Alertmanager | すべての Ceph Manager ホストと Grafana サーバー配下のホスト。 |

Prometheus Alertmanager の高可用性 (ピアデーモン同期)。したがって、 |

| 9100 |

Prometheus の | Node Exporter メトリック Web UI を表示する必要がある Prometheus を実行しているホスト、およびすべての Ceph Manager ホストと Grafana サーバー、または Prometheus を実行しているホスト。 | MON、OSDS、Grafana サーバーホストを含む、すべてのストレージクラスターホスト。 |

| 9283 | Ceph Manager Prometheus エクスポーターモジュール | Ceph Exporter メトリック Web UI および Grafana サーバーにアクセスする必要がある Prometheus を実行しているホスト。 | すべての Ceph Manager ホスト。 |

| 9287 | Ceph iSCSI ゲートウェイデータ | すべての Ceph Manager ホストと Grafana サーバー。 | すべての Ceph iSCSI ゲートウェイホスト。 |

関連情報

- 詳細は、Red Hat Ceph Storage インストールガイド を参照してください。

- 詳細については、ネットワークの設定と管理 の ファイアウォールの使用と設定 を参照してください。

2.2. Ceph Dashboard へのアクセス

Ceph Dashboard にアクセスして Red Hat Ceph Storage クラスターを管理および監視できます。

前提条件

- Red Hat Ceph Storage Dashboard の正常なインストール

- NTP はクロックを適切に同期しています。

手順

Web ブラウザーで、以下の URL を入力します。

構文

https://HOST_NAME:PORT

以下を置き換えます。

- HOST_NAME は、アクティブなマネージャーホストの完全修飾ドメイン名 (FQDN) に置き換えます。

PORT は、ポート

8443に置き換えます。例:

https://host01:8443

Cephadm シェルで次のコマンドを実行して、ダッシュボードの URL を取得することもできます。

例:

[ceph: root@host01 /]# ceph mgr services

このコマンドは、現在設定されているすべてのエンドポイントを表示します。

ダッシュボードキーを探して、ダッシュボードにアクセスするための URL を取得します。

-

ログインページで、ブートストラップ時に指定したユーザー名

adminとデフォルトパスワードを入力します。 - Red Hat Ceph Storage ダッシュボードに初めてログインするときにパスワードを変更する必要があります。

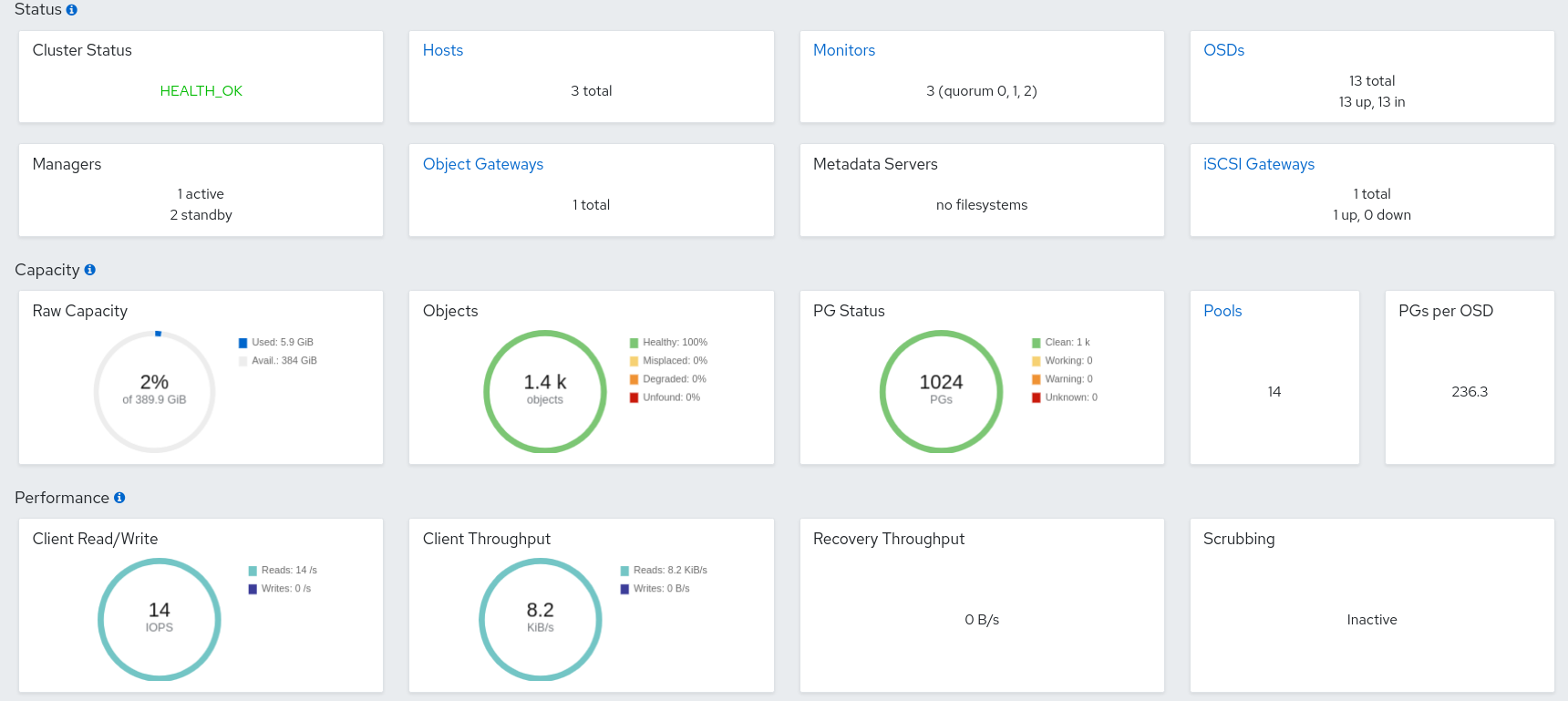

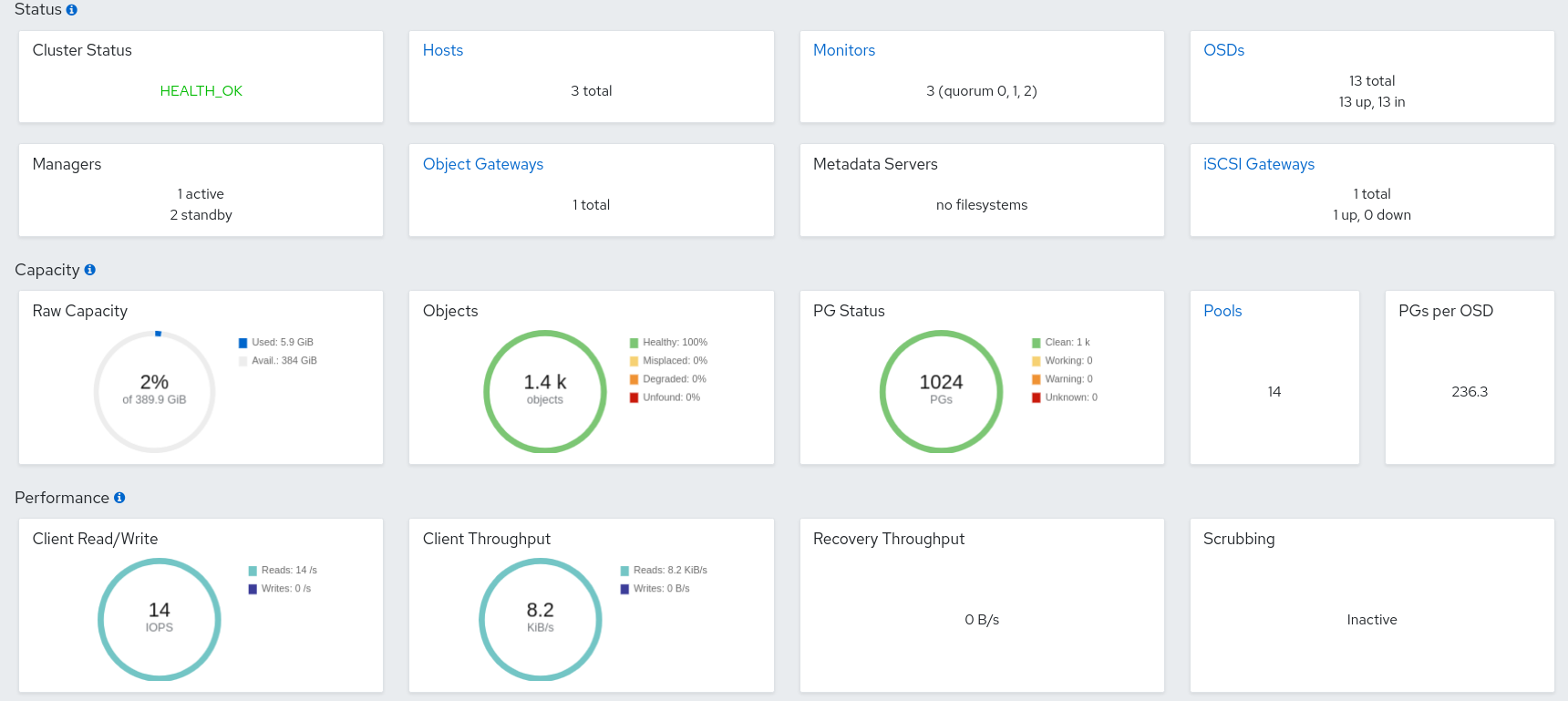

ログイン後、ダッシュボードのデフォルトランディングページが表示され、Red Hat Ceph Storage クラスターのステータス、パフォーマンス、および容量のメトリックの概要が提供されています。

図2.1 Ceph Dashboard のランディングページ

ダッシュボードのランディングページの以下のアイコンをクリックして、垂直メニューのオプションを折りたたむか表示します。

図2.2 Ceph Dashboard の垂直メニュー

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard を使用したダッシュボードパスワードの変更 を参照してください。

2.3. Ceph Dashboard でのログインバナーの設定

多くのユーザーは、セキュリティー、法律、または免責事項の理由から、ログインページのカスタマイズ可能なテキストにおいてサポートを必要としています。

コマンドラインインターフェイス (CLI) を使用して、Ceph Dashboard のログインページでこれらのカスタムテキストを設定できます。

前提条件

- モニタリングスタックがインストールされた実行中の Red Hat Ceph Storage クラスターがある。

-

cephadmホストへの root レベルのアクセスがある。 -

dashboardモジュールが有効化されている。

手順

root ユーザーとして

login.txtファイルを作成し、ユーザーにカスタムメッセージを提供します。例:

****CUSTOM LOGIN MESSAGE****

コンテナー内のディレクトリーの下に

login.txtファイルをマウントします。例:

[root@host01 ~]# cephadm shell --mount login.txt:/var/lib/ceph/login.txt

注記シェルを終了するたびに、デーモンをデプロイする前にファイルをコンテナーにマウントする必要があります。

オプション:

dashboardの Ceph Manager モジュールが有効になっているかどうかを確認します。例:

[ceph: root@host01 /]# ceph mgr module ls

ログインバナーテキストを設定します。

構文

ceph dashboard set-login-banner -i FILE_PATH例:

[ceph: root@host01 /]# ceph dashboard set-login-banner -i /var/lib/ceph/login.txt login banner file added

ログインバナーテキストを取得します。

例:

[ceph: root@host01 /]# ceph dashboard get-login-banner ****CUSTOM LOGIN MESSAGE****

オプション:

unsetコマンドを使用して、ログインバナーを削除できます。例:

[ceph: root@host01 /]# ceph dashboard unset-login-banner Login banner removed

検証

ダッシュボードにログインします。

https://HOST_NAME:8443

2.4. Ceph Dashboard での今日のメッセージ (MOTD) の設定

Red Hat Ceph Storage に関する最新のニュース、更新、情報について、Ceph Dashboardのユーザーに通知する必要がある場合があります。

ストレージ管理者は、コマンドラインインターフェイス (CLI) を使用して、今日のメッセージ (MOTD) を設定できます。

ユーザーが Ceph Dashboard にログインすると、Telemetry モジュールと同様に、設定済みの MOTD が Ceph Dashboard の上部に表示されます。

MOTD の重要度は、info、warning、danger などの重大度に基づいて設定できます。

重大度が info または warning の MOTD は、ユーザーが閉じることができます。info MOTD は、ローカルストレージの Cookie がクリアされるか、異なる重大度の新しい MOTD が表示されるまで表示されません。重大度が warning の MOTD は、新しいセッションで再び表示されます。

前提条件

- モニタリングスタックがインストールされた実行中の Red Hat Ceph Storage クラスターがある。

-

cephadmホストへの root レベルのアクセスがある。 -

dashboardモジュールが有効化されている。

手順

ダッシュボードの MOTD を設定します。

構文

ceph dashboard motd set SEVERITY EXPIRES MESSAGE

例:

[ceph: root@host01 /]# ceph dashboard motd set danger 2d "Custom login message" Message of the day has been set.

置き換え

-

SEVERITY は、

info、warning、dangerのいずれかです。 -

EXPIRES は、秒 (

s)、分 (m)、時間 (h)、日 (d)、週 (w)、または無期限 (0) にできます。 - MESSAGE は、ユーザーがダッシュボードにログインするとすぐに表示できる任意のカスタムメッセージにできます。

-

SEVERITY は、

オプション: 無期限の MOTD を設定します。

例:

[ceph: root@host01 /]# ceph dashboard motd set danger 0 "Custom login message" Message of the day has been set.

設定された MOTD を取得します。

例:

[ceph: root@host01 /]# ceph dashboard motd get Message="Custom login message", severity="danger", expires="2022-09-08T07:38:52.963882Z"

オプション:

clearコマンドを使用して設定された MOTD をクリアします。例:

[ceph: root@host01 /]# ceph dashboard motd clear Message of the day has been cleared.

検証

ダッシュボードにログインします。

https://HOST_NAME:8443

2.5. Ceph Dashboard でのクラスターのデプロイメント

ダッシュボードを使用して、Red Hat Ceph Storage クラスターを拡張し、ホストの追加、OSD の追加、Alertmanager、Cephadm-exporter、CephFS-mirror、Grafana、ingress、iSCSI、MDS、NFS、node-exporter、Prometheus、BD ミラー、Ceph Object Gateway などのサービスの作成を行うことができます。

新しいストレージクラスターをブートストラップすると、Ceph Monitor Daemon と Ceph Manager Daemon が作成され、クラスターは HEALTH_WARN 状態になります。ダッシュボードでクラスターのすべてのサービスを作成すると、クラスターの正常性が HEALTH_WARN から HEALTH_OK ステータスに変わります。

前提条件

- ブートストラップされたストレージクラスター。詳細については、Red Hat Ceph Storage インストールガイド の 新しいストレージクラスターのブートストラップ セクションを参照してください。

-

Red Hat Ceph ストレージダッシュボード上のユーザーの少なくとも

cluster-managerロール。詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのユーザーロールおよびパーミッション のセクションを参照してください。

手順

ブートストラップされたホストから他のホストに管理キーをコピーします。

構文

ssh-copy-id -f -i /etc/ceph/ceph.pub root@HOST_NAME例:

[ceph: root@host01 /]# ssh-copy-id -f -i /etc/ceph/ceph.pub root@host02 [ceph: root@host01 /]# ssh-copy-id -f -i /etc/ceph/ceph.pub root@host03

- ブートストラップ中に提供されたデフォルトの認証情報を使用してダッシュボードにログインします。

- パスワードを変更し、新しいパスワードでダッシュボードにログインします。

ランディングページで、Expand Cluster をクリックします。

図2.3 クラスターのデプロイメント

ホストの追加:

- Add Hosts ウィンドウで、+Add をクリックします。

ホスト名を指定します。これは、ブートストラップされたホストからキーをコピーするときに提供されたホスト名と同じです。

注記詳細については、Add Hosts ダイアログボックスのツールチップを使用できます。

- オプション: ホストのそれぞれの IP アドレスを指定します。

- オプション: サービスが作成されるホストのラベルを選択します。

- Add Host をクリックします。

- ストレージクラスター内のすべてのホストについて、上記の手順に従います。

- Add Hosts ウィンドウで、Next をクリックします。

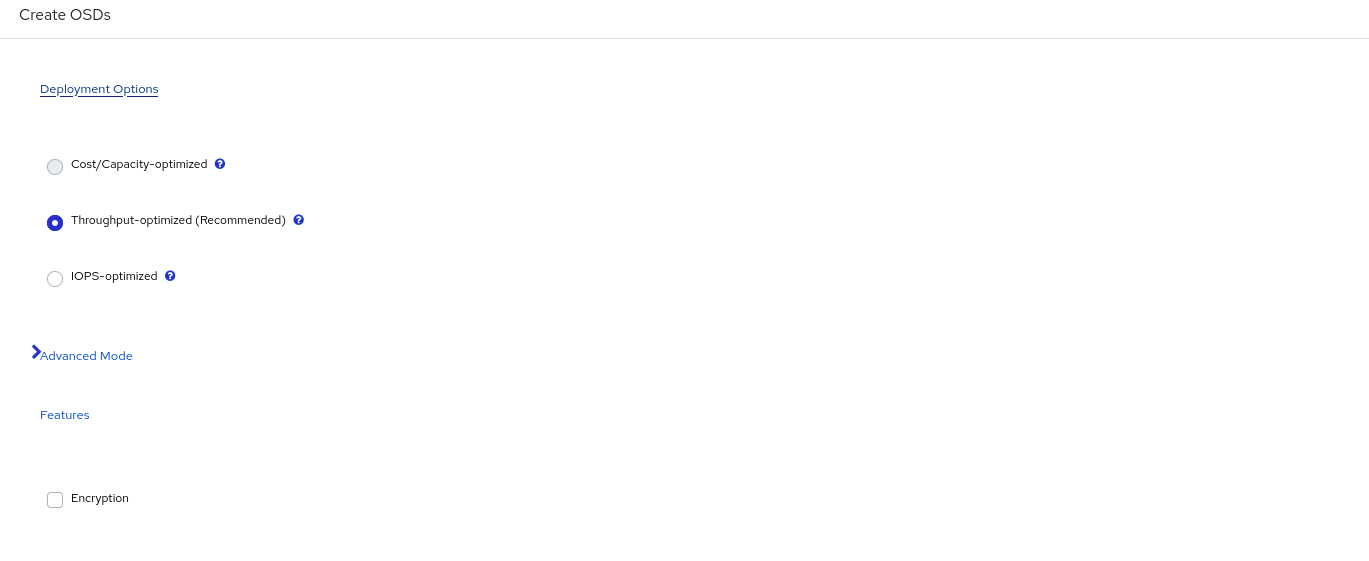

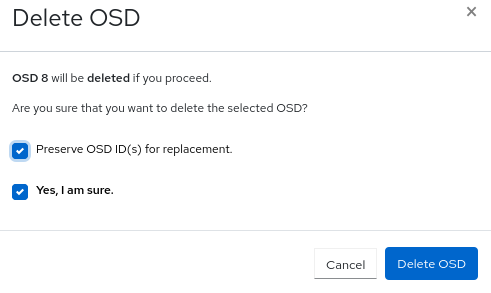

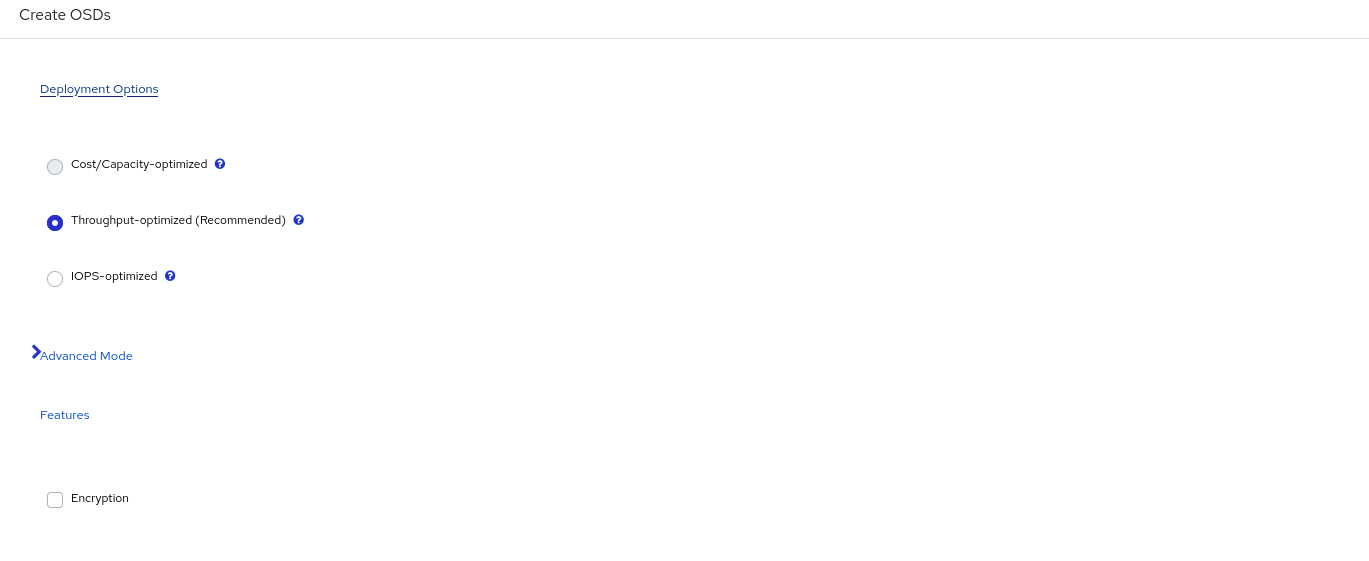

OSD を作成します。

- Create OSDsウィンドウのプライマリーデバイスで、+Add をクリックします。

- プライマリーデバイス ウィンドウで、デバイスをフィルタリングしてデバイスを選択します。

- Add をクリックします。

- オプション: Create OSDs ウィンドウで、WAL や DB デバイスなどの共有デバイスがある場合は、デバイスを追加します。

- オプション: 機能を暗号化するには、Encryption チェックボックスをクリックします。

- Create OSDs ウィンドウで、Next をクリックします。

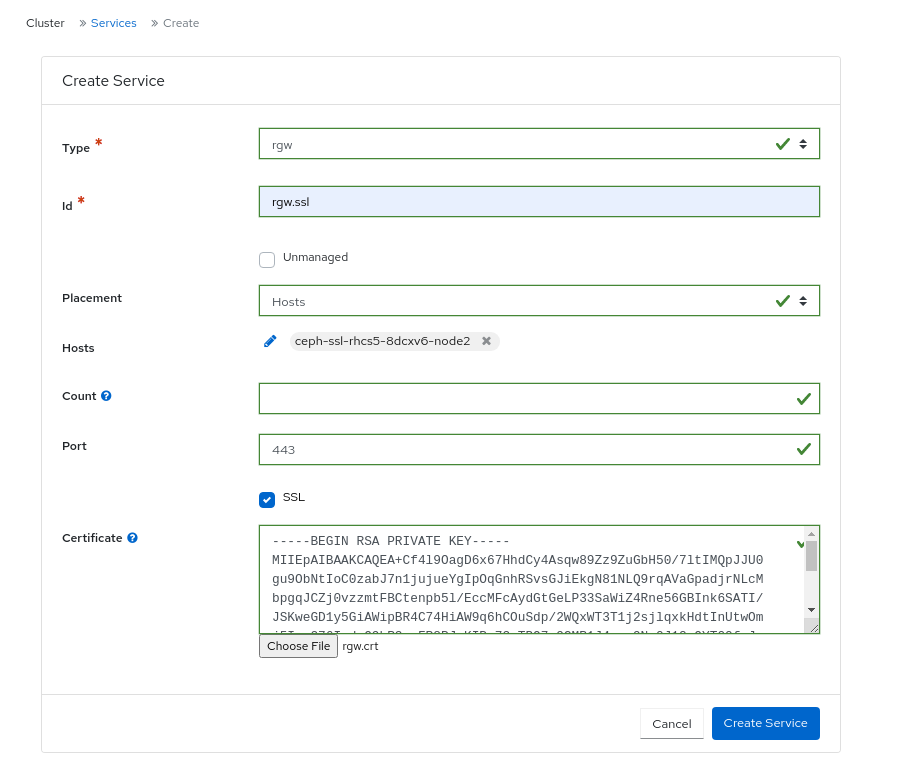

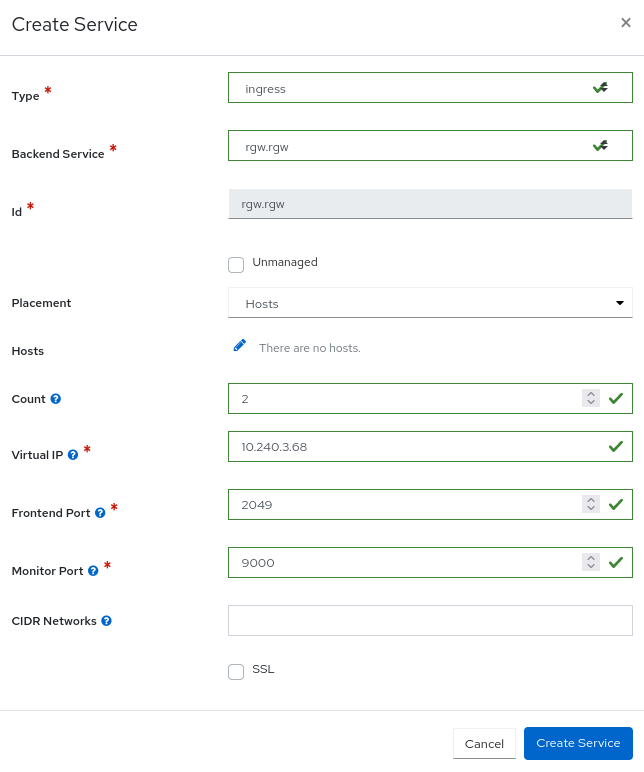

サービスを作成します。

- Create Services ウィンドウで、+Create をクリックします。

Create Service ダイアログボックスで、

- ドロップダウンからサービスのタイプを選択します。

- サービスの一意の名前であるサービス ID を入力します。

- ホストまたはラベルごとに配置を提供します。

- ホストを選択します。

- デプロイする必要のあるデーモンまたはサービスの数を提供します。

- Create Service をクリックします。

- Create Service ウィンドウで、Next をクリックします。

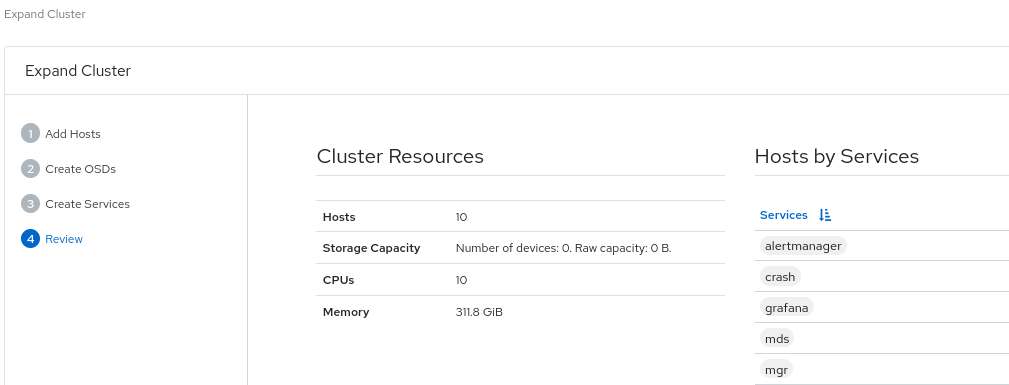

Cluster Resources、Hosts by Services、Host Details を確認します。パラメーターを編集する場合は、Back をクリックして上記の手順に従います。

図2.4 クラスターのレビュー

- Expand Cluster をクリックします。

- クラスターの拡張が成功したという通知が表示されます。

- ダッシュボードでクラスターの状態が HEALTH_OK ステータスに変わります。

検証

cephadmシェルにログインします。例:

[root@host01 ~]# cephadm shell

ceph-sコマンドを実行します。例:

[ceph: root@host01 /]# ceph -s

クラスターの正常性は HEALTH_OK です。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのユーザーロールおよびパーミッション のセクションを参照してください。

- 詳細は、Red Hat Ceph Storage インストールガイド を参照してください。

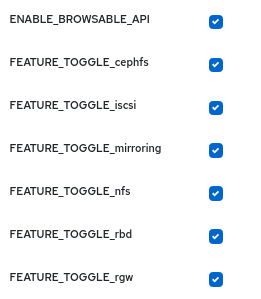

2.6. Ceph Dashboard 機能の切り替え

オンデマンドで機能を有効または無効にすることで、Red Hat Ceph Storage ダッシュボードのコンポーネントをカスタマイズできます。デフォルトでは、すべての機能が有効になっています。機能を無効にすると、Web インターフェイス要素は非表示になり、関連付けられた REST API のエンドポイントはその機能に対する追加のリクエストを拒否します。ダッシュボード機能の有効化および無効化は、コマンドラインインターフェイスまたは Web インターフェイスから実行できます。

利用可能な機能:

Ceph ブロックデバイス:

-

イメージの管理 (

rbd) -

ミラーリング (

mirroring) -

iSCSI ゲートウェイ (

iscsi)

-

イメージの管理 (

-

Ceph ファイルシステム (

cephfs) -

Ceph オブジェクトゲートウェイ (

rgw) -

NFS Ganesha ゲートウェイ (

nfs)

デフォルトでは、Ceph Manager は Ceph Monitor と併置されます。

複数の機能を一度に無効にできます。

機能が無効になったら、Web インターフェイスの変更を反映するのに最大 20 秒かかる場合があります。

前提条件

- Red Hat Ceph Storage ダッシュボードソフトウェアのインストールおよび設定

- Ceph Manager ホストまたはダッシュボードの Web インターフェイスへのユーザーアクセス

- Ceph Manager ホストへの root レベルのアクセス

手順

ダッシュボードの Web インターフェイスからダッシュボード機能を切り替えるには、以下を実行します。

- ダッシュボードのランディングページで、Cluster ドロップダウンメニューに移動します。

- Manager Modules を選択し、Dashboard を選択します。

Edit Manager module ページで、機能名の横にある選択ボックスを選択するか、選択を解除すると、ダッシュボードの機能を有効または無効にできます。

図2.5 Manager モジュールを編集

- 選択が完了したら、下にスクロールして Update をクリックします。

コマンドラインインターフェイスからダッシュボード機能を切り替えるには、以下を実行します。

Cephadm シェルにログインします。

例:

[root@host01 ~]# cephadm shell

機能のステータスのリストを表示します。

例:

[ceph: root@host01 /]# ceph dashboard feature status

機能を無効にします。

[ceph: root@host01 /]# ceph dashboard feature disable iscsi

以下の例では、Ceph iSCSI ゲートウェイ機能を無効にします。

機能を有効にします。

[ceph: root@host01 /]# ceph dashboard feature enable cephfs

以下の例では、Ceph Filesystem 機能を有効にします。

2.7. Ceph Dashboard のランディングページの理解

ランディングページには、ナビゲーションバーと個別のパネルを使用した Ceph クラスター全体の概要が表示されます。

ナビゲーションバーには、次のオプションがあります。

- タスクと通知に関するメッセージ。

- ドキュメント、Ceph Rest API、および Red Hat Ceph Storage Dashboard に関する詳細へのリンク。

- ユーザー管理とテレメトリー設定へのリンク。

- パスワードを変更してダッシュボードからサインアウトするためのリンク。

図2.6 ナビゲーションバー

それとは別に、個々のパネルには、クラスターの状態に関する具体的な情報が表示されます。

Categories

ランディングページでは、パネルが以下の 3 つのカテゴリーに分けられます。

- ステータス

- 容量

- パフォーマンス

図2.7 Ceph Dashboard のランディングページ

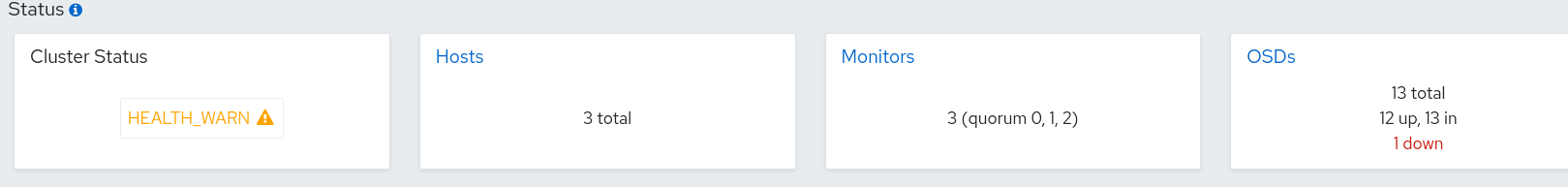

ステータスパネル

ステータスパネルには、クラスターの状態とホストおよびデーモンの状態が表示されます。

クラスターの状態: Ceph ストレージクラスターの現在のヘルスステータスを表示します。

ホスト: Ceph Storage クラスターのホストの合計数を表示します。

監視: Ceph Monitor の数およびクォーラムのステータスを表示します。

OSDs: Ceph Storage クラスターの OSD の合計数と、up および in の数を表示します。

マネージャー: Manager Daemon の数およびステータスを表示します。

Object Gateway : Ceph Storage クラスターのObject Gateway の数を表示します。

メタデータサーバー: Ceph ファイルシステム (CephFS) のメタデータサーバーの数とステータスを表示します。

iSCSI ゲートウェイ: Ceph ストレージクラスター内の iSCSI ゲートウェイの数を表示します。

容量パネル

容量パネルには、ストレージ使用量のメトリックが表示されます。

Raw 容量: クラスターの raw ストレージ容量の使用状況および可用性を表示します。

オブジェクト: プール内のオブジェクトの合計数と、オブジェクトを Healthy、Misplaced、Degraded、または Unfound の状態に分割するグラフを表示します。

PG ステータス: 配置グループの合計数と、PG を Clean、Working、Warning、または Unknown の状態に分割するグラフを表示します。PG ステータスの Working および Warning の表示を簡素化するために、実際には複数の状態が含まれます。

Working の状態には、以下のいずれかの状態の PG が含まれます。

- activating

- backfill_wait

- backfilling

- creating

- deep

- degraded

- forced_backfill

- forced_recovery

- peering

- peered

- recovering

- recovery_wait

- repair

- scrubbing

- snaptrim

- snaptrim_wait

Warning の状態には、以下のいずれかの状態の PG が含まれます。

- backfill_toofull

- backfill_unfound

- down

- incomplete

- inconsistent

- recovery_toofull

- recovery_unfound

- remapped

- snaptrim_error

- stale

- undersized

プール: Ceph クラスター内のストレージプールの数を表示します。

OSD ごとの PG: OSD ごとの配置グループ数を表示します。

パフォーマンスパネル

パフォーマンスパネルには、データ転送速度に関する情報が表示されます。

クライアントの読み取り/書き込み: 1 秒あたりの入出力操作の合計、読み取り、および書き込みを表示します。

クライアントのスループット: クライアントスループット、読み取りスループット、書き込みスループットを表示します。

リカバリーのスループット: データのリカバリー速度を表示します。

スクラビング: データの整合性を確認するために Ceph がスクラビングしているかどうかを表示します。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboardガイドの Ceph Dashboard でのクラスターの監視 セクションを参照してください。

2.8. Ceph Dashboard を使用したダッシュボードパスワードの変更

デフォルトでは、ダッシュボードにアクセスするためのパスワードは、クラスターのブートストラップ中にシステムでランダムに生成されます。Red Hat Ceph Storage ダッシュボードに初めてログインするときにパスワードを変更する必要があります。ダッシュボードを使用して、admin ユーザーのパスワードを変更できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

手順

ダッシュボードにログインします。

https://HOST_NAME:8443ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

図2.8 ユーザー管理

- admin のパスワードを変更するには、その行をクリックします。

- Edit ドロップダウンメニューで Edit を選択します。

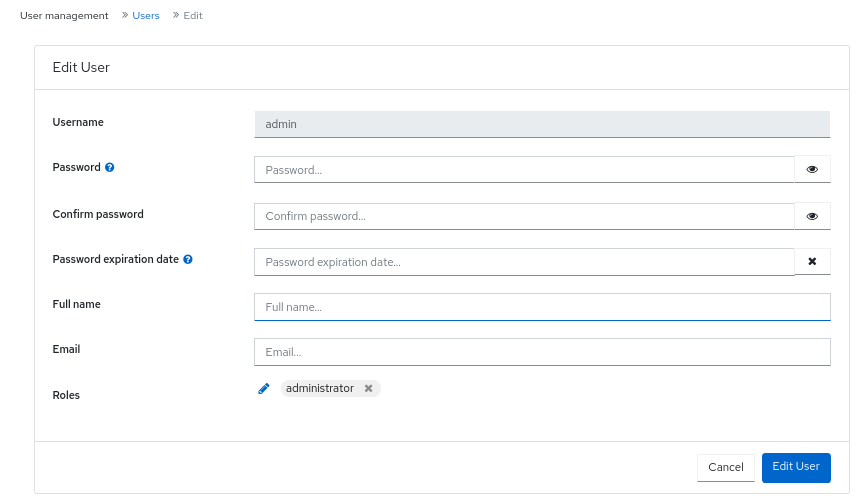

Edit User ウィンドウで、新しいパスワードを入力し、その他のパラメーターを変更し、Edit User をクリックします。

図2.9 ユーザー管理の編集

ログアウトし、ログイン画面にリダイレクトされます。パスワードの変更を確認する通知が表示されます。

2.9. コマンドラインインターフェイスを使用した Ceph Dashboard のパスワードの変更

Ceph Dashboard のパスワードを忘れた場合は、コマンドラインインターフェイスを使用してパスワードを変更できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- ダッシュボードがインストールされているホストへの root レベルのアクセス。

手順

Cephadm シェルにログインします。

例:

[root@host01 ~]# cephadm shell

dashboard_password.ymlファイルを作成します。例:

[ceph: root@host01 /]# touch dashboard_password.yml

ファイルを編集し、新しいダッシュボードパスワードを追加します。

例:

[ceph: root@host01 /]# vi dashboard_password.yml

ダッシュボードのパスワードをリセットします。

構文

ceph dashboard ac-user-set-password DASHBOARD_USERNAME -i PASSWORD_FILE

例

[ceph: root@host01 /]# ceph dashboard ac-user-set-password admin -i dashboard_password.yml {"username": "admin", "password": "$2b$12$i5RmvN1PolR61Fay0mPgt.GDpcga1QpYsaHUbJfoqaHd1rfFFx7XS", "roles": ["administrator"], "name": null, "email": null, "lastUpdate": , "enabled": true, "pwdExpirationDate": null, "pwdUpdateRequired": false}

検証

- 新しいパスワードでダッシュボードにログインします。

2.10. Grafana の admin ユーザーパスワードの設定

デフォルトでは、cephadm は Grafana の管理者ユーザーを作成しません。Ceph Orchestrator を使用すると、管理者ユーザーを作成してパスワードを設定できます。

これらの認証情報を使用すると、管理者ユーザーに指定されたパスワードを使用して、ストレージクラスターの Grafana URL にログインできます。

前提条件

- モニタリングスタックがインストールされた実行中の Red Hat Ceph Storage クラスターがある。

-

cephadmホストへの root レベルのアクセスがある。 -

dashboardモジュールが有効化されている。

手順

root ユーザーとして

grafana.ymlファイルを作成し、次の詳細を指定します。構文

service_type: grafana spec: initial_admin_password: PASSWORD例:

service_type: grafana spec: initial_admin_password: mypassword

grafana.ymlファイルをコンテナーのディレクトリーにマウントします。例:

[root@host01 ~]# cephadm shell --mount grafana.yml:/var/lib/ceph/grafana.yml

注記シェルを終了するたびに、デーモンをデプロイする前にファイルをコンテナーにマウントする必要があります。

オプション:

dashboardの Ceph Manager モジュールが有効になっているかどうかを確認します。例:

[ceph: root@host01 /]# ceph mgr module ls

オプション:

dashboardの Ceph Manager モジュールを有効にします。例:

[ceph: root@host01 /]# ceph mgr module enable dashboard

orchコマンドを使用して仕様を適用します。構文

ceph orch apply -i FILE_NAME.yml例:

[ceph: root@host01 /]# ceph orch apply -i /var/lib/ceph/grafana.yml

grafanaサービスを再デプロイします。例:

[ceph: root@host01 /]# ceph orch redeploy grafana

これにより、指定されたパスワードで

adminという名前の管理者ユーザーが作成され、ユーザーはこれらの認証情報を使用して Grafana URL にログインできます。

検証:

次の認証情報を使用して Grafana にログインします。

構文

https://HOST_NAME:PORT

例:

https://host01:3000/

2.11. Red Hat Ceph Storage Dashboard を手動で有効にする

ブートストラップ中に --skip-dashboard オプションを使用して Red Hat Ceph Storage クラスターをインストールした場合は、ダッシュボードの URL と認証情報がブートストラップ出力で使用できないことが確認できます。コマンドラインインターフェイスを使用して、ダッシュボードを手動で有効にできます。Prometheus、Grafana、Alertmanager、node-exporter などの監視スタックコンポーネントはデプロイされていますが、これらは無効になっているため、手動で有効にする必要があります。

前提条件

-

ブートストラップ中に

--skip-dashboardオプションを指定してインストールされた実行中の Red Hat Ceph Storage クラスター。 - ダッシュボードを有効にする必要があるホストへの root レベルのアクセス。

手順

Cephadm シェルにログインします。

例:

[root@host01 ~]# cephadm shell

Ceph Manager サービスを確認します。

例:

[ceph: root@host01 /]# ceph mgr services { "prometheus": "http://10.8.0.101:9283/" }ダッシュボードの URL が設定されていないことが確認できます。

ダッシュボードモジュールを有効にします。

例:

[ceph: root@host01 /]# ceph mgr module enable dashboard

ダッシュボードアクセス用の自己署名証明書を作成します。

例:

[ceph: root@host01 /]# ceph dashboard create-self-signed-cert

注記証明書の検証を無効にして、証明書のエラーを回避できます。

Ceph Manager サービスを確認します。

例:

[ceph: root@host01 /]# ceph mgr services { "dashboard": "https://10.8.0.101:8443/", "prometheus": "http://10.8.0.101:9283/" }Red Hat Ceph Storage ダッシュボードにアクセスするための管理者ユーザーとパスワードを作成します。

構文

echo -n "PASSWORD" > PASSWORD_FILE ceph dashboard ac-user-create admin -i PASSWORD_FILE administrator

例:

[ceph: root@host01 /]# echo -n "p@ssw0rd" > password.txt [ceph: root@host01 /]# ceph dashboard ac-user-create admin -i password.txt administrator

- 監視スタックを有効にします。詳細は、Red Hat Ceph Storage Dashboard Guide の Enabling monitoring stack セクションを参照してください。

関連情報

- Red Hat Ceph Storage Operations Guide の Deploying the monitoring stack using the Ceph Orchestrator セクションを参照してください。

2.12. Ceph Dashboard にユーザーを同期するための管理者アカウントの作成

ユーザーを Ceph Dashboard に同期するには、管理者アカウントを作成する必要があります。

アカウントを作成したら、Red Hat シングルサインオン (SSO) を使用して、ユーザーを Ceph Dashboard と同期させます。Red Hat Ceph Storage Dashboard ガイドの Red Hat シングルサインオンを使用した Ceph Dashboard へのユーザーの同期 セクションを参照してください。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ダッシュボードへの管理者レベルのアクセス権。

- ユーザーをダッシュボードに追加しておく。

- すべてのホストでの root レベルのアクセス。

- Red hat Single Sign-On を ZIP ファイルからインストールしておく。詳細は、Zip ファイルからの Red Hat Single Sign-On のインストール を参照してください。

手順

- Red Hat Ceph ストレージがインストールされているシステムに Red Hat Single Sign-On 7.4.0 サーバー をダウンロードします。

フォルダーをデプロイメントします。

[root@host01 ~]# unzip rhsso-7.4.0.zip

standalone/configurationディレクトリーに移動し、standalone.xmlを開いて編集します。[root@host01 ~]# cd standalone/configuration [root@host01 configuration]# vi standalone.xml

-

localhostのすべてのインスタンスと127.0.0.1の 2 つのインスタンスは、Red Hat SSO がインストールされているマシンの IP アドレスに置き換えます。 オプション: Red Hat Enterprise Linux 8 の場合には、認証局 (CA) の問題が発生する可能性があります。CA からカスタム証明書をインポートして、正確な Java バージョンを使用するキーストアに移動します。

例:

[root@host01 ~]# keytool -import -noprompt -trustcacerts -alias ca -file ../ca.cer -keystore /etc/java/java-1.8.0-openjdk/java-1.8.0-openjdk-1.8.0.272.b10-3.el8_3.x86_64/lib/security/cacert

rh-sso-7.4フォルダーのbinディレクトリーからサーバーを起動するには、standaloneブートスクリプトを実行します。[root@host01 bin]# ./standalone.sh

ユーザー名とパスワードを指定して、https: IP_ADDRESS :8080/auth で管理アカウントを作成します。

注記管理者アカウントを作成する必要があるのは、コンソールに初めてログインするときだけです。

- 作成された認証情報を使用して管理コンソールにログインします。

関連情報

- ダッシュボードでユーザーのロールを追加する方法は、Red Hat Ceph Storage ダッシュボードガイドの Ceph Dashboard でのロールの作成 セクションを参照してください。

- ダッシュボードでユーザーを作成する方法は、Red Hat Ceph Storage ダッシュボードガイドの Ceph Dashboard でのユーザーの作成 セクションを参照してください。

2.13. Red Hat シングルサインオンを使用したユーザーの Ceph Dashboard への同期

Red Hat シングルサインオン (SSO) と Lightweight Directory Access Protocol (LDAP) 統合を使用して、ユーザーを Red Hat Ceph ストレージダッシュボードと同期させることができます。

ユーザーは特定のレルムに追加されます。このレルムでは、パスワードの追加要件なしで SSO を介してダッシュボードにアクセスできます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ダッシュボードへの管理者レベルのアクセス権。

- ユーザーをダッシュボードに追加しておく。Red Hat Ceph Storage Dashboard ガイド の Ceph dashboard でのユーザーの作成 セクションを参照してください。

- すべてのホストでの root レベルのアクセス。

- ユーザーの同期用に作成された管理者アカウント。Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でユーザーを同期するための管理者アカウントの作成 セクションを参照してください。

手順

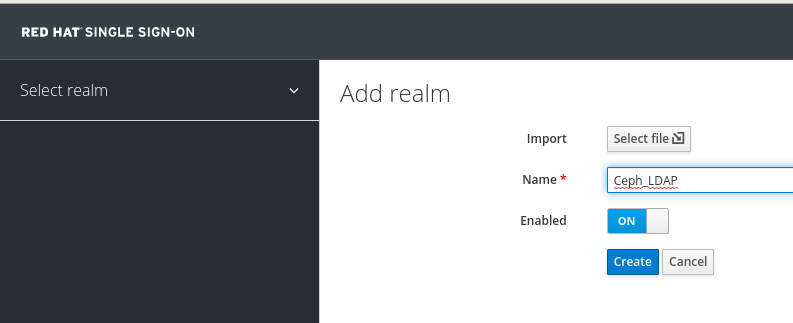

- レルムを作成するには、Master ドロップダウンメニューをクリックします。このレルムでは、ユーザーおよびアプリケーションにアクセスできます。

Add Realm ウィンドウで、レルム名 (大文字と小文字を区別) を入力し、パラメーターを Enabled に設定し、Create をクリックします。

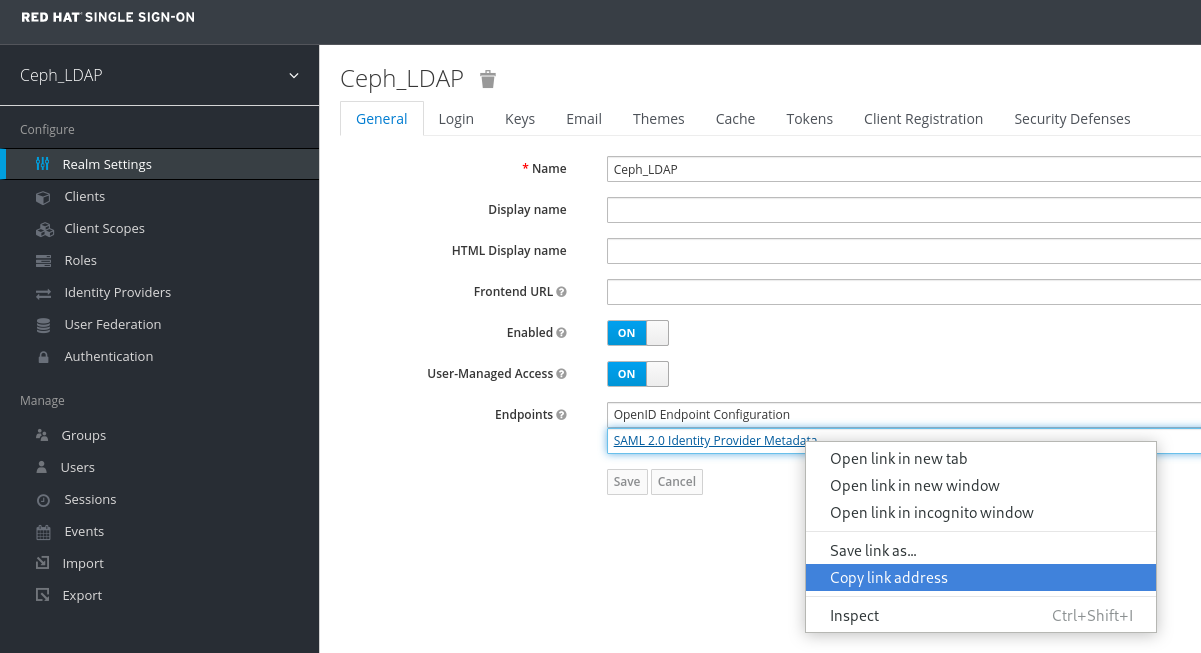

Realm Settings タブで、次のパラメーターを設定し、Save をクリックします。

- Enabled - ON

- User-Managed Access - ON

Client Settings に貼り付ける SAML 2.0 アイデンティティープロバイダーメタデータのリンクアドレスをメモしておきます。

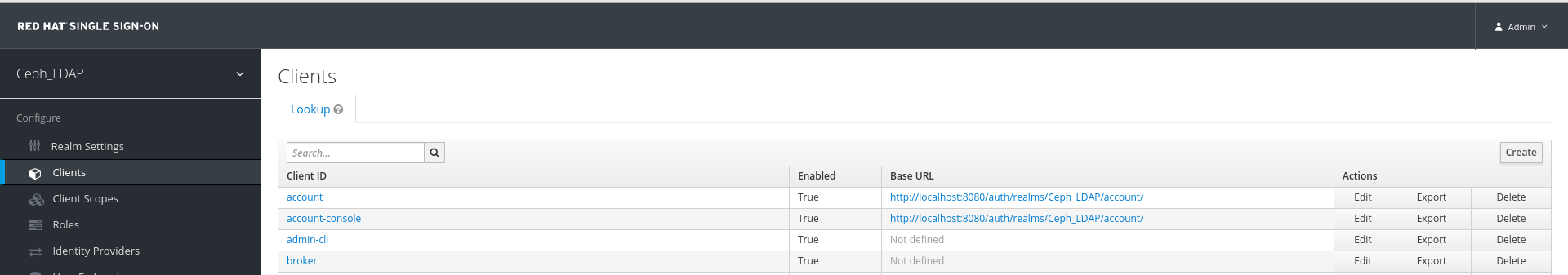

Clients タブで、Create をクリックします。

Add Client ウィンドウで、次のパラメーターを設定し、Save をクリックします。

クライアント ID - BASE_URL:8443/auth/saml2/metadata

例:

https://example.ceph.redhat.com:8443/auth/saml2/metadata

- クライアントプロトコル - saml

Client ウィンドウの Settings タブで、次のパラメーターを設定します。

表2.2 クライアント設定タブ

パラメーターの名前 構文 例: Client IDBASE_URL:8443/auth/saml2/metadata

https://example.ceph.redhat.com:8443/auth/saml2/metadata

有効ON

ON

クライアントプロトコルsaml

saml

Include AuthnStatementON

ON

サインインドキュメントON

ON

Signature AlgorithmRSA_SHA1

RSA_SHA1

SAML Signature Key NameKEY_ID

KEY_ID

有効なリダイレクト URLBASE_URL:8443/*

https://example.ceph.redhat.com:8443/*

ベース URLBASE_URL:8443

https://example.ceph.redhat.com:8443/

Master SAML Processing URLhttps://localhost:8080/auth/realms/REALM_NAME/protocol/saml/descriptor

https://localhost:8080/auth/realms/Ceph_LDAP/protocol/saml/descriptor

注記Realm Settings タブから SAML 2.0 アイデンティティープロバイダーメタデータのリンクを貼り付けます。

Fine Grain SAML Endpoint Configuration で、次のパラメーターを設定し、Save をクリックします。

表2.3 詳細にわたる SAML 設定

パラメーターの名前 構文 例: Assertion Consumer Service POST Binding URLBASE_URL:8443/#/dashboard

https://example.ceph.redhat.com:8443/#/dashboard

Assertion Consumer Service Redirect Binding URLBASE_URL:8443/#/dashboard

https://example.ceph.redhat.com:8443/#/dashboard

Logout Service Redirect Binding URLBASE_URL:8443/

https://example.ceph.redhat.com:8443/

Clients ウィンドウの Mappers タブで、次のパラメーターを設定し、Save をクリックします。

表2.4 クライアントマッパータブ

パラメーターの名前 値 プロトコルsaml

名前username

マッパープロパティーユーザープロパティー

プロパティーusername

SAML 属性名username

Clients Scope タブで、role_list を選択します。

- Mappers タブで、role list を選択し、Single Role Attribute をオンに設定します。

User_Federation タブを選択します。

- User Federation ウィンドウで、ドロップダウンメニューから LDAP を選択します。

User_Federation ウィンドウの Settings タブで、次のパラメーターを設定し、Save をクリックします。

表2.5 ユーザーフェデレーション設定タブ

パラメーターの名前 値 コンソール表示名rh-ldap

ユーザーのインポートON

Edit_ModeREAD_ONLY

ユーザー名 LDAP 属性username

RDN LDAP 属性username

UUID LDAP 属性nsuniqueid

ユーザーオブジェクトクラスinetOrgPerson

organizationalPersonrhatPerson

接続 URL例: ldap: //ldap.corp.redhat.com。Test Connection をクリックします。LDAP 接続が成功したという通知が表示されます。

ユーザー DNou=users、dc=example、dc=com

バインドタイプsimple

Test authentication をクリックします。LDAP 認証が成功したという通知が表示されます。

Mappers タブで、first name の行を選択して、以下のパラメーターを編集し、Save をクリックします。

- LDAP 属性 - GivenName

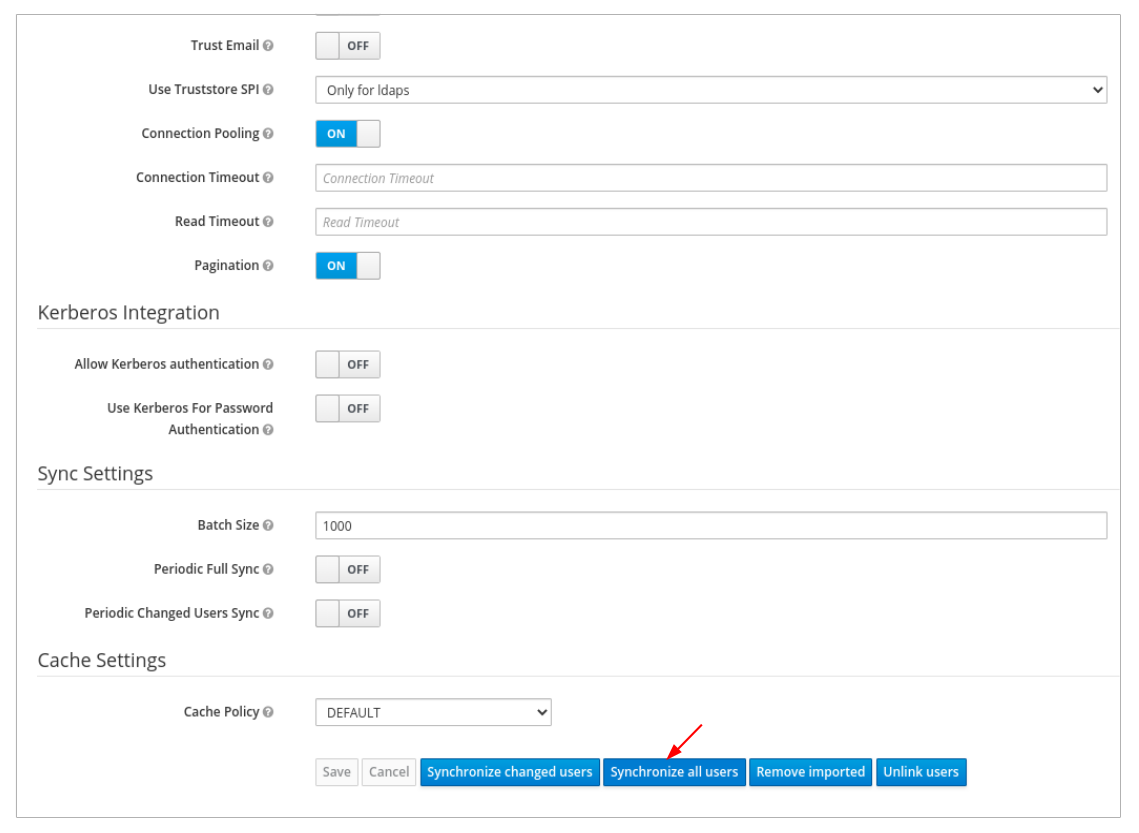

User_Federation タブの Settings タブで、Synchronize all users をクリックします。

ユーザーの同期が正常に終了したという通知が表示されます。

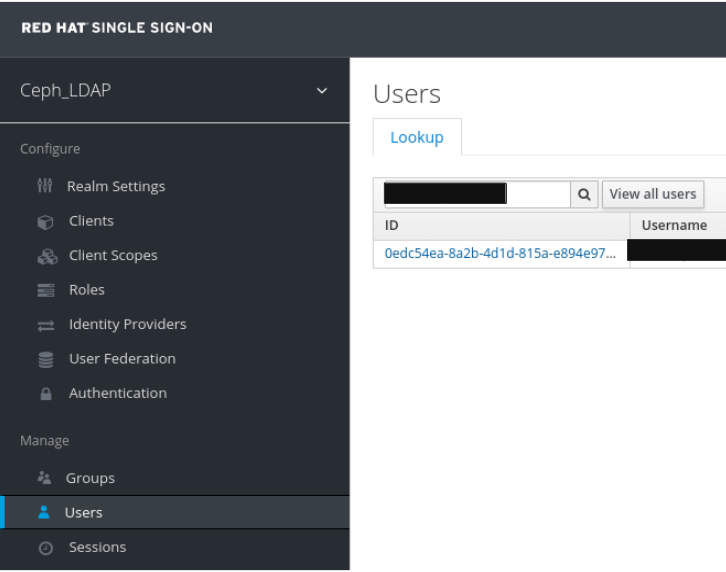

Users タブで、ダッシュボードに追加されたユーザーを検索し、検索アイコンをクリックします。

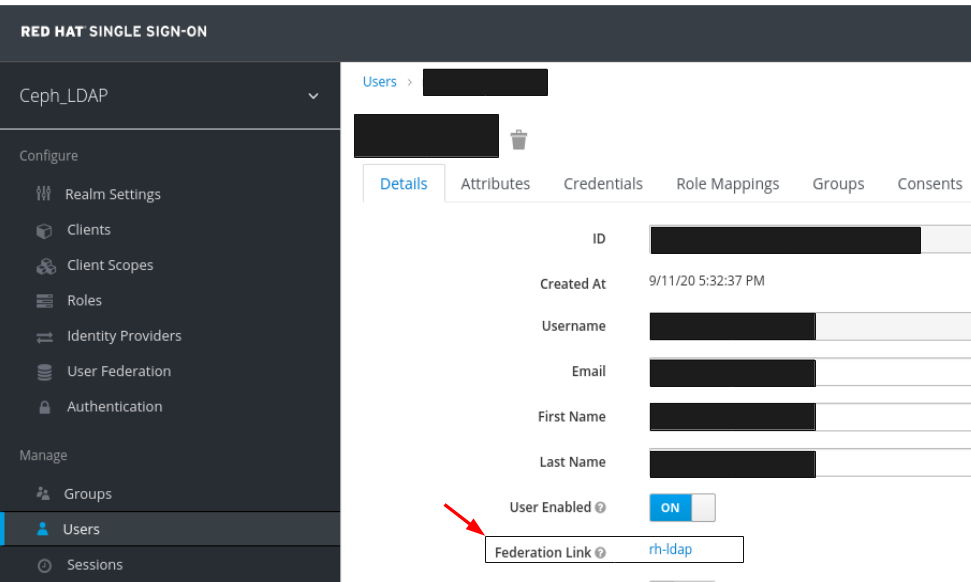

ユーザーを表示するには、特定の行をクリックします。フェデレーションリンクは、 User Federation で指定した名前で表示されます。

重要

重要ユーザーは LDAP では同期されないため、手動でユーザーを追加しないでください。手動で追加した場合は、Delete をクリックしてユーザーを削除します。

検証

レルムとダッシュボードに追加されたユーザーは、メールアドレスとパスワードを使用して Ceph Dashboard にアクセスできます。

例:

https://example.ceph.redhat.com:8443

関連情報

- ダッシュボードでユーザーのロールを追加する方法は、Red Hat Ceph Storage ダッシュボードガイドの Ceph Dashboard でのロールの作成 セクションを参照してください。

2.14. Ceph Dashboard のシングルサインオンの有効化

Ceph Dashboard は、Security Assertion Markup Language (SAML) 2.0 プロトコルを使用したユーザーの外部認証をサポートします。Ceph Dashboard にシングルサインオン (SSO) を使用する前に、ダッシュボードのユーザーアカウントを作成して必要なロールを割り当てます。Ceph Dashboard はユーザーの承認を実行し、認証プロセスは既存のアイデンティティープロバイダー (IdP) によって実行されます。SAML プロトコルを使用してシングルサインオンを有効にできます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Ceph Dashboard のインストール。

- Ceph Manager ホストへの root レベルのアクセス。

手順

Ceph Dashboard で SSO を設定するには、以下のコマンドを実行します。

構文

podman exec CEPH_MGR_HOST ceph dashboard sso setup saml2 CEPH_DASHBOARD_BASE_URL IDP_METADATA IDP_USERNAME_ATTRIBUTE IDP_ENTITY_ID SP_X_509_CERT SP_PRIVATE_KEY

例:

[root@host01 ~]# podman exec host01 ceph dashboard sso setup saml2 https://dashboard_hostname.ceph.redhat.com:8443 idp-metadata.xml username https://10.70.59.125:8080/auth/realms/realm_name /home/certificate.txt /home/private-key.txt

置き換え

-

CEPH_MGR_HOST と Ceph

mgrホスト。(例:host01) - CEPH_DASHBOARD_BASE_URL は、Ceph Dashboard がアクセス可能なベース URL に置き換えます。

- IDP_METADATA は、リモートパスまたはローカルパス、または IdP メタデータ XML の内容への URL に置き換えます。サポートされる URL タイプは http、https、およびファイルです。

- 任意: IDP_USERNAME_ATTRIBUTE は、認証応答からユーザー名を取得するために使用される属性に置き換えます。デフォルトは uid です。

- 任意: IDP_ENTITY_ID は、IdP メタデータに複数のエンティティー ID が存在する場合は IdP エンティティー ID に置き換えます。

- 任意: SP_X_509_CERT は、署名および暗号化に Ceph Dashboard によって使用される証明書のファイルパスに置き換えます。

- 任意: SP_PRIVATE_KEY は、署名および暗号化に Ceph Dashboard によって使用される秘密鍵のファイルパスに置き換えます。

-

CEPH_MGR_HOST と Ceph

現在の SAML 2.0 設定を確認します。

構文

podman exec CEPH_MGR_HOST ceph dashboard sso show saml2例:

[root@host01 ~]# podman exec host01 ceph dashboard sso show saml2

SSO を有効にするには、以下のコマンドを実行します。

構文

podman exec CEPH_MGR_HOST ceph dashboard sso enable saml2 SSO is "enabled" with "SAML2" protocol.例:

[root@host01 ~]# podman exec host01 ceph dashboard sso enable saml2

ダッシュボードの URL を開きます。

例:

https://dashboard_hostname.ceph.redhat.com:8443

- SSO ページで、ログインの認証情報を入力します。SSO はダッシュボードの Web インターフェイスにリダイレクトされます。

関連情報

- シングルサインオンを無効にするには、Red Hat Ceph Storage ダッシュボードガイドの Ceph Dashboard のシングルサインオンの無効化 を参照してください。

2.15. Ceph Dashboard のシングルサインオンの無効化

SAML 2.0 プロトコルを使用して、Ceph Dashboard のシングルサインオンを無効にすることができます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Ceph Dashboard のインストール。

- Ceph Manager ホストへの root レベルのアクセス。

- Ceph Dashboard で有効になっているシングルサインオン

手順

SSO が有効になっているかどうかを確認します。

構文

podman exec CEPH_MGR_HOST ceph dashboard sso status例:

[root@host01 ~]# podman exec host01 ceph dashboard sso status SSO is "enabled" with "SAML2" protocol.

SSO を無効にします。

構文

podman exec CEPH_MGR_HOST ceph dashboard sso disable SSO is "disabled".例

[root@host01 ~]# podman exec host01 ceph dashboard sso disable

関連情報

- シングルサインオンを有効にするには、Red Hat Ceph Storage ダッシュボードガイドの Ceph Dashboard のシングルサインオンの有効化 を参照してください。

第3章 Ceph Dashboard でのロールの管理

ストレージ管理者は、ダッシュボードでロールを作成、編集、複製、削除できます。

デフォルトでは、8 つのシステムロールがあります。カスタムロールを作成し、それらのロールにアクセス権を付与できます。これらのロールは、要件に基づいてユーザーに割り当てることができます。

本セクションでは、以下の管理タスクを説明します。

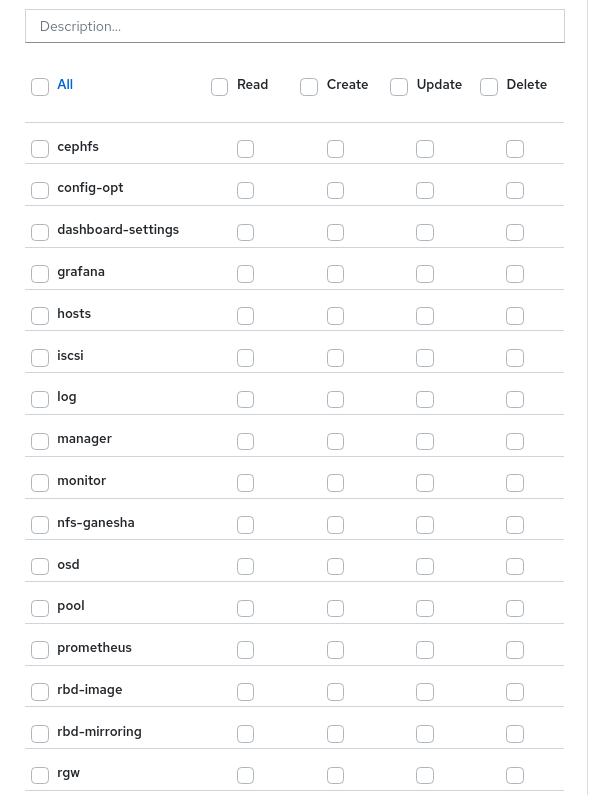

3.1. Ceph Dashboard 上のユーザーロールとパーミッション

ユーザーアカウントは、アクセス可能な特定のダッシュボード機能を定義するロールのセットに関連付けられます。

Red Hat Ceph Storage ダッシュボードの機能またはモジュールは、セキュリティースコープ内でグループ化されます。セキュリティースコープは事前に定義され、静的です。Red Hat Ceph Storage ダッシュボードで現在利用可能な セキュリティースコープ は以下のとおりです。

- cephfs: CephFS 管理に関連するすべての機能が含まれます。

- config-opt: Ceph 設定オプションの管理に関連するすべての機能が含まれます。

- dashboard-settings: ダッシュボード設定を編集することができます。

- Grafana: Grafana プロキシーに関連するすべての機能が含まれます。

- hosts: Hosts メニューエントリーに関連するすべての機能が含まれます。

- iscsi: iSCSI 管理に関するすべての機能が含まれます。

- log: Ceph ログ管理に関するすべての機能が含まれます。

- manager: Ceph Manager 管理に関連するすべての機能が含まれます。

- monitor: Ceph monitor 管理に関連するすべての機能が含まれます。

- nfs-ganesha: NFS-Ganesha 管理に関連するすべての機能が含まれます。

- osd: OSD 管理に関連するすべての機能が含まれます。

- pool: プール管理に関連するすべての機能が含まれます。

- Prometheus: Prometheus アラート管理に関連するすべての機能が含まれます。

- rbd-image: RBD イメージ管理に関連するすべての機能が含まれます。

- rbd-mirroring: RBD ミラーリング管理に関連するすべての機能が含まれます。

- RGW: Ceph オブジェクトゲートウェイ (RGW) 管理に関連するすべての機能が含まれます。

ロールはセキュリティースコープとパーミッションのセット間のマッピングのセットを指定します。パーミッション には 4 つのタイプがあります。

- 読み取り

- Create

- Update

- Delete

システムロール のリストは以下のとおりです。

- administrator: すべてのセキュリティースコープの完全なパーミッションを許可します。

- block-manager: RBD-image、RBD-mirroring、および iSCSI スコープのフルパーミッションを許可します。

- cephfs-manager: Ceph ファイルシステムのスコープのフルパーミッションを許可します。

- cluster-manager: ホスト、OSD、モニター、マネージャー、および config-opt スコープのフルパーミッションを許可します。

- Ganesha-manager: NFS-Ganesha スコープのフルパーミッションを許可します。

- pool-manager: プールスコープのフルパーミッションを許可します。

- read-only: ダッシュボード設定および config-opt スコープ以外のすべてのセキュリティースコープの読み取りパーミッションを許可します。

- RGW-manager: Ceph オブジェクトゲートウェイスコープのフルパーミッションを許可します。

たとえば、すべての Ceph オブジェクトゲートウェイ操作についてユーザーに rgw-manager アクセスを提供する必要があります。

関連情報

- Ceph Dashboard でユーザーを作成するには、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard でのユーザーの作成 セクションを参照してください。

- Ceph Dashboard でロールを作成するには、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard でのロールの作成 セクションを参照してください。

3.2. Ceph Dashboard でのロールの作成

ダッシュボードでカスタムロールを作成し、ロールに基づいてこれらのロールをユーザーに割り当てることができます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Dashboard への管理者アクセスレベル。

手順

- ダッシュボードにログインします。

ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

- Roles タブで、Create をクリックします。

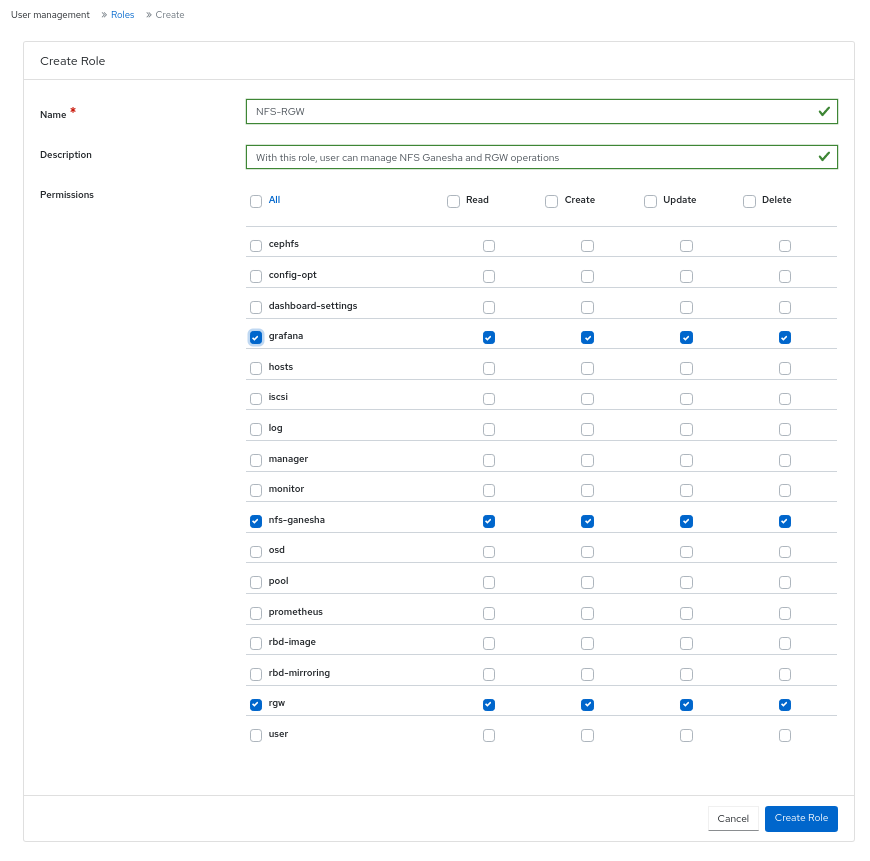

Create Role ウィンドウで、Name、Description を設定し、このロールの Permissions を選択して、Create Role ボタンをクリックします。

この例では、

Ganesha-managerロールとrgw-managerロールを付与すると、これらのロールに割り当てられたユーザーは、すべての NFS-GanesHA ゲートウェイおよび Ceph オブジェクトゲートウェイ操作を管理できます。- ロールが正常に作成されたという通知が表示されます。

- その行の Expand/Collapse アイコンをクリックして、ロールに付与された詳細と権限を表示します。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのユーザーロールおよびパーミッション のセクションを参照してください。

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのユーザーの作成 セクションを参照してください。

3.3. Ceph Dashboard でのロールの編集

ダッシュボードでは、ダッシュボードのロールを編集できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Dashboard への管理者アクセスレベル。

- ダッシュボードでロールが作成されます。

手順

- ダッシュボードにログインします。

ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

- Roles タブで、編集するロールをクリックします。

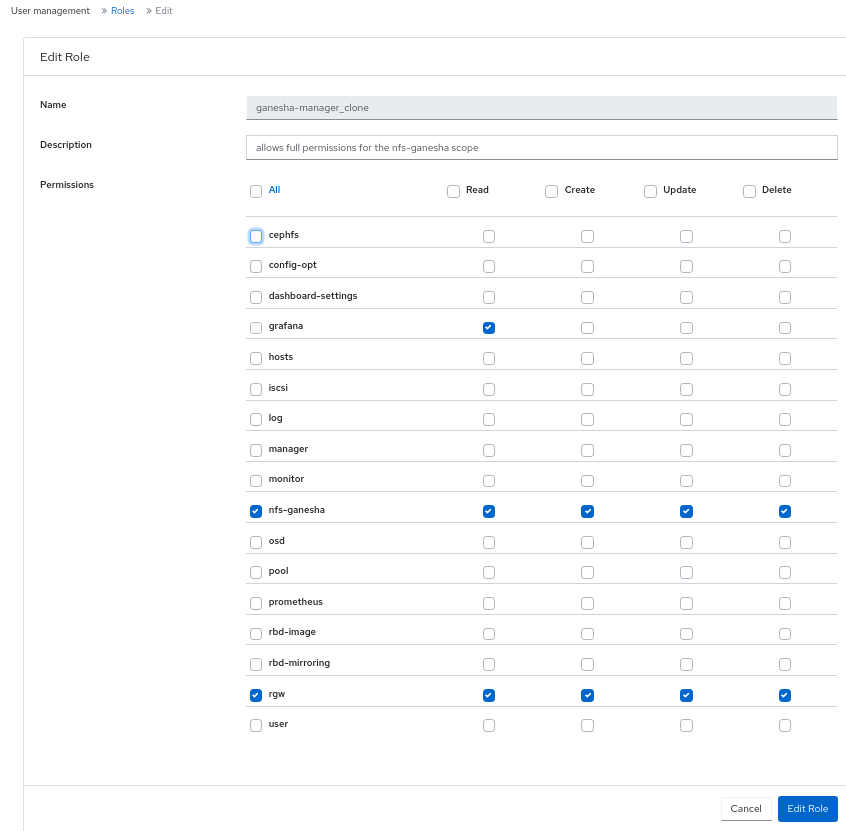

Edit Role ウィンドウで、パラメーターを編集し、Edit Role をクリックします。

- ロールが正常に更新されたという通知が表示されます。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのロールの作成 セクションを参照してください。

3.4. Ceph Dashboard でのロールのクローン作成

既存のロールに追加の権限を割り当てる場合は、システムロールのクローンを作成し、Red Hat Ceph Storage Dashbaord で編集できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ダッシュボードへの管理者アクセスレベル。

- ロールがダッシュボードに作成されている。

手順

- ダッシュボードにログインします。

ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

- Roles タブで、クローンを作成するロールをクリックします。

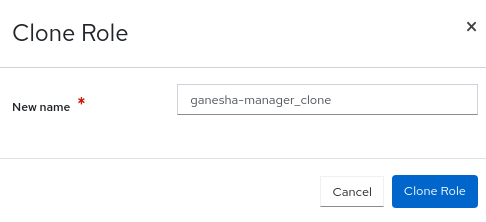

- Edit ドロップダウンメニューから Clone を選択します。

Clone Role ダイアログボックスで、ロールの詳細を入力し、Clone Role をクリックします。

- ロールを複製すると、要件に従って権限をカスタマイズできます。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのロールの作成 セクションを参照してください。

3.5. Ceph Dashboard でのロールの削除

Red Hat Ceph Storage Dashboard で作成したカスタムロールは削除できます。

Ceph Dashboard のシステムロールは削除できません。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Dashboard への管理者アクセスレベル。

- カスタムロールがダッシュボードで作成されている。

手順

- ダッシュボードにログインします。

ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

- Roles タブで、削除するロールをクリックします。

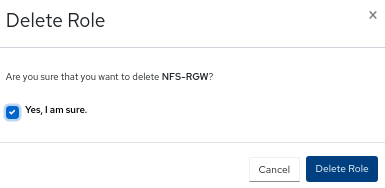

- Edit ドロップダウンメニューから Delete を選択します。

Delete Role ダイアログボックスで、Yes, I am sure ボックスをクリックし、Delete Role をクリックします。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのロールの作成 セクションを参照してください。

第4章 Ceph Dashboard でのユーザーの管理

ストレージ管理者は、Red Hat Ceph Storage Dashboard で特定のロールが割り当てられたユーザーを作成、編集、削除できます。ロールベースのアクセス制御は、各ユーザーのロールと要件に基づいて各ユーザーに付与されます。

本セクションでは、以下の管理タスクを説明します。

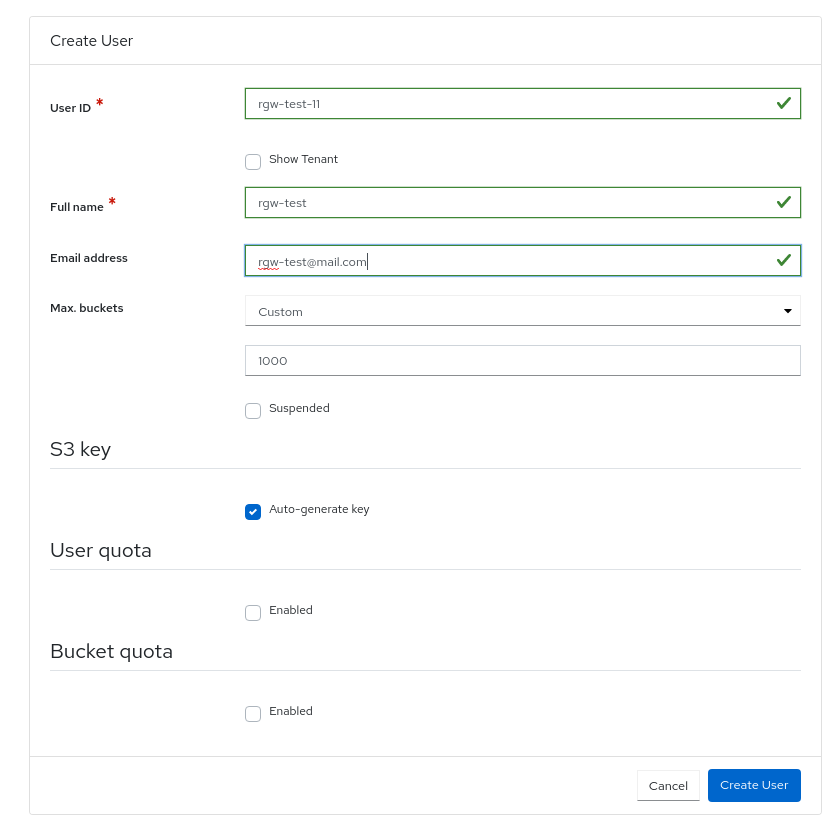

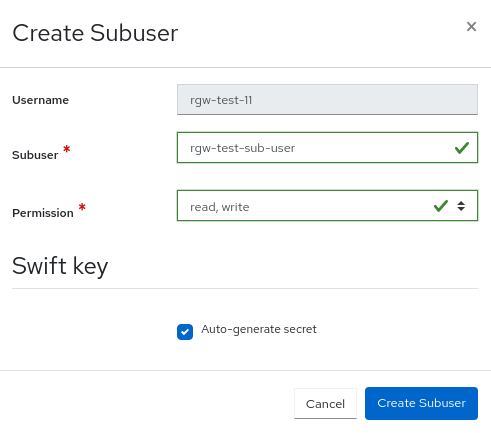

4.1. Ceph Dashboard でのユーザーの作成

Red Hat Ceph Storage Dashboard で、ロールに基づいて適切なロールと権限が割り当てられたユーザーを作成できます。たとえば、Ceph オブジェクトゲートウェイ操作を管理させる場合には、ユーザーに rgw-manager ロールを付与できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Dashboard への管理者アクセスレベル。

Red Hat Ceph Storage Dashboard は、ユーザーパスワードの変更時に電子メールの検証をサポートしません。Dashboard はシングルサインオン (SSO) をサポートし、この機能を SSO プロバイダーに委譲できるため、この動作は意図的です。

手順

- ダッシュボードにログインします。

ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

- Users タブで、Create をクリックします。

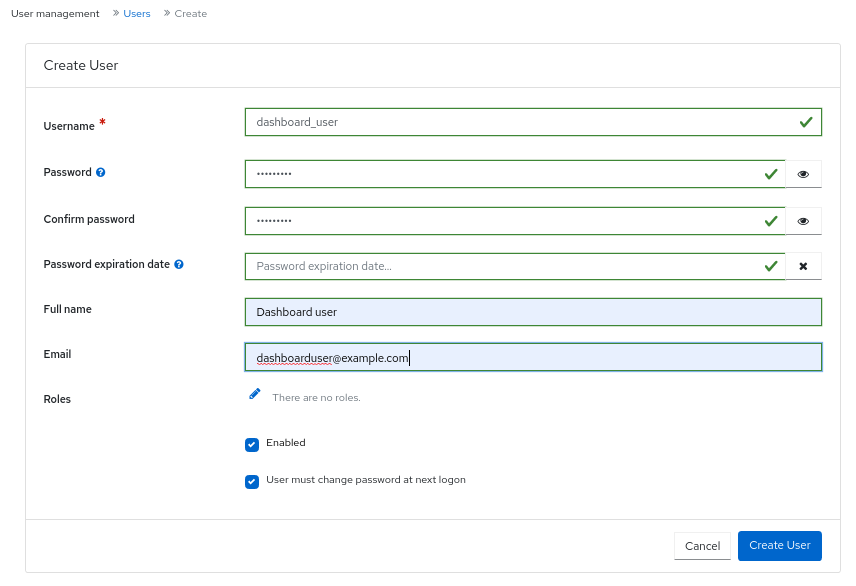

Create User ウィンドウで、Username とロールを含むその他のパラメーターを設定し、Create User をクリックします。

- ユーザーが正常に作成されたという通知が表示されます。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのロールの作成 セクションを参照してください。

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのユーザーロールおよびパーミッション のセクションを参照してください。

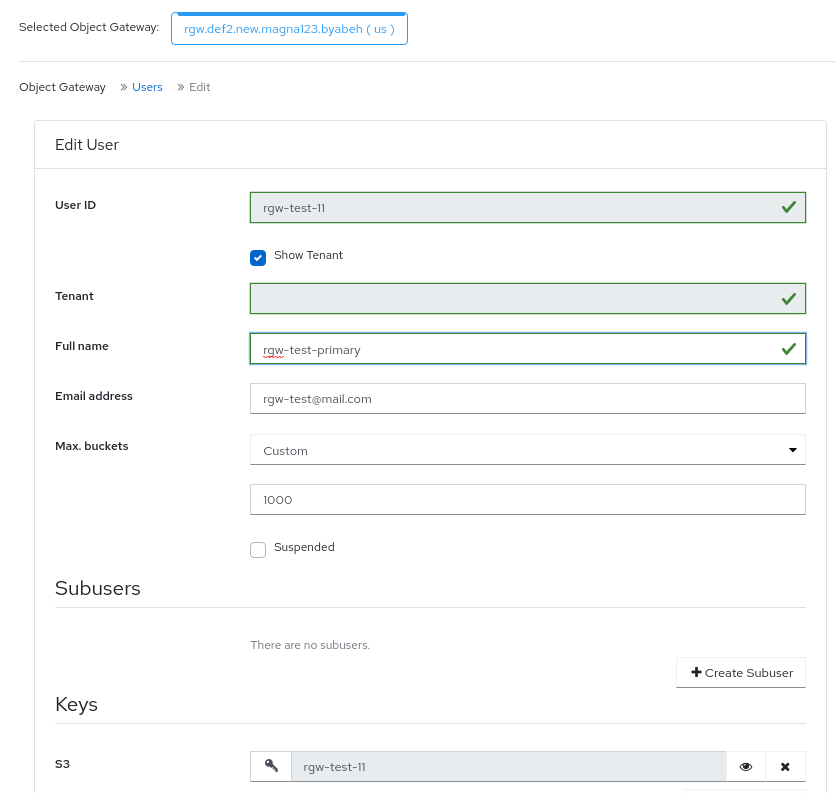

4.2. Ceph Dashboard でのユーザーの編集

Red Hat Ceph Storage Dashboard でユーザーを編集できます。要件に基づいて、ユーザーのパスワードとロールを変更できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Dashboard への管理者アクセスレベル。

- ダッシュボードで作成したユーザー。

手順

- ダッシュボードにログインします。

ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

- ユーザーを編集するには、行をクリックします。

- Users タブで、Edit ドロップダウンメニューから Edit を選択します。

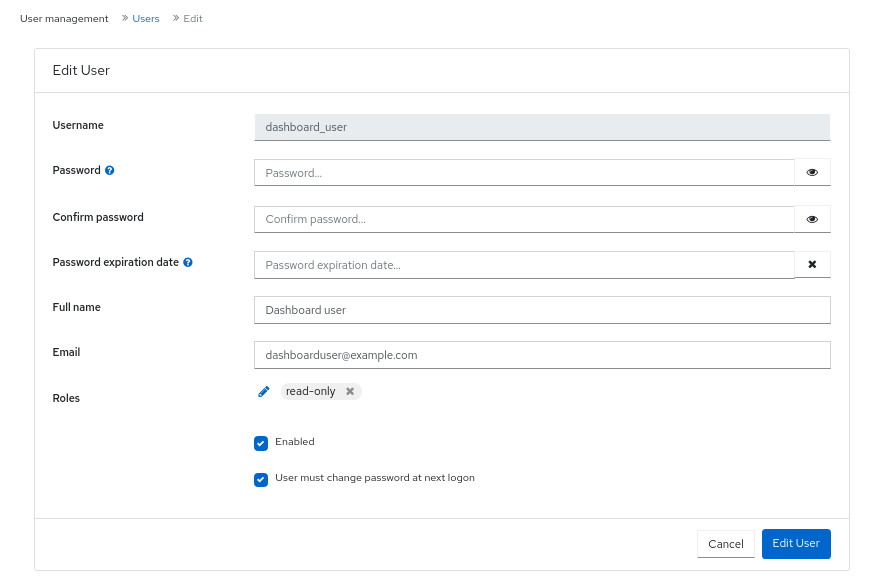

Edit User ウィンドウで、パスワードやロールなどのパラメーターを編集し、Edit User をクリックします。

注記

注記Ceph Dashboard へのユーザーのアクセスを無効にするには、Edit User ウィンドウで Enabled オプションの選択を解除します。

- ユーザーが正常に作成されたという通知が表示されます。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのユーザーの作成 セクションを参照してください。

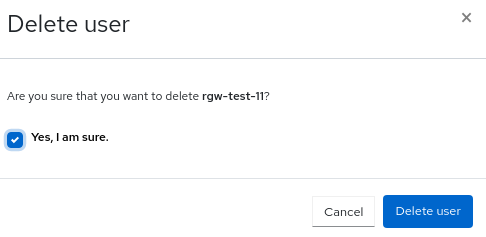

4.3. Ceph Dashboard でのユーザーの削除

Ceph Dashboard でユーザーを削除できます。一部のユーザーがシステムから削除される可能性があります。このようなユーザーへのアクセスは、Ceph Dashboard から削除できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Dashboard への管理者アクセスレベル。

- ダッシュボードで作成したユーザー。

手順

- ダッシュボードにログインします。

ダッシュボードの設定 アイコンをクリックし、User management をクリックします。

- Users タブで、削除するユーザーをクリックします。

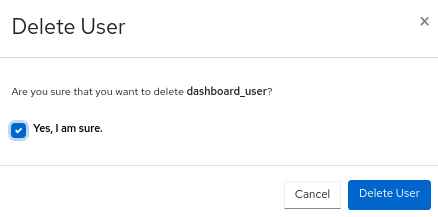

- Edit ドロップダウンメニューから Delete を選択します。

Delete User ダイアログボックスで、Yes, I am sure ボックスをクリックし、Delete User をクリックして設定を保存します。

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのユーザーの作成 セクションを参照してください。

第5章 Ceph デーモンの管理

ストレージ管理者は、Red Hat Ceph Storage Dashboard で Ceph デーモンを管理できます。

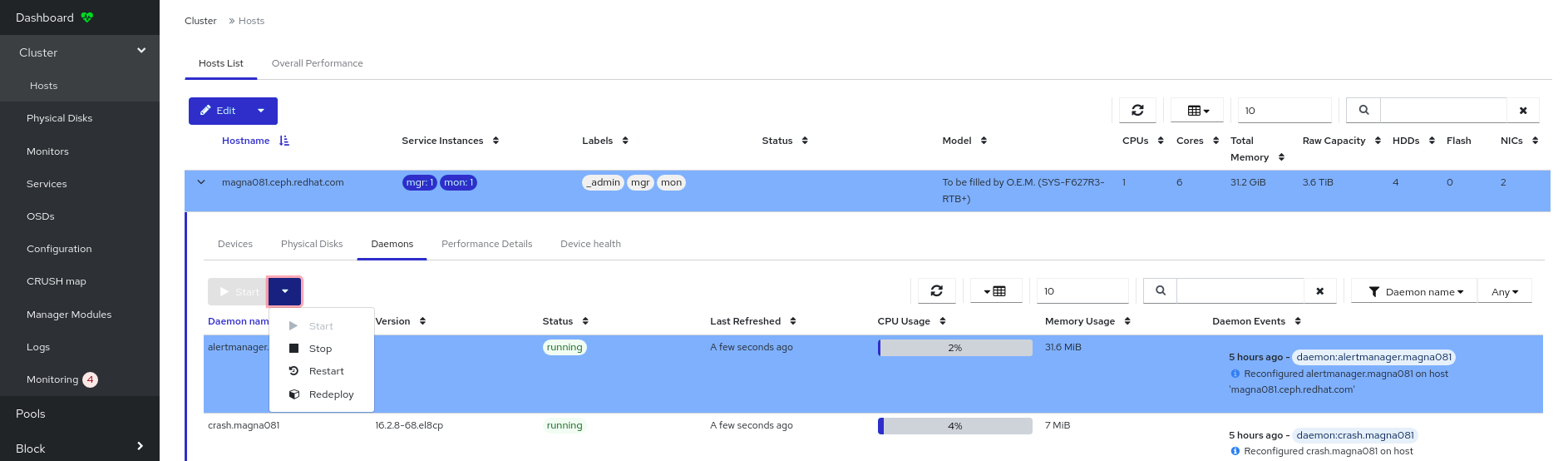

5.1. デーモンアクション

Red Hat Ceph Storage Dashboard を使用すると、デーモンを開始、停止、再起動、および再デプロイできます。

これらのアクションは、Monitor Daemon と Manager Daemon を除くすべてのデーモンでサポートされています。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ストレージクラスターに少なくとも 1 つのデーモンが設定されている。

手順

デーモンは 2 つの方法で管理できます。

サービスページから:

- ダッシュボードにログインします。

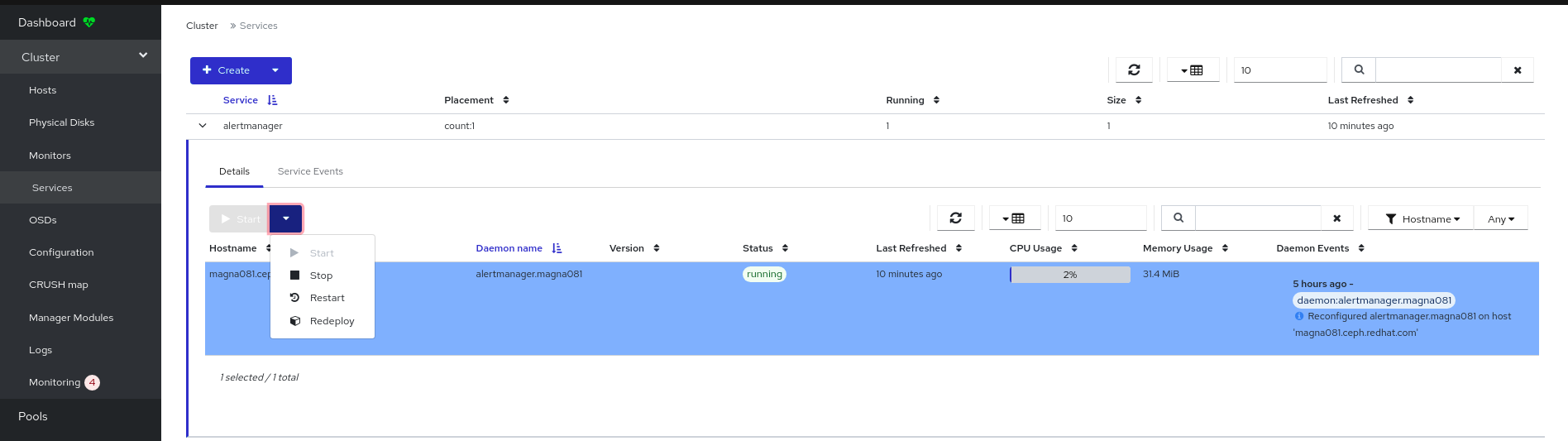

- Cluster ドロップダウンメニューから、Services を選択します。

- その行の Expand/Collapse アイコンをクリックして、アクションを実行するデーモンでサービスの詳細を表示します。

Details で、目的のデーモンの横にあるドロップダウンを選択して、開始、停止、再起動、または 再デプロイ を実行します。

図5.1 デーモンの管理

ホストページから:

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Hosts を選択します。

- Hosts List から、アクションを実行するデーモンを含むホストを選択します。

- ホストの Daemon タブで、デーモンをクリックします。

上部のドロップダウンを使用して、Start、Stop、Restart、または Redeploy を実行します。

図5.2 デーモンの管理

第6章 Ceph Dashboard でのクラスターの監視

ストレージ管理者は、Red Hat Ceph Storage Dashboard を使用して、ホストのタイプ、サービス、データアクセス方法などに基づいて、クラスターの特定の側面を監視できます。

本セクションでは、以下の管理タスクを説明します。

- ダッシュボードでの Ceph クラスターのホストの監視

- ダッシュボードでの Ceph クラスター設定の表示および編集

- ダッシュボードでの Ceph クラスターのマネージャーモジュールの表示および編集

- ダッシュボードでの Ceph クラスターのモニターの監視

- ダッシュボードでの Ceph クラスターのモニタリングサービス

- ダッシュボードでの Ceph OSD の監視

- ダッシュボードでの HAProxy の監視

- ダッシュボードでの Ceph クラスターの CRUSH マップの表示

- ダッシュボードでの Ceph クラスターログのフィルタリング

- ダッシュボードでの Ceph クラスターのプールの監視

- ダッシュボードでの Ceph ファイルシステムの監視

- ダッシュボードでの Ceph オブジェクトゲートウェイデーモンの監視

- Ceph Dashboard でのブロックデバイスイメージの監視

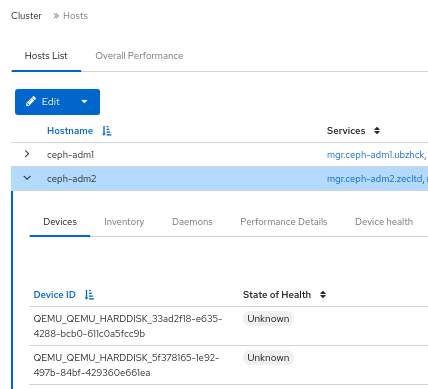

6.1. ダッシュボードでの Ceph クラスターのホストの監視

Red Hat Ceph Storage Dashboard でクラスターのホストを監視できます。

以下で、ホストページの各種タブを紹介します。

- デバイス - このタブには、デバイス ID、ヘルス状態、デバイス名、ホスト上のデーモンなどの詳細が表示されます。

- インベントリー: このタブには、選択したホストに接続されているすべてのディスクと、そのタイプ、サイズなどが表示されます。デバイスパス、デバイスのタイプ、可用性、ベンダー、モデル、サイズ、デプロイされた OSD などの詳細があります。

- デーモン - このタブには、選択したホストにデプロイされたすべてのサービス、実行中のコンテナー、および現在のステータスが表示されます。ホスト名、デーモンタイプ、デーモン ID、コンテナー ID、コンテナーイメージ名、コンテナーイメージ ID、バージョンステータス、最終更新時刻などの詳細があります。

- パフォーマンスの詳細 - このタブには、デプロイされた OSD、CPU 使用率、RAM 使用率、ネットワーク負荷、ネットワークドロップ率、OSD ディスクのパフォーマンス統計などの詳細が表示されます。

- デバイスのヘルス - スマート対応デバイスの場合には、OSD がデプロイされたホスト上でのみ個々のヘルスステータスと SMART データを取得できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ホストがストレージクラスターに追加されている。

- すべてのサービス、モニター、マネージャー、および OSD デーモンがストレージクラスターにデプロイされている。

手順

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Hosts を選択します。

- 特定のホストの詳細を表示するには、そのホストの行にある Expand/Collapse アイコンをクリックします。

各タブをクリックすると、デバイス、インベントリー、デーモン、パフォーマンスの詳細、デバイスのヘルス などの詳細を表示できます。

図6.1 Ceph クラスターのホストの監視

関連情報

- 詳細は、Red Hat Ceph Storage 管理ガイドの Ceph パフォーマンスカウンター を参照してください。

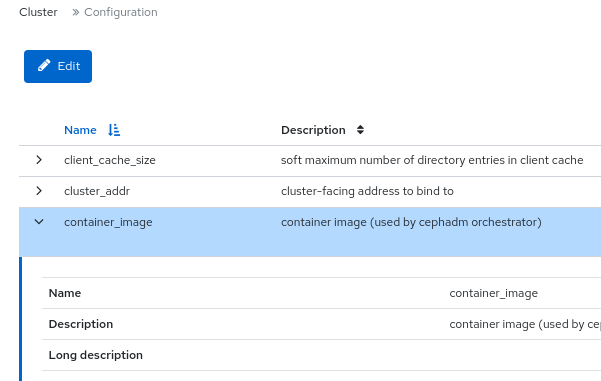

6.2. ダッシュボードでの Ceph クラスターの設定の表示と編集

ダッシュボードで Ceph クラスターのさまざまな設定オプションを表示できます。編集できるのは一部の設定オプションのみです。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- すべてのサービスがストレージクラスターにデプロイされている。

手順

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Configuration を選択します。

- オプション: 検索 ボックスを使用して設定を検索できます。

オプション: 次のフィルターを使用して、特定の設定をフィルタリングできます。

- レベル - Basic、advanced または dev

- サービス - Any、mon、mgr、osd、mds、common、mds_client、rgw などのフィルター。

- ソース - Any、mon などのフィルター

- 変更済み - Yes または No

設定の詳細を表示するには、その行の Expand/Collapse アイコンをクリックします。

図6.2 設定オプション

設定を編集するには、その行をクリックし、Edit をクリックします。

- 編集ダイアログウィンドウで、必要なパラメーターを編集し、Update をクリックします。

- 設定が正常に更新されたという通知が表示されます。

関連情報

- 詳細は、Red Hat Ceph Storage 設定ガイドの Ceph ネットワーク設定 の章を参照してください。

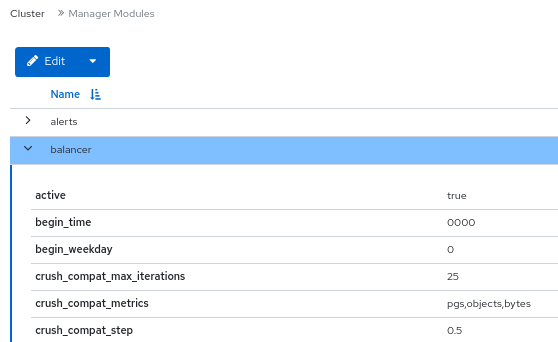

6.3. ダッシュボードでの Ceph クラスターのマネージャーモジュールの表示および編集

マネージャーモジュールは、モジュール固有の設定管理すに使用されます。たとえば、クラスターのヘルスに関するアラートを有効にできます。

Red Hat Ceph Storage Dashboard で、クラスターのマネージャーモジュールを表示、有効化、無効化、および編集できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

マネージャーモジュールの表示

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Manager Modules を選択します。

特定のマネージャーモジュールの詳細を表示するには、その行の Expand/Collapse アイコンをクリックします。

図6.3 マネージャーモジュール

マネージャーモジュールの有効化

- 行を選択します。

- Edit ドロップダウンメニューから、Enable を選択します。

マネージャーモジュールの無効化

- 行を選択します。

- Edit ドロップダウンメニューから、Disable を選択します。

マネージャーモジュールの編集

行を選択します。

注記すべてのモジュールに設定可能なパラメーターがあるわけではありません。モジュールが設定できない場合、Edit ボタンは無効になります。

- 必要なパラメーターを編集し、Update をクリックします。

- モジュールが正常に更新されたという通知が表示されます。

6.4. ダッシュボードでの Ceph クラスターのモニター監視

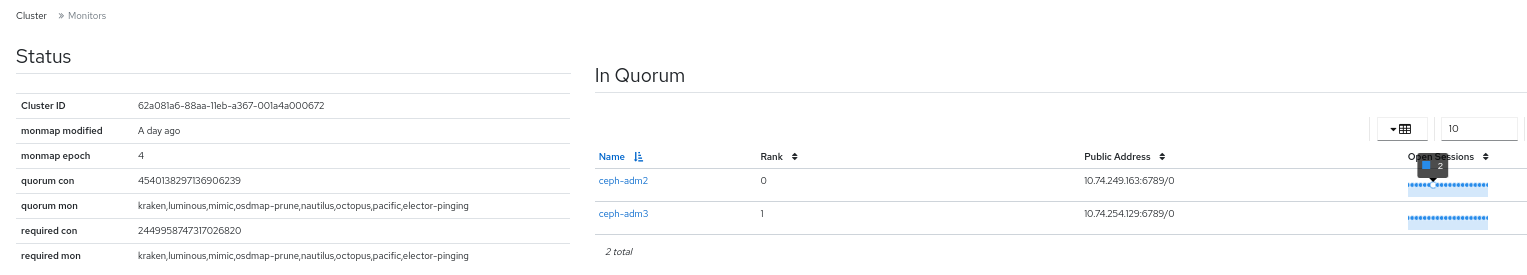

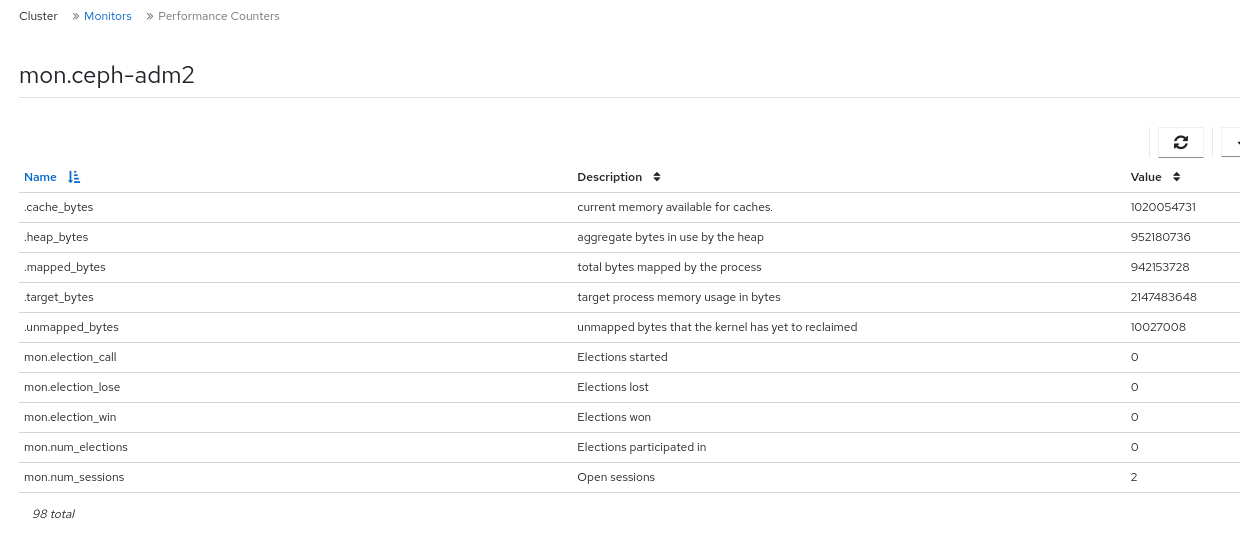

Ceph モニターのパフォーマンスを監視するには、Red Hat Ceph Storage ダッシュボードのランディングページで、モニターのステータス、クォーラム、オープンセッション数、パフォーマンスカウンターなどの詳細を Monitors タブに表示することもできます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- モニターはストレージクラスターにデプロイされます。

手順

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Monitors を選択します。

Monitors 概要ページには、全体的な監視ステータスに関する情報と、in Quorum および Not in quorum Monitor のテーブルが表示されます。

- 開いているセッションの数を確認するには、青い点線のトレイルにカーソルを合わせます。

任意のモニターのパフォーマンスカウンターを表示するには、そのホスト名をクリックします。

モニターのパフォーマンスカウンターを表示します。

関連情報

- Red Hat Ceph ストレージ操作ガイドの Ceph モニター のセクションを参照してください。

- 詳細は、Red Hat Ceph Storage 管理ガイドの Ceph パフォーマンスカウンター を参照してください。

6.5. ダッシュボードでの Ceph クラスターの監視サービス

Red Hat Ceph Storage Dashboard でクラスターのサービスを監視できます。ホスト名、デーモンタイプ、デーモン ID、コンテナー ID、コンテナーイメージ名、コンテナーイメージ ID、バージョンステータス、最終更新時刻の詳細を表示できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ホストがストレージクラスターに追加されている。

- すべてのサービスがストレージクラスターにデプロイされている。

手順

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Services を選択します。

特定のサービスの詳細を表示するには、そのホストの行にある Expand/Collapse アイコンをクリックします。

図6.4 Ceph クラスターの監視サービス

関連情報

- 詳細は、Red Hat Ceph Storage 操作ガイド の Ceph オーケストレーター を参照してください。

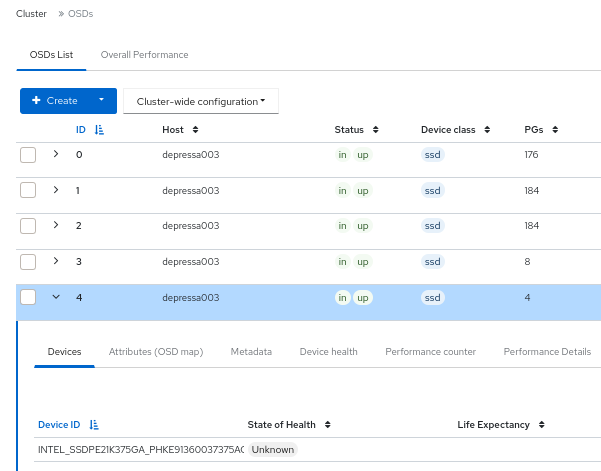

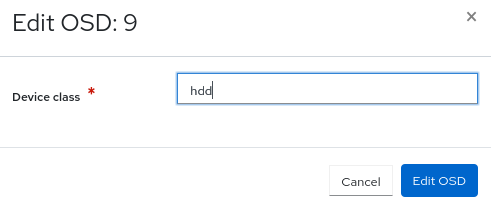

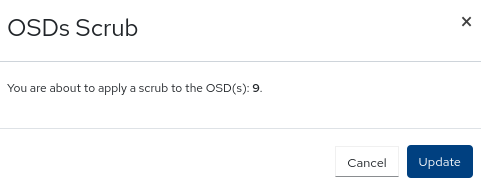

6.6. ダッシュボードでの Ceph OSD の監視

Red Hat Ceph Storage Dashboard のランディングページで、Ceph OSD のステータスを監視できます。OSD タブでは、ホスト、ステータス、デバイスクラス、プレイスメントグループ (PG) の数、サイズフラグ、使用状況、読み取りまたは書き込み操作時間などの詳細を表示することもできます。

OSD ページのさまざまなタブを次に示します。

- デバイス - このタブには、デバイス ID、ヘルス状態、有効期限、デバイス名、ホストのデーモンなどの詳細が表示されます。

- 属性 (OSD マップ) - このタブには、クラスターアドレス、ハートビートの詳細、OSD の状態、およびその他の OSD 属性が表示されます。

- メタデータ - このタブには、OSD オブジェクトストア、デバイス、オペレーティングシステム、およびカーネルの詳細が表示されます。

- デバイスのヘルス - スマート対応デバイスの場合には、個々のヘルスステータスと SMART データを取得できます。

- パフォーマンスカウンター - このタブには、デバイスに書き込まれたバイトの詳細が表示されます。

- パフォーマンスの詳細 - このタブには、デプロイされた OSD、CPU 使用率、RAM 使用率、ネットワーク負荷、ネットワークドロップ率、OSD ディスクのパフォーマンス統計などの詳細が表示されます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ホストがストレージクラスターに追加されている。

- OSD を含むすべてのサービスがストレージクラスターにデプロイされている。

手順

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、OSD を選択します。

特定の OSD の詳細を表示するには、そのホストの行にある Expand/Collapse アイコンをクリックします。

図6.5 Ceph クラスターの OSD のモニタリング

各タブをクリックすると、デバイス、属性 (OSD マップ)、メタデータ、デバイスヘルス、パフォーマンスカウンター、パフォーマンスの詳細 などの情報を表示できます。

関連情報

- 詳細は、Red Hat Ceph Storage 操作ガイド の Ceph オーケストレーター を参照してください。

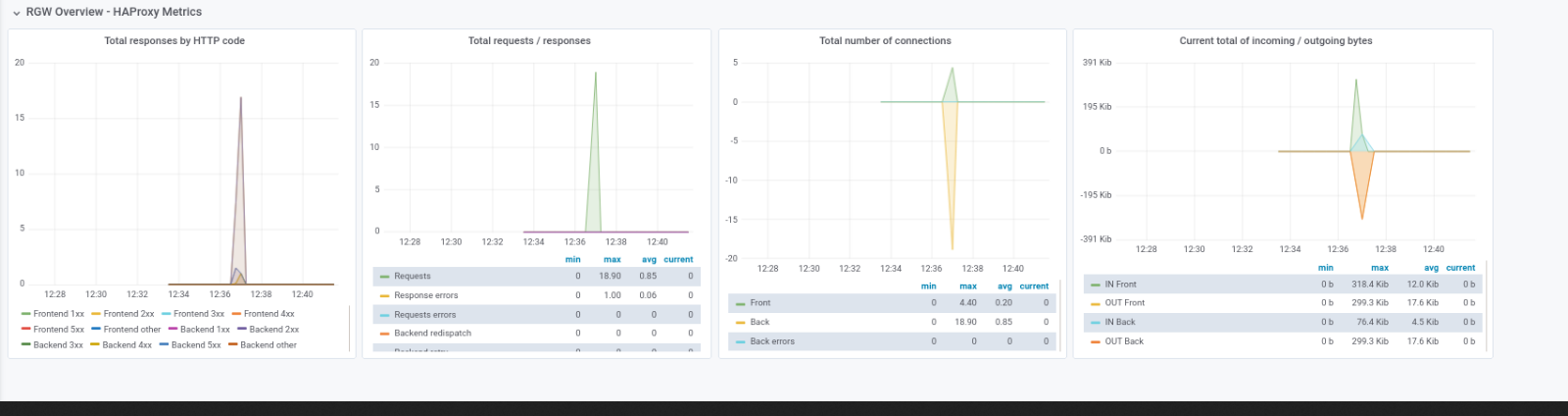

6.7. ダッシュボードでの HAProxy の監視

Ceph Object Gateway を使用すると、オブジェクトゲートウェイの多くのインスタンスを 1 つのゾーンに割り当てできるため、負荷の増加に合わせてスケールアウトすることができます。各オブジェクトゲートウェイインスタンスは独自の IP アドレスを持つため、HAProxy を使用して Ceph Object Gateway サーバー全体で負荷を分散できます。

ダッシュボードで次の HAProxy メトリックを監視できます。

- HTTP コードごとの合計応答数。

- 要求/応答の合計数。

- 接続の合計数。

- 着信/発信バイトの現在の合計数。

ceph dashboard get-grafana-api-url コマンドを実行して、Grafana の詳細を取得することもできます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- ストレージダッシュボードでの管理者レベルのアクセスがある。

- SSL を使用しない既存の Ceph Object Gateway サービスがある。SSL サービスが必要な場合は、Ceph Object Gateway サービスではなく、Ingress サービスで証明書を設定する必要があります。

- Ceph Orchestrator を使用してデプロイされた Ingress サービスがある。

- モニタリングスタックコンポーネントがダッシュボード上に作成されている。

手順

Grafana URL にログインし、RGW_Overview パネルを選択します。

構文

https://DASHBOARD_URL:3000例:

https://dashboard_url:3000

- Grafana URL で HAProxy メトリックを確認します。

Ceph Dashboard を起動し、認証情報でログインします。

例:

https://dashboard_url:8443

- Cluster ドロップダウンメニューから、Object Gateway を選択します。

- Daemons を選択します。

- Overall Performance タブを選択します。

検証

Ceph Object Gateway HAProxy メトリックを確認します。

図6.6 HAProxy メトリック

関連情報

- 詳細は、Red Hat Ceph Storage Object Gateway Guide の Configuring high availability for the Ceph Object Gateway を参照してください。

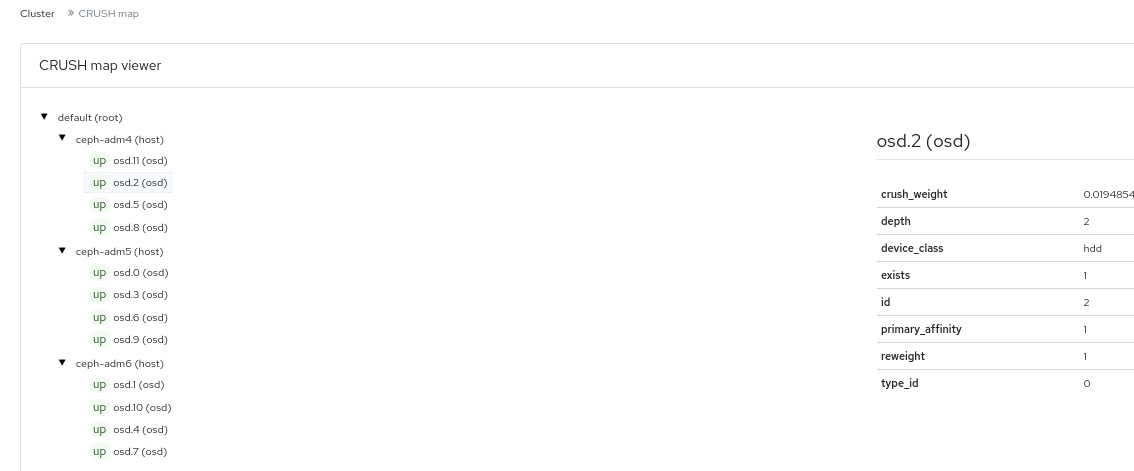

6.8. ダッシュボードでの Ceph クラスターの CRUSH マップの表示

Red Hat Ceph Storage Dashbaoard で、OSD のリストおよび関連情報を含む CRUSH マップを表示できます。CRUSH マップおよび CRUSH アルゴリズムが一緒になって、データの保存方法と場所を決めます。このダッシュボードでは、OSD ホスト、OSD デーモン、ID 番号、デバイスクラスなど、CRUSH マップのさまざまな側面を確認することができます。

CRUSH マップを使用すると、特定の OSD ID が実行しているホストを決定できます。これは、OSD に問題がある場合に便利です。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- OSD デーモンがストレージクラスターにデプロイされている。

手順

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、CRUSH Map を選択します。

特定の OSD の詳細を表示するには、その行をクリックします。

図6.7 CRUSH Map の詳細ビュー

関連情報

- CRUSH マップの詳細は、Red Hat Ceph Storage Storage 戦略ガイドの クラッシュ管理 を参照してください。

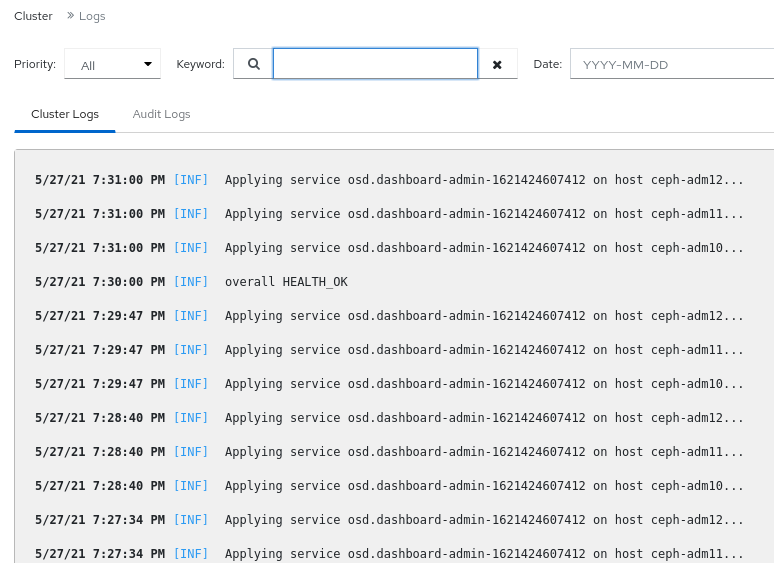

6.9. ダッシュボードでの Ceph クラスターのログのフィルタリング

いくつかの条件をもとに、ダッシュボードで Red Hat Ceph Storage クラスターのログを表示およびフィルタリングできます。条件には、優先度、キーワード、日付、および 時間範囲 が含まれます。

ログをシステムにダウンロードするか、ログをクリップボードにコピーして、さらに分析することができます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Ceph Monitor が最後に起動されてからログエントリーが生成されている。

Dashboard ロギング機能は最新の高レベルイベントのみを表示します。イベントは Ceph Monitor によってメモリーに格納されます。Monitor を再起動すると、エントリーが消えます。詳細なログまたは古いログを確認する必要がある場合は、ファイルベースのログを参照してください。

手順

- ダッシュボードにログインします。

Cluster ドロップダウンメニューから、Logs を選択します。

図6.8 クラスターログ

-

優先度で絞り込むには、

Priorityドロップダウンメニューをクリックし、Debug、Info、Warning、Error または All のいずれかを選択します。 -

キーワードで絞り込むには、

Keywordフィールドにテキストを入力します。 -

日付で絞り込むには、

Dateフィールドをクリックし、メニューから日付を選択するか、YYYY-MM-DD の形式で日付を入力します。 -

時間で絞り込むには、HH:MM - HH:MM 形式を使用して

Time rangeフィールドに範囲を入力します。時間は、数字0から23に入力する必要があります。 - フィルターを組み合わせるには、2 つ以上のフィルターを設定します。

-

優先度で絞り込むには、

- Download アイコンまたは Copy to Clipboard アイコンをクリックして、ログをダウンロードします。

関連情報

- 詳細については、Red Hat Ceph Storage トラブルシューティングガイドの ロギングの設定 の章を参照してください。

- 詳細については、Red Hat Ceph Storage トラブルシューティングガイドの Ceph ログについて のセクションを参照してください。

6.10. ダッシュボードでの Ceph クラスターのプールの監視

Red Hat Ceph Storage Dashboard では、クラスター内のプールの詳細、パフォーマンスの詳細、設定、および全体的なパフォーマンスを表示できます。

プールは、Ceph Storage クラスターがデータを分散し、格納する方法において重要なロールを果たします。プールを作成せずにクラスターをデプロイした場合に、Ceph はデフォルトのプールを使用してデータを格納します。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- プールが作成されている。

手順

- ダッシュボードにログインします。

- ナビゲーションバーで、Pools を選択します。

- データ保護の詳細と、プールが有効化されているアプリケーションが含まれるプールリストを表示します。必要な詳細を表示するには、Usage、Read bytes および Write bytes にマウスをかざします。

プールに関する詳細情報を表示するには、その行にある Expand/Collapse アイコンをクリックします。

図6.9 プールの監視

関連情報

- プールの詳細については、Red Hat Ceph Storage アーキテクチャーガイドの Ceph プール を参照してください。

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのプールの作成 セクションを参照してください。

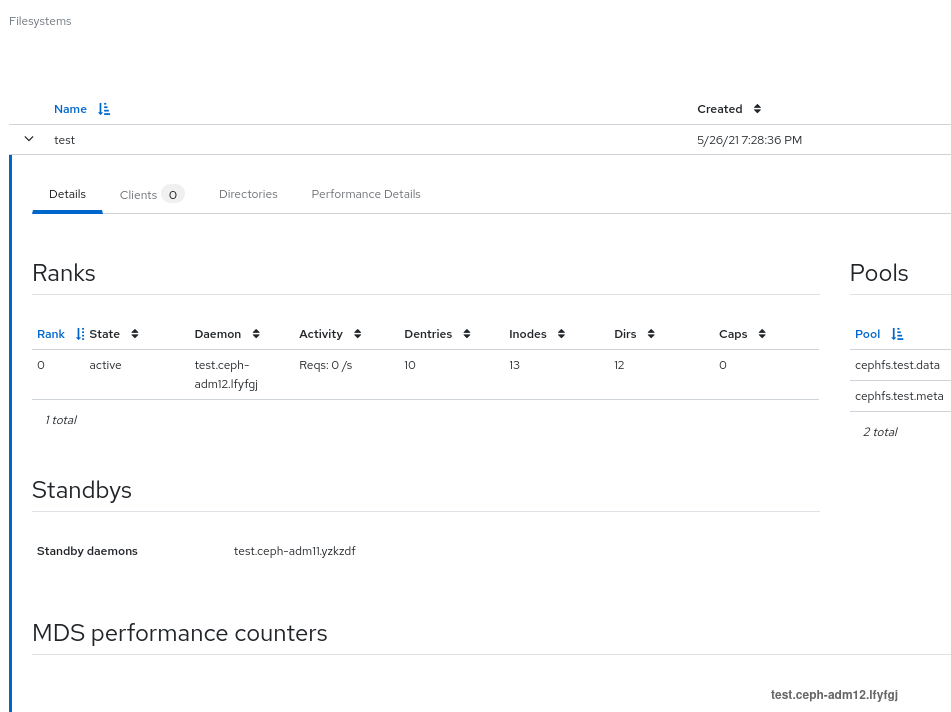

6.11. ダッシュボードでの Ceph ファイルシステムの監視

Red Hat Ceph Storage Dashboard を使用して Ceph File Systems (CephFS) および関連するコンポーネントを監視することができます。ファイルシステム には、次の 4 つの主要なタブがあります。

- Details: メタデータサーバー (MDS) とそのランクに加えて、スタンバイデーモン、プール、その使用状況、パフォーマンスカウンターを表示します。

- Clients: ファイルシステムをマウントしたクライアントのリストを表示します。

- ディレクトリー - ディレクトリーのリストを表示します。

- パフォーマンス: ファイルシステムのパフォーマンスを表示します。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- MDS サービスが少なくとも 1 つのホストにデプロイされている。

- Ceph File System がインストールされている。

手順

- ダッシュボードにログインします。

- ナビゲーションバーで、Filesystems をクリックします。

ファイルシステムに関する詳細情報を表示するには、その行にある Expand/Collapse アイコンをクリックします。

図6.10 Ceph ファイルシステムの監視

関連情報

- 詳細は、ファイルシステムガイド を参照してください。

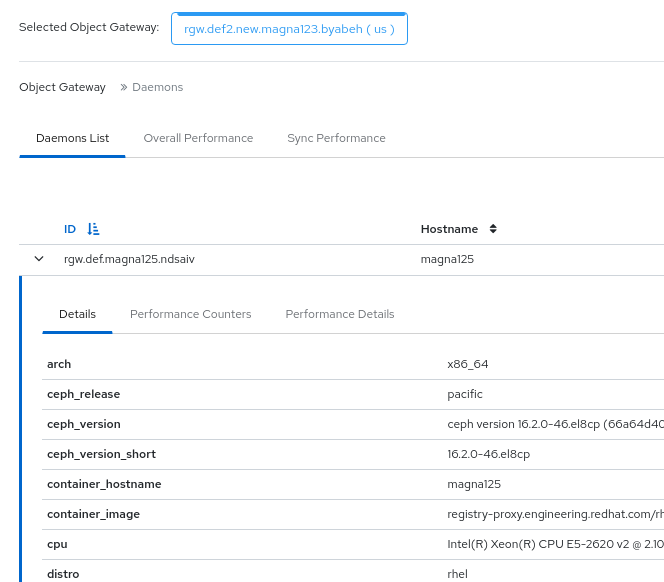

6.12. ダッシュボードでの Ceph オブジェクトゲートウェイデーモンの監視

Red Hat Ceph Storage Dashboard を使用して、Ceph オブジェクトゲートウェイデーモンを監視できます。Ceph オブジェクトゲートウェイデーモンの詳細、パフォーマンスカウンター、およびパフォーマンスの詳細を表示できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ストレージクラスターに少なくとも 1 つの Ceph オブジェクトゲートウェイデーモンが設定されている。

手順

- ダッシュボードにログインします。

- ナビゲーションバーで、Object Gateway をクリックします。

Ceph オブジェクトゲートウェイデーモンの詳細を表示するには、その行の Expand/Collapse アイコンをクリックします。

図6.11 Ceph オブジェクトゲートウェイデーモンの監視

Ceph Object Gateway デーモンを複数設定している場合は、Sync Performance タブをクリックして、マルチサイトのパフォーマンスカウンターを表示します。

関連情報

- 詳細は、Red Hat Ceph Storage の Ceph オブジェクトゲートウェイガイド を参照してください。

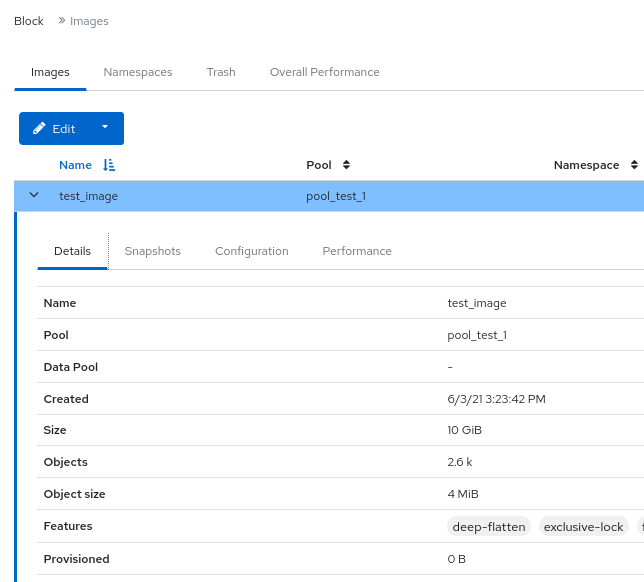

6.13. Ceph Dashboard でブロックデバイスイメージを監視します。

Red Hat Ceph ストレージダッシュボードを使用して、ブロックデバイスイメージを監視および管理できます。イメージの詳細、スナップショット、設定の詳細、およびパフォーマンスの詳細を表示できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- rbd アプリケーションが有効になっているプールが作成されている。

- イメージが作成されている。

手順

- ダッシュボードにログインします。

- ナビゲーションバーで Block をクリックします。

イメージの詳細を表示するには、その行にある Expand/Collapse アイコンをクリックします。

図6.12 ブロックデバイスイメージの監視

関連情報

- 詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard でのイメージの作成 セクションを参照してください。

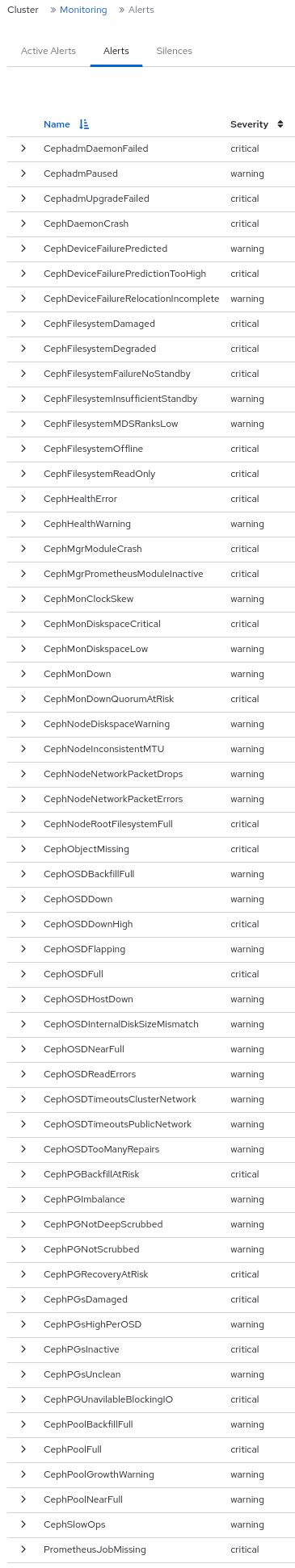

第7章 Ceph Dashboard でのアラートの管理

ストレージ管理者は、Red Hat Ceph Storage Dashbaoard でアラートの詳細を表示し、アラートのサイレンスを作成できます。これには、次の事前定義されたアラートが含まれます。

- CephadmDaemonFailed

- CephadmPaused

- CephadmUpgradeFailed

- CephDaemonCrash

- CephDeviceFailurePredicted

- CephDeviceFailurePredictionTooHigh

- CephDeviceFailureRelocationIncomplete

- CephFilesystemDamaged

- CephFilesystemDegraded

- CephFilesystemFailureNoStandby

- CephFilesystemInsufficientStandby

- CephFilesystemMDSRanksLow

- CephFilesystemOffline

- CephFilesystemReadOnly

- CephHealthError

- CephHealthWarning

- CephMgrModuleCrash

- CephMgrPrometheusModuleInactive

- CephMonClockSkew

- CephMonDiskspaceCritical

- CephMonDiskspaceLow

- CephMonDown

- CephMonDownQuorumAtRisk

- CephNodeDiskspaceWarning

- CephNodeInconsistentMTU

- CephNodeNetworkPacketDrops

- CephNodeNetworkPacketErrors

- CephNodeRootFilesystemFull

- CephObjectMissing

- CephOSDBackfillFull

- CephOSDDown

- CephOSDDownHigh

- CephOSDFlapping

- CephOSDFull

- CephOSDHostDown

- CephOSDInternalDiskSizeMismatch

- CephOSDNearFull

- CephOSDReadErrors

- CephOSDTimeoutsClusterNetwork

- CephOSDTimeoutsPublicNetwork

- CephOSDTooManyRepairs

- CephPGBackfillAtRisk

- CephPGImbalance

- CephPGNotDeepScrubbed

- CephPGNotScrubbed

- CephPGRecoveryAtRisk

- CephPGsDamaged

- CephPGsHighPerOSD

- CephPGsInactive

- CephPGsUnclean

- CephPGUnavilableBlockingIO

- CephPoolBackfillFull

- CephPoolFull

- CephPoolGrowthWarning

- CephPoolNearFull

- CephSlowOps

- PrometheusJobMissing

図7.1 事前定義されたアラート

簡易ネットワーク管理プロトコル (SNMP) トラップを使用してアラートを監視することもできます。Red Hat Ceph Storage 操作ガイドの SNMP トラップの設定 の章を参照してください。

7.1. 監視スタックの有効化

コマンドラインインターフェイスを使用して、Prometheus、Alertmanager、Grafana などの Red Hat Ceph Storage クラスターのモニタリングスタックを手動で有効にできます。

Prometheus および Alertmanager API を使用して、アラートと無音を管理できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- すべてのホストへの root レベルのアクセス。

手順

cephadmシェルにログインします。例:

[root@host01 ~]# cephadm shell

監視スタックの API を設定します。

Alertmanager サーバーのホストとポートを指定します。

構文

ceph dashboard set-alertmanager-api-host 'ALERTMANAGER_API_HOST:PORT'

例:

[ceph: root@host01 /]# ceph dashboard set-alertmanager-api-host 'http://10.0.0.101:9093' Option ALERTMANAGER_API_HOST updated

設定されたアラートを表示するには、Prometheus API への URL を設定します。この API を使用して、Ceph Dashboard UI は、新しい無音が対応するアラートと一致することを確認します。

構文

ceph dashboard set-prometheus-api-host 'PROMETHEUS_API_HOST:PORT'

例:

[ceph: root@host01 /]# ceph dashboard set-prometheus-api-host 'http://10.0.0.101:9095' Option PROMETHEUS_API_HOST updated

ホストを設定した後、ブラウザーのダッシュボードウィンドウを更新します。

Grafana サーバーのホストとポートを指定します。

構文

ceph dashboard set-grafana-api-url 'GRAFANA_API_URL:PORT'

例:

[ceph: root@host01 /]# ceph dashboard set-grafana-api-url 'http://10.0.0.101:3000' Option GRAFANA_API_URL updated

Prometheus、Alertmanager、および Grafana API ホストの詳細を取得します。

例:

[ceph: root@host01 /]# ceph dashboard get-alertmanager-api-host http://10.0.0.101:9093 [ceph: root@host01 /]# ceph dashboard get-prometheus-api-host http://10.0.0.101:9095 [ceph: root@host01 /]# ceph dashboard get-grafana-api-url http://10.0.0.101:3000

オプション: Prometheus、Alertmanager、または Grafana のセットアップで自己署名証明書を使用している場合は、ダッシュボードで証明書の検証を無効にします。これにより、不明な認証局 (CA) によって署名された証明書や、ホスト名と一致しない証明書が原因となる接続拒否を回避することができます。

Prometheus の場合:

例:

[ceph: root@host01 /]# ceph dashboard set-prometheus-api-ssl-verify False

Alertmanager の場合:

例:

[ceph: root@host01 /]# ceph dashboard set-alertmanager-api-ssl-verify False

Grafana の場合:

例:

[ceph: root@host01 /]# ceph dashboard set-grafana-api-ssl-verify False

Prometheus、Alertmanager、および Grafana の自己署名証明書検証設定の詳細を取得します。

例:

[ceph: root@host01 /]# ceph dashboard get-prometheus-api-ssl-verify [ceph: root@host01 /]# ceph dashboard get-alertmanager-api-ssl-verify [ceph: root@host01 /]# ceph dashboard get-grafana-api-ssl-verify

オプション: ダッシュボードに変更が反映されていない場合は、ダッシュボードを無効にしてから有効にする必要があります。

例:

[ceph: root@host01 /]# ceph mgr module disable dashboard [ceph: root@host01 /]# ceph mgr module enable dashboard

関連情報

- Red Hat Ceph Storage インストールガイド の ブートストラップコマンドオプション セクションを参照してください。

- Red Hat Ceph Storage インストールガイドの Red Hat Ceph Storage インストール の章を参照してください。

- Red Hat Ceph Storage Operations Guide の Deploying the monitoring stack using the Ceph Orchestrator セクションを参照してください。

7.2. Grafana 証明書の設定

cephadm は、ceph キー/値ストアで定義された証明書を使用して Grafana をデプロイします。証明書が指定されていない場合、cephadm は Grafana サービスのデプロイメント中に自己署名証明書を生成します。

ceph config-key set コマンドを使用してカスタム証明書を設定できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

手順

cephadmシェルにログインします。例:

[root@host01 ~]# cephadm shell

Grafana のカスタム証明書を設定します。

例:

[ceph: root@host01 /]# ceph config-key set mgr/cephadm/grafana_key -i $PWD/key.pem [ceph: root@host01 /]# ceph config-key set mgr/cephadm/grafana_crt -i $PWD/certificate.pem

Grafana がすでにデプロイされている場合は、

reconfigを実行して設定を更新します。例:

[ceph: root@host01 /]# ceph orch reconfig grafana

新しい証明書を追加するたびに、次の手順に従います。

新しいディレクトリーを作成する

例:

[root@host01 ~]# mkdir /root/internalca [root@host01 ~]# cd /root/internalca

キーを生成します。

例:

[root@host01 internalca]# openssl ecparam -genkey -name secp384r1 -out $(date +%F).key

キーを表示します。

例:

[root@host01 internalca]# openssl ec -text -in $(date +%F).key | less

リクエストを行う:

例:

[root@host01 internalca]# umask 077; openssl req -config openssl-san.cnf -new -sha256 -key $(date +%F).key -out $(date +%F).csr

署名のために送信する前にリクエストを確認してください。

例:

[root@host01 internalca]# openssl req -text -in $(date +%F).csr | less

CA サインとして:

例:

[root@host01 internalca]# openssl ca -extensions v3_req -in $(date +%F).csr -out $(date +%F).crt -extfile openssl-san.cnf

署名された証明書を確認します。

例:

[root@host01 internalca]# openssl x509 -text -in $(date +%F).crt -noout | less

関連情報

- 詳細は、共有システム証明書の使用 を参照してください。

7.3. Alertmanager Webhook の追加

新しい Webhook を既存の Alertmanager 設定に追加して、ストレージクラスターの正常性に関するリアルタイムのアラートを受け取ることができます。サードパーティーアプリケーションへの非同期メッセージを許可するには、着信 Webhook を有効にする必要があります。

たとえば、Red Hat Ceph Storage クラスターで OSD がダウンしている場合、Alertmanager を設定して Google チャットで通知を送信できます。

前提条件

- モニタリングスタックコンポーネントが有効になっている実行中の Red Hat Ceph Storage クラスター。

- 受信側のサードパーティーアプリケーションで設定された着信 Webhook。

手順

cephadmシェルにログインします。例:

[root@host01 ~]# cephadm shell

Alertmanager が通知のために Webhook を使用するように設定します。

構文

service_type: alertmanager spec: user_data: default_webhook_urls: - "_URLS_"default_webhook_urlsは、デフォルトの受信者のwebhook_configs設定に追加される追加の URL のリストです。例:

service_type: alertmanager spec: user_data: webhook_configs: - url: 'http:127.0.0.10:8080'Alertmanager 設定を更新します。

例:

[ceph: root@host01 /]# ceph orch reconfig alertmanager

検証

Alertmanager から Gchat への通知の例:

例:

using: https://chat.googleapis.com/v1/spaces/(xx- space identifyer -xx)/messages posting: {'status': 'resolved', 'labels': {'alertname': 'PrometheusTargetMissing', 'instance': 'postgres-exporter.host03.chest response: 200 response: { "name": "spaces/(xx- space identifyer -xx)/messages/3PYDBOsIofE.3PYDBOsIofE", "sender": { "name": "users/114022495153014004089", "displayName": "monitoring", "avatarUrl": "", "email": "", "domainId": "", "type": "BOT", "isAnonymous": false, "caaEnabled": false }, "text": "Prometheus target missing (instance postgres-exporter.cluster.local:9187)\n\nA Prometheus target has disappeared. An e "cards": [], "annotations": [], "thread": { "name": "spaces/(xx- space identifyer -xx)/threads/3PYDBOsIofE" }, "space": { "name": "spaces/(xx- space identifyer -xx)", "type": "ROOM", "singleUserBotDm": false, "threaded": false, "displayName": "_privmon", "legacyGroupChat": false }, "fallbackText": "", "argumentText": "Prometheus target missing (instance postgres-exporter.cluster.local:9187)\n\nA Prometheus target has disappea "attachment": [], "createTime": "2022-06-06T06:17:33.805375Z", "lastUpdateTime": "2022-06-06T06:17:33.805375Z"

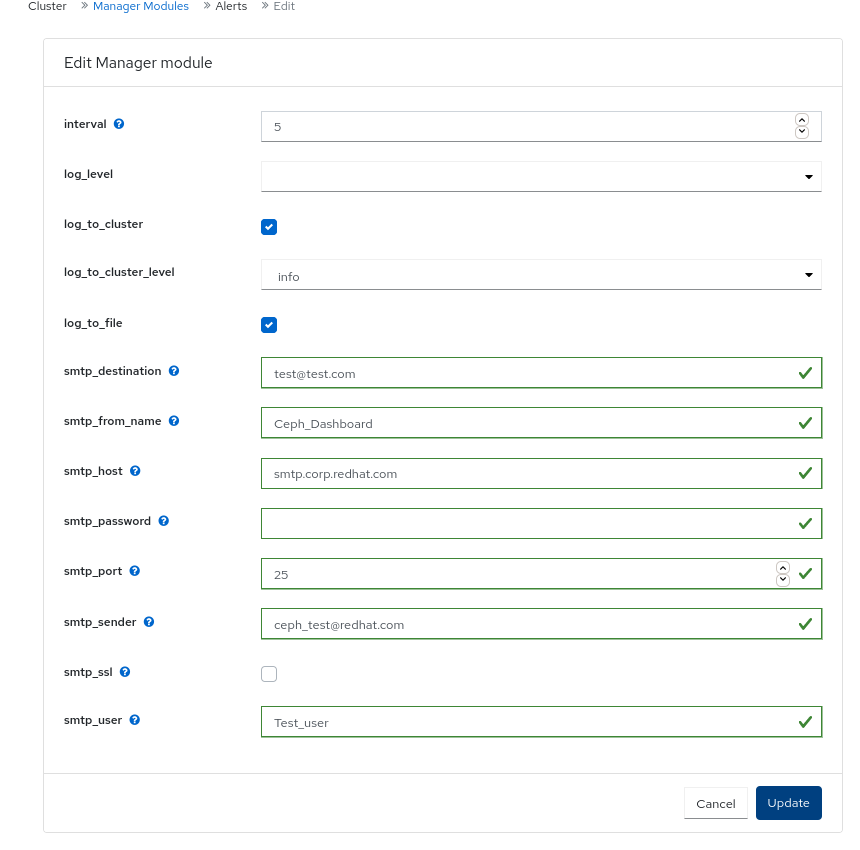

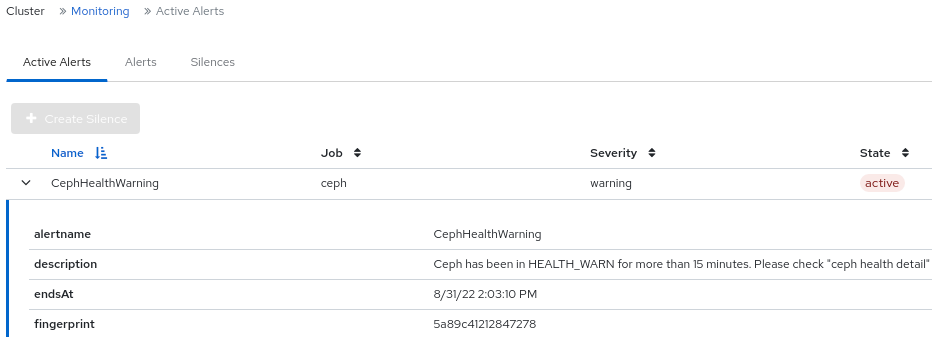

7.4. Ceph Dashboard でのアラートの表示

アラートが起動したら、Red Hat Ceph Storage Dashboard でアラートを表示できます。マネージャーモジュール の設定を編集して、アラートが発行されたときにメールをトリガーできます。

SSL は、Red Hat Ceph Storage 5 クラスターではサポートされていません。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- 実行中の簡単なメール転送プロトコル (SMTP) が設定されている。

- アラートが発生している。

手順

- ダッシュボードにログインします。

ダッシュボードの alerts モジュールをカスタマイズして、ストレージクラスターの電子メールアラートを取得します。

- ナビゲーションメニューで、Cluster をクリックします。

- Manager modules を選択します。

- アラート モジュールを選択します。

- Edit ドロップダウンメニューで、Edit を選択します。

Edit Manager module ウィンドウで、必要なパラメーターを更新し、Update をクリックします。

図7.2 アラートの Manager モジュールの編集

- ナビゲーションメニューで、Cluster をクリックします。

- ドロップダウンメニューから Monitoring を選択します。

アラートの詳細を表示するには、その行にある Expand/Collapse アイコンをクリックします。

図7.3 アラートの表示

- アラートのソースを表示するには、その行をクリックし、Source をクリックします。

関連情報

- SMTP 設定の詳細については、Ceph Dashboard でのアラートの管理 を参照してください。

7.5. Ceph Dashboard でのサイレンスの作成

Red Hat Ceph Storage Dashboard で、アラートを一定期間サイレントに作成できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- アラートが発生している。

手順

- ダッシュボードにログインします。

- ナビゲーションメニューで、Cluster をクリックします。

- ドロップダウンメニューから Monitoring を選択します。

- アラートのサイレンスを作成するには、その行を選択します。

- +Create Silence をクリックします。

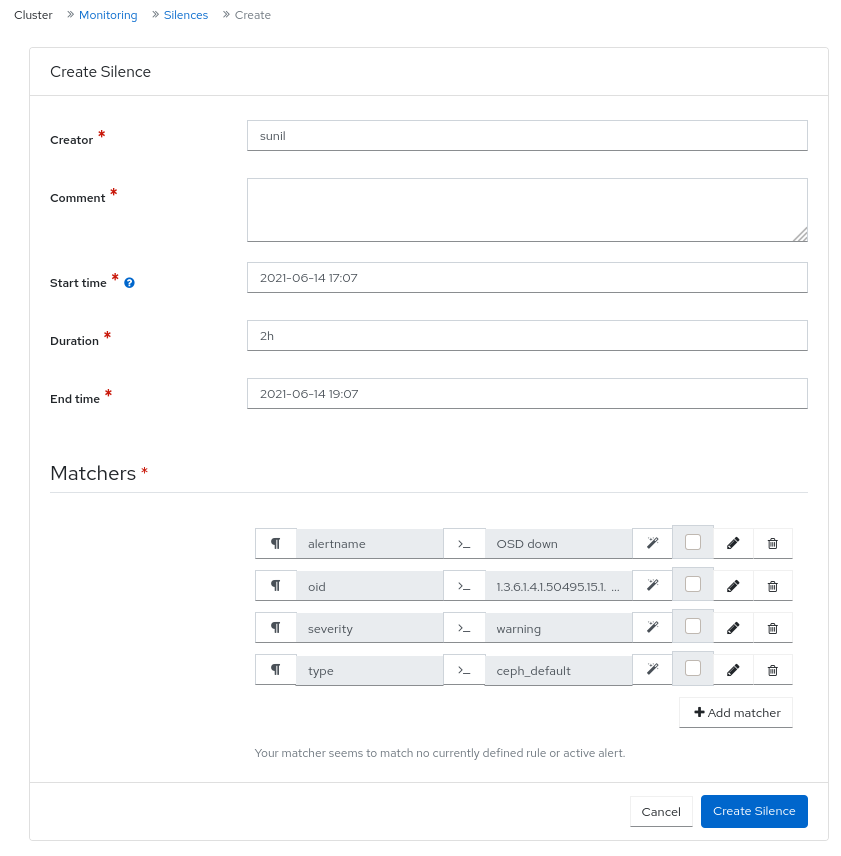

Create Silence ウィンドウで、Duration の詳細を追加し、 Create Silence をクリックします。

図7.4 サイレンスの作成

- サイレンスが正常に作成されたという通知が表示されます。

7.6. Ceph Dashboard でのサイレンスの再作成

Red Hat Ceph Storage Dashboard で、期限切れのサイレンスをもとにサイレンスを再作成できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- アラートが発生している。

- アラートのサイレンスが作成されている。

手順

- ダッシュボードにログインします。

- ナビゲーションメニューで、Cluster をクリックします。

- ドロップダウンメニューから Monitoring を選択します。

- Silences タブをクリックします。

- 期限切れのサイレンスを作成しなおすには、その行をクリックします。

- Recreate ボタンをクリックします。

Recreate Silence ウィンドウで、詳細を追加し、Recreate Silence をクリックします。

図7.5 サイレンスの再作成

- サイレンスが正常に再作成されたという通知が表示されます。

7.7. Ceph Dashboard でのサイレンスの編集

アクティブなサイレンスは、Red Hat Ceph Storage Dashboard でアクティブな時間を延長するなど、編集が可能です。サイレンスの有効期限が切れている場合は、サイレンスを再作成するか、アラート用に新しいサイレンスを作成することができます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- アラートが発生している。

- アラートのサイレンスが作成されている。

手順

- ダッシュボードにログインします。

- ナビゲーションメニューで、Cluster をクリックします。

- ドロップダウンメニューから Monitoring を選択します。

- Silences タブをクリックします。

- サイレンスを編集するには、その行をクリックします。

- Edit ドロップダウンメニューで、Edit を選択します。

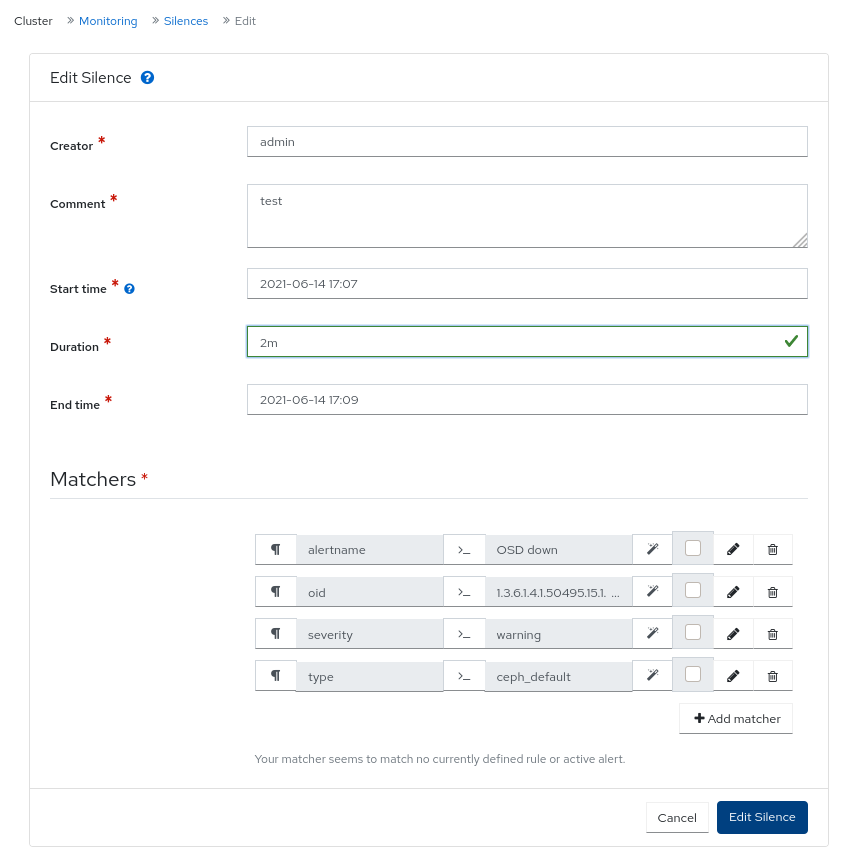

Edit Silence ウィンドウで、詳細を更新し、Edit Silence をクリックします。

図7.6 サイレンスの編集

- サイレンスが正常に更新されたという通知が表示されます。

7.8. Ceph Dashboard でのサイレンスの失効

Red Hat Ceph Storage Dashbaoard で一致したアラートが抑制されないように、サイレンスを期限切れにすることができます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- アラートが発生している。

- アラートのサイレンスが作成されている。

手順

- ダッシュボードにログインします。

- ナビゲーションメニューで、Cluster をクリックします。

- ドロップダウンメニューから Monitoring を選択します。

- Silences タブをクリックします。

- サイレンスを失効させるには、その行をクリックします。

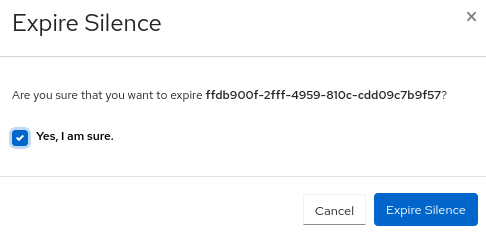

- Edit ドロップダウンメニューで、Expire を選択します。

Expire Silence ダイアログボックスで、Yes, I am sure を選択し、Expire Silence をクリックします。

図7.7 サイレンスの期限切れ

- サイレンスが正常に失効したという通知が届きます。

7.9. 関連情報

- 詳細は、Red Hat Ceph Storage トラブルシューティングガイド を参照してください。

第8章 Ceph Dashboard での NFS Ganesha エクスポートの管理

ストレージ管理者は、Red Hat Ceph Storage Dashbaoard で Ceph オブジェクトゲートウェイをバックストアとして使用する NFS Ganesha エクスポートを管理できます。ダッシュボードで NFS ganesha デーモンをデプロイ、設定、編集、削除できます。

ダッシュボードでは、Ceph クラスター上の RADOS オブジェクトに格納されている NFS-Ganesha 設定ファイルを管理します。NFS-Ganesha は、設定の一部を Ceph クラスターに格納する必要があります。

8.1. Ceph Dashboard での NFS Ganesha デーモンの設定

コマンドラインインターフェイスを使用して Ceph オブジェクトゲートウェイを設定し、NFS-Ganesha 専用のプールを有効にしてから、ダッシュボードで NFS Ganesha を設定できます。

Red Hat Ceph Storage 5 は、NFSv4 プロトコルのみをサポートしています。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- Ceph Object Gateway がインストールされている。

- Ceph Object ゲートウェイのログイン認証情報がダッシュボードに追加されている。

-

専用のプールが有効で、

nfsのカスタムタグが付けられている。 -

最低でも Ceph Dashboard での

Ganesha-managerレベルのアクセス。

手順

Cephadm シェルにログインします。

例:

[root@host01 ~]# cephadm shell

RADOS プールと namespace を作成し、

rgwを有効にします。構文

ceph osd pool create POOL_NAME _ ceph osd pool application enable POOL_NAME freeform/rgw/rbd/cephfs/nfs

例

[ceph: root@host01 /]# ceph osd pool create nfs-ganesha [ceph: root@host01 /]# ceph osd pool application enable nfs-ganesha rgw

コマンドラインインターフェイスで配置仕様を使用して NFS-Ganesha ゲートウェイをデプロイします。

構文

ceph orch apply nfs SERVICE_ID --placement="NUMBER_OF_DAEMONS HOST_NAME_1 HOST_NAME_2 HOST_NAME_3"

例

[ceph: root@host01 /]# ceph orch apply nfs foo --placement="2 host01 host02"

これにより、

host01およびhost02の 1 つのデーモンと、NFS-Ganesha クラスターnfsganeshaがデプロイされます。ganesha-clusters-rados-pool-namespaceパラメーターは、namespace と service_ID に更新します。構文

ceph dashboard set-ganesha-clusters-rados-pool-namespace POOL_NAME/SERVICE_ID

例:

[ceph: root@host01 /]# ceph dashboard set-ganesha-clusters-rados-pool-namespace nfs-ganesha/foo

- ダッシュボードのランディングページで、NFS をクリックします。

- Create を選択します。

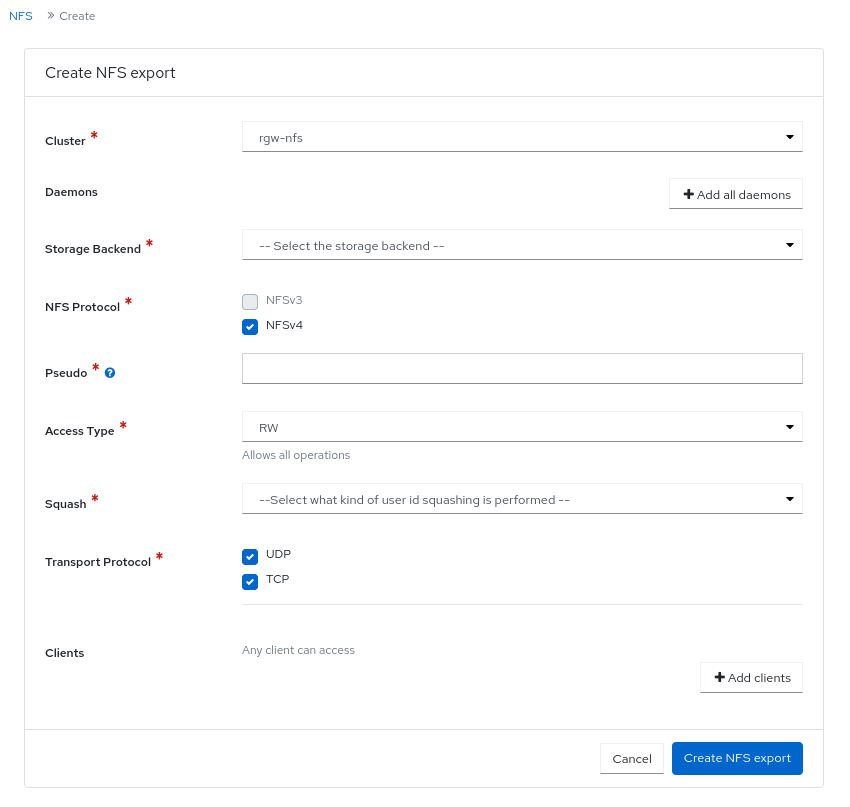

Create NFS export ウィンドウで、次のパラメーターを設定し、Create NFS export をクリックします。

- Cluster - クラスターの名前。

- Daemons - すべてのデーモンを選択できます。

- Storage Backend - Object Gateway を選択できます。

- Object Gateway User - 作成したユーザーを選択します。この例では、test_user です。

- Path - 任意のディレクトリー。

- NFS Protocol - NFSv4 がデフォルトで選択されています。

- Pseudo - ルートパス。

- Access Type - サポートされているアクセスタイプは RO、RW、および NONE です。

- Squash

- Transport Protocol

クライアント

NFS デーモンが設定されていることを確認します。

例:

[ceph: root@host01 /]# ceph -s

root ユーザーとして、NFS サービスがアクティブで実行中かどうかを確認します。

例:

[root@host01 ~]# systemctl list-units | grep nfs

- NFS エクスポートをマウントし、いくつかの I/O 操作を実行します。

-

NFS サービスが起動して実行されたら、NFS-RGW コンテナーで、

etc/ganesha/ganesha.confファイルのdir_chunk=0パラメーターをコメントアウトします。NFS-Ganesha サービスを再起動します。これにより、NFS マウントでの適切なリスト表示が可能になります。

検証

NFS デーモンは、Ceph オブジェクトゲートウェイのバケットの下に表示できます。

関連情報

- Ceph オブジェクトゲートウェイのデプロイに関する詳細は、Red Hat Ceph Storage 操作ガイド の コマンドラインインターフェイスを使用した Ceph オブジェクトゲートウェイのデプロイ セクションを参照してください。

- オブジェクトゲートウェイのログイン認証情報をダッシュボードに追加する方法は、Red Hat Ceph Storage Dashboard ガイドの ダッシュボードへの Ceph オブジェクトゲートウェイログイン認証情報の手動追加 セクションを参照してください。

- ダッシュボードでのオブジェクトゲートウェイユーザーの作成の詳細については、Red Hat Ceph Storage Dashboard ガイドの ダッシュボードでの Ceph オブジェクトゲートウェイユーザーの作成 セクションを参照してください。

- ダッシュボードでのオブジェクトゲートウェイバケットの作成の詳細は、Red Hat Ceph Storage Dashboard ガイドの ダッシュボードでの Ceph オブジェクトゲートウェイバケットの作成 セクションを参照してください。

- システムロールの詳細については、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard のユーザーロールとパーミッション セクションを参照してください。

8.2. Ceph Dashboard での CephFS を使用した NFS エクスポートの設定

コマンドラインインターフェイスを使用して Ceph File System (CephFS) を設定した後、Ceph Dashboard で NFS エクスポートを作成、編集、および削除できます。NFS プロトコルを介して CephFS 名前空間をエクスポートできます。

すべての NFS Ganesha デーモン、CLUSTER_ID に基づく新しいユーザー、および共通の NFS Ganesha 設定 RADOS オブジェクト用の共通の回復プールを作成する NFS クラスターを作成する必要があります。

Red Hat Ceph Storage 5 は、NFSv4 プロトコルのみをサポートしています。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ブートストラップされたホストへの root レベルのアクセス。

-

最低でも Ceph Dashboard での

Ganesha-managerレベルのアクセス。

手順

cephadmシェルにログインします。例:

[root@host01 ~]# cephadm shell

バックエンドで CephFS ストレージを作成します。

構文

ceph fs volume create CEPH_FILE_SYSTEM例:

[ceph: root@host01 /]# ceph fs volume create cephfs

Ceph Manager の NFS モジュールを有効にします。

例:

[ceph: root@host01 /]# ceph mgr module enable nfs

NFS Ganesha クラスターを作成します。

構文

ceph nfs cluster create NFS_CLUSTER_NAME "HOST_NAME_PLACEMENT_LIST"

例:

[ceph: root@host01 /]# ceph nfs cluster create nfs-cephfs host02 NFS Cluster Created Successfully

ダッシュボードの URL を取得します。

例:

[ceph: root@host01 /]# ceph mgr services { "dashboard": "https://10.00.00.11:8443/", "prometheus": "http://10.00.00.11:9283/" }- 認証情報を使用して Ceph Dashboard にログインします。

- ダッシュボードのランディングページで、NFS をクリックします。

- Create をクリックします。

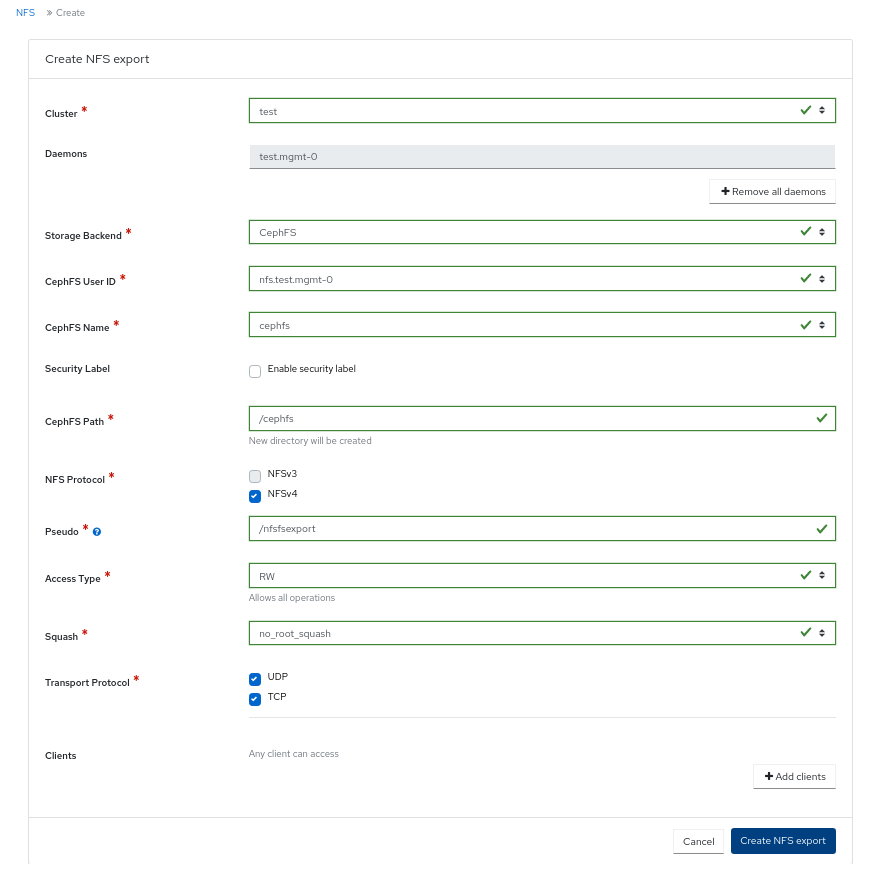

Create NFS export ウィンドウで、次のパラメーターを設定し、Create NFS export をクリックします。

- Cluster - クラスターの名前。

- Daemons - すべてのデーモンを選択できます。

- ストレージバックエンド: CephFS を選択できます。

- CephFS ユーザー ID: NFS クラスターが作成されるサービスを選択します。

- CephFS 名: ユーザー名を指定します。

- CephFs パス: 任意のディレクトリー。

- NFS Protocol - NFSv4 がデフォルトで選択されています。

- Pseudo - ルートパス。

- Access Type - サポートされているアクセスタイプは RO、RW、および NONE です。

- Squash: Squash のタイプを選択します。

- トランスポートプロトコル: UDP または TCP プロトコルのいずれかを選択します。

Clients

図8.1 CephFS NFS エクスポートウィンドウ

クライアントホストで root ユーザーとして、ディレクトリーを作成し、NFS エクスポートをマウントします。

構文

mkdir -p /mnt/nfs/ mount -t nfs -o port=2049 HOSTNAME:EXPORT_NAME _MOUNT_DIRECTORY_

例

[root@ client ~]# mkdir -p /mnt/nfs/ [root@ client ~]# mount -t nfs -o port=2049 host02:/export1 /mnt/nfs/

検証

NFS デーモンが設定されていることを確認します。

例:

[ceph: root@host01 /]# ceph -s

関連情報

- 詳細は、Red Hat Ceph Storage Operations Guideの Creating the NFS-Ganesha cluster using the Ceph Orchestrator セクションを参照してください。

8.3. Ceph Dashboard での NFS Ganesha デーモンの編集

NFS Ganesha デーモンは Red Hat Ceph Storage Dashboard で編集できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

-

最低でも Ceph Dashboard での

Ganesha-managerレベルのアクセス。 - NFS Ganesha デーモンがダッシュボードで設定されている。

手順

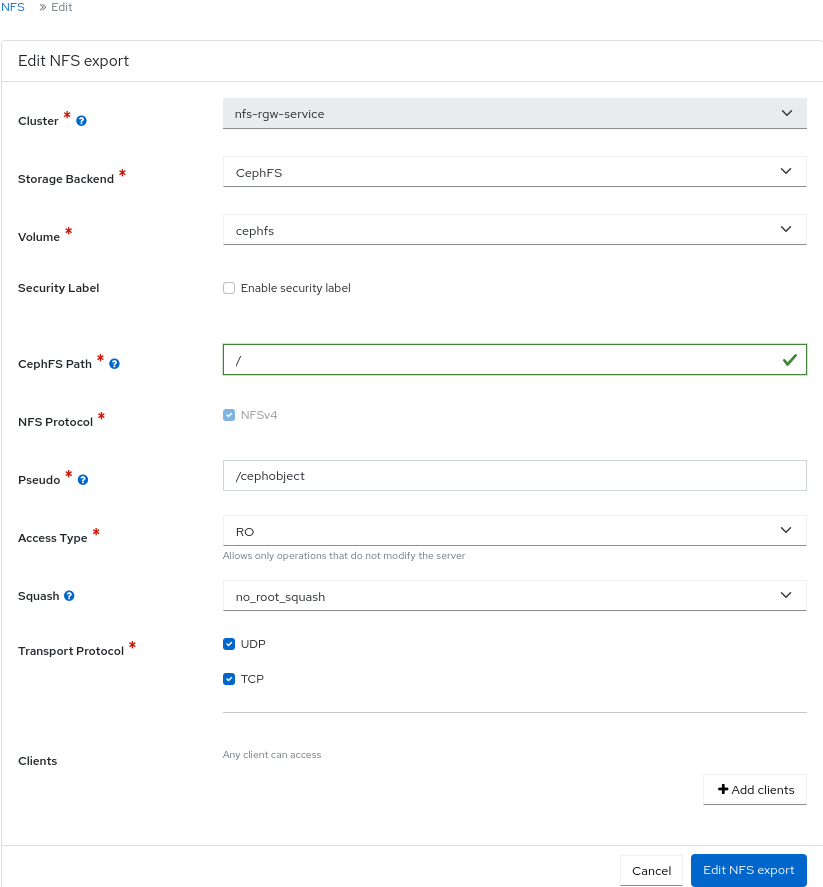

- ダッシュボードで、NFS をクリックします。

- 編集が必要な行をクリックします。

- Edit ドロップダウンメニューから、Edit をクリックします。

Edit NFS export ウィンドウで、必要なパラメーターを編集し、Edit NFS export をクリックします。

検証

- NFS Ganesha が正常に更新されたことを示す通知が表示されます。

関連情報

- NFS Ganesha の設定の詳細は、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard での NFS Ganesha デーモンの設定 を参照してください。

- Ceph Object Gateway のログイン認証情報をダッシュボードに追加する方法は、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard へのオブジェクトゲートウェイログイン認証情報の手動追加 セクションを参照してください。

- ダッシュボードでの Ceph Object Gateway ユーザーの作成の詳細については、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard でのオブジェクトゲートウェイユーザーの作成 セクションを参照してください。

- ダッシュボードでの Ceph Object Gateway バケットの作成の詳細は、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard でのオブジェクトゲートウェイバケットの作成 セクションを参照してください。

- システムロールの詳細については、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard のユーザーロールとパーミッション セクションを参照してください。

8.4. Ceph Dashboard での NFS Ganesha デーモンの削除

Ceph Dashboard では、NFS Ganesha デーモンを削除できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

-

最低でも Ceph Dashboard での

Ganesha-managerレベルのアクセス。 - NFS Ganesha デーモンがダッシュボードで設定されている。

手順

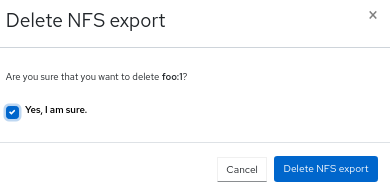

- ダッシュボードで、NFS をクリックします。

- 削除の必要な行をクリックします。

- Edit ドロップダウンメニューから、Delete をクリックします。

Delete NFS export ダイアログボックスで、Yes, I am sure チェックボックスをオンにして、Delete NFS export をクリックします。

検証

- 選択した行が正常に削除されます。

関連情報

- NFS Ganesha の設定の詳細は、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard での NFS Ganesha デーモンの設定 を参照してください。

- Ceph Object Gateway のログイン認証情報をダッシュボードに追加する方法は、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard へのオブジェクトゲートウェイログイン認証情報の手動追加 セクションを参照してください。

- ダッシュボードでの Ceph Object Gateway ユーザーの作成の詳細については、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard でのオブジェクトゲートウェイユーザーの作成 セクションを参照してください。

- ダッシュボードでの Ceph Object Gateway バケットの作成の詳細は、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard でのオブジェクトゲートウェイバケットの作成 セクションを参照してください。

- システムロールの詳細については、Red Hat Ceph Storage Dashboard ガイド の Ceph Dashboard のユーザーロールとパーミッション セクションを参照してください。

8.5. Ceph Dashboard での NFS クラスターの NFS-HA へのアップグレード

Ceph Dashboard を使用すると、スタンドアロン NFS クラスターを NFS-HA にアップグレードできます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- NFS サービスが実行されている。

-

最低でも Ceph Dashboard での

Ganesha-managerレベルのアクセス。 - NFS Ganesha デーモンがダッシュボードで設定されている。

手順

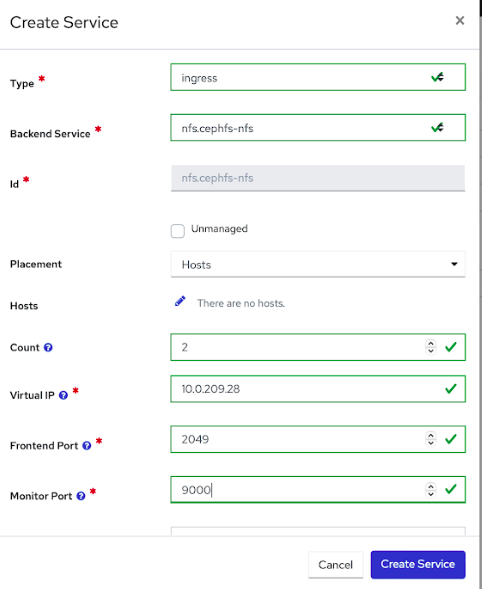

- ダッシュボードで、Cluster をクリックします。

- Cluster ドロップダウンメニューから、Services をクリックします。

- + Create をクリックします。

-

Create Service ウィンドウで、

ingressサービスを選択します。 必要なバックエンドサービスを選択し、必要なパラメーターを編集し、Create Service をクリックして、アップグレードします。

図8.2 Create Service ウィンドウ

関連情報

- NFS Ganesha の設定の詳細は、Red Hat Ceph Storage Dashboard ガイドの Ceph Dashboard での NFS Ganesha デーモンの設定 を参照してください。

第9章 Ceph Dashboard でのプールの管理

ストレージ管理者は、Red Hat Ceph Storage Dashboard でプールを作成、編集、削除できます。

本セクションでは、以下の管理タスクを説明します。

9.1. Ceph Dashboard でのプールの作成

プールを作成せずにストレージクラスターをデプロイすると、Ceph はデフォルトのプールを使用してデータを格納します。Red Hat Ceph Storage Dashboard で、プールを作成して、ストレージオブジェクトを論理的にパーティション分割できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

手順

- ダッシュボードにログインします。

- ナビゲーションメニューで、Pools をクリックします。

- Create をクリックします。

Create Pool ウィンドウで、次のパラメーターを設定します。

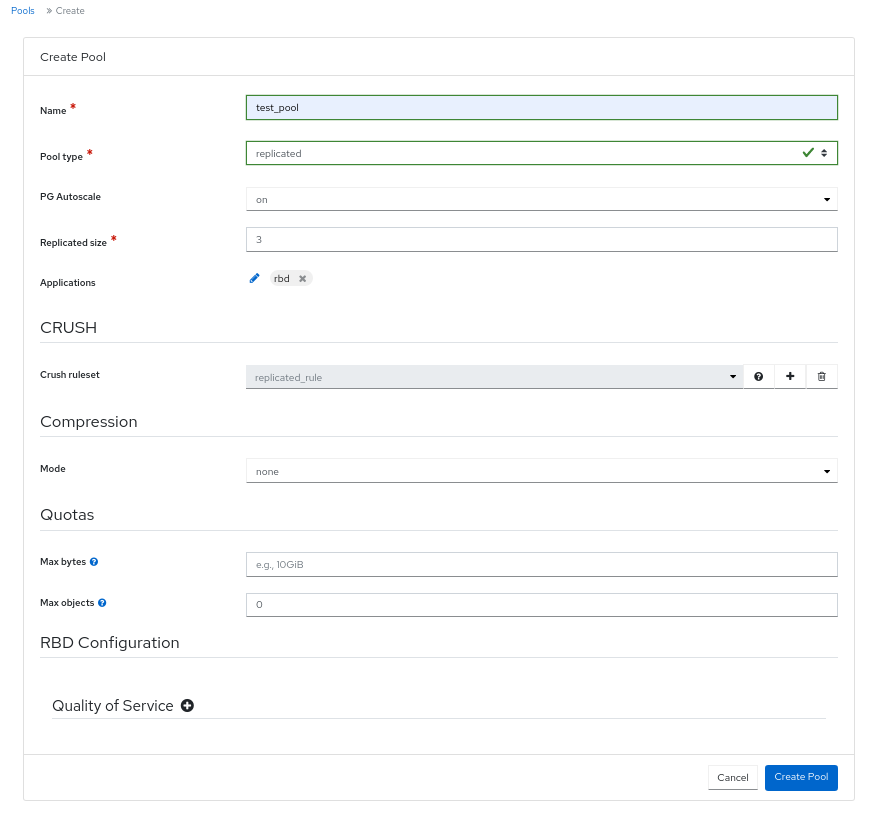

図9.1 プールの作成

- プールの名前を設定し、プールタイプを選択します。

- レプリケートまたはイレイジャーコード (EC) のいずれかのプールタイプを選択します。

- 配置グループ (PG) 番号を設定します。

- 必要に応じて、レプリケートされたプールタイプを使用する場合は、レプリケートされたサイズを設定します。

- 必要に応じて、EC プールタイプを使用する場合には、以下の追加設定を設定します。

- 必要に応じて、現在選択されている EC プロファイルの設定を確認するには、クレスチョンマークをクリックします。

- 必要に応じて、プラス記号をクリックして、新しい EC プロファイルを追加します。

- 必要に応じて、鉛筆記号をクリックして、プールのアプリケーションを選択します。

- オプション: 該当する場合は、CRUSH ルールを設定します。

- 必要に応じて、圧縮が必要な場合は、passive、aggressive、または force を選択します。

- オプション: クォータを設定します。

- オプション: サービス品質 (Quality of Service) 設定を設定します。

- Create Pool をクリックします。

- プールが正常に作成されたという通知が表示されます。

関連情報

- 詳細は、Red Hat Ceph Storage アーキテクチャーガイドの Ceph プール を参照してください。

9.2. Ceph Dashboard でのプールの編集

Red Hat Ceph Storage Dashboard でプールを編集できます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- プールが作成されている。

手順

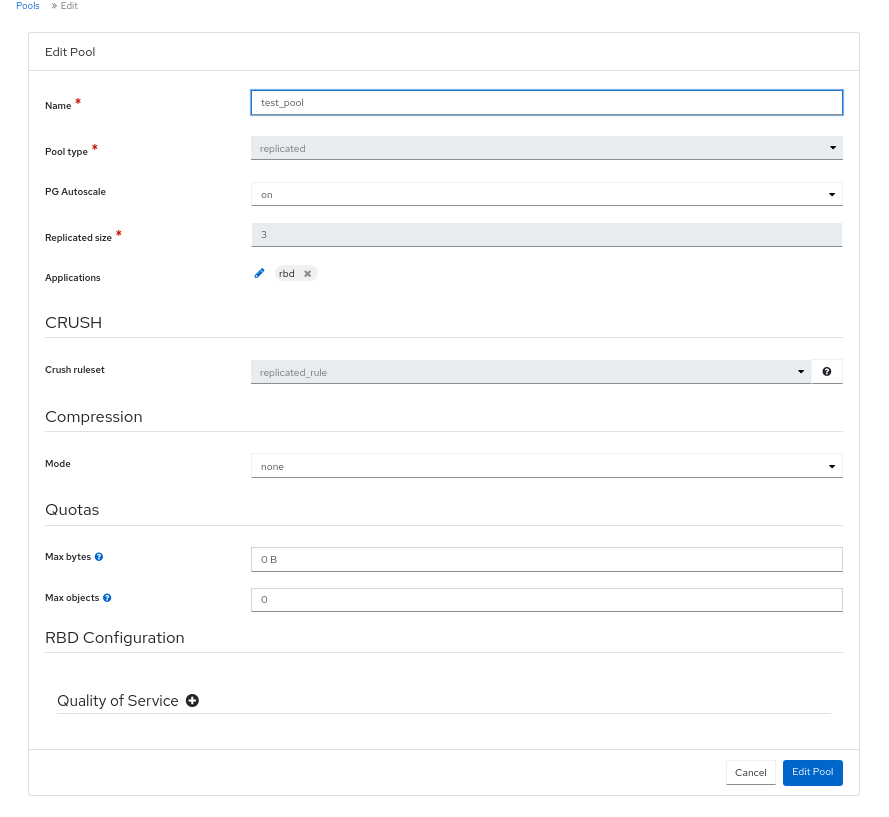

- ダッシュボードにログインします。

- ナビゲーションメニューで、Pools をクリックします。

- プールを編集するには、その行をクリックします。

- Edit ドロップダウンで Edit を選択します。

Edit Pool ウィンドウで、必要なパラメーターを編集し、Edit Pool をクリックします。

図9.2 プールの編集

- プールが正常に作成されたという通知が表示されます。

9.3. Ceph Dashboard でのプールの削除

Red Hat Ceph Storage Dashboard でプールを削除できます。マネージャーモジュールで mon_allow_pool_delete の値が True に設定されていることを確認します。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- プールが作成されている。

手順

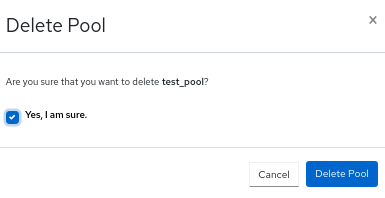

- ダッシュボードにログインします。

- ナビゲーションバーの Cluster ドロップダウンメニューで、Configuration をクリックします。

- Level ドロップダウンメニューで、Advanced を選択します。

-

mon_allow_pool_deleteを検索し、編集をクリックします。 すべての値を

trueに設定します。図9.3 プールを削除する設定

- ナビゲーションバーで、Pools をクリックします。

- プールを削除するには、行をクリックします。

- Edit ドロップダウンメニューから、Delete を選択します。

Delete Pool ウィンドウで、Yes, I am sure ボックスをクリックし、Delete Pool をクリックして設定を保存します。

図9.4 プールの削除

第10章 Ceph Dashboard でのホストの管理

ストレージ管理者は、Red Hat Ceph Storage Dashboard でホストのメンテナンスモードを有効または無効にすることができます。メンテナンスモードでは、メンテナンスアクティビティーを実行するためにホストをシャットダウンしても、クラスターに悪影響を与えることはありません。

Red Hat Ceph Storage Dashboard の Start Drain および Remove オプションを使用して、ホストを削除することもできます。

本セクションでは、以下の管理タスクを説明します。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- ホスト、Ceph Monitor Daemon、および Ceph Manager Daemon がストレージクラスターに追加されている。

10.1. メンテナンスモードの開始

Red Hat Ceph Storage Dashboard でホストをシャットダウンする前に、ホストのメンテナンスモードを開始することができます。メンテナンスモードが正常に有効になると、ホストはエラーなしでオフラインになり、メンテナンスアクティビティーを実行できます。メンテナンスモードが失敗した場合は、失敗の理由と、ホストを停止する前に実行する必要があるアクションが示されます。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- 他のすべての前提条件の確認は Ceph によって内部的に実行され、考えられるエラーは Ceph によって内部的に処理されます。

手順

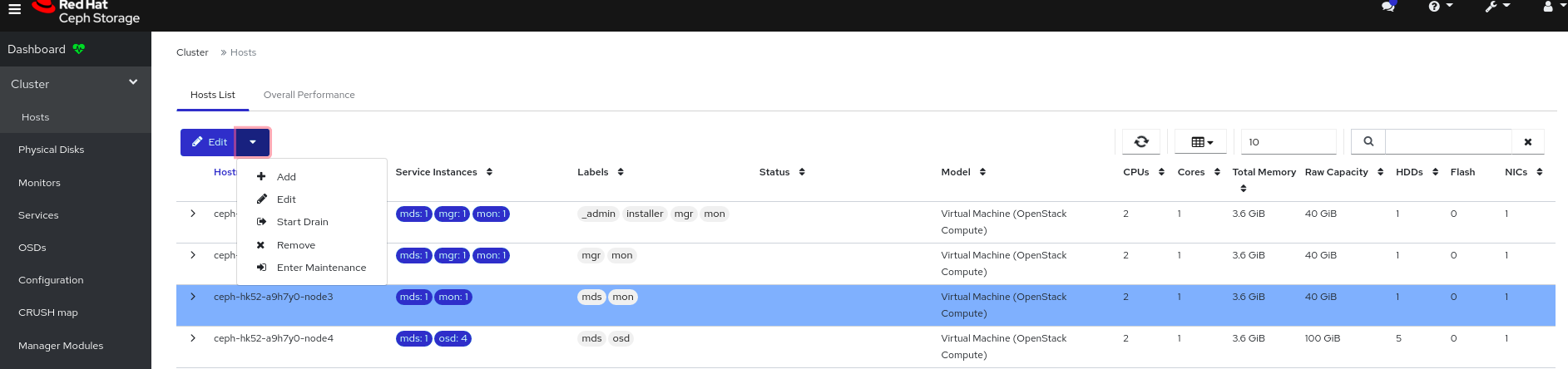

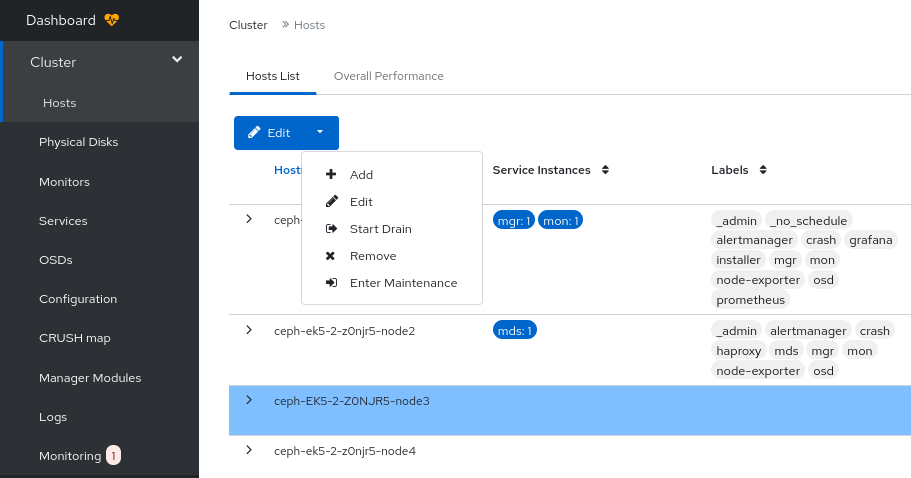

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Hosts を選択します。

- リストからホストを選択します。

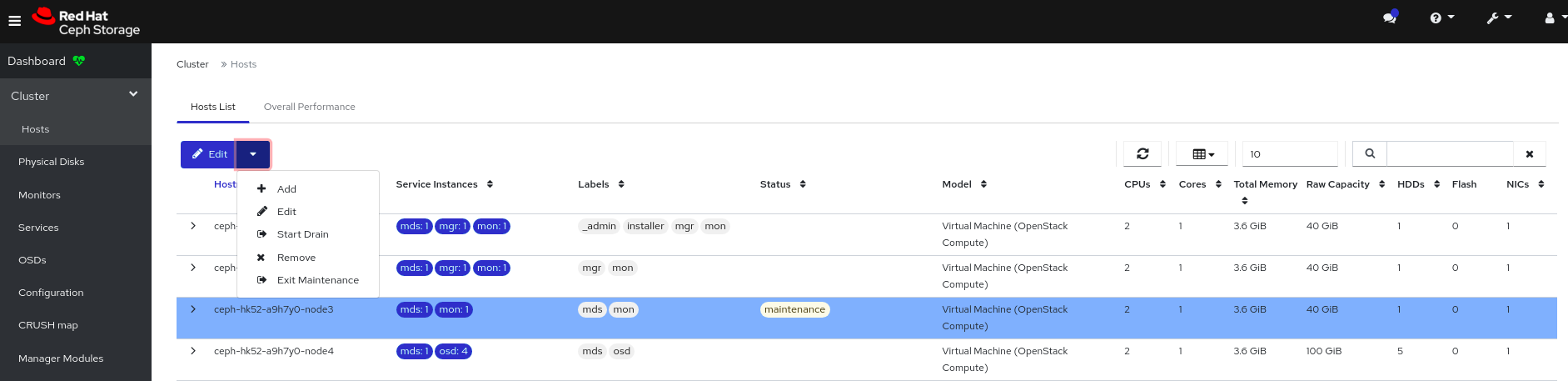

Edit ドロップダウンメニューから、Enter Maintenance をクリックします。

図10.1 メンテナンスモードの開始

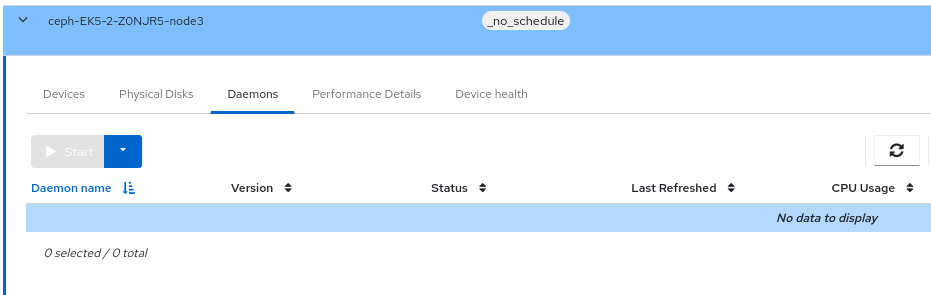

注記

注記ホストがメンテナンスモードを開始すると、すべてのデーモンが停止します。ホストの Daemons タブで、デーモンのステータスを確認できます。

検証

- ホストが正常にメンテナンスモードに移行したという通知を受け取り、Status 列に maintenance ラベルが表示されます。

メンテナンスモードが失敗した場合は、失敗の理由を示す通知を受け取ります。

10.2. メンテナンスモードの終了

ホストを再起動するには、Red Hat Ceph Storage Dashboard でホストのメンテナンスモードを終了します。

前提条件

- 稼働中の Red Hat Ceph Storage クラスターがある。

- Dashboard がインストールされている。

- 他のすべての前提条件の確認は Ceph によって内部的に実行され、考えられるエラーは Ceph によって内部的に処理されます。

手順

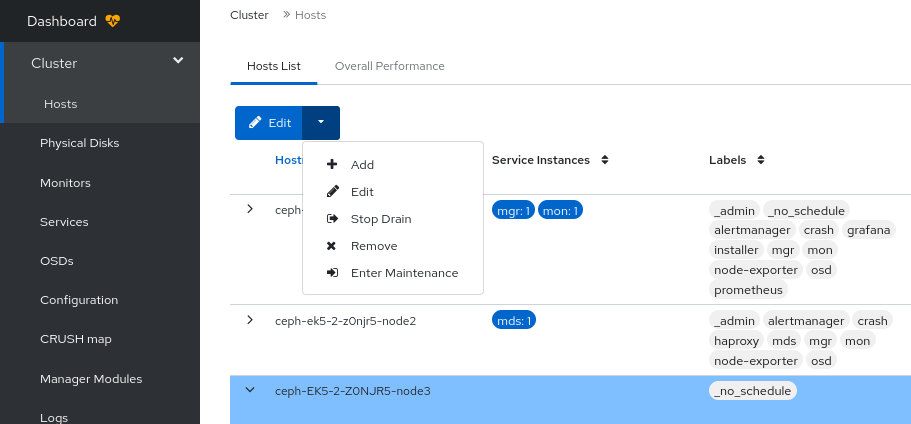

- ダッシュボードにログインします。

- Cluster ドロップダウンメニューから、Hosts を選択します。

Hosts 一覧から、メンテナンス中のホストを選択します。

注記Status 列の maintenance ラベルを確認することで、メンテナンス中のホストを特定できます。

Edit ドロップダウンメニューから、Exit Maintenance をクリックします。

図10.2 メンテナンスモードの終了

メンテナンスモードの終了後、default-crash でホスト上に必要なサービスを作成し、node-exporter がデプロイされるようにする必要があります。

検証

- ホストのメンテナンスが正常に終了し、Status 列から maintenance ラベルが削除されたという通知が表示されます。

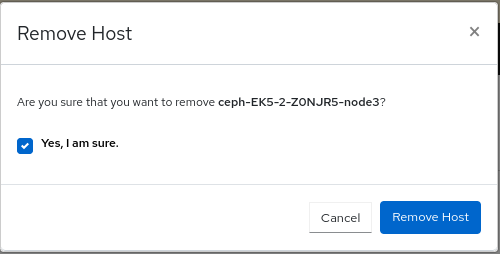

10.3. Ceph Dashboard を使用したホストの削除

Ceph クラスターからホストを削除するには、Red Hat Ceph Storage Dashboard の Start Drain および Remove オプションを使用できます。