AMQ Streams on OpenShift の使用

OpenShift Container Platform 上で AMQ Streams 1.5 を使用

概要

第1章 AMQ Streams の概要

AMQ Streams は、OpenShift クラスターで Apache Kafka を実行するプロセスを簡素化します。

本ガイドでは、Kafka コンポーネントの設定と、AMQ Streams operator を使用する手順について説明します。手順は、デプロイメントの変更方法や、Cruise Control や分散トレーシングなどの追加機能を導入する方法に関連しています。

1.1. Kafka の機能

Kafka の基盤のデータストリーム処理機能とコンポーネントアーキテクチャーによって以下が提供されます。

- スループットが非常に高く、レイテンシーが低い状態でデータを共有するマイクロサービスおよびその他のアプリケーション

- メッセージの順序の保証

- アプリケーションの状態を再構築するためにデータストレージからメッセージを巻き戻し/再生

- キーバリューログの使用時に古いレコードを削除するメッセージ圧縮

- クラスター設定での水平スケーラビリティー

- 耐障害性を制御するデータのレプリケーション

- 即時アクセス用の大量データの保持

1.2. Kafka のユースケース

Kafka の機能は、以下に適しています。

- イベント駆動型のアーキテクチャー

- アプリケーションの状態に加えられた変更をイベントのログとしてキャプチャーするイベントソーシング

- メッセージのブローカー

- Web サイトアクティビティーの追跡

- メトリクスによる運用上のモニターリング

- ログの収集および集計

- 分散システムのコミットログ

- アプリケーションがリアルタイムでデータに対応できるようにするストリーム処理

1.3. AMQ Streams による Kafka のサポート

AMQ Streams は、Kafka を OpenShift で実行するためのコンテナーイメージおよび Operator を提供します。AMQ Streams Operator は、AMQ Streams の実行に必要です。AMQ Streams で提供される Operator は、Kafka を効果的に管理するために、専門的なオペレーション情報で目的に合うよう構築されています。

Operator は以下のプロセスを単純化します。

- Kafka クラスターのデプロイおよび実行

- Kafka コンポーネントのデプロイおよび実行

- Kafka へアクセスするための設定

- Kafka へのアクセスのセキュア化

- Kafka のアップグレード

- ブローカーの管理

- トピックの作成および管理

- ユーザーの作成および管理。

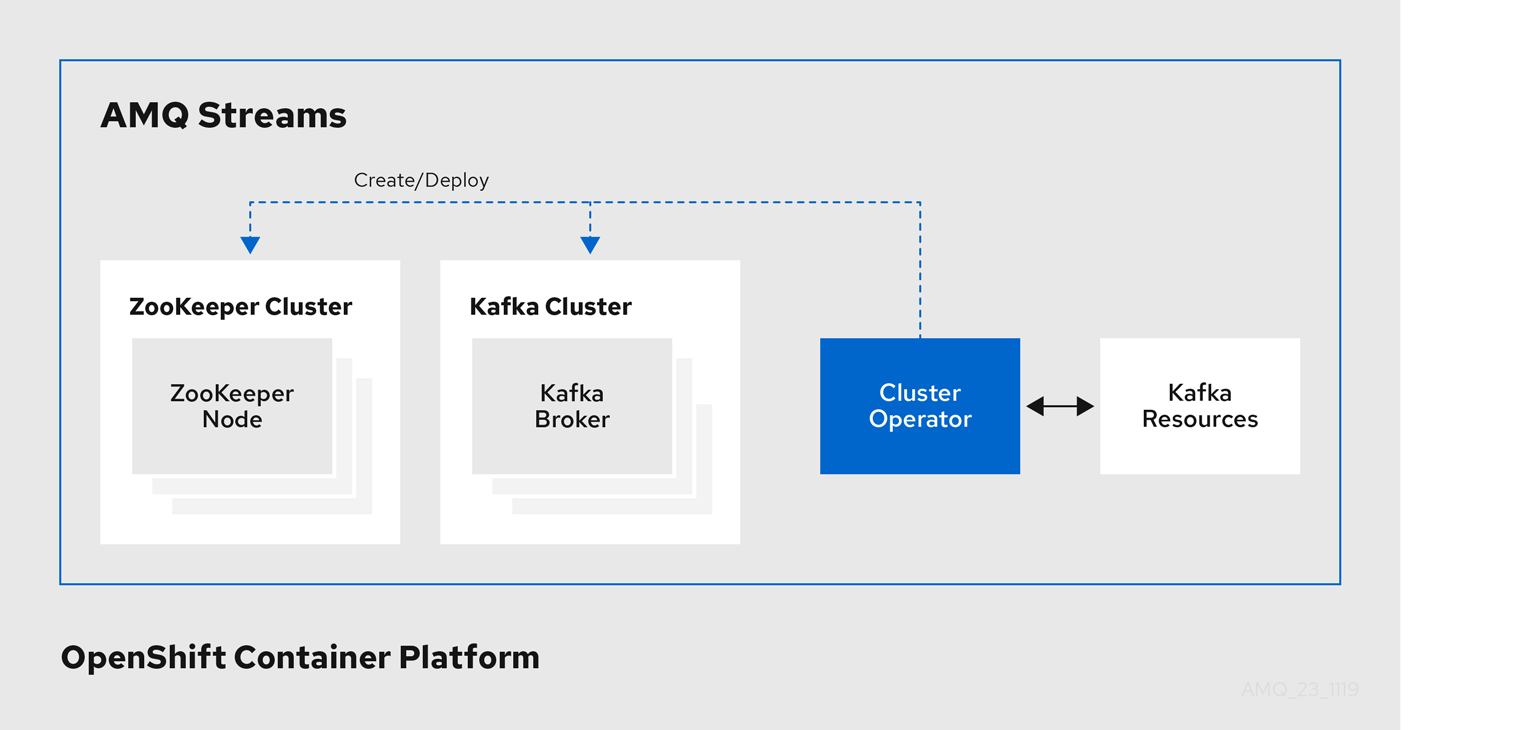

1.4. AMQ Streams の Operator

AMQ Streams では Operator を使用して Kafka をサポートし、Kafka のコンポーネントおよび依存関係を OpenShift にデプロイして管理します。

Operator は、OpenShift アプリケーションのパッケージ化、デプロイメント、および管理を行う方法です。AMQ Streams Operator は OpenShift の機能を拡張し、Kafka デプロイメントに関連する共通タスクや複雑なタスクを自動化します。Kafka 操作の情報をコードに実装することで、Kafka の管理タスクは簡素化され、必要な手動の作業が少なくなります。

Operator

AMQ Streams は、OpenShift クラスター内で実行中の Kafka クラスターを管理するための Operator を提供します。

- Cluster Operator

- Apache Kafka クラスター、Kafka Connect、Kafka MirrorMaker、Kafka Bridge、Kafka Exporter、および Entity Operator をデプロイおよび管理します。

- Entitiy Operator

- Topic Operator および User Operator を設定します。

- Topic Operator

- Kafka トピックを管理します。

- User Operator

- Kafka ユーザーを管理します。

Cluster Operator は、Kafka クラスターと同時に、Topic Operator および User Operator を Entity Operator 設定の一部としてデプロイできます。

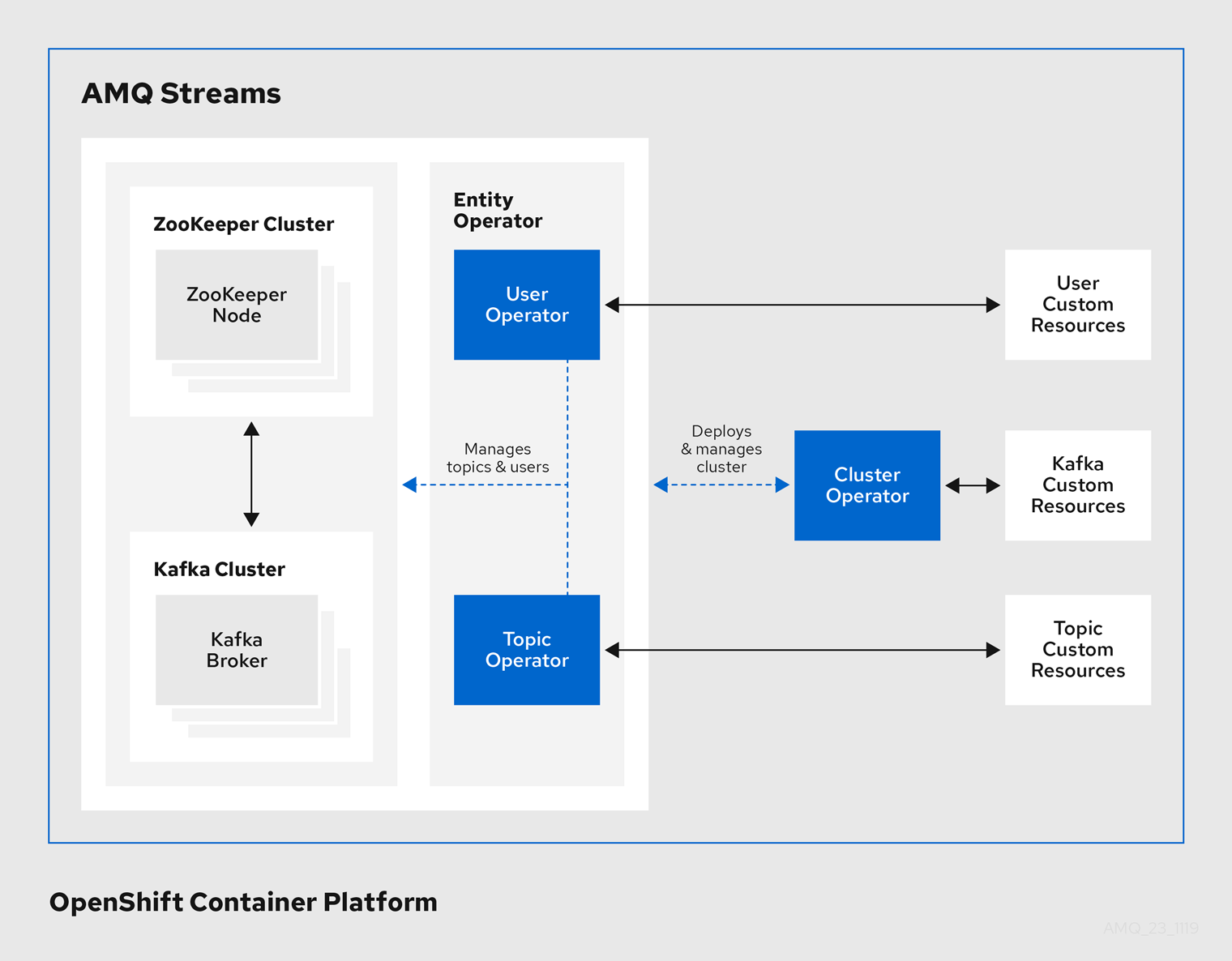

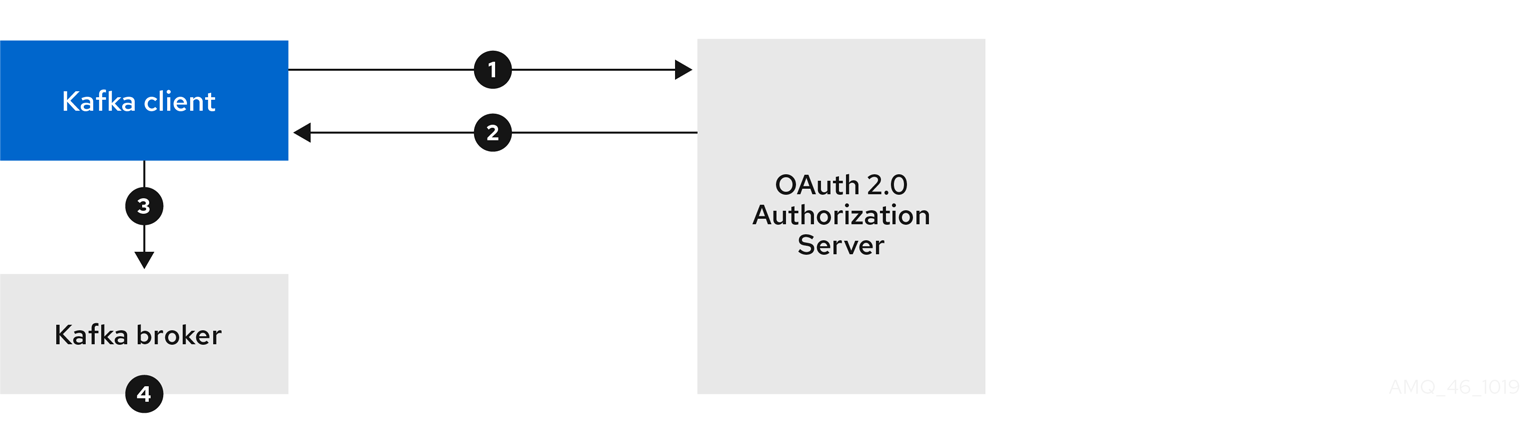

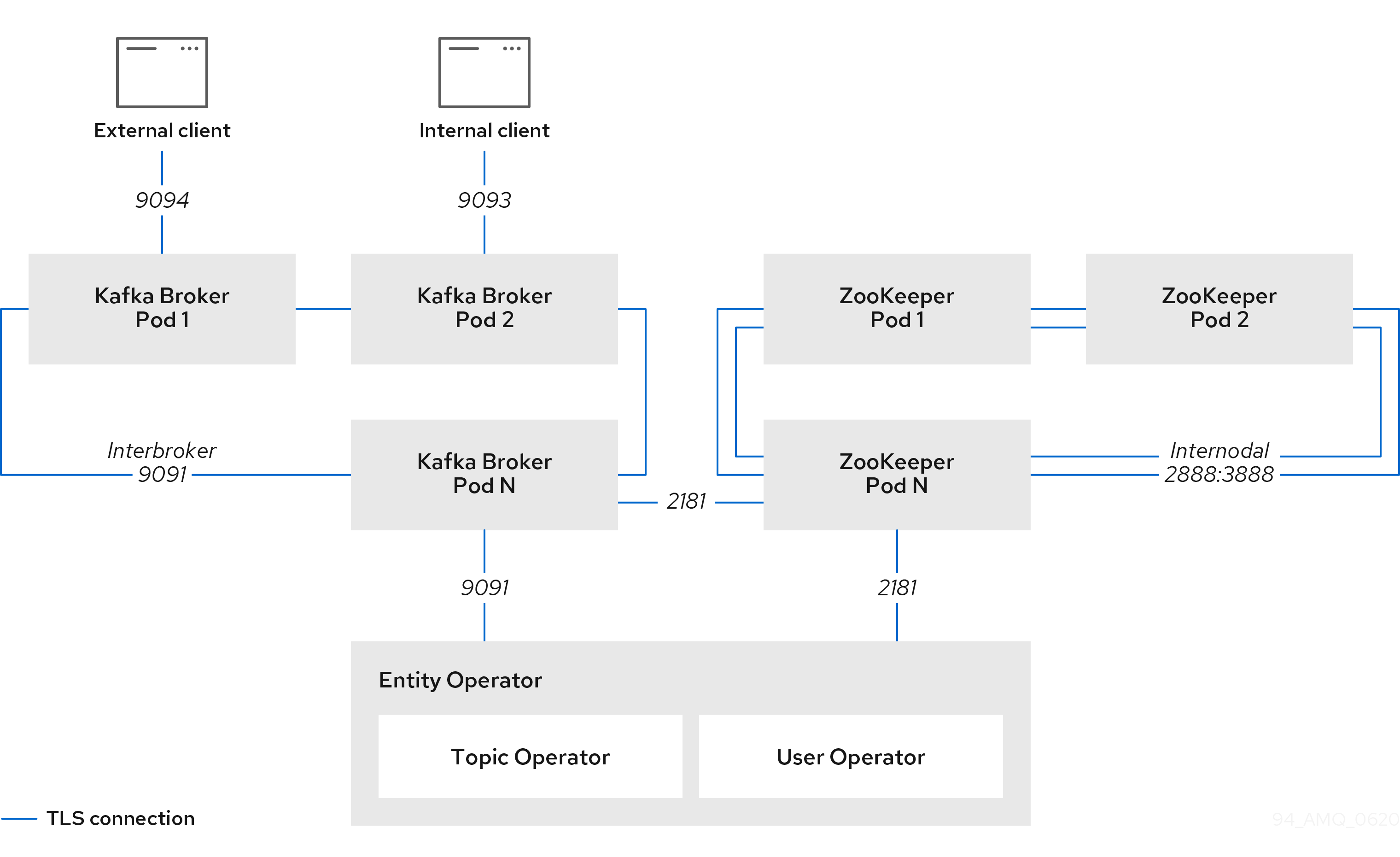

AMQ Streams アーキテクチャー内の Operator

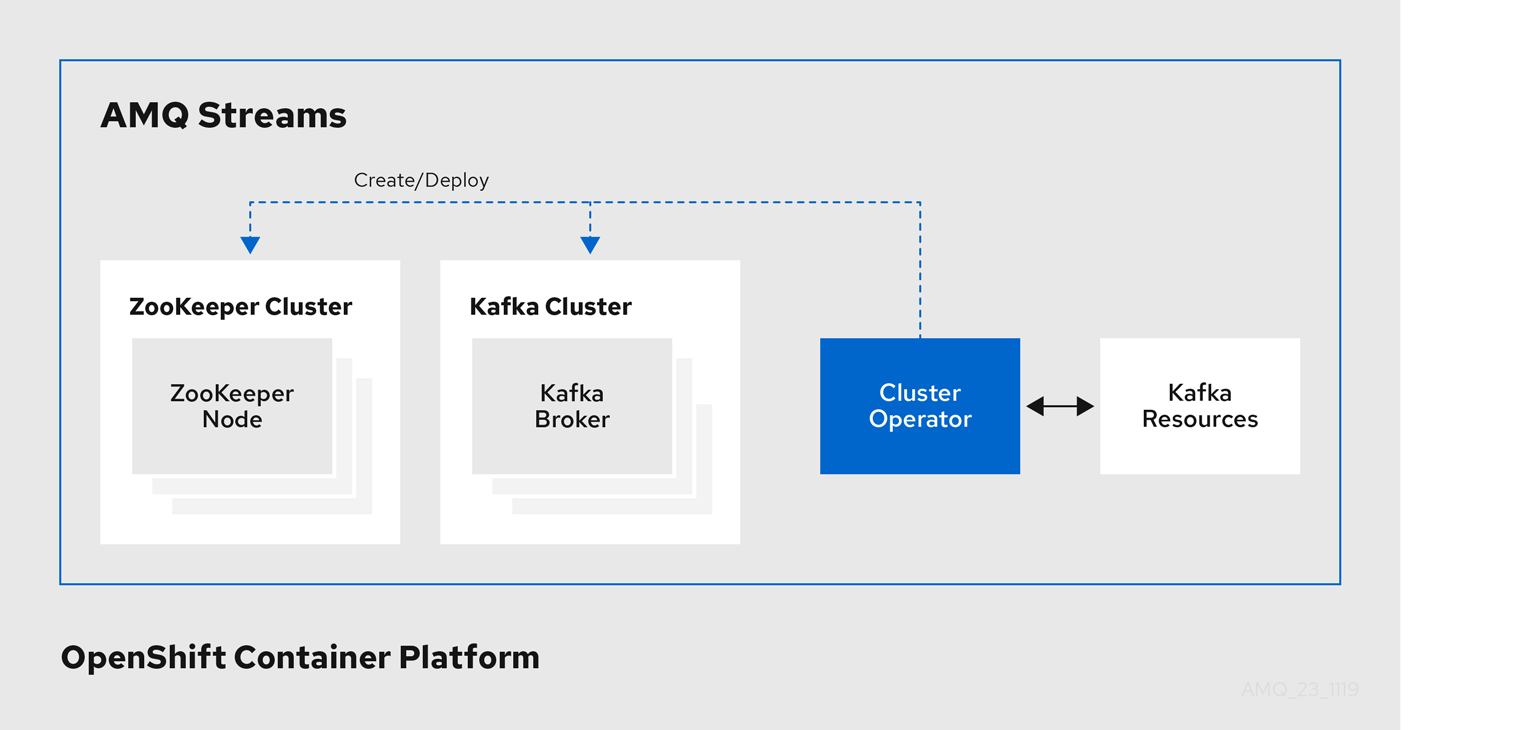

1.4.1. Cluster Operator

AMQ Streams では、Cluster Operator を使用して以下のクラスターをデプロイおよび管理します。

- Kafka (ZooKeeper、Entity Operator、Kafka Exporter、Cruise Control を含む)

- Kafka Connect

- Kafka MirrorMaker

- Kafka Bridge

クラスターのデプロイメントにはカスタムリソースが使用されます。

たとえば、以下のように Kafka クラスターをデプロイします。

-

クラスター設定のある

Kafkaリソースが OpenShift クラスター内で作成されます。 -

Kafkaリソースに宣言された内容を基にして、該当する Kafka クラスターが Cluster Operator によってデプロイされます。

Cluster Operator で以下もデプロイできます (Kafka リソースの設定より)。

-

KafkaTopicカスタムリソースより Operator スタイルのトピック管理を提供する Topic Operator -

KafkaUserカスタムリソースより Operator スタイルのユーザー管理を提供する User Operator

デプロイメントの Entity Operator 内の Topic Operator および User Operator 関数。

Cluster Operator のアーキテクチャー例

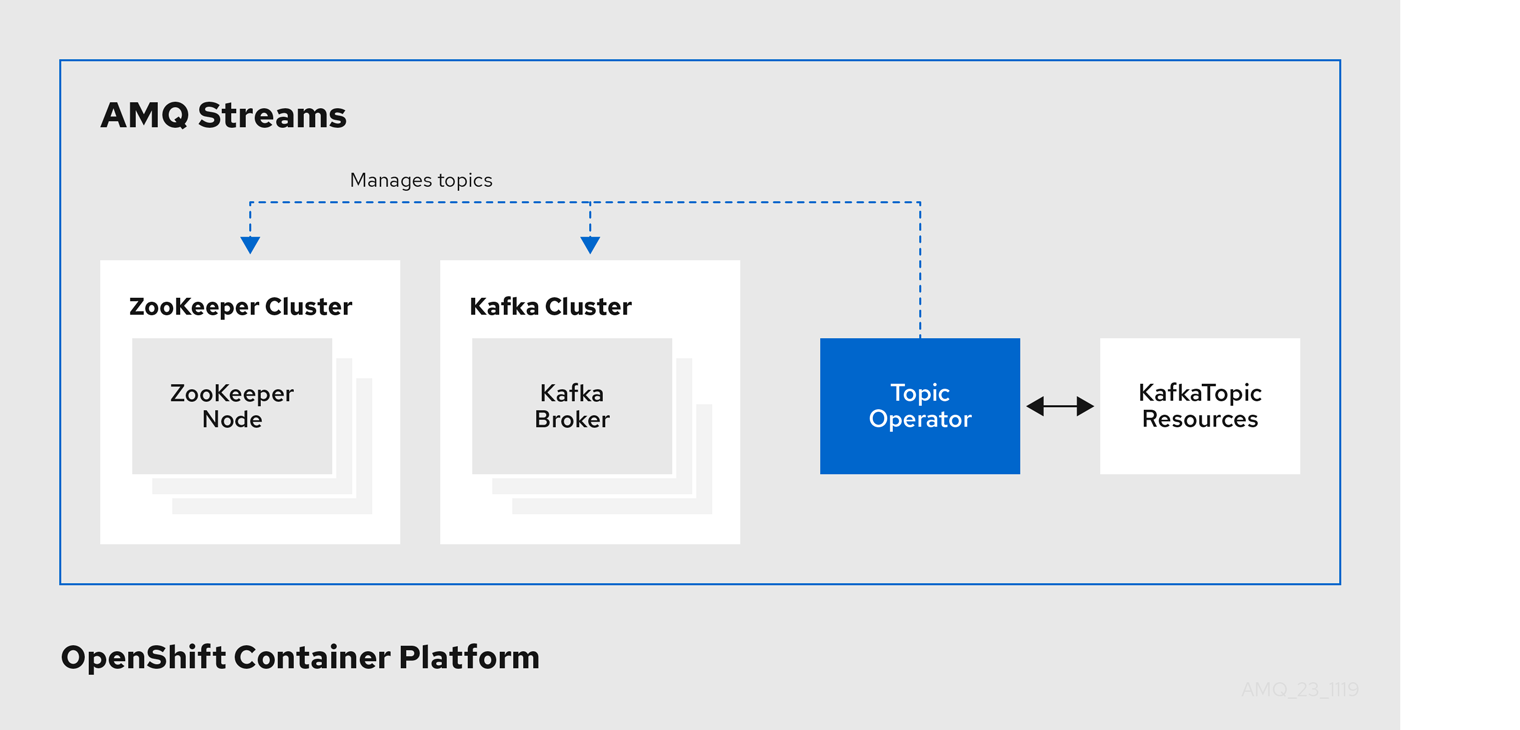

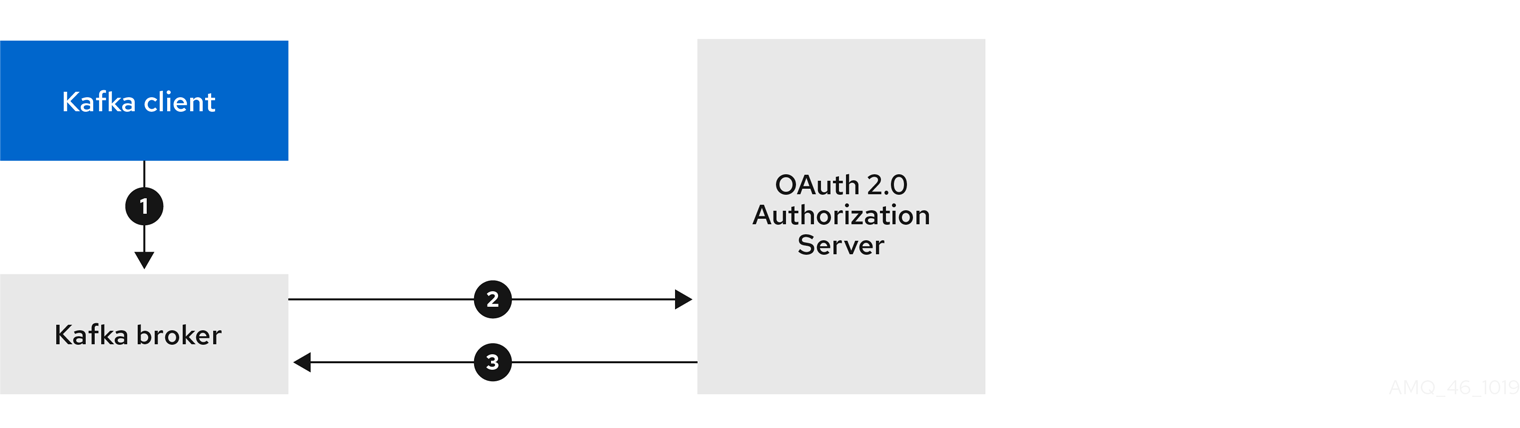

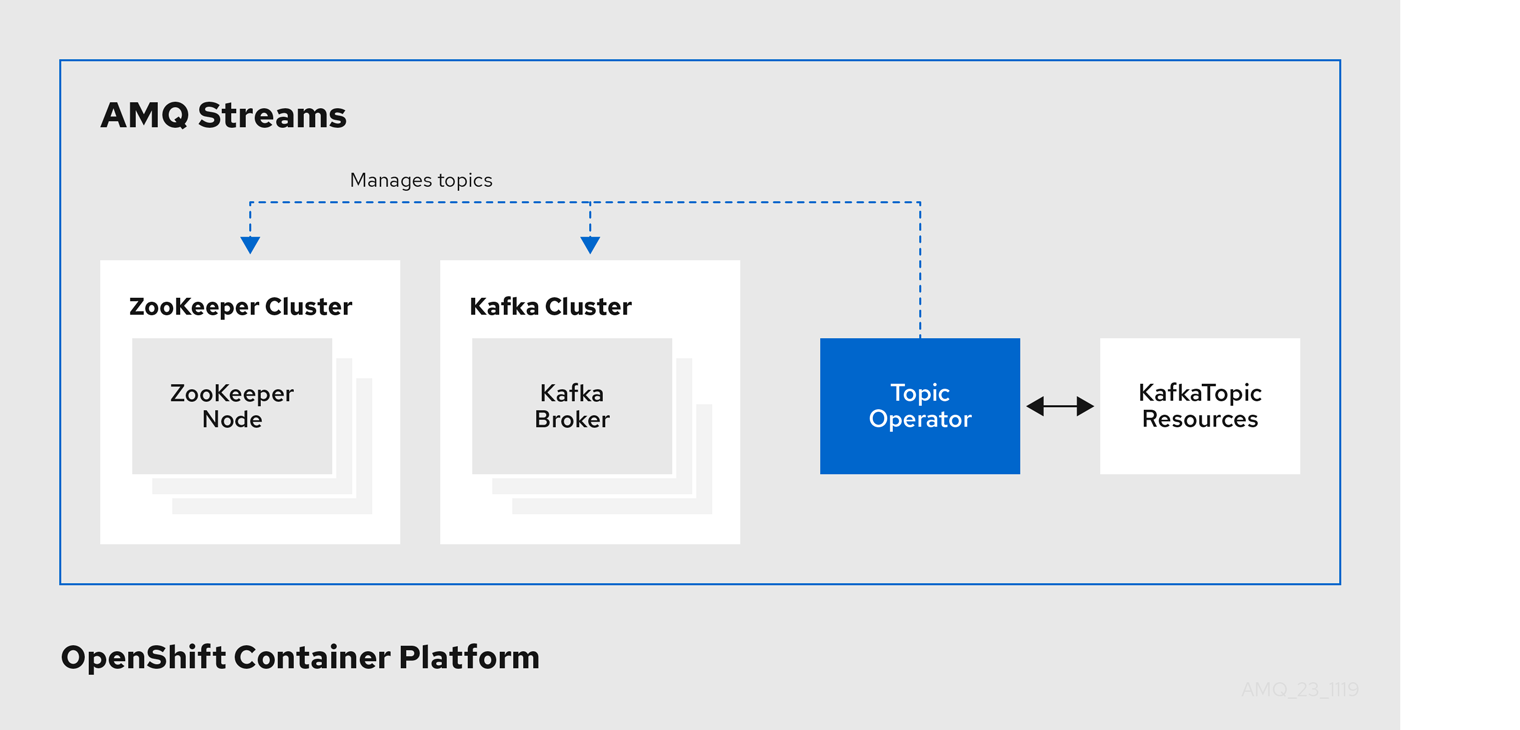

1.4.2. Topic Operator

Topic Operator は、OpenShift リソースより Kafka クラスターのトピックを管理する方法を提供します。

Topic Operator のアーキテクチャー例

Topic Operator のロールは、対応する Kafka トピックと同期して Kafka トピックを記述する KafkaTopic OpenShift リソースのセットを保持することです。

特に、KafkaTopic が

- 作成されると、Topic Operator によってトピックが作成されます。

- 削除されると、Topic Operator によってトピックが削除されます。

- 変更されると、Topick Operator によってトピックが更新されます。

上記と逆の方向で、トピックが

-

Kafka クラスター内で作成されると、Operator によって

KafkaTopicが作成されます。 -

Kafka クラスターから削除されると、Operator によって

KafkaTopicが削除されます。 -

Kafka クラスターで変更されると、Operator によって

KafkaTopicが更新されます。

このため、KafkaTopic をアプリケーションのデプロイメントの一部として宣言でき、トピックの作成は Topic Operator によって行われます。アプリケーションは、必要なトピックからの作成または消費のみに対処する必要があります。

トピックが再設定された場合や、別の Kafka ノードに再割り当てされた場合、KafkaTopic は常に最新の状態になります。

1.4.3. User Operator

User Operator は、Kafka ユーザーが記述される KafkaUser リソースを監視して Kafka クラスターの Kafka ユーザーを管理し、Kafka ユーザーが Kafka クラスターで適切に設定されるようにします。

たとえば、KafkaUser が

- 作成されると、User Operator によって記述されるユーザーが作成されます。

- 削除されると、User Operator によって記述されるユーザーが削除されます。

- 変更されると、User Operator によって記述されるユーザーが更新されます。

User Operator は Topic Operator とは異なり、Kafka クラスターからの変更は OpenShift リソースと同期されません。アプリケーションで直接 Kafka トピックを Kafka で作成することは可能ですが、ユーザーが User Operator と同時に直接 Kafka クラスターで管理されることは想定されません。

User Operator では、アプリケーションのデプロイメントの一部として KafkaUser リソースを宣言できます。ユーザーの認証および承認メカニズムを指定できます。たとえば、ユーザーがブローカーへのアクセスを独占しないようにするため、Kafka リソースの使用を制御する ユーザークォータ を設定することもできます。

ユーザーが作成されると、ユーザークレデンシャルが Secret に作成されます。アプリケーションはユーザーとそのクレデンシャルを使用して、認証やメッセージの生成または消費を行う必要があります。

User Operator は 認証のクレデンシャルを管理する他に、KafkaUser 宣言にユーザーのアクセス権限の記述を含めることで承認も管理します。

1.5. AMQ Streams のカスタムリソース

AMQ Streams を使用した Kafka コンポーネントの OpenShift クラスターへのデプロイメントは、カスタムリソースの適用により高度な設定が可能です。カスタムリソースは、OpenShift リソースを拡張するために CRD (カスタムリソース定義、Custom Resource Definition) によって追加される API のインスタンスとして作成されます。

CRD は、OpenShift クラスターでカスタムリソースを記述するための設定手順として機能し、デプロイメントで使用する Kafka コンポーネントごとに AMQ Streams で提供されます。CRD およびカスタムリソースは YAML ファイルとして定義されます。YAML ファイルのサンプルは AMQ Streams ディストリビューションに同梱されています。

また、CRD を使用すると、CLI へのアクセスや設定検証などのネイティブ OpenShift 機能を AMQ Streams リソースで活用することもできます。

1.5.1. AMQ Streams カスタムリソースの例

AMQ Streams 固有リソースのインスタンス化および管理に使用されるスキーマを定義するため、CRD をクラスターに 1 度インストールする必要があります。

CRD をインストールして新規カスタムリソースタイプをクラスターに追加した後に、その仕様に基づいてリソースのインスタンスを作成できます。

クラスターの設定によりますが、インストールには通常、クラスター管理者権限が必要です。

カスタムリソースの管理は、 AMQ Streams 管理者 のみが行えます。

kind:Kafka などの新しい kind リソースは、OpenShift クラスター内で CRD によって定義されます。

Kubernetes API サーバーを使用すると、kind を基にしたカスタムリソースの作成が可能になり、カスタムリソースが OpenShift クラスターに追加されたときにカスタムリソースの検証および格納方法を CRD から判断します。

CRD が削除されると、そのタイプのカスタムタイプも削除されます。さらに、Pod や Statefulset などのカスタムリソースによって作成されたリソースも削除されます。

AMQ Streams 固有の各カスタムリソースは、リソースの kind の CRD によって定義されるスキーマに準拠します。AMQ Streams コンポーネントのカスタムリソースには、spec で定義される共通の設定プロパティーがあります。

CRD とカスタムリソースの関係を理解するため、Kafka トピックの CRD の例を見てみましょう。

Kafka トピックの CRD

apiVersion: kafka.strimzi.io/v1beta1 kind: CustomResourceDefinition metadata: 1 name: kafkatopics.kafka.strimzi.io labels: app: strimzi spec: 2 group: kafka.strimzi.io versions: v1beta1 scope: Namespaced names: # ... singular: kafkatopic plural: kafkatopics shortNames: - kt 3 additionalPrinterColumns: 4 # ... subresources: status: {} 5 validation: 6 openAPIV3Schema: properties: spec: type: object properties: partitions: type: integer minimum: 1 replicas: type: integer minimum: 1 maximum: 32767 # ...

- 1

- CRD を識別するためのトピック CRD、その名前および名前のメタデータ。

- 2

- グループ (ドメイン) 名、複数名、サポート対象のスキーマバージョンなど、この CRD の仕様。トピックの API にアクセスするために URL で使用されます。他の名前は、CLI のインスタンスリソースを識別するために使用されます。たとえば、

oc get kafkaShortNametopic my-topicやoc get kafkatopicsなどです。 - 3

- ShortName は CLI コマンドで使用できます。たとえば、

oc get kafkatopicの代わりにoc get ktを略名として使用できます。 - 4

- カスタムリソースで

getコマンドを使用する場合に示される情報。 - 5

- リソースの スキーマ参照 に記載されている CRD の現在の状態。

- 6

- openAPIV3Schema 検証によって、トピックカスタムリソースの作成が検証されます。たとえば、トピックには 1 つ以上のパーティションと 1 つのレプリカが必要です。

ファイル名に、インデックス番号とそれに続く Crd が含まれるため、AMQ Streams インストールファイルと提供される CRD YAML ファイルを識別できます。

KafkaTopic カスタムリソースに該当する例は次のとおりです。

Kafka トピックカスタムリソース

apiVersion: kafka.strimzi.io/v1beta1 kind: KafkaTopic 1 metadata: name: my-topic labels: strimzi.io/cluster: my-cluster 2 spec: 3 partitions: 1 replicas: 1 config: retention.ms: 7200000 segment.bytes: 1073741824 status: conditions: 4 lastTransitionTime: "2019-08-20T11:37:00.706Z" status: "True" type: Ready observedGeneration: 1 / ...

- 1

kindおよびapiVersionによって、インスタンスであるカスタムリソースの CRD が特定されます。- 2

- トピックまたはユーザーが属する Kafka クラスターの名前 (

Kafkaリソースの名前と同じ) を定義する、KafkaTopicおよびKafkaUserリソースのみに適用可能なラベル。 - 3

- 指定内容には、トピックのパーティション数およびレプリカ数や、トピック自体の設定パラメーターが示されています。この例では、メッセージがトピックに保持される期間や、ログのセグメントファイルサイズが指定されています。

- 4

KafkaTopicリソースのステータス条件。lastTransitionTimeでtype条件がReadyに変更されています。

プラットフォーム CLI からカスタムリソースをクラスターに適用できます。カスタムリソースが作成されると、Kubernetes API の組み込みリソースと同じ検証が使用されます。

KafkaTopic の作成後、Topic Operator は通知を受け取り、該当する Kafka トピックが AMQ Streams で作成されます。

1.6. 本書の表記慣例

置き換え可能なテキスト

本書では、置き換え可能なテキストは、monospace フォントのイタリック体、大文字、およびハイフンで記載されています。

たとえば、以下のコードでは MY-NAMESPACE を namespace の名前に置き換えます。

sed -i 's/namespace: .*/namespace: MY-NAMESPACE/' install/cluster-operator/*RoleBinding*.yaml第2章 AMQ Streams の使用

AMQ Streams は、パブリックおよびプライベートクラウドからデプロイメントを目的とするローカルデプロイメントまで、ディストリビューションに関係なくすべてのタイプの OpenShift クラスターで動作するよう設計されています。

AMQ Streams は Strimzi 0.18.x をベースとしています。ここでは、OpenShift 3.11 以降に AMQ Streams をデプロイする方法を説明します。

本ガイドのコマンドを実行するには、クラスターユーザーに RBAC (ロールベースアクセス制御) および CRD を管理する権限を付与する必要があります。

2.1. AMQ Streams デプロイメントの準備

ここでは、AMQ Streams デプロイメントを準備する方法を説明します。

本ガイドのコマンドを実行するには、クラスターユーザーに RBAC (ロールベースアクセス制御) および CRD を管理する権限を付与する必要があります。

2.1.1. デプロイメントの前提条件

AMQ Streams のデプロイする場合、以下を確認してください。

OpenShift 3.11 以降のクラスターが利用できること。

AMQ Streams は AMQ Streams Strimzi 0.18.x をベースとしています。

-

ocコマンドラインツールがインストールされ、稼働中のクラスターに接続するように設定されていること。

AMQ Streams は、OpenShift 固有の一部機能をサポートします。そのようなインテグレーションは OpenShift ユーザーに有用で、標準の OpenShift を使用した同等の実装はありません。

2.1.2. AMQ Streams リリースアーティファクト

AMQ Streams をインストールするには、AMQ Streams のダウンロードページ から amq-streams-<version>-ocp-install-examples.zip ファイルをダウンロードし、リリースアーティファクトを展開します。

AMQ Streams のリリースアーティファクトには、YAML ファイルが含まれています。これらのファイルは、AMQ Streams コンポーネントの OpenShift へのデプロイ、共通の操作の実行、および Kafka クラスターの設定に便利です。

oc コマンドラインツールを使用して、AMQ Streams と OpenShift クラスターにデプロイします。

AMQ Streams コンテナーイメージは、Red Hat Ecosystem Catalog から使用することもできます。しかし、提供される YAML ファイルを使用して AMQ Streams をデプロイすることが推奨されます。

2.1.3. コンテナーイメージを独自のレジストリーにプッシュ

AMQ Streams のコンテナーイメージは Red Hat Ecosystem Catalog にあります。AMQ Streams によって提供されるインストール YAML ファイルは、直接 Red Hat Ecosystem Catalog からイメージをプルします。

Red Hat Ecosystem Catalog にアクセスできない場合や独自のコンテナーリポジトリーを使用する場合は以下を行います。

- リストにある すべての コンテナーイメージをプルします。

- 独自のレジストリーにプッシュします。

- インストール YAML ファイルのイメージ名を更新します。

リリースに対してサポートされる各 Kafka バージョンには別のイメージがあります。

| コンテナーイメージ | namespace/リポジトリー | 説明 |

|---|---|---|

| Kafka |

| 次を含む、Kafka を実行するための AMQ Streams イメージ。

|

| Operator |

| Operator を実行するための AMQ Streams イメージ。

|

| Kafka Bridge |

| AMQ Streams Kafka Bridge を稼働するための AMQ Streams イメージ |

2.1.4. AMQ Streams の管理者の指名

AMQ Streams では、デプロイメントの設定にカスタムリソースが提供されます。デフォルトでは、これらのリソースの表示、作成、編集、および削除権限は OpenShift クラスター管理者に限定されます。AMQ Streams には、このような権限を他のユーザーに割り当てするために使用する 2 つのクラスターロールがあります。

-

strimzi-viewロールを指定すると、ユーザーは AMQ Streams リソースを表示できます。 -

strimzi-adminロールを指定すると、ユーザーは AMQ Streams リソースを作成、編集、または削除することもできます。

これらのロールをインストールすると、これらの権限が自動的にデフォルトの OpenShift クラスターロールに集約 (追加) されます。strimzi-view は view ロールに集約され、strimzi-admin は edit および admin ロールに集約されます。このように集約することで、同様の権限がすでに持つユーザーに、上記のロールを割り当てる必要がなくなります。

以下の手順では、クラスター管理者でないユーザーが AMQ Streams リソースを管理できるようにする strimzi-admin ロールの割り当て方法を説明します。

システム管理者は、Cluster Operator のデプロイ後に AMQ Streams の管理者を指名できます。

前提条件

- Cluster Operator でデプロイとデプロイされた CRD (カスタムリソース定義) を管理する AMQ Streams の CRD リソースおよび RBAC (ロールベースアクセス制御) リソースが必要です。

手順

OpenShift で

strimzi-viewおよびstrimzi-adminクラスターロールを作成します。oc apply -f install/strimzi-admin

必要な場合は、ユーザーに必要なアクセス権限を付与するロールを割り当てます。

oc create clusterrolebinding strimzi-admin --clusterrole=strimzi-admin --user=user1 --user=user2

2.1.5. AMQ Streams のインストール方法

AMQ Streams を OpenShift にインストールする方法は 2 つあります。

| インストール方法 | 説明 | サポート対象バージョン |

|---|---|---|

| インストールアーティファクト (YAML ファイル) |

AMQ Streams のダウンロードサイト から | OpenShift 3.11 以上 |

| OperatorHub | OperatorHub で AMQ Streams Operator を使用し、Cluster Operator を単一またはすべての namespace にデプロイします。 | OpenShift 4.x のみ |

柔軟性が重要な場合は、インストールアーティファクトによる方法を選択します。OpenShift 4 Web コンソールを使用して標準設定で AMQ Streams を OpenShift 4 にインストールする場合は、OperatorHub による方法を選択します。OperatorHub を使用すると、自動更新も利用できます。

どちらの方法でも、Cluster Operator は OpenShift クラスターにデプロイされ、提供される YAML サンプルファイルを使用して、Kafka クラスターから順に AMQ Streams の他のコンポーネントをデプロイする準備が整います。

AMQ Streams インストールアーティファクト

AMQ Streams インストールアーティファクトには、OpenShift にデプロイできるさまざまな YAML ファイルが含まれ、oc を使用して以下を含むカスタムリソースが作成されます。

- デプロイメント

- Custom Resource Definition (CRD)

- ロールおよびロールバインディング

- サービスアカウント

YAML インストールファイルは、Cluster Operator、Topic Operator、User Operator、および Strimzi Admin ロールに提供されます。

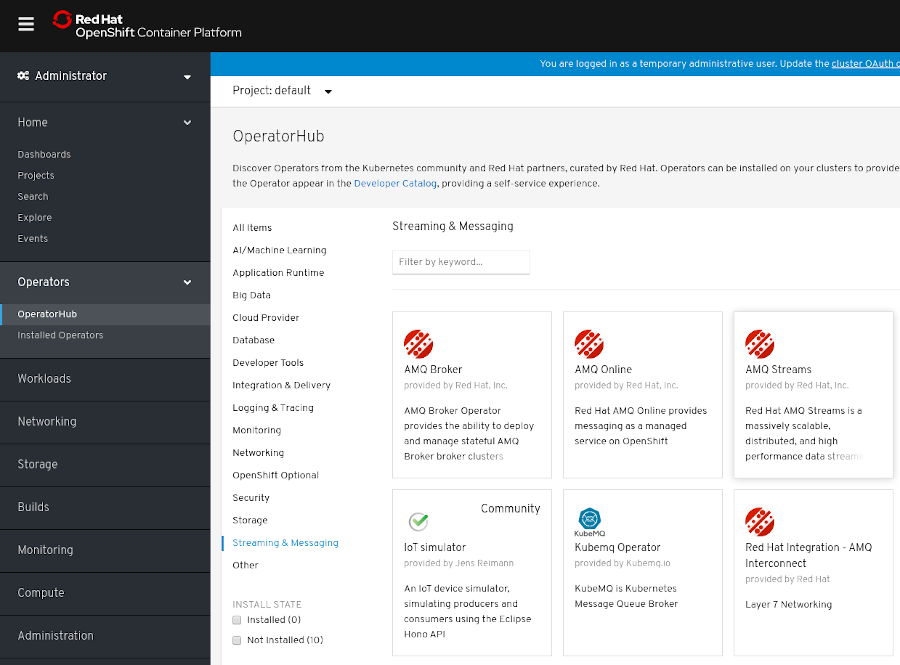

OperatorHub

OpenShift 4 では、Operator Lifecycle Manager (OLM) を使用することにより、クラスター管理者はクラスター全体で実行されるすべての Operator やそれらの関連サービスをインストール、更新、および管理できます。OLM は、Kubernetes のネイティブアプリケーション (Operator) を効率的に自動化された拡張可能な方法で管理するために設計されたオープンソースツールキットの Operator Framework の一部です。

OperatorHub は OpenShift 4 Web コンソールの一部です。クラスター管理者はこれを使用して Operator を検出、インストール、およびアップグレードできます。Operator は OperatorHub からプルでき、単一の (プロジェクト) namespace またはすべての (プロジェクト) namespace への OpenShift クラスターにインストールできます。Operator は OLM で管理できます。エンジニアリングチームは OLM を使用して、独自に開発、テスト、および本番環境でソフトウェアを管理できます。

OperatorHub は、バージョン 4 未満の OpenShift では使用できません。

AMQ Streams Operator

AMQ Streams Operator は OperatorHub からインストールできます。AMQ Streams Operator のインストール後、必要な CRD およびロールベースアクセス制御 (RBAC) リソースと共に Cluster Operator が OpenShift クラスターにデプロイされます。

その他のリソース

インストールアーティファクトを使用した AMQ Streams のインストール:

OperatorHub からの AMQ Streams のインストール:

- 「OperatorHub からの Cluster Operator のデプロイ」

- OpenShift ドキュメントOperator

2.2. Kafka クラスターの作成

Kafka クラスターを作成するには、Cluster Operator をデプロイして Kafka クラスターを管理し、Kafka クラスターをデプロイします。

Kafka リソースを使用して Kafka クラスターをデプロイするときに、Topic Operator および User Operator を同時にデプロイできます。この代わりに、AMQ Streams ではない Kafka クラスターを使用している場合は、Topic Operator および User Operator をスタンドアロンコンポーネントとしてデプロイすることもできます。

Kafka クラスターを Topic Operator および User Operator とデプロイ

AMQ Streams によって管理される Kafka クラスターを Topic Operator および User Operator と使用する場合は、このデプロイメント手順を実行します。

- Cluster Operator をデプロイします。

Cluster Operator を使用して以下をデプロイします。

スタンドアロン Topic Operator および User Operator のデプロイ

AMQ Streams によって管理されない Kafka クラスターを Topic Operator および User Operator と使用する場合は、このデプロイメント手順を実行します。

2.2.1. Cluster Operator のデプロイ

Cluster Operator は、OpenShift クラスター内で Apache Kafka クラスターのデプロイおよび管理を行います。

本セクションの手順は以下を説明します。

以下を監視するよう Cluster Operator をデプロイする方法。

代替のデプロイメント

2.2.1.1. Cluster Operator デプロイメントの監視オプション

Cluster Operator の稼働中に、Kafka リソースの更新に対する監視が開始されます。

Cluster Operator をデプロイして、以下からの Kafka リソースの監視を選択できます。

- 単一の namespace (Cluster Operator が含まれる同じ namespace)

- 複数の namespace

- すべての namespace

AMQ Streams では、デプロイメントの処理を簡単にするため、YAML ファイルのサンプルが提供されます。

Cluster Operator では、以下のリソースの変更が監視されます。

-

Kafka クラスターの

Kafka。 -

Kafka Connect クラスターの

KafkaConnect。 -

Source2Image がサポートされる Kafka Connect クラスターの

KafkaConnectS2I。 -

Kafka Connect クラスターでコネクターを作成および管理するための

KafkaConnector。 -

Kafka MirrorMaker インスタンスの

KafkaMirrorMaker。 -

Kafka Bridge インスタンスの

KafkaBridge。

OpenShift クラスターでこれらのリソースの 1 つが作成されると、Operator によってクラスターの詳細がリソースより取得されます。さらに、StatefulSet、Service、および ConfigMap などの必要な OpenShift リソースが作成され、リソースの新しいクラスターの作成が開始されます。

Kafka リソースが更新されるたびに、リソースのクラスターを設定する OpenShift リソースで該当する更新が Operator によって実行されます。

クラスターの望ましい状態がリソースのクラスターに反映されるようにするため、リソースへのパッチ適用後またはリソースの削除後にリソースが再作成されます。この操作は、サービスの中断を引き起こすローリング更新の原因となる可能性があります。

リソースが削除されると、Operator によってクラスターがアンデプロイされ、関連する OpenShift リソースがすべて削除されます。

2.2.1.2. 単一の namespace を監視対象とする Cluster Operator のデプロイメント

この手順では、OpenShift クラスターの単一の namespace で AMQ Streams リソースを監視するように Cluster Operator をデプロイする方法を説明します。

前提条件

-

この手順では、

CustomResourceDefinitions、ClusterRoles、およびClusterRoleBindingsを作成できる OpenShift ユーザーアカウントを使用する必要があります。通常、OpenShift クラスターでロールベースアクセス制御 (RBAC) を使用する場合、これらのリソースを作成、編集、および削除する権限を持つユーザーはsystem:adminなどの OpenShift クラスター管理者に限定されます。

手順

Cluster Operator がインストールされる namespace を使用するように、AMQ Streams のインストールファイルを編集します。

たとえば、この手順では Cluster Operator は

my-cluster-operator-namespaceという namespace にインストールされます。Linux の場合は、以下を使用します。

sed -i 's/namespace: .*/namespace: my-cluster-operator-namespace/' install/cluster-operator/*RoleBinding*.yamlMacOS の場合は、以下を使用します。

sed -i '' 's/namespace: .*/namespace: my-cluster-operator-namespace/' install/cluster-operator/*RoleBinding*.yamlCluster Operator をデプロイします。

oc apply -f install/cluster-operator -n my-cluster-operator-namespaceCluster Operator が正常にデプロイされたことを確認します。

oc get deployments

2.2.1.3. 複数の namespace を監視対象とする Cluster Operator のデプロイメント

この手順では、OpenShift クラスターの複数の namespace 全体で AMQ Streams リソースを監視するように Cluster Operator をデプロイする方法を説明します。

前提条件

-

この手順では、

CustomResourceDefinitions、ClusterRoles、およびClusterRoleBindingsを作成できる OpenShift ユーザーアカウントを使用する必要があります。通常、OpenShift クラスターでロールベースアクセス制御 (RBAC) を使用する場合、これらのリソースを作成、編集、および削除する権限を持つユーザーはsystem:adminなどの OpenShift クラスター管理者に限定されます。

手順

Cluster Operator がインストールされる namespace を使用するように、AMQ Streams のインストールファイルを編集します。

たとえば、この手順では Cluster Operator は

my-cluster-operator-namespaceという namespace にインストールされます。Linux の場合は、以下を使用します。

sed -i 's/namespace: .*/namespace: my-cluster-operator-namespace/' install/cluster-operator/*RoleBinding*.yamlMacOS の場合は、以下を使用します。

sed -i '' 's/namespace: .*/namespace: my-cluster-operator-namespace/' install/cluster-operator/*RoleBinding*.yamlinstall/cluster-operator/050-Deployment-strimzi-cluster-operator.yamlファイルを編集し、Cluster Operator によって監視されるすべての namespace のリストをSTRIMZI_NAMESPACE環境変数に追加します。たとえば、この手順では Cluster Operator は

watched-namespace-1、watched-namespace-2、およびwatched-namespace-3という namespace を監視します。apiVersion: apps/v1 kind: Deployment spec: # ... template: spec: serviceAccountName: strimzi-cluster-operator containers: - name: strimzi-cluster-operator image: registry.redhat.io/amq7/amq-streams-rhel7-operator:1.5.0 imagePullPolicy: IfNotPresent env: - name: STRIMZI_NAMESPACE value: watched-namespace-1,watched-namespace-2,watched-namespace-3リストした各 namespace に

RoleBindingsをインストールします。この例では、コマンドの

watched-namespaceを前述のステップでリストした namespace に置き換えます。watched-namespace-1、watched-namespace-2、およびwatched-namespace-3に対してこれを行います。oc apply -f install/cluster-operator/020-RoleBinding-strimzi-cluster-operator.yaml -n watched-namespace oc apply -f install/cluster-operator/031-RoleBinding-strimzi-cluster-operator-entity-operator-delegation.yaml -n watched-namespace oc apply -f install/cluster-operator/032-RoleBinding-strimzi-cluster-operator-topic-operator-delegation.yaml -n watched-namespace

Cluster Operator をデプロイします。

oc apply -f install/cluster-operator -n my-cluster-operator-namespaceCluster Operator が正常にデプロイされたことを確認します。

oc get deployments

2.2.1.4. すべての namespace を対象とする Cluster Operator のデプロイメント

この手順では、OpenShift クラスターのすべての namespace 全体で AMQ Streams リソースを監視するように Cluster Operator をデプロイする方法を説明します。

このモードで実行している場合、Cluster Operator によって、新規作成された namespace でクラスターが自動的に管理されます。

前提条件

-

この手順では、

CustomResourceDefinitions、ClusterRoles、およびClusterRoleBindingsを作成できる OpenShift ユーザーアカウントを使用する必要があります。通常、OpenShift クラスターでロールベースアクセス制御 (RBAC) を使用する場合、これらのリソースを作成、編集、および削除する権限を持つユーザーはsystem:adminなどの OpenShift クラスター管理者に限定されます。

手順

Cluster Operator がインストールされる namespace を使用するように、AMQ Streams のインストールファイルを編集します。

たとえば、この手順では Cluster Operator は

my-cluster-operator-namespaceという namespace にインストールされます。Linux の場合は、以下を使用します。

sed -i 's/namespace: .*/namespace: my-cluster-operator-namespace/' install/cluster-operator/*RoleBinding*.yamlMacOS の場合は、以下を使用します。

sed -i '' 's/namespace: .*/namespace: my-cluster-operator-namespace/' install/cluster-operator/*RoleBinding*.yamlinstall/cluster-operator/050-Deployment-strimzi-cluster-operator.yamlファイルを編集し、STRIMZI_NAMESPACE環境変数の値を*に設定します。apiVersion: apps/v1 kind: Deployment spec: # ... template: spec: # ... serviceAccountName: strimzi-cluster-operator containers: - name: strimzi-cluster-operator image: registry.redhat.io/amq7/amq-streams-rhel7-operator:1.5.0 imagePullPolicy: IfNotPresent env: - name: STRIMZI_NAMESPACE value: "*" # ...クラスター全体ですべての namespace にアクセスできる権限を Cluster Operator に付与する

ClusterRoleBindingsを作成します。oc create clusterrolebinding strimzi-cluster-operator-namespaced --clusterrole=strimzi-cluster-operator-namespaced --serviceaccount my-cluster-operator-namespace:strimzi-cluster-operator oc create clusterrolebinding strimzi-cluster-operator-entity-operator-delegation --clusterrole=strimzi-entity-operator --serviceaccount my-cluster-operator-namespace:strimzi-cluster-operator oc create clusterrolebinding strimzi-cluster-operator-topic-operator-delegation --clusterrole=strimzi-topic-operator --serviceaccount my-cluster-operator-namespace:strimzi-cluster-operator

my-cluster-operator-namespaceは、Cluster Operator をインストールする namespace に置き換えます。Cluster Operator を OpenShift クラスターにデプロイします。

oc apply -f install/cluster-operator -n my-cluster-operator-namespaceCluster Operator が正常にデプロイされたことを確認します。

oc get deployments

2.2.1.5. OperatorHub からの Cluster Operator のデプロイ

OperatorHub から AMQ Streams Operator をインストールして、Cluster Operator を OpenShift クラスターにデプロイできます。OperatorHub は OpenShift 4 のみで使用できます

前提条件

-

Red Hat Operator の

OperatorSourceが OpenShift クラスターで有効になっている必要があります。適切なOperatorSourceが有効になっていれば OperatorHub に Red Hat Operator が表示されます。詳細は、Operatorを参照してください。 - インストールには、Operator を OperatorHub からインストールするための権限を持つユーザーが必要です

手順

- OpenShift 4 Web コンソールで、Operators > OperatorHub をクリックします。

Streaming & Messaging カテゴリーの AMQ Streams Operator を検索または閲覧します。

- AMQ Streams タイルをクリックし、右側のサイドバーで Install をクリックします。

Create Operator Subscription 画面で、以下のインストールおよび更新オプションから選択します。

- Installation Mode: AMQ Streams Operator をクラスターのすべての (プロジェクト) namespace にインストール (デフォルト) するか、特定の (プロジェクト) namespace インストールするかを選択します。namespace を使用して関数を分離することが推奨されます。特定の namespace を Kafka クラスターおよびその他の AMQ Streams コンポーネントの専用とすることが推奨されます。

- Approval Strategy: デフォルトでは、OLM (Operator Lifecycle Manager) によって、AMQ Streams Operator が自動的に最新の AMQ Streams バージョンにアップグレードされます。今後のアップグレードを手動で承認する場合は、Manual を選択します。詳細は、OpenShift ドキュメントのOperatorを参照してください。

Subscribe をクリックすると、AMQ Streams Operator が OpenShift クラスターにインストールされます。

AMQ Streams Operator によって、Cluster Operator、CRD、およびロールベースアクセス制御 (RBAC) リソースは選択された namespace またはすべての namespace にデプロイされます。

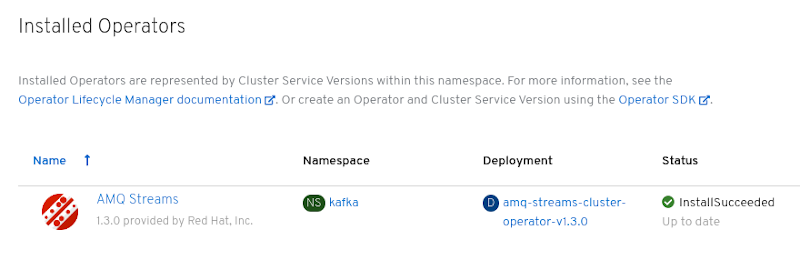

Installed Operators 画面で、インストールの進捗を確認します。AMQ Streams Operator は、ステータスが InstallSucceeded に変更されると使用できます。

次に、YAML サンプルファイルを使用して、Kafka クラスターから順に AMQ Streams の他のコンポーネントをデプロイできます。

2.2.2. Kafka のデプロイ

Apache Kafka は、耐障害性のリアルタイムデータフィードを実現する、オープンソースの分散型 publish/subscribe メッセージングシステムです。

本セクションの手順は以下を説明します。

Cluster Operator を使用して以下をデプロイする方法

- 一時 または 永続 Kafka クラスター

Topic Operator および User Operator (

Kafkaカスタムリソースを設定してデプロイする)

Topic Operator および User Operator の代替のスタンドアロンデプロイメント手順

Kafka をインストールする場合、AMQ Streams によって ZooKeeper クラスターもインストールされ、Kafka と ZooKeeper との接続に必要な設定が追加されます。

2.2.2.1. Kafka クラスターのデプロイメント

この手順では、Cluster Operator を使用して Kafka クラスターを OpenShift にデプロイする方法を説明します。

デプロイメントでは、YAML ファイルの仕様を使って Kafka リソースが作成されます。

AMQ Streams では、デプロイメントの YAML ファイルのサンプルは examples/kafka/ にあります。

kafka-persistent.yaml- 3 つの Zookeeper ノードと 3 つの Kafka ノードを使用して永続クラスターをデプロイします。

kafka-jbod.yaml- それぞれが複数の永続ボリューを使用する、3 つの ZooKeeper ノードと 3 つの Kafka ノードを使用して、永続クラスターをデプロイします。

kafka-persistent-single.yaml- 1 つの ZooKeeper ノードと 1 つの Kafka ノードを使用して、永続クラスターをデプロイします。

kafka-ephemeral.yaml- 3 つの ZooKeeper ノードと 3 つの Kafka ノードを使用して、一時クラスターをデプロイします。

kafka-ephemeral-single.yaml- 3 つの ZooKeeper ノードと 1 つの Kafka ノードを使用して、一時クラスターをデプロイします。

この手順では、一時 および 永続 Kafka クラスターデプロイメントの例を使用します。

- 一時クラスター

-

通常、Kafka の一時クラスターは開発およびテスト環境での使用に適していますが、本番環境での使用には適していません。このデプロイメントでは、ブローカー情報 (ZooKeeper) と、トピックまたはパーティション (Kafka) を格納するための

emptyDirボリュームが使用されます。emptyDirボリュームを使用すると、その内容は厳密に Pod のライフサイクルと関連し、Pod がダウンすると削除されます。 - 永続クラスター

-

Kafka の永続クラスターでは、

PersistentVolumesを使用して ZooKeeper および Kafka データを格納します。PersistentVolumeClaimを使用してPersistentVolumeが取得され、PersistentVolumeの実際のタイプには依存しません。たとえば、YAML ファイルを変更しなくても Amazon AWS デプロイメントで Amazon EBS ボリュームを使用できます。PersistentVolumeClaimでStorageClassを使用し、自動ボリュームプロビジョニングをトリガーすることができます。

サンプルクラスターの名前はデフォルトで my-cluster になります。クラスター名はリソースの名前によって定義され、クラスターがデプロイされた後に変更できません。クラスターをデプロイする前にクラスター名を変更するには、関連する YAML ファイルにある Kafka リソースの Kafka.metadata.name プロパティーを編集します。

apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka metadata: name: my-cluster # ...

Kafka リソースの設定に関する詳細は Kafka クラスターの設定 を参照してください。

手順

一時 または 永続 クラスターを作成およびデプロイします。

開発またはテストでは、一時クラスターの使用が適している可能性があります。永続クラスターはどのような状況でも使用することができます。

一時 クラスターを作成およびデプロイするには、以下を実行します。

oc apply -f examples/kafka/kafka-ephemeral.yaml

永続 クラスターを作成およびデプロイするには、以下を実行します。

oc apply -f examples/kafka/kafka-persistent.yaml

Kafka クラスターが正常にデプロイされたことを確認します。

oc get deployments

2.2.2.2. Cluster Operator を使用した Topic Operator のデプロイ

この手順では、Cluster Operator を使用して Topic Operator をデプロイする方法を説明します。

Kafka リソースの entityOperator プロパティーを設定し、topicOperator が含まれるようにします。

AMQ Streams によって管理されない Kafka クラスターを Topic Operator と使用する場合は、Topic Operator をスタンドアロンコンポーネントとしてデプロイ する必要があります。

entityOperator および topicOperator プロパティーの設定に関する詳細は Entity Operator を参照してください。

手順

KafkaリソースのentityOperatorプロパティーを編集し、topicOperatorが含まれるようにします。apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka metadata: name: my-cluster spec: #... entityOperator: topicOperator: {} userOperator: {}EntityTopicOperatorSpecスキーマ参照に記載されているプロパティーを使用して、Topic Operator のspecを設定します。すべてのプロパティーにデフォルト値を使用する場合は、空のオブジェクト (

{}) を使用します。リソースを作成または更新します。

次のように

oc applyを使用します。oc apply -f <your-file>

2.2.2.3. Cluster Operator を使用した User Operator のデプロイ

この手順では、Cluster Operator を使用して User Operator をデプロイする方法を説明します。

Kafka リソースの entityOperator プロパティーを設定し、userOperator が含まれるようにします。

AMQ Streams によって管理されない Kafka クラスターを User Operator と使用する場合は、User Operator をスタンドアロンコンポーネントとしてデプロイ する必要があります。

entityOperator および userOperator プロパティーの設定に関する詳細は Entity Operator を参照してください。

手順

KafkaリソースのentityOperatorプロパティーを編集し、userOperatorが含まれるようにします。apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka metadata: name: my-cluster spec: #... entityOperator: topicOperator: {} userOperator: {}EntityUserOperatorSpecスキーマ参照 に記載されているプロパティーを使用して、User Operator のspecを設定します。すべてのプロパティーにデフォルト値を使用する場合は、空のオブジェクト (

{}) を使用します。リソースを作成または更新します。

oc apply -f <your-file>

2.2.3. AMQ Streams Operator の代替のスタンドアロンデプロイメントオプション

Cluster Operator を使用して Kafka クラスターをデプロイするときに、Topic Operator および User Operator をデプロイすることもできます。この代わりに、スタンドアロンデプロイメントを行うことができます。

スタンドアロンデプロイメントとは、Topic Operator および User Operator が AMQ Streams によって管理されない Kafka クラスターと操作できることを意味します。

2.2.3.1. スタンドアロン Topic Operator のデプロイ

この手順では、Topic Operator をスタンドアロンコンポーネントとしてデプロイする方法を説明します。

スタンドアロンデプロイメントには、環境変数の設定が必要で、Cluster Operator を使用した Topic Operator のデプロイ よりも複雑です。しかし、Topic Operator は Cluster Operator によってデプロイされた Kafka クラスターに限らず、あらゆる Kafka クラスターと操作できるため、スタンドアロンデプロイメントの柔軟性は高くなります。

前提条件

- Topic Operator が接続する既存の Kafka クラスターが必要です。

手順

以下を設定し、

install/topic-operator/05-Deployment-strimzi-topic-operator.yamlファイルのDeployment.spec.template.spec.containers[0].envプロパティーを編集します。-

STRIMZI_KAFKA_BOOTSTRAP_SERVERS。hostname:portペアのコンマ区切りリストで Kafka クラスターのブートストラップブローカーを指定します。 -

STRIMZI_ZOOKEEPER_CONNECT。hostname:portペアのコンマ区切りリストで ZooKeeper ノードを指定します。これは、Kafka クラスターが使用する ZooKeeper クラスターと同じである必要があります。 -

STRIMZI_NAMESPACE。Operator がKafkaTopicリソースを監視する OpenShift namespace。 -

STRIMZI_RESOURCE_LABELS。Operator によって管理されるKafkaTopicリソースを識別するために使用されるラベルセレクター。 -

STRIMZI_FULL_RECONCILIATION_INTERVAL_MS。定期的な調整の間隔 (秒単位) を指定します。 -

STRIMZI_TOPIC_METADATA_MAX_ATTEMPTS。Kafka からトピックメタデータを取得するための試行回数を指定します。各試行の間隔は、指数バックオフとして定義されます。パーティションまたはレプリカの数によって、トピックの作成に時間がかかる可能性がある場合は、この値を増やすことを検討してください。デフォルトは6です。 -

STRIMZI_ZOOKEEPER_SESSION_TIMEOUT_MS。ZooKeeper セッションのタイムアウト (ミリ秒単位)。例:10000。デフォルトは20000(20 秒) です。 -

STRIMZI_TOPICS_PATH。Topic Operator がそのメタデータを保存する Zookeeper ノードパス。デフォルトは/strimzi/topicsです。 -

STRIMZI_TLS_ENABLED。Kafka ブローカーとの通信を暗号化するために、TLS サポートを有効にします。デフォルトはtrueです。 -

STRIMZI_TRUSTSTORE_LOCATION。TLS ベースの通信を有効にするための証明書が含まれるトラストストアへのパス。TLS がSTRIMZI_TLS_ENABLEDによって有効化された場合のみ必須です。 -

STRIMZI_TRUSTSTORE_PASSWORD。STRIMZI_TRUSTSTORE_LOCATIONで定義されるトラストストアにアクセスするためのパスワード。TLS がSTRIMZI_TLS_ENABLEDによって有効化された場合のみ必須です。 -

STRIMZI_KEYSTORE_LOCATION。TLS ベースの通信を有効にするための秘密鍵が含まれるキーストアへのパス。TLS がSTRIMZI_TLS_ENABLEDによって有効化された場合のみ必須です。 -

STRIMZI_KEYSTORE_PASSWORD。STRIMZI_KEYSTORE_LOCATIONで定義されるキーストアにアクセスするためのパスワード。TLS がSTRIMZI_TLS_ENABLEDによって有効化された場合のみ必須です。 -

STRIMZI_LOG_LEVEL。ロギングメッセージの出力レベル。値は、ERROR、WARNING、INFO、DEBUG、およびTRACEに設定できます。デフォルトはINFOです。 -

STRIMZI_JAVA_OPTS(任意)。Topic Operator を実行する JVM に使用される Java オプション。例:-Xmx=512M -Xms=256M -

STRIMZI_JAVA_SYSTEM_PROPERTIES(任意)。Topic Operator に設定される-Dオプションをリストします。例:-Djavax.net.debug=verbose -DpropertyName=value.

-

Topic Operator をデプロイします。

oc apply -f install/topic-operator

Topic Operator が正常にデプロイされていることを確認します。

oc describe deployment strimzi-topic-operator

Replicas:エントリーに1 availableが表示されれば、Topic Operator はデプロイされています。注記OpenShift への接続が低速な場合やイメージがこれまでダウンロードされたことがない場合は、デプロイメントに遅延が発生することがあります。

2.2.3.2. スタンドアロン User Operator のデプロイ

この手順では、User Operator をスタンドアロンコンポーネントとしてデプロイする方法を説明します。

スタンドアロンデプロイメントには、環境変数の設定が必要で、Cluster Operator を使用した User Operator のデプロイ よりも複雑です。しかし、User Operator は Cluster Operator によってデプロイされた Kafka クラスターに限らず、あらゆる Kafka クラスターと操作できるため、スタンドアロンデプロイメントの柔軟性は高くなります。

前提条件

- User Operator が接続する既存の Kafka クラスターが必要です。

手順

以下を設定し、

install/user-operator/05-Deployment-strimzi-user-operator.yamlファイルのDeployment.spec.template.spec.containers[0].envプロパティーを編集します。-

STRIMZI_KAFKA_BOOTSTRAP_SERVERS。hostname:portペアのコンマ区切りリストで Kafka ブローカーを指定します。 -

STRIMZI_ZOOKEEPER_CONNECT。hostname:portペアのコンマ区切りリストで ZooKeeper ノードを指定します。これは、Kafka クラスターが使用する ZooKeeper クラスターと同じである必要があります。TLS 暗号化で ZooKeeper ノードに接続することはサポートされません。 -

STRIMZI_NAMESPACE。Operator がKafkaUserリソースを監視する OpenShift namespace。 -

STRIMZI_LABELS。Operator によって管理されるKafkaUserリソースを識別するために使用されるラベルセレクター。 -

STRIMZI_FULL_RECONCILIATION_INTERVAL_MS。定期的な調整の間隔 (秒単位) を指定します。 -

STRIMZI_ZOOKEEPER_SESSION_TIMEOUT_MS。ZooKeeper セッションのタイムアウト (ミリ秒単位)。例:10000。デフォルトは20000(20 秒) です。 -

STRIMZI_CA_CERT_NAME。TLS クライアント認証に対して新しいユーザー証明書を署名するための認証局の公開鍵が含まれる OpenShiftSecretを示します。Secretのca.crtキーに、認証局の公開鍵が含まれている必要があります。 -

STRIMZI_CA_KEY_NAME。TLS クライアント認証に対して新しいユーザー証明書を署名するための認証局の秘密鍵が含まれる OpenShiftSecretを示します。Secretのca.crtキーに、認証局の秘密鍵が含まれている必要があります。 -

STRIMZI_CLUSTER_CA_CERT_SECRET_NAME。TLS ベースの通信を有効にするために Kafka ブローカーの証明書の署名に使用される認証局の秘密鍵が含まれる OpenShiftSecretを示します。Secretのca.crtキーに、認証局の公開鍵が含まれている必要があります。この環境変数の設定は任意で、Kafka クラスターとの通信が TLS ベースである場合のみ設定する必要があります。 -

STRIMZI_EO_KEY_SECRET_NAME。Kafka クラスターに対する TLS クライアント認証の秘密鍵と関連する証明書が含まれる OpenShiftSecretを示します。Secretのentity-operator.p12キーに、秘密鍵と証明書が含まれるキーストアが含まれ、entity-operator.passwordキーに関連するパスワードが含まれる必要があります。この環境変数の設定は任意で、Kafka クラスターとの通信が TLS ベースで、TLS のクライアント認証が必要な場合のみ設定する必要があります。 -

STRIMZI_CA_VALIDITY。認証局の有効期限。デフォルトは365日です。 -

STRIMZI_CA_RENEWAL。認証局の更新期限。 -

STRIMZI_LOG_LEVEL。ロギングメッセージの出力レベル。値は、ERROR、WARNING、INFO、DEBUG、およびTRACEに設定できます。デフォルトはINFOです。 -

STRIMZI_GC_LOG_ENABLED。ガベージコレクション (GC) ロギングを有効にします。デフォルトはtrueです。デフォルトでは、古い証明書が期限切れになる前の証明書の更新期間は30日です。 -

STRIMZI_JAVA_OPTS(任意)。User Operator を実行する JVM に使用される Java オプション。例:-Xmx=512M -Xms=256M -

STRIMZI_JAVA_SYSTEM_PROPERTIES(任意)。User Operator に設定される-Dオプションをリストします。例:-Djavax.net.debug=verbose -DpropertyName=value.

-

User Operator をデプロイします。

oc apply -f install/user-operator

User Operator が正常にデプロイされていることを確認します。

oc describe deployment strimzi-user-operator

Replicas:エントリーに1 availableが表示されれば、User Operator はデプロイされています。注記OpenShift への接続が低速な場合やイメージがこれまでダウンロードされたことがない場合は、デプロイメントに遅延が発生することがあります。

2.3. Kafka Connect のデプロイ

Kafka Connect は、Apache Kafka と外部システムとの間でデータをストリーミングするためのツールです。

AMQ Streams では、Kafka Connect は分散 (distributed) モードでデプロイされます。Kafka Connect はスタンドアロンモードでも動作しますが、AMQ Streams ではサポートされません。

Kafka Connect では、コネクター の概念を使用し、スケーラビリティーと信頼性を維持しながら Kafka クラスターで大量のデータを出し入れするためのフレームワークが提供されます。

Kafka Connect は通常、Kafka を外部データベース、ストレージシステム、およびメッセージングシステムと統合するために使用されます。

本セクションの手順では以下の方法を説明します。

コネクター という用語は、Kafka Connect クラスター内で実行されているコネクターインスタンスや、コネクタークラスと同じ意味で使用されます。本ガイドでは、本文の内容で意味が明確である場合に コネクター という用語を使用します。

2.3.1. Kafka Connect の OpenShift クラスターへのデプロイ

この手順では、Cluster Operator を使用して Kafka Connect クラスターを OpenShift クラスターにデプロイする方法を説明します。

Kafka Connect クラスターは、設定可能なノード数 (このノードの別称: ワーカー) を指定して Deployment として実装されます。このノードは、メッセージフローのスケーラビリティーと信頼性が高くなるように、コネクターのワークロードを タスク として分散します。

デプロイメントでは、YAML ファイルの仕様を使って KafkaConnect リソースが作成されます。

この手順では、AMQ Streams にある以下のサンプルファイルを使用します。

-

examples/connect/kafka-connect.yaml

KafkaConnect リソースの設定に関する詳細は以下を参照してください。

手順

Kafka Connect を OpenShift クラスターにデプロイします。

oc apply -f examples/connect/kafka-connect.yaml

Kafka Connect が正常にデプロイされたことを確認します。

oc get deployments

2.3.2. コネクタープラグインでの Kafka Connect の拡張

Kafka Connect の AMQ Streams コンテナーイメージには、ファイルベースのデータを Kafka クラスターで出し入れするために 2 つの組み込みコネクターが含まれています。

| ファイルコネクター | 説明 |

|---|---|

|

| ファイル (ソース) から Kafka クラスターにデータを転送します。 |

|

| Kafka クラスターからファイル (シンク) にデータを転送します。 |

Cluster Operator では、Kafka Connect クラスターを OpenShift クラスターにデプロイするために作成したイメージを使用することもできます。

ここの手順では、以下を行って、独自のコネクタークラスをコネクターイメージに追加する方法を説明します。

Kafka Connect REST API または KafkaConnector カスタムリソースを使用 して直接コネクターの設定を作成します。

2.3.2.1. Kafka Connect ベースイメージからの Docker イメージの作成

この手順では、カスタムイメージを作成し、/opt/kafka/plugins ディレクトリーに追加する方法を説明します。

Red Hat Ecosystem Catalog の Kafka コンテナーイメージを、追加のコネクタープラグインで独自のカスタムイメージを作成するためのベースイメージとして使用できます。

AMQ Stream バージョンの Kafka Connect は起動時に、/opt/kafka/plugins ディレクトリーに含まれるサードパーティーのコネクタープラグインをロードします。

手順

registry.redhat.io/amq7/amq-streams-kafka-25-rhel7:1.5.0をベースイメージとして使用して、新規のDockerfileを作成します。FROM registry.redhat.io/amq7/amq-streams-kafka-25-rhel7:1.5.0 USER root:root COPY ./my-plugins/ /opt/kafka/plugins/ USER 1001プラグインファイルの例

$ tree ./my-plugins/ ./my-plugins/ ├── debezium-connector-mongodb │ ├── bson-3.4.2.jar │ ├── CHANGELOG.md │ ├── CONTRIBUTE.md │ ├── COPYRIGHT.txt │ ├── debezium-connector-mongodb-0.7.1.jar │ ├── debezium-core-0.7.1.jar │ ├── LICENSE.txt │ ├── mongodb-driver-3.4.2.jar │ ├── mongodb-driver-core-3.4.2.jar │ └── README.md ├── debezium-connector-mysql │ ├── CHANGELOG.md │ ├── CONTRIBUTE.md │ ├── COPYRIGHT.txt │ ├── debezium-connector-mysql-0.7.1.jar │ ├── debezium-core-0.7.1.jar │ ├── LICENSE.txt │ ├── mysql-binlog-connector-java-0.13.0.jar │ ├── mysql-connector-java-5.1.40.jar │ ├── README.md │ └── wkb-1.0.2.jar └── debezium-connector-postgres ├── CHANGELOG.md ├── CONTRIBUTE.md ├── COPYRIGHT.txt ├── debezium-connector-postgres-0.7.1.jar ├── debezium-core-0.7.1.jar ├── LICENSE.txt ├── postgresql-42.0.0.jar ├── protobuf-java-2.6.1.jar └── README.md

- コンテナーイメージをビルドします。

- カスタムイメージをコンテナーレジストリーにプッシュします。

新しいコンテナーイメージを示します。

以下のいずれかを行います。

KafkaConnectカスタムリソースのKafkaConnect.spec.imageプロパティーを編集します。設定された場合、このプロパティーによって Cluster Operator の

STRIMZI_KAFKA_CONNECT_IMAGES変数がオーバーライドされます。apiVersion: kafka.strimzi.io/v1beta1 kind: KafkaConnect metadata: name: my-connect-cluster spec: 1 #... image: my-new-container-image 2 config: 3 #...

または

-

install/cluster-operator/050-Deployment-strimzi-cluster-operator.yamlファイルのSTRIMZI_KAFKA_CONNECT_IMAGES変数を編集して新しいコンテナーイメージを示すようにした後、Cluster Operator を再インストールします。

その他のリソース

-

KafkaConnect.spec.image propertyの詳細は、コンテナーイメージ を参照してください。 -

STRIMZI_KAFKA_CONNECT_IMAGES変数の詳細は、Cluster Operator の設定 を参照してください。

2.3.2.2. OpenShift ビルドおよび S2I (Source-to-Image) を使用したコンテナーイメージの作成

この手順では、OpenShift ビルド と S2I (Source-to-Image) フレームワークを使用して、新しいコンテナーイメージを作成する方法を説明します。

OpenShift ビルドは、S2I がサポートされるビルダーイメージとともに、ユーザー提供のソースコードおよびバイナリーを取得し、これらを使用して新しいコンテナーイメージを構築します。構築後、コンテナーイメージは OpenShfit のローカルコンテナーイメージリポジトリーに格納され、デプロイメントで使用可能になります。

S2I がサポートされる Kafka Connect ビルダーイメージは、registry.redhat.io/amq7/amq-streams-kafka-25-rhel7:1.5.0 イメージの一部として、Red Hat Ecosystem Catalog で提供されます。この S2I イメージは、バイナリー (プラグインおよびコネクターとともに) を取得し、/tmp/kafka-plugins/s2i ディレクトリーに格納されます。このディレクトリーから、Kafka Connect デプロイメントとともに使用できる新しい Kafka Connect イメージを作成します。改良されたイメージの使用を開始すると、Kafka Connect は /tmp/kafka-plugins/s2i ディレクトリーからサードパーティープラグインをロードします。

手順

コマンドラインで

oc applyコマンドを使用し、Kafka Connect の S2I クラスターを作成およびデプロイします。oc apply -f examples/connect/kafka-connect-s2i.yaml

Kafka Connect プラグインでディレクトリーを作成します。

$ tree ./my-plugins/ ./my-plugins/ ├── debezium-connector-mongodb │ ├── bson-3.4.2.jar │ ├── CHANGELOG.md │ ├── CONTRIBUTE.md │ ├── COPYRIGHT.txt │ ├── debezium-connector-mongodb-0.7.1.jar │ ├── debezium-core-0.7.1.jar │ ├── LICENSE.txt │ ├── mongodb-driver-3.4.2.jar │ ├── mongodb-driver-core-3.4.2.jar │ └── README.md ├── debezium-connector-mysql │ ├── CHANGELOG.md │ ├── CONTRIBUTE.md │ ├── COPYRIGHT.txt │ ├── debezium-connector-mysql-0.7.1.jar │ ├── debezium-core-0.7.1.jar │ ├── LICENSE.txt │ ├── mysql-binlog-connector-java-0.13.0.jar │ ├── mysql-connector-java-5.1.40.jar │ ├── README.md │ └── wkb-1.0.2.jar └── debezium-connector-postgres ├── CHANGELOG.md ├── CONTRIBUTE.md ├── COPYRIGHT.txt ├── debezium-connector-postgres-0.7.1.jar ├── debezium-core-0.7.1.jar ├── LICENSE.txt ├── postgresql-42.0.0.jar ├── protobuf-java-2.6.1.jar └── README.md

oc start-buildコマンドで、準備したディレクトリーを使用してイメージの新しいビルドを開始します。oc start-build my-connect-cluster-connect --from-dir ./my-plugins/

注記ビルドの名前は、デプロイされた Kafka Connect クラスターと同じになります。

- ビルドが完了したら、Kafka Connect のデプロイメントによって新しいイメージが自動的に使用されます。

2.3.3. コネクターの作成および管理

コネクタープラグインのコンテナーイメージを作成したら、Kafka Connect クラスターにコネクターインスタンスを作成する必要があります。その後、稼働中のコネクターインスタンスを設定、監視、および管理できます。

コネクターは特定の コネクタークラス のインスタンスで、関連のある外部システムとメッセージについて通信する方法を認識しています。コネクターは多くの外部システムで使用でき、独自のコネクターを作成することもできます。

ソース および シンク タイプのコネクターを作成できます。

- ソースコネクター

- ソースコネクターは、外部システムからデータを取得し、それをメッセージとして Kafka に提供するランタイムエンティティーです。

- シンクコネクター

- シンクコネクターは、Kafka トピックからメッセージを取得し、外部システムに提供するランタイムエンティティーです。

AMQ Streams では、コネクターの作成および管理に 2 つの API が提供されます。

-

KafkaConnectorリソース (KafkaConnectorsと呼ばれます) - Kafka Connect REST API

API を使用すると、以下を行うことができます。

- コネクターインスタンスのステータスの確認。

- 稼働中のコネクターの再設定。

- コネクターインスタンスのタスク数の増減。

-

失敗したタスクの再起動 (

KafkaConnectorリソースによってサポートされません)。 - コネクターインスタンスの一時停止。

- 一時停止したコネクターインスタンスの再開。

- コネクターインスタンスの削除。

2.3.3.1. KafkaConnector リソース

KafkaConnectors を使用すると、Kafka Connect のコネクターインスタンスを OpenShift ネイティブに作成および管理できるため、cURL などの HTTP クライアントが必要ありません。その他の Kafka リソースと同様に、コネクターの望ましい状態を OpenShift クラスターにデプロイされた KafkaConnector YAML ファイルに宣言し、コネクターインスタンスを作成します。

該当する KafkaConnector を更新して稼働中のコネクターインスタンスを管理した後、更新を適用します。該当する KafkaConnector を削除して、コネクターを削除します。

これまでのバージョンの AMQ Streams との互換性を維持するため、KafkaConnectors はデフォルトで無効になっています。Kafka Connect クラスターのために有効にするには、KafkaConnect リソースでアノテーションを使用する必要があります。手順は KafkaConnector リソースの有効化 を参照してください。

KafkaConnectors が有効になると、Cluster Operator によって監視が開始されます。KafkaConnectors に定義された設定と一致するよう、稼働中のコネクターインスタンスの設定を更新します。

AMQ Streams には、examples/connect/source-connector.yaml という名前のサンプル KafkaConnector が含まれます。このサンプルを使用して、FileStreamSourceConnector を作成および管理できます。

2.3.3.2. Kafka Connect REST API の可用性

Kafka Connect REST API は、<connect-cluster-name>-connect-api サービスとして 8083 番ポートで使用できます。

KafkaConnectors が有効になっている場合、Kafka Connect REST API に直接手作業で追加された変更は Cluster Operator によって元に戻されます。

REST API でサポートされる操作は、Apache Kafka のドキュメント を参照してください。

2.3.4. KafkaConnector リソースの Kafka Connect へのデプロイ

この手順では、KafkaConnector の例を Kafka Connect クラスターにデプロイする方法を説明します。

YAML の例によって FileStreamSourceConnector が作成され、ライセンスファイルの各行が my-topic という名前のトピックでメッセージとして Kafka に送信されます。

前提条件

-

KafkaConnectorsが有効になっている Kafka Connect デプロイメントが必要です。 - 稼働中の Cluster Operator が必要です。

手順

examples/connect/source-connector.yamlファイルを編集します。apiVersion: kafka.strimzi.io/v1alpha1 kind: KafkaConnector metadata: name: my-source-connector 1 labels: strimzi.io/cluster: my-connect-cluster 2 spec: class: org.apache.kafka.connect.file.FileStreamSourceConnector 3 tasksMax: 2 4 config: 5 file: "/opt/kafka/LICENSE" topic: my-topic # ...

OpenShift クラスターで

KafkaConnectorを作成します。oc apply -f examples/connect/source-connector.yaml

リソースが作成されたことを確認します。

oc get kctr --selector strimzi.io/cluster=my-connect-cluster -o name

2.4. Kafka MirrorMaker のデプロイ

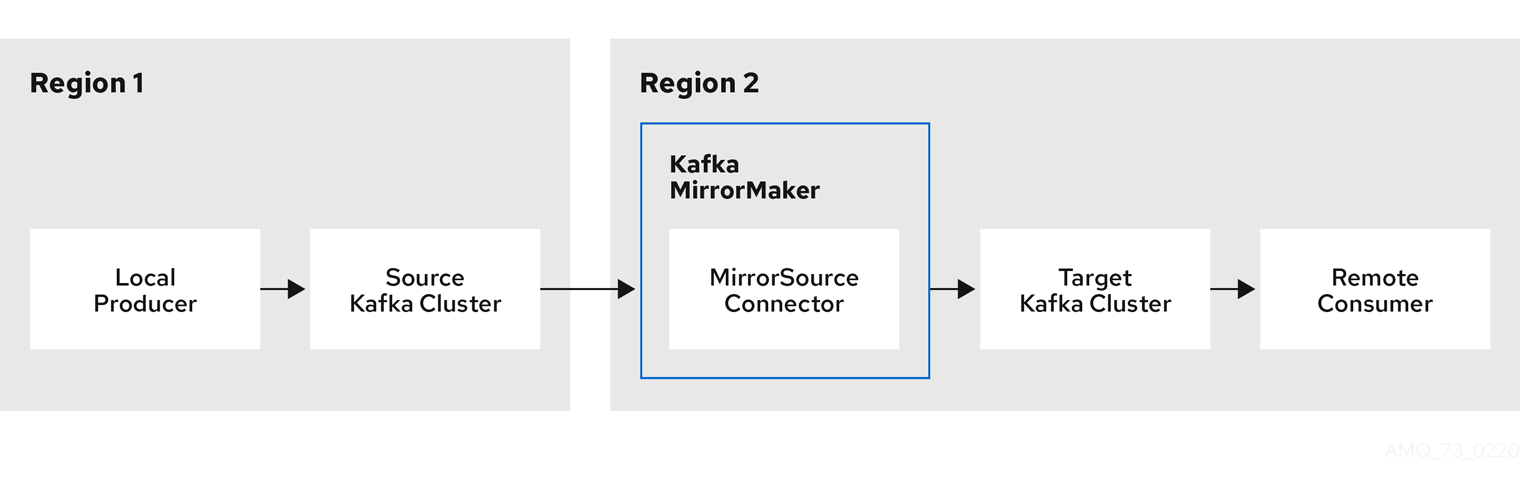

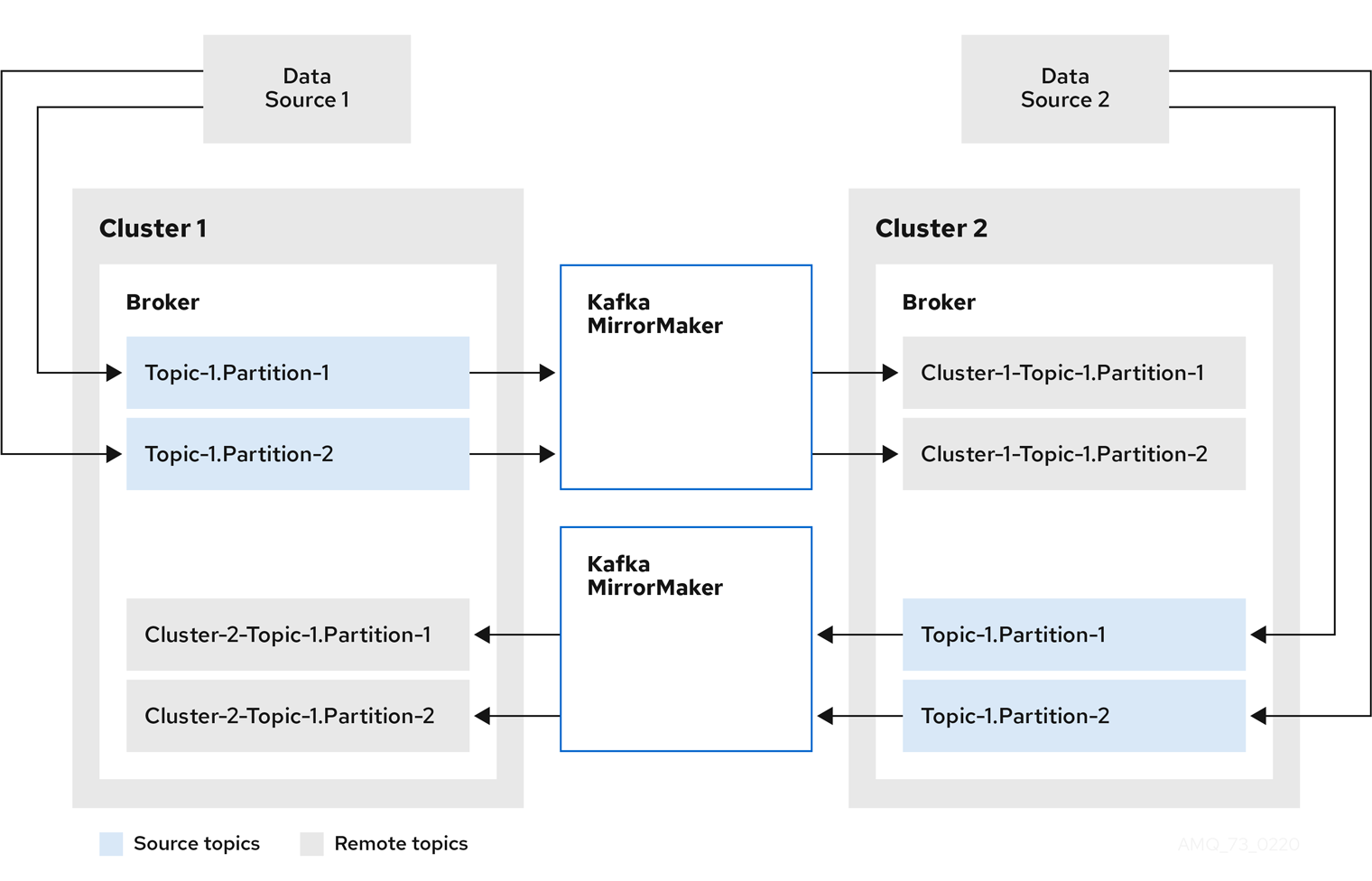

Cluster Operator によって、1 つ以上の Kafka MirrorMaker のレプリカがデプロイされ、Kafka クラスターの間でデータが複製されます。このプロセスはミラーリングと言われ、Kafka パーティションのレプリケーションの概念と混同しないようにします。MirrorMaker は、ソースクラスターからメッセージを消費し、これらのメッセージをターゲットクラスターにパブリッシュします。

2.4.1. Kafka MirrorMaker の OpenShift クラスターへのデプロイ

この手順では、Cluster Operator を使用して Kafka MirrorMaker クラスターを OpenShift クラスターにデプロイする方法を説明します。

デプロイメントでは、YAML ファイルの仕様を使って、デプロイされた MirrorMaker のバージョンに応じて KafkaMirrorMaker または KafkaMirrorMaker2 リソースが作成されます。

この手順では、AMQ Streams にある以下のサンプルファイルを使用します。

-

examples/mirror-maker/kafka-mirror-maker.yaml -

examples/mirror-maker/kafka-mirror-maker-2.yaml

KafkaMirrorMaker または KafkaMirrorMaker2 リソースの設定に関する詳細は Kafka MirrorMaker の設定 を参照してください。

手順

Kafka MirrorMaker を OpenShift クラスターにデプロイします。

MirrorMaker の場合

oc apply -f examples/mirror-maker/kafka-mirror-maker.yaml

MirrorMaker 2.0 の場合

oc apply -f examples/mirror-maker/kafka-mirror-maker-2.yaml

MirrorMaker が正常にデプロイされたことを確認します。

oc get deployments

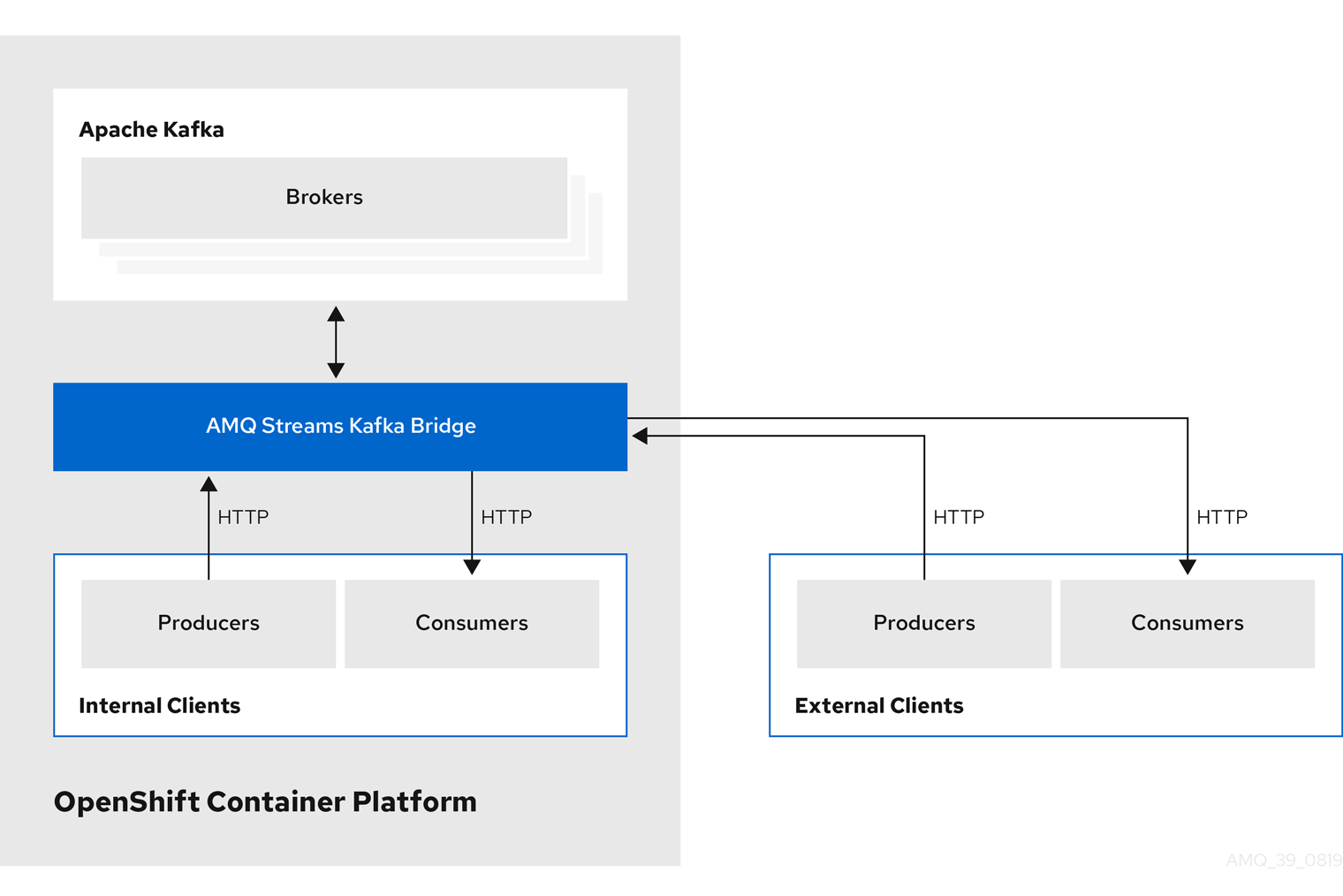

2.5. Kafka Bridge のデプロイ

Cluster Operator によって、1 つ以上の Kafka Bridge のレプリカがデプロイされ、HTTP API 経由で Kafka クラスターとクライアントの間でデータが送信されます。

2.5.1. Kafka Bridge を OpenShift クラスターへデプロイ

この手順では、Cluster Operator を使用して Kafka Bridge クラスターを OpenShift クラスターにデプロイする方法を説明します。

デプロイメントでは、YAML ファイルの仕様を使って KafkaBridge リソースが作成されます。

この手順では、AMQ Streams にある以下のサンプルファイルを使用します。

-

examples/bridge/kafka-bridge.yaml

KafkaBridge リソースの設定に関する詳細は Kafka Bridge の設定 を参照してください。

手順

Kafka Bridge を OpenShift クラスターにデプロイします。

oc apply -f examples/bridge/kafka-bridge.yaml

Kafka Bridge が正常にデプロイされたことを確認します。

oc get deployments

2.6. サンプルクライアントのデプロイ

この手順では、ユーザーが作成した Kafka クラスターを使用してメッセージを送受信するプロデューサーおよびコンシューマークライアントの例をデプロイする方法を説明します。

前提条件

- クライアントが Kafka クラスターを使用できる。

手順

Kafka プロデューサーをデプロイします。

oc run kafka-producer -ti --image=registry.redhat.io/amq7/amq-streams-kafka-25-rhel7:1.5.0 --rm=true --restart=Never -- bin/kafka-console-producer.sh --broker-list cluster-name-kafka-bootstrap:9092 --topic my-topic

- プロデューサーが稼働しているコンソールにメッセージを入力します。

- Enter を押してメッセージを送信します。

Kafka コンシューマーをデプロイします。

oc run kafka-consumer -ti --image=registry.redhat.io/amq7/amq-streams-kafka-25-rhel7:1.5.0 --rm=true --restart=Never -- bin/kafka-console-consumer.sh --bootstrap-server cluster-name-kafka-bootstrap:9092 --topic my-topic --from-beginning

- コンシューマーコンソールに受信メッセージが表示されることを確認します。

第3章 デプロイメント設定

本章では、サポートされるデプロイメントの異なる側面を設定する方法について説明します。

- Kafka クラスター

- Kafka Connect クラスター

- Source2Image がサポートされる Kafka Connect クラスター

- Kafka Mirror Maker

- Kafka Bridge

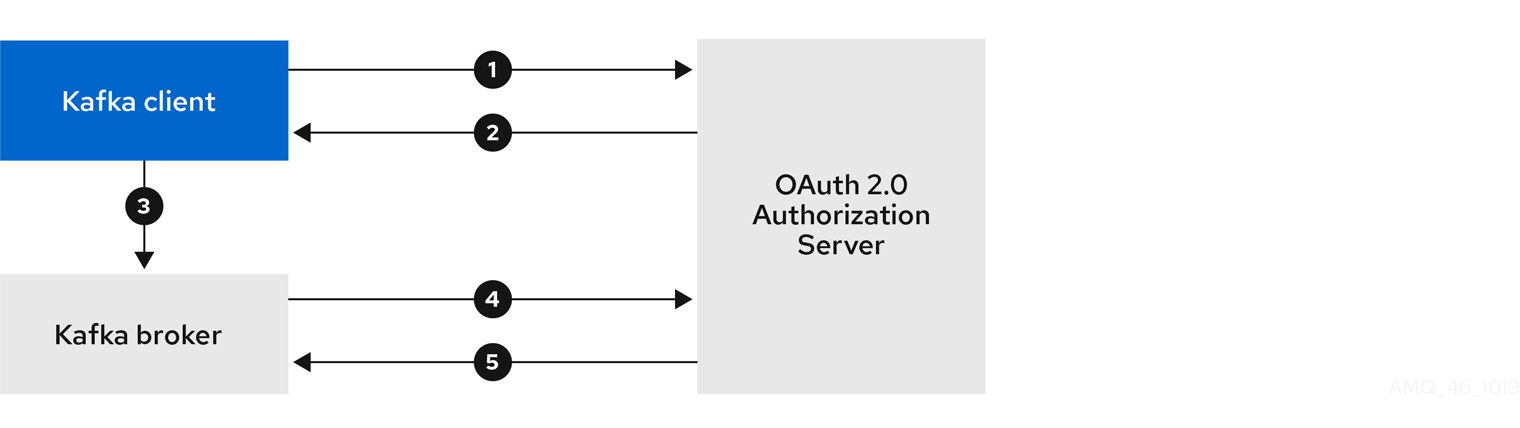

- OAuth 2.0 のトークンベースの認証

- OAuth 2.0 のトークンベースの承認

3.1. Kafka クラスターの設定

Kafka リソースの完全なスキーマは 「Kafka スキーマ参照」 に記載されています。指定の Kafka リソースに適用されたすべてのラベルは、Kafka クラスターを設定する OpenShift リソースにも適用されます。そのため、必要に応じてリソースにラベルが適用されるため便利です。

3.1.1. Kafka YAML の設定例

Kafka デプロイメントで利用可能な設定オプションを理解するには、ここに提供されるサンプル YAML ファイルを参照してください。

例では、可能な設定オプションの一部のみを取り上げますが、特に重要なオプションは次のとおりです。

- リソース要求 (CPU/メモリー)

- 最大および最小メモリー割り当ての JVM オプション

- リスナー (および認証)

- 認証

- ストレージ

- ラックアウェアネス

- メトリクス

apiVersion: kafka.strimzi.io/v1beta1

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

replicas: 3 1

version: 1.5 2

resources: 3

requests:

memory: 64Gi

cpu: "8"

limits: 4

memory: 64Gi

cpu: "12"

jvmOptions: 5

-Xms: 8192m

-Xmx: 8192m

listeners: 6

tls:

authentication:7

type: tls

external: 8

type: route

authentication:

type: tls

configuration:

brokerCertChainAndKey: 9

secretName: my-secret

certificate: my-certificate.crt

key: my-key.key

authorization: 10

type: simple

config: 11

auto.create.topics.enable: "false"

offsets.topic.replication.factor: 3

transaction.state.log.replication.factor: 3

transaction.state.log.min.isr: 2

ssl.cipher.suites: "TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384" 12

ssl.enabled.protocols: "TLSv1.2"

ssl.protocol: "TLSv1.2"

storage: 13

type: persistent-claim 14

size: 10000Gi 15

rack: 16

topologyKey: failure-domain.beta.kubernetes.io/zone

metrics: 17

lowercaseOutputName: true

rules: 18

# Special cases and very specific rules

- pattern : kafka.server<type=(.+), name=(.+), clientId=(.+), topic=(.+), partition=(.*)><>Value

name: kafka_server_$1_$2

type: GAUGE

labels:

clientId: "$3"

topic: "$4"

partition: "$5"

# ...

zookeeper: 19

replicas: 3

resources:

requests:

memory: 8Gi

cpu: "2"

limits:

memory: 8Gi

cpu: "2"

jvmOptions:

-Xms: 4096m

-Xmx: 4096m

storage:

type: persistent-claim

size: 1000Gi

metrics:

# ...

entityOperator: 20

topicOperator:

resources:

requests:

memory: 512Mi

cpu: "1"

limits:

memory: 512Mi

cpu: "1"

userOperator:

resources:

requests:

memory: 512Mi

cpu: "1"

limits:

memory: 512Mi

cpu: "1"

kafkaExporter: 21

# ...

cruiseControl: 22

# ...- 1

- レプリカは、ブローカーノードの数を指定 します。

- 2

- アップグレード手順にしたがうと変更できる Kafka バージョン。

- 3

- リソース要求は、指定のコンテナーに対して予約するリソースを指定 します。

- 4

- リソースの制限は、コンテナーによって消費可能な最大リソースを指定します。

- 5

- JVM オプションは、JVM の最小 (

-Xms) および最大 (-Xmx) メモリー割り当てを指定 できます。 - 6

- リスナーは、ブートストラップアドレスでクライアントが Kafka クラスターに接続する方法を設定します。リスナーは、

plain(暗号化なし)、tls、またはexternalとして設定 されます。 - 7

- リスナーの認証メカニズムは各リスナーに対して設定でき、相互 TLS または SCRAM-SHA として指定 できます。

- 8

- 外部リスナー設定は、

route、loadbalancer、またはnodeportからなど、Kafka クラスターが外部の OpenShift に公開される方法 を指定します。 - 9

- 外部の認証局によって管理される Kafka リスナー証明書 の任意設定。

brokerCertChainAndKeyプロパティーは、サーバー証明書および秘密鍵を保持するSecretを指定します。Kafka リスナー証明書も TLS リスナーに対して設定できます。 - 10

- 11

- 設定によって、ブローカー設定が指定されます。標準の Apache Kafka 設定が提供されることがあり、AMQ Streams によって直接管理されないプロパティーに限定されます。

- 12

- 13

- ストレージは、

ephemeral、persistent-claim、またはjbodとして設定 されます。 - 14

- 15

- 16

- ラックアウェアネスは、異なるラック全体でレプリカを分散 ために設定されます。

topologyキーはクラスターノードのラベルと一致する必要があります。 - 17

- 18

- JMX Exporter でメトリクスを Grafana ダッシュボードにエクスポートする Kafka ルール。AMQ Streams によって提供されるルールのセットは Kafka リソース設定にコピーされることがあります。

- 19

- Kafka 設定と似たプロパティーが含まれる、ZooKeeper 固有の設定。

- 20

- Topic Operator および User Operator の設定を指定する、Entity Operator 設定。

- 21

- データを Prometheus メトリクスとして公開するために 使用される Kafka Exporter 設定。

- 22

- Kafka クラスターのリバランス を行うために使用される Cruise Control。

3.1.2. データストレージに関する留意事項

効率的なデータストレージインフラストラクチャーは、AMQ Streams のパフォーマンスを最適化するために不可欠です。

ブロックストレージが必要です。NFS などのファイルストレージは、Kafka では機能しません。

ブロックストレージには、以下などを選択できます。

- Amazon Elastic Block Store (EBS) などのクラウドベースのブロックストレージソリューション。

- ローカルの永続ボリューム。

- ファイバーチャネル や iSCSI などのプロトコルがアクセスする SAN (ストレージエリアネットワーク) ボリューム。

AMQ Streams には OpenShift の raw ブロックボリュームは必要ありません。

3.1.2.1. ファイルシステム

XFS ファイルシステムを使用するようにストレージシステムを設定することが推奨されます。AMQ Streams は ext4 ファイルシステムとも互換性がありますが、最適化するには追加の設定が必要になることがあります。

3.1.2.2. Apache Kafka および ZooKeeper ストレージ

Apache Kafka と ZooKeeper には別々のディスクを使用します。

3 種類のデータストレージがサポートされます。

- 一時データストレージ (開発用のみで推奨されます)

- 永続データストレージ

- JBOD (Just a Bunch of Disks、Kafka のみに適しています)

詳細は Kafka および ZooKeeper ストレージ を参照してください。

ソリッドステートドライブ (SSD) は必須ではありませんが、複数のトピックに対してデータが非同期的に送受信される大規模なクラスターで Kafka のパフォーマンスを向上させることができます。SSD は、高速で低レイテンシーのデータアクセスが必要な ZooKeeper で特に有効です。

Kafka と ZooKeeper の両方にデータレプリケーションが組み込まれているため、複製されたストレージのプロビジョニングは必要ありません。

3.1.3. Kafka および ZooKeeper のストレージタイプ

Kafka および ZooKeeper はステートフルなアプリケーションであるため、データをディスクに格納する必要があります。AMQ Streams では、3 つのタイプのストレージがサポートされます。

- 一時ストレージ

- 永続ストレージ

- JBOD ストレージ

JBOD ストレージは Kafka でのみサポートされ、ZooKeeper ではサポートされません。

Kafka リソースを設定する場合、Kafka ブローカーおよび対応する ZooKeeper ノードで使用されるストレージのタイプを指定できます。以下のリソースの storage プロパティーを使用して、ストレージタイプを設定します。

-

Kafka.spec.kafka -

Kafka.spec.zookeeper

ストレージタイプは type フィールドで設定されます。

Kafka クラスターをデプロイした後に、ストレージタイプを変更することはできません。

関連情報

- 一時ストレージの詳細は、一時ストレージのスキーマ参照 を参照してください。

- 永続ストレージの詳細は、永続ストレージのスキーマ参照 を参照してください。

- JBOD ストレージの詳細は、JBOD の スキーマ参照 を参照してください。

-

Kafkaのスキーマに関する詳細は、Kafkaのスキーマ参照 を参照してください。

3.1.3.1. 一時ストレージ

一時ストレージは `emptyDir` ボリュームを使用してデータを保存します。一時ストレージを使用するには、type フィールドを ephemeral に設定する必要があります。

emptyDir ボリュームは永続的ではなく、保存されたデータは Pod の再起動時に失われます。新規 Pod の起動後に、クラスターの他のノードからすべてのデータを復元する必要があります。一時ストレージは、単一ノードの ZooKeeper クラスターやレプリケーション係数が 1 の Kafka トピックでの使用には適していません。これはデータが損失する原因となるからです。

一時ストレージの例

apiVersion: kafka.strimzi.io/v1beta1

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

storage:

type: ephemeral

# ...

zookeeper:

# ...

storage:

type: ephemeral

# ...

3.1.3.1.1. ログディレクトリー

一時ボリュームは、以下のパスにマウントされるログディレクトリーとして Kafka ブローカーによって使用されます。

/var/lib/kafka/data/kafka-log_idx_-

idxは、Kafka ブローカー Pod インデックスです。たとえば、/var/lib/kafka/data/kafka-log0のようになります。

3.1.3.2. 永続ストレージ

永続ストレージは Persistent Volume Claim (永続ボリューム要求、PVC) を使用して、データを保存するための永続ボリュームをプロビジョニングします。永続ボリューム要求を使用すると、ボリュームのプロビジョニングを行う ストレージクラス に応じて、さまざまなタイプのボリュームをプロビジョニングできます。永続ボリューム要求と使用できるデータタイプには、多くのタイプの SAN ストレージや ローカル永続ボリューム などがあります。

永続ストレージを使用するには、type を persistent-claim に設定する必要があります。永続ストレージでは、追加の設定オプションがサポートされます。

id(任意)-

ストレージ ID 番号。このオプションは、JBOD ストレージ宣言で定義されるストレージボリュームには必須です。デフォルトは

0です。 size(必須)- 永続ボリューム要求のサイズを定義します (例: 1000Gi)。

class(任意)- 動的ボリュームプロビジョニングに使用する OpenShift の ストレージクラス。

selector(任意)- 使用する特定の永続ボリュームを選択できます。このようなボリュームを選択するラベルを表す key:value ペアが含まれます。

deleteClaim(任意)-

クラスターのアンデプロイ時に永続ボリューム要求を削除する必要があるかどうかを指定するブール値。デフォルトは

falseです。

既存の AMQ Streams クラスターで永続ボリュームのサイズを増やすことは、永続ボリュームのサイズ変更をサポートする OpenShift バージョンでのみサポートされます。サイズを変更する永続ボリュームには、ボリューム拡張をサポートするストレージクラスを使用する必要があります。ボリューム拡張をサポートしないその他のバージョンの OpenShift およびストレージクラスでは、クラスターをデプロイする前に必要なストレージサイズを決定する必要があります。既存の永続ボリュームのサイズを縮小することはできません。

size が 1000Gi の永続ストレージ設定の例 (抜粋)

# ... storage: type: persistent-claim size: 1000Gi # ...

以下の例は、ストレージクラスの使用例を示しています。

特定のストレージクラスを指定する永続ストレージ設定の例 (抜粋)

# ... storage: type: persistent-claim size: 1Gi class: my-storage-class # ...

最後に、selector を使用して特定のラベルが付いた永続ボリュームを選択し、SSD などの必要な機能を提供できます。

セレクターを指定する永続ストレージ設定の例 (抜粋)

# ...

storage:

type: persistent-claim

size: 1Gi

selector:

hdd-type: ssd

deleteClaim: true

# ...

3.1.3.2.1. ストレージクラスのオーバーライド

デフォルトのストレージクラスを使用する代わりに、1 つ以上の Kafka ブローカーに異なるストレージクラスを指定できます。これは、ストレージクラスが、異なるアベイラビリティーゾーンやデータセンターに制限されている場合などに便利です。この場合、overrides フィールドを使用できます。

以下の例では、デフォルトのストレージクラスの名前は my-storage-class になります。

ストレージクラスのオーバーライドを使用した AMQ Streams クラスターの例

apiVersion: kafka.strimzi.io/v1beta1

kind: Kafka

metadata:

labels:

app: my-cluster

name: my-cluster

namespace: myproject

spec:

# ...

kafka:

replicas: 3

storage:

deleteClaim: true

size: 100Gi

type: persistent-claim

class: my-storage-class

overrides:

- broker: 0

class: my-storage-class-zone-1a

- broker: 1

class: my-storage-class-zone-1b

- broker: 2

class: my-storage-class-zone-1c

# ...

overrides プロパティーが設定され、ブローカーボリュームによって以下のストレージクラスが使用されます。

-

broker 0 の永続ボリュームでは

my-storage-class-zone-1aが使用されます。 -

broker 1 の永続ボリュームでは

my-storage-class-zone-1bが使用されます。 -

broker 2 の永続ボリュームでは

my-storage-class-zone-1cが使用されます。

現在、overrides プロパティーは、ストレージクラスの設定をオーバーライドするためのみに使用されます。他のストレージ設定フィールドのオーバーライドは現在サポートされていません。ストレージ設定の他のフィールドは現在サポートされていません。

3.1.3.2.2. 永続ボリューム要求の命名

永続ストレージが使用されると、以下の名前で永続ボリューム要求が作成されます。

data-cluster-name-kafka-idx-

Kafka ブローカー Pod

idxのデータを保存するために使用されるボリュームの永続ボリューム要求です。 data-cluster-name-zookeeper-idx-

ZooKeeper ノード Pod

idxのデータを保存するために使用されるボリュームの永続ボリューム要求です。

3.1.3.2.3. ログディレクトリー

永続ボリュームは、以下のパスにマウントされるログディレクトリーとして Kafka ブローカーによって使用されます。

/var/lib/kafka/data/kafka-log_idx_-

idxは、Kafka ブローカー Pod インデックスです。たとえば、/var/lib/kafka/data/kafka-log0のようになります。

3.1.3.3. 永続ボリュームのサイズ変更

既存の AMQ Streams クラスターによって使用される永続ボリュームのサイズを増やすことで、ストレージ容量を増やすことができます。永続ボリュームのサイズ変更は、JBOD ストレージ設定で 1 つまたは複数の永続ボリュームが使用されるクラスターでサポートされます。

永続ボリュームのサイズを拡張することはできますが、縮小することはできません。永続ボリュームのサイズ縮小は、現在 OpenShift ではサポートされていません。

前提条件

- ボリュームのサイズ変更をサポートする OpenShift クラスター。

- Cluster Operator が稼働中です。

- ボリューム拡張をサポートするストレージクラスを使用して作成された永続ボリュームを使用する Kafka クラスター。

手順

Kafkaリソースで、Kafka クラスター、ZooKeeper クラスター、またはその両方に割り当てられた永続ボリュームのサイズを増やします。-

Kafka クラスターに割り当てられたボリュームサイズを増やすには、

spec.kafka.storageプロパティーを編集します。 ZooKeeper クラスターに割り当てたボリュームサイズを増やすには、

spec.zookeeper.storageプロパティーを編集します。たとえば、ボリュームサイズを

1000Giから2000Giに増やすには、以下のように編集します。apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: persistent-claim size: 2000Gi class: my-storage-class # ... zookeeper: # ...

-

Kafka クラスターに割り当てられたボリュームサイズを増やすには、

リソースを作成または更新します。

次のように

oc applyを使用します。oc apply -f your-fileOpenShift では、Cluster Operator からの要求に応じて、選択された永続ボリュームの容量が増やされます。サイズ変更が完了すると、サイズ変更された永続ボリュームを使用するすべての Pod が Cluster Operator によって再起動されます。これは自動的に行われます。

関連情報

OpenShift での永続ボリュームのサイズ変更に関する詳細は、Resizing Persistent Volumes using Kubernetes を参照してください。

3.1.3.4. JBOD ストレージの概要

AMQ Streams で、複数のディスクやボリュームのデータストレージ設定である JBOD を使用するように設定できます。JBOD は、Kafka ブローカーのデータストレージを増やす方法の 1 つです。また、パフォーマンスを向上することもできます。

JBOD 設定は 1 つまたは複数のボリュームによって記述され、各ボリュームは 一時 または 永続 ボリュームのいずれかになります。JBOD ボリューム宣言のルールおよび制約は、一時および永続ストレージのルールおよび制約と同じです。たとえば、永続ストレージのボリュームをプロビジョニング後に変更することはできません。

3.1.3.4.1. JBOD の設定

AMQ Streams で JBOD を使用するには、ストレージ type を jbod に設定する必要があります。volumes プロパティーを使用すると、JBOD ストレージアレイまたは設定を設定するディスクを記述できます。以下は、JBOD 設定例の抜粋になります。

# ...

storage:

type: jbod

volumes:

- id: 0

type: persistent-claim

size: 100Gi

deleteClaim: false

- id: 1

type: persistent-claim

size: 100Gi

deleteClaim: false

# ...id は、JBOD ボリュームの作成後に変更することはできません。

ユーザーは JBOD 設定に対してボリュームを追加または削除できます。

3.1.3.4.2. JBOD および 永続ボリューム要求

永続ストレージを使用して JBOD ボリュームを宣言する場合、永続ボリューム要求の命名スキームは以下のようになります。

data-id-cluster-name-kafka-idx-

idは、Kafka ブローカー Podidxのデータを保存するために使用されるボリュームの ID に置き換えます。

3.1.3.4.3. ログディレクトリー

JBOD ボリュームは、以下のパスにマウントされるログディレクトリーとして Kafka ブローカーによって使用されます。

/var/lib/kafka/data-id/kafka-log_idx_-

idは、Kafka ブローカー Podidxのデータを保存するために使用されるボリュームの ID に置き換えます。たとえば、/var/lib/kafka/data-0/kafka-log0のようになります。

3.1.3.5. JBOD ストレージへのボリュームの追加

この手順では、JBOD ストレージを使用するように設定されている Kafka クラスターにボリュームを追加する方法を説明します。この手順は、他のストレージタイプを使用するように設定されている Kafka クラスターには適用できません。

以前使用され、削除された id の下に新規ボリュームを追加する場合、以前使用された PersistentVolumeClaims が必ず削除されているよう確認する必要があります。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

- JBOD ストレージのある Kafka クラスター。

手順

Kafkaリソースのspec.kafka.storage.volumesプロパティーを編集します。新しいボリュームをvolumesアレイに追加します。たとえば、id が2の新しいボリュームを追加します。apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: jbod volumes: - id: 0 type: persistent-claim size: 100Gi deleteClaim: false - id: 1 type: persistent-claim size: 100Gi deleteClaim: false - id: 2 type: persistent-claim size: 100Gi deleteClaim: false # ... zookeeper: # ...リソースを作成または更新します。

oc applyを使用して、これを行うことができます。oc apply -f your-file- 新しいトピックを作成するか、既存のパーティションを新しいディスクに再度割り当てます。

関連情報

トピックの再割り当てについて、詳しくは 「パーティションの再割り当て」 を参照してください。

3.1.3.6. JBOD ストレージからのボリュームの削除

この手順では、JBOD ストレージを使用するように設定されている Kafka クラスターからボリュームを削除する方法を説明します。この手順は、他のストレージタイプを使用するように設定されている Kafka クラスターには適用できません。JBOD ストレージには、常に 1 つのボリュームが含まれている必要があります。

データの損失を避けるには、ボリュームを削除する前にすべてのパーティションを移動する必要があります。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

- 複数のボリュームがある JBOD ストレージのある Kafka クラスター

手順

- 削除するディスクからすべてのパーティションを再度割り当てます。削除するディスクに割り当てられたままになっているパーティションのデータは削除される可能性があります。

Kafkaリソースのspec.kafka.storage.volumesプロパティーを編集します。volumesアレイから 1 つまたは複数のボリュームを削除します。たとえば、ID が1と2のボリュームを削除します。apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka metadata: name: my-cluster spec: kafka: # ... storage: type: jbod volumes: - id: 0 type: persistent-claim size: 100Gi deleteClaim: false # ... zookeeper: # ...リソースを作成または更新します。

oc applyを使用して、これを行うことができます。oc apply -f your-file

関連情報

トピックの再割り当てについて、詳しくは 「パーティションの再割り当て」 を参照してください。

3.1.4. Kafka ブローカーレプリカ

Kafka クラスターは多くのブローカーを使って実行できます。Kafka.spec.kafka.replicas の Kafka クラスターに使用されるブローカーの数を設定できます。クラスターに最適なブローカー数は、特定のユースケースに基づいて決定する必要があります。

3.1.4.1. ブローカーノード数の設定

この手順では、新規クラスターの Kafka ブローカーノードの数を設定する方法を説明します。これは、パーティションのない新しいクラスターのみに適用できます。クラスターにトピックがすでに定義されている場合は、「クラスターのスケーリング」 を参照してください。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator が必要です。

- トピックが定義されていない Kafka クラスター。

手順

Kafkaリソースのreplicasプロパティーを編集します。以下に例を示します。apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka metadata: name: my-cluster spec: kafka: # ... replicas: 3 # ... zookeeper: # ...リソースを作成または更新します。

oc applyを使用して、これを行うことができます。oc apply -f your-file

関連情報

クラスターにトピックがすでに定義されている場合は、「クラスターのスケーリング」 を参照してください。

3.1.5. Kafka ブローカーの設定

AMQ Streams では、Kafka クラスターの Kafka ブローカーの設定をカスタマイズできます。Apache Kafka ドキュメント の Broker Configs セクションに記載されているほとんどのオプションを指定および設定できます。以下に関係する設定オプションは設定できません。

- セキュリティー (暗号化、認証、および承認)

- リスナーの設定

- Broker ID の設定

- ログデータディレクトリーの設定

- ブローカー間の通信

- ZooKeeper の接続

これらのオプションは AMQ Streams によって自動的に設定されます。

3.1.5.1. Kafka ブローカーの設定

Kafka.spec.kafka の config プロパティーには Kafka ブローカー設定オプションがキーとして含まれ、それらの値は以下の JSON タイプの 1 つになります。

- 文字列

- 数値

- ブール値

AMQ Streams によって直接管理されるオプション以外は、Apache Kafka ドキュメント の Broker Configs セクションにあるすべてのオプションを指定および設定できます。以下の文字列の 1 つと同じキーまたは以下の文字列の 1 つで始まるキーを持つ設定オプションはすべて変更できません。

-

listeners -

advertised. -

broker. -

listener. -

host.name -

port -

inter.broker.listener.name -

sasl. -

ssl. -

security. -

password. -

principal.builder.class -

log.dir -

zookeeper.connect -

zookeeper.set.acl -

authorizer. -

super.user

制限されたオプションが config プロパティーに指定された場合、そのオプションは無視され、Cluster Operator のログファイルに警告メッセージが出力されます。サポートされるその他すべてのオプションは Kafka に渡されます。

許可される 3 つの ssl 設定オプションを使用して、TLS バージョンの固有の暗号スイートで外部リスナーを実行します。暗号スイートでは、セキュアな接続とデータ転送のためのアルゴリズムが組み合わされます。

Kafka ブローカーの設定例

apiVersion: kafka.strimzi.io/v1beta1

kind: Kafka

metadata:

name: my-cluster

spec:

kafka:

# ...

config:

num.partitions: 1

num.recovery.threads.per.data.dir: 1

default.replication.factor: 3

offsets.topic.replication.factor: 3

transaction.state.log.replication.factor: 3

transaction.state.log.min.isr: 1

log.retention.hours: 168

log.segment.bytes: 1073741824

log.retention.check.interval.ms: 300000

num.network.threads: 3

num.io.threads: 8

socket.send.buffer.bytes: 102400

socket.receive.buffer.bytes: 102400

socket.request.max.bytes: 104857600

group.initial.rebalance.delay.ms: 0

ssl.cipher.suites: "TLS_ECDHE_RSA_WITH_AES_256_GCM_SHA384" 1

ssl.enabled.protocols: "TLSv1.2" 2

ssl.protocol: "TLSv1.2" 3

# ...

3.1.5.2. Kafka ブローカーの設定

既存の Kafka ブローカーを設定するか、指定した設定で新しい Kafka ブローカーを作成します。

前提条件

- OpenShift クラスターが利用できる必要があります。

- Cluster Operator が稼働している必要があります。

手順

-

クラスターデプロイメントを指定する

Kafkaリソースが含まれる YAML 設定ファイルを開きます。 Kafkaリソースのspec.kafka.configプロパティーで、Kafka 設定を 1 つまたは複数入力します。以下に例を示します。apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka spec: kafka: # ... config: default.replication.factor: 3 offsets.topic.replication.factor: 3 transaction.state.log.replication.factor: 3 transaction.state.log.min.isr: 1 # ... zookeeper: # ...新しい設定を適用してリソースを作成または更新します。

次のように

oc applyを使用します。oc apply -f kafka.yamlkafka.yamlは、設定するリソースの YAML 設定ファイルに置き換えます (例:kafka-persistent.yaml)。

3.1.6. Kafka ブローカーリスナー

Kafka ブローカーで有効なリスナーを設定できます。以下のタイプのリスナーがサポートされます。

- ポート 9092 のプレーンリスナー (TLS による暗号化なし)

- ポート 9093 の TLS リスナー (TLS による暗号化を使用)

- OpenShift の外部からアクセスするためのポート 9094 の外部リスナー

OAuth 2.0

OAuth 2.0 トークンベースの認証を使用している場合、承認サーバーに接続するようにリスナーを設定できます。詳細は、OAuth 2.0 トークンベース認証の使用 を参照してください。

リスナー証明書

TLS 暗号化が有効になっている TLS リスナーまたは外部リスナーの、Kafka リスナー証明書 と呼ばれる独自のサーバー証明書を提供できます。詳細は、「Kafka リスナー証明書」 を参照してください。

3.1.6.1. Kafka リスナー

Kafka.spec.kafka リソースの listeners プロパティーを使用して Kafka ブローカーリスナーを設定できます。listeners プロパティーには 3 つのサブプロパティーが含まれます。

-

plain -

tls -

external

各リスナーは、listeners オブジェクトに指定のプロパティーがある場合にのみ定義されます。

すべてのリスナーが有効な listeners プロパティーの例

# ...

listeners:

plain: {}

tls: {}

external:

type: loadbalancer

# ...

プレーンリスナーのみが有効な listeners プロパティーの例

# ...

listeners:

plain: {}

# ...

3.1.6.2. Kafka リスナーの設定

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

手順

Kafka.spec.kafkaリソースのlistenersプロパティーを編集します。認証のないプレーン (暗号化されていない) リスナーの設定例:

apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka spec: kafka: # ... listeners: plain: {} # ... zookeeper: # ...リソースを作成または更新します。

oc applyを使用して、これを行うことができます。oc apply -f your-file

関連情報

-

スキーマの詳細は、

KafkaListenersスキーマ参照 を参照してください。

3.1.6.3. リスナー認証

リスナーの authentication プロパティーは、そのリスナーに固有の認証メカニズムを指定するために使用されます。

- 相互 TLS 認証 (TLS による暗号化のリスナーのみ)

- SCRAM-SHA 認証

authentication プロパティーが指定されていない場合、リスナーはそのリスナー経由で接続するクライアントを認証しません。

認証は、User Operator を使用して KafkaUsers を管理する場合に設定する必要があります。

3.1.6.3.1. リスナーの認証設定

以下の例で指定されるものは次のとおりです。

-

SCRAM-SHA 認証に設定された

plainリスナー -

相互 TLS 認証を使用する

tlsリスナー -

相互 TLS 認証を使用する

externalリスナー

リスナー認証設定の例

# ...

listeners:

plain:

authentication:

type: scram-sha-512

tls:

authentication:

type: tls

external:

type: loadbalancer

tls: true

authentication:

type: tls

# ...

3.1.6.3.2. 相互 TLS 認証

相互 TLS 認証は、Kafka ブローカーと ZooKeeper Pod 間の通信で常に使用されます。

相互認証または双方向認証は、サーバーとクライアントの両方が証明書を提示するときに使用されます。AMQ Streams では、Kafka が TLS (Transport Layer Security) を使用して、相互認証の有無を問わず、Kafka ブローカーとクライアントとの間で暗号化された通信が行われるよう設定できます。相互認証を設定する場合、ブローカーによってクライアントが認証され、クライアントによってブローカーが認証されます。

TLS 認証は一般的には一方向で、一方が他方のアイデンティティーを認証します。たとえば、Web ブラウザーと Web サーバーの間で HTTPS が使用される場合、サーバーはブラウザーのアイデンティティーの証明を取得します。

3.1.6.3.2.1. クライアントに相互 TLS 認証を使用する場合

以下の場合、Kafka クライアントの認証に相互 TLS 認証が推奨されます。

- 相互 TLS 認証を使用した認証がクライアントでサポートされる場合。

- パスワードの代わりに TLS 証明書を使用する必要がある場合。

- 期限切れの証明書を使用しないように、クライアントアプリケーションを定期的に再設定および再起動できる場合。

3.1.6.3.3. SCRAM-SHA 認証

SCRAM (Salted Challenge Response Authentication Mechanism) は、パスワードを使用して相互認証を確立できる認証プロトコルです。AMQ Streams では、Kafka が SASL (Simple Authentication and Security Layer) SCRAM-SHA-512 を使用するよう設定し、暗号化されていないクライアントの接続と TLS で暗号化されたクライアントの接続の両方で認証を提供できます。TLS 認証は、Kafka ブローカーと ZooKeeper ノードの間で常に内部で使用されます。TLS クライアント接続で TLS プロトコルを使用すると、接続が暗号化されますが、認証には使用されません。

SCRAM の以下のプロパティーは、暗号化されていない接続でも SCRAM-SHA を安全に使用できるようにします。

- 通信チャネル上では、パスワードはクリアテキストで送信されません。代わりに、クライアントとサーバーはお互いにチャレンジを生成し、認証するユーザーのパスワードを認識していることを証明します。

- サーバーとクライアントは、認証を交換するたびに新しいチャレンジを生成します。よって、交換はリレー攻撃に対して回復性を備えています。

3.1.6.3.3.1. サポートされる SCRAM クレデンシャル

AMQ Streams では SCRAM-SHA-512 のみがサポートされます。KafkaUser.spec.authentication.type を scram-sha-512 に設定すると、User Operator によって、大文字と小文字の ASCII 文字と数字で設定された無作為の 12 文字のパスワードが生成されます。

3.1.6.3.3.2. クライアントに SCRAM-SHA 認証を使用する場合

以下の場合、Kafka クライアントの認証に SCRAM-SHA が推奨されます。

- SCRAM-SHA-512 を使用した認証がクライアントでサポートされる場合。

- TLS 証明書の代わりにパスワードを使用する必要がある場合。

- 暗号化されていない通信に認証が必要な場合。

3.1.6.4. 外部リスナー

外部リスナーを使用して AMQ Streams の Kafka クラスターを OpenShift 環境外のクライアントに公開します。

その他のリソース

3.1.6.4.1. 外部リスナーでアドバタイズされたアドレスのカスタマイズ

デフォルトでは、AMQ Streams は Kafka クラスターがそのクライアントにアドバタイズするホスト名とポートを自動的に決定しようとします。AMQ Streams が稼働しているインフラストラクチャーでは Kafka にアクセスできる正しいホスト名やポートを提供しない可能性があるため、デフォルトの動作はすべての状況に適しているわけではありません。外部リスナーの overrides プロパティーで、アドバタイズされたホスト名およびポートをカスタマイズできます。その後、TLS ホスト名の検証で使用できるようにするため、AMQ Streams では Kafka ブローカーでアドバタイズされたアドレスが自動的に設定され、ブローカー証明書に追加されます。アドバタイズされたホストおよびポートのオーバーライドは、すべてのタイプの外部リスナーで利用できます。

アドバタイズされたアドレスのオーバーライドが設定された外部リスナーの例

# ...

listeners:

external:

type: route

authentication:

type: tls

overrides:

brokers:

- broker: 0

advertisedHost: example.hostname.0

advertisedPort: 12340

- broker: 1

advertisedHost: example.hostname.1

advertisedPort: 12341

- broker: 2

advertisedHost: example.hostname.2

advertisedPort: 12342

# ...

さらに、ブートストラップサービスの名前を指定することもできます。この名前はブローカー証明書に追加され、TLS ホスト名の検証に使用できます。すべてのタイプの外部リスナーで、ブートストラップアドレスを追加できます。

追加のブートストラップアドレスが設定された外部リスナーの例

# ...

listeners:

external:

type: route

authentication:

type: tls

overrides:

bootstrap:

address: example.hostname

# ...

3.1.6.4.2. ルート外部リスナー

タイプ route の外部リスナーは、OpenShift の Routes および HAProxy ルーターを使用して Kafka を公開します。

route は OpenShift でのみサポートされます。

3.1.6.4.2.1. OpenShift Routes を使用した Kafka の公開

OpenShift Routes および HAProxy ルーターを使用して Kafka を公開する場合、各 Kafka ブローカー Pod に専用の Route が作成されます。追加の Route が作成され、Kafka ブートストラップアドレスとして提供されます。これらの Routes を使用すると、Kafka クライアントを 443 番ポートで Kafka に接続することができます。

TLS による暗号化は常に Routes と使用されます。

デフォルトでは、ルートホストは OpenShift によって自動的に割り当てられます。ただし、 overrides プロパティーに要求されたホストを指定すると、割り当てられたルートをオーバーライドすることができます。AMQ Streams では、要求されたホストが利用可能であるか検証されません。そのため、ホストが利用可能であることをユーザーが確認する必要があります。

OpenShift ルートホストのオーバーライドが設定されたタイプ routes の外部リスナーの例

# ...

listeners:

external:

type: route

authentication:

type: tls

overrides:

bootstrap:

host: bootstrap.myrouter.com

brokers:

- broker: 0

host: broker-0.myrouter.com

- broker: 1

host: broker-1.myrouter.com

- broker: 2

host: broker-2.myrouter.com

# ...

Routes を使用した Kafka へのアクセスに関する詳細は 「OpenShift ルートを使用した Kafka へのアクセス」 を参照してください。

3.1.6.4.2.2. OpenShift ルートを使用した Kafka へのアクセス

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

手順

外部リスナーが有効で、タイプ

routeに設定されている Kafka クラスターをデプロイします。Routesを使用するよう設定された外部リスナーがある設定の例apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka spec: kafka: # ... listeners: external: type: route # ... # ... zookeeper: # ...リソースを作成または更新します。

oc apply -f your-fileブートストラップ

Routeのアドレスを見つけます。oc get routes CLUSTER-NAME-kafka-bootstrap -o=jsonpath='{.status.ingress[0].host}{"\n"}'このアドレスと Kafka クライアントの 443 番ポートをブートストラップアドレスとして使用します。

ブローカーの認証局の公開証明書を取得します。

oc get secret CLUSTER-NAME-cluster-ca-cert -o jsonpath='{.data.ca\.crt}' | base64 -d > ca.crtKafka クライアントで取得した証明書を使用して TLS 接続を設定します。認証が有効になっている場合は、SASL または TLS 認証を設定する必要もあります。

その他のリソース

-

スキーマの詳細は、

KafkaListenersスキーマ参照 を参照してください。

3.1.6.4.3. ロードバランサー外部リスナー

タイプが loadbalancer の外部リスナーは、Loadbalancer タイプの Services を使用して、Kafka を公開します。

3.1.6.4.3.1. ロードバランサーを使用した Kafka の公開

Loadbalancer タイプの Services を使用して Kafka を公開すると、Kafka ブローカー Pod ごとに新しいロードバランサーサービスが作成されます。追加のロードバランサーが作成され、Kafka の ブートストラップ アドレスとして提供されます。ロードバランサーは 9094 番ポートで接続をリッスンします。

デフォルトでは、TLS による暗号化は有効になっています。これを無効にするには、tls フィールドを false に設定します。

タイプが loadbalancer の外部リスナーの例

# ...

listeners:

external:

type: loadbalancer

authentication:

type: tls

# ...

ロードバランサーを使用した Kafka へのアクセスに関する詳細は 「ロードバランサーを使用した Kafka へのアクセス」 を参照してください。

3.1.6.4.3.2. 外部ロードバランサーリスナーの DNS 名のカスタマイズ

loadbalancer リスナーでは、dnsAnnotations プロパティーを使用して追加のアノテーションをロードバランサーサービスに追加できます。これらのアノテーションを使用すると、自動的に DNS 名をロードバランサーサービスに割り当てる ExternalDNS などの DNS ツールをインストルメント化できます。

dnsAnnotations を使用するタイプ loadbalancer の外部リスナーの例

# ...

listeners:

external:

type: loadbalancer

authentication:

type: tls

overrides:

bootstrap:

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-bootstrap.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

brokers:

- broker: 0

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-broker-0.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

- broker: 1

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-broker-1.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

- broker: 2

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-broker-2.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

# ...

3.1.6.4.3.3. ロードバランサー IP アドレスのカスタマイズ

loadbalancer リスナーで、ロードバランサーの作成時に loadBalancerIP プロパティーを使用すると、特定の IP アドレスをリクエストできます。特定の IP アドレスでロードバランサーを使用する必要がある場合は、このプロパティーを使用します。クラウドプロバイダーがこの機能に対応していない場合、loadBalancerIP フィールドは無視されます。

特定のロードバランサー IP アドレスリクエストのある loadbalancer タイプの外部リスナーの例

# ...

listeners:

external:

type: loadbalancer

authentication:

type: tls

overrides:

bootstrap:

loadBalancerIP: 172.29.3.10

brokers:

- broker: 0

loadBalancerIP: 172.29.3.1

- broker: 1

loadBalancerIP: 172.29.3.2

- broker: 2

loadBalancerIP: 172.29.3.3

# ...

3.1.6.4.3.4. ロードバランサーを使用した Kafka へのアクセス

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

手順

外部リスナーが有効で、タイプが

loadbalancerに設定されている Kafka クラスターをデプロイします。ロードバランサーを使用するよう設定された外部リスナーがある設定の例

apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka spec: kafka: # ... listeners: external: type: loadbalancer authentication: type: tls # ... # ... zookeeper: # ...リソースを作成または更新します。

oc applyを使用して、これを行うことができます。oc apply -f your-fileブートストラップロードバランサーのホスト名を見つけます。

oc getを使用してこれを行うことができます。oc get service cluster-name-kafka-external-bootstrap -o=jsonpath='{.status.loadBalancer.ingress[0].hostname}{"\n"}'ホスト名が見つからない場合 (コマンドによって返されなかった場合)、ロードバランサーの IP アドレスを使用します。

oc getを使用してこれを行うことができます。oc get service cluster-name-kafka-external-bootstrap -o=jsonpath='{.status.loadBalancer.ingress[0].ip}{"\n"}'ホスト名または IP アドレスと Kafka クライアントの 9094 番ポートをブートストラップアドレスとして使用します。

TLS による暗号化が無効になっている場合を除き、ブローカーの認証局の公開証明書を取得します。

oc getを使用してこれを行うことができます。oc get secret cluster-name-cluster-ca-cert -o jsonpath='{.data.ca\.crt}' | base64 -d > ca.crtKafka クライアントで取得した証明書を使用して TLS 接続を設定します。認証が有効になっている場合は、SASL または TLS 認証を設定する必要もあります。

その他のリソース

-

スキーマの詳細は、

KafkaListenersスキーマ参照 を参照してください。

3.1.6.4.4. ノードポートの外部リスナー

タイプが nodeport の外部リスナーは、NodePort タイプの Services を使用して、Kafka を公開します。

3.1.6.4.4.1. ノードポートを使用した Kafka の公開

NodePort タイプの Services を使用して Kafka を公開する場合、Kafka クライアントは OpenShift のノードに直接接続されます。各クライアントの OpenShift ノード上のポートへのアクセスを有効にする必要があります (ファイアウォール、セキュリティーグループなど)。各 Kafka ブローカー Pod が別々のポートでアクセス可能になります。

追加の NodePort タイプのサービスが作成され、Kafka ブートストラップアドレスとして提供されます。

Kafka ブローカー Pod にアドバタイズされたアドレスを設定する場合、AMQ Stremas では該当の Pod が稼働しているノードのアドレスが使用されます。多くの場合で、ノードには複数のアドレスがあります。以下の優先順位で、最初に見つかったタイプのアドレスが使用されます。

- ExternalDNS

- ExternalIP

- Hostname

- InternalDNS

- InternalIP

リスナー設定の preferredAddressType プロパティーを使用して、ノードアドレスとしてチェックされた最初のアドレスタイプを指定できます。たとえば、デプロイメントに DNS サポートがない場合や、内部 DNS または IP アドレスを介してブローカーを内部でのみ公開する場合、このプロパティーは便利です。該当タイプのアドレスが見つかった場合はそのアドレスが使用されます。アドレスタイプが見つからなかった場合、AMQ Streams は標準の優先順位でタイプの検索を続行します。

優先アドレスタイプで設定された外部リスナーの例

apiVersion: kafka.strimzi.io/v1beta1

kind: Kafka

spec:

kafka:

# ...

listeners:

external:

type: nodeport

tls: true

authentication:

type: tls

configuration:

preferredAddressType: InternalDNS

# ...

zookeeper:

# ...

デフォルトでは、TLS による暗号化は有効になっています。これを無効にするには、tls フィールドを false に設定します。

ノードポートを使用して Kafka クラスターを公開する場合、現在 TLS ホスト名の検証はサポートされません。

デフォルトでは、ブートストラップおよびブローカーサービスに使用されるポート番号は OpenShift によって自動的に割り当てられます。ただし、overrides プロパティーに要求されたポート番号を指定すると、割り当てられたノードポートをオーバーライドすることができます。AMQ Streams では、要求されたポートで検証を実行しません。そのため、ポートが使用可能であることをユーザーが確認する必要があります。

ノードポートのオーバーライドが設定された外部リスナーの例

# ...

listeners:

external:

type: nodeport

tls: true

authentication:

type: tls

overrides:

bootstrap:

nodePort: 32100

brokers:

- broker: 0

nodePort: 32000

- broker: 1

nodePort: 32001

- broker: 2

nodePort: 32002

# ...

ノードポートを使用した Kafka へのアクセスに関する詳細は 「ノードポートを使用した Kafka へのアクセス」 を参照してください。

3.1.6.4.4.2. 外部ノードポートリスナーの DNS 名のカスタマイズ

nodeport リスナーでは、dnsAnnotations プロパティーを使用して追加のアノテーションをノードポートサービスに追加できます。これらのアノテーションを使用すると、自動的に DNS 名をクラスターノードに割り当てる ExternalDNS などの DNS ツールをインストルメント化できます。

dnsAnnotations を使用するタイプ nodeport の外部リスナーの例

# ...

listeners:

external:

type: nodeport

tls: true

authentication:

type: tls

overrides:

bootstrap:

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-bootstrap.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

brokers:

- broker: 0

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-broker-0.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

- broker: 1

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-broker-1.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

- broker: 2

dnsAnnotations:

external-dns.alpha.kubernetes.io/hostname: kafka-broker-2.mydomain.com.

external-dns.alpha.kubernetes.io/ttl: "60"

# ...

3.1.6.4.4.3. ノードポートを使用した Kafka へのアクセス

この手順では、ノードポートを使用して外部クライアントから AMQ Streams Kafka クラスターにアクセスする方法について説明します。

ブローカーに接続するには、Kafka bootstrap アドレスのホスト名 (アドバタイズされたアドレス) とポート番号、および認証に使用される証明書が必要です。

前提条件

- OpenShift クラスター

- 稼働中の Cluster Operator

手順

外部リスナーが有効で、タイプが

nodeportに設定されている Kafka クラスターをデプロイします。以下に例を示します。

apiVersion: kafka.strimzi.io/v1beta1 kind: Kafka spec: kafka: # ... listeners: external: type: nodeport tls: true authentication: type: tls configuration: brokerCertChainAndKey: 1 secretName: my-secret certificate: my-certificate.crt key: my-key.key preferredAddressType: InternalDNS 2 # ... zookeeper: # ...- 1

- 外部の認証局によって管理される Kafka リスナー証明書 の任意設定。

brokerCertChainAndKeyプロパティーは、サーバー証明書および秘密鍵を保持するSecretを指定します。Kafka リスナー証明書も TLS リスナーに対して設定できます。 - 2

リソースを作成または更新します。

oc apply -f your-fileブートストラップサービスのポート番号を見つけます。

oc get service cluster-name-kafka-external-bootstrap -o=jsonpath='{.spec.ports[0].nodePort}{"\n"}'ポートは Kafka ブートストラップアドレスで使用されます。

OpenShift ノードのアドレスを見つけます。

oc get node node-name -o=jsonpath='{range .status.addresses[*]}{.type}{"\t"}{.address}{"\n"}'異なるアドレスが返される場合は、以下の順序を基にしてアドレスタイプを選択します。

- ExternalDNS

- ExternalIP

- Hostname

- InternalDNS

- InternalIP

アドレスと前述のステップで見つけたポートを、Kafka ブートストラップアドレスで使用します。

TLS による暗号化が無効になっている場合を除き、ブローカーの認証局の公開証明書を取得します。

oc get secret cluster-name-cluster-ca-cert -o jsonpath='{.data.ca\.crt}' | base64 -d > ca.crtKafka クライアントで取得した証明書を使用して TLS 接続を設定します。認証が有効になっている場合は、SASL または TLS 認証を設定する必要もあります。

その他のリソース

-

スキーマの詳細は、

KafkaListenersスキーマ参照 を参照してください。

3.1.6.4.5. OpenShift Ingress 外部リスナー

タイプが ingress の外部リスナーは、Kubernetes Ingress と NGINX Ingress Controller for Kubernetes を使用して Kafka を公開します。

3.1.6.4.5.1. Kubernetes Ingress を使用した Kafka の公開

Kubernetes Ingress と NGINX Ingress Controller for Kubernetes を使用して Kafka が公開されると、Kafka ブローカー Pod ごとに専用の Ingress リソースが作成されます。追加の Ingress リソースが作成され、Kafka ブートストラップアドレスとして提供されます。これらの Ingress リソースを使用すると、Kafka クライアントを 443 番ポートで Kafka に接続することができます。

Ingress を使用する外部リスナーは、現在 NGINX Ingress Controller for Kubernetes でのみテストされています。

Kafka は TCP 上でバイナリープロトコルを使用しますが、NGINX Ingress Controller for Kubernetes は HTTP プロトコルで動作するように設計されています。Ingress から Kafka コネクションを渡せるようにするため、AMQ Streams では NGINX Ingress Controller for Kubernetes の TLS パススルー機能が使用されます。TLS パススルーが NGINX Ingress Controller for Kubernetes デプロイメントで有効になっていることを確認してください。TLS パススルーの有効化に関する詳細は、TLS パススルーのドキュメント を参照してください。Ingress を使用して Kafka を公開する場合、TLS パススルー機能を使用するため、TLS による暗号化を無効にできません。

Ingress コントローラーはホスト名を自動的に割り当てません。spec.kafka.listeners.external.configuration セクションに、ブートストラップおよびブローカーごとのサービスによって使用されるホスト名を指定する必要があります。また、確実にホスト名が Ingress エンドポイントに解決することを確認する必要があります。AMQ Streams では、要求されたホストが利用可能で、適切に Ingress エンドポイントにルーティングされることを検証しません。

タイプが ingress の外部リスナーの例

# ...

listeners:

external:

type: ingress

authentication:

type: tls

configuration:

bootstrap:

host: bootstrap.myingress.com

brokers:

- broker: 0

host: broker-0.myingress.com

- broker: 1

host: broker-1.myingress.com

- broker: 2

host: broker-2.myingress.com

# ...

Ingress を使用した Kafka へのアクセスに関する詳細は 「ingress を使用した Kafka へのアクセス」 を参照してください。

3.1.6.4.5.2. Ingress クラスの設定

デフォルトで、Ingress クラスは nginx に設定されます。class プロパティーを使用して Ingress クラスを変更できます。

Ingress クラスの nginx-internal を使用した ingress タイプの外部リスナーの例

# ...

listeners:

external:

type: ingress

class: nginx-internal

# ...

# ...

3.1.6.4.5.3. 外部 ingress リスナーの DNS 名のカスタマイズ