『Using AMQ Streams on RHEL』

Red Hat Enterprise Linux 上で AMQ Streams 1.7 を使用

概要

多様性を受け入れるオープンソースの強化

Red Hat では、コード、ドキュメント、Web プロパティーにおける配慮に欠ける用語の置き換えに取り組んでいます。まずは、マスター (master)、スレーブ (slave)、ブラックリスト (blacklist)、ホワイトリスト (whitelist) の 4 つの用語の置き換えから始めます。これは大規模な取り組みであるため、これらの変更は今後の複数のリリースで段階的に実施されます。詳細は、Red Hat CTO である Chris Wright のメッセージをご覧ください。

第1章 AMQ Streams の概要

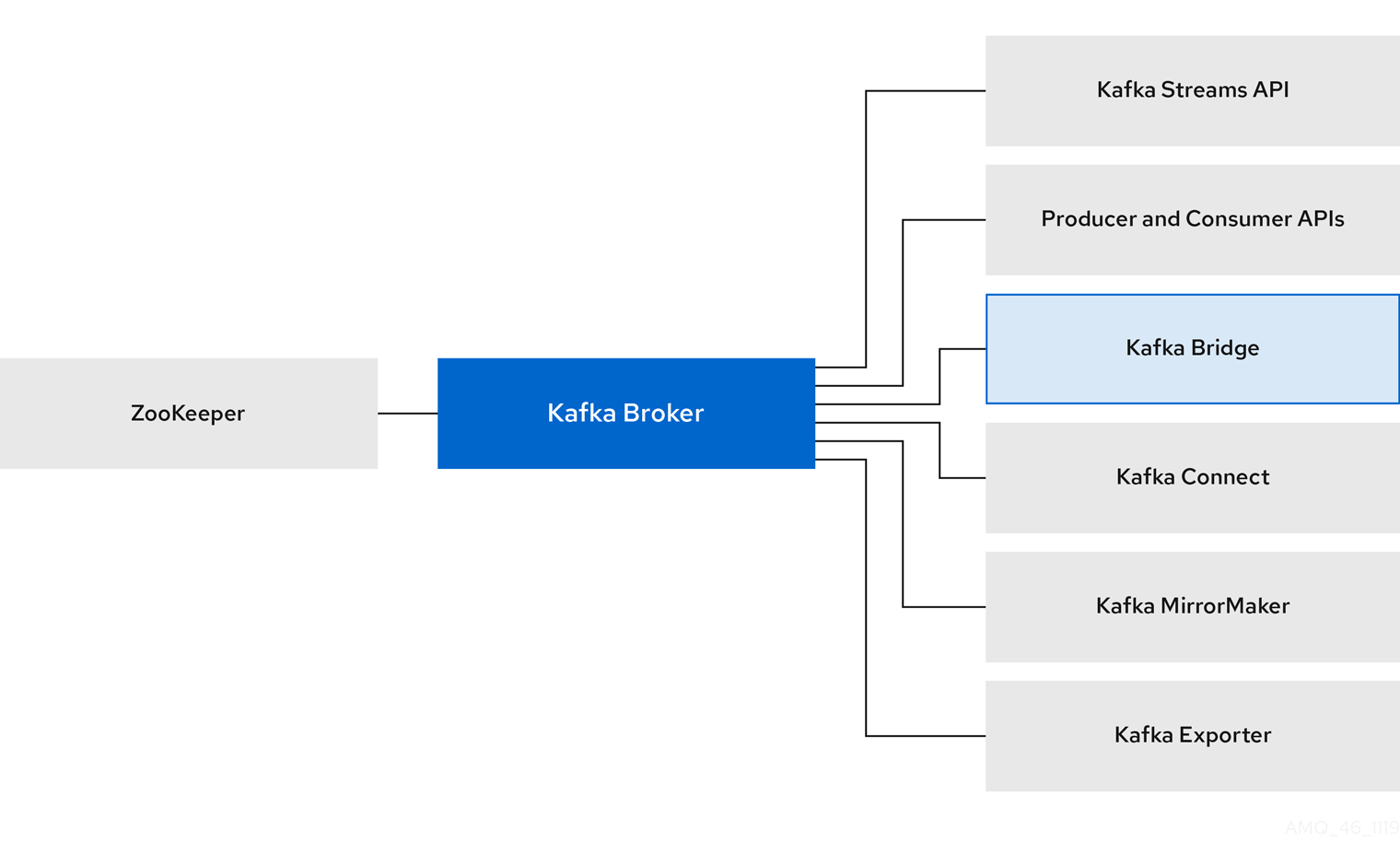

Red Hat AMQ Streams は、Apache ZooKeeper プロジェクトおよび Apache Kafka プロジェクトをベースとする非常にスケーラブルで分散され、高パフォーマンスのデータストリーミングプラットフォームです。

主なコンポーネントは、以下のとおりです。

- Kafka Broker

クライアントを消費するためのクライアントの生成からレコードを配信するメッセージングブローカー。

Apache ZooKeeper は Kafka のコア依存関係であり、信頼性の高い分散コーディネーションを実現するためにクラスター調整サービスを提供します。

- Kafka Streams API

- ストリームプロセッサーアプリケーションを 記述する API。

- プロデューサーおよびコンシューマー API

- Kafka ブローカーとの間でメッセージを生成および消費するための Java ベースの API。

- Kafka Bridge

- AMQ Streams Kafka Bridge では、HTTP ベースのクライアントと Kafka クラスターとの対話を可能にする RESTful インターフェースが提供されます。

- Kafka Connect

- Connector プラグインを使用して Kafka ブローカーと他のシステム間でデータをストリーミングするツールキット。

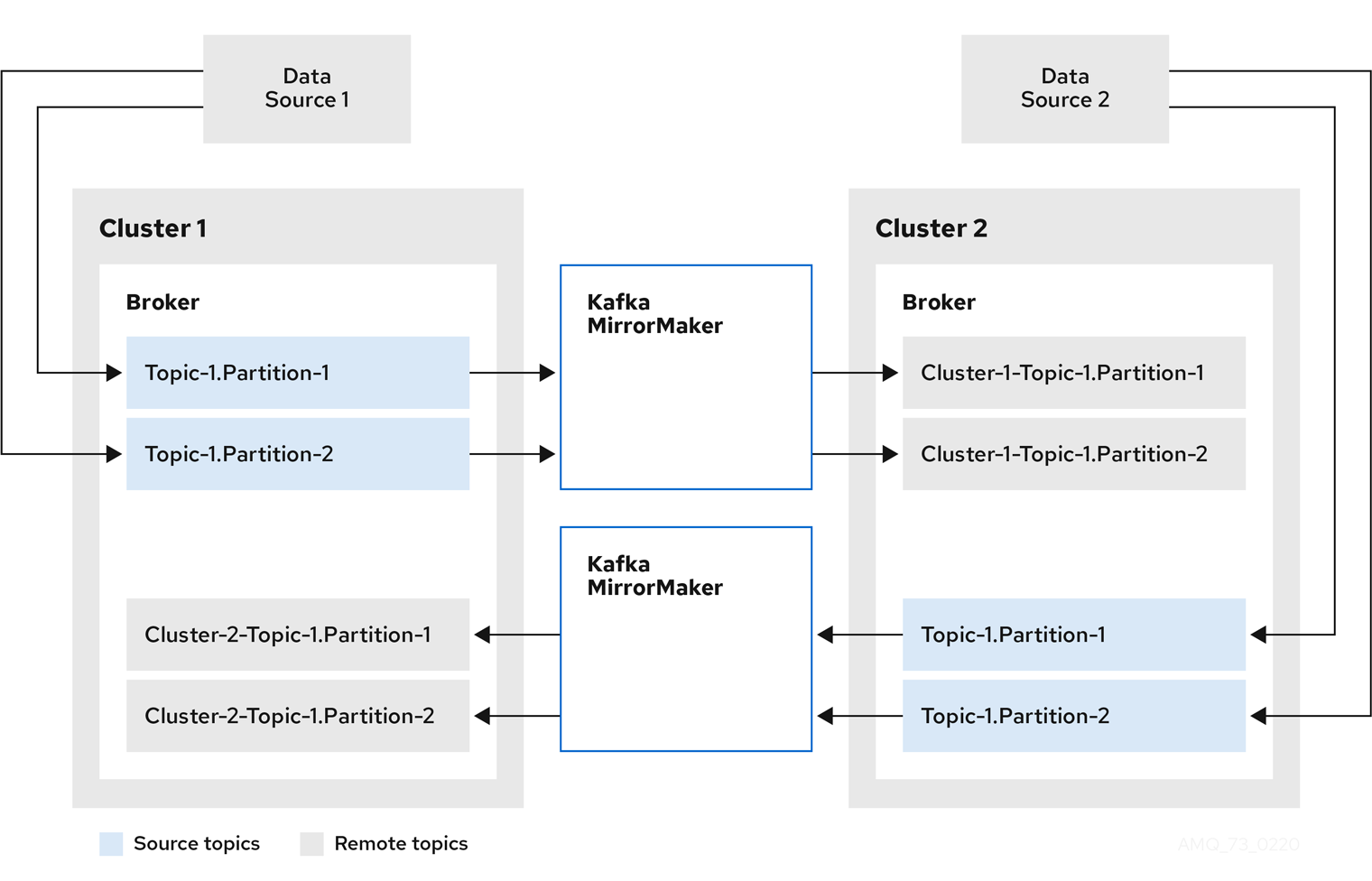

- Kafka MirrorMaker

- データセンター内またはデータセンター全体の 2 つの Kafka クラスター間でデータを複製します。

- Kafka Exporter

- 監視用に Kafka メトリクスデータの抽出に使用されるエクスポーター。

- Kafka Cruise Control

- 最適化ゴールと容量制限を基にして、Kafka クラスターをリバランスします。

Kafka ブローカーのクラスターは、これらのコンポーネントをすべて接続するハブです。ブローカーは、設定データを保存およびクラスターの調整に Apache ZooKeeper を使用します。Apache Kafka の実行前に、Apache ZooKeeper クラスターを用意する必要があります。

図1.1 AMQ Streams アーキテクチャー

1.1. Kafka の機能

Kafka の基盤のデータストリーム処理機能とコンポーネントアーキテクチャーによって以下が提供されます。

- スループットが非常に高く、レイテンシーが低い状態でデータを共有するマイクロサービスおよびその他のアプリケーション。

- メッセージの順序の保証。

- アプリケーションの状態を再構築するためにデータストレージからメッセージを巻き戻し/再生。

- キーバリューログの使用時に古いレコードを削除するメッセージ圧縮。

- クラスター設定での水平スケーラビリティー。

- 耐障害性を制御するデータのレプリケーション。

- 即座にアクセスするために大容量のデータを保持。

1.2. Kafka のユースケース

Kafka の機能は、以下に適しています。

- イベント駆動型のアーキテクチャー。

- アプリケーションの状態変更をイベントのログとしてキャプチャーするイベントソーシング。

- メッセージのブローカー。

- Web サイトアクティビティーの追跡。

- メトリクスによるオペレーションの監視。

- ログの収集および集計。

- 分散システムのログのコミット。

- アプリケーションがリアルタイムでデータに対応できるようにするストリーム処理。

1.3. サポートされる構成

AMQ Streams をサポートされる構成で実行するには、以下の JVM バージョンの 1 つと、サポートされるオペレーティングシステムの 1 つで実行する必要があります。

表1.1 サポートされる Java 仮想マシンの一覧

| Java 仮想マシン | バージョン |

|---|---|

| OpenJDK | 1.8, 11 |

| OracleJDK | 1.8, 11 |

| IBM JDK | 1.8 |

表1.2 サポート対象オペレーティングシステムの一覧

| オペレーティングシステム | アーキテクチャー | バージョン |

|---|---|---|

| Red Hat Enterprise Linux (RHEL) | x86_64 | 7.x, 8.x |

1.4. ドキュメントの規則

置き換え可能なテキスト

本書では、置き換え可能なテキストは、monospace フォントのイタリック体、大文字、およびハイフンで記載されています。

たとえば、以下のコードでは BOOTSTRAP-ADDRESS および TOPIC-NAME を独自のアドレスおよびトピック名に置き換えます。

bin/kafka-console-consumer.sh --bootstrap-server BOOTSTRAP-ADDRESS --topic TOPIC-NAME --from-beginning

第2章 スタートガイド

2.1. AMQ Streams ディストリビューション

AMQ Streams は単一の ZIP ファイルとして配布されます。この ZIP ファイルには、以下の AMQ Streams コンポーネントが含まれます。

- Apache ZooKeeper

- Apache Kafka

- Apache Kafka Connect

- Apache Kafka MirrorMaker

- Kafka Exporter

Kafka Bridge および Cruise Control コンポーネントは、個別の zip アーカイブとして提供されます。

2.2. AMQ Streams アーカイブのダウンロード

AMQ Streams のアーカイブされたディストリビューションは、Red Hat の Web サイトからダウンロードできます。以下の手順に従って、ディストリビューションのコピーをダウンロードできます。

手順

- カスタマーポータルから最新バージョンの Red Hat AMQ Streams アーカイブを ダウンロード します。

2.3. AMQ Streams のインストール

以下の手順に従って、最新バージョンの AMQ Streams を Red Hat Enterprise Linux にインストールします。

既存のクラスターを AMQ Streams 1.7 にアップグレードする方法は、「 AMQ Streams および Kafka のアップグレード 」を参照してください。

前提条件

- インストールアーカイブ をダウンロードします。

- レビュー 「サポートされる構成」

手順

新しい

kafkaユーザーおよびグループを追加します。sudo groupadd kafka sudo useradd -g kafka kafka sudo passwd kafka

/opt/kafkaディレクトリーを作成します。sudo mkdir /opt/kafka

一時ディレクトリーを作成し、AMQ Streams ZIP ファイルの内容を展開します。

mkdir /tmp/kafka unzip amq-streams_y.y-x.x.x.zip -d /tmp/kafka展開したコンテンツを

/opt/kafkaディレクトリーに移動し、一時ディレクトリーを削除します。sudo mv /tmp/kafka/kafka_y.y-x.x.x/* /opt/kafka/ rm -r /tmp/kafka/opt/kafkaディレクトリーの所有権をkafkaユーザーに変更します。sudo chown -R kafka:kafka /opt/kafka

ZooKeeper データを保存し、その所有権を

kafkaユーザーに設定する/var/lib/zookeeperディレクトリーを作成します。sudo mkdir /var/lib/zookeeper sudo chown -R kafka:kafka /var/lib/zookeeper

Kafka データを保存し、その所有権を

kafkaユーザーに設定する/var/lib/kafkaディレクトリーを作成します。sudo mkdir /var/lib/kafka sudo chown -R kafka:kafka /var/lib/kafka

2.4. データストレージに関する留意事項

効率的なデータストレージインフラストラクチャーは、AMQ Streams のパフォーマンスを最適化するために不可欠です。

AMQ Streams にはブロックストレージが必要で、Amazon Elastic Block Store(EBS)などのクラウドベースのブロックストレージソリューションと適切に機能します。ファイルストレージの使用は推奨されません。

可能な場合はローカルストレージを選択します。ローカルストレージが利用できない場合は、ファイバーチャネルや iSCSI などのプロトコルがアクセスするストレージエリアネットワーク(SAN)を使用できます。

2.4.1. Apache Kafka および ZooKeeper ストレージのサポート

Apache Kafka と ZooKeeper には別々のディスクを使用します。

Kafka は JBOD(Bunch of Disks)ストレージ、複数のディスクまたはボリュームのデータストレージ設定をサポートします。JBOD では、Kafka ブローカーのデータストレージが向上します。また、パフォーマンスを向上することもできます。

ソリッドステートドライブ (SSD) は必須ではありませんが、複数のトピックに対してデータが非同期的に送受信される大規模なクラスターで Kafka のパフォーマンスを向上させることができます。SSD は、高速で低レイテンシーのデータアクセスが必要な ZooKeeper で特に有効です。

Kafka と ZooKeeper の両方にデータレプリケーションが組み込まれているため、複製されたストレージのプロビジョニングは必要ありません。

2.4.2. ファイルシステム

XFS ファイルシステムを使用するようにストレージシステムを設定することが推奨されます。AMQ Streams は ext4 ファイルシステムとも互換性がありますが、最適化するには追加の設定が必要になる場合があります。

関連情報

- XFS の詳細 は、「XFS ファイルシステム」を参照してください。

2.5. 単一ノードの AMQ Streams クラスターの実行

この手順では、同じホスト上で実行される単一の Apache ZooKeeper ノードと 1 つの Apache Kafka ノードで構成される基本的な AMQ Streams クラスターを実行する方法を説明します。デフォルトの設定ファイルは ZooKeeper および Kafka に使用されます。

単一ノードの AMQ Streams クラスターは信頼性および高可用性を提供しないため、開発での使用のみに適しています。

前提条件

- AMQ Streams がホストにインストールされていること。

クラスターの実行

ZooKeeper 設定ファイル

/opt/kafka/config/zookeeper.propertiesを編集します。dataDirオプションを/var/lib/zookeeper/に設定します。dataDir=/var/lib/zookeeper/

Kafka 設定ファイル

/opt/kafka/config/server.propertiesを編集します。log.dirsオプションを/var/lib/kafka/に設定します。log.dirs=/var/lib/kafka/

kafkaユーザーに切り替えます。su - kafka

ZooKeeper を起動します。

/opt/kafka/bin/zookeeper-server-start.sh -daemon /opt/kafka/config/zookeeper.properties

ZooKeeper が稼働していることを確認します。

jcmd | grep zookeeper

以下を返します。

number org.apache.zookeeper.server.quorum.QuorumPeerMain /opt/kafka/config/zookeeper.propertiesKafka を起動します。

/opt/kafka/bin/kafka-server-start.sh -daemon /opt/kafka/config/server.properties

Kafka が実行されていることを確認します。

jcmd | grep kafka

以下を返します。

number kafka.Kafka /opt/kafka/config/server.properties

関連情報

- AMQ Streams のインストールに関する詳細は、「AMQ Streams のインストール」 を参照してください。

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

2.6. クラスターの使用

この手順では、Kafka コンソールプロデューサーおよびコンシューマークライアントを起動し、これを使用して複数のメッセージを送受信する方法を説明します。

手順 1 つに新しいトピックが自動的に作成されます。トピックの自動作成 は、auto.create.topics.enable 設定プロパティーを使用して制御されます(デフォルトでは true に設定されます)。または、クラスターを使用する前にトピックを設定し、作成することができます。詳細は、「 トピック 」を参照してください。

手順

Kafka コンソールプロデューサーを起動し、メッセージを新しいトピックに送信するように設定します。

/opt/kafka/bin/kafka-console-producer.sh --broker-list <bootstrap-address> --topic <topic-name>

以下に例を示します。

/opt/kafka/bin/kafka-console-producer.sh --broker-list localhost:9092 --topic my-topic

コンソールに複数のメッセージを入力します。Enter キーを押して、個別のメッセージを新しいトピックに送信します。

>message 1 >message 2 >message 3 >message 4

Kafka が新しいトピックを自動的に作成すると、トピックが存在しないことを示す警告が表示されることがあります。

WARN Error while fetching metadata with correlation id 39 : {4-3-16-topic1=LEADER_NOT_AVAILABLE} (org.apache.kafka.clients.NetworkClient)さらにメッセージを送信した後も警告が表示されるはずです。

新しいターミナルウィンドウで、Kafka コンソールコンシューマーを起動し、新しいトピックの最初からメッセージを読み取るように設定します。

/opt/kafka/bin/kafka-console-consumer.sh --bootstrap-server <bootstrap-address> --topic <topic-name> --from-beginning

以下に例を示します。

/opt/kafka/bin/kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic my-topic --from-beginning

受信メッセージがコンシューマーコンソールに表示されます。

- プロデューサーコンソールに切り替え、追加のメッセージを送信します。コンシューマーコンソールに表示されていることを確認します。

- Ctrl+C を押して、Kafka コンソールプロデューサーを停止し、コンシューマーを削除します。

2.7. AMQ Streams サービスの停止

スクリプトを実行して、Kafka サービスおよび ZooKeeper サービスを停止できます。Kafka および ZooKeeper サービスへのすべての接続が終了します。

前提条件

- AMQ Streams がホストにインストールされていること。

- ZooKeeper および Kafka が稼働している必要があります。

手順

Kafka ブローカーを停止します。

su - kafka /opt/kafka/bin/kafka-server-stop.sh

Kafka ブローカーが停止していることを確認します。

jcmd | grep kafka

ZooKeeper を停止します。

su - kafka /opt/kafka/bin/zookeeper-server-stop.sh

2.8. AMQ Streams の設定

前提条件

- AMQ Streams がホストにダウンロードされ、インストールされている。

手順

テキストエディターで ZooKeeper および Kafka ブローカー設定ファイルを開きます。設定ファイルは以下にあります。

- ZooKeeper

-

/opt/kafka/config/zookeeper.properties - Kafka

-

/opt/kafka/config/server.properties

設定オプションを編集します。設定ファイルは Java プロパティー形式になります。すべての設定オプションは、以下の形式で別々の行に指定する必要があります。

<option> = <value>

#または!で始まる行はコメントとして処理され、AMQ Streams コンポーネントによって無視されます。# This is a comment

改行やキャリアリッジを返す前に

\を直接使用して、複数の行に分割することができます。sasl.jaas.config=org.apache.kafka.common.security.plain.PlainLoginModule required \ username="bob" \ password="bobs-password";- 変更を保存します。

- ZooKeeper または Kafka ブローカーを再起動します。

- クラスターのすべてのノードでこの手順を繰り返します。

第3章 ZooKeeper の設定

Kafka は ZooKeeper を使用して設定データを保存およびクラスターの調整に使用します。複製された ZooKeeper インスタンスのクラスターを実行することが強く推奨されます。

3.1. 基本設定

最も重要な ZooKeeper 設定オプションは次のとおりです。

tickTime- ZooKeeper の基本的な時間単位(ミリ秒単位)。これはハートビートおよびセッションタイムアウトに使用されます。たとえば、セッションタイムアウトの最小数は 2 ティックです。

dataDir-

ZooKeeper がトランザクションログとそのスナップショットを保存するディレクトリー。これは、インストール時に作成された

/var/lib/zookeeper/ディレクトリーに設定する必要があります。 clientPort-

クライアントが接続できるポート番号。デフォルトは

2181です。

config/zookeeper.properties という名前の ZooKeeper 設定ファイルの例は AMQ Streams インストールディレクトリーにあります。ZooKeeper のレイテンシーを最小限に抑えるために、dataDir ディレクトリーを別のディスクデバイスに配置することが推奨されます。

ZooKeeper 設定ファイルは /opt/kafka/config/zookeeper.properties にあります。設定ファイルの基本例は、以下を参照してください。設定ファイルは、kafka ユーザーが読み取り可能でなければなりません。

tickTime=2000 dataDir=/var/lib/zookeeper/ clientPort=2181

3.2. ZooKeeper クラスターの設定

多くの実稼働環境では、複製された ZooKeeper インスタンスのクラスターをデプロイすることが推奨されます。信頼性の高い ZooKeeper サービスでは、ZooKeeper クラスターの安定性および高可用性が重要になります。ZooKeeper クラスターは ensembles とも呼ばれ ます。

ZooKeeper クラスターは、通常最適なノード数で構成されます。ZooKeeper では、クラスター内のノードの大半が稼働している必要があります。以下に例を示します。

- 3 つのノードで構成されるクラスターでは、最低でも 2 つのノードが稼働している必要があります。つまり、1 つのノードが停止していることを意味します。

- クラスターでは、5 つのノードで構成されるクラスターでは、3 つ以上のノードが利用可能でなければなりません。これは、2 つのノードが停止していることを意味します。

- 7 つのノードで構成されるクラスターでは、4 つ以上のノードが利用可能である必要があります。つまり、ダウンしている 3 つのノードを許容できることを意味します。

ZooKeeper クラスターでより多くのノードがあると、クラスター全体の回復性および信頼性が向上します。

ZooKeeper は、偶数のノードを使用してクラスターで実行することができます。ただし、追加のノードはクラスターの回復性を増やしません。4 つのノードで構成されるクラスターでは、少なくとも 3 つのノードが利用可能必要があり、1 つのノードのみを許容できます。そのため、3 つのノードのみを持つクラスターと同じ回復性があります。

理想的には、異なる ZooKeeper ノードは、異なるデータセンターまたはネットワークセグメントに配置する必要があります。ZooKeeper ノードの数を増やすと、クラスター同期で費やされたワークロードが増加します。ほとんどの Kafka ユースケースでは、3、5、または 7 のノードで構成される ZooKeeper クラスターで十分です。

3 つのノードで構成される ZooKeeper クラスターは、1 つの利用できないノードのみを許容できます。つまり、ZooKeeper クラスターの別のノードでメンテナンスを実施している間にクラスターノードがクラッシュすると、ZooKeeper クラスターが利用できないことになります。

複製された ZooKeeper 設定は、スタンドアロン設定でサポートされるすべての設定オプションをサポートします。クラスタリング設定の追加オプションが追加されます。

initLimit-

フォロワーがクラスターリーダーに接続および同期できるようにする時間。この時間は多数のティックとして指定されます(詳細は、

timeTickオプション を使用します)。 syncLimit-

フォロワーがリーダーの背後にある時間。この時間は多数のティックとして指定されます(詳細は、

timeTickオプション を使用します)。 reconfigEnabled- 動的再設定 を有効または無効にします。サーバーを ZooKeeper クラスターに追加または削除するには、有効にする必要があります。

standaloneEnabled- 1 台のサーバーでのみ ZooKeeper を実行するスタンドアロンモードを有効または無効にします。

上記のオプションに加え、すべての設定ファイルに ZooKeeper クラスターのメンバーである必要があるサーバーのリストが含まれている必要があります。サーバーレコードは server.id=hostname:port1:port2 の形式で指定する必要があります。

id- ZooKeeper クラスターノードの ID。

hostname- ノードが接続をリッスンするホスト名または IP アドレス。

port1- イントラクラスター通信に使用されるポート番号。

port2- リーダーの選択に使用するポート番号。

以下は、3 つのノードで構成される ZooKeeper クラスターの設定ファイルの例になります。

timeTick=2000 dataDir=/var/lib/zookeeper/ initLimit=5 syncLimit=2 reconfigEnabled=true standaloneEnabled=false server.1=172.17.0.1:2888:3888:participant;172.17.0.1:2181 server.2=172.17.0.2:2888:3888:participant;172.17.0.2:2181 server.3=172.17.0.3:2888:3888:participant;172.17.0.3:2181

ZooKeeper 3.5.7 では、使用する前に 4 文字の単語 コマンドを許可リストに追加する必要があります。詳細は、ZooKeeper ドキュメント を参照してください。

myid files

ZooKeeper クラスターの各ノードには一意の ID を割り当てる必要があります。各ノードの ID は myid ファイルで設定して、/var/lib/zookeeper/ などの dataDir フォルダーに保存する必要があります。myid ファイルには、ID がテキストとして書き込まれた 1 行のみ含まれている必要があります。ID には、1 から 255 までの任意の整数を使用できます。このファイルは、各クラスターノードに手動で作成する必要があります。このファイルを使用して、各 ZooKeeper インスタンスは設定ファイルの対応する server. 行の設定を使用してそのリスナーを設定します。また、その他すべての server. 行を使用して、他のクラスターメンバーも特定します。

上記の例では、3 つのノードがあるため、それぞれに 1、2、および 3 の値がそれぞれ異なる myid があります。

3.3. マルチノードの ZooKeeper クラスターの実行

この手順では、ZooKeeper をマルチノードクラスターとして設定および実行する方法を説明します。

ZooKeeper 3.5.7 では、使用する前に 4 文字の単語 コマンドを許可リストに追加する必要があります。詳細は、ZooKeeper ドキュメント を参照してください。

前提条件

- AMQ Streams は、ZooKeeper クラスターノードとして使用されるすべてのホストにインストールされます。

クラスターの実行

/var/lib/zookeeper/にmyidファイルを作成します。最初の ZooKeeper ノードの ID1、次の ZooKeeper ノードの2を入力します。su - kafka echo "<NodeID>" > /var/lib/zookeeper/myid以下に例を示します。

su - kafka echo "1" > /var/lib/zookeeper/myid

以下のように ZooKeeper の

/opt/kafka/config/zookeeper.properties設定ファイルを編集します。-

dataDirオプションを/var/lib/zookeeper/に設定します。 -

initLimitおよびsyncLimitオプションを設定します。 -

reconfigEnabledおよびstandaloneEnabledオプションを設定します。 すべての ZooKeeper ノードのリストを追加します。一覧には現在のノードも含まれます。

5 メンバーを持つ ZooKeeper クラスターのノードの設定例

timeTick=2000 dataDir=/var/lib/zookeeper/ initLimit=5 syncLimit=2 reconfigEnabled=true standaloneEnabled=false server.1=172.17.0.1:2888:3888:participant;172.17.0.1:2181 server.2=172.17.0.2:2888:3888:participant;172.17.0.2:2181 server.3=172.17.0.3:2888:3888:participant;172.17.0.3:2181 server.4=172.17.0.4:2888:3888:participant;172.17.0.4:2181 server.5=172.17.0.5:2888:3888:participant;172.17.0.5:2181

-

デフォルトの設定ファイルで ZooKeeper を起動します。

su - kafka /opt/kafka/bin/zookeeper-server-start.sh -daemon /opt/kafka/config/zookeeper.properties

ZooKeeper が稼働していることを確認します。

jcmd | grep zookeeper

- クラスターのすべてのノードでこの手順を繰り返します。

クラスターのすべてのノードを起動して実行したら、

ncatユーティリティーを使用して各ノードにstatコマンドを送信して、すべてのノードがクラスターのメンバーであることを確認します。ncat stat を使用してノードのステータスを確認します。

echo stat | ncat localhost 2181

この出力に、ノードが

leaderまたはfollowerのいずれかであることが確認できます。ncatコマンドの出力例ZooKeeper version: 3.4.13-2d71af4dbe22557fda74f9a9b4309b15a7487f03, built on 06/29/2018 00:39 GMT Clients: /0:0:0:0:0:0:0:1:59726[0](queued=0,recved=1,sent=0) Latency min/avg/max: 0/0/0 Received: 2 Sent: 1 Connections: 1 Outstanding: 0 Zxid: 0x200000000 Mode: follower Node count: 4

関連情報

- AMQ Streams のインストールに関する詳細は、「AMQ Streams のインストール」 を参照してください。

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

3.4. 認証

デフォルトでは、ZooKeeper は認証形式を使用せず、匿名接続を許可します。ただし、Simple Authentication and Security Layer(SASL)を使用した認証の設定に使用できる Java Authentication and Authorization Service(JAAS)をサポートします。ZooKeeper は、ローカルで保存された認証情報を使用した DIGEST-MD5 SASL メカニズムを使用した認証をサポートします。

3.4.1. SASL での認証

JAAS は別の設定ファイルを使用して設定します。JAAS 設定ファイルを ZooKeeper 設定と同じディレクトリー(/opt/kafka/config/)に配置することが推奨されます。推奨されるファイル名は zookeeper-jaas.conf です。複数のノードで ZooKeeper クラスターを使用する場合は、すべてのクラスターノードに JAAS 設定ファイルを作成する必要があります。

JAAS はコンテキストを使用して設定されます。サーバーとクライアントなどの個別の部分は常に個別の コンテキスト で設定されます。コンテキストは 設定 オプションで、以下の形式になります。

ContextName {

param1

param2;

};SASL 認証は、サーバー間通信(ZooKeeper インスタンス間の)とクライアント間の通信(Kafka と ZooKeeper の間)とクライアント間の通信(Kafka と ZooKeeper の間)に対して個別に設定されます。サーバー間の認証は、複数のノードを持つ ZooKeeper クラスターにのみ関連します。

サーバー間の認証

サーバー間の認証の場合、JAAS 設定ファイルには以下の 2 つの部分が含まれます。

- サーバー設定

- クライアント設定

DIGEST-MD5 SASL メカニズムを使用する場合、QuorumServer コンテキストを使用して認証サーバーを設定します。暗号化されていない形式でパスワードと接続できるようにするには、すべてのユーザー名が含まれている必要があります。2 つ目のコンテキスト QuorumLearner は、ZooKeeper に組み込まれているクライアントに設定する必要があります。また、パスワードを暗号化されていない形式で含んでいます。DIGEST-MD5 メカニズムの JAAS 設定ファイルの例を以下に示します。

QuorumServer {

org.apache.zookeeper.server.auth.DigestLoginModule required

user_zookeeper="123456";

};

QuorumLearner {

org.apache.zookeeper.server.auth.DigestLoginModule required

username="zookeeper"

password="123456";

};JAAS 設定ファイルの他に、以下のオプションを指定して、通常の ZooKeeper 設定ファイルでサーバー間の認証を有効にする必要があります。

quorum.auth.enableSasl=true quorum.auth.learnerRequireSasl=true quorum.auth.serverRequireSasl=true quorum.auth.learner.loginContext=QuorumLearner quorum.auth.server.loginContext=QuorumServer quorum.cnxn.threads.size=20

KAFKA_OPTS 環境変数を使用して、JAAS 設定ファイルを Java プロパティーとして ZooKeeper サーバーに渡します。

su - kafka export KAFKA_OPTS="-Djava.security.auth.login.config=/opt/kafka/config/zookeeper-jaas.conf"; /opt/kafka/bin/zookeeper-server-start.sh -daemon /opt/kafka/config/zookeeper.properties

サーバー間の認証に関する詳細は、「 ZooKeeper wiki 」を参照してください。

クライアント間の認証

クライアント間の認証は、サーバー間の認証と同じ JAAS ファイルで設定されます。ただし、サーバー間の認証とは異なり、サーバー設定のみが含まれます。設定のクライアント部分は、クライアントで実行する必要があります。認証を使用して ZooKeeper に接続するように Kafka ブローカーを設定する方法は、「 Kafka のインストール 」を参照してください。

Server コンテキストを JAAS 設定ファイルに追加し、クライアント間の認証を設定します。DIGEST-MD5 メカニズムでは、すべてのユーザー名とパスワードを設定します。

Server {

org.apache.zookeeper.server.auth.DigestLoginModule required

user_super="123456"

user_kafka="123456"

user_someoneelse="123456";

};JAAS コンテキストの設定後、以下の行を追加して ZooKeeper 設定ファイルで client-to-server 認証を有効にします。

requireClientAuthScheme=sasl authProvider.1=org.apache.zookeeper.server.auth.SASLAuthenticationProvider authProvider.2=org.apache.zookeeper.server.auth.SASLAuthenticationProvider authProvider.3=org.apache.zookeeper.server.auth.SASLAuthenticationProvider

ZooKeeper クラスターの一部であるすべてのサーバーに対して authProvider.<ID> プロパティーを追加する必要があります。

KAFKA_OPTS 環境変数を使用して、JAAS 設定ファイルを Java プロパティーとして ZooKeeper サーバーに渡します。

su - kafka export KAFKA_OPTS="-Djava.security.auth.login.config=/opt/kafka/config/zookeeper-jaas.conf"; /opt/kafka/bin/zookeeper-server-start.sh -daemon /opt/kafka/config/zookeeper.properties

Kafka ブローカーでの ZooKeeper 認証の設定に関する詳細は、「ZooKeeper の認証」 を参照してください。

3.4.2. DIGEST-MD5 を使用したサーバー間の認証の有効化

この手順では、ZooKeeper クラスターのノード間で SASL DIGEST-MD5 メカニズムを使用して認証を有効にする方法を説明します。

前提条件

- AMQ Streams がホストにインストールされていること。

- ZooKeeper クラスターは複数のノードで 設定され ます。

SASL DIGEST-MD5 認証の有効化

すべての ZooKeeper ノードで

/opt/kafka/config/zookeeper-jaas.confJAAS 設定ファイルを作成または編集し、以下のコンテキストを追加します。QuorumServer { org.apache.zookeeper.server.auth.DigestLoginModule required user_<Username>="<Password>"; }; QuorumLearner { org.apache.zookeeper.server.auth.DigestLoginModule required username="<Username>" password="<Password>"; };ユーザー名とパスワードは JAAS コンテキストの両方で同じである必要があります。以下に例を示します。

QuorumServer { org.apache.zookeeper.server.auth.DigestLoginModule required user_zookeeper="123456"; }; QuorumLearner { org.apache.zookeeper.server.auth.DigestLoginModule required username="zookeeper" password="123456"; };すべての ZooKeeper ノードで

/opt/kafka/config/zookeeper.propertiesZooKeeper 設定ファイルを編集し、以下のオプションを設定します。quorum.auth.enableSasl=true quorum.auth.learnerRequireSasl=true quorum.auth.serverRequireSasl=true quorum.auth.learner.loginContext=QuorumLearner quorum.auth.server.loginContext=QuorumServer quorum.cnxn.threads.size=20

すべての ZooKeeper ノードを 1 つずつ再起動します。JAAS 設定を ZooKeeper に渡すには、

KAFKA_OPTS環境変数を使用します。su - kafka export KAFKA_OPTS="-Djava.security.auth.login.config=/opt/kafka/config/zookeeper-jaas.conf"; /opt/kafka/bin/zookeeper-server-start.sh -daemon /opt/kafka/config/zookeeper.properties

関連情報

- AMQ Streams のインストールに関する詳細は、「AMQ Streams のインストール」 を参照してください。

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- ZooKeeper クラスターの実行に関する詳細は、「マルチノードの ZooKeeper クラスターの実行」 を参照してください。

3.4.3. DIGEST-MD5 を使用したクライアント間の認証の有効化

この手順では、ZooKeeper クライアントと ZooKeeper の間で SASL DIGEST-MD5 メカニズムを使用して認証を有効にする方法を説明します。

前提条件

- AMQ Streams がホストにインストールされていること。

- ZooKeeper クラスターが 設定され、実行されている。

SASL DIGEST-MD5 認証の有効化

すべての ZooKeeper ノードで

/opt/kafka/config/zookeeper-jaas.confJAAS 設定ファイルを作成または編集し、以下のコンテキストを追加します。Server { org.apache.zookeeper.server.auth.DigestLoginModule required user_super="<SuperUserPassword>" user<Username1>_="<Password1>" user<USername2>_="<Password2>"; };superには、管理者の priviledges が自動的に付与します。ファイルには複数のユーザーを含めることができますが、Kafka ブローカーに必要な追加ユーザーのみが 1 つだけです。Kafka ユーザーに推奨される名前はkafkaです。以下の例は、クライアント/サーバー認証の

Serverコンテキストを示しています。Server { org.apache.zookeeper.server.auth.DigestLoginModule required user_super="123456" user_kafka="123456"; };すべての ZooKeeper ノードで

/opt/kafka/config/zookeeper.propertiesZooKeeper 設定ファイルを編集し、以下のオプションを設定します。requireClientAuthScheme=sasl authProvider.<IdOfBroker1>=org.apache.zookeeper.server.auth.SASLAuthenticationProvider authProvider.<IdOfBroker2>=org.apache.zookeeper.server.auth.SASLAuthenticationProvider authProvider.<IdOfBroker3>=org.apache.zookeeper.server.auth.SASLAuthenticationProvider

authProvider.<ID>プロパティーは、ZooKeeper クラスターの一部であるすべてのノードに対して追加する必要があります。3 ノードの ZooKeeper クラスターの設定例は以下のようになります。requireClientAuthScheme=sasl authProvider.1=org.apache.zookeeper.server.auth.SASLAuthenticationProvider authProvider.2=org.apache.zookeeper.server.auth.SASLAuthenticationProvider authProvider.3=org.apache.zookeeper.server.auth.SASLAuthenticationProvider

すべての ZooKeeper ノードを 1 つずつ再起動します。JAAS 設定を ZooKeeper に渡すには、

KAFKA_OPTS環境変数を使用します。su - kafka export KAFKA_OPTS="-Djava.security.auth.login.config=/opt/kafka/config/zookeeper-jaas.conf"; /opt/kafka/bin/zookeeper-server-start.sh -daemon /opt/kafka/config/zookeeper.properties

関連情報

- AMQ Streams のインストールに関する詳細は、「AMQ Streams のインストール」 を参照してください。

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- ZooKeeper クラスターの実行に関する詳細は、「マルチノードの ZooKeeper クラスターの実行」 を参照してください。

3.5. 承認

ZooKeeper はアクセス制御リスト(ACL)をサポートし、そこに格納されているデータを保護します。Kafka ブローカーは、他の ZooKeeper ユーザーが変更できないように、作成するすべての ZooKeeper レコードの ACL 権限を自動的に設定できます。

Kafka ブローカーでの ZooKeeper ACL の有効化に関する詳細は、「ZooKeeper の承認」 を参照してください。

3.6. TLS

ZooKeeper は暗号化または認証に対して TLS をサポートします。

3.7. 追加の設定オプション

ユースケースに応じて、以下の追加の ZooKeeper 設定オプションを設定できます。

maxClientCnxns- ZooKeeper クラスターの単一のメンバーへの同時クライアント接続の最大数。

autopurge.snapRetainCount-

保持される ZooKeeper のインメモリーデータベースのスナップショットの数。デフォルト値は

3です。 autopurge.purgeInterval-

スナップショットを消去する時間間隔。デフォルト値は

0で、このオプションは無効になります。

使用できる設定オプションはすべて ZooKeeper のドキュメントを参照してください。

3.8. ログ

ZooKeeper はログインフラストラクチャーとして log4j を使用します。ロギング設定は、/opt/kafka/config/ ディレクトリーまたはクラスパスのどちらに配置する必要がある log4j.properties 設定ファイルからデフォルトで読み取られます。設定ファイルの場所と名前は、KAFKA_LOG4J_OPTS 環境変数を使用して ZooKeeper に渡すことのできる Java プロパティー log4j.configuration を使用して変更できます。

su - kafka export KAFKA_LOG4J_OPTS="-Dlog4j.configuration=file:/my/path/to/log4j.properties"; /opt/kafka/bin/zookeeper-server-start.sh -daemon /opt/kafka/config/zookeeper.properties

Log4j の設定に関する詳細は、Log4j ドキュメント を参照してください。

第4章 Kafka の設定

Kafka はプロパティーファイルを使用して静的設定を保存します。設定ファイルの推奨場所は /opt/kafka/config/server.properties です。設定ファイルは、kafka ユーザーが読み取り可能でなければなりません。

AMQ Streams には、製品のさまざまな基本機能や高度な機能を強調表示する設定ファイルのサンプルが含まれています。AMQ Streams インストールディレクトリーの config/server.properties にあります。

本章では、最も重要な設定オプションについて説明します。サポートされる Kafka ブローカー設定オプションの完全リストは、付録A ブローカー設定パラメーター を参照してください。

4.1. ZooKeeper

Kafka ブローカーは、クラスターの一部の設定も保存し、クラスターを調整する必要があります(たとえば、パーティションのリーダーであるノードを決定)。ZooKeeper クラスターの接続の詳細は設定ファイルに保存されます。フィールド zookeeper.connect には、zookeeper クラスターのメンバーのホスト名およびポートのコンマ区切りリストが含まれます。

以下に例を示します。

zookeeper.connect=zoo1.my-domain.com:2181,zoo2.my-domain.com:2181,zoo3.my-domain.com:2181

Kafka はこれらのアドレスを使用して ZooKeeper クラスターに接続します。この設定では、すべての Kafka znodes が ZooKeeper データベースのルートに直接作成されます。そのため、ZooKeeper クラスターは単一の Kafka クラスターにのみ使用できます。単一の ZooKeeper クラスターを使用するように複数の Kafka クラスターを設定するには、Kafka 設定ファイルの ZooKeeper 接続文字列の最後にベース(プレフィックス)パスを指定します。

zookeeper.connect=zoo1.my-domain.com:2181,zoo2.my-domain.com:2181,zoo3.my-domain.com:2181/my-cluster-1

4.2. リスナー

Kafka ブローカーは、複数のリスナーを使用するように設定できます。各リスナーは異なるポートまたはネットワークインターフェースをリッスンするために使用され、異なる設定を指定できます。リスナーは、設定ファイルの listeners プロパティーで設定されます。listeners プロパティーには、各リスナーが <listenerName>://<hostname>:_<port>_ として設定されたリスナーのリストが含まれます。ホスト名の値が空の場合、Kafka は java.net.InetAddress.getCanonicalHostName() をホスト名として使用します。以下の例は、複数のリスナーの設定方法を示しています。

listeners=INT1://:9092,INT2://:9093,REPLICATION://:9094

Kafka クライアントが Kafka クラスターに接続する場合は、最初に ブートストラップサーバー に接続します。ブートストラップサーバー はクラスターノードの 1 つです。クライアントには、クラスターの一部である他のすべてのブローカーの一覧を提供し、クライアントは個別に接続します。デフォルトでは、ブートストラップサーバー は listeners フィールドに基づくノードのリストをクライアントに提供します。

アドバタイズされたリスナー

listeners プロパティーに指定されたものとは異なるアドレスのセットをクライアントに付与することができます。プロキシーなどの追加のネットワークインフラストラクチャーがクライアントとブローカー間、または IP アドレスの代わりに外部 DNS 名が使用される場合に役立ちます。このブローカーは、advertised.listeners 設定プロパティーでリスナーのアドバタイズされたアドレスを定義できます。このプロパティーは listeners プロパティーと同じフォーマットになります。以下の例は、アドバタイズされたリスナーの設定方法を示しています。

listeners=INT1://:9092,INT2://:9093 advertised.listeners=INT1://my-broker-1.my-domain.com:1234,INT2://my-broker-1.my-domain.com:1234:9093

リスナーの名前は、listeners プロパティーのリスナー名と一致する必要があります。

ブローカー間のリスナー

クラスターにトピックがレプリケートされたら、このようなトピックを担当するブローカーは、これらのトピックでメッセージをレプリケートするために相互に通信する必要があります。複数のリスナーが設定される場合、設定フィールド inter.broker.listener.name を使用してブローカー間のレプリケーションに使用されるリスナーの名前を指定します。以下に例を示します。

inter.broker.listener.name=REPLICATION

4.3. ログのコミット

Apache Kafka は、プロデューサーから受信するすべてのレコードをコミットログに保存します。コミットログには、Kafka が配信する必要のあるレコード形式で実際のデータが含まれます。これらは、ブローカーが実行する内容を記録するアプリケーションのログファイルではありません。

ログディレクトリー

log.dirs プロパティーファイルを使用してログディレクトリーを設定し、1 つまたは複数のログディレクトリーにコミットログを保存できます。インストール時に作成した /var/lib/kafka ディレクトリーに設定する必要があります。

log.dirs=/var/lib/kafka

パフォーマンス上の理由から、log.dir を複数のディレクトリーに設定し、各ディレクトリーを異なる物理デバイスに配置して、ディスク I/O のパフォーマンスを向上できます。以下に例を示します。

log.dirs=/var/lib/kafka1,/var/lib/kafka2,/var/lib/kafka3

4.4. Broker ID

ブローカー ID は、クラスター内の各ブローカーの一意の識別子です。0 以上の整数をブローカー ID に割り当てることができます。ブローカー ID は、再起動またはクラッシュ後にブローカーを識別するために使用されます。そのため、ID が安定し、時間の経過とともに変更しないことが重要です。ブローカー ID はブローカープロパティーファイルで設定されます。

broker.id=1

4.5. マルチノードの Kafka クラスターの実行

この手順では、Kafka をマルチノードクラスターとして設定および実行する方法を説明します。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストに インストール されます。

- ZooKeeper クラスターが 設定され、実行されている。

クラスターの実行

AMQ Streams クラスターの Kafka ブローカーごとに以下を行います。

以下のように

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集します。-

最初のブローカーの

broker.idフィールドを0、第 2 ブローカーの1などに設定します。 -

zookeeper.connectオプションで ZooKeeper に接続する詳細を設定します。 - Kafka リスナーを設定します。

コミットログが

logs.dirディレクトリーに格納されるディレクトリーを設定します。Kafka ブローカーの設定例は次のとおりです。

broker.id=0 zookeeper.connect=zoo1.my-domain.com:2181,zoo2.my-domain.com:2181,zoo3.my-domain.com:2181 listeners=REPLICATION://:9091,PLAINTEXT://:9092 inter.broker.listener.name=REPLICATION log.dirs=/var/lib/kafka

各 Kafka ブローカーが同じハードウェアで実行されている一般的なインストールでは、

broker.id設定プロパティーのみがブローカー設定によって異なります。

-

最初のブローカーの

デフォルトの設定ファイルを使用して Kafka ブローカーを起動します。

su - kafka /opt/kafka/bin/kafka-server-start.sh -daemon /opt/kafka/config/server.properties

Kafka ブローカーが稼働していることを確認します。

jcmd | grep Kafka

ブローカーの検証

クラスターのすべてのノードが稼働したら、ncat ユーティリティーを使用して dump コマンドを ZooKeeper ノードの 1 つに送信し、すべてのノードが Kafka クラスターのメンバーであることを確認します。このコマンドは、ZooKeeper に登録されているすべての Kafka ブローカーを出力します。

ncat stat を使用してノードのステータスを確認します。

echo dump | ncat zoo1.my-domain.com 2181

出力には、先ほど設定および起動したすべての Kafka ブローカーが含まれている必要があります。

3 つのノードで構成される Kafka クラスターの

ncatコマンドからの出力例:SessionTracker dump: org.apache.zookeeper.server.quorum.LearnerSessionTracker@28848ab9 ephemeral nodes dump: Sessions with Ephemerals (3): 0x20000015dd00000: /brokers/ids/1 0x10000015dc70000: /controller /brokers/ids/0 0x10000015dc70001: /brokers/ids/2

関連情報

- AMQ Streams のインストールに関する詳細は、「AMQ Streams のインストール」 を参照してください。

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- ZooKeeper クラスターの実行に関する詳細は、「マルチノードの ZooKeeper クラスターの実行」 を参照してください。

- サポートされる Kafka ブローカー設定オプションの完全リストは、付録A ブローカー設定パラメーター を参照してください。

4.6. ZooKeeper の認証

デフォルトでは、ZooKeeper と Kafka 間の接続は認証されません。ただし、Kafka および ZooKeeper は、SASL(Simple Authentication and Security Layer)を使用して認証を設定するために使用できる Java Authentication and Authorization Service(JAAS)をサポートします。ZooKeeper は、ローカルで保存された認証情報を使用した DIGEST-MD5 SASL メカニズムを使用した認証をサポートします。

4.6.1. JAAS 設定

ZooKeeper 接続の SASL 認証は JAAS 設定ファイルで設定する必要があります。デフォルトでは、Kafka は ZooKeeper に接続するために Client という名前の JAAS コンテキストを使用します。Client コンテキストは /opt/kafka/config/jass.conf ファイルで設定する必要があります。以下の例のように、コンテキストは PLAIN SASL 認証を有効にする必要があります。

Client {

org.apache.kafka.common.security.plain.PlainLoginModule required

username="kafka"

password="123456";

};4.6.2. ZooKeeper 認証の有効化

この手順では、ZooKeeper に接続する際に SASL DIGEST-MD5 メカニズムを使用して認証を有効にする方法を説明します。

前提条件

- ZooKeeper でクライアント間の認証が 有効 である。

SASL DIGEST-MD5 認証の有効化

すべての Kafka ブローカーノードで

/opt/kafka/config/jaas.confJAAS 設定ファイルを作成または編集し、以下のコンテキストを追加します。Client { org.apache.kafka.common.security.plain.PlainLoginModule required username="<Username>" password="<Password>"; };ユーザー名とパスワードは ZooKeeper で設定されるものと同じである必要があります。

以下の例は、

Clientコンテキストを示しています。Client { org.apache.kafka.common.security.plain.PlainLoginModule required username="kafka" password="123456"; };すべての Kafka ブローカーノードを 1 つずつ再起動します。JAAS 設定を Kafka ブローカーに渡すには、

KAFKA_OPTS環境変数を使用します。su - kafka export KAFKA_OPTS="-Djava.security.auth.login.config=/opt/kafka/config/jaas.conf"; /opt/kafka/bin/kafka-server-start.sh -daemon /opt/kafka/config/server.properties

関連情報

- ZooKeeper でのクライアント/サーバー認証の設定に関する詳細は、「認証」 を参照してください。

4.7. 承認

Kafka ブローカーの承認は、オーソライザープラグインを使用して実装されます。

ここでは、Kafka で提供される AclAuthorizer プラグインを使用する方法を説明します。

または、独自の承認プラグインを使用することもできます。たとえば、OAuth 2.0 トークンベースの認証 を使用している場合、OAuth 2.0 承認 を使用できます。

4.7.1. シンプル ACL オーソライザー

AclAuthorizer を含むオーソライザープラグインは、authorizer.class.name プロパティーを使用して有効になります。

authorizer.class.name=kafka.security.auth.SimpleAclAuthorizer

選択したオーソライザーには完全修飾名が必要です。AclAuthorizer では、完全修飾名は kafka.security.auth.SimpleAclAuthorizer です。

4.7.1.1. ACL ルール

AclAuthorizer は、ACL ルールを使用して Kafka ブローカーへのアクセスを管理します。

ACL ルールは、以下の形式で定義されます。

principal P is allowed/ denied operation O on Kafka resource R from host H

たとえば、ユーザーが以下を行うようにルールを設定できます。

John は、ホスト 127.0.0.1からトピックの コメント を 表示 できます。

host は、John が接続しているマシンの IP アドレスです。

多くの場合、ユーザーはプロデューサーまたはコンシューマーアプリケーションです。

consumer01 は、ホスト 127.0.0.1 から コンシューマーグループアカウントに 書き込む ことができる。

ACL ルールが存在しない場合

指定のリソースに ACL ルールが存在しない場合は、すべてのアクションが拒否されます。この動作は、Kafka 設定ファイルの allow.everyone.if.no.acl.found プロパティーを true に設定すると変更できます。/opt/kafka/config/server.properties

4.7.1.2. principals

プリンシパル はユーザーのアイデンティティーを表します。ID の形式は、クライアントが Kafka に接続するための認証メカニズムによって異なります。

-

User:ANONYMOUS認証なしで接続する場合。 User:<username>PLAIN や SCRAM などの簡単な認証メカニズムを使用して接続する場合。例:

User:adminまたはUser:user1User:<DistinguishedName>TLS クライアント認証を使用して接続する場合。たとえば、

User:CN=user1,O=MyCompany,L=Prague,C=CZのようになります。-

User:<Kerberos username>Kerberos を使用して接続する場合

distinguishedName は クライアント証明書からの識別名です。

Kerberos ユーザー名 は、Kerberos プリンシパルの主な部分で、Kerberos を使用した接続時にデフォルトで使用されます。sasl.kerberos.principal.to.local.rules プロパティーを使用すると、Kerberos プリンシパルから Kafka プリンシパルを構築する方法を設定できます。

4.7.1.3. ユーザーの認証

承認を使用するには、クライアントが認証を有効にし、使用する必要があります。それ以外の場合は、すべての接続にプリンシパル User:ANONYMOUS があります。

認証方法の詳細については、「 Encryption and authentication 」を参照してください。

4.7.1.4. スーパーユーザー

スーパーユーザーを使用すると、ACL ルールに関係なくすべてのアクションを実行することができます。

スーパーユーザーは、super.users プロパティーを使用して Kafka 設定ファイルで定義されます。

以下に例を示します。

super.users=User:admin,User:operator

4.7.1.5. レプリカブローカーの認証

承認を有効にすると、すべてのリスナーおよびすべての接続に適用されます。これには、ブローカー間のデータの複製に使用されるブローカー間接続が含まれます。そのため、承認を有効にする場合は、ブローカー間の接続に認証を使用し、ブローカーが十分な権限を付与していることを確認します。たとえば、ブローカー間の認証で kafka-broker ユーザーが使用される場合、スーパーユーザー設定にユーザー名 super.users=User:kafka-broker が含まれる必要があります。

4.7.1.6. サポートされるリソース

Kafka ACL は、以下のタイプのリソースに適用できます。

- トピック

- コンシューマーグループ

- クラスター

- TransactionId

- DelegationToken

4.7.1.7. サポートされる演算

AclAuthorizer リソースの操作を承認します。

以下の表の X を持つフィールドは、各リソースでサポートされる操作をマークします。

表4.1 リソースでサポートされる操作

| トピック | コンシューマーグループ | クラスター | |

|---|---|---|---|

| Read | X | X | |

| Write | X | ||

| Create | X | ||

| Delete | X | ||

| Alter | X | ||

| Describe | X | X | X |

| ClusterAction | X | ||

| すべて | X | X | X |

4.7.1.8. ACL 管理オプション

ACL ルールは、Kafka ディストリビューションパッケージの一部として提供される bin/kafka-acls.sh ユーティリティーを使用して管理されます。

kafka-acls.sh パラメーターオプションを使用して ACL ルールを追加、一覧表示、および削除し、その他の機能を実行します。

パラメーターには、--add のように 2 倍の規則が必要です。

| オプション | 型 | 説明 | デフォルト |

|---|---|---|---|

|

| 動作 | ACL ルールを追加します。 | |

|

| 動作 | ACL ルールを削除します。 | |

|

| 動作 | ACL ルールの一覧を表示します。 | |

|

| 動作 | オーソライザーの完全修飾クラス名。 |

|

|

| 設定 | 初期化のためにオーソライザーに渡されるキー/値のペア。

| |

|

| リソース | Kafka クラスターに接続するためのホスト/ポートのペア。 |

両方ではなく、このオプションまたは |

|

| リソース |

| |

|

| リソース | クラスターを ACL リソースとして指定します。 | |

|

| リソース | トピック名を ACL リソースとして指定します。

ワイルドカードとして使用されるアスタリスク(

1 つのコマンドで、複数の | |

|

| リソース | コンシューマーグループ名を ACL リソースとして指定します。

1 つのコマンドで、複数の | |

|

| リソース | ACL リソースとしてトランザクション ID を指定します。 トランザクション配信は、プロデューサーによって複数のパーティションに送信されたすべてのメッセージを正常に配信したり、何も指定しないことを意味します。

ワイルドカードとして使用されるアスタリスク( | |

|

| リソース | 委譲トークンを ACL リソースとして指定します。

ワイルドカードとして使用されるアスタリスク( | |

|

| 設定 |

|

|

|

| principal | 許可 ACL ルールに追加されたプリンシパル。

1 つのコマンドで、複数の | |

|

| principal | プリンシパルが拒否 ACL ルールに追加される。

1 つのコマンドで、複数の | |

|

| principal |

プリンシパルの ACL 一覧を返す際に

1 つのコマンドで、複数の | |

|

| ホスト |

ホスト名または CIDR 範囲はサポートされません。 |

|

|

| ホスト |

ホスト名または CIDR 範囲はサポートされません。 |

|

|

| 演算子 | 操作を許可または拒否します。

1 つのコマンドで、複数の Multiple | すべて |

|

| ショートカット | メッセージプロデューサーが必要とするすべての操作を許可または拒否するショートカット(トピック上の WRITE および DESCRIBE、クラスターの CREATE)。 | |

|

| ショートカット | メッセージコンシューマーが必要とするすべての操作を許可または拒否するショートカット(トピックの READ および DESCRIBE、コンシューマーグループの READ)。 | |

|

| ショートカット |

Idepmotence は、プロデューサーが特定のトランザクション ID に基づいてメッセージを送信できると、自動的に有効になります。 | |

|

| ショートカット | すべてのクエリーを受け入れ、プロンプトを表示しないショートカット。 |

4.7.2. 承認の有効化

この手順では、Kafka ブローカーで承認の AclAuthorizer プラグインを有効にする方法を説明します。

手順

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集してAclAuthorizerを使用します。authorizer.class.name=kafka.security.auth.SimpleAclAuthorizer

- (re)Kafka ブローカーを起動します。

関連情報

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- Kafka クラスターの実行に関する詳細は、「マルチノードの Kafka クラスターの実行」 を参照してください。

4.7.3. ACL ルールの追加

AclAuthorizer アクセス制御リスト(ACL)を使用します。これは、ユーザーがどのユーザーが実行できるかを記述する一連のルールを定義します。

この手順では、Kafka ブローカーで AclAuthorizer プラグインの使用時に ACL ルールを追加する方法を説明します。

ルールは kafka-acls.sh ユーティリティーを使用して追加され、ZooKeeper に保存されます。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストにインストール されます。

- 承認は Kafka ブローカーで 有効 になります。

手順

--addオプションを指定してkafka-acls.shを実行します。例:

MyConsumerGroupコンシューマーグループを使用してuser1およびuser2アクセスがmyTopicから読み取りできるようにします。bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --add --operation Read --topic myTopic --allow-principal User:user1 --allow-principal User:user2 bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --add --operation Describe --topic myTopic --allow-principal User:user1 --allow-principal User:user2 bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --add --operation Read --operation Describe --group MyConsumerGroup --allow-principal User:user1 --allow-principal User:user2

IP アドレス

127.0.0.1からmyTopicを読み取るuser1アクセスを拒否します。bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --add --operation Describe --operation Read --topic myTopic --group MyConsumerGroup --deny-principal User:user1 --deny-host 127.0.0.1

MyConsumerGroupを使用してmyTopicのコンシューマーとしてuser1を追加します。bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --add --consumer --topic myTopic --group MyConsumerGroup --allow-principal User:user1

関連情報

-

すべての

kafka-acls.shオプションの一覧は、「シンプル ACL オーソライザー」 を参照してください。

4.7.4. ACL ルールの一覧表示

この手順では、Kafka ブローカーで AclAuthorizer プラグインの使用時に既存の ACL ルールの一覧を表示する方法を説明します。

ルールは、kafka-acls.sh ユーティリティーを使用して一覧表示されます。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストにインストール されます。

- Kafka ブローカーで承認が 有効になっ ている必要があります。

- ACL が 追加 されました。

手順

--listオプションを指定してkafka-acls.shを実行します。以下に例を示します。

$ bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --list --topic myTopic Current ACLs for resource `Topic:myTopic`: User:user1 has Allow permission for operations: Read from hosts: * User:user2 has Allow permission for operations: Read from hosts: * User:user2 has Deny permission for operations: Read from hosts: 127.0.0.1 User:user1 has Allow permission for operations: Describe from hosts: * User:user2 has Allow permission for operations: Describe from hosts: * User:user2 has Deny permission for operations: Describe from hosts: 127.0.0.1

関連情報

-

すべての

kafka-acls.shオプションの一覧は、「シンプル ACL オーソライザー」 を参照してください。

4.7.5. ACL ルールの削除

この手順では、Kafka ブローカーで AclAuthorizer プラグインの使用時に ACL ルールを削除する方法を説明します。

ルールは kafka-acls.sh ユーティリティーを使用して削除されます。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストにインストール されます。

- 承認は Kafka ブローカーで 有効 になります。

- ACL が 追加 されました。

手順

--removeオプションを指定してkafka-acls.shを実行します。例:

MyConsumerGroupコンシューマーグループを使用して、myTopicから読み込むuser1およびuser2アクセスを許可する ACL を削除します。bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --remove --operation Read --topic myTopic --allow-principal User:user1 --allow-principal User:user2 bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --remove --operation Describe --topic myTopic --allow-principal User:user1 --allow-principal User:user2 bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --remove --operation Read --operation Describe --group MyConsumerGroup --allow-principal User:user1 --allow-principal User:user2

MyConsumerGroupを使用してmyTopicのコンシューマーとしてuser1を追加して ACL を削除します。bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --remove --consumer --topic myTopic --group MyConsumerGroup --allow-principal User:user1

user1アクセスを拒否し、IP アドレスホスト127.0.0.1からmyTopicを読み取るように拒否する ACL を削除します。bin/kafka-acls.sh --authorizer-properties zookeeper.connect=zoo1.my-domain.com:2181 --remove --operation Describe --operation Read --topic myTopic --group MyConsumerGroup --deny-principal User:user1 --deny-host 127.0.0.1

関連情報

-

すべての

kafka-acls.shオプションの一覧は、「シンプル ACL オーソライザー」 を参照してください。 - 承認の有効化に関する詳細は、「承認の有効化」 を参照してください。

4.8. ZooKeeper の承認

Kafka と ZooKeeper 間で認証が有効になっている場合、ZooKeeper アクセス制御リスト(ACL)ルールを使用して、ZooKeeper に保存される Kafka のメタデータへのアクセスを自動的に制御できます。

4.8.1. ACL 設定

ZooKeeper ACL ルールの適用は、config/server.properties Kafka 設定ファイルの zookeeper.set.acl プロパティーによって制御されます。

このプロパティーはデフォルトでは無効になっており、true に設定して有効にします。

zookeeper.set.acl=true

ACL ルールが有効な場合、znode が ZooKeeper で作成されると、変更または削除が可能な Kafka ユーザーのみが ZooKeeper で作成されます。他のすべてのユーザーは読み取り専用アクセスを持ちます。

Kafka は、新規に作成された ZooKeeper znodes に対してのみ ACL ルールを設定します。クラスターの初回の起動後に ACL が有効になると、zookeeper-security-migration.sh ツールはすべての既存 znodes で ACL を設定することができます。

ZooKeeper でのデータの機密性

ZooKeeper に保存されるデータには以下が含まれます。

- トピック名およびその設定

- SASL SCRAM 認証が使用される場合に、ソルトおよびハッシュ化されたユーザー認証情報。

しかし、ZooKeeper は Kafka を使用して送受信されたレコードを保存しません。ZooKeeper に保存されるデータは特定されないことが想定されます。

データが機密であると思われる場合(トピック名には顧客 ID が含まれるなど)、保護に使用できる唯一のオプションはネットワークレベルで ZooKeeper を分離するだけで、Kafka ブローカーへのアクセスを許可します。

4.8.2. 新しい Kafka クラスターの ZooKeeper ACL の有効化

この手順では、新しい Kafka クラスターの Kafka 設定で ZooKeeper ACL を有効にする方法を説明します。この手順は、Kafka クラスターの最初の起動前にのみ使用してください。既に実行しているクラスターで ZooKeeper ACL を有効にする場合は、「既存の Kafka クラスターでの ZooKeeper ACL の有効化」 を参照してください。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストに インストール されます。

- ZooKeeper クラスターが 設定され、実行されている。

- ZooKeeper でクライアント間の認証が 有効 になります。

- ZooKeeper 認証は Kafka ブローカーで 有効 になります。

- Kafka ブローカーが起動していません。

手順

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集し、すべてのクラスターノードのzookeeper.set.aclフィールドをtrueに設定します。zookeeper.set.acl=true

- Kafka ブローカーを起動します。

4.8.3. 既存の Kafka クラスターでの ZooKeeper ACL の有効化

この手順では、稼働中の Kafka クラスターの Kafka 設定で ZooKeeper ACL を有効にする方法を説明します。zookeeper-security-migration.sh ツールを使用して、既存の znodes すべてに ZooKeeper ACL を設定します。zookeeper-security-migration.sh は AMQ Streams の一部として使用でき、bin ディレクトリーにあります。

前提条件

- Kafka クラスターが 設定され、稼働している。

ZooKeeper ACL の有効化

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集し、すべてのクラスターノードのzookeeper.set.aclフィールドをtrueに設定します。zookeeper.set.acl=true

- すべての Kafka ブローカーを 1 つずつ再起動します。

zookeeper-security-migration.shツールを使用して、既存の ZooKeeperznodesに ACL を設定します。su - kafka cd /opt/kafka KAFKA_OPTS="-Djava.security.auth.login.config=./config/jaas.conf"; ./bin/zookeeper-security-migration.sh --zookeeper.acl=secure --zookeeper.connect=<ZooKeeperURL> exit以下に例を示します。

su - kafka cd /opt/kafka KAFKA_OPTS="-Djava.security.auth.login.config=./config/jaas.conf"; ./bin/zookeeper-security-migration.sh --zookeeper.acl=secure --zookeeper.connect=zoo1.my-domain.com:2181 exit

4.9. 暗号化および認証

AMQ Streams は、リスナー設定の一部として設定された暗号化および認証をサポートします。

4.9.1. リスナーの設定

Kafka ブローカーの暗号化および認証はリスナーごとに設定されます。Kafka リスナーの設定に関する詳細は、「リスナー」 を参照してください。

Kafka ブローカーの各リスナーは、独自のセキュリティープロトコルで設定されます。設定プロパティー listener.security.protocol.map は、セキュリティープロトコルを使用するリスナーを定義します。各リスナー名をセキュリティープロトコルにマッピングします。サポートされるセキュリティープロトコルは以下のとおりです。

PLAINTEXT- 暗号化または認証のないリスナー。

SSL- TLS による暗号化を使用し、任意で TLS クライアント証明書を使用した認証。

SASL_PLAINTEXT- 暗号化がなく、SASL ベースの認証を使用するリスナー。

SASL_SSL- TLS ベースの暗号化および SASL ベースの認証を使用するリスナー。

以下の listeners 設定を指定します。

listeners=INT1://:9092,INT2://:9093,REPLICATION://:9094

listener.security.protocol.map は以下の例のようになります。

listener.security.protocol.map=INT1:SASL_PLAINTEXT,INT2:SASL_SSL,REPLICATION:SSL

これにより、リスナー INT1 が SASL 認証との暗号化されていない接続を使用するように、リスナー INT2 は SASL 認証との暗号化された接続を使用するように、および REPLICATION インターフェースを TLS 暗号化(TLS クライアント認証など)を使用するように設定します。同じセキュリティープロトコルを複数回使用できます。以下の例は、有効な設定です。

listener.security.protocol.map=INT1:SSL,INT2:SSL,REPLICATION:SSL

このような設定では、全インターフェースに TLS 暗号化と TLS 認証を使用します。以下の章では、TLS および SASL の設定方法について説明します。

4.9.2. TLS 暗号化

Kafka は、Kafka クライアントとの通信を暗号化するために TLS をサポートします。

TLS 暗号化およびサーバーの認証を使用するには、秘密鍵と公開鍵を含むキーストアを指定する必要があります。通常、これは Java Keystore(JKS)形式のファイルを使用して行われます。このファイルへのパスは、ssl.keystore.location プロパティーで設定されます。ssl.keystore.password プロパティーを使用して、キーストアを保護するパスワードを設定する必要があります。以下に例を示します。

ssl.keystore.location=/path/to/keystore/server-1.jks ssl.keystore.password=123456

秘密鍵を保護するために、追加のパスワードが使用されることがあります。このようなパスワードは、ssl.key.password プロパティーを使用して設定できます。

Kafka は認証局によって署名されたキーと自己署名証明書を使用できます。認証局が署名した鍵の使用は、常に優先される方法である必要があります。クライアントが接続している Kafka ブローカーの ID を検証できるようにするには、証明書に、コモンネーム(CN)または Subject Alternative Names(SAN)としてアドバタイズされたホスト名が常に含まれている必要があります。

異なるリスナーに異なる SSL 設定を使用できます。ssl. で始まるすべてのオプションの前に listener.name.<NameOfTheListener>. を付けることができます。ここで、リスナーの名前は小文字の場合に常に必要になります。これにより、その特定のリスナーのデフォルトの SSL 設定が上書きされます。以下の例は、異なるリスナーに異なる SSL 設定を使用する方法を表しています。

listeners=INT1://:9092,INT2://:9093,REPLICATION://:9094 listener.security.protocol.map=INT1:SSL,INT2:SSL,REPLICATION:SSL # Default configuration - will be used for listeners INT1 and INT2 ssl.keystore.location=/path/to/keystore/server-1.jks ssl.keystore.password=123456 # Different configuration for listener REPLICATION listener.name.replication.ssl.keystore.location=/path/to/keystore/server-1.jks listener.name.replication.ssl.keystore.password=123456

追加の TLS 設定オプション

上記の主な TLS 設定オプションに加え、Kafka は TLS 設定を調整するための多くのオプションをサポートしています。たとえば、TLS / SSL プロトコルまたは暗号スイートを有効または無効にするには、次のコマンドを実行します。

ssl.cipher.suites- 有効な暗号スイートの一覧。各暗号スイートは、TLS 接続に使用される認証、暗号化、MAC、鍵交換アルゴリズムの組み合わせです。デフォルトでは、利用可能なすべての暗号スイートが有効になります。

ssl.enabled.protocols-

有効な TLS / SSL プロトコルの一覧。デフォルトは

TLSv1.2,TLSv1.1,TLSv1です。

サポートされる Kafka ブローカー設定オプションの完全リストは、付録A ブローカー設定パラメーター を参照してください。

4.9.3. TLS 暗号化の有効化

この手順では、Kafka ブローカーで暗号化を有効にする方法を説明します。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストに インストール されます。

手順

- クラスターのすべての Kafka ブローカーの TLS 証明書を生成します。証明書には、Common Name または Subject Alternative Name にアドバタイズされ、ブートストラップアドレスが必要です。

以下について、すべてのクラスターノードで

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集します。-

listener.security.protocol.mapフィールドを変更し、TLS 暗号化を使用するリスナーのSSLプロトコルを指定します。 -

ssl.keystore.locationオプションを、ブローカー証明書を使用して JKS キーストアへのパスに設定します。 キーストアを保護するために使用したパスワードに

ssl.keystore.passwordオプションを設定します。以下に例を示します。

listeners=UNENCRYPTED://:9092,ENCRYPTED://:9093,REPLICATION://:9094 listener.security.protocol.map=UNENCRYPTED:PLAINTEXT,ENCRYPTED:SSL,REPLICATION:PLAINTEXT ssl.keystore.location=/path/to/keystore/server-1.jks ssl.keystore.password=123456

-

- (re)Kafka ブローカーを起動します。

関連情報

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- Kafka クラスターの実行に関する詳細は、「マルチノードの Kafka クラスターの実行」 を参照してください。

クライアントで TLS 暗号化の設定に関する詳細は、以下を参照してください。

4.9.4. 認証

認証には、以下を使用できます。

- 暗号化された接続で X.509 証明書を基にした TLS クライアント認証

- サポートされる Kafka SASL(Simple Authentication and Security Layer)メカニズム

- OAuth 2.0 のトークンベースの認証

4.9.4.1. TLS クライアント認証

TLS クライアント認証は、TLS 暗号化を使用している接続でのみ使用できます。TLS クライアント認証を使用するには、パブリックキーを持つトラストストアをブローカーに提供できます。これらのキーは、ブローカーに接続するクライアントを認証するために使用できます。トラストストアは Java Keystore(JKS)形式で提供され、認証局の公開鍵が含まれている必要があります。トラストストアに含まれる認証局のいずれかによって署名された公開鍵および秘密鍵を持つすべてのクライアントは認証されます。トラストストアの場所は、フィールド ssl.truststore.location を使用して設定されます。トラストストアがパスワードで保護されている場合は、パスワードは ssl.truststore.password プロパティーに設定する必要があります。以下に例を示します。

ssl.truststore.location=/path/to/keystore/server-1.jks ssl.truststore.password=123456

トラストストアを設定したら、ssl.client.auth プロパティーを使用して TLS クライアント認証を有効にする必要があります。このプロパティーは、3 つの異なる値のいずれかに設定できます。

none- TLS クライアント認証は無効になっています。(デフォルト値)

requested- TLS クライアント認証はオプションです。クライアントは TLS クライアント証明書を使用して認証するよう要求されますが、選択することはできません。

required- クライアントが TLS クライアント証明書を使用して認証する必要があります。

クライアントが TLS クライアント認証を使用して認証される場合、認証されたプリンシパル名は認証されたクライアント証明書からの識別名になります。たとえば、識別名 CN=someuser を持つ証明書を持つユーザーは、以下のプリンシパル CN=someuser,OU=Unknown,O=Unknown,L=Unknown,ST=Unknown,C=Unknown で認証されます。TLS クライアント認証が使用されず、SASL が無効化されると、プリンシパル名は ANONYMOUS になります。

4.9.4.2. SASL 認証

SASL 認証は、Java Authentication and Authorization Service(JAAS)を使用して設定されます。JAAS は、Kafka と ZooKeeper 間の接続の認証にも使用されます。JAAS は独自の設定ファイルを使用します。このファイルの推奨場所は /opt/kafka/config/jaas.conf です。このファイルは、kafka ユーザーが読み取り可能でなければなりません。Kafka の実行時に、Java システムプロパティー java.security.auth.login.config を使用してこのファイルの場所を指定します。このプロパティーは、ブローカーノードの起動時に Kafka に渡す必要があります。

KAFKA_OPTS="-Djava.security.auth.login.config=/path/to/my/jaas.config"; bin/kafka-server-start.sh

SASL 認証は、暗号化されていない接続と TLS 接続の両方でサポートされます。SASL はリスナーごとに個別に有効にできます。これを有効にするには、listener.security.protocol.map のセキュリティープロトコルは SASL_PLAINTEXT または SASL_SSL のどちらかでなければなりません。

Kafka の SASL 認証は複数のメカニズムをサポートします。

PLAIN- ユーザー名とパスワードに基づいて認証を実装します。ユーザー名とパスワードは Kafka 設定にローカルに保存されます。

SCRAM-SHA-256およびSCRAM-SHA-512- Salted Challenge Response Authentication Mechanism(SCRAM)を使用した認証を実装します。SCRAM クレデンシャルは ZooKeeper に一元的に保存されます。SCRAM は、ZooKeeper クラスターノードがプライベートネットワークで分離された状態で使用できます。

GSSAPI- Kerberos サーバーに対する認証を実装します。

PLAIN メカニズムは、暗号化されていない形式でネットワーク経由でユーザー名とパスワードを送信します。したがって、TLS による暗号化と組み合わせて使用することはできません。

SASL メカニズムは JAAS 設定ファイルを使用して設定されます。Kafka は KafkaServer という名前の JAAS コンテキストを使用します。JAAS で設定後、Kafka 設定で SASL メカニズムを有効にする必要があります。これは、sasl.enabled.mechanisms プロパティーを使用して行います。このプロパティーには、有効なメカニズムのコンマ区切りリストが含まれます。

sasl.enabled.mechanisms=PLAIN,SCRAM-SHA-256,SCRAM-SHA-512

ブローカー間の通信に使用されるリスナーが SASL を使用している場合は、sasl.mechanism.inter.broker.protocol プロパティーを使用して使用する必要のある SASL メカニズムを指定する必要があります。以下に例を示します。

sasl.mechanism.inter.broker.protocol=PLAIN

ブローカーの通信に使用されるユーザー名とパスワードは、フィールド username および password を使用して KafkaServer JAAS コンテキストに指定する必要があります。

SASL PLAIN

PLAIN メカニズムを使用するには、接続が許可されるユーザー名とパスワードを JAAS コンテキストで直接指定されます。以下の例は、SASL PLAIN 認証に設定されたコンテキストを示しています。この例では、3 つの異なるユーザーを設定します。

-

admin -

user1 -

user2

KafkaServer {

org.apache.kafka.common.security.plain.PlainLoginModule required

user_admin="123456"

user_user1="123456"

user_user2="123456";

};ユーザーデータベースのある JAAS 設定ファイルは、すべての Kafka ブローカーで同期する必要があります。

ブローカー間の認証に SASL PLAIN が使用される場合、username および password プロパティーは JAAS コンテキストに追加する必要があります。

KafkaServer {

org.apache.kafka.common.security.plain.PlainLoginModule required

username="admin"

password="123456"

user_admin="123456"

user_user1="123456"

user_user2="123456";

};SASL SCRAM

Kafka の SCRAM 認証は SCRAM-SHA-256 と SCRAM-SHA-512 の 2 つのメカニズムで構成されます。これらのメカニズムは、使用されるハッシュアルゴリズムでのみ異なります。SHA-256 と強力な SHA-512。SCRAM 認証を有効にするには、JAAS 設定ファイルに以下の設定ファイルが含まれている必要があります。

KafkaServer {

org.apache.kafka.common.security.scram.ScramLoginModule required;

};Kafka 設定ファイルで SASL 認証を有効にする場合、両方の SCRAM メカニズムを一覧表示できます。ただし、ブローカー間通信には選択できるのは 1 つのみです。以下に例を示します。

sasl.enabled.mechanisms=SCRAM-SHA-256,SCRAM-SHA-512 sasl.mechanism.inter.broker.protocol=SCRAM-SHA-512

SCRAM メカニズムのユーザークレデンシャルは ZooKeeper に保存されます。kafka-configs.sh ツールは、これらを管理するために使用できます。たとえば、以下のコマンドを実行して、パスワード 123456 で user1 を追加します。

bin/kafka-configs.sh --bootstrap-server localhost:9092 --alter --add-config 'SCRAM-SHA-256=[password=123456],SCRAM-SHA-512=[password=123456]' --entity-type users --entity-name user1

ユーザークレデンシャルを削除するには、以下を使用します。

bin/kafka-configs.sh --bootstrap-server localhost:9092 --alter --delete-config 'SCRAM-SHA-512' --entity-type users --entity-name user1

SASL GSSAPI

Kerberos を使用した認証に使用される SASL メカニズムは GSSAPI と呼ばれます。Kerberos SASL 認証を設定するには、以下の設定を JAAS 設定ファイルに追加します。

KafkaServer {

com.sun.security.auth.module.Krb5LoginModule required

useKeyTab=true

storeKey=true

keyTab="/etc/security/keytabs/kafka_server.keytab"

principal="kafka/kafka1.hostname.com@EXAMPLE.COM";

};Kerberos プリンシパルのドメイン名は常に大文字にする必要があります。

JAAS 設定の他に、Kafka 設定の sasl.kerberos.service.name プロパティーで Kerberos サービス名を指定する必要があります。

sasl.enabled.mechanisms=GSSAPI sasl.mechanism.inter.broker.protocol=GSSAPI sasl.kerberos.service.name=kafka

複数の SASL メカニズム

Kafka は複数の SASL メカニズムを同時に使用できます。異なる JAAS 設定はすべて同じコンテキストに追加できます。

KafkaServer {

org.apache.kafka.common.security.plain.PlainLoginModule required

user_admin="123456"

user_user1="123456"

user_user2="123456";

com.sun.security.auth.module.Krb5LoginModule required

useKeyTab=true

storeKey=true

keyTab="/etc/security/keytabs/kafka_server.keytab"

principal="kafka/kafka1.hostname.com@EXAMPLE.COM";

org.apache.kafka.common.security.scram.ScramLoginModule required;

};複数のメカニズムを有効にすると、クライアントが使用するメカニズムを選択することができます。

4.9.5. TLS クライアント認証の有効化

この手順では、Kafka ブローカーで TLS クライアント認証を有効にする方法を説明します。

手順

- ユーザー証明書の署名に使用する認証局の公開鍵が含まれる JKS トラストストアを準備します。

以下について、すべてのクラスターノードで

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集します。-

ユーザー証明書の認証局が含まれる JKS トラストストアへのパスに

ssl.truststore.locationオプションを設定します。 -

トラストストアを保護するために使用したパスワードに

ssl.truststore.passwordオプションを設定します。 ssl.client.authオプションをrequiredに設定します。以下に例を示します。

ssl.truststore.location=/path/to/truststore.jks ssl.truststore.password=123456 ssl.client.auth=required

-

ユーザー証明書の認証局が含まれる JKS トラストストアへのパスに

- (re)Kafka ブローカーを起動します。

関連情報

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- Kafka クラスターの実行に関する詳細は、「マルチノードの Kafka クラスターの実行」 を参照してください。

クライアントで TLS 暗号化の設定に関する詳細は、以下を参照してください。

4.9.6. SASL PLAIN 認証の有効化

この手順では、Kafka ブローカーで SASL PLAIN 認証を有効にする方法を説明します。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストに インストール されます。

手順

/opt/kafka/config/jaas.confJAAS 設定ファイルを編集または作成します。このファイルには、ユーザーとパスワードをすべて含める必要があります。このファイルはすべての Kafka ブローカーで同じであることを確認します。以下に例を示します。

KafkaServer { org.apache.kafka.common.security.plain.PlainLoginModule required user_admin="123456" user_user1="123456" user_user2="123456"; };以下について、すべてのクラスターノードで

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集します。-

listener.security.protocol.mapフィールドを変更し、SASL PLAIN 認証を使用するリスナーのSASL_PLAINTEXTまたはSASL_SSLプロトコルを指定します。 sasl.enabled.mechanismsオプションをPLAINに設定します。以下に例を示します。

listeners=INSECURE://:9092,AUTHENTICATED://:9093,REPLICATION://:9094 listener.security.protocol.map=INSECURE:PLAINTEXT,AUTHENTICATED:SASL_PLAINTEXT,REPLICATION:PLAINTEXT sasl.enabled.mechanisms=PLAIN

-

()KAFKA_OPTS 環境変数を使用して Kafka ブローカーを起動し、JAAS 設定を Kafka ブローカーに渡します。

su - kafka export KAFKA_OPTS="-Djava.security.auth.login.config=/opt/kafka/config/jaas.conf"; /opt/kafka/bin/kafka-server-start.sh -daemon /opt/kafka/config/server.properties

関連情報

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- Kafka クラスターの実行に関する詳細は、「マルチノードの Kafka クラスターの実行」 を参照してください。

クライアントで SASL PLAIN 認証の設定に関する詳細は、以下を参照してください。

4.9.7. SASL SCRAM 認証の有効化

この手順では、Kafka ブローカーで SASL SCRAM 認証を有効にする方法を説明します。

前提条件

- AMQ Streams は、Kafka ブローカーとして使用されるすべてのホストに インストール されます。

手順

/opt/kafka/config/jaas.confJAAS 設定ファイルを編集または作成します。KafkaServerコンテキストのScramLoginModuleを有効にします。このファイルはすべての Kafka ブローカーで同じであることを確認します。以下に例を示します。

KafkaServer { org.apache.kafka.common.security.scram.ScramLoginModule required; };以下について、すべてのクラスターノードで

/opt/kafka/config/server.propertiesKafka 設定ファイルを編集します。-

listener.security.protocol.mapフィールドを変更し、SASL SCRAM 認証を使用するリスナーのSASL_PLAINTEXTまたはSASL_SSLプロトコルを指定します。 sasl.enabled.mechanismsオプションをSCRAM-SHA-256またはSCRAM-SHA-512に設定します。以下に例を示します。

listeners=INSECURE://:9092,AUTHENTICATED://:9093,REPLICATION://:9094 listener.security.protocol.map=INSECURE:PLAINTEXT,AUTHENTICATED:SASL_PLAINTEXT,REPLICATION:PLAINTEXT sasl.enabled.mechanisms=SCRAM-SHA-512

-

()KAFKA_OPTS 環境変数を使用して Kafka ブローカーを起動し、JAAS 設定を Kafka ブローカーに渡します。

su - kafka export KAFKA_OPTS="-Djava.security.auth.login.config=/opt/kafka/config/jaas.conf"; /opt/kafka/bin/kafka-server-start.sh -daemon /opt/kafka/config/server.properties

関連情報

- AMQ Streams の設定に関する詳細は、「AMQ Streams の設定」 を参照してください。

- Kafka クラスターの実行に関する詳細は、「マルチノードの Kafka クラスターの実行」 を参照してください。

- SASL SCRAM ユーザーの追加に関する詳細は、「SASL SCRAM ユーザーの追加」 を参照してください。

- SASL SCRAM ユーザーの削除に関する詳細は、「SASL SCRAM ユーザーの削除」 を参照してください。

クライアントで SASL SCRAM 認証の設定に関する詳細は、以下を参照してください。

4.9.8. SASL SCRAM ユーザーの追加

この手順では、SASL SCRAM を使用して認証用の新規ユーザーを追加する方法を説明します。

手順

kafka-configs.shツールを使用して、新しい SASL SCRAM ユーザーを追加します。bin/kafka-configs.sh --bootstrap-server <BrokerAddress> --alter --add-config 'SCRAM-SHA-512=[password=<Password>]' --entity-type users --entity-name <Username>

以下に例を示します。

bin/kafka-configs.sh --bootstrap-server localhost:9092 --alter --add-config 'SCRAM-SHA-512=[password=123456]' --entity-type users --entity-name user1

関連情報

クライアントで SASL SCRAM 認証の設定に関する詳細は、以下を参照してください。

4.9.9. SASL SCRAM ユーザーの削除

この手順では、SASL SCRAM 認証を使用する際にユーザーを削除する方法を説明します。

手順

kafka-configs.shツールを使用して SASL SCRAM ユーザーを削除します。bin/kafka-configs.sh --bootstrap-server <BrokerAddress> --alter --delete-config 'SCRAM-SHA-512' --entity-type users --entity-name <Username>

以下に例を示します。

bin/kafka-configs.sh --bootstrap-server localhost:9092 --alter --delete-config 'SCRAM-SHA-512' --entity-type users --entity-name user1

関連情報

クライアントで SASL SCRAM 認証の設定に関する詳細は、以下を参照してください。

4.10. OAuth 2.0 トークンベース認証の使用

AMQ Streams は、OAUTHBEARER および PLAIN メカニズムを使用して OAuth 2.0 認証の使用をサポートします。

OAuth 2.0 は、アプリケーション間で標準的なトークンベースの認証および承認を有効にし、中央の承認サーバーを使用してリソースに制限されたアクセス権限を付与するトークンを発行します。

Kafka ブローカーおよびクライアントの両方が OAuth 2.0 を使用するように設定する必要があります。OAuth 2.0 認証を設定した後に OAuth 2.0 承認 を設定できます。

OAuth 2.0 認証は、使用する承認サーバーに関係なく ACL ベースの Kafka 承認 と併用できます。

OAuth 2.0 認証を使用すると、アプリケーションクライアントはアカウントのクレデンシャルを公開せずにアプリケーションサーバー (リソースサーバー と呼ばれる) のリソースにアクセスできます。

アプリケーションクライアントは、アクセストークンを認証の手段として渡します。アプリケーションサーバーはこれを使用して、付与するアクセス権限のレベルを決定することもできます。承認サーバーは、アクセスの付与とアクセスに関する問い合わせを処理します。

AMQ Streams のコンテキストでは以下が行われます。

- Kafka ブローカーは OAuth 2.0 リソースサーバーとして動作します。

- Kafka クライアントは OAuth 2.0 アプリケーションクライアントとして動作します。

Kafka クライアントは Kafka ブローカーに対して認証を行います。ブローカーおよびクライアントは、必要に応じて OAuth 2.0 承認サーバーと通信し、アクセストークンを取得または検証します。

AMQ Streams のデプロイメントでは、OAuth 2.0 インテグレーションは以下を提供します。

- Kafka ブローカーのサーバー側 OAuth 2.0 サポート。

- Kafka MirrorMaker、Kafka Connect、および Kafka Bridge のクライアント側 OAuth 2.0 サポート。

AMQ Streams on RHEL には、2 つの OAuth 2.0 ライブラリーが含まれています。

kafka-oauth-client-

io.strimzi.kafka.oauth.client.JaasClientOauthLoginCallbackHandlerという名前のカスタムログインコールバックハンドラークラスを提供します。OAUTHBEARER認証メカニズムを処理するには、Apache Kafka が提供するOAuthBearerLoginModuleでログインコールバックハンドラーを使用します。 kafka-oauth-common-

kafka-oauth-clientライブラリーで必要な機能の一部を提供するヘルパーライブラリーです。

提供されるクライアントライブラリーには、keycloak-core、jackson-databind、slf4j-api などの追加のサードパーティーライブラリーの依存関係も含まれます。

Maven プロジェクトを使用してクライアントをパッケージ化し、すべての依存関係ライブラリーを含めることが推奨されます。依存関係ライブラリーは、今後のバージョンで変更される可能性があります。

OAuth コールバックハンドラー は Kafka Client Java ライブラリー用に提供されるため、Java クライアント用に独自のコールバックハンドラーを作成する必要はありません。アプリケーションクライアントはコールバックハンドラーを使用してアクセストークンを提供できます。Go などの他言語で書かれたクライアントは、カスタムコードを使用して承認サーバーに接続し、アクセストークンを取得する必要があります。

関連情報

4.10.1. OAuth 2.0 認証メカニズム

AMQ Streams は、OAuth 2.0 認証で OAUTHBEARER および PLAIN メカニズムをサポートします。どちらのメカニズムも、Kafka クライアントが Kafka ブローカーで認証されたセッションを確立できるようにします。クライアント、承認サーバー、および Kafka ブローカー間の認証フローは、メカニズムごとに異なります。

可能な限り、OAUTHBEARER を使用するようにクライアントを設定することが推奨されます。OAUTHBEARER では、クライアントクレデンシャルは Kafka ブローカーと共有されることがないため、PLAIN よりも高レベルのセキュリティーが提供されます。OAUTHBEARER をサポートしない Kafka クライアントの場合のみ、PLAIN の使用を検討してください。

必要であれば、同じ OAuth 認証リスナー設定で OAUTHBEARER と PLAIN を両方有効にすることができます。

OAUTHBEARER の概要

Kafka は OAUTHBEARER 認証メカニズムをサポートしますが、明示的に設定する必要があります。多くの Kafka クライアントツールは、プロトコルレベルで OAUTHBEARER の基本サポートを提供するライブラリーを使用します。

OAUTHBEARER を使用する場合、クライアントはクレデンシャルを交換するために Kafka ブローカーでセッションを開始します。ここで、クレデンシャルはコールバックハンドラーによって提供されるベアラートークンの形式を取ります。コールバックを使用して、以下の 3 つの方法のいずれかでトークンの提供を設定できます。

- クライアント ID およびシークレット( OAuth 2.0 クライアントクレデンシャルメカニズムを使用)

- 設定時に手動で取得された有効期限の長いアクセストークン

- 設定時に手動で取得された有効期限の長い更新トークン

OAUTHBEARER を使用するには、Kafka ブローカーの OAuth 認証リスナー設定で sasl.enabled.mechanisms を OAUTHBEARER に設定する必要があります。詳細な設定は、「OAuth 2.0 Kafka ブローカーの設定」 を参照してください。

listener.name.client.sasl.enabled.mechanisms=OAUTHBEARER

OAUTHBEARER 認証は、プロトコルレベルで OAUTHBEARER メカニズムをサポートする Kafka クライアントでのみ使用できます。

PLAIN の概要

PLAIN は、kafkacat などの開発者ツールを含む、すべての Kafka クライアントツールでサポートされる簡易認証メカニズムです。PLAIN を OAuth 2.0 認証と使用できるように、RHEL の AMQ Streams にはサーバー側のコールバックが含まれています。PLAIN の AMQ Streams 実装は OAuth 2.0 over PLAIN と呼ばれます。

OAuth 2.0 の PLAIN では、クライアントクレデンシャルは ZooKeeper に保存されません。代わりに、OAUTHBEARER 認証が使用される場合と同様に、準拠した承認サーバーの背後で一元的に処理されます。

OAuth 2.0 over PLAIN コールバックを併用する場合、以下のいずれかの方法を使用して Kafka クライアントは Kafka ブローカーで認証されます。

- クライアント ID およびシークレット( OAuth 2.0 クライアントクレデンシャルメカニズムを使用)

- 設定時に手動で取得された有効期限の長いアクセストークン

PLAIN 認証を使用し、username および password を提供するように、クライアントを有効にする必要があります。パスワードの最初に $accessToken: が付けられ、その後にアクセストークンの値が続く場合は、Kafka ブローカーはパスワードをアクセストークンとして解釈します。それ以外の場合は、Kafka ブローカーは username をクライアント ID として解釈し、password をクライアントシークレットとして解釈します。

password がアクセストークンとして設定されている場合、username は Kafka ブローカーによってアクセストークンから取得されるプリンシパル名と同じになるように設定される必要があります。このプロセスは、userNameClaim、fallbackUserNameClaim、fallbackUsernamePrefix、または userInfoEndpointUri を使用してユーザー名の抽出を設定する方法によって異なります。また、承認サーバーによっても異なり、特にクライアント ID をアカウント名にマッピングする方法によります。

Kafka ブローカーの OAuth 認証リスナー設定で PLAIN を有効にできます。これを行うには、PLAIN を sasl.enabled.mechanisms の値に追加します。

listener.name.client.sasl.enabled.mechanisms=OAUTHBEARER,PLAIN

詳細な設定は、「OAuth 2.0 Kafka ブローカーの設定」 を参照してください。

4.10.1.1. プロパティーまたは変数での OAuth 2.0 の設定

OAuth 2.0 設定は、Java Authentication and Authorization Service(JAAS)プロパティーまたは環境変数を使用して設定できます。

-

JAAS プロパティーは

server.properties設定ファイルで設定され、listener.name.LISTENER-NAME.oauthbearer.sasl.jaas.configプロパティーのキーと値のペアとして渡されます。 環境変数を使用する場合は、

server.propertiesファイルでlistener.name.LISTENER-NAME.oauthbearer.sasl.jaas.configプロパティーを指定する必要がありますが、他の JAAS プロパティーを省略することができます。大文字または大文字の環境変数の命名規則を使用できます。

AMQ Streams OAuth 2.0 ライブラリーは、以下で始まるプロパティーを使用します。

-

oauth.認証の設定 -

strimzi.OAuth 2.0 承認の設定

4.10.2. OAuth 2.0 Kafka ブローカーの設定

OAuth 2.0 認証用の Kafka ブローカー設定には、以下が関係します。

- 承認サーバーでの OAuth 2.0 クライアントの作成

- Kafka クラスターでの OAuth 2.0 認証の設定

承認サーバーに関連する Kafka ブローカーおよび Kafka クライアントはどちらも OAuth 2.0 クライアントと見なされます。

4.10.2.1. 承認サーバーの OAuth 2.0 クライアント設定

セッションの開始中に受信されたトークンを検証するように Kafka ブローカーを設定するには、承認サーバーで OAuth 2.0 の クライアント 定義を作成し、以下のクライアントクレデンシャルが有効な状態で 機密情報 として設定することが推奨されます。

-

kafka-brokerのクライアント ID(例) - 認証メカニズムとしてのクライアント ID およびシークレット

承認サーバーのパブリックでないイントロスペクションエンドポイントを使用する場合のみ、クライアント ID およびシークレットを使用する必要があります。高速のローカル JWT トークンの検証と同様に、パブリック承認サーバーのエンドポイントを使用する場合は、通常クレデンシャルは必要ありません。

4.10.2.2. Kafka クラスターでの OAuth 2.0 認証設定

Kafka クラスターで OAuth 2.0 認証を使用するには、Kafka クラスターの OAuth 認証リスナー設定を Kafka server.properties ファイルで有効にします。最小の設定が必要です。また、TLS がブローカー間通信に使用される TLS リスナーを設定することもできます。

以下の方法のいずれかを使用して、承認サーバーによってトークン検証のブローカーを設定できます。

- 高速なローカルトークン検証: JWKS エンドポイントが署名済み JWT 形式のアクセストークンと組み合わせて使用

- イントロスペクションエンドポイント

OAUTHBEARER または PLAIN 認証(またはその両方)を設定できます。

以下の例は、グローバル リスナー設定を適用する最小設定を示しています。つまり、ブローカー間通信はアプリケーションクライアントと同じリスナーを通過します。

この例は、sasl.enabled.mechanisms ではなく listener.name.LISTENER-NAME.sasl.enabled.mechanisms を指定する、特定のリスナーの OAuth 2.0 設定も示しています。tFineER-NAME は、リスナーの大文字と小文字を区別しません。ここでは、リスナーの名前を CLIENT とし、プロパティー名は listener.name.client.sasl.enabled.mechanisms になります。

この例では、OAUTHBEARER 認証を使用します。

例: JWKS エンドポイントを使用した OAuth 2.0 認証の最小リスナー設定

sasl.enabled.mechanisms=OAUTHBEARER 1 listeners=CLIENT://0.0.0.0:9092 2 listener.security.protocol.map=CLIENT:SASL_PLAINTEXT 3 listener.name.client.sasl.enabled.mechanisms=OAUTHBEARER 4 sasl.mechanism.inter.broker.protocol=OAUTHBEARER 5 inter.broker.listener.name=CLIENT 6 listener.name.client.oauthbearer.sasl.server.callback.handler.class=io.strimzi.kafka.oauth.server.JaasServerOauthValidatorCallbackHandler 7 listener.name.client.oauthbearer.sasl.jaas.config=org.apache.kafka.common.security.oauthbearer.OAuthBearerLoginModule required \ 8 oauth.valid.issuer.uri="https://AUTH-SERVER-ADDRESS" \ 9 oauth.jwks.endpoint.uri="https://AUTH-SERVER-ADDRESS/jwks" \ 10 oauth.username.claim="preferred_username" \ 11 oauth.client.id="kafka-broker" \ 12 oauth.client.secret="kafka-secret" \ 13 oauth.token.endpoint.uri="https://AUTH-SERVER-ADDRESS/token" ; 14 listener.name.client.oauthbearer.sasl.login.callback.handler.class=io.strimzi.kafka.oauth.client.JaasClientOauthLoginCallbackHandler 15 listener.name.client.oauthbearer.connections.max.reauth.ms=3600000 16

- 1

- SASL を介した認証情報交換の OAUTHBEARER メカニズムを有効にします。

- 2

- クライアントアプリケーションが接続するリスナーを設定します。システム

hostnameは、再接続のためにクライアントが解決する必要があるアドバタイズされたホスト名として使用されます。この例では、リスナーの名前はCLIENTになります。 - 3

- リスナーのチャネルプロトコルを指定します。

SASL_SSLは TLS 用です。SASL_PLAINTEXT暗号化されていない接続に使用されますが(TLS なし)、TCP 接続層での盗難や傍受のリスクがあります。 - 4

- CLIENT リスナーの OAUTHBEARER メカニズムを指定します。クライアント名(

CLIENT)は通常、listenersプロパティーで大文字で指定します。listener.nameプロパティーの場合は小文字(listener.name.client)と、listener.name.client.*プロパティーの一部が含まれる場合に小文字が指定されます。 - 5

- ブローカー間の通信に OAUTHBEARER メカニズムを指定します。

- 6

- ブローカー間の通信のリスナーを指定します。設定を有効にするには、仕様が必要です。

- 7

- クライアントリスナーで OAuth 2.0 認証を設定します。

- 8

- クライアントおよびブローカー間の通信の認証設定を設定します。

oauth.client.id、oauth.client.secret、およびauth.token.endpoint.uriプロパティーは、ブローカー間の設定に関連します。 - 9

- 有効な発行者 URI。この発行者が発行するアクセストークンのみが許可されます。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME

- 10

- JWKS エンドポイント URL。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/certs

- 11

- トークンの実際のユーザー名が含まれるトークン要求 (またはキー)。ユーザー名は、ユーザーの識別に使用される principal です。この値は、使用される認証フローと承認サーバーによって異なります。

- 12

- すべてのブローカーで同じ Kafka ブローカーのクライアント ID。これは、

kafka-brokerとして承認サーバーに登録されているクライアント です。 - 13

- すべてのブローカーで同じ Kafka ブローカーのシークレット。

- 14

- 承認サーバーへの OAuth 2.0 トークンエンドポイント URL。本番環境では常に HTTP を使用してください。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/token

- 15

- ブローカー間の通信に OAuth 2.0 認証を有効にする(および唯一の必須)場合。

- 16

- (任意設定): トークンの期限が切れるとセッションの有効期限を強制し、Kafka の再認証メカニズム もアクティブにします。指定された値がアクセストークンの有効期限が切れるまでの残り時間未満の場合、クライアントは実際にトークンの有効期限が切れる前に再認証する必要があります。デフォルトでは、アクセストークンの期限が切れてもセッションは期限切れにならず、クライアントは再認証を試行しません。

以下の例は、TLS がブローカー間通信に使用される TLS リスナーの最小設定を示しています。

例: OAuth 2.0 認証の TLS リスナー設定

listeners=REPLICATION://kafka:9091,CLIENT://kafka:9092 1 listener.security.protocol.map=REPLICATION:SSL,CLIENT:SASL_PLAINTEXT 2 listener.name.client.sasl.enabled.mechanisms=OAUTHBEARER inter.broker.listener.name=REPLICATION listener.name.replication.ssl.keystore.password=KEYSTORE-PASSWORD 3 listener.name.replication.ssl.truststore.password=TRUSTSTORE-PASSWORD listener.name.replication.ssl.keystore.type=JKS listener.name.replication.ssl.truststore.type=JKS listener.name.replication.ssl.endpoint.identification.algorithm=HTTPS 4 listener.name.replication.ssl.secure.random.implementation=SHA1PRNG 5 listener.name.replication.ssl.keystore.location=PATH-TO-KEYSTORE 6 listener.name.replication.ssl.truststore.location=PATH-TO-TRUSTSTORE 7 listener.name.replication.ssl.client.auth=required 8 listener.name.client.oauthbearer.sasl.server.callback.handler.class=io.strimzi.kafka.oauth.server.JaasServerOauthValidatorCallbackHandler listener.name.client.oauthbearer.sasl.jaas.config=org.apache.kafka.common.security.oauthbearer.OAuthBearerLoginModule required \ oauth.valid.issuer.uri="https://AUTH-SERVER-ADDRESS" \ oauth.jwks.endpoint.uri="https://AUTH-SERVER-ADDRESS/jwks" \ oauth.username.claim="preferred_username" ; 9

- 1

- ブローカー間の通信とクライアントアプリケーションには、別の設定が必要です。

- 2

- TLS を使用するように REPLICATION リスナーと、暗号化されていないチャネルで SASL を使用するように CLIENT リスナーを設定します。クライアントは、実稼働環境で暗号化チャンネル(

SASL_SSL)を使用することができます。 - 3

ssl.プロパティーは TLS 設定を定義します。- 4

- 乱数ジェネレーターの実装。設定されていない場合は、Java プラットフォーム SDK のデフォルトが使用されます。

- 5

- ホスト名の検証。空の文字列に設定すると、ホスト名の検証はオフになります。設定されていない場合は、デフォルト値は HTTPS で、サーバー証明書のホスト名の検証を強制します。

- 6

- リスナーのキーストアへのパス。

- 7

- リスナーのトラストストアへのパス。

- 8

- REPLICATION リスナーのクライアントが TLS 接続の確立時にクライアント証明書で認証する必要があることを指定します(ブローカー間接続に使用されます)。

- 9

- OAuth 2.0 の CLIENT リスナーを設定します。承認サーバーとの接続は、セキュアな HTTPS 接続を使用する必要があります。

以下の例は、SASL を介した認証情報交換の PLAIN 認証メカニズムを使用した OAuth 2.0 認証の最小設定を示しています。高速のローカルトークン検証が使用されます。

例: PLAIN 認証の最小リスナー設定

listeners=CLIENT://0.0.0.0:9092 1 listener.security.protocol.map=CLIENT:SASL_PLAINTEXT 2 listener.name.client.sasl.enabled.mechanisms=OAUTHBEARER,PLAIN 3 sasl.mechanism.inter.broker.protocol=OAUTHBEARER 4 inter.broker.listener.name=CLIENT 5 listener.name.client.oauthbearer.sasl.server.callback.handler.class=io.strimzi.kafka.oauth.server.JaasServerOauthValidatorCallbackHandler 6 listener.name.client.oauthbearer.sasl.jaas.config=org.apache.kafka.common.security.oauthbearer.OAuthBearerLoginModule required \ 7 oauth.valid.issuer.uri="http://AUTH_SERVER/auth/realms/REALM" \ 8 oauth.jwks.endpoint.uri="https://AUTH_SERVER/auth/realms/REALM/protocol/openid-connect/certs" \ 9 oauth.username.claim="preferred_username" \ 10 oauth.client.id="kafka-broker" \ 11 oauth.client.secret="kafka-secret" \ 12 oauth.token.endpoint.uri="https://AUTH-SERVER-ADDRESS/token" ; 13 listener.name.client.oauthbearer.sasl.login.callback.handler.class=io.strimzi.kafka.oauth.client.JaasClientOauthLoginCallbackHandler 14 listener.name.client.plain.sasl.server.callback.handler.class=io.strimzi.kafka.oauth.server.plain.JaasServerOauthOverPlainValidatorCallbackHandler 15 listener.name.client.plain.sasl.jaas.config=org.apache.kafka.common.security.plain.PlainLoginModule required \ 16 oauth.valid.issuer.uri="https://AUTH-SERVER-ADDRESS" \ 17 oauth.jwks.endpoint.uri="https://AUTH-SERVER-ADDRESS/jwks" \ 18 oauth.username.claim="preferred_username" \ 19 oauth.token.endpoint.uri="http://AUTH_SERVER/auth/realms/REALM/protocol/openid-connect/token" ; 20 connections.max.reauth.ms=3600000 21

- 1

- クライアントアプリケーションが接続するリスナー(この例では

CLIENT)を設定します。システムhostnameは、再接続のためにクライアントが解決する必要があるアドバタイズされたホスト名として使用されます。これは唯一設定されたリスナーであるため、ブローカー間の通信にも使用されます。 - 2

- 暗号化されていないチャネルで SASL を使用するように

CLIENTリスナーの例を設定します。実稼働環境では、TCP 接続層で盗難や傍受のために保護するために、クライアントは暗号化チャンネル(SASL_SSL)を使用する必要があります。 - 3

- SASL を介した認証情報交換の PLAIN 認証メカニズムを有効にします。ブローカー間通信には必要であるため、OAUTHBEARER も指定されます。Kafka クライアントは、使用するメカニズムを選択できます。

- 4

- ブローカー間の通信に OAUTHBEARER 認証メカニズムを指定します。

- 5

- ブローカー間の通信にリスナー(この例では

CLIENT)を指定します。設定が有効であるには必要。 - 6

- OAUTHBEARER メカニズムのサーバーコールバックハンドラーを設定します。

- 7

- OAUTHBEARER メカニズムを使用して、クライアントおよびブローカー間の通信の認証設定を設定します。

oauth.client.id、oauth.client.secret、およびoauth.token.endpoint.uriプロパティーは、ブローカー間の設定に関連します。 - 8

- 有効な発行者 URI。この発行者からアクセストークンのみが許可されます。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME

- 9

- JWKS エンドポイント URL。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/certs

- 10

- トークンの実際のユーザー名が含まれるトークン要求 (またはキー)。ユーザー名は、ユーザーを識別する プリンシパル です。この値は、使用される認証フローと承認サーバーによって異なります。

- 11

- すべてのブローカーで同じ Kafka ブローカーのクライアント ID。これは、

kafka-brokerとして承認サーバーに登録されているクライアント です。 - 12

- Kafka ブローカーのシークレット(すべてのブローカーで同じ)。

- 13

- 承認サーバーへの OAuth 2.0 トークンエンドポイント URL。本番環境では常に HTTPS を使用します。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/token

- 14

- ブローカー間の通信の OAuth 2.0 認証を有効にします。

- 15

- PLAIN 認証のサーバーコールバックハンドラーを設定します。

- 16

- PLAIN 認証を使用してクライアント通信の認証設定を設定します。

oauth.token.endpoint.uriOAuth 2.0 クライアントクレデンシャルメカニズムを使用して OAuth 2.0 を PLAIN で有効にする必須のプロパティーです。 - 17

- 有効な発行者 URI。この発行者からアクセストークンのみが許可されます。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME

- 18

- JWKS エンドポイント URL。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/certs

- 19

- トークンの実際のユーザー名が含まれるトークン要求 (またはキー)。ユーザー名は、ユーザーを識別する プリンシパル です。この値は、使用される認証フローと承認サーバーによって異なります。

- 20

- (必須)承認サーバーへの OAuth 2.0 トークンエンドポイント URL。本番環境では常に HTTP を使用してください。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/token

リスナーは、OAuth 2.0 クライアントクレデンシャルメカニズムを使用してクライアントの代わりにアクセストークンを取得します。リスナーは

usernameおよびpasswordパラメーターをclientIdおよびsecretとして扱います。 - 21

- (任意設定): トークンの期限が切れるとセッションの有効期限を強制し、Kafka の再認証メカニズム もアクティブにします。指定された値がアクセストークンの有効期限が切れるまでの残り時間未満の場合、クライアントは実際にトークンの有効期限が切れる前に再認証する必要があります。デフォルトでは、アクセストークンの期限が切れてもセッションは期限切れにならず、クライアントは再認証を試行しません。

4.10.2.3. 高速なローカル JWT トークン検証の設定

高速なローカル JWT トークンの検証では、JWTトークンの署名がローカルでチェックされます。

ローカルチェックでは、トークンに対して以下が確認されます。

-

アクセストークンに

Bearerの (typ) 要求値が含まれ、トークンがタイプに準拠することを確認します。 - 有効であるか (期限切れでない) を確認します。

-

トークンに

validIssuerURIと一致する発行元があることを確認します。

承認サーバーによって発行されなかったすべてのトークンが拒否されるよう、リスナーの設定時に 有効な発行者 URI を指定します。

高速のローカル JWT トークン検証の実行中に、承認サーバーの通信は必要はありません。OAuth 2.0 承認サーバーによって公開される JWKs エンドポイント URI を指定して、高速のローカル JWT トークン検証をアクティベートします。エンドポイントには、署名済み JWT トークンの検証に使用される公開鍵が含まれます。これらは、Kafka クライアントによってクレデンシャルとして送信されます。

承認サーバーとの通信はすべて HTTPS を使用して実行する必要があります。

TLS リスナーでは、証明書 トラストストア を設定し、トラストストアファイルを示すことができます。

高速なローカル JWT トークン検証のプロパティーの例

listener.name.client.oauthbearer.sasl.jaas.config=org.apache.kafka.common.security.oauthbearer.OAuthBearerLoginModule required \ oauth.valid.issuer.uri="https://AUTH-SERVER-ADDRESS" \ 1 oauth.jwks.endpoint.uri="https://AUTH-SERVER-ADDRESS/jwks" \ 2 oauth.jwks.refresh.seconds="300" \ 3 oauth.jwks.refresh.min.pause.seconds="1" \ 4 oauth.jwks.expiry.seconds="360" \ 5 oauth.username.claim="preferred_username" \ 6 oauth.ssl.truststore.location="PATH-TO-TRUSTSTORE-P12-FILE" \ 7 oauth.ssl.truststore.password="TRUSTSTORE-PASSWORD" \ 8 oauth.ssl.truststore.type="PKCS12" ; 9

- 1

- 有効な発行者 URI。この発行者が発行するアクセストークンのみが許可されます。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME

- 2

- JWKS エンドポイント URL。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/certs

- 3

- エンドポイントの更新の間隔(デフォルトは 300)。

- 4

- JWKS 公開鍵の更新が連続して試行される間隔の最小一時停止時間 (秒単位)。不明な署名キーが検出されると、JWKS キーの更新は、最後に更新を試みてから少なくとも指定された期間は一時停止し、通常の定期スケジュール以外でスケジュールされます。キーの更新はエクスポネンシャルバックオフ(exponential backoff)のルールに従い、

oauth.jwks.refresh.secondsに到達するまで、一時停止を増やして失敗した更新の再試行を行います。デフォルト値は 1 です。 - 5

- JWK 証明書が期限切れになる前に有効とみなされる期間。デフォルトは

360秒 です。デフォルトよりも長い時間を指定する場合は、無効になった証明書へのアクセスが許可されるリスクを考慮してください。 - 6

- トークンの実際のユーザー名が含まれるトークン要求 (またはキー)。ユーザー名は、ユーザーの識別に使用される principal です。この値は、使用される認証フローと承認サーバーによって異なります。

- 7

- TLS 設定で使用されるトラストストアの場所。

- 8

- トラストストアにアクセスするためのパスワード。

- 9

- PKCS #12 形式のトラストストアタイプ。

4.10.2.4. OAuth 2.0 イントロスペクションエンドポイントの設定

OAuth 2.0 のイントロスペクションエンドポイントを使用したトークンの検証では、受信したアクセストークンは不透明として対処されます。Kafka ブローカーは、アクセストークンをイントロスペクションエンドポイントに送信します。このエンドポイントは、検証に必要なトークン情報を応答として返します。ここで重要なのは、特定のアクセストークンが有効である場合は最新情報を返すことで、トークンの有効期限に関する情報も返します。

OAuth 2.0 のイントロスペクションベースの検証を設定するには、高速のローカル JWT トークン検証に指定された JWKs エンドポイント URI では なくイントロスペクションエンドポイント URI を指定します。通常、イントロスペクションエンドポイントは保護されているため、承認サーバーに応じて クライアント ID とクライアントシークレット を指定する必要があります。

イントロスペクションエンドポイントのプロパティーの例

listener.name.client.oauthbearer.sasl.jaas.config=org.apache.kafka.common.security.oauthbearer.OAuthBearerLoginModule required \ oauth.introspection.endpoint.uri="https://AUTH-SERVER-ADDRESS/introspection" \ 1 oauth.client.id="kafka-broker" \ 2 oauth.client.secret="kafka-broker-secret" \ 3 oauth.ssl.truststore.location="PATH-TO-TRUSTSTORE-P12-FILE" \ 4 oauth.ssl.truststore.password="TRUSTSTORE-PASSWORD" \ 5 oauth.ssl.truststore.type="PKCS12" \ 6 oauth.username.claim="preferred_username" ; 7

- 1

- OAuth 2.0 のイントロスペクションエンドポイント URI。例: https://AUTH-SERVER-ADDRESS/auth/realms/REALM-NAME/protocol/openid-connect/token/introspect

- 2

- Kafka ブローカーのクライアント ID。

- 3

- Kafka ブローカーのシークレット。

- 4

- TLS 設定で使用されるトラストストアの場所。

- 5

- トラストストアにアクセスするためのパスワード。

- 6

- PKCS #12 形式のトラストストアタイプ。

- 7

- トークンの実際のユーザー名が含まれるトークン要求 (またはキー)。ユーザー名は、ユーザーの識別に使用される principal です。

oauth.username.claimの値は、使用される承認サーバーによって異なります。

4.10.3. Kafka ブローカーの再認証の設定

Kafka クライアントと Kafka ブローカー間の OAuth 2.0 セッションに Kafka セッション再認証 を使用するように OAuth リスナーを設定できます。このメカニズムは、定義された期間後に、クライアントとブローカー間の認証されたセッションを期限切れにします。セッションの有効期限が切れると、クライアントは既存のコネクションを破棄せずに再使用して、新しいセッションを即座に開始します。

セッションの再認証はデフォルトで無効になっています。これを server.properties ファイルで有効にできます。OAUTHBEARER または PLAIN が SASL メカニズムとして有効になっている TLS リスナーの connections.max.reauth.ms プロパティーを設定します。

リスナーごとにセッションの再認証を指定できます。以下に例を示します。

listener.name.client.oauthbearer.connections.max.reauth.ms=3600000

セッションの再認証は、クライアントによって使用される Kafka クライアントライブラリーによってサポートされる必要があります。

セッションの再認証は、高速ローカル JWT またはイントロスペクションエンドポイントのトークン検証と使用できます。

クライアントの再認証

ブローカーの認証されたセッションが期限切れになると、クライアントは接続を切断せずに新しい有効なアクセストークンをブローカーに送信し、既存のセッションを再認証する必要があります。

トークンの検証に成功すると、既存の接続を使用して新しいクライアントセッションが開始されます。クライアントが再認証に失敗した場合、さらにメッセージを送受信しようとすると、ブローカーは接続を閉じます。ブローカーで再認証メカニズムが有効になっていると、Kafka クライアントライブラリー 2.2 以降を使用する Java クライアントが自動的に再認証されます。

更新トークンが使用される場合、セッションの再認証は更新トークンにも適用されます。セッションが期限切れになると、クライアントは更新トークンを使用してアクセストークンを更新します。その後、クライアントは新しいアクセストークンを使用して既存接続で再認証を行います。

OAUTHBEARER および PLAIN のセッションの有効期限

セッションの再認証が設定されている場合、OAUTHBEARER と PLAIN 認証ではセッションの有効期限は異なります。

クライアント ID およびシークレットによる方法を使用する OAUTHBEARER および PLAIN の場合:

-

ブローカーの認証されたセッションは、設定された

connections.max.reauth.msで期限切れになります。 - アクセストークンが設定期間前に期限切れになると、セッションは設定期間前に期限切れになります。

有効期間の 長いアクセストークンによる 方法を使用する PLAIN の場合:

-

ブローカーの認証されたセッションは、設定された

connections.max.reauth.msで期限切れになります。 - アクセストークンが設定期間前に期限切れになると、再認証に失敗します。セッションの再認証は試行されますが、PLAIN にはトークンを更新するメカニズムがありません。

connections.max.reauth.ms が設定されて いない 場合は、再認証しなくても、OAUTHBEARER および PLAIN クライアントはブローカーへの接続を無期限に維持します。認証されたセッションは、アクセストークンの期限が切れても終了しません。ただし、これは keycloak 承認を使用したり、カスタムオーソライザーをインストールしたりして、承認を設定する場合に考慮されます。

4.10.4. OAuth 2.0 Kafka クライアントの設定

Kafka クライアントは以下のいずれかで設定されます。

- 有効なアクセストークンを取得するために承認サーバーでの認証に必要なクレデンシャル(クライアント ID およびシークレット)

- 承認サーバーによって提供されるツールを使用して取得される、有効期限の長い有効な アクセストークン または 更新トークン。

アクセストークンは、Kafka ブローカーに送信される唯一の情報です。承認サーバーでの認証に使用されるクレデンシャルはブローカー に 送信されません。クライアントによるアクセストークンの取得後、承認サーバーと通信する必要はありません。

クライアント ID とシークレットを使用した認証が最も簡単です。有効期間の長いアクセストークンまたは更新トークンを使用すると、承認サーバーツールに追加の依存関係があるため、より複雑になります。

有効期間が長いアクセストークンを使用している場合は、承認サーバーでクライアントを設定し、トークンの最大有効期間を長くする必要があります。

Kafka クライアントが直接アクセストークンで設定されていない場合、クライアントは承認サーバーと通信して Kafka セッションの開始中にアクセストークンのクレデンシャルを交換します。Kafka クライアントは以下のいずれかを交換します。

- クライアント ID およびシークレット

- クライアント ID、更新トークン、および (任意の) シークレット

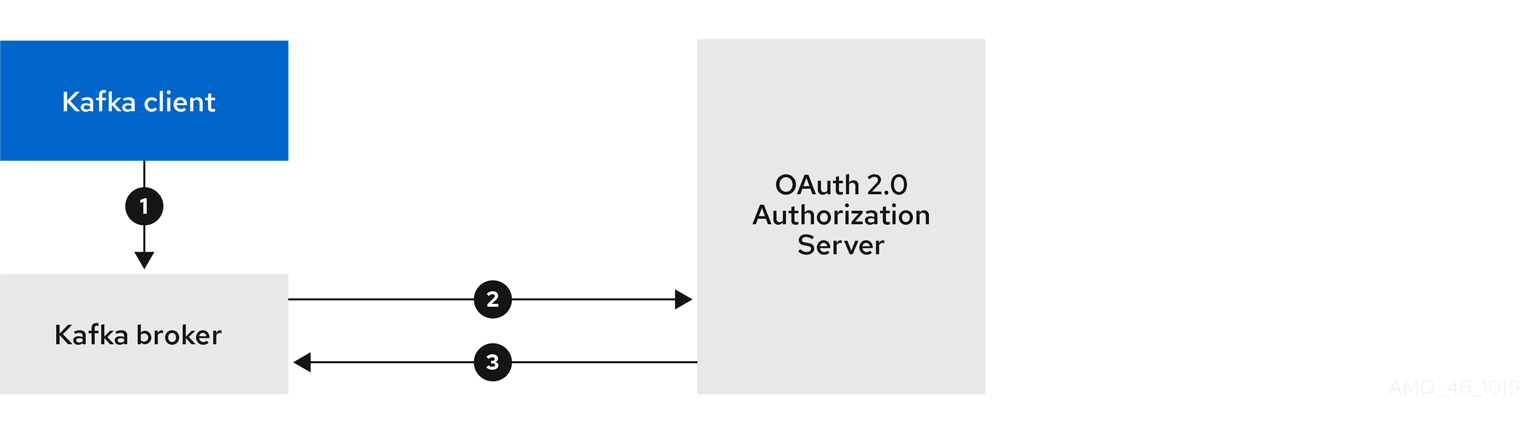

4.10.5. OAuth 2.0 のクライアント認証フロー

ここでは、Kafka セッションの開始時における Kafka クライアント、Kafka ブローカー、および承認ブローカー間の通信フローを説明および可視化します。フローは、クライアントとサーバーの設定によって異なります。

Kafka クライアントがアクセストークンをクレデンシャルとして Kafka ブローカーに送信する場合、トークンを検証する必要があります。

使用する承認サーバーや利用可能な設定オプションによっては、以下の使用が適している場合があります。

- 承認サーバーと通信しない、JWT の署名確認およびローカルトークンのイントロスペクションをベースとした高速なローカルトークン検証。

- 承認サーバーによって提供される OAuth 2.0 のイントロスペクションエンドポイント。

高速のローカルトークン検証を使用するには、トークンでの署名検証に使用される公開証明書のある JWKS エンドポイントを提供する承認サーバーが必要になります。

この他に、承認サーバーで OAuth 2.0 のイントロスペクションエンドポイントを使用することもできます。新しい Kafka ブローカー接続が確立されるたびに、ブローカーはクライアントから受け取ったアクセストークンを承認サーバーに渡し、応答を確認してトークンが有効であるかどうかを確認します。

Kafka クライアントのクレデンシャルは以下に対して設定することもできます。

- 以前に生成された有効期間の長いアクセストークンを使用した直接ローカルアクセス。

- 新しいアクセストークンの発行についての承認サーバーとの通信。

承認サーバーは不透明なアクセストークンの使用のみを許可する可能性があり、この場合はローカルトークンの検証は不可能です。

4.10.5.1. クライアント認証フローの例

Kafka クライアントおよびブローカーが以下に設定されている場合の、Kafka セッション認証中のコミュニケーションフローを確認できます。

クライアントではクライアント ID とシークレットが使用され、ブローカーによって検証が承認サーバーに委譲される場合

- Kafka クライアントは承認サーバーからアクセストークンを要求します。これにはクライアント ID とシークレットを使用し、任意で更新トークンも使用します。

- 承認サーバーによって新しいアクセストークンが生成されます。

- Kafka クライアントは SASL OAUTHBEARER メカニズムを使用してアクセストークンを渡し、Kafka ブローカーの認証を行います。

- Kafka ブローカーは、独自のクライアント ID およびシークレットを使用して、承認サーバーでトークンイントロスペクションエンドポイントを呼び出し、アクセストークンを検証します。

- トークンが有効な場合は、Kafka クライアントセッションが確立されます。

クライアントではクライアント ID およびシークレットが使用され、ブローカーによって高速のローカルトークン検証が実行される場合

- Kafka クライアントは、トークンエンドポイントから承認サーバーの認証を行います。これにはクライアント ID とシークレットが使用され、任意で更新トークンも使用されます。

- 承認サーバーによって新しいアクセストークンが生成されます。

- Kafka クライアントは SASL OAUTHBEARER メカニズムを使用してアクセストークンを渡し、Kafka ブローカーの認証を行います。