インストール

OpenShift Container Platform クラスターのインストールおよび設定

概要

第1章 OpenShift Container Platform インストールの概要

1.1. OpenShift Container Platform インストールの概要

OpenShift Container Platform インストールプログラムは柔軟性を提供します。インストールプログラムを使用して、インストールプログラムがプロビジョニングし、クラスターで維持するインフラストラクチャーでクラスターをデプロイしたり、ユーザーが独自に準備し、維持するインフラストラクチャーでクラスターをデプロイしたりすることができます。

OpenShift Container Platform クラスターの基本的な 2 つのタイプとして、インストーラーでプロビジョニングされるインフラストラクチャークラスターとユーザーによってプロビジョニングされるインフラストラクチャークラスターがあります。

これらのクラスターのタイプにはどちらにも以下の特徴があります。

- 単一障害点のない可用性の高いインフラストラクチャーがデフォルトで利用可能である。

- 管理者は適用される更新内容および更新タイミングを制御できる。

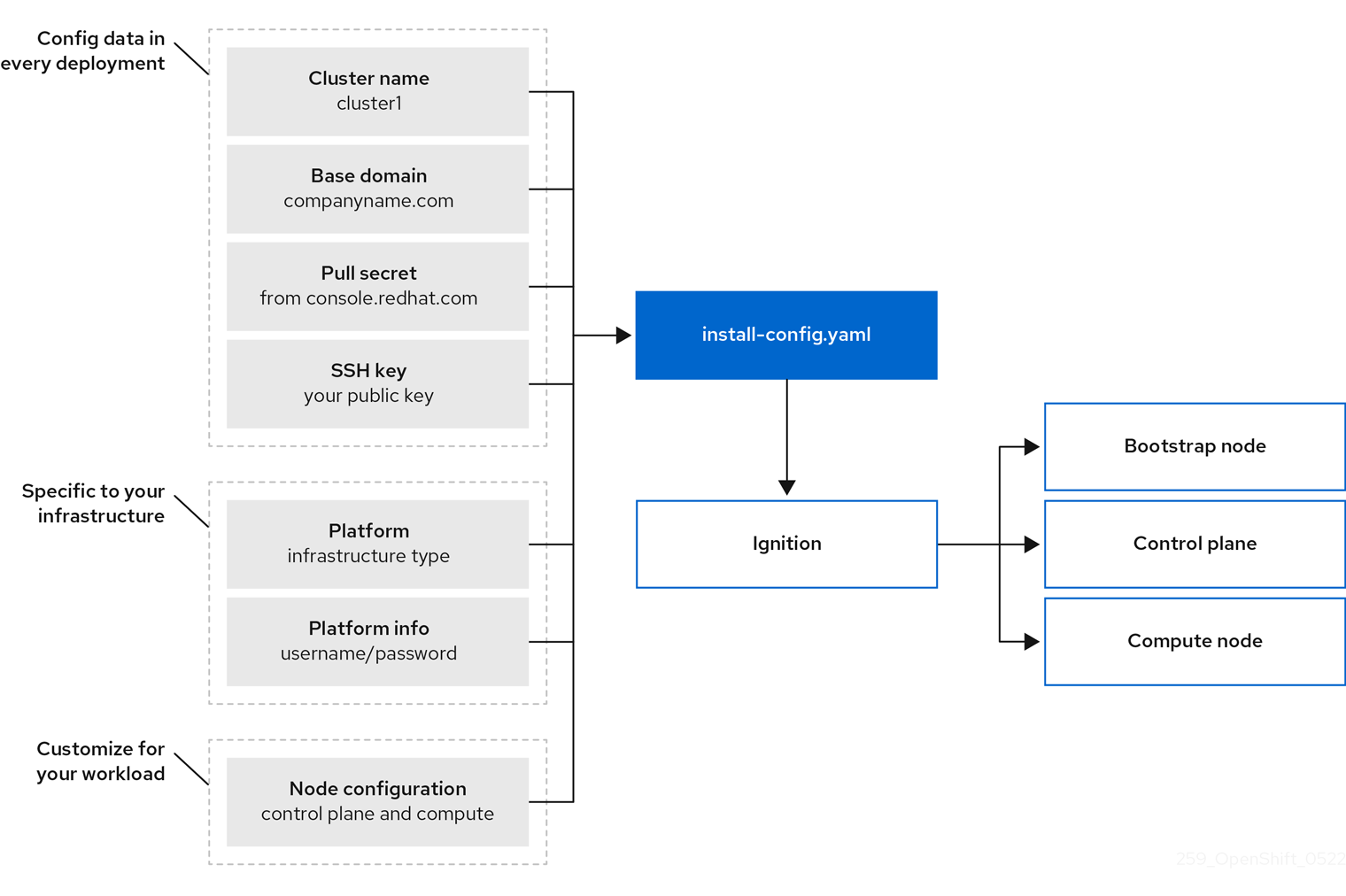

同一のインストールプログラムを使用してこれらクラスターの両方のタイプをデプロイできます。インストールプログラムで生成される主なアセットは ブートストラップ、マスターおよびワーカーマシンの Ignition 設定です。これらの 3 つの設定および適切に設定されたインフラストラクチャーを使用して、OpenShift Container Platform クラスターを起動することができます。

OpenShift Container Platform インストールプログラムは、クラスターのインストールを管理するために一連のターゲットおよび依存関係を使用します。インストールプログラムには、達成する必要のある一連のターゲットが設定され、それぞれのターゲットには一連の依存関係が含まれます。各ターゲットはそれぞれの依存関係の条件が満たされ次第、別個に解決されるため、インストールプログラムは複数のターゲットを並行して達成できるように動作します。最終的なターゲットはクラスターを実行することです。コマンドを実行するのではなく依存関係の条件を満たすことにより、インストールプログラムは、コマンドを実行してコンポーネントを再度作成する代わりに、既存のコンポーネントを認識し、それらを使用することができます。

以下の図は、インストールのターゲットと依存関係のサブセットを示しています。

図1.1 OpenShift Container Platform インストールのターゲットおよび依存関係

インストール後に、各クラスターマシンは Red Hat Enterprise Linux CoreOS (RHCOS) をオペレーティングマシンとして使用します。RHCOS は Red Hat Enterprise Linux (RHEL) の不変のコンテナーホストのバージョンであり、デフォルトで SELinux が有効にされた RHEL カーネルを特長としています。これには、Kubernetes ノードエージェントである kubelet や、Kubernetes に対して最適化される CRI-O コンテナーランタイムが含まれます。

OpenShift Container Platform 4.9 クラスターのすべてのコントロールプレーンは、Ignition と呼ばれる最初の起動時に使用される重要なプロビジョニングツールが含まれる RHCOS を使用する必要があります。このツールは、クラスターのマシンの設定を可能にします。オペレーティングシステムの更新は、Operator によってクラスター全体に展開されるコンテナーイメージに組み込まれる Atomic OSTree リポジトリーとして提供されます。実際のオペレーティングシステムの変更については、rpm-ostree を使用する atomic 操作として各マシンでインプレースで実行されます。これらのテクノロジーを組み合わせて使用することにより、OpenShift Container Platform では、プラットフォーム全体を最新の状態に保つインプレースアップグレードで、その他のアプリケーションをクラスターで管理するかのようにオペレーティングシステムを管理することができます。これらのインプレースアップグレードにより、オペレーションチームの負担を軽減することができます。

すべてのクラスターマシンのオペレーティングシステムとして RHCOS を使用する場合、クラスターはオペレーティングシステムを含むコンポーネントとマシンのあらゆる側面を管理します。このため、マシンを変更できるのは、インストールプログラムと Machine Config Operator だけです。インストールプログラムは Ignition 設定ファイルを使用して各マシンの状態を設定し、Machine Config Operator はインストール後に、新規証明書またはキーの適用などのマシンへの変更を実行します。

1.1.1. インストールプロセス

OpenShift Container Platform クラスターをインストールする場合、インストールプログラムを OpenShift Cluster Manager サイトの適切な インフラストラクチャープロバイダー ページからダウンロードします。このサイトでは以下を管理しています。

- アカウントの REST API

- 必要なコンポーネントを取得するために使用するプルシークレットであるレジストリートークン

- クラスターのアイデンティティーを Red Hat アカウントに関連付けて使用状況のメトリクスの収集を容易にするクラスター登録

OpenShift Container Platform 4.9 では、インストールプログラムは、一連のアセットに対して一連のファイル変換を実行する Go バイナリーファイルです。インストールプログラムと対話する方法は、インストールタイプによって異なります。

- インストーラーでプロビジョニングされるインフラストラクチャーのクラスターの場合、インフラストラクチャーのブートストラップおよびプロビジョニングは、ユーザーが独自に行うのではなくインストールプログラムが代行します。インストールプログラムは、クラスターをサポートするために必要なネットワーク、マシン、およびオペレーティングシステムのすべてを作成します。

- クラスターのインフラストラクチャーを独自にプロビジョニングし、管理する場合には、ブートストラップマシン、ネットワーク、負荷分散、ストレージ、および個々のクラスターマシンを含む、すべてのクラスターインフラストラクチャーおよびリソースを指定する必要があります。

インストール時には、お使いのマシンタイプ用の install-config.yaml という名前のインストール設定ファイル、Kubernetes マニフェスト、および Ingition 設定ファイルの 3 つのファイルセットを使用します。

インストール時に、Kubernetes および基礎となる RHCOS オペレーティングシステムを制御する Ignition 設定ファイルを変更することができます。ただし、これらのオブジェクトに対して加える変更の適合性を確認するための検証の方法はなく、これらのオブジェクトを変更するとクラスターが機能しなくなる可能性があります。これらのオブジェクトを変更する場合、クラスターが機能しなくなる可能性があります。このリスクがあるために、変更方法についての文書化された手順に従っているか、または Red Hat サポートが変更することを指示した場合を除き、Kubernetes および Ignition 設定ファイルの変更はサポートされていません。

インストール設定ファイルは Kubernetes マニフェストに変換され、その後マニフェストは Ignition 設定にラップされます。インストールプログラムはこれらの Ignition 設定ファイルを使用してクラスターを作成します。

インストール設定ファイルはインストールプログラムの実行時にすべてプルーニングされるため、再び使用する必要のあるすべての設定ファイルをバックアップしてください。

インストール時に設定したパラメーターを変更することはできませんが、インストール後に数多くのクラスター属性を変更することができます。

インストーラーでプロビジョニングされるインフラストラクチャーでのインストールプロセス

デフォルトのインストールタイプは、インストーラーでプロビジョニングされるインフラストラクチャーです。デフォルトで、インストールプログラムはインストールウィザードとして機能し、独自に判別できない値の入力を求めるプロンプトを出し、残りのパラメーターに妥当なデフォルト値を提供します。インストールプロセスは、高度なインフラストラクチャーシナリオに対応するようカスタマイズすることもできます。インストールプログラムは、クラスターの基盤となるインフラストラクチャーをプロビジョニングします。

標準クラスターまたはカスタマイズされたクラスターのいずれかをインストールすることができます。標準クラスターの場合、クラスターをインストールするために必要な最小限の詳細情報を指定します。カスタマイズされたクラスターの場合、コントロールプレーンが使用するマシン数、クラスターがデプロイする仮想マシンのタイプ、または Kubernetes サービスネットワークの CIDR 範囲などのプラットフォームについての詳細を指定することができます。

可能な場合は、この機能を使用してクラスターインフラストラクチャーのプロビジョニングと保守の手間を省くようにしてください。他のすべての環境の場合には、インストールプログラムを使用してクラスターインフラストラクチャーをプロビジョニングするために必要なアセットを生成できます。

インストーラーでプロビジョニングされるインフラストラクチャークラスターの場合、OpenShift Container Platform は、オペレーティングシステム自体を含むクラスターのすべての側面を管理します。各マシンは、それが参加するクラスターでホストされるリソースを参照する設定に基づいて起動します。この設定により、クラスターは更新の適用時に自己管理できます。

ユーザーによってプロビジョニングされるインフラストラクチャーを使用したインストールプロセス

OpenShift Container Platform はユーザーが独自にプロビジョニングするインフラストラクチャーにインストールすることもできます。インストールプログラムを使用してクラスターインフラストラクチャーのプロビジョニングに必要なアセットを生成し、クラスターインフラストラクチャーを作成し、その後にクラスターをプロビジョニングしたインフラストラクチャーにデプロイします。

インストールプログラムがプロビジョニングするインフラストラクチャーを使用しない場合、以下を含むクラスターリソースを管理し、維持する必要があります。

- クラスターを設定するコントロールプレーンおよびコンピュートマシンの基礎となるインフラストラクチャー

- ロードバランサー

- DNS レコードおよび必要なサブネットを含むクラスターネットワーク

- クラスターインフラストラクチャーおよびアプリケーションのストレージ

クラスターでユーザーによってプロビジョニングされるインフラストラクチャーを使用する場合には、RHEL コンピュートマシンをクラスターに追加するオプションを使用できます。

インストールプロセスの詳細

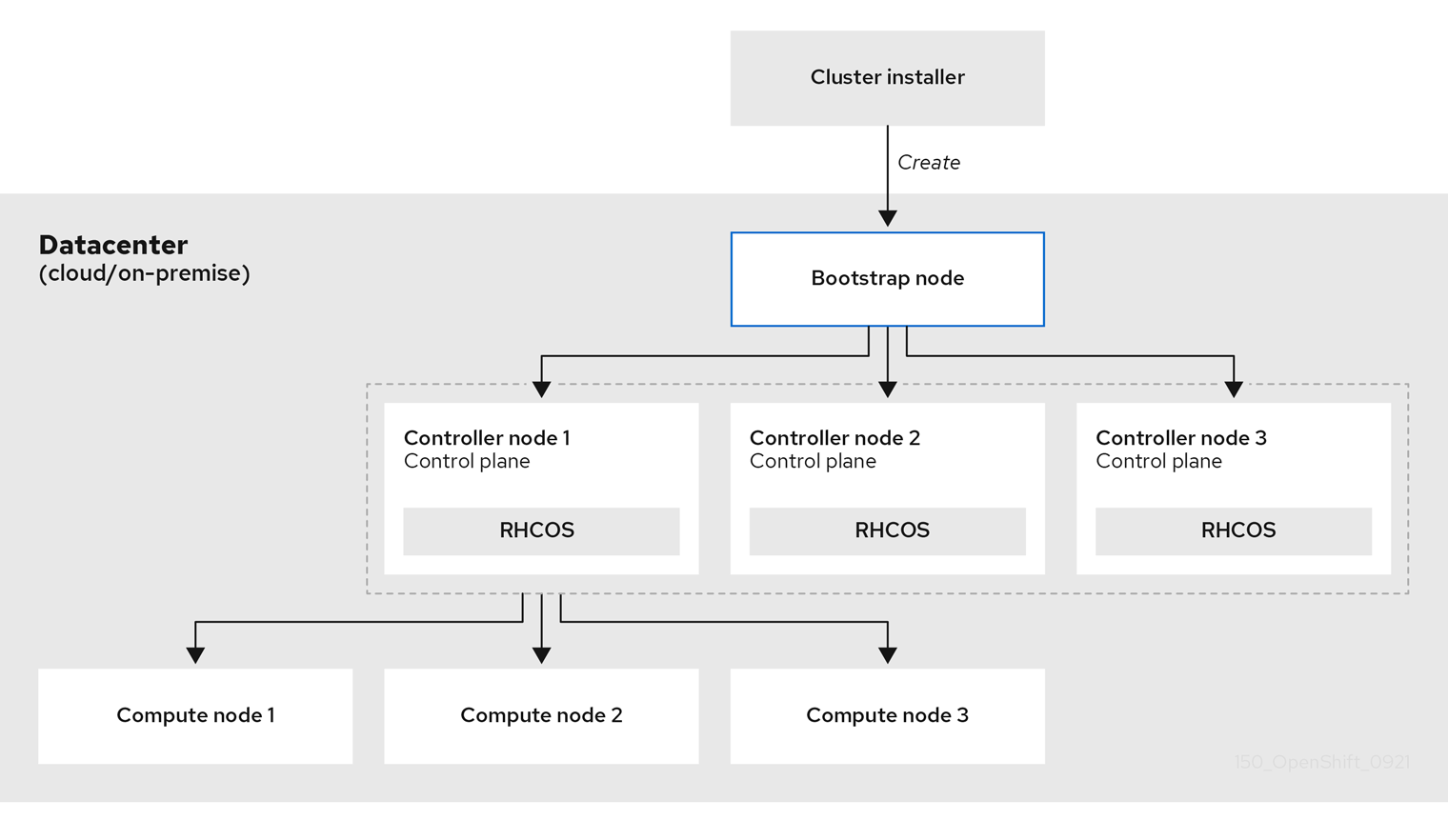

クラスターの各マシンにはプロビジョニング時にクラスターについての情報が必要になるため、OpenShift Container Platform は初期設定時に一時的な bootstrap マシンを使用し、必要な情報を永続的なコントロールマシンに提供します。これは、クラスターの作成方法を記述する Ignition 設定ファイルを使用して起動されます。ブートストラップマシンは、コントロールプレーンを設定するコントロールプレーンマシンを作成します。その後、コントロールプレーンマシンはコンピュートマシン (ワーカーマシンとしても知られる) を作成します。以下の図はこのプロセスを示しています。

図1.2 ブートストラップ、コントロールプレーンおよびコンピュートマシンの作成

クラスターマシンを初期化した後、ブートストラップマシンは破棄されます。すべてのクラスターがこのブートストラッププロセスを使用してクラスターを初期化しますが、ユーザーがクラスターのインフラストラクチャーをプロビジョニングする場合には、多くの手順を手動で実行する必要があります。

-

インストールプログラムが生成する Ignition 設定ファイルには、24 時間が経過すると期限切れになり、その後に更新される証明書が含まれます。証明書を更新する前にクラスターが停止し、24 時間経過した後にクラスターを再起動すると、クラスターは期限切れの証明書を自動的に復元します。例外として、kubelet 証明書を回復するために保留状態の

node-bootstrapper証明書署名要求 (CSR) を手動で承認する必要があります。詳細は、コントロールプレーン証明書の期限切れの状態からのリカバリー についてのドキュメントを参照してください。 - 24 時間証明書はクラスターのインストール後 16 時間から 22 時間にローテーションするため、Ignition 設定ファイルは、生成後 12 時間以内に使用することをお勧めします。12 時間以内に Ignition 設定ファイルを使用することにより、インストール中に証明書の更新が実行された場合のインストールの失敗を回避できます。

クラスターのブートストラップには、以下のステップが関係します。

- ブートストラップマシンが起動し、コントロールプレーンマシンの起動に必要なリモートリソースのホスティングを開始します。(ユーザーがインフラストラクチャーをプロビジョニングする場合には手動の介入が必要になります)。

- ブートストラップマシンは、単一ノードの etcd クラスターと一時的な Kubernetes コントロールプレーンを起動します。

- コントロールプレーンマシンは、ブートストラップマシンからリモートリソースをフェッチし、起動を終了します。(ユーザーがインフラストラクチャーをプロビジョニングする場合には手動の介入が必要になります)。

- 一時的なコントロールプレーンは、実稼働コントロールプレーンマシンに対して実稼働コントロールプレーンをスケジュールします。

- Cluster Version Operator (CVO) はオンラインになり、etcd Operator をインストールします。etcd Operator はすべてのコントロールプレーンノードで etcd をスケールアップします。

- 一時的なコントロールプレーンはシャットダウンし、コントロールを実稼働コントロールプレーンに渡します。

- ブートストラップマシンは OpenShift Container Platform コンポーネントを実稼働コントロールプレーンに挿入します。

- インストールプログラムはブートストラップマシンをシャットダウンします。(ユーザーがインフラストラクチャーをプロビジョニングする場合には手動の介入が必要になります)。

- コントロールプレーンはコンピュートノードを設定します。

- コントロールプレーンは一連の Operator の形式で追加のサービスをインストールします。

このブートストラッププロセスの結果として、OpenShift Container Platform クラスターが実行されます。次に、クラスターはサポートされる環境でのコンピュートマシンの作成など、日常の操作に必要な残りのコンポーネントをダウンロードし、設定します。

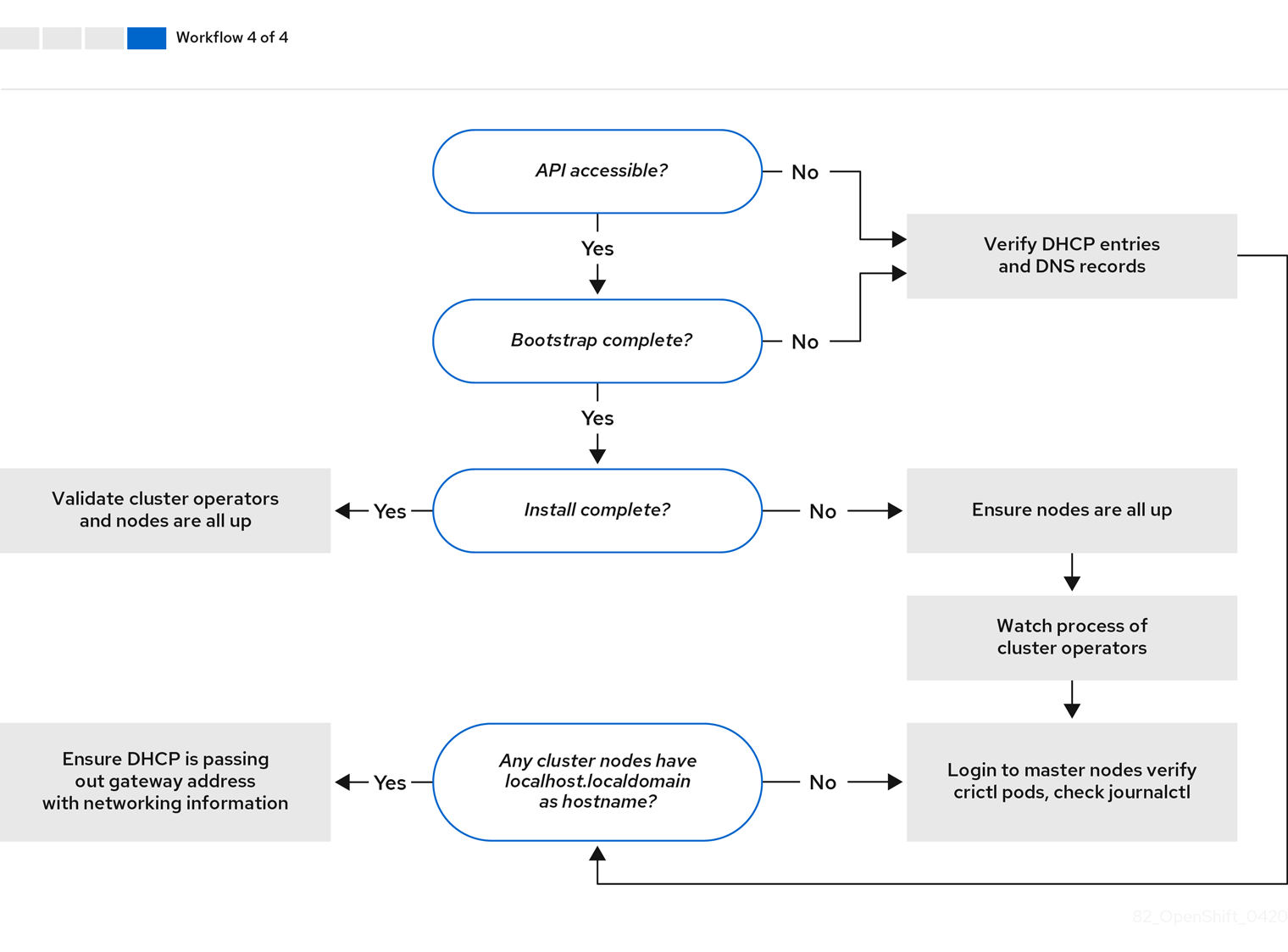

1.1.2. インストール後のノード状態の確認

以下のインストールヘルスチェックが正常に行われると、OpenShift Container Platform のインストールが完了します。

- プロビジョニングホストは OpenShift Container Platform Web コンソールにアクセスできます。

- すべてのコントロールプレーンノードが準備状態にある。

- すべてのクラスター Operator が利用可能です。

インストールが完了すると、ワーカーノードを実行する特定のクラスター Operator が継続的にすべてのワーカーノードのプロビジョニングを試みます。すべてのワーカーノードが READY と報告されるまでに時間がかかる場合があります。ベアメタルへのインストールの場合、ワーカーノードのトラブルシューティングを行う前に、少なくとも 60 分間待機してください。他のすべてのプラットフォームへのインストールの場合は、ワーカーノードのトラブルシューティングを行う前に、少なくとも 40 分間待機してください。ワーカーノードを実行するクラスター Operator の DEGRADED 状態は、ノードの状態ではなく、Operator 自体のリソースに依存します。

インストールが完了したら、以下の手順を使用してクラスター内のノードの状態を監視し続けることができます。

前提条件

- インストールプログラムはターミナルで正常に解決されます。

手順

すべてのワーカーノードのステータスを表示します。

$ oc get nodes

出力例

NAME STATUS ROLES AGE VERSION example-compute1.example.com Ready worker 13m v1.21.6+bb8d50a example-compute2.example.com Ready worker 13m v1.21.6+bb8d50a example-compute4.example.com Ready worker 14m v1.21.6+bb8d50a example-control1.example.com Ready master 52m v1.21.6+bb8d50a example-control2.example.com Ready master 55m v1.21.6+bb8d50a example-control3.example.com Ready master 55m v1.21.6+bb8d50a

すべてのワーカーマシンノードのフェーズを表示します。

$ oc get machines -A

出力例

NAMESPACE NAME PHASE TYPE REGION ZONE AGE openshift-machine-api example-zbbt6-master-0 Running 95m openshift-machine-api example-zbbt6-master-1 Running 95m openshift-machine-api example-zbbt6-master-2 Running 95m openshift-machine-api example-zbbt6-worker-0-25bhp Running 49m openshift-machine-api example-zbbt6-worker-0-8b4c2 Running 49m openshift-machine-api example-zbbt6-worker-0-jkbqt Running 49m openshift-machine-api example-zbbt6-worker-0-qrl5b Running 49m

インストールのスコープ

OpenShift Container Platform インストールプログラムのスコープは意図的に狭められています。単純さを確保し、確実にインストールを実行できるように設計されているためです。インストールが完了した後に数多くの設定タスクを実行することができます。

関連情報

- OpenShift Container Platform 設定リソースについての詳細は、利用可能なクラスターのカスタマイズ について参照してください。

1.2. OpenShift Container Platform クラスターでサポートされるプラットフォーム

OpenShift Container Platform バージョン 4.9 では、インストーラーでプロビジョニングされるインフラストラクチャーを使用するクラスターの場合、以下のプラットフォームにインストールできます。

- Amazon Web Services (AWS)

- Google Cloud Platform (GCP)

- Microsoft Azure

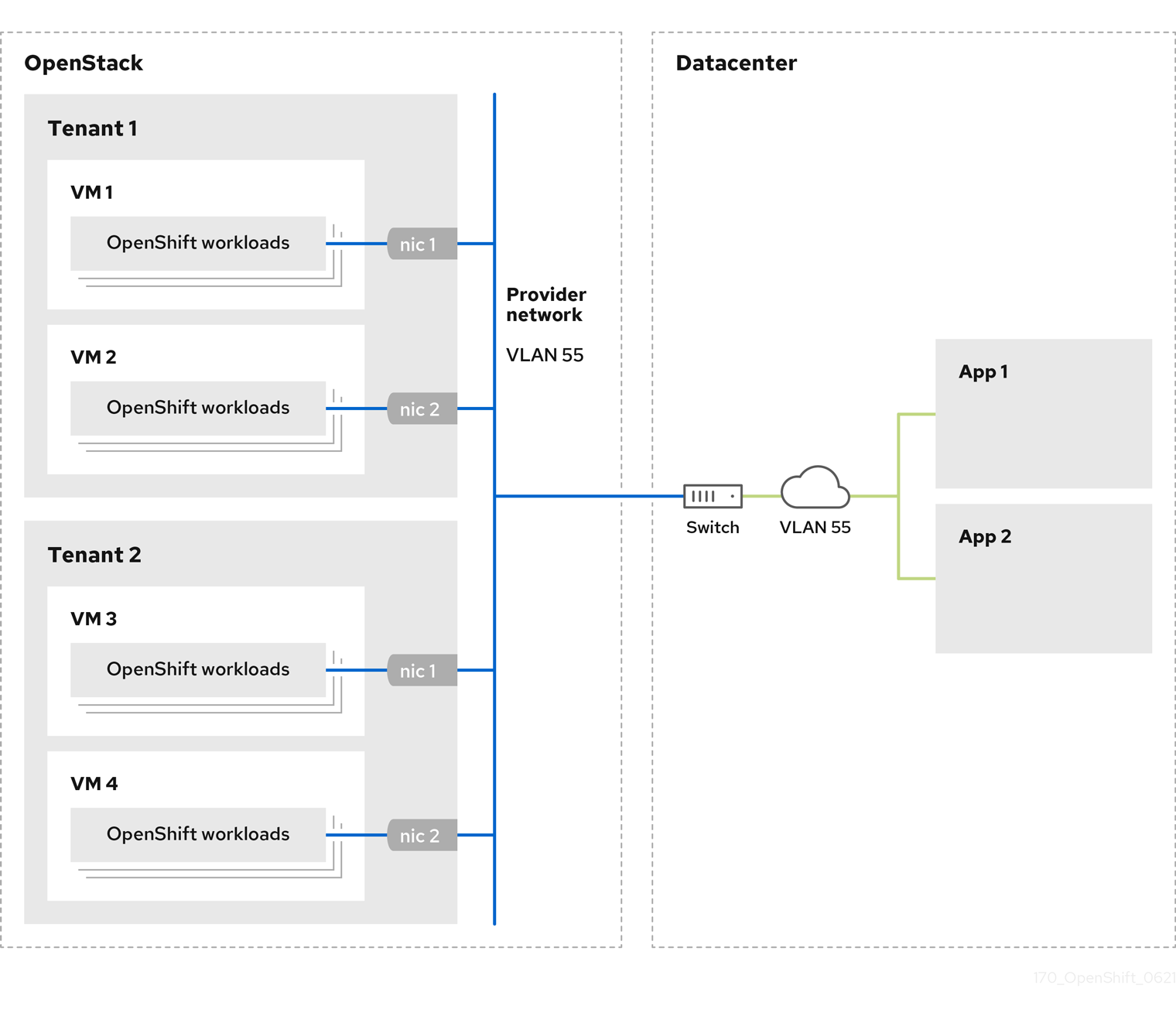

Red Hat OpenStack Platform (RHOSP) バージョン 16.1 および 16.2

- OpenShift Container Platform の最新リリースは、最新の RHOSP のロングライフリリースおよび中間リリースの両方をサポートします。RHOSP リリースの互換性についての詳細は、OpenShift Container Platform on RHOSP support matrix を参照してください。

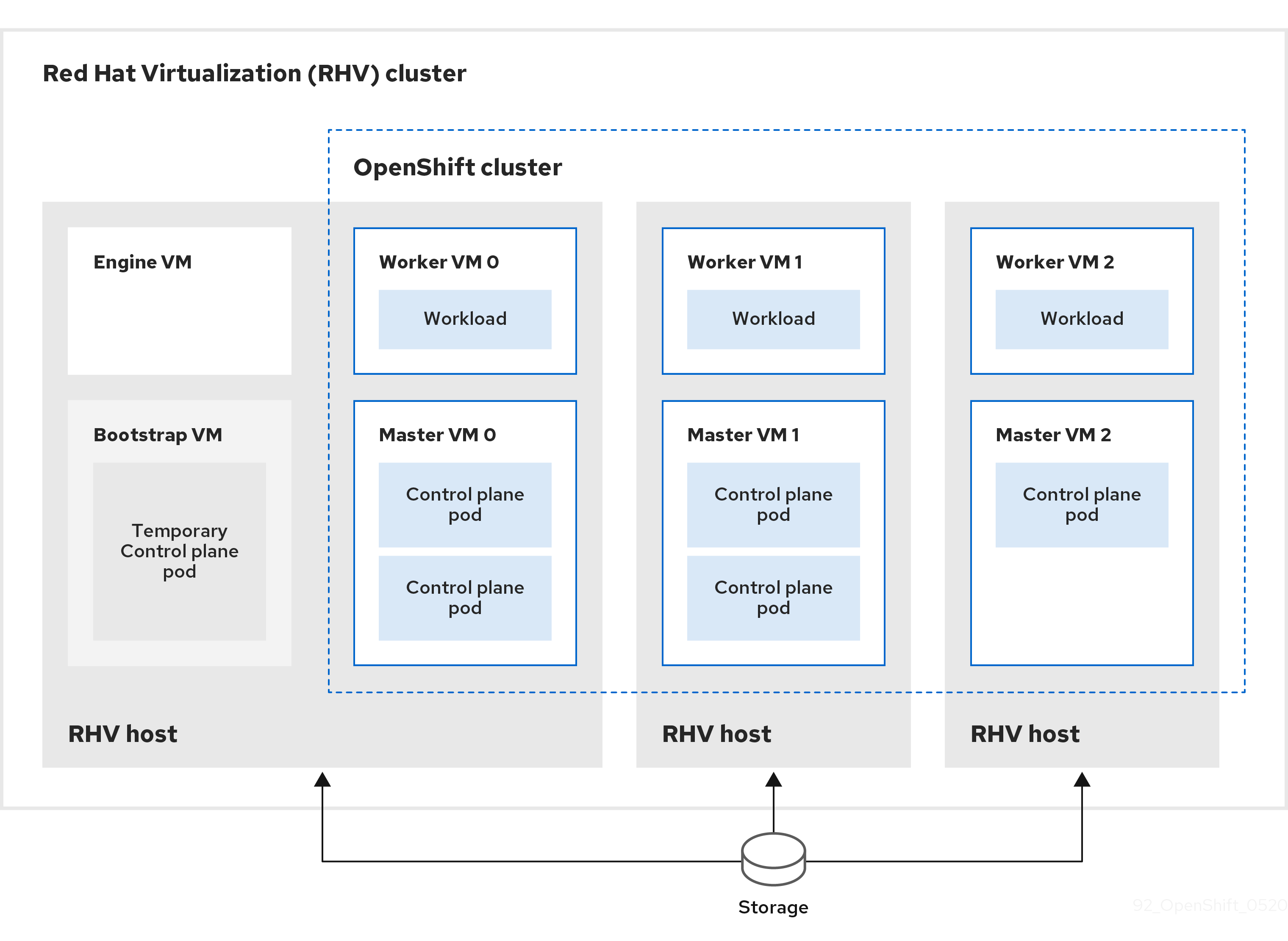

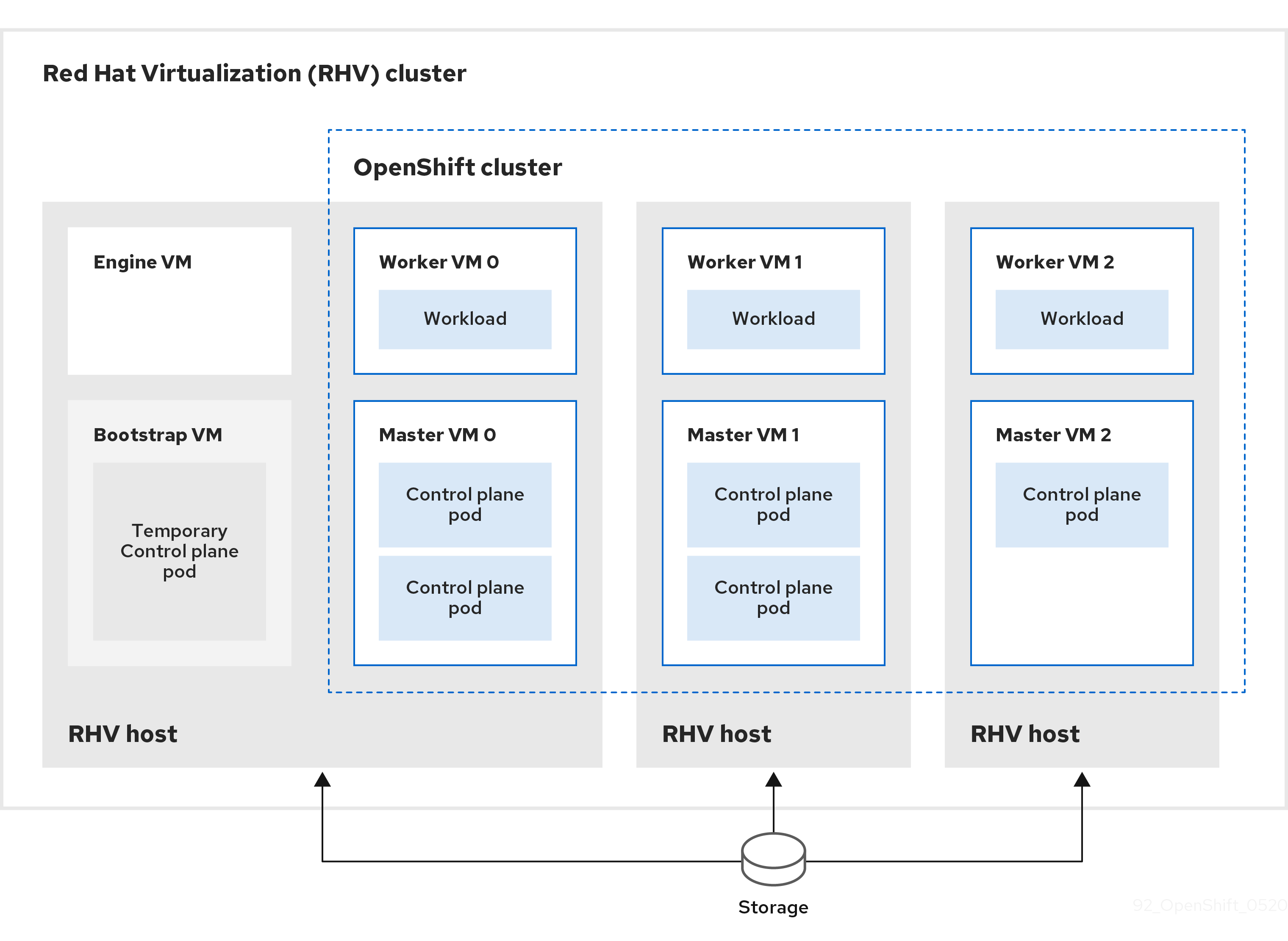

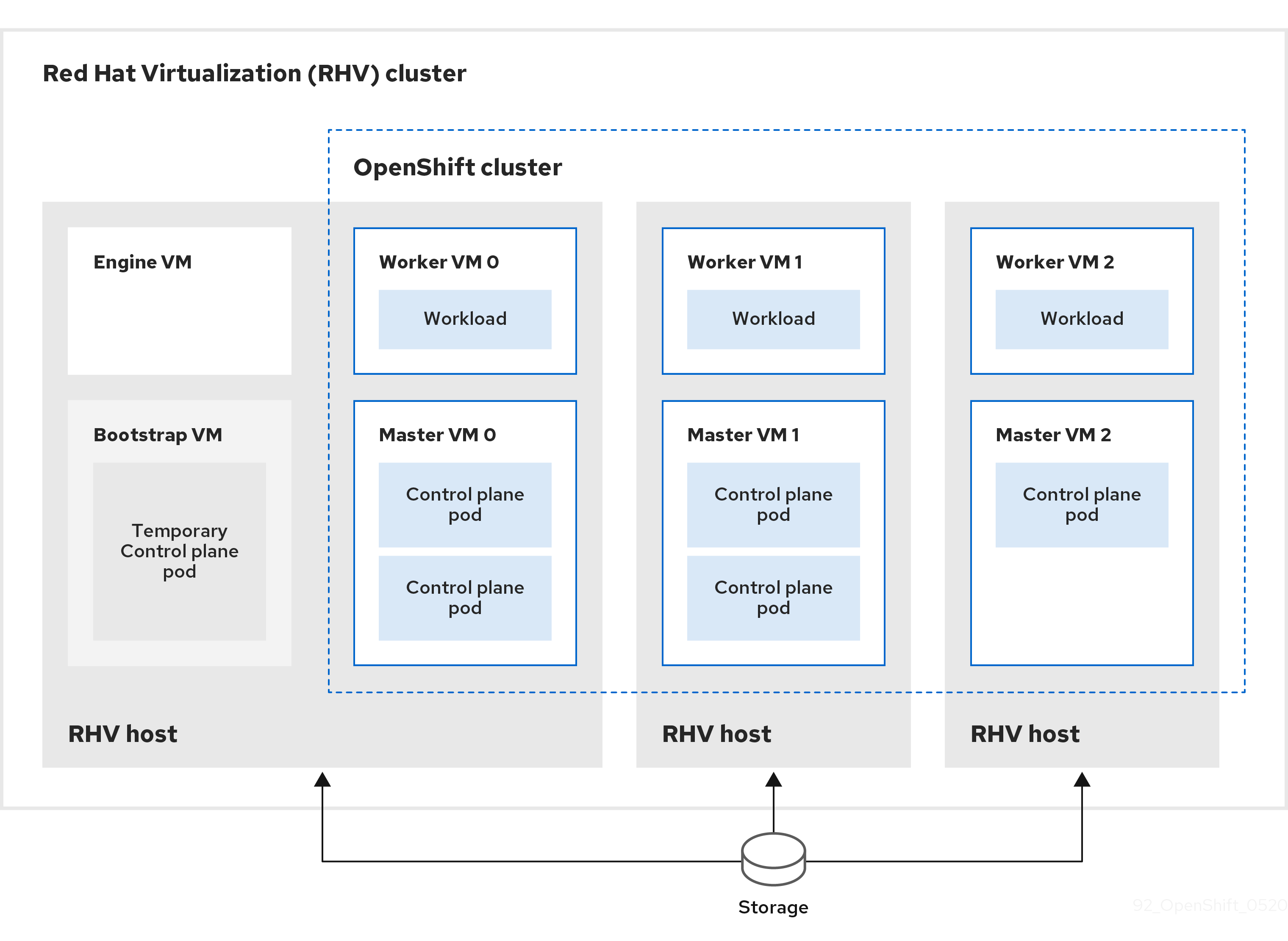

- Red Hat Virtualization (RHV)

- VMware vSphere

- VMware Cloud (VMC) on AWS

- ベアメタル

これらのクラスターの場合、インストールプロセスを実行するコンピューターを含むすべてのマシンが、プラットフォームコンテナーのイメージをプルし、Telemetry データを Red Hat に提供できるようインターネットに直接アクセスできる必要があります。

インストール後は、以下の変更はサポートされません。

- クラウドプロバイダープラットフォームの組み合わせ

- クラスターがインストールされているプラットフォームとは異なるプラットフォームの永続ストレージフレームワークを使用するなどの、クラウドプロバイダーのコンポーネントの組み合わせ

OpenShift Container Platform バージョン 4.9 では、ユーザーによってプロビジョニングされるインフラストラクチャーを使用するクラスターの場合、以下のプラットフォームにインストールできます。

- AWS

- Azure

- Azure Stack Hub

- GCP

- RHOSP バージョン 16.1 および 16.2

- RHV

- VMware vSphere

- VMware Cloud on AWS

- ベアメタル

- IBM Z または LinuxONE

- IBM Power

プラットフォームでサポートされているケースに応じて、ユーザーがプロビジョニングしたインフラストラクチャーにインストールすると、完全なインターネットアクセスでマシンを実行したり、クラスターをプロキシーの背後に配置したり、制限付きネットワークインストール を実行したりできます。ネットワークが制限された環境でのインストールでは、クラスターのインストールに必要なイメージをダウンロードして、ミラーレジストリーに配置し、そのデータを使用してクラスターをインストールできます。vSphere またはベアメタルインフラストラクチャーのネットワークが制限されたインストールでは、プラットフォームコンテナーのイメージをプルするためにインターネットにアクセスする必要がありますが、クラスターマシンはインターネットへの直接のアクセスを必要としません。

OpenShift Container Platform 4.x Tested Integrations のページには、各種プラットフォームの統合テストについての詳細が記載されています。

関連情報

- それぞれのサポートされているプラットフォームで利用できるインストールのタイプについての詳細は、各種プラットフォームのサポートされているインストール方法 を参照してください。

- インストール方法を選択し、必要なリソースを準備する方法については、クラスターインストール方法の選択およびそのユーザー向けの準備 を参照してください。

第2章 クラスターインストール方法の選択およびそのユーザー向けの準備

OpenShift Container Platform をインストールする前に、実行するインストールプロセスを決定し、ユーザー用にクラスターを準備する際に必要なすべてのリソースがあることを確認します。

2.1. クラスターのインストールタイプの選択

OpenShift Container Platform クラスターをインストールする前に、実行する最適なインストール手順を選択する必要があります。以下の質問に回答して、最も良いオプションを選択します。

2.1.1. OpenShift Container Platform クラスターを独自にインストールし、管理しますか ?

OpenShift Container Platform を独自にインストールし、管理する必要がある場合、以下のプラットフォームにインストールすることができます。

- Amazon Web Services (AWS)

- Microsoft Azure

- Microsoft Azure Stack Hub

- Google Cloud Platform (GCP)

- Red Hat OpenStack Platform (RHOSP)

- Red Hat Virtualization (RHV)

- IBM Z および LinuxONE

- Red Hat Enterprise Linux (RHEL) KVM 用の IBM Z および LinuxONE

- IBM Power

- VMware vSphere

- VMware Cloud (VMC) on AWS

- ベアメタルまたはその他のプラットフォームに依存しないインフラストラクチャー

OpenShift Container Platform 4 クラスターは、オンプレミスハードウェアとクラウドホストサービスの両方にデプロイできますが、クラスターのすべてのマシンは同じデータセンターまたはクラウドホストサービスにある必要があります。

OpenShift Container Platform を使用する必要があるが、クラスターを独自に管理することを望まない場合は、複数のマネージドサービスオプションを使用できます。Red Hat によって完全に管理されるクラスターが必要な場合は、OpenShift Dedicated または OpenShift Online を使用することができます。OpenShift を Azure、AWS、IBM Cloud、または Google Cloud でマネージドサービスとして使用することもできます。マネージドサービスの詳細は、OpenShift の製品 ページを参照してください。クラウド仮想マシンを仮想ベアメタルとして OpenShift Container Platform クラスターをインストールする場合、対応するクラウドベースのストレージはサポートされません。

2.1.2. OpenShift Container Platform 3 を使用したことがあり、その上で OpenShift Container Platform 4 を使用することを希望していますか ?

OpenShift Container Platform 3 を使用したことがあり、OpenShift Container Platform 4 を使用してみたいと思われる場合は、OpenShift Container Platform 4 がどのように異なるかを理解しておく必要があります。OpenShift Container Platform 4 では、 Kubernetes アプリケーション、プラットフォームが実行されるオペレーティングシステム、Red Hat Enterprise Linux CoreOS (RHCOS) を共にシームレスにパッケージ化し、デプロイし、管理する Operator を使用します。マシンをデプロイし、それらのオペレーティングシステムを設定して OpenShift Container Platform をそれらにインストールできるようにする代わりに、RHCOS オペレーティングシステムが OpenShift Container Platform クラスターの統合された部分として使用されます。OpenShift Container Platform のインストールプロセスの一部として、クラスターマシンのオペレーティングシステムをデプロイします。OpenShift Container Platform 3 と OpenShift Container Platform 4 の比較 を参照してください。

OpenShift Container Platform クラスターのインストールプロセスの一部としてマシンをプロビジョニングする必要があるため、OpenShift Container Platform 3 クラスターを OpenShift Container Platform 4 にアップグレードすることはできません。その代わりに、新規の OpenShift Container Platform 4 クラスターを作成し、OpenShift Container Platform 3 ワークロードをそれらに移行する必要があります。移行について詳細は、OpenShift の移行のベストプラクティス を参照してください。OpenShift Container Platform 4 に移行するにあたり、任意のタイプの実稼働用のクラスターのインストールプロセスを使用して新規クラスターを作成できます。

2.1.3. クラスターで既存のコンポーネントを使用する必要がありますか ?

オペレーティングシステムは OpenShift Container Platform に不可欠な要素であり、OpenShift Container Platform のインストールプログラムはすべてのインフラストラクチャーの起動を簡単に実行できます。これらは、インストーラーでプロビジョニングされるインフラストラクチャー のインストールと呼ばれています。この種のインストールでは、ユーザーは既存のインフラストラクチャーをクラスターに提供できますが、インストールプログラムがクラスターを最初に必要とするすべてのマシンをデプロイします。

インストーラーでプロビジョニングされるインフラストラクチャークラスターは、クラスターまたはその基礎となるマシンを、AWS、Azure、または GCP、または VMC on AWS に対してカスタマイズせずにデプロイできます。これらのインストール方法は、実稼働対応の OpenShift Container Platform クラスターをデプロイする最も高速な方法です。

クラスターマシンのインスタンスタイプなど、インストーラーでプロビジョニングされるインフラストラクチャークラスターの基本設定を実行する必要がある場合は、AWS、Azure、または GCP、または VMC on AWS のインストールをカスタマイズできます。

インストーラーでプロビジョニングされるインフラストラクチャーのインストールの場合、AWS の既存の VPC、Azure の vNet、または GCP の VPC を使用できます。ネットワークインフラストラクチャーの一部を再利用して、AWS、Azure、GCP、または VMC on AWS のクラスターが環境内の既存の IP アドレスの割り当てと共存し、既存の MTU および VXLAN 設定と統合できるようにします。これらのクラウドに既存のアカウントおよび認証情報がある場合は、それらを再利用できますが、OpenShift Container Platform クラスターをインストールするために必要なパーミッションを持つようアカウントを変更する必要がある場合があります。

インストーラーでプロビジョニングされるインフラストラクチャー方法を使用して、RHOSP、RHOSP with Kuryr、RHOSP on SR-IOV、RHV、vSphere、および bare metal のハードウェアに適切なマシンインスタンスを作成できます。さらに、vSphere の VMC on AWS では、インストール時に追加のネットワークパラメーターをカスタマイズすることもできます。

大規模なクラウドインフラストラクチャーを再利用する必要がある場合、ユーザーによってプロビジョニングされるインフラストラクチャー のインストールを実行できます。これらのインストールでは、インストールプロセス時にクラスターに必要なマシンを手動でデプロイします。AWS、Azure、Azure Stack Hub、GCP、または VMC on AWS でユーザーによってプロビジョニングされるインフラストラクチャーを実行する場合、提供されるテンプレートを使用して必要なすべてのコンポーネントを起動できます。共有 VPC on GCP を再利用することもできます。それ以外の場合は、 プロバイダーに依存しない インストール方法を使用して、クラスターを他のクラウドにデプロイすることができます。

ユーザーによってプロビジョニングされるインフラストラクチャーは、既存のハードウェアで実行することもできます。RHOSP、RHOSP on SR-IOV、RHV、IBM Z or LinuxONE、IBM Z or LinuxONE with RHEL KVM、IBM Power、または vSphere を使用する場合は、特定のインストール手順を使用してクラスターをデプロイします。サポートされる他のハードウェアを使用する場合は、ベアメタルのインストール 手順に従います。RHOSP、vSphere、VMC on AWS、bare metal などの一部のプラットフォームの場合は、インストール時に追加のネットワークパラメーターをカスタマイズすることもできます。

2.1.4. クラスターに追加のセキュリティーが必要ですか ?

ユーザーによってプロビジョニングされるインストール方法を使用する場合、クラスターのプロキシーを設定できます。この手順は各インストール手順に含まれています。

パブリッククラウドのクラスターがエンドポイントを外部に公開するのを防ぐ必要がある場合、AWS、Azure、または GCP のインストーラーでプロビジョニングされるインフラストラクチャーを使用してプライベートクラスターをデプロイすることができます。

非接続のクラスターまたはネットワークが制限されたクラスターなど、インターネットへのアクセスが限定されたクラスターをインストールする必要がある場合、インストールパッケージをミラーリング し、そこからクラスターをインストールできます。AWS、GCP、IBM Z or LinuxONE、IBM Z or LinuxONE with RHEL KVM、IBM Power、vSphere、VMC on AWS、または bare metal のネットワークが制限された環境へのユーザーによってプロビジョニングされるインフラストラクチャーのインストールの詳細な手順を実行します。You can also install a cluster into a restricted network using installer-provisioned infrastructure by following detailed instructions for AWS、GCP、VMC on AWS、RHOSP、RHV、および vSphere の詳細な手順に従って、インストーラーでプロビジョニングされるインフラストラクチャーを使用してクラスターをネットワークが制限された環境にインストールすることもできます。

クラスターを AWS GovCloud リージョン、AWS China リージョン、または Azure government リージョン にデプロイする必要がある場合は、インストーラーでプロビジョニングされるインフラストラクチャーのインストール時にこれらのカスタムリージョンを設定できます。

また、インストール時に FIPS で検証済み/進行中のモジュール (Modules in Process) 暗号ライブラリー を使用するようにクラスターマシンを設定することもできます。

FIPS 検証済み/進行中のモジュール (Modules in Process) 暗号ライブラリーの使用は、x86_64 アーキテクチャーの OpenShift Container Platform デプロイメントでのみサポートされています。

2.2. インストール後のユーザー向けのクラスターの準備

一部の設定は、クラスターのインストールに必須ではありませんが、ユーザーがクラスターにアクセスする前に設定することが推奨されます。クラスター自体のカスタマイズは、クラスターを設定する Operator を カスタマイズ して実行でき、クラスターをアイデンティティープロバイダーなどの他の必要なシステムに統合できます。

実稼働クラスターの場合、以下の統合を設定する必要があります。

2.3. ワークロードについてのクラスターの準備

ワークロードのニーズによっては、アプリケーションのデプロイを開始する前に、追加の手順が必要になる場合があります。たとえば、アプリケーションの ビルドストラテジー をサポートできるようなインフラストラクチャーを準備した後に、低レイテンシー のワークロードに対応できるようにしたり、機密のワークロードを保護 できるようにしたりする必要がある場合があります。アプリケーションワークロードの モニターリング を設定することもできます。Windows ワークロード を実行する予定の場合、インストールプロセス時に OVN-Kubernetes を使用してハイブリッドネットワーク を有効にする必要があります。ハイブリッドネットワークは、クラスターのインストール後に有効にすることはできません。

2.4. 各種プラットフォームのサポートされているインストール方法

各種のプラットフォームで各種のインストールを実行できます。

以下の表にあるように、すべてのプラットフォームですべてのインストールオプションがサポートされている訳ではありません。チェックマークは、オプションがサポートされていることを示し、関連するセクションにリンクしています。

表2.1 インストーラーでプロビジョニングされるインフラストラクチャーのオプション

第3章 非接続インストールのイメージのミラーリング

このセクションの手順を使用して、クラスターが外部コンテンツに対する組織の制限条件を満たすコンテナーイメージのみを使用するようにできます。ネットワークが制限された環境でプロビジョニングするインフラストラクチャーにクラスターをインストールする前に、必要なコンテナーイメージをその環境にミラーリングする必要があります。コンテナーイメージをミラーリングするには、ミラーリング用のレジストリーが必要です。

必要なコンテナーイメージを取得するには、インターネットへのアクセスが必要です。この手順では、ご使用のネットワークとインターネットのどちらにもアクセスできるミラーホストにミラーレジストリーを配置します。ミラーホストにアクセスできない場合は、非接続クラスターで使用する Operator カタログのミラーリング を使用して、ネットワークの境界を越えて移動できるデバイスにイメージをコピーします。

3.1. 前提条件

以下のレジストリーのいずれかなど、OpenShift Container Platform クラスターをホストする場所に Docker v2-2 をサポートするコンテナーイメージレジストリーが必要です。

Red Hat Quay のエンタイトルメントをお持ちの場合は、Red Hat Quay のデプロイに関するドキュメント 概念実証 (実稼働以外) 向けの Red Hat Quay のデプロイ または Quay Operator の使用による OpenShift への Red Hat Quay のデプロイ を参照してください。レジストリーの選択およびインストールがにおいてさらにサポートが必要な場合は、営業担当者または Red Hat サポートにお問い合わせください。

- コンテナーイメージレジストリーの既存のソリューションがまだない場合には、OpenShift Container Platform のサブスクライバーに Red Hat OpenShift のミラーレジストリー が提供されます。Red Hat Openshift 導入用のミラーレジストリーはサブスクリプションに含まれており、切断されたインストールで OpenShift Container Platform で必須のコンテナーイメージのミラーリングに使用できる小規模なコンテナーレジストリーです。

3.2. ミラーレジストリーについて

OpenShift Container Platform のインストールとその後の製品更新に必要なイメージは、Red Hat Quay、JFrog Artifactory、Sonatype Nexus Repository、Harbor などのコンテナーミラーレジストリーにミラーリングできます。大規模なコンテナーレジストリーにアクセスできない場合は、OpenShift Container Platform サブスクリプションに含まれる小規模なコンテナーレジストリーである Red Hat Openshift 導入用のミラーレジストリー を使用できます。

Red Hat Quay、Red Hat Openshift 導入用のミラーレジストリー、Artifactory、Sonatype Nexus リポジトリー、Harbor など、Dockerv2-2 をサポートする任意のコンテナーレジストリーを使用できます。選択したレジストリーに関係なく、インターネット上の Red Hat がホストするサイトから分離されたイメージレジストリーにコンテンツをミラーリングする手順は同じです。コンテンツをミラーリングした後に、各クラスターをミラーレジストリーからこのコンテンツを取得するように設定します。

OpenShift Container Platform クラスターの内部レジストリーはターゲットレジストリーとして使用できません。これは、ミラーリングプロセスで必要となるタグを使わないプッシュをサポートしないためです。

Red Hat Openshift 導入用のミラーレジストリー以外のコンテナーレジストリーを選択する場合は、プロビジョニングするクラスター内の全マシンから到達可能である必要があります。レジストリーに到達できない場合、インストール、更新、またはワークロードの再配置などの通常の操作が失敗する可能性があります。そのため、ミラーレジストリーは可用性の高い方法で実行し、ミラーレジストリーは少なくとも OpenShift Container Platform クラスターの実稼働環境の可用性の条件に一致している必要があります。

ミラーレジストリーを OpenShift Container Platform イメージで設定する場合、2 つのシナリオを実行することができます。インターネットとミラーレジストリーの両方にアクセスできるホストがあり、クラスターノードにアクセスできない場合は、そのマシンからコンテンツを直接ミラーリングできます。このプロセスは、connected mirroring (接続ミラーリング) と呼ばれます。このようなホストがない場合は、イメージをファイルシステムにミラーリングしてから、そのホストまたはリムーバブルメディアを制限された環境に配置する必要があります。このプロセスは、disconnected mirroring (非接続ミラーリング) と呼ばれます。

ミラーリングされたレジストリーの場合は、プルされたイメージのソースを表示するには、CRI-O ログで Trying to access のログエントリーを確認する必要があります。ノードで crictl images コマンドを使用するなど、イメージのプルソースを表示する他の方法では、イメージがミラーリングされた場所からプルされている場合でも、ミラーリングされていないイメージ名を表示します。

Red Hat は、OpenShift Container Platform を使用してサードパーティーのレジストリーをテストしません。

関連情報

CRI-O ログを表示してイメージソースを表示する方法は、イメージのプルソースの表示 を参照してください。

3.3. ミラーホストの準備

ミラー手順を実行する前に、ホストを準備して、コンテンツを取得し、リモートの場所にプッシュできるようにする必要があります。

3.3.1. バイナリーのダウンロードによる OpenShift CLI のインストール

コマンドラインインターフェイスを使用して OpenShift Container Platform と対話するために CLI (oc) をインストールすることができます。oc は Linux、Windows、または macOS にインストールできます。

以前のバージョンの oc をインストールしている場合、これを使用して OpenShift Container Platform 4.9 のすべてのコマンドを実行することはできません。新規バージョンの oc をダウンロードし、インストールします。

Linux への OpenShift CLI のインストール

以下の手順を使用して、OpenShift CLI (oc) バイナリーを Linux にインストールできます。

手順

- Red Hat カスタマーポータルの OpenShift Container Platform ダウンロードページ に移動します。

- Version ドロップダウンメニューで適切なバージョンを選択します。

- OpenShift v4.9 Linux Client エントリーの横にある Download Now をクリックして、ファイルを保存します。

アーカイブを展開します。

$ tar xvf <file>

ocバイナリーを、PATHにあるディレクトリーに配置します。PATHを確認するには、以下のコマンドを実行します。$ echo $PATH

OpenShift CLI のインストール後に、oc コマンドを使用して利用できます。

$ oc <command>

Windows への OpenShift CLI のインストール

以下の手順を使用して、OpenShift CLI (oc) バイナリーを Windows にインストールできます。

手順

- Red Hat カスタマーポータルの OpenShift Container Platform ダウンロードページ に移動します。

- Version ドロップダウンメニューで適切なバージョンを選択します。

- OpenShift v4.9 Windows Client エントリーの横にある Download Now をクリックして、ファイルを保存します。

- ZIP プログラムでアーカイブを解凍します。

ocバイナリーを、PATHにあるディレクトリーに移動します。PATHを確認するには、コマンドプロンプトを開いて以下のコマンドを実行します。C:\> path

OpenShift CLI のインストール後に、oc コマンドを使用して利用できます。

C:\> oc <command>

macOC への OpenShift CLI のインストール

以下の手順を使用して、OpenShift CLI (oc) バイナリーを macOS にインストールできます。

手順

- Red Hat カスタマーポータルの OpenShift Container Platform ダウンロードページ に移動します。

- Version ドロップダウンメニューで適切なバージョンを選択します。

- OpenShift v4.9 MacOSX Client エントリーの横にある Download Now をクリックして、ファイルを保存します。

- アーカイブを展開し、解凍します。

ocバイナリーをパスにあるディレクトリーに移動します。PATHを確認するには、ターミナルを開き、以下のコマンドを実行します。$ echo $PATH

OpenShift CLI のインストール後に、oc コマンドを使用して利用できます。

$ oc <command>

3.4. イメージのミラーリングを可能にする認証情報の設定

Red Hat からミラーへのイメージのミラーリングを可能にするコンテナーイメージレジストリーの認証情報ファイルを作成します。

クラスターのインストール時に、このイメージレジストリー認証情報ファイルをプルシークレットとして使用しないでください。クラスターのインストール時にこのファイルを指定すると、クラスター内のすべてのマシンにミラーレジストリーへの書き込みアクセスが付与されます。

このプロセスでは、ミラーレジストリーのコンテナーイメージレジストリーへの書き込みアクセスがあり、認証情報をレジストリープルシークレットに追加する必要があります。

前提条件

- 切断された環境で使用するミラーレジストリーを設定しました。

- イメージをミラーリングするミラーレジストリー上のイメージリポジトリーの場所を特定している。

- イメージのイメージリポジトリーへのアップロードを許可するミラーレジストリーアカウントをプロビジョニングしている。

手順

インストールホストで以下の手順を実行します。

-

registry.redhat.ioプルシークレットを Red Hat OpenShift Cluster Manager からダウンロードし、.jsonファイルに保存します。 ミラーレジストリーの base64 でエンコードされたユーザー名およびパスワードまたはトークンを生成します。

$ echo -n '<user_name>:<password>' | base64 -w0 1 BGVtbYk3ZHAtqXs=- 1

<user_name>および<password>については、レジストリーに設定したユーザー名およびパスワードを指定します。

JSON 形式でプルシークレットのコピーを作成します。

$ cat ./pull-secret.text | jq . > <path>/<pull_secret_file_in_json>1- 1

- プルシークレットを保存するフォルダーへのパスおよび作成する JSON ファイルの名前を指定します。

ファイルを

~/.docker/config.jsonまたは$XDG_RUNTIME_DIR/containers/auth.jsonとして保存します。ファイルの内容は以下の例のようになります。

{ "auths": { "cloud.openshift.com": { "auth": "b3BlbnNo...", "email": "you@example.com" }, "quay.io": { "auth": "b3BlbnNo...", "email": "you@example.com" }, "registry.connect.redhat.com": { "auth": "NTE3Njg5Nj...", "email": "you@example.com" }, "registry.redhat.io": { "auth": "NTE3Njg5Nj...", "email": "you@example.com" } } }新規ファイルを編集し、レジストリーについて記述するセクションをこれに追加します。

"auths": { "<mirror_registry>": { 1 "auth": "<credentials>", 2 "email": "you@example.com" } },ファイルは以下の例のようになります。

{ "auths": { "registry.example.com": { "auth": "BGVtbYk3ZHAtqXs=", "email": "you@example.com" }, "cloud.openshift.com": { "auth": "b3BlbnNo...", "email": "you@example.com" }, "quay.io": { "auth": "b3BlbnNo...", "email": "you@example.com" }, "registry.connect.redhat.com": { "auth": "NTE3Njg5Nj...", "email": "you@example.com" }, "registry.redhat.io": { "auth": "NTE3Njg5Nj...", "email": "you@example.com" } } }

3.5. Red Hat OpenShift のミラーレジストリー

Red Hat OpenShift のミラーレジストリーは、切断されたインストールに必要な OpenShift Container Platform のコンテナーイメージのミラーリングターゲットとして使用できる小規模で合理化されたコンテナーレジストリーです。

Red Hat Quay などのコンテナーイメージレジストリーがすでにある場合は、これらのステップをスキップして、OpenShift Container Platform イメージリポジトリーのミラーリング に直接進むことができます。

前提条件

- OpenShift Container Platform サブスクリプション

- Podman 3.3 および OpenSSL がインストールされた Red Hat Enterprise Linux (RHEL) 8。

- Red Hat Quay サービスの完全修飾ドメイン名。DNS サーバーを介して解決する必要があります。

-

ターゲットホストでパスワードなしに使用できる

sudoアクセス権。 - ターゲットホストでのキーベースの SSH 接続。SSH キーは、ローカルインストール用に自動的に生成されます。リモートホストの場合は、独自の SSH キーを生成する必要があります。

- vCPU 2 つ以上。

- RAM 8 GB。

OpenShift Container Platform 4.9 リリースイメージの場合は約 9.6GB、OpenShift Container Platform4.9 リリースイメージおよび OpenShift Container Platform 4.9 Red Hat Operator イメージの場合は約 444GB。ストリームあたり最大 1TB 以上が推奨されます。

重要これらの要件は、リリースイメージと Operator イメージだけでテストしたローカルテスト結果に基づいています。ストレージ要件は、組織のニーズによって異なります。ユーザーによって、複数の z ストリームをミラーリングするなどの場合に、より多くのスペースを必要とする場合があります。標準の Red Hat Quay 機能を使用して、不要なイメージを削除し、スペースを解放できます。

3.5.1. Red Hat OpenShift 導入用のミラーレジストリー

OpenShift Container Platform の切断されたデプロイメントの場合に、クラスターのインストールを実行するためにコンテナーレジストリーが必要です。このようなクラスターで実稼働レベルのレジストリーサービスを実行するには、別のレジストリーデプロイメントを作成して最初のクラスターをインストールする必要があります。Red Hat Openshift 導入用のミラーレジストリー は、このニーズに対応し、すべての OpenShift サブスクリプションに含まれています。これは、OpenShift コンソールの ダウンロード ページからダウンロードできます。

Red Hat Openshift 導入用のミラーレジストリー を使用すると、ユーザーは、 mirror-registry コマンドラインインターフェイス (CLI) ツールを使用して、Red Hat Quay の小規模バージョンとその必要なコンポーネントをインストールできます。Red Hat Openshift 導入用のミラーレジストリー は、事前設定されたローカルストレージとローカルデータベースを使用して自動的にデプロイされます。また、このレジストリーには、自動生成されたユーザー認証情報とアクセス権限と、単一の入力セットが含まれており、追加の設定オプションなしに開始できます。

Red Hat Openshift のミラーレジストリー は、事前に決定されたネットワーク設定を提供し、成功時にデプロイされたコンポーネントの認証情報とアクセス URL を報告します。完全修飾ドメイン名 (FQDN) サービス、スーパーユーザー名とパスワード、カスタム TLS 証明書などのオプションの設定入力のセットも少しだけ含まれています。これにより、ユーザーはコンテナーレジストリーを利用できるため、制限されたネットワーク環境での OpenShift Container Platform 実行時に、すべての OpenShift Container Platform リリースコンテンツのオフラインミラーを簡単に作成できます。

Red Hat Openshift 導入用のミラーレジストリー は、リリースイメージや Red Hat Operator イメージなど、切断された OpenShift Container Platform クラスターのインストールに必要なイメージのホスティングに限定されます。Red Hat Enterprise Linux (RHEL) マシンのローカルストレージを使用して、RHEL でサポートされるストレージは、Red Hat Openshift 導入用のミラーレジストリー でサポートされます。お客様が作成したコンテンツは、Red Hat Openshift 導入用のミラーレジストリー でホストしないでください。

Red Hat Quay とは異なり、Red Hat Openshift 導入用のミラーレジストリーは高可用性レジストリーではなく、ローカルファイルシステムストレージのみがサポートされています。クラスターのグループの更新時にクラスターが複数あると単一障害点を生み出す可能性があるため、複数のクラスターで Red Hat Openshift 導入用のミラーレジストリーを使用することはお勧めしません。Red Hat Openshift 導入用のミラーレジストリーを活用して、OpenShift Container Platform コンテンツを他のクラスターに提供できる Red Hat Quay などの実稼働環境レベルの高可用性レジストリーをホストできるクラスターをインストールすることをお勧めします。

インストール環境で別のコンテナーレジストリーがすでに使用可能な場合、Red Hat Openshift 導入用のミラーレジストリー の使用はオプションです。

3.5.2. Red Hat Openshift 導入用のミラーレジストリーを使用したローカルホストでのミラーリング

この手順では、mirror-registry インストーラーツールを使用して、 Red Hat Openshift 導入用のミラーレジストリーをローカルホストにインストールする方法について説明します。このツールを使用することで、ユーザーは、OpenShift Container Platform イメージのミラーを保存する目的で、ポート 443 で実行されるローカルホストレジストリーを作成できます。

mirror-registry CLI ツールを使用してRed Hat Openshift 導入用のミラーレジストリー をインストールすると、マシンにいくつかの変更が加えられます。インストール後、インストールファイル、ローカルストレージ、および設定バンドルを含む、/ etc/quay-install ディレクトリーが作成されます。デプロイ先がローカルホストである場合には、信頼できる SSH キーが生成され、コンテナーのランタイムが永続的になるようにホストマシン上の systemd ファイルが設定されます。さらに、 init という名前の初期ユーザーが、自動生成されたパスワードを使用して作成されます。すべてのアクセス認証情報は、インストール操作の最後に出力されます。

手順

-

OpenShift コンソールのダウンロードページにある Red Hat Openshift 導入用のミラーレジストリーの最新バージョンは、

mirror-registry.tar.gzパッケージをダウンロードしてください。 mirror-registryツールを使用して、現在のユーザーアカウントでローカルホストにRed Hat Openshift 導入用のミラーレジストリー をインストールします。使用可能なフラグの完全なリストは、Red Hat OpenShift フラグのミラーレジストリーを参照してください。$ sudo ./mirror-registry install \ --quayHostname <host_example_com> \ --quayRoot <example_directory_name>

インストール中に生成されたユーザー名とパスワードを使用して、次のコマンドを実行してレジストリーにログインします。

$ podman login --authfile pull-secret.txt \ -u init \ -p <password> \ <host_example_com>:8443> \ --tls-verify=false 1- 1

- 生成された root CA 証明書を信頼するようにシステムを設定して、

--tls-verify=falseの実行を回避できます。詳細は、SSL を使用した Red Hat Quay への接続の保護および認証局を信頼するようにシステムを設定するを参照してください。

注記インストール後、

https:// <host.example.com>:8443の UI にアクセスしてログインすることもできます。ログイン後、OpenShift Container Platform イメージをミラーリングできます。必要に応じて、このドキュメントの OpenShift Container Platform イメージリポジトリーのミラーリングまたは、非接続クラスターで使用する Operator カタログのミラーリングセクションを参照してください。

注記ストレージレイヤーの問題が原因でRed Hat OpenShift のミラーレジストリー で保存されたイメージに問題がある場合は、OpenShift Container Platform イメージを再ミラーリングするか、より安定したストレージにミラーレジストリーを再インストールできます。

3.5.3. Red Hat OpenShift のミラーレジストリーを使用したリモートホストでのミラーリング

この手順では、mirror-registry ツールを使用して、 Red Hat Openshift 導入用のミラーレジストリーをリモートホストにインストールする方法について説明します。そうすることで、ユーザーは OpenShift Container Platform イメージのミラーを保持するレジストリーを作成できます。

mirror-registry CLI ツールを使用してRed Hat Openshift 導入用のミラーレジストリー をインストールすると、マシンにいくつかの変更が加えられます。インストール後、インストールファイル、ローカルストレージ、および設定バンドルを含む、/ etc/quay-install ディレクトリーが作成されます。デプロイ先がローカルホストである場合には、信頼できる SSH キーが生成され、コンテナーのランタイムが永続的になるようにホストマシン上の systemd ファイルが設定されます。さらに、 init という名前の初期ユーザーが、自動生成されたパスワードを使用して作成されます。すべてのアクセス認証情報は、インストール操作の最後に出力されます。

手順

-

OpenShift コンソールのダウンロードページにある Red Hat Openshift 導入用のミラーレジストリーの最新バージョンは、

mirror-registry.tar.gzパッケージをダウンロードしてください。 mirror-registryツールを使用して、現在のユーザーアカウントでローカルホストにRed Hat Openshift 導入用のミラーレジストリー をインストールします。使用可能なフラグの完全なリストは、Red Hat OpenShift フラグのミラーレジストリーを参照してください。$ sudo ./mirror-registry install -v \ --targetHostname <host_example_com> \ --targetUsername <example_user> \ -k ~/.ssh/my_ssh_key \ --quayHostname <host_example_com> \ --quayRoot <example_directory_name>

インストール中に生成されたユーザー名とパスワードを使用して、次のコマンドを実行してミラーレジストリーにログインします。

$ podman login --authfile pull-secret.txt \ -u init \ -p <password> \ <host_example_com>:8443> \ --tls-verify=false 1- 1

- 生成された root CA 証明書を信頼するようにシステムを設定して、

--tls-verify=falseの実行を回避できます。詳細は、SSL を使用した Red Hat Quay への接続の保護および認証局を信頼するようにシステムを設定するを参照してください。

注記インストール後、

https:// <host.example.com>:8443の UI にアクセスしてログインすることもできます。ログイン後、OpenShift Container Platform イメージをミラーリングできます。必要に応じて、このドキュメントの OpenShift Container Platform イメージリポジトリーのミラーリングまたは、非接続クラスターで使用する Operator カタログのミラーリングセクションを参照してください。

注記ストレージレイヤーの問題が原因でRed Hat OpenShift のミラーレジストリー で保存されたイメージに問題がある場合は、OpenShift Container Platform イメージを再ミラーリングするか、より安定したストレージにミラーレジストリーを再インストールできます。

3.6. Red Hat OpenShift のミラーレジストリーのアップグレード

次のコマンドを実行して、ローカルホストから Red Hat OpenShift のミラーレジストリー をアップグレードできます。

$ sudo ./mirror-registry upgrade

注記-

./mirror-registry upgradeフラグを使用して Red Hat OpenShift のミラーレジストリー をアップグレードするユーザーは、ミラーレジストリーの作成時に使用したものと同じクレデンシャルを含める必要があります。たとえば、Red Hat OpenShift のミラーレジストリー を--quayHostname<host_example_com>および--quayRoot<example_directory_name>でインストールした場合、ミラーレジストリーを適切にアップグレードするには、その文字列を含める必要があります。

-

3.6.1. Red Hat Openshift 導入用のミラーレジストリーのアンインストール

次のコマンドを実行して、ローカルホストから Red Hat Openshift 導入用のミラーレジストリー をアンインストールできます。

$ sudo ./mirror-registry uninstall -v \ --quayRoot <example_directory_name>

注記-

Red Hat Openshift 導入用のミラーレジストリー を削除しようとと、削除前にユーザーにプロンプトが表示されます。

--auto Approveを使用して、このプロンプトをスキップできます。 -

--quayRootフラグを指定して Red Hat Openshift 導入用のミラーレジストリー をインストールした場合には、アンインストール時に--quayRootフラグを含める必要があります。たとえば、 Red Hat Openshift 導入用のミラーレジストリー のインストールで--quay Rootexample_directory_nameを指定した場合には、 この文字列を追加して、ミラーレジストリーを適切にアンインストールする必要があります。

-

Red Hat Openshift 導入用のミラーレジストリー を削除しようとと、削除前にユーザーにプロンプトが表示されます。

3.6.2. Red Hat OpenShift フラグのミラーレジストリー

Red Hat Openshift 導入用のミラーレジストリー では、以下のフラグを使用できます。

| Flags | 説明 |

|---|---|

|

|

対話型プロンプトを無効にするブール値。 |

|

| Quay のインストール中に作成された init ユーザーのパスワード。空白を含まず、8 文字以上にする必要があります。 |

|

|

初期ユーザーのユーザー名を表示します。指定しない場合、デフォルトで |

|

|

クライアントがレジストリーへの接続に使用するミラーレジストリーの完全修飾ドメイン名。 |

|

|

|

|

|

SSH ID キーのパス。指定しない場合、デフォルトは |

|

|

SSL/TLS 公開鍵/証明書へのパス。デフォルトは |

|

|

|

|

|

HTTPS 通信に使用される SSL/TLS 秘密鍵へのパス。デフォルトは |

|

|

Quay のインストール先のホスト名。デフォルトは |

|

|

SSH に使用するターゲットホストのユーザー。デフォルトは |

|

| デバッグログと Ansible Playbook の出力を表示します。 |

|

| Red Hat Openshift 導入用のミラーレジストリー のバージョンを表示します。 |

-

システムのパブリック DNS 名がローカルホスト名と異なる場合は、

--quayHostnameを変更する必要があります。 -

--ssl Check Skipは、ミラーレジストリーがプロキシーの背後に設定されており、公開されているホスト名が内部の Quay ホスト名と異なる場合に使用されます。また、インストール中に、指定した Quay ホスト名に対して証明書の検証を行わない場合にも使用できます。

3.7. OpenShift Container Platform イメージリポジトリーのミラーリング

クラスターのインストールまたはアップグレード時に使用するために、OpenShift Container Platform イメージリポジトリーをお使いのレジストリーにミラーリングします。

前提条件

- ミラーホストがインターネットにアクセスできる。

- ネットワークが制限された環境で使用するミラーレジストリーを設定し、設定した証明書および認証情報にアクセスできる。

- Red Hat OpenShift Cluster Manager からプルシークレット をダウンロードし、ミラーリポジトリーへの認証を含めるようにこれを変更している。

Subject Alternative Name が設定されていない自己署名証明書を使用する場合は、この手順の

ocコマンドの前にGODEBUG=x509ignoreCN=0を追加する必要があります。この変数を設定しない場合、ocコマンドは以下のエラーを出して失敗します。x509: certificate relies on legacy Common Name field, use SANs or temporarily enable Common Name matching with GODEBUG=x509ignoreCN=0

手順

ミラーホストで以下の手順を実行します。

- OpenShift Container Platform ダウンロード ページを確認し、インストールする必要のある OpenShift Container Platform のバージョンを判別し、Repository Tags ページで対応するタグを判別します。

必要な環境変数を設定します。

リリースバージョンをエクスポートします。

$ OCP_RELEASE=<release_version>

<release_version>について、インストールする OpenShift Container Platform のバージョンに対応するタグを指定します (例:4.5.4)。ローカルレジストリー名とホストポートをエクスポートします。

$ LOCAL_REGISTRY='<local_registry_host_name>:<local_registry_host_port>'

<local_registry_host_name>については、ミラーレジストリーのレジストリードメイン名を指定し、<local_registry_host_port>については、コンテンツの送信に使用するポートを指定します。ローカルリポジトリー名をエクスポートします。

$ LOCAL_REPOSITORY='<local_repository_name>'

<local_repository_name>については、ocp4/openshift4などのレジストリーに作成するリポジトリーの名前を指定します。ミラーリングするリポジトリーの名前をエクスポートします。

$ PRODUCT_REPO='openshift-release-dev'

実稼働環境のリリースの場合には、

openshift-release-devを指定する必要があります。パスをレジストリープルシークレットにエクスポートします。

$ LOCAL_SECRET_JSON='<path_to_pull_secret>'

<path_to_pull_secret>については、作成したミラーレジストリーのプルシークレットの絶対パスおよびファイル名を指定します。リリースミラーをエクスポートします。

$ RELEASE_NAME="ocp-release"

実稼働環境のリリースについては、

ocp-releaseを指定する必要があります。サーバーのアーキテクチャーのタイプをエクスポートします (例:

x86_64)。$ ARCHITECTURE=<server_architecture>

ミラーリングされたイメージをホストするためにディレクトリーへのパスをエクスポートします。

$ REMOVABLE_MEDIA_PATH=<path> 1- 1

- 最初のスラッシュ (/) 文字を含む完全パスを指定します。

バージョンイメージをミラーレジストリーにミラーリングします。

ミラーホストがインターネットにアクセスできない場合は、以下の操作を実行します。

- リムーバブルメディアをインターネットに接続しているシステムに接続します。

ミラーリングするイメージおよび設定マニフェストを確認します。

$ oc adm release mirror -a ${LOCAL_SECRET_JSON} \ --from=quay.io/${PRODUCT_REPO}/${RELEASE_NAME}:${OCP_RELEASE}-${ARCHITECTURE} \ --to=${LOCAL_REGISTRY}/${LOCAL_REPOSITORY} \ --to-release-image=${LOCAL_REGISTRY}/${LOCAL_REPOSITORY}:${OCP_RELEASE}-${ARCHITECTURE} --dry-run-

直前のコマンドの出力の

imageContentSourcesセクション全体を記録します。ミラーの情報はミラーリングされたリポジトリーに一意であり、インストール時にimageContentSourcesセクションをinstall-config.yamlファイルに追加する必要があります。 イメージをリムーバブルメディア上のディレクトリーにミラーリングします。

$ oc adm release mirror -a ${LOCAL_SECRET_JSON} --to-dir=${REMOVABLE_MEDIA_PATH}/mirror quay.io/${PRODUCT_REPO}/${RELEASE_NAME}:${OCP_RELEASE}-${ARCHITECTURE}メディアをネットワークが制限された環境に移し、イメージをローカルコンテナーレジストリーにアップロードします。

$ oc image mirror -a ${LOCAL_SECRET_JSON} --from-dir=${REMOVABLE_MEDIA_PATH}/mirror "file://openshift/release:${OCP_RELEASE}*" ${LOCAL_REGISTRY}/${LOCAL_REPOSITORY} 1- 1

REMOVABLE_MEDIA_PATHの場合、イメージのミラーリング時に指定した同じパスを使用する必要があります。

ローカルコンテナーレジストリーがミラーホストに接続されている場合は、以下の操作を実行します。

以下のコマンドを使用して、リリースイメージをローカルレジストリーに直接プッシュします。

$ oc adm release mirror -a ${LOCAL_SECRET_JSON} \ --from=quay.io/${PRODUCT_REPO}/${RELEASE_NAME}:${OCP_RELEASE}-${ARCHITECTURE} \ --to=${LOCAL_REGISTRY}/${LOCAL_REPOSITORY} \ --to-release-image=${LOCAL_REGISTRY}/${LOCAL_REPOSITORY}:${OCP_RELEASE}-${ARCHITECTURE}このコマンドは、リリース情報をダイジェストとしてプルします。その出力には、クラスターのインストール時に必要な

imageContentSourcesデータが含まれます。直前のコマンドの出力の

imageContentSourcesセクション全体を記録します。ミラーの情報はミラーリングされたリポジトリーに一意であり、インストール時にimageContentSourcesセクションをinstall-config.yamlファイルに追加する必要があります。注記ミラーリングプロセス中にイメージ名に Quay.io のパッチが適用され、podman イメージにはブートストラップ仮想マシンのレジストリーに Quay.io が表示されます。

ミラーリングしたコンテンツをベースとしているインストールプログラムを作成するには、これを展開し、リリースに固定します。

ミラーホストがインターネットにアクセスできない場合は、以下のコマンドを実行します。

$ oc adm release extract -a ${LOCAL_SECRET_JSON} --command=openshift-install "${LOCAL_REGISTRY}/${LOCAL_REPOSITORY}:${OCP_RELEASE}"ローカルコンテナーレジストリーがミラーホストに接続されている場合は、以下のコマンドを実行します。

$ oc adm release extract -a ${LOCAL_SECRET_JSON} --command=openshift-install "${LOCAL_REGISTRY}/${LOCAL_REPOSITORY}:${OCP_RELEASE}-${ARCHITECTURE}"重要選択した OpenShift Container Platform バージョンに適したイメージを使用するには、ミラーリングされたコンテンツからインストールプログラムを展開する必要があります。

インターネット接続のあるマシンで、このステップを実行する必要があります。

非接続環境を使用している場合には、must-gather の一部として

--imageフラグを使用し、ペイロードイメージを参照します。

インストーラーでプロビジョニングされるインフラストラクチャーを使用するクラスターの場合は、以下のコマンドを実行します。

$ openshift-install

3.8. 非接続環境の Cluster Samples Operator

非接続環境で Cluster Samples Operator を設定するには、クラスターのインストール後に追加の手順を実行する必要があります。以下の情報を確認し、準備してください。

3.8.1. ミラーリングの Cluster Samples Operator のサポート

インストール時に、OpenShift Container Platform は imagestreamtag-to-image という名前の設定マップを openshift-cluster-samples-operator namespace に作成します。imagestreamtag-to-image 設定マップには、各イメージストリームタグのエントリー (設定されるイメージ) が含まれます。

設定マップの data フィールドの各エントリーのキーの形式は、<image_stream_name>_<image_stream_tag_name> です。

OpenShift Container Platform の非接続インストール時に、Cluster Samples Operator のステータスは Removed に設定されます。これを Managed に変更することを選択する場合、サンプルがインストールされます。

ネットワークが制限されている環境または切断されている環境でサンプルを使用するには、ネットワークの外部のサービスにアクセスする必要がある場合があります。サービスの例には、Github、Maven Central、npm、RubyGems、PyPi などがあります。クラスターサンプルオペレーターのオブジェクトが必要なサービスに到達できるようにするために、追加の手順を実行する必要がある場合があります。

この設定マップを、イメージストリームがインポートできるようにミラーリングする必要のあるイメージについての参照情報として使用できます。

-

Cluster Samples Operator が

Removedに設定される場合、ミラーリングされたレジストリーを作成するか、または使用する必要のある既存のミラーリングされたレジストリーを判別できます。 - 新しい設定マップをガイドとして使用し、ミラーリングされたレジストリーに必要なサンプルをミラーリングします。

-

Cluster Samples Operator 設定オブジェクトの

skippedImagestreams一覧に、ミラーリングされていないイメージストリームを追加します。 -

Cluster Samples Operator 設定オブジェクトの

samplesRegistryをミラーリングされたレジストリーに設定します。 -

次に、Cluster Samples Operator を

Managedに設定し、ミラーリングしたイメージストリームをインストールします。

3.9. 非接続クラスターで使用する Operator カタログのミラーリング

oc adm catalog mirror コマンドを使用して、Red Hat が提供するカタログまたはカスタムカタログの Operator コンテンツをコンテナーイメージレジストリーにミラーリングできます。ターゲットレジストリーは Docker v2-2 をサポートする必要があります。ネットワークが制限された環境のクラスターの場合、このレジストリーには、ネットワークが制限されたクラスターのインストール時に作成されたミラーレジストリーなど、クラスターにネットワークアクセスのあるレジストリーを使用できます。

OpenShift Container Platform クラスターの内部レジストリーはターゲットレジストリーとして使用できません。これは、ミラーリングプロセスで必要となるタグを使わないプッシュをサポートしないためです。

oc adm catalog mirror コマンドは、Red Hat が提供するインデックスイメージであるか、または独自のカスタムビルドされたインデックスイメージであるかに関係なく、ミラーリングプロセス中に指定されるインデックスイメージをターゲットレジストリーに自動的にミラーリングします。次に、ミラーリングされたインデックスイメージを使用して、Operator Lifecycle Manager (OLM) がミラーリングされたカタログを OpenShift Container Platform クラスターにロードできるようにするカタログソースを作成できます。

3.9.1. 前提条件

非接続クラスターで使用する Operator カタログのミラーリングには、以下の前提条件があります。

- ネットワークアクセスが無制限のワークステーション

-

podmanバージョン 1.9.3 以降。 デフォルトのカタログをフィルターリングまたはプルーニングして、演算子のサブセットのみを選択的にミラーリングする場合は、次のセクションを参照してください。

Red Hat が提供するカタログをミラーリングする場合は、ネットワークアクセスが無制限のワークステーションで以下のコマンドを実行し、

registry.redhat.ioで認証します。$ podman login registry.redhat.io

- Docker v2-2 をサポートするミラーレジストリーへのアクセス。

-

ミラーレジストリーで、ミラーリングされた Operator コンテンツの保存に使用する namespace を決定します。たとえば、

olm-mirrornamespace を作成できます。 - ミラーレジストリーにインターネットアクセスがない場合は、ネットワークアクセスが無制限のワークステーションにリムーバブルメディアを接続します。

registry.redhat.ioなどのプライベートレジストリーを使用している場合、後続の手順で使用するためにREG_CREDS環境変数をレジストリー認証情報のファイルパスに設定します。たとえばpodmanCLI の場合は、以下のようになります。$ REG_CREDS=${XDG_RUNTIME_DIR}/containers/auth.json

3.9.2. カタログコンテンツの抽出およびミラーリング

oc adm catalog mirror コマンドは、インデックスイメージのコンテンツを抽出し、ミラーリングに必要なマニフェストを生成します。コマンドのデフォルト動作で、マニフェストを生成し、インデックスイメージからのすべてのイメージコンテンツを、インデックスイメージと同様にミラーレジストリーに対して自動的にミラーリングします。

または、ミラーレジストリーが完全に非接続または エアギャップ環境のホスト上にある場合、最初にコンテンツをリムーバブルメディアにミラーリングし、メディアを非接続環境に移行してから、メディアからレジストリーにコンテンツをレジストリーに対してミラーリングできます。

3.9.2.1. 同じネットワーク上のレジストリーへのカタログコンテンツのミラーリング

ミラーレジストリーがネットワークアクセスが無制限のワークステーションと同じネットワーク上に置かれている場合は、ワークステーションで以下のアクションを実行します。

手順

ミラーレジストリーに認証が必要な場合は、以下のコマンドを実行してレジストリーにログインします。

$ podman login <mirror_registry>

以下のコマンドを実行して、コンテンツをミラーレジストリーに対して抽出し、ミラーリングします。

$ oc adm catalog mirror \ <index_image> \ 1 <mirror_registry>:<port>/<namespace> \ 2 [-a ${REG_CREDS}] \ 3 [--insecure] \ 4 [--index-filter-by-os='<platform>/<arch>'] \ 5 [--manifests-only] 6- 1

- ミラーリングするカタログのインデックスイメージを指定します。たとえば、これは以前に作成したプルーニングされたインデックスイメージ、または

registry.redhat.io/redhat/redhat-operator-index:v4.9などのデフォルトカタログのソースインデックスイメージのいずれかである可能性があります。 - 2

- Operator コンテンツをミラーリングするターゲットレジストリーおよび namespace の完全修飾ドメイン名 (FQDN) を指定します。ここで、

<namespace>はレジストリーの既存の namespace です。たとえば、olm-mirrornamespace を作成し、ミラーリングされたすべてのコンテンツをプッシュすることができます。 - 3

- オプション: 必要な場合は、レジストリー認証情報ファイルの場所を指定します。

registry.redhat.ioには、{REG_CREDS}が必要です。 - 4

- オプション: ターゲットレジストリーの信頼を設定しない場合は、

--insecureフラグを追加します。 - 5

- オプション: 複数のバリアントが利用可能な場合に、選択するインデックスイメージのプラットフォームおよびアーキテクチャーを指定します。イメージは

'<platform>/<arch>[/<variant>]'として渡されます。これはインデックスで参照されるイメージには適用されません。使用できる値は、linux/amd64、linux/ppc64le、linux/s390xおよび.*です。 - 6

- オプション: ミラーリングに必要なマニフェストのみを生成し、実際にはイメージコンテンツをレジストリーにミラーリングしません。このオプションは、ミラーリングする内容を確認するのに役立ちます。また、パッケージのサブセットのみが必要な場合に、マッピングの一覧に変更を加えることができます。次に、

mapping.txtファイルをoc image mirrorコマンドで使用し、後のステップでイメージの変更済みの一覧をミラーリングできます。このフラグは、カタログからのコンテンツの高度で選択可能なミラーリングにのみ使用することが意図されています。opm index pruneをインデックスイメージをプルーニングするために以前にしている場合、これはほとんどのカタログ管理のユースケースに適しています。

出力例

src image has index label for database path: /database/index.db using database path mapping: /database/index.db:/tmp/153048078 wrote database to /tmp/153048078 1 ... wrote mirroring manifests to manifests-redhat-operator-index-1614211642 2

注記Red Hat Quay では、ネストされたリポジトリーはサポート対象外です。その結果、

oc adm catalog mirrorコマンドを実行すると、401unauthorized エラーで失敗します。回避策として、oc adm catalog mirrorコマンドを実行するときに--max-components = 2オプションを使用して、ネストされたリポジトリーの作成を無効にすることができます。この回避策の詳細は Unauthorized error thrown while using catalog mirror command with Quay registry のナレッジソリューションを参照してください。

3.9.2.2. カタログコンテンツをエアギャップされたレジストリーへのミラーリング

ミラーレジストリーが完全に切断された、またはエアギャップのあるホスト上にある場合は、次のアクションを実行します。

手順

ネットワークアクセスが無制限のワークステーションで以下のコマンドを実行し、コンテンツをローカルファイルにミラーリングします。

$ oc adm catalog mirror \ <index_image> \ 1 file:///local/index \ 2 -a ${REG_CREDS} \ 3 --insecure \ 4 --index-filter-by-os='<platform>/<arch>' 5- 1

- ミラーリングするカタログのインデックスイメージを指定します。たとえば、これは以前に作成したプルーニングされたインデックスイメージ、または

registry.redhat.io/redhat/redhat-operator-index:v4.9などのデフォルトカタログのソースインデックスイメージのいずれかである可能性があります。 - 2

- 現在のディレクトリーのローカルファイルにミラーリングするコンテンツを指定します。

- 3

- オプション: 必要な場合は、レジストリー認証情報ファイルの場所を指定します。

- 4

- オプション: ターゲットレジストリーの信頼を設定しない場合は、

--insecureフラグを追加します。 - 5

- オプション: 複数のバリアントが利用可能な場合に、選択するインデックスイメージのプラットフォームおよびアーキテクチャーを指定します。イメージは

'<platform>/<arch>[/<variant>]'として指定されます。これはインデックスで参照されるイメージには適用されません。使用できる値は、linux/amd64、linux/ppc64le、linux/s390xおよび.*です。

出力例

... info: Mirroring completed in 5.93s (5.915MB/s) wrote mirroring manifests to manifests-my-index-1614985528 1 To upload local images to a registry, run: oc adm catalog mirror file://local/index/myrepo/my-index:v1 REGISTRY/REPOSITORY 2

このコマンドにより、現在のディレクトリーに

v2/ディレクトリーが作成されます。-

v2/ディレクトリーをリムーバブルメディアにコピーします。 - メディアを物理的に削除して、これをミラーレジストリーにアクセスできる非接続環境のホストに割り当てます。

ミラーレジストリーに認証が必要な場合は、非接続環境のホストで以下のコマンドを実行し、レジストリーにログインします。

$ podman login <mirror_registry>

v2/ディレクトリーを含む親ディレクトリーから以下のコマンドを実行し、ローカルファイルからミラーレジストリーにイメージをアップロードします。$ oc adm catalog mirror \ file://local/index/<repo>/<index_image>:<tag> \ 1 <mirror_registry>:<port>/<namespace> \ 2 -a ${REG_CREDS} \ 3 --insecure \ 4 --index-filter-by-os='<platform>/<arch>' 5- 1

- 直前のコマンド出力の

file://パスを指定します。 - 2

- Operator コンテンツをミラーリングするターゲットレジストリーおよび namespace の完全修飾ドメイン名 (FQDN) を指定します。ここで、

<namespace>はレジストリーの既存の namespace です。たとえば、olm-mirrornamespace を作成し、ミラーリングされたすべてのコンテンツをプッシュすることができます。 - 3

- オプション: 必要な場合は、レジストリー認証情報ファイルの場所を指定します。

- 4

- オプション: ターゲットレジストリーの信頼を設定しない場合は、

--insecureフラグを追加します。 - 5

- オプション: 複数のバリアントが利用可能な場合に、選択するインデックスイメージのプラットフォームおよびアーキテクチャーを指定します。イメージは

'<platform>/<arch>[/<variant>]'として指定されます。これはインデックスで参照されるイメージには適用されません。使用できる値は、linux/amd64、linux/ppc64le、linux/s390xおよび.*です。

注記Red Hat Quay では、ネストされたリポジトリーはサポート対象外です。その結果、

oc adm catalog mirrorコマンドを実行すると、401unauthorized エラーで失敗します。回避策として、oc adm catalog mirrorコマンドを実行するときに--max-components = 2オプションを使用して、ネストされたリポジトリーの作成を無効にすることができます。この回避策の詳細は Unauthorized error thrown while using catalog mirror command with Quay registry のナレッジソリューションを参照してください。oc adm catalogmirrorコマンドを再度実行します。新しくミラーリングされたインデックスイメージをソースとして使用し、前の手順で使用したのと同じミラーレジストリーの namespace をターゲットとして使用します。$ oc adm catalog mirror \ <mirror_registry>:<port>/<index_image> \ <mirror_registry>:<port>/<namespace> \ --manifests-only \1 [-a ${REG_CREDS}] \ [--insecure]- 1

- コマンドがミラーリングされたすべてのコンテンツを再度コピーしないように、このステップには

--manifests-onlyフラグが必要です。

重要前のステップで生成された

imageContentSourcePolicy.yamlファイルのイメージマッピングをローカルパスから有効なミラー位置に更新する必要があるため、このステップが必要です。そうしないと、後のステップでimageContentSourcePolicyオブジェクトを作成するときにエラーが発生します。

カタログのミラーリング後、残りのクラスターインストールを続行できます。クラスターのインストールが正常に完了した後に、この手順から manifests ディレクトリーを指定して ImageContentSourcePolicy および CatalogSource オブジェクトを作成する必要があります。これらのオブジェクトは、OperatorHub からの Operator のインストールを有効にするために必要になります。

3.9.3. 生成されたマニフェスト

Operator カタログコンテンツをミラーレジストリーにミラーリングした後に、現在のディレクトリーに manifests ディレクトリーが生成されます。

同じネットワークのレジストリーにコンテンツをミラーリングする場合、ディレクトリー名は以下のパターンになります。

manifests-<index_image_name>-<random_number>

直前のセクションで非接続ホストのレジストリーにコンテンツをミラーリングする場合、ディレクトリー名は以下のパターンになります。

manifests-index/<namespace>/<index_image_name>-<random_number>

manifests ディレクトリー名は、後続の手順で参照されます。

manifests ディレクトリーには以下のファイルが含まれており、これらの一部にはさらに変更が必要になる場合があります。

catalogSource.yamlファイルは、インデックスイメージタグおよび他の関連するメタデータで事前に設定されるCatalogSourceオブジェクトの基本的な定義です。このファイルは、カタログソースをクラスターに追加するためにそのまま使用したり、変更したりできます。重要ローカルファイルにコンテンツをミラーリングする場合は、

catalogSource.yamlファイルを変更してmetadata.nameフィールドからバックスラッシュ (/) 文字を削除する必要があります。または、オブジェクトの作成を試みると、invalid resource name (無効なリソース名) を示すエラーを出して失敗します。これにより、

imageContentSourcePolicy.yamlファイルはImageContentSourcePolicyオブジェクトを定義します。このオブジェクトは、ノードを Operator マニフェストおよびミラーリングされたレジストリーに保存されるイメージ参照間で変換できるように設定します。注記クラスターが

ImageContentSourcePolicyオブジェクトを使用してリポジトリーのミラーリングを設定する場合、ミラーリングされたレジストリーにグローバルプルシークレットのみを使用できます。プロジェクトにプルシークレットを追加することはできません。mapping.txtファイルには、すべてのソースイメージが含まれ、これはそれらのイメージをターゲットレジストリー内のどこにマップするかを示します。このファイルはoc image mirrorコマンドと互換性があり、ミラーリング設定をさらにカスタマイズするために使用できます。重要ミラーリングのプロセスで

--manifests-onlyフラグを使用しており、ミラーリングするパッケージのサブセットをさらにトリミングするには、mapping.txtファイルの変更およびoc image mirrorコマンドでのファイルの使用について、OpenShift Container Platform 4.7 ドキュメントの Package Manifest Format カタログイメージのミラーリング の手順を参照してください。

3.9.4. インストール後の要件

カタログのミラーリング後、残りのクラスターインストールを続行できます。クラスターのインストールが正常に完了した後に、この手順から manifests ディレクトリーを指定して ImageContentSourcePolicy および CatalogSource オブジェクトを作成する必要があります。これらのオブジェクトは、OperatorHub からの Operator のインストールを設定し、有効にするために必要です。

3.10. 次のステップ

- VMware vSphere、ベアメタル、または Amazon Web Services など、ネットワークが制限された環境でプロビジョニングするインフラストラクチャーにクラスターをインストールします。

3.11. 関連情報

- must-gather の使用についての詳細は、特定の機能についてのデータの収集 について参照してください。

第4章 AWS へのインストール

4.1. AWS へのインストールの準備

4.1.1. 前提条件

- OpenShift Container Platform のインストールおよび更新 プロセスについての詳細を確認している。

- クラスターンストール方法の選択およびそのユーザー向けの準備 を確認している。

4.1.2. OpenShift Container Platform OpenStack の AWS へのインストールについての要件

OpenShift Container Platform を Amazon Web Services (AWS) にインストールする前に、AWS アカウントを作成する必要があります。アカウント、アカウントの制限、アカウントのパーミッション、IAM ユーザーセットアップ、およびサポートされている AWS リージョンの設定についての詳細は、AWS アカウントの設定 を参照してください。

ご使用の環境でクラウドアイデンティティーおよびアクセス管理 (IAM) API にアクセスできない場合や、管理者レベルの認証情報シークレットを kube-system namespace に保存することを望まない場合は、Amazon Web Services Security Token Service (AWS STS) を使用するための Cloud Credential Operator (CCO) の設定 を含む、他のオプションについて AWS の IAM の手動作成 を参照してください。

4.1.3. AWS に OpenShift Container Platform をインストールする方法の選択

OpenShift Container Platform をインストーラーまたはユーザーによってプロビジョニングされるインフラストラクチャーにインストールすることができます。デフォルトのインストールタイプは、インストーラーでプロビジョニングされるインフラストラクチャーを使用します。この場合、インストールプログラムがクラスターの基礎となるインフラストラクチャーをプロビジョニングします。OpenShift Container Platform は、ユーザーによってプロビジョニングされるインフラストラクチャーにインストールすることもできます。インストールプログラムがプロビジョニングするインフラストラクチャーを使用しない場合は、クラスターリソースをユーザー自身で管理し、維持する必要があります。

インストーラーおよびユーザーによってプロビジョニングされるインストールプロセスの詳細は、インストールプロセス を参照してください。

4.1.3.1. インストーラーでプロビジョニングされるインフラストラクチャーへのクラスターのインストール

以下の方法のいずれかを使用して、OpenShift Container Platform インストールプログラムでプロビジョニングされる AWS インフラストラクチャーに、クラスターをインストールできます。

- クラスターの AWS へのクイックインストール: OpenShift Container Platform インストールプログラムでプロビジョニングされる AWS インフラストラクチャーに OpenShift Container Platform をインストールできます。デフォルトの設定オプションを使用して、クラスターを迅速にインストールできます。

- カスタマイズされたクラスターの AWS へのインストール: インストールプログラムがプロビジョニングする AWS インフラストラクチャーにカスタマイズされたクラスターをインストールできます。インストールプログラムは、インストールの段階で一部のカスタマイズを適用できるようにします。その他の数多くのカスタマイズオプションは、インストール後 に利用できます。

- ネットワークのカスタマイズを使用したクラスターの AWS へのインストール: インストール時に OpenShift Container Platform ネットワーク設定をカスタマイズすることで、クラスターが既存の IP アドレスの割り当てと共存でき、ネットワーク要件に準拠することができます。

- ネットワークが制限された環境での AWS へのクラスターのインストール: インストールリリースコンテンツの内部ミラーを使用して、インストーラーでプロビジョニングされる AWS インフラストラクチャーに OpenShift Container Platform をインストールできます。この方法を使用して、ソフトウェアコンポーネントを取得するためにアクティブなインターネット接続を必要としないクラスターをインストールできます。

- クラスターの既存の Virtual Private Cloud へのインストール: OpenShift Container Platform を既存の AWS Virtual Private Cloud (VPC) にインストールできます。このインストール方法は、新規アカウントまたはインフラストラクチャーを作成する際の制限など、会社のガイドラインによる制約がある場合に使用できます。

- プライベートクラスターの既存の VPC へのインストール: プライベートクラスターを既存の AWS VPC にインストールできます。この方法を使用して、インターネット上に表示されない内部ネットワークに OpenShift Container Platform をデプロイすることができます。

- クラスターの AWS の government またはシークレットリージョンへのインストール: OpenShift Container Platform は、機密ワークロードをクラウドで実行する必要のある連邦、州、地方の米国の各種の政府機関、請負業者、教育機関、およびその他の米国の顧客向けに設計されている AWS リージョンにデプロイできます。

4.1.3.2. ユーザーによってプロビジョニングされるインフラストラクチャーへのクラスターのインストール

以下の方法のいずれかを使用して、独自にプロビジョニングする AWS インフラストラクチャーにクラスターをインストールできます。

- クラスターの各自でプロビジョニングする AWS インフラストラクチャーへのインストール: OpenShift Container Platform を、プロビジョニングする AWS インフラストラクチャーにインストールできます。提供される CloudFormation テンプレートを使用して、OpenShift Container Platform インストールに必要な各コンポーネントを表す AWS リソースのスタックを作成できます。

- ユーザーによってプロビジョニングされるインフラストラクチャーを使用したネットワークが制限された環境での AWS へのクラスターのインストール: インストールリリースコンテンツの内部ミラーを使用して、独自に提供する AWS インフラストラクチャーに OpenShift Container Platform をインストールできます。この方法を使用して、ソフトウェアコンポーネントを取得するためにアクティブなインターネット接続を必要としないクラスターをインストールできます。また、このインストール方法を使用して、クラスターが外部コンテンツに対する組織の制御の条件を満たすコンテナーイメージのみを使用するようにすることもできます。ミラーリングされたコンテンツを使用して OpenShift Container Platform をインストールすることは可能ですが、クラスターが AWS API を使用するにはインターネットへのアクセスが必要です。

4.1.4. 次のステップ

4.2. AWS アカウントの設定

OpenShift Container Platform をインストールする前に、Amazon Web Services (AWS) アカウントを設定する必要があります。

4.2.1. Route 53 の設定

OpenShift Container Platform をインストールするには、使用する Amazon Web Services (AWS) アカウントに、Route 53 サービスの専用のパブリックホストゾーンが必要になります。このゾーンはドメインに対する権威を持っている必要があります。Route 53 サービスは、クラスターへの外部接続のためのクラスターの DNS 解決および名前検索を提供します。

手順

ドメイン、またはサブドメイン、およびレジストラーを特定します。既存のドメインおよびレジストラーを移行するか、または AWS または他のソースから新規のものを取得できます。

注記AWS で新規ドメインを購入する場合、関連する DNS の変更が伝播するのに時間がかかります。AWS 経由でドメインを購入する方法についての詳細は、AWS ドキュメントの Registering Domain Names Using Amazon Route 53 を参照してください。

- 既存のドメインおよびレジストラーを使用している場合、その DNS を AWS に移行します。AWS ドキュメントの Making Amazon Route 53 the DNS Service for an Existing Domain を参照してください。

ドメインまたはサブドメインのパブリックホストゾーンを作成します。AWS ドキュメントの Creating a Public Hosted Zone を参照してください。

openshiftcorp.comなどのルートドメインや、clusters.openshiftcorp.comなどのサブドメインを使用します。- ホストゾーンレコードから新規の権威ネームサーバーを抽出します。AWS ドキュメントの Getting the Name Servers for a Public Hosted Zone を参照してください。

- ドメインが使用する AWS Route 53 ネームサーバーのレジストラーレコードを更新します。たとえば、別のアカウントを使ってドメインを Route 53 サービスに登録している場合は、AWS ドキュメントの Adding or Changing Name Servers or Glue Records のトピックを参照してください。

- サブドメインを使用している場合は、その委任レコードを親ドメインに追加します。これにより、サブドメインの Amazon Route 53 の責任が付与されます。親ドメインの DNS プロバイダーによって要約された委任手順に従います。ハイレベルの手順の例については、AWS ドキュメントの Creating a subdomain that uses Amazon Route 53 as the DNS service without migrating the parent domain を参照してください。

4.2.1.1. AWS Route 53 の Ingress Operator エンドポイント設定

Amazon Web Services (AWS) GovCloud (US) US-West または US-East リージョンのいずれかにインストールする場合、Ingress Operator は Route53 およびタグ付けする API クライアントに us-gov-west-1 リージョンを使用します。

Ingress Operator は、タグ付けするエンドポイントが 文字列 'us-gov-east-1' を含むように設定される場合、タグ付けする API エンドポイントとして https://tagging.us-gov-west-1.amazonaws.com を使用します。

AWS GovCloud (US) エンドポイントについての詳細は、GovCloud (US) についての AWS ドキュメントの Service Endpoints を参照してください。

us-gov-east-1 リージョンにインストールする場合、プライベート、非接続インストールは AWS GovCloud ではサポートされません。

Route 53 設定の例

platform:

aws:

region: us-gov-west-1

serviceEndpoints:

- name: ec2

url: https://ec2.us-gov-west-1.amazonaws.com

- name: elasticloadbalancing

url: https://elasticloadbalancing.us-gov-west-1.amazonaws.com

- name: route53

url: https://route53.us-gov.amazonaws.com 1

- name: tagging

url: https://tagging.us-gov-west-1.amazonaws.com 2

- 1

- Route 53 は、AWS GovCloud (US) リージョンの両方で

https://route53.us-gov.amazonaws.comにデフォルト設定されます。 - 2

- US-West リージョンのみにタグ付けするためのエンドポイントがあります。クラスターが別のリージョンにある場合は、このパラメーターを省略します。

4.2.2. AWS アカウントの制限

OpenShift Container Platform クラスターは数多くの Amazon Web Services (AWS) コンポーネントを使用し、デフォルトの サービス制限 は、OpenShift Container Platform クラスターをインストールする機能に影響を与えます。特定のクラスター設定を使用し、クラスターを特定の AWS リージョンにデプロイするか、またはアカウントを使って複数のクラスターを実行する場合、AWS アカウントの追加リソースを要求することが必要になる場合があります。

以下の表は、OpenShift Container Platform クラスターのインストールおよび実行機能に影響を与える可能性のある AWS コンポーネントの制限を要約しています。

| コンポーネント | デフォルトで利用できるクラスターの数 | デフォルトの AWS の制限 | 説明 |

|---|---|---|---|

| インスタンスの制限 | 変動あり。 | 変動あり。 | デフォルトで、各クラスターは以下のインスタンスを作成します。

これらのインスタンスタイプの数は、新規アカウントのデフォルト制限内の値です。追加のワーカーノードをデプロイし、自動スケーリングを有効にし、大規模なワークロードをデプロイするか、または異なるインスタンスタイプを使用するには、アカウントの制限を見直し、クラスターが必要なマシンをデプロイできることを確認します。

ほとんどのリージョンでは、ブートストラップおよびワーカーマシンは |

| Elastic IP (EIP) | 0 - 1 | アカウントごとに 5 つの EIP | クラスターを高可用性設定でプロビジョニングするために、インストールプログラムはそれぞれの リージョン内のアベイラビリティーゾーン にパブリックおよびプライベートのサブネットを作成します。各プライベートサブネットには NAT ゲートウェイ が必要であり、各 NAT ゲートウェイには別個の Elastic IP が必要です。AWS リージョンマップ を確認して、各リージョンにあるアベイラビリティーゾーンの数を判別します。デフォルトの高可用性を利用するには、少なくとも 3 つのアベイラビリティーゾーンがあるリージョンにクラスターをインストールします。アベイラビリティーゾーンが 6 つ以上あるリージョンにクラスターをインストールするには、EIP 制限を引き上げる必要があります。 重要

|

| Virtual Private Cloud (VPC) | 5 | リージョンごとに 5 つの VPC | 各クラスターは独自の VPC を作成します。 |

| Elastic Load Balancing (ELB/NLB) | 3 | リージョンごとに 20 |

デフォルトで、各クラスターは、マスター API サーバーの内部および外部のネットワークロードバランサーおよびルーターの単一の Classic Elastic Load Balancer を作成します。追加の Kubernetes |

| NAT ゲートウェイ | 5 | アベイラビリティゾーンごとに 5 つ | クラスターは各アベイラビリティーゾーンに 1 つの NAT ゲートウェイをデプロイします。 |

| Elastic Network Interface (ENI) | 12 以上 | リージョンごとに 350 |

デフォルトのインストールは 21 の ENI を作成し、リージョンの各アベイラビリティーゾーンに 1 つの ENI を作成します。たとえば、 追加の ENI が、クラスターの使用およびデプロイされたワークロード別に作成される追加のマシンおよび Elastic Load Balancer について作成されます。 |

| VPC ゲートウェイ | 20 | アカウントごとに 20 | 各クラスターは、S3 アクセス用の単一の VPC ゲートウェイを作成します。 |

| S3 バケット | 99 | アカウントごとに 100 バケット | インストールプロセスでは 1 つの一時的なバケットを作成し、各クラスターのレジストリーコンポーネントがバケットを作成するため、AWS アカウントごとに 99 の OpenShift Container Platform クラスターのみを作成できます。 |

| セキュリティーグループ | 250 | アカウントごとに 2,500 | 各クラスターは、10 の個別のセキュリティーグループを作成します。 |

4.2.3. IAM ユーザーに必要な AWS パーミッション

ベースクラスターリソースを削除するには、IAM ユーザーが領域 us-east-1 にアクセス許可 tag:GetResources を持っている必要があります。AWS API 要件の一部として、OpenShift Container Platform インストールプログラムはこのリージョンでさまざまなアクションを実行します。

AdministratorAccess ポリシーを、Amazon Web Services (AWS) で作成する IAM ユーザーに割り当てる場合、そのユーザーには必要なパーミッションすべてを付与します。OpenShift Container Platform クラスターのすべてのコンポーネントをデプロイするために、IAM ユーザーに以下のパーミッションが必要になります。

例4.1 インストールに必要な EC2 パーミッション

-

ec2:AuthorizeSecurityGroupEgress -

ec2:AuthorizeSecurityGroupIngress -

ec2:CopyImage -

ec2:CreateNetworkInterface -

ec2:AttachNetworkInterface -

ec2:CreateSecurityGroup -

ec2:CreateTags -

ec2:CreateVolume -

ec2:DeleteSecurityGroup -

ec2:DeleteSnapshot -

ec2:DeleteTags -

ec2:DeregisterImage -

ec2:DescribeAccountAttributes -

ec2:DescribeAddresses -

ec2:DescribeAvailabilityZones -

ec2:DescribeDhcpOptions -

ec2:DescribeImages -

ec2:DescribeInstanceAttribute -

ec2:DescribeInstanceCreditSpecifications -

ec2:DescribeInstances -

ec2:DescribeInstanceTypes -

ec2:DescribeInternetGateways -

ec2:DescribeKeyPairs -

ec2:DescribeNatGateways -

ec2:DescribeNetworkAcls -

ec2:DescribeNetworkInterfaces -

ec2:DescribePrefixLists -

ec2:DescribeRegions -

ec2:DescribeRouteTables -

ec2:DescribeSecurityGroups -

ec2:DescribeSubnets -

ec2:DescribeTags -

ec2:DescribeVolumes -

ec2:DescribeVpcAttribute -

ec2:DescribeVpcClassicLink -

ec2:DescribeVpcClassicLinkDnsSupport -

ec2:DescribeVpcEndpoints -

ec2:DescribeVpcs -

ec2:GetEbsDefaultKmsKeyId -

ec2:ModifyInstanceAttribute -

ec2:ModifyNetworkInterfaceAttribute -

ec2:RevokeSecurityGroupEgress -

ec2:RevokeSecurityGroupIngress -

ec2:RunInstances -

ec2:TerminateInstances

例4.2 インストール時のネットワークリソースの作成に必要なパーミッション

-

ec2:AllocateAddress -

ec2:AssociateAddress -

ec2:AssociateDhcpOptions -

ec2:AssociateRouteTable -

ec2:AttachInternetGateway -

ec2:CreateDhcpOptions -

ec2:CreateInternetGateway -

ec2:CreateNatGateway -

ec2:CreateRoute -

ec2:CreateRouteTable -

ec2:CreateSubnet -

ec2:CreateVpc -

ec2:CreateVpcEndpoint -

ec2:ModifySubnetAttribute -

ec2:ModifyVpcAttribute

既存の VPC を使用する場合、アカウントではネットワークリソースの作成にこれらのパーミッションを必要としません。

例4.3 インストールに必要な Elastic Load Balancing (ELB) のパーミッション

-

elasticloadbalancing:AddTags -

elasticloadbalancing:ApplySecurityGroupsToLoadBalancer -

elasticloadbalancing:AttachLoadBalancerToSubnets -

elasticloadbalancing:ConfigureHealthCheck -

elasticloadbalancing:CreateLoadBalancer -

elasticloadbalancing:CreateLoadBalancerListeners -

elasticloadbalancing:DeleteLoadBalancer -

elasticloadbalancing:DeregisterInstancesFromLoadBalancer -

elasticloadbalancing:DescribeInstanceHealth -

elasticloadbalancing:DescribeLoadBalancerAttributes -

elasticloadbalancing:DescribeLoadBalancers -

elasticloadbalancing:DescribeTags -

elasticloadbalancing:ModifyLoadBalancerAttributes -

elasticloadbalancing:RegisterInstancesWithLoadBalancer -

elasticloadbalancing:SetLoadBalancerPoliciesOfListener

例4.4 インストールに必要な Elastic Load Balancing (ELBv2) のパーミッション

-

elasticloadbalancing:AddTags -

elasticloadbalancing:CreateListener -

elasticloadbalancing:CreateLoadBalancer -

elasticloadbalancing:CreateTargetGroup -

elasticloadbalancing:DeleteLoadBalancer -

elasticloadbalancing:DeregisterTargets -

elasticloadbalancing:DescribeListeners -

elasticloadbalancing:DescribeLoadBalancerAttributes -

elasticloadbalancing:DescribeLoadBalancers -

elasticloadbalancing:DescribeTargetGroupAttributes -

elasticloadbalancing:DescribeTargetHealth -

elasticloadbalancing:ModifyLoadBalancerAttributes -

elasticloadbalancing:ModifyTargetGroup -

elasticloadbalancing:ModifyTargetGroupAttributes -

elasticloadbalancing:RegisterTargets

例4.5 インストールに必要な IAM パーミッション

-

iam:AddRoleToInstanceProfile -

iam:CreateInstanceProfile -

iam:CreateRole -

iam:DeleteInstanceProfile -

iam:DeleteRole -

iam:DeleteRolePolicy -

iam:GetInstanceProfile -

iam:GetRole -

iam:GetRolePolicy -

iam:GetUser -

iam:ListInstanceProfilesForRole -

iam:ListRoles -

iam:ListUsers -

iam:PassRole -

iam:PutRolePolicy -

iam:RemoveRoleFromInstanceProfile -

iam:SimulatePrincipalPolicy -

iam:TagRole

AWS アカウントに Elastic Load Balancer (ELB) を作成していない場合、IAM ユーザーには iam:CreateServiceLinkedRole パーミッションも必要です。

例4.6 インストールに必要な Route 53 パーミッション

-

route53:ChangeResourceRecordSets -

route53:ChangeTagsForResource -

route53:CreateHostedZone -

route53:DeleteHostedZone -

route53:GetChange -

route53:GetHostedZone -

route53:ListHostedZones -

route53:ListHostedZonesByName -

route53:ListResourceRecordSets -

route53:ListTagsForResource -

route53:UpdateHostedZoneComment

例4.7 インストールに必要な S3 パーミッション

-

s3:CreateBucket -

s3:DeleteBucket -

s3:GetAccelerateConfiguration -

s3:GetBucketAcl -

s3:GetBucketCors -

s3:GetBucketLocation -

s3:GetBucketLogging -

s3:GetBucketObjectLockConfiguration -

s3:GetBucketReplication -

s3:GetBucketRequestPayment -

s3:GetBucketTagging -

s3:GetBucketVersioning -

s3:GetBucketWebsite -

s3:GetEncryptionConfiguration -

s3:GetLifecycleConfiguration -

s3:GetReplicationConfiguration -

s3:ListBucket -

s3:PutBucketAcl -

s3:PutBucketTagging -

s3:PutEncryptionConfiguration

例4.8 クラスター Operator が必要とする S3 パーミッション

-

s3:DeleteObject -

s3:GetObject -

s3:GetObjectAcl -

s3:GetObjectTagging -

s3:GetObjectVersion -

s3:PutObject -

s3:PutObjectAcl -

s3:PutObjectTagging

例4.9 ベースクラスターリソースの削除に必要なパーミッション

-

autoscaling:DescribeAutoScalingGroups -

ec2:DeleteNetworkInterface -

ec2:DeleteVolume -

elasticloadbalancing:DeleteTargetGroup -

elasticloadbalancing:DescribeTargetGroups -

iam:DeleteAccessKey -

iam:DeleteUser -

iam:ListAttachedRolePolicies -

iam:ListInstanceProfiles -

iam:ListRolePolicies -

iam:ListUserPolicies -

s3:DeleteObject -

s3:ListBucketVersions -

tag:GetResources

例4.10 ネットワークリソースの削除に必要なパーミッション

-

ec2:DeleteDhcpOptions -

ec2:DeleteInternetGateway -

ec2:DeleteNatGateway -

ec2:DeleteRoute -

ec2:DeleteRouteTable -

ec2:DeleteSubnet -

ec2:DeleteVpc -

ec2:DeleteVpcEndpoints -

ec2:DetachInternetGateway -

ec2:DisassociateRouteTable -

ec2:ReleaseAddress -

ec2:ReplaceRouteTableAssociation

既存の VPC を使用する場合、アカウントではネットワークリソースの削除にこれらのパーミッションを必要としません。代わりに、アカウントではネットワークリソースの削除に tag:UntagResources パーミッションのみが必要になります。

例4.11 共有インスタン出力ルが割り当てられたクラスターを削除するために必要なパーミッション

-

iam:UntagRole

例4.12 マニフェストの作成に必要な追加の IAM および S3 パーミッション

-

iam:DeleteAccessKey -

iam:DeleteUser -

iam:DeleteUserPolicy -

iam:GetUserPolicy -

iam:ListAccessKeys -

iam:PutUserPolicy -

iam:TagUser -

s3:PutBucketPublicAccessBlock -

s3:GetBucketPublicAccessBlock -

s3:PutLifecycleConfiguration -

s3:HeadBucket -

s3:ListBucketMultipartUploads -

s3:AbortMultipartUpload

クラウドプロバイダーのクレデンシャルをミントモードで管理している場合に、IAM ユーザーには iam:CreateAccessKey と iam:CreateUser 権限も必要です。

例4.13 インスタンスのオプションのパーミッションおよびインストールのクォータチェック

-

ec2:DescribeInstanceTypeOfferings -

servicequotas:ListAWSDefaultServiceQuotas

4.2.4. IAM ユーザーの作成

各 Amazon Web Services (AWS) アカウントには、アカウントの作成に使用するメールアドレスに基づく root ユーザーアカウントが含まれます。これは高度な権限が付与されたアカウントであり、初期アカウントにのみ使用し、請求設定また初期のユーザーセットの作成およびアカウントのセキュリティー保護のために使用することが推奨されています。

OpenShift Container Platform をインストールする前に、セカンダリー IAM 管理ユーザーを作成します。AWS ドキュメントの Creating an IAM User in Your AWS Account 手順を実行する際に、以下のオプションを設定します。

手順

-

IAM ユーザー名を指定し、

Programmatic accessを選択します。 AdministratorAccessポリシーを割り当て、アカウントにクラスターを作成するために十分なパーミッションがあることを確認します。このポリシーはクラスターに対し、各 OpenShift Container Platform コンポーネントに認証情報を付与する機能を提供します。クラスターはコンポーネントに対し、それらが必要とする認証情報のみを付与します。注記必要なすべての AWS パーミッションを付与し、これをユーザーに割り当てるポリシーを作成することは可能ですが、これは優先されるオプションではありません。クラスターには追加の認証情報を個別コンポーネントに付与する機能がないため、同じ認証情報がすべてのコンポーネントによって使用されます。

- オプション: タグを割り当て、メタデータをユーザーに追加します。

-

指定したユーザー名に

AdministratorAccessポリシーが付与されていることを確認します。 アクセスキー ID およびシークレットアクセスキーの値を記録します。ローカルマシンをインストールプログラムを実行するように設定する際にこれらの値を使用する必要があります。

重要クラスターのデプロイ時に、マルチファクター認証デバイスの使用中に生成した一時的なセッショントークンを使用して AWS に対する認証を行うことはできません。クラスターは継続的に現行の AWS 認証情報を使用して、クラスターの有効期間全体にわたって AWS リソースを作成するため、キーをベースとした有効期間の長い認証情報を使用する必要があります。

関連情報

-

インストール前に Cloud Credential Operator (CCO) を手動モードに設定する手順については、AWS の IAM の手動作成 について参照してください。このモードは、クラウドアイデンティティーおよびアクセス管理 (IAM) API に到達できない環境で使用するか、または管理者レベルの認証情報シークレットをクラスターの

kube-systemプロジェクトに保存する選択をしない場合に使用します。

4.2.5. IAM ポリシーと AWS 認証

デフォルトでは、インストールプログラムは、ブートストラップ、コントロールプレーン、およびコンピュートインスタンスのインスタンスプロファイルを作成し、クラスターの動作に必要な権限を付与します。

ただし、独自の IAM ロールを作成して、インストールプロセスの一部として指定できます。クラスターをデプロイするため、またはインストール後にクラスターを管理するために、独自のロールを指定する必要がある場合があります。以下に例を示します。

- 組織のセキュリティーポリシーでは、より制限的なアクセス許可セットを使用してクラスターをインストールする必要があります。

- インストール後、クラスターは、追加サービスへのアクセスを必要とする Operator で設定されます。

独自の IAM ロールを指定する場合は、次の手順を実行できます。

- デフォルトのポリシーから始めて、必要に応じて調整します。詳細については、「IAM インスタンスプロファイルのデフォルトのアクセス許可」を参照してください。

- AWS IAM Access Analyzer (Identity and Access Management Access Analyzer) を使用して、クラスターのアクティビティーに基づくポリシーテンプレートを作成します。詳細は、「AWS IAM Analyzer を使用してポリシーテンプレートの作成」を参照してください。

4.2.5.1. IAM インスタンスプロファイルのデフォルトのアクセス許可

デフォルトでは、インストールプログラムは、ブートストラップ、コントロールプレーン、およびワーカーインスタンスの IAM インスタンスプロファイルを作成し、クラスターの動作に必要な権限を付与します。

次のリストでは、コントロールプレーンとコンピュートマシンのデフォルトのアクセス許可を指定します。

例4.14 コントロールプレーンインスタンスのプロファイル向けデフォルト IAM ロールのパーミッション

-

ec2:AttachVolume -

ec2:AuthorizeSecurityGroupIngress -

ec2:CreateSecurityGroup -

ec2:CreateTags -

ec2:CreateVolume -

ec2:DeleteSecurityGroup -

ec2:DeleteVolume -

ec2:Describe* -

ec2:DetachVolume -

ec2:ModifyInstanceAttribute -

ec2:ModifyVolume -

ec2:RevokeSecurityGroupIngress -

elasticloadbalancing:AddTags -

elasticloadbalancing:AttachLoadBalancerToSubnets -

elasticloadbalancing:ApplySecurityGroupsToLoadBalancer -

elasticloadbalancing:CreateListener -

elasticloadbalancing:CreateLoadBalancer -

elasticloadbalancing:CreateLoadBalancerPolicy -

elasticloadbalancing:CreateLoadBalancerListeners -

elasticloadbalancing:CreateTargetGroup -

elasticloadbalancing:ConfigureHealthCheck -

elasticloadbalancing:DeleteListener -

elasticloadbalancing:DeleteLoadBalancer -

elasticloadbalancing:DeleteLoadBalancerListeners -

elasticloadbalancing:DeleteTargetGroup -

elasticloadbalancing:DeregisterInstancesFromLoadBalancer -

elasticloadbalancing:DeregisterTargets -

elasticloadbalancing:Describe* -

elasticloadbalancing:DetachLoadBalancerFromSubnets -

elasticloadbalancing:ModifyListener -

elasticloadbalancing:ModifyLoadBalancerAttributes -

elasticloadbalancing:ModifyTargetGroup -

elasticloadbalancing:ModifyTargetGroupAttributes -

elasticloadbalancing:RegisterInstancesWithLoadBalancer -

elasticloadbalancing:RegisterTargets -

elasticloadbalancing:SetLoadBalancerPoliciesForBackendServer -

elasticloadbalancing:SetLoadBalancerPoliciesOfListener -

kms:DescribeKey

例4.15 コンピュートインスタンスプロファイル向けデフォルト IAM ロールのパーミッション

-

ec2:DescribeInstances -

ec2:DescribeRegions

4.2.5.2. 既存の IAM ロールの指定

インストールプログラムがデフォルトのアクセス許可で IAM インスタンスプロファイルを作成できるようにする代わりに、install-config.yaml ファイルを使用して、コントロールプレーンとコンピュートインスタンスの既存の IAM ロールを指定できます。

前提条件

-

既存の

install-config.yamlファイルがある。

手順

コントロールプレーンマシンの既存のロールで

compute.platform.aws.iamRoleを更新します。コンピュートインスタンスの IAM ロールを含む

install-config.yamlファイルのサンプルcompute: - hyperthreading: Enabled name: worker platform: aws: iamRole: ExampleRoleコンピュートマシンの既存のロールで

controlPlane.platform.aws.iamRoleを更新します。コントロールプレーンインスタンスの IAM ロールを含む

install-config.yamlファイルのサンプルcontrolPlane: hyperthreading: Enabled name: master platform: aws: iamRole: ExampleRole- ファイルを保存し、OpenShift Container Platform クラスターのインストール時に参照します。

関連情報

- クラスターのデプロイ を参照してください。

4.2.5.3. AWS IAM Analyzer を使用してポリシーテンプレートの作成

コントロールプレーンとコンピュートインスタンスプロファイルに必要な最小限のアクセス許可セットは、クラスターが日常の運用のためにどのように設定されているかによって異なります。

クラスターインスタンスに必要なアクセス許可を決定する 1 つの方法は、IAM Access Analyzer (AWS Identity and Access Management Access Analyzer) を使用してポリシーテンプレートを作成することです。

- ポリシーテンプレートには、クラスターが指定された期間に使用したアクセス許可が含まれています。

- その後、テンプレートを使用して、きめ細かい権限を持つポリシーを作成できます。

手順

全体的なプロセスは次のようになります。

- CloudTrail が有効になっていることを確認します。CloudTrail は、ポリシーテンプレートの作成に必要な API 呼び出しを含め、AWS アカウントのすべてのアクションとイベントを記録します。詳細は、CloudTrail の操作 に関する AWS ドキュメントを参照してください。

- コントロールプレーンインスタンスのインスタンスプロファイルとコンピューティングインスタンスのインスタンスプロファイルを作成します。PowerUserAccess などの寛容なポリシーを各ロールに割り当ててください。詳細は、インスタンスプロファイルロールの作成 に関する AWS ドキュメントを参照してください。

- クラスターを開発環境にインストールし、必要に応じて設定します。クラスターが本番環境でホストするすべてのアプリケーションを必ずデプロイしてください。

- クラスターを徹底的にテストします。クラスターをテストすると、必要なすべての API 呼び出しがログに記録されることが保証されます。

- IAM Access Analyzer を使用して、各インスタンスプロファイルのポリシーテンプレートを作成します。詳細は、CloudTrail ログに基づいてポリシーを生成する ための AWS ドキュメントを参照してください。

- きめ細かいポリシーを作成し、各インスタンスプロファイルに追加します。

- 各インスタンスプロファイルから許容ポリシーを削除します。

- 新しいポリシーで既存のインスタンスプロファイルを使用して実稼働クラスターをデプロイします。

ポリシーに IAM 条件 を追加して、ポリシーをより制限し、組織のセキュリティー要件に準拠させることができます。

4.2.6. サポートされている AWS Marketplace リージョン

北米でオファーを購入したお客様は、AWS Marketplace イメージを使用して、OpenShift Container Platform クラスターをインストールすることができます。

このオファーはアメリカで購入する必要がありますが、サポートされるパーティションのいずれかにクラスターをデプロイできます。

- 公開

- GovCloud

AWS Marketplace イメージを使用した OpenShift Container Platform クラスターのデプロイは、AWS シークレットリージョンまたは中国リージョンではサポートされていません。

4.2.7. サポートされている AWS リージョン

OpenShift Container Platform クラスターを以下のリージョンにデプロイできます。

ベースクラスターリソースを削除するには、IAM ユーザーが領域 us-east-1 にアクセス許可 tag:GetResources を持っている必要があります。AWS API 要件の一部として、OpenShift Container Platform インストールプログラムはこのリージョンでさまざまなアクションを実行します。

4.2.7.1. AWS パブリックリージョン

以下の AWS パブリックリージョンがサポートされます。

-

af-south-1(Cape Town) -

ap-east-1(Hong Kong) -

ap-northeast-1(Tokyo) -

ap-northeast-2(Seoul) -

ap-northeast-3(Osaka) -

ap-south-1(Mumbai) -

ap-southeast-1(Singapore) -

ap-southeast-2(Sydney) -

ca-central-1(Central) -

eu-central-1(Frankfurt) -

eu-north-1(Stockholm) -

eu-south-1(Milan) -

eu-west-1(Ireland) -

eu-west-2(London) -

eu-west-3(Paris) -

me-south-1(Bahrain) -

sa-east-1(São Paulo) -

us-east-1(N. Virginia) -

us-east-2(Ohio) -

us-west-1(N. California) -

us-west-2(Oregon)

4.2.7.2. AWS GovCloud リージョン

以下の AWS GovCloud リージョンがサポートされます。

-

us-gov-west-1 -

us-gov-east-1

4.2.7.3. AWS C2S Secret リージョン

us-iso-east-1 リージョンがサポートされます。

4.2.7.4. AWS China リージョン

以下の AWS China リージョンがサポートされます。

-

cn-north-1(Beijing) -

cn-northwest-1(Ningxia)

4.2.8. 次のステップ

OpenShift Container Platform クラスターをインストールします。

4.3. AWS の IAM の手動作成

クラウドアイデンティティーおよびアクセス管理 (IAM) API に到達できない環境や、管理者がクラスター kube-system namespace に管理者レベルの認証情報シークレットを保存する選択をしない場合に、クラスターのインストール前に Cloud Credential Operator (CCO) を手動モードにすることができます。

4.3.1. 管理者レベルのシークレットを kube-system プロジェクトに保存する代替方法

Cloud Credential Operator (CCO) は、クラウドプロバイダーの認証情報を Kubernetes カスタムリソース定義 (CRD) として管理します。credentialsMode パラメーターの異なる値を install-config.yaml ファイルに設定し、組織のセキュリティー要件に応じて CCO を設定できます。

管理者レベルの認証情報シークレットをクラスターの kube-system プロジェクトに保存する選択をしない場合、OpenShift Container Platform をインストールする際に以下のいずれかのオプションを選択できます。

Amazon Web Services Security Token Service:

CCO ユーティリティー (

ccoctl) を使用して、Amazon Web Services Security Token Service (AWS STS) を設定できるようになりました。CCO ユーティリティーを使用して STS のクラスターを設定する場合、短期の権限に制限のあるセキュリティー認証情報を提供する IAM ロールをコンポーネントに割り当てます。注記このクレデンシャルストラテジーは、新しい OpenShift Container Platform クラスターでのみサポートされており、インストール中に設定する必要があります。この機能を使用するために、既存のクラスターが別のクレデンシャルストラテジーを使用するように再設定することはできません。

クラウド認証情報を手動で管理 します。

CCO の

credentialsModeパラメーターをManualに設定し、クラウド認証情報を手動で管理できます。手動モードを使用すると、クラスターに管理者レベルの認証情報を保存する必要なく、各クラスターコンポーネントに必要なパーミッションのみを指定できます。お使いの環境でクラウドプロバイダーのパブリック IAM エンドポイントへの接続がない場合も、このモードを使用できます。ただし、各アップグレードについて、パーミッションを新規リリースイメージを使用して手動で調整する必要があります。また、それらを要求するすべてのコンポーネントについて認証情報を手動で指定する必要があります。OpenShift Container Platform を mint モードでインストールした後に、管理者レベルの認証情報シークレットを削除 します。

credentialsModeパラメーターがMintに設定された状態で CCO を使用している場合、OpenShift Container Platform のインストール後に管理者レベルの認証情報を削除したり、ローテーションしたりできます。Mint モードは、CCO のデフォルト設定です。このオプションには、インストール時に管理者レベルの認証情報が必要になります。管理者レベルの認証情報はインストール時に、付与された一部のパーミッションと共に他の認証情報を生成するために使用されます。元の認証情報シークレットはクラスターに永続的に保存されません。

z-stream 以外のアップグレードの前に、認証情報のシークレットを管理者レベルの認証情報と共に元に戻す必要があります。認証情報が存在しない場合は、アップグレードがブロックされる可能性があります。

関連情報

-

CCO ユーティリティー (

ccoctl) を使用して AWS STS を使用するように CCO を設定する方法の詳細は、STS での手動モードの使用 を参照してください。

- OpenShift Container Platform のインストール後に管理者レベルの認証情報シークレットをローテーションするか、または削除する方法については、クラウドプロバイダーの認証情報のローテーションまたは削除 について参照してください。

- 利用可能なすべての CCO 認証情報モードとそれらのサポートされるプラットフォームの詳細については、Cloud Credential Operator について 参照してください。

4.3.2. IAM の手動作成

Cloud Credential Operator (CCO) は、クラウドアイデンティティーおよびアクセス管理 (IAM) API に到達できない環境にインストールする前に手動モードに配置できます。管理者はクラスター kube-system namespace に管理者レベルの認証情報シークレットを保存しないようにします。

手順

インストールプログラムが含まれるディレクトリーに切り替え、以下のコマンドを実行して

install-config.yamlファイルを作成します。$ openshift-install create install-config --dir <installation_directory>

ここで、

<installation_directory>は、インストールプログラムがファイルを作成するディレクトリーに置き換えます。install-config.yaml設定ファイルを編集し、credentialsModeパラメーターがManualに設定されるようにします。サンプル

install-config.yaml設定ファイルapiVersion: v1 baseDomain: cluster1.example.com credentialsMode: Manual 1 compute: - architecture: amd64 hyperthreading: Enabled ...- 1

- この行は、

credentialsModeパラメーターをManualに設定するために追加されます。

マニフェストを生成するには、インストールプログラムが含まれるディレクトリーから以下のコマンドを実行します。

$ openshift-install create manifests --dir <installation_directory>

ここで、

<installation_directory>は、インストールプログラムがファイルを作成するディレクトリーに置き換えます。インストールプログラムが含まれるディレクトリーから、以下のコマンドを実行して、

openshift-installバイナリーがビルドされている OpenShift Container Platform リリースイメージの詳細を取得します。$ openshift-install version

出力例

release image quay.io/openshift-release-dev/ocp-release:4.y.z-x86_64

以下のコマンドを実行して、デプロイするクラウドをターゲットとするリリースイメージですべての

CredentialsRequestオブジェクトを見つけます。$ oc adm release extract quay.io/openshift-release-dev/ocp-release:4.y.z-x86_64 \ --credentials-requests \ --cloud=aws

このコマンドにより、それぞれの

CredentialsRequestオブジェクトに YAML ファイルが作成されます。サンプル

CredentialsRequestオブジェクトapiVersion: cloudcredential.openshift.io/v1 kind: CredentialsRequest metadata: name: <component-credentials-request> namespace: openshift-cloud-credential-operator ... spec: providerSpec: apiVersion: cloudcredential.openshift.io/v1 kind: AWSProviderSpec statementEntries: - effect: Allow action: - iam:GetUser - iam:GetUserPolicy - iam:ListAccessKeys resource: "*" ...以前に生成した

openshift-installマニフェストディレクトリーにシークレットの YAML ファイルを作成します。シークレットは、それぞれのCredentialsRequestオブジェクトについてspec.secretRefに定義される namespace およびシークレット名を使用して保存する必要があります。シークレットを含む

CredentialsRequestオブジェクトのサンプルapiVersion: cloudcredential.openshift.io/v1 kind: CredentialsRequest metadata: name: <component-credentials-request> namespace: openshift-cloud-credential-operator ... spec: providerSpec: apiVersion: cloudcredential.openshift.io/v1 kind: AWSProviderSpec statementEntries: - effect: Allow action: - s3:CreateBucket - s3:DeleteBucket resource: "*" ... secretRef: name: <component-secret> namespace: <component-namespace> ...サンプル

SecretオブジェクトapiVersion: v1 kind: Secret metadata: name: <component-secret> namespace: <component-namespace> data: aws_access_key_id: <base64_encoded_aws_access_key_id> aws_secret_access_key: <base64_encoded_aws_secret_access_key>

手動でメンテナンスされる認証情報を使用するクラスターをアップグレードする前に、CCO がアップグレード可能な状態であることを確認します。詳細は、クラウドプロバイダーのインストールコンテンツの手動でメンテナンスされる認証情報を使用したクラスターのアップグレードについてのセクションを参照してください。

4.3.3. 手動でメンテナンスされた認証情報を使用したクラスターのアップグレード

手動でメンテナンスされる認証情報をを含むクラスターの Cloud Credential Operator (CCO) の upgradable ステータスはデフォルトで false となります。

-

4.8 から 4.9 などのマイナーリリースの場合には、このステータスを使用することで、パーミッションを更新して

CloudCredentialリソースにアノテーションを付けてパーミッションが次のバージョンの要件に合わせて更新されていることを指定するまで、アップグレードができないようになります。このアノテーションは、UpgradableステータスをTrueに変更します。 - 4.9.0 から 4.9.1 などの z-stream リリースの場合には、パーミッションは追加または変更されないため、アップグレードはブロックされません。

手動でメンテナンスされる認証情報でクラスターをアップグレードする前に、アップグレードするリリースイメージ用に認証情報を新規作成する必要があります。さらに、既存の認証情報に必要なパーミッションを確認し、これらのコンポーネントの新規リリースの新しいパーミッション要件に対応する必要があります。

手順

新規リリースの

CredentialsRequestカスタムリソースを抽出して検査します。クラウドプロバイダーのインストールコンテンツの IAM の手動作成についてのセクションでは、クラウドに必要な認証情報を取得し、使用する方法について説明します。

クラスターで手動でメンテナンスされる認証情報を更新します。

-

新規リリースイメージによって追加される

CredentialsRequestカスタムリソースの新規のシークレットを作成します。 -

シークレットに保存される既存の認証情報の

CredentialsRequestカスタムリソースにパーミッション要件を変更した場合は、必要に応じてパーミッションを更新します。

-

新規リリースイメージによって追加される

新規リリースですべてのシークレットが正しい場合は、クラスターをアップグレードする準備が整っていることを示します。

-

cluster-adminロールを持つユーザーとして OpenShift Container Platform CLI にログインします。 CloudCredentialリソースを編集して、metadataフィールドにupgradeable-toアノテーションを追加します。$ oc edit cloudcredential cluster

追加するテキスト

... metadata: annotations: cloudcredential.openshift.io/upgradeable-to: <version_number> ...ここで、

<version_number>は、アップグレードするバージョン (x.y.z形式) に置き換えます。例: OpenShift Container Platform4.8.2(OpenShift Container Platform 4.8.2 の場合)アノテーションを追加してから、upgradeable のステータスが変更されるまで、数分かかる場合があります。

-

CCO がアップグレードできることを確認します。

- Web コンソールの Administrator パースペクティブで、Administration → Cluster Settings に移動します。

- CCO ステータスの詳細を表示するには、Cluster Operators 一覧で cloud-credential をクリックします。

-

Conditions セクションの Upgradeable ステータスが False の場合に、

upgradeable-toアノテーションに間違いがないことを確認します。

Conditions セクションの Upgradeable ステータスが True の場合には、OpenShift Container Platform のアップグレードを開始できます。

:_content-type: CONCEPT

4.3.4. mint モード

mint モードは、OpenShift Container Platform のデフォルトの Cloud Credential Operator (CCO) の認証情報モードです。このモードでは、CCO は提供される管理者レベルのクラウド認証情報を使用してクラスターを実行します。Mint モードは AWS と GCP でサポートされています。

mint モードでは、admin 認証情報は kube-system namespace に保存され、次に CCO によってクラスターの CredentialsRequest オブジェクトを処理し、特定のパーミッションでそれぞれのユーザーを作成するために使用されます。

mint モードには以下の利点があります。

- 各クラスターコンポーネントにはそれぞれが必要なパーミッションのみがあります。

- クラウド認証情報の自動の継続的な調整が行われます。これには、アップグレードに必要になる可能性のある追加の認証情報またはパーミッションが含まれます。

1 つの不利な点として、mint モードでは、admin 認証情報がクラスターの kube-system シークレットに保存される必要があります。

4.3.5. 管理者レベルの認証情報の削除またはローテーション機能を持つ mint モード

現時点で、このモードは AWS および GCP でのみサポートされます。

このモードでは、ユーザーは通常の mint モードと同様に管理者レベルの認証情報を使用して OpenShift Container Platform をインストールします。ただし、このプロセスはクラスターのインストール後の管理者レベルの認証情報シークレットを削除します。

管理者は、Cloud Credential Operator に読み取り専用の認証情報について独自の要求を行わせることができます。これにより、すべての CredentialsRequest オブジェクトに必要なパーミッションがあることの確認が可能になります。そのため、いずれかの変更が必要にならない限り、管理者レベルの認証情報は必要になりません。関連付けられた認証情報が削除された後に、必要な場合は、これは基礎となるクラウドで破棄するか、または非アクティブにできます。

z-stream 以外のアップグレードの前に、認証情報のシークレットを管理者レベルの認証情報と共に元に戻す必要があります。認証情報が存在しない場合は、アップグレードがブロックされる可能性があります。